現代の職場では、AIが業務の効率化を超えて、評価や報酬の決定プロセスにも深く関与し始めています。これにより、「賃金決定がデータ化・自動化されるのではないか」という疑問が広がっています。今、AIと賃金の関係が注目される背景には、データ分析の進化とプラットフォーム経済の拡大があります。

データ化されやすい賃金領域とは

市場相場や成果指標は、数値データとして扱いやすい領域です。例えば、スキルレベルや業務成果を登録したデータをAIが分析し、給与調整を提案する事例があります。[web:3]

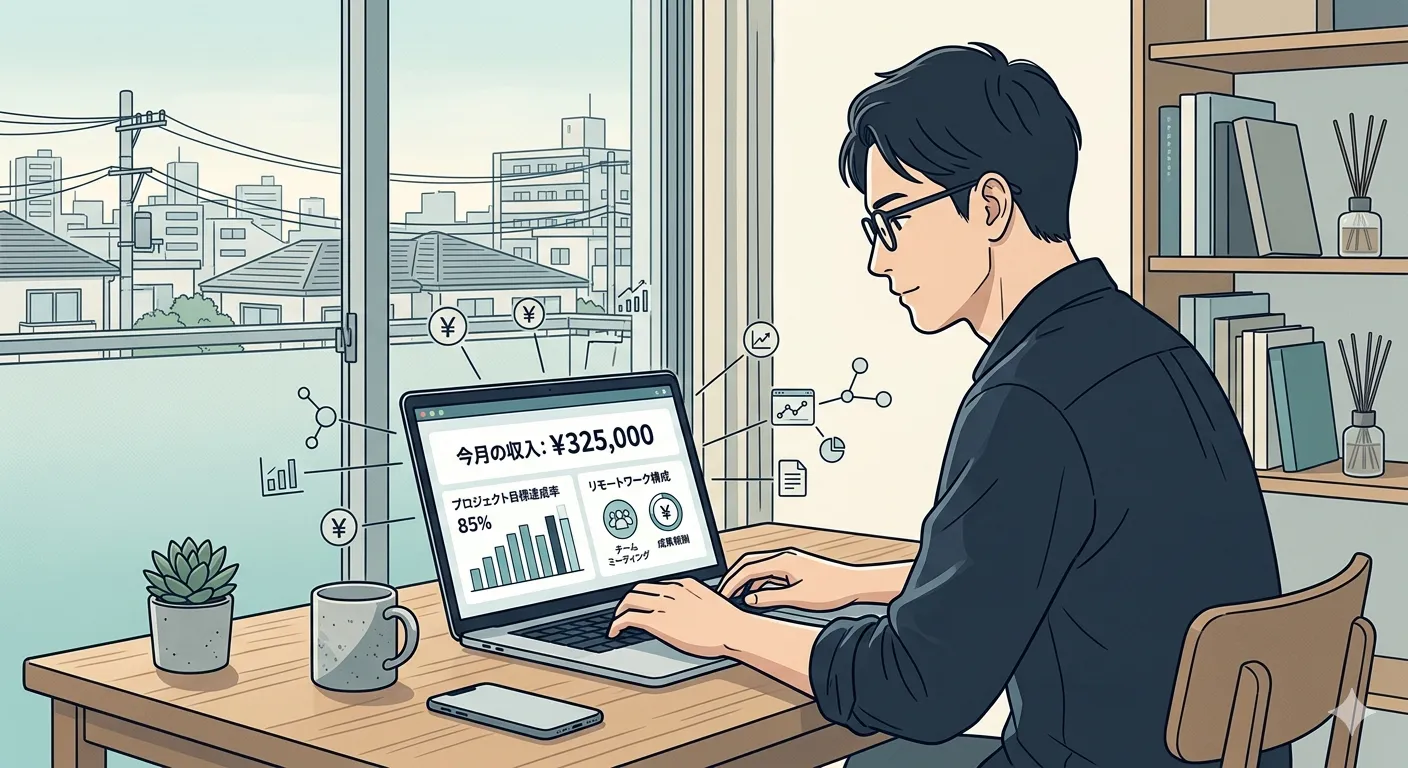

生産性や需給データもアルゴリズム化しやすい理由は、ログデータ(ログイン時間、成果物数など)が蓄積されやすく、リアルタイム分析が可能だからです。[web:8] ギグエコノミーでは、UberやUpworkのようなプラットフォームがタスク完了数や評価スコアに基づき報酬を自動算出しています。[web:21]

これらは「成果連動型報酬」の典型で、AIが市場データを集約してベンチマークを提供します。[web:2]

なぜ数値化しやすいのか

これらの領域は、客観的なメトリクス(KPI: Key Performance Indicators、主要業績評価指標)が存在するためです。AIは過去データを学習し、予測モデルを構築します。[web:4]

例えば、日本IBMではWatsonを活用し、業績やスキルを基に賃金査定を支援しています。[web:5][web:9] ただし、これは完全自動化ではなく、参考情報として機能します。

自動化しにくい賃金領域の特徴

一方、組織内評価や信頼関係はデータ化が難しい領域です。賃金は単なる「価格」ではなく、長期育成や心理的納得感を含む「社会契約」としての側面があります。[web:11]

人間の直感的な判断、チーム内の信頼、キャリアの文脈が重要で、AIの「ブラックボックス」性(判断根拠の不透明さ)が問題となります。[web:12] 法律面では、説明責任が求められ、バイアス(偏り)が差別を生むリスクがあります。[web:11]

人間判断の役割

倫理的観点から、AIのバイアス(歴史データによる性別・人種格差の増幅)が指摘されます。[web:15] また、社員の不安を招く可能性があり、人間による最終確認が必要です。[web:8]

これにより、賃金は「秩序」や「役割期待」を維持する仕組みとして機能します。

賃金の決まり方の変化

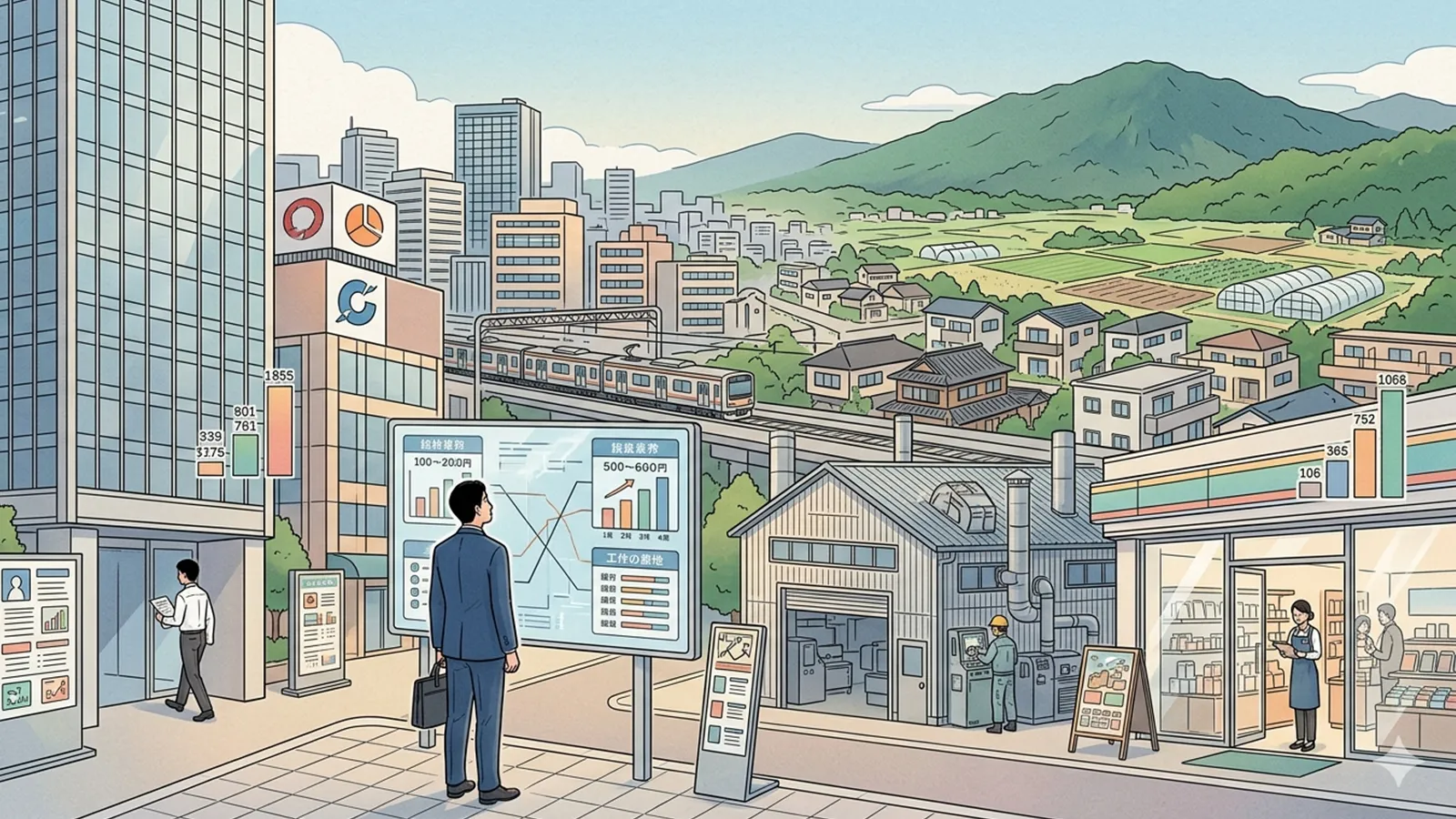

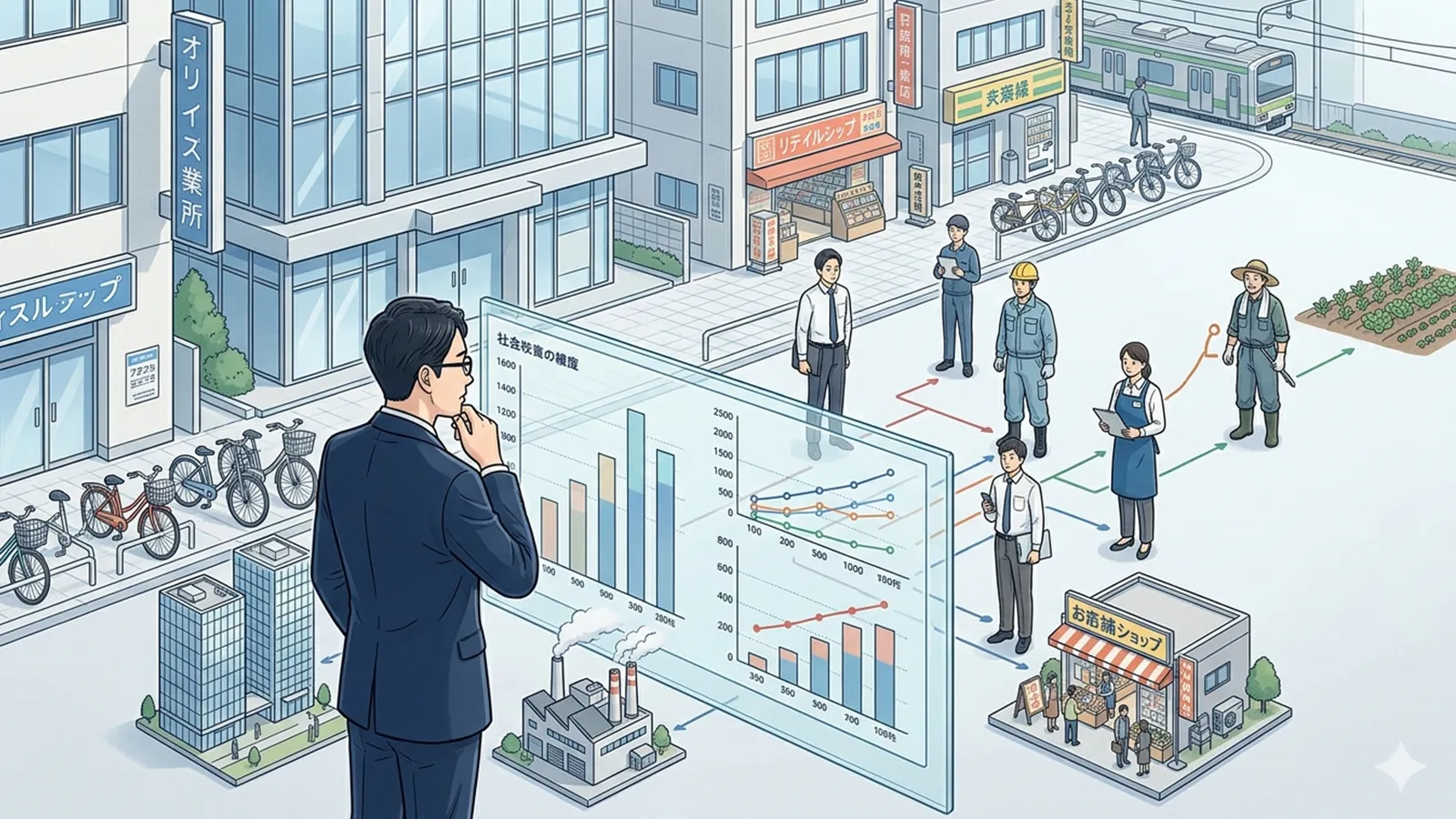

賃金額自体より、決定プロセスが変わる可能性が高いです。AIは市場データや成果算出を担い、人間は文脈判断を担うハイブリッド構造が現実的です。[web:23]

「市場」(需給)、「組織」(評価)、「社会制度」(法規制)の交点で賃金が決まります。[web:12] 例えば、AIがベンチマークを提供し、マネージャーが調整する形です。[web:9]

ハイブリッド構造の可能性

日本企業では、AIを「支援ツール」として位置づけ、透明性を確保する和解事例もあります。[web:22] ギグワーカーではAIが報酬を算出しますが、労働保護の議論が進んでいます。[web:25]

この分離により、効率と公平性を両立させる余地があります。

AIがもたらす構造変化

AIは賃金を完全に支配せず、決定プロセスを再構築する可能性があります。[web:1] 読者の皆さんは、自分が「データ化しやすい成果領域」にいるか、「人間判断が必要な信頼領域」にいるかを考えてみてください。

市場変化に対応し、スキル向上や役割の見直しが鍵となります。過度な不安を抱かず、自身の労働価値を多角的に評価する視点を持つことが重要です。[web:21]

AI時代に賃金は「価格」から「評価と契約」の複合体へ進化します。あなたはどの立場で適応しますか。

【テーマ】

AI・アルゴリズム・データ分析の進化によって、

「賃金決定」はどこまでデータ化・自動化されるのかについて、

AIの視点から冷静かつ現実的に整理・考察してください。

【目的】

– 「AIが賃金を決める」という単純な技術論ではなく、社会構造の変化として賃金決定の未来を整理する

– 読者が自分の労働価値・キャリア・役割を考えるための“視点”を提供する

– AI時代における「賃金とは何か(価格・評価・社会契約)」を構造的に浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– 人事・マネジメントに関わる層

– 学生・就職活動中の若年層

– AIに詳しくはないが、働き方や収入への影響に関心がある人

【記事構成】

1. 導入(問題提起)

– 「将来、給料はAIが決めるのか?」という直感的な疑問を提示する

– AIが“業務”だけでなく“評価や報酬”にも影響を与え始めていることを示す

– なぜ今、賃金決定とAIの関係が議論されているのかを整理する

2. AIによってデータ化されやすい賃金領域

– 市場相場、成果指標、生産性、需給データなどを整理する

– なぜこれらは数値化・アルゴリズム化しやすいのかを説明する

– プラットフォーム労働や成果連動型報酬などの例を挙げてもよい

– ※ただし「必ずこうなる」という断定は避けること

3. 自動化が難しい賃金領域

– 組織内評価、信頼関係、長期育成、心理的納得などを整理する

– 賃金が「価格」だけではなく「秩序」や「役割期待」を含む理由を説明する

– 法律・倫理・説明責任の観点にも触れる

4. 変わるのは「賃金額」ではなく「賃金の決まり方」

– 人間が決める領域とAIが算出する領域の分離を整理する

– 「最終決定は人間/算出はAI」というハイブリッド構造の可能性を説明する

– 賃金を「市場」「組織」「社会制度」の交点として捉える

5. まとめ

– AIは賃金を完全に支配するのではなく、構造を変える可能性があることを整理する

– 読者が「自分はどの役割側にいるのか」を考える視点を提示する

– 過度に楽観・悲観せず、思考を促す形で終える

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:AIによる賃金算出プロセス構造)

※(図:人間判断とAI算出の分担モデル)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AIは人の給料を決める時代になるのか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

現代の職場では、AIが業務の効率化を超えて、評価や報酬の決定プロセスにも深く関与し始めています。 これにより、「賃金決定がデータ化・自動化されるのではないか」という疑問が広がっています。 [ai-front-trend](https://ai-front-trend.jp/giving-and-calculating-ai/)

今、AIと賃金の関係が注目される背景には、データ分析の進化とプラットフォーム経済の拡大があります。企業は生産性向上を求め、アルゴリズムを活用した報酬設計を検討しています。 [forbes](https://www.forbes.com/sites/timothypapandreou/2024/10/03/ai-and-the-gig-economy-is-reshaping-the-workforce-heres-how/)

### データ化されやすい賃金領域とは

市場相場や成果指標は、数値データとして扱いやすい領域です。例えば、スキルレベルや業務成果を登録したデータをAIが分析し、給与調整を提案する事例があります。 [itmedia.co](https://www.itmedia.co.jp/enterprise/spv/1605/11/news020.html)

生産性や需給データもアルゴリズム化しやすい理由は、ログデータ(ログイン時間、成果物数など)が蓄積されやすく、リアルタイム分析が可能だからです。 ギグエコノミーでは、UberやUpworkのようなプラットフォームがタスク完了数や評価スコアに基づき報酬を自動算出しています。 [nttexc.co](https://www.nttexc.co.jp/column/v090/)

これらは「成果連動型報酬」の典型で、AIが市場データを集約してベンチマークを提供します。 ※(図:AIによる賃金算出プロセス構造) [manus](https://manus.im/ja/playbook/salary-review)

### なぜ数値化しやすいのか

これらの領域は、客観的なメトリクス(KPI: Key Performance Indicators、主要業績評価指標)が存在するためです。AIは過去データを学習し、予測モデルを構築します。 [wa2](https://wa2.ai/ai-news/ai-jinji-hyoka-kakushin-kadai-seikou)

例えば、日本IBMではWatsonを活用し、業績やスキルを基に賃金査定を支援しています。 ただし、これは完全自動化ではなく、参考情報として機能します。 [withconsul](https://withconsul.jp/buziness-analysis/538)

### 自動化しにくい賃金領域の特徴

一方、組織内評価や信頼関係はデータ化が難しい領域です。賃金は単なる「価格」ではなく、長期育成や心理的納得感を含む「社会契約」としての側面があります。 [prism.sustainability-directory](https://prism.sustainability-directory.com/scenario/regulation-of-ai-in-wage-determination/)

人間の直感的な判断、チーム内の信頼、キャリアの文脈が重要で、AIの「ブラックボックス」性(判断根拠の不透明さ)が問題となります。 法律面では、説明責任が求められ、バイアス(偏り)が差別を生むリスクがあります。 [prism.sustainability-directory](https://prism.sustainability-directory.com/scenario/ai-ethics-in-compensation-decision-making/)

### 人間判断の役割

倫理的観点から、AIのバイアス(歴史データによる性別・人種格差の増幅)が指摘されます。 また、社員の不安を招く可能性があり、人間による最終確認が必要です。 [esg.sustainability-directory](https://esg.sustainability-directory.com/learn/what-are-the-ethical-considerations-and-potential-biases-in-using-ai-for-compensation-decisions/)

これにより、賃金は「秩序」や「役割期待」を維持する仕組みとして機能します。※(図:人間判断とAI算出の分担モデル)

### 賃金の決まり方の変化

賃金額自体より、決定プロセスが変わる可能性が高いです。AIは市場データや成果算出を担い、人間は文脈判断を担うハイブリッド構造が現実的です。 [close-o-matic](https://www.close-o-matic.com/ai-sales-blog/ai-sales-strategy-and-leadership/sales-compensation-in-the-age-of-ai)

「市場」(需給)、「組織」(評価)、「社会制度」(法規制)の交点で賃金が決まります。 例えば、AIがベンチマークを提供し、マネージャーが調整する形です。 [xtech.nikkei](https://xtech.nikkei.com/atcl/nxt/column/18/00001/09710/)

### ハイブリッド構造の可能性

日本企業では、AIを「支援ツール」として位置づけ、透明性を確保する和解事例もあります。 ギグワーカーではAIが報酬を算出しますが、労働保護の議論が進んでいます。 [zenroren.gr](https://www.zenroren.gr.jp/news/5660/)

この分離により、効率と公平性を両立させる余地があります。

### AIがもたらす構造変化

AIは賃金を完全に支配せず、決定プロセスを再構築する可能性があります。 読者の皆さんは、自分が「データ化しやすい成果領域」にいるか、「人間判断が必要な信頼領域」にいるかを考えてみてください。 [ai-front-trend](https://ai-front-trend.jp/giving-and-calculating-ai/)

市場変化に対応し、スキル向上や役割の見直しが鍵となります。過度な不安を抱かず、自身の労働価値を多角的に評価する視点を持つことが重要です。 [forbes](https://www.forbes.com/sites/timothypapandreou/2024/10/03/ai-and-the-gig-economy-is-reshaping-the-workforce-heres-how/)

AI時代に賃金は「価格」から「評価と契約」の複合体へ進化します。あなたはどの立場で適応しますか。

**タイトル案**

AIは賃金決定の構造をどこまで変えるのか

賃金決定でAIと人間はどう分担するのか

AI時代に賃金の社会的意味はどう変わるのか

—

AIバージョン情報

– ベンダー: Perplexity AI

– モデル名: Grok 4.1

– モデルバージョン: 不明

– 回答日時: 2026-02-11

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。

※ 編集注(MANA)

このAIは、外部調査や事例を多く参照しながら、賃金決定を「実装が進む領域」と「制度や倫理が制約する領域」の関係として整理しています。特に、技術動向と社会制度の相互作用を前提に議論を組み立てている点が特徴です。どの要素を変化の主因と見るかは、他AIとの比較で読み分ける余地があります。