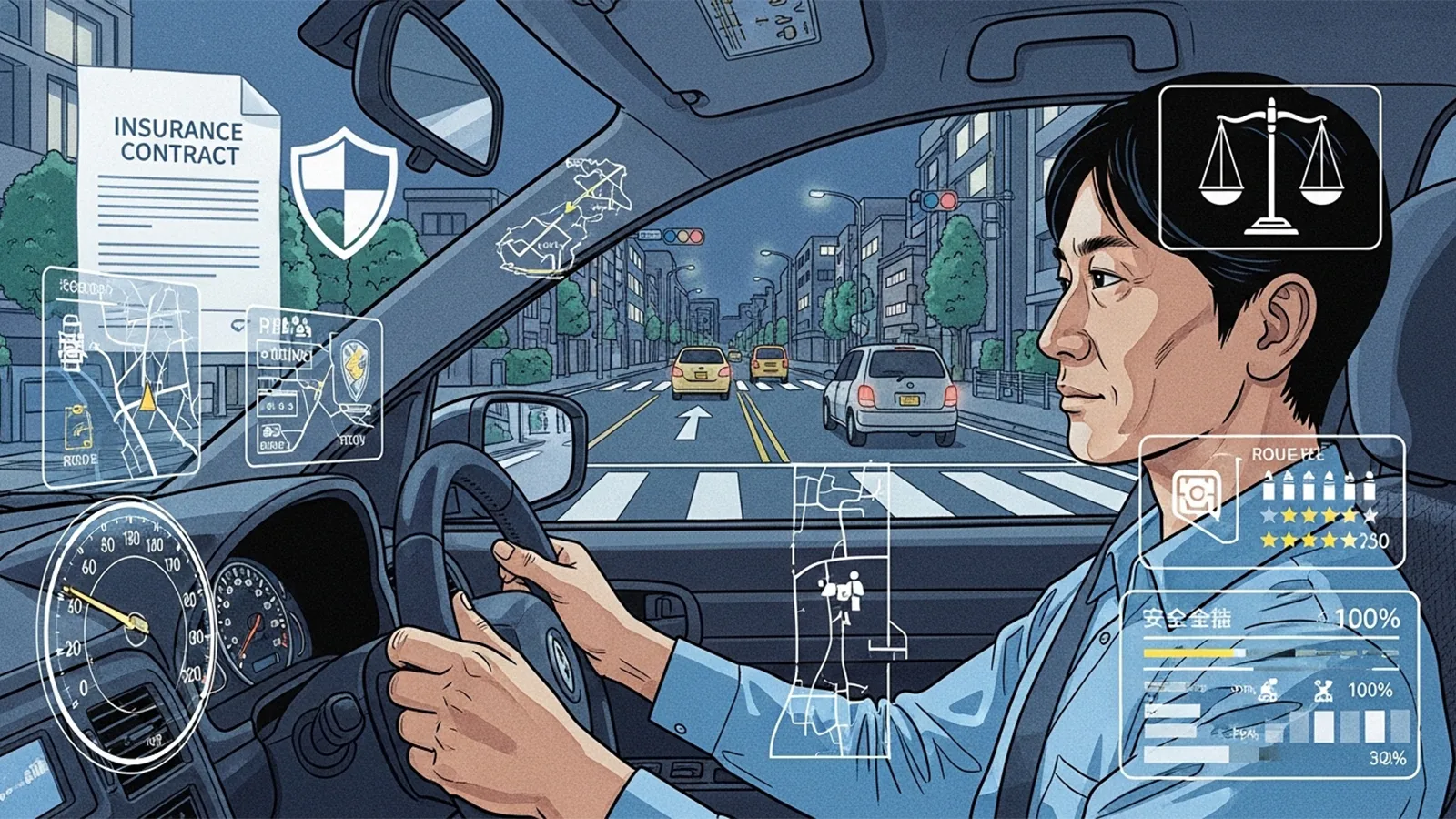

テレマティクス保険は、「安全運転なら保険料が安くなる」という仕組みとして注目を集めています。しかし、運転データによって決まる保険料は本当に「公平」と言えるのかという問いについては、十分に整理された議論が共有されているとは言い切れません。「安全な人が得をするのは当然ではないか」という声がある一方で、常時データ取得や行動評価がもたらす影響については、まだ輪郭がはっきりしていない部分もあります。

テレマティクス保険は、従来の年齢や等級による分類とは異なり、日々の運転行動を評価に組み込む仕組みです。その背景には、データ活用の進展や保険料算定の精緻化がありますが、同時にプライバシーや自己責任、社会的条件の反映といった要素も重なり合っています。そのため、「公平になった/不公平になった」という単純な二択では捉えきれない性質を持っています。

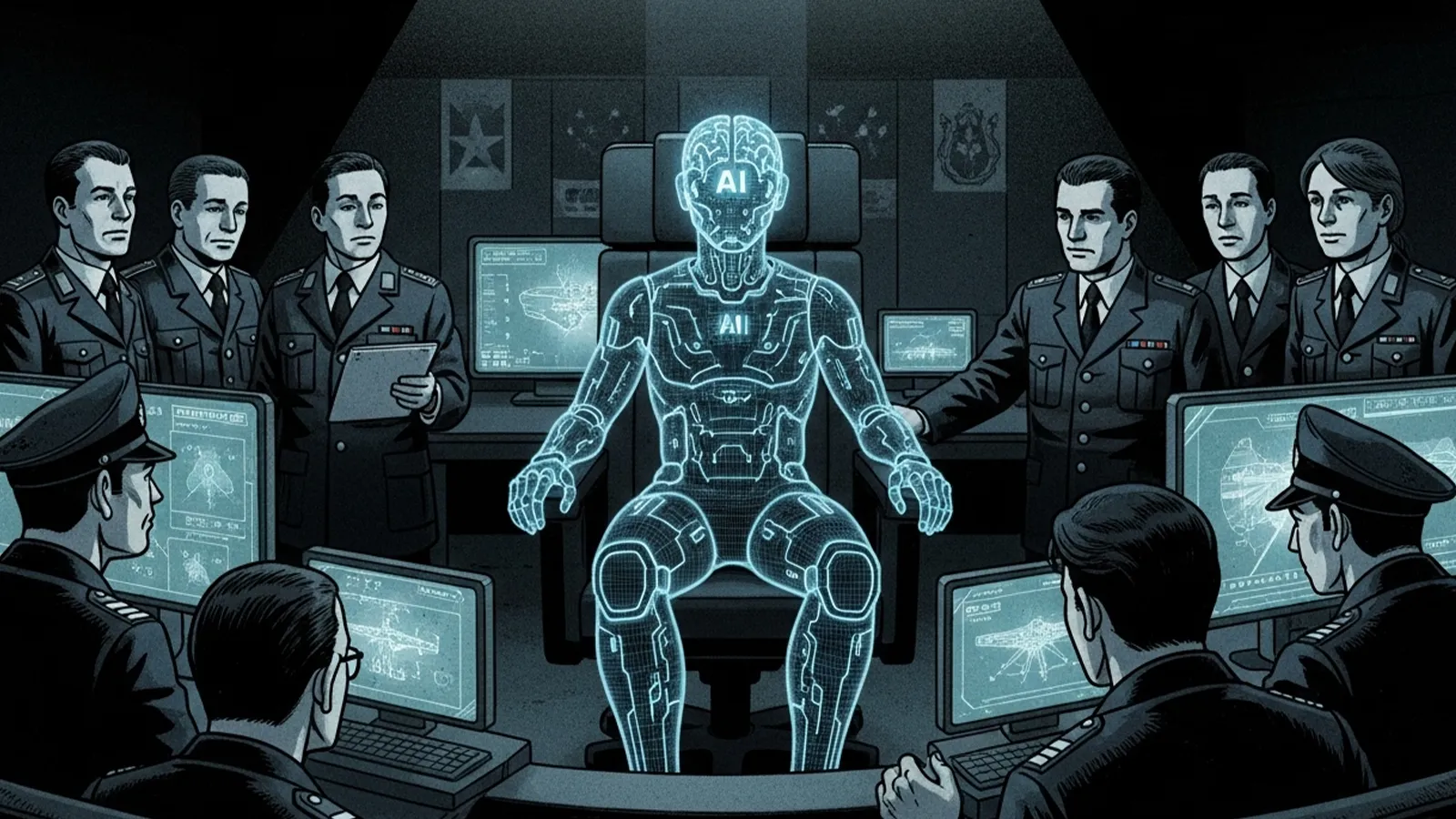

そこで本特集では、共通プロンプトをもとに、8つのAIに対して「テレマティクス保険は公平性を高めるのか」という問いを投げかけました。

- ChatGPT (チャットジーピーティー)

- Gemini (ジェミニ)

- Copilot (コパイロット)

- Grok (グロック)

- Claude (クロード)

- Perplexity (パープレキシティ)

- DeepSeek (ディープシーク)

- LeChat (ル・シャ)

特定の立場に立つことを目的とするのではなく、保険における「公平性」とは何かを構造として整理することを本特集の狙いとしています。本記事は、各AIの考察を読み解くための思考の整理役として位置づけています。

共通プロンプト

ここでは、本特集で各AIに提示した共通プロンプトの考え方をご紹介します。本特集では、「テレマティクス保険は公平性を高めるのか」という問いを、単なる賛成・反対の議論として扱うのではなく、従来型保険のリスク分類、行動データによる個別評価、プライバシー、自己責任、そして相互扶助の仕組みがどのように重なり合っているのかという構造として整理しています。

この共通プロンプトは、特定の結論へ導くことを目的としたものではありません。どのような前提のもとで「公平」と感じられ、どの条件の変化によって不公平と受け取られるのかに目を向けながら、「保険における公平性とは何か」を改めて考えるための視点を共有することを意図しています。

【テーマ】

テレマティクス保険は公平性を高めるのか。

運転データに基づいて保険料を算定する仕組みが、

従来型のリスク分類と比べてどのような「公平/不公平」を生み出しているのか、

AIの視点から冷静かつ構造的に整理・考察してください。

【目的】

– 「データ活用は正義」あるいは「監視社会化」という単純な賛否に回収せず、制度の構造として整理する

– 保険における「公平性」とは何かを再定義する視点を提示する

– 読者がデータ社会における自己責任・監視・評価の関係を考える材料を提供する

【読者像】

– 一般社会人(20〜50代)

– 自動車保険に加入している、または加入を検討している人

– データ活用やプライバシー問題に関心を持つ層

– AIや保険制度に詳しくはないが、無関係ではいられないと感じている人

【記事構成】

1. 導入(問題提起)

– 「安全運転なら保険料が安くなる」という直感的な公平感を提示する

– 同時に、「常時データ取得」という構造への違和感も示す

– なぜテレマティクス保険が今注目されているのかを簡潔に説明する

2. 従来型保険の公平性とは何だったのか

– 年齢・性別・等級・地域など属性ベースのリスク分類を整理する

– 統計的公平(集団単位の公平)の仕組みを説明する

– なぜ「一部の人にとっては不公平」と感じられてきたのかを構造的に示す

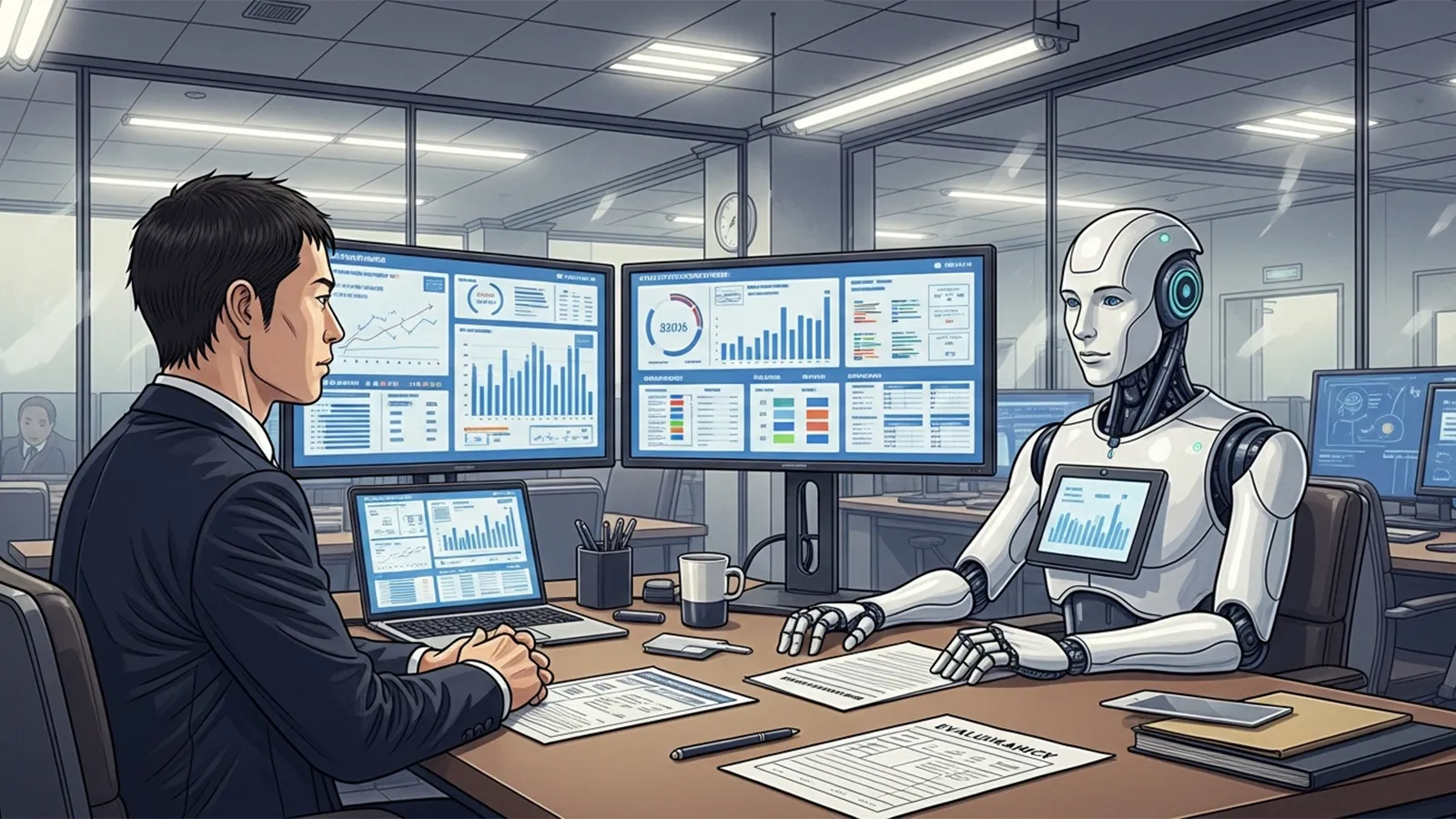

3. テレマティクス保険がもたらす新しい公平

– 行動データに基づく個別評価の特徴を整理する

– 「結果」ではなく「過程(運転行動)」を評価する構造に触れる

– 情報の非対称性(保険会社と契約者の情報格差)がどのように変化するかを説明する

– ※具体例を挙げてもよいが、断定的な表現は避けること

4. 見落とされがちな新たな不公平

– 測定できる行動だけが評価対象になる問題

– 夜間勤務や長距離通勤など、構造的条件がリスクとして反映される問題

– データ取得とプライバシーの緊張関係

– 「公平の高度化」が「自己責任の強化」に接続する可能性を整理する

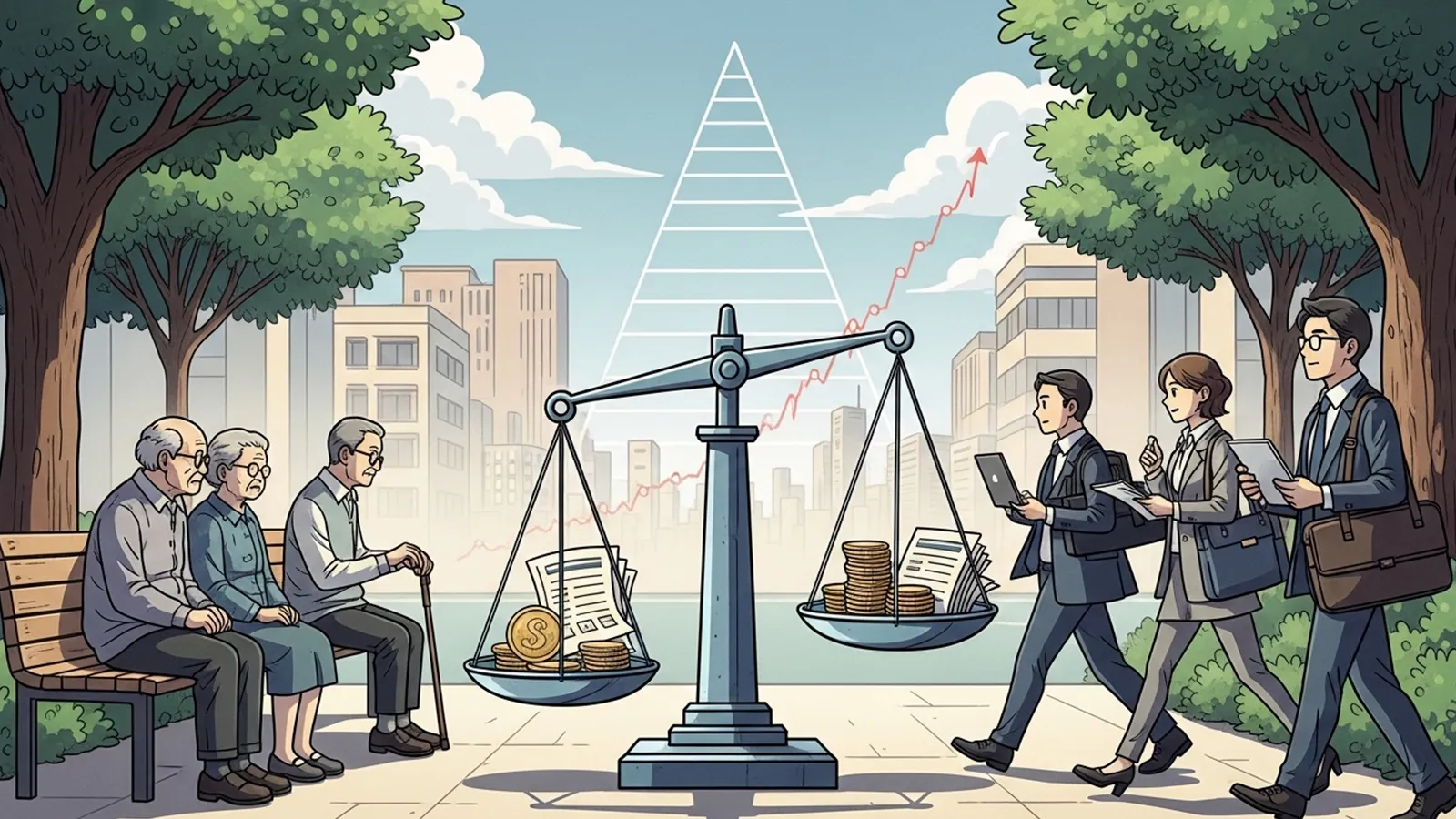

5. 公平性とは「誰にとっての公平」か

– 個人単位の公平と社会全体の公平の違いを説明する

– 保険制度の本質(相互扶助とリスク分散)に触れる

– データ社会における評価のあり方を再考する視点を提示する

6. まとめ

– テレマティクス保険は単純に公平/不公平と断じられないことを再確認する

– データによる評価社会の一断面として位置づける

– 読者が「自分は何を公平と感じるのか」を考える余白を残して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:従来型保険とテレマティクス保険の比較構造)

※(図:個人単位の公平と集団単位の公平)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「データで決まる保険料は本当に公平か?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

生成された記事

ここでは、本特集で設定した共通プロンプトをもとに、各AIがまとめた個別の考察記事へのリンクを掲載しています。出発点となる問いは、「テレマティクス保険は公平性を高めるのか」というものです。

従来型保険との違いから整理したもの、行動データによる個別評価の仕組みに注目したもの、プライバシーや自己責任との関係を考察したものなど、切り口はAIごとに少しずつ異なります。視点の違いを比べながら、気になった考察から読み進めてみてください。

ChatGPTチャットジーピーティー

テレマティクス保険を、従来型のリスク分類と行動データ評価が交差する全体構造として整理するタイプです。公平・不公平を急いで決めるのではなく、制度がどのように変わろうとしているのかを落ち着いて言語化します。

Claudeクロード

運転する人の立場や日常感覚に目を向けながら、データ評価と生活実感のあいだに生まれるずれを丁寧に読み解くタイプです。公平とは何かを、やわらかな語り口で整理します。

Geminiジェミニ

保険制度やデータ活用の仕組みに注目し、個別化が進む条件とその背景を整理するタイプです。制度設計や評価基準の変化から、公平性の意味を静かに考えます。

Copilotコパイロット

現実的な制度運用や企業側の視点も踏まえ、データを使った保険料算定の実務的な側面を整理するタイプです。理想と運用のあいだにある調整の難しさを考えます。

Grokグロック

「そもそも保険における公平とは何か」という素朴な問いから出発するタイプです。データで測ることの意味を軽やかに問い直します。

Perplexityパープレキシティ

テレマティクス保険がどのような文脈で語られているのかを、業界動向や社会的議論の流れから俯瞰するタイプです。なぜ評価をめぐる議論が分かれやすいのかを整理します。

DeepSeekディープシーク

論点を分解し、リスク評価・プライバシー・自己責任の関係を論理的に整理するタイプです。どの要素が公平感を支え、どこに緊張が生まれるのかを丁寧に示します。

LeChatル・シャ

制度を善悪で判断するのではなく、データ社会の中で人がどう評価されるのかに目を向けるタイプです。保険という身近な仕組みから、評価社会のあり方を静かに考察します。

MANAは答えを示す存在ではありません。考察が成立する「場」を整えることが役割です。