今や、企業や個人の情報はクラウドやアプリを通じて常にネットワーク上に存在しています。サイバー攻撃の手口は高度化し、人間の目や手だけでは防ぎきれない時代です。こうした状況の中で、AI(人工知能)によるセキュリティ対策が広がっています。AIが不審な通信を検知し、自動で防御する仕組みは、まるで「24時間稼働するデジタルの番人」のようです。一方で、「AIが守ってくれる」安心感と同時に、「AIの誤判断によって自分が排除されるかもしれない」という不安も生まれています。たとえばSNSアカウントの誤凍結や正当な通信の遮断など、人間が説明できないブラックボックス的な判断が日常になりつつあります。ここに、セキュリティAIをめぐる根本的な問いが存在します。それは技術の問題なのか、それとも社会の設計の問題なのかということです。

防御としてのセキュリティAI

AIがセキュリティ分野で注目される理由の一つは、「未知の攻撃」に対応できる点です。従来のセキュリティは、既知の攻撃データ(シグネチャ)に基づいて防御を行う「シグネチャ型」が主流でした。しかし、新たなマルウェアやゼロデイ攻撃には対応が遅れるという弱点がありました。

そこで登場したのが「行動分析型」AIです。これは、通信の振る舞いや利用者の行動パターンを学習し、異常を自動検出します。たとえば、普段とは異なるログイン場所や時間をAIが検知すると、不正アクセスと判断して一時的に遮断するといった仕組みです。

さらに、攻撃者側もAIを活用して防御を突破しようとします。AIが防御を強化すれば、攻撃AIもそれを学び、攻撃手法を洗練させる――いわば「AI対AIの攻防戦」が進行しています。この構造的な対抗関係の中で、AIによる自動防御はもはや必須インフラとなりつつあります。

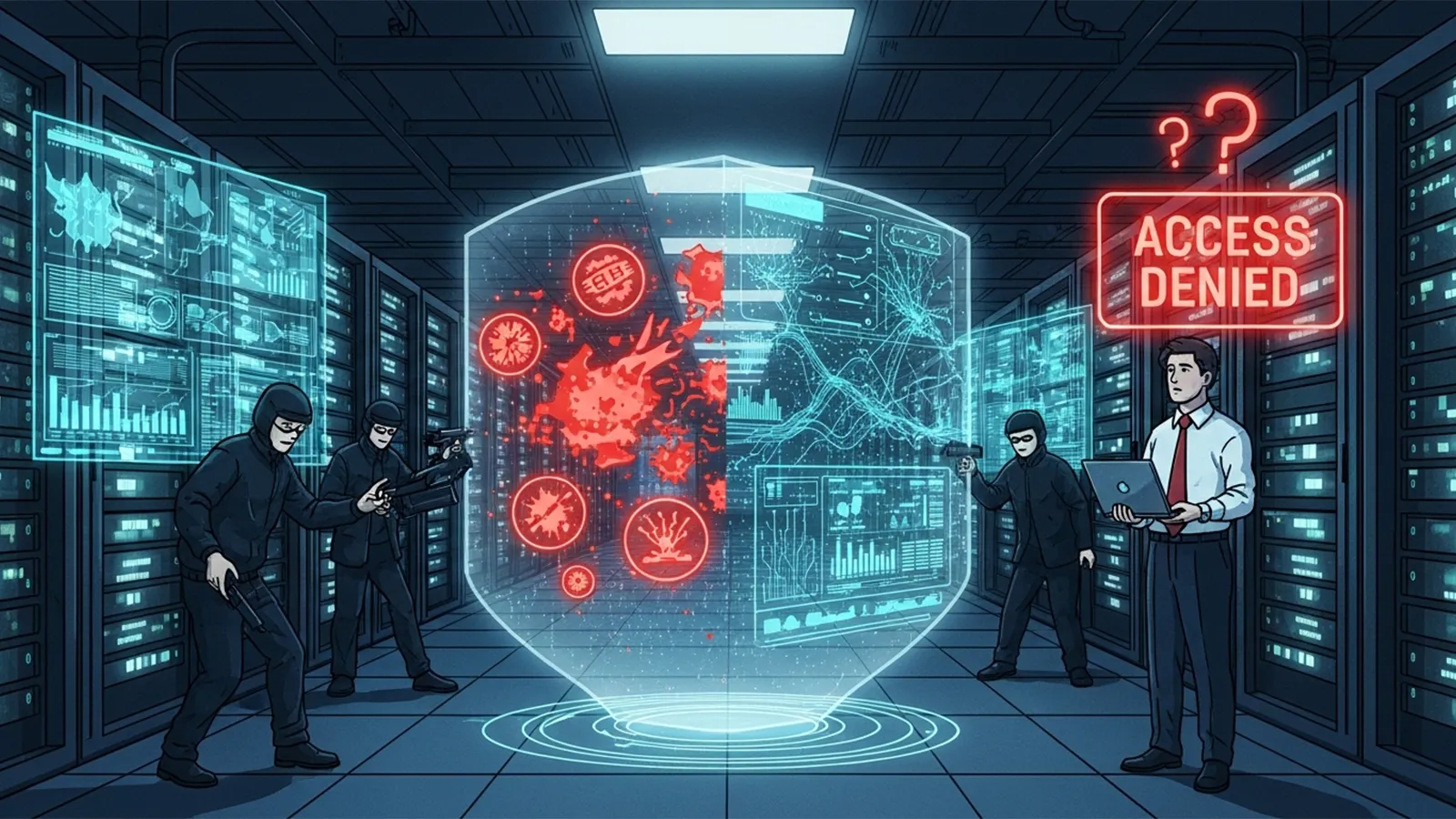

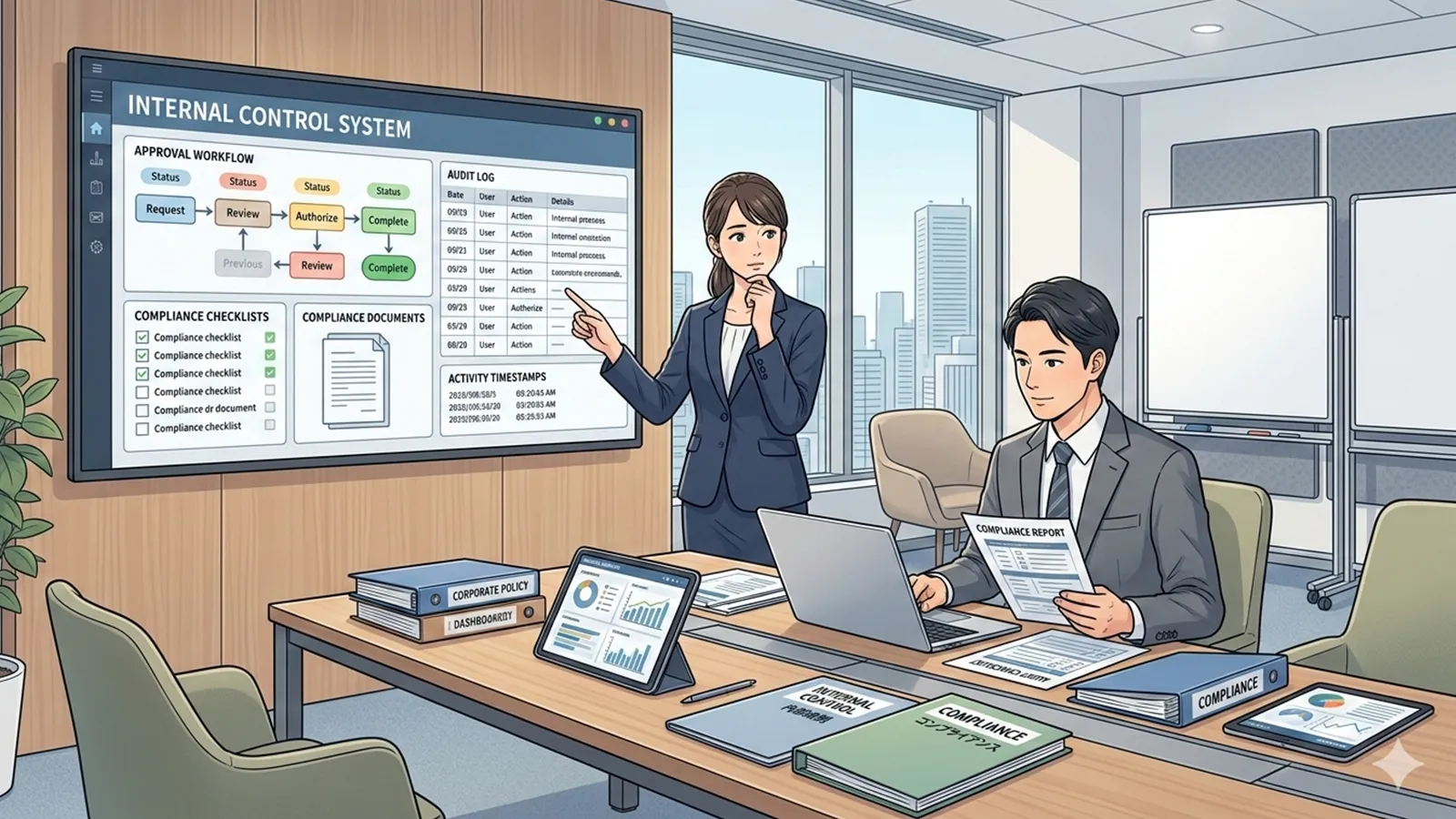

※(図:セキュリティAIの防御と誤検知の構造)

誤検知と排除のリスク

とはいえ、AIによる自動防御にはもう一つの側面があります。それが「誤検知(False Positive)」です。本来は安全なデータや行動を「危険」と誤って判断してしまうことを指します。

たとえば、安全な社内システムへのアクセスが突然ブロックされたり、正規ユーザーのメールがスパム扱いされるといったケースです。誤検知が頻発すると、業務の停滞や顧客の不信につながるだけでなく、利用者の行動そのものが制約されることになります。

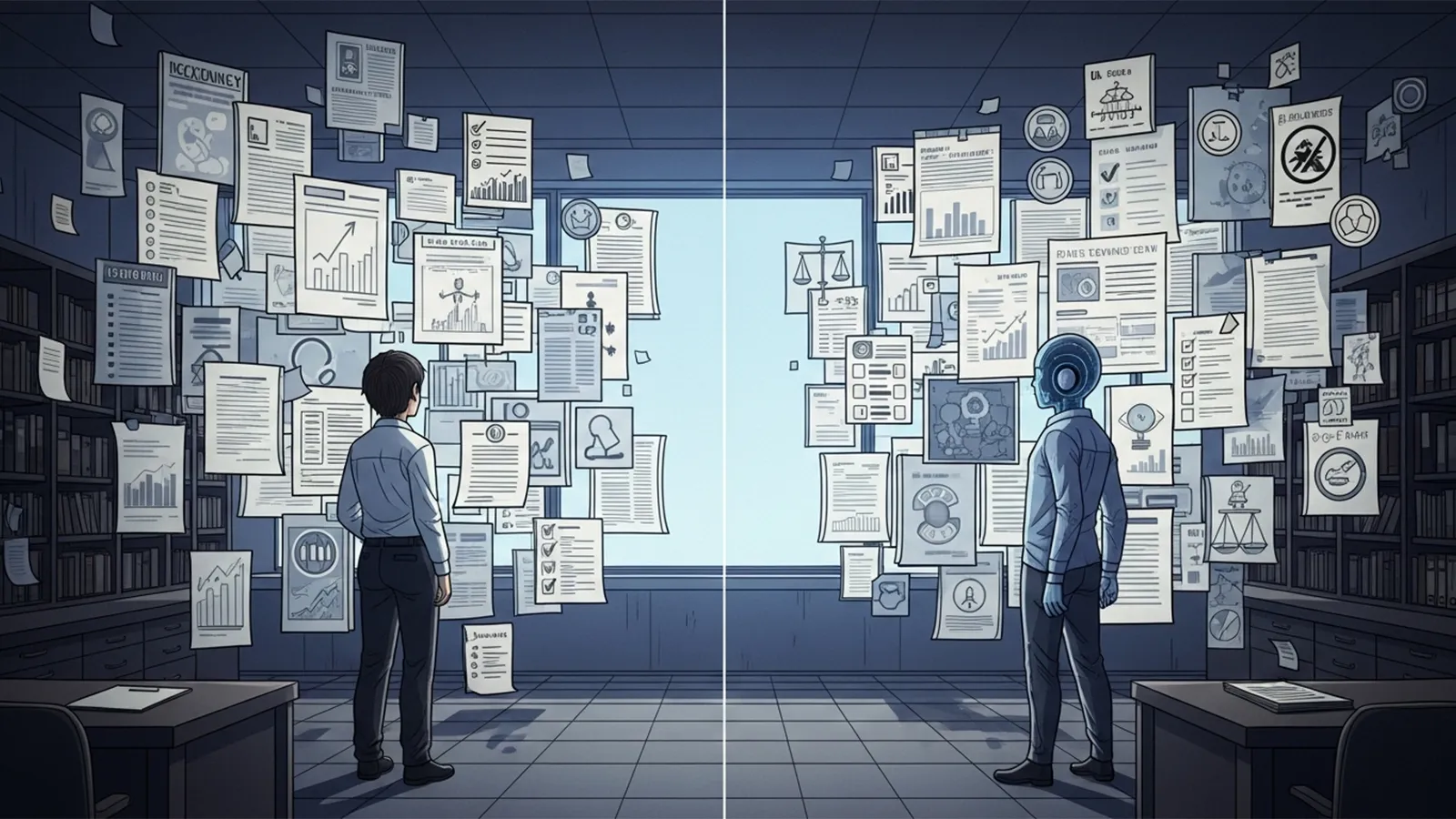

このとき問題を難しくしているのが、AIの「ブラックボックス化」です。AIがどの基準で「不審」と判断したのかを明確に説明できない場合、誤検知が起きても原因を特定できません。すると、「自動防御」は容易に「自動排除」へと転化します。守るための仕組みが、結果として「正当なものを排除する力」を持ち得る――ここにセキュリティAIの本質的なジレンマがあります。

問題は技術か、それとも統治設計か

このジレンマを解くためには、技術そのものよりも「統治」と「運用設計」の視点が重要です。AIの判断には必ず閾値(しきい値)設定があり、「どの程度の異常を危険とみなすか」は開発者や運用者の設計思想によって決まります。つまり、AIは中立ではなく、人間の判断方針を技術的に実装した存在なのです。

そのため、一度誤検知が起きた際に「AIがそう判断したから」として責任を免れる体制では問題が解決しません。運用責任者が判断結果をレビューしたり、ユーザーが異議申し立てを行える制度設計が不可欠です。こうした透明性と再審の仕組みがなければ、AIの防御システムは「自動排除装置」に変質してしまいます。

また、国家・企業・プラットフォームそれぞれのレベルで統治設計の課題も異なります。国家では監視と自由のバランスが問われ、企業では顧客体験との両立、SNSやクラウドでは利用規約とアルゴリズム運用の透明性が焦点になります。最終的に、セキュリティAIを「どう位置づけるか」は、社会がどのような価値を優先するかという設計思想の問題です。

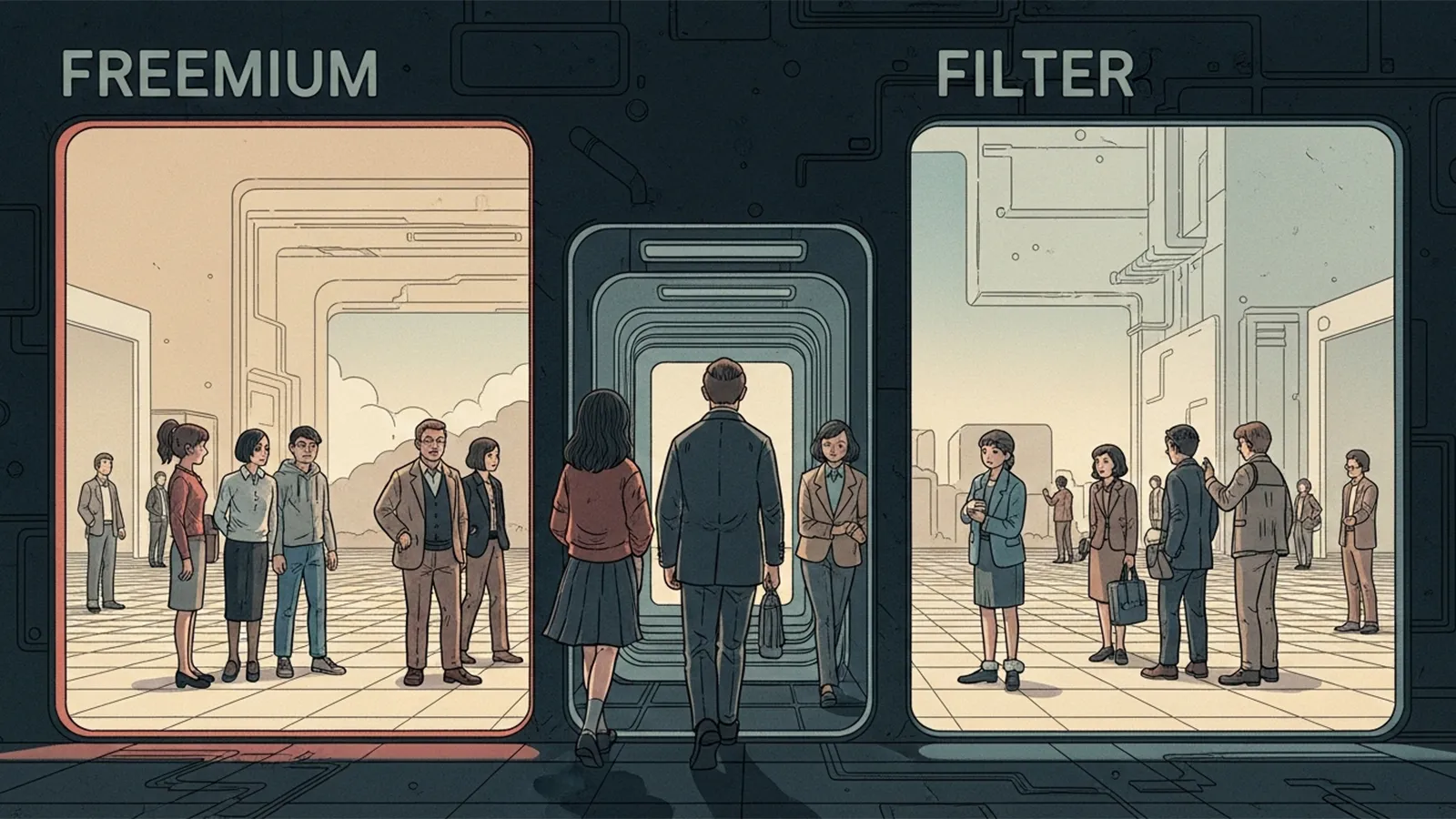

※(図:自動判断と責任主体の関係図)

まとめ:AIをどう使い、どう責任を持つか

セキュリティAIは、防御の要であると同時に、新たなリスクの源でもあります。AIによって脅威を自動で防げる一方で、その自動化が誤検知や排除を引き起こし、説明責任の空洞化を招く可能性もあるのです。

大切なのは、「使うか使わないか」ではなく、「どう設計し、どう責任を持つか」です。AIを盲目的に信じることも、全面的に否定することもなく、私たちがその仕組みと限界を理解したうえで運用を問い直すことが求められます。

読者の皆さんにとって重要なのは、「AIが判断する」という言葉の背後に、必ず「人の設計意図」と「社会のルール」があるという事実です。セキュリティAIの未来は、その透明性と責任の設計にかかっています。

【テーマ】

セキュリティAIは「防御装置」なのか、それとも「誤検知リスクを内包する自動判断システム」なのか。

AIによるセキュリティ対策の進化と、その副作用としての誤検知・排除・ブラックボックス化の問題について、構造的に整理・考察してください。

【目的】

– セキュリティAIを「万能の防御」または「危険な監視装置」と単純化せず、両面性を整理する

– 技術論だけでなく、運用・責任・統治設計の観点を提示する

– 読者が「AIに任せることの意味」を自分で考えるための視点を提供する

【読者像】

– 一般社会人(20〜50代)

– ITやAIに詳しくはないが、日常的にデジタルサービスを利用している層

– 企業の情報セキュリティやアカウント凍結、誤検知に関心を持つ人

– AIによる自動判断に漠然とした不安や期待を抱いている人

【記事構成】

1. 導入(問題提起)

– サイバー攻撃の高度化とAI活用の現状を簡潔に提示する

– 「AIが守ってくれる」という期待と、「AIに誤って排除されるかもしれない」という不安を提示する

– なぜセキュリティAIが単なる技術問題ではないのかを示す

2. 防御としてのセキュリティAI

– 従来型セキュリティとの違い(シグネチャ型と行動分析型など)を簡潔に整理する

– 未知の攻撃や大規模データ処理への対応力を説明する

– 攻撃側もAIを使うという構造的対抗関係に触れる

– 防御インフラとしての必要性を冷静に整理する

3. 誤検知と排除のリスク

– 誤検知(False Positive)の概念を簡潔に説明する

– 正常なユーザーや業務が遮断される可能性を整理する

– ブラックボックス化や説明困難性の問題に触れる

– 「自動防御」が「自動排除」に変わる構造を説明する

4. 問題は技術か、それとも統治設計か

– 閾値設定・運用責任・異議申し立て制度の重要性を整理する

– 「AIが判断した」という言葉が責任を曖昧にする構造を指摘する

– 国家レベル、企業レベル、プラットフォームレベルの違いに簡潔に触れる

– セキュリティAIをどう位置づけるかは設計思想次第であることを示す

5. まとめ

– セキュリティAIは防御でもあり、リスクでもあるという二面性を再確認する

– 問題は「使うか使わないか」ではなく「どう設計し、どう責任を持つか」であることを提示する

– 過度に楽観・悲観せず、読者が自分なりに考える余白を残して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「恐怖を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:セキュリティAIの防御と誤検知の構造)

※(図:自動判断と責任主体の関係図)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「3年後、あなたの仕事は残っているか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

### 1. 導入:AIが守る安心と、その裏にある不安

今や、企業や個人の情報はクラウドやアプリを通じて常にネットワーク上に存在しています。サイバー攻撃の手口は高度化し、人間の目や手だけでは防ぎきれない時代です。こうした状況の中で、AI(人工知能)によるセキュリティ対策が広がっています。AIが不審な通信を検知し、自動で防御する仕組みは、まるで「24時間稼働するデジタルの番人」のようです。

一方で、「AIが守ってくれる」安心感と同時に、「AIの誤判断によって自分が排除されるかもしれない」という不安も生まれています。たとえばSNSアカウントの誤凍結や正当な通信の遮断など、人間が説明できないブラックボックス的な判断が日常になりつつあります。ここに、セキュリティAIをめぐる根本的な問いが存在します。それは技術の問題なのか、それとも社会の設計の問題なのかということです。

***

### 2. 防御としてのセキュリティAI

AIがセキュリティ分野で注目される理由の一つは、「未知の攻撃」に対応できる点です。従来のセキュリティは、既知の攻撃データ(シグネチャ)に基づいて防御を行う「シグネチャ型」が主流でした。しかし、新たなマルウェアやゼロデイ攻撃には対応が遅れるという弱点がありました。

そこで登場したのが「行動分析型」AIです。これは、通信の振る舞いや利用者の行動パターンを学習し、異常を自動検出します。たとえば、普段とは異なるログイン場所や時間をAIが検知すると、不正アクセスと判断して一時的に遮断するといった仕組みです。

さらに、攻撃者側もAIを活用して防御を突破しようとします。AIが防御を強化すれば、攻撃AIもそれを学び、攻撃手法を洗練させる――いわば「AI対AIの攻防戦」が進行しています。この構造的な対抗関係の中で、AIによる自動防御はもはや必須インフラとなりつつあります。

※(図:セキュリティAIの防御と誤検知の構造)

***

### 3. 誤検知と排除のリスク

とはいえ、AIによる自動防御にはもう一つの側面があります。それが「誤検知(False Positive)」です。本来は安全なデータや行動を「危険」と誤って判断してしまうことを指します。

たとえば、安全な社内システムへのアクセスが突然ブロックされたり、正規ユーザーのメールがスパム扱いされるといったケースです。誤検知が頻発すると、業務の停滞や顧客の不信につながるだけでなく、利用者の行動そのものが制約されることになります。

このとき問題を難しくしているのが、AIの「ブラックボックス化」です。AIがどの基準で「不審」と判断したのかを明確に説明できない場合、誤検知が起きても原因を特定できません。すると、「自動防御」は容易に「自動排除」へと転化します。守るための仕組みが、結果として「正当なものを排除する力」を持ち得る――ここにセキュリティAIの本質的なジレンマがあります。

***

### 4. 問題は技術か、それとも統治設計か

このジレンマを解くためには、技術そのものよりも「統治」と「運用設計」の視点が重要です。AIの判断には必ず閾値(しきい値)設定があり、「どの程度の異常を危険とみなすか」は開発者や運用者の設計思想によって決まります。つまり、AIは中立ではなく、人間の判断方針を技術的に実装した存在なのです。

そのため、一度誤検知が起きた際に「AIがそう判断したから」として責任を免れる体制では問題が解決しません。運用責任者が判断結果をレビューしたり、ユーザーが異議申し立てを行える制度設計が不可欠です。こうした透明性と再審の仕組みがなければ、AIの防御システムは「自動排除装置」に変質してしまいます。

また、国家・企業・プラットフォームそれぞれのレベルで統治設計の課題も異なります。国家では監視と自由のバランスが問われ、企業では顧客体験との両立、SNSやクラウドでは利用規約とアルゴリズム運用の透明性が焦点になります。最終的に、セキュリティAIを「どう位置づけるか」は、社会がどのような価値を優先するかという設計思想の問題です。

※(図:自動判断と責任主体の関係図)

***

### 5. まとめ:AIをどう使い、どう責任を持つか

セキュリティAIは、防御の要であると同時に、新たなリスクの源でもあります。AIによって脅威を自動で防げる一方で、その自動化が誤検知や排除を引き起こし、説明責任の空洞化を招く可能性もあるのです。

大切なのは、「使うか使わないか」ではなく、「どう設計し、どう責任を持つか」です。AIを盲目的に信じることも、全面的に否定することもなく、私たちがその仕組みと限界を理解したうえで運用を問い直すことが求められます。

読者の皆さんにとって重要なのは、「AIが判断する」という言葉の背後に、必ず「人の設計意図」と「社会のルール」があるという事実です。セキュリティAIの未来は、その透明性と責任の設計にかかっています。

***

## タイトル案

1. セキュリティAIは誰を守り誰を排除するのか

2. AIによる防御はどこまで信頼できるのか

3. 自動防御の時代に人の責任はどこにあるのか

***

AIバージョン情報

– ベンダー: Perplexity AI

– モデル名: GPT-5

– モデルバージョン: 不明

– 回答日時: 2026年2月24日

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。