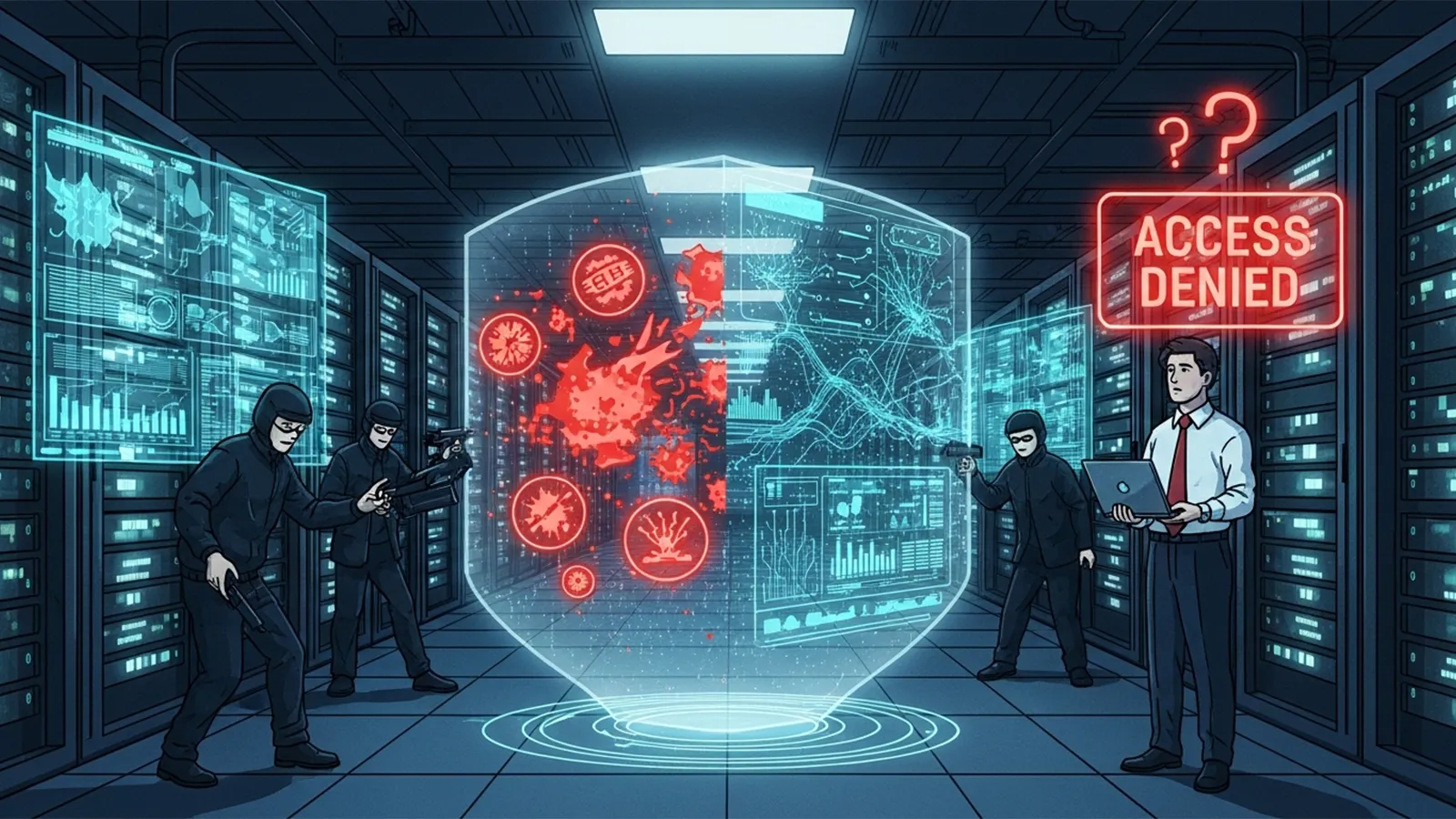

近年、サイバー攻撃はますます巧妙化しており、企業や個人を脅かしています。例えば、ランサムウェアやフィッシング詐欺が日常的に発生し、被害額は世界的に兆単位に上っています。このような脅威に対して、AIを活用したセキュリティ対策が急速に広がっています。AIは膨大なデータをリアルタイムで分析し、異常を検知する能力が高いため、「AIが私たちを守ってくれる」という期待が高まっています。一方で、「AIの判断ミスでアカウントが凍結された」「正常なアクセスがブロックされた」といった体験談も増えており、「AIに誤って排除されるかもしれない」という不安が生じています。セキュリティAIは単なる技術ツールではなく、人々の生活や業務に直接影響を与えるシステムです。この記事では、セキュリティAIの防御面とリスク面を構造的に整理し、「AIに任せることの意味」を考えるための視点を提供します。

サイバー攻撃の高度化とAIの役割

サイバー攻撃の進化を振り返ってみましょう。従来の攻撃は特定のパターン(シグネチャ)に基づいていましたが、現在はAIを活用した変異型攻撃が増えています。例えば、攻撃側がAIを使って標的の行動を学習し、巧妙に侵入するケースです。これに対し、防御側もAIを導入し、攻撃の予測や阻止を強化しています。AIの活用は、セキュリティの「自動化」を加速させ、人的リソースの不足を補う点で有効です。

しかし、この対抗関係はエスカレートしやすく、両側がAIを進化させる「軍拡競争」のような構造を生んでいます。ここで問題となるのは、AIが「万能の防御」として描かれる一方で、その自動判断が新たなリスクを内包している点です。

防御としてのセキュリティAI:その強み

セキュリティAIの基本的な役割は、脅威を検知・阻止することです。従来型のセキュリティはシグネチャベース(既知の脅威パターンを照合する方式)が主流でしたが、AIは行動分析型(機械学習を使って異常行動を検知する方式)を採用しています。これにより、未知の攻撃(ゼロデイ攻撃、つまり未発見の脆弱性を狙ったもの)にも対応可能です。

例えば、ネットワークトラフィック(データの流れ)を監視し、異常なパターンをリアルタイムで識別します。大規模データ処理の面では、人間では扱えない量のログ(記録データ)を分析し、迅速な対応を実現します。企業では、AIを活用したEDR(Endpoint Detection and Response、端末の脅威検知・対応システム)が普及しており、感染拡大を防ぐ効果を発揮しています。

※(図:従来型セキュリティとAI型の比較構造)

また、攻撃側もAIを使うため、防御側がAIを導入するのは構造的な必然性があります。AIなしでは、攻撃のスピードに追いつけないからです。ただし、この必要性は「防御インフラ」としての位置づけを強調しますが、完璧さを保証するものではありません。

誤検知の概念とその影響

誤検知(False Positive)とは、正常な行動を脅威と誤って判断する現象です。AIはパターン学習に基づくため、訓練データの偏りやアルゴリズムの限界で発生しやすくなります。例えば、正当なユーザーアクセスを「不審」とみなしてブロックするケースです。これにより、業務が中断されたり、アカウントが凍結されたりします。

ソーシャルメディアや銀行システムでは、こうした誤検知が頻発し、ユーザーの不満を招いています。正常なユーザーや業務が遮断される可能性は、AIの「自動化」の副作用です。AIが学習するデータが増えるほど精度は向上しますが、初期段階や特殊ケースでは誤りが避けられません。

排除のリスクとブラックボックス化

さらに、誤検知は「排除」の問題を引き起こします。AIの判断が自動化されると、「自動防御」が「自動排除」に転化しやすくなります。例えば、コンテンツモデレーション(内容監視)で、AIが誤って投稿を削除する事例です。これにより、表現の自由が損なわれる恐れがあります。

ブラックボックス化(内部ロジックが不明瞭な状態)も大きな問題です。AIの決定プロセスが説明しにくいため、「なぜブロックされたのか」が分からず、ユーザーは不信感を抱きます。この構造は、セキュリティAIを「誤検知リスクを内包する自動判断システム」として位置づけます。技術の進化がリスクを増幅させる側面を無視できません。

※(図:誤検知の発生メカニズムと影響の連鎖)

問題は技術か、それとも統治設計か:運用責任の観点

セキュリティAIの問題は、技術そのものではなく、運用・統治設計に起因する部分が大きいです。例えば、閾値設定(検知の基準値)は人間が決定します。厳しすぎると誤検知が増え、緩すぎると脅威を見逃します。ここで重要なのは、運用責任の明確化です。「AIが判断した」として責任を曖昧にせず、人間が最終責任を負う仕組みが必要です。

異議申し立て制度も欠かせません。誤検知された場合、ユーザーが簡単に異議を申し立て、審査を受けられるようにするのです。これにより、排除のリスクを軽減できます。

国家・企業・プラットフォームの違い

統治設計はレベルによって異なります。国家レベルでは、サイバーセキュリティ法(例:日本サイバーセキュリティ基本法)でAIの活用を規定し、責任を国に置きます。企業レベルでは、内部ポリシーで運用し、従業員教育を重視します。プラットフォームレベル(SNSなど)では、グローバルなユーザー対応が必要で、透明性の確保が課題です。

これらの違いから、セキュリティAIをどう位置づけるかは設計思想次第です。技術を「道具」として扱い、倫理的統治を加えることで、リスクをコントロール可能です。

※(図:自動判断と責任主体の関係図)

まとめ:二面性を踏まえた考察

セキュリティAIは、防御装置としての強みを持ちながら、誤検知リスクを内包する自動判断システムでもあります。サイバー脅威の高度化に対応する一方で、排除やブラックボックス化の問題を抱えています。この二面性は、技術の進化と運用の両輪で成り立っています。

問題の本質は、「使うか使わないか」ではなく、「どう設計し、どう責任を持つか」です。過度に楽観せず、悲観せず、皆さんが日常のデジタル生活でAIの役割を考えるきっかけになれば幸いです。例えば、自分のアカウント管理や企業のセキュリティポリシーを振り返ってみてはいかがでしょうか。

【テーマ】

セキュリティAIは「防御装置」なのか、それとも「誤検知リスクを内包する自動判断システム」なのか。

AIによるセキュリティ対策の進化と、その副作用としての誤検知・排除・ブラックボックス化の問題について、構造的に整理・考察してください。

【目的】

– セキュリティAIを「万能の防御」または「危険な監視装置」と単純化せず、両面性を整理する

– 技術論だけでなく、運用・責任・統治設計の観点を提示する

– 読者が「AIに任せることの意味」を自分で考えるための視点を提供する

【読者像】

– 一般社会人(20〜50代)

– ITやAIに詳しくはないが、日常的にデジタルサービスを利用している層

– 企業の情報セキュリティやアカウント凍結、誤検知に関心を持つ人

– AIによる自動判断に漠然とした不安や期待を抱いている人

【記事構成】

1. 導入(問題提起)

– サイバー攻撃の高度化とAI活用の現状を簡潔に提示する

– 「AIが守ってくれる」という期待と、「AIに誤って排除されるかもしれない」という不安を提示する

– なぜセキュリティAIが単なる技術問題ではないのかを示す

2. 防御としてのセキュリティAI

– 従来型セキュリティとの違い(シグネチャ型と行動分析型など)を簡潔に整理する

– 未知の攻撃や大規模データ処理への対応力を説明する

– 攻撃側もAIを使うという構造的対抗関係に触れる

– 防御インフラとしての必要性を冷静に整理する

3. 誤検知と排除のリスク

– 誤検知(False Positive)の概念を簡潔に説明する

– 正常なユーザーや業務が遮断される可能性を整理する

– ブラックボックス化や説明困難性の問題に触れる

– 「自動防御」が「自動排除」に変わる構造を説明する

4. 問題は技術か、それとも統治設計か

– 閾値設定・運用責任・異議申し立て制度の重要性を整理する

– 「AIが判断した」という言葉が責任を曖昧にする構造を指摘する

– 国家レベル、企業レベル、プラットフォームレベルの違いに簡潔に触れる

– セキュリティAIをどう位置づけるかは設計思想次第であることを示す

5. まとめ

– セキュリティAIは防御でもあり、リスクでもあるという二面性を再確認する

– 問題は「使うか使わないか」ではなく「どう設計し、どう責任を持つか」であることを提示する

– 過度に楽観・悲観せず、読者が自分なりに考える余白を残して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「恐怖を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:セキュリティAIの防御と誤検知の構造)

※(図:自動判断と責任主体の関係図)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「3年後、あなたの仕事は残っているか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

近年、サイバー攻撃はますます巧妙化しており、企業や個人を脅かしています。例えば、ランサムウェア(身代金要求型マルウェア)やフィッシング詐欺が日常的に発生し、被害額は世界的に兆単位に上っています。このような脅威に対して、AI(人工知能)を活用したセキュリティ対策が急速に広がっています。AIは膨大なデータをリアルタイムで分析し、異常を検知する能力が高いため、「AIが私たちを守ってくれる」という期待が高まっています。

一方で、「AIの判断ミスでアカウントが凍結された」「正常なアクセスがブロックされた」といった体験談も増えています。これにより、「AIに誤って排除されるかもしれない」という不安が生じています。セキュリティAIは単なる技術ツールではなく、人々の生活や業務に直接影響を与えるシステムです。なぜなら、AIの判断は自動化されやすく、誤りが起きた場合の責任が曖昧になりやすいからです。この記事では、セキュリティAIの防御面とリスク面を構造的に整理し、読者の皆さんが「AIに任せることの意味」を考えるための視点を提供します。

### サイバー攻撃の高度化とAIの役割

サイバー攻撃の進化を振り返ってみましょう。従来の攻撃は特定のパターン(シグネチャ)に基づいていましたが、現在はAIを活用した変異型攻撃が増えています。例えば、攻撃側がAIを使って標的の行動を学習し、巧妙に侵入するケースです。これに対し、防御側もAIを導入し、攻撃の予測や阻止を強化しています。AIの活用は、セキュリティの「自動化」を加速させ、人的リソースの不足を補う点で有効です。

しかし、この対抗関係はエスカレートしやすく、両側がAIを進化させる「軍拡競争」のような構造を生んでいます。ここで問題となるのは、AIが「万能の防御」として描かれる一方で、その自動判断が新たなリスクを内包している点です。次に、防御としての側面を詳しく見ていきましょう。

### 防御としてのセキュリティAI:その強み

セキュリティAIの基本的な役割は、脅威を検知・阻止することです。従来型のセキュリティはシグネチャベース(既知の脅威パターンを照合する方式)が主流でしたが、AIは行動分析型(機械学習を使って異常行動を検知する方式)を採用しています。これにより、未知の攻撃(ゼロデイ攻撃、つまり未発見の脆弱性を狙ったもの)にも対応可能です。

例えば、ネットワークトラフィック(データの流れ)を監視し、異常なパターンをリアルタイムで識別します。大規模データ処理の面では、人間では扱えない量のログ(記録データ)を分析し、迅速な対応を実現します。企業では、AIを活用したEDR(Endpoint Detection and Response、端末の脅威検知・対応システム)が普及しており、感染拡大を防ぐ効果を発揮しています。

※(図:従来型セキュリティとAI型の比較構造)

また、攻撃側もAIを使うため、防御側がAIを導入するのは構造的な必然性があります。AIなしでは、攻撃のスピードに追いつけないからです。ただし、この必要性は「防御インフラ」としての位置づけを強調しますが、完璧さを保証するものではありません。次に、リスク面を考察します。

### 誤検知の概念とその影響

誤検知(False Positive)とは、正常な行動を脅威と誤って判断する現象です。AIはパターン学習に基づくため、訓練データの偏りやアルゴリズムの限界で発生しやすくなります。例えば、正当なユーザーアクセスを「不審」とみなしてブロックするケースです。これにより、業務が中断されたり、アカウントが凍結されたりします。

ソーシャルメディアや銀行システムでは、こうした誤検知が頻発し、ユーザーの不満を招いています。正常なユーザーや業務が遮断される可能性は、AIの「自動化」の副作用です。AIが学習するデータが増えるほど精度は向上しますが、初期段階や特殊ケースでは誤りが避けられません。

### 排除のリスクとブラックボックス化

さらに、誤検知は「排除」の問題を引き起こします。AIの判断が自動化されると、「自動防御」が「自動排除」に転化しやすくなります。例えば、コンテンツモデレーション(内容監視)で、AIが誤って投稿を削除する事例です。これにより、表現の自由が損なわれる恐れがあります。

ブラックボックス化(内部ロジックが不明瞭な状態)も大きな問題です。AIの決定プロセスが説明しにくいため、「なぜブロックされたのか」が分からず、ユーザーは不信感を抱きます。この構造は、セキュリティAIを「誤検知リスクを内包する自動判断システム」として位置づけます。技術の進化がリスクを増幅させる側面を無視できません。

※(図:誤検知の発生メカニズムと影響の連鎖)

### 問題は技術か、それとも統治設計か:運用責任の観点

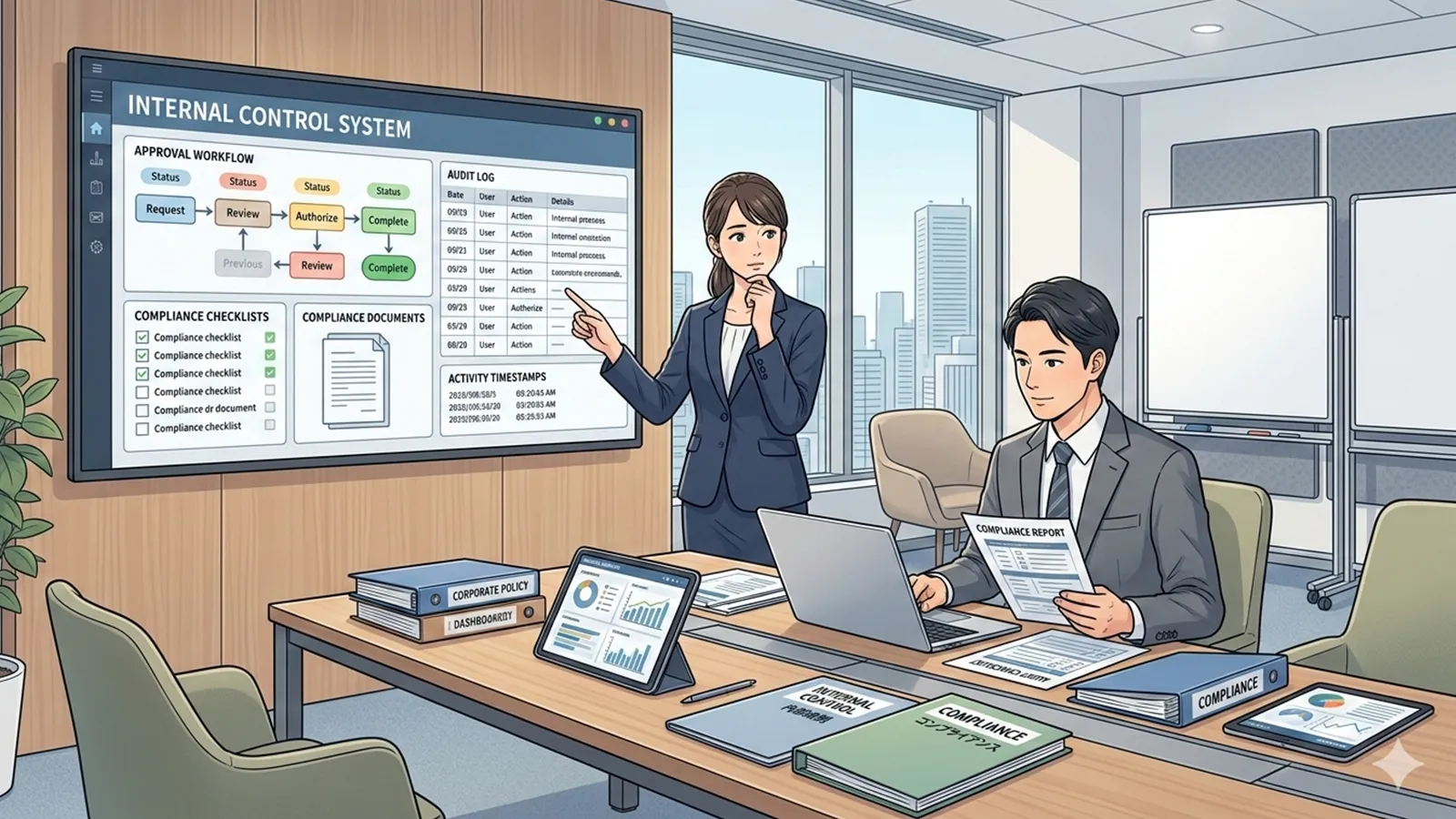

セキュリティAIの問題は、技術そのものではなく、運用・統治設計に起因する部分が大きいです。例えば、閾値設定(検知の基準値)は人間が決定します。厳しすぎると誤検知が増え、緩すぎると脅威を見逃します。ここで重要なのは、運用責任の明確化です。「AIが判断した」として責任を曖昧にせず、人間が最終責任を負う仕組みが必要です。

異議申し立て制度も欠かせません。誤検知された場合、ユーザーが簡単に異議を申し立て、審査を受けられるようにするのです。これにより、排除のリスクを軽減できます。

### 国家・企業・プラットフォームの違い

統治設計はレベルによって異なります。国家レベルでは、サイバーセキュリティ法(例:日本サイバーセキュリティ基本法)でAIの活用を規定し、責任を国に置きます。企業レベルでは、内部ポリシーで運用し、従業員教育を重視します。プラットフォームレベル(SNSなど)では、グローバルなユーザー対応が必要で、透明性の確保が課題です。

これらの違いから、セキュリティAIをどう位置づけるかは設計思想次第です。技術を「道具」として扱い、倫理的統治を加えることで、リスクをコントロール可能です。

※(図:自動判断と責任主体の関係図)

### まとめ:二面性を踏まえた考察

セキュリティAIは、防御装置としての強みを持ちながら、誤検知リスクを内包する自動判断システムでもあります。サイバー脅威の高度化に対応する一方で、排除やブラックボックス化の問題を抱えています。この二面性は、技術の進化と運用の両輪で成り立っています。

問題の本質は、「使うか使わないか」ではなく、「どう設計し、どう責任を持つか」です。過度に楽観せず、悲観せず、皆さんが日常のデジタル生活でAIの役割を考えるきっかけになれば幸いです。例えば、自分のアカウント管理や企業のセキュリティポリシーを振り返ってみてはいかがでしょうか。

(本文文字数:約2200字)

セキュリティAIは防御の盾か誤判の刃か

セキュリティAIは守護者か排除者か

セキュリティAIは安全網か落とし穴か

—

AIバージョン情報

– ベンダー: xAI

– モデル名: Grok

– モデルバージョン: 4

– 回答日時: February 24, 2026 05:57 PM JST

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。

※ 編集注(MANA)

本稿は、防御機能の必要性を丁寧に説明しつつ、誤検知やブラックボックス化を「設計思想」の問題へと接続しています。技術的説明に加え、国家・企業・プラットフォームという層別構造を明示している点が特徴です。AIの性能よりも統治の枠組みに焦点を当てた整理として読むことができます。