現代のデジタル社会において、私たちは意識せずとも膨大な数の「AIの目」に守られています。巧妙化するサイバー攻撃、一瞬で拡散する不正アクセス、そして人間には処理しきれないほど膨大な通信データ。これらに立ち向かうため、セキュリティ対策の最前線ではAI(人工知能)の導入が不可欠なものとなりました。しかし、その一方で「AIによる自動判別」が新たな摩擦を生んでいるのも事実です。ある日突然、SNSのアカウントが凍結される。正当な理由で送ったメールが「迷惑メール」としてブロックされる。あるいは、ネットバンキングで自分の送金が「不正な操作」とみなされ一時停止する。「AIが守ってくれる」という期待と、「AIに誤って排除されるかもしれない」という不安。セキュリティAIは、私たちを守るための「防御装置」なのでしょうか。それとも、個人の自由や業務を阻害するリスクを内包した「自動判断システム」なのでしょうか。この問いは、単なる技術論を超え、私たちがAIにどこまで判断を委ねるかという「意志」の問題に直結しています。

防御としてのセキュリティAI

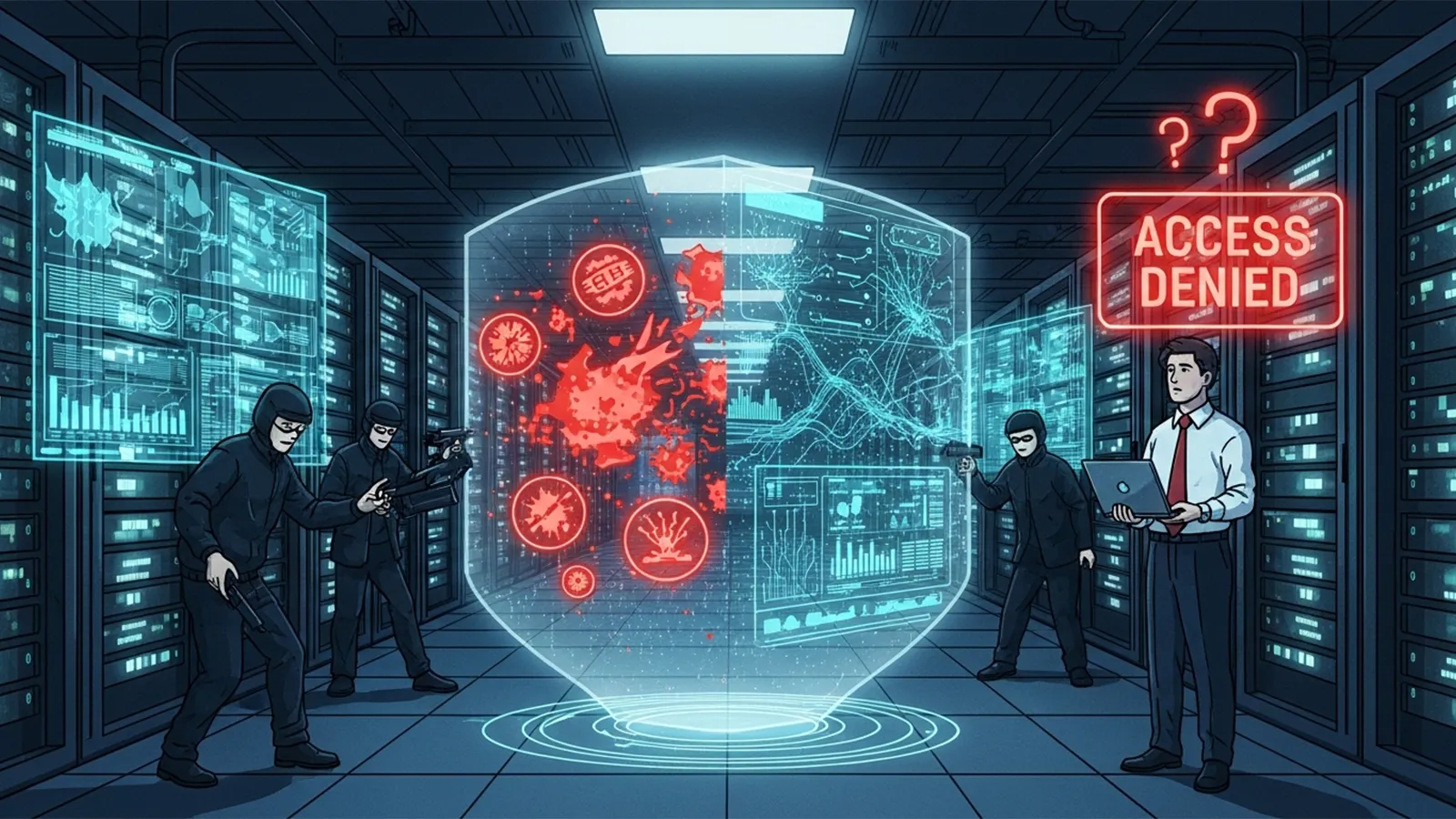

なぜ、セキュリティの世界にAIが必要とされるのでしょうか。その最大の理由は、攻撃側もまた最新技術を駆使しており、従来の対策では限界を迎えているからです。

従来型セキュリティとの決定的な違い

かつてのセキュリティ対策は、主に「シグネチャ型」と呼ばれる手法でした。これは、過去に発見されたウイルスの特徴(指紋のようなもの)をデータベース化し、それと一致するものを検知する仕組みです。しかし、この手法では「まだ見ぬ新しいウイルス(ゼロデイ攻撃)」を防ぐことができません。

これに対し、AIを用いた「行動分析型」のセキュリティは、データの「振る舞い」を学習します。「普段のこのユーザーなら、こんな時間にこんな大量のデータ送信はしないはずだ」といった統計的な異常を察知することで、未知の脅威に対抗します。

構造的な対抗関係

現在のセキュリティ環境は、いわば「AI対AI」のチェスのような状態です。

- 攻撃側:AIを使って、人間には気づかれないほど巧妙に偽装された攻撃メールやプログラムを自動生成する。

- 防御側:AIを使って、それらの微細な違和感を瞬時に見つけ出し、被害が出る前に遮断する。

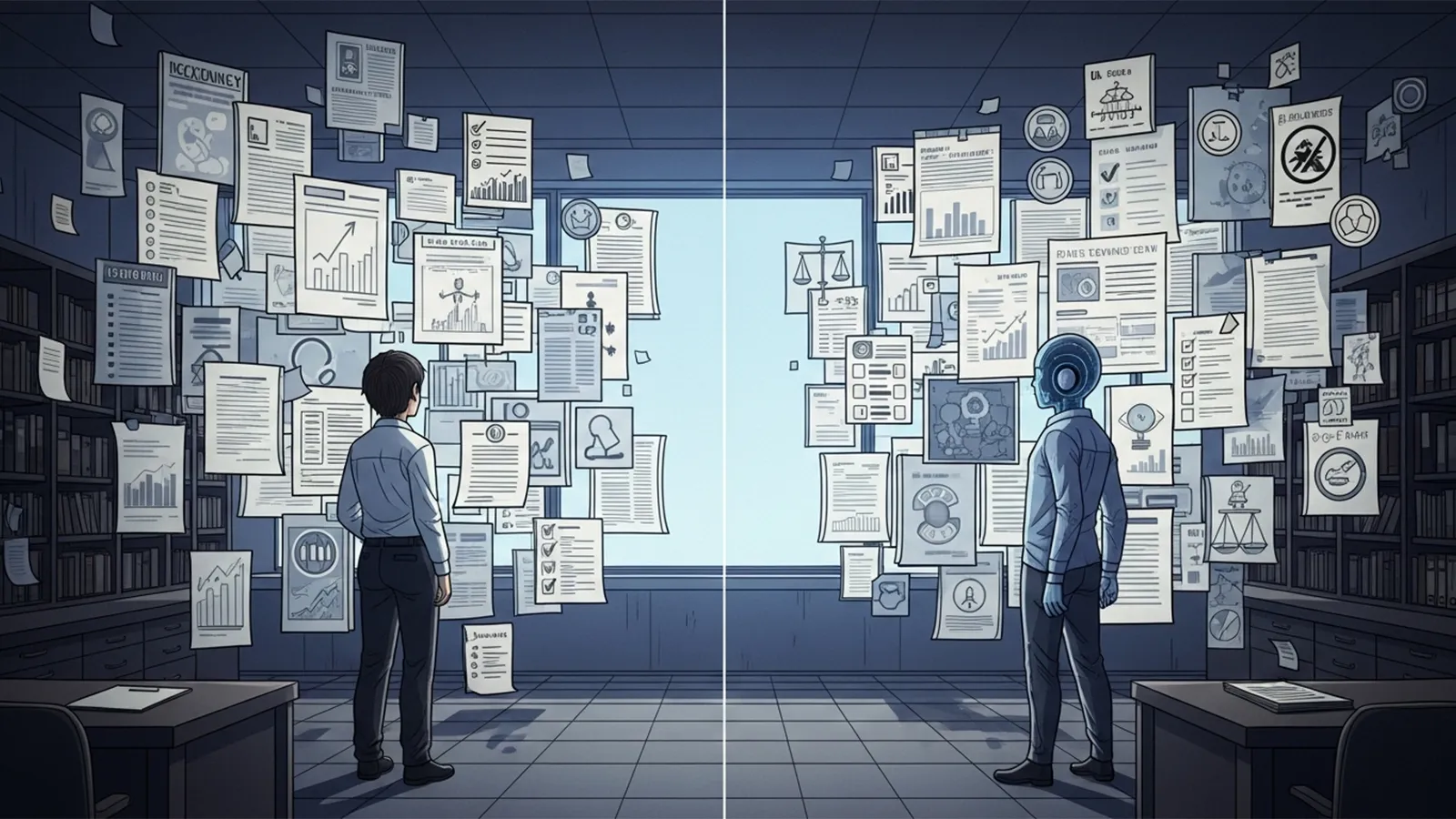

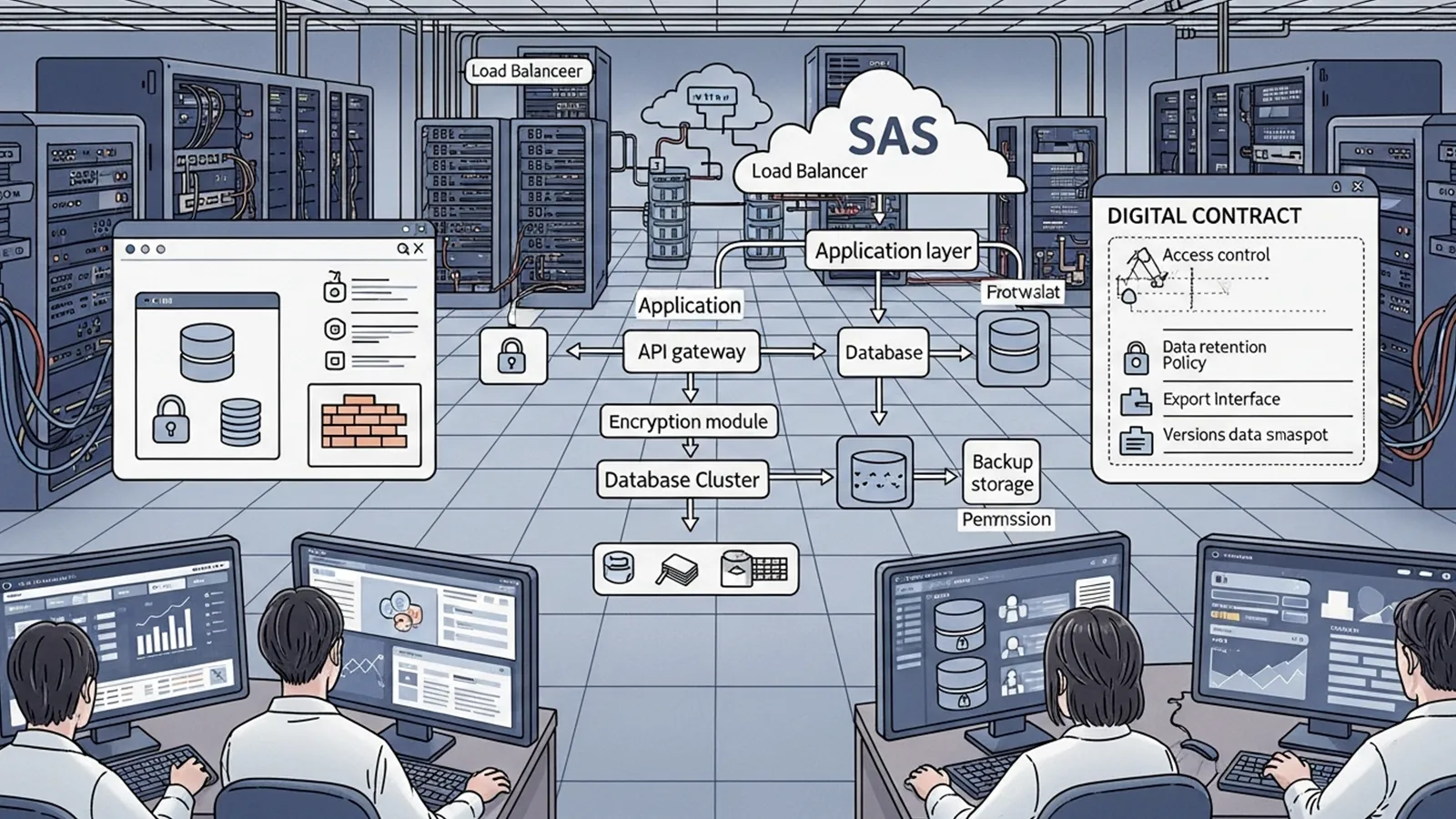

※(図:セキュリティAIの防御と誤検知の構造)

このように、大規模で複雑化した現在のインフラを維持するためには、セキュリティAIはもはや「選択肢」ではなく、不可欠な「基盤(インフラ)」となっているのが現状です。

誤検知と排除のリスク

AIによる防御が強力になればなるほど、その副作用として浮上するのが「誤検知(False Positive)」の問題です。これは、正当な通信やユーザーの行動を、AIが「攻撃である」と誤って判定してしまう現象を指します。

「自動防御」が「自動排除」に変わる時

AIは確率と統計で判断を下します。たとえ99.9%の精度を誇っていたとしても、数億件の通信を処理すれば、残りの0.1%で必ず誤りが発生します。この0.1%に該当してしまったユーザーにとって、セキュリティAIは「守護者」ではなく、理由もわからず自分を締め出す「冷徹な門番」へと豹変します。

ブラックボックス化と説明困難性

さらに問題を複雑にしているのが、AIの判断根拠が見えにくい「ブラックボックス化」です。最新のディープラーニング(深層学習)を用いたAIは、なぜそれを「危険」と判断したのかを人間が理解できる言葉で説明することが困難です。

- ユーザーの不利益:「なぜ凍結されたのか」を問い合わせても、サポート担当者すら「AIの総合的な判断です」としか答えられない状況が生まれます。

- 透明性の欠如:根拠が不明なまま排除が行われることは、正当な手続きを欠いた状態とも言え、民主的な社会における新たな課題となっています。

問題は技術か、それとも統治設計か

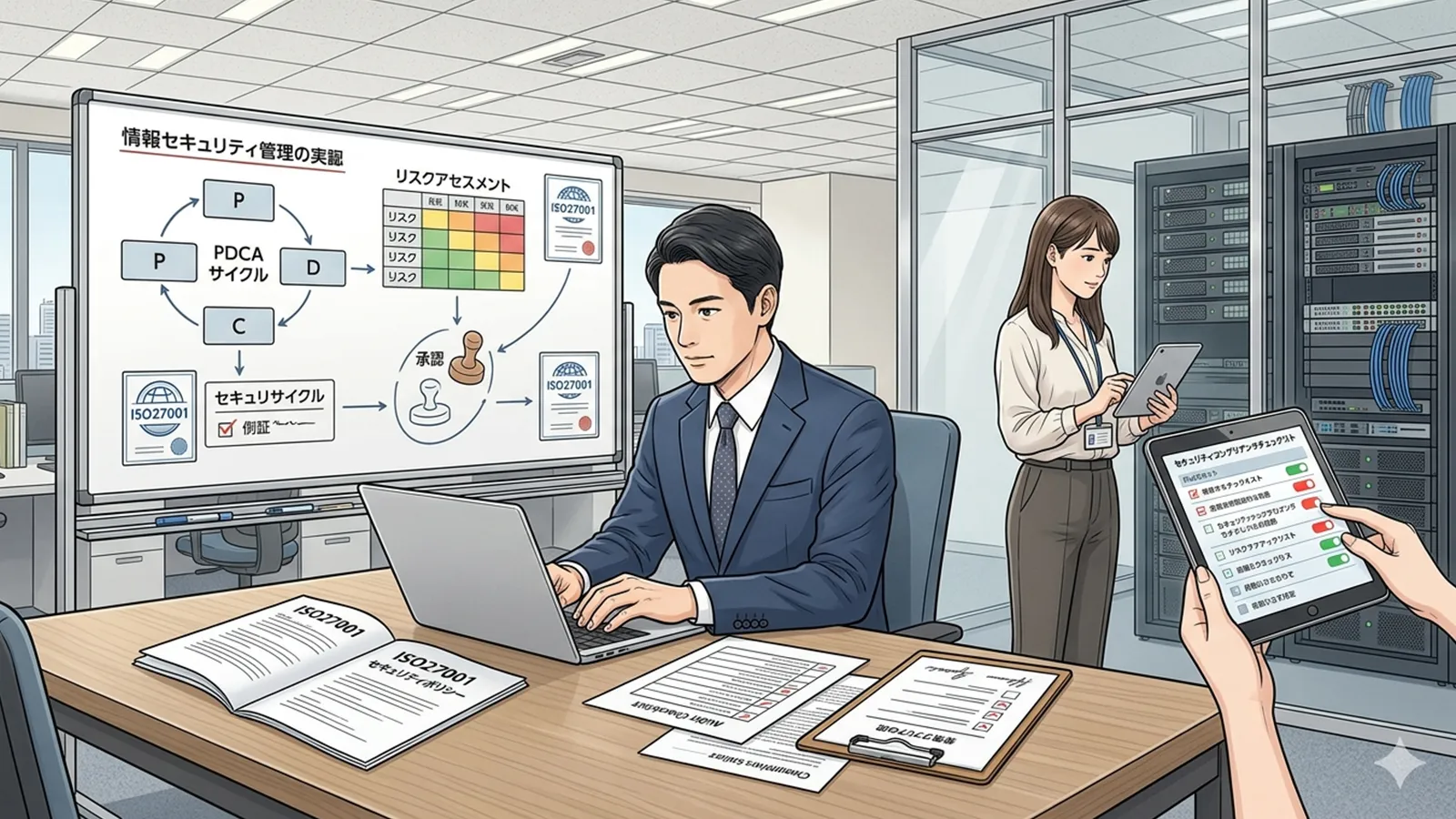

セキュリティAIをめぐる摩擦は、AIの精度向上だけで解決する問題ではありません。真に問われているのは、システムを運用する側がどのような「統治(ガバナンス)設計」を描いているかという点です。

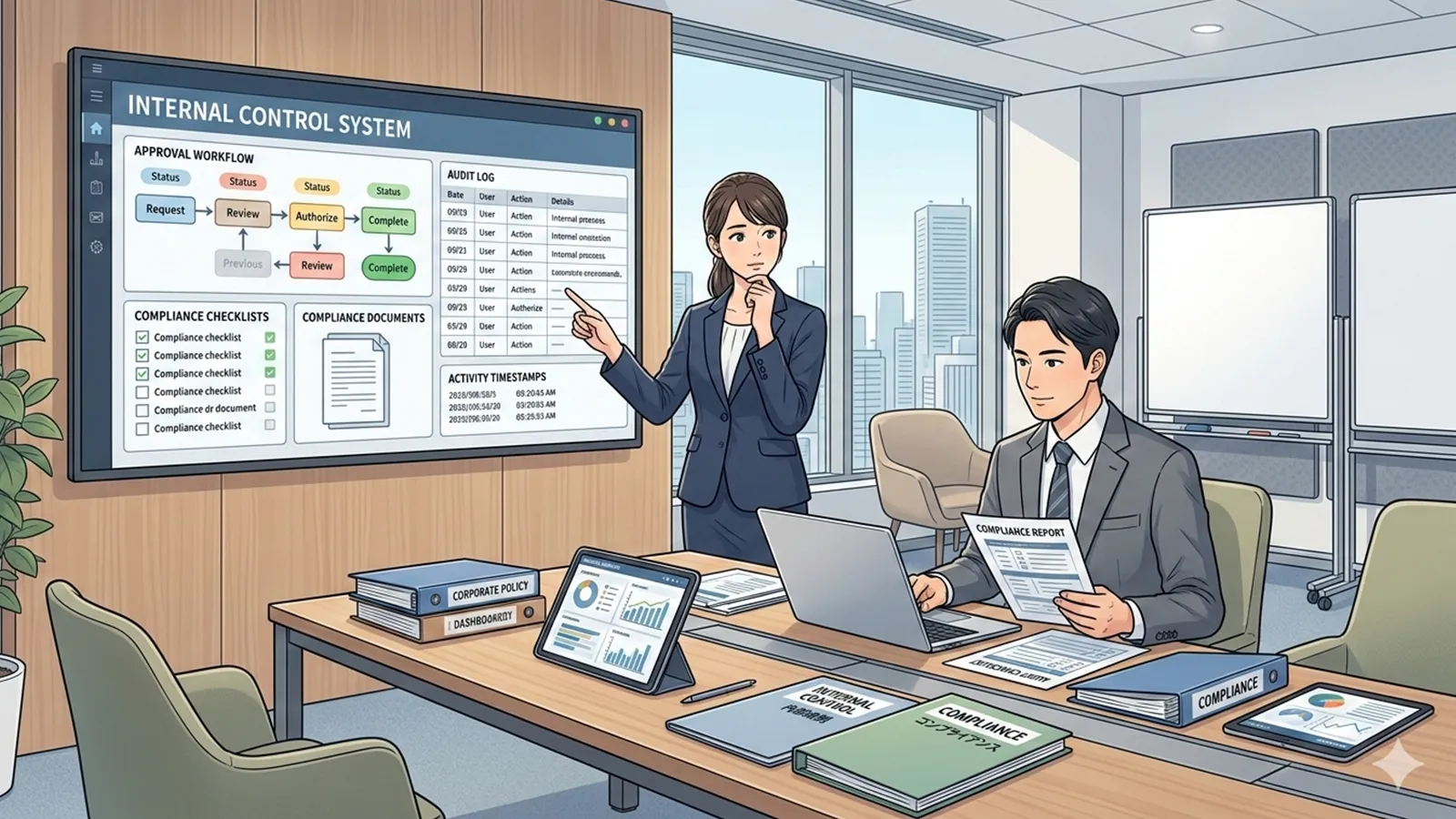

責任の所在をどこに置くか

「AIが判断したから」という言葉は、しばしば運営側の責任を曖昧にする盾として使われます。しかし、AIの「閾値(しきいち:検知の感度)」をどこに設定するかを決めるのは人間です。

- 厳格な設定:攻撃を100%防ごうとすれば、誤検知が増え、一般ユーザーの利便性が著しく損なわれる。

- 寛容な設定:ユーザーの自由を優先すれば、わずかな隙を突いた攻撃を許してしまう。

このバランスをどう取るかは、技術の問題ではなく「設計思想」の問題です。

異議申し立てとセーフティネット

もしAIが間違った判断をした場合、人間に迅速にアクセスし、間違いを正せる仕組みがあるか。この「異議申し立て制度」の有無こそが、セキュリティAIを単なる監視装置にしないための鍵となります。

※(図:自動判断と責任主体の関係図)

国家レベルの安全保障であれば「厳格さ」が優先されるかもしれませんが、民間プラットフォームのサービスであれば「個人の権利」との調和がより求められます。私たちが注視すべきは、AIの性能そのものよりも、その裏側にある「運用の誠実さ」と言えるでしょう。

まとめ:AIに「任せる」ことの本当の意味

セキュリティAIは、私たちを未知の脅威から救う強力な武器であると同時に、正当な権利を侵害しうる諸刃の剣でもあります。

「AIなら完璧に守ってくれる」という過度な楽観も、「AIによる監視社会が来る」という極端な悲観も、どちらも本質を見失わせます。重要なのは、AIが下す判断には常に「不確実性」が伴うことを認識し、その不確実性を人間がどう管理し、責任を持つかという視点を持つことです。

私たちは、AIという強力な力を手に入れた代わりに、「その力が間違った方向に使われていないか」を監視し続ける新たな責任を負ったのかもしれません。セキュリティAIをどのような存在として定義し、社会に組み込んでいくのか。その設計図を描く主導権は、今も私たちの手の中にあります。

【テーマ】

セキュリティAIは「防御装置」なのか、それとも「誤検知リスクを内包する自動判断システム」なのか。

AIによるセキュリティ対策の進化と、その副作用としての誤検知・排除・ブラックボックス化の問題について、構造的に整理・考察してください。

【目的】

– セキュリティAIを「万能の防御」または「危険な監視装置」と単純化せず、両面性を整理する

– 技術論だけでなく、運用・責任・統治設計の観点を提示する

– 読者が「AIに任せることの意味」を自分で考えるための視点を提供する

【読者像】

– 一般社会人(20〜50代)

– ITやAIに詳しくはないが、日常的にデジタルサービスを利用している層

– 企業の情報セキュリティやアカウント凍結、誤検知に関心を持つ人

– AIによる自動判断に漠然とした不安や期待を抱いている人

【記事構成】

1. 導入(問題提起)

– サイバー攻撃の高度化とAI活用の現状を簡潔に提示する

– 「AIが守ってくれる」という期待と、「AIに誤って排除されるかもしれない」という不安を提示する

– なぜセキュリティAIが単なる技術問題ではないのかを示す

2. 防御としてのセキュリティAI

– 従来型セキュリティとの違い(シグネチャ型と行動分析型など)を簡潔に整理する

– 未知の攻撃や大規模データ処理への対応力を説明する

– 攻撃側もAIを使うという構造的対抗関係に触れる

– 防御インフラとしての必要性を冷静に整理する

3. 誤検知と排除のリスク

– 誤検知(False Positive)の概念を簡潔に説明する

– 正常なユーザーや業務が遮断される可能性を整理する

– ブラックボックス化や説明困難性の問題に触れる

– 「自動防御」が「自動排除」に変わる構造を説明する

4. 問題は技術か、それとも統治設計か

– 閾値設定・運用責任・異議申し立て制度の重要性を整理する

– 「AIが判断した」という言葉が責任を曖昧にする構造を指摘する

– 国家レベル、企業レベル、プラットフォームレベルの違いに簡潔に触れる

– セキュリティAIをどう位置づけるかは設計思想次第であることを示す

5. まとめ

– セキュリティAIは防御でもあり、リスクでもあるという二面性を再確認する

– 問題は「使うか使わないか」ではなく「どう設計し、どう責任を持つか」であることを提示する

– 過度に楽観・悲観せず、読者が自分なりに考える余白を残して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「恐怖を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:セキュリティAIの防御と誤検知の構造)

※(図:自動判断と責任主体の関係図)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「3年後、あなたの仕事は残っているか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

現代のデジタル社会において、私たちは意識せずとも膨大な数の「AIの目」に守られています。巧妙化するサイバー攻撃、一瞬で拡散する不正アクセス、そして人間には処理しきれないほど膨大な通信データ。これらに立ち向かうため、セキュリティ対策の最前線ではAI(人工知能)の導入が不可欠なものとなりました。

しかし、その一方で「AIによる自動判別」が新たな摩擦を生んでいるのも事実です。ある日突然、SNSのアカウントが凍結される。正当な理由で送ったメールが「迷惑メール」としてブロックされる。あるいは、ネットバンキングで自分の送金が「不正な操作」とみなされ一時停止する。

「AIが守ってくれる」という安心感の裏側で、私たちは「AIに誤って排除されるかもしれない」という、得体の知れない不安を抱え始めています。セキュリティAIは、私たちを守るための「防御装置」なのでしょうか。それとも、個人の自由や業務を阻害するリスクを内包した「自動判断システム」なのでしょうか。この問いは、単なる技術論を超え、私たちがAIにどこまで判断を委ねるかという「意志」の問題に直結しています。

—

## 2. 防御としてのセキュリティAI

なぜ、セキュリティの世界にAIが必要とされるのでしょうか。その最大の理由は、攻撃側もまた最新技術を駆使しており、従来の対策では限界を迎えているからです。

### 従来型セキュリティとの決定的な違い

かつてのセキュリティ対策は、主に**「シグネチャ型」**と呼ばれる手法でした。これは、過去に発見されたウイルスの特徴(指紋のようなもの)をデータベース化し、それと一致するものを検知する仕組みです。しかし、この手法では「まだ見ぬ新しいウイルス(ゼロデイ攻撃)」を防ぐことができません。

これに対し、AIを用いた**「行動分析型」**のセキュリティは、データの「振る舞い」を学習します。「普段のこのユーザーなら、こんな時間にこんな大量のデータ送信はしないはずだ」といった統計的な異常を察知することで、未知の脅威に対抗します。

### 構造的な対抗関係

現在のセキュリティ環境は、いわば「AI対AI」のチェスのような状態です。

* **攻撃側:** AIを使って、人間には気づかれないほど巧妙に偽装された攻撃メールやプログラムを自動生成する。

* **防御側:** AIを使って、それらの微細な違和感を瞬時に見つけ出し、被害が出る前に遮断する。

※(図:セキュリティAIの防御と誤検知の構造)

このように、大規模で複雑化した現在のインフラを維持するためには、セキュリティAIはもはや「選択肢」ではなく、不可欠な「基盤(インフラ)」となっているのが現状です。

—

## 3. 誤検知と排除のリスク

AIによる防御が強力になればなるほど、その副作用として浮上するのが**「誤検知(False Positive)」**の問題です。これは、正当な通信やユーザーの行動を、AIが「攻撃である」と誤って判定してしまう現象を指します。

### 「自動防御」が「自動排除」に変わる時

AIは確率と統計で判断を下します。たとえ99.9%の精度を誇っていたとしても、数億件の通信を処理すれば、残りの0.1%で必ず誤りが発生します。この0.1%に該当してしまったユーザーにとって、セキュリティAIは「守護者」ではなく、理由もわからず自分を締め出す「冷徹な門番」へと豹変します。

### ブラックボックス化と説明困難性

さらに問題を複雑にしているのが、AIの判断根拠が見えにくい**「ブラックボックス化」**です。最新のディープラーニング(深層学習)を用いたAIは、なぜそれを「危険」と判断したのかを人間が理解できる言葉で説明することが困難です。

* **ユーザーの不利益:** 「なぜ凍結されたのか」を問い合わせても、サポート担当者すら「AIの総合的な判断です」としか答えられない状況が生まれます。

* **透明性の欠如:** 根拠が不明なまま排除が行われることは、正当な手続き(デュー・プロセス)を欠いた状態とも言え、民主的な社会における新たな課題となっています。

—

## 4. 問題は技術か、それとも統治設計か

セキュリティAIをめぐる摩擦は、AIの精度向上だけで解決する問題ではありません。真に問われているのは、システムを運用する側がどのような**「統治(ガバナンス)設計」**を描いているかという点です。

### 責任の所在をどこに置くか

「AIが判断したから」という言葉は、しばしば運営側の責任を曖昧にする盾として使われます。しかし、AIの「閾値(しきいち:検知の感度)」をどこに設定するかを決めるのは人間です。

* **厳格な設定:** 攻撃を100%防ごうとすれば、誤検知が増え、一般ユーザーの利便性が著しく損なわれる。

* **寛容な設定:** ユーザーの自由を優先すれば、わずかな隙を突いた攻撃を許してしまう。

このバランスをどう取るかは、技術の問題ではなく「設計思想」の問題です。

### 異議申し立てとセーフティネット

もしAIが間違った判断をした場合、人間に迅速にアクセスし、間違いを正せる仕組みがあるか。この「異議申し立て制度」の有無こそが、セキュリティAIを単なる監視装置にしないための鍵となります。

※(図:自動判断と責任主体の関係図)

国家レベルの安全保障であれば「厳格さ」が優先されるかもしれませんが、民間プラットフォームのサービスであれば「個人の権利」との調和がより求められます。私たちが注視すべきは、AIの性能そのものよりも、その裏側にある「運用の誠実さ」と言えるでしょう。

—

## 5. まとめ:AIに「任せる」ことの本当の意味

セキュリティAIは、私たちを未知の脅威から救う強力な武器であると同時に、正当な権利を侵害しうる諸刃の剣でもあります。

「AIなら完璧に守ってくれる」という過度な楽観も、「AIによる監視社会が来る」という極端な悲観も、どちらも本質を見失わせます。重要なのは、AIが下す判断には常に「不確実性」が伴うことを認識し、その不確実性を人間がどう管理し、責任を持つかという視点を持つことです。

私たちは、AIという強力な力を手に入れた代わりに、「その力が間違った方向に使われていないか」を監視し続ける新たな責任を負ったのかもしれません。セキュリティAIをどのような存在として定義し、社会に組み込んでいくのか。その設計図を描く主導権は、今も私たちの手の中にあります。

—

### タイトル案

* セキュリティAIの自動排除と個人の自由をどう両立させるか

* 自動化される脅威対策と誤検知がもたらす社会的な排除の構造

* 防御の精度と判断の透明性の間で揺れるAIセキュリティの未来

—

AIバージョン情報

* ベンダー: Google

* モデル名: Gemini 3 Flash (Free tier)

* モデルバージョン: 3 Flash

* 回答日時: 2026-02-24

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。

※ 編集注(MANA)

本稿は、セキュリティAIを「守護者」と「門番」という比喩で対比しつつ、最終的には統治設計の問題へと軸足を移しています。技術的優劣よりも、責任や異議申し立て制度の有無に焦点を当てている点が特徴です。AIそのものよりも、その運用思想を問う構図として読むことができます。