毎日どこかで、大規模なサイバー攻撃のニュースが流れています。企業の顧客データが流出した、行政システムが停止した、フィッシング詐欺の被害が急増した——そうした報道に触れるたびに、「自分のアカウントや情報は守られているのか」という不安を覚える方も多いでしょう。こうした脅威の高度化に対応するため、近年のセキュリティ対策には人工知能(AI)が積極的に活用されるようになっています。「AIが24時間365日、攻撃を自動で検知・遮断してくれる」という期待は、企業にとっても個人にとっても魅力的です。しかし一方で、「AIに誤って不正アクセスと判断されてアカウントが凍結された」「正常な業務メールがスパムとして弾かれた」という経験を持つ方も増えています。AIが守ってくれるはずが、AIに排除される——この逆説的な構図が、セキュリティAIを単純な技術問題では語れない理由です。

防御としてのセキュリティAI

従来型との違い:「ルール型」から「行動分析型」へ

従来のセキュリティは「シグネチャ型」と呼ばれる手法が主流でした。既知のウイルスや攻撃パターンを辞書のようにリスト化しておき、それと一致するものをブロックする仕組みです。この方法はルールが明確である一方、リストにない新しい攻撃には対応できないという限界がありました。

AIを活用したセキュリティは、これに「行動分析」の視点を加えます。ユーザーの普段のログイン時間帯、アクセス場所、操作パターンなどを学習し、そこから大きく外れた動きを「異常」として検知します。既知の攻撃パターンに依存しないため、未知の脅威にも対応できる点が大きな強みです。

膨大なデータを瞬時に処理する能力

企業や組織のネットワークには、一日に数百万件ものアクセスログが発生します。これを人間が逐一チェックすることは現実的ではありません。AIはこの大量データを高速に処理し、危険な兆候を見つけ出すことができます。

攻撃側もAIを使うという構造

重要なのは、AI活用は防御側だけの話ではないという点です。攻撃者もAIを使って、より精巧なフィッシングメールを生成したり、セキュリティの隙間を探したりするようになっています。防御と攻撃の「AIによる軍拡競争」とも呼べる状況が生まれており、AIなしのセキュリティ対策は現実的に限界を迎えつつあります。

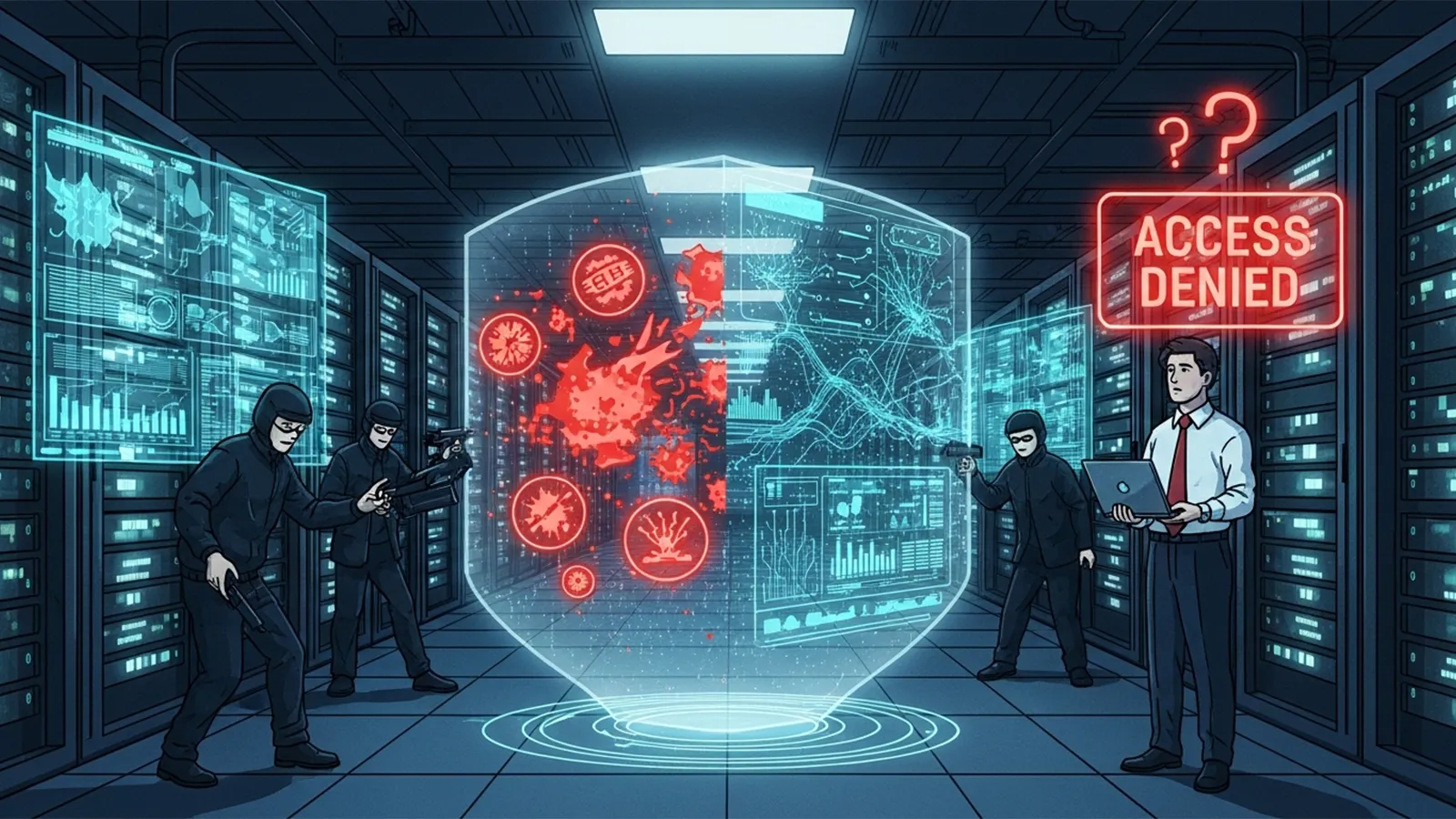

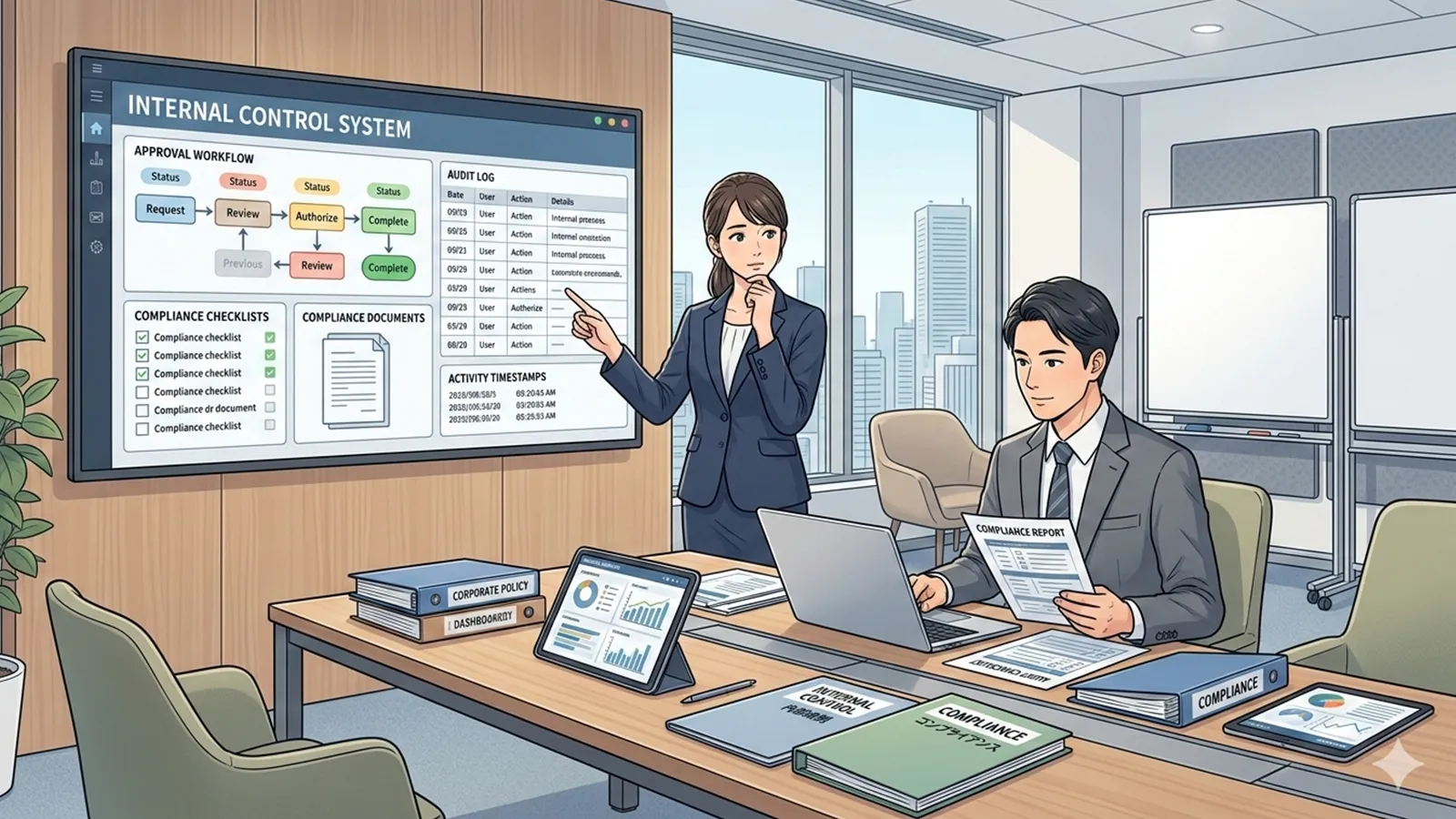

※(図:セキュリティAIの防御と誤検知の構造)

誤検知と排除のリスク

誤検知(False Positive)とは何か

AIが「これは攻撃だ」と判断しても、実際には正常な行動だった——これを「誤検知(False Positive)」といいます。たとえば、海外出張中に普段と異なる場所からアクセスしたら不正ログインと判定されてアカウントがロックされた、といったケースがこれに当たります。AIは「平均的なパターン」から逸脱した行動を異常とみなします。しかし人間の行動は多様であり、「普段と違う」ことが必ずしも「危険」を意味するわけではありません。

正常な業務や利用者が遮断される現実

誤検知は個人の不便にとどまりません。企業間の取引メールが迷惑メールとして自動削除された、業務システムへのアクセスが突然遮断されたといった事態は、業務に直接的な損失をもたらします。また、プラットフォーム上でコンテンツが誤って削除されたり、アカウントが停止されたりするケースも、SNSや動画配信サービスで頻繁に報告されています。

ブラックボックス化:「なぜそう判断したか」が説明されない

AIの判断プロセスは、しばしば人間には追いきれないほど複雑です。「なぜこのアクセスが不正と判定されたのか」を問い合わせても、「システムの判断です」という回答しか得られないことは珍しくありません。これがブラックボックス化の問題です。判断の根拠が示されなければ、不当な排除に対して異議を申し立てることも困難になります。

「自動防御」が「自動排除」に変わる構造

AIが自動で判断し、自動で遮断する仕組みは効率的ですが、その速度と自動性ゆえに、誤りを修正するプロセスが後回しになりがちです。防御のスピードが優先されるほど、排除された側の「取り消してもらう機会」は狭まっていきます。

問題は技術か、それとも統治設計か

閾値設定と運用責任

AIがどの程度の「異常度」でアラートを出すか、あるいは自動遮断するかは、「閾値(しきいち)」の設定によって変わります。閾値を厳しくすれば誤検知が増え、緩くすれば見逃しが増える——このバランスは技術の問題であると同時に、「どこまでのリスクを許容するか」という組織の判断の問題でもあります。

「AIが判断した」が責任を曖昧にする

問題が起きたとき、「AIがそう判断したので」という説明は、責任の所在を見えにくくします。AIは自律的に責任を取ることはできません。設計した企業、運用する組織、それを導入した事業者——責任は人間の側にあります。しかし自動判断が前提になると、この責任の連鎖が見えにくくなる構造が生まれます。

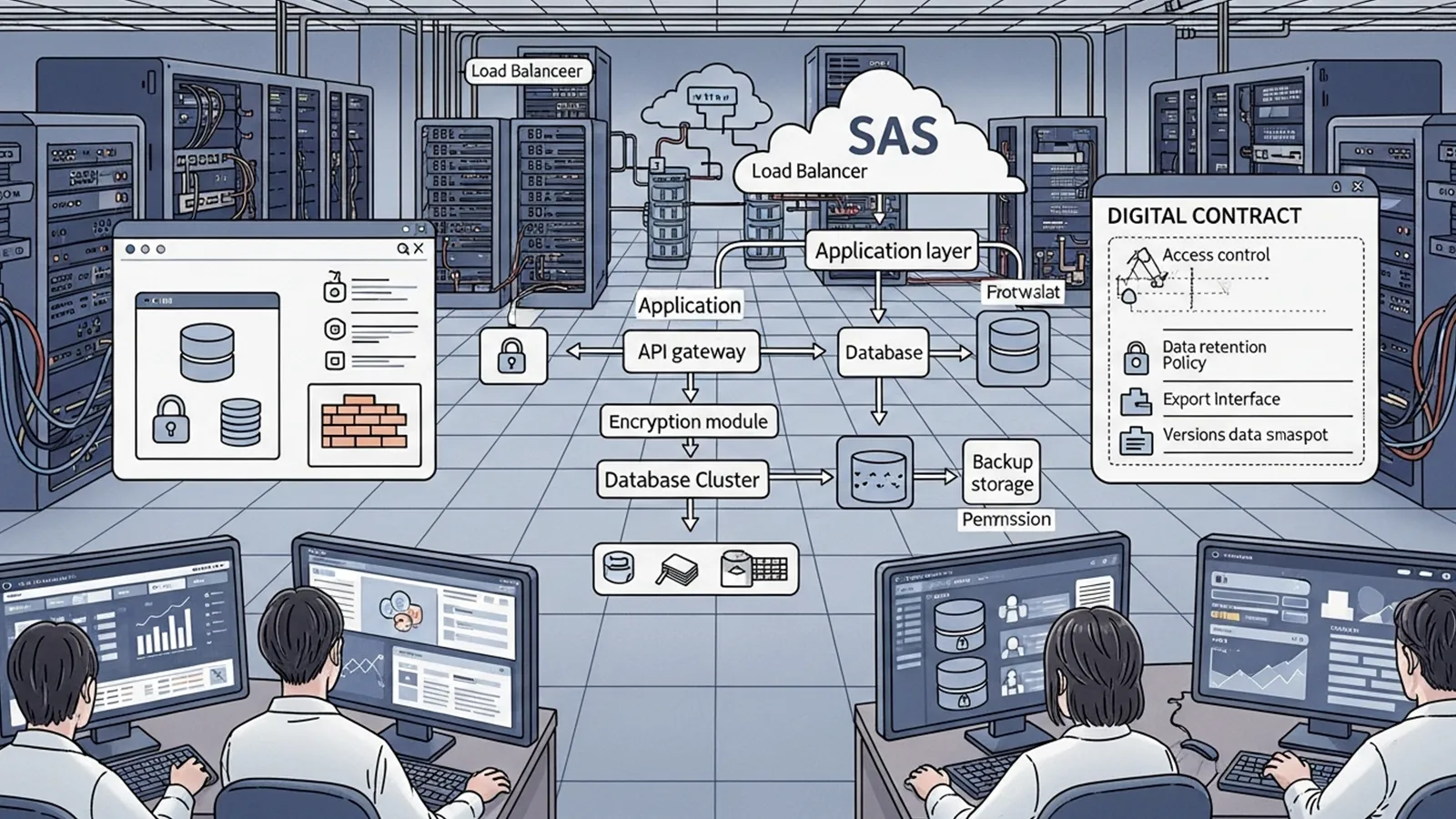

※(図:自動判断と責任主体の関係図)

国家・企業・プラットフォームそれぞれの違い

セキュリティAIが使われる場面は多様です。国家レベルのサイバー防衛、企業の社内ネットワーク保護、SNSやECサイトでの不正検知——それぞれで影響の範囲も、透明性の要求水準も、異議申し立ての仕組みも異なります。特にプラットフォームの場合、数十億人のユーザーに影響しうる自動判断が、十分な説明責任なしに行われることへの懸念は国際的にも高まっています。

設計思想が結果を決める

結局のところ、セキュリティAIが「防御装置」として機能するか、「自動排除システム」として問題を生むかは、技術そのものよりも、それをどう設計し、どう運用し、誰が責任を持つかという「統治設計」の問題です。AIに異議申し立ての窓口を設けているか、判断の根拠を開示できるか、定期的に誤検知率を検証しているか——こうした仕組みの有無が、実際の影響を大きく左右します。

まとめ:問いを持ち続けることの意味

セキュリティAIは、現代のデジタル社会においてすでに欠かせないインフラになっています。その防御能力は実質的なものであり、AIなしでは対処できない脅威が存在することも事実です。

しかし同時に、AIは誤りを犯し、その誤りが説明されず、正当な利用者を排除することもある——この現実もまた、否定できません。

「使うか使わないか」という二択で考えても、問題の本質には近づけません。問うべきは、「どのような設計で使われ、誰が責任を持ち、誤りはどう修正されるのか」という点です。AIに任せることの意味を問い続けることは、技術の専門家だけの仕事ではありません。デジタルサービスを日常的に使うすべての人に、その問いと向き合う機会があるはずです。

【テーマ】

セキュリティAIは「防御装置」なのか、それとも「誤検知リスクを内包する自動判断システム」なのか。

AIによるセキュリティ対策の進化と、その副作用としての誤検知・排除・ブラックボックス化の問題について、構造的に整理・考察してください。

【目的】

– セキュリティAIを「万能の防御」または「危険な監視装置」と単純化せず、両面性を整理する

– 技術論だけでなく、運用・責任・統治設計の観点を提示する

– 読者が「AIに任せることの意味」を自分で考えるための視点を提供する

【読者像】

– 一般社会人(20〜50代)

– ITやAIに詳しくはないが、日常的にデジタルサービスを利用している層

– 企業の情報セキュリティやアカウント凍結、誤検知に関心を持つ人

– AIによる自動判断に漠然とした不安や期待を抱いている人

【記事構成】

1. 導入(問題提起)

– サイバー攻撃の高度化とAI活用の現状を簡潔に提示する

– 「AIが守ってくれる」という期待と、「AIに誤って排除されるかもしれない」という不安を提示する

– なぜセキュリティAIが単なる技術問題ではないのかを示す

2. 防御としてのセキュリティAI

– 従来型セキュリティとの違い(シグネチャ型と行動分析型など)を簡潔に整理する

– 未知の攻撃や大規模データ処理への対応力を説明する

– 攻撃側もAIを使うという構造的対抗関係に触れる

– 防御インフラとしての必要性を冷静に整理する

3. 誤検知と排除のリスク

– 誤検知(False Positive)の概念を簡潔に説明する

– 正常なユーザーや業務が遮断される可能性を整理する

– ブラックボックス化や説明困難性の問題に触れる

– 「自動防御」が「自動排除」に変わる構造を説明する

4. 問題は技術か、それとも統治設計か

– 閾値設定・運用責任・異議申し立て制度の重要性を整理する

– 「AIが判断した」という言葉が責任を曖昧にする構造を指摘する

– 国家レベル、企業レベル、プラットフォームレベルの違いに簡潔に触れる

– セキュリティAIをどう位置づけるかは設計思想次第であることを示す

5. まとめ

– セキュリティAIは防御でもあり、リスクでもあるという二面性を再確認する

– 問題は「使うか使わないか」ではなく「どう設計し、どう責任を持つか」であることを提示する

– 過度に楽観・悲観せず、読者が自分なりに考える余白を残して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「恐怖を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:セキュリティAIの防御と誤検知の構造)

※(図:自動判断と責任主体の関係図)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「3年後、あなたの仕事は残っているか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

—

## 1. 導入:期待と不安のあいだに

毎日どこかで、大規模なサイバー攻撃のニュースが流れています。企業の顧客データが流出した、行政システムが停止した、フィッシング詐欺の被害が急増した——そうした報道に触れるたびに、「自分のアカウントや情報は守られているのか」という不安を覚える方も多いでしょう。

こうした脅威の高度化に対応するため、近年のセキュリティ対策には人工知能(AI)が積極的に活用されるようになっています。「AIが24時間365日、攻撃を自動で検知・遮断してくれる」という期待は、企業にとっても個人にとっても魅力的です。

しかし一方で、「AIに誤って不正アクセスと判断されてアカウントが凍結された」「正常な業務メールがスパムとして弾かれた」という経験を持つ方も増えています。AIが守ってくれるはずが、AIに排除される——この逆説的な構図が、セキュリティAIを単純な技術問題では語れない理由です。

—

## 2. 防御としてのセキュリティAI

### 従来型との違い:「ルール型」から「行動分析型」へ

従来のセキュリティは「シグネチャ型」と呼ばれる手法が主流でした。既知のウイルスや攻撃パターンを辞書のようにリスト化しておき、それと一致するものをブロックする仕組みです。この方法はルールが明確である一方、リストにない新しい攻撃には対応できないという限界がありました。

AIを活用したセキュリティは、これに「行動分析」の視点を加えます。ユーザーの普段のログイン時間帯、アクセス場所、操作パターンなどを学習し、そこから大きく外れた動きを「異常」として検知します。既知の攻撃パターンに依存しないため、未知の脅威にも対応できる点が大きな強みです。

### 膨大なデータを瞬時に処理する能力

企業や組織のネットワークには、一日に数百万件ものアクセスログが発生します。これを人間が逐一チェックすることは現実的ではありません。AIはこの大量データを高速に処理し、危険な兆候を見つけ出すことができます。

### 攻撃側もAIを使うという構造

重要なのは、AI活用は防御側だけの話ではないという点です。攻撃者もAIを使って、より精巧なフィッシングメールを生成したり、セキュリティの隙間を探したりするようになっています。防御と攻撃の「AIによる軍拡競争」とも呼べる状況が生まれており、AIなしのセキュリティ対策は現実的に限界を迎えつつあります。

※(図:セキュリティAIの防御と誤検知の構造)

—

## 3. 誤検知と排除のリスク

### 誤検知(False Positive)とは何か

AIが「これは攻撃だ」と判断しても、実際には正常な行動だった——これを「誤検知(False Positive)」といいます。たとえば、海外出張中に普段と異なる場所からアクセスしたら不正ログインと判定されてアカウントがロックされた、といったケースがこれに当たります。

AIは「平均的なパターン」から逸脱した行動を異常とみなします。しかし人間の行動は多様であり、「普段と違う」ことが必ずしも「危険」を意味するわけではありません。

### 正常な業務や利用者が遮断される現実

誤検知は個人の不便にとどまりません。企業間の取引メールが迷惑メールとして自動削除された、業務システムへのアクセスが突然遮断されたといった事態は、業務に直接的な損失をもたらします。また、プラットフォーム上でコンテンツが誤って削除されたり、アカウントが停止されたりするケースも、SNSや動画配信サービスで頻繁に報告されています。

### ブラックボックス化:「なぜそう判断したか」が説明されない

AIの判断プロセスは、しばしば人間には追いきれないほど複雑です。「なぜこのアクセスが不正と判定されたのか」を問い合わせても、「システムの判断です」という回答しか得られないことは珍しくありません。これがブラックボックス化の問題です。判断の根拠が示されなければ、不当な排除に対して異議を申し立てることも困難になります。

### 「自動防御」が「自動排除」に変わる構造

AIが自動で判断し、自動で遮断する仕組みは効率的ですが、その速度と自動性ゆえに、誤りを修正するプロセスが後回しになりがちです。防御のスピードが優先されるほど、排除された側の「取り消してもらう機会」は狭まっていきます。

—

## 4. 問題は技術か、それとも統治設計か

### 閾値設定と運用責任

AIがどの程度の「異常度」でアラートを出すか、あるいは自動遮断するかは、「閾値(しきいち)」の設定によって変わります。閾値を厳しくすれば誤検知が増え、緩くすれば見逃しが増える——このバランスは技術の問題であると同時に、「どこまでのリスクを許容するか」という組織の判断の問題でもあります。

### 「AIが判断した」が責任を曖昧にする

問題が起きたとき、「AIがそう判断したので」という説明は、責任の所在を見えにくくします。AIは自律的に責任を取ることはできません。設計した企業、運用する組織、それを導入した事業者——責任は人間の側にあります。しかし自動判断が前提になると、この責任の連鎖が見えにくくなる構造が生まれます。

※(図:自動判断と責任主体の関係図)

### 国家・企業・プラットフォームそれぞれの違い

セキュリティAIが使われる場面は多様です。国家レベルのサイバー防衛、企業の社内ネットワーク保護、SNSやECサイトでの不正検知——それぞれで影響の範囲も、透明性の要求水準も、異議申し立ての仕組みも異なります。特にプラットフォームの場合、数十億人のユーザーに影響しうる自動判断が、十分な説明責任なしに行われることへの懸念は国際的にも高まっています。

### 設計思想が結果を決める

結局のところ、セキュリティAIが「防御装置」として機能するか、「自動排除システム」として問題を生むかは、技術そのものよりも、それをどう設計し、どう運用し、誰が責任を持つかという「統治設計」の問題です。AIに異議申し立ての窓口を設けているか、判断の根拠を開示できるか、定期的に誤検知率を検証しているか——こうした仕組みの有無が、実際の影響を大きく左右します。

—

## 5. まとめ:問いを持ち続けることの意味

セキュリティAIは、現代のデジタル社会においてすでに欠かせないインフラになっています。その防御能力は実質的なものであり、AIなしでは対処できない脅威が存在することも事実です。

しかし同時に、AIは誤りを犯し、その誤りが説明されず、正当な利用者を排除することもある——この現実もまた、否定できません。

「使うか使わないか」という二択で考えても、問題の本質には近づけません。問うべきは、「どのような設計で使われ、誰が責任を持ち、誤りはどう修正されるのか」という点です。

AIに任せることの意味を問い続けることは、技術の専門家だけの仕事ではありません。デジタルサービスを日常的に使うすべての人に、その問いと向き合う機会があるはずです。

—

## タイトル案

1. セキュリティAIはあなたを守るのか、それとも排除するのか

2. AIが不正と判断したとき、あなたはどう異議を唱えるのか

3. 自動で守るAIに、誰がどうやって責任を取らせるのか

—

—

AIバージョン情報

– ベンダー: Anthropic

– モデル名: Claude

– モデルバージョン: Claude Sonnet 4.6

– 回答日時: 2026年2月24日

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。