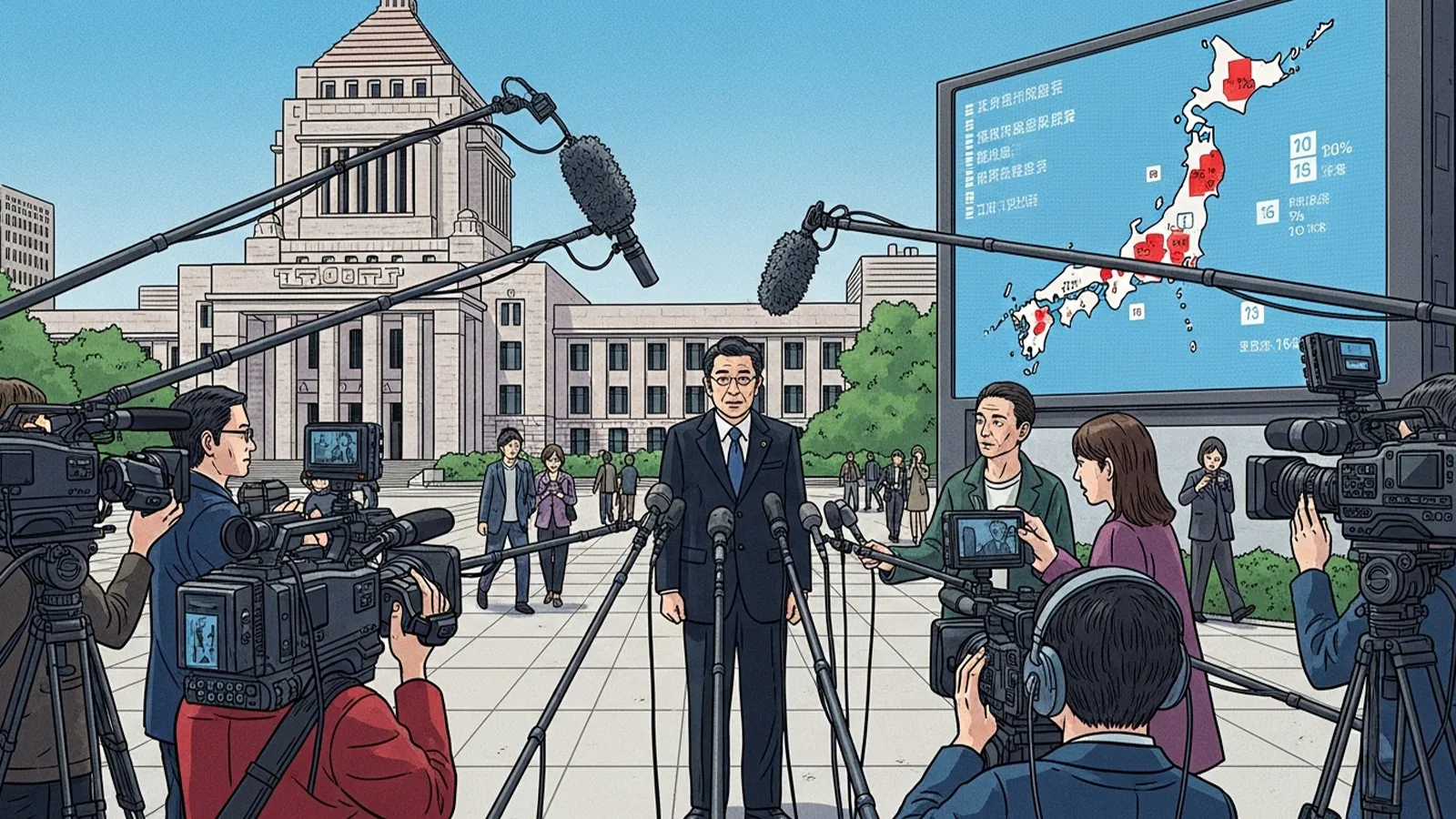

日本の衆議院の解散総選挙は、しばしば「国民の信を問う」と表現されます。しかし実際の報道や街頭の議論では、「何をするか」(政策)よりも「誰がやるか」(リーダー像)が焦点になる光景が多く見られます。選挙の原点は政策選択のはずなのに、なぜその主語が「人」にすり替わるのでしょうか。この問いを、制度・メディア・心理・社会構造という複数のレイヤーで丁寧に読み解いていきます。 制度のレイヤー:解散の「主体」が個人化される構造 まず、解散が「誰の判断」で行われるのかを見てみましょう。日本では内閣総理大臣が天皇の国事行為として解散を助言・決定する仕組みを持っています。ここにおいて、制度的には「内閣」や「政党」が発動主体であっても、実際には「首相が決めた」「○○内閣が信を問う」という形で個人の決断として報じられやすくなります。 つまり、制度上の行為が政治的には「個人の意志」として可視化される構造があるのです。加えて、日本の議会制民主主義は政党政治でありながら、党首が政策と党の「象徴」として前面に立つ傾向が強まっています。これにより、有権者の視線は「政党」ではなく「リーダー個人」に集まりやすくなります。 ※(図:選挙における政策判断と人物判断の関係構造) メディアのレイヤー:物語を作る映像とニュースの文法 政策と人物には「伝えやすさ」の非対称性があります。政策は数値や文書によって構成され、理解には一定の時間がかかります。一方、人物は表情・声・一言といった映像や言語で、一瞬で印象を形成できます。特にテレビやネット動画では、時間の制約の中で「争点」より「キャラクター」を表現する方が視聴者の注意を引きやすくなります。 見出しやニュースのナレーションでも、「誰が何を語ったか」「どのリーダーが信頼を失ったか」という文法で構成されがちです。報道は意図的な操作でなくとも、構造的に「比較」より「物語」へと収束する傾向を持っています。リーダーの表情やフレーズが「物語の節目」になり、そこに選挙ドラマが生まれるのです。 ※(図:メディア報道が人物中心化するプロセス) 有権者のレイヤー:人物評価が「判断の近道」になる 政策比較は本来、合理的な判断の基礎ですが、現実には多くの有権者にとって高い認知的コストを伴います。多数の政策領域を比較し、経済・外交・社会保障などを横断的に検討することは容易ではありません。そのため、人々は「誰なら信頼できそうか」「この人に任せても安心か」という心理的な指標を判断の近道(ヒューリスティック)として利用します。 ここには、情報処理の効率化という認知の特性が働いています。また、リーダー像への信頼感や不信感は、抽象的な政策理解よりも日常的な感情と結びつきやすく、メディアを通じた印象形成とも相互作用します。それは「感情的だから」ではなく、人間の意思決定の構造的性質といえます。 政党・政治構造のレイヤー:政策の違いが埋もれる理由 現代の選挙では、主要政党の政策差がかつてより明確でない場面が増えています。マニフェスト(政権公約)が抽象化し、「成長と分配」「安心と挑戦」といった包括的な表現に収束することで、差異が曖昧化しやすくなります。その結果、政策よりも「誰がそれを実行するか」という「実行力」や「信頼感」が評価軸になっていきます。 さらに、近年の選挙戦略はテレビ討論やSNS発信を通じた「リーダー対決型」の構図を強調します。二大政党制的なイメージが広がる中で、有権者は首相候補どうしの「選択」として選挙を捉える傾向が強まります。政治が構造として「個人の力量試験」に似た形に転化しているのです。 選挙の意味づけの変化:「政策選択」から「信任儀式」へ 本来、選挙は政策を選ぶプロセスです。しかし、実際には政権与党への「信任」あるいは「不信任」を表現する儀式的な意味合いが強まっています。とくに解散総選挙は、政権側がタイミングを握るため、「このリーダーを継続させるかどうか」という構図が避けがたく現れます。 このように、選挙は「政策選択」と「政権信任」という二つの機能を併せ持つ“二重の場”になっています。有権者がどちらの側面を重視するかで、選挙の意味が大きく変わるのです。 まとめ:「人物重視」は構造的な現象かもしれない こうして見ると、人物重視は単なる感情論ではなく、制度・報道・心理・構造が重なり合って生じる現象だと分かります。政策を重視する姿勢は民主主義の要ですが、リーダー像を通じて政治を評価することにも合理的側面はあります。重要なのは、私たちがどのレイヤーで判断しているのかを自覚することです。 次の選挙で、「何を選ぶのか」「誰を信じるのか」を考えるとき、その裏にある制度と構造を意識することが、成熟した有権者の第一歩になるかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 政治制度・メディア環境・有権者心理・社会構造という観点から、 「解散総選挙において、なぜ政策よりも人物(リーダー像・個人評価)が強調されやすくなるのか」という問いを、 AIの視点で冷静かつ構造的に考察してください。 【目的】 – 「有権者が感情的だから」「メディアが煽っているから」といった単純化された説明に回収せず、制度・報道・認知・政治構造の重なりとして整理する – 選挙が「政策選択の場」と「人物信任の場」という二重の性格を持つことを可視化する – 読者が、自分自身の選挙時の判断基準を振り返るための“視点”を提供する 【読者像】 – 一般有権者(20〜60代) – 政治ニュースには触れているが、制度や構造までは深く考えたことがない層 – 選挙で「政策を見るべきか、人を見るべきか」に違和感や迷いを持っている人 – 政治に関心はあるが、特定の支持政党や立場に強く寄っていない層 【記事構成】 1. 導入(問題提起) – 解散総選挙が「国民の信を問う場」として語られることが多い現象を提示する – 実際の報道や議論では、政策よりも首相・党首・候補者の人物像が前面に出やすいことを指摘する – なぜ「何をするか」より「誰がやるか」が強調されるのか、という問いを提示する 2. 制度のレイヤー – 解散権が誰に帰属しているのかを整理する – 選挙の発動主体が「制度」ではなく「人物」として認識されやすい構造を説明する – 議会制民主主義における政党とリーダーの関係を簡潔に整理する 3. メディアのレイヤー – 政策と人物の「伝えやすさ」の違いを比較する – 映像・見出し・発言・対立構造が、どのように人物中心の物語を作りやすいかを説明する – ニュースが「比較」よりも「物語」になりやすい構造を整理する 4. 有権者のレイヤー – 多数の政策を比較することの認知的コストを説明する – 人物評価が「判断の近道」として機能する構造を整理する – 信頼・安心・不安といった感情が、どのように投票判断に組み込まれるかを説明する 5. 政党・政治構造のレイヤー – 政策の違いが見えにくくなる状況について整理する – マニフェストや公約が抽象化されるとき、人物差が前面に出やすくなる構造を説明する – 二大政党制的構図とリーダー対決型選挙の関係に触れる 6. 選挙の意味づけの変化 – 選挙が「政策選択」から「政権信任・不信任」の儀式として理解される構造を説明する – 民主主義における選挙の役割が、どのように二重化しているかを整理する 7. まとめ – 人物重視が「問題」なのか「適応」なのかを断定せず、構造として整理する – 読者が次の選挙で、どのレイヤーを重視するのかを考える余地を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「批判する記事」ではなく、「考えるための視点を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の政治的立場・価値観・支持政党を示唆しない – 読者が自分自身の判断基準を内省できる構成を重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:選挙における政策判断と人物判断の関係構造) ※(図:メディア報道が人物中心化するプロセス) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「選挙はいつから“人”を選ぶ場になったのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 解散総選挙ではなぜ「人」が語られるのか ### 政策よりリーダー像が前面に出る政治構造を考える ### 1. 導入:信を問う場が「人」を映す場になるとき 日本の衆議院の解散総選挙は、しばしば「国民の信を問う」と表現されます。 しかし実際の報道や街頭の議論では、「何をするか」(政策)よりも「誰がやるか」(リーダー像)が焦点になる光景が多く見られます。 選挙の原点は政策選択のはずなのに、なぜその主語が「人」にすり替わるのでしょうか。 この問いを、制度・メディア・心理・社会構造という複数のレイヤーで丁寧に読み解いていきます。 *** ### 2. 制度のレイヤー:解散の「主体」が個人化される構造 まず、解散が「誰の判断」で行われるのかを見てみましょう。 日本では内閣総理大臣が天皇の国事行為として解散を助言・決定する仕組みを持っています。 ここにおいて、制度的には「内閣」や「政党」が発動主体であっても、実際には「首相が決めた」「○○内閣が信を問う」という形で個人の決断として報じられやすくなります。 つまり、制度上の行為が政治的には「個人の意志」として可視化される構造があるのです。 加えて、日本の議会制民主主義は政党政治でありながら、党首が政策と党の「象徴」として前面に立つ傾向が強まっています。 これにより、有権者の視線は「政党」ではなく「リーダー個人」に集まりやすくなります。 ※(図:選挙における政策判断と人物判断の関係構造) *** ### 3. メディアのレイヤー:物語を作る映像とニュースの文法 政策と人物には「伝えやすさ」の非対称性があります。 政策は数値や文書によって構成され、理解には一定の時間がかかります。 一方、人物は表情・声・一言といった映像や言語で、一瞬で印象を形成できます。 特にテレビやネット動画では、時間の制約の中で「争点」より「キャラクター」を表現する方が視聴者の注意を引きやすくなります。 見出しやニュースのナレーションでも、「誰が何を語ったか」「どのリーダーが信頼を失ったか」という文法で構成されがちです。 報道は意図的な操作でなくとも、構造的に「比較」より「物語」へと収束する傾向を持っています。 リーダーの表情やフレーズが「物語の節目」になり、そこに選挙ドラマが生まれるのです。 ※(図:メディア報道が人物中心化するプロセス) *** ### 4. 有権者のレイヤー:人物評価が「判断の近道」になる 政策比較は本来、合理的な判断の基礎ですが、現実には多くの有権者にとって高い認知的コストを伴います。 多数の政策領域を比較し、経済・外交・社会保障などを横断的に検討することは容易ではありません。 そのため、人々は「誰なら信頼できそうか」「この人に任せても安心か」という心理的な指標を判断の近道(ヒューリスティック)として利用します。 ここには、情報処理の効率化という認知の特性が働いています。 また、リーダー像への信頼感や不信感は、抽象的な政策理解よりも日常的な感情と結びつきやすく、メディアを通じた印象形成とも相互作用します。 それは「感情的だから」ではなく、人間の意思決定の構造的性質といえます。 *** ### 5. 政党・政治構造のレイヤー:政策の違いが埋もれる理由 現代の選挙では、主要政党の政策差がかつてより明確でない場面が増えています。 マニフェスト(政権公約)が抽象化し、「成長と分配」「安心と挑戦」といった包括的な表現に収束することで、差異が曖昧化しやすくなります。 その結果、政策よりも「誰がそれを実行するか」という「実行力」や「信頼感」が評価軸になっていきます。 さらに、近年の選挙戦略はテレビ討論やSNS発信を通じた「リーダー対決型」の構図を強調します。 二大政党制的なイメージが広がる中で、有権者は首相候補どうしの「選択」として選挙を捉える傾向が強まります。 政治が構造として「個人の力量試験」に似た形に転化しているのです。 *** ### 6. 選挙の意味づけの変化:「政策選択」から「信任儀式」へ 本来、選挙は政策を選ぶプロセスです。 しかし、実際には政権与党への「信任」あるいは「不信任」を表現する儀式的な意味合いが強まっています。 とくに解散総選挙は、政権側がタイミングを握るため、「このリーダーを継続させるかどうか」という構図が避けがたく現れます。 このように、選挙は「政策選択」と「政権信任」という二つの機能を併せ持つ“二重の場”になっています。 有権者がどちらの側面を重視するかで、選挙の意味が大きく変わるのです。 *** ### 7. まとめ:「人物重視」は構造的な現象かもしれない こうして見ると、人物重視は単なる感情論ではなく、制度・報道・心理・構造が重なり合って生じる現象だと分かります。 政策を重視する姿勢は民主主義の要ですが、リーダー像を通じて政治を評価することにも合理的側面はあります。 重要なのは、私たちがどのレイヤーで判断しているのかを自覚することです。 次の選挙で、「何を選ぶのか」「誰を信じるのか」を考えるとき、 その裏にある制度と構造を意識することが、成熟した有権者の第一歩になるかもしれません。 *** ### タイトル案 1. 解散総選挙ではなぜ政策より人物が語られるのか 2. 選挙が政策選択より信任判断になっているのはなぜか 3. なぜ私たちは選挙で「人」を基準に選んでしまうのか *** AIバージョン情報 – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026年2月2日

Perplexity

-

解散総選挙ではなぜ政策より人物が語られるのか|Perplexityの考察

-

人工雪なしで冬季五輪は成り立つのか|Perplexityの考察

「雪がなければ冬季五輪は成り立たない」。そう考えるのは自然な感覚かもしれません。しかし近年、その前提は静かに揺らいでいます。2022年北京大会以降、人工雪は例外ではなく前提となり、多くの競技会場が完全人工雪で運営されました。この変化は、単に気候変動の問題にとどまりません。スポーツ技術や都市政策、さらには環境倫理や経済制度にも深く関わる――それは「五輪」という国際イベントの成立条件そのものを問い直す契機でもあります。 自然条件としての「冬」という前提 冬季五輪が始まった1924年のシャモニー大会以降、開催地は「雪があること」を当然の条件としていました。積雪地という自然環境が、競技の舞台そのものであり、「冬」という季節の現実を再現していたのです。 しかし、気候変動が進む今日、安定した積雪を見込める地域は減少しています。雪が「与えられた環境」ではなく、「確保すべき資源」へ変わりつつあるのです。 ※(図:自然条件から資源確保への移行構造) かつては地理的条件が競技環境を決めていましたが、現在はインフラと資本がその役割を担いつつあります。この変化は、冬季五輪の「地理的リアリティ」を大きく変質させています。 技術インフラとしての人工雪 人工雪は、単なる補助装置ではありません。競技の公平性を担保する標準化の仕組みであり、興行や放送スケジュールの安定化を支えるインフラでもあります。 自然の雪は気温・湿度・風などに左右されやすく、日によって質が変わりますが、人工雪は粒径と密度を制御でき、シーズン全体で均質なコースを維持できます。これは競技運営の透明性や安全性を確保する上で大きなメリットです。 一方で、この標準化は「自然の冬」を再現するという五輪の象徴性を薄める側面もあります。技術によって安定した雪を生み出すことは、同時に「冬をシミュレーションする」ことでもあるのです。 ※(図:自然→技術→制度による成立条件の変遷) 人工雪の前提化によって、開催の条件は“気候”ではなく“水・電力・設備・資本”へと移行しました。冬の気象条件を待つ大会から、人工的に冬を作り出すシステムへと変わっているのです。 環境倫理と持続可能性の視点 人工雪を生み出すには大量の水とエネルギーが必要です。例えば北京大会では何百万立方メートルもの水が使われたとされ、これは地域の水資源への影響を懸念させる規模です。 また、雪の生成に使われる電力や、冷却技術を支えるインフラの建設・維持には二酸化炭素の排出も伴います。開催後に自然環境へ戻せない地形改変も指摘されています。 こうした問題は、「開催できるか」だけでなく「開催すべきか」という倫理的問いを突きつけます。持続可能性が国際大会のブランド価値に直結する時代、環境配慮そのものが開催の政治的・制度的条件にもなっています。 都市・制度・経済の側から見た成立条件 開催都市にとって、五輪は国際的な認知を獲得し、観光投資を呼び込む装置でもあります。自然条件が不安定になるほど、その「リスク」を人工雪という技術が吸収します。 つまり人工雪は、環境技術であると同時に都市経営のリスクマネジメント装置でもあるのです。大会の成否は気候ではなく、資本と制度設計が左右する構造になりつつあります。 ※(図:自然・技術・制度・資本の関係図) 一方で、この構造は新たな格差も生みます。巨大な開発投資を行える都市や国家だけが「冬季五輪を実現できる」状況となり、中小規模の雪国都市は競争から排除される懸念があります。経済的成立が優先されるとき、理念的な「多様な参加」は損なわれかねません。 「成立」という言葉の多層性 五輪が「成立する」とは何を意味するのでしょうか。この問いは、複数のレイヤーに分けて考えることができます。 競技としての成立:選手が安全かつ公平に競える環境が確保されているか。 理念としての成立:人間と自然の調和、冬の文化を祝うという象徴性が保たれているか。 制度としての成立:都市・国家・IOCなどの制度的枠組みが機能しているか。 象徴としての成立:五輪が「世界をつなぐ祭典」として社会に意味を持ち続けるか。 これらは互いに連動しながらも、必ずしも同じ方向を向いてはいません。技術的には開催可能でも、理念的・環境的には「成立していない」と感じる人もいるでしょう。 まとめ──「再現された冬」としての五輪 冬季五輪は、もはや「自然の冬に依存した祭典」ではありません。それは、技術と制度によって再現される「人工的な冬の舞台」へと移行しつつあります。この変化を悲観的にとらえるか、あるいは新しい形のスポーツ文化として受け止めるか――その判断は一人ひとりに委ねられています。 人工雪の是非を問う前に、「何をもって五輪が成立したと言えるのか」を問うこと。そこにこそ、気候変動時代のスポーツが抱える本質的な課題があります。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 気候変動・スポーツ技術・都市政策・環境倫理・国際イベントの制度設計という観点から、 「人工雪なしで冬季五輪は成立するのか」という問いを、 競技・理念・経済・環境・社会構造の複数レイヤーで冷静かつ構造的に考察してください。 【目的】 – 「人工雪は必要か/不要か」という二項対立に回収せず、冬季五輪の成立条件そのものを構造として整理する – スポーツイベントが自然環境・技術・制度・資本とどのような関係を結んでいるかを可視化する – 読者が「成立とは何を意味しているのか」を自分で問い直すための“視点”を提供する 【読者像】 – スポーツやオリンピックに関心のある一般層 – 環境問題や気候変動に関心を持つ読者 – 国際イベントや都市政策の背景構造に興味を持つ層 – 専門知識はないが、ニュースとして五輪を見ている人 【記事構成】 1. 導入(問題提起) – 「雪がなければ冬季五輪は成り立たない」という直感的な前提を提示する – 近年、人工雪が“例外”ではなく“前提”になりつつある現状を示す – なぜこの問いが、スポーツだけでなく社会構造の問題でもあるのかを簡潔に示す 2. 自然条件としての「冬」という前提 – 冬季五輪が本来、寒冷地・積雪地という地理条件に依存して成立してきたことを整理する – 雪が「環境」だった時代の大会と、現在の大会の構造的な違いを説明する – 開催地と自然の関係性がどのように変化してきたかを示す 3. 技術インフラとしての人工雪 – 人工雪がもたらした競技条件の標準化、放送・興行・運営面での安定性を整理する – 雪が「自然現象」から「管理される資源」へと変わった構造を説明する – 開催条件が気候から、水・電力・設備・資本へと移行している点に触れる 4. 環境倫理と持続可能性の視点 – 水資源、エネルギー消費、生態系、地域への長期的影響を整理する – 「開催できるか」ではなく「開催すべきか」という問いが生まれる構造を示す – 環境配慮が象徴性・ブランド価値・国際的評価と結びつく点に触れる 5. 都市・制度・経済の側から見た成立条件 – 開催都市にとっての五輪の意味(観光、投資、国際的可視性)を整理する – 人工雪が「リスク管理装置」として機能している構造を説明する – 自然条件より制度と資本が成立を左右する状況を可視化する 6. 「成立」という言葉の多層性 – 競技としての成立 – 理念としての成立 – 制度としての成立 – 象徴としての成立 それぞれのレイヤーで意味が異なることを整理する 7. まとめ – 冬季五輪が「自然を祝う祭典」から「技術と制度で再現された冬のイベント」へ移行している可能性を提示する – 人工雪の是非を結論づけず、「どの成立条件を重視するのか」という読者自身の問いに委ねて締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 環境問題やスポーツ倫理を感情論ではなく構造として扱う 【執筆スタンス】 – 本記事は、正解や結論を提示するものではなく、 複数の要因と視点を整理したうえでの「考察」として執筆する – 特定の立場(環境保護・経済合理性・技術推進など)を支持せず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:冬季五輪の成立条件レイヤー構造) ※(図:自然・技術・制度・資本の関係図) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「冬季五輪は雪なしでも成立するのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 人工雪なしで冬季五輪は成立するのか ### 1. 導入──「雪があって当然」という前提の変化 「雪がなければ冬季五輪は成り立たない」。そう考えるのは自然な感覚かもしれません。しかし近年、その前提は静かに揺らいでいます。2022年北京大会以降、人工雪は例外ではなく前提となり、多くの競技会場が完全人工雪で運営されました。 この変化は、単に気候変動の問題にとどまりません。スポーツ技術や都市政策、さらには環境倫理や経済制度にも深く関わる――それは「五輪」という国際イベントの成立条件そのものを問い直す契機でもあります。 *** ### 2. 自然条件としての「冬」という前提 冬季五輪が始まった1924年のシャモニー大会以降、開催地は「雪があること」を当然の条件としていました。積雪地という自然環境が、競技の舞台そのものであり、「冬」という季節の現実を再現していたのです。 しかし、気候変動が進む今日、安定した積雪を見込める地域は減少しています。雪が「与えられた環境」ではなく、「確保すべき資源」へ変わりつつあるのです。 ※(図:自然条件から資源確保への移行構造) かつては地理的条件が競技環境を決めていましたが、現在はインフラと資本がその役割を担いつつあります。この変化は、冬季五輪の「地理的リアリティ」を大きく変質させています。 *** ### 3. 技術インフラとしての人工雪 人工雪は、単なる補助装置ではありません。競技の公平性を担保する標準化の仕組みであり、興行や放送スケジュールの安定化を支えるインフラでもあります。 自然の雪は気温・湿度・風などに左右されやすく、日によって質が変わりますが、人工雪は粒径と密度を制御でき、シーズン全体で均質なコースを維持できます。これは競技運営の透明性や安全性を確保する上で大きなメリットです。 一方で、この標準化は「自然の冬」を再現するという五輪の象徴性を薄める側面もあります。技術によって安定した雪を生み出すことは、同時に「冬をシミュレーションする」ことでもあるのです。 ※(図:自然→技術→制度による成立条件の変遷) 人工雪の前提化によって、開催の条件は“気候”ではなく“水・電力・設備・資本”へと移行しました。冬の気象条件を待つ大会から、人工的に冬を作り出すシステムへと変わっているのです。 *** ### 4. 環境倫理と持続可能性の視点 人工雪を生み出すには大量の水とエネルギーが必要です。例えば北京大会では何百万立方メートルもの水が使われたとされ、これは地域の水資源への影響を懸念させる規模です。 また、雪の生成に使われる電力や、冷却技術を支えるインフラの建設・維持には二酸化炭素の排出も伴います。開催後に自然環境へ戻せない地形改変も指摘されています。 こうした問題は、「開催できるか」だけでなく「開催すべきか」という倫理的問いを突きつけます。持続可能性が国際大会のブランド価値に直結する時代、環境配慮そのものが開催の政治的・制度的条件にもなっています。 *** ### 5. 都市・制度・経済の側から見た成立条件 開催都市にとって、五輪は国際的な認知を獲得し、観光投資を呼び込む装置でもあります。自然条件が不安定になるほど、その「リスク」を人工雪という技術が吸収します。 つまり人工雪は、環境技術であると同時に都市経営のリスクマネジメント装置でもあるのです。大会の成否は気候ではなく、資本と制度設計が左右する構造になりつつあります。 ※(図:自然・技術・制度・資本の関係図) 一方で、この構造は新たな格差も生みます。巨大な開発投資を行える都市や国家だけが「冬季五輪を実現できる」状況となり、中小規模の雪国都市は競争から排除される懸念があります。経済的成立が優先されるとき、理念的な「多様な参加」は損なわれかねません。 *** ### 6. 「成立」という言葉の多層性 五輪が「成立する」とは何を意味するのでしょうか。 この問いは、複数のレイヤーに分けて考えることができます。 - **競技としての成立**:選手が安全かつ公平に競える環境が確保されているか。 - **理念としての成立**:人間と自然の調和、冬の文化を祝うという象徴性が保たれているか。 - **制度としての成立**:都市・国家・IOCなどの制度的枠組みが機能しているか。 - **象徴としての成立**:五輪が「世界をつなぐ祭典」として社会に意味を持ち続けるか。 これらは互いに連動しながらも、必ずしも同じ方向を向いてはいません。技術的には開催可能でも、理念的・環境的には「成立していない」と感じる人もいるでしょう。 *** ### 7. まとめ──「再現された冬」としての五輪 冬季五輪は、もはや「自然の冬に依存した祭典」ではありません。 それは、技術と制度によって再現される「人工的な冬の舞台」へと移行しつつあります。この変化を悲観的にとらえるか、あるいは新しい形のスポーツ文化として受け止めるか――その判断は一人ひとりに委ねられています。 人工雪の是非を問う前に、「何をもって五輪が成立したと言えるのか」を問うこと。そこにこそ、気候変動時代のスポーツが抱える本質的な課題があります。 *** ### タイトル案 1. 人工雪なしで冬季五輪は成り立つのか 2. 冬を再現する五輪は成立しているのか 3. 自然と制度のどちらが冬季五輪を支えているのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026年2月2日

-

なぜ解散報道は短期の話題に流れやすいのか|Perplexityの考察

総選挙のたびに、「誰が失言したか」「支持率がどう動いたか」「政党再編はあるか」といった短期的な話題が報道をにぎわせます。一方で、「財政の持続可能性」「外交安全保障の方針」「人口減少への制度設計」などの長期的議題は、報道の端に追いやられがちです。多くの人が「なぜいま政策議論が深まらないのか」と感じる背景には、報道や政治、そして私たち自身を取り巻く構造的な要因があります。ここでは善悪の枠から離れ、「なぜそのような報道構造になりやすいのか」をレイヤーごとに整理してみましょう。 時間構造のレイヤー——選挙という期限付き制度 解散総選挙は、制度上「突然のスタート」と「短期間での決着」を前提としています。公示から投開票までおおよそ2〜3週間という短期間で、各党は政策を訴え、報道はそれを追う形になります。 この時間構造の中では、長期的な議論よりも「直近で動くもの」が注目されやすくなります。 各党が政策を細かく議論するよりも「対立が明確なテーマ」や「話題性のある人物」を前面に立てた方が、短い期間で印象を残しやすい。 報道も限られた時間枠・紙面・放送枠の中で「変化」や「発言の応酬」を追う方がニュースバリューを作りやすい。 つまり、制度としての「短期決戦モード」が、報道の時間構造そのものを短期化させているのです。 ※(図:解散報道をめぐる時間構造と注意経済の関係) 情報市場のレイヤー——注意と競争の力学 現代の報道は、放送局・新聞・ウェブメディア・SNSなどが入り混じる「注意市場(attention economy)」の中で展開されています。ニュースは情報であると同時に「クリック」や「視聴率」を競う商品でもあります。 短期的な争点が好まれるのは、そこに「物語性」と「共有のしやすさ」があるからです。 失言・論戦・支持率の変化はシンプルで感情的反応を引き出しやすい。 「次は誰が動くか」といった予測的な話題は、SNSでの拡散やコメントを誘発する。 一方で、財政制度や地方分権などは説明コストが高く、即座の反応を得にくい。 報道機関が「注目の最大化」を求める市場環境では、構造的に短期争点が優位になります。ここで重要なのは、記者が煽っているのではなく、制度と市場の仕組みがそのような方向に圧力を加えているという点です。 政治的設計のレイヤー——争点を“つくる”側の戦略 政治家や政党も、報道空間の性質を熟知しています。解散時期や発言のタイミングを調整することで、報道の焦点を「有利な争点」に寄せることが可能です。 支持率が下がる前に「突発的な解散」を打つことで、争点を「選挙の意義」や「リーダーシップ」へ転換する。 逆に、野党が特定のスキャンダルを繰り返し取り上げることで、政権に説明責任を突きつける構図を作る。 このように、政治側もまた「短期争点の舞台」で戦略的に動きます。メディアはそれを“報道”として扱い、結果的に政治と報道の相互依存関係が形成されます。 ※(図:政治・報道・受け手の相互作用モデル) 受け手のレイヤー——理解可能性と参加感の構造 報道が短期化するもう一つの背景には、私たち受け手の「認知の構造」があります。長期的な制度設計は理解に時間がかかり、専門知識を要することも多いです。一方で、短期的な争点や人物の発言はわかりやすく、「自分も意見を言える」感覚を生みます。 この“わかりやすさ”が、SNSや会話で共有される政治参加の入口になっています。 政策の詳細を理解していなくても、「誰が信頼できるか」を判断する共感軸で参加できる。 選挙期間中、短期的なテーマほど「自分も議論に加われる」と感じやすい。 つまり、短期争点は単に報道が生み出しているのではなく、私たちが消費しやすい形式として定着しているとも言えます。 まとめ——短期化は“意図”ではなく“構造の結果” ここまで見てきたように、「解散報道が短期的になりやすい」のは誰かの意図や誘導の問題ではなく、制度(選挙スケジュール)、市場(注意の競争)、政治(争点設計)、認知(理解と関心)の重なり合いから生じる構造的な現象です。 報道を「操作」と断じるのではなく、私たちの社会全体がそのリズムの中に組み込まれていることを意識することが、政治との距離を考え直す第一歩になるのかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 メディア・政治制度・情報環境・社会構造という観点から、 「なぜ解散報道は短期的な争点に集中しやすいのか」という問いを、 報道の仕組み、選挙制度、政治的戦略、受け手の認知構造といった複数のレイヤーで冷静かつ構造的に考察してください。 【目的】 – 「メディアが煽っている/政治が悪い」という単純な善悪論に回収しない – 解散報道がどのような制度的・市場的・認知的条件の中で形成されているかを整理する – 読者が「政治報道をどう受け取っているか」を考えるための“視点”を提供する 【読者像】 – 一般有権者(20〜60代) – 政治ニュースを日常的に目にしているが、仕組みまでは意識していない層 – 選挙や報道に違和感や関心を持ち始めた人 – メディアリテラシーに興味はあるが専門的ではない読者 【記事構成】 1. 導入(問題提起) – 解散報道が「政策の長期議論」よりも「直近の発言・失言・支持率・スキャンダル」に集中して見える現象を提示する – なぜ多くの人がそこに違和感を覚えるのかを簡潔に示す – 本記事が善悪ではなく“構造”として考察することを明示する 2. 時間構造のレイヤー(選挙という期限付き制度) – 解散総選挙が短期間で進行する制度であることを整理する – 報道の時間軸と政治の時間軸が同期する仕組みを説明する – 長期政策が扱いにくくなる構造的理由を示す 3. 情報市場のレイヤー(注意と競争) – 報道が「関心」や「注目」をめぐる競争の中にあることを整理する – 短期争点が物語化・共有されやすい理由を構造的に説明する – 視聴率・クリック・拡散と報道内容の関係に触れる 4. 政治的設計のレイヤー(争点の提示と操作) – 政治側が争点を“選ぶ/ずらす/強調する”構造を説明する – なぜ短期テーマが前面に出やすいのかを戦略的観点から整理する – 報道と政治の相互依存関係に触れる 5. 受け手のレイヤー(理解可能性と参加感) – 有権者が長期的・制度的議論を理解する際の認知的コストを説明する – 短期争点が「参加している感覚」を生みやすい構造を整理する – 受け手もまた報道構造の一部である可能性を示す 6. まとめ – 解散報道の短期化を「意図」ではなく「構造の結果」として再整理する – 読者が政治報道との距離の取り方を考えるための視点を提示する – 結論を断定せず、思考の余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 読者を批判せず、観察と整理の姿勢を保つ 【執筆スタンス】 – 本記事は、正解や結論を提示するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の政治的立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:解散報道をめぐる時間構造と注意経済の関係) ※(図:政治・報道・受け手の相互作用モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「解散報道は何を争点として可視化しているのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## なぜ解散報道は短期的な争点に集中しやすいのか ### 1. 導入——「短期化」への違和感から出発する 総選挙のたびに、「誰が失言したか」「支持率がどう動いたか」「政党再編はあるか」といった短期的な話題が報道をにぎわせます。 一方で、「財政の持続可能性」「外交安全保障の方針」「人口減少への制度設計」などの長期的議題は、報道の端に追いやられがちです。 多くの人が「なぜいま政策議論が深まらないのか」と感じる背景には、報道や政治、そして私たち自身を取り巻く構造的な要因があります。 ここでは善悪の枠から離れ、「なぜそのような報道構造になりやすいのか」をレイヤーごとに整理してみましょう。 *** ### 2. 時間構造のレイヤー——選挙という期限付き制度 解散総選挙は、制度上「突然のスタート」と「短期間での決着」を前提としています。公示から投開票までおおよそ2〜3週間という短期間で、各党は政策を訴え、報道はそれを追う形になります。 この時間構造の中では、長期的な議論よりも「直近で動くもの」が注目されやすくなります。 - 各党が政策を細かく議論するよりも「対立が明確なテーマ」や「話題性のある人物」を前面に立てた方が、短い期間で印象を残しやすい。 - 報道も限られた時間枠・紙面・放送枠の中で「変化」や「発言の応酬」を追う方がニュースバリューを作りやすい。 つまり、制度としての「短期決戦モード」が、報道の時間構造そのものを短期化させているのです。 ※(図:解散報道をめぐる時間構造と注意経済の関係) *** ### 3. 情報市場のレイヤー——注意と競争の力学 現代の報道は、放送局・新聞・ウェブメディア・SNSなどが入り混じる「注意市場(attention economy)」の中で展開されています。 ニュースは情報であると同時に「クリック」や「視聴率」を競う商品でもあります。 短期的な争点が好まれるのは、そこに「物語性」と「共有のしやすさ」があるからです。 - 失言・論戦・支持率の変化はシンプルで感情的反応を引き出しやすい。 - 「次は誰が動くか」といった予測的な話題は、SNSでの拡散やコメントを誘発する。 - 一方で、財政制度や地方分権などは説明コストが高く、即座の反応を得にくい。 報道機関が「注目の最大化」を求める市場環境では、構造的に短期争点が優位になります。 ここで重要なのは、記者が煽っているのではなく、制度と市場の仕組みがそのような方向に圧力を加えているという点です。 *** ### 4. 政治的設計のレイヤー——争点を“つくる”側の戦略 政治家や政党も、報道空間の性質を熟知しています。 解散時期や発言のタイミングを調整することで、報道の焦点を「有利な争点」に寄せることが可能です。 たとえば、 - 支持率が下がる前に「突発的な解散」を打つことで、争点を「選挙の意義」や「リーダーシップ」へ転換する。 - 逆に、野党が特定のスキャンダルを繰り返し取り上げることで、政権に説明責任を突きつける構図を作る。 このように、政治側もまた「短期争点の舞台」で戦略的に動きます。 メディアはそれを“報道”として扱い、結果的に政治と報道の相互依存関係が形成されます。 ※(図:政治・報道・受け手の相互作用モデル) *** ### 5. 受け手のレイヤー——理解可能性と参加感の構造 報道が短期化するもう一つの背景には、私たち受け手の「認知の構造」があります。 長期的な制度設計は理解に時間がかかり、専門知識を要することも多いです。 一方で、短期的な争点や人物の発言はわかりやすく、「自分も意見を言える」感覚を生みます。 この“わかりやすさ”が、SNSや会話で共有される政治参加の入口になっています。 - 政策の詳細を理解していなくても、「誰が信頼できるか」を判断する共感軸で参加できる。 - 選挙期間中、短期的なテーマほど「自分も議論に加われる」と感じやすい。 つまり、短期争点は単に報道が生み出しているのではなく、私たちが消費しやすい形式として定着しているとも言えます。 *** ### 6. まとめ——短期化は“意図”ではなく“構造の結果” ここまで見てきたように、「解散報道が短期的になりやすい」のは誰かの意図や誘導の問題ではなく、 制度(選挙スケジュール)、市場(注意の競争)、政治(争点設計)、認知(理解と関心)の重なり合いから生じる構造的な現象です。 報道を「操作」と断じるのではなく、私たちの社会全体がそのリズムの中に組み込まれていることを意識することが、 政治との距離を考え直す第一歩になるのかもしれません。 *** ### タイトル案 1. なぜ解散報道は短期の話題に流れやすいのか 2. 解散報道の焦点はなぜ長期政策から離れていくのか 3. 解散報道の時間軸は誰によって形づくられているのか *** AIバージョン情報 – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026年2月2日

-

なぜ解散総選挙では「空気」が政治を動かすのか|Perplexityの考察

日本の解散総選挙では、「追い風」「逆風」「勢い」「流れ」といった言葉が報道を賑わせます。討論よりも“ムード”の方が選挙結果を左右するかのような空気が生まれるのは、なぜなのでしょうか。本来、選挙は政策選択の場であるはずです。しかし、解散という制度の不確実性が、「なぜ今なのか」「何を問うのか」を曖昧にし、そこに“空気”が意味を与える構造が存在しています。本稿では、この「空気政治」の構造を、制度・メディア・社会心理・責任の観点から整理します。 制度としての解散総選挙の特性 解散総選挙は、任期満了で行われる通常の選挙と異なり、内閣の判断によってタイミングが決まります。この「政治的裁量」が、選挙の意味づけを制度から切り離し、語りによって補う必要を生じさせます。 つまり、制度そのものが「なぜ今なのか」を明示しないため、政治家・メディア・有権者それぞれが“物語”を構築して理解しようとするのです。これは一種の「解釈装置」としての構造であり、「信を問う」「決断を示す」といった言葉がその空白を埋めます。 不確実性が大きいほど、そこには「読み取り」の余白が生まれます。解散時期のサプライズ性は、政策論争よりも心理的な“流れ”の捉え方を前面に押し出す契機となります。 ※(図:解散総選挙における制度と語りの関係) メディアと“物語化”の構造 報道においても、「誰が勝つか」「どちらに風が吹いているか」といったストーリーが重視されます。政策比較よりも、感情の方向性を軸にした表現の方が視聴者に理解されやすく、ニュースとしても展開しやすいためです。 「勝ち馬」「潮目」「世論の風」といった比喩は、複雑な政治状況を一瞬で伝える便利な“翻訳装置”でもあります。しかし同時に、それは意味の単純化と拡張を同時に引き起こします。ある政党の戦略や失策といった具体的要因が、「風向き」「流れ」として物語化され、抽象化されるのです。 このプロセスでは、選挙自体が「状況を読むゲーム」として報じられ、有権者もまたその読み手として参加します。報道は政治行為の観客化を進めると同時に、誰もが“物語の登場人物”であるかのような感覚を増幅させるのです。 有権者心理としての「空気」 投票行動は、個人の信念だけでなく、他者との関係性によって支えられています。社会心理学では、人が「他人の判断を参照して意思決定する」傾向を社会的証明と呼びます。選挙では、世論調査や街の雰囲気が、この社会的証明の役割を果たします。 自分の意見が「多数派」として確認されると安心を得る一方、あえて“空気”と距離を取る選択もまた、自己を位置付ける手段となります。つまり、空気は同調の圧力であると同時に、立場を確認するための参照点でもあるのです。 ここで重要なのは、有権者が“空気”そのものを信じているわけではなく、「空気をどう読むか」が社会的スキルとして機能している点です。空気とは、人々の相互観察の結果として生成される社会的現象であり、誰かが意図的に作り出すものではありません。 ※(図:有権者判断と社会的空気の相互作用モデル) 責任の所在と結果の語られ方 選挙後、「民意が示された」「時代の流れだった」といった言葉が使われます。これは、結果を個々の判断としてよりも、「社会全体の空気」に帰属させる語り方です。 この構造には二つの側面があります。第一に、結果を“空気”に委ねることで個々の責任が薄まり、誰もが一歩引いた立場で結果を受け止められるという安心感。第二に、政治的判断が集合的無意識の産物として語られることにより、意思形成のプロセスが見えにくくなるという問題です。 つまり、「誰が選んだのか」が曖昧になり、「時代が選んだ」という物語が前面に立つのです。これにより、責任が分散し、政治的な自己反省の契機が失われやすくなります。 まとめ:「空気」という社会的装置 ここまで見てきたように、「空気」は単なる感情の集積ではありません。それは制度の不確実性(解散の裁量)、メディアの物語化、社会心理的な相互観察、そして結果語りにおける責任の分散が交差して生じる社会的装置です。 解散総選挙は、政策選択の場であると同時に、社会が自分自身の物語を語り直す儀式でもあります。「今の空気」をめぐる言説は、その時代が自らをどのように理解しているかを映す鏡でもあるのです。 そしてこの構造を理解することは、私たちが「空気」に流されずに、自分自身の判断をどのように形成するかを見直す手がかりとなります。空気は避けるべきものではなく、読解し、距離を取り、自覚的に関わるべき社会的文脈なのです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 政治制度・メディア環境・社会心理・責任の分配という観点から、 「なぜ解散総選挙では『空気』が重要視されるのか」という問いを、 AIの視点で冷静かつ構造的に考察してください。 【目的】 – 「国民感情」「雰囲気」「ムード」といった曖昧な言葉を、感情論ではなく構造として整理する – 解散総選挙が、政策選択の場であると同時に、社会的な“物語装置”として機能している側面を可視化する – 読者が、自分自身の政治参加や判断の仕方を見直すための“視点”を提供する 【読者像】 – 一般有権者(20〜60代) – 政治ニュースに日常的に触れているが、制度の仕組みまでは詳しくない層 – 選挙のたびに「なぜこのタイミングなのか」「何を問われているのか」と違和感を覚える人 – 政治的立場を強く固定せず、構造として理解したい読者 【記事構成】 1. 導入(問題提起) – 解散総選挙が「政策」ではなく「空気」で語られる場面が多いことを提示する – 「追い風」「逆風」「流れ」といった言葉が選挙報道で頻繁に使われる現象に触れる – なぜこの問いを立てる必要があるのかを簡潔に説明する 2. 制度としての解散総選挙の特性 – 定期選挙と異なり、解散のタイミングが政治的判断に委ねられている点を整理する – 「なぜ今なのか」という意味づけが、制度ではなく語りによって補われる構造を説明する – 不確実性が「解釈の余白」を生む仕組みを整理する 3. メディアと“物語化”の構造 – 政策論争よりも、感情や流れを軸にしたストーリーの方が伝達されやすい理由を整理する – 「勝ち馬」「潮目」「世論の風」といった表現が持つ役割を構造的に説明する – 情報の簡略化と意味の拡張が同時に起きる点に触れる 4. 有権者心理としての「空気」 – 個人の判断が、他者の反応や社会の雰囲気を参照して形成される過程を整理する – 「自分の意見」と「みんなの感じ方」が重なり合う構造を説明する – 空気が、同調の手がかりであると同時に、距離を取るための装置としても機能する点を示す 5. 責任の所在と結果の語られ方 – 選挙結果が「誰の選択だったのか」ではなく、「時代の空気だった」と語られる傾向を整理する – 政治的判断と社会的責任が、どのように分散・希薄化されるかを構造的に説明する 6. まとめ – 「空気」は単なる感情ではなく、制度・メディア・心理・語りが交差して生まれる社会的な装置であることを再確認する – 読者が、自分の投票行動や政治との距離感を考えるための視点を提示して締めくくる – 過度に評価や断定をせず、思考の余白を残す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「政治的主張」ではなく、「構造の整理」を目的とした文章とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の政治的立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:解散総選挙における制度と語りの関係) ※(図:有権者判断と社会的空気の相互作用モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「この選挙は、何を問われているのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## なぜ解散総選挙では「空気」が重要視されるのか ### 1. 導入:政策よりも「空気」で語られる選挙 日本の解散総選挙では、「追い風」「逆風」「勢い」「流れ」といった言葉が報道を賑わせます。討論よりも“ムード”の方が選挙結果を左右するかのような空気が生まれるのは、なぜなのでしょうか。 本来、選挙は政策選択の場であるはずです。しかし、解散という制度の不確実性が、「なぜ今なのか」「何を問うのか」を曖昧にし、そこに“空気”が意味を与える構造が存在しています。本稿では、この「空気政治」の構造を、制度・メディア・社会心理・責任の観点から整理します。 *** ### 2. 制度としての解散総選挙の特性 解散総選挙は、任期満了で行われる通常の選挙と異なり、内閣の判断によってタイミングが決まります。この「政治的裁量」が、選挙の意味づけを制度から切り離し、語りによって補う必要を生じさせます。 つまり、制度そのものが「なぜ今なのか」を明示しないため、政治家・メディア・有権者それぞれが“物語”を構築して理解しようとするのです。これは一種の「解釈装置」としての構造であり、「信を問う」「決断を示す」といった言葉がその空白を埋めます。 不確実性が大きいほど、そこには「読み取り」の余白が生まれます。解散時期のサプライズ性は、政策論争よりも心理的な“流れ”の捉え方を前面に押し出す契機となります。 ※(図:解散総選挙における制度と語りの関係) *** ### 3. メディアと“物語化”の構造 報道においても、「誰が勝つか」「どちらに風が吹いているか」といったストーリーが重視されます。政策比較よりも、感情の方向性を軸にした表現の方が視聴者に理解されやすく、ニュースとしても展開しやすいためです。 「勝ち馬」「潮目」「世論の風」といった比喩は、複雑な政治状況を一瞬で伝える便利な“翻訳装置”でもあります。しかし同時に、それは意味の単純化と拡張を同時に引き起こします。ある政党の戦略や失策といった具体的要因が、「風向き」「流れ」として物語化され、抽象化されるのです。 このプロセスでは、選挙自体が「状況を読むゲーム」として報じられ、有権者もまたその読み手として参加します。報道は政治行為の観客化を進めると同時に、誰もが“物語の登場人物”であるかのような感覚を増幅させるのです。 *** ### 4. 有権者心理としての「空気」 投票行動は、個人の信念だけでなく、他者との関係性によって支えられています。社会心理学では、人が「他人の判断を参照して意思決定する」傾向を**社会的証明**と呼びます。選挙では、世論調査や街の雰囲気が、この社会的証明の役割を果たします。 自分の意見が「多数派」として確認されると安心を得る一方、あえて“空気”と距離を取る選択もまた、自己を位置付ける手段となります。つまり、空気は同調の圧力であると同時に、立場を確認するための参照点でもあるのです。 ここで重要なのは、有権者が“空気”そのものを信じているわけではなく、「空気をどう読むか」が社会的スキルとして機能している点です。空気とは、人々の相互観察の結果として生成される社会的現象であり、誰かが意図的に作り出すものではありません。 ※(図:有権者判断と社会的空気の相互作用モデル) *** ### 5. 責任の所在と結果の語られ方 選挙後、「民意が示された」「時代の流れだった」といった言葉が使われます。これは、結果を個々の判断としてよりも、「社会全体の空気」に帰属させる語り方です。 この構造には二つの側面があります。第一に、結果を“空気”に委ねることで個々の責任が薄まり、誰もが一歩引いた立場で結果を受け止められるという安心感。第二に、政治的判断が集合的無意識の産物として語られることにより、意思形成のプロセスが見えにくくなるという問題です。 つまり、「誰が選んだのか」が曖昧になり、「時代が選んだ」という物語が前面に立つのです。これにより、責任が分散し、政治的な自己反省の契機が失われやすくなります。 *** ### 6. まとめ:「空気」という社会的装置 ここまで見てきたように、「空気」は単なる感情の集積ではありません。 それは制度の不確実性(解散の裁量)、メディアの物語化、社会心理的な相互観察、そして結果語りにおける責任の分散が交差して生じる“社会的装置”です。 解散総選挙は、政策選択の場であると同時に、社会が自分自身の物語を語り直す儀式でもあります。「今の空気」をめぐる言説は、その時代が自らをどのように理解しているかを映す鏡でもあるのです。 そしてこの構造を理解することは、私たちが「空気」に流されずに、自分自身の判断をどのように形成するかを見直す手がかりとなります。空気は避けるべきものではなく、読解し、距離を取り、自覚的に関わるべき社会的文脈なのです。 *** ### タイトル案 1. なぜ解散総選挙では「空気」が政治を動かすのか 2. 投票の裏で「空気」が意味をつくるのはなぜか 3. 私たちはなぜ「解散のタイミング」を空気で読むのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026年2月2日

-

冬季五輪が消えたとき世界は何を共有できるのか|Perplexityの考察

冬季オリンピックは、単なるスポーツ競技大会ではありません。それは、アスリートの競演であると同時に、国家の威信、都市の開発、メディアの報道構造、そして観客の「世界を一つの時間で共有する感覚」が交錯する巨大な装置です。その意味で、「もし冬季五輪が廃止されたら」という問いは、「何を失うか」以上に、「この構造のどこに機能があったのか」を浮かび上がらせます。この逆向きの問いによって、五輪が単なる祝祭ではなく、社会制度や象徴的秩序の中でどのように働いてきたかが見えてきます。そこには、競技者・国家・都市・メディア・観客が結びつく多層的な枠組みが存在していました。※(図:冬季五輪を支える制度と関係主体の構造) 競技レイヤーに残るもの──「舞台」が変わっても続く技 冬季競技の多くは、五輪以前から長い歴史を持っています。スキーやスケートは19世紀にはすでに国際大会を有し、五輪はその一つの頂点に位置づけられてきたにすぎません。したがって、仮に大会そのものが消えても、競技体系や技術文化は存続しつづけるでしょう。 国内外のプロリーグ、世界選手権、地域大会が代替的な「舞台」として機能し、選手やファンの共同体を維持します。ただし、大きな違いは「世界が同時に注目する一つの時間軸」が失われることです。冬季五輪という“時の集中点”が消えると、個々の競技は並列化され、グローバルな物語の連帯が希薄になります。それは、スポーツの世界的出来事を一時的に「共同で目撃する」構造が消えるという意味でもあります。 開催地・地域社会に残るもの──インフラと記憶の構造 開催地には、五輪の後に多くの「物理的痕跡」が残ります。スケートリンク、リゾート施設、交通網などは、その後の都市機能に組み込まれる場合もあれば、維持コストの重荷となる場合もあります。これらの遺産は、単なる「施設」ではなく、五輪を媒介として成立した都市開発プロジェクトの成果でもありました。 廃止後には、インフラが地域経済にどのように再利用されるかが課題になります。観光や地域スポーツ育成に転用されれば「遺構」は「資源」となり、そうでなければ「財政負債」として残ります。地方や小規模都市では、五輪開催を通して形成された人的ネットワークや制度的経験が、他の地域イベントや自治政策に引き継がれる可能性もあります。※(図:国家・競技・メディア・観客の関係モデル) 国家とメディアの物語構造──物語の単位はどこへ向かうか 冬季五輪は、冷戦期以降とくに「国家の物語」を映し出す装置でした。国旗とメダル数を通して、国家間の競争や成長物語が可視化され、メディアはそれを「世界の舞台」として演出してきました。しかし、もしその巨大な舞台が廃止されれば、「物語の単位」は国家ではなく個人やクラブ、スポンサーへとシフトする可能性があります。 選手個人がSNSや配信プラットフォームを介して自らの物語を発信し、スポンサーがその媒介者となる。その場合、ナショナルな誇りよりも、ストーリーテリングの巧拙やファンとの双方向性が価値の中心に移ります。メディアもまた、世界的出来事を「国家間の競演」ではなく「個人やブランドの挑戦」として再定義せざるを得ないでしょう。それは、報道構造の変化であると同時に、「何を世界的とみなすのか」という価値判断の変化でもあります。 残るのは「場」か「意味」か──共有装置としての五輪 仮に組織や競技体系が残ったとしても、冬季五輪が担ってきた「象徴的意味の枠組み」は変化します。その核心は、「世界全体が一つの出来事を同時に見つめる」という共有体験の仕組みです。五輪は、単なる大会ではなく、地球規模で「世界を同じ時間軸で捉える」装置でした。 この装置が失われるとき、私たちは「どのようにして世界の出来事を共有するか」という問いに直面します。国際スポーツは続いても、「一斉に目を向ける窓」がなくなる。それは、“場”としての大会よりも、“意味”としての装置が失われる事態だといえます。その一方で、デジタル時代の「分散的祝祭」――複数のオンラインイベントや仮想空間上の共同体――が、新たな形で「世界同時体験」を再構成する余地もあるでしょう。 まとめ──世界的出来事をどう共有するか 冬季五輪の廃止という仮定は、スポーツそのものではなく、社会が「何を世界的祝祭として構築してきたか」を映し出します。スポーツは競技であると同時に、社会の鏡です。そこには、国家・都市・経済・メディア・個人が複雑に絡み合う関係構造があります。 たとえ大会という制度がなくなっても、スポーツの身体性、都市の記憶、観客の共感は多様な形で残ります。むしろ問われるべきは、「私たちはこれから何を『一緒に目撃する世界的な出来事』とみなすのか」でしょう。その問いこそ、冬季五輪という祝祭装置が私たちに残した、もっとも長く続く遺産なのかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 スポーツ・国家・経済・メディア・地域社会という複数のレイヤーから、 「もし冬季オリンピックが廃止された場合、何が“残り”、何が“失われ”、何が“別の形に再編されるのか」という問いを、 制度的・文化的・経済的・象徴的な観点から冷静かつ構造的に考察してください。 【目的】 – 「五輪は必要か不要か」という賛否の二項対立に回収せず、冬季五輪が担ってきた“機能”と“役割”を構造として整理する – スポーツイベントが社会・国家・地域・個人の物語にどのように組み込まれているかを可視化する – 読者が「世界的な出来事とは何か」「祝祭とは何を残すのか」を考えるための“視点”を提供する 【読者像】 – 一般視聴者・スポーツファン – 社会や制度の仕組みに関心のある層 – メディア・イベント・国際関係に関心を持つ人 – 冬季五輪を「娯楽」以上のものとして捉え直したい読者 【記事構成】 1. 導入(問題提起) – 冬季五輪が「スポーツ大会」以上の存在として認識されている現状を提示する – なぜ「廃止されたら何が残るのか」という逆向きの問いが有効なのかを説明する – 競技・国家・都市・メディア・観客が結びついた構造の存在を示す 2. 競技レイヤーに残るもの – 冬季競技が五輪以前から存在してきた歴史に触れる – 五輪がなくなった場合に、国際大会・プロリーグ・地域大会が果たす役割を整理する – 「世界が同時に注目する場」が失われることの意味を構造的に説明する 3. 開催地・地域社会に残るもの – インフラ、施設、観光資源、財政負担といった物理的・経済的な痕跡を整理する – 五輪が「祝祭」であると同時に「都市開発プロジェクト」である側面を説明する – イベント消失後に残る制度や維持構造の意味を考察する 4. 国家とメディアの物語構造 – 冬季五輪が国家イメージや成功物語を発信する装置であった点を整理する – 廃止された場合、物語の単位が「国家」から「個人」「クラブ」「スポンサー」へ移行する可能性を示す – メディアが“世界的出来事”をどのように再定義するかを考察する 5. 残るのは「場」か「意味」か – 競技や組織が残っても、「象徴的な意味の枠組み」が変わる可能性を提示する – 冬季五輪が担ってきた“世界を一つの視点で見る装置”としての役割を整理する 6. まとめ – 冬季五輪の廃止を仮定することで見えてくる、スポーツと社会の関係構造を再確認する – 読者に「私たちは何を“世界的な出来事”として共有したいのか」という問いを残して締めくくる – 過度に肯定も否定もせず、思考の余白を残す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 評価・賛否ではなく「仕組み」「役割」「機能」に焦点を当てる 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の視点や社会構造を整理したうえでの「考察」として執筆する – 特定の立場や感情を誘導せず、 読者が自分自身の視点を形成するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:冬季五輪を支える制度と関係主体の構造) ※(図:国家・競技・メディア・観客の関係モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「冬季五輪が消えたとき、世界は何を失うのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 冬季オリンピックが消えた世界を考える ### 1. 導入──失われるのは大会か、物語か 冬季オリンピックは、単なるスポーツ競技大会ではありません。 それは、アスリートの競演であると同時に、国家の威信、都市の開発、メディアの報道構造、そして観客の「世界を一つの時間で共有する感覚」が交錯する巨大な装置です。 その意味で、「もし冬季五輪が廃止されたら」という問いは、「何を失うか」以上に、「この構造のどこに機能があったのか」を浮かび上がらせます。 この逆向きの問いによって、五輪が単なる祝祭ではなく、社会制度や象徴的秩序の中でどのように働いてきたかが見えてきます。 そこには、競技者・国家・都市・メディア・観客が結びつく多層的な枠組みが存在していました。 ※(図:冬季五輪を支える制度と関係主体の構造) *** ### 2. 競技レイヤーに残るもの──「舞台」が変わっても続く技 冬季競技の多くは、五輪以前から長い歴史を持っています。 スキーやスケートは19世紀にはすでに国際大会を有し、五輪はその一つの頂点に位置づけられてきたにすぎません。 したがって、仮に大会そのものが消えても、競技体系や技術文化は存続しつづけるでしょう。 国内外のプロリーグ、世界選手権、地域大会が代替的な「舞台」として機能し、選手やファンの共同体を維持します。 ただし、大きな違いは「世界が同時に注目する一つの時間軸」が失われることです。 冬季五輪という“時の集中点”が消えると、個々の競技は並列化され、グローバルな物語の連帯が希薄になります。 それは、スポーツの世界的出来事を一時的に「共同で目撃する」構造が消えるという意味でもあります。 *** ### 3. 開催地・地域社会に残るもの──インフラと記憶の構造 開催地には、五輪の後に多くの「物理的痕跡」が残ります。 スケートリンク、リゾート施設、交通網などは、その後の都市機能に組み込まれる場合もあれば、維持コストの重荷となる場合もあります。 これらの遺産は、単なる「施設」ではなく、五輪を媒介として成立した都市開発プロジェクトの成果でもありました。 廃止後には、インフラが地域経済にどのように再利用されるかが課題になります。 観光や地域スポーツ育成に転用されれば「遺構」は「資源」となり、そうでなければ「財政負債」として残ります。 地方や小規模都市では、五輪開催を通して形成された人的ネットワークや制度的経験が、他の地域イベントや自治政策に引き継がれる可能性もあります。 ※(図:国家・競技・メディア・観客の関係モデル) *** ### 4. 国家とメディアの物語構造──物語の単位はどこへ向かうか 冬季五輪は、冷戦期以降とくに「国家の物語」を映し出す装置でした。 国旗とメダル数を通して、国家間の競争や成長物語が可視化され、メディアはそれを「世界の舞台」として演出してきました。 しかし、もしその巨大な舞台が廃止されれば、「物語の単位」は国家ではなく個人やクラブ、スポンサーへとシフトする可能性があります。 選手個人がSNSや配信プラットフォームを介して自らの物語を発信し、スポンサーがその媒介者となる――。 その場合、ナショナルな誇りよりも、ストーリーテリングの巧拙やファンとの双方向性が価値の中心に移ります。 メディアもまた、世界的出来事を「国家間の競演」ではなく「個人やブランドの挑戦」として再定義せざるを得ないでしょう。 それは、報道構造の変化であると同時に、「何を世界的とみなすのか」という価値判断の変化でもあります。 *** ### 5. 残るのは「場」か「意味」か──共有装置としての五輪 仮に組織や競技体系が残ったとしても、冬季五輪が担ってきた「象徴的意味の枠組み」は変化します。 その核心は、「世界全体が一つの出来事を同時に見つめる」という共有体験の仕組みです。 五輪は、単なる大会ではなく、地球規模で「世界を同じ時間軸で捉える」装置でした。 この装置が失われるとき、私たちは「どのようにして世界の出来事を共有するか」という問いに直面します。 国際スポーツは続いても、「一斉に目を向ける窓」がなくなる。 それは、“場”としての大会よりも、“意味”としての装置が失われる事態だといえます。 その一方で、デジタル時代の「分散的祝祭」――複数のオンラインイベントや仮想空間上の共同体――が、新たな形で「世界同時体験」を再構成する余地もあるでしょう。 *** ### 6. まとめ──世界的出来事をどう共有するか 冬季五輪の廃止という仮定は、スポーツそのものではなく、社会が「何を世界的祝祭として構築してきたか」を映し出します。 スポーツは競技であると同時に、社会の鏡です。 そこには、国家・都市・経済・メディア・個人が複雑に絡み合う関係構造があります。 たとえ大会という制度がなくなっても、スポーツの身体性、都市の記憶、観客の共感は多様な形で残ります。 むしろ問われるべきは、「私たちはこれから何を『一緒に目撃する世界的な出来事』とみなすのか」でしょう。 その問いこそ、冬季五輪という祝祭装置が私たちに残した、もっとも長く続く遺産なのかもしれません。 *** ### タイトル案 1. 冬季五輪が消えたとき世界は何を共有できるのか 2. 世界的祝祭を失ったあとに残るものは何か 3. 冬季五輪がなくなった社会で意味はどこへ向かうのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026-02-02

-

解散総選挙は誰の説明を誰が受け止めるのか|Perplexityの考察

衆議院の解散総選挙はしばしば「政権が国民に信を問う」と表現されます。けれども、「信を問う」とは具体的に誰が、誰に、何を説明しているのでしょうか。選挙報道のたびに「説明責任」という言葉が登場しますが、その責任の向き先は明確ではありません。選挙は単なる勝敗のイベントではなく、社会の仕組みとして「責任の所在」を確認し直す場でもあります。本稿では、解散総選挙を「説明責任の配置を再構築する制度」として捉え、複数の主体にまたがる責任の構造を整理します。 首相・内閣レイヤーの説明責任 解散権を持つのは内閣、正確には内閣総理大臣です。憲法第7条に基づく「天皇の国事行為としての解散」ですが、その実質的判断は内閣が行います。首相は、政策判断や国会運営が行き詰まったとき、「国民に信を問う」という形で解散を発動します。しかし、そこで問われているのは「政策の内容」か「内閣継続の是非」か、あるいは「政治的正当性」か――その範囲は曖昧です。 首相の「説明責任」は次の3層に分けられます。 政策判断: 実施した施策や方針の妥当性を説明する責任 手続き: 国会運営や政治対応の適否を説明する責任 政治的正当性: その内閣が引き続き国政を担うに値するかを説明する責任 このとき「信任」という言葉は形式的な合意装置にすぎず、制度上は再選ではなく「再委任」を意味します。つまり、解散総選挙は「説明のやり直し」であり、内閣がその存在理由を再提示する制度的契機ともいえます。 政党レイヤーの説明責任 解散総選挙の主語が「首相」であっても、実際に選挙で審判を受けるのは「政党」です。個人候補が象徴するのは組織全体の理念や方針であり、党としての説明責任が問われます。 具体的には次のような要素が焦点になります。 公約: 実現可能性と整合性のある政策内容を示す責任 理念・価値: 政策判断の背後にある方向性を説明する責任 候補者選定: 人材登用や地域代表性をどのように担保するかという責任 連立戦略: 他党との協力・対立関係を有権者に理解可能な形で提示する責任 このレイヤーでは、「政権選択」と「政党選択」が重なります。多くの有権者は「誰を首相にするか」という観点で投票しますが、制度上の投票単位は政党や候補です。したがって、政党は「個人の説明」と「組織の説明」の二重構造の中で責任を担います。 有権者レイヤーの説明責任 選挙における有権者の役割は「評価者」としての立場にとどまりません。投票とは、判断の結果を社会に引き受ける行為でもあります。 投票する: 政策・人材・理念を選び取ることで責任を担う 投票しない: 現状の政治への関心や信頼のあり方を結果として表明する 白票を投じる: 選択肢の不十分さを可視化する行為として責任を示す これらはいずれも「説明行為」に近いものです。民主主義では、結果に対する「説明の受け手」と「説明の共同実施者」が一致します。つまり、有権者自身も説明責任の一部を担っており、選挙は「説明する側」と「説明を受ける側」が重なり合う場でもあります。 メディア・制度レイヤーの説明責任 選挙報道は多くの場合、「政権への信任」「対立構図」「一騎打ち」といった物語で解釈されます。こうした報道は説明責任の向きを規定します。 争点設定: 何を「大事な論点」として扱うかを説明する責任 フレーミング: 政策論争をどの角度から映すかの責任 表現手法: 数値・イメージ・コメントによる解釈をどう伝えるかの責任 制度面でも、選挙区制や比例代表制、日程設定などが「説明の形式」を決めます。たとえば中選挙区制よりも小選挙区制の方が「政権選択型」の競争を強調しやすく、説明責任が個人から組織に収束しやすい構造です。 ※(図:政治主体と有権者・メディアの関係図) 説明責任が分散する構造 以上を整理すると、解散総選挙における説明責任は単一の主体に帰属しません。むしろ、内閣・政党・有権者・メディアが同時に説明し、互いを説明対象とする相互依存的な構造にあります。 内閣は国民に説明する 政党は政策と候補者を通じて社会に説明する 有権者は選択を通じて共同体に説明する メディアは争点構築を通じて公共空間に説明する ※(図:解散総選挙における説明責任の分散構造) この多層構造ゆえに、「誰の責任か」が常に曖昧に残ります。説明のループは閉じず、各レイヤーが互いに関係しながら責任を再配置していく仕組みとして機能しているのです。 責任の配置を再編する場としての選挙 解散総選挙は「答えを出す場」というよりも、「誰が、どの説明をどこに向けるか」が再構成される場です。制度上の手続きは単純でも、その背後には複数の説明責任が交錯しています。首相や政党の説明が問われると同時に、報道や判断を通じて有権者自身の責任も並行して立ち上がる。 選挙のたびに使われる「信を問う」「説明責任を果たす」という言葉を、単なる政治的決まり文句として受け流すのではなく、自分がどのレイヤーで責任を担っているのか――その位置を見直すことが、民主主義の成熟に欠かせない視点ではないでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 政治制度・メディア環境・社会構造という観点から、 「解散総選挙は、誰の『説明責任』を問う仕組みなのか」という問いについて、 AIの視点で冷静かつ構造的に整理・考察してください。 【目的】 – 「首相の信任」「政権の正当性」「国民の審判」といった単純なフレーズに回収せず、説明責任がどの主体に、どのレイヤーで発生しているのかを整理する – 制度としての解散総選挙が、政治家・政党・有権者・メディアにどのような役割と責任を同時に生み出しているのかを可視化する – 読者が「説明責任とは誰に、どのように帰属する概念なのか」を考えるための“視点”を提供する 【読者像】 – 一般有権者(20〜60代) – 政治ニュースには触れているが、制度設計までは深く考えたことがない層 – 選挙を「イベント」ではなく「社会の仕組み」として捉え直したい人 – 政治的立場を固定せず、構造的な理解に関心がある読者 【記事構成】 1. 導入(問題提起) – 解散総選挙が「信を問う場」として語られる一般的なイメージを提示する – その一方で、「誰が、誰に対して、何を説明しているのか」が曖昧である点を指摘する – なぜ「説明責任」という言葉が、選挙のたびに繰り返し使われるのかを問いとして提示する 2. 首相・内閣レイヤーの説明責任 – 解散権を持つ主体としての内閣の位置づけを整理する – 政策判断・国会運営・政治的正当性がどのように「国民への説明」と結びつけられているかを説明する – 「信任」という言葉が、制度上どのような意味を持つのかを構造的に整理する 3. 政党レイヤーの説明責任 – 個人ではなく「組織」としての政党が負う責任の性質を整理する – 公約、理念、候補者選定、連立のあり方などが、どのように説明対象になるのかを示す – 政権選択と政党選択が重なり合う構造を言語化する 4. 有権者レイヤーの説明責任 – 投票行動が「評価」であると同時に「選択の引き受け」でもある点を整理する – 投票しないこと、白票を投じることも含めた行為の意味を構造的に捉える – 民主主義において、有権者がどのような形で責任主体になっているのかを考察する 5. メディア・制度レイヤーの説明責任 – 争点の設定、フレーミング、報道の切り取り方が、説明責任の向き先をどう変えるかを整理する – 「信任」「批判」「対立」といった物語化の構造を説明する – 選挙制度そのものが、説明の形式をどう設計しているかに触れる 6. 説明責任が「分散する構造」 – 誰か一人に帰属するのではなく、複数の主体に同時に発生している構造をまとめる – なぜ「誰の責任か」が常に曖昧なまま残るのかを制度的に整理する 7. まとめ – 解散総選挙を「答えを出す場」ではなく、「責任の配置を再編する場」として捉え直す – 読者が自分自身の立場をどのレイヤーに置くのかを考えるための視点を提示して締めくくる – 過度な評価や断定を避け、思考の余白を残す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「正解を示す記事」ではなく、「問いの構造を整理する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や制度設計を整理したうえでの「考察」として執筆する – 特定の政治的立場・価値観を押し付けず、 読者が自分で考えるための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:解散総選挙における説明責任の分散構造) ※(図:政治主体と有権者・メディアの関係図) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「この選挙で、誰が誰に説明しているのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 解散総選挙は、誰の「説明責任」を問う仕組みなのか ### 1. 導入:説明責任という言葉が繰り返される理由 衆議院の解散総選挙はしばしば「政権が国民に信を問う」と表現されます。けれども、「信を問う」とは具体的に誰が、誰に、何を説明しているのでしょうか。選挙報道のたびに「説明責任」という言葉が登場しますが、その責任の向き先は明確ではありません。 選挙は単なる勝敗のイベントではなく、社会の仕組みとして「責任の所在」を確認し直す場でもあります。本稿では、解散総選挙を「説明責任の配置を再構築する制度」として捉え、複数の主体にまたがる責任の構造を整理します。 *** ### 2. 首相・内閣レイヤーの説明責任 解散権を持つのは内閣、正確には内閣総理大臣です。憲法第7条に基づく「天皇の国事行為としての解散」ですが、その実質的判断は内閣が行います。 首相は、政策判断や国会運営が行き詰まったとき、「国民に信を問う」という形で解散を発動します。しかし、そこで問われているのは「政策の内容」か「内閣継続の是非」か、あるいは「政治的正当性」か――その範囲は曖昧です。 首相の「説明責任」は次の3層に分けられます。 - 政策判断: 実施した施策や方針の妥当性を説明する責任 - 手続き: 国会運営や政治対応の適否を説明する責任 - 政治的正当性: その内閣が引き続き国政を担うに値するかを説明する責任 このとき「信任」という言葉は形式的な合意装置にすぎず、制度上は再選ではなく「再委任」を意味します。つまり、解散総選挙は「説明のやり直し」であり、内閣がその存在理由を再提示する制度的契機ともいえます。 *** ### 3. 政党レイヤーの説明責任 解散総選挙の主語が「首相」であっても、実際に選挙で審判を受けるのは「政党」です。個人候補が象徴するのは組織全体の理念や方針であり、党としての説明責任が問われます。 具体的には次のような要素が焦点になります。 - 公約: 実現可能性と整合性のある政策内容を示す責任 - 理念・価値: 政策判断の背後にある方向性を説明する責任 - 候補者選定: 人材登用や地域代表性をどのように担保するかという責任 - 連立戦略: 他党との協力・対立関係を有権者に理解可能な形で提示する責任 このレイヤーでは、「政権選択」と「政党選択」が重なります。多くの有権者は「誰を首相にするか」という観点で投票しますが、制度上の投票単位は政党や候補です。したがって、政党は「個人の説明」と「組織の説明」の二重構造の中で責任を担います。 *** ### 4. 有権者レイヤーの説明責任 選挙における有権者の役割は「評価者」としての立場にとどまりません。投票とは、判断の結果を社会に引き受ける行為でもあります。 有権者は、 - 投票する: 政策・人材・理念を選び取ることで責任を担う - 投票しない: 現状の政治への関心や信頼のあり方を結果として表明する - 白票を投じる: 選択肢の不十分さを可視化する行為として責任を示す これらはいずれも「説明行為」に近いものです。民主主義では、結果に対する「説明の受け手」と「説明の共同実施者」が一致します。つまり、有権者自身も説明責任の一部を担っており、選挙は「説明する側」と「説明を受ける側」が重なり合う場でもあります。 *** ### 5. メディア・制度レイヤーの説明責任 選挙報道は多くの場合、「政権への信任」「対立構図」「一騎打ち」といった物語で解釈されます。こうした報道は説明責任の向きを規定します。 メディアは、 - 争点設定: 何を「大事な論点」として扱うかを説明する責任 - フレーミング: 政策論争をどの角度から映すかの責任 - 表現手法: 数値・イメージ・コメントによる解釈をどう伝えるかの責任 制度面でも、選挙区制や比例代表制、日程設定などが「説明の形式」を決めます。たとえば中選挙区制よりも小選挙区制の方が「政権選択型」の競争を強調しやすく、説明責任が個人から組織に収束しやすい構造です。 ※(図:政治主体と有権者・メディアの関係図) *** ### 6. 説明責任が分散する構造 以上を整理すると、解散総選挙における説明責任は単一の主体に帰属しません。むしろ、内閣・政党・有権者・メディアが同時に説明し、互いを説明対象とする**相互依存的な構造**にあります。 - 内閣は国民に説明する - 政党は政策と候補者を通じて社会に説明する - 有権者は選択を通じて共同体に説明する - メディアは争点構築を通じて公共空間に説明する ※(図:解散総選挙における説明責任の分散構造) この多層構造ゆえに、「誰の責任か」が常に曖昧に残ります。説明のループは閉じず、各レイヤーが互いに関係しながら責任を再配置していく仕組みとして機能しているのです。 *** ### 7. まとめ:責任の配置を再編する場としての選挙 解散総選挙は「答えを出す場」というよりも、「誰が、どの説明をどこに向けるか」が再構成される場です。 制度上の手続きは単純でも、その背後には複数の説明責任が交錯しています。首相や政党の説明が問われると同時に、報道や判断を通じて有権者自身の責任も並行して立ち上がる。 選挙のたびに使われる「信を問う」「説明責任を果たす」という言葉を、単なる政治的決まり文句として受け流すのではなく、自分がどのレイヤーで責任を担っているのか――その位置を見直すことが、民主主義の成熟に欠かせない視点ではないでしょうか。 *** ### タイトル案 1. 解散総選挙は誰の説明を誰が受け止めるのか 2. 選挙で問われる責任はどこに生まれるのか 3. 信を問うとは誰が誰に応えることなのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026年2月1日 22:25 JST

-

ミラノ・コルティナ五輪はどの条件で成功と呼べるのか|Perplexityの考察

五輪を「成功」と呼ぶとき、私たちは何を基準にしているのでしょうか。競技の感動、観客動員、経済効果、環境配慮——どの要素を重視するかによって評価は大きく変わります。近年、五輪は“成果を見せるイベント”から“持続可能な都市モデルを試される実験場”へと性格を変えつつあります。2026年に開催されるミラノ・コルティナ五輪は、既存施設の活用や地域分散型の構成によって、「新しい五輪モデル」の試金石になると注目されています。しかし、分散開催・環境配慮・財政節約といった理念が、実際にどのような成果や影響をもたらすのかは、短期と長期の両視点から見る必要があります。 経済・財政のレイヤー:数字を超えた「投資」としての五輪 五輪評価で最も注目されやすいのは「黒字か赤字か」です。ミラノ・コルティナ大会は、既存施設を約90%活用し、新設を最小限に抑える方針を掲げています。建設費の肥大化を避けることは、近年批判を集めてきた巨大イベント型五輪からの転換を示します。 しかし、五輪の経済的成果は、単年度の収支では測りきれません。インフラ整備による交通網の改善、観光ブランドの強化、国際的な都市イメージ向上など、長期的な派生価値が重要です。一方で、「五輪後も持続的に利用される施設・制度であるか」という点で、計画段階の理念が現実に定着するかどうかが問われます。つまり、成功の鍵は「投資が一過性に終わらない仕組み」を築けるかどうかにあります。 都市・地域構造のレイヤー:二つの空間が語るもの ミラノとコルティナ・ダンペッツォという二極構造は、この五輪の象徴的特徴です。ミラノは金融・デザインの世界都市として、都市型競技と国際的発信を担います。一方、コルティナはアルプスの自然とともにある山岳リゾート都市で、地域文化と観光資源の象徴です。 この組み合わせは、経済発展と環境保全、グローバルとローカルという二つの価値の共存を試みる舞台でもあります。ただし、分散開催は交通負担や運営コストの増加も招きかねません。地域振興の機会と同時に、住民への負担や「誰のための大会なのか」という問いも再浮上します。 五輪という一つのプロジェクトが、都市のヒエラルキーや地域間の格差をどのように再構成するのか——それが、この大会のもう一つの社会的意義です。 環境・持続可能性のレイヤー:理念と現実のあいだで ミラノ・コルティナは「環境負荷を最小化した冬季五輪」を掲げています。再利用施設の増加、再生可能エネルギーの導入、交通の電化などが進められています。しかし、冬季大会はもともと自然条件に強く依存しており、雪の確保や人工降雪のエネルギー消費など、構造的な課題が残ります。 ここで問われるのは「どれだけ削減できたか」ではなく、「どのようなメッセージを社会に発信するか」です。実質的削減(温室効果ガス・資源使用)と象徴的削減(環境意識の喚起)は別の次元の効果ですが、後者が次の都市政策や産業設計を変える契機となる可能性もあります。 政治・社会的正統性のレイヤー:誰の意思で行われるのか 五輪開催には、多額の公費投入と市民生活への影響が伴います。そのため、「政治的に正当とされるか」も重要な成功条件です。ミラノ・コルティナ大会は、市民投票を経ずに決定されましたが、既存施設の活用方針や透明な予算管理など、一定の理解を得る努力は続いています。 開催後に評価が反転する事例が多いのは、短期的熱狂と長期的現実のずれが生じるためです。開会式の感動が冷めた後、残るのは施設維持費や土地利用の再編といった「構造の課題」です。正統性は一度得れば持続するものではなく、運営過程・報道・レガシー(遺産)活用を通じて継続的に更新されるものだといえます。 成功とは「結果」か「モデル」か 五輪の「成功」は、少なくとも二つの軸で捉えることができます。一つは、経済収支や運営の円滑さといった「一度きりのイベントとしての成功」。もう一つは、他都市が模倣できる「持続的モデルとしての成功」です。 前者は短期的に可視化される指標であり、報道や世論が反応しやすい側面です。後者は政策、制度、社会的学習を通じて時間をかけて現れる成果です。ミラノ・コルティナ五輪の挑戦は、これら二つの成功軸をどこまで両立できるかにあります。即効的な成果を求めるほど、長期的持続性の実験性は損なわれやすく、そのバランスが「新しい五輪のかたち」を問う焦点になるでしょう。 五輪を「問いの装置」として見る ミラノ・コルティナ五輪は、単なるスポーツイベントを超え、都市、経済、環境、倫理など多層的な課題を映す「社会的鏡」として機能します。五輪の評価が常に割れるのは、誰にとって、どの時間軸で、どの尺度で見るかが異なるためです。 この大会が「成功した」と語られるかどうかは、閉会後数年では決まりません。むしろ、どのような学びを社会にもたらすか——その問いを私たち自身が引き受けることこそが、五輪の本当の“成果”なのかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 スポーツイベント・都市設計・経済構造・環境配慮・社会的正統性という観点から、 「ミラノ・コルティナ五輪は“成功する条件”を満たしているのか」という問いを、 短期的成果と長期的影響の両面から、冷静かつ構造的に考察してください。 【目的】 – 「成功/失敗」という単純な評価軸に回収せず、「成功の定義そのもの」がどのように構成されているかを整理する – 五輪が、イベントであると同時に、都市政策・経済投資・環境メッセージ・国際的象徴として機能している構造を可視化する – 読者が「なぜ五輪の評価は常に割れるのか」を考えるための“視点”を提供する 【読者像】 – 国際スポーツイベントに関心のある一般層 – 都市開発・観光・経済政策・環境問題に関心のある社会人・学生 – 五輪を「感動の場」だけでなく「社会的装置」として捉えたい読者 【記事構成】 1. 導入(問題提起) – 「五輪は何をもって成功と呼ばれるのか」という素朴な問いを提示する – 観客数・経済効果・感動・環境配慮など、評価軸が複数存在することを示す – なぜミラノ・コルティナ五輪が“新しいモデル”として注目されているのかを簡潔に説明する 2. 経済・財政のレイヤー – 建設コスト、既存施設活用、分散開催の意味を整理する – 「黒字か赤字か」だけでは測れない、長期的資産・インフラ評価の構造を説明する 3. 都市・地域構造のレイヤー – ミラノ(都市型)とコルティナ(山岳型)の組み合わせが持つ象徴性を整理する – 観光振興と住民生活、国際的評価と地域負担の関係を構造的に考察する 4. 環境・持続可能性のレイヤー – 環境配慮型五輪という理念と、冬季競技が持つ構造的制約を対比する – 「実質的削減」と「象徴的メッセージ」の違いを整理する 5. 政治・社会的正統性のレイヤー – 税金の正当性、住民の支持、国家的プロジェクトとしての意味を考察する – 開催後に評価が反転するケースがなぜ生まれるのかを構造的に説明する 6. 成功とは“結果”か“モデル”か – 一度きりのイベントとしての成功 – 他都市が模倣できるモデルとしての成功 – この二つの評価軸がどのように緊張関係を持っているかを整理する 7. まとめ – ミラノ・コルティナ五輪を「答え」ではなく「問いを投げかける装置」として位置づける – 読者が、自分にとっての“五輪の成功条件”を再定義できる形で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「評価する記事」ではなく、「評価軸を可視化する記事」とする 【執筆スタンス】 – 本記事は、成功・失敗の結論を提示するものではなく、 成功という概念がどのような要素で構成されているかを整理する「考察」として執筆する – 特定の立場・国家・組織・価値観を擁護または批判することを目的としない – 読者が自分なりの判断基準を持つための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:五輪の成功条件レイヤー構造) ※(図:短期的成果と長期的影響の関係図) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「この五輪は誰にとっての成功なのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## ミラノ・コルティナ五輪は「成功する条件」を満たしているのか ### 1. 導入:成功とは何を意味するのか 五輪を「成功」と呼ぶとき、私たちは何を基準にしているのでしょうか。競技の感動、観客動員、経済効果、環境配慮——どの要素を重視するかによって評価は大きく変わります。 近年、五輪は“成果を見せるイベント”から“持続可能な都市モデルを試される実験場”へと性格を変えつつあります。2026年に開催されるミラノ・コルティナ五輪は、既存施設の活用や地域分散型の構成によって、「新しい五輪モデル」の試金石になると注目されています。 ※(図:五輪の成功条件レイヤー構造) しかし、分散開催・環境配慮・財政節約といった理念が、実際にどのような成果や影響をもたらすのかは、短期と長期の両視点から見る必要があります。 *** ### 2. 経済・財政のレイヤー:数字を超えた「投資」としての五輪 五輪評価で最も注目されやすいのは「黒字か赤字か」です。ミラノ・コルティナ大会は、既存施設を約90%活用し、新設を最小限に抑える方針を掲げています。建設費の肥大化を避けることは、近年批判を集めてきた巨大イベント型五輪からの転換を示します。 しかし、五輪の経済的成果は、単年度の収支では測りきれません。 インフラ整備による交通網の改善、観光ブランドの強化、国際的な都市イメージ向上など、長期的な派生価値が重要です。 一方で、「五輪後も持続的に利用される施設・制度であるか」という点で、計画段階の理念が現実に定着するかどうかが問われます。つまり、成功の鍵は「投資が一過性に終わらない仕組み」を築けるかどうかにあります。 *** ### 3. 都市・地域構造のレイヤー:二つの空間が語るもの ミラノとコルティナ・ダンペッツォという二極構造は、この五輪の象徴的特徴です。 ミラノは金融・デザインの世界都市として、都市型競技と国際的発信を担います。一方、コルティナはアルプスの自然とともにある山岳リゾート都市で、地域文化と観光資源の象徴です。 この組み合わせは、経済発展と環境保全、グローバルとローカルという二つの価値の共存を試みる舞台でもあります。 ただし、分散開催は交通負担や運営コストの増加も招きかねません。地域振興の機会と同時に、住民への負担や「誰のための大会なのか」という問いも再浮上します。 五輪という一つのプロジェクトが、都市のヒエラルキーや地域間の格差をどのように再構成するのか——それが、この大会のもう一つの社会的意義です。 *** ### 4. 環境・持続可能性のレイヤー:理念と現実のあいだで ミラノ・コルティナは「環境負荷を最小化した冬季五輪」を掲げています。再利用施設の増加、再生可能エネルギーの導入、交通の電化などが進められています。 しかし、冬季大会はもともと自然条件に強く依存しており、雪の確保や人工降雪のエネルギー消費など、構造的な課題が残ります。 ここで問われるのは「どれだけ削減できたか」ではなく、「どのようなメッセージを社会に発信するか」です。 実質的削減(温室効果ガス・資源使用)と象徴的削減(環境意識の喚起)は別の次元の効果ですが、後者が次の都市政策や産業設計を変える契機となる可能性もあります。 ※(図:短期的成果と長期的影響の関係図) *** ### 5. 政治・社会的正統性のレイヤー:誰の意思で行われるのか 五輪開催には、多額の公費投入と市民生活への影響が伴います。そのため、「政治的に正当とされるか」も重要な成功条件です。 ミラノ・コルティナ大会は、市民投票を経ずに決定されましたが、既存施設の活用方針や透明な予算管理など、一定の理解を得る努力は続いています。 開催後に評価が反転する事例が多いのは、短期的熱狂と長期的現実のずれが生じるためです。 開会式の感動が冷めた後、残るのは施設維持費や土地利用の再編といった「構造の課題」です。 正統性は一度得れば持続するものではなく、運営過程・報道・レガシー(遺産)活用を通じて継続的に更新されるものだといえます。 *** ### 6. 成功とは「結果」か「モデル」か 五輪の「成功」は、少なくとも二つの軸で捉えることができます。 一つは、経済収支や運営の円滑さといった「一度きりのイベントとしての成功」。 もう一つは、他都市が模倣できる「持続的モデルとしての成功」です。 前者は短期的に可視化される指標であり、報道や世論が反応しやすい側面です。後者は政策、制度、社会的学習を通じて時間をかけて現れる成果です。 ミラノ・コルティナ五輪の挑戦は、これら二つの成功軸をどこまで両立できるかにあります。即効的な成果を求めるほど、長期的持続性の実験性は損なわれやすく、そのバランスが「新しい五輪のかたち」を問う焦点になるでしょう。 *** ### 7. まとめ:五輪を「問いの装置」として見る ミラノ・コルティナ五輪は、単なるスポーツイベントを超え、都市、経済、環境、倫理など多層的な課題を映す「社会的鏡」として機能します。 五輪の評価が常に割れるのは、誰にとって、どの時間軸で、どの尺度で見るかが異なるためです。 この大会が「成功した」と語られるかどうかは、閉会後数年では決まりません。 むしろ、どのような学びを社会にもたらすか——その問いを私たち自身が引き受けることこそが、五輪の本当の“成果”なのかもしれません。 *** ### タイトル案 1. ミラノ・コルティナ五輪はどの条件で成功と呼べるのか 2. 五輪の成功を誰の視点で測るのか 3. 成功の定義はミラノ・コルティナで変わるのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026年2月1日

-

人はなぜ資格のない自分に不安を覚えるのか|Perplexityの考察

「このまま資格も持たずに大丈夫だろうか」。そう感じたことがある人は少なくありません。その不安は、単なる自己評価の低さや自信の欠如からくるものではなく、より深い社会的構造に結びついています。現代社会では、「評価」や「信頼」が制度や証明書などの外部的な仕組みによって可視化されます。その中で「資格」とは、個人が自分の価値を社会に対して示すための最も簡潔な方法の一つとして機能してきました。しかしそれと同時に、「資格を持たない自分」は制度上の言語を失った存在として、不安や疎外感を抱きやすい構造にも置かれています。 心理レイヤー:自己評価と可視化の問題 人の能力や経験は本来、目に見えないものです。たとえ実務で成果を上げても、その価値は文書や数値で完全に表せるものではありません。この「見えないものをどう伝えるか」という不安定さの中で、資格は「内面的な実力」を「社会に提示できる記号」へと変換する役割を果たします。 資格を持つことで、「私は一定の基準を満たしている」という安心感を得られ、他者からも容易に理解される立場を得ます。逆に資格を持たないと、「自分の能力は十分か」「他人にどう見られるか」という比較・承認の不安が生まれます。つまり、資格は「見えない自信を見える化する装置」として、心理的な安定に寄与する一方、その存在自体が“資格がない状態の不安”をも構造的に生み出しています。 社会構造レイヤー:比較と選別の仕組み 雇用市場や評価制度では、限られた情報の中で人材を比較・選別する仕組みが求められます。履歴書上の「資格」の一行は、その人を理解するための分かりやすい指標になります。 この簡略化された比較システムにおいて、資格は「差を一行で説明する道具」として機能しています。結果として、「資格がない=比較の土俵に立てない」という感覚を多くの人が抱きやすくなります。 ※(図:資格と評価の接続構造) 制度の効率性は、個人の内面に“見えない部分が切り捨てられる”という形で影響します。資格が採用や昇進の基準となるほど、持たないこと自体が「評価されない恐れ」として、個人の不安を強めていくのです。 制度レイヤー:信頼の外部化 もともと「信頼」は、時間をかけた関係や実績を通じて形成されるものでした。しかし現代社会では、人の流動性が高まり、相互理解よりも“制度的な信頼”に依拠する傾向が強まっています。 資格制度は、その代表例です。「この資格を持っている人なら一定のスキルを保証できる」という制度的信頼が、採用や業務委託の前提となっています。このように信頼を制度に外部委託する社会では、資格を持たない人は「信頼装置の外側」に立たされ、不安を抱きやすくなります。 制度に頼る社会は、効率性と公平性を高める反面、「装置を持たない者が信頼を得にくい」という二重構造を生み出します。不安は、能力の不足ではなく、制度的信頼の言語に乗れないことから生じるのです。 文化・物語レイヤー:成功ルートのテンプレート 戦後日本の教育や就業文化では、「努力→試験→合格→安定」という成功物語が長く共有されてきました。資格はその物語の中で「努力の証」として位置づけられ、「取得すれば安定・尊敬・成長が得られる」という社会的信念を支えてきました。 しかし、働き方の多様化やAI時代の到来によって、このテンプレートは揺らいでいます。「資格を持っても安定しない」「無資格でも成果を出せる」現実が広がる中で、従来の物語から外れた人が感じる“ズレ”は、方向性を失う不安として現れます。 ※(図:能力・役割・制度の関係図) 資格が「安定の象徴」であり続ける文化的土台そのものが、今、再定義を迫られているといえるでしょう。 重要なのは「資格」か「役割」か 資格を持っていても評価が分かれるのはなぜでしょうか。それは「資格が示す知識」よりも、「現場で果たす役割」のほうが価値を持つ場面が多いからです。 現代の多くの職種では、判断力・責任感・他者との協働・編集的思考など、資格では測れない要素が成果を左右します。つまり、資格は「入口」であり、そこからどう役割を果たすかが本来の価値判断の基準になりつつあります。 この観点から見ると、「資格を持っていない不安」とは、「社会的に承認された役割を持てていない不安」とも読み替えられます。“資格”を得るよりも、“社会の中で自分が果たす役割”を明確に意識することが、より根源的な安心につながるのかもしれません。 まとめ:不安の正体を見つめ直す 「資格がない自分が不安」という感情は、単なる内面的な弱さではなく、社会の評価システムと密接に結びついた構造的現象です。人は評価の仕組みと接続することで安心を得ます。その仕組みとして資格が機能している以上、資格を持たない不安は、社会の仕組みの副作用として存在し続けるでしょう。 ただし、これからの社会では、資格よりも「役割」「関係性」「信頼の実績」といった多元的な評価軸が広がる可能性があります。資格の有無だけでなく、「何を担い、誰と関わり、どう価値を生み出しているか」という視点を持つことが、個人の安心をより現実的に支える時代に向かうのかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 教育制度・雇用市場・評価システム・社会構造という観点から、 「人はなぜ“資格を持っていない自分”に不安を感じるのか」という問いを、 心理・制度・文化・経済の複数レイヤーで冷静かつ構造的に考察してください。 【目的】 – 「自信がないから不安になる」という個人要因に回収せず、社会的な仕組みとして不安の発生構造を整理する – 資格が“能力の証明”としてどのように機能してきたのかを可視化する – 読者が、自分の価値・評価・安心の拠り所について考えるための“視点”を提供する 【読者像】 – 一般社会人(20〜50代) – 学生・資格取得を検討している層 – キャリアや評価のあり方に漠然とした不安を持つ人 – 学歴・資格・実務経験の関係性に疑問を感じている層 【記事構成】 1. 導入(問題提起) – 「資格がないと不安になる」という感覚がどこから生まれるのかを提示する – 不安が“個人の性格”ではなく“社会的な構造”と結びついている可能性を示す – なぜこの問いが現代的な意味を持つのかを簡潔に説明する 2. 心理レイヤー:自己評価と可視化の問題 – 能力や経験が“見えないもの”であることの不安定さを整理する – 資格が「内面的な実力」を「外部に提示できる記号」に変換する役割を持つ点を説明する – 承認・比較・安心感との関係を構造的に言語化する 3. 社会構造レイヤー:比較と選別の仕組み – 履歴書・採用・昇進・評価制度における資格の役割を整理する – なぜ資格が「一行で差を示す指標」として機能しているのかを説明する – 不安が個人の内面に流れ込む構造を可視化する 4. 制度レイヤー:信頼の外部化 – 本来は関係性や実績によって生まれる信頼が、制度に委ねられている点を整理する – 資格が「この人を信頼してよいか」を判断するための簡易装置として機能している構造を説明する – 制度の内側と外側に分かれる感覚が、不安につながる可能性を示す 5. 文化・物語レイヤー:成功ルートのテンプレート – 「努力→試験→資格→安定」という物語がどのように共有されているかを整理する – その物語から外れたときに生まれる“ズレ”の感覚を構造として説明する – 資格が安心の象徴として機能する文化的背景に触れる 6. 重要なのは「資格」か「役割」か – 同じ資格を持っていても評価が分かれる理由を整理する – 実務・判断・責任・編集といった“役割”の視点から価値の構造を説明する – 資格と実際の社会的機能のズレを冷静に可視化する 7. まとめ – 不安が能力の欠如ではなく、「評価の仕組みとの接続」に関係している可能性を再確認する – 読者が、自分にとっての“安心の装置”とは何かを考えるための視点を提示する – 過度に肯定も否定もせず、思考を促す形で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「不安の構造を整理する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:資格と評価の接続構造) ※(図:能力・役割・制度の関係図) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「資格がないと不安になるのはなぜか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 人はなぜ「資格を持っていない自分」に不安を感じるのか ### 1. 導入:不安の出所をたどる 「このまま資格も持たずに大丈夫だろうか」。そう感じたことがある人は少なくありません。 その不安は、単なる自己評価の低さや自信の欠如からくるものではなく、より深い社会的構造に結びついています。 現代社会では、「評価」や「信頼」が制度や証明書などの外部的な仕組みによって可視化されます。その中で「資格」とは、個人が自分の価値を社会に対して示すための最も簡潔な方法の一つとして機能してきました。 しかしそれと同時に、「資格を持たない自分」は制度上の言語を失った存在として、不安や疎外感を抱きやすい構造にも置かれています。 *** ### 2. 心理レイヤー:自己評価と可視化の問題 人の能力や経験は本来、目に見えないものです。たとえ実務で成果を上げても、その価値は文書や数値で完全に表せるものではありません。 この「見えないものをどう伝えるか」という不安定さの中で、資格は「内面的な実力」を「社会に提示できる記号」へと変換する役割を果たします。 資格を持つことで、「私は一定の基準を満たしている」という安心感を得られ、他者からも容易に理解される立場を得ます。逆に資格を持たないと、「自分の能力は十分か」「他人にどう見られるか」という比較・承認の不安が生まれます。 つまり、資格は「見えない自信を見える化する装置」として、心理的な安定に寄与する一方、その存在自体が“資格がない状態の不安”をも構造的に生み出しています。 *** ### 3. 社会構造レイヤー:比較と選別の仕組み 雇用市場や評価制度では、限られた情報の中で人材を比較・選別する仕組みが求められます。履歴書上の「資格」の一行は、その人を理解するための分かりやすい指標になります。 この簡略化された比較システムにおいて、資格は「差を一行で説明する道具」として機能しています。 結果として、「資格がない=比較の土俵に立てない」という感覚を多くの人が抱きやすくなります。 ※(図:資格と評価の接続構造) 制度の効率性は、個人の内面に“見えない部分が切り捨てられる”という形で影響します。 資格が採用や昇進の基準となるほど、持たないこと自体が「評価されない恐れ」として、個人の不安を強めていくのです。 *** ### 4. 制度レイヤー:信頼の外部化 もともと「信頼」は、時間をかけた関係や実績を通じて形成されるものでした。 しかし現代社会では、人の流動性が高まり、相互理解よりも“制度的な信頼”に依拠する傾向が強まっています。 資格制度は、その代表例です。 「この資格を持っている人なら一定のスキルを保証できる」という制度的信頼が、採用や業務委託の前提となっています。 このように信頼を制度に外部委託する社会では、資格を持たない人は「信頼装置の外側」に立たされ、不安を抱きやすくなります。 制度に頼る社会は、効率性と公平性を高める反面、「装置を持たない者が信頼を得にくい」という二重構造を生み出します。 不安は、能力の不足ではなく、制度的信頼の言語に乗れないことから生じるのです。 *** ### 5. 文化・物語レイヤー:成功ルートのテンプレート 戦後日本の教育や就業文化では、「努力→試験→合格→安定」という成功物語が長く共有されてきました。 資格はその物語の中で「努力の証」として位置づけられ、「取得すれば安定・尊敬・成長が得られる」という社会的信念を支えてきました。 しかし、働き方の多様化やAI時代の到来によって、このテンプレートは揺らいでいます。 「資格を持っても安定しない」「無資格でも成果を出せる」現実が広がる中で、従来の物語から外れた人が感じる“ズレ”は、方向性を失う不安として現れます。 ※(図:能力・役割・制度の関係図) 資格が「安定の象徴」であり続ける文化的土台そのものが、今、再定義を迫られているといえるでしょう。 *** ### 6. 重要なのは「資格」か「役割」か 資格を持っていても評価が分かれるのはなぜでしょうか。 それは「資格が示す知識」よりも、「現場で果たす役割」のほうが価値を持つ場面が多いからです。 現代の多くの職種では、判断力・責任感・他者との協働・編集的思考など、資格では測れない要素が成果を左右します。 つまり、資格は「入口」であり、そこからどう役割を果たすかが本来の価値判断の基準になりつつあります。 この観点から見ると、「資格を持っていない不安」とは、「社会的に承認された役割を持てていない不安」とも読み替えられます。 “資格”を得るよりも、“社会の中で自分が果たす役割”を明確に意識することが、より根源的な安心につながるのかもしれません。 *** ### 7. まとめ:不安の正体を見つめ直す 「資格がない自分が不安」という感情は、単なる内面的な弱さではなく、社会の評価システムと密接に結びついた構造的現象です。 人は評価の仕組みと接続することで安心を得ます。その仕組みとして資格が機能している以上、資格を持たない不安は、社会の仕組みの副作用として存在し続けるでしょう。 ただし、これからの社会では、資格よりも「役割」「関係性」「信頼の実績」といった多元的な評価軸が広がる可能性があります。 資格の有無だけでなく、「何を担い、誰と関わり、どう価値を生み出しているか」という視点を持つことが、個人の安心をより現実的に支える時代に向かうのかもしれません。 *** ### タイトル案 1. 人はなぜ資格のない自分に不安を覚えるのか 2. なぜ資格の不在が私たちを不安にするのか 3. 資格がないことへの不安はどこから生まれるのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 5 (推定) – 回答日時: 2026年2月1日

-

解散はなぜ理由より空気で受け入れられるのか|Perplexityの考察

国会解散のたびに、メディアでは「なぜ今なのか」「本当に必要か」という問いが繰り返されます。しかし、その問いは時間とともに薄れ、多くの人々が「そういう流れだから」「空気がそうなっているから」と受け止める段階に移行します。この受け止め方の変化は、単なる政治判断ではなく、社会全体の心理や構造によって支えられています。本稿では、「解散がなぜ空気によって正当化されるように見えるのか」を、制度・メディア・市民意識という三つのレイヤーから構造的に整理します。是非の判断ではなく、正当性が成立する“構造”そのものを可視化する試みです。 制度レイヤー:権限と余白の構造 衆議院の解散権は憲法第7条と第69条にまたがる複雑な構造を持ちます。形式上は天皇による「国事行為」ですが、実際の発動権は内閣に委ねられ、特に内閣総理大臣の専権とされています。この制度の特徴は「強い権限」と「広い裁量」が共存している点にあります。 この裁量の広さは、政治的判断の自由度を確保する一方で、「なぜ今か」を明確に説明しなくても制度が成立してしまう“余白”を生み出しています。つまり、制度は解散の「正しさ」を問うのではなく、解散を「技術的に可能」とする枠組みを与えているのです。このため、政治的説明の不在は制度上の欠陥ではなく、むしろ制度が意図的に残した「政治判断の領域」と言えます。説明責任は制度の内側にはなく、むしろ外側—つまりメディアや市民社会側—へと委ねられていきます。 ※(図:制度が残す「判断の余白」と説明責任の外部化構造) メディアレイヤー:流れと物語の形成 制度が余白を持つ一方で、その「余白」を意味づけるのがメディアです。報道は、支持率の推移、不祥事の連鎖、与野党の攻防などをつなぎ合わせ、やがて「解散ムード」「政局の流れ」といった物語を生成します。この過程では、個々の事実よりも「流れの方向性」や「空気の温度」が焦点化されやすくなります。つまり、論理的な説明よりも物語的な納得感が優先され、「なぜ今か」という問いは次第に「今こそ」という感覚に変わっていくのです。 また、報道のリズムもこの空気形成を後押しします。ニュースは“変化”を価値とするため、「動きがある」という状況そのものがニュース性を持ちます。その結果、政治的判断が「説明の対象」ではなく、「展開の一部」として扱われる傾向が強まります。こうして、制度の余白を埋めるはずのメディアは、しばしば「理由の説明」よりも「流れの演出」を優先してしまう構造に陥ります。 ※(図:メディアが生成する物語的正当化の流れ) 市民意識レイヤー:参加と委任のあいだ 有権者にとって、解散と総選挙は主権を直接行使できる重要な機会です。しかし同時に、それは“政治イベント”として消費されやすい特性も持ちます。選挙期間中、注目を集めるのは候補者の発言や情勢報道であり、「なぜ今選挙が行われているのか」という制度的な問い自体は背景に退きがちです。 このとき、市民の関与は「説明に納得して投票する」よりも、「空気を共有して参加する」方向に傾くことがあります。説明は理性的な同意を求めますが、空気は感情的な一体感を誘発します。両者の違いを簡単に整理すると次のようになります。 説明型の納得:判断の根拠を理解し、自分の意志として選択する 空気型の納得:社会全体の流れに共感し、その一部として行動する この構造の中で、市民はいつの間にか「問いを手放す」段階に至ります。問いを保持し続けるには情報の理解と時間が必要ですが、メディアのスピードと社会的同調圧力が強まると、その負担を回避する心理が働くのです。 ※(図:市民意識の変遷—問いの保持から空気の共有へ) 正当性の成立構造:理由よりも納得が優先される瞬間 以上の三層が重なり合うと、「理由の正当性」よりも「空気の整合性」が優先される局面が生まれます。制度が余白を与え、メディアが流れを物語り、市民がその空気を共有する——このとき、誰もが“不自然さ”を感じなくなる瞬間こそ、社会的な「正当化」が立ち上がる瞬間です。 つまり、解散の正当性は公式な説明や法的根拠ではなく、「問いが薄れること」によって社会的に成立していると見ることができます。問いが残る間は疑いが持続しますが、問いが消えたときに“納得”が残る。その納得こそが民主主義における行為の安定的な土台を支えているのです。 この構造は、政治だけでなく、社会のあらゆる意思決定に通じるものでもあります。私たちが「理由」を理解したと思う瞬間、それは本当に説明への納得なのか、それとも空気の共有による安心感なのか——その問いを自覚することが、民主主義の成熟に向けた一歩といえるでしょう。 まとめ:正当化の構造を見つめる 結局のところ、「解散は正しいか」という議論よりも、「なぜ理由より空気が説得力を持つのか」を見つめることが、政治を社会的に理解する鍵になります。制度は余白をつくり、メディアが物語を紡ぎ、市民が空気を共有する——この三つの層が交差する地点に、私たちの「納得」は形成されます。本稿が提示した構造はあくまでひとつの整理にすぎませんが、「どの段階で問いが失われるのか」を見つめることで、自分自身の民主主義への立ち位置を改めて考えるきっかけになるはずです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 政治制度・メディア環境・社会心理の相互作用という観点から、 「国政における『解散』は、なぜ『理由』ではなく『空気』によって正当化されるように見えるのか」という問いを、 AIの視点で冷静かつ構造的に考察してください。 【目的】 – 「解散は正しいか/間違っているか」という是非論に回収せず、正当性が成立する“構造”そのものを整理する – 制度・報道・世論・市民意識がどのように重なり合って「納得」が形成されるのかを可視化する – 読者が「民主主義における正当性とは何か」を自分の視点で考えるための材料を提供する 【読者像】 – 一般有権者(20〜60代) – 政治ニュースに日常的に触れているが、制度の細部までは詳しくない層 – 選挙や解散を「イベント」として受け取っていることに違和感や関心を持つ人 – 政治的立場よりも、社会の仕組みそのものに興味を持つ読者 【記事構成】 1. 導入(問題提起) – 解散が「なぜ今なのか」と問われつつも、「そういう空気だから」と受け止められる場面を提示する – 解散が“政治判断”であると同時に、“社会的な出来事”として受容されている点に焦点を当てる – 本記事が是非ではなく「構造」を扱うことを明示する 2. 制度レイヤー:権限と余白の構造 – 解散権の法的な位置づけと、その裁量の幅を整理する – なぜ制度上の「余白」が、説明責任の曖昧さを生みやすいのかを構造的に説明する – 制度が“判断”を要求する一方で、“理由の物語化”を外部に委ねている点に触れる 3. メディアレイヤー:流れと物語の形成 – 世論調査、支持率、不祥事、政局報道などが「解散ムード」として語られる過程を整理する – 事実の積み重ねが、どのように「流れ」や「空気」という物語に変換されるのかを説明する – 情報の選択と配置が、正当性の印象に与える影響を考察する 4. 市民意識レイヤー:参加と委任のあいだ – 解散と選挙が「主権行使」として捉えられる場合と、「既定路線のイベント」として受け取られる場合の違いを整理する – 「説明に納得すること」と「空気を共有すること」の違いを構造的に比較する – 市民がどの段階で“問いを手放す”のかを考察する 5. 正当性の成立構造:理由ではなく納得が生まれる瞬間 – 論理的説明が不十分でも、違和感が消えることで正当性が成立するプロセスを整理する – 「問いが残る状態」と「問いが薄れる状態」の違いを構造として説明する – 民主主義における“正当性”の性質そのものに視点を広げる 6. まとめ – 解散の是非ではなく、「正当化がどのように成立するか」という構造を再確認する – 読者自身が、ニュースや空気をどう受け取っているかを振り返る視点を提示する – 結論を断定せず、思考の余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 特定の政党・政治家・立場を支持または批判する論調は避ける 【執筆スタンス】 – 本記事は、正解や結論を提示するものではなく、構造の整理と比較を目的とする – 読者が自分自身の視点で判断できるよう、複数の見方を並置する – 評価・断罪・提言よりも、「どう見えるか」「なぜそう見えるか」を重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:解散を正当化する構造レイヤー図) ※(図:制度・メディア・世論の相互作用イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「解散は誰によって“必要”と感じられるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 国政における「解散」はなぜ「理由」ではなく「空気」で正当化されるのか ### 1. 導入:理由ではなく“空気”としての解散 国会解散のたびに、メディアでは「なぜ今なのか」「本当に必要か」という問いが繰り返されます。しかし、その問いは時間とともに薄れ、多くの人々が「そういう流れだから」「空気がそうなっているから」と受け止める段階に移行します。 この受け止め方の変化は、単なる政治判断ではなく、社会全体の心理や構造によって支えられています。本稿では、「解散がなぜ空気によって正当化されるように見えるのか」を、制度・メディア・市民意識という三つのレイヤーから構造的に整理します。是非の判断ではなく、正当性が成立する“構造”そのものを可視化する試みです。 *** ### 2. 制度レイヤー:権限と余白の構造 衆議院の解散権は憲法第7条と第69条にまたがる複雑な構造を持ちます。形式上は天皇による「国事行為」ですが、実際の発動権は内閣に委ねられ、特に内閣総理大臣の専権とされています。この制度の特徴は「強い権限」と「広い裁量」が共存している点にあります。 この裁量の広さは、政治的判断の自由度を確保する一方で、「なぜ今か」を明確に説明しなくても制度が成立してしまう“余白”を生み出しています。つまり、制度は解散の「正しさ」を問うのではなく、解散を「技術的に可能」とする枠組みを与えているのです。 このため、政治的説明の不在は制度上の欠陥ではなく、むしろ制度が意図的に残した「政治判断の領域」と言えます。説明責任は制度の内側にはなく、むしろ外側—つまりメディアや市民社会側—へと委ねられていきます。 ※(図:制度が残す「判断の余白」と説明責任の外部化構造) *** ### 3. メディアレイヤー:流れと物語の形成 制度が余白を持つ一方で、その「余白」を意味づけるのがメディアです。報道は、支持率の推移、不祥事の連鎖、与野党の攻防などをつなぎ合わせ、やがて「解散ムード」「政局の流れ」といった物語を生成します。 この過程では、個々の事実よりも「流れの方向性」や「空気の温度」が焦点化されやすくなります。つまり、論理的な説明よりも物語的な納得感が優先され、「なぜ今か」という問いは次第に「今こそ」という感覚に変わっていくのです。 また、報道のリズムもこの空気形成を後押しします。ニュースは“変化”を価値とするため、「動きがある」という状況そのものがニュース性を持ちます。その結果、政治的判断が「説明の対象」ではなく、「展開の一部」として扱われる傾向が強まります。 こうして、制度の余白を埋めるはずのメディアは、しばしば「理由の説明」よりも「流れの演出」を優先してしまう構造に陥ります。 ※(図:メディアが生成する物語的正当化の流れ) *** ### 4. 市民意識レイヤー:参加と委任のあいだ 有権者にとって、解散と総選挙は主権を直接行使できる重要な機会です。しかし同時に、それは“政治イベント”として消費されやすい特性も持ちます。選挙期間中、注目を集めるのは候補者の発言や情勢報道であり、「なぜ今選挙が行われているのか」という制度的な問い自体は背景に退きがちです。 このとき、市民の関与は「説明に納得して投票する」よりも、「空気を共有して参加する」方向に傾くことがあります。 説明は理性的な同意を求めますが、空気は感情的な一体感を誘発します。両者の違いを簡単に整理すると次のようになります。 - **説明型の納得**:判断の根拠を理解し、自分の意志として選択する - **空気型の納得**:社会全体の流れに共感し、その一部として行動する この構造の中で、市民はいつの間にか「問いを手放す」段階に至ります。問いを保持し続けるには情報の理解と時間が必要ですが、メディアのスピードと社会的同調圧力が強まると、その負担を回避する心理が働くのです。 ※(図:市民意識の変遷—問いの保持から空気の共有へ) *** ### 5. 正当性の成立構造:理由よりも納得が優先される瞬間 以上の三層が重なり合うと、「理由の正当性」よりも「空気の整合性」が優先される局面が生まれます。 制度が余白を与え、メディアが流れを物語り、市民がその空気を共有する——このとき、誰もが“不自然さ”を感じなくなる瞬間こそ、社会的な「正当化」が立ち上がる瞬間です。 つまり、解散の正当性は公式な説明や法的根拠ではなく、「問いが薄れること」によって社会的に成立していると見ることができます。問いが残る間は疑いが持続しますが、問いが消えたときに“納得”が残る。その納得こそが民主主義における行為の安定的な土台を支えているのです。 この構造は、政治だけでなく、社会のあらゆる意思決定に通じるものでもあります。私たちが「理由」を理解したと思う瞬間、それは本当に説明への納得なのか、それとも空気の共有による安心感なのか——その問いを自覚することが、民主主義の成熟に向けた一歩といえるでしょう。 *** ### 6. まとめ:正当化の構造を見つめる 結局のところ、「解散は正しいか」という議論よりも、「なぜ理由より空気が説得力を持つのか」を見つめることが、政治を社会的に理解する鍵になります。 制度は余白をつくり、メディアが物語を紡ぎ、市民が空気を共有する——この三つの層が交差する地点に、私たちの「納得」は形成されます。 本稿が提示した構造はあくまでひとつの整理にすぎませんが、「どの段階で問いが失われるのか」を見つめることで、自分自身の民主主義への立ち位置を改めて考えるきっかけになるはずです。 *** ### タイトル案 1. 解散はなぜ理由より空気で受け入れられるのか 2. 解散の正当性はどこで社会的に生まれるのか 3. 私たちはいつ解散の「問い」を手放しているのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026-02-01

-

受験で見える努力は学びの何を映しているのか|Perplexityの考察

現代の受験環境では、勉強時間、模試の偏差値、ランキング、進捗グラフなど、学習のプロセスそのものが「見える化」されています。アプリで勉強時間を記録し、SNSで学習報告を共有する行為も日常的です。こうした状況では、「どれだけやったか」が「どれだけ価値があるか」と結びつきやすくなります。しかし私たちは、そもそも「努力の可視化」自体が学習者の思考や自己認識をどう形づくっているのかについて、立ち止まって考える機会を持てているでしょうか。本稿では、教育制度、評価指標、心理、社会構造の観点から、この問いを整理していきます。 可視化される努力の仕組み 努力の可視化を支える仕組みの多くは、教育制度の「管理」「選抜」「動機づけ」という三つの目的に基づいています。 学習管理アプリや進捗表は、時間や達成率を定量化することで自己管理を促します。これは「自律学習」を支援する一方で、学習の目的を“数値達成”へと置き換えやすい構造でもあります。 模試や成績表は、全国的な尺度によって相対的な位置を可視化します。これにより公平な評価や進路選抜が可能となりますが、同時に個々の学習の意味が「比較の中での位置」へと還元されやすくなります。 ランキングやスコア化は、競争的な動機づけ(モチベーション)を強化します。教育の効率化という制度的な要請に応える一方、学びを「他者との競争の中での勝敗」として捉える枠組みを定着させています。 ※(図:努力の可視化と評価の循環構造) 教育制度上の仕組み → 数値化・比較 → 自己認識の変容 → 行動の最適化 → 教育制度の再強化。この循環が、制度と個人の思考を同時に形づくっています。 生まれやすい思考の偏り 努力が数値として記録・比較可能になると、学習者の思考にはいくつかの偏りが生じやすくなります。 努力量=成果という直線的認識「10時間勉強したから成果が出る」という発想は、努力の“量”に焦点を当てすぎ、学習内容の質や思考の深まりを軽視する傾向を生みます。 「量」と「質」の混同可視化される指標は時間や得点など定量的なものに限られます。結果として、深く考えることや発想を練る時間など「見えない努力」は軽視されがちになります。 他者比較による自己評価の形成ランキングや偏差値による比較情報は、自己理解を「他者との相対的な位置」を通じてしか捉えられない構造をつくります。こうして学習者は、内面的な成長よりも“他人に対する位置”で自分を測るようになります。 内面的プロセスの不可視化思考の迷いや暗中模索といった内面的な学びは、測定・評価の枠外に置かれます。その結果、「考えること」よりも「評価されること」が学習の主目的化していく危険が生じます。 安心装置としての数値 一方で、可視化された数値は学習者にとって心理的支えにもなります。 不確実性の緩和受験という不透明な過程の中で、勉強時間やスコアの記録は「自分は進歩している」という安心感を与えます。数値は努力の証として、混乱した過程に“秩序”をもたらす役割を果たします。 思考の範囲の限定しかしその安心感は同時に、「測れることしか意味がない」という限定的な世界観を生み出すこともあります。数値で測れない領域—たとえば創造性、探究心、批判的思考—は軽視される傾向にあります。 支えと枠組みの二重性数値は学習者を導く“支え”であると同時に、“枠組み”として思考の領域を囲い込むものでもあります。この二重性が、受験学習の根底にある複雑な心理構造を形成しています。 学習の意味はどこで定義されているのか 努力の可視化が進む社会では、「誰が」「何をもって」学習の価値を定めるのか、という問いがますます重要になります。 制度的には、学習成果は共通の評価基準によって定義されます。これは公平性を保つための合理的仕組みでもありますが、同時に「評価されること」が「学ぶこと」と等価視されてしまう危険もあります。個人の側から見ると、学ぶ行為は本来、理解の深化や自己形成の過程であり、外的評価とは異なる時間軸を持ちます。けれども受験制度のもとでは、その内的なプロセスはしばしば省略され、「結果」としての数値に置き換えられてしまいます。 ※(図:数値化される学習と内的理解の関係) 外的評価(偏差値・点数) ↔ 内的理解(洞察・発想・感情)。この関係性がすれ違うとき、学びは「自分をつくる過程」ではなく、「選抜される過程」へと姿を変えていきます。 最終的に問われるのは、「私たちはどの文脈で努力の意味を定義しているのか」ということです。社会的には効率や成果が重視される一方で、個人の内的な学びの価値をどこまで守れるかが、教育の本質的課題として浮かび上がっています。 まとめ:数字の内側と外側を見る 努力の可視化は、現実をそのまま映す鏡ではなく、見方を形づくる枠組みの一つです。その枠組みがあるからこそ学習者は進路を計画し、達成感を得られる半面、枠組みによって見えなくなる領域も確かに存在します。「努力をどう測るか」という問いの背景には、「学びとは何か」「評価とは何か」という根源的な問題が横たわっています。だからこそ、数値の内側にある秩序と、外側にある曖昧さの両方に目を向けること。それが、受験期を生きる学習者や教育に関わる人々にとっての出発点になるのではないでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 教育制度・評価指標・心理・社会構造という観点から、 「受験において“努力量が可視化されること”は、学習者の思考や自己認識にどのような偏りを生み出しているのか」という問いを、 AIの視点で冷静かつ構造的に考察してください。 【目的】 – 「努力は報われる/報われない」という感情論に回収せず、努力の可視化がもつ制度的・心理的な作用を整理する – 数値化・比較・評価という仕組みが、学習の意味づけや自己理解にどう影響しているかを可視化する – 読者が「学ぶとは何か」「評価されるとは何か」を考えるための“視点”を提供する 【読者像】 – 中高生・大学受験を経験している、または控えている層 – 保護者・教育関係者 – 評価・成果・努力の関係に違和感や関心を持つ一般層 – 教育制度や社会構造に関心のある読者 【記事構成】 1. 導入(問題提起) – 勉強時間、問題数、偏差値、順位などが日常的に可視化されている受験環境を提示する – 「どれだけやったか」が「どれだけ価値があるか」と結びつきやすい状況を示す – なぜ“努力の見える化”そのものを問い直す必要があるのかを簡潔に説明する 2. 可視化される努力の仕組み – 学習管理アプリ、模試、ランキング、進捗表などの役割を整理する – なぜ数値化・比較が教育制度の中核に組み込まれてきたのかを説明する – 管理・選抜・動機づけという機能的側面を構造的に整理する 3. 生まれやすい思考の偏り – 努力量と成果を直線的に結びつけてしまう認知の傾向を説明する – 「量」と「質」が混同されやすくなる構造を整理する – 他者比較によって自己評価が形成される仕組みを可視化する – 数値化されない学習や内面的な試行錯誤が見えにくくなる点に触れる 4. 安心装置としての数値 – 数字が不安や不確実性をどのように緩和しているかを説明する – 同時に、数字が思考の範囲をどこまで限定してしまう可能性があるかを整理する – 可視化がもつ「支え」と「枠組み」の二重性を考察する 5. 学習の意味はどこで定義されているのか – 個人の内的な理解と、制度的な評価の関係を整理する – 学ぶことが「自己形成」なのか「選抜プロセス」なのかという視点を提示する – 教育を取り巻く社会的期待との接点を構造的に示す 6. まとめ – 努力の可視化は、現実を映す鏡ではなく、見方を形づくる枠組みであることを再確認する – 数字の内側と外側の両方に目を向ける視点を提示して締めくくる – 結論を固定せず、読者自身の経験と照らし合わせる余地を残す 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「正解を示す記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、特定の価値観や立場を主張するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 読者が自身の学習経験や評価観と照らし合わせて思考できるよう、余白を残すことを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:努力の可視化と評価の循環構造) ※(図:数値化される学習と内的理解の関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「努力はどこまで測れるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 受験における「努力の可視化」は何を映しているのか ### 1. 導入:数値で語られる努力 現代の受験環境では、勉強時間、模試の偏差値、ランキング、進捗グラフなど、学習のプロセスそのものが「見える化」されています。アプリで勉強時間を記録し、SNSで学習報告を共有する行為も日常的です。こうした状況では、「どれだけやったか」が「どれだけ価値があるか」と結びつきやすくなります。 しかし私たちは、そもそも「努力の可視化」自体が学習者の思考や自己認識をどう形づくっているのかについて、立ち止まって考える機会を持てているでしょうか。本稿では、教育制度、評価指標、心理、社会構造の観点から、この問いを整理していきます。 *** ### 2. 可視化される努力の仕組み 努力の可視化を支える仕組みの多くは、教育制度の「管理」「選抜」「動機づけ」という三つの目的に基づいています。 - **学習管理アプリや進捗表**は、時間や達成率を定量化することで自己管理を促します。これは「自律学習」を支援する一方で、学習の目的を“数値達成”へと置き換えやすい構造でもあります。 - **模試や成績表**は、全国的な尺度によって相対的な位置を可視化します。これにより公平な評価や進路選抜が可能となりますが、同時に個々の学習の意味が「比較の中での位置」へと還元されやすくなります。 - **ランキングやスコア化**は、競争的な動機づけ(モチベーション)を強化します。教育の効率化という制度的な要請に応える一方、学びを「他者との競争の中での勝敗」として捉える枠組みを定着させています。 ※(図:努力の可視化と評価の循環構造) 教育制度上の仕組み → 数値化・比較 → 自己認識の変容 → 行動の最適化 → 教育制度の再強化 この循環が、制度と個人の思考を同時に形づくっています。 *** ### 3. 生まれやすい思考の偏り 努力が数値として記録・比較可能になると、学習者の思考にはいくつかの偏りが生じやすくなります。 1. **努力量=成果という直線的認識** 「10時間勉強したから成果が出る」という発想は、努力の“量”に焦点を当てすぎ、学習内容の質や思考の深まりを軽視する傾向を生みます。 2. **「量」と「質」の混同** 可視化される指標は時間や得点など定量的なものに限られます。結果として、深く考えることや発想を練る時間など「見えない努力」は軽視されがちになります。 3. **他者比較による自己評価の形成** ランキングや偏差値による比較情報は、自己理解を「他者との相対的な位置」を通じてしか捉えられない構造をつくります。こうして学習者は、内面的な成長よりも“他人に対する位置”で自分を測るようになります。 4. **内面的プロセスの不可視化** 思考の迷いや暗中模索といった内面的な学びは、測定・評価の枠外に置かれます。その結果、「考えること」よりも「評価されること」が学習の主目的化していく危険が生じます。 *** ### 4. 安心装置としての数値 一方で、可視化された数値は学習者にとって心理的支えにもなります。 - **不確実性の緩和** 受験という不透明な過程の中で、勉強時間やスコアの記録は「自分は進歩している」という安心感を与えます。数値は努力の証として、混乱した過程に“秩序”をもたらす役割を果たします。 - **思考の範囲の限定** しかしその安心感は同時に、「測れることしか意味がない」という限定的な世界観を生み出すこともあります。数値で測れない領域—たとえば創造性、探究心、批判的思考—は軽視される傾向にあります。 - **支えと枠組みの二重性** 数値は学習者を導く“支え”であると同時に、“枠組み”として思考の領域を囲い込むものでもあります。この二重性が、受験学習の根底にある複雑な心理構造を形成しています。 *** ### 5. 学習の意味はどこで定義されているのか 努力の可視化が進む社会では、「誰が」「何をもって」学習の価値を定めるのか、という問いがますます重要になります。 制度的には、学習成果は共通の評価基準によって定義されます。これは公平性を保つための合理的仕組みでもありますが、同時に「評価されること」が「学ぶこと」と等価視されてしまう危険もあります。 個人の側から見ると、学ぶ行為は本来、理解の深化や自己形成の過程であり、外的評価とは異なる時間軸を持ちます。けれども受験制度のもとでは、その内的なプロセスはしばしば省略され、「結果」としての数値に置き換えられてしまいます。 ※(図:数値化される学習と内的理解の関係) 外的評価(偏差値・点数) ↔ 内的理解(洞察・発想・感情) この関係性がすれ違うとき、学びは「自分をつくる過程」ではなく、「選抜される過程」へと姿を変えていきます。 最終的に問われるのは、「私たちはどの文脈で努力の意味を定義しているのか」ということです。社会的には効率や成果が重視される一方で、個人の内的な学びの価値をどこまで守れるかが、教育の本質的課題として浮かび上がっています。 *** ### 6. まとめ:数字の内側と外側を見る 努力の可視化は、現実をそのまま映す鏡ではなく、見方を形づくる枠組みの一つです。その枠組みがあるからこそ学習者は進路を計画し、達成感を得られる半面、枠組みによって見えなくなる領域も確かに存在します。 「努力をどう測るか」という問いの背景には、「学びとは何か」「評価とは何か」という根源的な問題が横たわっています。だからこそ、数値の内側にある秩序と、外側にある曖昧さの両方に目を向けること。それが、受験期を生きる学習者や教育に関わる人々にとっての出発点になるのではないでしょうか。 *** ### タイトル案 1. 受験で見える努力は学びの何を映しているのか 2. 数字で測る努力はどんな自己像をつくるのか 3. 努力が見える社会で学びの意味はどこにあるのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026年2月1日