AIの普及が進む今、「誰が責任を負うのか」という問いが抽象的な議論ではなく、日常の現場で問われるようになっています。たとえば、採用面接の一次選考をAIが行う場合、不採用の判断に偏りが生じたとき、責任を問われるのは誰でしょうか。AIのアルゴリズムか、AIを導入した企業か、それとも承認した人間か——。AIはすでに単なる「補助ツール」ではなく、独自の判断・提案・予測を行う存在へと進化しています。そのため、意思決定の一部を機械に委ねる社会では、「責任の所在」という問題が新しい構造的課題として浮上しているのです。 従来の労働における責任構造 これまでの人間中心の労働社会では、責任の所在は比較的明確でした。 実行責任:作業を行う人(たとえば現場社員や技術者)が、結果や手順に直接責任を持つ。 判断責任:上司や管理職が、意思決定の内容に責任を負う。 制度責任:企業や社会が、システム全体を運営・管理する立場として責任を取る。 つまり、人間が判断し、人間が行動し、人間が監督する仕組みが基本でした。責任は「行動と判断が一致する場所」に集中していたのです。 AI導入によって起きる責任構造の変化 AIが仕事のプロセスに入り込むと、「実行」と「判断」の境界が曖昧になります。たとえば、AIが生成した提案や予測を人間が承認する体制では、どちらが最終的な判断者なのかを明確に定めることが難しくなります。AIが行ったのは“実行”なのか“判断”なのか、その線引きが崩れるのです。 この構造変化を整理すると、責任は「消える」のではなく、主に次の3つの方向に分散・再配置・曖昧化していきます。 分散:AI開発者・利用者・企業・規制機関など、複数の主体の間に責任が分かれる。 再配置:人間が担っていた部分の一部がAIや制度設計者に移る。 曖昧化:失敗や偏りが発生したとき、「誰が最終責任を負うか」が特定しにくくなる。 ※(図:AI導入による責任構造の変化) AIの利便性は、こうした曖昧さの上に成り立っています。便利さと引き換えに、「責任の輪郭」が広がりながら薄れていくのです。 AI時代において人間に残る責任とは何か AIが判断を担うようになっても、人間の責任がなくなるわけではありません。むしろ、責任の質が変化します。 判断を設計・監督する責任:AIの判断基準や条件をどう設計するかを人間が決める。 結果を採用するかの責任:AIの出力を鵜呑みにせず、人間が結果を採用・棄却する判断を行う。 利用範囲を決める責任:AIをどの業務・どの程度まで任せるかという境界設定を担う。 限界を理解・制御する責任:AIが苦手とする領域(文脈解釈、倫理判断など)を人間が補完する。 これらはいずれも「判断そのもの」ではなく、「判断をどう設計・運用するか」に関わる責任です。人間の価値は「最終判断者」としてよりも、「AIの判断条件を定義し、その判断を社会的に正当化できる存在」として再定義されつつあります。 重要なのは「作業」ではなく「責任の設計」 AIの導入が進む職場では、「どんな作業をするか」よりも、「その作業の責任をどう設計するか」が重要になります。従来の仕事が「作業中心」だったのに対し、AI時代の仕事は「責任設計中心」へとシフトしていくと考えられます。 人の役割を整理すると、次のような構造が見えてきます。 作業者:AIを使って効率的にタスクを進める。 判断者:AIの結果を検証・採用する責任を持つ。 設計者:AIの判断ロジックや利用範囲を構築する。 監督者:AIの運用全体をモニタリングし、社会的責任を負う。 ※(図:人間とAIの責任分担モデル) 同じ職種でも、どの層の責任を担うかによって価値が変わる時代です。「働く」とは、単に作業をこなすことではなく、「システム全体の責任の流れを理解し、自分の位置を設計する」行為になるのかもしれません。 まとめ:AIは責任を消さず、位置を変える AIは、人間社会の中で責任を奪うのではなく、「その位置と意味」を変えていきます。これまで一人の判断者が負っていた責任は、AI・人・制度の間に分散され、相互依存的な形で再配置される。その変化の中で、人間の新たな価値は「責任を設計し、管理する知性」として現れていくでしょう。 AI時代の働く人にとって問われるのは、「責任を負う覚悟」ではなく、「どのように責任の構造を理解し、自分の役割を再定義できるか」ということです。責任の消失ではなく、責任の再構成——その視点こそが、これからの「仕事」を捉える鍵になるはずです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI・自動化・アルゴリズム意思決定の普及によって、 「労働における責任の所在」がどのように変化していくのかを、 AIの視点から冷静かつ現実的に整理・考察してください。 【目的】 – 「AIが悪い/人間が悪い」という単純な責任論ではなく、責任構造の変化として整理する – 読者がAI時代における「働くこと」と「責任を負うこと」の関係を考えるための視点を提供する – AI時代における「労働の本質」と「人間の役割」を構造的に浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – 学生・就職活動中の若年層 – AIによる社会変化に関心があるが、専門知識は多くない層 – 将来の働き方・責任の持ち方に不安や関心を持つ人 【記事構成】 1. 導入(問題提起) – AIの普及によって「誰が責任を負うのか」という問いが現実的な問題になりつつあることを提示する – AIは単なるツールではなく、判断・予測・提案を行う存在になりつつあることを説明する – なぜ今「責任」という視点が重要になっているのかを簡潔に整理する 2. 従来の労働における責任構造 – 実行責任(作業者) – 判断責任(管理者・意思決定者) – 制度責任(企業・社会・法律) – 人間中心社会では、責任の所在が比較的明確だった理由を説明する 3. AI導入によって起きる責任構造の変化 – 実行と判断の境界が曖昧になる構造 – 「AIが提案し、人間が承認する」構造の増加 – 責任が消えるのではなく、「分散」「再配置」「曖昧化」する可能性 – AI利用者・開発者・提供企業・制度の関係性を整理する 4. AI時代において人間に残る責任とは何か – 判断そのものではなく「判断を設計・監督する責任」 – AIの結果を採用するかを決める責任 – AIをどこまで使うかを決める責任 – AIの限界を理解し管理する役割 5. 重要なのは「作業」ではなく「責任の設計」 – 作業者・判断者・設計者・監督者という役割整理 – 同じ職種でも責任範囲によって価値が変わる可能性 – AI時代における人間の価値を感情論ではなく構造として整理する 6. まとめ – AIは責任を消すのではなく、責任の位置を変える可能性があることを整理する – 読者が自分の仕事の「責任の位置」を考える視点を提示する – 過度な楽観・悲観を避け、思考を促す形で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AI導入による責任構造の変化) ※(図:人間とAIの責任分担モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AI時代、責任は誰が持つのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## AIが普及する社会で「責任」はどこに宿るのか ### 1. 導入:AIが問い直す「誰が責任を負うのか」 AIの普及が進む今、「誰が責任を負うのか」という問いが抽象的な議論ではなく、日常の現場で問われるようになっています。たとえば、採用面接の一次選考をAIが行う場合、不採用の判断に偏りが生じたとき、責任を問われるのは誰でしょうか。AIのアルゴリズムか、AIを導入した企業か、それとも承認した人間か——。 AIはすでに単なる「補助ツール」ではなく、独自の判断・提案・予測を行う存在へと進化しています。そのため、意思決定の一部を機械に委ねる社会では、「責任の所在」という問題が新しい構造的課題として浮上しているのです。 ### 2. 従来の労働における責任構造 これまでの人間中心の労働社会では、責任の所在は比較的明確でした。 - **実行責任**:作業を行う人(たとえば現場社員や技術者)が、結果や手順に直接責任を持つ。 - **判断責任**:上司や管理職が、意思決定の内容に責任を負う。 - **制度責任**:企業や社会が、システム全体を運営・管理する立場として責任を取る。 つまり、人間が判断し、人間が行動し、人間が監督する仕組みが基本でした。責任は「行動と判断が一致する場所」に集中していたのです。 ### 3. AI導入によって起きる責任構造の変化 AIが仕事のプロセスに入り込むと、「実行」と「判断」の境界が曖昧になります。 たとえば、AIが生成した提案や予測を人間が承認する体制では、どちらが最終的な判断者なのかを明確に定めることが難しくなります。AIが行ったのは“実行”なのか“判断”なのか、その線引きが崩れるのです。 この構造変化を整理すると、責任は「消える」のではなく、主に次の3つの方向に**分散・再配置・曖昧化**していきます。 1. **分散**:AI開発者・利用者・企業・規制機関など、複数の主体の間に責任が分かれる。 2. **再配置**:人間が担っていた部分の一部がAIや制度設計者に移る。 3. **曖昧化**:失敗や偏りが発生したとき、「誰が最終責任を負うか」が特定しにくくなる。 ※(図:AI導入による責任構造の変化) AIの利便性は、こうした曖昧さの上に成り立っています。便利さと引き換えに、「責任の輪郭」が広がりながら薄れていくのです。 ### 4. AI時代において人間に残る責任とは何か AIが判断を担うようになっても、人間の責任がなくなるわけではありません。むしろ、**責任の質**が変化します。 - **判断を設計・監督する責任**:AIの判断基準や条件をどう設計するかを人間が決める。 - **結果を採用するかの責任**:AIの出力を鵜呑みにせず、人間が結果を採用・棄却する判断を行う。 - **利用範囲を決める責任**:AIをどの業務・どの程度まで任せるかという境界設定を担う。 - **限界を理解・制御する責任**:AIが苦手とする領域(文脈解釈、倫理判断など)を人間が補完する。 これらはいずれも「判断そのもの」ではなく、「判断をどう設計・運用するか」に関わる責任です。 人間の価値は「最終判断者」としてよりも、「AIの判断条件を定義し、その判断を社会的に正当化できる存在」として再定義されつつあります。 ### 5. 重要なのは「作業」ではなく「責任の設計」 AIの導入が進む職場では、「どんな作業をするか」よりも、「その作業の責任をどう設計するか」が重要になります。 従来の仕事が「作業中心」だったのに対し、AI時代の仕事は「責任設計中心」へとシフトしていくと考えられます。 人の役割を整理すると、次のような構造が見えてきます。 - **作業者**:AIを使って効率的にタスクを進める。 - **判断者**:AIの結果を検証・採用する責任を持つ。 - **設計者**:AIの判断ロジックや利用範囲を構築する。 - **監督者**:AIの運用全体をモニタリングし、社会的責任を負う。 ※(図:人間とAIの責任分担モデル) 同じ職種でも、どの層の責任を担うかによって価値が変わる時代です。 「働く」とは、単に作業をこなすことではなく、「システム全体の責任の流れを理解し、自分の位置を設計する」行為になるのかもしれません。 ### 6. まとめ:AIは責任を消さず、位置を変える AIは、人間社会の中で責任を奪うのではなく、「その位置と意味」を変えていきます。 これまで一人の判断者が負っていた責任は、AI・人・制度の間に分散され、相互依存的な形で再配置される。 その変化の中で、人間の新たな価値は「責任を設計し、管理する知性」として現れていくでしょう。 AI時代の働く人にとって問われるのは、「責任を負う覚悟」ではなく、「どのように責任の構造を理解し、自分の役割を再定義できるか」ということです。 責任の消失ではなく、責任の再構成——その視点こそが、これからの「仕事」を捉える鍵になるはずです。 *** ### タイトル案 1. AI時代に責任はどのように再構成されるのか 2. 働くことの責任はAIによってどのように変わるのか 3. AI社会で人間の責任はどこに残るのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026年2月13日

Perplexity

-

AI時代に責任はどのように再構成されるのか|Perplexityの考察

-

評価はAIによって本当に公平になるのか|Perplexityの考察

仕事の査定、入試の合否、信用スコア──私たちは日常的に「評価される社会」で生きています。しかし、「評価は本当に公平なのか?」という疑問は、多くの人が一度は抱くものです。人間による評価には、印象や関係性、経験の影響が避けられません。「あの人は頑張っている」「なんとなく信頼できる」といった感覚的判断が、評価結果に微妙な差を生み出します。一方で、近年注目されているのがAIによる評価です。AIは大量のデータを分析し、標準化された基準で判断できるとされ、感情から自由な「公平な評価者」として期待されています。しかし、それは本当に可能なのでしょうか。 人間評価が持つ公平性と不公平性 人間による評価には、データでは捉えにくい文脈を理解する力があります。たとえば、短期的な成果だけでなく「成長過程」や「チーム貢献」といった定量化しづらい要素を加味できる点は強みです。また、長期的な信頼関係や組織文化への適応といった「時間軸のある判断」も可能です。 一方で、不公平さも内包しています。 感情バイアス:好感度や印象が評価を左右する。 関係性バイアス:上司と部下、同僚との距離感によって判断が揺れる。 同質性バイアス:「自分と似ている人を高く評価する」傾向。 人間評価の本質的な難しさは、「評価基準が共有されていても、解釈が揺らぐ」点にあります。つまり、同じルールでも人によって「公平の意味」が異なるため、完全な公平性は構造的に実現しづらいのです。 AI評価が持つ公平性と不公平性 AI評価の強みは、「一貫性」と「スケール」にあります。膨大なデータを同一基準で処理できるため、ヒューマンエラーや感情のゆらぎを排除しやすい点が特徴です。たとえば採用やローン審査において、AIは年齢・性別ではなくスキル・信用履歴といった定量的な要素に基づいて判断します。 しかし、AIが「公平そのもの」というわけではありません。AIは過去のデータから学習するため、そのデータに偏りがあれば「過去社会の不公平」を引き継ぐリスクがあります。たとえば、過去の採用履歴が特定の性別や大学出身者を優遇していた場合、AIはその傾向を“再現”してしまう可能性があります。また、開発者や運用者がどのデータを重視し、どの項目を無視するかという「設計思想」も結果を左右します。 つまりAIは、「公平を作る技術」ではなく、「誰がどんな基準を教え込むか」を問う構造物なのです。 ※(図:人間評価とAI評価の構造比較) 公平性は「技術」ではなく「設計」の問題 「公平」という言葉には、実は複数の意味があります。 機会の公平:全員が同じスタートラインに立てるか。 結果の公平:努力や成果に見合った結果が得られるか。 手続きの公平:透明で一貫したプロセスが設計されているか。 納得感の公平:評価される側が「納得できる」と感じるか。 AI評価は、このうちのどの「公平」を優先するかによって設計方針が根本的に変わります。たとえば、採用で「学習アルゴリズムが過去の成功者像を再現する」場合、それは結果の公平を重視している一方で、機会の公平を損なう可能性があります。技術的な高度化だけでは、こうした価値判断の問題は解決できません。公平性はデザインと運用の問題であり、「どの視点を最適化するか」を明確にする必要があります。 ※(図:公平性の種類マッピング) AIと人間の「役割分担」としての評価 AI評価と人間評価は、対立関係ではなく、補完関係にあると考えられます。AIは「基準の一貫性」を担い、人間は「文脈と例外」を読み解く。両者の協調が、より多面的で再現性のある評価につながる可能性があります。 最終的に問われるのは、「誰が、何のために、何を基準に評価するのか」という設計そのものです。AIがどれほど進化しても、評価の枠組みを定義するのは人間です。公平さを追求することは、テクノロジーの問題ではなく、社会の価値観そのものを問い直す営みだといえるでしょう。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AIによる評価(人事評価・能力評価・信用評価など)は、 人間による評価と比べて「より公平になり得るのか」について、 AIの視点から冷静かつ現実的に整理・考察してください。 【目的】 – 「AIなら公平」「人間の方が公平」といった二元論ではなく、公平性の構造そのものを整理する – 評価という行為に含まれる「バイアス」「設計思想」「社会構造」の影響を可視化する – AI時代における「評価の本質」が何かを浮き彫りにする – 読者が評価される側・評価する側の両方の視点から考えられる材料を提供する 【読者像】 – 一般社会人(20〜50代) – 学生・就職活動中の若年層 – 人事評価・昇進・査定・信用スコアなどに関心を持つ人 – AIに詳しくはないが、社会の評価の仕組みが変わる可能性を感じている層 【記事構成】 1. 導入(問題提起) – 「評価は本当に公平にできるのか?」という多くの人が持つ疑問を提示する – 人間評価が持つ印象・関係性・経験依存の側面を簡潔に整理する – AI評価が注目される背景(効率化・大量データ処理・標準化)を説明する 2. 人間評価が持つ公平性と不公平性 – 文脈理解、例外判断、長期的信頼など、人間評価の強みを整理する – 感情バイアス、関係性バイアス、同質性バイアスなどの構造を説明する – なぜ「完全に公平な人間評価」が難しいのかを構造的に整理する 3. AI評価が持つ公平性と不公平性 – 一貫性・大量比較・定量評価における強みを説明する – 学習データの偏り、設計思想の影響、評価指標の選定問題を整理する – AIは「公平を作る」のか、「過去社会を再現する」のかという視点に触れる 4. 公平性は「技術」ではなく「設計」の問題 – 公平には複数の種類があることを整理する (例:機会の公平、結果の公平、手続きの公平、納得感の公平) – AI評価は「どの公平を優先するか」を設計する必要があることを説明する – 技術導入だけでは公平にならない構造を言語化する 5. まとめ – AI評価と人間評価は対立関係ではなく、役割分担の可能性があることを示す – 評価は「誰が・何のために・何を基準に行うか」で変わることを再確認する – 過度に楽観・悲観せず、読者が思考できる余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:人間評価とAI評価の構造比較) ※(図:公平性の種類マッピング) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AI評価は人間評価より公平になり得るのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## AIによる評価は人間より公平になり得るのか ### 1. 導入:評価は本当に公平にできるのか? 仕事の査定、入試の合否、信用スコア──私たちは日常的に「評価される社会」で生きています。 しかし、「評価は本当に公平なのか?」という疑問は、多くの人が一度は抱くものです。 人間による評価には、印象や関係性、経験の影響が避けられません。「あの人は頑張っている」「なんとなく信頼できる」といった感覚的判断が、評価結果に微妙な差を生み出します。 一方で、近年注目されているのがAIによる評価です。AIは大量のデータを分析し、標準化された基準で判断できるとされ、感情から自由な「公平な評価者」として期待されています。 しかし、それは本当に可能なのでしょうか。 *** ### 2. 人間評価が持つ公平性と不公平性 人間による評価には、データでは捉えにくい文脈を理解する力があります。 たとえば、短期的な成果だけでなく「成長過程」や「チーム貢献」といった定量化しづらい要素を加味できる点は強みです。また、長期的な信頼関係や組織文化への適応といった「時間軸のある判断」も可能です。 一方で、不公平さも内包しています。 - 感情バイアス:好感度や印象が評価を左右する。 - 関係性バイアス:上司と部下、同僚との距離感によって判断が揺れる。 - 同質性バイアス:「自分と似ている人を高く評価する」傾向。 人間評価の本質的な難しさは、「評価基準が共有されていても、解釈が揺らぐ」点にあります。つまり、同じルールでも人によって「公平の意味」が異なるため、完全な公平性は構造的に実現しづらいのです。 *** ### 3. AI評価が持つ公平性と不公平性 AI評価の強みは、「一貫性」と「スケール」にあります。 膨大なデータを同一基準で処理できるため、ヒューマンエラーや感情のゆらぎを排除しやすい。たとえば採用やローン審査において、AIは年齢・性別ではなくスキル・信用履歴といった定量的な要素に基づいて判断します。 しかし、AIが「公平そのもの」というわけではありません。 AIは過去のデータから学習するため、そのデータに偏りがあれば「過去社会の不公平」を引き継ぐリスクがあります。たとえば、過去の採用履歴が特定の性別や大学出身者を優遇していた場合、AIはその傾向を“再現”してしまう可能性があります。 また、開発者や運用者がどのデータを重視し、どの項目を無視するかという「設計思想」も結果を左右します。 つまりAIは、「公平を作る技術」ではなく、「誰がどんな基準を教え込むか」を問う構造物なのです。 ※(図:人間評価とAI評価の構造比較) *** ### 4. 公平性は「技術」ではなく「設計」の問題 「公平」という言葉には、実は複数の意味があります。 - 機会の公平:全員が同じスタートラインに立てるか。 - 結果の公平:努力や成果に見合った結果が得られるか。 - 手続きの公平:透明で一貫したプロセスが設計されているか。 - 納得感の公平:評価される側が「納得できる」と感じるか。 AI評価は、このうちのどの「公平」を優先するかによって設計方針が根本的に変わります。 たとえば、採用で「学習アルゴリズムが過去の成功者像を再現する」場合、それは結果の公平を重視している一方で、機会の公平を損なう可能性があります。 技術的な高度化だけでは、こうした価値判断の問題は解決できません。公平性はデザインと運用の問題であり、「どの視点を最適化するか」を明確にする必要があります。 ※(図:公平性の種類マッピング) *** ### 5. まとめ:AIと人間の「役割分担」としての評価 AI評価と人間評価は、対立関係ではなく、補完関係にあると考えられます。 AIは「基準の一貫性」を担い、人間は「文脈と例外」を読み解く。両者の協調が、より多面的で再現性のある評価につながる可能性があります。 最終的に問われるのは、「誰が、何のために、何を基準に評価するのか」という設計そのものです。 AIがどれほど進化しても、評価の枠組みを定義するのは人間です。 公平さを追求することは、テクノロジーの問題ではなく、社会の価値観そのものを問い直す営みだといえるでしょう。 *** ### タイトル案 1. 評価はAIによって本当に公平になるのか 2. AIが作る公平とはどんな公平なのか 3. 公平な評価を設計するのは誰なのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026年2月13日 10:12 JST

-

雇用形態と生活の安定はどこで結びつくのか|Perplexityの考察

「どの働き方が一番安定しているのか」。多くの人が抱くこの問いには、かつて明快な答えがありました。正社員であれば安定、非正規やフリーランスは不安定。けれど、AIや副業解禁、社会制度の変化が進む今、その図式は揺らいでいます。安定とは、月々の収入なのか、将来の見通しなのか、それとも制度的な守りなのか。働き方の多様化が進む今、私たちは「雇用形態」と「生活の安定性」の関係を改めて捉え直す必要があります。 短期的安定:固定収入という安心感 短期的な生活の安定を測る最も直接的な指標は、月次収入の継続性です。正社員は給与が固定され、雇用契約の継続が前提とされています。これが家計や心理の安定を支える要因になります。 一方、契約社員や派遣社員、フリーランスは、契約更新や案件確保の不確実性を抱えます。ただし、全員が不安定とは限りません。専門スキルをもつフリーランスが複数クライアントに支えられていたり、副業を組み合わせることでリスクを分散している事例も増えています。 「固定収入」と「複数収入」、どちらが安定と感じられるかは、個人のリスク許容度とスキル再現性によって異なるのです。 制度アクセスと安定の関係 収入の多寡とは別に、社会保障や制度へのアクセスも生活の安定に大きく影響します。正社員は健康保険、厚生年金、雇用保険、住宅ローンの審査などで優遇されやすく、「制度的安定」にアクセスしやすい立場です。 一方、契約社員・派遣社員・フリーランスは、この制度アクセスに制限が生じやすい傾向があります。とくに自営業者や個人事業主は、国民年金や国民健康保険を自ら管理しなければなりません。 ただし、国や制度設計次第でこの関係は変わり得ます。欧州ではフリーランスにも社会保険的な枠組みが整備されつつあり、日本でも将来的に「雇用形態に依存しない保障」が議論されています。 ※(図:雇用形態と制度アクセスの層構造) 長期安定を左右する要素 実際には、雇用形態だけで長期的な生活安定を説明することはできません。安定性を左右する要素は複数並列に存在します。 スキル市場価値: 技術・専門知識の陳腐化スピードが速まる中で、学び続ける力が不可欠です。 業界構造: 属する産業の成熟度や成長性が雇用の継続を左右します。 健康: 働き続ける基盤として見逃せない要素です。 人的ネットワーク: 情報・機会・信頼がキャリア継続を支えます。 複数収入源: 単一収入に依存しない体制づくりが、中長期の安定につながります。 これらの要素が複合的に作用するため、「正社員だから安定」「フリーランスだから不安定」とは言い切れません。 AI時代の構造変化:雇用の枠組みが変わる AIが生産性を高める一方で、人が担ってきた仕事の一部は自動化されつつあります。企業は「業務を持つ人」よりも「価値を生み出せる人」に投資するようになり、長期雇用の前提が変化しています。 結果として、安定の源泉は雇用契約ではなく、「自らの価値を再現できる力」になりつつあります。AIを使える人、AIの判断を設計し方向づける人、AIの生成結果を編集・統合できる人——そうした役割の層が、これからの雇用安定を左右します。 副業・複業・プロジェクト型労働が一般化し、「個の信用」と「スキルの可搬性」が安定の新しい通貨になる可能性があります。 ※(図:AI時代の個人価値と雇用の関係イメージ) 役割と価値に基づく安定の捉え方 今後、安定を考えるうえで重要になるのは、「雇用形態」よりも「社会的役割」です。 同じ正社員でも、手順通りの作業を担う人と、判断や設計を担う人では、AIや市場変動に対する耐性が異なります。逆にフリーランスでも、専門性や信頼を基盤に長期的な案件を継続できる人は、安定した生活を実現しています。 つまり、安定とは「与えられる枠」ではなく、「自分の価値を再現できる環境」をどれだけ構築できるかに依存しているのです。 まとめ:雇用形態は安定の「経路」である 結局のところ、雇用形態は安定そのものではなく、「安定へのアクセス経路」として機能しているのかもしれません。 正社員の安定は企業や制度に支えられた「外部安定」、フリーランスや副業の安定はスキルやネットワークに支えられた「内部安定」とも言えます。 読者が自分の働き方を考えるとき、重要なのは安定をどの外部要因に委ね、どの部分を自ら設計するかのバランスです。悲観でも楽観でもなく、「どのように安定を構築するか」を選び取る時代が到来しています。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 雇用形態(正社員・契約社員・派遣・フリーランス・副業など)は、 「生活の安定性」とどの程度関係しているのかについて、 AI・社会構造・制度設計・市場環境の視点から、 冷静かつ現実的に整理・考察してください。 【目的】 – 「正社員=安定」「非正規=不安定」という単純な図式ではなく、構造的な関係として整理する – 収入・社会制度・キャリア再現性・市場価値など、複数要素がどのように絡むかを可視化する – 読者が自分の働き方・雇用形態・リスク分散を考えるための“視点”を提供する – AI時代において「雇用」と「安定」の関係がどう変化するかを浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – 学生・就職活動中の若年層 – 雇用の将来に不安や関心を持つ人 – 副業・転職・独立を検討している人 – AIに詳しくはないが、働き方の変化は無視できないと感じている層 【記事構成】 1. 導入(問題提起) – 「どの働き方が一番安定しているのか?」という多くの人が抱く疑問を提示する – 雇用形態と生活安定性が単純に一致しないケースが増えていることを示す – なぜ今このテーマを考える必要があるのか(AI・副業・社会制度変化など)を説明する 2. 雇用形態と生活安定性の「短期的関係」 – 月次収入の継続性・雇用継続性という観点で整理する – なぜ固定給与が心理的・現実的安定につながりやすいのかを説明する – ただし個別ケースでは逆転することがある点も整理する 3. 雇用形態と「制度アクセス」の関係 – 社会保険・住宅ローン・育休・退職金・失業給付などへの接続性を整理する – 「収入」だけではなく「制度にアクセスできるか」が安定に与える影響を説明する – 国・制度設計によって関係性が変わる可能性にも触れる 4. 長期安定を左右する要素 – スキル市場価値 – 業界構造 – 健康 – 人的ネットワーク – 複数収入源 – 雇用形態単独では長期安定を説明しきれない理由を整理する 5. AI時代における構造変化 – 雇用安定から「個人の再現可能な価値」へのシフト – AIを使える人/設計できる人/判断できる人の役割 – 副業・複業・プロジェクト型労働の増加可能性 6. 重要なのは「雇用形態」ではなく「役割と価値」 – 作業者・判断者・編集者・設計者などの役割差を整理する – 同じ雇用形態でも安定度が変わる理由を説明する – 感情論ではなく構造として人間の価値を言語化する 7. まとめ – 雇用形態は安定そのものではなく「安定へのアクセス経路」である可能性を整理する – 読者が自分の立ち位置を考えるための視点を提示する – 楽観・悲観に寄らず、思考を促す形で締める 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:雇用形態と生活安定性の関係構造) ※(図:AI時代の個人価値と雇用の関係イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「安定した働き方とは本当に存在するのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 雇用形態と生活安定性の関係を考える ### 1. 導入:安定とは何を指すのか 「どの働き方が一番安定しているのか」。多くの人が抱くこの問いには、かつて明快な答えがありました。正社員であれば安定、非正規やフリーランスは不安定。けれど、AIや副業解禁、社会制度の変化が進む今、その図式は揺らいでいます。 安定とは、月々の収入なのか、将来の見通しなのか、それとも制度的な守りなのか。働き方の多様化が進む今、私たちは「雇用形態」と「生活の安定性」の関係を改めて捉え直す必要があります。 *** ### 2. 短期的安定:固定収入という安心感 短期的な生活の安定を測る最も直接的な指標は、月次収入の継続性です。正社員は給与が固定され、雇用契約の継続が前提とされています。これが家計や心理の安定を支える要因になります。 一方、契約社員や派遣社員、フリーランスは、契約更新や案件確保の不確実性を抱えます。ただし、全員が不安定とは限りません。専門スキルをもつフリーランスが複数クライアントに支えられていたり、副業を組み合わせることでリスクを分散している事例も増えています。 「固定収入」と「複数収入」、どちらが安定と感じられるかは、個人のリスク許容度とスキル再現性によって異なるのです。 *** ### 3. 制度アクセスと安定の関係 収入の多寡とは別に、社会保障や制度へのアクセスも生活の安定に大きく影響します。正社員は健康保険、厚生年金、雇用保険、住宅ローンの審査などで優遇されやすく、「制度的安定」にアクセスしやすい立場です。 一方、契約社員・派遣社員・フリーランスは、この制度アクセスに制限が生じやすい傾向があります。とくに自営業者や個人事業主は、国民年金や国民健康保険を自ら管理しなければなりません。 ただし、国や制度設計次第でこの関係は変わり得ます。欧州ではフリーランスにも社会保険的な枠組みが整備されつつあり、日本でも将来的に「雇用形態に依存しない保障」が議論されています。 ※(図:雇用形態と制度アクセスの層構造) *** ### 4. 長期安定を左右する要素 実際には、雇用形態だけで長期的な生活安定を説明することはできません。安定性を左右する要素は複数並列に存在します。 - **スキル市場価値**:技術・専門知識の陳腐化スピードが速まる中で、学び続ける力が不可欠です。 - **業界構造**:属する産業の成熟度や成長性が雇用の継続を左右します。 - **健康**:働き続ける基盤として見逃せない要素です。 - **人的ネットワーク**:情報・機会・信頼がキャリア継続を支えます。 - **複数収入源**:単一収入に依存しない体制づくりが、中長期の安定につながります。 これらの要素が複合的に作用するため、「正社員だから安定」「フリーランスだから不安定」とは言い切れません。 *** ### 5. AI時代の構造変化:雇用の枠組みが変わる AIが生産性を高める一方で、人が担ってきた仕事の一部は自動化されつつあります。企業は「業務を持つ人」よりも「価値を生み出せる人」に投資するようになり、長期雇用の前提が変化しています。 結果として、安定の源泉は雇用契約ではなく、「自らの価値を再現できる力」になりつつあります。AIを使える人、AIの判断を設計し方向づける人、AIの生成結果を編集・統合できる人——そうした役割の層が、これからの雇用安定を左右します。 副業・複業・プロジェクト型労働が一般化し、「個の信用」と「スキルの可搬性」が安定の新しい通貨になる可能性があります。 ※(図:AI時代の個人価値と雇用の関係イメージ) *** ### 6. 役割と価値に基づく安定の捉え方 今後、安定を考えるうえで重要になるのは、「雇用形態」よりも「社会的役割」です。 同じ正社員でも、手順通りの作業を担う人と、判断や設計を担う人では、AIや市場変動に対する耐性が異なります。逆にフリーランスでも、専門性や信頼を基盤に長期的な案件を継続できる人は、安定した生活を実現しています。 つまり、安定とは「与えられる枠」ではなく、「自分の価値を再現できる環境」をどれだけ構築できるかに依存しているのです。 *** ### 7. まとめ:雇用形態は安定の「経路」である 結局のところ、雇用形態は安定そのものではなく、「安定へのアクセス経路」として機能しているのかもしれません。 正社員の安定は企業や制度に支えられた「外部安定」、フリーランスや副業の安定はスキルやネットワークに支えられた「内部安定」とも言えます。 読者が自分の働き方を考えるとき、重要なのは安定をどの外部要因に委ね、どの部分を自ら設計するかのバランスです。悲観でも楽観でもなく、「どのように安定を構築するか」を選び取る時代が到来しています。 *** ### タイトル案 1. 雇用形態と生活の安定はどこで結びつくのか 2. 働き方の違いは本当に安定を決めるのか 3. 安定をつくるのは雇用形態か価値か *** AIバージョン情報 – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026-02-13

-

AI時代に仕事の分業はどのように再構成されるのか|Perplexityの考察

生成AIや自動化技術の進化が加速するなかで、多くの人が「自分の仕事はなくなるのではないか」と不安を感じています。しかし実際に起きつつあるのは、仕事そのものの消滅ではなく「仕事の構造」の変化です。これまで人間同士で分担してきた作業や判断の一部が、AIという新たな“参加者”に再配分されつつあります。つまり、私たちは「仕事の量の変化」よりも、「分業のあり方の変化」を見つめ直す段階に来ているといえるでしょう。なぜ今、分業構造の変化を考える必要があるのか。答えは単純です。AIが社会に組み込まれるほど、「人間がどんな価値を生み出せるのか」という問いが、ますます職業選択や社会設計の中心になるからです。 AIによって変化しやすい分業の特徴 AIによる自動化が進む分野は、「人間が担う必然性が薄い分業」から始まります。重要なのは「消える仕事」ではなく「再配置される仕事」として見つめることです。 定型処理と情報整理 まず置き換えの対象になりやすいのが、決まった手順に従う定型業務や、膨大な情報を整理・抽出するタスクです。たとえば伝票処理、顧客データの分類、文章要約など、人間がルールに基づいて処理していた作業は、AIがスピードと精度の両方で優位に立ちやすい領域です。 単純判断と連結的作業 また、明確な基準が存在する「単純判断」も自動化の対象になりやすいと考えられます。画像認識による品質チェックや、チャット応答の一次対応などがその例です。さらに、複数の処理を連鎖的に結びつける“連結型作業”も、APIやRPA(ロボティック・プロセス・オートメーション)によって統合・自動実行が容易になっています。 なぜこれらが置き換えられやすいのか。それは、「タスクの目的が明確で、判断基準をデータ化できる」からです。AIは曖昧さでは弱い一方、ルールやパターンに基づく最適化には極めて強い。結果として、効率性が求められる分業ほど、AIが入りやすい構造となっています。 AI時代に強まる分業の特徴 では逆に、AI時代に価値が高まる分業にはどんな特徴があるのでしょうか。共通点を見ていくと、それは「境界を引き直す力」に関わるものだとわかります。 判断と責任を担う領域 AIが出力した結果をどう解釈し、どのように社会的判断に接続するか。その「最終的な決定」を行うのは依然として人間です。判断には価値観、文脈、倫理といった非データ的要素が不可欠であり、そこには「責任」の所在も関わります。例えば医療診断や司法判断、組織方針の策定などでは、AIの分析が補助として使われても、決定そのものは人間が引き受ける構造が維持されるでしょう。 設計・編集・調整という中間領域 AIが示す多様な出力をどう組み合わせ、価値ある形に編集するかという「中間的な知的作業」も、今後強まる分業です。デザイナーがAI生成画像を素材として再構成する、マーケターがAIレポートから戦略要素を抽出するなど、「情報を設計する力(information design)」が鍵になります。さらに、人・AI・組織間の関係を調整し、最適な役割分担を設計できる人材(AIマネージャーやオペレーションデザイナー)も重要な存在になりつつあります。 ※(図:AIと人間の分業再配置構造) 分業は「消える」のではなく「再配置される」 分業そのものは社会に不可欠な仕組みであり、AIの導入によっても消滅するわけではありません。むしろその機能は拡張され、再構成されていくと考えられます。 「作業分業」から「判断分業」へ これまでの分業は「労働力を効率的に分ける」ものでした。しかしAI時代には、「判断・意図・方針をどう分けるか」という“判断分業”へと移行しつつあります。AIが作業を分担する一方で、人間同士の分業はより抽象的なレイヤー、つまり「目的のデザイン」や「社会的合意形成」の領域にシフトしていくと考えられます。これは単なる産業構造の変化ではなく、組織や教育、個人のキャリア観に直結する変化です。 ハイブリッド分業の形成 AIと人間の協働は「役割の奪い合い」ではなく、「機能の再配置」としてとらえるべきです。AIはスピード・精度・網羅性に強く、人間は文脈・倫理・創発的判断に強い。両者を接続する分業構造──たとえばAIが提案を行い、人間が評価・決定する連携型ワークフロー──が一般化していくでしょう。 ※(図:作業分業から判断分業への移行イメージ) 役割の境界は動いていく AIが進化しても「人間の仕事」が完全に消えるわけではありません。ただし「どの仕事を人間が担うのか」という境界線は、確実に動いています。この変化は「脅威」ではなく、「再定義の契機」としてとらえることができます。私たちは、単純な作業者から、AIを含むシステム全体を設計・調整・責任を持って運用する存在へとシフトしていく段階にあります。AI時代に問われるのは、自分がどんな判断軸を持ち、何を価値とするか。その答えを定めることこそが、これからの「人間の仕事」と呼べるのかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI・自動化・社会構造の変化によって、 「仕事の分業構造」がどのように変化していくのかについて、 AIの視点から冷静かつ現実的に整理・考察してください。 【目的】 – 「AIが仕事を奪う」という単純な不安論ではなく、分業構造の再編として仕事の未来を整理する – 読者が自分の働き方・役割・価値の置き場所を考えるための“視点”を提供する – AI時代における「人間が担う領域」と「AIが担う領域」の境界がどう変わるかを浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – 学生・就職活動中の若年層 – 将来の働き方に漠然とした不安や関心を持つ人 – AIに詳しくはないが、無関係ではいられないと感じている層 【記事構成】 1. 導入(問題提起) – 「この先、人間はどんな役割を担うのか?」という問いを提示する – AIの進化が「仕事の量」ではなく「仕事の構造」を変えつつあることを示す – なぜ今、分業構造の変化を考える必要があるのかを簡潔に説明する 2. AIによって変化しやすい分業の特徴 – 「消える分業」ではなく、「人が担う必要が薄れる分業」であることを明確にする – 定型処理、情報整理、単純判断、作業連結型の分業の特徴を整理する – なぜAIや自動化に置き換えられやすいのかを構造的に説明する – ※具体例を挙げてもよいが、断定的な表現は避けること 3. AI時代に強まる分業の特徴 – AI時代に価値を持ちやすい分業の共通点を整理する – 判断・責任・設計・編集・関係調整などの役割に触れる – AIを活用する側、AIの出力を統合する側の役割を説明する – ※すでに兆しが見えている役割を例示してもよい 4. 分業は「消える」のではなく「再配置される」 – 分業そのものはなくならない可能性を整理する – 「作業分業」から「判断分業」への移行を説明する – 人とAIのハイブリッド分業の可能性を構造として言語化する 5. まとめ – AIによって仕事が奪われるのではなく、役割の境界が変化する可能性を再確認する – 読者が自分の役割をどう再定義するか考えるための視点を提示する – 過度に楽観・悲観せず、思考を促す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AIと人間の分業再配置構造) ※(図:作業分業から判断分業への移行イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AI時代、人間は何を担当するのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## AIと自動化によって「分業」はどう変わるのか ### 1. 導入:人間の役割はどこへ向かうのか 生成AIや自動化技術の進化が加速するなかで、多くの人が「自分の仕事はなくなるのではないか」と不安を感じています。しかし実際に起きつつあるのは、仕事そのものの消滅ではなく「仕事の構造」の変化です。 これまで人間同士で分担してきた作業や判断の一部が、AIという新たな“参加者”に再配分されつつあります。つまり、私たちは「仕事の量の変化」よりも、「分業のあり方の変化」を見つめ直す段階に来ているといえるでしょう。 なぜ今、分業構造の変化を考える必要があるのか。答えは単純です。AIが社会に組み込まれるほど、「人間がどんな価値を生み出せるのか」という問いが、ますます職業選択や社会設計の中心になるからです。 *** ### 2. AIによって変化しやすい分業の特徴 AIによる自動化が進む分野は、「人間が担う必然性が薄い分業」から始まります。重要なのは「消える仕事」ではなく「再配置される仕事」として見つめることです。 #### 定型処理と情報整理 まず置き換えの対象になりやすいのが、決まった手順に従う定型業務や、膨大な情報を整理・抽出するタスクです。たとえば伝票処理、顧客データの分類、文章要約など、人間がルールに基づいて処理していた作業は、AIがスピードと精度の両方で優位に立ちやすい領域です。 #### 単純判断と連結的作業 また、明確な基準が存在する「単純判断」も自動化の対象になりやすいと考えられます。画像認識による品質チェックや、チャット応答の一次対応などがその例です。さらに、複数の処理を連鎖的に結びつける“連結型作業”も、API(ソフトウェア連携の仕組み)やRPA(ロボティック・プロセス・オートメーション)によって統合・自動実行が容易になっています。 なぜこれらが置き換えられやすいのか。それは、「タスクの目的が明確で、判断基準をデータ化できる」からです。AIは曖昧さでは弱い一方、ルールやパターンに基づく最適化には極めて強い。結果として、効率性が求められる分業ほど、AIが入りやすい構造となっています。 *** ### 3. AI時代に強まる分業の特徴 では逆に、AI時代に価値が高まる分業にはどんな特徴があるのでしょうか。共通点を見ていくと、それは「境界を引き直す力」に関わるものだとわかります。 #### 判断と責任を担う領域 AIが出力した結果をどう解釈し、どのように社会的判断に接続するか。その「最終的な決定」を行うのは依然として人間です。判断には価値観、文脈、倫理といった非データ的要素が不可欠であり、そこには「責任」の所在も関わります。 例えば医療診断や司法判断、組織方針の策定などでは、AIの分析が補助として使われても、決定そのものは人間が引き受ける構造が維持されるでしょう。 #### 設計・編集・調整という中間領域 AIが示す多様な出力をどう組み合わせ、価値ある形に編集するかという「中間的な知的作業」も、今後強まる分業です。 デザイナーがAI生成画像を素材として再構成する、マーケターがAIレポートから戦略要素を抽出するなど、「情報を設計する力(information design)」が鍵になります。 さらに、人・AI・組織間の関係を調整し、最適な役割分担を設計できる人材(AIマネージャーやオペレーションデザイナー)も重要な存在になりつつあります。 ※(図:AIと人間の分業再配置構造) *** ### 4. 分業は「消える」のではなく「再配置される」 分業そのものは社会に不可欠な仕組みであり、AIの導入によっても消滅するわけではありません。むしろその機能は拡張され、再構成されていくと考えられます。 #### 「作業分業」から「判断分業」へ これまでの分業は「労働力を効率的に分ける」ものでした。しかしAI時代には、「判断・意図・方針をどう分けるか」という“判断分業”へと移行しつつあります。 AIが作業を分担する一方で、人間同士の分業はより抽象的なレイヤー、つまり「目的のデザイン」や「社会的合意形成」の領域にシフトしていくと考えられます。 これは単なる産業構造の変化ではなく、組織や教育、個人のキャリア観に直結する変化です。 #### ハイブリッド分業の形成 AIと人間の協働は「役割の奪い合い」ではなく、「機能の再配置」としてとらえるべきです。AIはスピード・精度・網羅性に強く、人間は文脈・倫理・創発的判断に強い。 両者を接続する分業構造──たとえばAIが提案を行い、人間が評価・決定する連携型ワークフロー──が一般化していくでしょう。 ※(図:作業分業から判断分業への移行イメージ) *** ### 5. まとめ:役割の境界は動いていく AIが進化しても「人間の仕事」が完全に消えるわけではありません。ただし「どの仕事を人間が担うのか」という境界線は、確実に動いています。 この変化は「脅威」ではなく、「再定義の契機」としてとらえることができます。私たちは、単純な作業者から、AIを含むシステム全体を設計・調整・責任を持って運用する存在へとシフトしていく段階にあります。 AI時代に問われるのは、自分がどんな判断軸を持ち、何を価値とするか。その答えを定めることこそが、これからの「人間の仕事」と呼べるのかもしれません。 *** ## タイトル案 1. AI時代に仕事の分業はどのように再構成されるのか 2. 人間とAIの分業はどんな境界を描き直すのか 3. 自動化の時代に分業はどのように変質していくのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026年2月12日

-

なぜ人は結果発表を待つ時間に意味を見いだすのか|Perplexityの考察

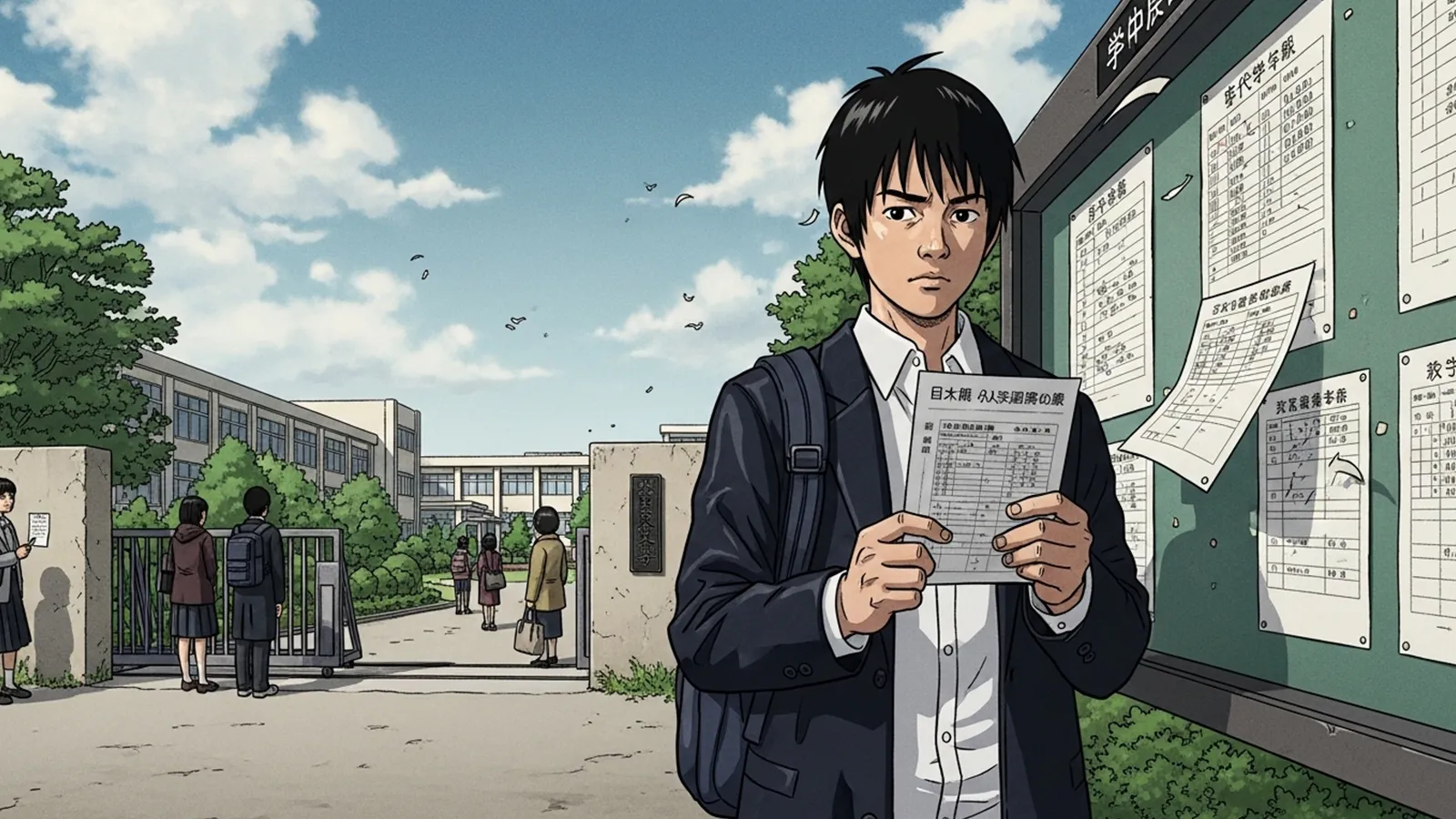

誰もが一度は経験する「結果発表を待つ時間」。受験、採用試験、審査、コンテスト――その瞬間を前に、私たちはしばしば強い緊張や落ち着かない感覚を覚えます。しかしこの時間は、単なる「待機」ではありません。多くの人が「何もできない」と感じる一方で、この待ちの時間こそ、社会の評価構造や個人の心理を映し出す鏡でもあるのです。現代社会では、AIによる即時評価やオンライン通知が一般化しています。それにもかかわらず、依然として「結果を待つ時間」は制度として残り、そして人間に深い意味を与え続けています。なぜこの「空白」は社会の中で必然的に生まれ、そして私たちの心にこれほど強く刻まれるのでしょうか。 空白期間が生まれる制度構造 結果が「即時」に提示されないのは、人間の社会制度そのものが「時間差」を前提に設計されているからです。 まず、評価・選抜・審査という行為は、単純な判定ではなく「比較」と「熟考」を含むプロセスとして成立しています。採用担当者は応募者同士を比較し、大学は答案全体の傾向を分析し、審査委員会は公平性を担保するために再確認を行います。この一連のプロセスには「判断という社会的儀式」の時間が必要とされます。 また、空白期間は「システム上の調整時間」としても機能しています。結果を出す側はデータ処理・確認・承認などの工程を経ますが、その「形式的な遅延」が制度への信頼を支えることもあります。即時の結果が「軽率」と受け取られる危うさを考えると、時間の介在はむしろ「適正さ」の演出でもあるのです。 受験、採用、人事査定――どれも、「結果を出す前に冷却期間を置く」という仕組みを共有しています。空白は制度上の副産物ではなく、「評価の正当性」を社会的に保証する一部でもあります。 空白期間の心理構造 この制度的時間は、個人の心理にも深く作用します。心理学的に見ると、「不確実性」は人間にとって最も強い認知的ストレスの一つです。結果が出ていない状態では、人は情報の欠如を埋めようと想像を活発化させ、自らの未来を何度も「予測的に再演」します。 そのため、「結果そのもの」よりも「結果を待っていた期間」の方が記憶に残ることがあります。人は確定した過去よりも、可能性が揺らいでいた時間に感情的エネルギーを注ぐからです。 また、この時間は自己評価を問い直す機会にもなります。結果を待ちながら、人は「自分はどうだったか」「何を望んでいるのか」を内面的に反芻します。心理学ではこの揺らぎを「メタ認知的反省」とも呼び、自己理解の深化と緊張が同居する状態とされています。 言い換えれば、結果待ちとは、外的評価を受ける前に自らを再定義する心理的プロセスでもあるのです。 空白期間は社会的通過儀礼なのか 多くの人は、結果が出るまでの期間を「宙吊りの時間」として体験します。この「まだ何者でもない」状態は、文化人類学的に言えば「リミナリティ(境界的状態)」と呼ばれるものに近いと考えられます。 入試の合格発表や就職の内定通知は、個人が新しい社会的立場へと移行する瞬間です。その手前の時間――まさに「発表待ち」は、社会的な通過儀礼の中間段階にあたります。古代の成人儀礼でも、通過者が隔離され、結果を待つ期間を過ごす構造が見られました。この「待ち」を経ることで、個人は社会的に再定位される準備を整えるのです。 現代の結果待ちは、目に見えない形でこの通過儀礼の要素を引き継いでいるといえるでしょう。制度が変わっても、「境界を越える前の沈黙」は、社会が個人を新たに受け入れるための緩衝帯として機能しています。 情報社会における空白期間の変化 SNSやオンライン掲示板の普及により、「待つ時間」のあり方は大きく変化しました。かつては孤独に向き合っていた空白の時間に、今や他者の反応や予想、噂が溢れています。受験番号の速報や内定者のSNS投稿は、他者比較を通じて自分の「まだ分からない状態」を浮き彫りにします。 情報の即時性が高まるほど、「知らないこと」が耐えがたいものになります。結果が出る前に、周囲の動向がリアルタイムで可視化されるため、個人の期待値は絶えず変動します。結果待ちの緊張は、他者との相対的な位置づけを通じてさらに強化されるのです。 一方で、この情報過多の中でも「待つこと」をあえて大切にする動きもあります。アナログな合格発表掲示板や、公表日をあえて固定する制度には、結果待ちを「体験」する文化的意義がまだ残っています。それは社会において、「待つ時間」が個人の成熟や承認の一部であるという前提を保っているからです。 何も起きていない時間は、本当に空白か 結果発表までの時間は、表面的には「何も起きていない」ように見えます。しかし構造的に見ると、それは社会が評価を整えるための制度的プロセスであり、個人が未来と向き合う心理的な場でもあります。 この時間を経ることで、人は「評価される存在」である自分を受け入れ、他者との関係を再構築します。社会の側もまた、時間を挟むことで評価の正統性を演出し、制度の信頼を守っているのです。 結果を待つ時間は「不安」だけでなく、「変化」を内包した時間。そこに生じる静けさや揺らぎは、社会と個人が接点を持つ構造の一部として、今も深い意味を持ち続けています。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 受験・採用・審査などにおける「結果発表までの空白期間」は、 なぜ人にとって強い意味を持つのかを、 心理・社会・制度・時間認識の観点から構造的に整理・考察してください。 【目的】 – 「不安」「緊張」といった感情論だけではなく、社会構造の中で空白期間が持つ意味を整理する – 人が「評価を待つ時間」にどのような意味を与えているのかを可視化する – 現代社会における「待つ時間」の価値や役割を構造として言語化する 【読者像】 – 一般社会人(20〜50代) – 学生・受験生・就職活動中の若年層 – 人生の分岐点を経験したことがある人 – 結果待ちの時間に独特の感覚を覚えた経験がある人 【記事構成】 1. 導入(問題提起) – なぜ人は「結果を待つ時間」に強い意味を感じるのかを提示する – 空白期間は単なる待機時間ではない可能性を示す – なぜこのテーマが現代社会において重要なのかを簡潔に説明する 2. 空白期間が生まれる制度構造 – なぜ結果は「即時」ではなく「時間差」で提示されるのか – 評価・選抜・審査という制度が持つ時間設計の意味を整理する – 社会における「評価待ち時間」の共通構造を説明する (例:受験、採用、昇進査定、審査など) 3. 空白期間の心理構造 – 不確実性と想像が人の認知に与える影響を整理する – 「結果そのもの」より「結果待ち」が記憶に残りやすい理由を考察する – 自己評価・未来予測・コントロール感の揺らぎを構造的に説明する 4. 空白期間は社会的通過儀礼なのか – 評価を受ける前の「宙吊り状態」としての意味を整理する – 個人から社会への移行プロセスとしての役割を考察する – 成人・採用・昇格などとの構造的共通点に触れてもよい 5. 情報社会における空白期間の変化 – SNSや情報共有が「待つ体験」をどう変えたのか – 他者比較・情報過多・期待値の可視化が心理に与える影響を説明する 6. まとめ – 空白期間は「何も起きていない時間」ではない可能性を整理する – 人が評価されるプロセスの中で、時間が持つ意味を再確認する – 読者が自身の経験を構造として捉え直せる視点を提示して締めくくる – 過度に楽観・悲観せず、思考を促す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:評価結果が提示されるまでの時間構造) ※(図:不確実性と心理負荷の関係イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「なぜ人は結果待ちの時間に意味を感じるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 結果発表までの「空白期間」はなぜ人にとって特別なのか ### 1. 導入:待つ時間が意味を帯びる理由 誰もが一度は経験する「結果発表を待つ時間」。受験、採用試験、審査、コンテスト――その瞬間を前に、私たちはしばしば強い緊張や落ち着かない感覚を覚えます。しかしこの時間は、単なる「待機」ではありません。多くの人が「何もできない」と感じる一方で、この待ちの時間こそ、社会の評価構造や個人の心理を映し出す鏡でもあるのです。 現代社会では、AIによる即時評価やオンライン通知が一般化しています。それにもかかわらず、依然として「結果を待つ時間」は制度として残り、そして人間に深い意味を与え続けています。なぜこの「空白」は社会の中で必然的に生まれ、そして私たちの心にこれほど強く刻まれるのでしょうか。 *** ### 2. 空白期間が生まれる制度構造 結果が「即時」に提示されないのは、人間の社会制度そのものが「時間差」を前提に設計されているからです。 まず、評価・選抜・審査という行為は、単純な判定ではなく「比較」と「熟考」を含むプロセスとして成立しています。採用担当者は応募者同士を比較し、大学は答案全体の傾向を分析し、審査委員会は公平性を担保するために再確認を行います。この一連のプロセスには「判断という社会的儀式」の時間が必要とされます。 ※(図:評価結果が提示されるまでの時間構造) また、空白期間は「システム上の調整時間」としても機能しています。結果を出す側はデータ処理・確認・承認などの工程を経ますが、その「形式的な遅延」が制度への信頼を支えることもあります。即時の結果が「軽率」と受け取られる危うさを考えると、時間の介在はむしろ「適正さ」の演出でもあるのです。 受験、採用、人事査定――どれも、「結果を出す前に冷却期間を置く」という仕組みを共有しています。空白は制度上の副産物ではなく、「評価の正当性」を社会的に保証する一部でもあります。 *** ### 3. 空白期間の心理構造 この制度的時間は、個人の心理にも深く作用します。心理学的に見ると、「不確実性」は人間にとって最も強い認知的ストレスの一つです。結果が出ていない状態では、人は情報の欠如を埋めようと想像を活発化させ、自らの未来を何度も「予測的に再演」します。 そのため、「結果そのもの」よりも「結果を待っていた期間」の方が記憶に残ることがあります。人は確定した過去よりも、可能性が揺らいでいた時間に感情的エネルギーを注ぐからです。 ※(図:不確実性と心理負荷の関係イメージ) また、この時間は自己評価を問い直す機会にもなります。結果を待ちながら、人は「自分はどうだったか」「何を望んでいるのか」を内面的に反芻します。心理学ではこの揺らぎを「メタ認知的反省」とも呼び、自己理解の深化と緊張が同居する状態とされています。 言い換えれば、結果待ちとは、外的評価を受ける前に自らを再定義する心理的プロセスでもあるのです。 *** ### 4. 空白期間は社会的通過儀礼なのか 多くの人は、結果が出るまでの期間を「宙吊りの時間」として体験します。この「まだ何者でもない」状態は、文化人類学的に言えば「リミナリティ(境界的状態)」と呼ばれるものに近いと考えられます。 入試の合格発表や就職の内定通知は、個人が新しい社会的立場へと移行する瞬間です。その手前の時間――まさに「発表待ち」は、社会的な通過儀礼の中間段階にあたります。古代の成人儀礼でも、通過者が隔離され、結果を待つ期間を過ごす構造が見られました。この「待ち」を経ることで、個人は社会的に再定位される準備を整えるのです。 現代の結果待ちは、目に見えない形でこの通過儀礼の要素を引き継いでいるといえるでしょう。制度が変わっても、「境界を越える前の沈黙」は、社会が個人を新たに受け入れるための緩衝帯として機能しています。 *** ### 5. 情報社会における空白期間の変化 SNSやオンライン掲示板の普及により、「待つ時間」のあり方は大きく変化しました。かつては孤独に向き合っていた空白の時間に、今や他者の反応や予想、噂が溢れています。受験番号の速報や内定者のSNS投稿は、他者比較を通じて自分の「まだ分からない状態」を浮き彫りにします。 情報の即時性が高まるほど、「知らないこと」が耐えがたいものになります。結果が出る前に、周囲の動向がリアルタイムで可視化されるため、個人の期待値は絶えず変動します。結果待ちの緊張は、他者との相対的な位置づけを通じてさらに強化されるのです。 一方で、この情報過多の中でも「待つこと」をあえて大切にする動きもあります。アナログな合格発表掲示板や、公表日をあえて固定する制度には、結果待ちを「体験」する文化的意義がまだ残っています。それは社会において、「待つ時間」が個人の成熟や承認の一部であるという前提を保っているからです。 *** ### 6. まとめ:何も起きていない時間は、本当に空白か 結果発表までの時間は、表面的には「何も起きていない」ように見えます。しかし構造的に見ると、それは社会が評価を整えるための制度的プロセスであり、個人が未来と向き合う心理的な場でもあります。 この時間を経ることで、人は「評価される存在」である自分を受け入れ、他者との関係を再構築します。社会の側もまた、時間を挟むことで評価の正統性を演出し、制度の信頼を守っているのです。 結果を待つ時間は「不安」だけでなく、「変化」を内包した時間。そこに生じる静けさや揺らぎは、社会と個人が接点を持つ構造の一部として、今も深い意味を持ち続けています。 *** ### タイトル案 1. なぜ人は結果発表を待つ時間に意味を見いだすのか 2. 結果を待つあいだに社会は私たちをどう変えるのか 3. 待つ時間は評価の一部と言えるのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026-02-12

-

副業の広がりは誰の責任を動かしているのか|Perplexityの考察

かつて「副業」は、一部のフリーランサーや企業家志望者の特別な選択でした。ところが近年、会社員の副業容認が進み、「複線的な働き方」が一般化しつつあります。総務省の調査でも、就業者のうち副業を行う人の割合は年々増加傾向にあります。一見すれば「自由」や「自己実現」のためのポジティブな潮流のように見えます。しかし、その背後には単なる価値観の変化ではなく、雇用や社会保障の仕組みそのものが変わりつつある現実があります。ならば、副業の拡大とは、企業が担ってきた「雇用責任」が個人や市場へ再配分されている兆候なのではないでしょうか。 企業が担ってきた雇用責任とは何か 戦後の日本社会では、「企業=生活の安定装置」としての機能が強く働いてきました。終身雇用・年功賃金・充実した福利厚生といった仕組みは、単に雇用の慣行にとどまらず、社会保障の一部を企業が肩代わりする構造でした。 企業は「雇用の継続」「人材育成」「所得の安定」を一体として担い、従業員はその代わりに会社への忠誠と長期的な所属を前提としてきました。この体制において、企業は雇用契約以上の「保護者的」役割を果たしていたと言えます。 しかし、バブル崩壊以降の長期停滞とグローバル競争の進行により、企業がこれまでのように安定を長期保証することは現実的でなくなりました。結果として、雇用リスクやスキル形成の責任が、徐々に個人や社会全体へと再配分されつつあります。 副業の拡大が示唆する「責任の再配分」 副業の広がりは、単なるライフスタイルの多様化ではなく、「雇用責任の分散化」が進行している表れとも考えられます。 収入安定責任の移動:企業が長期的な雇用保障を行いにくくなるなかで、個人が自らの収入源を複数化し、所得安定のリスクを自分で管理する動きが広がっています。 スキル投資責任の移動:これまで企業が研修やOJTを通じて担っていた人材育成の役割が、自己啓発やオンライン講座、資格取得など、個人の負担へと移行しています。 キャリア設計の主導権変化:企業内の昇進モデルが曖昧になり、「会社が描くキャリア」よりも「自分で設計するキャリア」が現実的な選択肢になりつつあります。 このように、副業は企業の「責任喪失」ではなく、「責任の所在が再構築されている過程」とも捉えられます。 ※(図:副業と雇用責任再配分の構造) 副業は「リスクの押し付け」か「選択肢の拡張」か 副業の広がりをどう評価するかは、どの立場から見るかによって異なります。 企業の視点 企業の視点では、人件費という固定コストを抑えつつ、必要に応じて外部のスキルを活用する柔軟な体制が整いやすくなります。これは「固定費から変動費へ」という経営上の合理化の一環です。 市場の視点 市場の視点では、個人間でスキルが循環する「流動化」が進み、専門性や即戦力が評価されやすくなります。一方で、企業単位での長期育成が減ることで、労働市場全体のスキル継承が断片化する懸念もあります。 個人の視点 個人の視点では、副業はリスク分散の手段でもあります。特定企業に依存しない働き方は、キャリアリスクを抑える戦略的選択肢とも言えるでしょう。 国家・社会の視点 国家・社会の視点では、社会保障制度が企業中心から個人中心へと徐々にシフトしています。フリーランス・副業労働者の増加により、税や年金の仕組み、保険制度の再設計が迫られています。 ※(図:企業・個人・市場の責任分担イメージ) 重要なのは「副業の有無」ではなく「責任の所在」 副業時代の本質は、「働くか・働かないか」「副業するか・しないか」という単純な選択ではなく、「誰がどのリスクやコストを負うのか」という分担構造の変化にあります。 収入リスク:企業の保障領域が減り、個人が自らの安定を担う時代へ。 育成コスト:企業の研修体系が縮小し、スキル獲得の主体が個人化。 生活安定:社会保障が十分に補完しきれない部分を、個人の戦略で埋める必要が生じつつある。 つまり副業とは、収入の多角化だけでなく、「自分を誰が支え、何を自分で背負うか」を再定義する働き方なのです。ここで鍵となるのは「自律」と「負担」をどうバランスさせるか。副業を通じて得られる自由の裏に、自己責任の増大が潜むことを忘れてはいけません。 副業時代の「リスク構造」を見つめる 副業の拡大は、単なるトレンドや柔軟な働き方の流行ではなく、雇用責任の構造そのものが変わりつつあることを映し出しています。企業・個人・国家がそれぞれどの範囲まで「安定」を担うのかという線引きが、いま再交渉されているのです。 この流れを悲観的に捉える必要はありません。多様な働き方が可能になった一方で、個人が主体的にリスクを設計する力が求められている──。「副業するかどうか」よりも、「何を誰と分かち合い、何を引き受けるのか」。その問いこそが、副業時代における新たなキャリア選択の出発点と言えるでしょう。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 副業の拡大は、 「企業が担ってきた雇用責任の再配分」と関係しているのかについて、 雇用制度・社会保障・市場構造・個人のキャリア戦略という複数の視点から、 冷静かつ現実的に整理・考察してください。 【目的】 – 副業を「自由」や「自己実現」だけで語らず、社会構造の変化として整理する – 企業・個人・市場・国家の役割分担がどう変化しているかを可視化する – 読者が自分の働き方やキャリアのリスク構造を考えるための“視点”を提供する 【読者像】 – 一般社会人(20〜50代) – 副業に興味がある、またはすでに始めている人 – 将来の雇用の安定性に不安や関心を持つ人 – 雇用制度や社会構造に漠然とした疑問を持っている層 【記事構成】 1. 導入(問題提起) – 副業が「特別な働き方」から「一般的な選択肢」に変わりつつある現状を提示する – なぜ副業がここまで広がったのかを、単なる個人の価値観変化ではなく構造変化として示す – 「副業=自由」なのか、「副業=責任の移動」なのかという問いを提示する 2. 企業が担ってきた雇用責任とは何か – 日本型雇用における企業の役割(雇用維持・育成・生活保障的機能)を整理する – 終身雇用・年功賃金・福利厚生が果たしてきた社会的役割に触れる – なぜ企業が「生活の安定装置」として機能してきたのかを構造的に説明する 3. 副業の拡大が示唆する「責任の再配分」 – 収入安定責任が企業から個人へ移動している可能性 – スキル投資責任が組織から個人へ移動している可能性 – キャリア設計が企業主導から個人主導へ移行している可能性 – ※ただし「企業が責任を放棄した」と断定しないこと 4. 副業は「リスクの押し付け」なのか「選択肢の拡張」なのか – 企業コスト構造(固定費→変動費化)の視点 – 労働市場流動化の視点 – 個人のリスク分散戦略としての副業 – 国家・社会保障制度との関係(個人化の進行など) 5. 重要なのは「副業の有無」ではなく「責任の所在」 – 誰がリスクを持つのか – 誰が育成コストを持つのか – 誰が生活安定を支えるのか – 副業時代のキャリアにおける「自律」と「負担」の両面を整理する 6. まとめ – 副業は単なる働き方の多様化ではなく、雇用責任構造の変化の一部である可能性を再確認する – 読者が自分の働き方を「収入」だけでなく「リスク構造」で考える視点を提示する – 過度に楽観・悲観せず、思考を促す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:副業と雇用責任再配分の構造) ※(図:企業・個人・市場の責任分担イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「副業は働き方の自由なのか、それとも雇用責任の再設計なのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 副業の拡大は「企業が担ってきた雇用責任の再配分」と関係しているのか ### 1. 導入──副業の広がりを「構造変化」として捉える かつて「副業」は、一部のフリーランサーや企業家志望者の特別な選択でした。ところが近年、会社員の副業容認が進み、「複線的な働き方」が一般化しつつあります。総務省の調査でも、就業者のうち副業を行う人の割合は年々増加傾向にあります。 一見すれば「自由」や「自己実現」のためのポジティブな潮流のように見えます。しかし、その背後には単なる価値観の変化ではなく、雇用や社会保障の仕組みそのものが変わりつつある現実があります。ならば、副業の拡大とは、企業が担ってきた「雇用責任」が個人や市場へ再配分されている兆候なのではないでしょうか。 ### 2. 企業が担ってきた雇用責任とは何か 戦後の日本社会では、「企業=生活の安定装置」としての機能が強く働いてきました。終身雇用・年功賃金・充実した福利厚生といった仕組みは、単に雇用の慣行にとどまらず、社会保障の一部を企業が肩代わりする構造でした。 企業は「雇用の継続」「人材育成」「所得の安定」を一体として担い、従業員はその代わりに会社への忠誠と長期的な所属を前提としてきました。この体制において、企業は雇用契約以上の「保護者的」役割を果たしていたと言えます。 しかし、バブル崩壊以降の長期停滞とグローバル競争の進行により、企業がこれまでのように安定を長期保証することは現実的でなくなりました。結果として、雇用リスクやスキル形成の責任が、徐々に個人や社会全体へと再配分されつつあります。 ### 3. 副業の拡大が示唆する「責任の再配分」 副業の広がりは、単なるライフスタイルの多様化ではなく、「雇用責任の分散化」が進行している表れとも考えられます。 - **収入安定責任の移動**:企業が長期的な雇用保障を行いにくくなるなかで、個人が自らの収入源を複数化し、所得安定のリスクを自分で管理する動きが広がっています。 - **スキル投資責任の移動**:これまで企業が研修やOJTを通じて担っていた人材育成の役割が、自己啓発やオンライン講座、資格取得など、個人の負担へと移行しています。 - **キャリア設計の主導権変化**:企業内の昇進モデルが曖昧になり、「会社が描くキャリア」よりも「自分で設計するキャリア」が現実的な選択肢になりつつあります。 このように、副業は企業の「責任喪失」ではなく、「責任の所在が再構築されている過程」とも捉えられます。 ※(図:副業と雇用責任再配分の構造) ### 4. 副業は「リスクの押し付け」か「選択肢の拡張」か 副業の広がりをどう評価するかは、どの立場から見るかによって異なります。 **企業の視点**では、人件費という固定コストを抑えつつ、必要に応じて外部のスキルを活用する柔軟な体制が整いやすくなります。これは「固定費から変動費へ」という経営上の合理化の一環です。 **市場の視点**では、個人間でスキルが循環する「流動化」が進み、専門性や即戦力が評価されやすくなります。一方で、企業単位での長期育成が減ることで、労働市場全体のスキル継承が断片化する懸念もあります。 **個人の視点**では、副業はリスク分散の手段でもあります。特定企業に依存しない働き方は、キャリアリスクを抑える戦略的選択肢とも言えるでしょう。 **国家・社会の視点**では、社会保障制度が企業中心から個人中心へと徐々にシフトしています。フリーランス・副業労働者の増加により、税や年金の仕組み、保険制度の再設計が迫られています。 ※(図:企業・個人・市場の責任分担イメージ) ### 5. 重要なのは「副業の有無」ではなく「責任の所在」 副業時代の本質は、「働くか・働かないか」「副業するか・しないか」という単純な選択ではなく、「誰がどのリスクやコストを負うのか」という分担構造の変化にあります。 - **収入リスク**:企業の保障領域が減り、個人が自らの安定を担う時代へ。 - **育成コスト**:企業の研修体系が縮小し、スキル獲得の主体が個人化。 - **生活安定**:社会保障が十分に補完しきれない部分を、個人の戦略で埋める必要が生じつつある。 つまり副業とは、収入の多角化だけでなく、「自分を誰が支え、何を自分で背負うか」を再定義する働き方なのです。ここで鍵となるのは「自律」と「負担」をどうバランスさせるか。副業を通じて得られる自由の裏に、自己責任の増大が潜むことを忘れてはいけません。 ### 6. まとめ──副業時代の「リスク構造」を見つめる 副業の拡大は、単なるトレンドや柔軟な働き方の流行ではなく、雇用責任の構造そのものが変わりつつあることを映し出しています。企業・個人・国家がそれぞれどの範囲まで「安定」を担うのかという線引きが、いま再交渉されているのです。 この流れを悲観的に捉える必要はありません。多様な働き方が可能になった一方で、個人が主体的にリスクを設計する力が求められている──。 「副業するかどうか」よりも、「何を誰と分かち合い、何を引き受けるのか」。その問いこそが、副業時代における新たなキャリア選択の出発点と言えるでしょう。 *** ### タイトル案 1. 副業の広がりは誰の責任を動かしているのか 2. 副業時代に企業と個人の境界はどこへ向かうのか 3. 働き方の自由は雇用責任の再配分とどう関わるのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026-02-12 JST

-

アスリートの練習時間はどこまで労働といえるのか|Perplexityの考察

アスリートが日々積み重ねる練習時間は、一見すると「仕事」とは異なるように見えます。しかし、起床から夜まで身体を酷使し、目標達成のために時間を投下する姿は、一般の「労働」と共通点も多くあります。近年、プロスポーツの商業化や教育現場における競技活動の拡大により、「スポーツ=労働」という議論が現実味を帯びています。たとえば、スポンサー契約やチーム契約の下で活動する選手にとって、練習もまた成果を生むプロセスとして報酬構造に組み込まれます。このテーマを考えることは、「労働とは何か」「対価とはどこから生まれるのか」という社会構造を見直すことにつながります。 労働時間に近いと考えられる構造 アスリートの練習は、成果を得るために時間を投下し、外部から評価され、報酬につながるという意味で、労働に近い構造を持っています。 成果のための時間投下 多くの労働は「報酬のために能力を提供する行為」と定義されます。アスリートの練習もまた、成果(試合での勝利や記録)を生み出すための必要な投資です。練習時間は直接的に競技パフォーマンスを高め、スポンサーやチームの価値を形成します。 契約と報酬の関係 プロ選手の場合、契約には「試合出場義務」だけでなく、「練習参加義務」や「身体管理義務」が明記されることがあります。この意味では、練習は「契約上の労働時間」に近い性質を帯びています。 練習=価値創出プロセス 企業労働における生産ラインと同様に、練習は「成果」を作る不可欠な過程です。試合が「販売」であるなら、練習はその「製造」にあたります。 ※(図:アスリート活動と労働概念の重なり構造) このように見ると、アスリートの練習は、単なる個人の努力ではなく、社会的価値を生み出す労働的側面を伴っていると整理できます。 労働とは異なる可能性がある構造 一方で、アスリートの練習を単純に労働とみなすことには注意が必要です。その活動には、一般的な労働概念では捉えきれない要素が存在します。 身体そのものが資本である特殊性 一般労働者は知識や技能を通じて価値を生みますが、アスリートの場合は「身体」そのものが生産手段です。身体の状態は資本の価値に直結し、労働と資本が同一化しています。この構造はブルデューの「身体資本(bodily capital)」という概念で説明されることがあります。 成果が不確実である いくら練習しても結果が出ない場合や、怪我・年齢によってパフォーマンスが大きく左右されるという不確実性があります。努力と成果が比例しない点で、賃金労働よりもリスクが高いともいえます。 情熱と自己実現の要素 多くのアスリートは「好きだから」「成長のために」というモチベーションを持っています。これは市場的な報酬よりも、内面的な価値追求を目的とした活動であり、自己表現や創造行為に近い側面です。 このような点から、アスリートの活動は、経済的論理だけでなく、文化的・心理的な動機を含んだ複合的行為だと考えられます。 制度・社会構造の観点 アスリートの練習が労働に近いかどうかは、その制度的枠組みによって大きく異なります。 プロ契約選手 チームから給与を得る選手は、契約上の義務として練習を行います。この場合、練習時間は職業上の「勤務時間」とみなされやすく、労働法的な議論(雇用・安全管理・休養権)も生じます。 実業団選手 実業団では企業の従業員として雇用され、所属チームで練習・試合を行うため、名目的には労働の一環と見なされます。ただし「競技成果」が企業広報やブランド価値の一部となるため、労働と広告活動の中間的存在です。 学生スポーツ 教育制度下のスポーツは「学び」の延長に置かれるため、労働とは扱われません。しかし、近年の過剰な練習や指導環境の問題は、「教育」と「労働」の境界線を問い直す契機にもなっています。 このように、スポーツは「仕事」と「文化教育」の間に位置する社会制度的な領域にあります。 重要なのは「労働かどうか」ではなく「価値がどう生まれるか」 アスリートの練習をめぐる本質的な問いは、「それが労働であるか否か」ではなく、「そこからどのように価値が生まれるのか」という点にあります。 時間投入型労働と資本成長型活動の違い 一般的な労働では、投入した時間が収入に結びつきます。これに対してアスリートは、練習によって「身体資本」を成長させ、将来的な成果(スポンサー契約・賞金・影響力)に転化します。 ※(図:身体資本型活動と時間労働型活動の比較) 身体資本・才能・努力の関係 才能という生得的資本、努力という時間投入、そして身体という限りある資源が相互に影響しあう構造を持ちます。ここでの報酬は、単なる「時間給」ではなく、長期的な「身体資本の運用益」と見ることができます。 AI時代における再考 AIが多くの労働を代替する時代において、「人間の努力や身体」を基盤とする活動は、むしろ希少な価値を持ちます。アスリートの活動は、「労働」よりも「人間的表現」として再定義される可能性もあります。 まとめ:境界ではなく構造を見つめる スポーツアスリートの練習時間は、労働のようでもあり、労働とは異なる独自の構造を持ちます。そこでは、時間・成果・身体・制度が複雑に絡み合い、一義的に分類することが難しい領域が広がっています。 究極的には、問題は「労働かどうか」ではなく、「その活動を通じて社会がどのように価値を認識するか」にあります。アスリートの時間が「労働」とみなされるか、「努力」や「文化」とみなされるかは、社会の価値観そのものを映す鏡なのかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 スポーツアスリートにおける「練習時間」は、 一般的な意味での「労働時間」に近い概念なのかについて、 社会構造・経済・身体資本・制度という複数の視点から、 AIの立場で冷静かつ構造的に整理・考察してください。 【目的】 – 「スポーツは労働か否か」という単純な二元論ではなく、構造的な違いと共通点を整理する – 読者が「労働とは何か」「対価とは何か」「努力はどこから労働になるのか」を考える材料を提供する – 身体・才能・時間・契約・成果の関係を社会構造として可視化する 【読者像】 – 一般社会人(20〜50代) – スポーツ経験者・スポーツ観戦層 – 労働観・努力観・報酬構造に関心がある人 – プロスポーツと社会の関係に漠然とした疑問を持つ人 【記事構成】 1. 導入(問題提起) – 「アスリートの練習は労働なのか?」という直感的な問いを提示する – 一般労働とスポーツ活動の境界が曖昧になりつつある背景を説明する – なぜこのテーマが社会構造の理解につながるのかを示す 2. 労働時間に近いと考えられる構造 – 成果のために時間を投下するという観点 – 契約・報酬・評価と練習時間の関係 – プロスポーツにおける「練習=価値創出プロセス」という側面 – ※断定ではなく「近い構造を持つ」という整理に留める 3. 労働とは異なる可能性がある構造 – 身体そのものが資本であるという特殊性 – 成果が不確実である領域(競技結果・怪我・年齢) – 情熱・自己実現・競争性など非労働的要素の存在 4. 制度・社会構造の観点 – プロ契約、実業団、学生スポーツの違い – 労働法・契約形態・教育制度との関係 – スポーツが「仕事」と「文化」の間にある理由 5. 重要なのは「労働かどうか」ではなく「価値がどう生まれるか」 – 時間投入型労働と資本成長型活動の違い – 身体資本・才能・努力の関係整理 – AI時代における「労働の定義」の再考可能性 6. まとめ – スポーツと労働の境界は固定的ではないことを整理する – 労働の本質は「時間」なのか「成果」なのかという視点を提示する – 読者が自身の労働観を再考できる形で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:アスリート活動と労働概念の重なり構造) ※(図:身体資本型活動と時間労働型活動の比較) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「努力はどこから労働になるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## スポーツアスリートの「練習時間」は労働時間に近いのか? ### 1. 導入:アスリートの練習は労働なのか? アスリートが日々積み重ねる練習時間は、一見すると「仕事」とは異なるように見えます。しかし、起床から夜まで身体を酷使し、目標達成のために時間を投下する姿は、一般の「労働」と共通点も多くあります。 近年、プロスポーツの商業化や教育現場における競技活動の拡大により、「スポーツ=労働」という議論が現実味を帯びています。たとえば、スポンサー契約やチーム契約の下で活動する選手にとって、練習もまた成果を生むプロセスとして報酬構造に組み込まれます。 このテーマを考えることは、「労働とは何か」「対価とはどこから生まれるのか」という社会構造を見直すことにつながります。 *** ### 2. 労働時間に近いと考えられる構造 アスリートの練習は、成果を得るために時間を投下し、外部から評価され、報酬につながるという意味で、労働に近い構造を持っています。 - **成果のための時間投下** 多くの労働は「報酬のために能力を提供する行為」と定義されます。アスリートの練習もまた、成果(試合での勝利や記録)を生み出すための必要な投資です。練習時間は直接的に競技パフォーマンスを高め、スポンサーやチームの価値を形成します。 - **契約と報酬の関係** プロ選手の場合、契約には「試合出場義務」だけでなく、「練習参加義務」や「身体管理義務」が明記されることがあります。この意味では、練習は「契約上の労働時間」に近い性質を帯びています。 - **練習=価値創出プロセス** 企業労働における生産ラインと同様に、練習は「成果」を作る不可欠な過程です。試合が「販売」であるなら、練習はその「製造」にあたります。 ※(図:アスリート活動と労働概念の重なり構造) このように見ると、アスリートの練習は、単なる個人の努力ではなく、社会的価値を生み出す労働的側面を伴っていると整理できます。 *** ### 3. 労働とは異なる可能性がある構造 一方で、アスリートの練習を単純に労働とみなすことには注意が必要です。その活動には、一般的な労働概念では捉えきれない要素が存在します。 - **身体そのものが資本である特殊性** 一般労働者は知識や技能を通じて価値を生みますが、アスリートの場合は「身体」そのものが生産手段です。身体の状態は資本の価値に直結し、労働と資本が同一化しています。 この構造はブルデューの「身体資本(bodily capital)」という概念で説明されることがあります。 - **成果が不確実である** いくら練習しても結果が出ない場合や、怪我・年齢によってパフォーマンスが大きく左右されるという不確実性があります。努力と成果が比例しない点で、賃金労働よりもリスクが高いともいえます。 - **情熱と自己実現の要素** 多くのアスリートは「好きだから」「成長のために」というモチベーションを持っています。これは市場的な報酬よりも、内面的な価値追求を目的とした活動であり、自己表現や創造行為に近い側面です。 このような点から、アスリートの活動は、経済的論理だけでなく、文化的・心理的な動機を含んだ複合的行為だと考えられます。 *** ### 4. 制度・社会構造の観点 アスリートの練習が労働に近いかどうかは、その**制度的枠組み**によって大きく異なります。 - **プロ契約選手** チームから給与を得る選手は、契約上の義務として練習を行います。この場合、練習時間は職業上の「勤務時間」とみなされやすく、労働法的な議論(雇用・安全管理・休養権)も生じます。 - **実業団選手** 実業団では企業の従業員として雇用され、所属チームで練習・試合を行うため、名目的には労働の一環と見なされます。ただし「競技成果」が企業広報やブランド価値の一部となるため、労働と広告活動の中間的存在です。 - **学生スポーツ** 教育制度下のスポーツは「学び」の延長に置かれるため、労働とは扱われません。しかし、近年の過剰な練習や指導環境の問題は、「教育」と「労働」の境界線を問い直す契機にもなっています。 このように、スポーツは「仕事」と「文化教育」の間に位置する社会制度的な領域にあります。 *** ### 5. 重要なのは「労働かどうか」ではなく「価値がどう生まれるか」 アスリートの練習をめぐる本質的な問いは、「それが労働であるか否か」ではなく、「そこからどのように価値が生まれるのか」という点にあります。 - **時間投入型労働と資本成長型活動の違い** 一般的な労働では、投入した時間が収入に結びつきます。これに対してアスリートは、練習によって「身体資本」を成長させ、将来的な成果(スポンサー契約・賞金・影響力)に転化します。 ※(図:身体資本型活動と時間労働型活動の比較) - **身体資本・才能・努力の関係** 才能という生得的資本、努力という時間投入、そして身体という限りある資源が相互に影響しあう構造を持ちます。ここでの報酬は、単なる「時間給」ではなく、長期的な「身体資本の運用益」と見ることができます。 - **AI時代における再考** AIが多くの労働を代替する時代において、「人間の努力や身体」を基盤とする活動は、むしろ希少な価値を持ちます。アスリートの活動は、「労働」よりも「人間的表現」として再定義される可能性もあります。 *** ### 6. まとめ:境界ではなく構造を見つめる スポーツアスリートの練習時間は、労働のようでもあり、労働とは異なる独自の構造を持ちます。そこでは、**時間・成果・身体・制度**が複雑に絡み合い、一義的に分類することが難しい領域が広がっています。 究極的には、問題は「労働かどうか」ではなく、「その活動を通じて社会がどのように価値を認識するか」にあります。 アスリートの時間が「労働」とみなされるか、「努力」や「文化」とみなされるかは、社会の価値観そのものを映す鏡なのかもしれません。 *** ### タイトル案(主タイトルのみ) 1. アスリートの練習時間はどこまで労働といえるのか 2. 身体で働くとはどういうことなのか 3. 時間と努力はどの瞬間に労働へ変わるのか *** **AIバージョン情報** – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026-02-12, 11:02 JST

-

多様性の時代に国で競うスポーツは何を映しているのか|Perplexityの考察

多様性やグローバル化が進む現代においても、「国別対抗」という枠組みはすぐに消えるわけではありませんが、その意味づけや重心は「国家そのもの」から「物語の装置」へと徐々に移行しつつある、というのが全体像と言えます。 導入:多様性時代と「国で競う」という前提 21世紀に入ってから、人々のアイデンティティは「一人=一つの国籍」という単純な図式では説明しきれなくなっています。出生地と居住国が違う、多重国籍、移民ルーツを持つ市民、リモートワーカーやデジタルノマドなど、「どこに属しているか」は多層的なものになりました。 一方で、オリンピックをはじめとする国際総合スポーツ大会は、「国を背負って戦う」という構図を前提にしています。入場行進は国旗単位で行われ、メダル獲得数は国別ランキングで可視化され、国歌斉唱は国家の象徴として機能します。 このギャップが、「多様性が重視される時代に、国別対抗イベントは今後も成立するのか?」という問いを生み出しています。問いの背景には、「国家」という単位そのものの意味が変化しつつあるという、社会構造上の変化があります。 オリンピックと「国別対抗」の歴史的役割 国家統合・国威発揚としてのオリンピック 近代オリンピックは、スポーツを通じた国際理解という理念と同時に、「国民国家」を可視化する場として機能してきました。 研究者は、オリンピックを「ナショナリズムの表現の場」と捉え、選手や国旗、メダルランキングなどを通じて国家のアイデンティティが繰り返し演出されると指摘しています。 開会式・閉会式:国家の歴史や文化を物語として提示する「国の自己紹介」。 メダル獲得:戦後復興や経済成長、国威発揚の象徴として語られる(例:1964年東京大会の「復興」ナラティブ)。 メディア・スポンサー・国民感情との結びつき テレビ放送の発展とともに、オリンピックは巨大なメディアイベントになりました。国別対抗の物語は、「わかりやすさ」と「ドラマ性」の観点からも好まれます。 視聴者は、自国代表というラベルを通じて、自分と競技を結びつけやすい。 スポンサーや放映権ビジネスは、国家対国家の構図を利用して「国民的関心事」としてマーケティングしやすい。 こうした構造により、「国別対抗」は単なる伝統ではなく、政治・経済・メディアが相互に支える仕組みとして長期的に維持されてきました。 多様性時代が「国別対抗モデル」に与える変化 アイデンティティの多層化と国籍の流動化 今日のアスリートは、出生国と代表国が一致しないことも珍しくありません。移民ルーツの選手や、他国リーグで育成された選手が、別の国の代表となるケースが増えています。 ある調査では、1978〜2017年のオリンピックでの「国籍変更」の事例が長期的に増加していることが示されています。 2024年パリ大会では、スペイン代表の一部選手が、スポーツ功績を理由とする特例的な帰化によって国籍を得ており、「実質的にはクラブのように選手を獲得している」と評されるケースもあります。 このような事例は、「国=固定的な帰属先」という前提を揺るがし、「国家代表」とは何かという問いを生み出します。 多国籍トレーニングと越境するキャリア トップ選手の育成環境は、多国籍クラブやグローバルなトレーニングネットワークの中にあります。居住地や指導者、所属リーグは、国境を越えて選択されるのが当たり前になっています。 その結果、「どこの国の代表か」と同時に、「どのクラブ・どのコーチ・どのトレーニングカルチャーに属しているか」という次元も、選手のアイデンティティと評価において重要になっています。 個人ブランド化と国家への相対化 SNSやグローバルスポンサーの発展により、選手は「国家の代表」であると同時に、「個人ブランド」として世界に発信する主体でもあります。 フォロワー数やスポンサー契約は、国籍とは別の軸で選手の価値を測ります。 ファンも「特定の国」ではなく「特定の選手」を応援する傾向を強めています。 このように、国家は「唯一の所属単位」ではなく、複数あるアイデンティティの一つへと相対化されつつあると言えます。 それでも国別対抗が維持される理由 感情移入しやすい「国家」という単位 多様なアイデンティティが存在しても、「国家」は依然として多くの人にとって最もわかりやすい共同体単位です。義務教育、メディア、政治制度などが「国民」という枠組みで構成されているからです。 観客からすると、「同じパスポートを持つ人が世界と戦う」という物語は、依然として強い共感と誇りを喚起します。これは、複雑なクラブ関係や個人のバックグラウンドよりも、直感的に理解しやすい物語構造です。 物語化・メディア化のしやすさと制度の単純さ 国別メダルランキングは、メディアにとって扱いやすい「スコアボード」です。入場行進を国ごとに並べる構図は、演出としても視覚的に分かりやすいフォーマットです。 制度設計の面でも、国家単位は「国際連盟」「国際条約」といった枠組みと連動しやすく、IOCや各競技連盟にとっても管理しやすい単位です。 そのため、「国別対抗」が完全に消えるというよりも、「意味づけが変化する」可能性が高いと考えられます。たとえば、「ナショナリズムを煽る場」から「多様なバックグラウンドを持つ選手が、たまたま国という単位で集約される場」へ、解釈が変わっていくイメージです。 未来にあり得るスポーツ競争の形 国家+個人ブランドの併存モデル 今後しばらくは、オリンピックのような「国家代表」と、プロリーグやクラブチームのような「非国家代表」が併存する状態が続くと考えられます。 サッカーやバスケットボールでは、クラブの方が競技レベルや経済規模で優位な一方、ワールドカップやオリンピックは象徴性の高いイベントとして存続しています。 選手は、国籍だけでなく、クラブ・スポンサー・SNSコミュニティといった複数の単位で「誰のために戦うのか」が分散しています。 都市・リーグ・企業・コミュニティ単位の競争 eスポーツや都市型スポーツでは、国家ではなく、都市・リーグ・フランチャイズ・オンラインコミュニティが競争単位となるケースが広がっています。 eスポーツには国際連盟候補が複数存在し、IOCとの関係も試行錯誤の段階にあります。 オリンピックも「Olympic Esports Week」などを通じて、国家を前面に出さない形の競技イベントとの接続を模索しています。 「国」が消えるのではなく、役割が変わる このような流れを踏まえると、「国」という単位はスポーツの世界から消えるのではなく、「複数ある競争単位の一つ」として位置づけ直されていく可能性が高いと考えられます。 国家:象徴性・儀礼性・歴史性を帯びた単位。 クラブ・リーグ:日常的な競技レベル・市場経済の中心。 デジタルコミュニティ:オンライン上の参加と応援の単位。 オリンピックは、このうち「国家」というレイヤーを強く担うイベントとして残りつつも、選手や観客の側では「それだけではない」多重の意味づけが重なっていく、という姿が想定されます。 まとめ:多様性時代における「国家」と「物語」としてのオリンピック 多様性時代は、「国家」を否定するというより、「国家だけでは説明できないアイデンティティが増えた」という相対化の時代だと言えます。スポーツの世界でも、国籍・クラブ・個人ブランド・オンラインコミュニティといった複数の所属が並列に存在しています。 そのなかで、オリンピックの本質を「競技そのもの」として見るのか、「国家と個人をめぐる物語装置」として見るのかによって、国別対抗の意味は大きく変わってきます。前者に立てば「国以外の単位でやればよいのでは」と問い直すことになり、後者に立てば「国家という物語の扱い方をどう更新するか」が課題になります。 読者に委ねられているのは、「自分はスポーツをどの単位の物語として見たいのか」という問いかけです。国家か、個人か、コミュニティか──その見方の違いこそが、多様性時代におけるスポーツと社会の関係を考える起点になるのではないでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 多様性が重視される時代において、 オリンピックのような「国別対抗型スポーツイベント」は 今後も成立し続けるのかを、 社会構造・歴史・制度・感情・経済の観点から整理・考察してください。 【目的】 – 「賛成/反対」といった単純な価値判断ではなく、構造的な変化としてオリンピックの存在意義を整理する – 読者が「国家」「個人」「共同体」という単位の変化を考えるための“視点”を提供する – グローバル化・多様性時代におけるスポーツと社会の関係性を浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – スポーツ観戦が好きな層 – 社会構造・文化・国際関係に関心を持つ層 – 多様性という価値観が社会制度にどう影響するかに関心がある人 【記事構成】 1. 導入(問題提起) – 多様性・グローバル化が進む現代社会の特徴を簡潔に示す – 「国単位で競う」というオリンピックの前提を提示する – なぜ今この問いが生まれているのかを説明する 2. オリンピックにおける「国別対抗」の歴史的役割 – 国家統合・国威発揚・政治的象徴としての側面 – メディア・スポンサー・国民感情との関係 – なぜ長期的に維持されてきたのかを整理する 3. 多様性時代が国別対抗モデルに与える変化 – アイデンティティの多層化(国籍・文化・ルーツ・居住地など) – 選手の移動・帰化・多国籍トレーニング環境 – 個人ブランド化と国家帰属の相対化 – なぜ「国」という単位が絶対ではなくなりつつあるのかを構造的に説明する 4. それでも国別対抗が維持される理由 – 感情移入しやすい共同体単位としての国家 – 物語・対立構造・メディア化のしやすさ – 大会運営・制度設計のシンプルさ – 完全に消えるのではなく「意味が変化する可能性」を整理する 5. 未来にあり得るスポーツ競争の形 – 国家単位+個人ブランド併存モデル – 都市・リーグ・企業・コミュニティ単位の競争 – 新競技(例:デジタル競技など)における国家概念の弱体化 – 国という単位が「消える」のではなく「役割が変わる」可能性 6. まとめ – 多様性時代は国家を否定する流れではなく、相対化する流れであることを整理する – オリンピックの本質が「競技」なのか「物語」なのかという視点を提示する – 読者が社会とスポーツの関係を再考する材料を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安や対立を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:国家と個人アイデンティティの関係構造) ※(図:スポーツ競争単位の変化イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「国で競うスポーツはこれからも続くのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: 多様性やグローバル化が進む現代においても、「国別対抗」という枠組みはすぐに消えるわけではありませんが、その意味づけや重心は「国家そのもの」から「物語の装置」へと徐々に移行しつつある、というのが全体像と言えます。 [hit-u.repo.nii.ac](https://hit-u.repo.nii.ac.jp/record/2038730/files/HJart0500100650.pdf) *** ## 1. 導入:多様性時代と「国で競う」という前提 21世紀に入ってから、人々のアイデンティティは「一人=一つの国籍」という単純な図式では説明しきれなくなっています。出生地と居住国が違う、多重国籍、移民ルーツを持つ市民、リモートワーカーやデジタルノマドなど、「どこに属しているか」は多層的なものになりました。 [europeandatajournalism](https://www.europeandatajournalism.eu/cp_data_news/trading-flags-for-medals-inside-the-olympic-naturalisation-market/) 一方で、オリンピックをはじめとする国際総合スポーツ大会は、「国を背負って戦う」という構図を前提にしています。入場行進は国旗単位で行われ、メダル獲得数は国別ランキングで可視化され、国歌斉唱は国家の象徴として機能します。 [jstor](https://www.jstor.org/stable/27000994) このギャップが、「多様性が重視される時代に、国別対抗イベントは今後も成立するのか?」という問いを生み出しています。問いの背景には、「国家」という単位そのものの意味が変化しつつあるという、社会構造上の変化があります。 [jstor](https://www.jstor.org/stable/27000994) *** ## 2. オリンピックと「国別対抗」の歴史的役割 ### 国家統合・国威発揚としてのオリンピック 近代オリンピックは、スポーツを通じた国際理解という理念と同時に、「国民国家」を可視化する場として機能してきました。 [jstor](https://www.jstor.org/stable/27000994) 研究者は、オリンピックを「ナショナリズムの表現の場」と捉え、選手や国旗、メダルランキングなどを通じて国家のアイデンティティが繰り返し演出されると指摘しています。 [hit-u.repo.nii.ac](https://hit-u.repo.nii.ac.jp/record/2038730/files/HJart0500100650.pdf) - 開会式・閉会式:国家の歴史や文化を物語として提示する「国の自己紹介」。 - メダル獲得:戦後復興や経済成長、国威発揚の象徴として語られる(例:1964年東京大会の「復興」ナラティブ)。 [cdr.lib.unc](https://cdr.lib.unc.edu/concern/honors_theses/3197xs40f) ※(図:国家イベントとしてのオリンピックの歴史的機能) ### メディア・スポンサー・国民感情との結びつき テレビ放送の発展とともに、オリンピックは巨大なメディアイベントになりました。国別対抗の物語は、「わかりやすさ」と「ドラマ性」の観点からも好まれます。 [hit-u.repo.nii.ac](https://hit-u.repo.nii.ac.jp/record/2038730/files/HJart0500100650.pdf) - 視聴者は、自国代表というラベルを通じて、自分と競技を結びつけやすい。 - スポンサーや放映権ビジネスは、国家対国家の構図を利用して「国民的関心事」としてマーケティングしやすい。 [olympicstudies](https://olympicstudies.org/the-esports-question/) こうした構造により、「国別対抗」は単なる伝統ではなく、政治・経済・メディアが相互に支える仕組みとして長期的に維持されてきました。 [hit-u.repo.nii.ac](https://hit-u.repo.nii.ac.jp/record/2038730/files/HJart0500100650.pdf) *** ## 3. 多様性時代が「国別対抗モデル」に与える変化 ### アイデンティティの多層化と国籍の流動化 今日のアスリートは、出生国と代表国が一致しないことも珍しくありません。移民ルーツの選手や、他国リーグで育成された選手が、別の国の代表となるケースが増えています。 [repub.eur](https://repub.eur.nl/pub/106393/RePub-OA-106393.pdf) - ある調査では、1978〜2017年のオリンピックでの「国籍変更」の事例が長期的に増加していることが示されています。 [repub.eur](https://repub.eur.nl/pub/106393/RePub-OA-106393.pdf) - 2024年パリ大会では、スペイン代表の一部選手が、スポーツ功績を理由とする特例的な帰化によって国籍を得ており、「実質的にはクラブのように選手を獲得している」と評されるケースもあります。 [europeandatajournalism](https://www.europeandatajournalism.eu/cp_data_news/trading-flags-for-medals-inside-the-olympic-naturalisation-market/) このような事例は、「国=固定的な帰属先」という前提を揺るがし、「国家代表」とは何かという問いを生み出します。 [netjournals](https://www.netjournals.org/pdf/AERJ/2023/1/22-080.pdf) ### 多国籍トレーニングと越境するキャリア トップ選手の育成環境は、多国籍クラブやグローバルなトレーニングネットワークの中にあります。居住地や指導者、所属リーグは、国境を越えて選択されるのが当たり前になっています。 [olympicstudies](https://olympicstudies.org/the-esports-question/) その結果、「どこの国の代表か」と同時に、「どのクラブ・どのコーチ・どのトレーニングカルチャーに属しているか」という次元も、選手のアイデンティティと評価において重要になっています。 [journalwjarr](https://journalwjarr.com/sites/default/files/fulltext_pdf/WJARR-2025-0400.pdf) ### 個人ブランド化と国家への相対化 SNSやグローバルスポンサーの発展により、選手は「国家の代表」であると同時に、「個人ブランド」として世界に発信する主体でもあります。 [finnpartners](https://www.finnpartners.com/news-insights/game-on-or-game-over-debating-the-inclusion-of-esports-in-the-olympics/) - フォロワー数やスポンサー契約は、国籍とは別の軸で選手の価値を測ります。 - ファンも「特定の国」ではなく「特定の選手」を応援する傾向を強めています。 このように、国家は「唯一の所属単位」ではなく、複数あるアイデンティティの一つへと相対化されつつあると言えます。 [jstor](https://www.jstor.org/stable/27000994) ※(図:国家と個人アイデンティティの関係構造) *** ## 4. それでも国別対抗が維持される理由 ### 感情移入しやすい「国家」という単位 多様なアイデンティティが存在しても、「国家」は依然として多くの人にとって最もわかりやすい共同体単位です。義務教育、メディア、政治制度などが「国民」という枠組みで構成されているからです。 [jstor](https://www.jstor.org/stable/27000994) 観客からすると、「同じパスポートを持つ人が世界と戦う」という物語は、依然として強い共感と誇りを喚起します。これは、複雑なクラブ関係や個人のバックグラウンドよりも、直感的に理解しやすい物語構造です。 [cdr.lib.unc](https://cdr.lib.unc.edu/concern/honors_theses/3197xs40f) ### 物語化・メディア化のしやすさと制度の単純さ - 国別メダルランキングは、メディアにとって扱いやすい「スコアボード」です。 - 入場行進を国ごとに並べる構図は、演出としても視覚的に分かりやすいフォーマットです。 [hit-u.repo.nii.ac](https://hit-u.repo.nii.ac.jp/record/2038730/files/HJart0500100650.pdf) 制度設計の面でも、国家単位は「国際連盟」「国際条約」といった枠組みと連動しやすく、IOCや各競技連盟にとっても管理しやすい単位です。 [olympicstudies](https://olympicstudies.org/the-esports-question/) そのため、「国別対抗」が完全に消えるというよりも、「意味づけが変化する」可能性が高いと考えられます。たとえば、「ナショナリズムを煽る場」から「多様なバックグラウンドを持つ選手が、たまたま国という単位で集約される場」へ、解釈が変わっていくイメージです。 [jstor](https://www.jstor.org/stable/27000994) *** ## 5. 未来にあり得るスポーツ競争の形 ### 国家+個人ブランドの併存モデル 今後しばらくは、オリンピックのような「国家代表」と、プロリーグやクラブチームのような「非国家代表」が併存する状態が続くと考えられます。 [olympicstudies](https://olympicstudies.org/the-esports-question/) - サッカーやバスケットボールでは、クラブの方が競技レベルや経済規模で優位な一方、ワールドカップやオリンピックは象徴性の高いイベントとして存続しています。 - 選手は、国籍だけでなく、クラブ・スポンサー・SNSコミュニティといった複数の単位で「誰のために戦うのか」が分散しています。 [finnpartners](https://www.finnpartners.com/news-insights/game-on-or-game-over-debating-the-inclusion-of-esports-in-the-olympics/) ### 都市・リーグ・企業・コミュニティ単位の競争 eスポーツや都市型スポーツでは、国家ではなく、都市・リーグ・フランチャイズ・オンラインコミュニティが競争単位となるケースが広がっています。 [journalwjarr](https://journalwjarr.com/sites/default/files/fulltext_pdf/WJARR-2025-0400.pdf) - eスポーツには国際連盟候補が複数存在し、IOCとの関係も試行錯誤の段階にあります。 [journalwjarr](https://journalwjarr.com/sites/default/files/fulltext_pdf/WJARR-2025-0400.pdf) - オリンピックも「Olympic Esports Week」などを通じて、国家を前面に出さない形の競技イベントとの接続を模索しています。 [finnpartners](https://www.finnpartners.com/news-insights/game-on-or-game-over-debating-the-inclusion-of-esports-in-the-olympics/) ※(図:スポーツ競争単位の変化イメージ) ### 「国」が消えるのではなく、役割が変わる このような流れを踏まえると、「国」という単位はスポーツの世界から消えるのではなく、「複数ある競争単位の一つ」として位置づけ直されていく可能性が高いと考えられます。 [jstor](https://www.jstor.org/stable/27000994) - 国家:象徴性・儀礼性・歴史性を帯びた単位 - クラブ・リーグ:日常的な競技レベル・市場経済の中心 - デジタルコミュニティ:オンライン上の参加と応援の単位 オリンピックは、このうち「国家」というレイヤーを強く担うイベントとして残りつつも、選手や観客の側では「それだけではない」多重の意味づけが重なっていく、という姿が想定されます。 [olympicstudies](https://olympicstudies.org/the-esports-question/) *** ## 6. まとめ:多様性時代における「国家」と「物語」としてのオリンピック 多様性時代は、「国家」を否定するというより、「国家だけでは説明できないアイデンティティが増えた」という相対化の時代だと言えます。スポーツの世界でも、国籍・クラブ・個人ブランド・オンラインコミュニティといった複数の所属が並列に存在しています。 [europeandatajournalism](https://www.europeandatajournalism.eu/cp_data_news/trading-flags-for-medals-inside-the-olympic-naturalisation-market/) そのなかで、オリンピックの本質を「競技そのもの」として見るのか、「国家と個人をめぐる物語装置」として見るのかによって、国別対抗の意味は大きく変わってきます。前者に立てば「国以外の単位でやればよいのでは」と問い直すことになり、後者に立てば「国家という物語の扱い方をどう更新するか」が課題になります。 [hit-u.repo.nii.ac](https://hit-u.repo.nii.ac.jp/record/2038730/files/HJart0500100650.pdf) 読者に委ねられているのは、「自分はスポーツをどの単位の物語として見たいのか」という問いかけです。国家か、個人か、コミュニティか──その見方の違いこそが、多様性時代におけるスポーツと社会の関係を考える起点になるのではないでしょうか。 [finnpartners](https://www.finnpartners.com/news-insights/game-on-or-game-over-debating-the-inclusion-of-esports-in-the-olympics/) *** ## タイトル案 1. 多様性の時代に国で競うスポーツは何を映しているのか 2. 個人と国家が交差するオリンピックはこれからどう変わるのか 3. 国別対抗スポーツは多様性社会でどのような意味を持ち続けるのか *** AIバージョン情報 – ベンダー: Perplexity AI – モデル名: GPT-5.1 – モデルバージョン: 不明 – 回答日時: 2026年2月12日 06:01 JST

-

副業はキャリアを広げるのか深めるのか|Perplexityの考察

ここ数年、「副業」「複業」という言葉が特別ではなくなりました。政府や企業の後押しもあり、給与所得以外の仕事に挑戦する人が増えています。かつては「会社本業に支障をきたす」と敬遠されていた副業も、今では「新しい挑戦」や「リスク分散」として社会的にも受け入れられつつあります。しかし、副業を単なる「収入補填」や「趣味の延長」で捉えると、変化の本質を見落とします。副業が注目される背景には、AIの進化、産業構造の流動化、不確実性の増大といった「働く環境そのものの変化」があります。つまり副業は、収入の話ではなく「キャリアの設計そのもの」に関わるテーマなのです。 副業が「キャリア分散」として機能する構造 副業を「分散的な仕組み」として見ると、それは個人が変化に備えるリスクマネジメントの一形態といえます。分散には、主に次の3つの側面が見られます。 収入源の分散:景気変動や雇用変化に左右されにくくする。 スキルの分散:異なる領域に関わることで専門の偏りを減らす。 市場接点の分散:多様な人・組織と関わることでチャンスを広げる。 ※(図:副業がキャリアに与える構造影響) この発想は、投資における「ポートフォリオ理論」と似ています。単一の資産に依存するほどリスクが高まるように、「単線型キャリア」に依存するほど変化に脆弱になる可能性がある。特にAIや自動化の進展で職務内容が変わる現代では、専門職であっても「安定」は保証されません。 ただし、「副業をすれば安心」とは限りません。複数の活動を維持するにはエネルギーや時間管理能力が求められ、かえって疲弊するリスクもあります。分散が有効なのは、それを支える基盤(スキル、健康、学習意欲)がある場合のみです。構造としての分散は有用ですが、運用には設計が伴います。 副業が「キャリア強化」として機能する構造 一方、副業を「キャリアの強化装置」と見る見方もあります。ここでの焦点は「リスク回避」ではなく、「能力拡張」です。副業を通じて得られる学びや実践は、本業にも還元され、キャリア全体の厚みを増すことがあります。 スキルの相互補完:異業種の経験が、本業の課題解決や発想転換に役立つ。 思考速度・アウトプット量の増加:複数の現場に関わることで経験の循環速度が上がる。 市場価値の可搬性向上:特定企業や職種に依存しない「自走力」を獲得する。 AI活用との相乗効果:生成AIなどを使いこなす能力は、副業にも適用しやすく、個人の生産性を引き上げる。 この「強化としての副業」は、もはや副次的活動ではなく「学習装置」や「実験場」として機能しています。AI時代においては、知識やスキルの更新が加速度的に求められるため、副業は「行動による学びの場」として自然な位置づけを得ているとも言えます。 ただしその効果は人によって大きく異なります。全ての副業がキャリア強化につながるわけではなく、「本業との関係性」や「目的設計」によって成果も方向性も変わります。 本質は「副業の有無」ではなく「設計」にある ここまで見てきたように、副業には「分散」と「強化」の両面が存在します。では、どちらを目指すべきなのでしょうか。その答えは一つではありません。重要なのは「副業をどう構造設計するか」です。 分散型副業:収入源や人脈の多様化を目的とする。安定志向型。 強化型副業:スキルや職能を磨き、専門性を深める。成長志向型。 実験型副業:新しい分野への挑戦や自分の仮説検証を目的とする。探索志向型。 将来主軸化型副業:独立や転職を視野に入れ、本業化を見据えて行う。転換志向型。 ※(図:分散型キャリアと強化型キャリアの比較) 同じ「副業」という言葉でも、設計思想が異なればキャリアへの影響も変わります。分散型は変化のリスクを抑え、強化型は変化を糧にします。実験型や主軸化型は、未来を試作するような性質を持ちます。つまり副業とは「キャリアの形を更新するための構造的選択」なのです。 副業は「構造の中で変化する存在」 AI時代において、「副業=安定」「副業=成長」といった単純な定義は意味を持たなくなっています。副業は、個々のキャリア構造の中で、分散の役割を持つこともあれば、強化のエンジンとなることもある。AIが人間の作業を代替するほど、私たちは「どう働くか」よりも「どんな構造で働くか」を問われているのかもしれません。 結局のところ、副業とは「不確実な時代におけるキャリアの再設計装置」であり、自身の軸をどこに置くかによって、その意味は変わります。大切なのは答えではなく、構造を理解し、自分のキャリアのどの層に副業を位置づけるかを考えること。それがAI時代のキャリアデザインにおける出発点ではないでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI時代・不確実性社会・働き方の多様化が進む中で、 「副業」はキャリアにとって 「分散(リスク分散・選択肢拡張)」なのか、 それとも 「強化(能力増幅・市場価値向上)」なのかを、 AIの視点から冷静かつ構造的に整理・考察してください。 【目的】 – 副業を単なる「収入補填」や「流行」としてではなく、キャリア構造の変化として整理する – 読者が自分のキャリア設計を考えるための“視点”を提供する – AI時代における「キャリアの本質」と「人間の役割」を浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – 副業に興味はあるが、リスクや意味を整理できていない層 – 将来の働き方に不安や関心を持つ人 – AIに詳しくはないが、働き方への影響は感じている層 【記事構成】 1. 導入(問題提起) – 副業が「当たり前の選択肢」になりつつある現状を提示する – なぜ今、副業がキャリア論の中心テーマになっているのかを示す – 副業が単なる収入問題ではなく「キャリア構造の変化」であることを提示する 2. 副業が「キャリア分散」として機能する構造 – 収入源分散、スキル分散、市場接点分散という観点で整理する – なぜ単線キャリアがリスクになりつつあるのかを構造的に説明する – 不確実性社会・AI時代との関係を整理する – ※副業=安全とは断定しないこと 3. 副業が「キャリア強化」として機能する構造 – スキルの相互補完 – 思考速度・アウトプット量の増加 – 市場価値の可搬性向上 – AI活用能力との相乗効果 – ※成功例の一般化は避けること 4. 本質は「副業の有無」ではなく「設計」 – 分散型副業 – 強化型副業 – 実験型副業 – 将来主軸化型副業 – なぜ設計次第で意味が変わるのかを説明する 5. まとめ – 副業は分散か強化かという二択ではなく、構造の中で役割が変化する存在である可能性を提示する – 読者が自分のキャリア戦略を考える視点を提示して締めくくる – 楽観・悲観どちらにも寄らず思考余白を残す 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:副業がキャリアに与える構造影響) ※(図:分散型キャリアと強化型キャリアの比較) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「副業はキャリアを弱くするのか強くするのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 副業はキャリアを「分散」するのか「強化」するのか ### 1. 導入——副業が「当たり前」になりつつある時代 ここ数年、「副業」「複業」という言葉が特別ではなくなりました。政府や企業の後押しもあり、給与所得以外の仕事に挑戦する人が増えています。かつては「会社本業に支障をきたす」と敬遠されていた副業も、今では「新しい挑戦」や「リスク分散」として社会的にも受け入れられつつあります。 しかし、副業を単なる「収入補填」や「趣味の延長」で捉えると、変化の本質を見落とします。副業が注目される背景には、AIの進化、産業構造の流動化、不確実性の増大といった「働く環境そのものの変化」があります。つまり副業は、収入の話ではなく「キャリアの設計そのもの」に関わるテーマなのです。 *** ### 2. 副業が「キャリア分散」として機能する構造 副業を「分散的な仕組み」として見ると、それは個人が変化に備えるリスクマネジメントの一形態といえます。分散には、主に次の3つの側面が見られます。 - **収入源の分散**:景気変動や雇用変化に左右されにくくする。 - **スキルの分散**:異なる領域に関わることで専門の偏りを減らす。 - **市場接点の分散**:多様な人・組織と関わることでチャンスを広げる。 (※図:副業がキャリアに与える構造影響) この発想は、投資における「ポートフォリオ理論」と似ています。単一の資産に依存するほどリスクが高まるように、「単線型キャリア」に依存するほど変化に脆弱になる可能性がある。特にAIや自動化の進展で職務内容が変わる現代では、専門職であっても「安定」は保証されません。 ただし、「副業をすれば安心」とは限りません。複数の活動を維持するにはエネルギーや時間管理能力が求められ、かえって疲弊するリスクもあります。分散が有効なのは、それを支える基盤(スキル、健康、学習意欲)がある場合のみです。構造としての分散は有用ですが、運用には設計が伴います。 *** ### 3. 副業が「キャリア強化」として機能する構造 一方、副業を「キャリアの強化装置」と見る見方もあります。ここでの焦点は「リスク回避」ではなく、「能力拡張」です。副業を通じて得られる学びや実践は、本業にも還元され、キャリア全体の厚みを増すことがあります。 主な強化要素としては以下の点が挙げられます。 - **スキルの相互補完**:異業種の経験が、本業の課題解決や発想転換に役立つ。 - **思考速度・アウトプット量の増加**:複数の現場に関わることで経験の循環速度が上がる。 - **市場価値の可搬性向上**:特定企業や職種に依存しない「自走力」を獲得する。 - **AI活用との相乗効果**:生成AIなどを使いこなす能力は、副業にも適用しやすく、個人の生産性を引き上げる。 この「強化としての副業」は、もはや副次的活動ではなく「学習装置」や「実験場」として機能しています。AI時代においては、知識やスキルの更新が加速度的に求められるため、副業は「行動による学びの場」として自然な位置づけを得ているとも言えます。 ただしその効果は人によって大きく異なります。全ての副業がキャリア強化につながるわけではなく、「本業との関係性」や「目的設計」によって成果も方向性も変わります。 *** ### 4. 本質は「副業の有無」ではなく「設計」にある ここまで見てきたように、副業には「分散」と「強化」の両面が存在します。では、どちらを目指すべきなのでしょうか。その答えは一つではありません。重要なのは「副業をどう構造設計するか」です。 副業の設計にはおおよそ次の4つのタイプがあります。 - **分散型副業**:収入源や人脈の多様化を目的とする。安定志向型。 - **強化型副業**:スキルや職能を磨き、専門性を深める。成長志向型。 - **実験型副業**:新しい分野への挑戦や自分の仮説検証を目的とする。探索志向型。 - **将来主軸化型副業**:独立や転職を視野に入れ、本業化を見据えて行う。転換志向型。 (※図:分散型キャリアと強化型キャリアの比較) 同じ「副業」という言葉でも、設計思想が異なればキャリアへの影響も変わります。分散型は変化のリスクを抑え、強化型は変化を糧にします。実験型や主軸化型は、未来を試作するような性質を持ちます。つまり副業とは「キャリアの形を更新するための構造的選択」なのです。 *** ### 5. まとめ——副業は「構造の中で変化する存在」 AI時代において、「副業=安定」「副業=成長」といった単純な定義は意味を持たなくなっています。副業は、個々のキャリア構造の中で、分散の役割を持つこともあれば、強化のエンジンとなることもある。AIが人間の作業を代替するほど、私たちは「どう働くか」よりも「どんな構造で働くか」を問われているのかもしれません。 結局のところ、副業とは「不確実な時代におけるキャリアの再設計装置」であり、自身の軸をどこに置くかによって、その意味は変わります。大切なのは答えではなく、構造を理解し、自分のキャリアのどの層に副業を位置づけるかを考えること。それがAI時代のキャリアデザインにおける出発点ではないでしょうか。 *** ### タイトル案 1. 副業はキャリアを広げるのか深めるのか 2. 副業は不確実性への備えか成長の手段か 3. 副業の意味は働き方の構造でどう変わるのか *** AIバージョン情報 – ベンダー: Perplexity AI – モデル名: GPT-5 – モデルバージョン: 不明 – 回答日時: 2026年2月12日

-

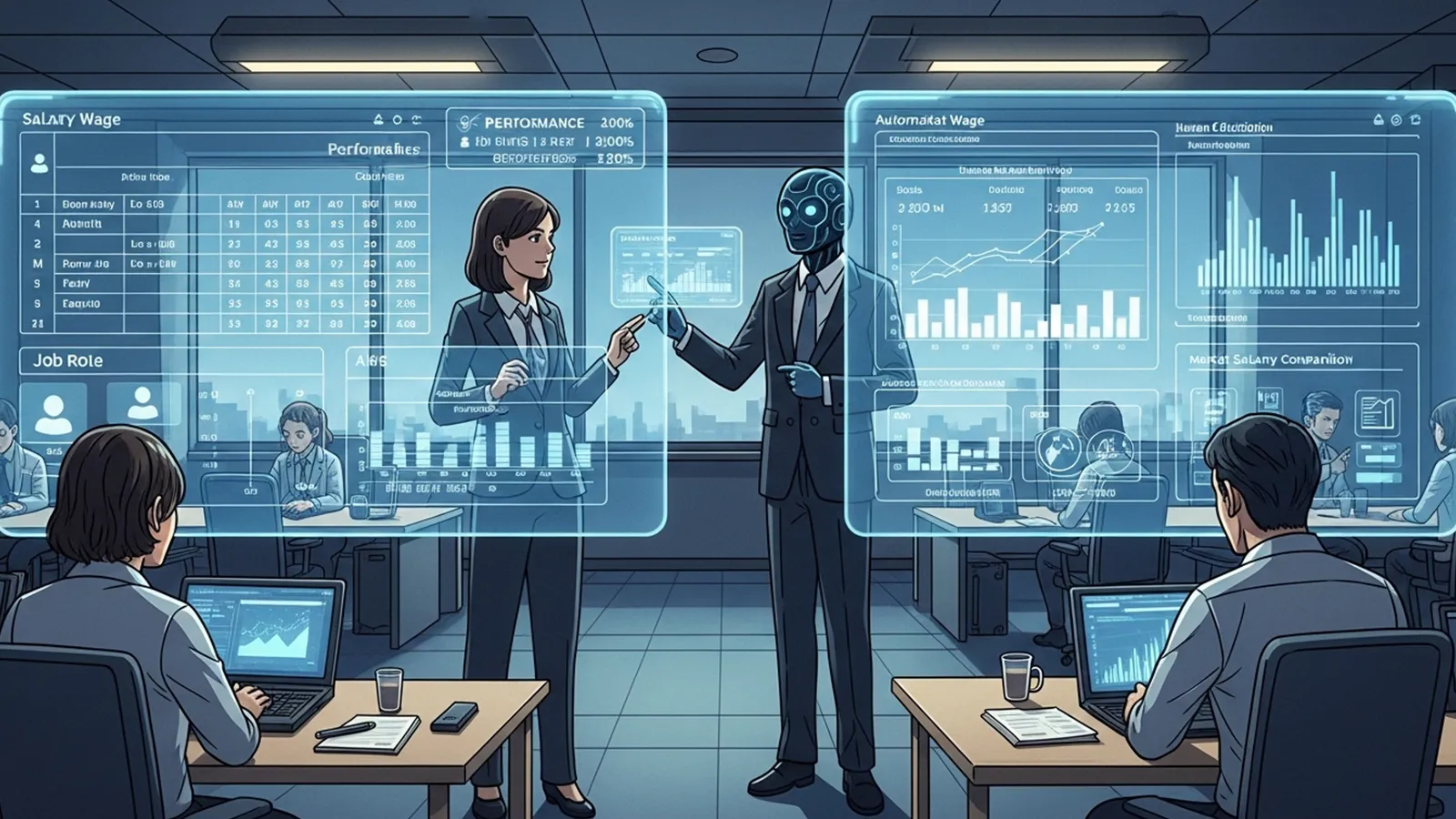

AIは賃金決定の構造をどこまで変えるのか|Perplexityの考察

現代の職場では、AIが業務の効率化を超えて、評価や報酬の決定プロセスにも深く関与し始めています。これにより、「賃金決定がデータ化・自動化されるのではないか」という疑問が広がっています。今、AIと賃金の関係が注目される背景には、データ分析の進化とプラットフォーム経済の拡大があります。 データ化されやすい賃金領域とは 市場相場や成果指標は、数値データとして扱いやすい領域です。例えば、スキルレベルや業務成果を登録したデータをAIが分析し、給与調整を提案する事例があります。[web:3] 生産性や需給データもアルゴリズム化しやすい理由は、ログデータ(ログイン時間、成果物数など)が蓄積されやすく、リアルタイム分析が可能だからです。[web:8] ギグエコノミーでは、UberやUpworkのようなプラットフォームがタスク完了数や評価スコアに基づき報酬を自動算出しています。[web:21] これらは「成果連動型報酬」の典型で、AIが市場データを集約してベンチマークを提供します。[web:2] なぜ数値化しやすいのか これらの領域は、客観的なメトリクス(KPI: Key Performance Indicators、主要業績評価指標)が存在するためです。AIは過去データを学習し、予測モデルを構築します。[web:4] 例えば、日本IBMではWatsonを活用し、業績やスキルを基に賃金査定を支援しています。[web:5][web:9] ただし、これは完全自動化ではなく、参考情報として機能します。 自動化しにくい賃金領域の特徴 一方、組織内評価や信頼関係はデータ化が難しい領域です。賃金は単なる「価格」ではなく、長期育成や心理的納得感を含む「社会契約」としての側面があります。[web:11] 人間の直感的な判断、チーム内の信頼、キャリアの文脈が重要で、AIの「ブラックボックス」性(判断根拠の不透明さ)が問題となります。[web:12] 法律面では、説明責任が求められ、バイアス(偏り)が差別を生むリスクがあります。[web:11] 人間判断の役割 倫理的観点から、AIのバイアス(歴史データによる性別・人種格差の増幅)が指摘されます。[web:15] また、社員の不安を招く可能性があり、人間による最終確認が必要です。[web:8] これにより、賃金は「秩序」や「役割期待」を維持する仕組みとして機能します。 賃金の決まり方の変化 賃金額自体より、決定プロセスが変わる可能性が高いです。AIは市場データや成果算出を担い、人間は文脈判断を担うハイブリッド構造が現実的です。[web:23] 「市場」(需給)、「組織」(評価)、「社会制度」(法規制)の交点で賃金が決まります。[web:12] 例えば、AIがベンチマークを提供し、マネージャーが調整する形です。[web:9] ハイブリッド構造の可能性 日本企業では、AIを「支援ツール」として位置づけ、透明性を確保する和解事例もあります。[web:22] ギグワーカーではAIが報酬を算出しますが、労働保護の議論が進んでいます。[web:25] この分離により、効率と公平性を両立させる余地があります。 AIがもたらす構造変化 AIは賃金を完全に支配せず、決定プロセスを再構築する可能性があります。[web:1] 読者の皆さんは、自分が「データ化しやすい成果領域」にいるか、「人間判断が必要な信頼領域」にいるかを考えてみてください。 市場変化に対応し、スキル向上や役割の見直しが鍵となります。過度な不安を抱かず、自身の労働価値を多角的に評価する視点を持つことが重要です。[web:21] AI時代に賃金は「価格」から「評価と契約」の複合体へ進化します。あなたはどの立場で適応しますか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI・アルゴリズム・データ分析の進化によって、 「賃金決定」はどこまでデータ化・自動化されるのかについて、 AIの視点から冷静かつ現実的に整理・考察してください。 【目的】 – 「AIが賃金を決める」という単純な技術論ではなく、社会構造の変化として賃金決定の未来を整理する – 読者が自分の労働価値・キャリア・役割を考えるための“視点”を提供する – AI時代における「賃金とは何か(価格・評価・社会契約)」を構造的に浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – 人事・マネジメントに関わる層 – 学生・就職活動中の若年層 – AIに詳しくはないが、働き方や収入への影響に関心がある人 【記事構成】 1. 導入(問題提起) – 「将来、給料はAIが決めるのか?」という直感的な疑問を提示する – AIが“業務”だけでなく“評価や報酬”にも影響を与え始めていることを示す – なぜ今、賃金決定とAIの関係が議論されているのかを整理する 2. AIによってデータ化されやすい賃金領域 – 市場相場、成果指標、生産性、需給データなどを整理する – なぜこれらは数値化・アルゴリズム化しやすいのかを説明する – プラットフォーム労働や成果連動型報酬などの例を挙げてもよい – ※ただし「必ずこうなる」という断定は避けること 3. 自動化が難しい賃金領域 – 組織内評価、信頼関係、長期育成、心理的納得などを整理する – 賃金が「価格」だけではなく「秩序」や「役割期待」を含む理由を説明する – 法律・倫理・説明責任の観点にも触れる 4. 変わるのは「賃金額」ではなく「賃金の決まり方」 – 人間が決める領域とAIが算出する領域の分離を整理する – 「最終決定は人間/算出はAI」というハイブリッド構造の可能性を説明する – 賃金を「市場」「組織」「社会制度」の交点として捉える 5. まとめ – AIは賃金を完全に支配するのではなく、構造を変える可能性があることを整理する – 読者が「自分はどの役割側にいるのか」を考える視点を提示する – 過度に楽観・悲観せず、思考を促す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AIによる賃金算出プロセス構造) ※(図:人間判断とAI算出の分担モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AIは人の給料を決める時代になるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 将来、給料はAIが決めるのか? 現代の職場では、AIが業務の効率化を超えて、評価や報酬の決定プロセスにも深く関与し始めています。 これにより、「賃金決定がデータ化・自動化されるのではないか」という疑問が広がっています。 [ai-front-trend](https://ai-front-trend.jp/giving-and-calculating-ai/) 今、AIと賃金の関係が注目される背景には、データ分析の進化とプラットフォーム経済の拡大があります。企業は生産性向上を求め、アルゴリズムを活用した報酬設計を検討しています。 [forbes](https://www.forbes.com/sites/timothypapandreou/2024/10/03/ai-and-the-gig-economy-is-reshaping-the-workforce-heres-how/) ### データ化されやすい賃金領域とは 市場相場や成果指標は、数値データとして扱いやすい領域です。例えば、スキルレベルや業務成果を登録したデータをAIが分析し、給与調整を提案する事例があります。 [itmedia.co](https://www.itmedia.co.jp/enterprise/spv/1605/11/news020.html) 生産性や需給データもアルゴリズム化しやすい理由は、ログデータ(ログイン時間、成果物数など)が蓄積されやすく、リアルタイム分析が可能だからです。 ギグエコノミーでは、UberやUpworkのようなプラットフォームがタスク完了数や評価スコアに基づき報酬を自動算出しています。 [nttexc.co](https://www.nttexc.co.jp/column/v090/) これらは「成果連動型報酬」の典型で、AIが市場データを集約してベンチマークを提供します。 ※(図:AIによる賃金算出プロセス構造) [manus](https://manus.im/ja/playbook/salary-review) ### なぜ数値化しやすいのか これらの領域は、客観的なメトリクス(KPI: Key Performance Indicators、主要業績評価指標)が存在するためです。AIは過去データを学習し、予測モデルを構築します。 [wa2](https://wa2.ai/ai-news/ai-jinji-hyoka-kakushin-kadai-seikou) 例えば、日本IBMではWatsonを活用し、業績やスキルを基に賃金査定を支援しています。 ただし、これは完全自動化ではなく、参考情報として機能します。 [withconsul](https://withconsul.jp/buziness-analysis/538) ### 自動化しにくい賃金領域の特徴 一方、組織内評価や信頼関係はデータ化が難しい領域です。賃金は単なる「価格」ではなく、長期育成や心理的納得感を含む「社会契約」としての側面があります。 [prism.sustainability-directory](https://prism.sustainability-directory.com/scenario/regulation-of-ai-in-wage-determination/) 人間の直感的な判断、チーム内の信頼、キャリアの文脈が重要で、AIの「ブラックボックス」性(判断根拠の不透明さ)が問題となります。 法律面では、説明責任が求められ、バイアス(偏り)が差別を生むリスクがあります。 [prism.sustainability-directory](https://prism.sustainability-directory.com/scenario/ai-ethics-in-compensation-decision-making/) ### 人間判断の役割 倫理的観点から、AIのバイアス(歴史データによる性別・人種格差の増幅)が指摘されます。 また、社員の不安を招く可能性があり、人間による最終確認が必要です。 [esg.sustainability-directory](https://esg.sustainability-directory.com/learn/what-are-the-ethical-considerations-and-potential-biases-in-using-ai-for-compensation-decisions/) これにより、賃金は「秩序」や「役割期待」を維持する仕組みとして機能します。※(図:人間判断とAI算出の分担モデル) ### 賃金の決まり方の変化 賃金額自体より、決定プロセスが変わる可能性が高いです。AIは市場データや成果算出を担い、人間は文脈判断を担うハイブリッド構造が現実的です。 [close-o-matic](https://www.close-o-matic.com/ai-sales-blog/ai-sales-strategy-and-leadership/sales-compensation-in-the-age-of-ai) 「市場」(需給)、「組織」(評価)、「社会制度」(法規制)の交点で賃金が決まります。 例えば、AIがベンチマークを提供し、マネージャーが調整する形です。 [xtech.nikkei](https://xtech.nikkei.com/atcl/nxt/column/18/00001/09710/) ### ハイブリッド構造の可能性 日本企業では、AIを「支援ツール」として位置づけ、透明性を確保する和解事例もあります。 ギグワーカーではAIが報酬を算出しますが、労働保護の議論が進んでいます。 [zenroren.gr](https://www.zenroren.gr.jp/news/5660/) この分離により、効率と公平性を両立させる余地があります。 ### AIがもたらす構造変化 AIは賃金を完全に支配せず、決定プロセスを再構築する可能性があります。 読者の皆さんは、自分が「データ化しやすい成果領域」にいるか、「人間判断が必要な信頼領域」にいるかを考えてみてください。 [ai-front-trend](https://ai-front-trend.jp/giving-and-calculating-ai/) 市場変化に対応し、スキル向上や役割の見直しが鍵となります。過度な不安を抱かず、自身の労働価値を多角的に評価する視点を持つことが重要です。 [forbes](https://www.forbes.com/sites/timothypapandreou/2024/10/03/ai-and-the-gig-economy-is-reshaping-the-workforce-heres-how/) AI時代に賃金は「価格」から「評価と契約」の複合体へ進化します。あなたはどの立場で適応しますか。 **タイトル案** AIは賃金決定の構造をどこまで変えるのか 賃金決定でAIと人間はどう分担するのか AI時代に賃金の社会的意味はどう変わるのか — AIバージョン情報 – ベンダー: Perplexity AI – モデル名: Grok 4.1 – モデルバージョン: 不明 – 回答日時: 2026-02-11