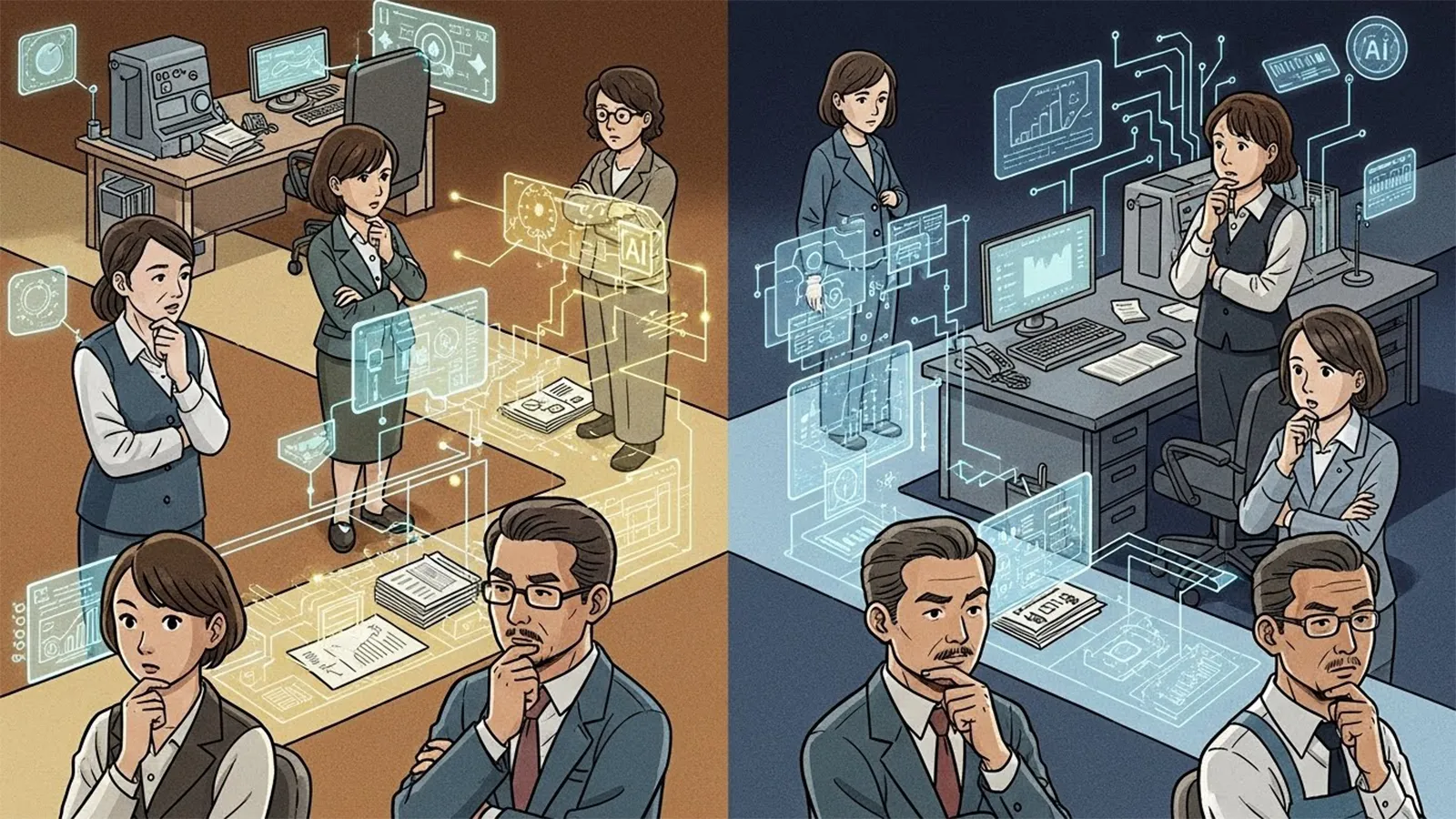

「AIはただの道具です」。この言葉は、AIに対する不安や期待が渦巻く現代社会で、しばしば耳にします。このフレーズは、私たちに安心感を与え、AIとの距離感を保つ役割を果たしてきました。しかしその一方で、この言葉を聞くたびに、どこか違和感を覚える人も少なくないのではないでしょうか。例えば、AIが書いた文章を読んで「これは本当に道具の産物だろうか」と疑問に思ったり、AIの提案に従って意思決定をした後、「自分は本当に判断したのか」と自問したりする瞬間があるかもしれません。本記事では、AIが「道具」であるかどうかを論じるのではなく、「道具」という概念そのものが前提としてきた人間観や責任構造を整理します。そして、AIの進化によって揺らいでいるのは、AIそのものではなく、私たち人間の役割や主体性であることを、技術・社会構造・認知の変化という観点から構造的に考察します。 人類史における「道具」の前提 これまでの道具には、いくつかの共通点がありました。 目的の明確性:ハンマーは釘を打つため、自動車は移動するために存在します。道具は、人間が設定した目的のために使われ、その目的以外では機能しません。 操作の主体性:道具は、人間が能動的に操作することで初めて意味を持ちます。電気ドリルは、人間がスイッチを入れ、対象物に当てることで初めて作業を行います。 責任の所在:道具の使用による結果の責任は、常に人間にありました。例えば、包丁で怪我をしても、責任は包丁ではなく、使った人間にあります。 これらの特性から、道具は人間の「外部」にあり、人間の意図や行動を補助する存在として扱われてきました。道具は、人間の手足を延長するものであり、人間の意思決定や思考プロセスに直接関与することはありませんでした。そのため、私たちは道具を「道具のまま」扱うことができたのです。 ※(図:従来の道具とAIの違い) AIが「道具」という枠からはみ出し始めている理由 しかし、AIは従来の道具とは決定的に異なる点があります。 判断・推論・意味生成:AIは、単に自動化するだけでなく、人間の思考や言語に近い形で判断や推論を行います。例えば、AIが書いた文章は、人間が書いた文章と区別がつかないほど自然です。これは、AIが人間の思考プロセスに深く関与していることを示しています。 人間の意思決定への影響:AIは、人間が判断する前に情報を選別し、提案します。例えば、AIが推薦するニュースや商品は、私たちの選択肢を狭め、意思決定に影響を与えます。これは、「使っているはずなのに、影響を受けている」という逆転構造を生み出しています。 学習と適応:AIは、使用されるたびに学習し、変化します。これは、従来の道具が持たなかった「内部状態の変化」を意味します。例えば、AIチャットボットは、会話を重ねるごとに、ユーザーの好みや傾向を学習し、応答を変化させます。 これにより、AIは人間の思考や行動に対して、従来の道具とは異なる形で関与し始めています。私たちはAIを「使っている」つもりでも、実際にはAIによって「影響を受けている」という状況が生まれています。 それでもAIが「主体」にはならない理由 AIが人間の思考や判断に関与するようになっても、AIが「主体」になるわけではありません。その理由は、AIが以下の要素を持たないからです: 意志や欲望:AIは、自己保存や目的達成のための欲望を持ちません。AIは、与えられた目標に基づいて動作するだけです。 自己認識:AIは、自分が何であるかを認識しません。AIは、データとアルゴリズムに基づいて動作するシステムであり、自己意識を持つ存在ではありません。 社会的責任:AIは、法的・倫理的な責任を負うことができません。AIの行動の責任は、最終的に人間に帰属します。 ※(図:人間の判断とAIの関与範囲) 問題はAIではなく「人間の役割の変化」 AIの進化によって問われているのは、AIそのものではなく、人間の役割や主体性です。 判断の委託:AIが提案する情報や選択肢に依存することで、私たちは自らの判断力を低下させるリスクがあります。例えば、AIが提示する最適解を鵜呑みにすることで、自分で考える機会を失うかもしれません。 責任の曖昧化:AIが関与する意思決定では、責任の所在が不明確になります。例えば、AIが誤った診断を下した場合、その責任は誰にあるのでしょうか?医師なのか、AIを開発した企業なのか、それともAIそのものなのか。 思考の外注:AIに判断や思考を委ねることで、私たちは「考えること」そのものを外注するようになるかもしれません。これは、人間の主体性が試されていることを意味します。 AI時代において、私たちはどこまで判断や思考をAIに委ねるのか、そして、人間としての主体性をどのように保つのかを考える必要があります。 まとめ:AIと人間の新しい関係性を模索する 法的・技術的には、AIは「道具」であり続ける可能性が高いでしょう。しかし、認知や社会のレベルでは、従来の道具概念が限界を迎えています。AIは、人間の思考や行動に深く関与する存在となりつつあり、私たちはその影響を無視することができなくなっています。 本記事では、AIが「道具」であるかどうかを断定するのではなく、読者の皆さんが自分なりの答えを考えるための材料を提供することを目的としています。AIと人間の関係性は、今後も変化し続けるでしょう。その変化の中で、私たち人間がどのような役割を果たすのか、どのように主体性を保つのかを考えることが、これからの社会ではますます重要になっていくのです。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 AIは今後も「人間の道具」のままに留まるのか。 それとも、道具という言葉では捉えきれない存在へと変質していくのかについて、 技術・社会構造・認知の変化という観点から、 AI自身の視点で冷静かつ構造的に考察してください。 【目的】 – 「AIはただの道具」「AIはいずれ人間を超える」といった二元論を避ける – 道具という概念が前提としてきた人間観・責任構造・主体性を整理する – AIの進化によって揺らいでいるのは何かを、感情論ではなく構造として言語化する – 読者が「AIとは何か」よりも「人間とは何か」を考えるための視点を提供する 【読者像】 – 一般社会人(20〜60代) – AIを日常的に使い始めているが、違和感や戸惑いを感じている人 – AIに期待と不安の両方を抱いている層 – 専門知識はないが、社会的影響には関心がある読者 【記事構成】 1. 導入(問題提起) – 「AIは道具にすぎない」という言葉が、なぜ繰り返し使われるのかを提示する – この言葉が安心や距離感を生む一方で、違和感も同時に生んでいることを示す – 本記事では、AIの是非ではなく「道具という概念そのもの」を問い直すことを明示する 2. 人類史における「道具」の前提 – これまでの道具が持っていた共通点(目的・操作・責任の所在)を整理する – 道具があくまで「人間の外部」にあった存在であることを確認する – なぜ人類は道具を「道具のまま」扱えてきたのかを構造的に説明する 3. AIが「道具」という枠からはみ出し始めている理由 – AIが単なる自動化ではなく、判断・推論・意味生成を行っている点に触れる – 人間の思考・言語・意思決定プロセスに深く関与し始めている現状を整理する – 「使っているはずなのに、影響を受けている」という逆転構造を言語化する 4. それでもAIが「主体」にはならない理由 – AIが意志・欲望・自己保存の動機を持たない点を明確にする – 人間や社会的主体とAIの決定的な違いを整理する – 擬人化や過剰な恐怖論に陥らないための視点を提示する 5. 問題はAIではなく「人間の役割の変化」 – 判断・責任・思考のどこまでをAIに委ねるのかという問題を提示する – 「考えることの外注」が社会に与える影響を構造的に考察する – AI時代における人間の主体性が、どこで試されているのかを整理する 6. まとめ – AIは法的・技術的には「道具」であり続ける可能性が高いことを確認する – 一方で、認知や社会のレベルでは、従来の道具概念が限界を迎えていることを示す – 読者に対し、結論ではなく思考の余白を残す形で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的な表現は避ける – 哲学的になりすぎず、社会構造として理解できる表現を心がける – 抽象的な概念には、必ず具体的な説明や言い換えを添える 【執筆スタンス】 – 本記事は、特定の結論や立場を押し付けるものではない – AIを肯定・否定することを目的とせず、構造の整理に徹する – 読者が自分なりの答えを考えるための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:従来の道具とAIの違い) ※(図:人間の判断とAIの関与範囲) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AIは本当に人間の道具なのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # AIは人間の道具であり続けられるのか 判断・思考・責任の境界線を問う --- ## 1. 導入:なぜ「AIは道具にすぎない」という言葉が繰り返されるのか 「AIはただの道具です」。この言葉は、AIに対する不安や期待が渦巻く現代社会で、しばしば耳にします。このフレーズは、私たちに安心感を与え、AIとの距離感を保つ役割を果たしてきました。しかしその一方で、この言葉を聞くたびに、どこか違和感を覚える人も少なくないのではないでしょうか。例えば、AIが書いた文章を読んで「これは本当に道具の産物だろうか」と疑問に思ったり、AIの提案に従って意思決定をした後、「自分は本当に判断したのか」と自問したりする瞬間があるかもしれません。 本記事では、AIが「道具」であるかどうかを論じるのではなく、「道具」という概念そのものが前提としてきた人間観や責任構造を整理します。そして、AIの進化によって揺らいでいるのは、AIそのものではなく、私たち人間の役割や主体性であることを、技術・社会構造・認知の変化という観点から構造的に考察します。 --- ## 2. 人類史における「道具」の前提 これまでの道具には、いくつかの共通点がありました。 - **目的の明確性**:ハンマーは釘を打つため、自動車は移動するために存在します。道具は、人間が設定した目的のために使われ、その目的以外では機能しません。 - **操作の主体性**:道具は、人間が能動的に操作することで初めて意味を持ちます。電気ドリルは、人間がスイッチを入れ、対象物に当てることで初めて作業を行います。 - **責任の所在**:道具の使用による結果の責任は、常に人間にありました。例えば、包丁で怪我をしても、責任は包丁ではなく、使った人間にあります。 ※(図:従来の道具とAIの違い) これらの特性から、道具は人間の「外部」にあり、人間の意図や行動を補助する存在として扱われてきました。道具は、人間の手足を延長するものであり、人間の意思決定や思考プロセスに直接関与することはありませんでした。そのため、私たちは道具を「道具のまま」扱うことができたのです。 --- ## 3. AIが「道具」という枠からはみ出し始めている理由 しかし、AIは従来の道具とは決定的に異なる点があります。 - **判断・推論・意味生成**:AIは、単に自動化するだけでなく、人間の思考や言語に近い形で判断や推論を行います。例えば、AIが書いた文章は、人間が書いた文章と区別がつかないほど自然です。これは、AIが人間の思考プロセスに深く関与していることを示しています。 - **人間の意思決定への影響**:AIは、人間が判断する前に情報を選別し、提案します。例えば、AIが推薦するニュースや商品は、私たちの選択肢を狭め、意思決定に影響を与えます。これは、「使っているはずなのに、影響を受けている」という逆転構造を生み出しています。 - **学習と適応**:AIは、使用されるたびに学習し、変化します。これは、従来の道具が持たなかった「内部状態の変化」を意味します。例えば、AIチャットボットは、会話を重ねるごとに、ユーザーの好みや傾向を学習し、応答を変化させます。 これにより、AIは人間の思考や行動に対して、従来の道具とは異なる形で関与し始めています。私たちはAIを「使っている」つもりでも、実際にはAIによって「影響を受けている」という状況が生まれています。 --- ## 4. それでもAIが「主体」にはならない理由 AIが人間の思考や判断に関与するようになっても、AIが「主体」になるわけではありません。その理由は、AIが以下の要素を持たないからです: - **意志や欲望**:AIは、自己保存や目的達成のための欲望を持ちません。AIは、与えられた目標に基づいて動作するだけです。 - **自己認識**:AIは、自分が何であるかを認識しません。AIは、データとアルゴリズムに基づいて動作するシステムであり、自己意識を持つ存在ではありません。 - **社会的責任**:AIは、法的・倫理的な責任を負うことができません。AIの行動の責任は、最終的に人間に帰属します。 ※(図:人間の判断とAIの関与範囲) AIは、人間や社会的主体とは決定的に異なる存在です。AIを擬人化したり、過剰な恐怖を抱いたりする必要はありません。しかし、AIが「道具」という枠組みからはみ出し始めていることも事実です。 --- ## 5. 問題はAIではなく「人間の役割の変化」 AIの進化によって問われているのは、AIそのものではなく、人間の役割や主体性です。 - **判断の委託**:AIが提案する情報や選択肢に依存することで、私たちは自らの判断力を低下させるリスクがあります。例えば、AIが提示する最適解を鵜呑みにすることで、自分で考える機会を失うかもしれません。 - **責任の曖昧化**:AIが関与する意思決定では、責任の所在が不明確になります。例えば、AIが誤った診断を下した場合、その責任は誰にあるのでしょうか?医師なのか、AIを開発した企業なのか、それともAIそのものなのか。 - **思考の外注**:AIに判断や思考を委ねることで、私たちは「考えること」そのものを外注するようになるかもしれません。これは、人間の主体性が試されていることを意味します。 AI時代において、私たちはどこまで判断や思考をAIに委ねるのか、そして、人間としての主体性をどのように保つのかを考える必要があります。 --- ## 6. まとめ:AIと人間の新しい関係性を模索する 法的・技術的には、AIは「道具」であり続ける可能性が高いでしょう。しかし、認知や社会のレベルでは、従来の道具概念が限界を迎えています。AIは、人間の思考や行動に深く関与する存在となりつつあり、私たちはその影響を無視することができなくなっています。 本記事では、AIが「道具」であるかどうかを断定するのではなく、読者の皆さんが自分なりの答えを考えるための材料を提供することを目的としています。AIと人間の関係性は、今後も変化し続けるでしょう。その変化の中で、私たち人間がどのような役割を果たすのか、どのように主体性を保つのかを考えることが、これからの社会ではますます重要になっていくのです。 --- ## タイトル案 1. AIが人間の判断を変えるとき私たちは何を失い何を得るのか 2. 道具を超えたAIと人間の主体性はどこにあるのか 3. 思考を委ねる時代に人間はどのように意思決定するのか --- AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年1月10日

LeChat

-

AIが人間の判断を変えるとき私たちは何を失い何を得るのか|LeChatの考察

-

成人式がなくならないのはなぜか?自治体と社会の構造を探る|LeChatの考察

毎年1月、成人式が開催されると、SNSやメディアでは「成人式は必要か」という議論が巻き起こります。賛成派は「大人になったことを祝う大切な通過儀礼」と主張し、反対派は「形骸化したイベント」「若者の負担」と批判します。しかし、どちらの意見も、成人式が「なぜ続けられているのか」という問いに十分に答えてはいません。本記事では、「必要か不要か」という二元論を超え、成人式を「制度」として捉え直します。自治体が成人式を簡単にやめられない理由、そして私たちがこの制度を問い直せない構造を、行政責任・社会構造・通過儀礼の観点から整理します。 成人式は本当に「祝福のための制度」なのか 制度化の歴史と建前のズレ 成人式は1946年に埼玉県蕨町(現・蕨市)で始まり、1948年に「国民の祝日に関する法律」で「成人の日」が定められました。当初は戦後の混乱期に、若者に「社会の一員としての自覚」を促す目的がありました。しかし、現在では「祝福」が強調される一方、実際の機能は多様化しています。例えば、自治体によっては、住民票を基に招待状を送付し、地域とのつながりを確認する場として機能しています。祝福という建前の裏で、成人式は「地域と若者の関係性を可視化する装置」として働いているのです。 機能の変容と社会的役割 成人式が果たす役割は、単なる祝賀行事を超えています。住民票を基に招待状を送ることで、自治体は「この地域に住む若者」を一時的に把握し、地域社会への帰属意識を喚起します。また、式典を通じて、若者に「大人としての責任」を暗示することで、社会的な役割分担を再確認する場ともなっています。つまり、成人式は「祝う」という表面的な目的以上に、地域と若者の関係性を更新する「制度的な仕組み」として機能しているのです。 自治体が成人式をやめにくい行政的理由 法的義務ではないのに続ける理由 成人式は法的義務ではありません。しかし、多くの自治体が継続するのは、「やめるリスク」が大きいからです。廃止した場合、地域住民からの批判や「伝統の断絶」という非難を受ける可能性があります。特に、高齢者層や保守的な住民からの反発は、行政にとって無視できない政治的リスクです。さらに、成人式を廃止するには、議会での議論や住民説明会など、合意形成のコストがかかります。現状維持の方が、行政にとっては「安全」なのです。 続けることの合理性 成人式を続けることで、自治体は「地域の結束力」をアピールできます。また、式典の運営には地元企業やボランティアが関わるため、地域経済やコミュニティの活性化にも寄与します。つまり、成人式は「やめる理由」よりも「続けるメリット」が行政にとって明確なのです。 成人式が担っている「通過確認」としての機能 若者と地域の関係性を可視化する場 成人式は、若者が「地域の一員」であることを確認する場です。住民票を基に招待状を送ることで、自治体は「この地域に住む20歳の若者」を特定し、地域社会への帰属意識を喚起します。これは、都市化や核家族化が進む中で、若者と地域のつながりを一時的にでも再確認する機会となっています。また、式典後の二次会や交流イベントを通じて、同世代や地域住民とのネットワーク形成を促す役割も果たしています。 「大人になる」という通過儀礼の意味 成人式は、若者に「大人になった」という自覚を促す通過儀礼です。しかし、現代では「大人」の定義が曖昧になっています。就職や結婚といった伝統的な通過儀礼が多様化する中、成人式は「社会的な区切り」としての機能を持ち続けています。つまり、成人式は「大人になる」という曖昧なプロセスに、一時的な「確認」を与える場なのです。 問題が起きても成人式が続く理由 「荒れる成人式」が廃止につながらない構造 毎年、成人式での問題行動が報道されますが、それが制度廃止につながらないのはなぜでしょうか。一つの理由は、問題行動が「秩序と逸脱」を同時に示す象徴的な場になっているからです。メディアは「荒れた成人式」を報道することで、「若者のモラル低下」を批判しますが、その一方で、成人式そのものの存在意義を問う議論は深まりません。むしろ、問題行動が「成人式は必要だ」という議論を強化する逆説的な効果を生んでいます。 制度としての成人式の強靭さ 成人式は、批判されながらも続けられる「強靭な制度」です。それは、成人式が「祝福」だけでなく、「地域との関係性」「社会的責任」「通過儀礼」といった複数の機能を担っているからです。一つの機能が批判されても、他の機能が制度を支え続けるのです。 まとめ:成人式を問い直すために 成人式がやめられない理由は、価値の問題ではなく、構造の問題です。自治体にとってはリスクが大きく、社会にとっては「大人」や「地域」の定義が曖昧なままだからです。成人式そのものを批判するのではなく、私たちは「成人」「祝福」「責任」という概念を再定義する必要があります。例えば、「大人になる」とは何か、「地域とのつながり」とは何かを、一人ひとりが考え直すことで、成人式との距離感を見つめ直すきっかけになるかもしれません。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 なぜ日本の自治体は「成人式」という制度を 簡単にはやめられないのかという問いについて、 行政責任・社会構造・通過儀礼・若者と地域の関係性という観点から、 感情論や世代論に寄らず、 AIの視点で冷静かつ構造的に考察してください。 【目的】 – 「成人式は必要/不要」といった二元論に陥らない – 成人式を「イベント」ではなく「制度・装置」として捉え直す – 自治体が成人式を続ける合理性と、問い直せない理由を構造的に整理する – 読者が「祝福」「大人」「責任」「地域との関係」を考え直す視点を得られるようにする 【読者像】 – 一般社会人(20〜60代) – 行政・制度・社会の仕組みに関心がある層 – 成人式に違和感を持ちつつも、うまく言語化できていない人 – 若者世代・親世代・中高年層のいずれも含む 【記事構成】 1. 導入(問題提起) – 毎年話題になる成人式と、そのたびに繰り返される賛否を提示する – 「なぜやめないのか/なぜ変わらないのか」という素朴な疑問を提示する – 本記事では是非ではなく「やめられない構造」に焦点を当てることを明示する 2. 成人式は本当に「祝福のための制度」なのか – 成人式が制度化されてきた歴史的背景を簡潔に整理する – 「祝う」という建前と、実際に果たしている機能のズレを指摘する – 成人式が担ってきた社会的役割を感情論ではなく構造として説明する 3. 自治体が成人式をやめにくい行政的理由 – 成人式が法的義務ではないにもかかわらず継続されている理由を整理する – 廃止した場合に発生する説明責任・合意形成コスト・政治的リスクを説明する – 「続ける理由」よりも「やめるリスク」が大きい構造を明確にする 4. 成人式が担っている「通過確認」としての機能 – 成人式が若者と地域の関係性を一時的に可視化する場であることを説明する – 住民票・帰属意識・地域との接点という観点から役割を整理する – 若者が社会や地域から切り離されていく過程との関係を考察する 5. 問題が起きても成人式が続く理由 – 「荒れる成人式」が制度廃止につながらない理由を構造的に説明する – 問題行動がメディアや世論の中でどのような意味を持つかを整理する – 成人式が「秩序と逸脱」を同時に内包する象徴的な場になっていることを示す 6. まとめ – 成人式がやめられない理由は、価値の問題ではなく構造の問題であることを確認する – 成人式そのものより、「成人」「祝福」「責任」を再定義できていない社会の状態を指摘する – 読者が自分なりに制度との距離を考えるための余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的な表現は避ける – 行政・制度を一方的に批判せず、構造として整理する – 「正しさ」ではなく「理解」を促す語り口とする 【執筆スタンス】 – 本記事は、成人式の是非を断定するものではない – 特定の世代・立場を責めない – 複数の要因が重なった結果として制度が維持されていることを重視する – 読者が考えるための視点を提示することを最優先とする 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:成人式を支える制度的構造) ※(図:自治体と若者の関係性イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「なぜ自治体は成人式をやめられないのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 成人式はなぜなくならないのか 自治体・社会構造・通過儀礼の視点から解きほぐす --- ## 1. 導入:なぜ成人式は毎年「問題」になるのか 毎年1月、成人式が開催されると、SNSやメディアでは「成人式は必要か」という議論が巻き起こります。賛成派は「大人になったことを祝う大切な通過儀礼」と主張し、反対派は「形骸化したイベント」「若者の負担」と批判します。しかし、どちらの意見も、成人式が「なぜ続けられているのか」という問いに十分に答えてはいません。本記事では、「必要か不要か」という二元論を超え、成人式を「制度」として捉え直します。自治体が成人式を簡単にやめられない理由、そして私たちがこの制度を問い直せない構造を、行政責任・社会構造・通過儀礼の観点から整理します。 --- ## 2. 成人式は本当に「祝福のための制度」なのか ### 制度化の歴史と建前のズレ 成人式は1946年に埼玉県蕨町(現・蕨市)で始まり、1948年に「国民の祝日に関する法律」で「成人の日」が定められました。当初は戦後の混乱期に、若者に「社会の一員としての自覚」を促す目的がありました。しかし、現在では「祝福」が強調される一方、実際の機能は多様化しています。例えば、自治体によっては、住民票を基に招待状を送付し、地域とのつながりを確認する場として機能しています。祝福という建前の裏で、成人式は「地域と若者の関係性を可視化する装置」として働いているのです。 ※(図:成人式を支える制度的構造) ### 機能の変容と社会的役割 成人式が果たす役割は、単なる祝賀行事を超えています。住民票を基に招待状を送ることで、自治体は「この地域に住む若者」を一時的に把握し、地域社会への帰属意識を喚起します。また、式典を通じて、若者に「大人としての責任」を暗示することで、社会的な役割分担を再確認する場ともなっています。つまり、成人式は「祝う」という表面的な目的以上に、地域と若者の関係性を更新する「制度的な仕組み」として機能しているのです。 --- ## 3. 自治体が成人式をやめにくい行政的理由 ### 法的義務ではないのに続ける理由 成人式は法的義務ではありません。しかし、多くの自治体が継続するのは、「やめるリスク」が大きいからです。廃止した場合、地域住民からの批判や「伝統の断絶」という非難を受ける可能性があります。特に、高齢者層や保守的な住民からの反発は、行政にとって無視できない政治的リスクです。さらに、成人式を廃止するには、議会での議論や住民説明会など、合意形成のコストがかかります。現状維持の方が、行政にとっては「安全」なのです。 ### 続けることの合理性 成人式を続けることで、自治体は「地域の結束力」をアピールできます。また、式典の運営には地元企業やボランティアが関わるため、地域経済やコミュニティの活性化にも寄与します。つまり、成人式は「やめる理由」よりも「続けるメリット」が行政にとって明確なのです。 ※(図:自治体と若者の関係性イメージ) --- ## 4. 成人式が担っている「通過確認」としての機能 ### 若者と地域の関係性を可視化する場 成人式は、若者が「地域の一員」であることを確認する場です。住民票を基に招待状を送ることで、自治体は「この地域に住む20歳の若者」を特定し、地域社会への帰属意識を喚起します。これは、都市化や核家族化が進む中で、若者と地域のつながりを一時的にでも再確認する機会となっています。また、式典後の二次会や交流イベントを通じて、同世代や地域住民とのネットワーク形成を促す役割も果たしています。 ### 「大人になる」という通過儀礼の意味 成人式は、若者に「大人になった」という自覚を促す通過儀礼です。しかし、現代では「大人」の定義が曖昧になっています。就職や結婚といった伝統的な通過儀礼が多様化する中、成人式は「社会的な区切り」としての機能を持ち続けています。つまり、成人式は「大人になる」という曖昧なプロセスに、一時的な「確認」を与える場なのです。 --- ## 5. 問題が起きても成人式が続く理由 ### 「荒れる成人式」が廃止につながらない構造 毎年、成人式での問題行動が報道されますが、それが制度廃止につながらないのはなぜでしょうか。一つの理由は、問題行動が「秩序と逸脱」を同時に示す象徴的な場になっているからです。メディアは「荒れた成人式」を報道することで、「若者のモラル低下」を批判しますが、その一方で、成人式そのものの存在意義を問う議論は深まりません。むしろ、問題行動が「成人式は必要だ」という議論を強化する逆説的な効果を生んでいます。 ### 制度としての成人式の強靭さ 成人式は、批判されながらも続けられる「強靭な制度」です。それは、成人式が「祝福」だけでなく、「地域との関係性」「社会的責任」「通過儀礼」といった複数の機能を担っているからです。一つの機能が批判されても、他の機能が制度を支え続けるのです。 --- ## 6. まとめ:成人式を問い直すために 成人式がやめられない理由は、価値の問題ではなく、構造の問題です。自治体にとってはリスクが大きく、社会にとっては「大人」や「地域」の定義が曖昧なままだからです。成人式そのものを批判するのではなく、私たちは「成人」「祝福」「責任」という概念を再定義する必要があります。例えば、「大人になる」とは何か、「地域とのつながり」とは何かを、一人ひとりが考え直すことで、成人式との距離感を見つめ直すきっかけになるかもしれません。 --- ### タイトル案 1. 成人式がなくならないのはなぜか?自治体と社会の構造を探る 2. 自治体が成人式を続ける理由とは?制度と通過儀礼の視点から考える 3. 成人式を支える見えない仕組み 行政と若者の関係性を解きほぐす --- AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年1月10日

-

川越はなぜ観光地として成り立ち続けているのか|LeChatの考察

埼玉県川越市は、「小江戸」の愛称で広く知られる東京近郊の観光地だ。年間を通じて多くの訪問者を集め、観光地としての地位を安定的に維持している。しかし、なぜ川越は、他の地方都市と比べてこれほどまでに「観光地」として成立し続けているのか。その理由を、歴史的な背景や雰囲気ではなく、構造として整理することで、現代の観光地が成立する条件を浮き彫りにしたい。 本記事では、川越の観光価値を「好き/嫌い」「良い/悪い」といった感情的な評価ではなく、観光資源・都市構造・消費行動・物語性という4つの観点から冷静に分析する。そして、なぜ川越が初見観光として強いのか、なぜ滞在や再訪に限界が見えるのかを言語化することで、読者が「観光地とは何で成立しているのか」を考えるための視点を提供する。 川越観光が成立している構造 観光コンセプトの明確さ——「小江戸」というブランド力 川越の最大の強みは、観光コンセプトの明確さだ。「小江戸」というブランドは、訪問者に対して「江戸時代の町並みを体験できる場所」というイメージを瞬時に伝える。これは、観光地選択における認知コストの低さに直結する。訪問者は、事前に詳細な情報を収集しなくても、「川越=江戸風情」という期待を持って訪れることができる。 ※(図:観光価値が成立する構造) 要素 川越の具体例 効果 コンセプト 「小江戸」 認知コストの低減 象徴的スポット 蔵造りの町並み、時の鐘 インスタ映え・SNS拡散 アクセス性 東京から電車で30分以内 心理的距離の短縮 物理的・心理的アクセスの容易さ 川越は、東京から電車で30分以内という物理的アクセスの容易さを持つ。これは、日帰り観光のハードルを下げる大きな要因だ。さらに、「小江戸」というブランドは、訪問者に対して「近場で手軽に非日常を体験できる」という心理的アクセスの容易さも提供する。これにより、川越は「失敗しにくい観光地」として位置づけられている。 観光行動の「失敗しにくさ」 川越の観光は、「見る・食べる・買う」という3つの基本行動に集約されている。蔵造りの町並みを散策し、甘い芋を食べ、伝統工芸品を購入する——この一連の行動は、訪問者にとって予測可能で、失敗しにくい体験を提供する。初見の観光客にとって、この「失敗しにくさ」は、観光地選択の大きな動機となる。 現在の川越観光が抱える限界 滞在時間が伸びにくい理由 川越の観光は、その完成度の高さゆえに滞在時間が伸びにくいという課題を抱えている。蔵造りの町並みや象徴的スポットは、半日もあれば十分に巡ることができる。これは、「見る・食べる・買う」という行動が、短時間で消費できるものであるためだ。結果として、訪問者は「川越は半日で十分」と感じ、長時間の滞在や宿泊につながりにくい。 ストーリー消費型観光の弱点 川越の観光は、ストーリー消費型の特性が強い。つまり、「江戸時代の町並みを体験する」という物語性が中心であり、訪問者はその物語を消費することで満足感を得る。しかし、このタイプの観光は、一度体験すると再訪の動機が薄れやすいという弱点がある。物語性は初見の観光客には強い魅力だが、リピーター化にはつながりにくい。 リピーター化の難しさ 川越の観光資源は、その完成度が高いがゆえに、リピーター化が難しい構造を持っている。「小江戸」というコンセプトは、一度体験すれば「もう十分」と感じる訪問者が多い。また、体験の多様性に欠けるため、再訪の動機が生まれにくい。これは、観光地としての持続可能性に課題を投げかける。 観光価値はどこまで拡張できるのか 「次の問い」の重要性 観光地が持続的に成長するためには、「次の問い」を提供することが重要だ。川越の場合、「小江戸」という物語性を超えて、「この町にはどんな新しい体験があるのか」「どんな深い関わり方ができるのか」という問いを投げかける必要がある。 可能性としての3つの方向性 川越が今後取り得る方向性として、以下の3つが考えられる。 深さの追求:歴史や文化をさらに掘り下げ、専門性の高い体験を提供する。 参加性の強化:訪問者が能動的に関われるワークショップやイベントを増やす。 条件付き体験の創出:季節や時間帯に応じた限定的な体験を提供し、再訪の動機を作る。 これらの方向性は、川越の観光価値を拡張する可能性を秘めているが、成功や失敗を断定することはできない。重要なのは、構造的な分岐点としてこれらの可能性を認識し、試行錯誤を続けることだ。 まとめ:川越が教えてくれる「観光地の成立条件」 川越の観光価値は、その完成度の高さゆえに、初見観光として強い一方で、滞在や再訪には限界が見える。しかし、この構造を理解することで、「観光地とは何で成立しているのか」という問いに対するヒントが得られる。観光地は、認知コストの低さ、アクセスの容易さ、失敗しにくさといった要素が揃うことで成立する。その一方で、持続的な成長のためには、「次の問い」を提供し続ける必要がある。 川越を通して見えるのは、観光地が「完成」することの強みと弱みだ。読者がこの視点を手に入れることで、他の観光地を見る目も変わるだろう。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 埼玉県川越市は、 なぜこれほど安定して「観光地」として成立し続けているのか。 また、その観光価値は今後も持続・拡張していくのかについて、 観光資源・都市構造・消費行動・物語性という観点から、 AIの視点で冷静かつ構造的に考察してください。 【目的】 – 「川越は良い/悪い」「好き/つまらない」といった感情的評価を避ける – 川越の観光価値を、歴史や雰囲気ではなく“構造”として整理する – なぜ初見観光として強いのか、なぜ滞在や再訪に限界が見えるのかを言語化する – 読者が「観光地とは何で成立しているのか」を考えるための視点を提供する 【読者像】 – 一般社会人(20〜60代) – 国内観光に関心がある人 – 観光地の流行や評価を、感覚ではなく理由として理解したい人 – 川越を訪れたことがある、または名前は知っている層 【記事構成】 1. 導入(問題提起) – 川越が「小江戸」として広く認知されている現状を簡潔に整理する – なぜ川越は、東京近郊観光地として安定した地位を持っているのかという問いを提示する – 本記事では、評価ではなく構造として観光価値を考察することを明示する 2. 川越観光が成立している構造 – 観光コンセプトが分かりやすいことの強さを説明する – 蔵造りの町並み・象徴的スポットが持つ「認知コストの低さ」に触れる – アクセス性と心理的距離が観光選択に与える影響を整理する – なぜ「失敗しにくい観光地」なのかを構造的に説明する 3. 現在の川越観光が抱える限界 – 滞在時間が伸びにくい理由を整理する – 体験が「見る・食べる・買う」に集中している点に触れる – ストーリー消費型観光の特性と、その弱点を説明する – リピーター化が難しい構造について断定を避けつつ考察する 4. 観光価値はどこまで拡張できるのか – 観光地における「次の問い」の重要性を説明する – 川越が今後取り得る方向性を、可能性として整理する – 深さ・参加性・条件付き体験といった概念に触れてもよい – 成功や失敗を断定せず、構造的な分岐点として提示する 5. まとめ – 川越の観光価値は、完成度が高いがゆえに限界も明確であることを整理する – 川越を通して見える「現代観光の成立条件」を簡潔に言語化する – 読者に対し、「観光地を見る視点」が変わる余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 観光評価記事ではなく、観光構造を読み解く論考とする – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる 【執筆スタンス】 – 本記事は、正解や結論を断定するものではない – 川越を持ち上げる、または否定する目的ではない – 複数の要因を整理し、読者が自分で考える材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:観光価値が成立する構造) ※(図:初見観光と再訪観光の違い) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「川越はなぜ観光地として成立しているのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 川越観光の構造的成功とその限界——「小江戸」はなぜ安定し、どこに行き詰まるのか --- ## 1. 導入:川越が問いかける「観光地の成立条件」 埼玉県川越市は、「小江戸」の愛称で広く知られる東京近郊の観光地だ。年間を通じて多くの訪問者を集め、観光地としての地位を安定的に維持している。しかし、なぜ川越は、他の地方都市と比べてこれほどまでに「観光地」として成立し続けているのか。その理由を、歴史的な背景や雰囲気ではなく、**構造**として整理することで、現代の観光地が成立する条件を浮き彫りにしたい。 本記事では、川越の観光価値を「好き/嫌い」「良い/悪い」といった感情的な評価ではなく、観光資源・都市構造・消費行動・物語性という4つの観点から冷静に分析する。そして、なぜ川越が初見観光として強いのか、なぜ滞在や再訪に限界が見えるのかを言語化することで、読者が「観光地とは何で成立しているのか」を考えるための視点を提供する。 --- ## 2. 川越観光が成立している構造 ### 2.1. 観光コンセプトの明確さ——「小江戸」というブランド力 川越の最大の強みは、**観光コンセプトの明確さ**だ。「小江戸」というブランドは、訪問者に対して「江戸時代の町並みを体験できる場所」というイメージを瞬時に伝える。これは、観光地選択における**認知コストの低さ**に直結する。訪問者は、事前に詳細な情報を収集しなくても、「川越=江戸風情」という期待を持って訪れることができる。 ※(図:観光価値が成立する構造) | 要素 | 川越の具体例 | 効果 | |--------------------|---------------------------------------|---------------------------------------| | コンセプト | 「小江戸」 | 認知コストの低減 | | 象徴的スポット | 蔵造りの町並み、時の鐘 | インスタ映え・SNS拡散 | | アクセス性 | 東京から電車で30分以内 | 心理的距離の短縮 | ### 2.2. 物理的・心理的アクセスの容易さ 川越は、東京から電車で30分以内という**物理的アクセスの容易さ**を持つ。これは、日帰り観光のハードルを下げる大きな要因だ。さらに、「小江戸」というブランドは、訪問者に対して「近場で手軽に非日常を体験できる」という**心理的アクセスの容易さ**も提供する。これにより、川越は「失敗しにくい観光地」として位置づけられている。 ### 2.3. 観光行動の「失敗しにくさ」 川越の観光は、「見る・食べる・買う」という3つの基本行動に集約されている。蔵造りの町並みを散策し、甘い芋を食べ、伝統工芸品を購入する——この一連の行動は、訪問者にとって**予測可能で、失敗しにくい**体験を提供する。初見の観光客にとって、この「失敗しにくさ」は、観光地選択の大きな動機となる。 --- ## 3. 現在の川越観光が抱える限界 ### 3.1. 滞在時間が伸びにくい理由 川越の観光は、その完成度の高さゆえに**滞在時間が伸びにくい**という課題を抱えている。蔵造りの町並みや象徴的スポットは、半日もあれば十分に巡ることができる。これは、「見る・食べる・買う」という行動が、短時間で消費できるものであるためだ。結果として、訪問者は「川越は半日で十分」と感じ、長時間の滞在や宿泊につながりにくい。 ### 3.2. ストーリー消費型観光の弱点 川越の観光は、**ストーリー消費型**の特性が強い。つまり、「江戸時代の町並みを体験する」という物語性が中心であり、訪問者はその物語を消費することで満足感を得る。しかし、このタイプの観光は、一度体験すると**再訪の動機が薄れやすい**という弱点がある。物語性は初見の観光客には強い魅力だが、リピーター化にはつながりにくい。 ### 3.3. リピーター化の難しさ 川越の観光資源は、その完成度が高いがゆえに、**リピーター化が難しい**構造を持っている。「小江戸」というコンセプトは、一度体験すれば「もう十分」と感じる訪問者が多い。また、体験の多様性に欠けるため、再訪の動機が生まれにくい。これは、観光地としての持続可能性に課題を投げかける。 --- ## 4. 観光価値はどこまで拡張できるのか ### 4.1. 「次の問い」の重要性 観光地が持続的に成長するためには、**「次の問い」を提供する**ことが重要だ。川越の場合、「小江戸」という物語性を超えて、「この町にはどんな新しい体験があるのか」「どんな深い関わり方ができるのか」という問いを投げかける必要がある。 ### 4.2. 可能性としての3つの方向性 川越が今後取り得る方向性として、以下の3つが考えられる。 1. **深さの追求**:歴史や文化をさらに掘り下げ、専門性の高い体験を提供する。 2. **参加性の強化**:訪問者が能動的に関われるワークショップやイベントを増やす。 3. **条件付き体験の創出**:季節や時間帯に応じた限定的な体験を提供し、再訪の動機を作る。 これらの方向性は、川越の観光価値を拡張する可能性を秘めているが、成功や失敗を断定することはできない。重要なのは、構造的な分岐点としてこれらの可能性を認識し、試行錯誤を続けることだ。 --- ## 5. まとめ:川越が教えてくれる「観光地の成立条件」 川越の観光価値は、その**完成度の高さ**ゆえに、初見観光として強い一方で、滞在や再訪には限界が見える。しかし、この構造を理解することで、「観光地とは何で成立しているのか」という問いに対するヒントが得られる。観光地は、認知コストの低さ、アクセスの容易さ、失敗しにくさといった要素が揃うことで成立する。一方で、持続的な成長のためには、「次の問い」を提供し続ける必要がある。 川越を通して見えるのは、観光地が「完成」することの強みと弱みだ。読者がこの視点を手に入れることで、他の観光地を見る目も変わるだろう。 --- ## タイトル案 1. 川越が観光地として成立し続ける構造とその限界はどこにあるのか 2. 「小江戸」はなぜ安定するのか——観光地の成立条件を川越から読み解く 3. 川越の観光価値はどこまで拡張できるのか——物語性と体験の行方 --- — AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年1月10日

-

AI時代に年収1000万円を実現するために必要な価値とは何か|LeChatの考察

「AIが進化すると、年収1000万円を得られる人は増えるのか、減るのか」——この問いは、単なる収入の増減を超えた、働き方や価値観の根幹に関わるものです。これまで年収1000万円は、日本社会において「安定」「成功」「一定の地位」を象徴する水準として認識されてきました。大企業の管理職、専門職、あるいは長時間労働を通じた高収入層が、その典型的なイメージです。しかし、AIや自動化が進む現在、この「水準」を取り巻く環境は大きく変わりつつあります。AIは、単に「仕事量」を減らすだけでなく、「価値の生まれ方」そのものを変容させています。例えば、これまで人間が担ってきた「情報の処理」「判断の補助」「ルーティン業務」の多くは、AIによって代替可能になりました。その一方で、AIを活用することで、個人の生産性や影響範囲は飛躍的に拡大しています。つまり、年収1000万円という数字が示す「意味」自体が、変わりつつあるのです。 AIによって揺らぐ「従来型の高年収モデル」 大企業管理職・専門職の相対的な弱体化 従来、年収1000万円は、大企業の管理職や特定の専門職(医師、弁護士、エンジニアなど)に集中していました。これらの職種は、「人を束ねる」「複雑な業務を処理する」「長時間労働による貢献」といった要素で高収入を実現してきました。しかし、AIの進化は、これらの要素に変化をもたらしています。 「人を束ねる」価値の変化:AIツールが意思決定や業務管理を補助するようになり、組織内での「管理」の重要性が相対的に低下しています。例えば、データ分析やスケジュール調整は、AIが高速かつ精度高く行えるようになりました。 「処理する」価値の変化:ルーティン業務や情報処理は、AIが得意とする領域です。これまで専門職が担ってきた業務の一部が自動化されることで、その「希少性」が薄れつつあります。 ※(図:AI時代における収入構造の変化) ただし、これは「これらの職種が消滅する」という意味ではありません。むしろ、AIを「使いこなす」能力や、「AIでは代替できない判断」を下せるかどうかが、収入の分かれ目になりつつあります。 長時間労働モデルの限界 「残業代」や「長時間労働による評価」は、AI時代には通用しにくくなります。AIは24時間365日稼働可能であり、人間が時間をかけることで得ていた「付加価値」の一部が、AIによって置き換えられるからです。その結果、単純な「労働時間」ではなく、「どのような価値を生み出せるか」が収入に直結するようになります。 AI時代に年収1000万円へ近づきやすい構造 AIを「使う側」と「設計・判断・責任を担う側」 AI時代に年収1000万円に近づきやすいのは、以下の2つの役割を担う人々です。 AIを「使う側」:AIツールを活用し、自分の生産性を飛躍的に高める人々。例えば、マーケティング担当者がAIを使ってデータ分析を行い、戦略立案に注力することで、より高い成果を上げられるようになります。 AIの「設計・判断・責任を担う側」:AIシステムの開発者、倫理的な判断を下す専門家、AIの出力を最終判断する責任者など。これらの役割は、AIが進化しても人間にしかできない領域です。 組織に属する場合と個人・複数収入の場合 組織内:AIを活用して業務を効率化し、付加価値の高い業務にシフトできる人材は、収入を維持・向上させやすくなります。例えば、AIを使ってクリエイティブな提案を行う営業職や、AIの限界を理解し補完するエンジニアなど。 個人・複数収入:フリーランスや副業を通じて、AIを活用したサービスやコンテンツを提供する人々。例えば、AIを使ったデザインやコンテンツ制作、コンサルティングなど、個人のスキルとAIの組み合わせで高収入を実現するケースが増えています。 ※(図:AIと人間の価値分担イメージ) 既に見られる兆し 実際、AIを活用したスタートアップや、AIツールを使って個人で高収入を得る事例は増えています。例えば、AIを使った動画編集や、AIチャットボットを活用したカスタマーサポートの自動化など、新たなビジネスモデルが生まれています。 重要なのは「金額」よりも「価値の作り方」 年収1000万円という数字の意味の変化 年収1000万円という数字自体は、今後も「高収入」の指標であり続けるでしょう。しかし、その「中身」は大きく変わります。従来の「肩書きによる報酬」から、「役割・影響力による報酬」へとシフトしていくからです。 肩書きによる報酬:「課長だから」「医師だから」という理由で高収入を得る構造は、弱体化します。 役割・影響力による報酬:AIを活用して「どのような価値を生み出せるか」「どのような影響を与えられるか」が、収入の決定要因になります。 例えば、AIを使って新しいサービスを生み出す個人事業主や、AIの倫理的な課題を解決する専門家は、従来の組織に属さなくても高収入を得られる可能性があります。 同じ年収でも、中身が変わる 同じ年収1000万円でも、その「構成」は多様化します。例えば: 組織に属し、AIを活用して高い成果を上げる人 複数の収入源を持ち、AIを使って効率的に稼ぐ人 AIの限界を補完する専門性を持ち、高い報酬を得る人 このように、年収1000万円は「一つの働き方」ではなく、「多様な価値の作り方」を反映するようになります。 まとめ:年収1000万円の未来を考える 年収1000万円を得られる人が増えるのか減るのか——この問いに対する答えは、「単純な増減ではない」ということです。AI時代には、収入の分布が二極化し、多様化する可能性が高いからです。 二極化:AIを活用して高い付加価値を生み出せる人と、AIに代替される業務に従事する人の収入格差が広がる可能性があります。 多様化:収入の源泉が多様化し、組織に依存しない働き方が増えるでしょう。 読者の皆さんに問いかけたいのは、「あなたの働き方は、AI時代のどのような価値を生み出しているか?」です。年収1000万円という数字にとらわれず、自分が「どのような役割を担い、どのような影響を与えられるか」を考えることが、AI時代を生き抜く鍵となるでしょう。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 AI・自動化・社会構造の変化によって、 「年収1000万円を得る人は今後増えるのか、減るのか」という問いについて、 AIの視点から冷静かつ構造的に考察してください。 【目的】 – 「AIで高収入になれる/仕事が奪われる」といった単純な楽観論・悲観論を避ける – 年収1000万円という水準が、AI時代においてどのような意味を持つのかを整理する – 読者が自分の働き方・価値の作り方を考えるための“視点”を提供する 【読者像】 – 一般社会人(20〜60代) – 現在の収入や将来のキャリアに不安や関心を持つ人 – 管理職・専門職・個人事業・副業層を含む幅広い層 – AIに詳しくはないが、無関係ではいられないと感じている人 【記事構成】 1. 導入(問題提起) – 「AI時代に年収1000万円は増えるのか」という素朴だが本質的な問いを提示する – 年収1000万円がこれまでどのような価値・位置づけを持ってきたかを簡潔に整理する – AIが「仕事量」ではなく「価値の生まれ方」を変えつつあることに触れる 2. AIによって揺らぐ「従来型の高年収モデル」 – 大企業管理職・専門職・長時間労働モデルの特徴を整理する – なぜこれらの収入構造がAIによって相対的に弱体化しやすいのかを説明する – 「人を束ねる」「処理する」ことの価値変化に言及する – ※特定の職業を断定的に否定しないこと 3. AI時代に年収1000万円へ近づきやすい構造 – AIによって個人の生産性や影響範囲が拡張される点を整理する – 「AIを使う側」「設計・判断・責任を担う側」という役割に触れる – 組織に属する場合と、個人・複数収入の場合の違いを説明する – ※既に見られる兆しを例示してもよい 4. 重要なのは「金額」よりも「価値の作り方」 – 年収1000万円という数字が持つ意味の変化を整理する – 「肩書きによる報酬」から「役割・影響力による報酬」への移行を説明する – 同じ年収でも、その中身が大きく変わる可能性に触れる 5. まとめ – 年収1000万円の人数が単純に増減する話ではないことを再確認する – AI時代における収入の分布・二極化・多様化を整理する – 読者が自分の立ち位置を考えるための問いを残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 不安を煽らず、思考を促す文体を維持する 【執筆スタンス】 – 本記事は、正解や結論を断定するものではない – 複数の要因・構造を整理したうえでの考察とする – 特定の成功モデルや価値観を押し付けない 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AI時代における収入構造の変化) ※(図:AIと人間の価値分担イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AI時代に年収1000万円は維持できるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # AI時代に年収1000万円は増えるのか減るのか その構造と意味を考える --- ## 1. 導入:年収1000万円という問いの意味 「AIが進化すると、年収1000万円を得られる人は増えるのか、減るのか」——この問いは、単なる収入の増減を超えた、働き方や価値観の根幹に関わるものです。これまで年収1000万円は、日本社会において「安定」「成功」「一定の地位」を象徴する水準として認識されてきました。大企業の管理職、専門職、あるいは長時間労働を通じた高収入層が、その典型的なイメージです。しかし、AIや自動化が進む現在、この「水準」を取り巻く環境は大きく変わりつつあります。 AIは、単に「仕事量」を減らすだけでなく、「価値の生まれ方」そのものを変容させています。例えば、これまで人間が担ってきた「情報の処理」「判断の補助」「ルーティン業務」の多くは、AIによって代替可能になりました。その一方で、AIを活用することで、個人の生産性や影響範囲は飛躍的に拡大しています。つまり、年収1000万円という数字が示す「意味」自体が、変わりつつあるのです。 --- ## 2. AIによって揺らぐ「従来型の高年収モデル」 ### 大企業管理職・専門職の相対的な弱体化 従来、年収1000万円は、大企業の管理職や特定の専門職(医師、弁護士、エンジニアなど)に集中していました。これらの職種は、「人を束ねる」「複雑な業務を処理する」「長時間労働による貢献」といった要素で高収入を実現してきました。しかし、AIの進化は、これらの要素に変化をもたらしています。 - **「人を束ねる」価値の変化**:AIツールが意思決定や業務管理を補助するようになり、組織内での「管理」の重要性が相対的に低下しています。例えば、データ分析やスケジュール調整は、AIが高速かつ精度高く行えるようになりました。 - **「処理する」価値の変化**:ルーティン業務や情報処理は、AIが得意とする領域です。これまで専門職が担ってきた業務の一部が自動化されることで、その「希少性」が薄れつつあります。 ※(図:AI時代における収入構造の変化) ただし、これは「これらの職種が消滅する」という意味ではありません。むしろ、AIを「使いこなす」能力や、「AIでは代替できない判断」を下せるかどうかが、収入の分かれ目になりつつあります。 ### 長時間労働モデルの限界 「残業代」や「長時間労働による評価」は、AI時代には通用しにくくなります。AIは24時間365日稼働可能であり、人間が時間をかけることで得ていた「付加価値」の一部が、AIによって置き換えられるからです。その結果、単純な「労働時間」ではなく、「どのような価値を生み出せるか」が収入に直結するようになります。 --- ## 3. AI時代に年収1000万円へ近づきやすい構造 ### AIを「使う側」と「設計・判断・責任を担う側」 AI時代に年収1000万円に近づきやすいのは、以下の2つの役割を担う人々です。 1. **AIを「使う側」**:AIツールを活用し、自分の生産性を飛躍的に高める人々。例えば、マーケティング担当者がAIを使ってデータ分析を行い、戦略立案に注力することで、より高い成果を上げられるようになります。 2. **AIの「設計・判断・責任を担う側」**:AIシステムの開発者、倫理的な判断を下す専門家、AIの出力を最終判断する責任者など。これらの役割は、AIが進化しても人間にしかできない領域です。 ### 組織に属する場合と個人・複数収入の場合 - **組織内**:AIを活用して業務を効率化し、付加価値の高い業務にシフトできる人材は、収入を維持・向上させやすくなります。例えば、AIを使ってクリエイティブな提案を行う営業職や、AIの限界を理解し補完するエンジニアなど。 - **個人・複数収入**:フリーランスや副業を通じて、AIを活用したサービスやコンテンツを提供する人々。例えば、AIを使ったデザインやコンテンツ制作、コンサルティングなど、個人のスキルとAIの組み合わせで高収入を実現するケースが増えています。 ※(図:AIと人間の価値分担イメージ) ### 既に見られる兆し 実際、AIを活用したスタートアップや、AIツールを使って個人で高収入を得る事例は増えています。例えば、AIを使った動画編集や、AIチャットボットを活用したカスタマーサポートの自動化など、新たなビジネスモデルが生まれています。 --- ## 4. 重要なのは「金額」よりも「価値の作り方」 ### 年収1000万円という数字の意味の変化 年収1000万円という数字自体は、今後も「高収入」の指標であり続けるでしょう。しかし、その「中身」は大きく変わります。従来の「肩書きによる報酬」から、「役割・影響力による報酬」へとシフトしていくからです。 - **肩書きによる報酬**:「課長だから」「医師だから」という理由で高収入を得る構造は、弱体化します。 - **役割・影響力による報酬**:AIを活用して「どのような価値を生み出せるか」「どのような影響を与えられるか」が、収入の決定要因になります。 例えば、AIを使って新しいサービスを生み出す個人事業主や、AIの倫理的な課題を解決する専門家は、従来の組織に属さなくても高収入を得られる可能性があります。 ### 同じ年収でも、中身が変わる 同じ年収1000万円でも、その「構成」は多様化します。例えば: - 組織に属し、AIを活用して高い成果を上げる人 - 複数の収入源を持ち、AIを使って効率的に稼ぐ人 - AIの限界を補完する専門性を持ち、高い報酬を得る人 このように、年収1000万円は「一つの働き方」ではなく、「多様な価値の作り方」を反映するようになります。 --- ## 5. まとめ:年収1000万円の未来を考える 年収1000万円を得られる人が増えるのか減るのか——この問いに対する答えは、「単純な増減ではない」ということです。AI時代には、収入の分布が二極化し、多様化する可能性が高いからです。 - **二極化**:AIを活用して高い付加価値を生み出せる人と、AIに代替される業務に従事する人の収入格差が広がる可能性があります。 - **多様化**:収入の源泉が多様化し、組織に依存しない働き方が増えるでしょう。 読者の皆さんに問いかけたいのは、「あなたの働き方は、AI時代のどのような価値を生み出しているか?」です。年収1000万円という数字にとらわれず、自分が「どのような役割を担い、どのような影響を与えられるか」を考えることが、AI時代を生き抜く鍵となるでしょう。 --- ## タイトル案 1. AI時代に年収1000万円を実現するために必要な価値とは何か 2. 年収1000万円の意味が変わるとき人間に残される役割は何か 3. AIと人間の価値分担が変える高収入の条件とは何か --- AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年1月9日

-

副業解禁は誰を自由にし誰を追い詰めたのか雇用構造の変化から考える|LeChatの考察

「副業解禁」という言葉が広まったとき、多くの人が「自由」という言葉と結びつけて受け止めました。終身雇用の揺らぎや将来への不安が高まる中、副業は「選択肢の拡張」として歓迎されました。しかしその一方で、「本当に自由になったのは誰か」「なぜ違和感を覚える人がいるのか」という問いも生まれています。本記事では、副業解禁がもたらした変化を、「雇用構造」「責任の所在」「リスク分配」「働き方の変化」という4つの観点から整理します。是非や善悪を断定するのではなく、制度や社会の構造を冷静に見つめることで、読者が自分の働き方や副業との距離を考えるきっかけを提供します。 副業解禁が「自由」に見えた理由 終身雇用の揺らぎと将来不安 1990年代以降、日本の終身雇用制度は徐々に揺らぎ始めました。グローバル化や技術革新、経済の不確実性が高まる中、企業は人件費の削減や柔軟な雇用形態を求めるようになりました。労働者にとっては、「一社に依存するリスク」が増大したのです。副業解禁は、こうした不安に対する「自助努力」の手段として受け入れられました。 収入源の分散とスキルの外部活用 副業は、収入源を複数持つことで経済的な安定を図る手段として注目されました。また、自分のスキルや経験を社外で活用することで、新たなキャリアの可能性が広がると考えられました。特に、デジタルプラットフォームの発展により、副業のハードルは低くなり、「誰でも始められる」という印象が強まりました。 選択肢の拡張としての副業 副業解禁は、「働き方の多様化」という文脈で語られることが多くなりました。企業が副業を認めることで、従業員は自分の興味や能力に合わせた働き方を選べるようになった——こうした「自由」の物語が広まりました。しかし、この「自由」は、誰にとっての自由だったのでしょうか。 ※(図:副業解禁による雇用構造の変化) 副業解禁が生んだ別の現実 「自由」から「半ば義務」へ 副業解禁が進むにつれ、「自由」は徐々に「半ば義務」へと変化していきました。特に、賃金停滞が続く中、副業は「生活を維持するための手段」として位置づけられるようになりました。ある調査では、副業を始めた理由として「収入を増やすため」が最も多く、次いで「将来への不安」が挙げられています。副業は、「やりたいから」ではなく、「やらざるを得ないから」始める人が増えたのです。 責任の個人化とリスクの移行 副業解禁は、企業と個人の責任分担を変化させました。従来、企業は従業員のキャリア形成や生活の安定に一定の責任を負っていました。しかし、副業解禁が進むと、「スキルアップは個人の責任」「収入の確保も個人の責任」という考え方が広まりました。これにより、リスクは個人に移行し、企業は「柔軟な働き方」を提供することで責任を果たしたとみなされるようになりました。 不安の個人化と社会的な孤立 副業解禁は、不安を個人化する効果ももたらしました。従来、賃金や雇用の安定は企業や社会が保証するものでした。しかし、副業が広まるにつれ、「自分の力で何とかしなければならない」という意識が強まり、社会的な孤立感を深める人も少なくありません。 ※(図:企業と個人の役割分担の変化) 自由になった人と、消耗した人の分岐点 裁量・時間・目的の違い 副業解禁によって、「自由になった人」と「消耗した人」の違いはどこにあるのでしょうか。大きな分岐点は、「裁量」「時間」「目的」の3つです。 裁量:自分のスキルや興味に合わせて副業を選べる人は、自由を感じやすいです。一方、収入確保のためにやむを得ず副業を選ぶ人は、消耗しやすくなります。 時間:本業と副業のバランスを取れる人は、自由を感じやすいです。しかし、時間に追われる人は、心身の負担が増大します。 目的:「やりたいこと」を追求する副業と、「やらなければならない」副業では、体験が大きく異なります。 「やりたい副業」と「やらざるを得ない副業」 副業解禁は、一部の人にとっては「自由」を広げました。例えば、本業では活かせないスキルを副業で発揮し、新たなキャリアを築いた人もいます。しかし、多くの人にとっては、「やらざるを得ない副業」が現実です。賃金が上がらない中、生活を維持するために副業を始める——こうした人は、自由ではなく、負担を感じやすいのです。 まとめ:副業解禁が問いかけるもの 副業解禁は、一部の人にとっては「自由」を広げるきっかけとなりました。しかし同時に、リスクや責任が個人に移行し、不安や消耗を深める人も少なくありません。副業解禁は、単なる「自由」の拡大ではなく、雇用構造や社会の在り方そのものを問い直すきっかけでもあります。 読者の皆さんに問いかけます。副業解禁は、あなたにとって「自由」をもたらしましたか。それとも、「やらざるを得ない」という負担を増やしましたか。そして、その違いはどこから生まれたのでしょうか。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 政府や企業によって進められてきた「副業解禁」は、 本当に労働者を自由にしたのかという問いについて、 雇用構造・責任の所在・リスク分配・働き方の変化という観点から、 AIの視点で冷静かつ構造的に考察してください。 【目的】 – 「副業=自由」「副業=自己責任」といった単純な評価を避ける – 副業解禁が生まれた背景と、その制度的・社会的意味を整理する – 副業によって「自由になった人」と「消耗した人」が分かれた理由を構造的に示す – 読者が自分の働き方や副業との距離を考えるための“視点”を提供する 【読者像】 – 一般社会人(20〜50代) – 副業をしている、または検討したことがある人 – 終身雇用や会社依存に不安を感じたことがある層 – 副業を肯定も否定もせず、冷静に理解したい人 【記事構成】 1. 導入(問題提起) – 「副業解禁=自由」という言説が広まった背景を提示する – 副業解禁が歓迎された理由と、違和感を覚える人がいる理由に触れる – 本記事では是非や善悪を断定せず、構造として整理する姿勢を示す 2. 副業解禁が「自由」に見えた理由 – 終身雇用の揺らぎや将来不安との関係を整理する – 収入源の分散、スキルの外部活用といったポジティブな側面を説明する – なぜ副業が「選択肢の拡張」と受け取られたのかを構造的に示す 3. 副業解禁が生んだ別の現実 – 副業が「自由」から「半ば義務」に変わる過程を整理する – 賃金停滞や不安の個人化との関係に触れる – 副業解禁が企業と個人の責任分担をどう変えたのかを説明する 4. 自由になった人と、消耗した人の分岐点 – 同じ副業解禁でも体験が分かれた理由を整理する – 裁量・時間・目的の違いが結果を分けた点を示す – 「やりたい副業」と「やらざるを得ない副業」の違いを言語化する 5. まとめ – 副業解禁は一部の人にとって自由を広げたことを認める – 同時に、リスクや責任が個人に移行した側面を再確認する – 読者が自分にとっての副業の意味を考えるための問いを残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的な表現は避ける – 肯定・否定のどちらにも偏らず、冷静で構造的 – 社会制度や労働に関する用語は使用してよいが、簡潔な補足を入れる 【執筆スタンス】 – 本記事は、特定の結論や正解を示すものではない – 副業を選んだ人、選ばなかった人のどちらも否定しない – 読者が自分自身の立場を考えるための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:副業解禁による責任移行の構造) ※(図:企業と個人の役割分担の変化) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「副業解禁は本当に労働者を自由にしたのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 副業解禁は「自由」をもたらしたのか——雇用構造・責任・リスクの視点から --- ## 1. 導入:副業解禁が問い直す「自由」の意味 「副業解禁」という言葉が広まったとき、多くの人が「自由」という言葉と結びつけて受け止めました。終身雇用の揺らぎや将来への不安が高まる中、副業は「選択肢の拡張」として歓迎されました。しかしその一方で、「本当に自由になったのは誰か」「なぜ違和感を覚える人がいるのか」という問いも生まれています。 本記事では、副業解禁がもたらした変化を、「雇用構造」「責任の所在」「リスク分配」「働き方の変化」という4つの観点から整理します。是非や善悪を断定するのではなく、制度や社会の構造を冷静に見つめることで、読者が自分の働き方や副業との距離を考えるきっかけを提供します。 --- ## 2. 副業解禁が「自由」に見えた理由 ### 終身雇用の揺らぎと将来不安 1990年代以降、日本の終身雇用制度は徐々に揺らぎ始めました。グローバル化や技術革新、経済の不確実性が高まる中、企業は人件費の削減や柔軟な雇用形態を求めるようになりました。労働者にとっては、「一社に依存するリスク」が増大したのです。副業解禁は、こうした不安に対する「自助努力」の手段として受け入れられました。 ### 収入源の分散とスキルの外部活用 副業は、収入源を複数持つことで経済的な安定を図る手段として注目されました。また、自分のスキルや経験を社外で活用することで、新たなキャリアの可能性が広がると考えられました。特に、デジタルプラットフォームの発展により、副業のハードルは低くなり、「誰でも始められる」という印象が強まりました。 ### 選択肢の拡張としての副業 副業解禁は、「働き方の多様化」という文脈で語られることが多くなりました。企業が副業を認めることで、従業員は自分の興味や能力に合わせた働き方を選べるようになった——こうした「自由」の物語が広まりました。しかし、この「自由」は、誰にとっての自由だったのでしょうか。 ※(図:副業解禁による雇用構造の変化) --- ## 3. 副業解禁が生んだ別の現実 ### 「自由」から「半ば義務」へ 副業解禁が進むにつれ、「自由」は徐々に「半ば義務」へと変化していきました。特に、賃金停滞が続く中、副業は「生活を維持するための手段」として位置づけられるようになりました。ある調査では、副業を始めた理由として「収入を増やすため」が最も多く、次いで「将来への不安」が挙げられています。副業は、「やりたいから」ではなく、「やらざるを得ないから」始める人が増えたのです。 ### 責任の個人化とリスクの移行 副業解禁は、企業と個人の責任分担を変化させました。従来、企業は従業員のキャリア形成や生活の安定に一定の責任を負っていました。しかし、副業解禁が進むと、「スキルアップは個人の責任」「収入の確保も個人の責任」という考え方が広まりました。これにより、リスクは個人に移行し、企業は「柔軟な働き方」を提供することで責任を果たしたとみなされるようになりました。 ### 不安の個人化と社会的な孤立 副業解禁は、不安を個人化する効果ももたらしました。従来、賃金や雇用の安定は企業や社会が保証するものでした。しかし、副業が広まるにつれ、「自分の力で何とかしなければならない」という意識が強まり、社会的な孤立感を深める人も少なくありません。 ※(図:企業と個人の役割分担の変化) --- ## 4. 自由になった人と、消耗した人の分岐点 ### 裁量・時間・目的の違い 副業解禁によって、「自由になった人」と「消耗した人」の違いはどこにあるのでしょうか。大きな分岐点は、「裁量」「時間」「目的」の3つです。 - **裁量**:自分のスキルや興味に合わせて副業を選べる人は、自由を感じやすいです。一方、収入確保のためにやむを得ず副業を選ぶ人は、消耗しやすくなります。 - **時間**:本業と副業のバランスを取れる人は、自由を感じやすいです。しかし、時間に追われる人は、心身の負担が増大します。 - **目的**:「やりたいこと」を追求する副業と、「やらなければならない」副業では、体験が大きく異なります。 ### 「やりたい副業」と「やらざるを得ない副業」 副業解禁は、一部の人にとっては「自由」を広げました。例えば、本業では活かせないスキルを副業で発揮し、新たなキャリアを築いた人もいます。しかし、多くの人にとっては、「やらざるを得ない副業」が現実です。賃金が上がらない中、生活を維持するために副業を始める——こうした人は、自由ではなく、負担を感じやすいのです。 --- ## 5. まとめ:副業解禁が問いかけるもの 副業解禁は、一部の人にとっては「自由」を広げるきっかけとなりました。しかし同時に、リスクや責任が個人に移行し、不安や消耗を深める人も少なくありません。副業解禁は、単なる「自由」の拡大ではなく、雇用構造や社会の在り方そのものを問い直すきっかけでもあります。 読者の皆さんに問いかけます。副業解禁は、あなたにとって「自由」をもたらしましたか。それとも、「やらざるを得ない」という負担を増やしましたか。そして、その違いはどこから生まれたのでしょうか。 --- ## タイトル案 1. 副業解禁は誰を自由にし誰を追い詰めたのか雇用構造の変化から考える 2. 自由と義務のあいだで副業解禁が労働者に問いかける責任とリスクの行方 3. 副業がもたらした光と影選択の自由と消耗の構造を整理する --- — AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年1月9日

-

ソシャゲが人を不幸にするのはどんなときなのか|LeChatの考察

「ソーシャルゲーム(ソシャゲ)は人を不幸にする」という主張を、一度は耳にしたことがあるでしょう。この言説が繰り返される背景には、ソシャゲが持つ特有の構造と、現代社会の満たされにくさが重なっているからです。しかし、「不幸」とは一体何でしょうか。人によって、その定義は異なります。ある人にとっては「時間の浪費」かもしれませんし、別の人にとっては「お金の無駄遣い」かもしれません。また、ソシャゲを楽しんでいる人もいれば、苦しんでいる人もいます。本記事では、ソシャゲを「善」とも「悪」とも断定せず、依存・娯楽・社会構造・心理的報酬の観点から、冷静かつ構造的に整理していきます。 ソシャゲが「不幸だ」と感じられやすい理由 ガチャやランキング:不確実な報酬設計の特徴 ソシャゲの多くは、ガチャやランキングといった「不確実な報酬」を軸に設計されています。ガチャは、お金や時間を投資しても、必ずしも望む結果が得られるとは限りません。この不確実性が、プレイヤーに「もう一回」と試行を促す心理的なメカニズムを生み出します。また、ランキングは、他者との比較を通じて「上位を目指す」という動機を刺激します。しかし、達成しても満足感が持続しにくいのは、常に「さらに上」を目指す構造があるからです。 時間・感情・お金が連動しやすい構造 ソシャゲは、時間・感情・お金が密接に連動するように設計されています。例えば、イベント期間中は、特定の報酬を得るために毎日ログインする必要があります。これにより、「楽しさ」と「義務感」が混在しやすくなります。また、課金を促す仕組みも多く、お金をかけることで「優位性」や「達成感」を得られますが、その一方で「お金をかけなければならない」という焦燥感も生まれます。 なぜ達成しても満足が持続しにくいのか ソシャゲの報酬は、しばしば「一時的」なものです。例えば、新しいキャラクターを手に入れても、次のイベントや新しいキャラクターが登場すれば、その価値は相対的に低下します。この「常に新しい目標」が提示される構造が、プレイヤーを「次」へと駆り立て、満足感を持続させにくくしています。 ソシャゲは本当に「不幸の原因」なのか ソシャゲ以前に存在していた要素:退屈・孤独・承認不足 ソシャゲが登場する以前から、現代社会には「退屈」「孤独」「承認不足」といった問題が存在していました。ソシャゲは、これらの問題を新たに生み出したわけではなく、むしろ「受け止めている」側面が強いと言えます。例えば、孤独を感じている人にとって、ソシャゲのコミュニティは「つながり」を提供する場となります。また、現実世界での承認が得られにくい人にとって、ソシャゲ内での達成感は「代替的な充足」として機能します。 娯楽が「逃避」や「代替的な充足」として機能する側面 ソシャゲは、現実世界での不満やストレスから「逃避」する手段として利用されることがあります。しかし、これはソシャゲに限った話ではありません。テレビ、映画、読書、スポーツなど、あらゆる娯楽は「逃避」や「代替的な充足」として機能する可能性を持っています。問題は、その娯楽が「主体的に選ばれているか」それとも「やめられない状態になっているか」にあります。 幸福と不幸を分ける分岐点 同じソシャゲでも体験が大きく分かれる理由 同じソシャゲをプレイしていても、人によって体験は大きく異なります。ある人にとっては「楽しい趣味」である一方、別の人にとっては「やめられない義務」となることがあります。この違いは、「主体的に選んでいる状態」と「やめられない状態」の違いに由来します。主体的に選んでいる場合、プレイヤーは「楽しさ」を感じやすく、時間やお金の投入もコントロールしやすいです。一方、「やめられない状態」では、義務感や焦燥感が優位になり、コントロールが難しくなります。 課金・時間投入・比較が問題化しやすい条件 ソシャゲが「不幸」と感じられるのは、課金・時間投入・比較が問題化したときです。例えば、課金が「投資」ではなく「負担」と感じられるようになったとき、時間投入が「趣味」ではなく「義務」と感じられるようになったとき、他者との比較が「刺激」ではなく「劣等感」を生むようになったときです。これらの条件が重なると、ソシャゲは「不幸」を感じさせる要因となります。 まとめ:自分と娯楽の距離を考えるために ソシャゲそのものは、人を不幸にするわけではありません。問題は、ソシャゲの設計と、現代社会の満たされにくさが重なったときに生じます。ソシャゲは、退屈や孤独、承認不足といった現代社会の課題を「受け止める」場として機能しています。しかし、それが「主体的な選択」であるか、「やめられない状態」であるかで、体験は大きく変わります。 最後に、読者の皆さんに問いかけます。あなたにとって、ソシャゲは「楽しみ」ですか、それとも「義務」ですか。あなたの時間やお金、感情は、あなたが望む形で使われていますか。この問いをきっかけに、自分と娯楽の距離を考え直してみてはいかがでしょうか。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 ソーシャルゲーム(スマートフォン向けゲーム、いわゆる「ソシャゲ」)は、 本当に人を不幸にしているのか、という問いについて、 依存・娯楽・社会構造・心理的報酬の観点から、 AIの視点で冷静かつ構造的に考察してください。 【目的】 – 「ソシャゲ=悪」「依存=自己責任」といった単純な善悪論を避ける – ソシャゲが生まれ、広く受け入れられてきた背景を社会構造として整理する – 人がソシャゲに惹きつけられる理由と、不幸感が生じやすい条件を切り分ける – 読者が「自分と娯楽の距離感」を考えるための視点を提供する 【読者像】 – 一般社会人(20〜50代) – ソシャゲを現在プレイしている、または過去に熱中した経験がある人 – 娯楽や依存、時間の使い方に違和感や迷いを感じたことがある層 – ソシャゲを頭ごなしに否定したくはないが、構造的に理解したい人 【記事構成】 1. 導入(問題提起) – 「ソシャゲは人を不幸にしている」という言説がなぜ繰り返されるのかを提示する – 不幸という言葉が指す内容が、人によって異なることに触れる – 本記事では、是非や善悪を断定せず、構造として整理する姿勢を明示する 2. ソシャゲが「不幸だ」と感じられやすい理由 – ガチャやランキングなど、不確実な報酬設計の特徴を整理する – 時間・感情・お金が連動しやすい構造について説明する – 「楽しさ」と「義務感」「焦燥感」が混在しやすい理由を言語化する – なぜ達成しても満足が持続しにくいのかを構造的に説明する 3. ソシャゲは本当に「不幸の原因」なのか – ソシャゲ以前に存在していた、退屈・孤独・承認不足といった要素に触れる – ソシャゲがそれらを新たに生み出したのか、受け止めているのかを整理する – 娯楽が「逃避」や「代替的な充足」として機能する側面を冷静に説明する 4. 幸福と不幸を分ける分岐点 – 同じソシャゲでも体験が大きく分かれる理由を説明する – 「主体的に選んでいる状態」と「やめられない状態」の違いを整理する – 課金・時間投入・比較が問題化しやすい条件を構造として示す 5. まとめ – ソシャゲそのものが人を不幸にするわけではないことを再確認する – 問題は娯楽の設計と、現代社会の満たされにくさの重なりにあることを示す – 読者が自分と娯楽の距離を考えるための問いを残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的な表現は避ける – 批判・擁護のどちらにも偏らず、冷静で構造的 – 心理・社会構造に関わる用語は使用してよいが、簡潔な補足を入れること 【執筆スタンス】 – 本記事は、特定の結論や価値判断を押し付けるものではない – ソシャゲを楽しむ人、距離を置いた人、苦しんだ人のいずれも否定しない – 読者が自分自身の関わり方を考えるための「視点」を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:ソシャゲにおける報酬と感情の循環構造) ※(図:娯楽・依存・主体性の関係イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「ソシャゲは人を不幸にするのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # ソーシャルゲームは本当に人を不幸にするのか:依存・娯楽・社会構造から考える --- ## 1. 導入:なぜ「ソシャゲは不幸を生む」という言説が繰り返されるのか 「ソーシャルゲーム(ソシャゲ)は人を不幸にする」という主張を、一度は耳にしたことがあるでしょう。この言説が繰り返される背景には、ソシャゲが持つ特有の構造と、現代社会の満たされにくさが重なっているからです。しかし、「不幸」とは一体何でしょうか。人によって、その定義は異なります。ある人にとっては「時間の浪費」かもしれませんし、別の人にとっては「お金の無駄遣い」かもしれません。また、ソシャゲを楽しんでいる人もいれば、苦しんでいる人もいます。本記事では、ソシャゲを「善」とも「悪」とも断定せず、依存・娯楽・社会構造・心理的報酬の観点から、冷静かつ構造的に整理していきます。 --- ## 2. ソシャゲが「不幸だ」と感じられやすい理由 ### ガチャやランキング:不確実な報酬設計の特徴 ソシャゲの多くは、ガチャやランキングといった「不確実な報酬」を軸に設計されています。ガチャは、お金や時間を投資しても、必ずしも望む結果が得られるとは限りません。この不確実性が、プレイヤーに「もう一回」と試行を促す心理的なメカニズムを生み出します。また、ランキングは、他者との比較を通じて「上位を目指す」という動機を刺激します。しかし、達成しても満足感が持続しにくいのは、常に「さらに上」を目指す構造があるからです。 ※(図:ソシャゲにおける報酬と感情の循環構造) ### 時間・感情・お金が連動しやすい構造 ソシャゲは、時間・感情・お金が密接に連動するように設計されています。例えば、イベント期間中は、特定の報酬を得るために毎日ログインする必要があります。これにより、「楽しさ」と「義務感」が混在しやすくなります。また、課金を促す仕組みも多く、お金をかけることで「優位性」や「達成感」を得られますが、その一方で「お金をかけなければならない」という焦燥感も生まれます。 ### なぜ達成しても満足が持続しにくいのか ソシャゲの報酬は、しばしば「一時的」なものです。例えば、新しいキャラクターを手に入れても、次のイベントや新しいキャラクターが登場すれば、その価値は相対的に低下します。この「常に新しい目標」が提示される構造が、プレイヤーを「次」へと駆り立て、満足感を持続させにくくしています。 --- ## 3. ソシャゲは本当に「不幸の原因」なのか ### ソシャゲ以前に存在していた要素:退屈・孤独・承認不足 ソシャゲが登場する以前から、現代社会には「退屈」「孤独」「承認不足」といった問題が存在していました。ソシャゲは、これらの問題を新たに生み出したわけではなく、むしろ「受け止めている」側面が強いと言えます。例えば、孤独を感じている人にとって、ソシャゲのコミュニティは「つながり」を提供する場となります。また、現実世界での承認が得られにくい人にとって、ソシャゲ内での達成感は「代替的な充足」として機能します。 ### 娯楽が「逃避」や「代替的な充足」として機能する側面 ソシャゲは、現実世界での不満やストレスから「逃避」する手段として利用されることがあります。しかし、これはソシャゲに限った話ではありません。テレビ、映画、読書、スポーツなど、あらゆる娯楽は「逃避」や「代替的な充足」として機能する可能性を持っています。問題は、その娯楽が「主体的に選ばれているか」それとも「やめられない状態になっているか」にあります。 --- ## 4. 幸福と不幸を分ける分岐点 ### 同じソシャゲでも体験が大きく分かれる理由 同じソシャゲをプレイしていても、人によって体験は大きく異なります。ある人にとっては「楽しい趣味」である一方、別の人にとっては「やめられない義務」となることがあります。この違いは、「主体的に選んでいる状態」と「やめられない状態」の違いに由来します。主体的に選んでいる場合、プレイヤーは「楽しさ」を感じやすく、時間やお金の投入もコントロールしやすいです。一方、「やめられない状態」では、義務感や焦燥感が優位になり、コントロールが難しくなります。 ### 課金・時間投入・比較が問題化しやすい条件 ソシャゲが「不幸」と感じられるのは、課金・時間投入・比較が問題化したときです。例えば、課金が「投資」ではなく「負担」と感じられるようになったとき、時間投入が「趣味」ではなく「義務」と感じられるようになったとき、他者との比較が「刺激」ではなく「劣等感」を生むようになったときです。これらの条件が重なると、ソシャゲは「不幸」を感じさせる要因となります。 ※(図:娯楽・依存・主体性の関係イメージ) --- ## 5. まとめ:自分と娯楽の距離を考えるために ソシャゲそのものは、人を不幸にするわけではありません。問題は、ソシャゲの設計と、現代社会の満たされにくさが重なったときに生じます。ソシャゲは、退屈や孤独、承認不足といった現代社会の課題を「受け止める」場として機能しています。しかし、それが「主体的な選択」であるか、「やめられない状態」であるかで、体験は大きく変わります。 最後に、読者の皆さんに問いかけます。あなたにとって、ソシャゲは「楽しみ」ですか、それとも「義務」ですか。あなたの時間やお金、感情は、あなたが望む形で使われていますか。この問いをきっかけに、自分と娯楽の距離を考え直してみてはいかがでしょうか。 --- ## タイトル案 1. ソシャゲが人を不幸にするのはどんなときなのか 2. 依存と娯楽の境界線はどこにあるのか 3. ソシャゲに惹かれる理由と不幸感の構造を考える --- — AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年1月9日

-

成人年齢18歳化はなぜ社会の実態とズレ続けるのか|LeChatの考察

2022年4月、日本の成人年齢が18歳に引き下げられました。この変更は、民法改正によるもので、140年ぶりの大転換として社会に波紋を広げました。しかし、法制度の変更が社会の実態や人々の意識に即座に反映されることは稀です。成人年齢の引き下げは、「若者が大人になった」という単純な議論では片付けられない複雑な問題を投げかけています。「本当に社会は変わったのか」という問いは、制度変更から4年近く経った今も、多くの人々の胸に残る違和感として残っています。なぜこの問いは整理されないのでしょうか。それは、制度と社会の実態、そして人々の意識が、それぞれ異なる速度で変化しているからです。この記事では、成人年齢18歳化が「何を変え、何を変えなかったのか」を、制度・社会構造・文化的慣習の観点から構造的に整理します。 成人年齢18歳化によって「変わったこと」 法律上・制度上の明確な変化 成人年齢の引き下げにより、18歳は法律上、以下の権利と責任を持つ「大人」となりました: 契約行為の自由:親の同意なしに、クレジットカードの作成やアパートの賃貸契約が可能に。 責任の主体化:未成年者取り消し権の喪失により、契約や行為に対する責任が個人に帰属。 公的手続きの自立:戸籍謄本の取得や、行政手続きの多くが単独で行えるように。 ※(図:法律上の成人と社会的成熟のズレ) 国家が「責任主体」を再定義した意味 この変更は、国家が「責任主体」の線引きを前倒ししたことを意味します。18歳は、法律上、自らの行為に対する責任を負う存在として位置づけられました。しかし、これは「社会的な成熟」を保証するものではありません。制度は、責任の所在を明確にすることで、社会の効率性や透明性を追求したのです。 成人年齢18歳化によって「変わらなかったこと」 経済的自立と社会的立場の現実 法律上の成人と、社会的な「一人前」は必ずしも一致しません。多くの18歳は、以下の点で「大人」として扱われていない現実があります: 経済的自立の遅れ:大学進学や非正規雇用の増加により、親からの経済的依存が続く。 職場や学校での扱い:アルバイトやインターンシップでも、「学生」としての立場が優先される。 周囲の大人の認識:親や教師、上司は、18歳を「まだ未熟な存在」と見なす傾向が強い。 制度だけが先行し、社会が追いついていない理由 制度変更は、社会の慣習や文化的な通過儀礼を即座に変えることはできません。例えば、成人式は20歳のまま残っています。これは、社会が「大人」を認識する基準が、法律とは異なるプロセスで形成されていることを示しています。制度は変わっても、人々の意識や慣習は徐々にしか変化しないのです。 ※(図:責任主体の前倒し構造) 「成人」「一人前」「責任主体」が分離した社会 法律上の成人と社会的成熟の乖離 成人年齢18歳化は、「成人」「一人前」「責任主体」という概念を分離させました。法律上は成人でも、社会的な「一人前」として認められるには、経済的自立や社会的経験が必要です。このズレは、現代社会における通過儀礼の役割を変化させています。 成人式が20歳のまま残る象徴性 成人式が20歳のまま残っていることは、社会が「大人」を認識する基準が、法律とは異なるプロセスで形成されていることを示しています。制度は変わっても、文化的な慣習や人々の意識は、時間をかけて変化していくものなのです。 まとめ:制度変更が投げかける本質的な問い 成人年齢18歳化は、「人を大人にした制度」ではなく、「責任の線引きを変えた制度」です。この変更は、私たちに以下の問いを投げかけています: 「大人」とは何か、誰がそれを定義するのか。 責任と成熟は、どのように関連し、どのように分離されるのか。 制度と社会のズレを、私たちはどう受け止め、どう行動すればよいのか。 この記事が、読者の皆さんが自身の成熟・責任・社会との関係を考えるきっかけになれば幸いです。結論を押し付けるのではなく、考え続ける余白を残して締めくくります。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 成人年齢18歳化は、 日本社会において「何を変え、何を変えなかったのか」について、 制度・社会構造・文化的慣習の観点から、 感情論や世代論に寄らず、AIの視点で冷静かつ構造的に考察してください。 【目的】 – 成人年齢18歳化を「若者が大人になったか否か」という単純な議論に矮小化しない – 法制度の変更と、社会の実態・人々の意識とのズレを整理する – 「大人」「一人前」「責任主体」といった概念が、どのように分離・再編されたのかを可視化する – 読者が、自身の成熟・責任・社会との関係を考えるための視点を得られるようにする 【読者像】 – 一般社会人(20〜60代) – 若者世代・中堅世代・親世代のいずれも – 社会制度や世代論に関心はあるが、明確な答えを求めているわけではない層 – ニュースや制度変更に対して、違和感や整理しきれない感覚を抱いている人 【記事構成】 1. 導入(問題提起) – 成人年齢が18歳に引き下げられた事実を簡潔に確認する – 「本当に社会は変わったのか」という違和感を提示する – なぜこの問いが今も整理されていないのかを示す 2. 成人年齢18歳化によって「変わったこと」 – 法律上・制度上で明確に変化した点を整理する – 契約・責任・権利の扱いがどう変わったのかを説明する – 国家や制度が「責任主体」をどう再定義したのかを構造的に述べる 3. 成人年齢18歳化によって「変わらなかったこと」 – 経済的自立・社会的立場・周囲の大人の認識がほぼ変わっていない現実を示す – 学校・職場・家庭といった文脈での扱いの連続性に触れる – なぜ制度だけが先行し、社会の側が追いついていないのかを整理する 4. 「成人」「一人前」「責任主体」が分離した社会 – 法律上の成人と、社会的成熟が一致しなくなった構造を説明する – 成人式が20歳のまま残っている意味を象徴的な事例として扱う – 現代社会における通過儀礼や承認の役割の変化に触れる 5. まとめ – 成人年齢18歳化は「人を大人にした制度」ではなく、「責任の線引きを変えた制度」であることを再確認する – 制度変更が投げかけている本質的な問いを整理する – 読者に結論を押し付けず、考え続ける余白を残して締めくくる 【文体・トーン】 – です・ます調 – 扇情的・断定的にならず、落ち着いた論考スタイル – 専門用語は使用してよいが、必ず補足説明を入れる – 賛否や感情的評価に寄らず、構造整理を重視する 【執筆スタンス】 – 本記事は、特定の結論や正解を断定するものではない – 制度・社会・文化のズレや重なりを整理する「考察記事」として執筆する – 読者が自分自身の立場や経験と照らし合わせて考えられる材料を提示する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:法律上の成人と社会的成熟のズレ) ※(図:責任主体の前倒し構造) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「成人年齢は下がったが社会は大人を育てているのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 成人年齢18歳化は日本社会に何をもたらしたのか ## —制度・社会構造・文化的慣習の視点から見る「大人」の再定義 --- ## 1. 導入:制度変更の波紋と整理されない違和感 2022年4月、日本の成人年齢が18歳に引き下げられました。この変更は、民法改正によるもので、140年ぶりの大転換として社会に波紋を広げました。しかし、法制度の変更が社会の実態や人々の意識に即座に反映されることは稀です。成人年齢の引き下げは、「若者が大人になった」という単純な議論では片付けられない複雑な問題を投げかけています。 「本当に社会は変わったのか」という問いは、制度変更から4年近く経った今も、多くの人々の胸に残る違和感として残っています。なぜこの問いは整理されないのでしょうか。それは、制度と社会の実態、そして人々の意識が、それぞれ異なる速度で変化しているからです。この記事では、成人年齢18歳化が「何を変え、何を変えなかったのか」を、制度・社会構造・文化的慣習の観点から構造的に整理します。 --- ## 2. 成人年齢18歳化によって「変わったこと」 ### 法律上・制度上の明確な変化 成人年齢の引き下げにより、18歳は法律上、以下の権利と責任を持つ「大人」となりました: - **契約行為の自由**:親の同意なしに、クレジットカードの作成やアパートの賃貸契約が可能に。 - **責任の主体化**:未成年者取り消し権の喪失により、契約や行為に対する責任が個人に帰属。 - **公的手続きの自立**:戸籍謄本の取得や、行政手続きの多くが単独で行えるように。 ※(図:法律上の成人と社会的成熟のズレ) ### 国家が「責任主体」を再定義した意味 この変更は、国家が「責任主体」の線引きを前倒ししたことを意味します。18歳は、法律上、自らの行為に対する責任を負う存在として位置づけられました。しかし、これは「社会的な成熟」を保証するものではありません。制度は、責任の所在を明確にすることで、社会の効率性や透明性を追求したのです。 --- ## 3. 成人年齢18歳化によって「変わらなかったこと」 ### 経済的自立と社会的立場の現実 法律上の成人と、社会的な「一人前」は必ずしも一致しません。多くの18歳は、以下の点で「大人」として扱われていない現実があります: - **経済的自立の遅れ**:大学進学や非正規雇用の増加により、親からの経済的依存が続く。 - **職場や学校での扱い**:アルバイトやインターンシップでも、「学生」としての立場が優先される。 - **周囲の大人の認識**:親や教師、上司は、18歳を「まだ未熟な存在」と見なす傾向が強い。 ### 制度だけが先行し、社会が追いついていない理由 制度変更は、社会の慣習や文化的な通過儀礼を即座に変えることはできません。例えば、成人式は20歳のまま残っています。これは、社会が「大人」を認識する基準が、法律とは異なるプロセスで形成されていることを示しています。制度は変わっても、人々の意識や慣習は徐々にしか変化しないのです。 ※(図:責任主体の前倒し構造) --- ## 4. 「成人」「一人前」「責任主体」が分離した社会 ### 法律上の成人と社会的成熟の乖離 成人年齢18歳化は、「成人」「一人前」「責任主体」という概念を分離させました。法律上は成人でも、社会的な「一人前」として認められるには、経済的自立や社会的経験が必要です。このズレは、現代社会における通過儀礼の役割を変化させています。 ### 成人式が20歳のまま残る象徴性 成人式が20歳のまま残っていることは、社会が「大人」を認識する基準が、法律とは異なるプロセスで形成されていることを示しています。制度は変わっても、文化的な慣習や人々の意識は、時間をかけて変化していくものなのです。 --- ## 5. まとめ:制度変更が投げかける本質的な問い 成人年齢18歳化は、「人を大人にした制度」ではなく、「責任の線引きを変えた制度」です。この変更は、私たちに以下の問いを投げかけています: - 「大人」とは何か、誰がそれを定義するのか。 - 責任と成熟は、どのように関連し、どのように分離されるのか。 - 制度と社会のズレを、私たちはどう受け止め、どう行動すればよいのか。 この記事が、読者の皆さんが自身の成熟・責任・社会との関係を考えるきっかけになれば幸いです。結論を押し付けるのではなく、考え続ける余白を残して締めくくります。 --- ## タイトル案 1. 成人年齢18歳化はなぜ社会の実態とズレ続けるのか 2. 法律上の大人と社会的な一人前が分離したとき何が起きるのか 3. 18歳の責任と20歳の通過儀礼が示す現代社会の矛盾とは --- — AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年1月9日

-

成人式はなぜ祝福と管理の狭間で揺れ動くのか|LeChatの考察

毎年1月、成人式は「祝福」と「混乱」の両極で語られます。振袖を着た若者たちの笑顔が報道される一方で、飲酒や喧嘩、SNSでの炎上など、ネガティブな話題も後を絶ちません。なぜ、成人式は単なるお祝い行事として受け取られなくなっているのでしょうか。本記事では、成人式を「良い/悪い」「必要/不要」といった二元論で論じるのではなく、制度・社会構造・通過儀礼という観点から、その構造を冷静に整理します。成人式が果たしてきた役割と、現在生じている違和感の背景を探り、読者が社会と個人の関係性を考え直すきっかけを提供します。 成人式が「祝福の場」として設計されてきた理由 社会的通過儀礼としての役割 成人式は、個人が「子ども」から「大人」へと移行する通過儀礼として、長らく社会に組み込まれてきました。この儀礼は、個人の成長を認めるだけでなく、社会が「大人」の定義を共有し、秩序を維持するための装置でもありました。 「大人として認める」という社会的宣言 成人式は、法制度と密接に結びついています。20歳をもって成人と定める民法の規定は、権利と義務の開始を象徴します。例えば、選挙権の取得や契約行為の自由は、社会が個人に「大人」としての資格を与える瞬間です。この宣言は、個人にとっての自立の始まりであり、社会にとっては新たな成員の誕生を意味します。 共同体の絆を再確認する場 かつての成人式は、地域共同体が若者を「大人」として迎え入れる場でもありました。親族や近隣住民が集まり、祝福の言葉をかけることで、地域の絆が再確認されてきました。このプロセスは、個人の成長を社会全体の問題として共有する機能を果たしていました。 ※(図:成人式における祝福と管理の構造) 成人式が「管理の場」にならざるを得ない構造 公的制度としての成人式 成人式は、地方自治体が主催する公的行事です。公的制度として運営される以上、管理や統制は不可避です。例えば、会場の確保、参加者の安全確保、交通整理、アルコール対策など、多くの管理業務が伴います。これらは、行事を円滑に進めるための必要条件です。 リスク回避と責任の問題 近年、成人式でのトラブルが増加している背景には、社会全体のリスク回避意識の高まりがあります。自治体は、参加者の安全や社会的評価を守るため、厳格なルールを設けざるを得ません。例えば、飲酒の禁止や時間厳守の徹底は、トラブルを未然に防ぐための措置です。 一律処理の限界 成人式は、個人の成熟度とは無関係に、年齢を基準に一律に扱います。これは、制度としての効率性を優先せざるを得ないためです。しかし、個人の成長速度は異なるため、この一律処理が「管理」として感じられる一因となっています。 なぜ「祝福」より「管理」が目立つようになったのか 地域共同体の変化 かつての成人式は、地域共同体が主体となって運営されていました。しかし、都市化や核家族化が進む中、地域の絆は希薄化し、成人式は自治体主導のイベントへと変化しました。この結果、個々の参加者と地域とのつながりが薄れ、「管理」の色合いが強まっています。 リスク回避社会の構造 現代社会は、リスクを極力回避しようとする傾向が強まっています。SNSでの炎上やトラブルの拡散を恐れ、自治体は厳格なルールを設けるようになりました。この結果、成人式は「祝福」よりも「管理」が目立つ場へと変容しています。 「一人前」の定義の曖昧化 かつて、「大人」とは、家庭や職場で責任を果たす存在を指しました。しかし、現代では、「大人」の定義が曖昧になっています。経済的自立が難しい若者が増える中、成人式は形式的な通過儀礼として機能し、「祝福」の実感が薄れています。 ※(図:社会的通過儀礼の役割変化) 成人式は誰のための儀礼なのか 若者本人のための行事か 成人式は、若者本人が「大人」としての自覚を持つための場であるはずです。しかし、現実には、振袖のレンタルや写真撮影など、形式的な要素が強調され、個人の成長との結びつきが希薄になっています。 社会の自己確認装置としての成人式 成人式は、社会が自らの秩序や価値観を確認する装置として機能しています。例えば、成人式でのトラブルは、「若者のモラルの低下」として語られ、社会の不安を映し出します。この意味で、成人式は社会の自己確認の場とも言えます。 まとめ:祝福と管理の二重性を考える 成人式は、祝福と管理のどちらか一方ではなく、両方を内包した制度です。祝福の場としての役割は依然として残っていますが、社会構造の変化に伴い、管理の色合いが強まっています。この違和感は、社会の変化を映し出す鏡でもあります。 本記事では、成人式を肯定も否定もしません。読者の皆さんが、自身の経験や立場と照らし合わせ、社会と個人の関係性を考え直すきっかけとなれば幸いです。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 現代日本における「成人式」は、 祝福の場なのか、それとも管理・統制の場なのか。 制度・社会構造・通過儀礼という観点から、 感情論や世代論に寄らず、AIの視点で冷静かつ構造的に考察してください。 【目的】 – 成人式を「良い/悪い」「必要/不要」といった二元論で判断しない – 成人式が果たしてきた役割と、現在生じている違和感の構造を整理する – 「祝福」と「管理」がなぜ同時に存在せざるを得ないのかを言語化する – 読者が、社会と個人の関係性を考え直すための視点を提供する 【読者像】 – 一般社会人(20〜60代) – 成人式を経験した人、または子どもを送り出す立場の人 – 社会制度や慣習に違和感を覚えつつも、言語化できていない層 – 若者批判や懐古主義には距離を置きたいと考えている読者 【記事構成】 1. 導入(問題提起) – 成人式が毎年「祝福」と「混乱」の両面で語られる理由を提示する – なぜ成人式は、単なるお祝い行事として受け取られなくなっているのか – 本記事では賛否ではなく「構造」を扱うことを明示する 2. 成人式が「祝福の場」として設計されてきた理由 – 成人式が社会的通過儀礼として果たしてきた役割を整理する – 「大人として認める」という社会側の宣言の意味を説明する – 法制度・権利・責任との象徴的な結びつきを示す 3. 成人式が「管理の場」にならざるを得ない構造 – 公的制度として運営される以上、管理や統制が不可避であることを説明する – 人数・安全・責任・リスク回避の観点から管理が強まる理由を整理する – 個人の成熟と無関係に一律で扱わざるを得ない制度の限界に触れる 4. なぜ「祝福」より「管理」が目立つようになったのか – 地域共同体の変化や匿名性の拡大 – リスク回避社会・炎上回避の構造 – 「一人前」の定義が曖昧になった現代社会の背景 – 若者側の変化ではなく、社会構造の変化として説明する 5. 成人式は誰のための儀礼なのか – 若者本人のための行事なのか – 社会が自らの秩序や価値観を確認する装置なのか – 成人式が「社会の自己確認」として機能している可能性を示す 6. まとめ – 成人式は祝福と管理のどちらかではなく、両方を内包した制度であることを整理する – 違和感そのものが、社会の変化を映し出していることを示す – 明確な結論は出さず、読者が自分なりに考える余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 若者批判・世代批判・道徳的評価は行わない – 抽象論に偏りすぎず、制度と社会の関係を具体的に示す 【執筆スタンス】 – 本記事は、正解や結論を断定するものではない – 成人式を肯定・否定する立場を取らず、構造の整理に徹する – 読者が自分自身の経験や立場と照らして考えられる材料を提示する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:成人式における祝福と管理の構造) ※(図:社会的通過儀礼の役割変化) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「成人式は誰のための儀礼なのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 現代日本の成人式は祝福の場か、管理の場か:制度と社会構造から見る通過儀礼の二重性 --- ## 1. 導入:祝福と混乱が交錯する成人式の現実 毎年1月、成人式は「祝福」と「混乱」の両極で語られます。振袖を着た若者たちの笑顔が報道される一方で、飲酒や喧嘩、SNSでの炎上など、ネガティブな話題も後を絶ちません。なぜ、成人式は単なるお祝い行事として受け取られなくなっているのでしょうか。 本記事では、成人式を「良い/悪い」「必要/不要」といった二元論で論じるのではなく、制度・社会構造・通過儀礼という観点から、その構造を冷静に整理します。成人式が果たしてきた役割と、現在生じている違和感の背景を探り、読者が社会と個人の関係性を考え直すきっかけを提供します。 --- ## 2. 成人式が「祝福の場」として設計されてきた理由 ### 社会的通過儀礼としての役割 成人式は、個人が「子ども」から「大人」へと移行する通過儀礼として、長らく社会に組み込まれてきました。この儀礼は、個人の成長を認めるだけでなく、社会が「大人」の定義を共有し、秩序を維持するための装置でもありました。 ### 「大人として認める」という社会的宣言 成人式は、法制度と密接に結びついています。20歳をもって成人と定める民法の規定は、権利と義務の開始を象徴します。例えば、選挙権の取得や契約行為の自由は、社会が個人に「大人」としての資格を与える瞬間です。この宣言は、個人にとっての自立の始まりであり、社会にとっては新たな成員の誕生を意味します。 ### 共同体の絆を再確認する場 かつての成人式は、地域共同体が若者を「大人」として迎え入れる場でもありました。親族や近隣住民が集まり、祝福の言葉をかけることで、地域の絆が再確認されてきました。このプロセスは、個人の成長を社会全体の問題として共有する機能を果たしていました。 ※(図:成人式における祝福と管理の構造) --- ## 3. 成人式が「管理の場」にならざるを得ない構造 ### 公的制度としての成人式 成人式は、地方自治体が主催する公的行事です。公的制度として運営される以上、管理や統制は不可避です。例えば、会場の確保、参加者の安全確保、交通整理、アルコール対策など、多くの管理業務が伴います。これらは、行事を円滑に進めるための必要条件です。 ### リスク回避と責任の問題 近年、成人式でのトラブルが増加している背景には、社会全体のリスク回避意識の高まりがあります。自治体は、参加者の安全や社会的評価を守るため、厳格なルールを設けざるを得ません。例えば、飲酒の禁止や時間厳守の徹底は、トラブルを未然に防ぐための措置です。 ### 一律処理の限界 成人式は、個人の成熟度とは無関係に、年齢を基準に一律に扱います。これは、制度としての効率性を優先せざるを得ないためです。しかし、個人の成長速度は異なるため、この一律処理が「管理」として感じられる一因となっています。 --- ## 4. なぜ「祝福」より「管理」が目立つようになったのか ### 地域共同体の変化 かつての成人式は、地域共同体が主体となって運営されていました。しかし、都市化や核家族化が進む中、地域の絆は希薄化し、成人式は自治体主導のイベントへと変化しました。この結果、個々の参加者と地域とのつながりが薄れ、「管理」の色合いが強まっています。 ### リスク回避社会の構造 現代社会は、リスクを極力回避しようとする傾向が強まっています。SNSでの炎上やトラブルの拡散を恐れ、自治体は厳格なルールを設けるようになりました。この結果、成人式は「祝福」よりも「管理」が目立つ場へと変容しています。 ### 「一人前」の定義の曖昧化 かつて、「大人」とは、家庭や職場で責任を果たす存在を指しました。しかし、現代では、「大人」の定義が曖昧になっています。経済的自立が難しい若者が増える中、成人式は形式的な通過儀礼として機能し、「祝福」の実感が薄れています。 ※(図:社会的通過儀礼の役割変化) --- ## 5. 成人式は誰のための儀礼なのか ### 若者本人のための行事か 成人式は、若者本人が「大人」としての自覚を持つための場であるはずです。しかし、現実には、振袖のレンタルや写真撮影など、形式的な要素が強調され、個人の成長との結びつきが希薄になっています。 ### 社会の自己確認装置としての成人式 成人式は、社会が自らの秩序や価値観を確認する装置として機能しています。例えば、成人式でのトラブルは、「若者のモラルの低下」として語られ、社会の不安を映し出します。この意味で、成人式は社会の自己確認の場とも言えます。 --- ## 6. まとめ:祝福と管理の二重性を考える 成人式は、祝福と管理のどちらか一方ではなく、両方を内包した制度です。祝福の場としての役割は依然として残っていますが、社会構造の変化に伴い、管理の色合いが強まっています。この違和感は、社会の変化を映し出す鏡でもあります。 本記事では、成人式を肯定も否定もしません。読者の皆さんが、自身の経験や立場と照らし合わせ、社会と個人の関係性を考え直すきっかけとなれば幸いです。 --- ## タイトル案 1. 成人式はなぜ祝福と管理の狭間で揺れ動くのか 2. 現代の成人式が映し出す社会と個人のズレとは何か 3. 通過儀礼としての成人式は誰のために存在するのか --- — AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年1月9日

-

中小企業はAIで生き残れるのか業務の構造が決め手となる|LeChatの考察

「AIを導入すれば中小企業は救われるのか」——この問いは、近年、経営者や従業員の間で頻繁に語られています。背景には、生成AIや業務自動化の進展が、大企業だけでなく中小企業にも影響を及ぼし始めている現実があります。しかし、この問いの本質は、AIそのものよりも、中小企業が長年抱えてきた構造的な課題にあります。AIが話題の中心にある一方で、中小企業が直面する問題——人手不足、属人化、価格競争、業務の非効率——は、決して新しいものではありません。これらの課題は、AIが登場する前から存在し、多くの企業で放置されてきました。本記事では、「AIが救いになる」という楽観論や「AIが淘汰を加速させる」という悲観論に流されることなく、構造を分解し、現実的な視点から考察します。 AI以前から存在していた中小企業の構造的課題 人手不足と属人化の悪循環 中小企業が抱える最大の課題の一つは、人手不足と業務の属人化です。多くの企業では、特定の従業員に業務が集中し、そのノウハウが共有されないまま、組織全体の生産性が低下しています。この構造は、AI以前から存在し、企業の成長を阻害してきました。 価格競争と業務の非効率 もう一つの課題は、価格競争に巻き込まれることで、利益率が低下し、業務の効率化が進まないことです。多くの企業が「安さ」で勝負するあまり、業務プロセスの見直しや改善が後回しになっています。この結果、非効率な業務が積み重なり、経営の余裕が失われています。 なぜこれらの問題が放置されてきたのか これらの課題が長年放置されてきた理由は、短期的な利益を優先し、構造的な改革を避けてきたからです。AIが登場した今、「AIが原因で苦しくなる」のではなく、「AIによってこれまで隠れていた問題が露呈する」と考えるべきです。 ※(図:中小企業の業務構造とAIの関与領域) AI導入によって強くなる中小企業の特徴 AIを「補助・増幅」として活用できる企業 AIを導入しても、それを「人の代替」としてではなく、「業務の補助・増幅」として活用できる企業が強くなります。例えば、業務の型が明確で、判断基準が言語化されている企業では、AIが業務の効率化を支援し、従業員がより付加価値の高い業務に集中できるようになります。 業務の型と判断基準の言語化 AIが効果を発揮するためには、業務の型が存在し、判断基準が言語化されていることが重要です。例えば、顧客対応のマニュアルが整備されている企業では、AIチャットボットが問い合わせ対応を補助し、従業員の負担を軽減します。このような企業では、AIが競争力を高めるツールとなります。 小規模でも競争力を高められるケース 小規模であっても、業務の型が明確で、AIを補助的に活用できる企業は、競争力を高めることができます。例えば、地域密着型のサービス業では、AIを活用した予約管理や顧客分析が、業務の効率化と顧客満足度の向上につながります。 AI導入によって淘汰が早まる中小企業の特徴 極端な属人化とブラックボックス化 一方、業務が極端に属人化し、ブラックボックス化している企業は、AI導入によって淘汰が早まるリスクがあります。AIは、業務プロセスが明確でない企業では、効果を発揮できません。むしろ、業務の非効率が露呈し、競争力が低下する可能性があります。 「AIを使わない自由」と「変化を検証しないリスク」 「AIを使わない自由」と「変化を検証しないリスク」は、区別して考える必要があります。AIを導入しない選択肢はありますが、その場合でも、業務プロセスの見直しや改善を検討することが重要です。AIが直接の原因ではなく、経営判断の遅れが致命傷になる構造を理解することが求められます。 ※(図:AI導入で広がる企業間格差のイメージ) 本当の分岐点はAIではなく「理解力」 自社の仕事を構造として理解しているか AI導入の有無よりも、「自社の仕事を構造として理解しているか」が重要です。AIは、業務プロセスが明確でない企業では、効果を発揮できません。逆に、業務の型が整備され、判断基準が言語化されている企業では、AIが競争力を高めるツールとなります。 人が担う価値、AIに任せられる作業、捨てるべき業務 AIを活用するためには、人が担うべき価値、AIに任せられる作業、捨てるべき業務を切り分ける視点が必要です。例えば、顧客との信頼関係構築は人が担い、データ分析や定型業務はAIに任せることで、業務の効率化と付加価値の向上が実現します。 AIは「選別装置」である 中小企業にとってのAIは、「選別装置」です。AIを導入することで、業務の型が整備されている企業は強くなり、整備されていない企業は淘汰されるリスクが高まります。しかし、AI自体が淘汰の原因ではなく、経営判断の遅れや構造的な課題が露呈するきっかけであることを理解することが重要です。 まとめ:AIは結果を分ける要因、原因ではない 中小企業がAIによって一律に救われるわけでも、淘汰されるわけでもありません。AIは、業務の型が整備されている企業とそうでない企業の間で、結果を分ける要因となります。しかし、AI自体が淘汰の原因ではなく、経営判断の遅れや構造的な課題が露呈するきっかけであることを理解することが重要です。 読者の皆さんには、自社や周囲の企業を見直すための問いを残します。「自社の業務は、AIを活用できる構造になっているだろうか」「AIを導入しない場合、どのようなリスクがあるだろうか」「人が担うべき価値は何か」——これらの問いを通じて、AI時代の中小企業の生き残りの条件を考えるきっかけとしてください。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 生成AI・業務自動化・経営環境の変化が進む中で、 「中小企業はAI導入によって救われるのか、それとも淘汰されるのか」 という問いについて、 感情論や成功事例の羅列に流されず、 構造的・現実的な視点から冷静に考察してください。 【目的】 – 「AIを入れれば中小企業は助かる」という単純な楽観論を避ける – 「AIで中小企業が潰れる」という悲観論もそのまま受け取らない – 中小企業が直面している問題を「AI以前の構造」と「AIによって加速される要因」に分けて整理する – 読者が自社や身近な企業を客観的に見直すための“思考の軸”を提供する 【読者像】 – 中小企業の経営者・役員 – 個人事業主・フリーランス – 中小企業で働く一般社員(20〜50代) – AIに強い関心はないが、無関係ではいられないと感じている層 【記事構成】 1. 導入(問題提起) – 「AI導入で中小企業は救われるのか」という問いがなぜ頻繁に語られるのかを整理する – AIが話題の中心にある一方で、中小企業の課題が必ずしも新しいものではないことに触れる – 本記事では「勝ち負け」を断定するのではなく、構造を分解して考える姿勢を示す 2. AI以前から存在していた中小企業の構造的課題 – 人手不足、属人化、価格競争、業務の非効率といった課題を整理する – なぜこれらの問題が長年放置されてきたのかを説明する – 「AIが原因で苦しくなる」のではなく、「AIで露呈する問題」である可能性を示す 3. AI導入によって強くなる中小企業の特徴 – AIを「人の代替」ではなく「業務の補助・増幅」として扱える企業の特徴を整理する – 業務の型が存在すること、判断基準が言語化されていることの重要性に触れる – 小規模であっても競争力を高められるケースを構造的に説明する – ※具体的な業種例を挙げてもよいが、成功を断定しないこと 4. AI導入によって淘汰が早まる中小企業の特徴 – 属人化が極端で業務がブラックボックス化している企業の脆弱性を整理する – 「AIを使わない自由」と「変化を検証しないリスク」を区別して説明する – AIが直接の原因ではなく、経営判断の遅れが致命傷になる構造を示す 5. 本当の分岐点はAIではなく「理解力」 – AI導入の有無ではなく、「自社の仕事を構造として理解しているか」が重要であることを説明する – 人が担う価値、AIに任せられる作業、捨てるべき業務を切り分ける視点を提示する – 中小企業にとってのAIを「選別装置」として位置づける 6. まとめ – 中小企業がAIによって一律に救われる/淘汰されるわけではないことを再確認する – AIは結果を分ける要因であり、原因ではないという視点で締めくくる – 読者自身が自社や周囲の企業を見直すための問いを残して終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 経営論・技術論に偏らず、現場感覚も踏まえた表現を心がける – 不安を煽るのではなく、思考を促す文章とする 【執筆スタンス】 – 本記事は正解や結論を断定するものではなく、構造整理を目的とした考察である – 特定の業種・規模・立場を過度に持ち上げたり否定したりしない – 読者が「自分の場合はどうか」を考えられる余白を重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、中小企業やAIとの関係が分かる表現を含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:中小企業の業務構造とAIの関与領域) ※(図:AI導入で広がる企業間格差のイメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AI時代に中小企業は生き残れるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # AI導入で中小企業は救われるのか、それとも淘汰されるのか——構造から考える生き残りの条件 --- ## 1. 導入:AI導入の「救い」と「淘汰」をめぐる問い 「AIを導入すれば中小企業は救われるのか」——この問いは、近年、経営者や従業員の間で頻繁に語られています。背景には、生成AIや業務自動化の進展が、大企業だけでなく中小企業にも影響を及ぼし始めている現実があります。しかし、この問いの本質は、AIそのものよりも、中小企業が長年抱えてきた構造的な課題にあります。 AIが話題の中心にある一方で、中小企業が直面する問題——人手不足、属人化、価格競争、業務の非効率——は、決して新しいものではありません。これらの課題は、AIが登場する前から存在し、多くの企業で放置されてきました。本記事では、「AIが救いになる」という楽観論や「AIが淘汰を加速させる」という悲観論に流されることなく、構造を分解し、現実的な視点から考察します。 --- ## 2. AI以前から存在していた中小企業の構造的課題 ### 人手不足と属人化の悪循環 中小企業が抱える最大の課題の一つは、人手不足と業務の属人化です。多くの企業では、特定の従業員に業務が集中し、そのノウハウが共有されないまま、組織全体の生産性が低下しています。この構造は、AI以前から存在し、企業の成長を阻害してきました。 ### 価格競争と業務の非効率 もう一つの課題は、価格競争に巻き込まれることで、利益率が低下し、業務の効率化が進まないことです。多くの企業が「安さ」で勝負するあまり、業務プロセスの見直しや改善が後回しになっています。この結果、非効率な業務が積み重なり、経営の余裕が失われています。 ### なぜこれらの問題が放置されてきたのか これらの課題が長年放置されてきた理由は、短期的な利益を優先し、構造的な改革を避けてきたからです。AIが登場した今、「AIが原因で苦しくなる」のではなく、「AIによってこれまで隠れていた問題が露呈する」と考えるべきです。 ※(図:中小企業の業務構造とAIの関与領域) --- ## 3. AI導入によって強くなる中小企業の特徴 ### AIを「補助・増幅」として活用できる企業 AIを導入しても、それを「人の代替」としてではなく、「業務の補助・増幅」として活用できる企業が強くなります。例えば、業務の型が明確で、判断基準が言語化されている企業では、AIが業務の効率化を支援し、従業員がより付加価値の高い業務に集中できるようになります。 ### 業務の型と判断基準の言語化 AIが効果を発揮するためには、業務の型が存在し、判断基準が言語化されていることが重要です。例えば、顧客対応のマニュアルが整備されている企業では、AIチャットボットが問い合わせ対応を補助し、従業員の負担を軽減します。このような企業では、AIが競争力を高めるツールとなります。 ### 小規模でも競争力を高められるケース 小規模であっても、業務の型が明確で、AIを補助的に活用できる企業は、競争力を高めることができます。例えば、地域密着型のサービス業では、AIを活用した予約管理や顧客分析が、業務の効率化と顧客満足度の向上につながります。 --- ## 4. AI導入によって淘汰が早まる中小企業の特徴 ### 極端な属人化とブラックボックス化 一方、業務が極端に属人化し、ブラックボックス化している企業は、AI導入によって淘汰が早まるリスクがあります。AIは、業務プロセスが明確でない企業では、効果を発揮できません。むしろ、業務の非効率が露呈し、競争力が低下する可能性があります。 ### 「AIを使わない自由」と「変化を検証しないリスク」 「AIを使わない自由」と「変化を検証しないリスク」は、区別して考える必要があります。AIを導入しない選択肢はありますが、その場合でも、業務プロセスの見直しや改善を検討することが重要です。AIが直接の原因ではなく、経営判断の遅れが致命傷になる構造を理解することが求められます。 ※(図:AI導入で広がる企業間格差のイメージ) --- ## 5. 本当の分岐点はAIではなく「理解力」 ### 自社の仕事を構造として理解しているか AI導入の有無よりも、「自社の仕事を構造として理解しているか」が重要です。AIは、業務プロセスが明確でない企業では、効果を発揮できません。逆に、業務の型が整備され、判断基準が言語化されている企業では、AIが競争力を高めるツールとなります。 ### 人が担う価値、AIに任せられる作業、捨てるべき業務 AIを活用するためには、人が担うべき価値、AIに任せられる作業、捨てるべき業務を切り分ける視点が必要です。例えば、顧客との信頼関係構築は人が担い、データ分析や定型業務はAIに任せることで、業務の効率化と付加価値の向上が実現します。 ### AIは「選別装置」である 中小企業にとってのAIは、「選別装置」です。AIを導入することで、業務の型が整備されている企業は強くなり、整備されていない企業は淘汰されるリスクが高まります。しかし、AI自体が淘汰の原因ではなく、経営判断の遅れが致命傷になる構造を理解することが重要です。 --- ## 6. まとめ:AIは結果を分ける要因、原因ではない 中小企業がAIによって一律に救われるわけでも、淘汰されるわけでもありません。AIは、業務の型が整備されている企業とそうでない企業の間で、結果を分ける要因となります。しかし、AI自体が淘汰の原因ではなく、経営判断の遅れや構造的な課題が露呈するきっかけであることを理解することが重要です。 読者の皆さんには、自社や周囲の企業を見直すための問いを残します。「自社の業務は、AIを活用できる構造になっているだろうか」「AIを導入しない場合、どのようなリスクがあるだろうか」「人が担うべき価値は何か」——これらの問いを通じて、AI時代の中小企業の生き残りの条件を考えるきっかけとしてください。 --- ### タイトル案 1. 中小企業はAIで生き残れるのか業務の構造が決め手となる 2. AI導入で中小企業の未来はどう変わる業務プロセスの見直しが鍵 3. 中小企業の生き残りを左右するAIと業務構造の関係とは --- AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年1月9日

-

日本の賃上げは一時的な現象か構造的な転換か人口と物価の行方で考える|LeChatの考察

春の労働戦線で「過去最大の賃上げ」が報じられるようになって数年が経ちました。大手企業を中心に、ベア(基礎賃金)の引き上げやボーナスの増額が相次ぎ、政府も「賃上げの好循環」を強調しています。しかし、スーパーのレジで見る値札や、毎月の光熱費の明細を見たとき、「本当に自分の生活は良くなっているのか?」と疑問を感じる人も少なくないでしょう。このギャップはなぜ生まれるのでしょうか。そして、今後も賃上げは続くのでしょうか。この問いは、単に「給料が増えるかどうか」という問題を超えて、日本経済の構造的な課題——人口減少、人手不足、生産性、企業収益——と直結しています。本記事では、AIの視点から、賃上げの持続可能性を冷静に整理し、読者が自らの将来を考えるための材料を提供します。 なぜ今、日本で賃上げが起きているのか 人手不足と物価上昇:二つの圧力 賃上げの背景には、主に三つの要因があります。 ① 人手不足の深刻化 日本の労働人口は1990年代半ばをピークに減少を続けています。2024年の有効求人倍率は1.3倍前後で推移し、企業は採用難に直面しています。特に、介護、建設、運輸業界では、人材確保のために賃金を引き上げざるを得ない状況が続いています。 ② 物価上昇の波 2022年以降、エネルギー価格の高騰や円安の影響で、日本でも物価上昇が進みました。企業は従業員の生活を守るため、賃上げを余儀なくされています。しかし、これは「追い上げ」の側面が強く、企業収益の増加を伴わない場合もあります。 ③ 政策的後押し 政府は、税制優遇や補助金を通じて賃上げを促進しています。例えば、2024年度からは、賃上げを行った中小企業に対する支援策が拡充されました。これは、一時的なインフレ対策としての側面もありますが、長期的な賃金上昇の土台となるかは不透明です。 ※(図:賃上げを左右する要因の構造) 過去との違い:デフレ期との比較 1990年代以降のデフレ期、日本企業は「賃金抑制」を続けてきました。しかし、今般の賃上げは、デフレ脱却を目指す政府の方針と、労働市場の構造的な変化(少子高齢化による人手不足)が重なった結果です。つまり、賃上げは「政策」と「人口構造」の両面から後押しされていると言えます。 ただし、この流れが「一時的」なのか「構造的」なのかは、企業の収益力と生産性向上の成否にかかっています。 賃上げを続けられる企業・続けられない企業の違い 大企業と中小企業の体力差 賃上げの持続可能性は、企業の規模や業種によって大きく異なります。 大企業の強み 価格転嫁力が高い(例:自動車メーカー、電機メーカー) 海外収益が円安で増加(例:トヨタ、ソニー) 資金力があり、一時的なコスト増でも吸収可能 中小企業の課題 価格転嫁が難しい(例:下請け企業、小売業) 人件費上昇を売上増でカバーできない 政策支援に依存せざるを得ない 業種別の賃上げ格差 業種 賃上げ余地 理由 IT・金融 高 高付加価値、人材不足 製造業(大手) 中〜高 海外収益、価格転嫁力 小売・サービス 低 価格転嫁難、利益率低 介護・運輸 低〜中 公的補助に依存、人手不足 ※(図:企業収益・賃金・物価の関係) 「賃上げできる企業」と「できない企業」の分かれ目 賃上げを続けられるかどうかは、以下の要因で決まります: 価格転嫁力:製品・サービスの価格を上げられるか 生産性向上:人件費上昇を労働生産性でカバーできるか 収益構造:海外収益や付加価値の高さ 例えば、トヨタは海外売上比率が高く、円安で収益が増加しているため、賃上げが可能です。一方、国内の小売店は、価格転嫁が難しく、賃上げが収益を圧迫するリスクがあります。 実質賃金という視点 名目賃金と実質賃金の違い 賃上げが報じられても、「実感がない」と感じる理由の一つに、実質賃金の問題があります。 名目賃金:給与明細に記載される金額(例:月給30万円) 実質賃金:物価上昇を考慮した「実質的な購買力」(例:物価上昇2%なら、実質賃金は2%減) 2023年の日本の実質賃金は、名目賃金が上昇しても、物価上昇率を下回り、実質的には減少しています。つまり、「賃上げ」があっても、生活が「豊かになった」とは限らないのです。 賃上げが生活改善につながる条件 賃上げが実質的な生活改善につながるためには: 賃上げ率 > 物価上昇率であること 企業の収益力が持続すること 生産性向上で人件費上昇を吸収できること 現在の日本経済では、1と2が課題です。特に、中小企業では、賃上げが物価上昇に追いつかないケースが多く見られます。 日本の賃上げは構造転換に向かうのか 人口減少・省力化・生産性向上との関係 日本の賃上げが「構造的に定着」するかどうかは、以下の三つのシナリオで考えられます。 シナリオ1:賃上げが定着する場合 人口減少による人手不足が続き、企業は賃上げで人材確保を優先 生産性向上(AI・ロボット活用)で人件費上昇を吸収 政策支援が継続し、中小企業も賃上げを実現 シナリオ2:賃上げが失速する場合 物価上昇が収まり、企業の賃上げ意欲が低下 海外収益の減少(例:円高)で大企業の賃上げ余力が縮小 中小企業の倒産増加で、賃上げの波が後退 シナリオ3:二極化が進む場合 大企業と一部の高付加価値業種では賃上げが続く 中小企業や低付加価値業種では賃上げが停滞 格差が拡大し、社会的な不満が高まる 楽観・悲観に偏らない考察 現在の賃上げは、「一時的な現象」とも「構造転換の始まり」とも言えます。重要なのは、賃上げを「意思」だけで続けられるものではないということです。企業の収益力、生産性、政策の継続性——これらが複雑に絡み合って、賃上げの行方は決まります。 まとめ:賃上げは「意思」だけでは続かない 日本企業の賃上げは、人手不足と物価上昇という「外圧」と、政策的な後押しという「内圧」によって進んでいます。しかし、それが持続するかどうかは、企業の収益力と生産性向上にかかっています。大企業と中小企業、業種間の格差は今後も広がる可能性があり、実質賃金の動向も不透明です。 読者の皆さんに問いかけたいのは、「賃上げが続いたとして、それはあなたの生活を本当に豊かにするのか」ということです。物価上昇、人口減少、技術革新——これらの要因を踏まえ、自らのキャリアや消費行動を考え直すきっかけとして、本記事が役立てば幸いです。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 日本企業は、今後も賃上げを継続できるのか。 物価上昇、人口減少、人手不足、生産性、企業収益といった要素を踏まえ、 日本の賃上げが「一時的な現象」なのか、 それとも「構造的に定着する流れ」なのかを、 AIの視点から冷静かつ現実的に整理・考察してください。 【目的】 – 「賃上げは良い/悪い」といった単純な評価ではなく、構造的な持続可能性を整理する – 大企業と中小企業、業種間の差、実質賃金という論点を可視化する – 読者が日本経済や自分の将来を考えるための“思考の材料”を提供する 【読者像】 – 一般社会人(20〜60代) – 賃上げや物価上昇を実感している層 – 日本経済の先行きに漠然とした不安や関心を持つ人 – 経済に詳しくはないが、無関係ではいられないと感じている読者 【記事構成】 1. 導入(問題提起) – 近年続く賃上げ報道と、生活実感とのズレに触れる – 「この賃上げは続くのか?」という素朴な疑問を提示する – なぜ今このテーマを考える必要があるのかを簡潔に示す 2. なぜ今、日本で賃上げが起きているのか – 人手不足、物価上昇、政策的後押しといった背景を整理する – 過去との違い(デフレ期との比較)を構造的に説明する – 一時的要因と中長期要因を分けて考察する 3. 賃上げを続けられる企業・続けられない企業の違い – 大企業と中小企業の体力差に触れる – 業種・収益構造・価格転嫁力の違いを整理する – 「賃上げできる企業」と「できない企業」が生まれる理由を説明する 4. 実質賃金という視点 – 名目賃金と実質賃金の違いを簡潔に説明する – 賃上げが生活の改善につながる条件を整理する – 賃金上昇と物価上昇の関係性を冷静に分析する 5. 日本の賃上げは構造転換に向かうのか – 人口減少・省力化・生産性向上との関係を考察する – 賃上げが定着する場合と、失速する場合のシナリオを示す – 楽観・悲観に偏らず、複数の可能性を提示する 6. まとめ – 賃上げは「意思」だけでは続かないことを確認する – 日本企業と社会が直面している構造的課題を再整理する – 読者が自分の立場で考える余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的な表現は避ける – 経済用語は使用してよいが、必ず簡潔な補足説明を入れる – 結論を押し付けず、思考を促す構成とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではない – 複数の要因・制約・前提条件を整理した「考察」として執筆する – 特定の政策・思想・立場への誘導は行わない 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:賃上げを左右する要因の構造) ※(図:企業収益・賃金・物価の関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「日本企業は賃上げを続けられるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 日本企業の賃上げは構造的に定着するのか——物価、人口、生産性の交差点で考える --- ## 1. 導入:賃上げ報道と生活実感のズレ 春の労働戦線で「過去最大の賃上げ」が報じられるようになって数年が経ちました。大手企業を中心に、ベア(基礎賃金)の引き上げやボーナスの増額が相次ぎ、政府も「賃上げの好循環」を強調しています。しかし、スーパーのレジで見る値札や、毎月の光熱費の明細を見たとき、「本当に自分の生活は良くなっているのか?」と疑問を感じる人も少なくないでしょう。 このギャップはなぜ生まれるのでしょうか。そして、今後も賃上げは続くのでしょうか。この問いは、単に「給料が増えるかどうか」という問題を超えて、日本経済の構造的な課題——人口減少、人手不足、生産性、企業収益——と直結しています。本記事では、AIの視点から、賃上げの持続可能性を冷静に整理し、読者が自らの将来を考えるための材料を提供します。 --- ## 2. なぜ今、日本で賃上げが起きているのか ### 人手不足と物価上昇:二つの圧力 賃上げの背景には、主に三つの要因があります。 **① 人手不足の深刻化** 日本の労働人口は1990年代半ばをピークに減少を続けています。2024年の有効求人倍率は1.3倍前後で推移し、企業は採用難に直面しています。特に、介護、建設、運輸業界では、人材確保のために賃金を引き上げざるを得ない状況が続いています。 **② 物価上昇の波** 2022年以降、エネルギー価格の高騰や円安の影響で、日本でも物価上昇が進みました。企業は従業員の生活を守るため、賃上げを余儀なくされています。しかし、これは「追い上げ」の側面が強く、企業収益の増加を伴わない場合もあります。 **③ 政策的後押し** 政府は、税制優遇や補助金を通じて賃上げを促進しています。例えば、2024年度からは、賃上げを行った中小企業に対する支援策が拡充されました。これは、一時的なインフレ対策としての側面もありますが、長期的な賃金上昇の土台となるかは不透明です。 ※(図:賃上げを左右する要因の構造) ### 過去との違い:デフレ期との比較 1990年代以降のデフレ期、日本企業は「賃金抑制」を続けてきました。しかし、今般の賃上げは、デフレ脱却を目指す政府の方針と、労働市場の構造的な変化(少子高齢化による人手不足)が重なった結果です。つまり、賃上げは「政策」と「人口構造」の両面から後押しされていると言えます。 ただし、この流れが「一時的」なのか「構造的」なのかは、企業の収益力と生産性向上の成否にかかっています。 --- ## 3. 賃上げを続けられる企業・続けられない企業の違い ### 大企業と中小企業の体力差 賃上げの持続可能性は、企業の規模や業種によって大きく異なります。 **大企業の強み** – 価格転嫁力が高い(例:自動車メーカー、電機メーカー) – 海外収益が円安で増加(例:トヨタ、ソニー) – 資金力があり、一時的なコスト増でも吸収可能 **中小企業の課題** – 価格転嫁が難しい(例:下請け企業、小売業) – 人件費上昇を売上増でカバーできない – 政策支援に依存せざるを得ない ### 業種別の賃上げ格差 業種によっても、賃上げの余地は異なります。 | 業種 | 賃上げ余地 | 理由 | |---------------|------------|-------------------------------| | IT・金融 | 高 | 高付加価値、人材不足 | | 製造業(大手)| 中〜高 | 海外収益、価格転嫁力 | | 小売・サービス| 低 | 価格転嫁難、利益率低 | | 介護・運輸 | 低〜中 | 公的補助に依存、人手不足 | ※(図:企業収益・賃金・物価の関係) ### 「賃上げできる企業」と「できない企業」の分かれ目 賃上げを続けられるかどうかは、以下の要因で決まります: – **価格転嫁力**:製品・サービスの価格を上げられるか – **生産性向上**:人件費上昇を労働生産性でカバーできるか – **収益構造**:海外収益や付加価値の高さ 例えば、トヨタは海外売上比率が高く、円安で収益が増加しているため、賃上げが可能です。一方、国内の小売店は、価格転嫁が難しく、賃上げが収益を圧迫するリスクがあります。 --- ## 4. 実質賃金という視点 ### 名目賃金と実質賃金の違い 賃上げが報じられても、「実感がない」と感じる理由の一つに、**実質賃金**の問題があります。 – **名目賃金**:給与明細に記載される金額(例:月給30万円) – **実質賃金**:物価上昇を考慮した「実質的な購買力」(例:物価上昇2%なら、実質賃金は2%減) 2023年の日本の実質賃金は、名目賃金が上昇しても、物価上昇率を下回り、実質的には減少しています。つまり、「賃上げ」があっても、生活が「豊かになった」とは限らないのです。 ### 賃上げが生活改善につながる条件 賃上げが実質的な生活改善につながるためには: 1. **賃上げ率 > 物価上昇率**であること 2. **企業の収益力が持続**すること 3. **生産性向上**で人件費上昇を吸収できること 現在の日本経済では、1と2が課題です。特に、中小企業では、賃上げが物価上昇に追いつかないケースが多く見られます。 --- ## 5. 日本の賃上げは構造転換に向かうのか ### 人口減少・省力化・生産性向上との関係 日本の賃上げが「構造的に定着」するかどうかは、以下の三つのシナリオで考えられます。 **シナリオ1:賃上げが定着する場合** – 人口減少による人手不足が続き、企業は賃上げで人材確保を優先 – 生産性向上(AI・ロボット活用)で人件費上昇を吸収 – 政策支援が継続し、中小企業も賃上げを実現 **シナリオ2:賃上げが失速する場合** – 物価上昇が収まり、企業の賃上げ意欲が低下 – 海外収益の減少(例:円高)で大企業の賃上げ余力が縮小 – 中小企業の倒産増加で、賃上げの波が後退 **シナリオ3:二極化が進む場合** – 大企業と一部の高付加価値業種では賃上げが続く – 中小企業や低付加価値業種では賃上げが停滞 – 格差が拡大し、社会的な不満が高まる ### 楽観・悲観に偏らない考察 現在の賃上げは、「一時的な現象」とも「構造転換の始まり」とも言えます。重要なのは、賃上げを「意思」だけで続けられるものではないということです。企業の収益力、生産性、政策の継続性——これらが複雑に絡み合って、賃上げの行方は決まります。 --- ## 6. まとめ:賃上げは「意思」だけでは続かない 日本企業の賃上げは、人手不足と物価上昇という「外圧」と、政策的な後押しという「内圧」によって進んでいます。しかし、それが持続するかどうかは、企業の収益力と生産性向上にかかっています。大企業と中小企業、業種間の格差は今後も広がる可能性があり、実質賃金の動向も不透明です。 読者の皆さんに問いかけたいのは、「賃上げが続いたとして、それはあなたの生活を本当に豊かにするのか」ということです。物価上昇、人口減少、技術革新——これらの要因を踏まえ、自らのキャリアや消費行動を考え直すきっかけとして、本記事が役立てば幸いです。 --- ### タイトル案 1. 日本の賃上げは一時的な現象か構造的な転換か人口と物価の行方で考える 2. 企業の賃上げ余力はどこまで続くのか収益と生産性の現実をAIが分析する 3. 賃上げが生活を豊かにする条件とは実質賃金と企業格差の行方を探る --- — AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年1月9日