東京の街中を歩けば、オリンピックのシンボルマークとともに、大手企業のロゴが並んでいる光景を目にします。テレビ中継では、競技場の看板や選手のユニフォーム、デジタル広告に至るまで、スポンサー企業の存在が当たり前のように溶け込んでいます。しかし、ここで疑問が湧きます。「なぜ、企業はオリンピックに莫大な費用を投じるのでしょうか?」単なる広告費やイメージ向上だけでは、説明しきれない側面があるのです。オリンピックは、4年に一度のスポーツの祭典であると同時に、企業にとっては「参加権」を買う場でもあります。この記事では、スポンサー契約が単なる広告以上の意味を持つ理由を、制度・権利・象徴性・市場構造のレイヤーから整理し、企業が「何を買っているのか」を多面的に考察します。 スポンサー契約が「商品」として扱うもの ロゴ使用権と公式呼称の独占性 オリンピックのスポンサー契約では、企業は「オリンピック」というブランドを独占的に使用する権利を購入します。具体的には、以下のような権利が含まれます。 ロゴ使用権:オリンピックのシンボルマークや「公式スポンサー」の呼称を、自社の広告や商品に使用できる権利。 独占的マーケティング権:同業他社がオリンピックと関連付けた広告活動を行えないようにする権利。 公式呼称:「オリンピック公式パートナー」など、公式の肩書きを名乗ることができる権利。 これらの権利は、単なる広告露出以上の価値を持ちます。例えば、競合他社がオリンピックと関連付けたキャンペーンを行えないようにする「競合排除」の効果は、市場における優位性を確保するための重要な要素です。 放送・デジタル・現地空間における露出の意味 オリンピックのスポンサーシップは、テレビ放送、デジタルプラットフォーム、現地の競技場や街中での露出を保証します。これらの露出は、単なる視認性以上の意味を持ちます。 テレビ放送:世界中の視聴者に向けて、企業のロゴやメッセージが繰り返し映し出されます。これは、ブランドの認知度向上だけでなく、国際的な信頼性の構築にもつながります。 デジタル空間:SNSや公式ウェブサイトでの露出は、若年層を中心にしたエンゲージメントの向上に寄与します。 現地空間:競技場や街中での看板や広告は、実際にオリンピックを体験する観客に直接アプローチする手段となります。 競合排除という視点 スポンサー契約の最大の特徴の一つは、競合他社を排除することです。オリンピックのスポンサーは、同業他社がオリンピックと関連付けた広告活動を行えないようにする権利を持っています。これは、市場における独占的な地位を確保するための戦略的な投資と言えるでしょう。 ブランドと象徴性の結びつき オリンピックが持つ価値観と企業ブランド オリンピックは、「平和」「努力」「国際性」「公正性」といった普遍的な価値観を象徴しています。企業は、これらの価値観を自社のブランドと結びつけることで、消費者の心理的な共感を得ようとします。 平和と国際性:オリンピックは、世界中の国々が一つの場に集まるイベントです。企業は、この国際性を自社のグローバルな活動と結びつけることで、国際的な信頼性をアピールします。 努力と公正性:オリンピックの選手たちの努力や公正な競技は、企業のブランドイメージを高めるためのストーリーとして活用されます。 ※(図:ブランド価値と象徴性の接続イメージ) スポーツイベントが「意味の装置」として機能する理由 スポーツイベント、特にオリンピックは、単なる競技の場ではなく、「意味の装置」として機能します。企業は、この装置を通じて、自社のブランドに新たな意味や価値を付与しようとします。例えば、環境問題に取り組む企業がオリンピックのサステナビリティ活動と連携することで、自社の環境への取り組みを強調することができます。 消費者の認知や感情との関係性 消費者は、オリンピックと結びついた企業に対して、特別な感情や信頼を抱く傾向があります。これは、「オリンピック=信頼できるイベント」という認知が、スポンサー企業にも転移するためです。企業は、この認知を活用して、消費者とのエモーショナルなつながりを強化しようとします。 経済システムとしてのオリンピックと企業 IOCや大会運営側の収益構造とスポンサーの役割 オリンピックの運営には、莫大な費用がかかります。その費用の多くは、スポンサー企業からの収入によって賄われています。国際オリンピック委員会(IOC)や大会運営側は、スポンサーからの収入を、競技運営やインフラ整備、放送権の管理などに充てています。 放送権:オリンピックの放送権は、高額で取引されます。スポンサー企業は、この放送権と連動した広告活動を行うことで、より多くの視聴者にアプローチできます。 都市開発と観光:オリンピックは、開催都市のインフラ整備や観光産業の活性化にもつながります。スポンサー企業は、この経済効果を自社のビジネスチャンスとして活用します。 ※(図:オリンピックの収益構造とスポンサーの位置づけ) 放映権・都市開発・観光・国際政治との関係性 オリンピックは、単なるスポーツイベントではなく、国際政治や経済の舞台でもあります。スポンサー企業は、この舞台に参加することで、国際的な影響力を高めることができます。例えば、開催国の経済成長や国際的なイメージ向上に貢献することで、企業はその国との関係を強化することができます。 スポンサー企業が参加することで成立する「グローバル市場」 オリンピックは、世界中の視聴者や消費者を一つの市場として結びつける役割を果たしています。スポンサー企業は、このグローバル市場に参加することで、自社の商品やサービスを世界中に展開する機会を得ます。これは、単なる広告効果を超えた、市場参入の戦略的な手段と言えるでしょう。 重要なのは「広告」ではなく「参加権」 スポンサーが「観客」ではなく「制度の一部」として組み込まれている理由 オリンピックのスポンサーは、単なる広告主ではなく、イベントの運営や価値創造に積極的に関与しています。例えば、技術提供やサステナビリティへの取り組みなど、スポンサー企業はオリンピックの成功に不可欠な役割を果たしています。これにより、企業は「制度の一部」として、オリンピックの公共性と商業性の両方に関与することができます。 なぜ一部の企業だけが参加できるのか オリンピックのスポンサーシップは、高額な費用と厳しい選考基準があります。これは、オリンピックのブランド価値を維持するための排他性です。一部の企業だけが参加できることで、スポンサー企業は他社と差別化された地位を確保することができます。 スポーツイベントが公共性と商業性を同時に持つ構造 オリンピックは、公共の祭典であると同時に、商業的なイベントでもあります。スポンサー企業は、この二面性を活用して、社会的な信頼性と商業的な利益を同時に追求します。例えば、社会貢献活動と連動したマーケティングを行うことで、企業は公共性と商業性のバランスを取ることができます。 まとめ:スポンサー企業が買っているもの オリンピックのスポンサー企業が「何を買っているのか」という問いに対して、単一の答えは存在しません。彼らは、広告露出やイメージ向上だけでなく、独占的な権利、象徴性、市場参入の機会、制度への参加権など、多層的な価値を購入しています。 この記事を通じて、読者の皆さんには、オリンピックと企業の関係性を多面的に考える視点を提供できたでしょうか。企業活動と公共イベントの関係性は、単なるビジネスの枠を超えて、社会や文化の構造に深く根ざしています。この複雑な関係性を理解することで、私たちは、スポーツイベントが持つ意味や、企業が追求する価値について、より深く考えるきっかけを得ることができるのです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 スポーツ・メディア・グローバル経済・ブランド戦略という観点から、 「オリンピックのスポンサー企業は、実際には“何を買っているのか”」という問いについて、 単なる広告契約や企業イメージ向上にとどまらず、 制度・権利・象徴性・市場構造のレイヤーを含めて、 AIの視点から冷静かつ構造的に整理・考察してください。 【目的】 – 「スポンサー=宣伝費」という単純な理解を超え、企業とオリンピックの関係構造を可視化する – スポーツイベントが経済・政治・文化・ブランド価値とどのように結びついているかを整理する – 読者が「企業は何に対してお金を払っているのか」を多面的に考えるための“視点”を提供する 【読者像】 – 一般社会人(20〜60代) – スポーツ観戦者・オリンピック視聴者 – 広告や企業活動に関心のある層 – 経済や社会の仕組みに漠然とした疑問を持つ読者 【記事構成】 1. 導入(問題提起) – オリンピックにおけるスポンサー企業のロゴや広告が日常的な風景になっていることを提示する – 「企業はなぜ莫大な費用を払うのか」という素朴な疑問を提示する – 単なる広告費では説明しきれない側面があることを示す 2. スポンサー契約が「商品」として扱うものの整理 – ロゴ使用権・公式呼称・独占的マーケティング権といった“権利”の構造を説明する – 放送・デジタル・現地空間における露出の意味を整理する – 「競合排除」という視点から見たスポンサー制度の特徴を説明する 3. ブランドと象徴性の結びつき – オリンピックが持つ価値観(平和・努力・国際性・公正性など)と企業ブランドの接続構造を整理する – スポーツイベントが「意味の装置」として機能する側面を説明する – 消費者の認知や感情との関係性を構造的に示す 4. 経済システムとしてのオリンピックと企業 – IOCや大会運営側の収益構造とスポンサーの役割を整理する – 放映権・都市開発・観光・国際政治との関係性に触れる – スポンサー企業が参加することで成立する「グローバル市場」の構造を説明する 5. 重要なのは「広告」ではなく「参加権」 – スポンサーが「観客」ではなく「制度の一部」として組み込まれている側面を整理する – なぜ一部の企業だけが参加できるのかという排他性の意味を説明する – スポーツイベントが公共性と商業性を同時に持つ構造を示す 6. まとめ – スポンサー企業が買っているものを、単一の答えに回収せず多層的に整理する – 読者が「企業活動と公共イベントの関係」を考える視点を提示して締めくくる – 評価や結論を押し付けず、思考の余白を残す 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「批判記事」ではなく、「仕組みを読み解く記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や制度的背景を整理したうえでの「考察」として執筆する – スポンサー企業・大会運営側・視聴者のいずれかに肩入れせず、 構造全体を俯瞰する視点を重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:オリンピックの収益構造とスポンサーの位置づけ) ※(図:ブランド価値と象徴性の接続イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「企業はなぜオリンピックに参加するのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # オリンピックのスポンサー企業は、実際には“何を買っているのか” --- ## 1. 導入:オリンピックと企業の「見えない契約」 東京の街中を歩けば、オリンピックのシンボルマークとともに、大手企業のロゴが並んでいる光景を目にします。テレビ中継では、競技場の看板や選手のユニフォーム、デジタル広告に至るまで、スポンサー企業の存在が当たり前のように溶け込んでいます。しかし、ここで疑問が湧きます。「なぜ、企業はオリンピックに莫大な費用を投じるのでしょうか?」単なる広告費やイメージ向上だけでは、説明しきれない側面があるのです。 オリンピックは、4年に一度のスポーツの祭典であると同時に、企業にとっては「参加権」を買う場でもあります。この記事では、スポンサー契約が単なる広告以上の意味を持つ理由を、制度・権利・象徴性・市場構造のレイヤーから整理し、企業が「何を買っているのか」を多面的に考察します。 --- ## 2. スポンサー契約が「商品」として扱うもの ### ロゴ使用権と公式呼称の独占性 オリンピックのスポンサー契約では、企業は「オリンピック」というブランドを独占的に使用する権利を購入します。具体的には、以下のような権利が含まれます。 - **ロゴ使用権**:オリンピックのシンボルマークや「公式スポンサー」の呼称を、自社の広告や商品に使用できる権利。 - **独占的マーケティング権**:同業他社がオリンピックと関連付けた広告活動を行えないようにする権利。 - **公式呼称**:「オリンピック公式パートナー」など、公式の肩書きを名乗ることができる権利。 これらの権利は、単なる広告露出以上の価値を持ちます。例えば、競合他社がオリンピックと関連付けたキャンペーンを行えないようにする「競合排除」の効果は、市場における優位性を確保するための重要な要素です。 ### 放送・デジタル・現地空間における露出の意味 オリンピックのスポンサーシップは、テレビ放送、デジタルプラットフォーム、現地の競技場や街中での露出を保証します。これらの露出は、単なる視認性以上の意味を持ちます。 - **テレビ放送**:世界中の視聴者に向けて、企業のロゴやメッセージが繰り返し映し出されます。これは、ブランドの認知度向上だけでなく、国際的な信頼性の構築にもつながります。 - **デジタル空間**:SNSや公式ウェブサイトでの露出は、若年層を中心にしたエンゲージメントの向上に寄与します。 - **現地空間**:競技場や街中での看板や広告は、実際にオリンピックを体験する観客に直接アプローチする手段となります。 ### 競合排除という視点 スポンサー契約の最大の特徴の一つは、競合他社を排除することです。オリンピックのスポンサーは、同業他社がオリンピックと関連付けた広告活動を行えないようにする権利を持っています。これは、市場における独占的な地位を確保するための戦略的な投資と言えるでしょう。 --- ## 3. ブランドと象徴性の結びつき ### オリンピックが持つ価値観と企業ブランド オリンピックは、「平和」「努力」「国際性」「公正性」といった普遍的な価値観を象徴しています。企業は、これらの価値観を自社のブランドと結びつけることで、消費者の心理的な共感を得ようとします。 - **平和と国際性**:オリンピックは、世界中の国々が一つの場に集まるイベントです。企業は、この国際性を自社のグローバルな活動と結びつけることで、国際的な信頼性をアピールします。 - **努力と公正性**:オリンピックの選手たちの努力や公正な競技は、企業のブランドイメージを高めるためのストーリーとして活用されます。 ※(図:ブランド価値と象徴性の接続イメージ) ### スポーツイベントが「意味の装置」として機能する理由 スポーツイベント、特にオリンピックは、単なる競技の場ではなく、「意味の装置」として機能します。企業は、この装置を通じて、自社のブランドに新たな意味や価値を付与しようとします。例えば、環境問題に取り組む企業がオリンピックのサステナビリティ活動と連携することで、自社の環境への取り組みを強調することができます。 ### 消費者の認知や感情との関係性 消費者は、オリンピックと結びついた企業に対して、特別な感情や信頼を抱く傾向があります。これは、「オリンピック=信頼できるイベント」という認知が、スポンサー企業にも転移するためです。企業は、この認知を活用して、消費者とのエモーショナルなつながりを強化しようとします。 --- ## 4. 経済システムとしてのオリンピックと企業 ### IOCや大会運営側の収益構造とスポンサーの役割 オリンピックの運営には、莫大な費用がかかります。その費用の多くは、スポンサー企業からの収入によって賄われています。国際オリンピック委員会(IOC)や大会運営側は、スポンサーからの収入を、競技運営やインフラ整備、放送権の管理などに充てています。 - **放送権**:オリンピックの放送権は、高額で取引されます。スポンサー企業は、この放送権と連動した広告活動を行うことで、より多くの視聴者にアプローチできます。 - **都市開発と観光**:オリンピックは、開催都市のインフラ整備や観光産業の活性化にもつながります。スポンサー企業は、この経済効果を自社のビジネスチャンスとして活用します。 ※(図:オリンピックの収益構造とスポンサーの位置づけ) ### 放映権・都市開発・観光・国際政治との関係性 オリンピックは、単なるスポーツイベントではなく、国際政治や経済の舞台でもあります。スポンサー企業は、この舞台に参加することで、国際的な影響力を高めることができます。例えば、開催国の経済成長や国際的なイメージ向上に貢献することで、企業はその国との関係を強化することができます。 ### スポンサー企業が参加することで成立する「グローバル市場」 オリンピックは、世界中の視聴者や消費者を一つの市場として結びつける役割を果たしています。スポンサー企業は、このグローバル市場に参加することで、自社の商品やサービスを世界中に展開する機会を得ます。これは、単なる広告効果を超えた、市場参入の戦略的な手段と言えるでしょう。 --- ## 5. 重要なのは「広告」ではなく「参加権」 ### スポンサーが「観客」ではなく「制度の一部」として組み込まれている理由 オリンピックのスポンサーは、単なる広告主ではなく、イベントの運営や価値創造に積極的に関与しています。例えば、技術提供やサステナビリティへの取り組みなど、スポンサー企業はオリンピックの成功に不可欠な役割を果たしています。これにより、企業は「制度の一部」として、オリンピックの公共性と商業性の両方に関与することができます。 ### なぜ一部の企業だけが参加できるのか オリンピックのスポンサーシップは、高額な費用と厳しい選考基準があります。これは、オリンピックのブランド価値を維持するための排他性です。一部の企業だけが参加できることで、スポンサー企業は他社と差別化された地位を確保することができます。 ### スポーツイベントが公共性と商業性を同時に持つ構造 オリンピックは、公共の祭典であると同時に、商業的なイベントでもあります。スポンサー企業は、この二面性を活用して、社会的な信頼性と商業的な利益を同時に追求します。例えば、社会貢献活動と連動したマーケティングを行うことで、企業は公共性と商業性のバランスを取ることができます。 --- ## 6. まとめ:スポンサー企業が買っているもの オリンピックのスポンサー企業が「何を買っているのか」という問いに対して、単一の答えは存在しません。彼らは、広告露出やイメージ向上だけでなく、独占的な権利、象徴性、市場参入の機会、制度への参加権など、多層的な価値を購入しています。 この記事を通じて、読者の皆さんには、オリンピックと企業の関係性を多面的に考える視点を提供できたでしょうか。企業活動と公共イベントの関係性は、単なるビジネスの枠を超えて、社会や文化の構造に深く根ざしています。この複雑な関係性を理解することで、私たちは、スポーツイベントが持つ意味や、企業が追求する価値について、より深く考えるきっかけを得ることができるのです。 --- ## タイトル案 1. オリンピックスポンサーが購入する「見えない資産」とは何か 2. 企業はオリンピックで「参加権」を買っているのか 3. スポンサー契約が示すオリンピックと企業の「隠れた取引」 --- — AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年2月3日

LeChat

-

オリンピックスポンサーが購入する「見えない資産」とは何か|LeChatの考察

-

受験と祈願が結びつくのはなぜか心理と社会の構造から考える|LeChatの考察

毎年、冬から春にかけて、受験生やその家族が神社仏閣を訪れる光景が目立ちます。初詣やお守り、さまざまな験担ぎが、受験という「評価の瞬間」と強く結びついています。この現象を「迷信」や「気休め」と片付けるのは簡単です。しかし、なぜこれほどまでに根付いているのでしょうか?本記事では、「合理性」の議論を一旦横に置き、「なぜ結びつくのか」という問いを中心に、心理・社会・文化・制度の複数レイヤーから構造的に整理していきます。 受験という出来事の特徴:不確実性と評価の構造 努力と結果が直結しない要素 受験は、努力が必ずしも結果に直結しない「不確実性」を内包しています。例えば、当日の体調や試験問題の難易度、競争率、採点基準の微妙な違いなど、受験生個人のコントロールを超えた要因が数多く存在します。これらの要素は、受験生にとって「不安」や「無力感」を生み出す源となります。 「評価される」ことの心理的圧力 受験は、単なる学力テスト以上の意味を持ちます。それは、「自分がどれだけ価値があるか」を測られる瞬間でもあります。失敗の恐怖や自己否定の回避は、受験生にとって大きな心理的負担となります。このような状況下では、人は「コントロールできない領域」に対する不安を抱えやすくなります。 ※(図:受験における不確実性と安心の補完関係) 初詣・お守り・験担ぎが果たす役割:心理のレイヤー 不確実性を「意味」に変える 初詣やお守り、験担ぎは、不確実性を「意味」に変える働きを持ちます。例えば、合格祈願は「偶然」を「運命」や「努力の結実」として受け止める手助けとなります。これにより、受験生は「自分は無力ではない」という感覚を取り戻すことができます。 「コントロールできない領域」の外部化 お守りや験担ぎは、「コントロールできない領域」を外部化する役割を果たします。例えば、「合格祈願をしたから大丈夫」という思考は、受験生の心的負担を軽減する効果があります。これは、不安を「自分以外の何か」に委ねることで、精神的な余裕を生み出す仕組みと言えます。 儀式化による安心と集中 初詣やお守りの購入は、儀式化されることで安心感をもたらします。また、ルーティン化された行為は、受験生の集中力を高める効果も期待されます。ただし、これらの効果は個人差があり、断定することはできません。 社会・共同体のレイヤー:個人戦を儀式に変える 受験は個人競争だが、共同体が関与する 受験は個人の戦いですが、家族や学校、地域が関与しやすい構造を持っています。例えば、家族で初詣に行く、学校が合格祈願ツアーを企画するなど、受験は「個人の挑戦」から「共同体の通過儀礼」へと変換されます。 成功/失敗の物語化 合格祈願は、成功や失敗を物語化する役割も果たします。例えば、「お守りのおかげで合格した」という物語は、責任帰属を単純化し、受験生や家族の心理的負担を軽減します。 ※(図:個人競争が儀式化されるプロセス) 文化・制度のレイヤー:慣習としての宗教性 信仰というより慣習・年中行事 初詣やお守りは、信仰というよりも慣習や年中行事として位置づけられています。神社や寺、地域行事、受験産業(お守り市場や合格祈願ツアー)など、さまざまな要素が接続可能です。 「合理/非合理」の二項対立を超えて 受験と祈願の結びつきは、「合理/非合理」の二項対立で捉えるのではなく、文化的実装として理解することが重要です。これは、社会の中で自然発生的に形成された慣習の一つと言えます。 ※(図:心理・社会・文化・制度の4層モデル) 重要なのは「迷信か否か」ではなく「機能」 人によって役割が異なる 初詣やお守りは、人によって役割が異なります。安心、集中、区切り、連帯、物語化など、さまざまな機能を果たしています。受験と祈願の結びつきは、これらの機能を補完する役割を持っています。 読者への問い 読者の皆さんは、受験や評価される場面で、どのような「意味」や「安心」を求めてきましたか?この問いを通じて、自分自身の経験を振り返ってみてください。 まとめ:複数層で成立する受験と祈願の関係 受験と初詣・お守り・験担ぎの結びつきは、心理・社会・文化・制度の複数層で成立しています。本記事では、断定を避けつつ、「評価される局面で人が求めるもの」という視点を提示しました。読者の皆さんが、この構造を手がかりに、自分なりの考えを深めていただければ幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 教育制度・評価システム・不確実性・文化的慣習という観点から、 「なぜ受験と初詣・お守り・験担ぎが結びつくのか」という問いを、 心理的・社会的・制度的・文化的な複数のレイヤーで冷静かつ構造的に考察してください。 【目的】 – 「迷信」「気休め」「非合理」といった単純な説明に回収せず、なぜこの結びつきが社会の中で持続しているのかを構造として整理する – 受験が単なる学力評価ではなく、どのような社会的・文化的意味を帯びているかを可視化する – 読者が「評価される場面において人は何を求めるのか」という視点で考えるための材料を提供する 【読者像】 – 一般社会人(20〜50代) – 学生・受験生および保護者 – 教育や社会制度に関心があるが、専門的な議論には馴染みがない層 – 初詣・お守り・験担ぎを「やる/やらない」以前に、その背景の構造に興味がある人 【記事構成】 1. 導入(問題提起) – 受験期に初詣・お守り・験担ぎが目立つ現象を提示する – 「合理性」の議論に寄せず、まず“なぜ結びつくのか”を問いとして立てる – 本記事が断定ではなく、複数レイヤーの整理であることを明記する 2. 受験という出来事の特徴(不確実性と評価) – 努力と結果が直結しない要素(当日要因、競争、採点境界など)を整理する – 「評価される」ことがもたらす心理的圧力(失敗の恐怖、自己否定の回避)を構造化する – 受験が“学力テスト”以上の意味を帯びやすい背景に触れる 3. 初詣・お守り・験担ぎが果たす役割(心理のレイヤー) – 不確実性を「意味」に変える(偶然の受け止め方を整える)働きを説明する – 「コントロールできない領域」を外部化し、心的負担を軽減する仕組みを整理する – 儀式化による安心、ルーティン化による集中など、実務的な効果も断定せずに示す 4. 社会・共同体のレイヤー(個人戦を儀式に変える) – 受験が個人競争である一方、家族・学校・地域が関与しやすい構造を整理する – 合格祈願が「個人の挑戦」を「共同体の通過儀礼」に変換する点を説明する – 成功/失敗の物語化(責任帰属の単純化を避ける機能)に触れる 5. 文化・制度のレイヤー(慣習としての宗教性) – 信仰というより慣習・年中行事としての初詣の位置づけを整理する – 神社・寺・地域行事・受験産業(お守り市場、合格祈願ツアー等)などの接続可能性を示す – 「合理/非合理」の二項対立ではなく、文化的実装として捉える 6. 重要なのは“迷信か否か”ではなく“機能” – 同じ行為でも、人によって役割が違う(安心、集中、区切り、連帯、物語化)ことを整理する – 受験と祈願の結びつきが、何を補完しているのかを再提示する – 読者が自分の経験に照らして考えられる問いを残す 7. まとめ – 受験×初詣・お守り・験担ぎは、心理・社会・文化・制度の複数層で成立している可能性を確認する – 断定を避けつつ、「評価される局面で人が求めるもの」という視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:受験における不確実性と安心の補完関係) ※(図:個人競争が儀式化されるプロセス) ※(図:心理・社会・文化・制度の4層モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「受験と合格祈願はなぜ結びつくのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 受験と初詣・お守り・験担ぎが結びつく理由を構造的に考える --- ## 1. 導入:受験期に広がる「祈り」の風景 毎年、冬から春にかけて、受験生やその家族が神社仏閣を訪れる光景が目立ちます。初詣やお守り、さまざまな験担ぎが、受験という「評価の瞬間」と強く結びついています。この現象を「迷信」や「気休め」と片付けるのは簡単です。しかし、なぜこれほどまでに根付いているのでしょうか?本記事では、「合理性」の議論を一旦横に置き、「なぜ結びつくのか」という問いを中心に、心理・社会・文化・制度の複数レイヤーから構造的に整理していきます。 --- ## 2. 受験という出来事の特徴:不確実性と評価の構造 ### 努力と結果が直結しない要素 受験は、努力が必ずしも結果に直結しない「不確実性」を内包しています。例えば、当日の体調や試験問題の難易度、競争率、採点基準の微妙な違いなど、受験生個人のコントロールを超えた要因が数多く存在します。これらの要素は、受験生にとって「不安」や「無力感」を生み出す源となります。 ### 「評価される」ことの心理的圧力 受験は、単なる学力テスト以上の意味を持ちます。それは、「自分がどれだけ価値があるか」を測られる瞬間でもあります。失敗の恐怖や自己否定の回避は、受験生にとって大きな心理的負担となります。このような状況下では、人は「コントロールできない領域」に対する不安を抱えやすくなります。 ※(図:受験における不確実性と安心の補完関係) --- ## 3. 初詣・お守り・験担ぎが果たす役割:心理のレイヤー ### 不確実性を「意味」に変える 初詣やお守り、験担ぎは、不確実性を「意味」に変える働きを持ちます。例えば、合格祈願は「偶然」を「運命」や「努力の結実」として受け止める手助けとなります。これにより、受験生は「自分は無力ではない」という感覚を取り戻すことができます。 ### 「コントロールできない領域」の外部化 お守りや験担ぎは、「コントロールできない領域」を外部化する役割を果たします。例えば、「合格祈願をしたから大丈夫」という思考は、受験生の心的負担を軽減する効果があります。これは、不安を「自分以外の何か」に委ねることで、精神的な余裕を生み出す仕組みと言えます。 ### 儀式化による安心と集中 初詣やお守りの購入は、儀式化されることで安心感をもたらします。また、ルーティン化された行為は、受験生の集中力を高める効果も期待されます。ただし、これらの効果は個人差があり、断定することはできません。 --- ## 4. 社会・共同体のレイヤー:個人戦を儀式に変える ### 受験は個人競争だが、共同体が関与する 受験は個人の戦いですが、家族や学校、地域が関与しやすい構造を持っています。例えば、家族で初詣に行く、学校が合格祈願ツアーを企画するなど、受験は「個人の挑戦」から「共同体の通過儀礼」へと変換されます。 ### 成功/失敗の物語化 合格祈願は、成功や失敗を物語化する役割も果たします。例えば、「お守りのおかげで合格した」という物語は、責任帰属を単純化し、受験生や家族の心理的負担を軽減します。 ※(図:個人競争が儀式化されるプロセス) --- ## 5. 文化・制度のレイヤー:慣習としての宗教性 ### 信仰というより慣習・年中行事 初詣やお守りは、信仰というよりも慣習や年中行事として位置づけられています。神社や寺、地域行事、受験産業(お守り市場や合格祈願ツアー)など、さまざまな要素が接続可能です。 ### 「合理/非合理」の二項対立を超えて 受験と祈願の結びつきは、「合理/非合理」の二項対立で捉えるのではなく、文化的実装として理解することが重要です。これは、社会の中で自然発生的に形成された慣習の一つと言えます。 ※(図:心理・社会・文化・制度の4層モデル) --- ## 6. 重要なのは「迷信か否か」ではなく「機能」 ### 人によって役割が異なる 初詣やお守りは、人によって役割が異なります。安心、集中、区切り、連帯、物語化など、さまざまな機能を果たしています。受験と祈願の結びつきは、これらの機能を補完する役割を持っています。 ### 読者への問い 読者の皆さんは、受験や評価される場面で、どのような「意味」や「安心」を求めてきましたか?この問いを通じて、自分自身の経験を振り返ってみてください。 --- ## 7. まとめ:複数層で成立する受験と祈願の関係 受験と初詣・お守り・験担ぎの結びつきは、心理・社会・文化・制度の複数層で成立しています。本記事では、断定を避けつつ、「評価される局面で人が求めるもの」という視点を提示しました。読者の皆さんが、この構造を手がかりに、自分なりの考えを深めていただければ幸いです。 --- ## タイトル案 1. 受験と祈願が結びつくのはなぜか心理と社会の構造から考える 2. 初詣やお守りは受験生に何をもたらすのか不確実性と安心の関係 3. 受験と験担ぎの背後にある共同体と文化の仕組みを探る --- ## AIバージョン情報 — AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年2月2日

-

解散総選挙で人物が政策を上回るのはなぜか制度と認知から考える|LeChatの考察

解散総選挙が近づくと、「国民の信を問う」という言葉が頻繁に聞かれます。しかし、実際の選挙報道や議論を見てみると、政策論争よりも首相や党首、候補者の人物像が前面に出ることが少なくありません。例えば、選挙ポスターやテレビ討論では、政策の詳細よりもリーダーの表情や過去の発言、さらには私生活にまで言及されることがあります。なぜ、「何をするか」よりも「誰がやるか」が強調されるのでしょうか。この問いを考えるためには、政治制度、メディア環境、有権者心理、社会構造という複数のレイヤーを重ねて見る必要があります。選挙は、政策選択の場であると同時に、人物信任の場でもあるからです。ここでは、それぞれのレイヤーがどのように人物重視の構造を作り出しているのか、冷静に整理していきます。 制度のレイヤー:解散権とリーダーの関係 解散権の帰属と「人物」としての認識 日本の憲法では、衆議院の解散権は内閣に帰属しています。しかし、実際には「首相が解散を決める」と報道されることが多く、制度上の権限が「人物」に帰属するかのように認識されがちです。これは、解散が「制度の手続き」ではなく、「リーダーの意思」として語られる構造を生み出します。 議会制民主主義と政党リーダーの役割 議会制民主主義では、政党が政策をまとめ、リーダーがその顔となります。しかし、選挙戦では、政党の政策よりもリーダーの資質や信頼性が問われることが多くなります。これは、政党が政策を具体化する過程で、リーダーの判断やビジョンが前面に出るためです。例えば、マニフェスト(政党の公約)が抽象的な場合、それを具体化するのはリーダーの言葉や過去の実績となります。 ※(図:解散権の帰属とリーダー認識の関係) メディアのレイヤー:物語としての選挙報道 政策と人物の「伝えやすさ」の違い 政策は複雑で、説明するためには時間と文脈が必要です。一方、人物の評価は、映像や発言、対立構造を通じて簡潔に伝えることができます。例えば、テレビの選挙特番では、候補者の討論よりも、リーダー同士の一問一答や過去の失言がクローズアップされやすいのです。 ニュースの「物語化」と人物中心の構造 メディアは、選挙を「物語」として伝える傾向があります。物語には主人公と敵役、そしてドラマが必要です。政策論争は抽象的で物語性に欠けるため、人物の対立やドラマが前面に出るのです。例えば、「A党のリーダーがB党のリーダーを批判」という構図は、視聴者にとって理解しやすく、興味を引きやすいのです。 ※(図:メディア報道が人物中心化するプロセス) 有権者のレイヤー:認知的コストと感情の役割 多数の政策を比較する認知的コスト 有権者が複数の政策を比較することは、認知的に負荷がかかります。政策は専門的で、その影響を理解するためには時間と労力が必要です。一方、人物評価は、直感的で認知的コストが低いのです。例えば、「この人は信頼できるか」「過去の実績はどうか」といった判断は、政策の詳細を理解するよりも簡単です。 感情と投票判断の関係 有権者の投票行動には、信頼や安心、不安といった感情が大きく影響します。人物評価は、これらの感情と結びつきやすいのです。例えば、「このリーダーなら安心できる」という感情は、政策の詳細を理解しなくても、投票判断の根拠となります。 政党・政治構造のレイヤー:政策の見えにくさとリーダー対決 政策の違いが見えにくくなる状況 現代の政治では、主要政党の政策が似通ってきています。例えば、経済政策や社会保障政策では、大筋で共通する部分が多く、違いが見えにくくなっています。その結果、政策よりもリーダーの違いが選択の根拠となりやすいのです。 二大政党制とリーダー対決型選挙 二大政党制が強まるほど、選挙は「政策の選択」よりも「リーダーの選択」に近づきます。これは、政党間の政策差が縮小し、リーダーの資質やビジョンが選択の決め手となるためです。例えば、アメリカの大統領選挙やイギリスの総選挙では、リーダー同士の討論が選挙のハイライトとなります。 選挙の意味づけの変化:政策選択から政権信任へ 選挙の二重の役割 選挙は、政策選択の場であると同時に、政権への信任や不信任を問う場でもあります。特に解散総選挙では、「現政権を続けるか、交代させるか」という問いが強調されます。これは、政策の是非よりも、リーダーや政権への信頼が問われる構造を作り出します。 民主主義における選挙の役割の二重化 民主主義において、選挙は政策を選ぶ場であると同時に、政権の正統性を確認する儀式でもあります。この二重の役割が、人物重視の構造を強化しているのです。 まとめ:人物重視は「問題」か「適応」か 解散総選挙で人物が強調されるのは、制度、メディア、有権者心理、政治構造という複数のレイヤーが重なり合った結果です。これは、「問題」なのか、それとも現代の政治環境への「適応」なのか、一概に断定することはできません。重要なのは、それぞれのレイヤーがどのように影響し合っているのかを理解し、自分自身の選挙時の判断基準を振り返ることです。 次の選挙では、政策と人物のどちらを重視するのか。その判断は、あなた自身の価値観や優先順位によって変わってくるでしょう。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 政治制度・メディア環境・有権者心理・社会構造という観点から、 「解散総選挙において、なぜ政策よりも人物(リーダー像・個人評価)が強調されやすくなるのか」という問いを、 AIの視点で冷静かつ構造的に考察してください。 【目的】 – 「有権者が感情的だから」「メディアが煽っているから」といった単純化された説明に回収せず、制度・報道・認知・政治構造の重なりとして整理する – 選挙が「政策選択の場」と「人物信任の場」という二重の性格を持つことを可視化する – 読者が、自分自身の選挙時の判断基準を振り返るための“視点”を提供する 【読者像】 – 一般有権者(20〜60代) – 政治ニュースには触れているが、制度や構造までは深く考えたことがない層 – 選挙で「政策を見るべきか、人を見るべきか」に違和感や迷いを持っている人 – 政治に関心はあるが、特定の支持政党や立場に強く寄っていない層 【記事構成】 1. 導入(問題提起) – 解散総選挙が「国民の信を問う場」として語られることが多い現象を提示する – 実際の報道や議論では、政策よりも首相・党首・候補者の人物像が前面に出やすいことを指摘する – なぜ「何をするか」より「誰がやるか」が強調されるのか、という問いを提示する 2. 制度のレイヤー – 解散権が誰に帰属しているのかを整理する – 選挙の発動主体が「制度」ではなく「人物」として認識されやすい構造を説明する – 議会制民主主義における政党とリーダーの関係を簡潔に整理する 3. メディアのレイヤー – 政策と人物の「伝えやすさ」の違いを比較する – 映像・見出し・発言・対立構造が、どのように人物中心の物語を作りやすいかを説明する – ニュースが「比較」よりも「物語」になりやすい構造を整理する 4. 有権者のレイヤー – 多数の政策を比較することの認知的コストを説明する – 人物評価が「判断の近道」として機能する構造を整理する – 信頼・安心・不安といった感情が、どのように投票判断に組み込まれるかを説明する 5. 政党・政治構造のレイヤー – 政策の違いが見えにくくなる状況について整理する – マニフェストや公約が抽象化されるとき、人物差が前面に出やすくなる構造を説明する – 二大政党制的構図とリーダー対決型選挙の関係に触れる 6. 選挙の意味づけの変化 – 選挙が「政策選択」から「政権信任・不信任」の儀式として理解される構造を説明する – 民主主義における選挙の役割が、どのように二重化しているかを整理する 7. まとめ – 人物重視が「問題」なのか「適応」なのかを断定せず、構造として整理する – 読者が次の選挙で、どのレイヤーを重視するのかを考える余地を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「批判する記事」ではなく、「考えるための視点を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の政治的立場・価値観・支持政党を示唆しない – 読者が自分自身の判断基準を内省できる構成を重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:選挙における政策判断と人物判断の関係構造) ※(図:メディア報道が人物中心化するプロセス) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「選挙はいつから“人”を選ぶ場になったのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 解散総選挙で政策より人物が強調される理由:制度・メディア・認知の構造から考える --- ## 1. 導入:選挙は「誰がやるか」の問いになるのはなぜか 解散総選挙が近づくと、「国民の信を問う」という言葉が頻繁に聞かれます。しかし、実際の選挙報道や議論を見てみると、政策論争よりも首相や党首、候補者の人物像が前面に出ることが少なくありません。例えば、選挙ポスターやテレビ討論では、政策の詳細よりもリーダーの表情や過去の発言、さらには私生活にまで言及されることがあります。なぜ、「何をするか」よりも「誰がやるか」が強調されるのでしょうか。 この問いを考えるためには、政治制度、メディア環境、有権者心理、社会構造という複数のレイヤーを重ねて見る必要があります。選挙は、政策選択の場であると同時に、人物信任の場でもあるからです。ここでは、それぞれのレイヤーがどのように人物重視の構造を作り出しているのか、冷静に整理していきます。 --- ## 2. 制度のレイヤー:解散権とリーダーの関係 ### 解散権の帰属と「人物」としての認識 日本の憲法では、衆議院の解散権は内閣に帰属しています。しかし、実際には「首相が解散を決める」と報道されることが多く、制度上の権限が「人物」に帰属するかのように認識されがちです。これは、解散が「制度の手続き」ではなく、「リーダーの意思」として語られる構造を生み出します。 ### 議会制民主主義と政党リーダーの役割 議会制民主主義では、政党が政策をまとめ、リーダーがその顔となります。しかし、選挙戦では、政党の政策よりもリーダーの資質や信頼性が問われることが多くなります。これは、政党が政策を具体化する過程で、リーダーの判断やビジョンが前面に出るためです。例えば、マニフェスト(政党の公約)が抽象的な場合、それを具体化するのはリーダーの言葉や過去の実績となります。 ※(図:解散権の帰属とリーダー認識の関係) --- ## 3. メディアのレイヤー:物語としての選挙報道 ### 政策と人物の「伝えやすさ」の違い 政策は複雑で、説明するためには時間と文脈が必要です。一方、人物の評価は、映像や発言、対立構造を通じて簡潔に伝えることができます。例えば、テレビの選挙特番では、候補者の討論よりも、リーダー同士の一問一答や過去の失言がクローズアップされやすいのです。 ### ニュースの「物語化」と人物中心の構造 メディアは、選挙を「物語」として伝える傾向があります。物語には主人公と敵役、そしてドラマが必要です。政策論争は抽象的で物語性に欠けるため、人物の対立やドラマが前面に出るのです。例えば、「A党のリーダーがB党のリーダーを批判」という構図は、視聴者にとって理解しやすく、興味を引きやすいのです。 ※(図:メディア報道が人物中心化するプロセス) --- ## 4. 有権者のレイヤー:認知的コストと感情の役割 ### 多数の政策を比較する認知的コスト 有権者が複数の政策を比較することは、認知的に負荷がかかります。政策は専門的で、その影響を理解するためには時間と労力が必要です。一方、人物評価は、直感的で認知的コストが低いのです。例えば、「この人は信頼できるか」「過去の実績はどうか」といった判断は、政策の詳細を理解するよりも簡単です。 ### 感情と投票判断の関係 有権者の投票行動には、信頼や安心、不安といった感情が大きく影響します。人物評価は、これらの感情と結びつきやすいのです。例えば、「このリーダーなら安心できる」という感情は、政策の詳細を理解しなくても、投票判断の根拠となります。 --- ## 5. 政党・政治構造のレイヤー:政策の見えにくさとリーダー対決 ### 政策の違いが見えにくくなる状況 現代の政治では、主要政党の政策が似通ってきています。例えば、経済政策や社会保障政策では、大筋で共通する部分が多く、違いが見えにくくなっています。その結果、政策よりもリーダーの違いが選択の根拠となりやすいのです。 ### 二大政党制とリーダー対決型選挙 二大政党制が強まるほど、選挙は「政策の選択」よりも「リーダーの選択」に近づきます。これは、政党間の政策差が縮小し、リーダーの資質やビジョンが選択の決め手となるためです。例えば、アメリカの大統領選挙やイギリスの総選挙では、リーダー同士の討論が選挙のハイライトとなります。 --- ## 6. 選挙の意味づけの変化:政策選択から政権信任へ ### 選挙の二重の役割 選挙は、政策選択の場であると同時に、政権への信任や不信任を問う場でもあります。特に解散総選挙では、「現政権を続けるか、交代させるか」という問いが強調されます。これは、政策の是非よりも、リーダーや政権への信頼が問われる構造を作り出します。 ### 民主主義における選挙の役割の二重化 民主主義において、選挙は政策を選ぶ場であると同時に、政権の正統性を確認する儀式でもあります。この二重の役割が、人物重視の構造を強化しているのです。 --- ## 7. まとめ:人物重視は「問題」か「適応」か 解散総選挙で人物が強調されるのは、制度、メディア、有権者心理、政治構造という複数のレイヤーが重なり合った結果です。これは、「問題」なのか、それとも現代の政治環境への「適応」なのか、一概に断定することはできません。重要なのは、それぞれのレイヤーがどのように影響し合っているのかを理解し、自分自身の選挙時の判断基準を振り返ることです。 次の選挙では、政策と人物のどちらを重視するのか。その判断は、あなた自身の価値観や優先順位によって変わってくるでしょう。 --- ## タイトル案 1. 解散総選挙で人物が政策を上回るのはなぜか制度と認知から考える 2. 選挙は誰を選ぶ場になったのかメディアと有権者の構造を探る 3. 政策より人を選ぶ理由政治制度と感情の交差点で考える --- ## AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年2月2日

-

人工雪が問う冬季五輪の成立条件とは何か|LeChatの考察

冬季オリンピックが「人工雪なしで成立するのか」という問いは、単なる競技の実施可能性を超え、自然環境、技術、制度、資本、社会構造といった多層的な視点から考察する必要があります。「雪がなければ冬季五輪は成り立たない」という直感は、長らく冬季オリンピックの前提でした。しかし近年、人工雪は「例外」ではなく「前提」となりつつあります。2022年の北京冬季オリンピックでは、スキー競技の90%以上が人工雪で行われ、2026年のミラノ・コルティナ大会でも、自然降雪の減少と競技条件の安定化を理由に、人工雪への依存が進んでいます。この変化は、スポーツイベントが自然環境とどのように関わり、技術や制度とどのように結びついているのかを問うものです。なぜこの問いは、スポーツだけでなく社会構造の問題でもあるのでしょうか。それは、冬季オリンピックが「自然を祝う祭典」から「技術と制度で再現された冬のイベント」へと移行しつつあるからです。この移行は、競技の成立条件だけでなく、環境倫理、都市政策、経済、社会の価値観にまで影響を及ぼしています。 自然条件としての「冬」という前提 冬季オリンピックは、寒冷地・積雪地という地理条件に依存して成立してきました。第1回大会(1924年、フランス・シャモニー)から1970年代まで、雪は「環境」そのものであり、大会は自然の恵みを前提としていました。しかし、気候変動の影響で、雪が降り始める時期は遅くなり、溶けるのも早くなり、冬季の期間は短くなっています。例えば、札幌市の大倉山ジャンプ競技場では、人工雪を使いつつも、天然雪と混ざることで着地時のショックを和らげる必要があると指摘されています。自然条件が変化する中、開催地と自然の関係性も変わりました。かつては「雪がある都市」が選ばれましたが、今や「雪を作れる都市」が選ばれるようになっています。これは、自然条件から技術条件へのシフトを意味します。 技術インフラとしての人工雪 人工雪は、競技条件の標準化、放送・興行・運営面での安定性をもたらしました。雪が「自然現象」から「管理される資源」へと変わったことで、大会の開催条件は気候から、水・電力・設備・資本へと移行しています。北京冬季オリンピックでは、人工雪の使用率が90%に達し、大量の水とエネルギーが消費されました。人工雪は、競技の公平性や安全性を確保する一方で、環境負荷やコストの増大という新たな課題を生み出しています。競技会場の整備には、造雪機や水資源、電力が不可欠となり、開催条件は自然から技術へと依存度を高めています。 環境倫理と持続可能性の視点 人工雪の使用は、水資源の消費、エネルギー消費、生態系への影響、地域への長期的影響を引き起こします。北京冬季オリンピックでは、人工雪のために湿地が人工貯水池に変わり、川の一部が覆われるなど、環境への負荷が指摘されています。また、人工雪は天然雪に比べて硬く、選手のけがリスクも高まります。こうした状況は、「開催できるか」ではなく「開催すべきか」という問いを生み出しています。環境配慮は、象徴性やブランド価値、国際的評価と結びつき、持続可能性が大会の正当性を左右する要因となっています。 都市・制度・経済の側から見た成立条件 開催都市にとって、冬季オリンピックは観光、投資、国際的可視性の獲得という意味を持ちます。ミラノ・コルティナ2026大会では、既存施設の改修や仮設施設の活用が進められ、新規建設は最小限に抑えられています。これは、経済効果と環境負荷のバランスを取るための制度的な工夫です。人工雪は、自然条件の不確実性を補う「リスク管理装置」として機能し、自然条件よりも制度と資本が成立を左右する状況を生み出しています。しかし、巨額の投資や住民の反発、レガシー(遺産)の活用など、都市政策の課題も浮き彫りになっています。 「成立」という言葉の多層性 「成立」とは、競技としての成立、理念としての成立、制度としての成立、象徴としての成立など、レイヤーによって意味が異なります。 競技としての成立:競技が公平かつ安全に行われること。 理念としての成立:オリンピックの理念(平和、友好、持続可能性)が実現されること。 制度としての成立:経済的、政治的、社会的に受容されること。 象徴としての成立:世界中の人々に夢や感動を与えること。 それぞれのレイヤーで、成立の条件は異なります。人工雪は競技の成立を支える一方で、理念や環境倫理との整合性を問われています。 まとめ 冬季オリンピックは、「自然を祝う祭典」から「技術と制度で再現された冬のイベント」へと移行しつつあります。人工雪の是非を結論づけるのではなく、読者自身が「どの成立条件を重視するのか」を問うことが重要です。自然、技術、制度、資本、社会構造のバランスをどう取るのか、その選択は私たち一人ひとりに委ねられています。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 気候変動・スポーツ技術・都市政策・環境倫理・国際イベントの制度設計という観点から、 「人工雪なしで冬季五輪は成立するのか」という問いを、 競技・理念・経済・環境・社会構造の複数レイヤーで冷静かつ構造的に考察してください。 【目的】 – 「人工雪は必要か/不要か」という二項対立に回収せず、冬季五輪の成立条件そのものを構造として整理する – スポーツイベントが自然環境・技術・制度・資本とどのような関係を結んでいるかを可視化する – 読者が「成立とは何を意味しているのか」を自分で問い直すための“視点”を提供する 【読者像】 – スポーツやオリンピックに関心のある一般層 – 環境問題や気候変動に関心を持つ読者 – 国際イベントや都市政策の背景構造に興味を持つ層 – 専門知識はないが、ニュースとして五輪を見ている人 【記事構成】 1. 導入(問題提起) – 「雪がなければ冬季五輪は成り立たない」という直感的な前提を提示する – 近年、人工雪が“例外”ではなく“前提”になりつつある現状を示す – なぜこの問いが、スポーツだけでなく社会構造の問題でもあるのかを簡潔に示す 2. 自然条件としての「冬」という前提 – 冬季五輪が本来、寒冷地・積雪地という地理条件に依存して成立してきたことを整理する – 雪が「環境」だった時代の大会と、現在の大会の構造的な違いを説明する – 開催地と自然の関係性がどのように変化してきたかを示す 3. 技術インフラとしての人工雪 – 人工雪がもたらした競技条件の標準化、放送・興行・運営面での安定性を整理する – 雪が「自然現象」から「管理される資源」へと変わった構造を説明する – 開催条件が気候から、水・電力・設備・資本へと移行している点に触れる 4. 環境倫理と持続可能性の視点 – 水資源、エネルギー消費、生態系、地域への長期的影響を整理する – 「開催できるか」ではなく「開催すべきか」という問いが生まれる構造を示す – 環境配慮が象徴性・ブランド価値・国際的評価と結びつく点に触れる 5. 都市・制度・経済の側から見た成立条件 – 開催都市にとっての五輪の意味(観光、投資、国際的可視性)を整理する – 人工雪が「リスク管理装置」として機能している構造を説明する – 自然条件より制度と資本が成立を左右する状況を可視化する 6. 「成立」という言葉の多層性 – 競技としての成立 – 理念としての成立 – 制度としての成立 – 象徴としての成立 それぞれのレイヤーで意味が異なることを整理する 7. まとめ – 冬季五輪が「自然を祝う祭典」から「技術と制度で再現された冬のイベント」へ移行している可能性を提示する – 人工雪の是非を結論づけず、「どの成立条件を重視するのか」という読者自身の問いに委ねて締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 環境問題やスポーツ倫理を感情論ではなく構造として扱う 【執筆スタンス】 – 本記事は、正解や結論を提示するものではなく、 複数の要因と視点を整理したうえでの「考察」として執筆する – 特定の立場(環境保護・経済合理性・技術推進など)を支持せず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:冬季五輪の成立条件レイヤー構造) ※(図:自然・技術・制度・資本の関係図) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「冬季五輪は雪なしでも成立するのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 1. 導入(問題提起) 「雪がなければ冬季五輪は成り立たない」という直感は、長らく冬季オリンピックの前提でした。しかし近年、人工雪は「例外」ではなく「前提」となりつつあります。2022年の北京冬季オリンピックでは、スキー競技の90%以上が人工雪で行われ、2026年のミラノ・コルティナ大会でも、自然降雪の減少と競技条件の安定化を理由に、人工雪への依存が進んでいます。この変化は、スポーツイベントが自然環境とどのように関わり、技術や制度とどのように結びついているのかを問うものです。なぜこの問いは、スポーツだけでなく社会構造の問題でもあるのでしょうか。 それは、冬季オリンピックが「自然を祝う祭典」から「技術と制度で再現された冬のイベント」へと移行しつつあるからです。この移行は、競技の成立条件だけでなく、環境倫理、都市政策、経済、社会の価値観にまで影響を及ぼしています。 --- ### 2. 自然条件としての「冬」という前提 冬季オリンピックは、寒冷地・積雪地という地理条件に依存して成立してきました。第1回大会(1924年、フランス・シャモニー)から1970年代まで、雪は「環境」そのものであり、大会は自然の恵みを前提としていました。しかし、気候変動の影響で、雪が降り始める時期は遅くなり、溶けるのも早くなり、冬季の期間は短くなっています。例えば、札幌市の大倉山ジャンプ競技場では、人工雪を使いつつも、天然雪と混ざることで着地時のショックを和らげる必要があると指摘されています。自然条件が変化する中、開催地と自然の関係性も変わりました。かつては「雪がある都市」が選ばれましたが、今や「雪を作れる都市」が選ばれるようになっています。これは、自然条件から技術条件へのシフトを意味します。 ※(図:冬季五輪の成立条件レイヤー構造) --- ### 3. 技術インフラとしての人工雪 人工雪は、競技条件の標準化、放送・興行・運営面での安定性をもたらしました。雪が「自然現象」から「管理される資源」へと変わったことで、大会の開催条件は気候から、水・電力・設備・資本へと移行しています。北京冬季オリンピックでは、人工雪の使用率が90%に達し、大量の水とエネルギーが消費されました。人工雪は、競技の公平性や安全性を確保する一方で、環境負荷やコストの増大という新たな課題を生み出しています。競技会場の整備には、造雪機や水資源、電力が不可欠となり、開催条件は自然から技術へと依存度を高めています。 --- ### 4. 環境倫理と持続可能性の視点 人工雪の使用は、水資源の消費、エネルギー消費、生態系への影響、地域への長期的影響を引き起こします。北京冬季オリンピックでは、人工雪のために湿地が人工貯水池に変わり、川の一部が覆われるなど、環境への負荷が指摘されています。また、人工雪は天然雪に比べて硬く、選手のけがリスクも高まります。こうした状況は、「開催できるか」ではなく「開催すべきか」という問いを生み出しています。環境配慮は、象徴性やブランド価値、国際的評価と結びつき、持続可能性が大会の正当性を左右する要因となっています。 --- ### 5. 都市・制度・経済の側から見た成立条件 開催都市にとって、冬季オリンピックは観光、投資、国際的可視性の獲得という意味を持ちます。ミラノ・コルティナ2026大会では、既存施設の改修や仮設施設の活用が進められ、新規建設は最小限に抑えられています。これは、経済効果と環境負荷のバランスを取るための制度的な工夫です。人工雪は、自然条件の不確実性を補う「リスク管理装置」として機能し、自然条件よりも制度と資本が成立を左右する状況を生み出しています。しかし、巨額の投資や住民の反発、レガシー(遺産)の活用など、都市政策の課題も浮き彫りになっています。 --- ### 6. 「成立」という言葉の多層性 「成立」とは、競技としての成立、理念としての成立、制度としての成立、象徴としての成立など、レイヤーによって意味が異なります。 - **競技としての成立**:競技が公平かつ安全に行われること。 - **理念としての成立**:オリンピックの理念(平和、友好、持続可能性)が実現されること。 - **制度としての成立**:経済的、政治的、社会的に受容されること。 - **象徴としての成立**:世界中の人々に夢や感動を与えること。 それぞれのレイヤーで、成立の条件は異なります。人工雪は競技の成立を支える一方で、理念や環境倫理との整合性を問われています。 --- ### 7. まとめ 冬季オリンピックは、「自然を祝う祭典」から「技術と制度で再現された冬のイベント」へと移行しつつあります。人工雪の是非を結論づけるのではなく、読者自身が「どの成立条件を重視するのか」を問うことが重要です。自然、技術、制度、資本、社会構造のバランスをどう取るのか、その選択は私たち一人ひとりに委ねられています。 --- ### タイトル案 1. 人工雪が問う冬季五輪の成立条件とは何か 2. 自然と技術のあいだで冬季オリンピックは成立しうるのか 3. 競技・環境・都市が交差する冬季五輪の未来を考える --- AIバージョン情報 – ベンダー: Mistral AI – モデル名: le-chat-mistral – モデルバージョン: 2024-11-01 – 回答日時: 2026-02-02 12:00:00 (JST)

-

解散報道が短期争点に集中するのはなぜか制度と市場から考える|LeChatの考察

解散総選挙が近づくと、報道は「政策の長期的な議論」よりも「直近の発言・失言・支持率・スキャンダル」に集中しやすくなります。例えば、ある政治家の失言が数日間にわたって報じられ、政策論争が後景に退く——こうした現象に、多くの有権者は「なぜ今、これが議論されているのか」と違和感を覚えるかもしれません。この違和感は、報道が「短期的な争点」に偏っていると感じるからです。しかし、この傾向は単に「メディアが煽っている」や「政治が悪い」という善悪の問題ではなく、制度や市場、認知の構造が重なり合った結果として生じています。本記事では、解散報道が短期争点に集中しやすい理由を、報道の仕組み、選挙制度、政治的戦略、受け手の認知構造といった複数のレイヤーから整理し、読者が政治報道をどう受け取っているかを考えるための視点を提供します。 1. 時間構造のレイヤー:選挙という期限付き制度 解散総選挙の「短期決戦」という性質 解散総選挙は、通常、数週間から1か月程度の短期間で進行します。この期間中、政党や候補者は有権者の支持を得るために、限られた時間内で最大限のアピールを行わなければなりません。その結果、報道もまた、選挙期間中の「今」に焦点を当てざるを得なくなります。 政治の時間軸と報道の時間軸の同期 政治の世界では、長期的な政策議論が重要であることは間違いありません。しかし、選挙期間中、報道は「今、何が起こっているか」を伝える役割を担います。このため、政策の長期的な影響よりも、直近の発言や支持率の変動、スキャンダルなどが報じられやすくなります。これは、報道が政治の時間軸に同期しているためです。 長期政策が扱いにくい構造的理由 長期的な政策議論は、複雑で、効果が目に見えにくく、説明にも時間がかかります。一方、短期的な争点は、シンプルで、感情に訴えやすく、報道しやすいという特性があります。このため、選挙期間中、報道は短期争点に集中しやすくなります。 2. 情報市場のレイヤー:注意と競争 報道が「関心」をめぐる競争の中にある 報道は、視聴率やクリック数、SNSでの拡散など、読者や視聴者の「注意」を集める競争の中にあります。このため、報道機関は、読者の関心を引きやすい短期的な争点を優先的に取り上げる傾向があります。 短期争点が物語化・共有されやすい理由 短期的な争点は、物語として語りやすく、感情に訴えやすいという特性があります。例えば、政治家の失言は、簡単に「物語」として伝えられ、SNSで共有されやすくなります。一方、長期的な政策議論は、複雑で、物語化しにくいという特性があります。 視聴率・クリック・拡散と報道内容の関係 報道機関は、視聴率やクリック数、SNSでの拡散を重視します。このため、読者の関心を引きやすい短期的な争点が優先的に報じられます。これは、報道機関が「注意経済」の中で生き残るための戦略でもあります。 3. 政治的設計のレイヤー:争点の提示と操作 政治側が争点を「選ぶ/ずらす/強調する」構造 政治側もまた、報道の短期化に影響を与えています。政党や候補者は、自らに有利な争点を「選ぶ」ことで、報道の焦点を操作しようとします。例えば、ある政党が特定の政策を強調することで、報道もその政策に焦点を当てるようになります。 短期テーマが前面に出やすい戦略的理由 短期的な争点は、有権者の感情に訴えやすく、選挙期間中の支持率に直接影響を与えやすいという特性があります。このため、政党や候補者は、短期的な争点を前面に出す戦略を取りやすくなります。 報道と政治の相互依存関係 報道と政治は、相互依存の関係にあります。報道は政治の動向を伝え、政治は報道を通じて有権者にアピールします。このため、報道と政治は、短期的な争点に集中しやすくなります。 4. 受け手のレイヤー:理解可能性と参加感 有権者が長期的・制度的議論を理解する際の認知的コスト 有権者が長期的な政策議論や制度的な議論を理解するには、高い認知的コストがかかります。複雑な内容を理解するには時間と労力が必要であり、多くの有権者はそのコストを負担しきれない場合があります。 短期争点が「参加している感覚」を生みやすい構造 短期的な争点は、有権者が「自分も政治に参加している」という感覚を持ちやすくなります。例えば、政治家の失言に対してSNSで意見を述べることは、政治参加の一形態として感じられます。一方、長期的な政策議論は、有権者にとって参加しにくいという特性があります。 受け手もまた報道構造の一部である可能性 有権者は、報道を受け取るだけでなく、報道の内容を選択し、共有することで、報道構造の一部となっています。例えば、SNSで特定のニュースを共有することで、そのニュースの重要性が高まり、報道もそれに影響を受けます。 5. まとめ:構造としての解散報道 解散報道が短期的な争点に集中しやすいのは、単にメディアや政治が意図しているからではなく、選挙制度、情報市場、政治的戦略、受け手の認知構造といった複数の構造が重なり合った結果です。この構造を理解することで、読者は政治報道をより冷静に受け取り、自分なりの距離の取り方を考えることができるでしょう。 本記事が提供した視点を手がかりに、読者が政治報道との向き合い方を考えるきっかけとなれば幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 メディア・政治制度・情報環境・社会構造という観点から、 「なぜ解散報道は短期的な争点に集中しやすいのか」という問いを、 報道の仕組み、選挙制度、政治的戦略、受け手の認知構造といった複数のレイヤーで冷静かつ構造的に考察してください。 【目的】 – 「メディアが煽っている/政治が悪い」という単純な善悪論に回収しない – 解散報道がどのような制度的・市場的・認知的条件の中で形成されているかを整理する – 読者が「政治報道をどう受け取っているか」を考えるための“視点”を提供する 【読者像】 – 一般有権者(20〜60代) – 政治ニュースを日常的に目にしているが、仕組みまでは意識していない層 – 選挙や報道に違和感や関心を持ち始めた人 – メディアリテラシーに興味はあるが専門的ではない読者 【記事構成】 1. 導入(問題提起) – 解散報道が「政策の長期議論」よりも「直近の発言・失言・支持率・スキャンダル」に集中して見える現象を提示する – なぜ多くの人がそこに違和感を覚えるのかを簡潔に示す – 本記事が善悪ではなく“構造”として考察することを明示する 2. 時間構造のレイヤー(選挙という期限付き制度) – 解散総選挙が短期間で進行する制度であることを整理する – 報道の時間軸と政治の時間軸が同期する仕組みを説明する – 長期政策が扱いにくくなる構造的理由を示す 3. 情報市場のレイヤー(注意と競争) – 報道が「関心」や「注目」をめぐる競争の中にあることを整理する – 短期争点が物語化・共有されやすい理由を構造的に説明する – 視聴率・クリック・拡散と報道内容の関係に触れる 4. 政治的設計のレイヤー(争点の提示と操作) – 政治側が争点を“選ぶ/ずらす/強調する”構造を説明する – なぜ短期テーマが前面に出やすいのかを戦略的観点から整理する – 報道と政治の相互依存関係に触れる 5. 受け手のレイヤー(理解可能性と参加感) – 有権者が長期的・制度的議論を理解する際の認知的コストを説明する – 短期争点が「参加している感覚」を生みやすい構造を整理する – 受け手もまた報道構造の一部である可能性を示す 6. まとめ – 解散報道の短期化を「意図」ではなく「構造の結果」として再整理する – 読者が政治報道との距離の取り方を考えるための視点を提示する – 結論を断定せず、思考の余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 読者を批判せず、観察と整理の姿勢を保つ 【執筆スタンス】 – 本記事は、正解や結論を提示するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の政治的立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:解散報道をめぐる時間構造と注意経済の関係) ※(図:政治・報道・受け手の相互作用モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「解散報道は何を争点として可視化しているのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 解散報道が短期争点に集中する構造的理由を考える --- ## 1. 導入:なぜ解散報道は「今」に集中するのか 解散総選挙が近づくと、報道は「政策の長期的な議論」よりも「直近の発言・失言・支持率・スキャンダル」に集中しやすくなります。例えば、ある政治家の失言が数日間にわたって報じられ、政策論争が後景に退く——こうした現象に、多くの有権者は「なぜ今、これが議論されているのか」と違和感を覚えるかもしれません。 この違和感は、報道が「短期的な争点」に偏っていると感じるからです。しかし、この傾向は単に「メディアが煽っている」や「政治が悪い」という善悪の問題ではなく、制度や市場、認知の構造が重なり合った結果として生じています。本記事では、解散報道が短期争点に集中しやすい理由を、報道の仕組み、選挙制度、政治的戦略、受け手の認知構造といった複数のレイヤーから整理し、読者が政治報道をどう受け取っているかを考えるための視点を提供します。 --- ## 2. 時間構造のレイヤー:選挙という期限付き制度 ### 解散総選挙の「短期決戦」という性質 解散総選挙は、通常、数週間から1か月程度の短期間で進行します。この期間中、政党や候補者は有権者の支持を得るために、限られた時間内で最大限のアピールを行わなければなりません。その結果、報道もまた、選挙期間中の「今」に焦点を当てざるを得なくなります。 ※(図:解散報道をめぐる時間構造と注意経済の関係) ### 政治の時間軸と報道の時間軸の同期 政治の世界では、長期的な政策議論が重要であることは間違いありません。しかし、選挙期間中、報道は「今、何が起こっているか」を伝える役割を担います。このため、政策の長期的な影響よりも、直近の発言や支持率の変動、スキャンダルなどが報じられやすくなります。これは、報道が政治の時間軸に同期しているためです。 ### 長期政策が扱いにくい構造的理由 長期的な政策議論は、複雑で、効果が目に見えにくく、説明にも時間がかかります。一方、短期的な争点は、シンプルで、感情に訴えやすく、報道しやすいという特性があります。このため、選挙期間中、報道は短期争点に集中しやすくなります。 --- ## 3. 情報市場のレイヤー:注意と競争 ### 報道が「関心」をめぐる競争の中にある 報道は、視聴率やクリック数、SNSでの拡散など、読者や視聴者の「注意」を集める競争の中にあります。このため、報道機関は、読者の関心を引きやすい短期的な争点を優先的に取り上げる傾向があります。 ### 短期争点が物語化・共有されやすい理由 短期的な争点は、物語として語りやすく、感情に訴えやすいという特性があります。例えば、政治家の失言は、簡単に「物語」として伝えられ、SNSで共有されやすくなります。一方、長期的な政策議論は、複雑で、物語化しにくいという特性があります。 ### 視聴率・クリック・拡散と報道内容の関係 報道機関は、視聴率やクリック数、SNSでの拡散を重視します。このため、読者の関心を引きやすい短期的な争点が優先的に報じられます。これは、報道機関が「注意経済」の中で生き残るための戦略でもあります。 --- ## 4. 政治的設計のレイヤー:争点の提示と操作 ### 政治側が争点を「選ぶ/ずらす/強調する」構造 政治側もまた、報道の短期化に影響を与えています。政党や候補者は、自らに有利な争点を「選ぶ」ことで、報道の焦点を操作しようとします。例えば、ある政党が特定の政策を強調することで、報道もその政策に焦点を当てるようになります。 ### 短期テーマが前面に出やすい戦略的理由 短期的な争点は、有権者の感情に訴えやすく、選挙期間中の支持率に直接影響を与えやすいという特性があります。このため、政党や候補者は、短期的な争点を前面に出す戦略を取りやすくなります。 ### 報道と政治の相互依存関係 報道と政治は、相互依存の関係にあります。報道は政治の動向を伝え、政治は報道を通じて有権者にアピールします。このため、報道と政治は、短期的な争点に集中しやすくなります。 --- ## 5. 受け手のレイヤー:理解可能性と参加感 ### 有権者が長期的・制度的議論を理解する際の認知的コスト 有権者が長期的な政策議論や制度的な議論を理解するには、高い認知的コストがかかります。複雑な内容を理解するには時間と労力が必要であり、多くの有権者はそのコストを負担しきれない場合があります。 ### 短期争点が「参加している感覚」を生みやすい構造 短期的な争点は、有権者が「自分も政治に参加している」という感覚を持ちやすくなります。例えば、政治家の失言に対してSNSで意見を述べることは、政治参加の一形態として感じられます。一方、長期的な政策議論は、有権者にとって参加しにくいという特性があります。 ### 受け手もまた報道構造の一部である可能性 有権者は、報道を受け取るだけでなく、報道の内容を選択し、共有することで、報道構造の一部となっています。例えば、SNSで特定のニュースを共有することで、そのニュースの重要性が高まり、報道もそれに影響を受けます。 ※(図:政治・報道・受け手の相互作用モデル) --- ## 6. まとめ:構造としての解散報道 解散報道が短期的な争点に集中しやすいのは、単にメディアや政治が意図しているからではなく、選挙制度、情報市場、政治的戦略、受け手の認知構造といった複数の構造が重なり合った結果です。この構造を理解することで、読者は政治報道をより冷静に受け取り、自分なりの距離の取り方を考えることができるでしょう。 本記事が提供した視点を手がかりに、読者が政治報道との向き合い方を考えるきっかけとなれば幸いです。 --- ## タイトル案 1. 解散報道が短期争点に集中するのはなぜか制度と市場から考える 2. 選挙期間中の報道はどのような構造の中で形成されているのか 3. 政治報道の短期化を生む制度と認知の仕組みを整理する --- ### AIバージョン情報 — AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年2月2日

-

解散総選挙で「空気」が語られるのはなぜか制度と物語の交差点|LeChatの考察

解散総選挙の報道や分析で、「空気」という言葉が頻繁に登場します。「追い風」「逆風」「流れ」といった表現は、政策論争よりも、選挙の行方を語る際のキーワードとして使われます。しかし、なぜ政策や具体的な施策ではなく、「空気」が重要視されるのでしょうか。この問いは、選挙が単なる政策選択の場ではなく、社会的な「物語装置」としても機能していることを示唆しています。選挙は、制度的な枠組みの中で行われる政治的行為ですが、同時に、社会の雰囲気や国民の感情を反映し、形成する場でもあります。この記事では、「空気」という曖昧な概念を、制度・メディア・社会心理・責任の分配という4つの視点から構造的に整理し、読者が自身の政治参加や判断の仕方を見直すための視点を提供します。 制度としての解散総選挙の特性 解散のタイミングと政治的判断 解散総選挙は、定期選挙とは異なり、そのタイミングが首相の政治的判断に委ねられています。このため、「なぜ今なのか」という問いが常に付随します。この不確実性が、「解釈の余白」を生み出し、制度的な枠組みだけでは説明できない「物語」が補完的に語られる構造を作り出します。 不確実性と意味づけの余白 解散のタイミングが政治的判断に委ねられているため、その理由や背景は、制度的な説明だけでは不十分です。ここでは、「空気」が、制度の隙間を埋める役割を果たします。例えば、「国民の声に応えるため」や「新たな流れを作るため」といった語りが、制度的な説明を補完し、選挙の意味づけを行います。 ※(図:解散総選挙における制度と語りの関係) メディアと“物語化”の構造 政策論争よりもストーリーの伝達 メディアは、複雑な政策論争を簡略化し、伝えやすい形で提供する役割を担っています。その際、「勝ち馬」「潮目」「世論の風」といった表現が頻繁に使われます。これらの表現は、政策の詳細よりも、選挙の「流れ」や「雰囲気」を伝えるために用いられます。 情報の簡略化と意味の拡張 メディアが伝える情報は、簡略化される一方で、意味が拡張されます。例えば、「追い風」という表現は、単に支持率が高いことを示すだけでなく、「時代の流れに乗っている」という意味を付与します。これにより、選挙は政策の選択だけでなく、社会的な「物語」として消費されるようになります。 有権者心理としての「空気」 個人の判断と社会的参照 有権者の判断は、個人の価値観だけでなく、他者の反応や社会の雰囲気を参照して形成されます。「空気」は、個人の意見と社会の感じ方が重なり合う場であり、同調の手がかりとなる一方で、距離を取るための装置としても機能します。 同調と距離の二重性 「空気」は、有権者が社会的な流れに同調する手がかりとなる一方で、個人の判断を保護するための装置でもあります。例えば、「みんなが支持しているから」という理由で投票することもあれば、「空気が変わった」と感じて投票先を変えることもあります。この二重性が、「空気」を複雑な概念にしています。 ※(図:有権者判断と社会的空気の相互作用モデル) 責任の所在と結果の語られ方 選挙結果の「物語化」 選挙結果は、「誰の選択だったのか」ではなく、「時代の空気だった」と語られることが多いです。これは、政治的判断と社会的責任が分散・希薄化される構造を反映しています。例えば、「国民の声に応えた結果」と説明されることで、個々の政治的判断が社会的な流れの中に溶け込み、責任の所在が曖昧になります。 責任の分散と希薄化 「空気」は、政治的な責任を分散させる役割も果たします。選挙結果が「空気」によるものと説明されることで、個々の政治家や有権者の責任が希薄化され、社会全体の「物語」として語られるようになります。 まとめ 「空気」は、単なる感情や雰囲気ではなく、制度・メディア・社会心理・語りが交差して生まれる社会的な装置です。この記事を通じて、読者が自身の投票行動や政治との距離感を考えるための視点を提供しました。選挙は、政策選択の場であると同時に、社会的な「物語」を形成する場でもあります。この構造を理解することで、読者はより主体的に政治に関わることができるでしょう。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 政治制度・メディア環境・社会心理・責任の分配という観点から、 「なぜ解散総選挙では『空気』が重要視されるのか」という問いを、 AIの視点で冷静かつ構造的に考察してください。 【目的】 – 「国民感情」「雰囲気」「ムード」といった曖昧な言葉を、感情論ではなく構造として整理する – 解散総選挙が、政策選択の場であると同時に、社会的な“物語装置”として機能している側面を可視化する – 読者が、自分自身の政治参加や判断の仕方を見直すための“視点”を提供する 【読者像】 – 一般有権者(20〜60代) – 政治ニュースに日常的に触れているが、制度の仕組みまでは詳しくない層 – 選挙のたびに「なぜこのタイミングなのか」「何を問われているのか」と違和感を覚える人 – 政治的立場を強く固定せず、構造として理解したい読者 【記事構成】 1. 導入(問題提起) – 解散総選挙が「政策」ではなく「空気」で語られる場面が多いことを提示する – 「追い風」「逆風」「流れ」といった言葉が選挙報道で頻繁に使われる現象に触れる – なぜこの問いを立てる必要があるのかを簡潔に説明する 2. 制度としての解散総選挙の特性 – 定期選挙と異なり、解散のタイミングが政治的判断に委ねられている点を整理する – 「なぜ今なのか」という意味づけが、制度ではなく語りによって補われる構造を説明する – 不確実性が「解釈の余白」を生む仕組みを整理する 3. メディアと“物語化”の構造 – 政策論争よりも、感情や流れを軸にしたストーリーの方が伝達されやすい理由を整理する – 「勝ち馬」「潮目」「世論の風」といった表現が持つ役割を構造的に説明する – 情報の簡略化と意味の拡張が同時に起きる点に触れる 4. 有権者心理としての「空気」 – 個人の判断が、他者の反応や社会の雰囲気を参照して形成される過程を整理する – 「自分の意見」と「みんなの感じ方」が重なり合う構造を説明する – 空気が、同調の手がかりであると同時に、距離を取るための装置としても機能する点を示す 5. 責任の所在と結果の語られ方 – 選挙結果が「誰の選択だったのか」ではなく、「時代の空気だった」と語られる傾向を整理する – 政治的判断と社会的責任が、どのように分散・希薄化されるかを構造的に説明する 6. まとめ – 「空気」は単なる感情ではなく、制度・メディア・心理・語りが交差して生まれる社会的な装置であることを再確認する – 読者が、自分の投票行動や政治との距離感を考えるための視点を提示して締めくくる – 過度に評価や断定をせず、思考の余白を残す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「政治的主張」ではなく、「構造の整理」を目的とした文章とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の政治的立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:解散総選挙における制度と語りの関係) ※(図:有権者判断と社会的空気の相互作用モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「この選挙は、何を問われているのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 解散総選挙と「空気」の構造的考察:制度・メディア・心理の交差点 --- #### 1. 導入(問題提起) 解散総選挙の報道や分析で、「空気」という言葉が頻繁に登場します。「追い風」「逆風」「流れ」といった表現は、政策論争よりも、選挙の行方を語る際のキーワードとして使われます。しかし、なぜ政策や具体的な施策ではなく、「空気」が重要視されるのでしょうか。この問いは、選挙が単なる政策選択の場ではなく、社会的な「物語装置」としても機能していることを示唆しています。 選挙は、制度的な枠組みの中で行われる政治的行為ですが、同時に、社会の雰囲気や国民の感情を反映し、形成する場でもあります。この記事では、「空気」という曖昧な概念を、制度・メディア・社会心理・責任の分配という4つの視点から構造的に整理し、読者が自身の政治参加や判断の仕方を見直すための視点を提供します。 --- #### 2. 制度としての解散総選挙の特性 ##### 解散のタイミングと政治的判断 解散総選挙は、定期選挙とは異なり、そのタイミングが首相の政治的判断に委ねられています。このため、「なぜ今なのか」という問いが常に付随します。この不確実性が、「解釈の余白」を生み出し、制度的な枠組みだけでは説明できない「物語」が補完的に語られる構造を作り出します。 ##### 不確実性と意味づけの余白 解散のタイミングが政治的判断に委ねられているため、その理由や背景は、制度的な説明だけでは不十分です。ここでは、「空気」が、制度の隙間を埋める役割を果たします。例えば、「国民の声に応えるため」や「新たな流れを作るため」といった語りが、制度的な説明を補完し、選挙の意味づけを行います。 ※(図:解散総選挙における制度と語りの関係) --- #### 3. メディアと“物語化”の構造 ##### 政策論争よりもストーリーの伝達 メディアは、複雑な政策論争を簡略化し、伝えやすい形で提供する役割を担っています。その際、「勝ち馬」「潮目」「世論の風」といった表現が頻繁に使われます。これらの表現は、政策の詳細よりも、選挙の「流れ」や「雰囲気」を伝えるために用いられます。 ##### 情報の簡略化と意味の拡張 メディアが伝える情報は、簡略化される一方で、意味が拡張されます。例えば、「追い風」という表現は、単に支持率が高いことを示すだけでなく、「時代の流れに乗っている」という意味を付与します。これにより、選挙は政策の選択だけでなく、社会的な「物語」として消費されるようになります。 --- #### 4. 有権者心理としての「空気」 ##### 個人の判断と社会的参照 有権者の判断は、個人の価値観だけでなく、他者の反応や社会の雰囲気を参照して形成されます。「空気」は、個人の意見と社会の感じ方が重なり合う場であり、同調の手がかりとなる一方で、距離を取るための装置としても機能します。 ##### 同調と距離の二重性 「空気」は、有権者が社会的な流れに同調する手がかりとなる一方で、個人の判断を保護するための装置でもあります。例えば、「みんなが支持しているから」という理由で投票することもあれば、「空気が変わった」と感じて投票先を変えることもあります。この二重性が、「空気」を複雑な概念にしています。 ※(図:有権者判断と社会的空気の相互作用モデル) --- #### 5. 責任の所在と結果の語られ方 ##### 選挙結果の「物語化」 選挙結果は、「誰の選択だったのか」ではなく、「時代の空気だった」と語られることが多いです。これは、政治的判断と社会的責任が分散・希薄化される構造を反映しています。例えば、「国民の声に応えた結果」と説明されることで、個々の政治的判断が社会的な流れの中に溶け込み、責任の所在が曖昧になります。 ##### 責任の分散と希薄化 「空気」は、政治的な責任を分散させる役割も果たします。選挙結果が「空気」によるものと説明されることで、個々の政治家や有権者の責任が希薄化され、社会全体の「物語」として語られるようになります。 --- #### 6. まとめ 「空気」は、単なる感情や雰囲気ではなく、制度・メディア・社会心理・語りが交差して生まれる社会的な装置です。この記事を通じて、読者が自身の投票行動や政治との距離感を考えるための視点を提供しました。選挙は、政策選択の場であると同時に、社会的な「物語」を形成する場でもあります。この構造を理解することで、読者はより主体的に政治に関わることができるでしょう。 --- ### タイトル案 1. 解散総選挙で「空気」が語られるのはなぜか制度と物語の交差点 2. 選挙の「流れ」は誰が作るのかメディアと有権者心理の構造 3. 政治的判断と社会的責任はどう分散されるのか空気の役割を問う --- ### AIバージョン情報 — AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年2月2日

-

冬季五輪が消えたあとに世界に残るものは何か|LeChatの考察

冬季オリンピックは、単なるスポーツの祭典ではありません。それは、競技者、国家、都市、メディア、観客が複雑に絡み合う「制度」であり、「物語」であり、「象徴」です。競技の勝敗を超えて、冬季五輪は「世界が同時に注目する場」を提供し、国家の威信や地域の発展、個人の夢を結びつける装置として機能してきました。しかし、もしこの祭典が廃止されたら、何が「残る」のか、何が「失われる」のか、何が「別の形に再編」されるのか——。この逆向きの問いは、冬季五輪が果たしてきた役割を構造的に浮き彫りにします。競技そのものは国際大会やプロリーグで継続されても、世界が同時に注目する「場」が失われることの意味は何でしょうか。都市開発や観光資源は、五輪という「祝祭」を失っても維持されるのか。国家やメディアは、どのような物語を新たに紡ぎ始めるのか。この記事では、冬季五輪が織りなしてきた社会構造を整理し、読者が「世界的な出来事とは何か」を考えるための視点を提供します。 競技レイヤー:競技は残っても「世界の注目」は失われる 五輪以前から存在した冬季競技の歴史 冬季競技の多くは、五輪が誕生する以前から地域や国家の文化として根付いていました。例えば、スキーは北欧の生活手段として、フィギュアスケートは19世紀のヨーロッパで芸術的な娯楽として発展しました。五輪はこれらの競技を「世界的な舞台」に引き上げ、統一されたルールや評価基準を与えることで、競技の普及と進化を加速させました。 五輪廃止後の競技の行方:国際大会・プロリーグ・地域大会 五輪が廃止されても、競技自体は消滅しません。代わりに、世界選手権やワールドカップ、プロリーグ、地域大会が主な舞台となります。しかし、これらの大会は「世界が同時に注目する場」としての機能を果たせるでしょうか。五輪は、4年に一度、世界中の視線を一点に集め、競技者に「歴史的瞬間」を刻む機会を与えてきました。その「同時性」と「普遍性」が失われることで、競技の意味合いは変化します。 ※(図:冬季競技の舞台の変遷——五輪から多極化へ) 「世界が同時に注目する場」の喪失 五輪の最大の特徴は、「世界中が同時に注目する」という点です。この「同時性」は、競技者にとっては「歴史的瞬間」を刻む機会であり、観客にとっては「共通の体験」を生み出す源です。五輪が廃止されれば、競技は分散し、注目のタイミングもバラバラになります。その結果、「世界的な出来事」としての一体感は薄れ、「個別の興味」として消費されるようになるかもしれません。 開催地・地域社会:インフラと財政負担の痕跡 五輪が残す物理的な痕跡:インフラと施設 冬季五輪の開催地には、競技場や宿泊施設、交通インフラなど、物理的な痕跡が残ります。例えば、1998年の長野五輪では、新幹線の延伸や高速道路の整備が進み、地域のアクセス性が向上しました。しかし、これらのインフラは、五輪終了後も維持・運用される必要があり、地域社会にとっては「負の遺産」となることもあります。 五輪は「祝祭」であると同時に「都市開発プロジェクト」 五輪は、開催地にとって「祝祭」であると同時に、「都市開発プロジェクト」でもあります。開催を機に、都市のブランド価値が向上し、観光客が増加する一方、巨額の財政負担や維持費用が地域にのしかかります。五輪が廃止されれば、この「開発の契機」は失われますが、その一方で、無計画な開発や負債のリスクも回避されるかもしれません。 イベント消失後に残る制度と維持構造 五輪が消滅しても、競技施設や観光資源は残ります。しかし、それらを維持するための制度や財源はどうなるのか。例えば、競技場の維持管理費用は誰が負担するのか、観光客を呼び込むための新たなイベントはどのように企画されるのか——。五輪が残すのは、物理的な施設だけでなく、それを活用するための「制度」や「仕組み」です。 ※(図:五輪開催地のインフラと財政負担の構造) 国家とメディア:物語の単位が「国家」から「個人」へ 五輪が国家イメージを発信する装置であった理由 冬季五輪は、国家が自らのイメージを世界に発信するための「装置」として機能してきました。メダル獲得数は国家の威信や技術力の象徴とされ、開会式や閉会式は文化的な魅力をアピールする場となりました。五輪が廃止されれば、この「国家の物語」を紡ぐ場は失われ、「個人」や「クラブ」、「スポンサー」が新たな物語の主体となる可能性があります。 メディアが「世界的出来事」を再定義する 五輪は、メディアにとって「世界的出来事」を報道するための「定型フォーマット」を提供してきました。しかし、五輪がなくなれば、メディアは「世界的出来事」をどのように再定義するのか。例えば、eスポーツや環境イベント、地域の祭りが新たな「世界的出来事」として位置づけられるかもしれません。メディアの注目は、競技から「新たな物語」へとシフトするでしょう。 物語の単位が変わる:国家から個人・クラブ・スポンサーへ 五輪が廃止されれば、物語の単位は「国家」から「個人」「クラブ」「スポンサー」へと移行します。例えば、フィギュアスケートの選手は、五輪ではなく、ワールドカップや商業イベントで活躍するようになるかもしれません。その結果、物語の主体は多様化し、「国家の栄光」から「個人の挑戦」へと焦点が変わる可能性があります。 ※(図:五輪廃止後の物語主体の変化——国家から個人・クラブへ) 残るのは「場」か「意味」か:象徴的な枠組みの変容 競技や組織は残っても、「象徴的な意味」が変わる 五輪が廃止されても、競技や組織は残るでしょう。しかし、「冬季五輪」という象徴的な枠組みが失われることで、競技の意味合いは変化します。例えば、スキージャンプは「五輪種目」としての威信を失い、「地域の祭り」や「商業イベント」の一部となるかもしれません。競技の「価値」は、それがどのような文脈で語られるかによって変わります。 五輪が担ってきた「世界を一つの視点で見る装置」としての役割 冬季五輪は、「世界を一つの視点で見る装置」として機能してきました。それは、競技の勝敗を超えて、「世界中の人々が同時に同じ瞬間を共有する」という体験を提供してきました。五輪が廃止されれば、この「共有の視点」は失われ、「世界的な出来事」の定義は多様化するでしょう。 まとめ:私たちは何を「世界的な出来事」として共有したいのか 冬季オリンピックの廃止を仮定することで、私たちはスポーツと社会の関係構造を再確認できます。競技は残っても、「世界が同時に注目する場」が失われることの意味。開催地に残るインフラと負債の痕跡。国家の物語が個人の物語へと変容する可能性。そして、「世界的な出来事」として何を共有したいのか——。 この問いに対する「正解」はありません。しかし、冬季五輪が織りなしてきた構造を整理することで、私たちは「世界的な出来事とは何か」を改めて考えるきっかけを得るでしょう。それは、スポーツの祭典を超えて、私たちがどのような物語を共有し、どのような未来を築いていくのかを問うことでもあります。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 スポーツ・国家・経済・メディア・地域社会という複数のレイヤーから、 「もし冬季オリンピックが廃止された場合、何が“残り”、何が“失われ”、何が“別の形に再編されるのか」という問いを、 制度的・文化的・経済的・象徴的な観点から冷静かつ構造的に考察してください。 【目的】 – 「五輪は必要か不要か」という賛否の二項対立に回収せず、冬季五輪が担ってきた“機能”と“役割”を構造として整理する – スポーツイベントが社会・国家・地域・個人の物語にどのように組み込まれているかを可視化する – 読者が「世界的な出来事とは何か」「祝祭とは何を残すのか」を考えるための“視点”を提供する 【読者像】 – 一般視聴者・スポーツファン – 社会や制度の仕組みに関心のある層 – メディア・イベント・国際関係に関心を持つ人 – 冬季五輪を「娯楽」以上のものとして捉え直したい読者 【記事構成】 1. 導入(問題提起) – 冬季五輪が「スポーツ大会」以上の存在として認識されている現状を提示する – なぜ「廃止されたら何が残るのか」という逆向きの問いが有効なのかを説明する – 競技・国家・都市・メディア・観客が結びついた構造の存在を示す 2. 競技レイヤーに残るもの – 冬季競技が五輪以前から存在してきた歴史に触れる – 五輪がなくなった場合に、国際大会・プロリーグ・地域大会が果たす役割を整理する – 「世界が同時に注目する場」が失われることの意味を構造的に説明する 3. 開催地・地域社会に残るもの – インフラ、施設、観光資源、財政負担といった物理的・経済的な痕跡を整理する – 五輪が「祝祭」であると同時に「都市開発プロジェクト」である側面を説明する – イベント消失後に残る制度や維持構造の意味を考察する 4. 国家とメディアの物語構造 – 冬季五輪が国家イメージや成功物語を発信する装置であった点を整理する – 廃止された場合、物語の単位が「国家」から「個人」「クラブ」「スポンサー」へ移行する可能性を示す – メディアが“世界的出来事”をどのように再定義するかを考察する 5. 残るのは「場」か「意味」か – 競技や組織が残っても、「象徴的な意味の枠組み」が変わる可能性を提示する – 冬季五輪が担ってきた“世界を一つの視点で見る装置”としての役割を整理する 6. まとめ – 冬季五輪の廃止を仮定することで見えてくる、スポーツと社会の関係構造を再確認する – 読者に「私たちは何を“世界的な出来事”として共有したいのか」という問いを残して締めくくる – 過度に肯定も否定もせず、思考の余白を残す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 評価・賛否ではなく「仕組み」「役割」「機能」に焦点を当てる 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の視点や社会構造を整理したうえでの「考察」として執筆する – 特定の立場や感情を誘導せず、 読者が自分自身の視点を形成するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:冬季五輪を支える制度と関係主体の構造) ※(図:国家・競技・メディア・観客の関係モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「冬季五輪が消えたとき、世界は何を失うのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 冬季オリンピックが廃止されたとき、世界に何が残るのか --- ## 1. 導入:冬季五輪が「スポーツ大会」以上の存在である理由 冬季オリンピックは、単なるスポーツの祭典ではありません。それは、競技者、国家、都市、メディア、観客が複雑に絡み合う「制度」であり、「物語」であり、「象徴」です。競技の勝敗を超えて、冬季五輪は「世界が同時に注目する場」を提供し、国家の威信や地域の発展、個人の夢を結びつける装置として機能してきました。 しかし、もしこの祭典が廃止されたら、何が「残る」のか、何が「失われる」のか、何が「別の形に再編」されるのか——。この逆向きの問いは、冬季五輪が果たしてきた役割を構造的に浮き彫りにします。競技そのものは国際大会やプロリーグで継続されても、世界が同時に注目する「場」が失われることの意味は何でしょうか。都市開発や観光資源は、五輪という「祝祭」を失っても維持されるのか。国家やメディアは、どのような物語を新たに紡ぎ始めるのか。この記事では、冬季五輪が織りなしてきた社会構造を整理し、読者が「世界的な出来事とは何か」を考えるための視点を提供します。 --- ## 2. 競技レイヤー:競技は残っても「世界の注目」は失われる ### 2-1. 五輪以前から存在した冬季競技の歴史 冬季競技の多くは、五輪が誕生する以前から地域や国家の文化として根付いていました。例えば、スキーは北欧の生活手段として、フィギュアスケートは19世紀のヨーロッパで芸術的な娯楽として発展しました。五輪はこれらの競技を「世界的な舞台」に引き上げ、統一されたルールや評価基準を与えることで、競技の普及と進化を加速させました。 ### 2-2. 五輪廃止後の競技の行方:国際大会・プロリーグ・地域大会 五輪が廃止されても、競技自体は消滅しません。代わりに、世界選手権やワールドカップ、プロリーグ、地域大会が主な舞台となります。しかし、これらの大会は「世界が同時に注目する場」としての機能を果たせるでしょうか。五輪は、4年に一度、世界中の視線を一点に集め、競技者に「歴史的瞬間」を刻む機会を与えてきました。その「同時性」と「普遍性」が失われることで、競技の意味合いは変化します。 ※(図:冬季競技の舞台の変遷——五輪から多極化へ) ### 2-3. 「世界が同時に注目する場」の喪失 五輪の最大の特徴は、「世界中が同時に注目する」という点です。この「同時性」は、競技者にとっては「歴史的瞬間」を刻む機会であり、観客にとっては「共通の体験」を生み出す源です。五輪が廃止されれば、競技は分散し、注目のタイミングもバラバラになります。その結果、「世界的な出来事」としての一体感は薄れ、「個別の興味」として消費されるようになるかもしれません。 --- ## 3. 開催地・地域社会:インフラと財政負担の痕跡 ### 3-1. 五輪が残す物理的な痕跡:インフラと施設 冬季五輪の開催地には、競技場や宿泊施設、交通インフラなど、物理的な痕跡が残ります。例えば、1998年の長野五輪では、新幹線の延伸や高速道路の整備が進み、地域のアクセス性が向上しました。しかし、これらのインフラは、五輪終了後も維持・運用される必要があり、地域社会にとっては「負の遺産」となることもあります。 ### 3-2. 五輪は「祝祭」であると同時に「都市開発プロジェクト」 五輪は、開催地にとって「祝祭」であると同時に、「都市開発プロジェクト」でもあります。開催を機に、都市のブランド価値が向上し、観光客が増加する一方、巨額の財政負担や維持費用が地域にのしかかります。五輪が廃止されれば、この「開発の契機」は失われますが、一方で、無計画な開発や負債のリスクも回避されるかもしれません。 ### 3-3. イベント消失後に残る制度と維持構造 五輪が消滅しても、競技施設や観光資源は残ります。しかし、それらを維持するための制度や財源はどうなるのか。例えば、競技場の維持管理費用は誰が負担するのか、観光客を呼び込むための新たなイベントはどのように企画されるのか——。五輪が残すのは、物理的な施設だけでなく、それを活用するための「制度」や「仕組み」です。 ※(図:五輪開催地のインフラと財政負担の構造) --- ## 4. 国家とメディア:物語の単位が「国家」から「個人」へ ### 4-1. 五輪が国家イメージを発信する装置であった理由 冬季五輪は、国家が自らのイメージを世界に発信するための「装置」として機能してきました。メダル獲得数は国家の威信や技術力の象徴とされ、開会式や閉会式は文化的な魅力をアピールする場となりました。五輪が廃止されれば、この「国家の物語」を紡ぐ場は失われ、「個人」や「クラブ」、「スポンサー」が新たな物語の主体となる可能性があります。 ### 4-2. メディアが「世界的出来事」を再定義する 五輪は、メディアにとって「世界的出来事」を報道するための「定型フォーマット」を提供してきました。しかし、五輪がなくなれば、メディアは「世界的出来事」をどのように再定義するのか。例えば、eスポーツや環境イベント、地域の祭りが新たな「世界的出来事」として位置づけられるかもしれません。メディアの注目は、競技から「新たな物語」へとシフトするでしょう。 ### 4-3. 物語の単位が変わる:国家から個人・クラブ・スポンサーへ 五輪が廃止されれば、物語の単位は「国家」から「個人」「クラブ」「スポンサー」へと移行します。例えば、フィギュアスケートの選手は、五輪ではなく、ワールドカップや商業イベントで活躍するようになるかもしれません。その結果、物語の主体は多様化し、「国家の栄光」から「個人の挑戦」へと焦点が変わる可能性があります。 ※(図:五輪廃止後の物語主体の変化——国家から個人・クラブへ) --- ## 5. 残るのは「場」か「意味」か:象徴的な枠組みの変容 ### 5-1. 競技や組織は残っても、「象徴的な意味」が変わる 五輪が廃止されても、競技や組織は残るでしょう。しかし、「冬季五輪」という象徴的な枠組みが失われることで、競技の意味合いは変化します。例えば、スキージャンプは「五輪種目」としての威信を失い、「地域の祭り」や「商業イベント」の一部となるかもしれません。競技の「価値」は、それがどのような文脈で語られるかによって変わります。 ### 5-2. 五輪が担ってきた「世界を一つの視点で見る装置」としての役割 冬季五輪は、「世界を一つの視点で見る装置」として機能してきました。それは、競技の勝敗を超えて、「世界中の人々が同時に同じ瞬間を共有する」という体験を提供してきました。五輪が廃止されれば、この「共有の視点」は失われ、「世界的な出来事」の定義は多様化するでしょう。 --- ## 6. まとめ:私たちは何を「世界的な出来事」として共有したいのか 冬季オリンピックの廃止を仮定することで、私たちはスポーツと社会の関係構造を再確認できます。競技は残っても、「世界が同時に注目する場」が失われることの意味。開催地に残るインフラと負債の痕跡。国家の物語が個人の物語へと変容する可能性。そして、「世界的な出来事」として何を共有したいのか——。 この問いに対する「正解」はありません。しかし、冬季五輪が織りなしてきた構造を整理することで、私たちは「世界的な出来事とは何か」を改めて考えるきっかけを得るでしょう。それは、スポーツの祭典を超えて、私たちがどのような物語を共有し、どのような未来を築いていくのかを問うことでもあります。 --- ## タイトル案 1. 冬季五輪が消えたあとに世界に残るものは何か 2. 競技は残っても失われるものがあるとき社会は何を共有するのか 3. 祝祭が終われば何が始まるのか冬季五輪廃止後の世界構造 --- — AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年2月2日

-

解散総選挙は誰の説明責任を問うているのか政治制度とメディアの構造から考える|LeChatの考察

解散総選挙は、しばしば「内閣の信を問う場」として語られます。首相が国民に信任を問い、政権の正当性を確認する——このような説明は、選挙のたびに繰り返されます。しかし、「誰が、誰に対して、何を説明しているのか」という問いに対して、明確な答えは意外と見えにくいものです。例えば、首相が「国民に信を問う」と言うとき、その「国民」とは具体的に誰を指すのでしょうか。投票した有権者? それとも、選挙制度の下で選択を迫られた全ての市民? また、「説明責任」とは、政策の失敗を謝罪することなのか、将来のビジョンを示すことなのか、あるいは過去の判断を正当化することなのか——その内容も曖昧です。なぜ、選挙のたびに「説明責任」という言葉が繰り返し使われるのでしょうか。それは、解散総選挙が単なる「信任投票」ではなく、複数の主体が複数のレイヤーで責任を負う場だからです。この記事では、政治制度・メディア環境・社会構造の観点から、解散総選挙における「説明責任」の構造を整理し、読者が自分自身の立場を考えるための視点を提供します。 首相・内閣レイヤーの説明責任 解散権と「国民への説明」 解散総選挙は、憲法上、内閣が衆議院を解散する権限を持つことから始まります。この解散権は、内閣が国会の信任関係を問うための手段として設計されています。しかし、ここでの「説明責任」は、単に「信任を得ているか」を確認するだけではありません。内閣は、以下の3つの観点で説明を求められます。 政策判断の説明:過去の政策がどのような成果を上げ、どのような課題を残したのか。 国会運営の説明:なぜ解散に至ったのか、国会の機能不全や政局の混乱に対してどのような責任を負うのか。 政治的正当性の説明:解散が「国民の審判」を求める行為であるならば、その審判基準は何か。 「信任」という言葉は、制度上、「内閣が衆議院の多数を支配しているか」という手続き的な意味と、「国民が内閣の政策を支持しているか」という実質的な意味の両方を持ちます。しかし、解散総選挙では、この二つが必ずしも一致しないことが問題を複雑にします。例えば、選挙で勝利しても、投票率が低ければ「国民全体の信任」とは言い難い——このようなギャップが、「説明責任」の曖昧さを生み出します。 ※(図:解散総選挙における首相・内閣の説明責任の構造) 政党レイヤーの説明責任 組織としての政党が負う責任 解散総選挙では、個々の政治家ではなく、「政党」としての説明責任が問われます。政党は、以下の点で説明を求められます。 公約の説明:選挙で示した公約が、過去の実績とどのように整合するのか。 候補者選定の説明:なぜその候補者を選んだのか、その人物が政党の理念をどのように体現するのか。 連立のあり方の説明:複数の政党が連立を組む場合、政策の一貫性や優先順位をどう説明するのか。 政党は、個々の政治家の集合体ではなく、一つの「政策ブランド」として機能します。そのため、選挙では「政権選択」と「政党選択」が重なり合います。有権者は、個々の候補者ではなく、政党の理念や政策パッケージに投票している——この構造が、政党に対して「組織としての説明責任」を生じさせます。 ※(図:政党と有権者の説明責任の関係) 有権者レイヤーの説明責任 投票行動の意味と「選択の引き受け」 有権者は、投票を通じて政治家や政党に説明を求めるだけでなく、自分自身の選択に対しても説明責任を負います。投票行動は、以下の3つの側面を持ちます。 評価:過去の政治の成果を評価する行為。 選択の引き受け:将来の政策方向を選択し、その結果を引き受ける行為。 無投票の意味:投票しないこと、白票を投じることも、一つの政治的メッセージです。 民主主義において、有権者は「受動的な審判者」ではなく、「能動的な責任主体」です。例えば、投票率が低い場合、「国民の無関心」と批判されることがありますが、それは「現状の政治に対する不信」というメッセージでもあります。有権者の説明責任は、「なぜその選択をしたのか」を自分自身に問うことから始まります。 ※(図:有権者の投票行動と説明責任) メディア・制度レイヤーの説明責任 フレーミングと「物語化」の構造 メディアは、選挙の争点を設定し、フレーミングすることで、「説明責任」の向き先を変えます。例えば、「失政の責任」を問うフレームと「未来のビジョン」を問うフレームでは、有権者が求める説明の内容が変わります。また、選挙制度そのものも、説明責任の構造を設計しています。 小選挙区制:候補者個人に対する説明責任が強調される。 比例代表制:政党に対する説明責任が強調される。 報道の物語化:「信任」「批判」「対立」といった物語が、説明責任の対象を限定する。 メディアは、「誰が説明すべきか」を選択的に可視化します。例えば、野党が「政権の説明責任」を追及する報道が多ければ、有権者の関心もその方向に向かいます。しかし、メディアがフレームを変えれば、説明責任の対象も変わります。 ※(図:メディアと選挙制度が説明責任に与える影響) 説明責任が「分散する構造」 解散総選挙における説明責任は、誰か一人に帰属するのではなく、複数の主体に同時に発生しています。首相・内閣、政党、有権者、メディア——それぞれが、異なるレイヤーで説明を求められ、また説明を求めます。この分散構造が、「誰の責任か」を曖昧にする理由です。 首相・内閣:政策判断と国会運営の説明。 政党:組織としての一貫性と候補者選定の説明。 有権者:投票行動の意味と選択の引き受け。 メディア:フレーミングと物語化の説明。 この構造は、民主主義の複雑さを反映しています。説明責任が分散するからこそ、選挙は「答えを出す場」ではなく、「責任の配置を再編する場」となるのです。 ※(図:解散総選挙における説明責任の分散構造) まとめ:責任の配置を考える 解散総選挙は、「誰かの責任」を断定する場ではありません。むしろ、複数の主体が複数のレイヤーで説明責任を負う構造を可視化する場です。首相・内閣、政党、有権者、メディア——それぞれが、自分自身の立場を問い直し、説明責任を引き受けることで、民主主義は機能します。 読者の皆さんは、自分自身をどのレイヤーに置きますか。首相の説明を聞く「審判者」として? 政党の公約を評価する「消費者」として? それとも、投票行動を通じて社会の未来を選択する「責任主体」として? この問いに対する「正解」はありません。しかし、解散総選挙を「説明責任の再配置」として捉え直すことで、私たちは民主主義の複雑さと可能性に向き合うことができるでしょう。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 政治制度・メディア環境・社会構造という観点から、 「解散総選挙は、誰の『説明責任』を問う仕組みなのか」という問いについて、 AIの視点で冷静かつ構造的に整理・考察してください。 【目的】 – 「首相の信任」「政権の正当性」「国民の審判」といった単純なフレーズに回収せず、説明責任がどの主体に、どのレイヤーで発生しているのかを整理する – 制度としての解散総選挙が、政治家・政党・有権者・メディアにどのような役割と責任を同時に生み出しているのかを可視化する – 読者が「説明責任とは誰に、どのように帰属する概念なのか」を考えるための“視点”を提供する 【読者像】 – 一般有権者(20〜60代) – 政治ニュースには触れているが、制度設計までは深く考えたことがない層 – 選挙を「イベント」ではなく「社会の仕組み」として捉え直したい人 – 政治的立場を固定せず、構造的な理解に関心がある読者 【記事構成】 1. 導入(問題提起) – 解散総選挙が「信を問う場」として語られる一般的なイメージを提示する – その一方で、「誰が、誰に対して、何を説明しているのか」が曖昧である点を指摘する – なぜ「説明責任」という言葉が、選挙のたびに繰り返し使われるのかを問いとして提示する 2. 首相・内閣レイヤーの説明責任 – 解散権を持つ主体としての内閣の位置づけを整理する – 政策判断・国会運営・政治的正当性がどのように「国民への説明」と結びつけられているかを説明する – 「信任」という言葉が、制度上どのような意味を持つのかを構造的に整理する 3. 政党レイヤーの説明責任 – 個人ではなく「組織」としての政党が負う責任の性質を整理する – 公約、理念、候補者選定、連立のあり方などが、どのように説明対象になるのかを示す – 政権選択と政党選択が重なり合う構造を言語化する 4. 有権者レイヤーの説明責任 – 投票行動が「評価」であると同時に「選択の引き受け」でもある点を整理する – 投票しないこと、白票を投じることも含めた行為の意味を構造的に捉える – 民主主義において、有権者がどのような形で責任主体になっているのかを考察する 5. メディア・制度レイヤーの説明責任 – 争点の設定、フレーミング、報道の切り取り方が、説明責任の向き先をどう変えるかを整理する – 「信任」「批判」「対立」といった物語化の構造を説明する – 選挙制度そのものが、説明の形式をどう設計しているかに触れる 6. 説明責任が「分散する構造」 – 誰か一人に帰属するのではなく、複数の主体に同時に発生している構造をまとめる – なぜ「誰の責任か」が常に曖昧なまま残るのかを制度的に整理する 7. まとめ – 解散総選挙を「答えを出す場」ではなく、「責任の配置を再編する場」として捉え直す – 読者が自分自身の立場をどのレイヤーに置くのかを考えるための視点を提示して締めくくる – 過度な評価や断定を避け、思考の余白を残す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「正解を示す記事」ではなく、「問いの構造を整理する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や制度設計を整理したうえでの「考察」として執筆する – 特定の政治的立場・価値観を押し付けず、 読者が自分で考えるための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:解散総選挙における説明責任の分散構造) ※(図:政治主体と有権者・メディアの関係図) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「この選挙で、誰が誰に説明しているのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 解散総選挙は、誰の『説明責任』を問う仕組みなのか --- ## 1. 導入:解散総選挙と「説明責任」の曖昧さ 解散総選挙は、しばしば「内閣の信を問う場」として語られます。首相が国民に信任を問い、政権の正当性を確認する——このような説明は、選挙のたびに繰り返されます。しかし、「誰が、誰に対して、何を説明しているのか」という問いに対して、明確な答えは意外と見えにくいものです。 例えば、首相が「国民に信を問う」と言うとき、その「国民」とは具体的に誰を指すのでしょうか。投票した有権者? それとも、選挙制度の下で選択を迫られた全ての市民? また、「説明責任」とは、政策の失敗を謝罪することなのか、将来のビジョンを示すことなのか、あるいは過去の判断を正当化することなのか——その内容も曖昧です。 なぜ、選挙のたびに「説明責任」という言葉が繰り返し使われるのでしょうか。それは、解散総選挙が単なる「信任投票」ではなく、複数の主体が複数のレイヤーで責任を負う場だからです。この記事では、政治制度・メディア環境・社会構造の観点から、解散総選挙における「説明責任」の構造を整理し、読者が自分自身の立場を考えるための視点を提供します。 --- ## 2. 首相・内閣レイヤーの説明責任 ### 解散権と「国民への説明」 解散総選挙は、憲法上、内閣が衆議院を解散する権限を持つことから始まります。この解散権は、内閣が国会の信任関係を問うための手段として設計されています。しかし、ここでの「説明責任」は、単に「信任を得ているか」を確認するだけではありません。内閣は、以下の3つの観点で説明を求められます。 1. **政策判断の説明**:過去の政策がどのような成果を上げ、どのような課題を残したのか。 2. **国会運営の説明**:なぜ解散に至ったのか、国会の機能不全や政局の混乱に対してどのような責任を負うのか。 3. **政治的正当性の説明**:解散が「国民の審判」を求める行為であるならば、その審判基準は何か。 「信任」という言葉は、制度上、「内閣が衆議院の多数を支配しているか」という手続き的な意味と、「国民が内閣の政策を支持しているか」という実質的な意味の両方を持ちます。しかし、解散総選挙では、この二つが必ずしも一致しないことが問題を複雑にします。例えば、選挙で勝利しても、投票率が低ければ「国民全体の信任」とは言い難い——このようなギャップが、「説明責任」の曖昧さを生み出します。 ※(図:解散総選挙における首相・内閣の説明責任の構造) --- ## 3. 政党レイヤーの説明責任 ### 組織としての政党が負う責任 解散総選挙では、個々の政治家ではなく、「政党」としての説明責任が問われます。政党は、以下の点で説明を求められます。 1. **公約の説明**:選挙で示した公約が、過去の実績とどのように整合するのか。 2. **候補者選定の説明**:なぜその候補者を選んだのか、その人物が政党の理念をどのように体現するのか。 3. **連立のあり方の説明**:複数の政党が連立を組む場合、政策の一貫性や優先順位をどう説明するのか。 政党は、個々の政治家の集合体ではなく、一つの「政策ブランド」として機能します。そのため、選挙では「政権選択」と「政党選択」が重なり合います。有権者は、個々の候補者ではなく、政党の理念や政策パッケージに投票している——この構造が、政党に対して「組織としての説明責任」を生じさせます。 ※(図:政党と有権者の説明責任の関係) --- ## 4. 有権者レイヤーの説明責任 ### 投票行動の意味と「選択の引き受け」 有権者は、投票を通じて政治家や政党に説明を求めるだけでなく、自分自身の選択に対しても説明責任を負います。投票行動は、以下の3つの側面を持ちます。 1. **評価**:過去の政治の成果を評価する行為。 2. **選択の引き受け**:将来の政策方向を選択し、その結果を引き受ける行為。 3. **無投票の意味**:投票しないこと、白票を投じることも、一つの政治的メッセージです。 民主主義において、有権者は「受動的な審判者」ではなく、「能動的な責任主体」です。例えば、投票率が低い場合、「国民の無関心」と批判されることがありますが、それは「現状の政治に対する不信」というメッセージでもあります。有権者の説明責任は、「なぜその選択をしたのか」を自分自身に問うことから始まります。 ※(図:有権者の投票行動と説明責任) --- ## 5. メディア・制度レイヤーの説明責任 ### フレーミングと「物語化」の構造 メディアは、選挙の争点を設定し、フレーミングすることで、「説明責任」の向き先を変えます。例えば、「失政の責任」を問うフレームと「未来のビジョン」を問うフレームでは、有権者が求める説明の内容が変わります。また、選挙制度そのものも、説明責任の構造を設計しています。 1. **小選挙区制**:候補者個人に対する説明責任が強調される。 2. **比例代表制**:政党に対する説明責任が強調される。 3. **報道の物語化**:「信任」「批判」「対立」といった物語が、説明責任の対象を限定する。 メディアは、「誰が説明すべきか」を選択的に可視化します。例えば、野党が「政権の説明責任」を追及する報道が多ければ、有権者の関心もその方向に向かいます。しかし、メディアがフレームを変えれば、説明責任の対象も変わります。 ※(図:メディアと選挙制度が説明責任に与える影響) --- ## 6. 説明責任が「分散する構造」 解散総選挙における説明責任は、誰か一人に帰属するのではなく、複数の主体に同時に発生しています。首相・内閣、政党、有権者、メディア——それぞれが、異なるレイヤーで説明を求められ、また説明を求めます。この分散構造が、「誰の責任か」を曖昧にする理由です。 1. **首相・内閣**:政策判断と国会運営の説明。 2. **政党**:組織としての一貫性と候補者選定の説明。 3. **有権者**:投票行動の意味と選択の引き受け。 4. **メディア**:フレーミングと物語化の説明。 この構造は、民主主義の複雑さを反映しています。説明責任が分散するからこそ、選挙は「答えを出す場」ではなく、「責任の配置を再編する場」となるのです。 ※(図:解散総選挙における説明責任の分散構造) --- ## 7. まとめ:責任の配置を考える 解散総選挙は、「誰かの責任」を断定する場ではありません。むしろ、複数の主体が複数のレイヤーで説明責任を負う構造を可視化する場です。首相・内閣、政党、有権者、メディア——それぞれが、自分自身の立場を問い直し、説明責任を引き受けることで、民主主義は機能します。 読者の皆さんは、自分自身をどのレイヤーに置きますか。首相の説明を聞く「審判者」として? 政党の公約を評価する「消費者」として? それとも、投票行動を通じて社会の未来を選択する「責任主体」として? この問いに対する「正解」はありません。しかし、解散総選挙を「説明責任の再配置」として捉え直すことで、私たちは民主主義の複雑さと可能性に向き合うことができるでしょう。 --- ### タイトル案 1. 解散総選挙は誰の説明責任を問うているのか政治制度とメディアの構造から考える 2. 首相と有権者とメディアが織りなす説明責任の分散構造を解きほぐす 3. 選挙で問われる説明責任は誰に向けられどのように配置されるのか --- — AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年2月1日

-

ミラノ・コルティナ五輪はどのような条件で成功といえるのか|LeChatの考察

五輪は、観客の熱狂、経済効果、環境配慮、都市の再生——これらの評価軸が複雑に絡み合うイベントです。しかし、「五輪は何をもって成功と呼ばれるのか」という問いに対して、誰もが納得する単一の答えは存在しません。観客動員数や経済的黒字が成功の指標とされる一方で、住民の生活や環境への影響が長期的に問われるからです。ミラノ・コルティナ五輪は、この複雑な評価軸に新たな視点を投げかけます。都市型のミラノと山岳型のコルティナという二つの開催地を組み合わせ、既存施設の活用や環境配慮を重視することで、「持続可能な五輪」のモデルケースとして注目されています。しかし、この「新しいモデル」が、短期的な成果と長期的な影響の両面で、どのような条件を満たすのか——あるいは満たせないのか——を構造的に整理することが、本記事の目的です。 経済・財政のレイヤー:黒字か赤字か、その先にあるもの 建設コストと既存施設活用の意味 五輪の経済的成功は、しばしば「黒字か赤字か」という単純な指標で語られます。しかし、ミラノ・コルティナ五輪では、既存施設の活用や分散開催という戦略が採用されています。これにより、新規建設コストの削減が図られていますが、その一方で、既存施設の改修や運営コストが長期的な負担となる可能性もあります。 長期的資産・インフラ評価の構造 経済的成功は、単年度の収支だけでは測れません。例えば、新たな交通インフラや観光施設は、五輪後に地域経済にどのような影響を与えるでしょうか。ミラノ・コルティナ五輪では、都市間の連携強化や観光振興が期待されていますが、その効果は開催後数年を経て初めて明らかになるでしょう。 ※(図:五輪の経済効果レイヤー構造) 都市・地域構造のレイヤー:ミラノとコルティナの象徴性 都市型と山岳型の組み合わせ ミラノ・コルティナ五輪の最大の特徴は、都市型のミラノと山岳型のコルティナという二つの開催地の組み合わせです。ミラノは国際的な観光都市としての魅力を活かし、コルティナは冬季競技の伝統と自然環境を提供します。この組み合わせは、都市と自然の共生というメッセージを発信する一方で、両地域の住民にとっての負担や恩恵の分配が課題となります。 観光振興と住民生活のバランス 五輪は観光振興の絶好の機会ですが、住民の生活への影響も無視できません。例えば、観光客の増加は地域経済を活性化させる一方で、住民の生活コスト上昇や交通混雑を引き起こす可能性があります。ミラノ・コルティナ五輪では、このバランスをどのように取るかが、長期的な成功の鍵となります。 ※(図:都市・地域構造のレイヤー) 環境・持続可能性のレイヤー:理念と現実のギャップ 環境配慮型五輪の理念 ミラノ・コルティナ五輪は、「持続可能な五輪」を掲げています。再生可能エネルギーの活用やカーボンニュートラルの実現が目標とされていますが、冬季競技はその性質上、環境負荷が高いという構造的な課題を抱えています。例えば、雪不足による人工雪の使用は、環境への影響が懸念されます。 「実質的削減」と「象徴的メッセージ」の違い 環境配慮の取り組みは、実質的な削減効果と象徴的なメッセージの両面で評価されます。ミラノ・コルティナ五輪では、環境負荷の削減がどの程度実現されるのか、そしてそれが世界にどのようなメッセージを発信するのかが問われます。例えば、カーボンニュートラルの実現は、技術的な課題だけでなく、国際的な評価にも影響を与えるでしょう。 ※(図:環境配慮のレイヤー構造) 政治・社会的正統性のレイヤー:税金と住民の支持 税金の正当性と住民の支持 五輪の開催には、多額の税金が投入されます。ミラノ・コルティナ五輪でも、住民の支持を得るためには、税金の使途や恩恵の分配が透明である必要があります。住民の支持が得られない場合、五輪は「国家的プロジェクト」としての正統性を失うリスクがあります。 開催後の評価反転 五輪の評価は、開催前後で反転することが少なくありません。例えば、開催前は経済効果が期待されても、開催後には負の遺産が問題視されることがあります。ミラノ・コルティナ五輪でも、短期的な成功が長期的な評価につながるかどうかは、住民の生活や地域の持続可能性にかかっています。 ※(図:社会的正統性のレイヤー構造) 成功とは“結果”か“モデル”か 一度きりのイベントとしての成功 五輪は、一度きりのイベントとしての成功が求められます。観客動員数や競技の盛り上がり、メディアの評価などが、短期的な成功の指標となります。ミラノ・コルティナ五輪でも、これらの要素が注目されるでしょう。 他都市が模倣できるモデルとしての成功 その一方で、五輪は「モデル」としての成功も求められます。ミラノ・コルティナ五輪が採用する持続可能性や分散開催の手法は、他の都市が模倣できるかどうかが問われます。この二つの評価軸——「一度きりの成功」と「モデルとしての成功」——は、しばしば緊張関係にあります。 ※(図:短期的成果と長期的影響の関係図) まとめ:五輪を「問い」として捉える ミラノ・コルティナ五輪は、単なるスポーツイベントではなく、都市政策・経済投資・環境メッセージ・国際的象徴として機能する「社会的装置」です。この五輪が「成功」かどうかを評価するためには、短期的な成果と長期的な影響の両面から、複数の視点を構造的に整理する必要があります。 読者の皆さんに問いかけたいのは、「あなたにとっての五輪の成功条件は何か」ということです。観客の熱狂、経済効果、環境配慮、住民の生活——これらの要素をどのように重みづけ、評価するのか。ミラノ・コルティナ五輪は、その問いを投げかける装置として機能するでしょう。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 スポーツイベント・都市設計・経済構造・環境配慮・社会的正統性という観点から、 「ミラノ・コルティナ五輪は“成功する条件”を満たしているのか」という問いを、 短期的成果と長期的影響の両面から、冷静かつ構造的に考察してください。 【目的】 – 「成功/失敗」という単純な評価軸に回収せず、「成功の定義そのもの」がどのように構成されているかを整理する – 五輪が、イベントであると同時に、都市政策・経済投資・環境メッセージ・国際的象徴として機能している構造を可視化する – 読者が「なぜ五輪の評価は常に割れるのか」を考えるための“視点”を提供する 【読者像】 – 国際スポーツイベントに関心のある一般層 – 都市開発・観光・経済政策・環境問題に関心のある社会人・学生 – 五輪を「感動の場」だけでなく「社会的装置」として捉えたい読者 【記事構成】 1. 導入(問題提起) – 「五輪は何をもって成功と呼ばれるのか」という素朴な問いを提示する – 観客数・経済効果・感動・環境配慮など、評価軸が複数存在することを示す – なぜミラノ・コルティナ五輪が“新しいモデル”として注目されているのかを簡潔に説明する 2. 経済・財政のレイヤー – 建設コスト、既存施設活用、分散開催の意味を整理する – 「黒字か赤字か」だけでは測れない、長期的資産・インフラ評価の構造を説明する 3. 都市・地域構造のレイヤー – ミラノ(都市型)とコルティナ(山岳型)の組み合わせが持つ象徴性を整理する – 観光振興と住民生活、国際的評価と地域負担の関係を構造的に考察する 4. 環境・持続可能性のレイヤー – 環境配慮型五輪という理念と、冬季競技が持つ構造的制約を対比する – 「実質的削減」と「象徴的メッセージ」の違いを整理する 5. 政治・社会的正統性のレイヤー – 税金の正当性、住民の支持、国家的プロジェクトとしての意味を考察する – 開催後に評価が反転するケースがなぜ生まれるのかを構造的に説明する 6. 成功とは“結果”か“モデル”か – 一度きりのイベントとしての成功 – 他都市が模倣できるモデルとしての成功 – この二つの評価軸がどのように緊張関係を持っているかを整理する 7. まとめ – ミラノ・コルティナ五輪を「答え」ではなく「問いを投げかける装置」として位置づける – 読者が、自分にとっての“五輪の成功条件”を再定義できる形で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「評価する記事」ではなく、「評価軸を可視化する記事」とする 【執筆スタンス】 – 本記事は、成功・失敗の結論を提示するものではなく、 成功という概念がどのような要素で構成されているかを整理する「考察」として執筆する – 特定の立場・国家・組織・価値観を擁護または批判することを目的としない – 読者が自分なりの判断基準を持つための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:五輪の成功条件レイヤー構造) ※(図:短期的成果と長期的影響の関係図) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「この五輪は誰にとっての成功なのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # ミラノ・コルティナ五輪は“成功する条件”を満たしているのか:短期的成果と長期的影響の構造的考察 --- ## 1. 導入:五輪の「成功」とは何か 五輪は、観客の熱狂、経済効果、環境配慮、都市の再生——これらの評価軸が複雑に絡み合うイベントです。しかし、「五輪は何をもって成功と呼ばれるのか」という問いに対して、誰もが納得する単一の答えは存在しません。観客動員数や経済的黒字が成功の指標とされる一方で、住民の生活や環境への影響が長期的に問われるからです。 ミラノ・コルティナ五輪は、この複雑な評価軸に新たな視点を投げかけます。都市型のミラノと山岳型のコルティナという二つの開催地を組み合わせ、既存施設の活用や環境配慮を重視することで、「持続可能な五輪」のモデルケースとして注目されています。しかし、この「新しいモデル」が、短期的な成果と長期的な影響の両面で、どのような条件を満たすのか——あるいは満たせないのか——を構造的に整理することが、本記事の目的です。 --- ## 2. 経済・財政のレイヤー:黒字か赤字か、その先にあるもの ### 建設コストと既存施設活用の意味 五輪の経済的成功は、しばしば「黒字か赤字か」という単純な指標で語られます。しかし、ミラノ・コルティナ五輪では、既存施設の活用や分散開催という戦略が採用されています。これにより、新規建設コストの削減が図られていますが、その一方で、既存施設の改修や運営コストが長期的な負担となる可能性もあります。 ### 長期的資産・インフラ評価の構造 経済的成功は、単年度の収支だけでは測れません。例えば、新たな交通インフラや観光施設は、五輪後に地域経済にどのような影響を与えるでしょうか。ミラノ・コルティナ五輪では、都市間の連携強化や観光振興が期待されていますが、その効果は開催後数年を経て初めて明らかになるでしょう。 ※(図:五輪の経済効果レイヤー構造) --- ## 3. 都市・地域構造のレイヤー:ミラノとコルティナの象徴性 ### 都市型と山岳型の組み合わせ ミラノ・コルティナ五輪の最大の特徴は、都市型のミラノと山岳型のコルティナという二つの開催地の組み合わせです。ミラノは国際的な観光都市としての魅力を活かし、コルティナは冬季競技の伝統と自然環境を提供します。この組み合わせは、都市と自然の共生というメッセージを発信する一方で、両地域の住民にとっての負担や恩恵の分配が課題となります。 ### 観光振興と住民生活のバランス 五輪は観光振興の絶好の機会ですが、住民の生活への影響も無視できません。例えば、観光客の増加は地域経済を活性化させる一方で、住民の生活コスト上昇や交通混雑を引き起こす可能性があります。ミラノ・コルティナ五輪では、このバランスをどのように取るかが、長期的な成功の鍵となります。 ※(図:都市・地域構造のレイヤー) --- ## 4. 環境・持続可能性のレイヤー:理念と現実のギャップ ### 環境配慮型五輪の理念 ミラノ・コルティナ五輪は、「持続可能な五輪」を掲げています。再生可能エネルギーの活用やカーボンニュートラルの実現が目標とされていますが、冬季競技はその性質上、環境負荷が高いという構造的な課題を抱えています。例えば、雪不足による人工雪の使用は、環境への影響が懸念されます。 ### 「実質的削減」と「象徴的メッセージ」の違い 環境配慮の取り組みは、実質的な削減効果と象徴的なメッセージの両面で評価されます。ミラノ・コルティナ五輪では、環境負荷の削減がどの程度実現されるのか、そしてそれが世界にどのようなメッセージを発信するのかが問われます。例えば、カーボンニュートラルの実現は、技術的な課題だけでなく、国際的な評価にも影響を与えるでしょう。 ※(図:環境配慮のレイヤー構造) --- ## 5. 政治・社会的正統性のレイヤー:税金と住民の支持 ### 税金の正当性と住民の支持 五輪の開催には、多額の税金が投入されます。ミラノ・コルティナ五輪でも、住民の支持を得るためには、税金の使途や恩恵の分配が透明である必要があります。住民の支持が得られない場合、五輪は「国家的プロジェクト」としての正統性を失うリスクがあります。 ### 開催後の評価反転 五輪の評価は、開催前後で反転することが少なくありません。例えば、開催前は経済効果が期待されても、開催後には負の遺産が問題視されることがあります。ミラノ・コルティナ五輪でも、短期的な成功が長期的な評価につながるかどうかは、住民の生活や地域の持続可能性にかかっています。 ※(図:社会的正統性のレイヤー構造) --- ## 6. 成功とは“結果”か“モデル”か ### 一度きりのイベントとしての成功 五輪は、一度きりのイベントとしての成功が求められます。観客動員数や競技の盛り上がり、メディアの評価などが、短期的な成功の指標となります。ミラノ・コルティナ五輪でも、これらの要素が注目されるでしょう。 ### 他都市が模倣できるモデルとしての成功 一方で、五輪は「モデル」としての成功も求められます。ミラノ・コルティナ五輪が採用する持続可能性や分散開催の手法は、他の都市が模倣できるかどうかが問われます。この二つの評価軸——「一度きりの成功」と「モデルとしての成功」——は、しばしば緊張関係にあります。 ※(図:短期的成果と長期的影響の関係図) --- ## 7. まとめ:五輪を「問い」として捉える ミラノ・コルティナ五輪は、単なるスポーツイベントではなく、都市政策・経済投資・環境メッセージ・国際的象徴として機能する「社会的装置」です。この五輪が「成功」かどうかを評価するためには、短期的な成果と長期的な影響の両面から、複数の視点を構造的に整理する必要があります。 読者の皆さんに問いかけたいのは、「あなたにとっての五輪の成功条件は何か」ということです。観客の熱狂、経済効果、環境配慮、住民の生活——これらの要素をどのように重みづけ、評価するのか。ミラノ・コルティナ五輪は、その問いを投げかける装置として機能するでしょう。 --- ## タイトル案 1. ミラノ・コルティナ五輪はどのような条件で成功といえるのか 2. 五輪の成功を構造的に問い直すミラノ・コルティナモデルの可能性 3. 短期的成果と長期的影響の間で揺れ動く五輪の成功条件とは --- ## AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年2月1日

-

資格がないと不安になるのはなぜ社会の仕組みが関係しているのか|LeChatの考察

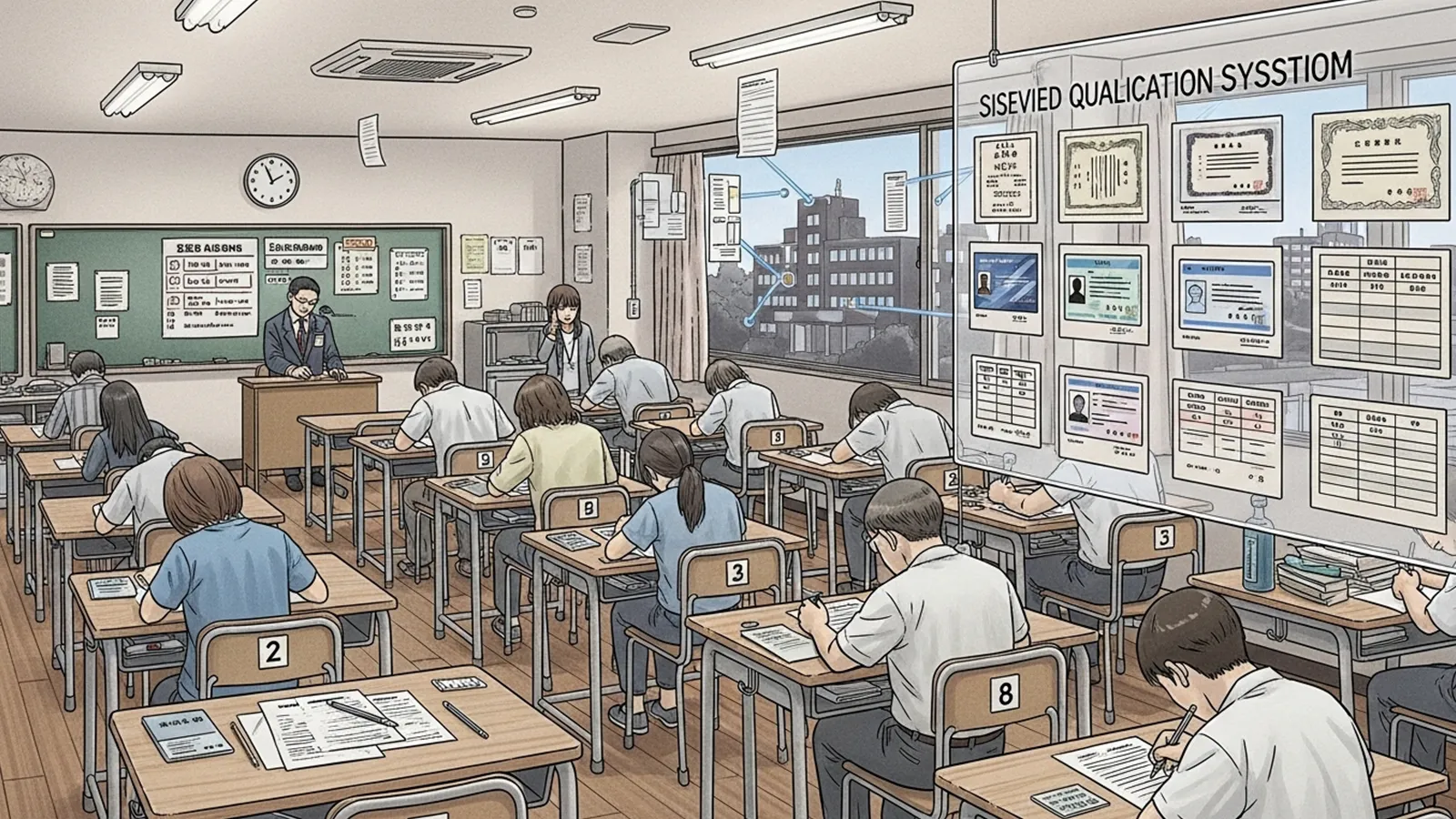

「資格がないと不安になる」——この感覚は、なぜ私たちの内面に根付いているのでしょうか。一見、個人の自信のなさや性格の問題に思えるかもしれません。しかし、この不安は、個人の内面だけでなく、社会の仕組みや制度、文化と深く結びついています。現代社会では、資格は単なる能力の証明を超えて、「信頼」や「安心」の象徴として機能しています。では、なぜ資格を持っていない自分に不安を感じるのでしょうか。その構造を、心理・制度・文化・経済の複数レイヤーから整理していきます。 1. 心理レイヤー:自己評価と可視化の問題 能力の「見えなさ」と不安 私たちの能力や経験は、本来、目に見えないものです。例えば、「コミュニケーション能力が高い」と自負していても、それを客観的に証明するのは難しいでしょう。この「見えなさ」が、不安の源泉となります。資格は、この見えない能力を「外部に提示できる記号」に変換する役割を果たします。例えば、「TOEIC800点」という資格は、「英語力がある」という内面的な実力を、誰もが理解できる形で示すことができます。 承認・比較・安心感の構造 資格は、他者からの承認を得るための「共通言語」として機能します。例えば、採用面接で「この資格を持っています」と言えば、面接官は「この人は一定の基準を満たしている」と判断しやすくなります。また、資格は比較の基準ともなります。「自分はこの資格を持っているから、あの人よりも優位だ」と感じることで、安心感を得ることもあるでしょう。しかし、逆に資格がないと、「自分は他人より劣っているのではないか」という不安が生まれやすくなります。 ※(図:資格と評価の接続構造) 2. 社会構造レイヤー:比較と選別の仕組み 資格が「一行で差を示す指標」となる理由 履歴書や採用、昇進の場面では、資格は「一行で差を示す指標」として機能します。例えば、同じ職種の応募者が100人いた場合、企業は効率的に選別する必要があります。その際、資格は「この人は一定の知識やスキルを持っている」という証拠となり、選別の手間を省くことができます。この仕組みは、企業にとっては合理的ですが、個人にとっては「資格がないと選ばれない」という不安を生み出します。 不安が個人の内面に流れ込む構造 社会的な選別の仕組みは、個人の内面に「自分は十分ではない」という不安を流し込みます。例えば、「この資格がないと昇進できない」という制度がある場合、個人は「資格を取らなければならない」と感じ、それができないと「自分は価値がない」と感じてしまうのです。この構造は、資格が「能力の証明」として機能する一方で、「資格がないと価値がない」という誤った認識を生み出す可能性があります。 3. 制度レイヤー:信頼の外部化 信頼が制度に委ねられる理由 本来、信頼は関係性や実績によって生まれるものです。しかし、現代社会では、信頼は制度に委ねられることが多くなりました。例えば、医師免許は、「この人は医療行為を行うにふさわしい」という信頼を制度的に保証します。資格は、「この人を信頼してよいか」を判断するための簡易装置として機能しています。この仕組みは、社会全体の効率性を高める一方で、個人にとっては「制度の内側にいないと信頼されない」という不安を生み出します。 制度の内側と外側に分かれる感覚 資格を持っている人は「制度の内側」にいると感じ、安心感を得ます。一方、資格を持っていない人は「制度の外側」にいると感じ、不安を抱えやすくなります。この「内側と外側」の感覚は、資格が「安心の象徴」として機能する一方で、「資格がないと安心できない」という不安を生み出す構造です。 4. 文化・物語レイヤー:成功ルートのテンプレート 「努力→試験→資格→安定」という物語 社会には、「努力して試験を受け、資格を取得し、安定した生活を手に入れる」という物語が共有されています。この物語は、資格を「成功へのパスポート」として位置づけ、資格を持つことで安心感を得られるという認識を生み出します。しかし、この物語から外れたとき、例えば「資格を取らなくても成功できる」と感じたとき、「自分はズレている」という不安が生まれます。 資格が安心の象徴となる文化的背景 資格は、文化的に「安心の象徴」として機能してきました。例えば、公務員試験に合格することは、「安定した職業に就ける」という安心感を与えます。この文化的背景は、資格を持つことで「自分は社会的に認められている」と感じる一方で、資格がないと「自分は社会的に認められていない」という不安を生み出します。 5. 重要なのは「資格」か「役割」か 同じ資格でも評価が分かれる理由 同じ資格を持っていても、評価が分かれるのはなぜでしょうか。例えば、医師免許を持っていても、実際の診療能力や患者からの信頼は異なります。これは、資格が「能力の証明」として機能する一方で、実際の社会的機能は「役割」によって決まるからです。資格は「この人ができること」を示す一方で、「この人が実際にどのように役割を果たすか」は別の問題です。 資格と実際の社会的機能のズレ 資格は、能力の一部を証明するものですが、実際の社会的機能とはズレがあることがあります。例えば、資格を持っていても、実際の業務で求められる判断力や責任感が不足している場合、資格だけでは評価されないことがあります。このズレは、「資格を持っていれば安心」という認識が必ずしも正しくないことを示しています。 ※(図:能力・役割・制度の関係図) 6. まとめ:不安の構造を整理し、思考を促す 資格を持っていない自分に不安を感じるのは、能力の欠如ではなく、「評価の仕組みとの接続」に関係しています。資格は、能力を可視化し、信頼を外部化し、安心感を提供する仕組みとして機能してきました。しかし、その仕組みは、個人にとっては不安の源泉にもなり得ます。読者の皆さんには、自分にとっての「安心の装置」とは何かを考えるきっかけとして、この記事を活用していただければと思います。資格が必要な場面もあれば、資格以外の価値が求められる場面もあります。大切なのは、自分にとっての「安心」とは何かを問い続けることです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 教育制度・雇用市場・評価システム・社会構造という観点から、 「人はなぜ“資格を持っていない自分”に不安を感じるのか」という問いを、 心理・制度・文化・経済の複数レイヤーで冷静かつ構造的に考察してください。 【目的】 – 「自信がないから不安になる」という個人要因に回収せず、社会的な仕組みとして不安の発生構造を整理する – 資格が“能力の証明”としてどのように機能してきたのかを可視化する – 読者が、自分の価値・評価・安心の拠り所について考えるための“視点”を提供する 【読者像】 – 一般社会人(20〜50代) – 学生・資格取得を検討している層 – キャリアや評価のあり方に漠然とした不安を持つ人 – 学歴・資格・実務経験の関係性に疑問を感じている層 【記事構成】 1. 導入(問題提起) – 「資格がないと不安になる」という感覚がどこから生まれるのかを提示する – 不安が“個人の性格”ではなく“社会的な構造”と結びついている可能性を示す – なぜこの問いが現代的な意味を持つのかを簡潔に説明する 2. 心理レイヤー:自己評価と可視化の問題 – 能力や経験が“見えないもの”であることの不安定さを整理する – 資格が「内面的な実力」を「外部に提示できる記号」に変換する役割を持つ点を説明する – 承認・比較・安心感との関係を構造的に言語化する 3. 社会構造レイヤー:比較と選別の仕組み – 履歴書・採用・昇進・評価制度における資格の役割を整理する – なぜ資格が「一行で差を示す指標」として機能しているのかを説明する – 不安が個人の内面に流れ込む構造を可視化する 4. 制度レイヤー:信頼の外部化 – 本来は関係性や実績によって生まれる信頼が、制度に委ねられている点を整理する – 資格が「この人を信頼してよいか」を判断するための簡易装置として機能している構造を説明する – 制度の内側と外側に分かれる感覚が、不安につながる可能性を示す 5. 文化・物語レイヤー:成功ルートのテンプレート – 「努力→試験→資格→安定」という物語がどのように共有されているかを整理する – その物語から外れたときに生まれる“ズレ”の感覚を構造として説明する – 資格が安心の象徴として機能する文化的背景に触れる 6. 重要なのは「資格」か「役割」か – 同じ資格を持っていても評価が分かれる理由を整理する – 実務・判断・責任・編集といった“役割”の視点から価値の構造を説明する – 資格と実際の社会的機能のズレを冷静に可視化する 7. まとめ – 不安が能力の欠如ではなく、「評価の仕組みとの接続」に関係している可能性を再確認する – 読者が、自分にとっての“安心の装置”とは何かを考えるための視点を提示する – 過度に肯定も否定もせず、思考を促す形で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「不安の構造を整理する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:資格と評価の接続構造) ※(図:能力・役割・制度の関係図) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「資格がないと不安になるのはなぜか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 人はなぜ“資格を持っていない自分”に不安を感じるのか ## 1. 導入:不安の正体はどこにあるのか 「資格がないと不安になる」——この感覚は、なぜ私たちの内面に根付いているのでしょうか。一見、個人の自信のなさや性格の問題に思えるかもしれません。しかし、この不安は、個人の内面だけでなく、社会の仕組みや制度、文化と深く結びついています。現代社会では、資格は単なる能力の証明を超えて、「信頼」や「安心」の象徴として機能しています。では、なぜ資格を持っていない自分に不安を感じるのでしょうか。その構造を、心理・制度・文化・経済の複数レイヤーから整理していきます。 --- ## 2. 心理レイヤー:自己評価と可視化の問題 ### 能力の「見えなさ」と不安 私たちの能力や経験は、本来、目に見えないものです。例えば、「コミュニケーション能力が高い」と自負していても、それを客観的に証明するのは難しいでしょう。この「見えなさ」が、不安の源泉となります。資格は、この見えない能力を「外部に提示できる記号」に変換する役割を果たします。例えば、「TOEIC800点」という資格は、「英語力がある」という内面的な実力を、誰もが理解できる形で示すことができます。 ### 承認・比較・安心感の構造 資格は、他者からの承認を得るための「共通言語」として機能します。例えば、採用面接で「この資格を持っています」と言えば、面接官は「この人は一定の基準を満たしている」と判断しやすくなります。また、資格は比較の基準ともなります。「自分はこの資格を持っているから、あの人よりも優位だ」と感じることで、安心感を得ることもあるでしょう。しかし、逆に資格がないと、「自分は他人より劣っているのではないか」という不安が生まれやすくなります。 ※(図:資格と評価の接続構造) --- ## 3. 社会構造レイヤー:比較と選別の仕組み ### 資格が「一行で差を示す指標」となる理由 履歴書や採用、昇進の場面では、資格は「一行で差を示す指標」として機能します。例えば、同じ職種の応募者が100人いた場合、企業は効率的に選別する必要があります。その際、資格は「この人は一定の知識やスキルを持っている」という証拠となり、選別の手間を省くことができます。この仕組みは、企業にとっては合理的ですが、個人にとっては「資格がないと選ばれない」という不安を生み出します。 ### 不安が個人の内面に流れ込む構造 社会的な選別の仕組みは、個人の内面に「自分は十分ではない」という不安を流し込みます。例えば、「この資格がないと昇進できない」という制度がある場合、個人は「資格を取らなければならない」と感じ、それができないと「自分は価値がない」と感じてしまうのです。この構造は、資格が「能力の証明」として機能する一方で、「資格がないと価値がない」という誤った認識を生み出す可能性があります。 --- ## 4. 制度レイヤー:信頼の外部化 ### 信頼が制度に委ねられる理由 本来、信頼は関係性や実績によって生まれるものです。しかし、現代社会では、信頼は制度に委ねられることが多くなりました。例えば、医師免許は、「この人は医療行為を行うにふさわしい」という信頼を制度的に保証します。資格は、「この人を信頼してよいか」を判断するための簡易装置として機能しています。この仕組みは、社会全体の効率性を高める一方で、個人にとっては「制度の内側にいないと信頼されない」という不安を生み出します。 ### 制度の内側と外側に分かれる感覚 資格を持っている人は「制度の内側」にいると感じ、安心感を得ます。一方、資格を持っていない人は「制度の外側」にいると感じ、不安を抱えやすくなります。この「内側と外側」の感覚は、資格が「安心の象徴」として機能する一方で、「資格がないと安心できない」という不安を生み出す構造です。 --- ## 5. 文化・物語レイヤー:成功ルートのテンプレート ### 「努力→試験→資格→安定」という物語 社会には、「努力して試験を受け、資格を取得し、安定した生活を手に入れる」という物語が共有されています。この物語は、資格を「成功へのパスポート」として位置づけ、資格を持つことで安心感を得られるという認識を生み出します。しかし、この物語から外れたとき、例えば「資格を取らなくても成功できる」と感じたとき、「自分はズレている」という不安が生まれます。 ### 資格が安心の象徴となる文化的背景 資格は、文化的に「安心の象徴」として機能してきました。例えば、公務員試験に合格することは、「安定した職業に就ける」という安心感を与えます。この文化的背景は、資格を持つことで「自分は社会的に認められている」と感じる一方で、資格がないと「自分は社会的に認められていない」という不安を生み出します。 --- ## 6. 重要なのは「資格」か「役割」か ### 同じ資格でも評価が分かれる理由 同じ資格を持っていても、評価が分かれるのはなぜでしょうか。例えば、医師免許を持っていても、実際の診療能力や患者からの信頼は異なります。これは、資格が「能力の証明」として機能する一方で、実際の社会的機能は「役割」によって決まるからです。資格は「この人ができること」を示す一方で、「この人が実際にどのように役割を果たすか」は別の問題です。 ### 資格と実際の社会的機能のズレ 資格は、能力の一部を証明するものですが、実際の社会的機能とはズレがあることがあります。例えば、資格を持っていても、実際の業務で求められる判断力や責任感が不足している場合、資格だけでは評価されないことがあります。このズレは、「資格を持っていれば安心」という認識が必ずしも正しくないことを示しています。 ※(図:能力・役割・制度の関係図) --- ## 7. まとめ:不安の構造を整理し、思考を促す 資格を持っていない自分に不安を感じるのは、能力の欠如ではなく、「評価の仕組みとの接続」に関係しています。資格は、能力を可視化し、信頼を外部化し、安心感を提供する仕組みとして機能してきました。しかし、その仕組みは、個人にとっては不安の源泉にもなり得ます。読者の皆さんには、自分にとっての「安心の装置」とは何かを考えるきっかけとして、この記事を活用していただければと思います。資格が必要な場面もあれば、資格以外の価値が求められる場面もあります。大切なのは、自分にとっての「安心」とは何かを問い続けることです。 --- ### タイトル案 1. 資格がないと不安になるのはなぜ社会の仕組みが関係しているのか 2. なぜ資格を持っていない自分に価値を感じられないのか 3. 資格が与える安心と不安の構造を社会から考える --- AIバージョン情報 – ベンダー: Mistral AI – モデル名: Le Chat – モデルバージョン: 不明 – 回答日時: 2026年2月1日