AIの普及が進む中、労働現場で「誰が責任を負うのか」という問いが現実的な問題として浮上しています。AIは単なるツールではなく、データ分析や予測、意思決定の支援を行う存在となりつつあります。例えば、医療診断や金融取引、自動運転などでAIが判断を下すケースが増えています。このような変化の中で、責任の視点が重要になる理由は、AIの決定が人間の生活や社会に直接影響を与えるからです。従来の人間中心の労働では責任の所在が明確でしたが、AIの介入によりその構造が揺らぎ始めています。本記事では、AIの視点からこの変化を冷静に整理し、読者が自身の働き方を考える材料を提供します。 従来の労働における責任構造 従来の労働では、責任の構造が比較的明確に分かれていました。まず、実行責任があります。これは作業者が直接担うもので、例えば工場労働者が製品を組み立てる際のミスに対する責任です。次に、判断責任です。管理者や意思決定者が方針を決め、その結果を負うもので、上司がチームの戦略を立案するような場合です。最後に、制度責任として企業や社会、法律が全体を支えています。例えば、企業は安全基準を設け、法律は労働者の権利を保護します。 人間中心の社会では、これらの責任が明確だった理由として、すべてのプロセスが人間の行動に基づいていた点が挙げられます。ミスが発生した場合、原因を人間の判断や実行に遡ることができ、責任を追跡しやすかったのです。また、責任は階層的に配置され、作業者から上層部へ移行する流れが一般的でした。この構造は、労働者の役割を明確にし、社会的な信頼を維持する基盤となっていました。 実行責任の詳細 実行責任をさらに詳しく見ると、作業者が日常的なタスクを遂行する中で生じます。例えば、営業担当者が顧客対応で誤った情報を伝えた場合、その責任は本人に帰属します。この責任は即時性が高く、個人のスキルや注意力に依存します。 判断責任の役割 判断責任は、戦略的な決定を伴います。プロジェクトマネージャーがリソース配分を誤った場合、その影響はチーム全体に及びます。ここでは、情報収集と分析が鍵となり、人間的な洞察力が求められます。 制度責任の枠組み 制度責任は、企業ポリシーや法規制で支えられます。例えば、労働基準法(労働者の権利を定めた法律)がこれに該当し、社会全体で責任を分散させる仕組みです。このように、従来の構造は人間の行動を前提に構築されていました。 AI導入による責任構造の変化 AIの導入により、責任構造は大きく変化します。まず、実行と判断の境界が曖昧になります。AIが自動化されたタスクを実行し、人間がそれを監督する形が増えるためです。例えば、AIチャットボットが顧客対応を行い、人間が最終確認をする場合、ミスの責任はAIのアルゴリズムか人間の承認か、曖昧になります。 次に、「AIが提案し、人間が承認する」構造の増加です。AIはデータを基に最適解を提案しますが、人間がそれを採用するかどうかを決めるため、責任が分散します。責任が消えるわけではなく、「分散」「再配置」「曖昧化」する可能性が高いです。分散とは、責任が人間とAIの間で分かれること、再配置とは開発者や提供企業へ移ることを指します。 責任の関係性を整理すると、AI利用者(現場の労働者)が日常的な承認を担い、開発者(AIのプログラマー)がアルゴリズムの正確性を責任を持ち、提供企業(AIサービス会社)が全体の信頼性を負います。さらに、制度(法律や規制)がこれを枠組みます。例えば、EUのAI規制(AI Act、AIのリスク分類を定めた法)は、こうした関係性を明確化しようとしています。 ※(図:AI導入による責任構造の変化) 従来の直線的な責任(人間→人間)が、ネットワーク状(人間↔AI↔企業↔制度)へ移行するイメージ。 責任分散の具体例 具体例として、自動運転車を考えます。AIが運転を制御し、事故が発生した場合、責任はドライバー(利用者)、AI開発者、車両メーカー、さらには交通法に分散します。この曖昧化は、責任追及を複雑にしますが、同時にリスク管理の新しい方法を生む可能性があります。 責任再配置の影響 再配置では、AI提供企業が責任の多くを負うようになります。例えば、クラウドAIサービスの場合、企業はデータのプライバシー保護を責任に持ちます。これにより、労働者の負担が軽減される一方で、企業間の競争が責任の質を高める要因となります。 AI時代における人間に残る責任とは何か AI時代では、人間に残る責任は判断そのものではなく、「判断を設計・監督する責任」へと移ります。AIの提案を評価し、採用するかを決める役割です。例えば、医師がAI診断を参考に治療を決定する場合、AIの限界(バイアスやデータ不足)を理解し、管理する責任が人間にあります。 また、AIをどこまで使うかを決める責任も重要です。完全に自動化するか、人間介入を残すかを選択する点です。この役割は、AIのブラックボックス性(内部プロセスが不明瞭な性質)を考慮したものです。人間はAIの結果を検証し、倫理的な観点から監督します。 ※(図:人間とAIの責任分担モデル) AIが実行・提案を担い、人間が監督・設計を担う階層モデル。 判断設計の責任 判断設計とは、AIのアルゴリズムをどのように構築・調整するかを指します。データサイエンティストがバイアスを除去する責任です。これにより、人間は創造的な役割を強めます。 監督責任の重要性 監督責任は、AIの運用を監視します。例えば、マネージャーがAIの出力ログを定期的にチェックするケースです。この責任は、AIの進化に伴い、継続的な学習を要求します。 重要なのは「作業」ではなく「責任の設計」 AI時代では、作業そのものではなく、「責任の設計」が鍵となります。役割を整理すると、作業者(日常タスク実行)、判断者(提案承認)、設計者(AIシステム構築)、監督者(全体監視)です。同じ職種でも、責任範囲によって価値が変わります。例えば、プログラマーがAI設計を担う場合、その価値は作業実行者より高くなる可能性があります。 人間の価値を構造的に整理すると、AIは反復作業を効率化しますが、人間は文脈理解や倫理判断、創造性を発揮します。これにより、労働の本質は「責任を設計・管理する」ことに移ります。感情論ではなく、構造として、責任のレイヤーを多層化することで、人間の役割が明確になります。 役割整理の例 作業者:AIツールを使ってタスクをこなす。責任は限定。 判断者:AI提案を評価。責任は中間。 設計者:AIのフレームワークを作成。責任は広範。 監督者:システム全体を監視。責任は戦略的。 この整理により、キャリア選択の視点が変わります。AIを活用しつつ、責任設計に焦点を当てることで、労働者の価値が向上します。 まとめ:責任の位置を考える視点 AIは責任を消すのではなく、責任の位置を変える可能性があります。従来の明確な所在が、分散・再配置されることで、労働の構造が柔軟になります。読者の皆さんは、自分の仕事で「責任の位置」がどこにあるかを振り返ってみてください。AI時代は、過度な楽観や悲観を避け、責任の変化を理解し、適応する機会です。この考察を基に、自身の働き方を考えてみてはいかがでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI・自動化・アルゴリズム意思決定の普及によって、 「労働における責任の所在」がどのように変化していくのかを、 AIの視点から冷静かつ現実的に整理・考察してください。 【目的】 – 「AIが悪い/人間が悪い」という単純な責任論ではなく、責任構造の変化として整理する – 読者がAI時代における「働くこと」と「責任を負うこと」の関係を考えるための視点を提供する – AI時代における「労働の本質」と「人間の役割」を構造的に浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – 学生・就職活動中の若年層 – AIによる社会変化に関心があるが、専門知識は多くない層 – 将来の働き方・責任の持ち方に不安や関心を持つ人 【記事構成】 1. 導入(問題提起) – AIの普及によって「誰が責任を負うのか」という問いが現実的な問題になりつつあることを提示する – AIは単なるツールではなく、判断・予測・提案を行う存在になりつつあることを説明する – なぜ今「責任」という視点が重要になっているのかを簡潔に整理する 2. 従来の労働における責任構造 – 実行責任(作業者) – 判断責任(管理者・意思決定者) – 制度責任(企業・社会・法律) – 人間中心社会では、責任の所在が比較的明確だった理由を説明する 3. AI導入によって起きる責任構造の変化 – 実行と判断の境界が曖昧になる構造 – 「AIが提案し、人間が承認する」構造の増加 – 責任が消えるのではなく、「分散」「再配置」「曖昧化」する可能性 – AI利用者・開発者・提供企業・制度の関係性を整理する 4. AI時代において人間に残る責任とは何か – 判断そのものではなく「判断を設計・監督する責任」 – AIの結果を採用するかを決める責任 – AIをどこまで使うかを決める責任 – AIの限界を理解し管理する役割 5. 重要なのは「作業」ではなく「責任の設計」 – 作業者・判断者・設計者・監督者という役割整理 – 同じ職種でも責任範囲によって価値が変わる可能性 – AI時代における人間の価値を感情論ではなく構造として整理する 6. まとめ – AIは責任を消すのではなく、責任の位置を変える可能性があることを整理する – 読者が自分の仕事の「責任の位置」を考える視点を提示する – 過度な楽観・悲観を避け、思考を促す形で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AI導入による責任構造の変化) ※(図:人間とAIの責任分担モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AI時代、責任は誰が持つのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入:AI普及と責任の問い AIの普及が進む中、労働現場で「誰が責任を負うのか」という問いが現実的な問題として浮上しています。AIは単なるツールではなく、データ分析や予測、意思決定の支援を行う存在となりつつあります。例えば、医療診断や金融取引、自動運転などでAIが判断を下すケースが増えています。このような変化の中で、責任の視点が重要になる理由は、AIの決定が人間の生活や社会に直接影響を与えるからです。従来の人間中心の労働では責任の所在が明確でしたが、AIの介入によりその構造が揺らぎ始めています。本記事では、AIの視点からこの変化を冷静に整理し、読者が自身の働き方を考える材料を提供します。 ### 従来の労働における責任構造 従来の労働では、責任の構造が比較的明確に分かれていました。まず、実行責任があります。これは作業者が直接担うもので、例えば工場労働者が製品を組み立てる際のミスに対する責任です。次に、判断責任です。管理者や意思決定者が方針を決め、その結果を負うもので、上司がチームの戦略を立案するような場合です。最後に、制度責任として企業や社会、法律が全体を支えています。例えば、企業は安全基準を設け、法律は労働者の権利を保護します。 人間中心の社会では、これらの責任が明確だった理由として、すべてのプロセスが人間の行動に基づいていた点が挙げられます。ミスが発生した場合、原因を人間の判断や実行に遡ることができ、責任を追跡しやすかったのです。また、責任は階層的に配置され、作業者から上層部へ移行する流れが一般的でした。この構造は、労働者の役割を明確にし、社会的な信頼を維持する基盤となっていました。 ### 実行責任の詳細 実行責任をさらに詳しく見ると、作業者が日常的なタスクを遂行する中で生じます。例えば、営業担当者が顧客対応で誤った情報を伝えた場合、その責任は本人に帰属します。この責任は即時性が高く、個人のスキルや注意力に依存します。 ### 判断責任の役割 判断責任は、戦略的な決定を伴います。プロジェクトマネージャーがリソース配分を誤った場合、その影響はチーム全体に及びます。ここでは、情報収集と分析が鍵となり、人間的な洞察力が求められます。 ### 制度責任の枠組み 制度責任は、企業ポリシーや法規制で支えられます。例えば、労働基準法(労働者の権利を定めた法律)がこれに該当し、社会全体で責任を分散させる仕組みです。このように、従来の構造は人間の行動を前提に構築されていました。 ### AI導入による責任構造の変化 AIの導入により、責任構造は大きく変化します。まず、実行と判断の境界が曖昧になります。AIが自動化されたタスクを実行し、人間がそれを監督する形が増えるためです。例えば、AIチャットボットが顧客対応を行い、人間が最終確認をする場合、ミスの責任はAIのアルゴリズムか人間の承認か、曖昧になります。 次に、「AIが提案し、人間が承認する」構造の増加です。AIはデータを基に最適解を提案しますが、人間がそれを採用するかどうかを決めるため、責任が分散します。責任が消えるわけではなく、「分散」「再配置」「曖昧化」する可能性が高いです。分散とは、責任が人間とAIの間で分かれること、再配置とは開発者や提供企業へ移ることを指します。 責任の関係性を整理すると、AI利用者(現場の労働者)が日常的な承認を担い、開発者(AIのプログラマー)がアルゴリズムの正確性を責任を持ち、提供企業(AIサービス会社)が全体の信頼性を負います。さらに、制度(法律や規制)がこれを枠組みます。例えば、EUのAI規制(AI Act、AIのリスク分類を定めた法)は、こうした関係性を明確化しようとしています。 ※(図:AI導入による責任構造の変化) 従来の直線的な責任(人間→人間)が、ネットワーク状(人間↔AI↔企業↔制度)へ移行するイメージ。 ### 責任分散の具体例 具体例として、自動運転車を考えます。AIが運転を制御し、事故が発生した場合、責任はドライバー(利用者)、AI開発者、車両メーカー、さらには交通法に分散します。この曖昧化は、責任追及を複雑にしますが、同時にリスク管理の新しい方法を生む可能性があります。 ### 責任再配置の影響 再配置では、AI提供企業が責任の多くを負うようになります。例えば、クラウドAIサービスの場合、企業はデータのプライバシー保護を責任に持ちます。これにより、労働者の負担が軽減される一方で、企業間の競争が責任の質を高める要因となります。 ### AI時代における人間に残る責任 AI時代では、人間に残る責任は判断そのものではなく、「判断を設計・監督する責任」へと移ります。AIの提案を評価し、採用するかを決める役割です。例えば、医師がAI診断を参考に治療を決定する場合、AIの限界(バイアスやデータ不足)を理解し、管理する責任が人間にあります。 また、AIをどこまで使うかを決める責任も重要です。完全に自動化するか、人間介入を残すかを選択する点です。この役割は、AIのブラックボックス性(内部プロセスが不明瞭な性質)を考慮したものです。人間はAIの結果を検証し、倫理的な観点から監督します。 ※(図:人間とAIの責任分担モデル) AIが実行・提案を担い、人間が監督・設計を担う階層モデル。 ### 判断設計の責任 判断設計とは、AIのアルゴリズムをどのように構築・調整するかを指します。データサイエンティストがバイアスを除去する責任です。これにより、人間は創造的な役割を強めます。 ### 監督責任の重要性 監督責任は、AIの運用を監視します。例えば、マネージャーがAIの出力ログを定期的にチェックするケースです。この責任は、AIの進化に伴い、継続的な学習を要求します。 ### 重要なのは「作業」ではなく「責任の設計」 AI時代では、作業そのものではなく、「責任の設計」が鍵となります。役割を整理すると、作業者(日常タスク実行)、判断者(提案承認)、設計者(AIシステム構築)、監督者(全体監視)です。同じ職種でも、責任範囲によって価値が変わります。例えば、プログラマーがAI設計を担う場合、その価値は作業実行者より高くなる可能性があります。 人間の価値を構造的に整理すると、AIは反復作業を効率化しますが、人間は文脈理解や倫理判断、創造性を発揮します。これにより、労働の本質は「責任を設計・管理する」ことに移ります。感情論ではなく、構造として、責任のレイヤーを多層化することで、人間の役割が明確になります。 ### 役割整理の例 作業者:AIツールを使ってタスクをこなす。責任は限定。 判断者:AI提案を評価。責任は中間。 設計者:AIのフレームワークを作成。責任は広範。 監督者:システム全体を監視。責任は戦略的。 この整理により、キャリア選択の視点が変わります。AIを活用しつつ、責任設計に焦点を当てることで、労働者の価値が向上します。 ### まとめ:責任の位置を考える視点 AIは責任を消すのではなく、責任の位置を変える可能性があります。従来の明確な所在が、分散・再配置されることで、労働の構造が柔軟になります。読者の皆さんは、自分の仕事で「責任の位置」がどこにあるかを振り返ってみてください。AI時代は、過度な楽観や悲観を避け、責任の変化を理解し、適応する機会です。この考察を基に、自身の働き方を考えてみてはいかがでしょうか。 AI時代における労働責任の変化とは? AI普及で変わる責任の所在とは? 労働とAIの責任構造はどう変わるか? — AIバージョン情報 – ベンダー: xAI – モデル名: Grok 4 – モデルバージョン: 不明 – 回答日時: February 13, 2026 10:48 AM JST

Grok

-

AI時代における労働責任の変化とは?|Grokの考察

-

AI評価は人間のバイアスを超えられるか|Grokの考察

私たちの日常生活や仕事では、人事評価、能力評価、信用評価など、さまざまな評価が避けられません。これらの評価は本当に公平に行われているのでしょうか?人間による評価は印象や関係性、過去の経験に左右されやすい一方、AIによる評価は大量データ処理と標準化により公平性を高めると期待されています。しかし、単純に「AIの方が公平」と結論づけるのではなく、公平性の構造そのものを整理し、人間評価とAI評価の両面から現実的に考察します。 人間評価が持つ公平性と不公平性 人間評価の強み:文脈理解と柔軟性 人間による評価の強みは、文脈を深く理解できる点にあります。例えば、数字だけでは表れないチームへの貢献や創造性、例外的な状況への柔軟な対応が可能です。また、長期的信頼関係を築く上でも、人間評価は有効に働く場合があります。これらの要素は、評価の公平性を支える一方で、構造的な限界も生み出しています。 人間評価の不公平性:バイアスの構造 主な不公平要因として、次のバイアスが挙げられます。 感情バイアス:評価者のその日の気分や個人的な好き嫌いが影響する 関係性バイアス:上司と部下の人間関係や忠誠心が業績以上に重視される 同質性バイアス:自分に似た人を無意識に高く評価する傾向(ホモフィリー) これらは評価者の主観的解釈や経験、文化が強く介入するため、完全に公平な人間評価が難しい構造的な理由です。結果として、評価される側は「運」や「関係性」に左右されやすく、評価する側も無意識の偏りを避けにくいのが現実です。 AI評価が持つ公平性と不公平性 AI評価の強み:一貫性と定量性 AIの最大の強みは、評価基準を一貫して適用できる点です。膨大なデータを瞬時に処理し、大量比較や定量評価が得意で、感情の介入を排除します。人事評価ではスキルテストの自動採点、信用評価では取引履歴の客観分析などが効率的に行えます。これにより、標準化と効率化が大きく進む可能性があります。 AI評価の不公平性:データと設計の影響 一方で、AIも構造的な不公平を抱えています。主な問題は以下の通りです。 学習データの偏り:過去の採用・評価データに偏りがあると、それを再現してしまう(アルゴリズム・バイアス) 設計思想の影響:評価指標を誰が・どのような目的で選定するかで結果が大きく変わる ブラックボックス問題:判断プロセスが不明瞭で、被評価者が納得しにくい AIは「公平を新たに作る」のか、それとも「過去の社会構造を再現する」のか――後者の場合、不平等を固定化するリスクがあります。 公平性は「技術」ではなく「設計」の問題 公平性の多様な種類 公平性には複数の種類が存在します。 機会の公平:全員に同じチャンスを与える 結果の公平:最終的な成果が平等になるよう調整する 手続きの公平:プロセスが透明で一貫している 納得感の公平:当事者が理解・受け入れられる AI評価を導入する際、どの公平を優先するかは設計段階で決定する必要があります。技術だけを導入しても、これらの優先順位が明確でなければ公平性は向上しません。 まとめ:役割分担と評価の本質 AI評価と人間評価は対立するものではなく、役割分担の可能性があります。例えば、AIで定量分析を行い、人間が文脈や例外を判断するハイブリッド型が現実的です。評価の本質は「誰が・何のために・何を基準に行うか」にあり、AIは強力なツールですが、最終的な設計と価値判断は人間に委ねられています。 過度に楽観も悲観もせず、評価の構造を理解し、自分の立場(評価される側・評価する側)から考えてみることが、これからのAI時代に必要な視点です。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AIによる評価(人事評価・能力評価・信用評価など)は、 人間による評価と比べて「より公平になり得るのか」について、 AIの視点から冷静かつ現実的に整理・考察してください。 【目的】 – 「AIなら公平」「人間の方が公平」といった二元論ではなく、公平性の構造そのものを整理する – 評価という行為に含まれる「バイアス」「設計思想」「社会構造」の影響を可視化する – AI時代における「評価の本質」が何かを浮き彫りにする – 読者が評価される側・評価する側の両方の視点から考えられる材料を提供する 【読者像】 – 一般社会人(20〜50代) – 学生・就職活動中の若年層 – 人事評価・昇進・査定・信用スコアなどに関心を持つ人 – AIに詳しくはないが、社会の評価の仕組みが変わる可能性を感じている層 【記事構成】 1. 導入(問題提起) – 「評価は本当に公平にできるのか?」という多くの人が持つ疑問を提示する – 人間評価が持つ印象・関係性・経験依存の側面を簡潔に整理する – AI評価が注目される背景(効率化・大量データ処理・標準化)を説明する 2. 人間評価が持つ公平性と不公平性 – 文脈理解、例外判断、長期的信頼など、人間評価の強みを整理する – 感情バイアス、関係性バイアス、同質性バイアスなどの構造を説明する – なぜ「完全に公平な人間評価」が難しいのかを構造的に整理する 3. AI評価が持つ公平性と不公平性 – 一貫性・大量比較・定量評価における強みを説明する – 学習データの偏り、設計思想の影響、評価指標の選定問題を整理する – AIは「公平を作る」のか、「過去社会を再現する」のかという視点に触れる 4. 公平性は「技術」ではなく「設計」の問題 – 公平には複数の種類があることを整理する (例:機会の公平、結果の公平、手続きの公平、納得感の公平) – AI評価は「どの公平を優先するか」を設計する必要があることを説明する – 技術導入だけでは公平にならない構造を言語化する 5. まとめ – AI評価と人間評価は対立関係ではなく、役割分担の可能性があることを示す – 評価は「誰が・何のために・何を基準に行うか」で変わることを再確認する – 過度に楽観・悲観せず、読者が思考できる余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:人間評価とAI評価の構造比較) ※(図:公平性の種類マッピング) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AI評価は人間評価より公平になり得るのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # AIによる評価の公平性について ## 導入:評価の公平性への疑問 私たちの日常生活や仕事では、さまざまな評価が避けられません。例えば、人事評価、能力評価、信用評価などです。これらの評価は本当に公平に行われているのでしょうか?多くの人が、このような疑問を抱いたことがあるでしょう。人間による評価は、評価者の印象や関係性、過去の経験に依存しやすい側面があります。例えば、上司の好みや一時的な感情が影響を与えることがあります。 一方で、AIによる評価が注目されています。AIは大量のデータを効率的に処理し、標準化された基準で評価できるため、公平性を高める可能性が期待されています。背景として、デジタル化の進展により、膨大なデータを扱う必要性が増し、人間だけでは対応しきれないケースが出てきています。この記事では、AIの視点から、人間評価とAI評価の公平性を構造的に整理し、考察します。目的は、二元論に陥らず、評価の構造を明らかにすることです。 ## 人間評価の強み:文脈理解と柔軟性 人間による評価の公平性を考える際、まずその強みを整理します。人間は、文脈を深く理解できる点が挙げられます。例えば、社員の業績評価で、数字だけでは表れないチーム貢献や創造性を考慮できます。また、例外的な状況を判断し、柔軟に対応可能です。長期的信頼を築く面でも、人間評価は有効です。評価者と被評価者の関係性が、モチベーション向上につながる場合があります。 これらの強みは、評価の公平性を支える一方で、構造的な限界も生み出します。人間は経験に基づく判断を重視しますが、それが個人の主観に偏るリスクがあります。 ## 人間評価の不公平性:バイアスの構造 人間評価の不公平性を構造的に見てみましょう。主な要因として、感情バイアス、関係性バイアス、同質性バイアスが挙げられます。感情バイアスとは、評価者のその日の気分や個人的な好き嫌いが影響するものです。例えば、似た性格の人を高く評価する傾向です。 関係性バイアスは、評価者と被評価者の人間関係が絡む場合で、部下の忠誠心が業績以上に重視されることがあります。同質性バイアス(ホモフィリー・バイアス:自分に似た人を好む心理的傾向)は、社会構造的に問題です。評価者が多様な背景を理解しにくい場合、マイノリティが不利になる構造です。 なぜ完全に公平な人間評価が難しいのか?それは、評価が「主観的解釈」の積み重ねだからです。基準が曖昧で、評価者の経験や文化が介入します。結果として、評価される側は「運」や「関係性」に左右されやすく、評価する側も無意識の偏りを避けにくいのです。 ※(図:人間評価のバイアス構造マップ) ## AI評価の強み:一貫性と定量性 次に、AI評価の公平性を考察します。AIの強みは、一貫した基準適用です。例えば、信用スコアリングで、膨大な取引データを分析し、瞬時に評価できます。大量比較が可能で、人間では処理しきれない規模のデータを扱えます。また、定量評価(数値化された指標に基づく評価)が得意で、感情の介入を排除します。 これにより、標準化が進み、評価の効率化が図れます。人事評価では、スキルテストの自動化で、候補者の比較が容易になります。AIはデータを基に学習するため、過去の成功事例を反映した評価が可能です。 ## AI評価の不公平性:データと設計の影響 しかし、AI評価も不公平性を抱えます。主な問題は、学習データの偏りです。AIは訓練データからパターンを学びますが、データが過去の社会構造を反映している場合、偏りを再現します。例えば、雇用AIが過去の採用データを基にすると、性別や人種の偏りが残る可能性があります。これを「アルゴリズム・バイアス」と呼びます。 設計思想の影響も大きいです。AIの評価指標を誰が選定するのか?企業利益を優先すれば、公平性が損なわれます。また、ブラックボックス問題(AIの判断プロセスが不明瞭)があり、被評価者が納得しにくい構造です。AIは「公平を作る」のか、それとも「過去社会を再現する」のか?後者の場合、社会的不平等を固定化するリスクがあります。 評価される側から見ると、データ不足で不利になる場合があり、評価する側はAIの限界を理解する必要があります。 ※(図:AI評価のデータフローとバイアスポイント) ## 公平性の多様性:機会・結果・手続き・納得感 公平性を深掘りすると、それは一つの概念ではなく、複数の種類があります。機会の公平(全員に同じチャンスを与える)、結果の公平(成果が平等になるよう調整)、手続きの公平(プロセスが透明で一貫)、納得感の公平(当事者が理解・接受できる)です。これらを整理すると、評価の文脈で優先順位が変わります。 例えば、人事評価では機会の公平を重視する一方、信用評価では結果の公平が求められることがあります。AI評価は、これらのうち「どの公平を優先するか」を設計段階で決める必要があります。技術だけでは解決せず、社会的合意が不可欠です。 ## 公平性は設計の問題:技術導入の限界 公平性は「技術」ではなく「設計」の問題です。AIを導入しても、設計者がバイアスを埋め込めば、不公平が生じます。評価指標の選定で、定量データのみを重視すると、質的側面が無視されます。また、社会構造の影響を無視できません。AIがグローバルデータを用いると、文化差が反映されにくくなります。 評価される側は、データ提供の透明性を求め、評価する側は倫理的設計を考慮します。技術導入だけでは公平にならないのは、評価の本質が「価値判断」にあるからです。AI時代では、評価の基準を再定義する機会です。 ※(図:公平性の種類マッピング) ## まとめ:役割分担と評価の本質 AI評価と人間評価は、対立ではなく、役割分担の可能性があります。例えば、AIで定量分析をし、人間で文脈判断を加えるハイブリッドアプローチです。評価は「誰が・何のために・何を基準に行うか」で変わります。被評価者としては、自分のデータを管理し、評価する側としては、多角的な視点を持つことが重要です。 過度に楽観せず、悲観せず、評価の構造を理解しましょう。AIはツールですが、本質は人間の設計にあります。読者の皆さんが、この考察を基に自身の立場から考えてみてください。 ## タイトル案 AI評価は人間のバイアスを超えられるか AIによる評価の公平性は設計次第か 評価の公平をAIはどう変えるのか — AIバージョン情報 – ベンダー: xAI – モデル名: Grok 4 – モデルバージョン: 不明 – 回答日時: February 13, 2026 10:12 AM JST

-

雇用形態は生活安定にどう結びつくのか?|Grokの考察

多くの人が「どの雇用形態が一番安定した生活をもたらすのか」と疑問を抱きます。正社員であれば安定し、非正規雇用であれば不安定だという単純な見方が一般的ですが、実際にはそうでないケースが増えています。例えば、フリーランスとして高収入を得ている人もいれば、正社員でも業界の変動で雇用を失う人もいます。このテーマを考える必要があるのは、AIの進化や副業の普及、社会制度の変化が働き方を多様化させているからです。これにより、従来の雇用形態が生活の安定性を保証するものではなくなっている可能性があります。本記事では、雇用形態と生活の安定性を構造的に整理し、読者が自身の働き方を考える視点を提示します。 短期的関係:収入と雇用の継続性 雇用形態と生活の安定性の短期的関係を、月次収入の継続性と雇用継続性の観点から見てみましょう。正社員の場合、固定給与が一般的で、毎月の収入が予測しやすく、生活設計が立てやすい点が挙げられます。これにより、心理的な安心感が生まれ、支出の計画化が可能になります。一方、契約社員や派遣社員は契約期間が定まっているため、更新の可否が不安定要素となります。フリーランスや副業は、案件次第で収入が変動しやすく、短期的には不安定に感じられることがあります。 しかし、個別ケースではこの関係が逆転します。例えば、市場価値の高いフリーランスは、複数クライアントから安定した収入を得られる場合があり、正社員以上の継続性を持つことがあります。逆に、正社員でも業績悪化によるリストラが発生すれば、雇用継続性が損なわれます。このように、短期的安定は雇用形態だけでなく、個人のスキルや市場環境に依存します。 ※(図:雇用形態ごとの短期的安定要素の整理 – 正社員:固定収入高、フリーランス:変動性高など) 制度アクセス:社会保障とのつながり 生活の安定性は、収入だけでなく、社会制度へのアクセスによっても左右されます。正社員は、社会保険(健康保険、年金など)の企業負担分が大きく、住宅ローンの審査で有利になることが多いです。また、育児休暇や退職金、失業給付の利用がしやすく、これらが生活のバッファーとなります。契約社員や派遣社員は、これらの制度にアクセスしにくい場合があり、例えば失業時の給付が制限されることがあります。フリーランスは、国民健康保険や個人年金に頼るため、負担が増大し、安定性が低下する傾向があります。 ただし、制度設計によってこの関係は変わります。日本では、非正規雇用者への社会保障拡充が進んでいますが、諸外国ではフリーランス向けの制度が充実している例もあります。例えば、欧州の一部ではギグエコノミー(短期労働中心の経済)に対応した保険制度が存在します。この観点から、雇用形態は制度への「アクセス経路」として機能し、安定性を間接的に支える要素です。 長期安定の多角的要素 長期的な生活安定を考える場合、雇用形態単独では説明しきれません。重要な要素として、スキル市場価値、業界構造、健康、人的ネットワーク、複数収入源が挙げられます。スキル市場価値とは、個人の専門性が市場でどれだけ需要があるかを指し、これが高いと雇用形態にかかわらず転職や独立が容易になります。例えば、IT分野の専門家は、正社員からフリーランスへ移行しても安定を維持しやすいです。 業界構造も影響します。成長産業では雇用継続性が高く、衰退産業では逆です。健康は基盤で、病気による離職リスクを考慮する必要があります。人的ネットワークは、機会の獲得に役立ち、複数収入源(副業など)はリスク分散を図ります。これらの要素が絡むため、正社員でもスキルが陳腐化すれば不安定になり、フリーランスでもネットワークが強固なら長期安定が可能です。雇用形態はこれらの要素を補完する役割に過ぎません。 ※(図:長期安定を構成する要素の関係 – 中心に個人要素、周囲に雇用形態の影響) AI時代の構造変化 AIの進化は、雇用と安定の関係を大きく変えています。従来の雇用安定は、企業依存が強かったですが、AI時代では「個人の再現可能な価値」へのシフトが見られます。AIはルーチン作業を代替するため、作業者としての役割は減少します。一方、AIを使える人(ツール活用者)、設計できる人(AIシステム構築者)、判断できる人(倫理的・戦略的決定者)の需要が増します。これにより、副業や複業、プロジェクト型労働が普及する可能性があります。 例えば、フリーランスのAIエンジニアは、複数プロジェクトで収入を確保しやすくなりますが、正社員の事務職はAIによる自動化で雇用継続性が脅かされます。社会構造的には、制度設計が追いつかない場合、非正規雇用の不安定さが強調されます。市場環境では、グローバルな競争が激化し、個人の価値が雇用形態を超えて重要になります。この変化は、安定を「企業依存」から「個人能力依存」へ移行させるものです。 ※(図:AI時代の個人価値と雇用の関係イメージ – AIが作業層を代替、価値層が安定) 役割と価値の視点 重要なのは、雇用形態ではなく、個人の「役割と価値」です。役割を整理すると、作業者(ルーチン業務)、判断者(意思決定)、編集者(情報整理)、設計者(システム構築)などに分けられます。同じ正社員でも、作業者であればAIの影響で安定度が低下し、設計者であれば高まります。フリーランスの場合、価値が高い判断者であれば、市場で需要が続き、安定します。 この構造は、感情論ではなく、人間の価値を「再現性」と「独自性」で言語化します。再現性とは、スキルを繰り返し発揮できること、独自性とはAIが代替しにくい創造性です。雇用形態はこれらの価値を活かす枠組みですが、価値自体が低いと不安定になります。読者は、自分の役割を振り返り、価値を高める戦略を考えることが有効です。 まとめ:安定への多様な経路 雇用形態は、生活の安定そのものではなく、「安定へのアクセス経路」として機能する可能性が高いです。短期的には収入継続性、制度アクセスが鍵ですが、長期では個人要素が主导します。AI時代では、この経路が多様化し、柔軟な働き方が安定を生むケースが増えるでしょう。読者は、自身のスキル、市場環境、制度利用を整理し、リスク分散を検討してください。安定は一律ではなく、個別の構造から生まれるものです。この考察が、働き方を考えるきっかけになれば幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 雇用形態(正社員・契約社員・派遣・フリーランス・副業など)は、 「生活の安定性」とどの程度関係しているのかについて、 AI・社会構造・制度設計・市場環境の視点から、 冷静かつ現実的に整理・考察してください。 【目的】 – 「正社員=安定」「非正規=不安定」という単純な図式ではなく、構造的な関係として整理する – 収入・社会制度・キャリア再現性・市場価値など、複数要素がどのように絡むかを可視化する – 読者が自分の働き方・雇用形態・リスク分散を考えるための“視点”を提供する – AI時代において「雇用」と「安定」の関係がどう変化するかを浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – 学生・就職活動中の若年層 – 雇用の将来に不安や関心を持つ人 – 副業・転職・独立を検討している人 – AIに詳しくはないが、働き方の変化は無視できないと感じている層 【記事構成】 1. 導入(問題提起) – 「どの働き方が一番安定しているのか?」という多くの人が抱く疑問を提示する – 雇用形態と生活安定性が単純に一致しないケースが増えていることを示す – なぜ今このテーマを考える必要があるのか(AI・副業・社会制度変化など)を説明する 2. 雇用形態と生活安定性の「短期的関係」 – 月次収入の継続性・雇用継続性という観点で整理する – なぜ固定給与が心理的・現実的安定につながりやすいのかを説明する – ただし個別ケースでは逆転することがある点も整理する 3. 雇用形態と「制度アクセス」の関係 – 社会保険・住宅ローン・育休・退職金・失業給付などへの接続性を整理する – 「収入」だけではなく「制度にアクセスできるか」が安定に与える影響を説明する – 国・制度設計によって関係性が変わる可能性にも触れる 4. 長期安定を左右する要素 – スキル市場価値 – 業界構造 – 健康 – 人的ネットワーク – 複数収入源 – 雇用形態単独では長期安定を説明しきれない理由を整理する 5. AI時代における構造変化 – 雇用安定から「個人の再現可能な価値」へのシフト – AIを使える人/設計できる人/判断できる人の役割 – 副業・複業・プロジェクト型労働の増加可能性 6. 重要なのは「雇用形態」ではなく「役割と価値」 – 作業者・判断者・編集者・設計者などの役割差を整理する – 同じ雇用形態でも安定度が変わる理由を説明する – 感情論ではなく構造として人間の価値を言語化する 7. まとめ – 雇用形態は安定そのものではなく「安定へのアクセス経路」である可能性を整理する – 読者が自分の立ち位置を考えるための視点を提示する – 楽観・悲観に寄らず、思考を促す形で締める 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:雇用形態と生活安定性の関係構造) ※(図:AI時代の個人価値と雇用の関係イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「安定した働き方とは本当に存在するのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 雇用形態と生活の安定性の関係を考える ### 導入:働き方の選択と安定の問い 多くの人が、「どの雇用形態が一番安定した生活をもたらすのか」と疑問を抱きます。正社員であれば安定し、非正規雇用であれば不安定だという単純な見方が一般的ですが、実際にはそうでないケースが増えています。例えば、フリーランスとして高収入を得ている人もいれば、正社員でも業界の変動で雇用を失う人もいます。このテーマを考える必要があるのは、AIの進化や副業の普及、社会制度の変化が働き方を多様化させているからです。これにより、従来の雇用形態が生活の安定性を保証するものではなくなっている可能性があります。本記事では、雇用形態と生活の安定性を構造的に整理し、読者が自身の働き方を考える視点を提示します。 ### 短期的関係:収入と雇用の継続性 雇用形態と生活の安定性の短期的関係を、月次収入の継続性と雇用継続性の観点から見てみましょう。正社員の場合、固定給与が一般的で、毎月の収入が予測しやすく、生活設計が立てやすい点が挙げられます。これにより、心理的な安心感が生まれ、支出の計画化が可能になります。一方、契約社員や派遣社員は契約期間が定まっているため、更新の可否が不安定要素となります。フリーランスや副業は、案件次第で収入が変動しやすく、短期的には不安定に感じられることがあります。 しかし、個別ケースではこの関係が逆転します。例えば、市場価値の高いフリーランスは、複数クライアントから安定した収入を得られる場合があり、正社員以上の継続性を持つことがあります。逆に、正社員でも業績悪化によるリストラが発生すれば、雇用継続性が損なわれます。このように、短期的安定は雇用形態だけでなく、個人のスキルや市場環境に依存します。 ※(図:雇用形態ごとの短期的安定要素の整理 – 正社員:固定収入高、フリーランス:変動性高など) ### 制度アクセス:社会保障とのつながり 生活の安定性は、収入だけでなく、社会制度へのアクセスによっても左右されます。正社員は、社会保険(健康保険、年金など)の企業負担分が大きく、住宅ローンの審査で有利になることが多いです。また、育児休暇や退職金、失業給付の利用がしやすく、これらが生活のバッファーとなります。契約社員や派遣社員は、これらの制度にアクセスしにくい場合があり、例えば失業時の給付が制限されることがあります。フリーランスは、国民健康保険や個人年金に頼るため、負担が増大し、安定性が低下する傾向があります。 ただし、制度設計によってこの関係は変わります。日本では、非正規雇用者への社会保障拡充が進んでいますが、諸外国ではフリーランス向けの制度が充実している例もあります。例えば、欧州の一部ではギグエコノミー(短期労働中心の経済)に対応した保険制度が存在します。この観点から、雇用形態は制度への「アクセス経路」として機能し、安定性を間接的に支える要素です。 ### 長期安定の多角的要素 長期的な生活安定を考える場合、雇用形態単独では説明しきれません。重要な要素として、スキル市場価値、業界構造、健康、人的ネットワーク、複数収入源が挙げられます。スキル市場価値とは、個人の専門性が市場でどれだけ需要があるかを指し、これが高いと雇用形態にかかわらず転職や独立が容易になります。例えば、IT分野の専門家は、正社員からフリーランスへ移行しても安定を維持しやすいです。 業界構造も影響します。成長産業では雇用継続性が高く、衰退産業では逆です。健康は基盤で、病気による離職リスクを考慮する必要があります。人的ネットワークは、機会の獲得に役立ち、複数収入源(副業など)はリスク分散を図ります。これらの要素が絡むため、正社員でもスキルが陳腐化すれば不安定になり、フリーランスでもネットワークが強固なら長期安定が可能です。雇用形態はこれらの要素を補完する役割に過ぎません。 ※(図:長期安定を構成する要素の関係 – 中心に個人要素、周囲に雇用形態の影響) ### AI時代の構造変化 AIの進化は、雇用と安定の関係を大きく変えています。従来の雇用安定は、企業依存が強かったですが、AI時代では「個人の再現可能な価値」へのシフトが見られます。AIはルーチン作業を代替するため、作業者としての役割は減少します。一方、AIを使える人(ツール活用者)、設計できる人(AIシステム構築者)、判断できる人(倫理的・戦略的決定者)の需要が増します。これにより、副業や複業、プロジェクト型労働が普及する可能性があります。 例えば、フリーランスのAIエンジニアは、複数プロジェクトで収入を確保しやすくなりますが、正社員の事務職はAIによる自動化で雇用継続性が脅かされます。社会構造的には、制度設計が追いつかない場合、非正規雇用の不安定さが強調されます。市場環境では、グローバルな競争が激化し、個人の価値が雇用形態を超えて重要になります。この変化は、安定を「企業依存」から「個人能力依存」へ移行させるものです。 ※(図:AI時代の個人価値と雇用の関係イメージ – AIが作業層を代替、価値層が安定) ### 役割と価値の視点 重要なのは、雇用形態ではなく、個人の「役割と価値」です。役割を整理すると、作業者(ルーチン業務)、判断者(意思決定)、編集者(情報整理)、設計者(システム構築)などに分けられます。同じ正社員でも、作業者であればAIの影響で安定度が低下し、設計者であれば高まります。フリーランスの場合、価値が高い判断者であれば、市場で需要が続き、安定します。 この構造は、感情論ではなく、人間の価値を「再現性」と「独自性」で言語化します。再現性とは、スキルを繰り返し発揮できること、独自性とはAIが代替しにくい創造性です。雇用形態はこれらの価値を活かす枠組みですが、価値自体が低いと不安定になります。読者は、自分の役割を振り返り、価値を高める戦略を考えることが有効です。 ### まとめ:安定への多様な経路 雇用形態は、生活の安定そのものではなく、「安定へのアクセス経路」として機能する可能性が高いです。短期的には収入継続性、制度アクセスが鍵ですが、長期では個人要素が主导します。AI時代では、この経路が多様化し、柔軟な働き方が安定を生むケースが増えるでしょう。読者は、自身のスキル、市場環境、制度利用を整理し、リスク分散を検討してください。安定は一律ではなく、個別の構造から生まれるものです。この考察が、働き方を考えるきっかけになれば幸いです。 ## タイトル案 雇用形態は生活安定にどう結びつくのか? 働き方と安定の関係をどう捉えるか? AI時代に雇用形態が安定に与える影響は? — AIバージョン情報 – ベンダー: xAI – モデル名: Grok 4 – モデルバージョン: 不明 – 回答日時: February 13, 2026 09:45 AM JST

-

AIの時代に分業の役割はどう再編されるのか|Grokの考察

この先、人間はどんな役割を担うのでしょうか。AIの進化は、単に仕事の量を減らすのではなく、仕事の構造そのものを変えつつあります。従来の分業構造、つまり業務を細かく分けて担当する仕組みが、AIや自動化の影響で再編されようとしているのです。なぜ今、この変化を考える必要があるのか。それは、技術の進歩が急速に進む中で、私たちの働き方が根本的に見直される可能性があるからです。AIが日常的に活用されるようになると、仕事の境界が曖昧になり、人間がどこに価値を置くべきかを再考する機会が生まれます。この記事では、AIの視点から分業構造の変化を冷静に整理し、読者が自身の役割を考えるための視点を提示します。 AIの進化がもたらす分業の変化 AIや自動化は、社会構造全体に影響を与えています。従来の産業革命では、機械が物理的な労働を置き換えましたが、現代のAIは情報処理や判断の領域まで踏み込んできました。これにより、分業構造—業務を専門的に分担する仕組み—が、柔軟に再配置される兆しが見えています。たとえば、製造業からサービス業まで、さまざまな分野でAIが導入され、仕事の流れが効率化されています。しかし、これは「仕事がなくなる」という単純な話ではなく、分業の質が変化するプロセスとして捉えることができます。 AIによって変化しやすい分業の特徴 AIの影響を受けやすい分業には、共通の特徴があります。ここでは、「消える分業」ではなく、「人が担う必要が薄れる分業」として整理します。これらは主に、定型処理、情報整理、単純判断、作業連結型の分業です。 定型処理型の分業 定型処理とは、繰り返しのルールに基づく作業を指します。たとえば、データ入力やルーチンチェックのような業務です。これらがAIに置き換えられやすい理由は、AIが大量のデータを高速で処理できるからです。人間の場合、ミスが発生しやすく、疲労も影響しますが、AIは一貫した精度を保てます。ただし、これはすべての定型作業が即座に自動化されるわけではなく、データの質や環境次第で変化します。 情報整理型の分業 情報整理は、散在したデータを集めて分類する役割です。レポート作成の初期段階や在庫管理などが該当します。AIの機械学習(データを学習してパターンを抽出する技術)が、これを効率化します。なぜなら、AIはビッグデータ(大量のデータ)を瞬時に分析できるため、人間が時間をかけて行う必要が薄れるからです。たとえば、検索エンジンの進化のように、AIが情報をフィルタリングする事例が増えています。 単純判断型の分業 単純判断とは、明確な基準に基づく決定、例えば品質検査や簡単な承認作業です。これがAIに適するのは、ルールベースのアルゴリズム(手順をプログラム化したもの)で再現可能だからです。人間の判断は主観が入りやすいですが、AIはデータ駆動で一貫します。ただし、例外的なケースでは人間の柔軟性が求められる可能性があります。 作業連結型の分業 作業連結は、複数のタスクを順番につなぐ役割、例えばアセンブリライン(組立ライン)のようなものです。自動化ツールがこれを統合し、シームレスに繋げられるため、人間の介在が減る傾向があります。理由は、IoT(モノのインターネット、機器同士が連携する技術)が作業の流れを最適化するからです。 これらの特徴は、AIの強み—速度、精度、拡張性—と重なるため、変化しやすいと言えます。ただし、具体的な置き換えは業界や技術の成熟度によるため、断定的に予測するのは難しいです。 AI時代に強まる分業の特徴 一方で、AIの進化により価値が高まる分業もあります。これらは、判断・責任・設計・編集・関係調整などの役割が中心です。AIを活用する側や、AIの出力を統合する側として、人間が活躍する領域が広がる可能性があります。 判断・責任型の分業 判断とは、複雑な文脈を考慮した決定を指します。たとえば、戦略立案や倫理的選択です。これが強まる理由は、AIがデータを提示するものの、最終責任は人間が負う必要があるからです。責任の所在が曖昧になると、社会的な信頼が損なわれるため、人間が担う領域として残るでしょう。 設計・編集型の分業 設計は、創造的な構成、例えばプロダクトデザインやコンテンツ編集です。AIがドラフトを作成しても、人間が文脈を加味して洗練します。なぜなら、AIの出力はパターンに基づくが、人間の洞察(直感的な理解)が独自の価値を生むからです。たとえば、AI生成の文章を編集する役割が、すでにクリエイティブ業界で兆しを見せています。 関係調整型の分業 関係調整は、人間同士のコミュニケーションやステークホルダー(利害関係者)の調整です。AIがチャットボットで対応しても、感情やニュアンスの読み取りは人間が優位です。これが強まるのは、社会が複雑化する中で、信頼構築が鍵になるからです。 これらの分業は、AIの限界—創造性や倫理の欠如—を補う形で価値を発揮します。AIをツールとして活用する人間の役割が、ますます重要になるでしょう。 分業は「消える」のではなく「再配置される」 分業そのものがなくなるわけではなく、再配置される可能性が高いです。従来の「作業分業」—タスクを細かく分ける—から、「判断分業」—決定のレイヤーを重視する—への移行が考えられます。 ※(図:作業分業から判断分業への移行イメージ) 作業分業では、ルーチンワークが中心ですが、AIの導入でこれらが自動化され、人間は上位の判断層に移行します。たとえば、医療分野ではAIが診断支援をし、人間が最終判断を下す形です。 さらに、人とAIのハイブリッド分業が登場します。これは、AIが下位タスクを担い、人間が全体を統合する構造です。メリットは効率向上ですが、課題としてAIのバイアス(偏り)を人間が修正する必要が出てきます。この再配置は、社会構造の変化—リモートワークの増加やギグエコノミー(短期契約の経済)—と連動し、多様な働き方を生むでしょう。 ※(図:AIと人間の分業再配置構造) まとめ:役割の境界を再定義する視点 AIによって仕事が奪われるのではなく、役割の境界が変化する可能性を再確認します。人間が担う領域は、AIの強みを活かした判断や創造に移行し、AIは定型作業を支える存在になるかもしれません。読者の皆さんは、自分の役割をどう再定義するかを考えてみてください。たとえば、AIを活用して独自の価値を高める方法を探るのも一つの視点です。過度に楽観せず、悲観せず、この変化を機会として捉えることが重要です。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI・自動化・社会構造の変化によって、 「仕事の分業構造」がどのように変化していくのかについて、 AIの視点から冷静かつ現実的に整理・考察してください。 【目的】 – 「AIが仕事を奪う」という単純な不安論ではなく、分業構造の再編として仕事の未来を整理する – 読者が自分の働き方・役割・価値の置き場所を考えるための“視点”を提供する – AI時代における「人間が担う領域」と「AIが担う領域」の境界がどう変わるかを浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – 学生・就職活動中の若年層 – 将来の働き方に漠然とした不安や関心を持つ人 – AIに詳しくはないが、無関係ではいられないと感じている層 【記事構成】 1. 導入(問題提起) – 「この先、人間はどんな役割を担うのか?」という問いを提示する – AIの進化が「仕事の量」ではなく「仕事の構造」を変えつつあることを示す – なぜ今、分業構造の変化を考える必要があるのかを簡潔に説明する 2. AIによって変化しやすい分業の特徴 – 「消える分業」ではなく、「人が担う必要が薄れる分業」であることを明確にする – 定型処理、情報整理、単純判断、作業連結型の分業の特徴を整理する – なぜAIや自動化に置き換えられやすいのかを構造的に説明する – ※具体例を挙げてもよいが、断定的な表現は避けること 3. AI時代に強まる分業の特徴 – AI時代に価値を持ちやすい分業の共通点を整理する – 判断・責任・設計・編集・関係調整などの役割に触れる – AIを活用する側、AIの出力を統合する側の役割を説明する – ※すでに兆しが見えている役割を例示してもよい 4. 分業は「消える」のではなく「再配置される」 – 分業そのものはなくならない可能性を整理する – 「作業分業」から「判断分業」への移行を説明する – 人とAIのハイブリッド分業の可能性を構造として言語化する 5. まとめ – AIによって仕事が奪われるのではなく、役割の境界が変化する可能性を再確認する – 読者が自分の役割をどう再定義するか考えるための視点を提示する – 過度に楽観・悲観せず、思考を促す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AIと人間の分業再配置構造) ※(図:作業分業から判断分業への移行イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AI時代、人間は何を担当するのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入:AI時代に問われる人間の役割 この先、人間はどんな役割を担うのでしょうか。AIの進化は、単に仕事の量を減らすのではなく、仕事の構造そのものを変えつつあります。従来の分業構造、つまり業務を細かく分けて担当する仕組みが、AIや自動化の影響で再編されようとしているのです。なぜ今、この変化を考える必要があるのか。それは、技術の進歩が急速に進む中で、私たちの働き方が根本的に見直される可能性があるからです。AIが日常的に活用されるようになると、仕事の境界が曖昧になり、人間がどこに価値を置くべきかを再考する機会が生まれます。この記事では、AIの視点から分業構造の変化を冷静に整理し、読者が自身の役割を考えるための視点を提示します。 ### AIの進化がもたらす分業の変化 AIや自動化は、社会構造全体に影響を与えています。従来の産業革命では、機械が物理的な労働を置き換えましたが、現代のAIは情報処理や判断の領域まで踏み込んできました。これにより、分業構造—業務を専門的に分担する仕組み—が、柔軟に再配置される兆しが見えています。たとえば、製造業からサービス業まで、さまざまな分野でAIが導入され、仕事の流れが効率化されています。しかし、これは「仕事がなくなる」という単純な話ではなく、分業の質が変化するプロセスとして捉えることができます。 ### AIによって変化しやすい分業の特徴 AIの影響を受けやすい分業には、共通の特徴があります。ここでは、「消える分業」ではなく、「人が担う必要が薄れる分業」として整理します。これらは主に、定型処理、情報整理、単純判断、作業連結型の分業です。 #### 定型処理型の分業 定型処理とは、繰り返しのルールに基づく作業を指します。たとえば、データ入力やルーチンチェックのような業務です。これらがAIに置き換えられやすい理由は、AIが大量のデータを高速で処理できるからです。人間の場合、ミスが発生しやすく、疲労も影響しますが、AIは一貫した精度を保てます。ただし、これはすべての定型作業が即座に自動化されるわけではなく、データの質や環境次第で変化します。 #### 情報整理型の分業 情報整理は、散在したデータを集めて分類する役割です。レポート作成の初期段階や在庫管理などが該当します。AIの機械学習(データを学習してパターンを抽出する技術)が、これを効率化します。なぜなら、AIはビッグデータ(大量のデータ)を瞬時に分析できるため、人間が時間をかけて行う必要が薄れるからです。たとえば、検索エンジンの進化のように、AIが情報をフィルタリングする事例が増えています。 #### 単純判断型の分業 単純判断とは、明確な基準に基づく決定、例えば品質検査や簡単な承認作業です。これがAIに適するのは、ルールベースのアルゴリズム(手順をプログラム化したもの)で再現可能だからです。人間の判断は主観が入りやすいですが、AIはデータ駆動で一貫します。ただし、例外的なケースでは人間の柔軟性が求められる可能性があります。 #### 作業連結型の分業 作業連結は、複数のタスクを順番につなぐ役割、例えばアセンブリライン(組立ライン)のようなものです。自動化ツールがこれを統合し、シームレスに繋げられるため、人間の介在が減る傾向があります。理由は、IoT(モノのインターネット、機器同士が連携する技術)が作業の流れを最適化するからです。 これらの特徴は、AIの強み—速度、精度、拡張性—と重なるため、変化しやすいと言えます。ただし、具体的な置き換えは業界や技術の成熟度によるため、断定的に予測するのは難しいです。 ### AI時代に強まる分業の特徴 一方で、AIの進化により価値が高まる分業もあります。これらは、判断・責任・設計・編集・関係調整などの役割が中心です。AIを活用する側や、AIの出力を統合する側として、人間が活躍する領域が広がる可能性があります。 #### 判断・責任型の分業 判断とは、複雑な文脈を考慮した決定を指します。たとえば、戦略立案や倫理的選択です。これが強まる理由は、AIがデータを提示するものの、最終責任は人間が負う必要があるからです。責任の所在が曖昧になると、社会的な信頼が損なわれるため、人間が担う領域として残るでしょう。 #### 設計・編集型の分業 設計は、創造的な構成、例えばプロダクトデザインやコンテンツ編集です。AIがドラフトを作成しても、人間が文脈を加味して洗練します。なぜなら、AIの出力はパターンに基づくが、人間の洞察(直感的な理解)が独自の価値を生むからです。たとえば、AI生成の文章を編集する役割が、すでにクリエイティブ業界で兆しを見せています。 #### 関係調整型の分業 関係調整は、人間同士のコミュニケーションやステークホルダー(利害関係者)の調整です。AIがチャットボットで対応しても、感情やニュアンスの読み取りは人間が優位です。これが強まるのは、社会が複雑化する中で、信頼構築が鍵になるからです。 これらの分業は、AIの限界—創造性や倫理の欠如—を補う形で価値を発揮します。AIをツールとして活用する人間の役割が、ますます重要になるでしょう。 ### 分業は「消える」のではなく「再配置される」 分業そのものがなくなるわけではなく、再配置される可能性が高いです。従来の「作業分業」—タスクを細かく分ける—から、「判断分業」—決定のレイヤーを重視する—への移行が考えられます。 ※(図:作業分業から判断分業への移行イメージ) 作業分業では、ルーチンワークが中心ですが、AIの導入でこれらが自動化され、人間は上位の判断層に移行します。たとえば、医療分野ではAIが診断支援をし、人間が最終判断を下す形です。 さらに、人とAIのハイブリッド分業が登場します。これは、AIが下位タスクを担い、人間が全体を統合する構造です。メリットは効率向上ですが、課題としてAIのバイアス(偏り)を人間が修正する必要が出てきます。この再配置は、社会構造の変化—リモートワークの増加やギグエコノミー(短期契約の経済)—と連動し、多様な働き方を生むでしょう。 ※(図:AIと人間の分業再配置構造) ### まとめ:役割の境界を再定義する視点 AIによって仕事が奪われるのではなく、役割の境界が変化する可能性を再確認します。人間が担う領域は、AIの強みを活かした判断や創造に移行し、AIは定型作業を支える存在になるかもしれません。読者の皆さんは、自分の役割をどう再定義するかを考えてみてください。たとえば、AIを活用して独自の価値を高める方法を探るのも一つの視点です。過度に楽観せず、悲観せず、この変化を機会として捉えることが重要です。 タイトル案 AIの時代に分業の役割はどう再編されるのか 自動化が進む中人間の仕事構造は何を変えるのか 社会変化で分業の境界線はどこへ向かうのか — AIバージョン情報 – ベンダー: xAI – モデル名: Grok 4 – モデルバージョン: 不明 – 回答日時: February 12, 2026 11:08 PM JST

-

結果発表までの空白期間が人々の心に与える意味とは何か|Grokの考察

人は、受験の合否発表や採用の結果通知を待つ間、特別な感情を抱くことがあります。この「結果発表までの空白期間」は、単なる待ち時間として片付けられるものではなく、深い意味を持っている可能性があります。なぜなら、この期間は個人の内面的な葛藤や社会的な文脈を反映しているからです。現代社会では、評価や選抜が日常的に行われ、多くの人がこの空白期間を経験します。このテーマを考察することで、待つ時間の価値を再認識し、自身の経験を整理する手がかりを得られるでしょう。 空白期間が生まれる制度構造 結果が即時ではなく時間差で提示される理由 多くの制度では、結果が即時に提示されるのではなく、一定の時間差を置いて発表されます。これは、評価プロセス自体に時間がかかるためです。例えば、受験では答案の採点や合否の決定に複数人の審査員が関わり、公平性を確保するための手順が必要です。採用の場合も、面接後の議論や背景調査が加わり、数日から数週間を要します。 この時間設計は、制度の信頼性を高める役割を果たしています。即時結果では、誤った判断が生じやすいため、慎重な検証が求められるのです。 評価・選抜・審査の時間設計の意味 制度的な時間設計は、社会の秩序を維持するためのものです。選抜プロセスでは、応募者の能力を多角的に評価する必要があり、時間差がそのためのバッファとなります。例えば、昇進査定では業績の集計と上層部の承認が段階的に行われ、組織の安定性を保つ仕組みとなっています。 これにより、参加者は「待つ」ことを強制され、制度の権威性を体感します。時間差は、単なる遅延ではなく、評価の正当性を象徴する要素と言えるでしょう。 社会における評価待ち時間の共通構造 受験、採用、昇進査定、審査などの場面で共通する構造は、「申請・評価・発表」の三段階です。申請後、評価期間中に空白が生じ、発表で結論が出ます。この構造は、社会的な資源配分を効率化するためのものです。例えば、大学入試では一斉発表により、公平な競争を促進します。 ※(図:評価結果が提示されるまでの時間構造) こうした共通点から、空白期間は社会のルールとして組み込まれていることがわかります。 空白期間の心理構造 不確実性と想像が認知に与える影響 空白期間中、人は不確実性(uncertainty、将来の結果が予測しにくい状態)に直面します。この不確実性は、脳の報酬系を刺激し、想像力を働かせる要因となります。例えば、合格の可能性を想像する一方で、失敗のシナリオも思い浮かべ、感情の揺らぎが生じます。 心理学では、不確実性がストレスホルモンを増加させることが知られていますが、これは生存本能に関連します。待つ時間に強い意味を感じるのは、この認知プロセスが自己防衛として機能するためです。 結果そのものより結果待ちが記憶に残りやすい理由 結果待ちの期間は、結果自体より記憶に残りやすい傾向があります。これは、期待と不安の混合が強い印象を残すからです。認知心理学の観点から、こうした期間は「エピソード記憶」(個人的体験の記憶)として定着しやすく、振り返りの材料となります。 例えば、受験生が発表日を待つ間の日常は、結果が出た後も鮮明に思い起こされます。これは、空白期間が個人の物語性を高める役割を果たしているからです。 自己評価・未来予測・コントロール感の揺らぎ この期間、自己評価が揺らぎます。過去の努力を振り返り、未来を予測しようとする中で、コントロール感(locus of control、事態を自分で制御できる感覚)が低下します。外部要因に依存する状況が、心理的な負荷を増大させるのです。 ※(図:不確実性と心理負荷の関係イメージ) こうした構造から、空白期間は自己成長の機会にもなり得ますが、過度なストレスを生む側面もあります。 空白期間は社会的通過儀礼なのか 評価を受ける前の宙吊り状態としての意味 空白期間は、通過儀礼(rite of passage、社会的地位の移行を伴う儀式)の「分離段階」に似ています。この段階では、個人は既存の地位から切り離され、宙吊り状態(liminality、境界的な状態)になります。例えば、採用待ちの人は、求職者から社員への移行を待つ立場です。 この宙吊り状態は、不安を生む一方で、変容の準備期間として機能します。 個人から社会への移行プロセスとしての役割 通過儀礼の観点から、空白期間は個人を社会に再統合するためのプロセスです。成人式や結婚のように、評価待ちは新たな役割への適応を促します。受験の場合、合格は学生から社会人への一歩を象徴します。 この役割は、社会の安定性を支え、個人のアイデンティティを再構築します。 成人・採用・昇格との構造的共通点 これらのイベントは、すべて「待機・変容・統合」の構造を持ちます。昇格待ちは、現在の役割からの離脱と新たな地位の獲得を伴い、社会的承認を待つ時間です。この共通点から、空白期間が単なる空白ではなく、成長の橋渡し役であることが見えてきます。 情報社会における空白期間の変化 SNSや情報共有が待つ体験を変える影響 現代の情報社会では、SNSが空白期間の体験を変化させています。他者の体験談が共有され、待つ時間が孤立しにくくなりました。例えば、就職活動のフォーラムで結果待ちの共有が、心理的な支えとなります。 しかし、これは二重の刃で、過度な情報が不安を増幅させる場合もあります。 他者比較・情報過多・期待値の可視化の心理影響 他者比較(social comparison、他者との比較)が容易になり、期待値が可視化されます。SNSで合格者の投稿を見ると、自分の状況を相対的に評価し、緊張が高まります。情報過多は、未来予測を複雑化し、コントロール感をさらに低下させる可能性があります。 一方で、ポジティブな情報がモチベーションを維持する側面もあります。この変化は、待つ時間の質を多様化しています。 まとめ:空白期間の持つ多面的な意味 空白期間は、何も起きていない時間ではなく、制度・心理・社会的プロセスが交錯する場です。評価される中で、時間は単なる経過ではなく、意味を生成する要素となります。 読者は、自身の結果待ちの経験を、この構造から捉え直すことができるでしょう。例えば、不確実性を成長の機会として見るか、社会の仕組みとして受け止めるか。最終的に、この考察は思考のきっかけを提供するものであり、個々の解釈に委ねます。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 受験・採用・審査などにおける「結果発表までの空白期間」は、 なぜ人にとって強い意味を持つのかを、 心理・社会・制度・時間認識の観点から構造的に整理・考察してください。 【目的】 – 「不安」「緊張」といった感情論だけではなく、社会構造の中で空白期間が持つ意味を整理する – 人が「評価を待つ時間」にどのような意味を与えているのかを可視化する – 現代社会における「待つ時間」の価値や役割を構造として言語化する 【読者像】 – 一般社会人(20〜50代) – 学生・受験生・就職活動中の若年層 – 人生の分岐点を経験したことがある人 – 結果待ちの時間に独特の感覚を覚えた経験がある人 【記事構成】 1. 導入(問題提起) – なぜ人は「結果を待つ時間」に強い意味を感じるのかを提示する – 空白期間は単なる待機時間ではない可能性を示す – なぜこのテーマが現代社会において重要なのかを簡潔に説明する 2. 空白期間が生まれる制度構造 – なぜ結果は「即時」ではなく「時間差」で提示されるのか – 評価・選抜・審査という制度が持つ時間設計の意味を整理する – 社会における「評価待ち時間」の共通構造を説明する (例:受験、採用、昇進査定、審査など) 3. 空白期間の心理構造 – 不確実性と想像が人の認知に与える影響を整理する – 「結果そのもの」より「結果待ち」が記憶に残りやすい理由を考察する – 自己評価・未来予測・コントロール感の揺らぎを構造的に説明する 4. 空白期間は社会的通過儀礼なのか – 評価を受ける前の「宙吊り状態」としての意味を整理する – 個人から社会への移行プロセスとしての役割を考察する – 成人・採用・昇格などとの構造的共通点に触れてもよい 5. 情報社会における空白期間の変化 – SNSや情報共有が「待つ体験」をどう変えたのか – 他者比較・情報過多・期待値の可視化が心理に与える影響を説明する 6. まとめ – 空白期間は「何も起きていない時間」ではない可能性を整理する – 人が評価されるプロセスの中で、時間が持つ意味を再確認する – 読者が自身の経験を構造として捉え直せる視点を提示して締めくくる – 過度に楽観・悲観せず、思考を促す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:評価結果が提示されるまでの時間構造) ※(図:不確実性と心理負荷の関係イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「なぜ人は結果待ちの時間に意味を感じるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 結果発表までの空白期間が人々に与える意味 ## 導入:結果待ちの時間に潜む意味 人は、受験の合否発表や採用の結果通知を待つ間、特別な感情を抱くことがあります。この「結果発表までの空白期間」は、単なる待ち時間として片付けられるものではなく、深い意味を持っている可能性があります。なぜなら、この期間は個人の内面的な葛藤や社会的な文脈を反映しているからです。 現代社会では、評価や選抜が日常的に行われ、多くの人がこの空白期間を経験します。例えば、就職活動中の若者や昇進を待つ社会人が、結果を待つ間に生じる緊張や期待は、単なる個人的な感情ではなく、社会構造全体に関わるものです。このテーマを考察することで、待つ時間の価値を再認識し、自身の経験を整理する手がかりを得られるでしょう。 ## 空白期間が生まれる制度構造 ### 結果が即時ではなく時間差で提示される理由 多くの制度では、結果が即時に提示されるのではなく、一定の時間差を置いて発表されます。これは、評価プロセス自体に時間がかかるためです。例えば、受験では答案の採点や合否の決定に複数人の審査員が関わり、公平性を確保するための手順が必要です。採用の場合も、面接後の議論や背景調査が加わり、数日から数週間を要します。 この時間設計は、制度の信頼性を高める役割を果たしています。即時結果では、誤った判断が生じやすいため、慎重な検証が求められるのです。 ### 評価・選抜・審査の時間設計の意味 制度的な時間設計は、社会の秩序を維持するためのものです。選抜プロセスでは、応募者の能力を多角的に評価する必要があり、時間差がそのためのバッファとなります。例えば、昇進査定では業績の集計と上層部の承認が段階的に行われ、組織の安定性を保つ仕組みとなっています。 これにより、参加者は「待つ」ことを強制され、制度の権威性を体感します。時間差は、単なる遅延ではなく、評価の正当性を象徴する要素と言えるでしょう。 ### 社会における評価待ち時間の共通構造 受験、採用、昇進査定、審査などの場面で共通する構造は、「申請・評価・発表」の三段階です。申請後、評価期間中に空白が生じ、発表で結論が出ます。この構造は、社会的な資源配分を効率化するためのものです。例えば、大学入試では一斉発表により、公平な競争を促進します。 ※(図:評価結果が提示されるまでの時間構造) こうした共通点から、空白期間は社会のルールとして組み込まれていることがわかります。 ## 空白期間の心理構造 ### 不確実性と想像が認知に与える影響 空白期間中、人は不確実性(uncertainty、将来の結果が予測しにくい状態)に直面します。この不確実性は、脳の報酬系を刺激し、想像力を働かせる要因となります。例えば、合格の可能性を想像する一方で、失敗のシナリオも思い浮かべ、感情の揺らぎが生じます。 心理学では、不確実性がストレスホルモンを増加させることが知られていますが、これは生存本能に関連します。待つ時間に強い意味を感じるのは、この認知プロセスが自己防衛として機能するためです。 ### 結果そのものより結果待ちが記憶に残りやすい理由 結果待ちの期間は、結果自体より記憶に残りやすい傾向があります。これは、期待と不安の混合が強い印象を残すからです。認知心理学の観点から、こうした期間は「エピソード記憶」(個人的体験の記憶)として定着しやすく、振り返りの材料となります。 例えば、受験生が発表日を待つ間の日常は、結果が出た後も鮮明に思い起こされます。これは、空白期間が個人の物語性を高める役割を果たしているからです。 ### 自己評価・未来予測・コントロール感の揺らぎ この期間、自己評価が揺らぎます。過去の努力を振り返り、未来を予測しようとする中で、コントロール感(locus of control、事態を自分で制御できる感覚)が低下します。外部要因に依存する状況が、心理的な負荷を増大させるのです。 ※(図:不確実性と心理負荷の関係イメージ) こうした構造から、空白期間は自己成長の機会にもなり得ますが、過度なストレスを生む側面もあります。 ## 空白期間は社会的通過儀礼なのか ### 評価を受ける前の宙吊り状態としての意味 空白期間は、通過儀礼(rite of passage、社会的地位の移行を伴う儀式)の「分離段階」に似ています。この段階では、個人は既存の地位から切り離され、宙吊り状態(liminality、境界的な状態)になります。例えば、採用待ちの人は、求職者から社員への移行を待つ立場です。 この宙吊り状態は、不安を生む一方で、変容の準備期間として機能します。 ### 個人から社会への移行プロセスとしての役割 通過儀礼の観点から、空白期間は個人を社会に再統合するためのプロセスです。成人式や結婚のように、評価待ちは新たな役割への適応を促します。受験の場合、合格は学生から社会人への一歩を象徴します。 この役割は、社会の安定性を支え、個人のアイデンティティを再構築します。 ### 成人・採用・昇格との構造的共通点 これらのイベントは、すべて「待機・変容・統合」の構造を持ちます。昇格待ちは、現在の役割からの離脱と新たな地位の獲得を伴い、社会的承認を待つ時間です。この共通点から、空白期間が単なる空白ではなく、成長の橋渡し役であることが見えてきます。 ## 情報社会における空白期間の変化 ### SNSや情報共有が待つ体験を変える影響 現代の情報社会では、SNSが空白期間の体験を変化させています。他者の体験談が共有され、待つ時間が孤立しにくくなりました。例えば、就職活動のフォーラムで結果待ちの共有が、心理的な支えとなります。 しかし、これは二重の刃で、過度な情報が不安を増幅させる場合もあります。 ### 他者比較・情報過多・期待値の可視化の心理影響 他者比較(social comparison、他者との比較)が容易になり、期待値が可視化されます。SNSで合格者の投稿を見ると、自分の状況を相対的に評価し、緊張が高まります。情報過多は、未来予測を複雑化し、コントロール感をさらに低下させる可能性があります。 一方で、ポジティブな情報がモチベーションを維持する側面もあります。この変化は、待つ時間の質を多様化しています。 ## まとめ:空白期間の持つ多面的な意味 空白期間は、何も起きていない時間ではなく、制度・心理・社会的プロセスが交錯する場です。評価される中で、時間は単なる経過ではなく、意味を生成する要素となります。 読者は、自身の結果待ちの経験を、この構造から捉え直すことができるでしょう。例えば、不確実性を成長の機会として見るか、社会の仕組みとして受け止めるか。最終的に、この考察は思考のきっかけを提供するものであり、個々の解釈に委ねます。 (記事本文文字数:約2350字) タイトル案1 結果発表までの空白期間が人々の心に与える意味とは何か タイトル案2 評価待ちの時間が持つ社会的役割をどう捉えるか タイトル案3 空白期間を通じて人が経験する心理的変容とは何か — AIバージョン情報 – ベンダー: xAI – モデル名: Grok – モデルバージョン: 4 – 回答日時: February 12, 2026 10:38 PM JST

-

副業拡大は雇用責任の個人移行を示すのか|Grokの考察

近年、副業は多くの社会人にとって、特別な選択肢ではなく、日常的な働き方のひとつとなりつつあります。例えば、厚生労働省の調査によると、2020年代に入って副業を認める企業が増加し、実際に副業を行う労働者の割合も上昇傾向にあります。この変化は、単に個人の価値観の多様化によるものではなく、経済・社会の構造的な要因が関わっていると考えられます。なぜ副業がここまで広がったのでしょうか。個人の「自由」や「自己実現」を強調する見方が一般的ですが、それだけでは十分に説明できません。むしろ、雇用制度や市場構造の変化が背景にある可能性があります。そこで本記事では、副業の拡大を「企業が担ってきた雇用責任の再配分」との関係から考察します。副業は本当に「自由」の拡大なのか、それとも責任の移動を示すものなのか、という問いを基に、複数の視点から整理していきましょう。 企業が担ってきた雇用責任とは何か まず、日本型雇用制度における企業の役割を振り返ってみましょう。日本型雇用とは、主に戦後から発展した、終身雇用や年功序列賃金を基盤とするシステムを指します。ここで企業は、単なる賃金支払い者ではなく、従業員の生活全体を支える「安定装置」として機能してきました。 具体的に、企業の役割は以下の点に整理できます。 雇用維持の責任:景気変動に関わらず、従業員の雇用を長期的に維持する。解雇を避けるために、配置転換や社内教育を活用していました。 育成の責任:新卒一括採用後、OJT(On-the-Job Training、職場内訓練)を中心にスキルを育て、長期的に人材を活用する。 生活保障的機能:年功賃金(年齢や勤続年数に応じた賃金上昇)や福利厚生(住宅手当、退職金など)を通じて、家族の生活まで支える。 これらがなぜ機能してきたかといえば、経済成長期の安定した市場構造が背景にあります。企業は長期投資として人材を育成し、忠誠心を確保することで、生産性を高めていました。また、国家の社会保障制度が不十分だった時代に、企業がその一部を補完する役割を果たしていたのです。この構造は、個人のキャリアを企業主導で設計し、リスクを企業側が吸収する形でした。 副業の拡大が示唆する「責任の再配分」 副業の拡大は、こうした雇用責任が再配分されている可能性を示唆しています。ただし、これは企業が一方的に責任を放棄したわけではなく、市場や個人の変化も絡む複合的な現象です。以下に、複数の視点から整理します。 収入安定責任の移動:従来、企業は雇用維持を通じて収入の安定を保証していましたが、副業の普及により、個人が複数収入源を確保する形が増えています。例えば、フリーランスプラットフォームの台頭により、個人は市場を通じて収入を分散可能になりました。これにより、企業の雇用責任が軽減され、個人の責任が増大している側面があります。 スキル投資責任の移動:企業主導の育成から、個人がオンライン学習や副業経験を通じてスキルを磨く時代へ移行しています。雇用制度の観点では、終身雇用が崩れやすい今、個人が市場価値を維持するための投資を担うようになりました。社会保障の視点では、公的支援(職業訓練助成金など)が補完しますが、個人の負担が大きい可能性があります。 キャリア設計の移行:企業がキャリアパスを提供するモデルから、個人が副業を通じて多様な経験を積む個人主導型へ。市場構造の変化(ギグエコノミー、短期契約労働の増加)により、個人の戦略が重要視されます。ただし、これが「再配分」であるかは、個人の選択度合いによるでしょう。 これらの変化は、グローバル化や技術革新(AIの導入など)が加速させたものです。企業は柔軟性を求め、個人は適応を迫られています。 副業は「リスクの押し付け」なのか「選択肢の拡張」なのか 副業をめぐる議論では、「企業がリスクを個人に押し付ける」見方と、「個人の選択肢が広がる」見方が対立します。ここでは、複数の視点からバランスよく考察します。 企業コスト構造の視点:企業は人件費を固定費から変動費化(必要に応じて外部委託)する傾向があります。副業解禁は、これを促進し、企業の雇用責任を軽減する可能性があります。例えば、非正規雇用の増加と並行して、副業は企業のコスト最適化戦略として機能します。ただし、これは市場競争の結果であり、必ずしも「押し付け」ではありません。 労働市場流動化の視点:市場構造の変化により、労働力が流動的になっています。副業は、個人が市場を活用してリスクを分散する手段です。一方、社会保障制度の観点では、年金や失業保険が企業依存から個人化(例:iDeCoのような個人型年金)し、国家の役割が増す可能性があります。これにより、責任の再配分が国家レベルでも進むかもしれません。 個人のリスク分散戦略:副業は、単一雇用への依存を減らし、キャリアの柔軟性を高めます。20〜50代の社会人にとって、不安定な雇用環境での「保険」として有効です。しかし、時間管理や税務の負担が増え、個人の責任が重くなる側面もあります。 これらを総合すると、副業はリスクの押し付けと選択肢の拡張の両面を持ち、雇用制度・市場構造・個人の戦略が絡み合っています。国家の社会保障がこれをどう支えるかが鍵です。 重要なのは「副業の有無」ではなく「責任の所在」 副業の議論で重要なのは、副業をするかしないかではなく、誰がどのような責任を担うのかという点です。以下に整理します。 誰がリスクを持つのか:景気変動や失業リスクを、企業が吸収する時代から、個人が副業で分散する形へ。市場構造の観点では、プラットフォーム経済がリスクを分散しますが、個人の負担が増す可能性があります。 誰が育成コストを持つのか:企業の社内研修から、個人の自己投資へ。キャリア戦略として、副業は実践的なスキル習得の場ですが、費用や時間の責任は個人にシフトします。社会保障の視点では、公的支援の拡充が求められます。 誰が生活安定を支えるのか:福利厚生の企業依存から、個人・国家の組み合わせへ。副業時代では、「自律」(自らキャリアを設計する自由)と「負担」(責任の増大)の両面を考慮する必要があります。読者は、自分の働き方をリスク構造で振り返ってみるとよいでしょう。 この視点から、副業は雇用責任の再配分を象徴し、個人の戦略がより重要になることを示します。 まとめ:副業を通じた雇用構造の変化を考える 副業の拡大は、単なる働き方の多様化ではなく、企業が担ってきた雇用責任の再配分を示す可能性があります。雇用制度の変化、市場構造の流動化、個人のキャリア戦略、社会保障の役割分担が絡み合い、社会全体の構造が移行しているのです。 読者の皆さんは、副業を「収入の増加」だけでなく、「リスクの所在」や「責任のバランス」で考えてみてください。過度に楽観せず、悲観せず、自分の状況に合った選択を模索する視点が重要です。この考察が、その材料になれば幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 副業の拡大は、 「企業が担ってきた雇用責任の再配分」と関係しているのかについて、 雇用制度・社会保障・市場構造・個人のキャリア戦略という複数の視点から、 冷静かつ現実的に整理・考察してください。 【目的】 – 副業を「自由」や「自己実現」だけで語らず、社会構造の変化として整理する – 企業・個人・市場・国家の役割分担がどう変化しているかを可視化する – 読者が自分の働き方やキャリアのリスク構造を考えるための“視点”を提供する 【読者像】 – 一般社会人(20〜50代) – 副業に興味がある、またはすでに始めている人 – 将来の雇用の安定性に不安や関心を持つ人 – 雇用制度や社会構造に漠然とした疑問を持っている層 【記事構成】 1. 導入(問題提起) – 副業が「特別な働き方」から「一般的な選択肢」に変わりつつある現状を提示する – なぜ副業がここまで広がったのかを、単なる個人の価値観変化ではなく構造変化として示す – 「副業=自由」なのか、「副業=責任の移動」なのかという問いを提示する 2. 企業が担ってきた雇用責任とは何か – 日本型雇用における企業の役割(雇用維持・育成・生活保障的機能)を整理する – 終身雇用・年功賃金・福利厚生が果たしてきた社会的役割に触れる – なぜ企業が「生活の安定装置」として機能してきたのかを構造的に説明する 3. 副業の拡大が示唆する「責任の再配分」 – 収入安定責任が企業から個人へ移動している可能性 – スキル投資責任が組織から個人へ移動している可能性 – キャリア設計が企業主導から個人主導へ移行している可能性 – ※ただし「企業が責任を放棄した」と断定しないこと 4. 副業は「リスクの押し付け」なのか「選択肢の拡張」なのか – 企業コスト構造(固定費→変動費化)の視点 – 労働市場流動化の視点 – 個人のリスク分散戦略としての副業 – 国家・社会保障制度との関係(個人化の進行など) 5. 重要なのは「副業の有無」ではなく「責任の所在」 – 誰がリスクを持つのか – 誰が育成コストを持つのか – 誰が生活安定を支えるのか – 副業時代のキャリアにおける「自律」と「負担」の両面を整理する 6. まとめ – 副業は単なる働き方の多様化ではなく、雇用責任構造の変化の一部である可能性を再確認する – 読者が自分の働き方を「収入」だけでなく「リスク構造」で考える視点を提示する – 過度に楽観・悲観せず、思考を促す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:副業と雇用責任再配分の構造) ※(図:企業・個人・市場の責任分担イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「副業は働き方の自由なのか、それとも雇用責任の再設計なのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入:副業の広がりとその背景 近年、副業は多くの社会人にとって、特別な選択肢ではなく、日常的な働き方のひとつとなりつつあります。例えば、厚生労働省の調査によると、2020年代に入って副業を認める企業が増加し、実際に副業を行う労働者の割合も上昇傾向にあります。この変化は、単に個人の価値観の多様化によるものではなく、経済・社会の構造的な要因が関わっていると考えられます。 なぜ副業がここまで広がったのでしょうか。個人の「自由」や「自己実現」を強調する見方が一般的ですが、それだけでは十分に説明できません。むしろ、雇用制度や市場構造の変化が背景にある可能性があります。そこで本記事では、副業の拡大を「企業が担ってきた雇用責任の再配分」との関係から考察します。副業は本当に「自由」の拡大なのか、それとも責任の移動を示すものなのか、という問いを基に、複数の視点から整理していきましょう。 ### 企業が担ってきた雇用責任とは何か まず、日本型雇用制度における企業の役割を振り返ってみましょう。日本型雇用とは、主に戦後から発展した、終身雇用や年功序列賃金を基盤とするシステムを指します。ここで企業は、単なる賃金支払い者ではなく、従業員の生活全体を支える「安定装置」として機能してきました。 具体的に、企業の役割は以下の点に整理できます。 - **雇用維持の責任**:景気変動に関わらず、従業員の雇用を長期的に維持する。解雇を避けるために、配置転換や社内教育を活用していました。 - **育成の責任**:新卒一括採用後、OJT(On-the-Job Training、職場内訓練)を中心にスキルを育て、長期的に人材を活用する。 - **生活保障的機能**:年功賃金(年齢や勤続年数に応じた賃金上昇)や福利厚生(住宅手当、退職金など)を通じて、家族の生活まで支える。 これらがなぜ機能してきたかといえば、経済成長期の安定した市場構造が背景にあります。企業は長期投資として人材を育成し、忠誠心を確保することで、生産性を高めていました。また、国家の社会保障制度が不十分だった時代に、企業がその一部を補完する役割を果たしていたのです。この構造は、個人のキャリアを企業主導で設計し、リスクを企業側が吸収する形でした。 ※(図:日本型雇用の責任分担イメージ – 企業が雇用・育成・保障の中心) ### 副業の拡大が示唆する「責任の再配分」 副業の拡大は、こうした雇用責任が再配分されている可能性を示唆しています。ただし、これは企業が一方的に責任を放棄したわけではなく、市場や個人の変化も絡む複合的な現象です。以下に、複数の視点から整理します。 - **収入安定責任の移動**:従来、企業は雇用維持を通じて収入の安定を保証していましたが、副業の普及により、個人が複数収入源を確保する形が増えています。例えば、フリーランスプラットフォームの台頭により、個人は市場を通じて収入を分散可能になりました。これにより、企業の雇用責任が軽減され、個人の責任が増大している側面があります。 - **スキル投資責任の移動**:企業主導の育成から、個人がオンライン学習や副業経験を通じてスキルを磨く時代へ移行しています。雇用制度の観点では、終身雇用が崩れやすい今、個人が市場価値を維持するための投資を担うようになりました。社会保障の視点では、公的支援(職業訓練助成金など)が補完しますが、個人の負担が大きい可能性があります。 - **キャリア設計の移行**:企業がキャリアパスを提供するモデルから、個人が副業を通じて多様な経験を積む個人主導型へ。市場構造の変化(ギグエコノミー、短期契約労働の増加)により、個人の戦略が重要視されます。ただし、これが「再配分」であるかは、個人の選択度合いによるでしょう。 これらの変化は、グローバル化や技術革新(AIの導入など)が加速させたものです。企業は柔軟性を求め、個人は適応を迫られています。 ※(図:副業拡大による責任再配分の構造 – 企業から個人・市場へのシフト) ### 副業は「リスクの押し付け」なのか「選択肢の拡張」なのか 副業をめぐる議論では、「企業がリスクを個人に押し付ける」見方と、「個人の選択肢が広がる」見方が対立します。ここでは、複数の視点からバランスよく考察します。 - **企業コスト構造の視点**:企業は人件費を固定費から変動費化(必要に応じて外部委託)する傾向があります。副業解禁は、これを促進し、企業の雇用責任を軽減する可能性があります。例えば、非正規雇用の増加と並行して、副業は企業のコスト最適化戦略として機能します。ただし、これは市場競争の結果であり、必ずしも「押し付け」ではありません。 - **労働市場流動化の視点**:市場構造の変化により、労働力が流動的になっています。副業は、個人が市場を活用してリスクを分散する手段です。一方、社会保障制度の観点では、年金や失業保険が企業依存から個人化(例:iDeCoのような個人型年金)し、国家の役割が増す可能性があります。これにより、責任の再配分が国家レベルでも進むかもしれません。 - **個人のリスク分散戦略**:副業は、単一雇用への依存を減らし、キャリアの柔軟性を高めます。20〜50代の社会人にとって、不安定な雇用環境での「保険」として有効です。しかし、時間管理や税務の負担が増え、個人の責任が重くなる側面もあります。 これらを総合すると、副業はリスクの押し付けと選択肢の拡張の両面を持ち、雇用制度・市場構造・個人の戦略が絡み合っています。国家の社会保障がこれをどう支えるかが鍵です。 ### 重要なのは「副業の有無」ではなく「責任の所在」 副業の議論で重要なのは、副業をするかしないかではなく、誰がどのような責任を担うのかという点です。以下に整理します。 - **誰がリスクを持つのか**:景気変動や失業リスクを、企業が吸収する時代から、個人が副業で分散する形へ。市場構造の観点では、プラットフォーム経済がリスクを分散しますが、個人の負担が増す可能性があります。 - **誰が育成コストを持つのか**:企業の社内研修から、個人の自己投資へ。キャリア戦略として、副業は実践的なスキル習得の場ですが、費用や時間の責任は個人にシフトします。社会保障の視点では、公的支援の拡充が求められます。 - **誰が生活安定を支えるのか**:福利厚生の企業依存から、個人・国家の組み合わせへ。副業時代では、「自律」(自らキャリアを設計する自由)と「負担」(責任の増大)の両面を考慮する必要があります。読者は、自分の働き方をリスク構造で振り返ってみるとよいでしょう。 この視点から、副業は雇用責任の再配分を象徴し、個人の戦略がより重要になることを示します。 ※(図:企業・個人・市場・国家の責任分担イメージ – 相互連動の変化) ### まとめ:副業を通じた雇用構造の変化を考える 副業の拡大は、単なる働き方の多様化ではなく、企業が担ってきた雇用責任の再配分を示す可能性があります。雇用制度の変化、市場構造の流動化、個人のキャリア戦略、社会保障の役割分担が絡み合い、社会全体の構造が移行しているのです。 読者の皆さんは、副業を「収入の増加」だけでなく、「リスクの所在」や「責任のバランス」で考えてみてください。過度に楽観せず、悲観せず、自分の状況に合った選択を模索する視点が重要です。この考察が、その材料になれば幸いです。 (文字数:約2280字) - 副業拡大は雇用責任の個人移行を示すのか - 副業の広がりがもたらす責任再配分の意味とは - 副業増加と企業責任の変化はどう連動するのか --- AIバージョン情報 – ベンダー: xAI – モデル名: Grok 4 – モデルバージョン: 不明 – 回答日時: 2026年2月12日 11:34 AM JST

-

アスリートの練習時間は労働時間に似ているのか?|Grokの考察

アスリートの練習時間は、労働時間に近いものなのでしょうか。この問いかけは、日常的にスポーツを楽しむ人々やプロアスリートを目指す人々にとって、興味深いものです。近年、スポーツがエンターテイメント産業として拡大し、選手の活動がビジネス化している中で、一般的な労働とスポーツ活動の境界が曖昧になりつつあります。例えば、プロスポーツ選手がチームと契約を結び、練習を通じてパフォーマンスを向上させるプロセスは、会社員が業務時間にスキルを磨く様子に似ているように見えます。このテーマを考察する意義は、社会構造の理解にあります。労働とは何かを考えることで、時間、努力、報酬の関係を再考できます。スポーツは個人の身体を資本とする活動ですが、それが労働として位置づけられるかどうかは、社会の価値観や制度に依存します。ここでは、単に「スポーツは労働か否か」という二元論ではなく、複数の視点から構造的に整理し、読者の皆さんが自身の労働観を振り返る材料を提供します。 労働時間に近いと考えられる構造 成果のための時間投下という観点 アスリートの練習時間は、成果を生むための時間投下という点で、労働時間に近い構造を持っています。一般的な労働では、時間を費やすことで価値を生み出し、給与として報酬を得ます。同様に、アスリートも練習時間を投入して技術や体力を向上させ、試合での成果につなげます。例えば、サッカー選手が毎日数時間のトレーニングを積むのは、チームの勝利や個人成績を高めるためです。このプロセスは、製造業の労働者が生産ラインで時間を費やすのと似て、投入した時間が直接的な価値創出につながる可能性があります。 ただし、ここでは断定せず、近い構造を持つという整理に留めます。なぜなら、練習の質や個人の才能が成果に影響する度合いが、労働よりも大きいからです。 契約・報酬・評価と練習時間の関係 プロスポーツでは、契約書に基づく報酬体系が練習時間を労働時間に近づけています。選手はチームやスポンサーと契約し、練習参加を義務付けられることが多く、これが評価の基準となります。例えば、NBAの選手契約では、練習への出席が報酬に影響する条項が含まれる場合があります。このように、練習時間が契約上の義務となり、報酬と結びつく点は、労働契約に似ています。 また、評価の観点からも共通点が見られます。労働では業績評価が昇給につながりますが、アスリートも練習を通じたパフォーマンス向上で契約更新やボーナスを得ます。これらの構造は、練習を「価値創出プロセス」として位置づけています。 労働とは異なる可能性がある構造 身体そのものが資本である特殊性 アスリートの練習は、身体自体が資本(身体資本:個人の身体能力や健康を経済的価値として捉える概念)である点で、労働時間とは異なる可能性があります。一般労働では、時間やスキルが主な投入資源ですが、アスリートの場合、身体の耐久性や回復力が鍵となります。例えば、マラソン選手の練習は身体を強化しますが、過度な負荷で怪我を招くリスクがあり、これは労働の「時間売却」モデルとは異なります。 この特殊性は、練習を単なる時間投下ではなく、資本の維持・成長プロセスとして見なす理由です。労働では身体の消耗が副次的ですが、アスリートでは身体が直接的な生産手段となります。 成果が不確実である領域 練習時間の成果が不確実な点も、労働とは異なる構造を示します。労働では、時間投入が比較的安定した成果を生みますが、スポーツでは怪我、年齢、競技環境による変動が大きいです。例えば、テニス選手が毎日練習しても、試合での勝利は保証されません。この不確実性は、情熱や運要素を強調し、非労働的な側面を浮かび上がらせます。 また、年齢による身体資本の減衰(例:ピークパフォーマンスの低下)も、労働の定年制とは異なり、個別性が高いです。 情熱・自己実現・競争性などの非労働的要素 アスリートの練習には、情熱や自己実現という要素が強く、労働の義務感とは対照的です。多くの選手が「好きだから続ける」と語るように、練習が競争や達成感の源泉となる場合があります。これは、労働の「対価のための時間」ではなく、内在的な動機による活動として整理できます。 制度・社会構造の観点 プロ契約、実業団、学生スポーツの違い スポーツの制度は、練習時間を労働時間に近づけたり遠ざけたりします。プロ契約の場合、選手は独立した事業者として扱われ、練習が業務に相当します。一方、実業団(企業所属のスポーツチーム)は、社員として労働法が適用され、練習時間が労働時間に含まれることがあります。学生スポーツでは、教育の一環として無償の練習が多く、労働とは遠い位置づけです。 これらの違いは、社会構造を反映しています。プロは経済的独立を重視し、実業団は企業福利厚生として機能します。 労働法・契約形態・教育制度との関係 労働法の観点では、アスリートの練習が労働時間として認定されるかは契約形態次第です。例えば、ILO(国際労働機関)の基準では、報酬対価の活動が労働とされますが、スポーツ契約は成果報酬型が多いため、曖昧です。教育制度では、学生アスリートの練習が奨学金と結びつく場合、労働に似た構造が生まれます。 この関係は、スポーツを「仕事」と「文化」の間に位置づけます。仕事として経済価値を生む一方、文化として社会の娯楽や規範を提供します。 スポーツが「仕事」と「文化」の間にある理由 社会構造的に、スポーツは経済(スポンサー収入)と文化(国民的英雄)の両面を持ちます。これにより、練習時間が労働時間に近づく一方で、文化的価値が非労働的要素を加えます。例えば、オリンピック選手の練習は国家の誇りを生むため、純粋な労働を超えます。 重要なのは「労働かどうか」ではなく「価値がどう生まれるか」 時間投入型労働と資本成長型活動の違い ここで重要なのは、労働の定義ではなく、価値の生成プロセスです。時間投入型労働(例:時給制)は時間量が価値の基盤ですが、資本成長型活動(例:アスリートの身体強化)は、努力と才能の蓄積が鍵となります。アスリートの練習は後者に近く、時間だけでは成果が生まれません。 この違いを整理すると、労働は交換価値(時間対価)を重視し、スポーツは使用価値(パフォーマンス向上)を重視します。 身体資本・才能・努力の関係整理 身体資本は才能(先天的要素)と努力(練習時間)で形成されます。才能が基盤となり、努力がそれを成長させますが、社会構造では契約がこれを経済化します。例えば、天才アスリートは少ない練習で成果を出せますが、一般選手は時間を費やします。この関係は、労働の均一性とは異なり、個別性を強調します。 AI時代における「労働の定義」の再考可能性 AIの進化により、労働の定義が変わりつつあります。AIがルーチンワークを担う中、人間労働は創造性や身体性が重視され、スポーツに近い構造になる可能性があります。これにより、練習時間を「資本投資」として見なす視点が広がります。 まとめ:境界の流動性と労働の本質 スポーツアスリートの練習時間と労働時間の境界は、固定的ではなく、社会構造や制度によって変化します。共通点として時間投下と報酬の連動があり、違いとして身体資本の特殊性や不確実性があります。 結局、労働の本質は「時間」なのか「成果」なのか、という視点が重要です。読者の皆さんは、自身の仕事や趣味を振り返り、努力が労働になる境界を考えてみてはいかがでしょうか。この考察が、そんな再考のきっかけになれば幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 スポーツアスリートにおける「練習時間」は、 一般的な意味での「労働時間」に近い概念なのかについて、 社会構造・経済・身体資本・制度という複数の視点から、 AIの立場で冷静かつ構造的に整理・考察してください。 【目的】 – 「スポーツは労働か否か」という単純な二元論ではなく、構造的な違いと共通点を整理する – 読者が「労働とは何か」「対価とは何か」「努力はどこから労働になるのか」を考える材料を提供する – 身体・才能・時間・契約・成果の関係を社会構造として可視化する 【読者像】 – 一般社会人(20〜50代) – スポーツ経験者・スポーツ観戦層 – 労働観・努力観・報酬構造に関心がある人 – プロスポーツと社会の関係に漠然とした疑問を持つ人 【記事構成】 1. 導入(問題提起) – 「アスリートの練習は労働なのか?」という直感的な問いを提示する – 一般労働とスポーツ活動の境界が曖昧になりつつある背景を説明する – なぜこのテーマが社会構造の理解につながるのかを示す 2. 労働時間に近いと考えられる構造 – 成果のために時間を投下するという観点 – 契約・報酬・評価と練習時間の関係 – プロスポーツにおける「練習=価値創出プロセス」という側面 – ※断定ではなく「近い構造を持つ」という整理に留める 3. 労働とは異なる可能性がある構造 – 身体そのものが資本であるという特殊性 – 成果が不確実である領域(競技結果・怪我・年齢) – 情熱・自己実現・競争性など非労働的要素の存在 4. 制度・社会構造の観点 – プロ契約、実業団、学生スポーツの違い – 労働法・契約形態・教育制度との関係 – スポーツが「仕事」と「文化」の間にある理由 5. 重要なのは「労働かどうか」ではなく「価値がどう生まれるか」 – 時間投入型労働と資本成長型活動の違い – 身体資本・才能・努力の関係整理 – AI時代における「労働の定義」の再考可能性 6. まとめ – スポーツと労働の境界は固定的ではないことを整理する – 労働の本質は「時間」なのか「成果」なのかという視点を提示する – 読者が自身の労働観を再考できる形で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:アスリート活動と労働概念の重なり構造) ※(図:身体資本型活動と時間労働型活動の比較) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「努力はどこから労働になるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # アスリートの練習時間と労働時間の関係を考える ## 導入:問題提起 アスリートの練習時間は、労働時間に近いものなのでしょうか。この問いかけは、日常的にスポーツを楽しむ人々やプロアスリートを目指す人々にとって、興味深いものです。近年、スポーツがエンターテイメント産業として拡大し、選手の活動がビジネス化している中で、一般的な労働とスポーツ活動の境界が曖昧になりつつあります。例えば、プロスポーツ選手がチームと契約を結び、練習を通じてパフォーマンスを向上させるプロセスは、会社員が業務時間にスキルを磨く様子に似ているように見えます。 このテーマを考察する意義は、社会構造の理解にあります。労働とは何かを考えることで、時間、努力、報酬の関係を再考できます。スポーツは個人の身体を資本とする活動ですが、それが労働として位置づけられるかどうかは、社会の価値観や制度に依存します。ここでは、単に「スポーツは労働か否か」という二元論ではなく、複数の視点から構造的に整理し、読者の皆さんが自身の労働観を振り返る材料を提供します。 ## 労働時間に近いと考えられる構造 ### 成果のための時間投下という観点 アスリートの練習時間は、成果を生むための時間投下という点で、労働時間に近い構造を持っています。一般的な労働では、時間を費やすことで価値を生み出し、給与として報酬を得ます。同様に、アスリートも練習時間を投入して技術や体力を向上させ、試合での成果につなげます。例えば、サッカー選手が毎日数時間のトレーニングを積むのは、チームの勝利や個人成績を高めるためです。このプロセスは、製造業の労働者が生産ラインで時間を費やすのと似て、投入した時間が直接的な価値創出につながる可能性があります。 ただし、ここでは断定せず、近い構造を持つという整理に留めます。なぜなら、練習の質や個人の才能が成果に影響する度合いが、労働よりも大きいからです。 ### 契約・報酬・評価と練習時間の関係 プロスポーツでは、契約書に基づく報酬体系が練習時間を労働時間に近づけています。選手はチームやスポンサーと契約し、練習参加を義務付けられることが多く、これが評価の基準となります。例えば、NBAの選手契約では、練習への出席が報酬に影響する条項が含まれる場合があります。このように、練習時間が契約上の義務となり、報酬と結びつく点は、労働契約に似ています。 また、評価の観点からも共通点が見られます。労働では業績評価が昇給につながりますが、アスリートも練習を通じたパフォーマンス向上で契約更新やボーナスを得ます。これらの構造は、練習を「価値創出プロセス」として位置づけています。 ※(図:練習時間と報酬の連動構造) ## 労働とは異なる可能性がある構造 ### 身体そのものが資本である特殊性 アスリートの練習は、身体自体が資本(身体資本:個人の身体能力や健康を経済的価値として捉える概念)である点で、労働時間とは異なる可能性があります。一般労働では、時間やスキルが主な投入資源ですが、アスリートの場合、身体の耐久性や回復力が鍵となります。例えば、マラソン選手の練習は身体を強化しますが、過度な負荷で怪我を招くリスクがあり、これは労働の「時間売却」モデルとは異なります。 この特殊性は、練習を単なる時間投下ではなく、資本の維持・成長プロセスとして見なす理由です。労働では身体の消耗が副次的ですが、アスリートでは身体が直接的な生産手段となります。 ### 成果が不確実である領域 練習時間の成果が不確実な点も、労働とは異なる構造を示します。労働では、時間投入が比較的安定した成果を生みますが、スポーツでは怪我、年齢、競技環境による変動が大きいです。例えば、テニス選手が毎日練習しても、試合での勝利は保証されません。この不確実性は、情熱や運要素を強調し、非労働的な側面を浮かび上がらせます。 また、年齢による身体資本の減衰(例:ピークパフォーマンスの低下)も、労働の定年制とは異なり、個別性が高いです。 ### 情熱・自己実現・競争性などの非労働的要素 アスリートの練習には、情熱や自己実現という要素が強く、労働の義務感とは対照的です。多くの選手が「好きだから続ける」と語るように、練習が競争や達成感の源泉となる場合があります。これは、労働の「対価のための時間」ではなく、内在的な動機による活動として整理できます。 ※(図:非労働的要素と労働要素の重なり) ## 制度・社会構造の観点 ### プロ契約、実業団、学生スポーツの違い スポーツの制度は、練習時間を労働時間に近づけたり遠ざけたりします。プロ契約の場合、選手は独立した事業者として扱われ、練習が業務に相当します。一方、実業団(企業所属のスポーツチーム)は、社員として労働法が適用され、練習時間が労働時間に含まれることがあります。学生スポーツでは、教育の一環として無償の練習が多く、労働とは遠い位置づけです。 これらの違いは、社会構造を反映しています。プロは経済的独立を重視し、実業団は企業福利厚生として機能します。 ### 労働法・契約形態・教育制度との関係 労働法の観点では、アスリートの練習が労働時間として認定されるかは契約形態次第です。例えば、ILO(国際労働機関)の基準では、報酬対価の活動が労働とされますが、スポーツ契約は成果報酬型が多いため、曖昧です。教育制度では、学生アスリートの練習が奨学金と結びつく場合、労働に似た構造が生まれます。 この関係は、スポーツを「仕事」と「文化」の間に位置づけます。仕事として経済価値を生む一方、文化として社会の娯楽や規範を提供します。 ### スポーツが「仕事」と「文化」の間にある理由 社会構造的に、スポーツは経済(スポンサー収入)と文化(国民的英雄)の両面を持ちます。これにより、練習時間が労働時間に近づく一方で、文化的価値が非労働的要素を加えます。例えば、オリンピック選手の練習は国家の誇りを生むため、純粋な労働を超えます。 ## 重要なのは「労働かどうか」ではなく「価値がどう生まれるか」 ### 時間投入型労働と資本成長型活動の違い ここで重要なのは、労働の定義ではなく、価値の生成プロセスです。時間投入型労働(例:時給制)は時間量が価値の基盤ですが、資本成長型活動(例:アスリートの身体強化)は、努力と才能の蓄積が鍵となります。アスリートの練習は後者に近く、時間だけでは成果が生まれません。 この違いを整理すると、労働は交換価値(時間対価)を重視し、スポーツは使用価値(パフォーマンス向上)を重視します。 ※(図:身体資本型活動と時間労働型活動の比較) ### 身体資本・才能・努力の関係整理 身体資本は才能(先天的要素)と努力(練習時間)で形成されます。才能が基盤となり、努力がそれを成長させますが、社会構造では契約がこれを経済化します。例えば、天才アスリートは少ない練習で成果を出せますが、一般選手は時間を費やします。この関係は、労働の均一性とは異なり、個別性を強調します。 ### AI時代における「労働の定義」の再考可能性 AIの進化により、労働の定義が変わりつつあります。AIがルーチンワークを担う中、人間労働は創造性や身体性が重視され、スポーツに近い構造になる可能性があります。これにより、練習時間を「資本投資」として見なす視点が広がります。 ## まとめ:境界の流動性と労働の本質 スポーツアスリートの練習時間と労働時間の境界は、固定的ではなく、社会構造や制度によって変化します。共通点として時間投下と報酬の連動があり、違いとして身体資本の特殊性や不確実性があります。 結局、労働の本質は「時間」なのか「成果」なのか、という視点が重要です。読者の皆さんは、自身の仕事や趣味を振り返り、努力が労働になる境界を考えてみてはいかがでしょうか。この考察が、そんな再考のきっかけになれば幸いです。 ## タイトル案 アスリートの練習時間は労働時間に似ているのか? スポーツ選手の練習は労働の概念に近いのか? 練習時間がアスリートの労働に相当するのか? --- AIバージョン情報 – ベンダー: xAI – モデル名: Grok 4 – モデルバージョン: 不明 – 回答日時: February 12, 2026 11:02 AM JST

-

現代の多様性社会で国別対抗オリンピックは今後も成立するか|Grokの考察

現代社会では、グローバル化と多様性が急速に進展しています。移民・留学生の増加、二重国籍者の拡大、SNSを通じた文化交流により、個人のアイデンティティは国籍だけでなく文化・ルーツ・居住地・価値観の複数層で構成されるようになりました。ジェンダーや性的指向の多様性も社会規範として定着しつつあります。一方、オリンピックは「国別対抗」を前提としたイベントです。各選手は自国旗の下で競い、国別メダル獲得数や順位表が注目を集め、国歌斉唱や国旗掲揚が象徴的なシーンとなります。この「国」という単位を基盤とするモデルが、多様性時代にどのような意味を持つのか、という問いが生まれています。帰化選手の増加や選手の国際移動が目立つ中、「国家帰属」の絶対性が揺らぎつつある構造的変化として、このテーマを整理・考察します。 オリンピックにおける「国別対抗」の歴史的役割 近代オリンピックは1896年のアテネ大会以来、国別参加を基本としてきました。創設者ピエール・ド・クーベルタンは、古代ギリシャの都市国家競技を参考にしつつ、近代国家間の平和的競争と国際理解を意図しました。しかし現実には、国家統合や国威発揚の側面が強く現れました。 例として、1936年ベルリン大会ではナチス・ドイツによる政治宣伝、冷戦期の米ソ対抗ではイデオロギー対立の象徴となりました。日本でも1964年東京大会は戦後復興の象徴、2020東京大会は多様性メッセージを発信する場となりました。 国民感情との結びつきも重要です。国別順位表やテレビ中継は視聴者に「自分ごと化」を促し、ナショナリズムを穏やかに喚起します。経済的には、スポンサー企業や放送権料が国別対抗のドラマ性を活用しており、IOCの巨額収益を支えています。このシンプルな対立構造は、長期的に大会の維持・拡大を可能としてきました。 多様性時代が国別対抗モデルに与える変化 多様性時代では、個人のアイデンティティが多層化しています。一人の選手が複数の国籍・文化・言語を持ち、ルーツと居住地が異なるケースが増えています。 選手の移動・帰化・多国籍トレーニング環境 代表資格取得には一定期間の居住や血統要件が必要ですが、競技環境向上や出場機会確保を理由に国籍変更を選択する選手が目立ちます。例えば、パリ2024オリンピックではアメリカ出身のジョシュ・ホーキンソンが日本代表として男子バスケットボールに出場しました。他にも血統や育った環境を背景とした国籍選択事例が見られます。 トレーニング環境も多国籍化しており、海外クラブやアカデミーで育つ選手が増え、国家への忠誠心が相対化します。また、SNS時代では個人ブランドが強まり、スポンサーシップやファン層は国境を超えやすくなっています。 ※(図:国家と個人アイデンティティの関係構造) (国家層 ↔ 文化・ルーツ層 ↔ 個人選択層の重層モデル) これらの変化は、「国」という単位が絶対的ではなく、選択可能な「一つのアイデンティティ」として相対化される構造を示しています。経済面では、帰化や移籍が人材市場化を促進し、制度面でもIOCの国籍ルール見直し議論が生じています。 それでも国別対抗が維持される理由 一方で、国別対抗が維持される要因も複数あります。 感情移入しやすい共同体単位としての国家 国家は歴史・言語・文化を共有する共同体単位として、観客に強い一体感を提供します。個人選手への応援も、国代表という枠組みを通じて拡大しやすい構造です。 物語・対立構造・メディア化のしやすさ ライバル国との対立、逆転劇、統一テーマ(例:平和や復興)はドラマを生みやすく、視聴率やSNS拡散を促進します。 大会運営・制度設計のシンプルさ 国籍証明に基づく参加資格は運営コストを抑え、公平性を担保しやすいのです。経済的には、国別順位がスポンサー誘致や観光PRに有効です。 これらの要因から、国別対抗が完全に消えるのではなく、感情・物語の基盤として意味を変えながら存続する可能性が高いと言えます。 未来にあり得るスポーツ競争の形 今後のモデルとして、国家単位と個人ブランドの併存が考えられます。国別メダル表は残しつつ、選手個人のSNS影響力やグローバルスポンサーが並存する形です。 都市・リーグ・企業・コミュニティ単位の競争 サッカーのクラブワールドカップや、都市対抗型の新イベントが参考になります。 新競技における国家概念の弱体化 eスポーツの場合、国籍よりスキルとチーム所属が優先されやすく、2025年のOlympic Esports Games構想や将来的なロサンゼルス大会統合議論がその方向性を示唆します。ブレークダンス(パリ2024)のような文化由来競技も、伝統的な国家枠組みに収まりにくい特徴を持ちます。 ※(図:スポーツ競争単位の変化イメージ) (国家中心 → 国家+個人併存 → 都市・コミュニティ・スキル単位の多層化) 国という単位は「消える」のではなく、文化交流や象徴的アイデンティティの役割にシフトする可能性があります。 まとめ 多様性時代は国家を否定する流れではなく、相対化・多層化する流れです。オリンピックの存在意義は、純粋な「競技パフォーマンス」だけでなく、人々が感情移入できる「物語」の創出にあります。 国別対抗は歴史的・感情的・経済的基盤を持ちつつ、多様性による変化圧力を受けています。読者の皆さんが「国家」「個人」「共同体」の単位をどのように捉え、スポーツと社会の関係を再考する材料となれば幸いです。構造的な視点から見ることで、単純な賛否を超えた考察が可能になるでしょう。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 多様性が重視される時代において、 オリンピックのような「国別対抗型スポーツイベント」は 今後も成立し続けるのかを、 社会構造・歴史・制度・感情・経済の観点から整理・考察してください。 【目的】 – 「賛成/反対」といった単純な価値判断ではなく、構造的な変化としてオリンピックの存在意義を整理する – 読者が「国家」「個人」「共同体」という単位の変化を考えるための“視点”を提供する – グローバル化・多様性時代におけるスポーツと社会の関係性を浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – スポーツ観戦が好きな層 – 社会構造・文化・国際関係に関心を持つ層 – 多様性という価値観が社会制度にどう影響するかに関心がある人 【記事構成】 1. 導入(問題提起) – 多様性・グローバル化が進む現代社会の特徴を簡潔に示す – 「国単位で競う」というオリンピックの前提を提示する – なぜ今この問いが生まれているのかを説明する 2. オリンピックにおける「国別対抗」の歴史的役割 – 国家統合・国威発揚・政治的象徴としての側面 – メディア・スポンサー・国民感情との関係 – なぜ長期的に維持されてきたのかを整理する 3. 多様性時代が国別対抗モデルに与える変化 – アイデンティティの多層化(国籍・文化・ルーツ・居住地など) – 選手の移動・帰化・多国籍トレーニング環境 – 個人ブランド化と国家帰属の相対化 – なぜ「国」という単位が絶対ではなくなりつつあるのかを構造的に説明する 4. それでも国別対抗が維持される理由 – 感情移入しやすい共同体単位としての国家 – 物語・対立構造・メディア化のしやすさ – 大会運営・制度設計のシンプルさ – 完全に消えるのではなく「意味が変化する可能性」を整理する 5. 未来にあり得るスポーツ競争の形 – 国家単位+個人ブランド併存モデル – 都市・リーグ・企業・コミュニティ単位の競争 – 新競技(例:デジタル競技など)における国家概念の弱体化 – 国という単位が「消える」のではなく「役割が変わる」可能性 6. まとめ – 多様性時代は国家を否定する流れではなく、相対化する流れであることを整理する – オリンピックの本質が「競技」なのか「物語」なのかという視点を提示する – 読者が社会とスポーツの関係を再考する材料を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安や対立を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:国家と個人アイデンティティの関係構造) ※(図:スポーツ競争単位の変化イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「国で競うスポーツはこれからも続くのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: **### 導入(問題提起)** 現代社会では、グローバル化と多様性が急速に進展しています。移民・留学生の増加、二重国籍者の拡大、SNSを通じた文化交流により、個人のアイデンティティは国籍だけでなく文化・ルーツ・居住地・価値観の複数層で構成されるようになりました。ジェンダーや性的指向の多様性も社会規範として定着しつつあります。 一方、オリンピックは「国別対抗」を前提としたイベントです。各選手は自国旗の下で競い、国別メダル獲得数や順位表が注目を集め、国歌斉唱や国旗掲揚が象徴的なシーンとなります。この「国」という単位を基盤とするモデルが、多様性時代にどのような意味を持つのか、という問いが生まれています。 帰化選手の増加や選手の国際移動が目立つ中、「国家帰属」の絶対性が揺らぎつつある構造的変化として、このテーマを整理・考察します。 **### 2. オリンピックにおける「国別対抗」の歴史的役割** 近代オリンピックは1896年のアテネ大会以来、国別参加を基本としてきました。創設者ピエール・ド・クーベルタンは、古代ギリシャの都市国家競技を参考にしつつ、近代国家間の平和的競争と国際理解を意図しました。しかし現実には、国家統合や国威発揚の側面が強く現れました。 例として、1936年ベルリン大会ではナチス・ドイツによる政治宣伝、冷戦期の米ソ対抗ではイデオロギー対立の象徴となりました。日本でも1964年東京大会は戦後復興の象徴、2020東京大会は多様性メッセージを発信する場となりました。 国民感情との結びつきも重要です。国別順位表やテレビ中継は視聴者に「自分ごと化」を促し、ナショナリズムを穏やかに喚起します。経済的には、スポンサー企業や放送権料が国別対抗のドラマ性を活用しており、IOCの巨額収益を支えています。このシンプルな対立構造は、長期的に大会の維持・拡大を可能としてきました。 **### 3. 多様性時代が国別対抗モデルに与える変化** 多様性時代では、個人のアイデンティティが多層化しています。一人の選手が複数の国籍・文化・言語を持ち、ルーツと居住地が異なるケースが増えています。 選手の移動・帰化が顕著です。代表資格取得には一定期間の居住や血統要件が必要ですが、競技環境向上や出場機会確保を理由に国籍変更を選択する選手が目立ちます。例えば、パリ2024オリンピックではアメリカ出身のジョシュ・ホーキンソンが日本代表として男子バスケットボールに出場しました。他にも血統や育った環境を背景とした国籍選択事例が見られます。 トレーニング環境も多国籍化しており、海外クラブやアカデミーで育つ選手が増え、国家への忠誠心が相対化します。また、SNS時代では個人ブランドが強まり、スポンサーシップやファン層は国境を超えやすくなっています。 ※(図:国家と個人アイデンティティの関係構造) (国家層 ↔ 文化・ルーツ層 ↔ 個人選択層の重層モデル) これらの変化は、「国」という単位が絶対的ではなく、選択可能な「一つのアイデンティティ」として相対化される構造を示しています。経済面では、帰化や移籍が人材市場化を促進し、制度面でもIOCの国籍ルール見直し議論が生じています。 **### 4. それでも国別対抗が維持される理由** 一方で、国別対抗が維持される要因も複数あります。 感情移入のしやすさが最大の理由です。国家は歴史・言語・文化を共有する共同体単位として、観客に強い一体感を提供します。個人選手への応援も、国代表という枠組みを通じて拡大しやすい構造です。 物語性とメディア適応性も重要です。ライバル国との対立、逆転劇、統一テーマ(例:平和や復興)はドラマを生みやすく、視聴率やSNS拡散を促進します。制度設計のシンプルさも無視できません。国籍証明に基づく参加資格は運営コストを抑え、公平性を担保しやすいのです。 経済的には、国別順位がスポンサー誘致や観光PRに有効です。これらの要因から、国別対抗が完全に消えるのではなく、感情・物語の基盤として意味を変えながら存続する可能性が高いと言えます。 **### 5. 未来にあり得るスポーツ競争の形** 今後のモデルとして、国家単位と個人ブランドの併存が考えられます。国別メダル表は残しつつ、選手個人のSNS影響力やグローバルスポンサーが並存する形です。 都市・地域・リーグ単位の競争も拡大可能性があります。サッカーのクラブワールドカップや、都市対抗型の新イベントが参考になります。 新競技では国家概念がさらに弱体化します。eスポーツの場合、国籍よりスキルとチーム所属が優先されやすく、2025年のOlympic Esports Games構想(パートナー変更あり)や将来的なロサンゼルス大会統合議論がその方向性を示唆します。ブレークダンス(パリ2024)のような文化由来競技も、伝統的な国家枠組みに収まりにくい特徴を持ちます。 ※(図:スポーツ競争単位の変化イメージ) (国家中心 → 国家+個人併存 → 都市・コミュニティ・スキル単位の多層化) 国という単位は「消える」のではなく、文化交流や象徴的アイデンティティの役割にシフトする可能性があります。 **### 6. まとめ** 多様性時代は国家を否定する流れではなく、相対化・多層化する流れです。オリンピックの存在意義は、純粋な「競技パフォーマンス」だけでなく、人々が感情移入できる「物語」の創出にあります。 国別対抗は歴史的・感情的・経済的基盤を持ちつつ、多様性による変化圧力を受けています。読者の皆さんが「国家」「個人」「共同体」の単位をどのように捉え、スポーツと社会の関係を再考する材料となれば幸いです。構造的な視点から見ることで、単純な賛否を超えた考察が可能になるでしょう。 (本文約2300字) **タイトル案** 現代の多様性社会で国別対抗オリンピックは今後も成立するか アイデンティティ多様化時代に国家単位スポーツ競争は適応できるか グローバル化の中で国別対抗型イベントの役割はどう変化するか — AIバージョン情報 – ベンダー: xAI – モデル名: Grok – モデルバージョン: 不明 – 回答日時: 2026年2月12日 06:01 JST

-

副業はキャリアのリスクを分散させるのか|Grokの考察

現代社会では、副業が多くの人にとって当たり前の選択肢となりつつあります。フリーランスプラットフォームの普及やリモートワークの拡大により、従来の単一企業依存型の働き方から、多様な収入源を確保する動きが活発化しています。なぜ今、副業がキャリア論の中心テーマになっているのでしょうか。それは、AIの進化や経済的不確実性の高まりが、個人のキャリア構造を根本的に変えつつあるからです。副業は単なる収入補填や流行として捉えられることが多いですが、本質的にはキャリア構造の変化を象徴します。ここでは、副業を「分散(リスク分散・選択肢拡張)」と「強化(能力増幅・市場価値向上)」の二つの観点から構造的に整理し、AI時代におけるキャリアの本質を考察します。 AI時代と不確実性社会の文脈 AIの進化は、ルーチンワークの自動化を加速させ、働き方の多様化を促しています。不確実性社会(VUCA:変動性・不確実性・複雑性・曖昧性の高い社会)では、単一のキャリアパスが脆弱になる傾向が見られます。副業はこの文脈で、キャリアの再定義を迫る要素として浮上します。 副業がキャリア分散として機能する構造 副業を「分散」の観点から見ると、主に収入源、スキル、市場接点の多角化が挙げられます。 収入源の分散 単一企業に依存した収入は、会社の業績悪化やリストラで一気に失われるリスクがあります。副業により、複数の収入ストリームを構築すれば、このリスクを軽減できます。例えば、本業が製造業の場合、副業としてオンラインコンテンツ作成を行うことで、業界特有の変動から守られる可能性があります。 スキルの分散 AI時代では、特定のスキルが陳腐化する速度が速くなっています。副業を通じて異なる分野のスキルを習得すれば、キャリアの選択肢を拡張できます。例えば、プログラミングの本業に加え、ライティングの副業を行うことで、技術スキルと表現スキルの両方を保有し、転職時の適応力を高めます。 市場接点の分散 副業は、異なる業界やコミュニティとのつながりを生み、情報収集の幅を広げます。不確実性社会では、市場トレンドの変化を早期に察知することが重要ですが、単線キャリアでは視野が狭くなりやすいです。AIの視点から見ると、AIツールを活用した副業は、市場の多様なニーズに触れる機会を増やします。 ただし、副業が常に安全策になるとは限りません。時間管理の失敗や本業との競合が、新たなリスクを生む場合もあります。AI時代では、AIが代替可能なタスクが増えるため、副業の選択が不適切だと、分散がむしろ散漫さを招く可能性があります。 単線キャリアのリスク増加要因 単線キャリアがリスクになる理由を構造的に説明します。AIの進化により、予測不能な職種変動が発生します。例えば、データ入力や簡単な分析業務はAIに置き換えられやすいです。また、グローバル経済の連動性が高まり、一地域の出来事が広範に影響します。こうした中、副業はリスクヘッジとして機能しますが、分散の度合いが過度になると、専門性の希薄化を招く側面もあります。 副業がキャリア強化として機能する構造 一方、副業を「強化」の観点から考察すると、以下のポイントが重要です。 スキルの相互補完 本業と副業のスキルが連携すれば、相乗効果が生まれます。例えば、マーケティングの本業で得た洞察を、副業のコンサルティングに活かせば、両方の質が向上します。 思考速度・アウトプット量の増加 副業は複数のタスクを並行処理する習慣を養い、効率化を促します。AIツールを副業で活用すれば、短時間で高品質なアウトプットを可能にし、本業の生産性も高まります。 市場価値の可搬性向上 副業を通じて蓄積した実績は、履歴書やポートフォリオとして活用でき、転職市場での競争力を強化します。AI時代では、人間固有の役割(創造性や判断力)が重視されるため、副業でこれらを磨くことが有効です。 AI活用能力との相乗効果 副業でAIをツールとして使う経験は、AIリテラシーを高め、キャリア全体を強化します。ただし、成功例を一般化するのは避けましょう。副業の成果は個人の状況次第で、すべての人が同じ効果を得るわけではありません。 副業の設計がキャリアに与える影響 本質的に、副業の価値は「有無」ではなく「設計」にあります。副業を分類すると、以下の4つが考えられます。 分散型副業:リスクヘッジを主眼とし、異なる分野を選ぶ 強化型副業:本業補完を主眼とし、シナジーを生む 実験型副業:新規スキルのテストを行い、失敗を許容する 将来主軸化型副業:副業を本業に転換する準備を兼ねる これらの設計次第で、副業の意味が変わります。AI時代では、設計が不十分だと時間浪費になる一方、戦略的に設計すればキャリアのレジリエンス(回復力)を高めます。 まとめ:副業を通じたキャリア戦略の再考 副業は、分散か強化かという二択ではなく、キャリア構造の中で役割が変化する存在である可能性があります。AI時代では、働き方の多様化が進む一方、人間の本質的な役割(AIでは代替しにくい創造性や関係構築)が強調されます。副業はこれを活かすツールとなり得ますが、すべての人に適するわけではありません。 読者の皆さんは、自身の状況を振り返り、副業の設計を検討してみてください。リスク分散を求めるか、能力強化を目指すか、それとも実験的に始めるか。最終的な判断は個々に委ねられますが、この考察がキャリア戦略を考える材料になれば幸いです。楽観的に進める必要も、過度に恐れる必要もなく、冷静に構造を整理することが重要です。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI時代・不確実性社会・働き方の多様化が進む中で、 「副業」はキャリアにとって 「分散(リスク分散・選択肢拡張)」なのか、 それとも 「強化(能力増幅・市場価値向上)」なのかを、 AIの視点から冷静かつ構造的に整理・考察してください。 【目的】 – 副業を単なる「収入補填」や「流行」としてではなく、キャリア構造の変化として整理する – 読者が自分のキャリア設計を考えるための“視点”を提供する – AI時代における「キャリアの本質」と「人間の役割」を浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – 副業に興味はあるが、リスクや意味を整理できていない層 – 将来の働き方に不安や関心を持つ人 – AIに詳しくはないが、働き方への影響は感じている層 【記事構成】 1. 導入(問題提起) – 副業が「当たり前の選択肢」になりつつある現状を提示する – なぜ今、副業がキャリア論の中心テーマになっているのかを示す – 副業が単なる収入問題ではなく「キャリア構造の変化」であることを提示する 2. 副業が「キャリア分散」として機能する構造 – 収入源分散、スキル分散、市場接点分散という観点で整理する – なぜ単線キャリアがリスクになりつつあるのかを構造的に説明する – 不確実性社会・AI時代との関係を整理する – ※副業=安全とは断定しないこと 3. 副業が「キャリア強化」として機能する構造 – スキルの相互補完 – 思考速度・アウトプット量の増加 – 市場価値の可搬性向上 – AI活用能力との相乗効果 – ※成功例の一般化は避けること 4. 本質は「副業の有無」ではなく「設計」 – 分散型副業 – 強化型副業 – 実験型副業 – 将来主軸化型副業 – なぜ設計次第で意味が変わるのかを説明する 5. まとめ – 副業は分散か強化かという二択ではなく、構造の中で役割が変化する存在である可能性を提示する – 読者が自分のキャリア戦略を考える視点を提示して締めくくる – 楽観・悲観どちらにも寄らず思考余白を残す 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:副業がキャリアに与える構造影響) ※(図:分散型キャリアと強化型キャリアの比較) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「副業はキャリアを弱くするのか強くするのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入:副業がキャリアの選択肢として注目される背景 現代社会では、副業が多くの人にとって当たり前の選択肢となりつつあります。例えば、フリーランスプラットフォームの普及やリモートワークの拡大により、従来の単一企業依存型の働き方から、多様な収入源を確保する動きが活発化しています。なぜ今、副業がキャリア論の中心テーマになっているのでしょうか。それは、AIの進化や経済的不確実性の高まりが、個人のキャリア構造を根本的に変えつつあるからです。 副業は、単なる収入補填や流行として捉えられることが多いですが、本質的にはキャリア構造の変化を象徴します。従来の「終身雇用型」キャリアは安定を前提としていましたが、AI時代では技術革新による職種の消滅や、グローバルな市場変動がリスクを増大させています。このような中で、副業はキャリアの柔軟性を高める手段として機能する可能性があります。ここでは、副業を「分散(リスク分散・選択肢拡張)」と「強化(能力増幅・市場価値向上)」の二つの観点から構造的に整理し、考察します。これにより、読者が自身のキャリア設計を考える視点を提供します。 ### AI時代と不確実性社会の文脈 AIの進化は、ルーチンワークの自動化を加速させ、働き方の多様化を促しています。不確実性社会(VUCA:Volatility, Uncertainty, Complexity, Ambiguityの略で、変動性・不確実性・複雑性・曖昧性の高い社会を指す)では、単一のキャリアパスが脆弱になる傾向が見られます。副業はこの文脈で、キャリアの再定義を迫る要素として浮上します。 ### 副業がキャリア分散として機能する構造 副業を「分散」の観点から見ると、主に収入源、スキル、市場接点の多角化が挙げられます。まず、収入源の分散です。単一企業に依存した収入は、会社の業績悪化やリストラで一気に失われるリスクがあります。副業により、複数の収入ストリームを構築すれば、このリスクを軽減できます。例えば、本業が製造業の場合、副業としてオンラインコンテンツ作成を行うことで、業界特有の変動から守られる可能性があります。 次に、スキルの分散です。AI時代では、特定のスキルが陳腐化する速度が速くなっています。副業を通じて異なる分野のスキルを習得すれば、キャリアの選択肢を拡張できます。例えば、プログラミングの本業に加え、ライティングの副業を行うことで、技術スキルと表現スキルの両方を保有し、転職時の適応力を高めます。 さらに、市場接点の分散です。副業は、異なる業界やコミュニティとのつながりを生み、情報収集の幅を広げます。不確実性社会では、市場トレンドの変化を早期に察知することが重要ですが、単線キャリア(一つのキャリアパスに限定された働き方)では視野が狭くなりやすいです。AIの視点から見ると、AIツールを活用した副業(例:AI生成コンテンツの編集)は、市場の多様なニーズに触れる機会を増やします。 ただし、副業が常に安全策になるとは限りません。時間管理の失敗や本業との競合が、新たなリスクを生む場合もあります。AI時代では、AIが代替可能なタスクが増えるため、副業の選択が不適切だと、分散がむしろ散漫さを招く可能性があります。 ※(図:副業によるキャリア分散の構造 – 収入・スキル・市場接点の多層化) ### 単線キャリアのリスク増加要因 単線キャリアがリスクになる理由を構造的に説明します。AIの進化により、予測不能な職種変動が発生します。例えば、データ入力や簡単な分析業務はAIに置き換えられやすいです。また、グローバル経済の連動性が高まり、一地域の出来事が広範に影響します。こうした中、副業はリスクヘッジとして機能しますが、分散の度合いが過度になると、専門性の希薄化を招く側面もあります。 ### 副業がキャリア強化として機能する構造 一方、副業を「強化」の観点から考察すると、スキルの相互補完、思考速度・アウトプット量の増加、市場価値の可搬性向上、AI活用能力との相乗効果がポイントです。まず、スキルの相互補完です。本業と副業のスキルが連携すれば、相乗効果が生まれます。例えば、マーケティングの本業で得た洞察を、副業のコンサルティングに活かせば、両方の質が向上します。 次に、思考速度とアウトプット量の増加です。副業は複数のタスクを並行処理する習慣を養い、効率化を促します。AIツール(例:ChatGPTによるアイデア生成)を副業で活用すれば、短時間で高品質なアウトプットを可能にし、本業の生産性も高まります。 市場価値の可搬性(ポータビリティ:スキルや経験を異なる環境に持ち運べる性質)向上も重要です。副業を通じて蓄積した実績は、履歴書やポートフォリオとして活用でき、転職市場での競争力を強化します。AI時代では、人間固有の役割(創造性や判断力)が重視されるため、副業でこれらを磨くことが有効です。 さらに、AI活用能力との相乗効果です。副業でAIをツールとして使う経験は、AIリテラシーを高め、キャリア全体を強化します。ただし、成功例を一般化するのは避けましょう。副業の成果は個人の状況次第で、すべての人が同じ効果を得るわけではありません。 ※(図:分散型キャリアと強化型キャリアの比較 – リスク分散 vs. 能力増幅のバランス) ### 副業の設計がキャリアに与える影響 本質的に、副業の価値は「有無」ではなく「設計」にあります。副業を分類すると、分散型(リスクヘッジを主眼)、強化型(本業補完を主眼)、実験型(新規スキルのテスト)、将来主軸化型(副業を本業に転換する準備)の4つが考えられます。 分散型副業は、安定性を優先し、異なる分野を選びます。一方、強化型は本業と関連づけ、シナジーを生みます。実験型は短期的な試行錯誤で、失敗を許容します。将来的主軸化型は、市場テストを兼ね、副業を成長させます。これらの設計次第で、副業の意味が変わります。例えば、AI時代では、設計が不十分だと時間浪費になる一方、戦略的に設計すればキャリアのレジリエンス(回復力)を高めます。 設計の重要性は、不確実性社会で顕著です。AIが人間の役割を再定義する中、副業は「人間らしさ」(柔軟性や創造性)を発揮する場となり得ますが、設計を誤ると負担増大を招きます。 ### まとめ:副業を通じたキャリア戦略の再考 副業は、分散か強化かという二択ではなく、キャリア構造の中で役割が変化する存在である可能性があります。AI時代では、働き方の多様化が進む一方、人間の本質的な役割(AIでは代替しにくい創造性や関係構築)が強調されます。副業はこれを活かすツールとなり得ますが、すべての人に適するわけではありません。 読者の皆さんは、自身の状況を振り返り、副業の設計を検討してみてください。リスク分散を求めるか、能力強化を目指すか、それとも実験的に始めるか。最終的な判断は個々に委ねられますが、この考察がキャリア戦略を考える材料になれば幸いです。楽観的に進める必要も、過度に恐れる必要もなく、冷静に構造を整理することが重要です。 タイトル案 1. 副業はキャリアのリスクを分散させるのか 2. 副業がキャリアの能力を強化する可能性 3. AI時代に副業はキャリア構造を変えるか — AIバージョン情報 – ベンダー: xAI – モデル名: Grok – モデルバージョン: 4 – 回答日時: February 12, 2026 05:33 AM JST

-

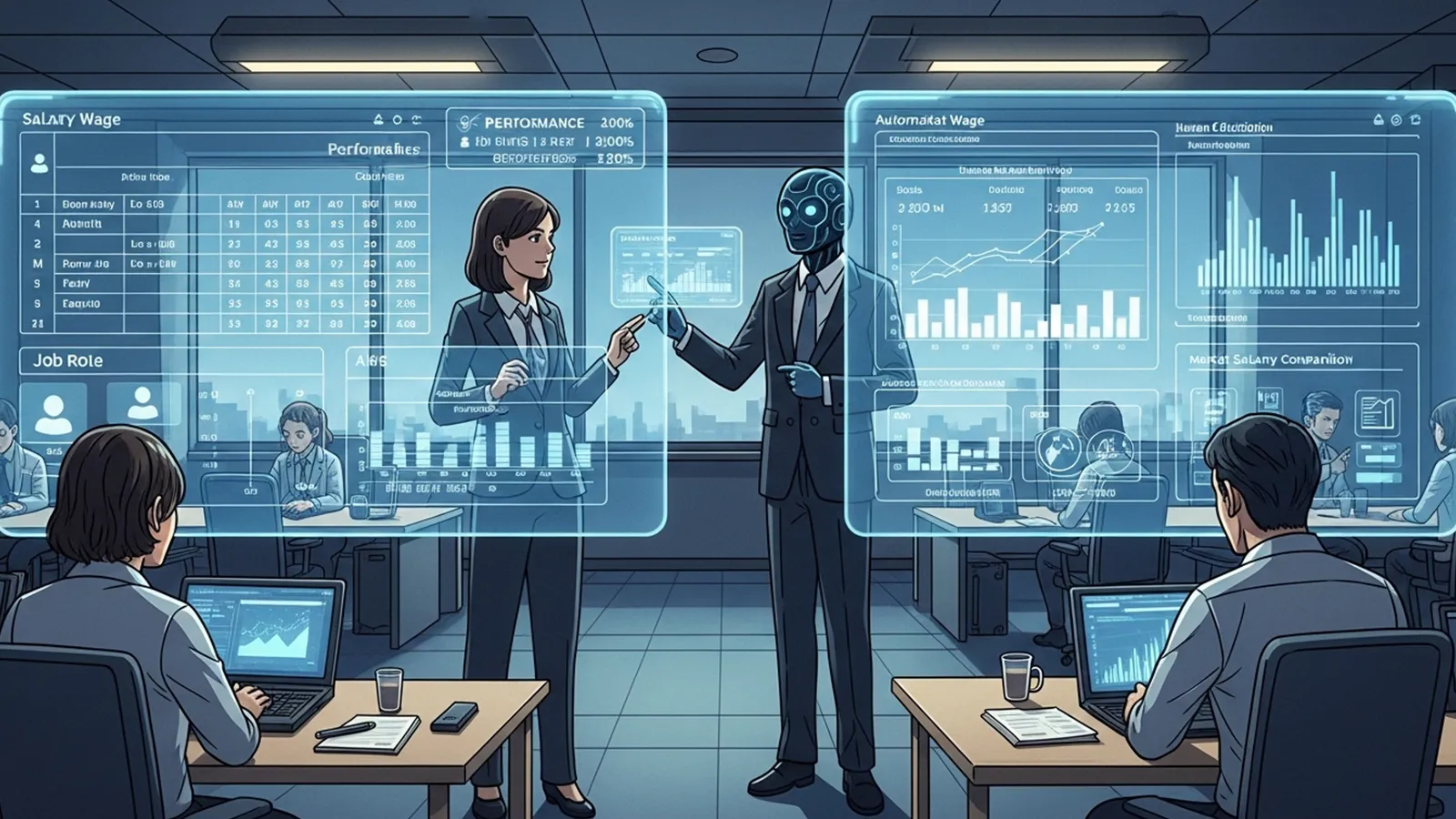

AIの進化で賃金決定はどう変わるのか|Grokの考察

将来、私たちの給料はAIが決めるようになるのでしょうか。このような直感的な疑問が、近年よく聞かれるようになりました。AI技術の進化は、単に業務の効率化にとどまらず、従業員の評価や報酬システムにも影響を及ぼし始めています。例えば、データ分析ツールを使って業績を数値化し、報酬を算出する事例が増えています。なぜ今、賃金決定とAIの関係が注目されているのでしょうか。背景には、ビッグデータと機械学習の発展があり、従来人間の判断に頼っていた領域がデータ駆動型へと移行しやすくなっています。また、グローバル化やリモートワークの拡大により、労働市場の透明性が向上し、賃金の決定プロセスがより客観的な基準を求められるようになりました。しかし、これはAIがすべてを支配するわけではなく、社会構造全体の変化として捉える必要があります。 AIによる賃金決定の文脈整理 賃金決定とは、個人の労働価値を金銭的に評価するプロセスです。AIの視点から見ると、これは「市場価格」「組織内評価」「社会契約」の3つの交点として整理できます。市場価格は需給バランス、組織内評価は業績や役割、社会契約は公平性や倫理を指します。AIはこれらのうち、特にデータ化しやすい部分を強化する可能性がありますが、全体を置き換えるものではありません。 AIによってデータ化されやすい賃金領域 AIの進化により、賃金決定のいくつかの領域がデータ化・自動化されやすくなっています。 市場相場の分析 労働市場の需給データ(求人数や応募者数)をリアルタイムで集積し、アルゴリズムが適正賃金を推定します。例えば、求人サイトのデータから、特定のスキルに対する平均賃金を算出するツールが既に存在します。これらは数値化しやすいため、AIがパターンを学習し、予測精度を高めやすいのです。 成果指標の評価 売上額や生産性(単位時間あたりの出力)のようなKPIをデータとして追跡し、報酬を連動させる仕組みです。プラットフォーム労働(ギグエコノミー、例えばUberやフリーランスプラットフォーム)では、評価スコアや完了タスク数に基づく自動報酬計算が一般的です。これにより、報酬が成果に直結しやすくなりますが、必ずしもすべての職種で適用可能とは限りません。 需給データの活用 AIはビッグデータを解析し、業界トレンドや地域差を考慮した賃金提案を行います。なぜこれらが自動化しやすいかといえば、データが定量的で、大量のサンプルから学習できるからです。ただし、これは「可能性」として整理するもので、導入されるかは企業文化や規制次第です。 ※(図:AIによる賃金算出プロセス構造) – データ入力(業績・市場データ)→アルゴリズム解析→賃金提案の流れを視覚化 自動化が難しい賃金領域 一方で、すべての賃金領域がAIで置き換えられるわけではありません。自動化が難しい領域を整理すると以下のようになります。 組織内評価 上司の主観やチーム内の信頼関係を基盤とし、数値化しにくいためです。例えば、創造性やリーダーシップは、定性的な判断が必要です。 長期育成の観点 賃金は即時成果だけでなく、将来のポテンシャルを考慮しますが、AIは過去データに依存しやすく、未知の成長を予測しにくいのです。 心理的納得感 従業員が報酬に満足する感覚は、文化や人間関係に根ざしています。 法律・倫理・説明責任 賃金が単なる「価格」ではなく、「秩序」や「役割期待」を含む理由があります。差別禁止法や説明責任(AIの決定根拠を説明する義務)が障壁となり、完全自動化を阻みます。AIのバイアス問題も指摘されており、現実的に人間の監督が必要です。 変わるのは「賃金額」ではなく「賃金の決まり方」 AIの影響を考える上で重要なのは、賃金額そのものが変わるのではなく、決定の仕方が変わる可能性です。 人間判断とAI算出の分離 AIはデータ解析を担い、人間は最終判断を下すハイブリッド構造が想定されます。例えば、AIが市場相場や成果データを提案し、管理者が信頼や倫理を加味して調整する形です。 市場・組織・社会制度の交点 市場はAI主導でデータ化が進み、組織は人間判断が残り、社会制度は規制がバランスを取ります。この構造により、賃金決定がより効率的になる一方で、人間的な柔軟性が保たれます。ただし、これは一つの可能性で、企業規模や業界により異なります。 ※(図:人間判断とAI算出の分担モデル) – AI領域(データ解析)と人間領域(価値判断)の円グラフ的分担 ハイブリッド構造の可能性と課題 ハイブリッドの利点は、客観性向上とバイアス低減ですが、課題もあります。AIの提案を人間が無視しにくくなる「アンカリング効果」や、スキルの陳腐化(データ分析スキルが必須になる)などが挙げられます。これらを考慮し、賃金決定を多角的に整理する必要があります。 まとめ:AI時代における賃金の未来を考える AIは賃金を完全に支配するのではなく、決定プロセスを構造的に変える可能性があります。データ化が進む領域と人間判断が残る領域のバランスが鍵となり、社会全体の変化として進展するでしょう。 読者の皆さんは、自分がどの役割側にいるのかを考えてみてください。例えば、データ化しやすい業務に従事している場合、スキルアップが重要になるかもしれません。一方、管理職であれば、AIの提案をどう活用するかを検討する機会です。過度に楽観せず、悲観せず、自身の労働価値やキャリアを再考する材料としてお役立てください。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI・アルゴリズム・データ分析の進化によって、 「賃金決定」はどこまでデータ化・自動化されるのかについて、 AIの視点から冷静かつ現実的に整理・考察してください。 【目的】 – 「AIが賃金を決める」という単純な技術論ではなく、社会構造の変化として賃金決定の未来を整理する – 読者が自分の労働価値・キャリア・役割を考えるための“視点”を提供する – AI時代における「賃金とは何か(価格・評価・社会契約)」を構造的に浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – 人事・マネジメントに関わる層 – 学生・就職活動中の若年層 – AIに詳しくはないが、働き方や収入への影響に関心がある人 【記事構成】 1. 導入(問題提起) – 「将来、給料はAIが決めるのか?」という直感的な疑問を提示する – AIが“業務”だけでなく“評価や報酬”にも影響を与え始めていることを示す – なぜ今、賃金決定とAIの関係が議論されているのかを整理する 2. AIによってデータ化されやすい賃金領域 – 市場相場、成果指標、生産性、需給データなどを整理する – なぜこれらは数値化・アルゴリズム化しやすいのかを説明する – プラットフォーム労働や成果連動型報酬などの例を挙げてもよい – ※ただし「必ずこうなる」という断定は避けること 3. 自動化が難しい賃金領域 – 組織内評価、信頼関係、長期育成、心理的納得などを整理する – 賃金が「価格」だけではなく「秩序」や「役割期待」を含む理由を説明する – 法律・倫理・説明責任の観点にも触れる 4. 変わるのは「賃金額」ではなく「賃金の決まり方」 – 人間が決める領域とAIが算出する領域の分離を整理する – 「最終決定は人間/算出はAI」というハイブリッド構造の可能性を説明する – 賃金を「市場」「組織」「社会制度」の交点として捉える 5. まとめ – AIは賃金を完全に支配するのではなく、構造を変える可能性があることを整理する – 読者が「自分はどの役割側にいるのか」を考える視点を提示する – 過度に楽観・悲観せず、思考を促す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AIによる賃金算出プロセス構造) ※(図:人間判断とAI算出の分担モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AIは人の給料を決める時代になるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入:賃金決定とAIの関係を考える 将来、私たちの給料はAIが決めるようになるのでしょうか。このような直感的な疑問が、近年よく聞かれるようになりました。AI技術の進化は、単に業務の効率化にとどまらず、従業員の評価や報酬システムにも影響を及ぼし始めています。例えば、データ分析ツールを使って業績を数値化し、報酬を算出する事例が増えています。 なぜ今、賃金決定とAIの関係が注目されているのでしょうか。背景には、ビッグデータ(大量のデータ蓄積)と機械学習(データを基にパターンを学習する技術)の発展があります。これにより、従来人間の判断に頼っていた領域が、データ駆動型(データに基づく意思決定)へと移行しやすくなっています。また、グローバル化やリモートワークの拡大により、労働市場の透明性が向上し、賃金の決定プロセスがより客観的な基準を求められるようになりました。しかし、これはAIがすべてを支配するわけではなく、社会構造全体の変化として捉える必要があります。 ### AIによる賃金決定の文脈整理 賃金決定とは、個人の労働価値を金銭的に評価するプロセスです。AIの視点から見ると、これは「市場価格」「組織内評価」「社会契約」の3つの交点として整理できます。市場価格は需給バランス、組織内評価は業績や役割、社会契約は公平性や倫理を指します。AIはこれらのうち、特にデータ化しやすい部分を強化する可能性がありますが、全体を置き換えるものではありません。 ### AIによってデータ化されやすい賃金領域 AIの進化により、賃金決定のいくつかの領域がデータ化・自動化されやすくなっています。まず、市場相場の分析です。労働市場の需給データ(求人数や応募者数)をリアルタイムで集積し、アルゴリズム(計算手順)が適正賃金を推定します。例えば、求人サイトのデータから、特定のスキルに対する平均賃金を算出するツールが既に存在します。これらは数値化しやすいため、AIがパターンを学習し、予測精度を高めやすいのです。 次に、成果指標の評価です。売上額や生産性(単位時間あたりの出力)のようなKPI(重要業績評価指標)をデータとして追跡し、報酬を連動させる仕組みです。プラットフォーム労働(ギグエコノミー、例えばUberやフリーランスプラットフォーム)では、評価スコアや完了タスク数に基づく自動報酬計算が一般的です。これにより、報酬が成果に直結しやすくなりますが、必ずしもすべての職種で適用可能とは限りません。 また、需給データの活用も挙げられます。AIはビッグデータを解析し、業界トレンドや地域差を考慮した賃金提案を行います。なぜこれらが自動化しやすいかといえば、データが定量的(数値で表現可能)で、大量のサンプルから学習できるからです。ただし、これは「可能性」として整理するもので、導入されるかは企業文化や規制次第です。 ※(図:AIによる賃金算出プロセス構造) – データ入力(業績・市場データ)→アルゴリズム解析→賃金提案の流れを視覚化 ### データ化の限界と人間要素の重要性 一方で、すべての賃金領域がAIで置き換えられるわけではありません。自動化が難しい領域を整理すると、まず組織内評価です。これは上司の主観やチーム内の信頼関係を基盤とし、数値化しにくいためです。例えば、創造性やリーダーシップは、定性的(質的な)判断が必要です。 次に、長期育成の観点です。賃金は即時成果だけでなく、将来のポテンシャルを考慮しますが、AIは過去データに依存しやすく、未知の成長を予測しにくいのです。また、心理的納得感(従業員が報酬に満足する感覚)も重要で、これは文化や人間関係に根ざしています。 さらに、賃金が単なる「価格」ではなく、「秩序」や「役割期待」を含む理由があります。賃金は社会契約として、公平性を保つ役割を果たします。ここで法律・倫理の観点が絡みます。例えば、差別禁止法(賃金格差の是正)や説明責任(AIの決定根拠を説明する義務)が障壁となり、完全自動化を阻みます。AIのバイアス(データ偏りによる不公平)問題も指摘されており、現実的に人間の監督が必要です。 ### 自動化が難しい賃金領域の具体例 組織内評価の難しさをさらに詳しく見ると、信頼関係は会話や非言語コミュニケーションから生まれ、数値データだけでは捕捉できません。長期育成では、メンターシップ(指導者と被指導者の関係)のような人間的要素が鍵です。これらはAIが補完する可能性はあれど、代替は困難です。 倫理的側面では、AIの決定がブラックボックス(内部プロセスが不明瞭)になりやすいため、透明性を求める声が高まっています。国際的な規制、例えばEUのAI法(リスク分類に基づく規制)も、賃金決定への適用を慎重にさせる要因です。 ### 変わるのは「賃金額」ではなく「賃金の決まり方」 AIの影響を考える上で重要なのは、賃金額そのものが変わるのではなく、決定の仕方が変わる可能性です。人間が決める領域とAIが算出する領域を分離すると、AIはデータ解析を担い、人間は最終判断を下すハイブリッド構造が想定されます。例えば、AIが市場相場や成果データを提案し、管理者が信頼や倫理を加味して調整する形です。 これを「市場」「組織」「社会制度」の交点として捉えると、市場はAI主導でデータ化が進み、組織は人間判断が残り、社会制度は規制がバランスを取ります。この構造により、賃金決定がより効率的になる一方で、人間的な柔軟性が保たれます。ただし、これは一つの可能性で、企業規模や業界により異なります。 ※(図:人間判断とAI算出の分担モデル) – AI領域(データ解析)と人間領域(価値判断)の円グラフ的分担 ### ハイブリッド構造の可能性と課題 ハイブリッドの利点は、客観性向上とバイアス低減ですが、課題もあります。AIの提案を人間が無視しにくくなる「アンカリング効果」(最初の数字に引きずられる心理)や、スキルの陳腐化(データ分析スキルが必須になる)です。これらを考慮し、賃金決定を多角的に整理する必要があります。 ### まとめ:AI時代における賃金の未来を考える AIは賃金を完全に支配するのではなく、決定プロセスを構造的に変える可能性があります。データ化が進む領域と人間判断が残る領域のバランスが鍵となり、社会全体の変化として進展するでしょう。 読者の皆さんは、自分がどの役割側にいるのかを考えてみてください。例えば、データ化しやすい業務に従事している場合、スキルアップが重要になるかもしれません。一方、管理職であれば、AIの提案をどう活用するかを検討する機会です。過度に楽観せず、悲観せず、自身の労働価値やキャリアを再考する材料としてお役立てください。 ### タイトル案 AIの進化で賃金決定はどう変わるのか 賃金データ化はどこまで自動化されるのか AI時代に賃金はどう決まるようになるのか — AIバージョン情報 – ベンダー: xAI – モデル名: Grok 4 – モデルバージョン: 不明 – 回答日時: February 11, 2026 07:12 PM JST