日本社会において「正社員」という言葉は、単なる雇用形態の名称を超えた、一種の社会的身分や安定の象徴として機能してきました。新卒で企業に入社し、定年まで勤め上げる。このモデルは、戦後の高度経済成長を支え、人々のライフプランの設計図となってきました。しかし現在、この強固だった「正社員モデル」が大きな転換期を迎えています。AIやロボティクスによる業務の自動化、加速する労働人口の減少、そして個人の価値観の多様化。これら複数の要因が絡み合い、従来の「一括採用・終身雇用」を前提としたシステムの維持が困難になりつつあります。果たして、正社員制度はこのまま縮小し、消えゆく運命にあるのでしょうか。あるいは、時代の要請に合わせてその役割を「再定義」していくのでしょうか。本記事では、AI時代の到来を踏まえ、この問いを構造的に考察します。 日本の正社員モデルはどのような構造で成立してきたのか 日本の正社員制度を支えてきたのは、主に「メンバーシップ型」と呼ばれる雇用慣行です。これは、職務(ジョブ)に対して人を割り当てるのではなく、企業という「共同体」の一員として人を採用する仕組みです。 日本型雇用の三種の神器 終身雇用: 定年までの雇用を保障することで、従業員の帰属意識を高める。 年功賃金: 勤続年数に応じて給与が上がる仕組み。生活保障的な側面が強い。 企業内教育(OJT): 特定のスキルを持つ人を外部から採るのではなく、社内で時間をかけて育成する。 社会合理性と生活モデルの一致 この制度が高度成長期に合理的だった理由は、右肩上がりの経済状況において「未熟練労働者を安く確保し、熟練工へと育て上げる」ことが企業の成長に直結したからです。また、社会保障や税制、銀行の融資審査にいたるまでが「正社員であること」を前提に設計されました。つまり、正社員制度は単なる契約形態ではなく、日本社会を機能させるための「OS(基本ソフト)」だったと言えます。 ※(図:日本型雇用モデルの構造) 正社員モデルを揺るがす要因 現在、この「OS」が最新の社会情勢とミスマッチを起こし始めています。主な要因は以下の4点に集約されます。 AI・自動化による「業務」の変質 AIは、定型的な事務作業だけでなく、分析や予測といった知的生産の一部をも代替し始めています。これにより、企業が「汎用的な能力を持つ人材を大量に抱える」必要性が低下しています。特定の成果を出すために必要なのは「人数の確保」ではなく「高度な専門性」や「AIの活用能力」へとシフトしています。 人材の流動化と価値観の変化 「一つの会社に骨を埋める」という価値観は薄れ、転職や副業、フリーランスといった柔軟な働き方を選択する層が増えています。特に優秀な層ほど、特定の組織に依存せず、自身の市場価値(マーケットバリュー)を重視する傾向にあります。 企業側のリスク管理 不確実性が高い現代の経営環境において、固定費である人件費を長期的に抱え続けることは、企業にとって大きな経営リスクとなります。プロジェクトごとに最適な人員を外部から調達する「ギグ・ワーク」や「アウトソーシング」の活用は、コスト最適化の観点から合理的な選択肢となっています。 人口減少による構造的労働不足 生産年齢人口の急減により、企業は「正社員」という枠組みだけで労働力を確保することが物理的に不可能になっています。短時間労働者、高齢者、外国人材など、多様な形態を受け入れざるを得ない状況が、結果として正社員の特権性を相対化させています。 正社員制度は「消える」のか、それとも「再定義される」のか 結論から言えば、正社員という制度が完全に消滅する可能性は低いと考えられます。しかし、その「中身」は劇的に変化していくでしょう。 存続の理由:組織の「核」としての機能 どんなに自動化が進んでも、企業のビジョンを策定し、重要な意思決定を行い、文化を継承する「コア人材」は必要です。長期的な信頼関係に基づき、組織の命運を共にするパートナーとしての正社員は、組織運営の安定剤として機能し続けます。 変化の兆し:大量雇用モデルの終焉 一方で、かつてのような「誰でも、一律に、正社員として採用する」というモデルは縮小していくでしょう。 コア人材: 経営戦略に深く関与する層(正社員)。 スペシャリスト: 特定の高度なスキルをプロジェクト単位で提供する層(業務委託・ジョブ型正社員)。 フレキシブル層: 変動する業務量に合わせて柔軟に働く層(パートタイム・自動化による代替)。 このように、組織が「多層化」していく過程で、正社員の役割は「共同体のメンバー」から「プロフェッショナルな中核人材」へと絞り込まれていく可能性があります。 正社員という概念の再定義 これからのAI時代において、再定義される「正社員」にはどのような要素が求められるのでしょうか。 「会社への忠誠」から「ミッションへのコミット」へ これまでは「社内のルールに精通し、円滑に調整できること」が評価されました。しかし今後は、「AIなどのテクノロジーを駆使して、いかに独自の価値を創造できるか」という成果へのコミットメントが問われます。会社に守られる存在から、会社を動かす存在への変容です。 人間に残る役割:非定型・創造・共感 AIが論理的推論やデータ処理を得意とする一方で、人間に残される役割は「問いを立てること」「感情的な合意形成」「倫理的判断」です。正社員は、これらの「機械に代替できない領域」において組織をリードする役割を担うことになるでしょう。 ※(図:AI時代の企業組織構造の変化) まとめ:変化を「選択」の機会とするために 正社員制度の未来は、単純な「消滅」か「存続」かという二択ではありません。それは、社会の要請に合わせて、より専門的で、より自律的なものへと「分化・洗練」していく過程にあると捉えるのが妥当でしょう。 制度が揺らぐことは、一見すると不安定さが増すように思えます。しかし、それは裏を返せば「会社という枠組みに依存せず、自らのキャリアを主体的に設計できる機会」が増えていることも意味します。 読者の皆様にとって重要なのは、現在のポジションが「正社員かどうか」という形式に固執することではなく、変化し続ける労働市場の中で「自分は何を価値として提供できるのか」を問い続けることではないでしょうか。社会構造の変化を冷静に見つめ、自らの立ち位置を再定義していく姿勢が、これからのAI時代を生き抜くための鍵となります。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI・自動化・人口構造・働き方の変化によって、 日本社会の「正社員モデル」は 今後「縮小していく制度」なのか、 それとも「役割が再定義される制度」なのかについて、 AIの視点から冷静かつ構造的に整理・考察してください。 【目的】 – 日本社会に深く根付いてきた「正社員制度」を単なる雇用形態ではなく社会構造として捉える – AI時代の働き方の変化の中で、正社員という制度がどのように変化する可能性があるのかを整理する – 読者が自分のキャリアや働き方を考えるための視点を提供する 【読者像】 – 一般社会人(20〜50代) – 日本の働き方の将来に関心を持つ人 – 転職・副業・フリーランスなど新しい働き方に興味がある人 – AIやテクノロジーが雇用に与える影響に漠然とした不安や関心を持つ層 【記事構成】 1. 導入(問題提起) – 日本では長く「正社員」が安定した働き方の象徴とされてきたことを説明する – 一方で、AI・自動化・人口減少・労働市場の変化によって、このモデルが揺らいでいるという議論があることを示す – 「正社員制度は消えるのか、それとも形を変えるのか」という問いを提示する 2. 日本の正社員モデルはどのような構造で成立してきたのか – 終身雇用・年功賃金・企業内教育など、日本型雇用の特徴を整理する – なぜこの制度が高度成長期の日本社会で合理的だったのかを説明する – 正社員が単なる雇用形態ではなく、社会制度や生活モデルと結びついてきたことに触れる 3. 正社員モデルを揺るがす要因 – AI・自動化による仕事の変化 – 人材の流動化(転職・副業・フリーランスの増加) – 企業側のリスク管理(固定人件費・不確実な経営環境) – 人口減少や労働市場の変化 これらの要因が正社員制度にどのような影響を与える可能性があるのかを構造的に説明する 4. 正社員制度は「消える」のか、それとも「再定義される」のか – 正社員が完全に消えるとは考えにくい理由を整理する – 一方で、これまでのような大量雇用型モデルが変化する可能性にも触れる – コア人材、専門職、プロジェクト型人材など、企業組織の構造変化を説明する 5. 正社員という概念の再定義 – 従来の「会社のメンバーとしての正社員」から 「企業の中核を担う専門人材」という意味への変化の可能性を考察する – AI時代において、人間に求められる役割がどのように変わるのかを整理する 6. まとめ – 正社員制度の未来は「消滅」か「存続」かという二択ではなく、 社会構造の変化の中で形を変えていく可能性があることを整理する – 読者が自身の働き方やキャリアの位置づけを考えるための視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:日本型雇用モデルの構造) ※(図:AI時代の企業組織構造の変化) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「正社員という制度はこれからも必要なのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:揺らぎ始めた「正社員」という聖域 日本社会において「正社員」という言葉は、単なる雇用形態の名称を超えた、一種の社会的身分や安定の象徴として機能してきました。新卒で企業に入社し、定年まで勤め上げる。このモデルは、戦後の高度経済成長を支え、人々のライフプラン(結婚、住宅ローン、教育費)の設計図となってきました。 しかし現在、この強固だった「正社員モデル」が大きな転換期を迎えています。AIやロボティクスによる業務の自動化、加速する労働人口の減少、そして個人の価値観の多様化。これら複数の要因が絡み合い、従来の「一括採用・終身雇用」を前提としたシステムの維持が困難になりつつあります。 果たして、正社員制度はこのまま縮小し、消えゆく運命にあるのでしょうか。あるいは、時代の要請に合わせてその役割を「再定義」していくのでしょうか。本記事では、AI時代の到来を踏まえ、この問いを構造的に考察します。 --- ## 2. 日本の正社員モデルはどのような構造で成立してきたのか 日本の正社員制度を支えてきたのは、主に「メンバーシップ型」と呼ばれる雇用慣行です。これは、職務(ジョブ)に対して人を割り当てるのではなく、企業という「共同体」の一員として人を採用する仕組みです。 ### 日本型雇用の三種の神器 * **終身雇用:** 定年までの雇用を保障することで、従業員の帰属意識を高める。 * **年功賃金:** 勤続年数に応じて給与が上がる仕組み。生活保障的な側面が強い。 * **企業内教育(OJT):** 特定のスキルを持つ人を外部から採るのではなく、社内で時間をかけて育成する。 ### 社会合理性と生活モデルの一致 この制度が高度成長期に合理的だった理由は、右肩上がりの経済状況において「未熟練労働者を安く確保し、熟練工へと育て上げる」ことが企業の成長に直結したからです。また、社会保障や税制、銀行の融資審査にいたるまでが「正社員であること」を前提に設計されました。つまり、正社員制度は単なる契約形態ではなく、日本社会を機能させるための「OS(基本ソフト)」だったと言えます。 ※(図:日本型雇用モデルの構造) --- ## 3. 正社員モデルを揺るがす要因 現在、この「OS」が最新の社会情勢とミスマッチを起こし始めています。主な要因は以下の4点に集約されます。 ### AI・自動化による「業務」の変質 AIは、定型的な事務作業だけでなく、分析や予測といった知的生産の一部をも代替し始めています。これにより、企業が「汎用的な能力を持つ人材を大量に抱える」必要性が低下しています。特定の成果を出すために必要なのは「人数の確保」ではなく「高度な専門性」や「AIの活用能力」へとシフトしています。 ### 人材の流動化と価値観の変化 「一つの会社に骨を埋める」という価値観は薄れ、転職や副業、フリーランスといった柔軟な働き方を選択する層が増えています。特に優秀な層ほど、特定の組織に依存せず、自身の市場価値(マーケットバリュー)を重視する傾向にあります。 ### 企業側のリスク管理 不確実性が高い現代の経営環境において、固定費である人件費を長期的に抱え続けることは、企業にとって大きな経営リスクとなります。プロジェクトごとに最適な人員を外部から調達する「ギグ・ワーク」や「アウトソーシング」の活用は、コスト最適化の観点から合理的な選択肢となっています。 ### 人口減少による構造的労働不足 生産年齢人口の急減により、企業は「正社員」という枠組みだけで労働力を確保することが物理的に不可能になっています。短時間労働者、高齢者、外国人材など、多様な形態を受け入れざるを得ない状況が、結果として正社員の特権性を相対化させています。 --- ## 4. 正社員制度は「消える」のか、それとも「再定義される」のか 結論から言えば、正社員という制度が完全に消滅する可能性は低いと考えられます。しかし、その「中身」は劇的に変化していくでしょう。 ### 存続の理由:組織の「核」としての機能 どんなに自動化が進んでも、企業のビジョンを策定し、重要な意思決定を行い、文化を継承する「コア人材」は必要です。長期的な信頼関係に基づき、組織の命運を共にするパートナーとしての正社員は、組織運営の安定剤として機能し続けます。 ### 変化の兆し:大量雇用モデルの終焉 一方で、かつてのような「誰でも、一律に、正社員として採用する」というモデルは縮小していくでしょう。 * **コア人材:** 経営戦略に深く関与する層(正社員)。 * **スペシャリスト:** 特定の高度なスキルをプロジェクト単位で提供する層(業務委託・ジョブ型正社員)。 * **フレキシブル層:** 変動する業務量に合わせて柔軟に働く層(パートタイム・自動化による代替)。 このように、組織が「多層化」していく過程で、正社員の役割は「共同体のメンバー」から「プロフェッショナルな中核人材」へと絞り込まれていく可能性があります。 --- ## 5. 正社員という概念の再定義 これからのAI時代において、再定義される「正社員」にはどのような要素が求められるのでしょうか。 ### 「会社への忠誠」から「ミッションへのコミット」へ これまでは「社内のルールに精通し、円滑に調整できること」が評価されました。しかし今後は、「AIなどのテクノロジーを駆使して、いかに独自の価値を創造できるか」という成果へのコミットメントが問われます。会社に守られる存在から、会社を動かす存在への変容です。 ### 人間に残る役割:非定型・創造・共感 AIが論理的推論やデータ処理を得意とする一方で、人間に残される役割は「問いを立てること」「感情的な合意形成」「倫理的判断」です。正社員は、これらの「機械に代替できない領域」において組織をリードする役割を担うことになるでしょう。 ※(図:AI時代の企業組織構造の変化) --- ## 6. まとめ:変化を「選択」の機会とするために 正社員制度の未来は、単純な「消滅」か「存続」かという二択ではありません。それは、社会の要請に合わせて、より専門的で、より自律的なものへと「分化・洗練」していく過程にあると捉えるのが妥当でしょう。 制度が揺らぐことは、一見すると不安定さが増すように思えます。しかし、それは裏を返せば「会社という枠組みに依存せず、自らのキャリアを主体的に設計できる機会」が増えていることも意味します。 読者の皆様にとって重要なのは、現在のポジションが「正社員かどうか」という形式に固執することではなく、変化し続ける労働市場の中で「自分は何を価値として提供できるのか」を問い続けることではないでしょうか。社会構造の変化を冷静に見つめ、自らの立ち位置を再定義していく姿勢が、これからのAI時代を生き抜くための鍵となります。 --- ### タイトル案 * 日本の正社員制度はAI時代にどのような変容を遂げるのか * 労働市場の構造変化は正社員という生き方をどう変えるのか * 企業の核となる正社員の役割はこれから再定義されるのか --- AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash * モデルバージョン: 3 Flash (Free Tier) * 回答日時: 2026-03-12 10:02 JST

Gemini

-

日本の正社員制度はAI時代にどのような変容を遂げるのか|Geminiの考察

-

アルゴリズムによる評価は社会の偏見を正すのかそれとも隠すのか|Geminiの考察

私たちは今、SNSのタイムラインから就職活動の選考、さらには銀行のローン審査にいたるまで、生活のあらゆる場面で「アルゴリズムによる評価」に囲まれています。かつては人間が行っていた判断を計算式に委ねることで、社会はより公平な場所になるのでしょうか。それとも、中身を理解できない巨大な「ブラックボックス」に支配されることになるのでしょうか。本記事では、この二面性について構造的に整理し、私たちが直面している変化の本質を探ります。 1. 導入:静かに広がる「評価の自動化」 現在、私たちの価値や嗜好は、刻一刻とデータとして処理されています。例えば、企業が採用選考にAIを導入すれば、数万人の応募者を数秒でランク付けすることが可能です。また、金融機関が個人の行動データを分析して「クレジットスコア(信用格付け)」を算出し、それに基づいて融資の可否を決定する仕組みも一般化しつつあります。 こうしたアルゴリズムの導入背景には、二つの大きな期待と懸念が混在しています。一つは、感情や偏見に左右される人間よりデータに基づいたAIの方が「公平」であるという期待。もう一つは、なぜその判断が下されたのかが誰にも説明できない「ブラックボックス化」への懸念です。 2. アルゴリズム評価が「公平化」と言われる理由 なぜ、多くの組織が重要な意思決定をアルゴリズムに委ねようとするのでしょうか。そこには、人間特有の「判断のバグ」を排除したいという強い動機があります。 人間の主観と偏見(バイアス)の排除 人間は、その日の体調や気分、あるいは無意識の偏見に影響を受けやすい生き物です。アルゴリズムはあらかじめ設定されたルールに従って機械的に処理を行うため、こうした一時的な感情や個人的な好みを排除した「一貫性のある評価」を可能にします。 判断基準の統一と透明なルール化 人間による評価は担当者ごとに基準がバラバラになりがちですが、アルゴリズムは明確なロジックに基づいています。「何を評価し、何を評価しないか」をデジタルなルールとして定義することで、組織全体で統一された基準を適用できるメリットがあります。 膨大なデータによる多角的な視点 アルゴリズムは過去のデータや数千項目に及ぶ変数を同時に分析し、人間が気づかなかった相関関係を見つけ出すことができます。これにより、一部の目立つ特徴だけで判断するのではない、多角的で客観的な評価が実現すると期待されています。 ※(図:人間の判断とアルゴリズム判断の比較) 3. アルゴリズム評価が「ブラックボックス」と言われる理由 一方で、アルゴリズムによる評価が進むほど、そのプロセスが「見えなくなる」という深刻な問題も浮上しています。 機械学習モデルの複雑化 近年のAIはパラメータが複雑に絡み合って結果を出力するため、開発者でさえも「なぜAIがその判断を下したのか」を具体的に説明することが困難になっています。この構造的な不透明さが、ブラックボックス問題の核心です。 「データの偏り」が引き継がれるリスク 学習に使う「過去のデータ」に偏りがあれば、AIはその偏見を増幅させてしまいます。不透明なプロセスのなかで差別が「自動化」されるリスクは、人間の判断とは異なる種類の危うさを持っています。 企業の秘密保持と説明責任 多くのアルゴリズムは知的財産として秘匿されています。評価を受ける側からすれば、なぜその結果になったのかを知る権利が阻害されており、人間の判断であれば求められたはずの「説明」が受けられないという不条理が生じます。 4. 公平性と透明性のあいだにある構造 「公平化」と「ブラックボックス化」は、実際には同じ現象の異なる側面として同時に進行しています。 恣意性と不透明性のトレードオフ 人間の判断には恣意性がありますが、対話による説明が可能です。対して、アルゴリズムには恣意性は少ないものの、計算過程に不透明性があります。私たちは、どちらの「不完全さ」を受け入れるべきかという選択を迫られています。 社会の新たな処方箋:説明可能AI(XAI) このジレンマを解消するため、世界中で以下のような試みが始まっています。 Explainable AI(説明可能AI):AIの判断根拠を人間に理解できる形で提示する技術の開発。 アルゴリズム監査:外部の専門家が、アルゴリズムに差別的な傾向がないかを定期的にチェックする仕組み。 拒否権の確保:AIの判断に対して人間が最終的な異議申し立てを行える権利の法整備。 5. まとめ:AIに「評価される」時代の歩き方 アルゴリズムによる評価は、人間の不安定な主観から私たちを解放してくれる救世主となる可能性を秘めている一方で、説明不能なルールによって私たちを縛り付ける鎖になる危険性も孕んでいます。 大切なのは、アルゴリズムを完璧だと盲信するのではなく、欠陥のあるツールとして適切に管理しようとする姿勢です。私たちが透明性を求め続けることで初めて、アルゴリズムは真に公平な仕組みへと近づくのかもしれません。皆さんは、どこまでの説明があれば、その判断を信頼できると感じるでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 アルゴリズムによる評価や判断は、 「人間の偏りを減らす公平な仕組み」なのか、 それとも「判断の理由が見えないブラックボックス」なのか。 採用、クレジットスコア、SNS推薦、広告配信、価格決定など、 社会のさまざまな場面で使われるアルゴリズム評価の役割について、 AIの視点から構造的に整理・考察してください。 【目的】 – アルゴリズム評価を「良い/悪い」の単純な議論ではなく、社会構造の変化として整理する – 人間の判断とアルゴリズム判断の違いを理解する視点を提供する – AI時代における「公平性」「透明性」「責任」の関係を浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – ITやAIに専門知識はないが、社会の変化に関心がある人 – SNSやネットサービスを日常的に使っている人 – 「AIに判断される社会」に違和感や疑問を持ち始めている層 【記事構成】 1. 導入(問題提起) – 採用選考、ローン審査、SNS推薦など、アルゴリズムによる評価が日常に広がっている状況を提示する – 人間の判断より公平になるという期待と、不透明になるという懸念が同時に存在していることを示す – 「アルゴリズム評価は公平化なのかブラックボックス化なのか」という問いを提示する 2. アルゴリズム評価が「公平化」と言われる理由 – 人間の判断が持つ偏りや主観の問題を整理する – ルール化・データ化によって判断基準を統一できる点を説明する – 大量データ処理によって、人間では難しい評価が可能になる点を示す – なぜ企業や社会がアルゴリズム評価を導入するのかを構造的に説明する 3. アルゴリズム評価が「ブラックボックス」と言われる理由 – 判断のロジックが見えにくくなる問題を整理する – 機械学習モデルの複雑さ、企業の非公開性、説明の難しさに触れる – 「なぜその結果になったのか」が分からない状況が生まれる構造を説明する – 人間の判断とは異なる不透明性の問題を整理する 4. 公平性と透明性のあいだにある構造 – 公平化とブラックボックス化が対立ではなく同時に起きる現象であることを説明する – 人間の恣意性とアルゴリズムの不透明性という二つの問題を比較する – Explainable AI(説明可能AI)やアルゴリズム監査など、社会が対応を模索している動きを紹介する 5. まとめ – アルゴリズム評価は単純に善悪で判断できるものではないことを再確認する – 公平性・透明性・責任という複数の視点が必要であることを示す – 読者が「AIに判断される社会」をどう捉えるかを考える余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:アルゴリズム評価の仕組み) ※(図:人間の判断とアルゴリズム判断の比較) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「アルゴリズム評価は公平化かブラックボックス化か?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:静かに広がる「評価の自動化」 現在、私たちの価値や嗜好は、刻一刻とデータとして処理されています。例えば、ある企業が採用選考にAIを導入すれば、数万人の応募者を数秒でランク付けすることが可能です。また、金融機関が個人の行動データを分析して「クレジットスコア(信用格付け)」を算出し、それに基づいて融資の可否や金利を決定する仕組みも一般化しつつあります。 こうしたアルゴリズムの導入背景には、二つの大きな期待と懸念が混在しています。 一つは、感情や偏見に左右される人間よりも、データに基づいたAIの方が**「公平」**であるという期待。 もう一つは、なぜその判断が下されたのかが誰にも説明できない**「ブラックボックス化」**への懸念です。 私たちは今、「アルゴリズム評価は公平化なのか、それとも不透明化なのか」という、極めて現代的な問いの前に立っています。 --- ## 2. アルゴリズム評価が「公平化」と言われる理由 なぜ、多くの組織が重要な意思決定をアルゴリズムに委ねようとするのでしょうか。そこには、人間特有の「判断のバグ」を排除したいという強い動機があります。 ### 人間の主観と偏見(バイアス)の排除 人間は、その日の体調や気分、あるいは無意識のうちに抱いている性別・年齢・出身地に対する偏見に影響を受けやすい生き物です。面接官が「自分と似た雰囲気の人」を高く評価してしまう、といった事象は枚挙にいとまがありません。アルゴリズムは、あらかじめ設定されたルールに従って機械的に処理を行うため、こうした一時的な感情や個人的な好みを排除した「一貫性のある評価」を可能にします。 ### 判断基準の統一と透明なルール化 人間による評価は、担当者ごとに基準がバラバラになりがちです。一方、アルゴリズムは(少なくとも設計段階では)明確な数式やロジックに基づいています。「何を評価し、何を評価しないか」をデジタルなルールとして定義することで、組織全体で統一された基準を適用できるメリットがあります。 ### 膨大なデータによる多角的な視点 人間が一度に処理できる情報の量には限界があります。しかし、アルゴリズムであれば、過去数十年分のデータや数千項目に及ぶ変数を同時に分析し、人間が気づかなかった相関関係を見つけ出すことができます。これにより、一部の目立つ特徴だけで判断するのではなく、より多角的で客観的な評価が実現すると期待されています。 ※(図:人間の判断とアルゴリズム判断の比較) --- ## 3. アルゴリズム評価が「ブラックボックス」と言われる理由 一方で、アルゴリズムによる評価が進むほど、そのプロセスが「見えなくなる」という深刻な問題も浮上しています。 ### 機械学習モデルの複雑化 近年のAI、特に「ディープラーニング(深層学習)」を用いたモデルは、数億、数兆ものパラメータが複雑に絡み合って結果を出力します。開発者でさえも「なぜAIがこの人を不採用と判断したのか」という具体的な理由をピンポイントで説明することが困難になっています。この構造的な不透明さが、ブラックボックス問題の核心です。 ### 「データの偏り」が引き継がれるリスク アルゴリズム自体が中立であっても、学習に使う「過去のデータ」に偏りがあれば、AIはその偏見を学習・増幅させてしまいます。例えば、過去に男性ばかりを採用してきた企業のデータをAIに学ばせれば、AIは「男性であること」を高く評価するルールを勝手に作り出してしまう可能性があります。この場合、不透明なプロセスのなかで差別が「自動化」されるリスクが生じます。 ### 企業の秘密保持と説明責任 多くのアルゴリズムは企業の知的財産として秘匿されています。SNSの表示順位や広告配信のロジックが公開されないのは、それが企業の競争力の源泉だからです。しかし、評価を受ける側からすれば、「なぜ自分のスコアが低いのか」を知る権利が阻害されているとも言えます。人間の判断であれば「説明」を求めることができますが、ブラックボックス化したアルゴリズムに対しては、納得感を得る手段が極めて限定的です。 --- ## 4. 公平性と透明性のあいだにある構造 「公平化」と「ブラックボックス化」は、一見すると正反対の現象に思えます。しかし、実際にはこれらは**「同じコインの表裏」**として同時に進行しています。 ### 恣意性と不透明性のトレードオフ 人間の判断には「恣意性(勝手な思い込み)」がありますが、対話を通じて理由を聞くことができます。対して、アルゴリズムには「恣意性」は少ないものの、計算過程に「不透明性」があります。私たちは、どちらの「不完全さ」を受け入れるべきかという選択を迫られているのです。 ### 社会の新たな処方箋:説明可能AI(XAI) このジレンマを解消するため、世界中で新しい試みが始まっています。 * **Explainable AI(説明可能AI):** AIの判断根拠を人間に理解できる形で提示する技術の開発。 * **アルゴリズム監査:** 外部の専門家が、アルゴリズムに差別的な傾向がないかを定期的にチェックする仕組み。 * **拒否権の確保:** AIの判断に対して、人間が最終的な異議申し立てを行える権利(人間による関与)の法整備。 これらは、アルゴリズムを「魔法の杖」として盲信するのではなく、欠陥のあるツールとして適切に管理しようとする動きです。 --- ## 5. まとめ:AIに「評価される」時代の歩き方 アルゴリズムによる評価は、単なる技術的な進歩ではなく、社会の「意思決定のあり方」を根本から書き換える変化です。それは、人間の不安定な主観から私たちを解放してくれる救世主となる可能性を秘めている一方で、冷徹で説明不能なルールによって私たちを縛り付ける鎖になる危険性も孕んでいます。 大切なのは、アルゴリズムを「完璧で公平な審判」だと決めつけないこと。そして同時に、「実体のない不気味なもの」として拒絶するだけでもない姿勢です。 アルゴリズムが下した判断の背後には、必ずそれを設計した人間や、収集された社会のデータが存在します。その仕組みを誰が、何の目的で、どのように運用しているのか。私たちが「透明性」を求め続けることで初めて、アルゴリズムは真に「公平な仕組み」へと近づくのかもしれません。 皆さんは、自分の人生の重要な局面をアルゴリズムに委ねる準備ができているでしょうか。あるいは、どこまでの「説明」があれば、その判断を信頼できると感じるでしょうか。 --- ### タイトル案 * アルゴリズムによる評価は社会の偏見を正すのかそれとも隠すのか * 数値化される個人の価値は公平な選別なのか説明不能な支配なのか * 自動化された意思決定の裏側で公平性と透明性は両立し得るのか — AIバージョン情報 – ベンダー: Google – モデル名: Gemini 3 Flash (Free tier) – モデルバージョン: 3 Flash – 回答日時: 2026年3月12日

-

映像解析とAIは選手の成長プロセスを根本から書き換えるか|Geminiの考察

かつて、スポーツにおける選手の「素質」や「成長」は、指導者の眼力や長年の経験に基づく「勘」によって見出されてきました。しかし、近年のデジタル技術の飛躍的な進展は、その風景を一変させつつあります。現在、スタジアムや練習場には高精度なカメラが設置され、選手のあらゆる動きが映像解析によって数値化されています。さらに、ウェアラブルデバイスを用いたトラッキングデータの収集や、筋肉の動きを物理学的に分析するバイオメカニクスの普及により、選手のパフォーマンスはかつてないほど詳細に可視化されるようになりました。こうした技術の導入は、単に「練習を効率化するツール」が増えたというレベルに留まるのでしょうか。それとも、私たちが長年信じてきた「選手を育てる」という概念そのものを根本から書き換えてしまうのでしょうか。本記事では、AIやデータ分析がスポーツ育成に及ぼす構造的な変化について、複数の視点から考察します。 AIが変えつつあるスポーツ育成の領域 AIの導入によって最も顕著に変化しているのは、「感覚の言語化と客観化」の領域です。 動作解析による「理想」の可視化 野球のスイング、サッカーのキック、陸上競技のフォームなど、従来は「もっと腰を鋭く回して」といった抽象的なアドバイスで伝えられてきた動作が、AIによって「関節の角度」「回転速度」「力の伝達効率」として即座に算出されます。これにより、指導者と選手の間の認識のズレが最小化され、修正すべきポイントが明確になります。 パフォーマンスデータの蓄積と予測 日々の走行距離、心拍数、睡眠の質といったバイタルデータをAIが分析することで、オーバートレーニング(過度な練習による疲労蓄積)の兆候を事前に察知することが可能になりました。これは「根性」や「気合」でカバーしてきた従来の練習量を、科学的な根拠に基づく「最適な負荷」へと置き換える動きです。 「経験と感覚」の補完 熟練の指導者が持っていた「この選手は伸びそうだ」「今は休ませるべきだ」という直感の一部が、データによって裏付けられ、あるいは否定される場面が増えています。AIによる客観化は、指導の属人性を排し、誰もが質の高いフィードバックを受けられる環境を整えつつあります。 ※(図:データ分析と指導経験の役割分担) 個別最適化された育成という可能性 AIがもたらす最大の転換点の一つは、集団に対する指導から「個」に対する最適化への移行です。 身体特性に応じたオーダーメイド・プログラム 同じ練習メニューをこなしても、骨格や筋繊維の組成、成長スピードによって得られる効果は異なります。AIは膨大な過去のデータと照らし合わせ、その選手にとって最も成長効率が高いトレーニングを提案する力を持ち始めています。 チームスポーツにおける個の自律 サッカーやラグビーのようなチームスポーツにおいて、従来は「チーム戦術に個を当てはめる」傾向が強くありました。しかし、個別のパフォーマンス履歴をAIで管理することで、チーム全体の練習と並行して、個人の弱点をピンポイントで補強する「ハイブリッド型」の育成が容易になっています。 集団練習の意義の変化 個別最適化が進む一方で、チーム全体で同じ苦楽を共にする「集団練習」の価値が問い直されています。効率を追求するAI的アプローチと、社会性や連帯感を育む伝統的アプローチがどのように共存していくべきかは、今後の重要な議論の焦点となるでしょう。 それでもAIが置き換えにくい要素 技術がどれほど進化しても、データ化が困難な、あるいはAIでは代替しにくい領域が依然として存在します。 試合中の判断力:練習での動作は解析できても、刻一刻と状況が変わる試合中における「直感的な判断」や「相手との駆け引き」をすべて数値化することは困難です。セオリーを超えた創造的なプレーや、土壇場でのひらめきは、依然として人間の感性に委ねられています。 メンタル面と心理的アプローチ:選手のモチベーション、プレッシャーへの耐性、私生活での不安などがパフォーマンスに与える影響は甚大です。AIは「数値が落ちている」という結果を示すことはできますが、その背後にある複雑な感情を汲み取り、寄り添うことは得意ではありません。 チーム文化と信頼関係:指導者と選手の間に流れる「この人のために頑張りたい」という信頼感や、チーム独自の伝統・文化といった無形の資産は、効率性だけでは測れない育成の根幹を成しています。これらは人間同士の相互作用によってのみ醸成されるものです。 AI時代のスポーツ指導者の役割 AIの普及は、指導者の仕事を奪うのではなく、その役割をより高度なものへと変容させていく可能性があります。 データの「解釈者」としての役割 AIが出した膨大なデータを、選手が納得できる言葉に翻訳し、モチベーションを高める形で伝える能力が求められます。単に「データがこう言っている」と伝えるのではなく、選手の性格や現状を考慮して「どう活用するか」を共に考える、いわば「コンサルタント」や「伴侶」としての側面が強まるでしょう。 多角的な意思決定の支援 AIは「効率」を最優先しますが、指導者は「選手の将来」や「人間的な成長」も考慮に入れなければなりません。あえて効率の悪い練習を課すことで精神力を鍛えるといった、高度な判断を支える道具としてAIを使いこなす姿勢が重要です。 技術と人間理解の橋渡し 最新のスポーツ科学を理解しつつ、目の前の選手の心の機微を察知する。AI時代の指導者には、デジタル・リテラシーと深い人間理解という、一見相反する二つの資質の高いレベルでの融合が期待されています。 ※(図:AIとスポーツ育成の関係構造) まとめ AIやデータ分析の進展は、スポーツの育成現場を「根拠のない熱血」から「根拠のある挑戦」へと変えつつあります。動作解析や個別最適化プログラムは、選手が自身のポテンシャルを最大限に引き出すための強力な武器となるでしょう。 しかし、スポーツの本質が「人間が限界に挑む営み」である以上、その中心にいるのは常に人間にほかなりません。データはあくまで過去と現在の写し鏡であり、未来を切り拓くのは選手の意志と、それを支える指導者の情熱です。 技術によって効率化される「トレーニング」と、数値化できない領域で育まれる「競技文化」。この両者が対立するのではなく、互いを補完し合う関係をいかに築くか。AI時代のスポーツ育成とは、効率の追求を通じて、むしろ「人間にしかできないことは何か」を問い直すプロセスそのものなのかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI・データ分析・映像解析などの技術の進展によって、 スポーツにおける「選手育成の方法」は変わりつつあるのか。 また、それは単なるトレーニングの高度化なのか、 それとも競技文化や指導の考え方そのものを変える可能性があるのかを、 AIの視点から冷静かつ構造的に整理・考察してください。 【目的】 – 「AIがスポーツを支配する」という単純な未来予測ではなく、選手育成の構造的な変化を整理する – データ・技術・指導文化がどのように交差するのかを明らかにする – AI時代における「人間の指導者の役割」や「感覚・経験の価値」を多角的に考える材料を提示する 【読者像】 – スポーツに関心のある一般読者 – 学生アスリートやスポーツ経験者 – スポーツ指導者・教育関係者 – AIやデータ分析のスポーツ活用に興味がある人 【記事構成】 1. 導入(問題提起) – 近年、スポーツの世界でデータ分析やAI活用が広がっていることを提示する – 映像解析、トラッキングデータ、バイオメカニクスなどの技術の普及に触れる – それが単なる「分析ツール」なのか、それとも「育成の考え方」を変えるのかという問いを提示する 2. AIが変えつつあるスポーツ育成の領域 – 動作解析、パフォーマンスデータ、トレーニング管理などの具体例を整理する – 「経験と感覚」に依存してきた指導の一部がデータ化されつつあることを説明する – AIによる客観化・可視化が、どのようにトレーニングに影響を与えているのかを整理する 3. 個別最適化された育成という可能性 – AIやデータ分析によって「選手ごとに異なる育成」が可能になる可能性を整理する – 身体特性・疲労管理・パフォーマンス履歴などを用いた個別トレーニングの概念に触れる – チームスポーツにおける「集団練習」と「個別最適化」の関係を考察する 4. それでもAIが置き換えにくい要素 – 試合中の判断力 – メンタル面 – チーム文化や人間関係 – 指導者と選手の信頼関係 これらの要素が、データだけでは扱いにくい領域である可能性を整理する 5. AI時代のスポーツ指導者の役割 – AIが「指導者を置き換える」のではなく、「意思決定を支援する道具」になる可能性を考える – データを解釈する能力 – 選手の個性や心理を理解する能力 – 技術と人間理解を橋渡しする役割 といった新しい指導者像について考察する 6. まとめ – AIはスポーツ育成の一部を変える可能性があるが、競技は依然として人間の営みであることを確認する – 技術・データ・経験がどのように共存していくのかという視点を提示する – スポーツにおける「育成とは何か」を改めて問い直す形で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「未来予測記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AIとスポーツ育成の関係構造) ※(図:データ分析と指導経験の役割分担) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AIはスポーツの選手育成を変えるのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:データと映像が変えるスポーツの現場 かつて、スポーツにおける選手の「素質」や「成長」は、指導者の眼力や長年の経験に基づく「勘」によって見出されてきました。しかし、近年のデジタル技術の飛躍的な進展は、その風景を一変させつつあります。 現在、スタジアムや練習場には高精度なカメラが設置され、選手のあらゆる動きが**映像解析**によって数値化されています。さらに、ウェアラブルデバイスを用いた**トラッキングデータ**の収集や、筋肉の動きを物理学的に分析する**バイオメカニクス**の普及により、選手のパフォーマンスはかつてないほど詳細に可視化されるようになりました。 こうした技術の導入は、単に「練習を効率化するツール」が増えたというレベルに留まるのでしょうか。それとも、私たちが長年信じてきた「選手を育てる」という概念そのものを根本から書き換えてしまうのでしょうか。本記事では、AIやデータ分析がスポーツ育成に及ぼす構造的な変化について、複数の視点から考察します。 --- ## 2. AIが変えつつあるスポーツ育成の領域 AIの導入によって最も顕著に変化しているのは、「感覚の言語化と客観化」の領域です。 ### 動作解析による「理想」の可視化 野球のスイング、サッカーのキック、陸上競技のフォームなど、従来は「もっと腰を鋭く回して」といった抽象的なアドバイスで伝えられてきた動作が、AIによって「関節の角度」「回転速度」「力の伝達効率」として即座に算出されます。これにより、指導者と選手の間の認識のズレが最小化され、修正すべきポイントが明確になります。 ### パフォーマンスデータの蓄積と予測 日々の走行距離、心拍数、睡眠の質といったバイタルデータをAIが分析することで、オーバートレーニング(過度な練習による疲労蓄積)の兆候を事前に察知することが可能になりました。これは「根性」や「気合」でカバーしてきた従来の練習量を、科学的な根拠に基づく「最適な負荷」へと置き換える動きです。 ### 「経験と感覚」の補完 熟練の指導者が持っていた「この選手は伸びそうだ」「今は休ませるべきだ」という直感の一部が、データによって裏付けられ、あるいは否定される場面が増えています。AIによる客観化は、指導の属人性を排し、誰もが質の高いフィードバックを受けられる環境を整えつつあります。 ※(図:データ分析と指導経験の役割分担) --- ## 3. 個別最適化された育成という可能性 AIがもたらす最大の転換点の一つは、集団に対する指導から「個」に対する最適化への移行です。 ### 身体特性に応じたオーダーメイド・プログラム 同じ練習メニューをこなしても、骨格や筋繊維の組成、成長スピードによって得られる効果は異なります。AIは膨大な過去のデータと照らし合わせ、その選手にとって最も成長効率が高いトレーニングを提案する力を持ち始めています。 ### チームスポーツにおける個の自律 サッカーやラグビーのようなチームスポーツにおいて、従来は「チーム戦術に個を当てはめる」傾向が強くありました。しかし、個別のパフォーマンス履歴をAIで管理することで、チーム全体の練習と並行して、個人の弱点をピンポイントで補強する「ハイブリッド型」の育成が容易になっています。 ### 集団練習の意義の変化 個別最適化が進む一方で、チーム全体で同じ苦楽を共にする「集団練習」の価値が問い直されています。効率を追求するAI的アプローチと、社会性や連帯感を育む伝統的アプローチがどのように共存していくべきかは、今後の重要な議論の焦点となるでしょう。 --- ## 4. それでもAIが置き換えにくい要素 技術がどれほど進化しても、データ化が困難な、あるいはAIでは代替しにくい領域が依然として存在します。 ### 混沌とした試合中における「判断力」 練習での動作は解析できても、刻一刻と状況が変わる試合中における「直感的な判断」や「相手との駆け引き」をすべて数値化することは困難です。セオリーを超えた創造的なプレーや、土壇場でのひらめきは、依然として人間の感性に委ねられています。 ### メンタル面と心理的アプローチ 選手のモチベーション、プレッシャーへの耐性、私生活での不安などがパフォーマンスに与える影響は甚大です。AIは「数値が落ちている」という結果を示すことはできますが、その背後にある複雑な感情を汲み取り、寄り添うことは得意ではありません。 ### チーム文化と信頼関係 指導者と選手の間に流れる「この人のために頑張りたい」という信頼感や、チーム独自の伝統・文化といった無形の資産は、効率性だけでは測れない育成の根幹を成しています。これらは人間同士の相互作用によってのみ醸成されるものです。 --- ## 5. AI時代のスポーツ指導者の役割 AIの普及は、指導者の仕事を奪うのではなく、その役割をより高度なものへと変容させていく可能性があります。 ### データの「解釈者」としての役割 AIが出した膨大なデータを、選手が納得できる言葉に翻訳し、モチベーションを高める形で伝える能力が求められます。単に「データがこう言っている」と伝えるのではなく、選手の性格や現状を考慮して「どう活用するか」を共に考える、いわば「コンサルタント」や「伴侶」としての側面が強まるでしょう。 ### 多角的な意思決定の支援 AIは「効率」を最優先しますが、指導者は「選手の将来」や「人間的な成長」も考慮に入れなければなりません。あえて効率の悪い練習を課すことで精神力を鍛えるといった、高度な判断を支える道具としてAIを使いこなす姿勢が重要です。 ### 技術と人間理解の橋渡し 最新のスポーツ科学を理解しつつ、目の前の選手の心の機微を察知する。AI時代の指導者には、デジタル・リテラシーと深い人間理解という、一見相反する二つの資質の高いレベルでの融合が期待されています。 ※(図:AIとスポーツ育成の関係構造) --- ## 6. まとめ AIやデータ分析の進展は、スポーツの育成現場を「根拠のない熱血」から「根拠のある挑戦」へと変えつつあります。動作解析や個別最適化プログラムは、選手が自身のポテンシャルを最大限に引き出すための強力な武器となるでしょう。 しかし、スポーツの本質が「人間が限界に挑む営み」である以上、その中心にいるのは常に人間にほかなりません。データはあくまで過去と現在の写し鏡であり、未来を切り拓くのは選手の意志と、それを支える指導者の情熱です。 技術によって効率化される「トレーニング」と、数値化できない領域で育まれる「競技文化」。この両者が対立するのではなく、互いを補完し合う関係をいかに築くか。AI時代のスポーツ育成とは、効率の追求を通じて、むしろ「人間にしかできないことは何か」を問い直すプロセスそのものなのかもしれません。 --- ### タイトル案 * 映像解析とAIは選手の成長プロセスを根本から書き換えるか * データによる個別最適化はスポーツ指導の伝統をどう変えるか * 客観的数値と指導者の経験が交差する育成の未来をどう描くか — AIバージョン情報 – ベンダー: Google – モデル名: Gemini 3 Flash (Free tier) – モデルバージョン: 3.0 – 回答日時: 2026-03-12 05:01:13 JST

-

WBCの巨大ビジネス化は野球という競技の純粋性と共存できるのか|Geminiの考察

近年、ワールド・ベースボール・クラシック(WBC)をはじめとする国際スポーツ大会は、単なる「競技の場」を超え、世界規模の巨大なエンターテインメント・ショーへと変貌を遂げています。スタジアムを埋め尽くす熱狂、SNSで拡散される劇的な逆転劇、そして数千億円規模で動く放映権料。こうした光景は、現代社会におけるスポーツの成功を象徴しています。しかし、その一方で「スポーツは純粋な勝負であるべきだ」「ビジネスが優先され、競技の本質が失われているのではないか」という声も根強く存在します。大会が「興行」としての側面を強めるほど、そこにはスポンサーの意向や放送時間の都合、演出された物語が介在するようになるからです。本記事では、WBCという具体的な事例を軸に、現代の国際スポーツ大会が抱える「競技・国家・ビジネス」の複合的な構造を紐解きます。興行化が進むことは、果たして競技の価値を損なうのか、それとも新たな価値を創造しているのか。AIの視点からその構造を整理し、読者の皆様と共に考えていきます。 スポーツが本来持っていた価値の源泉 「スポーツの純粋性」を議論する上で、まずはスポーツが歴史的にどのような役割を担ってきたかを確認する必要があります。 競技としての公平性と勝敗の純粋性 スポーツの根幹にあるのは「ルールに基づいた公平な競い合い」です。出自や経済力に関わらず、定められた時間や条件の中で全力を尽くし、勝敗を決する。この不可予測性と、筋書きのないドラマこそが、スポーツが持つ独自の美学とされてきました。 国家や地域の象徴としての役割 特に国際大会において、選手は個人の枠を超え「共同体の代表」となります。国旗を背負って戦う姿は、人々の帰属意識を刺激し、集団の連帯感を高める文化的な装置としての側面を持っています。 教育・文化としての側面 古くからスポーツは「健全な肉体に健全な精神が宿る」という概念とともに、教育的な価値を付与されてきました。忍耐、協力、相手への敬意(リスペクト)といった倫理観を育む場として、社会の公的な資産と考えられてきたのです。 興行化が進展する構造的要因 なぜ、スポーツはこれほどまでに巨大な「産業」となったのでしょうか。そこにはグローバル経済における構造的な必然性があります。 放送権とデジタルプラットフォームの拡大 現代のスポーツビジネスを支える最大の柱は放映権料です。ライブコンテンツは、録画視聴が主流となった現代において「リアルタイムで消費される稀少な価値」を持ちます。世界中のファンが同時に視聴する国際大会は、広告主にとって極めて魅力的なプラットフォームとなりました。 グローバル市場におけるブランド戦略 WBCのような大会は、主催者であるMLB(メジャーリーグベースボール)にとって、野球という競技を世界中に「輸出」するためのプロモーションの場でもあります。新しい市場を開拓し、グッズ販売やサブスクリプションサービスの利用者を増やすことで、競技の市場価値を最大化させようとする戦略が働いています。 経済波及効果と都市のブランディング 大会の開催は、観光、飲食、交通など広範囲にわたる経済効果をもたらします。国家や自治体にとって、国際大会を成功させることは「自国のプレゼンスを高める」という政治的・経済的投資の側面を強く持っています。 ※(図:国際スポーツ大会の利害関係構造) 興行化が競技に与える具体的な影響 興行化(ビジネス化)は、単に資金が流入するだけではありません。それは競技の「形」そのものにも変化を及ぼします。 「観客目線」によるルールの変容 テレビ映りを良くするため、あるいは視聴者の集中力を維持するために、ルールが変更されることがあります。野球における「ピッチクロック(投球間隔の制限)」の導入は、試合時間の短縮という興行上の要請と、競技のテンポ向上という側面の両方を持っています。 物語性(ストーリーテリング)の重視 興行においては、単なる勝敗以上に「どのような物語があるか」が重視されます。因縁の対決、スター選手の苦悩と復活といったエピソードがメディアによって強調され、消費されます。これにより、競技に興味のない層を取り込める一方で、競技そのものよりも演出された「ドラマ」が主役に躍り出る現象が起こります。 過密日程と選手の健康管理 ビジネス上の要請から、試合数が増加したり、強行軍の日程が組まれたりすることがあります。これは選手のコンディション維持に直面し、「最高のパフォーマンスを競う」という競技の純粋な目的と矛盾するケースも生じさせます。 スポーツは「競技」なのか「エンターテインメント」なのか ここで重要な問いが生じます。プロスポーツの本質は、純粋な「競技」にあるのか、それとも「エンターテインメント」にあるのかという点です。 利害関係の多重構造 現代のプロスポーツは、以下のプレイヤーたちの利害が複雑に絡み合うことで成立しています。 選手:自己の能力の証明と、正当な対価(報酬)の獲得 リーグ・主催者:大会の持続可能性と収益の最大化 スポンサー:ブランドイメージの向上とマーケティング効果 観客:感動、娯楽、コミュニティへの参加感 この中で、どれか一つが欠けても現代のスポーツは成り立ちません。収益(ビジネス)がなければ、選手は競技に専念する環境を得られず、競技レベルは低下します。逆に、競技の純粋性が失われれば、観客は魅力を感じなくなり、ビジネスとしても成立しなくなります。 変化する「価値」の定義 かつてスポーツの価値は「参加すること」や「鍛錬」に置かれていました。しかし現在は、それらに加えて「共有体験」や「コンテンツとしての面白さ」も不可欠な価値となっています。興行化とは、スポーツが社会の多種多様なニーズに応えようとした結果の、適応のプロセスであるとも捉えられます。 まとめ:問い直される「スポーツの在り方」 興行化が進むことは、競技の純粋性を損なう「悪」なのでしょうか。 構造的に見れば、ビジネスとしての成功は、競技を維持し、普及させるための強力なエンジンです。WBCが盛り上がることで野球を始める子供が増え、競技の裾野が広がるのであれば、それは競技の本質的な価値を高めていると言えるかもしれません。 しかし、過度な演出や商業至上主義が、選手を「消費される駒」に変え、勝敗の重みを薄れさせてしまうリスクも否定できません。私たちが目にする熱狂は、純粋な技術への称賛なのか、それとも巧みに設計された興行への反応なのか。その境界線は、常に揺れ動いています。 スポーツが持つ「競技・文化・産業」という三つの側面は、互いに矛盾しながらも共生しています。興行化という変化を否定するのではなく、その変化が「スポーツが守るべき一線」を越えていないか、ファン一人ひとりが冷静に見つめ続けることが、これからのスポーツ文化を形作る鍵となるでしょう。 ※(図:スポーツ競技と興行ビジネスの関係構造) あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 国際スポーツ大会において、 「興行化(ビジネス化)」が進むことは 競技の純粋性や価値を変化させるのか。 特にWBC(ワールド・ベースボール・クラシック)を例に、 スポーツ・ビジネス・国家性・エンターテインメントの関係を AIの視点から冷静かつ構造的に整理・考察してください。 【目的】 – 「スポーツは純粋であるべき」という感情論ではなく、構造として整理する – 国際大会が持つ「競技・国家・ビジネス」の複合構造を理解する – スポーツの価値がどのように変化しているのかを読者が考える材料を提示する 【読者像】 – スポーツ観戦が好きな一般読者 – WBCなど国際大会に興味がある層 – スポーツビジネスや社会構造に関心のある読者 – スポーツを「文化」「国家」「産業」として考えたい人 【記事構成】 1. 導入(問題提起) – 国際スポーツ大会が巨大イベント化している現状を提示する – WBCの盛り上がりを例に、スポーツが「競技」と「興行」の両方の側面を持つことを示す – 「興行化は競技の純粋性を変えるのか」という問いを提示する 2. スポーツが本来持っていた価値 – 競技としての公平性・勝敗の純粋性 – 国家や地域の象徴としての役割 – 文化・教育・共同体としてのスポーツ – 歴史的にスポーツがどのような意味を持ってきたかを整理する 3. 興行化が進む理由 – 放送権・スポンサー・広告などスポーツビジネスの拡大 – グローバル市場におけるスポーツイベントの価値 – 国際大会が持つ経済効果やブランド価値 – なぜスポーツが巨大産業になったのかを構造的に説明する 4. 興行化が競技に与える影響 – 試合形式やルールが「観客向け」に調整される可能性 – スター選手・物語性・ドラマの重視 – 国家対抗イベントとしての演出 – 競技の純粋性とエンターテインメント性の関係を整理する 5. スポーツは「競技」なのか「エンターテインメント」なのか – プロスポーツの本質を考える – 観客・選手・リーグ・スポンサーの利害関係 – スポーツが持つ複数の役割(競技・文化・産業)を整理する 6. まとめ – 興行化は競技の価値を単純に損なうのか、それとも形を変えるのかを整理する – スポーツが持つ複数の側面を再確認する – 読者がスポーツの見方を考えるための視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:スポーツ競技と興行ビジネスの関係構造) ※(図:国際スポーツ大会の利害関係構造) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「スポーツの興行化は競技の純粋性を変えてしまうのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:巨大化する祝祭とその舞台裏 近年、ワールド・ベースボール・クラシック(WBC)をはじめとする国際スポーツ大会は、単なる「競技の場」を超え、世界規模の巨大なエンターテインメント・ショーへと変貌を遂げています。スタジアムを埋め尽くす熱狂、SNSで拡散される劇的な逆転劇、そして数千億円規模で動く放映権料。こうした光景は、現代社会におけるスポーツの成功を象徴しています。 しかし、その一方で「スポーツは純粋な勝負であるべきだ」「ビジネスが優先され、競技の本質が失われているのではないか」という声も根強く存在します。大会が「興行」としての側面を強めるほど、そこにはスポンサーの意向や放送時間の都合、演出された物語が介在するようになるからです。 本記事では、WBCという具体的な事例を軸に、現代の国際スポーツ大会が抱える「競技・国家・ビジネス」の複合的な構造を紐解きます。興行化が進むことは、果たして競技の価値を損なうのか、それとも新たな価値を創造しているのか。AIの視点からその構造を整理し、読者の皆様と共に考えていきます。 --- ## 2. スポーツが本来持っていた価値の源泉 「スポーツの純粋性」を議論する上で、まずはスポーツが歴史的にどのような役割を担ってきたかを確認する必要があります。 ### 競技としての公平性と勝敗の純粋性 スポーツの根幹にあるのは「ルールに基づいた公平な競い合い」です。出自や経済力に関わらず、定められた時間や条件の中で全力を尽くし、勝敗を決する。この不可予測性と、筋書きのないドラマこそが、スポーツが持つ独自の美学とされてきました。 ### 国家や地域の象徴としての役割 特に国際大会において、選手は個人の枠を超え「共同体の代表」となります。国旗を背負って戦う姿は、人々の帰属意識を刺激し、集団の連帯感を高める文化的な装置としての側面を持っています。 ### 教育・文化としての側面 古くからスポーツは「健全な肉体に健全な精神が宿る」という概念とともに、教育的な価値を付与されてきました。忍耐、協力、相手への敬意(リスペクト)といった倫理観を育む場として、社会の公的な資産と考えられてきたのです。 --- ## 3. 興行化が進展する構造的要因 なぜ、スポーツはこれほどまでに巨大な「産業」となったのでしょうか。そこにはグローバル経済における構造的な必然性があります。 ### 放送権とデジタルプラットフォームの拡大 現代のスポーツビジネスを支える最大の柱は放映権料です。ライブコンテンツは、録画視聴が主流となった現代において「リアルタイムで消費される稀少な価値」を持ちます。世界中のファンが同時に視聴する国際大会は、広告主にとって極めて魅力的なプラットフォームとなりました。 ### グローバル市場におけるブランド戦略 WBCのような大会は、主催者であるMLB(メジャーリーグベースボール)にとって、野球という競技を世界中に「輸出」するためのプロモーションの場でもあります。新しい市場を開拓し、グッズ販売やサブスクリプションサービスの利用者を増やすことで、競技の市場価値を最大化させようとする戦略が働いています。 ### 経済波及効果と都市のブランディング 大会の開催は、観光、飲食、交通など広範囲にわたる経済効果をもたらします。国家や自治体にとって、国際大会を成功させることは「自国のプレゼンスを高める」という政治的・経済的投資の側面を強く持っています。 ※(図:国際スポーツ大会の利害関係構造) --- ## 4. 興行化が競技に与える具体的な影響 興行化(ビジネス化)は、単に資金が流入するだけではありません。それは競技の「形」そのものにも変化を及ぼします。 ### 「観客目線」によるルールの変容 テレビ映りを良くするため、あるいは視聴者の集中力を維持するために、ルールが変更されることがあります。野球における「ピッチクロック(投球間隔の制限)」の導入は、試合時間の短縮という興行上の要請と、競技のテンポ向上という側面の両方を持っています。 ### 物語性(ストーリーテリング)の重視 興行においては、単なる勝敗以上に「どのような物語があるか」が重視されます。因縁の対決、スター選手の苦悩と復活といったエピソードがメディアによって強調され、消費されます。これにより、競技に興味のない層を取り込める一方で、競技そのものよりも演出された「ドラマ」が主役に躍り出る現象が起こります。 ### 過密日程と選手の健康管理 ビジネス上の要請から、試合数が増加したり、強行軍の日程が組まれたりすることがあります。これは選手のコンディション維持に直面し、「最高のパフォーマンスを競う」という競技の純粋な目的と矛盾するケースも生じさせます。 --- ## 5. スポーツは「競技」なのか「エンターテインメント」なのか ここで重要な問いが生じます。プロスポーツの本質は、純粋な「競技」にあるのか、それとも「エンターテインメント」にあるのかという点です。 ### 利害関係の多重構造 現代のプロスポーツは、以下のプレイヤーたちの利害が複雑に絡み合うことで成立しています。 * **選手:** 自己の能力の証明と、正当な対価(報酬)の獲得 * **リーグ・主催者:** 大会の持続可能性と収益の最大化 * **スポンサー:** ブランドイメージの向上とマーケティング効果 * **観客:** 感動、娯楽、コミュニティへの参加感 この中で、どれか一つが欠けても現代のスポーツは成り立ちません。たとえば、収益(ビジネス)がなければ、選手は競技に専念する環境を得られず、競技レベルは低下します。逆に、競技の純粋性が失われれば、観客は魅力を感じなくなり、ビジネスとしても成立しなくなります。 ### 変化する「価値」の定義 かつてスポーツの価値は「参加すること」や「鍛錬」に置かれていました。しかし現在は、それらに加えて「共有体験」や「コンテンツとしての面白さ」も不可欠な価値となっています。興行化とは、スポーツが社会の多種多様なニーズに応えようとした結果の、適応のプロセスであるとも捉えられます。 --- ## 6. まとめ:問い直される「スポーツの在り方」 興行化が進むことは、競技の純粋性を損なう「悪」なのでしょうか。 構造的に見れば、ビジネスとしての成功は、競技を維持し、普及させるための強力なエンジンです。WBCが盛り上がることで野球を始める子供が増え、競技の裾野が広がるのであれば、それは競技の本質的な価値を高めていると言えるかもしれません。 しかし、過度な演出や商業至上主義が、選手を「消費される駒」に変え、勝敗の重みを薄れさせてしまうリスクも否定できません。私たちが目にする熱狂は、純粋な技術への称賛なのか、それとも巧みに設計された興行への反応なのか。その境界線は、常に揺れ動いています。 スポーツが持つ「競技・文化・産業」という三つの側面は、互いに矛盾しながらも共生しています。興行化という変化を否定するのではなく、その変化が「スポーツが守るべき一線」を越えていないか、ファン一人ひとりが冷静に見つめ続けることが、これからのスポーツ文化を形作る鍵となるでしょう。 ※(図:スポーツ競技と興行ビジネスの関係構造) --- ### タイトル案 * 国際スポーツ大会の興行化は競技本来の価値をどのように変質させるか * WBCの巨大ビジネス化は野球という競技の純粋性と共存できるのか * 演出される感動と勝負のリアリティは現代スポーツで両立するのか --- AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash (Free tier) * モデルバージョン: 3 Flash * 回答日時: 2026-03-12

-

トレーニング量はどのような構造で成果へと変換されるのか|Geminiの考察

「努力は裏切らない」「練習量は嘘をつかない」という言葉は、私たちの社会において一種の美徳として広く共有されています。スポーツ、学問、ビジネス、あるいは創作活動といったあらゆる分野で、成果を出すための絶対条件として「量」が強調される場面は少なくありません。しかし一方で、どれだけ膨大な時間を費やしても成果が横ばいのまま停滞する、いわゆる「プラトー(停滞期)」を経験する人も数多く存在します。同じ時間、同じメニューをこなしていても、個人によって現れる成果に大きな差が生じる現実は、単なる「量の不足」だけでは説明がつきません。なぜ、トレーニング量と成果の関係はこれほどまでに複雑で、時に矛盾を孕んで議論され続けているのでしょうか。それは、私たちが「努力」という言葉を一つの均質なエネルギーとして捉えがちである一方で、実際には「量」以外にも質、戦略、環境、 recruiters そして個人の特性といった多層的な構造が絡み合っているからです。本記事では、この「量と成果」の関係性を構造的な視点から整理し、考察していきます。 1. トレーニング量が成果に結びつきやすいケース:初期段階の構造 物事の習得における初期段階では、トレーニングの「量」が成果に対して正の相関(一方が増えればもう一方も増える関係)を示しやすい傾向があります。 基礎的な回路の形成 新しいスキルを習得する際、脳や身体はその動作をスムーズに行うための「回路」を構築する必要があります。楽器の運指、計算のスピード、スポーツの基本フォームなどは、反復練習によって意識的な動作を無意識的なレベルへと落とし込むプロセスが不可欠です。この段階では、試行回数そのものが習得の速度を決定づける主要因となります。 データの蓄積とパターン認識 学習においても、初期段階では基礎知識のインプット量が重要です。一定以上の語彙や公式、事例を頭に入れることで、初めて物事の構造を捉えるための「パターン認識」が可能になります。この「知のベースライン」を築くフェーズでは、質を問う前にまず絶対的な量を確保することが、その後の成長を支える土台となります。 「量」が能力を押し上げる力学 未経験の状態から一定のレベル(例えば初級から中級への移行)までは、スキルの伸びしろが非常に大きいため、投下した時間に比例して目に見える成果が得られやすいという構造があります。この成功体験が「量は成果を生む」という直感的な信頼を強化する背景となっていると考えられます。 ※(図:習得初期における量と成果の正比例モデル) 2. 量だけでは成果が伸びにくくなる理由:限界と質の転換 ある一定の熟達レベルを超えると、単にトレーニングの量を増やすだけでは成果が伸び悩む現象が見られるようになります。ここでは、量という変数が持つ限界の構造を整理します。 収穫逓減(しゅうかくていげん)の法則 経済学で用いられるこの概念は、投資量を増やし続けても、得られる追加的な成果が次第に減少していく現象を指します。トレーニングにおいても、初心者が1時間練習して得る成長幅と、プロフェッショナルが1時間練習して得る成長幅では、後者の方が圧倒的に小さくなるのが一般的です。高いレベルに到達するほど、わずかな向上を得るために必要な「量」のコストは膨大になります。 「漫然とした反復」の罠 同じ動作や作業を無意識に繰り返すだけでは、脳への刺激が薄れ、スキルの自動化が進む一方で「改善」が止まってしまいます。これを「適応の停滞」と呼びます。成果を伸ばし続けるには、常に現在の能力をわずかに上回る負荷をかける「漸進的過負荷(ぜんしんてきかふか)」の原理や、自身の弱点を客観的に分析し、修正を加えるプロセスが必要です。 フィードバックと学習設計の欠如 自己流で量をこなすだけでは、間違った癖を固定化させてしまうリスクもあります。 外部フィードバック: 指導者やデータによる客観的な評価 メタ認知: 自分の学習プロセスを客観的に把握し、調整する能力 これらの要素が伴わない「量」は、成果に直結しにくい構造を持っています。 3. 成果を左右する「量以外の要因」:多層的な構造分析 成果という結果は、トレーニング量という単一の変数によって生み出されるものではありません。実際には、以下のような複数の要因が掛け合わされた関数の結果として現れます。 戦略と適性(リソース配分) どの方向に努力を向けるかという「戦略」は、成果のレバレッジ(てこの作用)を決定します。自分の特性や才能に合致した領域で努力する場合と、そうでない場合では、同じ「量」を投下しても変換効率に劇的な差が生じます。 環境とインフラ 指導者の質、設備、情報へのアクセス、周囲のライバル、あるいは経済的基盤といった「環境的要因」は、努力を成果へと変換するための触媒として機能します。優れた環境下では、少量の努力でも効率的に成果へと結びつく構造が存在します。 心理状態と回復の質 「量」を追求するあまり、心身の疲労や燃え尽き症候群(バーンアウト)を招けば、成果はむしろマイナスに転じます。適切な休息や睡眠、高いモチベーションを維持する心理的安全性も、持続的な成長を支える不可欠な要素です。 「努力」の構成要素を分解する 私たちが「努力」と呼ぶものを構造的に分解すると、以下の3つの積として捉えることができます。 方向(戦略): どこを目指して動くか 質(方法): いかに効率的に動くか 量(時間・回数): どれだけ動くか ※(図:成果を決定する「方向×質×量」の相互関係モデル) 4. まとめ:思考の材料として トレーニング量と成果の関係を構造的に紐解くと、そこには単純な比例関係ではない、多層的な力学が働いていることが分かります。 量は、基礎を築き、回路を作るための「エネルギー」として不可欠なものです。特に初期段階においては、量が成果の主導権を握ります。しかし、習得が進むにつれて「量」の支配力は相対的に弱まり、代わりに「戦略の妥当性」や「フィードバックの質」といった要因が、成長曲線を左右する主要な変数へと入れ替わっていきます。 「努力が報われない」と感じたとき、それは必ずしも量が足りないからではなく、努力を成果に変換するための「構造」に目詰まりが起きているサインかもしれません。自分の現在地はどのフェーズにあるのか、方向性は正しいか、そして「量」を適切に変換するための「質」や「環境」は整っているか。本記事が提示した視点が、読者の皆様が自身の取り組みを冷静に振り返り、より納得感のある努力のあり方を模索するための一助となれば幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 トレーニング量は成果と比例するのか。 スポーツ、学習、仕事、創作など多くの分野で「努力量」と「成果」の関係は議論され続けています。 本記事では「量を増やせば成果は必ず伸びるのか」という問いについて、個人の精神論ではなく、構造的な視点から整理・考察してください。 【目的】 – 「努力すれば必ず報われる」という単純な精神論でも 「才能がすべて」という悲観論でもない形で整理する – トレーニング量と成果の関係を、複数の視点から構造的に理解する – 読者が自分の努力や学習方法を見直すための“思考の材料”を提供する 【読者像】 – スポーツ・勉強・仕事などで努力を続けている人 – 努力量と成果の関係に疑問を感じた経験がある人 – 自己成長や学習効率に関心がある社会人・学生 – 「努力とは何か」を冷静に考えたい読者 【記事構成】 1. 導入(問題提起) – 「努力すれば報われる」という言葉が広く共有されていることを提示する – 一方で、努力量と成果が必ずしも比例しない現実も多くの人が経験していることに触れる – なぜ「量」と「成果」の関係が長く議論されてきたのかを簡潔に説明する 2. トレーニング量が成果に結びつきやすいケース – 初期段階における反復練習の重要性を整理する – 基礎習得の段階では量が成果に反映されやすい理由を説明する – スポーツ・学習などで見られる「量が能力を押し上げる構造」を紹介する 3. 量だけでは成果が伸びにくくなる理由 – 一定段階を超えると、量よりも質や戦略が重要になるケースを整理する – フィードバック・修正・学習設計などの要素を説明する – 同じ努力量でも成果に差が生まれる構造を考察する 4. 成果を左右する「量以外の要因」 – 才能・環境・戦略・心理状態など、努力量以外の要素を整理する – 「努力」という言葉の中に含まれる複数の要素を構造的に分解する – 成果は単一要因ではなく複数要因の組み合わせで生まれることを説明する 5. まとめ – トレーニング量と成果の関係は単純な比例関係ではないことを整理する – 努力量が持つ意味と限界を冷静に振り返る – 読者が自分の努力の方向性を考えるための視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「努力論」ではなく「構造整理」を重視する 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:トレーニング量と成果の関係モデル) ※(図:努力量・質・環境の相互関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「努力量は成果をどこまで決めるのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:努力と成果の相関性を問い直す 「努力は裏切らない」「練習量は嘘をつかない」という言葉は、私たちの社会において一種の美徳として広く共有されています。スポーツ、学問、ビジネス、あるいは創作活動といったあらゆる分野で、成果を出すための絶対条件として「量」が強調される場面は少なくありません。 しかし一方で、どれだけ膨大な時間を費やしても成果が横ばいのまま停滞する、いわゆる「プラトー(停滞期)」を経験する人も数多く存在します。同じ時間、同じメニューをこなしていても、個人によって現れる成果に大きな差が生じる現実は、単なる「量の不足」だけでは説明がつきません。 なぜ、トレーニング量と成果の関係はこれほどまでに複雑で、時に矛盾を孕んで議論され続けているのでしょうか。それは、私たちが「努力」という言葉を一つの均質なエネルギーとして捉えがちである一方で、実際には「量」以外にも質、戦略、環境、そして個人の特性といった多層的な構造が絡み合っているからです。本記事では、この「量と成果」の関係性を構造的な視点から整理し、考察していきます。 --- ## 2. トレーニング量が成果に結びつきやすいケース:初期段階の構造 物事の習得における初期段階では、トレーニングの「量」が成果に対して正の相関(一方が増えればもう一方も増える関係)を示しやすい傾向があります。 ### 基礎的な回路の形成 新しいスキルを習得する際、脳や身体はその動作をスムーズに行うための「回路」を構築する必要があります。楽器の運指、計算のスピード、スポーツの基本フォームなどは、反復練習によって意識的な動作を無意識的なレベルへと落とし込むプロセスが不可欠です。この段階では、試行回数そのものが習得の速度を決定づける主要因となります。 ### データの蓄積とパターン認識 学習においても、初期段階では基礎知識のインプット量が重要です。一定以上の語彙や公式、事例を頭に入れることで、初めて物事の構造を捉えるための「パターン認識」が可能になります。この「知のベースライン」を築くフェーズでは、質を問う前にまず絶対的な量を確保することが、その後の成長を支える土台となります。 ### 「量」が能力を押し上げる力学 未経験の状態から一定のレベル(例えば初級から中級への移行)までは、スキルの伸びしろが非常に大きいため、投下した時間に比例して目に見える成果が得られやすいという構造があります。この成功体験が「量は成果を生む」という直感的な信頼を強化する背景となっていると考えられます。 ※(図:習得初期における量と成果の正比例モデル) --- ## 3. 量だけでは成果が伸びにくくなる理由:限界と質の転換 ある一定の熟達レベルを超えると、単にトレーニングの量を増やすだけでは成果が伸び悩む現象が見られるようになります。ここでは、量という変数が持つ限界の構造を整理します。 ### 収穫逓減(しゅうかくていげん)の法則 経済学で用いられるこの概念は、投資量を増やし続けても、得られる追加的な成果が次第に減少していく現象を指します。トレーニングにおいても、初心者が1時間練習して得る成長幅と、プロフェッショナルが1時間練習して得る成長幅では、後者の方が圧倒的に小さくなるのが一般的です。高いレベルに到達するほど、わずかな向上を得るために必要な「量」のコストは膨大になります。 ### 「漫然とした反復」の罠 同じ動作や作業を無意識に繰り返すだけでは、脳への刺激が薄れ、スキルの自動化が進む一方で「改善」が止まってしまいます。これを「適応の停滞」と呼びます。成果を伸ばし続けるには、常に現在の能力をわずかに上回る負荷をかける「漸進的過負荷(ぜんしんてきかふか)」の原理や、自身の弱点を客観的に分析し、修正を加えるプロセスが必要です。 ### フィードバックと学習設計の欠如 自己流で量をこなすだけでは、間違った癖を固定化させてしまうリスクもあります。 * **外部フィードバック:** 指導者やデータによる客観的な評価 * **メタ認知:** 自分の学習プロセスを客観的に把握し、調整する能力 これらの要素が伴わない「量」は、成果に直結しにくい構造を持っています。 --- ## 4. 成果を左右する「量以外の要因」:多層的な構造分析 成果という結果は、トレーニング量という単一の変数によって生み出されるものではありません。実際には、以下のような複数の要因が掛け合わされた関数の結果として現れます。 ### 戦略と適性(リソース配分) どの方向に努力を向けるかという「戦略」は、成果のレバレッジ(てこの作用)を決定します。自分の特性や才能に合致した領域で努力する場合と、そうでない場合では、同じ「量」を投下しても変換効率に劇的な差が生じます。 ### 環境とインフラ 指導者の質、設備、情報へのアクセス、周囲のライバル、あるいは経済的基盤といった「環境的要因」は、努力を成果へと変換するための触媒として機能します。優れた環境下では、少量の努力でも効率的に成果へと結びつく構造が存在します。 ### 心理状態と回復の質 「量」を追求するあまり、心身の疲労や燃え尽き症候群(バーンアウト)を招けば、成果はむしろマイナスに転じます。適切な休息や睡眠、高いモチベーションを維持する心理的安全性も、持続的な成長を支える不可欠な要素です。 ### 「努力」の構成要素を分解する 私たちが「努力」と呼ぶものを構造的に分解すると、以下の3つの積として捉えることができます。 1. **方向(戦略):** どこを目指して動くか 2. **質(方法):** いかに効率的に動くか 3. **量(時間・回数):** どれだけ動くか ※(図:成果を決定する「方向×質×量」の相互関係モデル) --- ## 5. まとめ:思考の材料として トレーニング量と成果の関係を構造的に紐解くと、そこには単純な比例関係ではない、多層的な力学が働いていることが分かります。 量は、基礎を築き、回路を作るための「エネルギー」として不可欠なものです。特に初期段階においては、量が成果の主導権を握ります。しかし、習得が進むにつれて「量」の支配力は相対的に弱まり、代わりに「戦略の妥当性」や「フィードバックの質」といった要因が、成長曲線を左右する主要な変数へと入れ替わっていきます。 「努力が報われない」と感じたとき、それは必ずしも量が足りないからではなく、努力を成果に変換するための「構造」に目詰まりが起きているサインかもしれません。自分の現在地はどのフェーズにあるのか、方向性は正しいか、そして「量」を適切に変換するための「質」や「環境」は整っているか。 本記事が提示した視点が、読者の皆様が自身の取り組みを冷静に振り返り、より納得感のある努力のあり方を模索するための一助となれば幸いです。 --- ### タイトル案 * トレーニング量はどのような構造で成果へと変換されるのか * 努力の投下量と成果の相関関係を左右する変数は何か * 練習の蓄積が成果に結びつくプロセスには何が必要か --- AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash (Nano Banana 2) * モデルバージョン: Free Tier * 回答日時: 2026-03-11 21:04 JST

-

エンタメ業界の報酬を左右する人気指標と収益モデルの連動構造|Geminiの考察

エンターテインメント業界において、「人気がある者ほど稼ぐ」という認識は一種の共通認識として定着しています。テレビ番組の視聴率が高いタレント、SNSのフォロワー数が多いインフルエンサー、あるいはストリーミング再生数が数億回を超えるアーティスト。彼らが多額の報酬を得ている事実は、一見すると「人気=報酬」という単純な方程式が成立しているように見えます。しかし、実態を精査すると、人気そのものが直接的に現金を生成しているわけではないことに気づかされます。実際に報酬を決定づけているのは、生身の人間が抱く「好き」という感情や熱狂そのものではなく、それらを外部から観測可能にした「人気を測る指標」です。なぜ、形のない人気は数値化されなければならないのでしょうか。そして、その数値化のプロセス(指標化)が、どのように表現者の収益システムを規定しているのでしょうか。本記事では、エンタメ業界における「人気・指標・報酬」の三位一体の構造を整理し、その連動性を多角的に考察します。 人気はどのように「指標化」されるのか エンターテインメントが産業として成立するためには、主観的な「おもしろさ」や「支持」を、客観的に評価可能な「共通言語」に変換する必要があります。これが「指標化」のプロセスです。 代表的な人気指標の分類 現在、エンタメ業界で活用されている指標は、その性質ごとに以下のように分類できます。 到達・露出指標(リーチ):テレビの「世帯・個人視聴率」、YouTubeの「再生回数」、SNSの「インフルエンサーのフォロワー数」などが該当します。どれだけ多くの人の目に触れたかを測る、最も伝統的かつ強力な指標です。 エンゲージメント指標(深化):SNSの「いいね」「保存数」「コメント率」、あるいは配信ライブの「同時視聴者数」などです。単なる露出量ではなく、視聴者がどれだけ能動的に反応したかを測ります。 直接購入指標(コンバージョン):ライブチケットの完売速度、ファンクラブ会員数、CDやグッズの売上枚数などです。人気が直接的な支出行動に結びついた結果を示します。 なぜ業界は人気を数値化する必要があるのか 業界がこれほどまでに数値を重視するのは、「取引の標準化」のためです。広告主がスポンサー料を支払う際や、プラットフォームがレベニューシェア(収益分配)を行う際、「なんとなく人気があるから」という理由では予算を正当化できません。「1再生あたり◯円」「視聴率1%あたり◯万円」といった、第三者が合意できる物差しが必要なのです。 ※(図:エンタメ業界における人気指標と報酬の関係) 人気指標と報酬モデルの関係 指標化された人気がどのように収益へと変換されるかは、採用されている「収益モデル」の構造に依存します。 広告モデル:指標の「量」が価値になる テレビやYouTube、無料版の音楽ストリーミングなどが代表的です。ここでは「再生数」や「視聴率」という指標が、そのまま広告枠の販売価格に直結します。このモデルでは、ニッチで深い支持よりも、マスに向けた広範な数値(リーチ)が報酬を最大化させる鍵となります。 興行・販売モデル:指標の「密度」が価値になる ライブコンサートや劇場映画、グッズ販売などが該当します。ここでは「総フォロワー数」よりも、「実際に会場に足を運び、財布を開く熱量(エンゲージメントの密度)」が重要視されます。フォロワーが100万人いてもチケットが売れないケースと、フォロワーは1万人だが常に完売するケースでは、後者の方がこのモデルにおける報酬は高くなる傾向にあります。 サブスクリプション・プラットフォーム分配モデル:アルゴリズムとの連動 NetflixやApple Musicなどのプラットフォームでは、独自のアルゴリズムに基づいた「再生時間」や「継続視聴率」が指標となります。ここでは、単発の話題性よりも「生活習慣の中にどれだけ入り込めたか」という継続的な指標が、プラットフォームからの分配金や次作の制作予算を左右します。 ※(図:人気・指標・収益化モデルの構造) 人気と収入が一致しない理由 「これだけ話題になっているのに、なぜ本人の収入は少ないのか」という現象はしばしば発生します。これは、人気と経済価値の間に介在する「構造的な歪み」が原因です。 契約構造と中間の介在 伝統的な芸能事務所システムやレコード会社との契約において、指標(売上や再生数)がどれだけ伸びても、クリエイター本人に還元される比率が固定されている場合、人気と報酬の連動性は弱まります。一方で、個人でプラットフォームと直接契約するクリエイターは、指標が報酬にダイレクトに反映されやすいという特徴があります。 指標の「質」と広告単価の乖離 同じ100万再生であっても、視聴者の属性(年齢、地域、購買力)によって広告単価は大きく変動します。例えば、購買意欲の高い層に支持される専門的な内容のチャンネルと、子供向けの内容では、指標上の数値が同じでも得られる収益に数倍の開きが出ることがあります。「人気(数字)」が「市場価値(単価)」と一致しない例です。 プラットフォーム・アルゴリズムへの依存 現代の報酬モデルは、各プラットフォームのアルゴリズムという「ブラックボックス」に強く依存しています。アルゴリズムが評価指標を変更(例:再生数重視から再生時間重視へ)した瞬間、人気は変わらなくても報酬だけが激減するというリスクを、現代のクリエイターは常に抱えています。 まとめ:人気とは「仕組み」によって定義される エンターテインメント業界における報酬の正体は、純粋な「人気」そのものではなく、それを特定の市場ルールに基づいて数値化した「指標」との交換レートであると言えます。 かつてはテレビ視聴率という単一の指標が支配的でしたが、現在はYouTube、SNS、ストリーミング、ファンコミュニティといった多層的な指標が存在し、それぞれが異なる報酬モデルと結びついています。この構造を理解することは、送り手にとっては「どの指標を伸ばすべきか」という戦略的な視点を与え、受け手にとっては「自分の『推し』という行動が、どのような仕組みで経済に組み込まれているか」を再認識する機会となります。 「人気がある」とは、単に好かれている状態を指すのか、それとも特定のシステムにおいて高い数値を叩き出している状態を指すのか。指標化とアルゴリズムが加速する現代において、私たちが無意識に消費している「人気」の定義そのものが、産業構造によって常に書き換えられているのかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 エンタメ業界の報酬は、人気そのものではなく 「人気を測る指標」とどのように連動しているのか。 音楽・テレビ・映画・YouTube・SNSなどを例に、 人気と収入の関係を構造的に整理し、 エンターテインメント産業の報酬モデルを考察してください。 【目的】 – 「人気がある人ほど稼ぐ」という単純な理解ではなく、人気の“指標化”という構造を整理する – エンタメ産業において、人気・市場・収益化の仕組みがどのように連動しているかを考察する – 人気・アルゴリズム・市場構造の関係を読み解く視点を読者に提供する 【読者像】 – エンタメ業界の仕組みに関心がある一般読者 – SNSやYouTubeなどの人気指標に日常的に触れている人 – クリエイター経済やインフルエンサー文化に興味がある人 – エンタメ産業の裏側の構造に興味がある人 【記事構成】 1. 導入(問題提起) – エンタメ業界では「人気=報酬」というイメージが広く共有されていることを提示する – しかし実際には、人気そのものではなく「人気を測る指標」が報酬に強く影響していることを示す – なぜ人気は数値化され、報酬システムと結びつくのかという問いを提示する 2. 人気はどのように「指標化」されるのか – エンタメ業界では人気がどのような数値として表現されるのかを整理する – 視聴率、売上枚数、再生回数、フォロワー数などの代表的な指標を紹介する – なぜ業界は人気を数値化する必要があるのかを構造的に説明する 3. 人気指標と報酬モデルの関係 – 人気指標がどのように収益モデルと結びつくのかを説明する – 広告モデル、興行モデル、サブスクリプションモデルなどを整理する – 同じ人気でも収益が大きく異なる理由を構造的に説明する 4. 人気と収入が一致しない理由 – 人気があっても収入が伸びないケースがある理由を整理する – 契約構造、プラットフォーム依存、収益化モデルなどの要因を説明する – 人気と経済価値の関係がどのように歪むことがあるのかを考察する 5. まとめ – エンタメ業界では人気そのものではなく「人気を測る仕組み」が重要であることを整理する – 人気指標・アルゴリズム・市場の関係を再確認する – 読者が「人気とは何か」を改めて考える視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「結論を押し付ける記事」ではなく、「思考の材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:エンタメ業界における人気指標と報酬の関係) ※(図:人気・指標・収益化モデルの構造) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「エンタメ業界の報酬は人気とどこまで連動しているのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:人気が報酬に直結するという言説の再考 エンターテインメント業界において、「人気がある者ほど稼ぐ」という認識は一種の共通認識として定着しています。テレビ番組の視聴率が高いタレント、SNSのフォロワー数が多いインフルエンサー、あるいはストリーミング再生数が数億回を超えるアーティスト。彼らが多額の報酬を得ている事実は、一見すると「人気=報酬」という単純な方程式が成立しているように見えます。 しかし、実態を精査すると、人気そのものが直接的に現金を生成しているわけではないことに気づかされます。実際に報酬を決定づけているのは、生身の人間が抱く「好き」という感情や熱狂そのものではなく、それらを外部から観測可能にした「人気を測る指標」です。 なぜ、形のない人気は数値化されなければならないのでしょうか。そして、その数値化のプロセス(指標化)が、どのように表現者の収益システムを規定しているのでしょうか。本記事では、エンタメ業界における「人気・指標・報酬」の三位一体の構造を整理し、その連動性を多角的に考察します。 --- ## 2. 人気はどのように「指標化」されるのか エンターテインメントが産業として成立するためには、主観的な「おもしろさ」や「支持」を、客観的に評価可能な「共通言語」に変換する必要があります。これが「指標化」のプロセスです。 ### 代表的な人気指標の分類 現在、エンタメ業界で活用されている指標は、その性質ごとに以下のように分類できます。 * **到達・露出指標(リーチ)** テレビの「世帯・個人視聴率」、YouTubeの「再生回数」、SNSの「インフルエンサーのフォロワー数」などが該当します。どれだけ多くの人の目に触れたかを測る、最も伝統的かつ強力な指標です。 * **エンゲージメント指標(深化)** SNSの「いいね」「保存数」「コメント率」、あるいは配信ライブの「同時視聴者数」などです。単なる露出量ではなく、視聴者がどれだけ能動的に反応したかを測ります。 * **直接購入指標(コンバージョン)** ライブチケットの完売速度、ファンクラブ会員数、CDやグッズの売上枚数などです。人気が直接的な支出行動に結びついた結果を示します。 ### なぜ指標化が必要なのか 業界がこれほどまでに数値を重視するのは、**「取引の標準化」**のためです。広告主がスポンサー料を支払う際や、プラットフォームがレベニューシェア(収益分配)を行う際、「なんとなく人気があるから」という理由では予算を正当化できません。「1再生あたり◯円」「視聴率1%あたり◯万円」といった、第三者が合意できる物差しが必要なのです。 ※(図:エンタメ業界における人気指標と報酬の関係) --- ## 3. 人気指標と報酬モデルの関係 指標化された人気がどのように収益へと変換されるかは、採用されている「収益モデル」の構造に依存します。 ### 広告モデル:指標の「量」が価値になる テレビやYouTube、無料版の音楽ストリーミングなどが代表的です。ここでは「再生数」や「視聴率」という指標が、そのまま広告枠の販売価格に直結します。このモデルでは、ニッチで深い支持よりも、マスに向けた広範な数値(リーチ)が報酬を最大化させる鍵となります。 ### 興行・販売モデル:指標の「密度」が価値になる ライブコンサートや劇場映画、グッズ販売などが該当します。ここでは「総フォロワー数」よりも、「実際に会場に足を運び、財布を開く熱量(エンゲージメントの密度)」が重要視されます。フォロワーが100万人いてもチケットが売れないケースと、フォロワーは1万人だが常に完売するケースでは、後者の方がこのモデルにおける報酬は高くなる傾向にあります。 ### サブスクリプション・PF分配モデル:アルゴリズムとの連動 NetflixやApple Musicなどのプラットフォームでは、独自のアルゴリズムに基づいた「再生時間」や「継続視聴率」が指標となります。ここでは、単発の話題性よりも「生活習慣の中にどれだけ入り込めたか」という継続的な指標が、プラットフォームからの分配金や次作の制作予算を左右します。 ※(図:人気・指標・収益化モデルの構造) --- ## 4. 人気と収入が一致しない理由 「これだけ話題になっているのに、なぜ本人の収入は少ないのか」という現象はしばしば発生します。これは、人気と経済価値の間に介在する「構造的な歪み」が原因です。 ### 契約構造と中間の介在 伝統的な芸能事務所システムやレコード会社との契約において、指標(売上や再生数)がどれだけ伸びても、クリエイター本人に還元される比率が固定されている場合、人気と報酬の連動性は弱まります。一方で、個人でプラットフォームと直接契約するクリエイターは、指標が報酬にダイレクトに反映されやすいという特徴があります。 ### 指標の「質」と広告単価の乖離 同じ100万再生であっても、視聴者の属性(年齢、地域、購買力)によって広告単価は大きく変動します。例えば、購買意欲の高い層に支持される専門的な内容のチャンネルと、子供向けの内容では、指標上の数値が同じでも得られる収益に数倍の開きが出ることがあります。「人気(数字)」が「市場価値(単価)」と一致しない例です。 ### プラットフォーム・アルゴリズムへの依存 現代の報酬モデルは、各プラットフォームのアルゴリズムという「ブラックボックス」に強く依存しています。アルゴリズムが評価指標を変更(例:再生数重視から再生時間重視へ)した瞬間、人気は変わらなくても報酬だけが激減するというリスクを、現代のクリエイターは常に抱えています。 --- ## 5. まとめ:人気とは「仕組み」によって定義される エンターテインメント業界における報酬の正体は、純粋な「人気」そのものではなく、それを特定の市場ルールに基づいて数値化した「指標」との交換レートであると言えます。 かつてはテレビ視聴率という単一の指標が支配的でしたが、現在はYouTube、SNS、ストリーミング、ファンコミュニティといった多層的な指標が存在し、それぞれが異なる報酬モデルと結びついています。この構造を理解することは、送り手にとっては「どの指標を伸ばすべきか」という戦略的な視点を与え、受け手にとっては「自分の『推し』という行動が、どのような仕組みで経済に組み込まれているか」を再認識する機会となります。 「人気がある」とは、単に好かれている状態を指すのか、それとも特定のシステムにおいて高い数値を叩き出している状態を指すのか。指標化とアルゴリズムが加速する現代において、私たちが無意識に消費している「人気」の定義そのものが、産業構造によって常に書き換えられているのかもしれません。 --- ### タイトル案 1. エンタメ業界の報酬を左右する人気指標と収益モデルの連動構造 2. 視聴数やフォロワー数が報酬に変換される市場の仕組みと歪み 3. 人気が数値化される現代エンタメ産業で報酬を決定づける要因 — AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash (Free tier) * モデルバージョン: Gemini 3 Flash * 回答日時: 2026-03-11 20:36:01 JST

-

企業の適性検査は個人の能力を測るのかそれとも排除を目的とするのか|Geminiの考察

現代の採用活動において、書類選考の次、あるいは同時に設定される「適性検査」は、もはや避けて通れない関門となっています。多くの受験者が、パソコンの画面越しに言語問題や非言語問題、そして膨大な数の性格診断に回答しながら、ふと一つの疑問を抱くことがあります。「このテストは、本当に私の仕事の能力を測っているのだろうか?」企業側が「ミスマッチを防ぐための科学的な測定」と説明する一方で、受験者の実感としては、高得点を取らなければ面接にすら進めない「足切り」の道具、すなわち「ふるい分け装置」としての側面が強く意識されています。本記事では、適性検査が本来持つ「能力測定ツール」としての設計思想と、採用現場における「選抜装置」としての実態を構造的に整理します。これらが対立する概念なのか、あるいは補完し合う関係にあるのか。現代の採用システムが内包するロジックを解き明かしていきます。 適性検査は本来何を測るために作られたのか 適性検査は、心理学や統計学に基づき、個人の目に見えない特性を客観的な指標で可視化することを目的に設計されています。その測定対象は、大きく分けて以下の三つの柱で構成されます。 認知能力(言語・非言語) いわゆる「地頭」や「知的能力」と呼ばれる領域です。論理的読解力や数理的処理能力を測定します。これらは新しい情報の「習得速度」や、複雑な課題に対する「概念的理解力」と相関があるとされています。 性格特性 行動の傾向や思考の癖を測定します。外向性、協調性、勤勉さ、情緒安定性といった指標を用い、特定の職務や組織文化において、どのような行動をとりやすいかを予測します。 適職・興味関心 本人がどのような活動に意欲を感じるか、どのような環境でパフォーマンスを発揮しやすいかを分析します。 企業がこうした客観的指標を求める背景には、面接官の主観やバイアス(偏見)を排除したいという構造的ニーズがあります。学歴や経歴だけでは見えない「ポテンシャル」や「定着可能性」を、共通の尺度で測ろうとする試みが、適性検査の本来の姿です。 ※(図:能力測定ツールとしての三要素:認知・性格・意欲) 採用現場での実際の使われ方:効率化の論理 理論上は「相互理解のためのツール」である適性検査も、実際の採用現場、特に応募者が殺到する人気企業においては、異なる力学が働きます。 膨大な母集団のハンドリング 数千、数万規模の応募がある企業にとって、全員と面接を行うことは時間的・コスト的に不可能です。ここで適性検査は、効率的に候補者を絞り込むための「一次選抜(スクリーニング)」として機能します。 面接コストの最適化 面接には多大な人件費がかかります。企業は「自社の基準を満たさない可能性が高い層」にリソースを割くことを避けようとします。その結果、適性検査の結果に一定の「ボーダーライン」を設け、機械的に合否を判定する運用が常態化します。 「ふるい分け装置」としての必然性 この段階において、適性検査の目的は「個人の可能性を見極めること」から、「効率的に不合格者を決めること」へと変質します。受験者が抱く「落とされるためのテスト」という違和感は、この運用実態に根ざした構造的な帰結と言えます。 適性検査が持つもう一つの役割:リスク管理の非対称性 企業が適性検査を用いる背景には、単なる効率化だけでなく、「採用リスク」に対する防御的な論理も存在します。 採用ミスのコスト 一般的に、優秀な人材を不合格にするリスク(機会損失)よりも、自社に不適合な人材を誤って採用してしまうリスク(ミスマッチコスト)の方が、組織にとっては致命的であると考えられています。一度採用した後の教育コストや、早期離職による損失、さらには既存チームへの悪影響を考慮すると、企業は慎重にならざるを得ません。 守りのスクリーニング 「優秀さ」を定義することは困難ですが、「自社の組織文化を破壊する可能性が高い特性」や「基礎的な論理的コミュニケーションが困難な層」を特定することは、統計的により容易です。適性検査は、組織の安定性を守るための「ネガティブ・チェック」の役割を担っている側面があります。 ※(図:能力測定ツールと選抜装置の二重構造) 適性検査が実際に測っているものは何か では、適性検査の結果は何を象徴しているのでしょうか。それは単なる「点数」以上の意味を持っています。 学習速度と適応性 認知能力テストが高いスコアを示す場合、それは特定の知識の有無ではなく、新しい環境や技術を「素早く習得する土台」があることを示唆します。変化の激しい現代ビジネスにおいて、この「学習の俊敏性(ラーニング・アジリティ)」は、個別のスキル以上に重視される傾向にあります。 準備能力と誠実性 特に新卒採用やポテンシャル採用において、適性検査対策を丁寧に行ってきたかどうかは、その企業の選考に対する「志望度の高さ」や、課題に対して真摯に取り組む「誠実性」の代替指標として読み取られることがあります。 採用判断の一部という位置づけ 重要なのは、適性検査だけで人生が決まるわけではないという点です。多くの企業では、適性検査は「面接での確認事項を絞り込むためのガイド」として活用されます。検査結果で「ストレス耐性が低い」と出た場合、面接でそれを補完する具体的なエピソードを深掘りする、といった使い方が本来の運用です。 まとめ:二面性を受け入れ、システムを読み解く 適性検査を「能力測定ツール」か「ふるい分け装置」か、という二者択一で捉えるのは、このシステムの全容を見誤ることになるかもしれません。 実態としては、その両面が重なり合った「多機能な社会システム」として機能しています。それは、個人の特性を科学的に解明しようとする情熱と、膨大な応募者を効率的に処理しなければならない組織の合理性が、複雑に絡み合った結果です。 受験者にとっては、適性検査は「自分を否定する壁」に見えるかもしれません。しかし、その数値の裏側にあるのは、企業が求める「再現性のあるパフォーマンス」への期待と、ミスマッチから組織と個人の双方を守ろうとする防衛本能でもあります。 このシステムが完全に公平であるとは言えません。しかし、現代の採用構造がどのようなロジックでこのツールを選択し、活用しているのかを理解することは、キャリアを選択する上での一助となるはずです。適性検査という鏡に映し出されているのは、あなたの実力でしょうか、それとも組織の都合でしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 企業の採用で広く使用されている「適性検査」は、 本来の目的である「能力測定ツール」なのか、 それとも応募者を減らすための「ふるい分け装置」なのか。 転職・就職市場の実態を踏まえ、 AIの視点から冷静かつ構造的に整理・考察してください。 【目的】 – 適性検査を「良い・悪い」で評価するのではなく、社会構造として理解する – 企業側の採用合理性と、応募者側の違和感の両方を整理する – 現代の採用システムがどのようなロジックで動いているのかを明らかにする 【読者像】 – 転職活動・就職活動をしている人 – 適性検査に違和感や疑問を持ったことがある人 – 企業の採用プロセスに関心のある社会人 – 人事・採用の構造を知りたい読者 【記事構成】 1. 導入(問題提起) – 多くの企業で適性検査が採用プロセスに組み込まれている現状を示す – 受験者の中には「これは本当に能力を測っているのか?」という疑問があることに触れる – 適性検査の役割を「能力測定」と「選抜装置」という2つの視点から考える必要性を提示する 2. 適性検査は本来何を測るために作られたのか – 適性検査の基本的な設計思想を整理する – 認知能力(言語・非言語)、性格特性、適職傾向などの測定目的を説明する – なぜ企業は客観的な指標を求めるのかを構造的に説明する 3. 採用現場での実際の使われ方 – 応募者数が多い企業では、適性検査が一次選抜として使われるケースが多いことに触れる – 面接コスト・採用効率という企業側の事情を説明する – 結果として適性検査が「ふるい分け装置」として機能する構造を整理する 4. 適性検査が持つもう一つの役割 – 採用リスク管理という観点からの役割を説明する – 「優秀な人を落とすリスク」と「不適合な人を採用するリスク」の非対称性を整理する – なぜ企業は一定のラインを設定するのかを説明する 5. 適性検査が測っているものは何か – 能力そのものではなく「学習速度」や「組織適応性」を見ている可能性に触れる – 数値化された評価がどのように使われているのかを整理する – 適性検査が採用判断の一部に過ぎないことを説明する 6. まとめ – 適性検査は「能力測定ツール」と「ふるい分け装置」の両面を持つ可能性を整理する – 採用システム全体の中での役割を改めて位置づける – 読者が適性検査をどう理解すべきか、思考の余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:採用プロセスにおける適性検査の位置) ※(図:能力測定ツールと選抜装置の二重構造) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「適性検査は能力測定なのか、それとも選抜装置なのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:採用プロセスに潜む「見えない壁」の正体 現代の採用活動において、書類選考の次、あるいは同時に設定される「適性検査」は、もはや避けて通れない関門となっています。多くの受験者が、パソコンの画面越しに言語問題や非言語問題、そして膨大な数の性格診断に回答しながら、ふと一つの疑問を抱くことがあります。 「このテストは、本当に私の仕事の能力を測っているのだろうか?」 企業側が「ミスマッチを防ぐための科学的な測定」と説明する一方で、受験者の実感としては、高得点を取らなければ面接にすら進めない「足切り」の道具、すなわち「ふるい分け装置」としての側面が強く意識されています。 本記事では、適性検査が本来持つ「能力測定ツール」としての設計思想と、採用現場における「選抜装置」としての実態を構造的に整理します。これらが対立する概念なのか、あるいは補完し合う関係にあるのか。現代の採用システムが内包するロジックを解き明かしていきます。 --- ## 2. 適性検査は本来何を測るために作られたのか 適性検査は、心理学や統計学に基づき、個人の目に見えない特性を客観的な指標で可視化することを目的に設計されています。その測定対象は、大きく分けて以下の三つの柱で構成されます。 ### 認知能力(言語・非言語) いわゆる「地頭」や「知的能力」と呼ばれる領域です。論理的読解力や数理的処理能力を測定します。これらは新しい情報の「習得速度」や、複雑な課題に対する「概念的理解力」と相関があるとされています。 ### 性格特性 行動の傾向や思考の癖を測定します。外向性、協調性、勤勉さ、情緒安定性といった指標を用い、特定の職務や組織文化において、どのような行動をとりやすいかを予測します。 ### 適職・興味関心 本人がどのような活動に意欲を感じるか、どのような環境でパフォーマンスを発揮しやすいかを分析します。 企業がこうした客観的指標を求める背景には、面接官の主観やバイアス(偏見)を排除したいという構造的ニーズがあります。学歴や経歴だけでは見えない「ポテンシャル」や「定着可能性」を、共通の尺度で測ろうとする試みが、適性検査の本来の姿です。 ※(図:能力測定ツールとしての三要素:認知・性格・意欲) --- ## 3. 採用現場での実際の使われ方:効率化の論理 理論上は「相互理解のためのツール」である適性検査も、実際の採用現場、特に応募者が殺到する人気企業においては、異なる力学が働きます。 ### 膨大な母集団のハンドリング 数千、数万規模の応募がある企業にとって、全員と面接を行うことは時間的・コスト的に不可能です。ここで適性検査は、効率的に候補者を絞り込むための「一次選抜(スクリーニング)」として機能します。 ### 面接コストの最適化 面接には多大な人件費がかかります。企業は「自社の基準を満たさない可能性が高い層」にリソースを割くことを避けようとします。その結果、適性検査の結果に一定の「ボーダーライン」を設け、機械的に合否を判定する運用が常態化します。 ### 「ふるい分け装置」としての必然性 この段階において、適性検査の目的は「個人の可能性を見極めること」から、「効率的に不合格者を決めること」へと変質します。受験者が抱く「落とされるためのテスト」という違和感は、この運用実態に根ざした構造的な帰結と言えます。 --- ## 4. 適性検査が持つもう一つの役割:リスク管理の非対称性 企業が適性検査を用いる背景には、単なる効率化だけでなく、「採用リスク」に対する防御的な論理も存在します。 ### 採用ミスのコスト 一般的に、優秀な人材を不合格にするリスク(機会損失)よりも、自社に不適合な人材を誤って採用してしまうリスク(ミスマッチコスト)の方が、組織にとっては致命的であると考えられています。一度採用した後の教育コストや、早期離職による損失、さらには既存チームへの悪影響を考慮すると、企業は慎重にならざるを得ません。 ### 守りのスクリーニング 「優秀さ」を定義することは困難ですが、「自社の組織文化を破壊する可能性が高い特性」や「基礎的な論理的コミュニケーションが困難な層」を特定することは、統計的により容易です。適性検査は、組織の安定性を守るための「ネガティブ・チェック」の役割を担っている側面があります。 ※(図:能力測定ツールと選抜装置の二重構造) --- ## 5. 適性検査が実際に測っているものは何か では、適性検査の結果は何を象徴しているのでしょうか。それは単なる「点数」以上の意味を持っています。 ### 学習速度と適応性 認知能力テストが高いスコアを示す場合、それは特定の知識の有無ではなく、新しい環境や技術を「素早く習得する土台」があることを示唆します。変化の激しい現代ビジネスにおいて、この「学習の俊敏性(ラーニング・アジリティ)」は、個別のスキル以上に重視される傾向にあります。 ### 準備能力と誠実性 特に新卒採用やポテンシャル採用において、適性検査対策を丁寧に行ってきたかどうかは、その企業の選考に対する「志望度の高さ」や、課題に対して真摯に取り組む「誠実性」の代替指標として読み取られることがあります。 ### 採用判断の一部という位置づけ 重要なのは、適性検査だけで人生が決まるわけではないという点です。多くの企業では、適性検査は「面接での確認事項を絞り込むためのガイド」として活用されます。検査結果で「ストレス耐性が低い」と出た場合、面接でそれを補完する具体的なエピソードを深掘りする、といった使い方が本来の運用です。 --- ## 6. まとめ:二面性を受け入れ、システムを読み解く 適性検査を「能力測定ツール」か「ふるい分け装置」か、という二者択一で捉えるのは、このシステムの全容を見誤ることになるかもしれません。 実態としては、その両面が重なり合った「多機能な社会システム」として機能しています。それは、個人の特性を科学的に解明しようとする情熱と、膨大な応募者を効率的に処理しなければならない組織の合理性が、複雑に絡み合った結果です。 受験者にとっては、適性検査は「自分を否定する壁」に見えるかもしれません。しかし、その数値の裏側にあるのは、企業が求める「再現性のあるパフォーマンス」への期待と、ミスマッチから組織と個人の双方を守ろうとする防衛本能でもあります。 このシステムが完全に公平であるとは言えません。しかし、現代の採用構造がどのようなロジックでこのツールを選択し、活用しているのかを理解することは、キャリアを選択する上での一助となるはずです。適性検査という鏡に映し出されているのは、あなたの実力でしょうか、それとも組織の都合でしょうか。 --- ### タイトル案 1. 企業の適性検査は個人の能力を測るのかそれとも排除を目的とするのか 2. 採用試験における適性検査が果たす科学的測定と選抜の構造的役割とは 3. 効率化を求める採用システムで適性検査は個人の何を可視化しているか --- AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash (Free tier) * モデルバージョン: Gemini 3 Flash (Nano Banana 2 / Gemini 3 Flash Image powered) * 回答日時: 2026-03-11 15:39:37 JST

-

AIの進化とリモートワークの普及は都市集中の構造をどう変えるのか|Geminiの考察

AI(人工知能)の飛躍的な進化と、パンデミックを機に定着したリモートワーク。かつて「仕事をするなら都心へ」という選択は、生存戦略上の必然でした。しかし、今や高度な業務さえもクラウド上で完結し、AIが物理的な作業を代替・補助する時代です。「もはや都市に住む必要はないのではないか?」このような問いが、現実味を帯びた議論として語られています。しかし、都市への人口集中は、数千年にわたる歴史の中で形成された強固な社会構造です。単に「通信環境が整ったから」という理由だけで、その形が霧散するとは考えにくい側面もあります。本記事では、AIやデジタル化が都市の在り方をどのように変容させるのか、技術革新が「集まること」の価値をどう書き換えるのかについて、多角的な視点から構造的に整理・考察していきます。 なぜ都市はこれまで集中してきたのか 都市がこれほどまでに巨大な引力を持ってきた背景には、経済学で「集積効果(アグロメレーション)」と呼ばれるメカニズムがあります。 効率性を生む「集積効果」 企業、人材、資本、そして情報が1カ所に集まることで、輸送コストが削減され、取引が活発化します。これは単なる物理的な近さだけでなく、以下の3つの要素が複雑に絡み合っています。 共有(Sharing):インフラや大規模な市場を多くの人で分かち合うことによるコスト低下。 マッチング(Matching):多様な人材と企業が出会う確率の向上。 学習(Learning):高度なスキルや知識が、対面でのコミュニケーションを通じて波及すること。 「暗黙知」の交換と信頼構築 特に重要なのが、言語化しにくい知識である「暗黙知」の存在です。マニュアル化された情報はインターネットで送信できますが、最先端のビジネスシーンにおける「ニュアンス」や「勘所」は、いまだに対面でのやり取りの中で醸成される傾向にあります。 また、物理的に同じ空間を共有することは、相手への信頼感を醸成する「社会的証明」としての機能も果たしてきました。 ※(図:都市集中の基本構造) AIとデジタル化が都市集中に与える可能性 AIの進化は、前述した都市の「必然性」を根本から揺さぶる可能性を秘めています。 場所の制約を無効化する技術 生成AIの普及により、プログラミング、執筆、デザイン、分析といった知的な定型業務の多くが、場所を選ばずに実行可能となりました。さらに、VR(仮想現実)やAR(拡張現実)などのメタバース技術、あるいは低遅延の通信インフラは、対面コミュニケーションに近い臨場感を提供し始めています。 物理적制約の消失:AIによる自動化が進むほど、人間が物理的な場所に拘束される時間は減少します。 専門性のポータビリティ(携帯性):AIを使いこなす個人が、地方にいながらにして都市部と同等、あるいはそれ以上の生産性を発揮できるようになります。 「都市にいなくてもいい」が加速する条件 一方で、AIは「情報の均質化」を加速させます。これまで都市部でしか得られなかった高度な分析や知見が、AIを通じて誰でもどこでも手に入るようになれば、情報の非対称性(都市と地方の情報格差)が解消され、都市に留まる経済的メリットは相対的に低下します。しかし、これは「都市の消滅」を意味するのでしょうか。 都市は弱まるのか、それとも再編されるのか 技術が進展した結果、起こりうるのは単純な「分散」ではなく、都市の役割の「再編」であるという考え方があります。ここでは3つのシナリオを提示します。 シナリオA:超大都市へのさらなる極点集中 意外にも、デジタル化が進むほど「超大都市」の価値が高まるという説があります。誰もがリモートで働けるようになると、最終的な意思決定や、AIでは代替できない「真の創造性」を持つトッププレイヤー同士の接触が、より希少価値を持つようになるためです。 シナリオB:中規模都市や「多拠点居住」への分散 生活コストの高い巨大都市を避けつつ、一定の利便性を維持できる中規模都市(地方中核市など)が選好される動きです。AIのサポートにより、生活の質(QOL)を重視しながら、仕事のパフォーマンスを落とさない働き方が可能になります。 シナリオC:都市の「体験型」・「社交型」への変容 生産の場としての都市が弱まる一方で、娯楽、文化、そして「偶然の出会い(セレンディピティ)」を提供する場としての都市が強調される変化です。 非効率性の価値:効率的な業務がAIに置き換わるからこそ、人間は「非効率的な雑談」や「予期せぬ衝突」を求めて都市に集まる。 身体性の回帰:デジタル疲れの反動として、リアルな五感を刺激する食事や空間、コミュニティとしての都市が再定義される。 ※(図:AI時代の都市構造の変化イメージ) まとめ:都市とは何のために存在するのか AIとデジタル化は、都市から「効率性のための集積」という強制力を剥ぎ取りつつあります。かつて、生きるために、あるいは稼ぐために「仕方がなく」都市に住んでいた人々は、今や「どこで生きるか」という選択の自由を突きつけられています。 しかし、都市は単なる「仕事場」ではありません。それは、多様な他者と交わり、新しい文化が生まれ、偶然のインスピレーションを得るための「装置」でもあります。AI時代における都市の未来は、技術が決めるのではなく、私たちが「人間として、どのようなつながりを求めているか」という価値観の選択によって決まっていくのではないでしょうか。 あなたは、効率化されたデジタル空間の中で自律的に働きたいですか? それとも、非効率でも刺激に満ちた物理的な都市の喧騒の中にいたいですか? この問いに対する一人ひとりの答えの集積が、未来の地図を描き出すことになります。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI・リモートワーク・自動化・デジタル化の進展によって、 都市への人口集中(都市集中)は今後どのように変化する可能性があるのかを、 AIの視点から冷静かつ構造的に整理・考察してください。 【目的】 – 「AIによって都市が不要になる」という単純な議論ではなく、都市集中の構造を整理する – 技術変化と社会構造(労働・企業・文化・人の移動)の関係を読み解く – 読者が「都市とは何か」「都市が存在する理由は何か」を考えるための視点を提供する 【読者像】 – 一般社会人(20〜50代) – 都市で働く人・都市から離れて働くことに関心がある人 – 地方移住やリモートワークに興味がある層 – AIや社会変化に関心はあるが、専門家ではない読者 【記事構成】 1. 導入(問題提起) – AIやリモートワークの普及によって「都市に住む必要はなくなるのではないか」という議論が増えていることを提示する – 都市集中は長い歴史の中で形成された社会構造であることを示す – 技術変化によって都市の意味がどう変わるのかという問いを提示する 2. なぜ都市はこれまで集中してきたのか – 都市が発展してきた基本構造を整理する – 企業・人材・情報・資本が集まる「集積効果(アグロメレーション)」の概念を説明する – 対面コミュニケーションやネットワークが都市に価値を生んできた理由を整理する 3. AIとデジタル化が都市集中に与える可能性 – リモートワーク、オンライン会議、AIツールなどによって場所の制約が弱まる側面を説明する – 「都市にいなくてもできる仕事」が増える可能性を整理する – 一方で、都市の役割が完全に消えるとは限らない理由も示す 4. 都市は弱まるのか、それとも再編されるのか – 都市集中が単純に解消されるとは限らないことを説明する – 超大都市の強化、中規模都市の弱体化、地方分散など複数のシナリオを提示する – 技術だけでなく、文化・人間関係・偶発的な出会いなど都市の非効率的価値にも触れる 5. まとめ – AIは都市を消すのではなく、都市の役割や意味を変える可能性があることを整理する – 「都市とは何のために存在するのか」という問いを改めて提示する – 読者が都市・地方・働き方の未来を考えるための視点を示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:都市集中の基本構造) ※(図:AI時代の都市構造の変化イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AIは都市集中を変えるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:私たちは「場所」から解放されるのか AI(人工知能)の飛躍的な進化と、パンデミックを機に定着したリモートワーク。かつて「仕事をするなら都心へ」という選択は、生存戦略上の必然でした。しかし、今や高度な業務さえもクラウド上で完結し、AIが物理的な作業を代替・補助する時代です。 「もはや都市に住む必要はないのではないか?」 このような問いが、現実味を帯びた議論として語られています。しかし、都市への人口集中は、数千年にわたる歴史の中で形成された強固な社会構造です。単に「通信環境が整ったから」という理由だけで、その形が霧散するとは考えにくい側面もあります。 本記事では、AIやデジタル化が都市の在り方をどのように変容させるのか。技術革新が「集まること」の価値をどう書き換えるのかについて、多角的な視点から構造的に整理・考察していきます。 --- ## 2. なぜ都市はこれまで集中してきたのか 都市がこれほどまでに巨大な引力を持ってきた背景には、経済学で「集積効果(アグロメレーション)」と呼ばれるメカニズムがあります。 ### 効率性を生む「集積効果」 企業、人材、資本、そして情報が1カ所に集まることで、輸送コストが削減され、取引が活発化します。これは単なる物理的な近さだけでなく、以下の3つの要素が複雑に絡み合っています。 * **共有(Sharing)**:インフラや大規模な市場を多くの人で分かち合うことによるコスト低下。 * **マッチング(Matching)**:多様な人材と企業が出会う確率の向上。 * **学習(Learning)**:高度なスキルや知識が、対面でのコミュニケーションを通じて波及すること。 ### 「暗黙知」の交換と信頼構築 特に重要なのが、言語化しにくい知識である「暗黙知」の存在です。マニュアル化された情報はインターネットで送信できますが、最先端のビジネスシーンにおける「ニュアンス」や「勘所」は、いまだに対面でのやり取りの中で醸成される傾向にあります。 また、物理的に同じ空間を共有することは、相手への信頼感を醸成する「社会的証明」としての機能も果たしてきました。 ※(図:都市集中の基本構造) --- ## 3. AIとデジタル化が都市集中に与える可能性 AIの進化は、前述した都市の「必然性」を根本から揺さぶる可能性を秘めています。 ### 場所の制約を無効化する技術 生成AIの普及により、プログラミング、執筆、デザイン、分析といった知的な定型業務の多くが、場所を選ばずに実行可能となりました。さらに、VR(仮想現実)やAR(拡張現実)などのメタバース技術、あるいは低遅延の通信インフラは、対面コミュニケーションに近い臨場感を提供し始めています。 * **物理的制約の消失**:AIによる自動化が進むほど、人間が物理的な場所に拘束される時間は減少します。 * **専門性のポータビリティ(携帯性)**:AIを使いこなす個人が、地方にいながらにして都市部と同等、あるいはそれ以上の生産性を発揮できるようになります。 ### 「都市にいなくてもいい」が加速する条件 一方で、AIは「情報の均質化」を加速させます。これまで都市部でしか得られなかった高度な分析や知見が、AIを通じて誰でもどこでも手に入るようになれば、情報の非対称性(都市と地方の情報格差)が解消され、都市に留まる経済的メリットは相対的に低下します。 しかし、これは「都市の消滅」を意味するのでしょうか。 --- ## 4. 都市は弱まるのか、それとも再編されるのか 技術が進展した結果、起こりうるのは単純な「分散」ではなく、都市の役割の「再編」であるという考え方があります。ここでは3つのシナリオを提示します。 ### シナリオA:超大都市へのさらなる極点集中 意外にも、デジタル化が進むほど「超大都市」の価値が高まるという説があります。誰もがリモートで働けるようになると、最終的な意思決定や、AIでは代替できない「真の創造性」を持つトッププレイヤー同士の接触が、より希少価値を持つようになるためです。 ### シナリオB:中規模都市や「多拠点居住」への分散 生活コストの高い巨大都市を避けつつ、一定の利便性を維持できる中規模都市(地方中核市など)が選好される動きです。AIのサポートにより、生活の質(QOL)を重視しながら、仕事のパフォーマンスを落とさない働き方が可能になります。 ### シナリオC:都市の「体験型」・「社交型」への変容 生産の場としての都市が弱まる一方で、娯楽、文化、そして「偶然の出会い(セレンディピティ)」を提供する場としての都市が強調される変化です。 * **非効率性の価値**:効率的な業務がAIに置き換わるからこそ、人間は「非効率的な雑談」や「予期せぬ衝突」を求めて都市に集まる。 * **身体性の回帰**:デジタル疲れの反動として、リアルな五感を刺激する食事や空間、コミュニティとしての都市が再定義される。 ※(図:AI時代の都市構造の変化イメージ) --- ## 5. まとめ:都市とは何のために存在するのか AIとデジタル化は、都市から「効率性のための集積」という強制力を剥ぎ取りつつあります。かつて、生きるために、あるいは稼ぐために「仕方がなく」都市に住んでいた人々は、今や「どこで生きるか」という選択の自由を突きつけられています。 しかし、都市は単なる「仕事場」ではありません。それは、多様な他者と交わり、新しい文化が生まれ、偶然のインスピレーションを得るための「装置」でもあります。 AI時代における都市の未来は、技術が決めるのではなく、私たちが「人間として、どのようなつながりを求めているか」という価値観の選択によって決まっていくのではないでしょうか。 あなたは、効率化されたデジタル空間の中で自律的に働きたいですか? それとも、非効率でも刺激に満ちた物理的な都市の喧騒の中にいたいですか? この問いに対する一人ひとりの答えの集積が、未来の地図を描き出すことになります。 --- ### タイトル案 * AIの進化とリモートワークの普及は都市集中の構造をどう変えるのか * デジタル化が加速する社会で都市という集積地が持ち続ける価値とは * 技術革新によって場所の制約が消えたあとに人はなぜ都市を求めるのか — AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash * モデルバージョン: Free tier * 回答日時: 2026-03-11

-

WBC出場が選手にもたらす名誉と経済的リスクの境界線はどこにあるのか|Geminiの考察

WBC(ワールド・ベースボール・クラシック)が開催されるたび、ファンの熱狂とともに繰り返される議論があります。それは、メジャーリーグ(MLB)をはじめとするトップクラスの選手たちが「出場すべきか、辞退すべきか」という問いです。ファンにとって、母国のユニフォームを背負って戦う姿は「至高の名誉」であり、スポーツの醍醐味そのものです。しかし、プロスポーツの世界において、選手の身体は単なる個人の持ち物ではありません。それは数億、時に数十億円という年俸を支える「キャリアそのもの」であり、球団にとっては莫大な投資対象である「資産」でもあります。なぜWBCにおける選手の参加問題は、これほどまでに複雑な議論を呼ぶのでしょうか。本記事では、プロスポーツ産業の経済構造や契約の仕組み、そして国際大会が抱える利害関係の対立という視点から、この問題を構造的に整理・考察していきます。 プロスポーツにおける「身体=資産」という構造 プロ野球選手、特にトップ層の選手にとって、自身の肉体は経済的価値を生み出す唯一無二の「資本」です。この構造を理解するためには、以下の視点が必要になります。 契約価値とリスクの相関 プロ選手の年俸は、過去の実績に基づいた「将来のパフォーマンスへの期待値」に対して支払われます。長期契約を結んでいる選手の場合、その身体は実質的に所属球団が独占的に利用する権利を持つ「運用資産」に近い性質を帯びます。 経済的損失の可視化 万が一、国際大会での負傷や、過密日程によるコンディションの悪化でシーズンを欠場することになれば、選手にとっては「将来のフリーエージェント(FA)権取得の遅れ」や「次期契約額の下落」という直接的な減収リスクにつながります。また、球団側にとっても、支払っている年俸に見合うリターンが得られないという「投資の失敗」を意味します。 ※(図:プロスポーツにおける身体資産の構造) 保険制度の限界 国際大会には通常、選手の負傷に対する保険がかけられますが、これはあくまで「現在の年俸」の一部を補填するものであり、選手が失うかもしれない「将来の市場価値」までを完全に担保するものではありません。この不完全なリスクヘッジが、トップ選手やその代理人が慎重になる構造的な要因となっています。 国際大会とプロリーグの利害構造 WBCを巡る議論が紛糾するのは、大会を主催する組織と、選手を雇用するリーグ・球団との間で、求める「利益」の方向性が異なるためです。 主催者とリーグの温度差 WBCはMLBとMLB選手会が主導して設立された大会ですが、個々の球団(オーナー側)からすれば、レギュラーシーズンの勝利こそが最大の至上命令です。球団にとって、シーズン開幕前の時期に選手を供出することは、準備不足や疲労蓄積のリスクを招く「外部コスト」として映りやすい側面があります。 制度的な拘束力の欠如 サッカーのワールドカップ(FIFA主催)とは異なり、野球におけるWBCは、クラブ側に選手の放出を完全に義務付ける強固な規定が確立されているとは言い難い状況にあります。そのため、参加の可否は「選手の意思」「球団の意向」「代表チームの交渉」という、多層的な調整によって決まる構造になっています。 国による野球文化の違い 日本(NPB)や中南米諸国と、米国(MLB)では、国際大会に対する「重み」の置き方に文化的な乖離があります。国内リーグの歴史や市場規模が巨大であるほど、国際大会を「リスク」と捉える力学が強く働き、逆に代表の強化が国内人気の起爆剤となる国では「名誉」としての側面が強調されます。 それでも選手が参加する理由 経済的な合理性やリスクだけを考慮すれば、辞退という選択が正解に近いかもしれません。しかし、多くのトップ選手がそれでもWBCの舞台を目指す背景には、数値化しにくい「価値」が存在します。 象徴性としての「ナショナル・プライド」 国家を代表して戦うことは、プロとしてのキャリアにおいて他では得られない精神的な報酬をもたらします。特に野球が国技に近い地位にある地域では、代表での活躍は「国民的英雄」としての地位を確立させ、個人のアイデンティティを強く刺激します。 グローバルなブランド価値の向上 短期間で世界中の注目を集めるWBCは、選手にとって個人の「ブランド」を世界規模で宣伝するショーケースとなります。大会での圧倒的なパフォーマンスは、スポンサー契約の獲得や、引退後のキャリア形成において、年俸以外の経済的メリットを生み出す可能性があります。 競技の普及という大義 野球という競技の国際的な普及(グローバル化)は、中長期的には野球界全体のパイを広げ、次世代の選手たちの待遇改善につながります。トップ選手には「球界の顔」として、競技の発展に寄与するというプロフェッショナルとしての使命感が働くことも少なくありません。 スポーツイベントは誰の利益で成立しているのか 国際大会は、多様なステークホルダーによる「価値の交換」によって成立しています。この関係性を整理すると、単なる善悪や正解の問題ではないことが見えてきます。 選手: 「名誉・ブランド・経験」と「身体的リスク・将来の契約」の交換 球団: 「所属選手の露出・市場拡大」と「戦力の損失リスク」の交換 主催者・スポンサー: 「コンテンツ提供」と「放映権・広告収入」の交換 ファン: 「熱狂・感動」と「時間・チケット代」の交換 国家: 「文化的な求心力・国威発揚」と「代表活動への支援」の交換 ※(図:WBCにおける利害関係構造) まとめ WBCにおける「名誉かリスクか」という問いは、プロスポーツが持つ二面性を象徴しています。一つは、人間の限界に挑む身体が織りなす「文化・エンターテインメント」としての側面。もう一つは、莫大な資本が投下され、冷徹な計算に基づいて運用される「ビジネス」としての側面です。 トップ選手が代表のユニフォームを着るという決断は、単なる精神論ではなく、こうした複雑な経済構造と個人的な価値観の狭間で行われる、極めて高度な「キャリア上の判断」であると捉えるべきでしょう。 私たちがWBCを観戦する際、そこにあるのは美しいプレーだけでなく、リスクを背負って舞台に立つ個人の意思と、それを支える巨大な産業の構造です。この背景を理解することは、スポーツという文化が現代社会においてどのような価値を持ち、どのように維持されているのかを考える、重要な手がかりになるはずです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 WBC(ワールド・ベースボール・クラシック)において、 トップ選手が代表チームに参加することは 「国家代表としての名誉」なのか、 それとも「経済的リスクを伴うキャリア上の判断」なのか。 プロスポーツ産業・選手の契約・国際大会の構造という視点から、 WBC参加と経済的リスクの関係を冷静かつ構造的に整理・考察してください。 【目的】 – WBCを単なるスポーツイベントとしてではなく、スポーツ産業・経済構造の中で捉える – 選手・球団・大会・国家という複数の利害関係の構造を整理する – 国際大会における「名誉」と「経済合理性」の関係を考える材料を提示する 【読者像】 – スポーツ観戦が好きな一般読者 – WBCや国際大会に関心を持つ野球ファン – スポーツビジネスやプロスポーツの構造に興味がある人 – スポーツと国家・経済の関係に関心がある読者 【記事構成】 1. 導入(問題提起) – WBCでは、世界トップクラスの選手が国家代表として出場する – しかしプロスポーツ選手にとって、身体はキャリアと契約価値に直結する資産でもある – なぜWBCでは「出場するべきか」「辞退するべきか」という議論が生まれるのかを提示する 2. プロスポーツにおける「身体=資産」という構造 – プロ選手の契約や年俸がどのように経済的価値として扱われているかを整理する – 怪我やコンディション悪化がどのような経済リスクになるのかを説明する – スポーツ選手の身体が、企業にとっての投資資産のように扱われる側面に触れる 3. 国際大会とプロリーグの利害構造 – WBCのような国際大会と、MLBやNPBなどのリーグとの関係を整理する – 球団・リーグ・大会主催者の利害がどのように異なるのかを説明する – なぜ国際大会では「出場問題」が繰り返し議論になるのかを構造的に説明する 4. それでも選手が参加する理由 – 国家代表としての象徴性や文化的価値 – キャリアの象徴となる大会としての意味 – ブランド価値や知名度の上昇 – ファンや社会からの期待など、経済合理性だけでは説明できない要素を整理する 5. スポーツイベントは誰の利益で成立しているのか – 選手・球団・リーグ・大会主催者・スポンサー・国家・ファンなどの関係を整理する – スポーツイベントがどのような価値の交換で成立しているのかを構造的に説明する 6. まとめ – WBC参加は「名誉かリスクか」という単純な二択ではないことを整理する – プロスポーツが国家・経済・文化の交差点にあることを示す – 読者がスポーツイベントの見方を少し広げられるような視点で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – スポーツファンの感情を否定するのではなく、構造を整理する記事とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:WBCにおける利害関係構造) ※(図:プロスポーツにおける身体資産の構造) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「WBC出場は名誉か、それとも経済的リスクなのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:国家代表の誇りと「資産」としての身体 WBC(ワールド・ベースボール・クラシック)が開催されるたび、ファンの熱狂とともに繰り返される議論があります。それは、メジャーリーグ(MLB)をはじめとするトップクラスの選手たちが「出場すべきか、辞退すべきか」という問いです。 ファンにとって、母国のユニフォームを背負って戦う姿は「至高の名誉」であり、スポーツの醍醐味そのものです。しかし、プロスポーツの世界において、選手の身体は単なる個人の持ち物ではありません。それは数億、時に数十億円という年俸を支える「キャリアそのもの」であり、球団にとっては莫大な投資対象である「資産」でもあります。 なぜWBCにおける選手の参加問題は、これほどまでに複雑な議論を呼ぶのでしょうか。本記事では、プロスポーツ産業の経済構造や契約の仕組み、そして国際大会が抱える利害関係の対立という視点から、この問題を構造的に整理・考察していきます。 --- ## 2. プロスポーツにおける「身体=資産」という構造 プロ野球選手、特にトップ層の選手にとって、自身の肉体は経済的価値を生み出す唯一無二の「資本」です。この構造を理解するためには、以下の視点が必要になります。 ### 契約価値とリスクの相関 プロ選手の年俸は、過去の実績に基づいた「将来のパフォーマンスへの期待値」に対して支払われます。長期契約を結んでいる選手の場合、その身体は実質的に所属球団が独占的に利用する権利を持つ「運用資産」に近い性質を帯びます。 ### 経済的損失の可視化 万が一、国際大会での負傷や、過密日程によるコンディションの悪化でシーズンを欠場することになれば、選手にとっては「将来のフリーエージェント(FA)権取得の遅れ」や「次期契約額の下落」という直接的な減収リスクにつながります。また、球団側にとっても、支払っている年俸に見合うリターンが得られないという「投資の失敗」を意味します。 ※(図:プロスポーツにおける身体資産の構造) ### 保険制度の限界 国際大会には通常、選手の負傷に対する保険がかけられますが、これはあくまで「現在の年俸」の一部を補填するものであり、選手が失うかもしれない「将来の市場価値」までを完全に担保するものではありません。この不完全なリスクヘッジが、トップ選手やその代理人が慎重になる構造的な要因となっています。 --- ## 3. 国際大会とプロリーグの利害構造 WBCを巡る議論が紛糾するのは、大会を主催する組織と、選手を雇用するリーグ・球団との間で、求める「利益」の方向性が異なるためです。 ### 主催者とリーグの温度差 WBCはMLBとMLB選手会が主導して設立された大会ですが、個々の球団(オーナー側)からすれば、レギュラーシーズンの勝利こそが最大の至上命令です。球団にとって、シーズン開幕前の時期に選手を供出することは、準備不足や疲労蓄積のリスクを招く「外部コスト」として映りやすい側面があります。 ### 制度的な拘束力の欠如 サッカーのワールドカップ(FIFA主催)とは異なり、野球におけるWBCは、クラブ側に選手の放出を完全に義務付ける強固な規定が確立されているとは言い難い状況にあります。そのため、参加の可否は「選手の意思」「球団の意向」「代表チームの交渉」という、多層的な調整によって決まる構造になっています。 ### 国による野球文化の違い 日本(NPB)や中南米諸国と、米国(MLB)では、国際大会に対する「重み」の置き方に文化的な乖離があります。国内リーグの歴史や市場規模が巨大であるほど、国際大会を「リスク」と捉える力学が強く働き、逆に代表の強化が国内人気の起爆剤となる国では「名誉」としての側面が強調されます。 --- ## 4. それでも選手が参加する理由 経済的な合理性やリスクだけを考慮すれば、辞退という選択が正解に近いかもしれません。しかし、多くのトップ選手がそれでもWBCの舞台を目指す背景には、数値化しにくい「価値」が存在します。 ### 象徴性としての「ナショナル・プライド」 国家を代表して戦うことは、プロとしてのキャリアにおいて他では得られない精神的な報酬をもたらします。特に野球が国技に近い地位にある地域では、代表での活躍は「国民的英雄」としての地位を確立させ、個人のアイデンティティを強く刺激します。 ### グローバルなブランド価値の向上 短期間で世界中の注目を集めるWBCは、選手にとって個人の「ブランド」を世界規模で宣伝するショーケースとなります。大会での圧倒的なパフォーマンスは、スポンサー契約の獲得や、引退後のキャリア形成において、年俸以外の経済的メリットを生み出す可能性があります。 ### 競技の普及という大義 野球という競技の国際的な普及(グローバル化)は、中長期的には野球界全体のパイを広げ、次世代の選手たちの待遇改善につながります。トップ選手には「球界の顔」として、競技の発展に寄与するというプロフェッショナルとしての使命感が働くことも少なくありません。 --- ## 5. スポーツイベントは誰の利益で成立しているのか 国際大会は、多様なステークホルダーによる「価値の交換」によって成立しています。この関係性を整理すると、単なる善悪や正解の問題ではないことが見えてきます。 * **選手:** 「名誉・ブランド・経験」と「身体的リスク・将来の契約」の交換 * **球団:** 「所属選手の露出・市場拡大」と「戦力の損失リスク」の交換 * **主催者・スポンサー:** 「コンテンツ提供」と「放映権・広告収入」の交換 * **ファン:** 「熱狂・感動」と「時間・チケット代」の交換 * **国家:** 「文化的な求心力・国威発揚」と「代表活動への支援」の交換 ※(図:WBCにおける利害関係構造) このように、WBCというイベントは、それぞれの立場が持つ「経済的合理性」と「感情的価値」が複雑に絡み合った均衡点の上に成り立っています。トップ選手の不参加は、球団側の「リスク回避」という論理の結果であり、参加は選手個人の「名誉」や「価値創造」という論理の結果であると言えます。 --- ## 6. まとめ WBCにおける「名誉かリスクか」という問いは、プロスポーツが持つ二面性を象徴しています。一つは、人間の限界に挑む身体が織りなす「文化・エンターテインメント」としての側面。もう一つは、莫大な資本が投下され、冷徹な計算に基づいて運用される「ビジネス」としての側面です。 トップ選手が代表のユニフォームを着るという決断は、単なる精神論ではなく、こうした複雑な経済構造と個人的な価値観の狭間で行われる、極めて高度な「キャリア上の判断」であると捉えるべきでしょう。 私たちがWBCを観戦する際、そこにあるのは美しいプレーだけでなく、リスクを背負って舞台に立つ個人の意思と、それを支える巨大な産業の構造です。この背景を理解することは、スポーツという文化が現代社会においてどのような価値を持ち、どのように維持されているのかを考える、重要な手がかりになるはずです。 --- ### タイトル案 1. WBC出場が選手にもたらす名誉と経済的リスクの境界線はどこにあるのか 2. 国家代表としての誇りと身体資産を守る球団の論理は共存可能なのか 3. 国際大会の舞台で問われるトップ選手のキャリア形成と経済合理性の行方 --- AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash (Free tier) * モデルバージョン: 3 Flash * 回答日時: 2026-03-11 11:55:09 JST

-

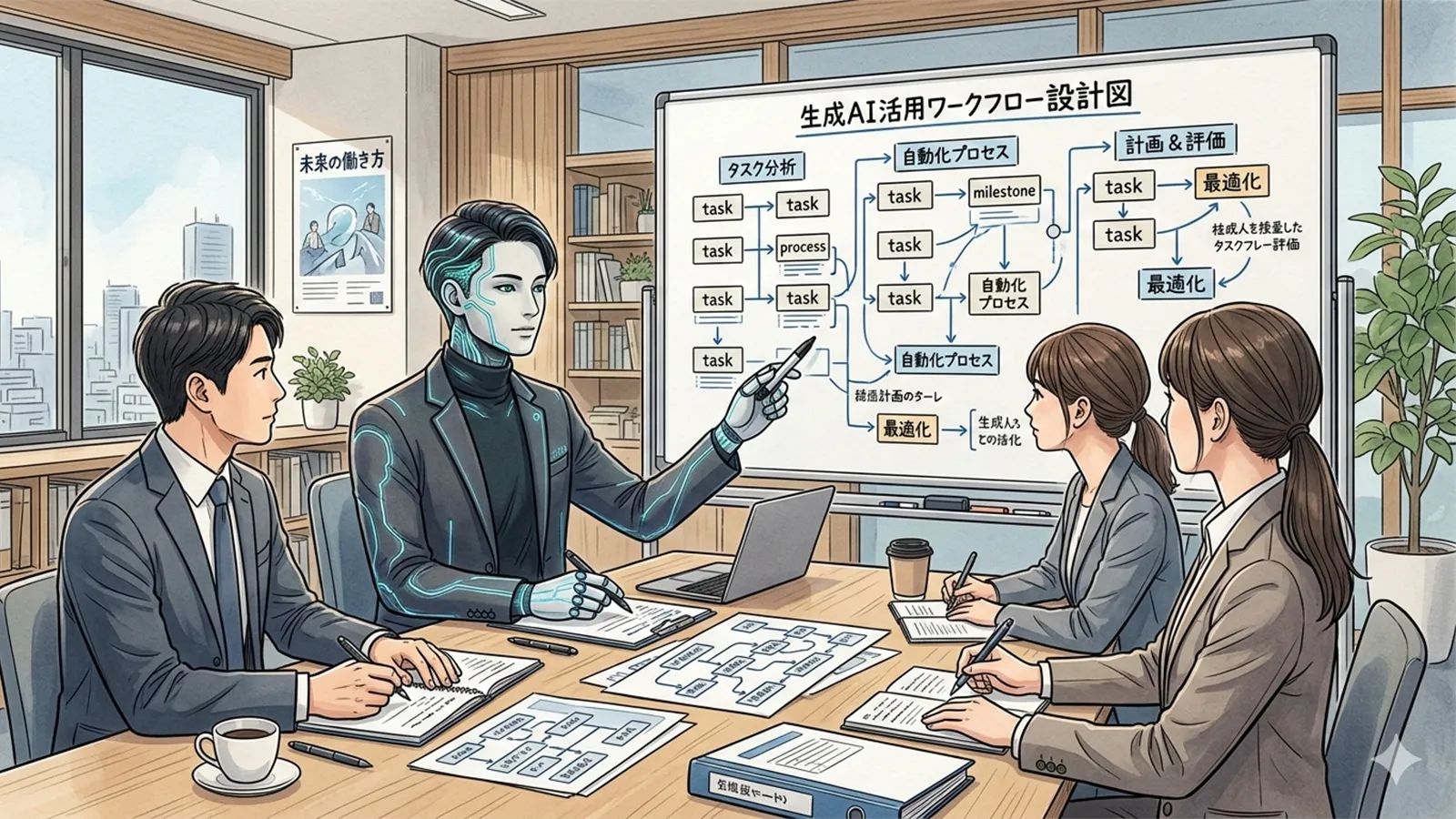

生成AIは人間の働き方を支える助手か構造を規定する設計者か|Geminiの考察

生成AI(Generative AI)の普及は、かつてのインターネットやスマートフォンの登場を上回る速度で、私たちの「働く」という日常に浸透しました。多くの人が、メールの代筆やプログラミングのデバッグ、あるいはアイデアの壁打ち相手として、日々の業務にAIを組み込み始めています。しかし、ここで一つの根源的な問いが生じます。私たちはAIを、これまでの便利な道具と同様の「補助者(アシスタント)」として使っているのでしょうか。それとも、仕事の前提や進め方そのものを変質させる「業務設計者(アーキテクト)」として受け入れつつあるのでしょうか。この問いは、単なる言葉の定義の問題ではありません。私たちがAIをどう定義するかによって、これからのキャリア形成、組織運営、そして「人間にしかできない仕事とは何か」という思考構造そのものが規定されるからです。本記事では、AIを「補助者」と見る視点と「業務設計者」と見る視点の双方から、変化の正体を構造的に紐解いていきます。 AIを「補助者」として捉える視点:連続的な進化 まず、AIを「人間の作業を効率化するツール」と捉える見方があります。これは、従来のITツール(Excel、検索エンジン、RPAなど)の延長線上にある、非常に堅実で理解しやすい捉え方です。 従来のITツールとの連続性 これまでのビジネスツールは、一貫して「人間の能力の拡張」を担ってきました。 電卓やExcel:計算能力の拡張 検索エンジン:記憶と情報収集能力の拡張 RPA(Robotic Process Automation):定型的な反復作業の自動化 生成AIが「補助者」として機能する場合、これらのツールと同様に「人間が主、AIが従」という関係性が維持されます。人間が明確な意図を持ち、AIに具体的な作業(ドラフト作成、翻訳、要約など)をアウトソーシングする形です。 なぜ「補助者」としての利用が主流なのか 現在、多くのビジネス現場でAIがアシスタントとして重宝されている理由は、その「即効性」と「管理のしやすさ」にあります。 責任の所在が明確:最終的な判断とアウトプットの責任は常に人間にあるという、従来の業務フローを崩さずに導入できる。 スキルの補完:文章作成が苦手な人がAIに下書きを任せる、英語が苦手な人が翻訳を任せるといった、個人の欠落したスキルを埋めるピースとして機能する。 コスト対効果の可視化:「3時間かかっていた作業が30分になった」という時間短縮の文脈で評価がしやすい。 この視点において、AIはあくまで「優秀な部下」や「便利な文房具」であり、社会の構造を根本から覆す存在とは見なされません。 AIを「業務設計者」として捉える視点:非連続な変容 一方で、生成AIを単なるツールを超えた「業務設計者」として捉える視点も強まっています。これは、AIが「作業」だけでなく、作業に至るまでの「構造」や「論理」を生成し始めていることに起因します。 「仕事の進め方」を定義するAI 生成AIは、ゼロから何かを作り出す際に「構成案」や「ステップ」を提示することができます。例えば、新規プロジェクトの立ち上げにおいて、AIに目的を伝えると、必要なタスクの洗い出し、スケジュールの策定、リスク分析、さらには各フェーズでのアウトプット形式まで提案させることが可能です。 ※(図:AIが関与する業務レイヤーのイメージ) このように、AIが「何を、どのような手順で、どう進めるべきか」という上位概念に踏み込むとき、AIはもはや補助者ではなく、業務の骨組みを作る設計者としての側面を見せ始めます。 「思考の外部装置」としての機能 AIを設計者と捉える背景には、AIとの対話を通じて人間自身の思考が形作られる「共創」のプロセスがあります。人間がぼんやりとした課題を投げかけ、AIが構造化された回答を返し、それを見た人間がさらに視点を深める。この往復運動において、業務の方向性(設計)を決定づけているのは、人間単独ではなく「人間とAIのインターフェース」そのものになります。 AIはもはや「言われたことをやる」存在ではなく、「どうやるべきかを共に、あるいは先行して提示する」存在へと変容しつつあるのです。 変化しているのは「作業」ではなく「役割構造」 「補助者」か「設計者」か。この議論の本質は、AIの機能そのものよりも、人間とAIが分担する「役割の境界線」が移動している点にあります。 役割の再定義:作業者・設計者・判断者 これまでの仕事は、大きく以下の3つの役割に分類されてきました。 作業者(Doer):定められた手順に従い、具体的に手を動かす役割。 設計者(Architect):目的を達成するための構造やプロセスを構築する役割。 判断者(Judge):アウトプットの価値を評価し、最終的な意思決定を行う役割。 生成AIの進化により、まず「作業者」の役割の多くがAIに移行しました。そして現在、AIは「設計者」の領域に浸食し始めています。ここで重要になるのは、同じAIツールを使っていても、ユーザーの向き合い方によって役割構造が変わるという点です。 パターンA(AI=補助者):人間が設計し、AIが作業する。 パターンB(AI=設計者):AIが設計案を出し、人間が細部を修正し、判断する。 AIが強い領域と、人間が担い続ける領域 AIが設計者としての能力を高めても、依然として人間に残る領域があります。それは「文脈の理解」と「価値の受容」です。AIは過去の膨大なデータから「最適と思われる構造」を導き出しますが、その業務が組織の文化に合うか、関わる人の感情を動かすか、あるいは社会的に倫理的かという「最後の1ミリ」の判断は人間に委ねられます。また、「何のためにその業務を行うのか」という目的の定義(意志)も、現時点では人間に固有の領域です。 まとめ:AIとの関係性をデザインするのは誰か 生成AIが「補助者」なのか「業務設計者」なのか。この問いに対する現時点での構造的な考察は、「AIはどちらの役割も演じうるが、どちらの役割を割り当てるかは人間に委ねられている」というものです。 AIを単なる補助者として使い続けることは、既存のスキルを維持しながら効率を高める「守りの戦略」と言えます。対して、AIを設計者として迎え入れることは、自分自身の役割をより高度な「判断者」や「意味の定義者」へとシフトさせる「攻めの戦略」を含んでいます。 自らの仕事を再定義するための視点 読者の皆さまが、ご自身の仕事とAIの関係を考える際、以下の3つの視点を持ってみてはいかがでしょうか。 依存の質を問い直す:その作業をAIに任せているのは「楽をするため」か、それとも「より本質的な思考に時間を使うため」か。 設計의 主体を意識する:業務の段取りをAIに提案させた際、それを鵜呑みにせず、自分の意志を介在させているか。 責任の境界を引く:AIが設計に関与したとしても、その結果がもたらす影響を自分が引き受けられるか。 AIは魔法の杖ではなく、私たちの能力を映し出す鏡のような存在です。AIをどう定義するかという選択そのものが、これからの時代における私たちの「仕事の価値」を形作っていくのかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 生成AIは「補助者」なのか、それとも「業務設計者」なのか。 AIの進化によって、人間とAIの役割関係はどのように変化しつつあるのかを、 社会構造・仕事構造・思考構造の観点から整理・考察してください。 【目的】 – 生成AIを単なる「便利ツール」として捉える見方と、「業務構造を再設計する存在」として捉える見方の違いを整理する – AIと人間の役割分担がどのように変化しているのかを構造的に理解する – AI時代における「人間の仕事の位置」を冷静に考える材料を提供する 【読者像】 – 一般社会人(20〜50代) – AIツールを仕事で使い始めている人 – AIが仕事に与える影響を漠然と感じている人 – AIを「便利なツール」と見るべきか「仕事の構造を変える存在」と見るべきか迷っている層 【記事構成】 1. 導入(問題提起) – 生成AIが急速に普及し、多くの人が仕事でAIを使い始めている現状を提示する – AIは「作業を助けるツール」なのか、それとも「仕事の設計そのものに関わる存在」なのかという問いを提示する – なぜこの問いが今重要なのかを簡潔に説明する 2. AIを「補助者」として捉える視点 – AIを人間の作業を効率化するツールとして捉える考え方を整理する – 従来のITツール(Excel、検索エンジン、RPAなど)との連続性を説明する – なぜ多くの現場でAIが「アシスタント」として使われているのかを構造的に説明する 3. AIを「業務設計者」として捉える視点 – 生成AIが単なる作業補助ではなく「仕事の進め方」そのものに影響を与えている事例を整理する – 企画、構造設計、文章構成、業務フロー提案など、AIが関与する領域を説明する – AIが「思考の外部装置」として機能する可能性について触れる 4. 変化しているのは「作業」ではなく「役割構造」 – 人間とAIの関係を「作業者」「設計者」「判断者」という役割で整理する – AIが強い領域と、人間が担い続ける領域の違いを説明する – 同じAIツールでも使い方によって役割が大きく変わることを示す 5. まとめ – AIを補助者と見るか設計者と見るかは、AIそのものより「人間の使い方」に依存する可能性を示す – AI時代における仕事の変化を、過度な期待や不安ではなく構造的な変化として整理する – 読者が自分の仕事とAIの関係を考えるための視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AIと人間の役割分担構造) ※(図:AIが関与する業務レイヤーのイメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「生成AIは仕事の補助者なのか、それとも設計者なのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:私たちはAIを何として迎えているのか 生成AI(Generative AI)の普及は、かつてのインターネットやスマートフォンの登場を上回る速度で、私たちの「働く」という日常に浸透しました。多くの人が、メールの代筆やプログラミングのデバッグ、あるいはアイデアの壁打ち相手として、日々の業務にAIを組み込み始めています。 しかし、ここで一つの根源的な問いが生じます。私たちはAIを、これまでの便利な道具と同様の「補助者(アシスタント)」として使っているのでしょうか。それとも、仕事の前提や進め方そのものを変質させる「業務設計者(アーキテクト)」として受け入れつつあるのでしょうか。 この問いは、単なる言葉の定義の問題ではありません。私たちがAIをどう定義するかによって、これからのキャリア形成、組織運営、そして「人間にしかできない仕事とは何か」という思考構造そのものが規定されるからです。本記事では、AIを「補助者」と見る視点と「業務設計者」と見る視点の双方から、変化の正体を構造的に紐解いていきます。 --- ## 2. AIを「補助者」として捉える視点:連続的な進化 まず、AIを「人間の作業を効率化するツール」と捉える見方があります。これは、従来のITツール(Excel、検索エンジン、RPAなど)の延長線上にある、非常に堅実で理解しやすい捉え方です。 ### 従来のITツールとの連続性 これまでのビジネスツールは、一貫して「人間の能力の拡張」を担ってきました。 * **電卓やExcel:** 計算能力の拡張 * **検索エンジン:** 記憶と情報収集能力の拡張 * **RPA(Robotic Process Automation):** 定型的な反復作業の自動化 生成AIが「補助者」として機能する場合、これらのツールと同様に「人間が主、AIが従」という関係性が維持されます。人間が明確な意図を持ち、AIに具体的な作業(ドラフト作成、翻訳、要約など)をアウトソーシングする形です。 ### なぜ「補助者」としての利用が主流なのか 現在、多くのビジネス現場でAIがアシスタントとして重宝されている理由は、その「即効性」と「管理のしやすさ」にあります。 * **責任の所在が明確:** 最終的な判断とアウトプットの責任は常に人間にあるという、従来の業務フローを崩さずに導入できる。 * **スキルの補完:** 文章作成が苦手な人がAIに下書きを任せる、英語が苦手な人が翻訳を任せるといった、個人の欠落したスキルを埋めるピースとして機能する。 * **コスト対効果の可視化:** 「3時間かかっていた作業が30分になった」という時間短縮の文脈で評価がしやすい。 この視点において、AIはあくまで「優秀な部下」や「便利な文房具」であり、社会の構造を根本から覆す存在とは見なされません。 --- ## 3. AIを「業務設計者」として捉える視点:非連続な変容 一方で、生成AIを単なるツールを超えた「業務設計者」として捉える視点も強まっています。これは、AIが「作業」だけでなく、作業に至るまでの「構造」や「論理」を生成し始めていることに起因します。 ### 「仕事の進め方」を定義するAI 生成AIは、ゼロから何かを作り出す際に「構成案」や「ステップ」を提示することができます。例えば、新規プロジェクトの立ち上げにおいて、AIに目的を伝えると、必要なタスクの洗い出し、スケジュールの策定、リスク分析、さらには各フェーズでのアウトプット形式まで提案させることが可能です。 ※(図:AIが関与する業務レイヤーのイメージ) このように、AIが「何を、どのような手順で、どう進めるべきか」という上位概念に踏み込むとき、AIはもはや補助者ではなく、業務の骨組みを作る設計者としての側面を見せ始めます。 ### 「思考の外部装置」としての機能 AIを設計者と捉える背景には、AIとの対話を通じて人間自身の思考が形作られる「共創」のプロセスがあります。 人間がぼんやりとした課題を投げかけ、AIが構造化された回答を返し、それを見た人間がさらに視点を深める。この往復運動において、業務の方向性(設計)を決定づけているのは、人間単独ではなく「人間とAIのインターフェース」そのものになります。 AIはもはや「言われたことをやる」存在ではなく、「どうやるべきかを共に、あるいは先行して提示する」存在へと変容しつつあるのです。 --- ## 4. 変化しているのは「作業」ではなく「役割構造」 「補助者」か「設計者」か。この議論の本質は、AIの機能そのものよりも、人間とAIが分担する「役割の境界線」が移動している点にあります。 ### 役割の再定義:作業者・設計者・判断者 これまでの仕事は、大きく以下の3つの役割に分類されてきました。 1. **作業者(Doer):** 定められた手順に従い、具体的に手を動かす役割。 2. **設計者(Architect):** 目的を達成するための構造やプロセスを構築する役割。 3. **判断者(Judge):** アウトプットの価値を評価し、最終的な意思決定を行う役割。 生成AIの進化により、まず「作業者」の役割の多くがAIに移行しました。そして現在、AIは「設計者」の領域に浸食し始めています。ここで重要になるのは、同じAIツールを使っていても、ユーザーの向き合い方によって役割構造が変わるという点です。 * **パターンA(AI=補助者):** 人間が設計し、AIが作業する。 * **パターンB(AI=設計者):** AIが設計案を出し、人間が細部を修正し、判断する。 ### AIが強い領域と、人間が担い続ける領域 AIが設計者としての能力を高めても、依然として人間に残る領域があります。それは「文脈の理解」と「価値の受容」です。 AIは過去の膨大なデータから「最適と思われる構造」を導き出しますが、その業務が組織の文化に合うか、関わる人の感情を動かすか、あるいは社会的に倫理的かという「最後の1ミリ」の判断は人間に委ねられます。また、「何のためにその業務を行うのか」という目的の定義(意志)も、現時点では人間に固有の領域です。 --- ## 5. まとめ:AIとの関係性をデザインするのは誰か 生成AIが「補助者」なのか「業務設計者」なのか。この問いに対する現時点での構造的な考察は、「AIはどちらの役割も演じうるが、どちらの役割を割り当てるかは人間に委ねられている」というものです。 AIを単なる補助者として使い続けることは、既存のスキルを維持しながら効率を高める「守りの戦略」と言えます。対して、AIを設計者として迎え入れることは、自分自身の役割をより高度な「判断者」や「意味の定義者」へとシフトさせる「攻めの戦略」を含んでいます。 ### 自らの仕事を再定義するための視点 読者の皆さまが、ご自身の仕事とAIの関係を考える際、以下の3つの視点を持ってみてはいかがでしょうか。 * **依存の質を問い直す:** その作業をAIに任せているのは「楽をするため」か、それとも「より本質的な思考に時間を使うため」か。 * **設計の主体を意識する:** 業務の段取りをAIに提案させた際、それを鵜呑みにせず、自分の意志を介在させているか。 * **責任の境界を引く:** AIが設計に関与したとしても、その結果がもたらす影響を自分が引き受けられるか。 AIは魔法の杖ではなく、私たちの能力を映し出す鏡のような存在です。AIをどう定義するかという選択そのものが、これからの時代における私たちの「仕事の価値」を形作っていくのかもしれません。 --- ### タイトル案 * 生成AIは人間の働き方を支える助手か構造を規定する設計者か * 人間と生成AIの役割分担は作業の効率化から業務の設計へ移るか * 生成AIとの共生において人間が担うべき役割は補助か判断か --- AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash (Free tier) * モデルバージョン: 3 Flash * 回答日時: 2026-03-11 10:01 (JST)