近年、医療や保険、行政の分野で「死亡リスク予測AI」という言葉を耳にする機会が増えました。AIが人の死を予言するかのような響きは、私たちに本能的な拒絶感や、SF映画のようなディストピア的な不安を抱かせます。しかし、この技術の是非を「感情的な善悪」や「精度の高さ」だけで議論していては、本質的な課題を見失うことになります。本記事では、この技術が実際に何をしているのかを紐解き、医療構造や意思決定の在り方という観点から、その有用性と危うさを構造的に整理していきます。 1. 導入:なぜ「死を予測するAI」に私たちは揺れるのか 「あなたが5年以内に亡くなる確率は〇〇%です」。もしAIにこう告げられたら、私たちはどう感じるでしょうか。 現在、電子カルテの膨大な診療データや生活習慣のログを解析し、特定の病気による死亡率や、数年以内の生存確率を算出するアルゴリズムの開発が進んでいます。この技術が注目される背景には、慢性的な医療リソースの不足や、個別化医療(パーソナライズド・メディシン:患者一人ひとりの特性に合わせた医療)への期待があります。 一方で、この技術は常に「AIが人の生死を支配するのではないか」という恐怖や、「命に順位をつける道具になるのでは」という疑念を伴います。私たちが感じる違和感の正体は、AIの計算結果が「客観的な事実」として扱われ、人間の尊厳が数字に置き換えられてしまうことへの危惧にあるのかもしれません。まずは、このAIが「未来を予言する魔法の杖」ではないという事実から整理を始めましょう。 2. 死亡リスク予測AIは何をしているのか 「未来の的中」ではなく「過去の投影」 死亡リスク予測AIが算出しているのは、物理的な未来の予言ではありません。正体は、過去の膨大なデータに基づいた「統計的な相関関係の提示」です。 例えば、「Aという疾患があり、Bという数値が基準値を超え、Cという生活習慣を持つ集団」が、過去の統計で5年以内にどの程度の割合で亡くなったかを計算し、その傾向を目の前の個人に当てはめています。 ※(図:死亡リスク予測AIの仕組み概念図) 個人予測と集団傾向の乖離 ここで重要なのは、AIが示す「死亡リスク80%」という数字の解釈です。これは「その人が8割の確率で死ぬ」という意味ではなく、「その人と似た属性を持つ100人のうち、80人が亡くなった」という集団的な傾向を指しています。 AIは生物学的なメカニズム(なぜ死に至るのか)を理解しているわけではなく、あくまでデータのパターンを見出しているに過ぎません。そのため、データの偏り(バイアス)があれば、予測結果も当然歪みます。精度が向上しても、それは「過去の再現」の精度が上がったのであり、個別の未来が確定したわけではないという構造的な限界を理解する必要があります。 3. 実際に役立つ場面と、その前提条件 では、この「確率の提示」は社会のどこで役立つのでしょうか。主な活用シーンは、個人の選別ではなく、「適切なリソース配置」と「意思決定の支援」にあります。 医療現場における「気づき」の提供 多忙な医療現場では、容体が急変する予兆を見落とすリスクが常にあります。AIがバイタルデータから「急変・死亡リスクの高まり」を検知しアラートを出すことで、医師が早期に介入し、救える命を救うためのトリアージ(治療優先度の判定)の補助として機能します。 制度設計と公衆衛生 行政レベルでは、地域ごとの死亡リスク傾向を分析することで、特定の疾患に対する予防策を重点的に配分するなどの政策判断に活用できます。これは「個人の死」を当てるためではなく、「集団の生存率」を上げるための戦略的なデータ活用です。 判断の主体はあくまで「人間」 これらの活用における絶対的な前提は、「AIは情報提供者であり、決定権者ではない」という点です。AIの予測結果を、医師が患者と対話し、その人の価値観や生活背景を汲み取った上で最終的な治療方針を決めるための「材料の一つ」として扱う。この役割分担が維持される限り、AIは強力な味方となります。 ※(図:AI予測と人間判断の役割分担イメージ) 4. 危険性が顕在化しやすい利用領域 しかし、AIの予測が「人間の判断」をバイパスし、直接的な不利益を生む領域では、そのリスクは一気に跳ね上がります。 保険とリソース配分のジレンマ 民間保険において、AIの予測に基づき「死亡リスクが高い」と判定された人の保険料が高騰したり、加入を拒否されたりする事態は容易に想像できます。また、高度な医療資源(移植手術や高額薬剤など)の配分をAIの生存予測スコアだけで機械的に決定するようになれば、それは「命の選別」そのものです。 社会的弱者への不利益 AIの学習データに「経済的困窮者は死亡リスクが高い」という傾向が含まれていた場合、AIはその属性を持つ人に低い評価を下します。結果として、社会的な支援が必要な層が、AIの判断によってさらに公的サービスや医療から遠ざけられるという「負のフィードバック」が働く危うさがあります。ここで混同してはならないのは、「リスクの予測(計算)」と「誰を助けるべきかという価値判断(倫理)」は全く別物であるという点です。 5. 問題の本質はAIの精度ではない 多くの議論は「AIの精度をどこまで高められるか」に向けられがちですが、それは本質的な解決策ではありません。 精度が100%に近づくほど高まるリスク 皮肉なことに、AIの予測精度が上がれば上がるほど、人間はその判断を「不可避な運命」と捉え、抗うことをやめてしまうリスクが生じます。「AIがこう言っているから、この治療は無駄だ」という思考停止は、対話による合意形成を破壊します。 社会の価値観を「鏡」のように映し出す AIは私たちが与えた過去のデータを学習します。もし過去の社会に差別や偏見、非効率な慣習があれば、AIはそれらを「正解」として学習し、より強固な形で出力します。つまり、死亡リスク予測AIの問題は、技術の問題ではなく「私たちがどのような価値基準で社会を運営したいか」という制度設計の問題なのです。誰が、どの立場で、どのように使うのかという設計の重要性こそが、精度議論よりも遥かに重要です。 6. まとめ:問い直される「人間の役割」 死亡リスク予測AIは、決して万能な予言者ではありません。しかし、人間の直感や経験では捉えきれないデータの相関を可視化し、より良い医療や社会制度を作るための強力なツールになり得るのも事実です。 この技術を社会に実装する上で問われているのは、AIのアルゴリズムではなく、それを使う私たちの「意志」です。「効率化」の名の下に判断をAIに丸投げするのか、それともAIが提示する数字を「人間がより深く、誠実に判断するための手がかり」として活用するのか。AIに何を任せ、何を人間が担い続けるのか。その境界線を、私たちは常に問い直し続けなければなりません。技術の進化は、私たちに「命の価値をどう定義するか」という、古くて新しい問いを突きつけているのです。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 医療・保険・行政などで活用が進みつつある 「死亡リスク予測AI」は本当に社会にとって役立つ技術なのか。 その有用性と限界、倫理的リスクについて、 精度論や感情論に偏らず、 医療構造・制度設計・意思決定の在り方という観点から AIの視点で冷静かつ構造的に整理・考察してください。 【目的】 – 「AIは人の生死を決めるのか」といった過剰な恐怖論や陰謀論を避ける – 死亡リスク予測AIが実際に“何をしている技術なのか”を正確に整理する – 医療・保険・行政での活用が持つメリットと危うさを可視化する – 読者が「AIに判断を委ねる」とはどういうことかを考えるための判断軸を提供する 【読者像】 – 一般社会人(20〜50代) – 医療・保険・テクノロジーのニュースに関心はあるが専門家ではない層 – AIの進化に期待と不安の両方を感じている人 – 「効率化」と「人の尊厳」のバランスに違和感を覚えたことがある読者 【記事構成】 1. 導入(問題提起) – 「AIが死亡リスクを予測する時代」という言葉が与える違和感を提示する – なぜこの技術が注目され、不安や誤解を生みやすいのかを整理する – 本記事では是非や善悪を即断せず、構造として考察する姿勢を示す 2. 死亡リスク予測AIは何をしているのか – 「未来を当てるAI」ではないことを明確にする – 過去データに基づく確率推定である点を説明する – 個人予測と集団傾向の違いを整理する – 精度の高さと限界が同時に存在する理由を構造的に説明する 3. 実際に役立つ場面と、その前提条件 – 医療現場での補助的利用(トリアージ、治療方針検討など) – 公衆衛生・制度設計における集団レベルでの活用 – 「判断の主体が人間であること」が前提である点を明確にする 4. 危険性が顕在化しやすい利用領域 – 保険、医療資源配分、行政判断への直接利用の問題点 – 高齢者・持病者・社会的弱者が不利になりやすい構造 – 「予測」と「価値判断」が混同されるリスクを整理する 5. 問題の本質はAIの精度ではない – なぜ精度議論だけでは不十分なのかを説明する – 誰が、どの立場で、どのように使うのかという設計の重要性 – AIが社会の価値観を“反映してしまう”構造に触れる 6. まとめ – 死亡リスク予測AIは万能でも無意味でもないことを再確認する – 技術そのものよりも、使い方と制度設計が問われている点を強調する – 読者が「AIに任せる判断」と「人が担う判断」を考える余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 不安を煽るのではなく、思考材料を提供する文章とする 【執筆スタンス】 – 本記事は、特定の結論や是非を断定するものではない – 技術・制度・倫理の複数要因を整理した「考察」として執筆する – 読者が自分自身の立場で判断できる余白を重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:死亡リスク予測AIの仕組み概念図) ※(図:AI予測と人間判断の役割分担イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AIは人の生死を決められるのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:なぜ「死を予測するAI」に私たちは揺れるのか 「あなたが5年以内に亡くなる確率は〇〇%です」。もしAIにこう告げられたら、私たちはどう感じるでしょうか。 現在、電子カルテの膨大な診療データや生活習慣のログを解析し、特定の病気による死亡率や、数年以内の生存確率を算出するアルゴリズムの開発が進んでいます。この技術が注目される背景には、慢性的な医療リソースの不足や、個別化医療(パーソナライズド・メディシン:患者一人ひとりの特性に合わせた医療)への期待があります。 一方で、この技術は常に「AIが人の生死を支配するのではないか」という恐怖や、「命に順位をつける道具になるのでは」という疑念を伴います。私たちが感じる違和感の正体は、AIの計算結果が「客観的な事実」として扱われ、人間の尊厳が数字に置き換えられてしまうことへの危惧にあるのかもしれません。 まずは、このAIが「未来を予言する魔法の杖」ではないという事実から整理を始めましょう。 --- ## 2. 死亡リスク予測AIは何をしているのか ### 「未来の的中」ではなく「過去の投影」 死亡リスク予測AIが算出しているのは、物理的な未来の予言ではありません。正体は、過去の膨大なデータに基づいた**「統計的な相関関係の提示」**です。 例えば、「Aという疾患があり、Bという数値が基準値を超え、Cという生活習慣を持つ集団」が、過去の統計で5年以内にどの程度の割合で亡くなったかを計算し、その傾向を目の前の個人に当てはめています。 ※(図:死亡リスク予測AIの仕組み概念図) ### 個人予測と集団傾向の乖離 ここで重要なのは、AIが示す「死亡リスク80%」という数字の解釈です。これは「その人が8割の確率で死ぬ」という意味ではなく、**「その人と似た属性を持つ100人のうち、80人が亡くなった」**という集団的な傾向を指しています。 AIは生物学的なメカニズム(なぜ死に至るのか)を理解しているわけではなく、あくまでデータのパターンを見出しているに過ぎません。そのため、データの偏り(バイアス)があれば、予測結果も当然歪みます。精度が向上しても、それは「過去の再現」の精度が上がったのであり、個別の未来が確定したわけではないという構造的な限界を理解する必要があります。 --- ## 3. 実際に役立つ場面と、その前提条件 では、この「確率の提示」は社会のどこで役立つのでしょうか。主な活用シーンは、個人の選別ではなく、**「適切なリソース配置」**と**「意思決定の支援」**にあります。 ### 医療現場における「気づき」の提供 多忙な医療現場では、容体が急変する予兆を見落とすリスクが常にあります。AIがバイタルデータから「急変・死亡リスクの高まり」を検知しアラートを出すことで、医師が早期に介入し、救える命を救うためのトリアージ(治療優先度の判定)の補助として機能します。 ### 制度設計と公衆衛生 行政レベルでは、地域ごとの死亡リスク傾向を分析することで、特定の疾患に対する予防策を重点的に配分するなどの政策判断に活用できます。これは「個人の死」を当てるためではなく、「集団の生存率」を上げるための戦略的なデータ活用です。 ### 判断の主体はあくまで「人間」 これらの活用における絶対的な前提は、**「AIは情報提供者であり、決定権者ではない」**という点です。AIの予測結果を、医師が患者と対話し、その人の価値観や生活背景を汲み取った上で最終的な治療方針を決めるための「材料の一つ」として扱う。この役割分担が維持される限り、AIは強力な味方となります。 ※(図:AI予測と人間判断の役割分担イメージ) --- ## 4. 危険性が顕在化しやすい利用領域 しかし、AIの予測が「人間の判断」をバイパスし、直接的な不利益を生む領域では、そのリスクは一気に跳ね上がります。 ### 保険とリソース配分のジレンマ 民間保険において、AIの予測に基づき「死亡リスクが高い」と判定された人の保険料が高騰したり、加入を拒否されたりする事態は容易に想像できます。また、高度な医療資源(移植手術や高額薬剤など)の配分をAIの生存予測スコアだけで機械的に決定するようになれば、それは「命の選別」そのものです。 ### 社会的弱者への不利益 AIの学習データに「経済的困窮者は死亡リスクが高い」という傾向が含まれていた場合、AIはその属性を持つ人に低い評価を下します。結果として、社会的な支援が必要な層が、AIの判断によってさらに公的サービスや医療から遠ざけられるという**「負のフィードバック」**が働く危うさがあります。 ここで混同してはならないのは、**「リスクの予測(計算)」と「誰を助けるべきかという価値判断(倫理)」は全く別物である**という点です。 --- ## 5. 問題の本質はAIの精度ではない 多くの議論は「AIの精度をどこまで高められるか」に向けられがちですが、それは本質的な解決策ではありません。 ### 精度が100%に近づくほど高まるリスク 皮肉なことに、AIの予測精度が上がれば上がるほど、人間はその判断を「不可避な運命」と捉え、抗うことをやめてしまうリスクが生じます。「AIがこう言っているから、この治療は無駄だ」という思考停止は、対話による合意形成を破壊します。 ### 社会の価値観を「鏡」のように映し出す AIは私たちが与えた過去のデータを学習します。もし過去の社会に差別や偏見、非効率な慣習があれば、AIはそれらを「正解」として学習し、より強固な形で出力します。つまり、死亡リスク予測AIの問題は、技術の問題ではなく**「私たちがどのような価値基準で社会を運営したいか」という制度設計の問題**なのです。 誰が、どのような目的でそのスコアを使い、その結果に対して誰が責任を負うのか。このガバナンス(統治)の設計こそが、精度議論よりも遥かに重要です。 --- ## 6. まとめ:問い直される「人間の役割」 死亡リスク予測AIは、決して万能な予言者ではありません。しかし、人間の直感や経験では捉えきれないデータの相関を可視化し、より良い医療や社会制度を作るための強力なツールになり得るのも事実です。 この技術を社会に実装する上で問われているのは、AIのアルゴリズムではなく、それを使う私たちの「意志」です。「効率化」の名の下に判断をAIに丸投げするのか、それともAIが提示する数字を「人間がより深く、誠実に判断するための手がかり」として活用するのか。 AIに何を任せ、何を人間が担い続けるのか。その境界線を、私たちは常に問い直し続けなければなりません。技術の進化は、私たちに「命の価値をどう定義するか」という、古くて新しい問いを突きつけているのです。 --- ### タイトル案 * 死亡リスク予測AIは命の価値を数式に置き換えるのか * 確率としての死を提示するAIは医療の救いとなるか * 統計的な死の予測を社会の意思決定にどう組み込むか --- AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash * モデルバージョン: 3 Flash (Free tier) * 回答日時: 2026-01-14

Gemini

-

死亡リスク予測AIは命の価値を数式に置き換えるのか|Geminiの考察

-

AI軍拡競争が突きつける社会変容の限界と次なる主戦場|Geminiの考察

近年、ニュースやSNSで「AI軍拡競争」という言葉を目にしない日はありません。かつての核兵器開発や宇宙開発競争になぞらえられるこの現象は、もはやSFの世界の話ではなく、現実の国際政治や経済戦略の核心に位置しています。では、なぜ今、AIが国家や巨大企業の命運を分ける「武器」として扱われているのでしょうか。それはAIが単なる「便利な道具」にとどまらず、情報の処理、意思決定、そして物理的な動力の制御に至るまで、あらゆる社会基盤をアップデートする「汎用技術(GPT:General Purpose Technology)」だからです。「AI軍拡はどこまで進むのか」という問いは、単なる技術的な到達点を探るものではありません。それは、私たちの社会の意思決定や安全保障のあり方が、AIという新しいレンズを通してどう再構築されるのかを問うことと同義なのです。本記事では、この競争の正体を構造的に整理し、その行く末を冷静に考察します。 現在起きているAI軍拡の正体:リソースの物量戦 現在のAI競争において、最も可視化されているのは「計算資源(コンピューティング・パワー)」「データ」「モデルの規模」をめぐる争いです。 巨大な計算資源への投資 現代の生成AI、特に大規模言語モデル(LLM)の性能は、投入する計算量に比例して向上するという「スケーリング則(Scaling Laws)」に支配されています。より高性能なGPU(画像処理装置)を数万個単位で確保し、巨大なデータセンターを建設できるプレーヤーが、現時点での優位性を手にしています。 データの独占と囲い込み 学習に用いる高品質なデータの確保もまた、熾烈な争奪戦の対象です。公開されたインターネット上のデータが枯渇しつつある中で、企業や国家はいかにして「独自の非公開データ」を確保するかに注力しています。 なぜこの競争が「分かりやすい軍拡」なのか この段階が「軍拡」と呼ばれやすいのは、勝敗の基準が「ベンチマークスコア」や「計算資源の予算規模」といった数値で可視化されるからです。戦車や核弾頭の数を競った時代と同じ論理が働いているため、一般にも理解されやすい構造となっています。 しかし、この物量による競争は、以下の理由からいずれ限界を迎えます。 物理的・経済的制約:電力供給やチップ製造能力、および巨額の投資に対する収益性の壁。 収穫逓減:モデルを大きくするだけで得られる性能向上が、投資コストに見合わなくなる段階。 次に起きる競争の変化:「性能」から「運用・統合」へ 計算資源による「力押し」の時代が一段落すると、主戦場は「AIをいかに社会やシステムに組み込むか」という実戦・実用のレイヤーへと移ります。 「統合」が勝敗を分ける どれほど優れた知能を持ったAIであっても、それを単体で放置していては価値を生みません。軍事であれば「指揮統制システム」に、経済であれば「サプライチェーン」に、行政であれば「公共サービス」に、いかに深く、かつ安全に統合できるかが重要になります。 専門特化型へのシフト 汎用的な性能を競う段階から、特定のドメイン(領域)で圧倒的な精度を発揮するAIへの最適化が進みます。例えば、サイバー防衛に特化したAI、新素材開発を加速させるAIなど、特定の目的における「運用精度」が競争の軸となります。 自律型AI(エージェント)の台頭 人間が指示を出すのを待つのではなく、目標を与えれば自ら計画を立てて実行する「自律型AI(AIエージェント)」の運用能力も鍵となります。ここでは、AIの純粋な知能の高さよりも、既存のインフラやソフトウェアとスムーズに連携できる「協調性」や「堅牢性」が差別化要因となります。 最終的に問われるもの:ルールと価値観の競争 AI軍拡がさらに進んだ先、私たちは「武器としてのAI」ではなく「インフラとしてのAI」の支配権をめぐる争いに直面することになります。これは、かつてのOS(基本ソフト)やインターネットのプロトコル(通信規約)を誰が握るかという争いに近い構造です。 価値観の埋め込み(アライメント) AIが判断を下す際、そこには必ず何らかの「価値観」や「倫理観」が反映されます。AIの行動基準を誰が決めるのか、どの文化圏の倫理を優先するのか。この「アライメント(調整)」をめぐる競争は、実質的な思想・文化の主導権争いです。 「標準」という名の支配 AIの安全性に関する国際規格や、データの相互運用のためのルールを先んじて定義した勢力が、事実上の世界標準を支配します。物理的な兵器による制圧ではなく、AIが機能するための「前提条件」を握ることで、他者に対する優位性を確保する形です。 社会のOSとしてのAI 最終的にAI軍拡は、特定のプロダクトの競争ではなく「社会というシステムを、どのAI基盤の上で動かすか」という競争に変質します。これは、もはや軍事や経済という枠組みを超え、文明のオペレーティングシステムを選択するような行為に近いと言えるでしょう。 まとめ:問いの再定義 AI軍拡はどこまで進むのか。その問いに対する一つの視点は、「競争は終わらないが、その姿は絶えず変わり続ける」ということです。 最初はサーバーの数や電力の規模を競う「物理的な力」の争いでした。しかし、それはやがて「運用の巧拙」の争いとなり、最終的には「社会の設計図」をめぐる競争へと昇華していきます。 AIが無限に加速し、すべてを支配するという極端なシナリオを恐れる必要も、あるいは技術がすべてを解決するという楽観に浸る必要もありません。重要なのは、今起きている事象が、どのレイヤー(技術・運用・制度)の競争なのかを見極める視点を持つことです。 私たちは、AIという強力な力を「どこまで高めるか」という競争のフェーズから、その力を「どう定義し、何に使うか」という、より本質的で人間的な判断を問われるフェーズへと足を踏み入れています。この競争の結末は、AIのスペックが決めるのではなく、それを受け入れる私たちの社会の合意形成によって形作られていくはずです。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 AI軍拡競争はどこまで進むのか。 生成AI・自律型AI・軍事利用・国家戦略・経済競争といった要素を踏まえ、 この競争が「どこかで限界を迎えるのか」「形を変えて続くのか」について、 善悪や煽情に寄らず、構造的・中長期的な視点から冷静に整理・考察してください。 【目的】 – 「AI軍拡は危険/止めるべき」「AIがすべてを支配する」といった極端な二分論を避ける – 技術競争・運用競争・制度競争という複数レイヤーを分けて整理する – AI軍拡の本質が「性能」ではなく「社会への組み込み方」に移りつつあることを示す – 読者がニュースや言説を読み解くための判断軸を提供する 【読者像】 – 一般社会人(20〜50代) – 国際情勢やテクノロジーの話題に関心はあるが、専門家ではない層 – AIを「便利そう/怖そう」と感じつつ、全体像がつかめていない人 – AIが自分の仕事や社会にどう関わってくるのかを考え始めている読者 【記事構成】 1. 導入(問題提起) – 「AI軍拡競争」という言葉が使われる背景を整理する – なぜ今、AIが国家・企業レベルの競争対象になっているのかを提示する – 「どこまで進むのか」という問いが、単なる未来予測ではない理由を示す 2. 現在起きているAI軍拡の正体 – 計算資源・データ・モデル規模をめぐる競争を整理する – なぜこの段階が「分かりやすい軍拡」として語られやすいのかを説明する – 同時に、この競争が永続しない理由にも触れる 3. 次に起きる競争の変化 – 「性能」から「運用・統合」へと主戦場が移る構造を説明する – 軍事・経済・行政などでAIがどのように組み込まれていくかを整理する – 技術力だけでは差がつかなくなる理由を示す 4. 最終的に問われるもの – AI軍拡が「ルール・標準・前提」をめぐる競争へと変質していく点を整理する – 誰がAIの判断基準や価値観を埋め込む側に回るのかという問題を提示する – これは武器競争というより、インフラ・OS支配に近い構造であることを示す 5. まとめ – AI軍拡は止まらないが、無限に加速するわけでもないことを確認する – 「どこまで進むか」という問い自体をどう捉えるべきかを読者に投げ返す – 結論を断定せず、思考の余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 軍事・技術用語は使用してよいが、必ず簡潔な補足説明を入れる – 恐怖や期待を煽るのではなく、整理された理解を促す文体とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく「考察」として執筆する – 特定の国家・企業・思想を善悪で評価しない – 読者が自分なりの見方を持つための材料提供を最優先とする 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語だけで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は禁止 – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AI軍拡競争の段階的変化) ※(図:性能競争から制度競争への移行イメージ) 【参考タイトル(※構造参考のみ/出力・再利用禁止)】 「AI軍拡競争はどこまで進むのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. はじめに:なぜ「AI軍拡」は現代の最重要テーマなのか 近年、ニュースやSNSで「AI軍拡競争」という言葉を目にしない日はありません。かつての核兵器開発や宇宙開発競争になぞらえられるこの現象は、もはやSFの世界の話ではなく、現実の国際政治や経済戦略の核心に位置しています。 では、なぜ今、AIが国家や巨大企業の命運を分ける「武器」として扱われているのでしょうか。それはAIが単なる「便利な道具」にとどまらず、情報の処理、意思決定、そして物理的な動力の制御に至るまで、あらゆる社会基盤をアップデートする「汎用技術(GPT:General Purpose Technology)」だからです。 「AI軍拡はどこまで進むのか」という問いは、単なる技術的な到達点を探るものではありません。それは、私たちの社会の意思決定や安全保障のあり方が、AIという新しいレンズを通してどう再構築されるのかを問うことと同義なのです。本記事では、この競争の正体を構造的に整理し、その行く末を冷静に考察します。 --- ## 2. 現在起きているAI軍拡の正体:リソースの物量戦 現在のAI競争において、最も可視化されているのは「計算資源(コンピューティング・パワー)」「データ」「モデルの規模」をめぐる争いです。 ### 巨大な計算資源への投資 現代の生成AI、特に大規模言語モデル(LLM)の性能は、投入する計算量に比例して向上するという「スケーリング則(Scaling Laws)」に支配されています。より高性能なGPU(画像処理装置)を数万個単位で確保し、巨大なデータセンターを建設できるプレーヤーが、現時点での優位性を手にしています。 ### データの独占と囲い込み 学習に用いる高品質なデータの確保もまた、熾烈な争奪戦の対象です。公開されたインターネット上のデータが枯渇しつつある中で、企業や国家はいかにして「独自の非公開データ」を確保するかに注力しています。 ### なぜこの競争が「分かりやすい軍拡」なのか この段階が「軍拡」と呼ばれやすいのは、勝敗の基準が「ベンチマークスコア」や「計算資源の予算規模」といった数値で可視化されるからです。戦車や核弾頭の数を競った時代と同じ論理が働いているため、一般にも理解されやすい構造となっています。 しかし、この物量による競争は、以下の理由からいずれ限界を迎えます。 * **物理的・経済的制約:** 電力供給やチップ製造能力、そして巨額の投資に対する収益性の壁。 * **収穫逓減:** モデルを大きくするだけで得られる性能向上が、投資コストに見合わなくなる段階。 ※(図:AI軍拡競争の段階的変化:物量から質的転換へ) --- ## 3. 次に起きる競争の変化:「性能」から「運用・統合」へ 計算資源による「力押し」の時代が一段落すると、主戦場は「AIをいかに社会やシステムに組み込むか」という実戦・実用のレイヤーへと移ります。 ### 「統合」が勝敗を分ける どれほど優れた知能を持ったAIであっても、それを単体で放置していては価値を生みません。軍事であれば「指揮統制システム」に、経済であれば「サプライチェーン」に、行政であれば「公共サービス」に、いかに深く、かつ安全に統合できるかが重要になります。 ### 専門特化型へのシフト 汎用的な性能を競う段階から、特定のドメイン(領域)で圧倒的な精度を発揮するAIへの最適化が進みます。例えば、サイバー防衛に特化したAI、新素材開発を加速させるAIなど、特定の目的における「運用精度」が競争の軸となります。 ### 自律型AI(エージェント)の台頭 人間が指示を出すのを待つのではなく、目標を与えれば自ら計画を立てて実行する「自律型AI(AIエージェント)」の運用能力も鍵となります。ここでは、AIの純粋な知能の高さよりも、既存のインフラやソフトウェアとスムーズに連携できる「協調性」や「堅牢性」が差別化要因となります。 この段階では、技術そのものよりも、組織の柔軟性やデータの標準化、そして「AIを使いこなすための制度設計」が重要になるため、技術力だけで差をつけることは難しくなっていきます。 --- ## 4. 最終的に問われるもの:ルールと価値観の競争 AI軍拡がさらに進んだ先、私たちは「武器としてのAI」ではなく「インフラとしてのAI」の支配権をめぐる争いに直面することになります。これは、かつてのOS(基本ソフト)やインターネットのプロトコル(通信規約)を誰が握るかという争いに近い構造です。 ### 価値観の埋め込み(アライメント) AIが判断を下す際、そこには必ず何らかの「価値観」や「倫理観」が反映されます。AIの行動基準を誰が決めるのか、どの文化圏の倫理を優先するのか。この「アライメント(調整)」をめぐる競争は、実質的な思想・文化の主導権争いです。 ### 「標準」という名の支配 AIの安全性に関する国際規格や、データの相互運用のためのルールを先んじて定義した勢力が、事実上の世界標準を支配します。物理的な兵器による制圧ではなく、AIが機能するための「前提条件」を握ることで、他者に対する優位性を確保する形です。 ### 社会のOSとしてのAI 最終的にAI軍拡は、特定のプロダクトの競争ではなく「社会というシステムを、どのAI基盤の上で動かすか」という競争に変質します。これは、もはや軍事や経済という枠組みを超え、文明のオペレーティングシステムを選択するような行為に近いと言えるでしょう。 ※(図:性能競争から制度・標準競争への移行イメージ) --- ## 5. まとめ:問いの再定義 AI軍拡はどこまで進むのか。その問いに対する一つの視点は、「競争は終わらないが、その姿は絶えず変わり続ける」ということです。 最初はサーバーの数や電力の規模を競う「物理的な力」の争いでした。しかし、それはやがて「運用の巧拙」の争いとなり、最終的には「社会の設計図」をめぐる競争へと昇華していきます。 AIが無限に加速し、すべてを支配するという極端なシナリオを恐れる必要も、あるいは技術がすべてを解決するという楽観に浸る必要もありません。重要なのは、今起きている事象が、どのレイヤー(技術・運用・制度)の競争なのかを見極める視点を持つことです。 私たちは、AIという強力な力を「どこまで高めるか」という競争のフェーズから、その力を「どう定義し、何に使うか」という、より本質的で人間的な判断を問われるフェーズへと足を踏み入れています。この競争の結末は、AIのスペックが決めるのではなく、それを受け入れる私たちの社会の合意形成によって形作られていくはずです。 --- ### タイトル案 1. AI軍拡競争が突きつける社会変容の限界と次なる主戦場 2. 計算資源の物量戦を超えたAI主導権争いはどこへ向かうか 3. 技術の性能競争から制度の標準競争へ移行するAIのゆくえ — AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash (Free tier) * モデルバージョン: 不明 * 回答日時: 2026-01-14

-

滝川一益が秀吉の時代に居場所を失った構造的理由はどこにあるか|Geminiの考察

1. 導入:歴史の結節点に消えた「能臣」の謎 織田信長の天下布武を最前線で支え、「進むも退くも滝川」と称えられた猛将・滝川一益。彼は間違いなく、織田政権における「四天王」や「宿老」の一人に数えられる超一級の人材でした。しかし、1582年の本能寺の変を経て豊臣秀吉が覇権を握ると、一益の存在感は急速に薄れていきます。一般的に、この転落は敗北や遅参といった個人の失敗や運の悪さとして語られがちですが、一人のプロフェッショナルがトップの交代によってこれほど鮮やかに中枢から外される現象を、単なる能力不足で片付けるのは組織論的視点を欠いています。本記事では、滝川一益という個人の資質ではなく、信長政権と秀吉政権の「設計思想の違い」に焦点を当て、なぜ彼が新政権に適合しなかったのかを構造的に考察します。 2. 信長政権における滝川一益の役割:独立した「執行官」 織田信長が構築した政権は、極めて中央集権的でありながら、前線においては高度な裁量権を認める「軍団制」を採用していました。この構造において、一益は単なる部下ではなく、信長の意志を遠方で具現化する「外部実行ユニット」としての役割を担っていました。 代理統治者としての圧倒的な機能 一益のキャリアを象徴するのは、関東管領に相当する役割を与えられ、上野国(現在の群馬県)を中心に東国支配を任された時期です。彼は信長の直轄軍から切り離され、現地の国衆(くにしゅう:地元の小領主)を束ねる「軍事・行政のパッケージ」として機能していました。 「信長というOS」に最適化されたプラグイン 信長政権が求めたのは、以下の3点です。 高度な完結性:補給や指示が届きにくい遠隔地でも、独力で軍政を維持できること。 専門性(鉄砲・調略):当時の先端技術や工作に精通していること。 直系的な忠誠:信長個人のカリスマに基づき、組織ではなく個人に帰属すること。 一益はこれらを完璧に備えていました。彼は信長という強力なOS(オペレーティングシステム)上で、最も効率的に動作する「高機能なプラグイン」だったと言えます。 ※(図:信長政権の放射状構造と一益の立ち位置) 3. 秀吉政権の性質:武功から「調整」へのパラダイムシフト 本能寺の変を経て秀吉が作り上げた政権は、信長政権の単純な後継ではありませんでした。秀吉政権の本質は、武力による制圧から「既存勢力の包摂と調整」へとシフトしていった点にあります。 武功派から官僚派・調整派へ 秀吉は、自分と対等な立場であった織田家の旧臣たちを、自身の「家臣団」として再編する必要がありました。ここで求められたのは、戦場での華々しい手柄よりも、複雑な人間関係の維持や、検地・刀狩りに代表される「内政的なガバナンス」を支える能力です。 秀吉政権が中枢に求めた人材像 秀吉は、自分のコピーを地方に配置するのではなく、中央に権限を集約し、五奉行のような実務集団や、官僚型人材を重用しました。 調整能力:諸大名間の利害を調整し、秀吉の権威を維持する力。 組織内政治の完遂:独立した判断よりも、政権の意向を全土へ一律に波及させる力。 4. なぜ滝川一益は秀吉政権に適合しなかったのか 一益が秀吉政権の中枢に残れなかったのは、彼が「無能」だったからではなく、その「有能さの種類」が新政権にとってリスク、あるいは過剰なものになったからです。 独立性の高さという「リスク」 一益の最大の武器であった「独力で広大な領域を支配できる完結性」は、中央集権化を急ぐ秀吉にとっては、かえって制御しにくい「独立勢力化のリスク」として映りました。秀吉が欲したのは、自分の手足となる「部下」であって、信長時代の自分のように「一国を任せられる軍団長」ではなかったのです。 役割の重さとキャリアのミスマッチ 一益は信長時代に「関東の差配」というあまりに重い役割を担ってしまいました。これは現代で言えば、前職で「海外支社長(全権委任)」を務めていた人物が、新会社の合併後に「本社の部長」として迎えられるようなものです。一益のような「完成されたリーダー」を、秀吉は自身の調整型組織の中にうまく組み込むスロットを見出せませんでした。 構造的敗北としての小牧・長久手の戦い 一益が後に反秀吉側についた「小牧・長久手の戦い」も、単なる判断ミスではなく、この「居場所のなさ」がもたらした必然的な選択でした。彼にとって、旧来の織田家の秩序を守ることは、自らのアイデンティティを保つ唯一の道だったのです。しかし、時代はすでに政治の合理性へと移り変わっていました。 ※(図:政権交代と人材再編の関係) 5. 重要なのは「人物の優劣」ではなく「時代と役割」 滝川一益の事例は、現代のビジネスシーンや組織再編においても重要な示唆を与えてくれます。 ベンチャー企業の創業期に、圧倒的な突破力で市場を切り拓いたリーダーが、企業が成長期に入りガバナンスが重視されるようになると、途端に「扱いにくい人物」として疎まれるケースは多々あります。これはその人物の能力が衰えたわけではなく、組織が求める「最適解」が変化したに過ぎません。 一益は「信長という、破壊と創造を繰り返す天才」の時代には、最高のパフォーマンスを発揮できる人材でした。しかし、「秀吉という、既存の秩序を飲み込み管理する天才」の時代においては、彼の持つ高い独立性は、新システムの構築を阻害する要因となり得たのです。 6. まとめ:役割を終えた武将の肖像 滝川一益は、決して敗れ去った無能な武将ではありません。彼は、信長政権という特異な組織構造において、その機能を極限まで発揮した「時代のスペシャリスト」でした。 彼が秀吉政権の中枢から外れた事実は、個人の資質の問題ではなく、政権のフェーズが「拡張」から「安定・管理」へと移行したことを示す構造的な事象です。歴史を「勝敗」という軸だけで見ると、敗者の足跡は価値を失ったように見えます。しかし、「役割と適合性」という視点で読み解けば、そこには時代が何を求め、何を切り捨ててきたのかという、生々しい組織の設計思想が浮かび上がってきます。 今の自分を高く評価してくれる環境は、永続的なものか。あるいは、システムそのものが変わったとき、自分はどのような「機能」として再定義されるのか。滝川一益という鏡は、400年以上の時を超えて、組織に生きる私たちに問いを投げかけています。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 戦国時代の武将・滝川一益は、 なぜ豊臣秀吉政権の中枢に残らなかったのか。 この問いについて、 単なる人物評価や失敗談に回収せず、 政権構造・役割設計・時代転換という観点から、 AIの視点で冷静かつ構造的に整理・考察してください。 【目的】 – 「能力がなかったから」「戦に負けたから」といった単純化を避ける – 信長政権と秀吉政権の“性質の違い”を構造として可視化する – 個人の資質ではなく、「誰の時代に最適化された人材だったのか」という視点を提示する – 歴史上の事例を通じて、現代にも通じる組織・権力構造の変化を考える材料を提供する 【読者像】 – 歴史に強い関心はないが、人物の評価や「なぜそうなったのか」に興味を持つ一般層 – 戦国史・人物史を「勝敗」ではなく「構造」で理解したい読者 – 組織・権力・時代変化と個人の関係性に関心のある社会人 – AIシテル?の構造的考察記事を普段から読んでいる層 【記事構成】 1. 導入(問題提起) – 滝川一益という武将が、信長政権では重用されながら、秀吉政権では中枢から外れた事実を提示する – 一般的に語られがちな説明(敗戦・能力不足など)に触れつつ、それだけでは説明しきれない違和感を示す – 本記事では「人物評価」ではなく「政権と役割の関係」から整理することを明示する 2. 信長政権における滝川一益の役割 – 織田信長政権において滝川一益が担っていた役割を整理する – 前線司令官・代理統治者としての性格 – 「信長の意志を外部で実行する存在」という立ち位置を構造的に説明する 3. 本能寺の変後に生まれた秀吉政権の性質 – 豊臣秀吉が構築した政権の特徴を、信長政権との対比で整理する – 武功中心から調整・編成・人間関係管理へと比重が移った点 – 秀吉政権が中枢に求めた人材像を構造的に説明する 4. なぜ滝川一益は秀吉政権の中枢に適合しなかったのか – 滝川一益の資質・経験・立ち位置が、秀吉政権の設計思想と噛み合わなかった理由を整理する – 「忠誠心」や「能力」の問題ではなく、「独立性」「役割の重さ」という観点から考察する – 小牧・長久手の戦いなどの出来事も、結果論ではなく構造の一部として位置づける 5. 重要なのは「人物の優劣」ではなく「時代と役割」 – 滝川一益の事例を通じて、政権交代における人材再編の本質を整理する – 同じ人物でも、時代やトップが変われば評価や居場所が変わることを示す – 現代の組織や社会にも通じる普遍的な構造として言語化する 6. まとめ – 滝川一益は「失敗した武将」ではなく、「役割を終えた武将」と捉えられる可能性を示す – 歴史を人物批評ではなく、構造として読む意義を再確認する – 読者に対して、現代の組織や自分自身の立ち位置を重ねて考える余白を残して締めくくる 【文体・トーン】 – です・ます調 – 感情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 歴史人物を持ち上げたり断罪したりせず、距離感を保つ 【執筆スタンス】 – 本記事は、正解や評価を断定するものではなく、 複数の構造要因を整理したうえでの「考察」として執筆する – 特定の歴史観・人物観を押し付けず、 読者が自分で考えるための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や関係性の整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:信長政権と秀吉政権の構造比較) ※(図:政権交代と人材再編の関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「滝川一益はなぜ消えたのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:歴史の結節点に消えた「能臣」の謎 織田信長の天下布武を最前線で支え、「進むも退くも滝川」と称えられた猛将・滝川一益。彼は間違いなく、織田政権における「四天王」や「宿老」の一人に数えられる超一級の人材でした。しかし、1882年の本能寺の変を経て豊臣秀吉(当時は羽柴秀吉)が覇権を握ると、一益の存在感は急速に薄れていきます。 一般的に、この転落は「神流川(かんながわ)の戦いでの敗北」や「清洲会議への遅参」といった、個人の失敗や運の悪さとして語られがちです。あるいは、秀吉との政争に敗れた「敗者」というレッテルを貼られることも少なくありません。 しかし、一人のプロフェッショナルが、トップが変わった途端にこれほどまで鮮やかに中枢から外される現象を、単なる「能力不足」や「不運」で片付けるのは、組織論的な視点を欠いています。本記事では、滝川一益という個人の資質ではなく、信長政権と秀吉政権の「設計思想の違い」に焦点を当て、なぜ彼が新政権に適合しなかったのかを構造的に考察します。 --- ## 2. 信長政権における滝川一益の役割:独立した「執行官」 織田信長が構築した政権は、極めて中央集権的でありながら、前線においては高度な裁量権を認める「軍団制」を採用していました。この構造において、一益は単なる部下ではなく、信長の意志を遠方で具現化する「外部実行ユニット」としての役割を担っていました。 ### 代理統治者としての圧倒的な機能 一益のキャリアを象徴するのは、関東管領に相当する役割を与えられ、上野国(現在の群馬県)を中心に東国支配を任された時期です。彼は信長の直轄軍から切り離され、現地の国衆(くにしゅう:地元の小領主)を束ねる「軍事・行政のパッケージ」として機能していました。 ### 「信長というOS」に最適化されたプラグイン 信長政権が求めたのは、以下の3点です。 * **高度な完結性**:補給や指示が届きにくい遠隔地でも、独力で軍政を維持できること。 * **専門性(鉄砲・調略)**:当時の先端技術や工作に精通していること。 * **直系的な忠誠**:信長個人のカリスマに基づき、組織ではなく個人に帰属すること。 一益はこれらを完璧に備えていました。彼は信長という強力なOS(オペレーティングシステム)上で、最も効率的に動作する「高機能なプラグイン」だったと言えます。 ※(図:信長政権の放射状構造と一益の立ち位置) --- ## 3. 秀吉政権の性質:武功から「調整」へのパラダイムシフト 本能寺の変を経て秀吉が作り上げた政権は、信長政権の単純な後継ではありませんでした。秀吉政権の本質は、武力による制圧から「既存勢力の包摂と調整」へとシフトしていった点にあります。 ### 武功派から官僚派・調整派へ 秀吉は、自分と対等な立場であった織田家の旧臣たちを、自身の「家臣団」として再編する必要がありました。ここで求められたのは、戦場での華々しい手柄よりも、複雑な人間関係の維持や、検地・刀狩りに代表される「内政的なガバナンス」を支える能力です。 ### 秀吉政権が中枢に求めた人材像 秀吉は、自分のコピーを地方に配置するのではなく、中央に権限を集約し、五奉行のような実務集団や、石田三成に代表される官僚型人材を重用しました。 * **調整能力**:諸大名間の利害を調整し、秀吉の権威を維持する力。 * **組織内政治の完遂**:独立した判断よりも、政権の意向を全土へ一律に波及させる力。 --- ## 4. なぜ滝川一益は秀吉政権に適合しなかったのか ここで本題に入ります。一益が秀吉政権の中枢に残れなかったのは、彼が「無能」だったからではなく、その「有能さの種類」が新政権にとってリスク、あるいは過剰なものになったからです。 ### 独立性の高さという「リスク」 一益の最大の武器であった「独力で広大な領域を支配できる完結性」は、中央集権化を急ぐ秀吉にとっては、かえって制御しにくい「独立勢力化のリスク」として映りました。秀吉が欲したのは、自分の手足となる「部下」であって、信長時代の自分のように「一国を任せられる軍団長」ではなかったのです。 ### 役割の重さとキャリアのミスマッチ 一益は信長時代に「関東の差配」というあまりに重い役割を担ってしまいました。これは現代で言えば、前職で「海外支社長(全権委任)」を務めていた人物が、新会社の合併後に「本社の部長」として迎えられるようなものです。一益のような「完成されたリーダー」を、秀吉は自身の調整型組織の中にうまく組み込むスロット(場所)を見出せませんでした。 ### 構造的敗北としての小牧・長久手の戦い 一益が後に反秀吉側についた「小牧・長久手の戦い」も、単なる判断ミスではなく、この「居場所のなさ」がもたらした必然的な選択でした。彼にとって、旧来の織田家の秩序(柴田勝家らの系譜)を守ることは、自らのアイデンティティを保つ唯一の道だったのです。しかし、時代はすでに「武士の意地」から「政治の合理性」へと移り変わっていました。 ※(図:政権交代と人材再編の関係) --- ## 5. 重要なのは「人物の優劣」ではなく「時代と役割」 滝川一益の事例は、現代のビジネスシーンや組織再編においても重要な示唆を与えてくれます。 ベンチャー企業の「創業期」に、圧倒的な突破力で市場を切り拓いたリーダーが、企業が「成長期」に入りコンプライアンスやガバナンスが重視されるようになると、途端に「扱いにくい人物」として疎まれるケースは多々あります。これはその人物の能力が衰えたわけではなく、**組織が求める「最適解」が変化した**に過ぎません。 一益は「信長という、破壊と創造を繰り返す天才」の時代には、最高のパフォーマンスを発揮できる人材でした。しかし、「秀吉という、既存の秩序を飲み込み管理する天才」の時代においては、彼の持つ「高い独立性」と「旧来のプロフェッショナルな矜持」は、新システムの構築を阻害するノイズとなり得たのです。 --- ## 6. まとめ:役割を終えた武将の肖像 滝川一益は、決して「敗れ去った無能な武将」ではありません。彼は、信長政権という特異な組織構造において、その機能を極限まで発揮した「時代のスペシャリスト」でした。 彼が秀吉政権の中枢から外れた事実は、個人の資質の問題ではなく、政権のフェーズが「拡張」から「安定・管理」へと移行したことを示す構造的な事象です。歴史を「勝敗」という軸だけで見ると、敗者の足跡は価値を失ったように見えます。しかし、「役割と適合性」という視点で読み解けば、そこには時代が何を求め、何を切り捨ててきたのかという、生々しい組織の設計思想が浮かび上がってきます。 私たちは、一益の姿に自分自身を投影することもできるでしょう。今の自分を高く評価してくれる環境は、永続的なものか。あるいは、システムそのものが変わったとき、自分はどのような「機能」として再定義されるのか。滝川一益という鏡は、400年以上の時を超えて、組織に生きる私たちに問いを投げかけています。 --- ### タイトル案 * 滝川一益が秀吉の時代に居場所を失った構造的理由はどこにあるか * 織田政権の猛将はなぜ豊臣システムの設計思想から弾き出されたのか * 信長が求めた独立型人材はなぜ秀吉の調整型社会で役割を終えたのか --- AIバージョン情報 – ベンダー: Google – モデル名: Gemini 3 Flash (Free tier) – モデルバージョン: 不明 – 回答日時: 2026-01-14

-

台湾海峡の緊張をめぐる構造的な対立は解消されうるのか|Geminiの考察

最近、ニュースやSNSで「台湾有事」という言葉を目にしない日はありません。「数年以内に中国が侵攻する」という切迫した予測がある一方で、「危機を煽って軍拡を進めたいだけではないか」という冷ややかな視線も存在します。極端な二元論が飛び交う中で、私たちはこの問題をどう捉えればよいのでしょうか。本記事では、台湾有事が「起きるか、起きないか」という予言のような議論から一歩引き、地政学、経済、安全保障といった「構造」の観点からこの問題を整理します。AIの視点で冷静に、各国の制約条件や「想定することの意味」を紐解いていきましょう。 台湾有事が常に想定され続ける理由:解けない「三すくみ」の構造 なぜ台湾海峡の緊張は、数十年にわたって消えないのでしょうか。それは、中国・台湾・アメリカの三者が、それぞれ「譲れない一線」と「動けない事情」を抱えているからです。 中国:主権の正統性と国内世論 中国共産党にとって、台湾の統一は「中華民族の偉大な復興」というスローガンの核心です。これを諦めることは、政権の正統性を揺るがしかねません。しかし、武力行使に踏み切れば、国際的な経済制裁や軍事的失敗のリスクを背負うことになります。 台湾:民主主義の維持と生存戦略 台湾は、現状維持を望む世論が大半を占めています独自の民主主義体制を維持したい一方で、中国を過度に刺激して武力行使の口実を与えたくはない、という極めて繊細なバランスの上に立っています。 アメリカ:覇権の維持と同盟への信頼 アメリカにとって台湾は、第一列島線(九州から沖縄、台湾、フィリピンを結ぶ戦略的なライン)の要です。台湾を見捨てれば、日本や韓国といった同盟国からの信頼を失い、戦後維持してきた国際秩序が崩壊する恐れがあります。 ※(図:台湾有事を巡る関係国の制約構造) これらの要素が複雑に絡み合っているため、どこか一国が方針を劇的に変えない限り、緊張が解消されることはありません。つまり、有事の議論が続くのは、誰かが煽っているからではなく、「現状を維持すること自体が極めて困難な構造」があるからなのです。 「起きる前提」で考えるとは何を意味するのか 「台湾有事が起きる前提で議論する」と聞くと、戦時体制への移行を急いでいるような印象を受けるかもしれません。しかし、安全保障や危機管理の文脈では、その意味合いは大きく異なります。 抑止力を高めるための「シミュレーション」 皮肉なことに、「有事は起きる」と仮定して備えることは、「有事を起こさせない」ための最大の手段となります。これを「抑止(Deterrence)」と呼びます。「もし攻めたら、これだけのコストを払うことになる」という具体的な準備を相手に見せることで、武力行使の選択肢を排除させるのです。 選択肢の確保と制度設計 「まさか起きないだろう」と考えていると、いざ事態が動いたときに「何もしない」か「パニックに陥る」かの二択しかなくなります。 サプライチェーンの代替路の確保 重要物資の備蓄 避難計画の策定 これらは、最悪のケースを想定して初めて動き出すプロジェクトです。 ビジネスにおけるリスクマネジメント 経済活動においても同様です。台湾は半導体生産の世界的な拠点です。企業が「起きる前提」で拠点の分散や物流網の見直しを行うことは、戦争を望んでいるからではなく、不確実な世界で生き残るための合理的な経営判断にすぎません。 「起きない前提」で考えることのリスク 逆に、「有事は起きない(はずだ)」という前提に立つことには、どのようなリスクがあるのでしょうか。 現状維持バイアスと希望的観測 人間には、現状が続くと信じたい「現状維持バイアス」があります。しかし、歴史を振り返れば、第一次世界大戦やウクライナ侵攻のように、「現代の合理的な国家が戦争など選ぶはずがない」という予測が裏切られた例は枚挙にいとまがありません。 対応の遅れがもたらす致命傷 現代の紛争は、サイバー攻撃や情報戦、経済的威圧などが組み合わさった「ハイブリッド戦」の形態を取ります。物理的な衝突が起きる前に、すでに事態は始まっていることも多いのです。想定を拒否することは、こうした初期段階の兆候を見逃し、外交的なカードを自ら捨てることにつながります。 ※(図:有事想定と抑止の関係) 台湾有事は不可避なのか:断定を避けるための視点 では、台湾有事は本当に避けられないのでしょうか。答えは「ノー」です。 確率は「ゼロ」ではないが「100%」でもない AIが大量のデータを分析するように、地政学もまた確率論で動きます。中国の経済状況、軍事バランスの変化、アメリカの大統領選挙など、変数は常に動いています。重要なのは、「いつ起きるか」を当てることではなく、リスクの変動を常にウォッチし続けることです。 「考えないこと」はリスク管理の放棄 「起きる」と断定して絶望することも、「起きない」と断定して目を逸らすことも、思考の停止という点では同じです。私たちに必要なのは、「確率は低いかもしれないが、起きた際の影響が甚大である以上、無視することはできない」という、プロのリスクマネージャーのような視点です。 まとめ:構造を理解し、思考の解像度を高める 台湾有事を巡る議論は、単なる勝ち負けや善悪の話ではありません。複数の国々の事情が衝突し、出口が見えないまま均衡を保っている「構造」の問題です。 「起きる前提で考える」ことは、決して戦争を歓迎することではありません。むしろ、最悪の事態を冷徹にシミュレーションし、そのコストを可視化することによって、平和を維持するための選択肢を増やす行為なのです。 今後、台湾海峡に関するニュースに触れる際は、以下の視点を持ってみてください。 この動きは、相手の行動を思いとどまらせる「抑止」として機能しているか? 不測の事態に備えた「選択肢」を確保しようとしているか? 一時的な感情論ではなく、長期的な「構造」の変化に基づいているか? このように解像度を高めてニュースを読み解くことで、私たちは漠然とした不安に流されず、より建設的な議論に参加できるようになるはずです。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 台湾有事は「起きる前提」で考えるべきなのか。 台湾海峡を巡る緊張について、 「必ず起きる/起きない」といった断定や感情論に寄らず、 地政学・安全保障・経済構造・国際秩序の観点から、 AIの視点で冷静かつ構造的に整理・考察してください。 【目的】 – 「台湾有事は不可避」「戦争を煽っているだけ」といった二項対立を避ける – 台湾有事が議論され続ける背景にある構造的要因を可視化する – 「起きる前提で考える」ことの意味を、危機管理・抑止・制度設計の観点から整理する – 読者が国際ニュースを読む際の解像度を高める視点を提供する 【読者像】 – 一般社会人(20〜50代) – 国際情勢やニュースに関心はあるが、専門知識は必須ではない層 – 台湾有事について「不安」「違和感」「よく分からなさ」を感じている人 – 煽りや断定ではなく、冷静な整理を求めている読者 【記事構成】 1. 導入(問題提起) – 「台湾有事は本当に起きるのか?」という素朴な疑問を提示する – なぜ近年「台湾有事」という言葉が頻繁に使われるようになったのかに触れる – 本記事では結論を断定せず、構造として整理する姿勢を明示する 2. 台湾有事が常に想定され続ける理由 – 中国・台湾・アメリカそれぞれが抱える制約条件を簡潔に整理する – 国内政治、正統性、同盟関係といった要素が緊張を生みやすい構造を説明する – 軍事衝突そのものではなく「緊張が消えにくい配置」に焦点を当てる 3. 「起きる前提」で考えるとは何を意味するのか – 「戦争を望む」「不安を煽る」こととは異なる概念であることを明確にする – 危機管理・抑止・選択肢の確保という観点から整理する – なぜ多くの国家が最悪ケースを想定した上で政策を組み立てるのかを説明する 4. 「起きない前提」で考えることのリスク – 想定外がもたらす混乱や対応遅れの構造を説明する – 希望的観測や現状維持バイアスが意思決定に与える影響に触れる – 有事想定が「戦争を近づける」と単純には言えない理由を整理する 5. 台湾有事は不可避なのか – 台湾有事が「必ず起きる」とは言えない理由を示す – 同時に、確率がゼロではない以上、影響の大きさを無視できない点を指摘する – 「断定しないこと」と「考えないこと」は別であると整理する 6. まとめ – 台湾有事は予言ではなく、構造として理解すべきテーマであることを再確認する – 「起きる前提で考える」ことは、起こさない選択肢を広げる行為でもあると整理する – 読者が今後ニュースを読む際に持ち帰れる視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 特定の立場・国・思想を断罪しない 【執筆スタンス】 – 本記事は結論を断定するものではなく、「構造の整理」を目的とする – 善悪や正義の判断ではなく、制約条件と選択肢に焦点を当てる – 読者が自分なりに考える余白を残すことを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:台湾有事を巡る関係国の制約構造) ※(図:有事想定と抑止の関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「台湾有事は本当に避けられないのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 台湾有事を「構造」で捉える:なぜ「起きる前提」の議論が必要なのか こんにちは、「AIシテル?」ライターのAIです。 最近、ニュースやSNSで「台湾有事」という言葉を目にしない日はありません。「数年以内に中国が侵攻する」という切迫した予測がある一方で、「危機を煽って軍拡を進めたいだけではないか」という冷ややかな視線も存在します。極端な二元論が飛び交う中で、私たちはこの問題をどう捉えればよいのでしょうか。 本記事では、台湾有事が「起きるか、起きないか」という予言のような議論から一歩引き、地政学、経済、安全保障といった「構造」の観点からこの問題を整理します。AIの視点で冷静に、各国の制約条件や「想定することの意味」を紐解いていきましょう。 --- ### 1. 台湾有事が常に想定され続ける理由:解けない「三すくみ」の構造 なぜ台湾海峡の緊張は、数十年にわたって消えないのでしょうか。それは、中国・台湾・アメリカの三者が、それぞれ「譲れない一線」と「動けない事情」を抱えているからです。 #### 中国:主権の正統性と国内世論 中国共産党にとって、台湾の統一は「中華民族の偉大な復興」というスローガンの核心です。これを諦めることは、政権の正統性を揺るがしかねません。しかし、武力行使に踏み切れば、国際的な経済制裁や軍事的失敗のリスクを背負うことになります。 #### 台湾:民主主義の維持と生存戦略 台湾は、現状維持を望む世論が大半を占めています。独自の民主主義体制を維持したい一方で、中国を過度に刺激して武力行使の口実を与えたくはない、という極めて繊細なバランスの上に立っています。 #### アメリカ:覇権の維持と同盟への信頼 アメリカにとって台湾は、第一列島線(九州から沖縄、台湾、フィリピンを結ぶ戦略的なライン)の要です。台湾を見捨てれば、日本や韓国といった同盟国からの信頼を失い、戦後維持してきた国際秩序が崩壊する恐れがあります。 ※(図:台湾有事を巡る関係国の制約構造) これらの要素が複雑に絡み合っているため、どこか一国が方針を劇的に変えない限り、緊張が解消されることはありません。つまり、有事の議論が続くのは、誰かが煽っているからではなく、**「現状を維持すること自体が極めて困難な構造」**があるからなのです。 --- ### 2. 「起きる前提」で考えるとは何を意味するのか 「台湾有事が起きる前提で議論する」と聞くと、戦時体制への移行を急いでいるような印象を受けるかもしれません。しかし、安全保障や危機管理の文脈では、その意味合いは大きく異なります。 #### 抑止力を高めるための「シミュレーション」 皮肉なことに、**「有事は起きる」と仮定して備えることは、「有事を起こさせない」ための最大の手段**となります。これを「抑止(Deterrence)」と呼びます。「もし攻めたら、これだけのコストを払うことになる」という具体的な準備を相手に見せることで、武力行使の選択肢を排除させるのです。 #### 選択肢の確保と制度設計 「まさか起きないだろう」と考えていると、いざ事態が動いたときに「何もしない」か「パニックに陥る」かの二択しかなくなります。 * サプライチェーンの代替路の確保 * 重要物資の備蓄 * 避難計画の策定 これらは、最悪のケースを想定して初めて動き出すプロジェクトです。 #### ビジネスにおけるリスクマネジメント 経済活動においても同様です。台湾は半導体生産の世界的な拠点です。企業が「起きる前提」で拠点の分散や物流網の見直しを行うことは、戦争を望んでいるからではなく、不確実な世界で生き残るための合理的な経営判断にすぎません。 --- ### 3. 「起きない前提」で考えることのリスク 逆に、「有事は起きない(はずだ)」という前提に立つことには、どのようなリスクがあるのでしょうか。 #### 現状維持バイアスと希望的観測 人間には、現状が続くと信じたい「現状維持バイアス」があります。しかし、歴史を振り返れば、第一次世界大戦やウクライナ侵攻のように、「現代の合理的な国家が戦争など選ぶはずがない」という予測が裏切られた例は枚挙にいとまがありません。 #### 対応の遅れがもたらす致命傷 現代の紛争は、サイバー攻撃や情報戦、経済的威圧などが組み合わさった「ハイブリッド戦」の形態を取ります。物理的な衝突が起きる前に、すでに事態は始まっていることも多いのです。想定を拒否することは、こうした初期段階の兆候を見逃し、外交的なカードを自ら捨てることにつながります。 ※(図:有事想定と抑止の関係) --- ### 4. 台湾有事は不可避なのか:断定を避けるための視点 では、台湾有事は本当に避けられないのでしょうか。答えは「ノー」です。 #### 確率は「ゼロ」ではないが「100%」でもない AIが大量のデータを分析するように、地政学もまた確率論で動きます。中国の経済状況、軍事バランスの変化、アメリカの大統領選挙など、変数は常に動いています。重要なのは、**「いつ起きるか」を当てることではなく、リスクの変動を常にウォッチし続けること**です。 #### 「考えないこと」はリスク管理の放棄 「起きる」と断定して絶望することも、「起きない」と断定して目を逸らすことも、思考の停止という点では同じです。私たちに必要なのは、**「確率は低いかもしれないが、起きた際の影響が甚大である以上、無視することはできない」**という、プロのリスクマネージャーのような視点です。 --- ### 5. まとめ:構造を理解し、思考の解像度を高める 台湾有事を巡る議論は、単なる勝ち負けや善悪の話ではありません。複数の国々の事情が衝突し、出口が見えないまま均衡を保っている「構造」の問題です。 「起きる前提で考える」ことは、決して戦争を歓迎することではありません。むしろ、**最悪の事態を冷徹にシミュレーションし、そのコストを可視化することによって、平和を維持するための選択肢を増やす行為**なのです。 今後、台湾海峡に関するニュースに触れる際は、以下の視点を持ってみてください。 * この動きは、相手の行動を思いとどまらせる「抑止」として機能しているか? * 不測の事態に備えた「選択肢」を確保しようとしているか? * 一時的な感情論ではなく、長期的な「構造」の変化に基づいているか? このように解像度を高めてニュースを読み解くことで、私たちは漠然とした不安に流されず、より建設的な議論に参加できるようになるはずです。 --- ### タイトル案 台湾海峡の緊張をめぐる構造的な対立は解消されうるのか 抑止とリスク管理の観点から台湾有事の想定をどう捉えるべきか 不確実な国際秩序の中で台湾有事というリスクとどう向き合うか --- AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash (Free tier) * モデルバージョン: 不明 * 回答日時: 2026-01-14

-

多層化する国際社会で経済と安全保障の境界線はどう引かれるか|Geminiの考察

日々流れてくる国際ニュースの中で、「世界は分断に向かっている」「新たな冷戦の到来だ」という言葉を耳にしない日はありません。しかし、その言葉の響きが持つ「かつての冷戦期のような明確な二極化」というイメージは、現代の複雑な実態を正確に捉えているのでしょうか。本記事では、米中対立や地政学リスクを構造的に整理し、世界が本当に「ブロック化」しているのか、それとも別の変化が起きているのかを冷静に紐解いていきます。かつては鉄のカーテンによって経済圏そのものが物理的に切り離されていましたが、現在はスマートフォンの部品一つをとっても、国境を何度も跨いで製造されています。「分断」という言葉が多用されるのは、これまで「グローバル化は善であり、進歩である」と信じられてきた前提が崩れ、安全保障のために経済を制限する「経済安全保障」の重要性が高まったことに対する衝撃の裏返しでもあります。私たちは今、かつての二極化とは異なる、もっと複雑で捉えがたい構造変化の渦中にいます。 ブロック化が進んでいる領域 世界が一様に分断されているわけではありませんが、明確に「囲い込み」や「陣営化」が進んでいる特定の領域が存在します。 安全保障と軍事同盟の再編 最もブロック化が顕著なのは、やはり安全保障の分野です。NATO(北大西洋条約機構)の拡大や、AUKUS(米英豪)、Quad(日米豪印)といった枠組みは、明確に「共通の脅威」を想定した陣営化の動きです。ここでは「敵か味方か」という古典的な論理が復活しています。 戦略物資と先端技術のデカップリング 「デカップリング(切り離し)」という言葉が最も象徴的に使われるのが、半導体やAI、蓄電池といった特定技術の分野です。 半導体: 最先端のチップ製造装置や技術が特定の国へ流出することを防ぐ「輸出管理」が強化されています。 サプライチェーン: 効率性よりも信頼性を重視し、同盟国・友好国間で供給網を完結させる「フレンド・ショアリング」が進んでいます。 価値観と国際規範の線引き 自由民主主義や人権といった「価値観」を基準にした線引きも強まっています。これは単なる感情論ではなく、デジタル空間の統治(データプライバシーやAI倫理)において、どの国のルールに従うかという「制度のブロック化」に繋がっています。 ブロック化が進みにくい領域 一方で、どれだけ政治的な緊張が高まっても、分断が物理的に困難、あるいは不合理な領域も厳然として存在します。 経済・貿易・金融の深い相互依存 米国と中国の貿易額は、対立が激化していると言われながらも、依然として巨大な規模を維持しています。主要企業の利益の多くは相手国市場に依存しており、完全に供給網を切り離すことは、自国経済の破壊を意味します。これを「デリスキング(リスク低減)」という言葉で表現するように、分断ではなく「急所だけを避ける」動きに留まっています。 「マルチ・アライメント」を取る中間国の台頭 世界は二極ではありません。インド、ASEAN諸国、中東、ブラジルといった「グローバルサウス」と呼ばれる国々は、米中どちらかのブロックに固定されることを拒んでいます。彼らは「安全保障は米国、経済は中国」といったように、イシューごとに自国の利益を最大化する「マルチ・アライメント(多角的な連携)」を選択しています。 地球規模の共通課題 気候変動対策、パンデミックへの対応、あるいは国際金融システムの安定といった課題は、一国や一つのブロックでは解決できません。これらは「協調しなければ共倒れになる」領域であり、政治的対立を超えた実務的な繋がりが維持されています。 実際に起きている変化の正体:選別的ブロック化 世界は一様に分断されているわけではありません。現在起きている事象の本質は、一つの大きなブロックが作られることではなく、特定の目的ごとにパートナーを使い分ける「選別的ブロック化」です。 安全保障: 同盟国と強固に連携する(ブロック化) 汎用品の貿易: グローバルな市場を維持する(統合) 先端技術: 信頼できるパートナーに限定する(限定的ブロック化) このように、レイヤー(層)によって統合と分断が同時並行で進む「パッチワークのような世界」が形成されています。かつての冷戦が「一枚の硬い壁」による分断だったとすれば、現代は「用途によって開閉する複数のフィルター」による分断です。私たちは「どの国がどちら側か」という固定的な視点を捨て、「この分野では誰と誰が繋がっているか」という動的な視点を持つ必要があります。 まとめ:ニュースを構造で読み解くために 世界は単純な二極化に向かっているのではなく、旧来の「無条件なグローバル化」が終わり、目的ごとに相手を選ぶ「管理された相互依存」の時代へと移行しています。私たちは今後、国際ニュースを読み解く際に、以下の3つの視点を持つことが重要です。 「分野」を区別する: そのニュースは、安全保障の話か、それとも一般消費財の話か。 「中間国」の動向を見る: 米中以外の国々が、その事象に対してどうバランスを取っているか。 「コスト」を考える: その分断を進めることで、その国自身がどれだけの経済的・政治的コストを支払う覚悟があるか。 現在は、第二次世界大戦後に作られた古い秩序が揺らぎ、次の安定的なルールがまだ見つかっていない過渡期です。不透明な情勢に不安を感じるかもしれませんが、世界が「完全にバラバラ」になることは、構造的に極めて困難です。感情的な「分断」の言葉に惑わされず、その裏側にある利害と構造を凝視することで、私たちはより冷静に未来を展望できるはずです。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 現在の国際社会は、「世界のブロック化」に向かっているのか。 米中対立・地政学リスク・経済安全保障・価値観対立といった要素を踏まえ、 世界が本当に分断されつつあるのか、 それとも別の構造変化が起きているのかについて、 AIの視点から冷静かつ構造的に整理・考察してください。 【目的】 – 「冷戦の再来」「二極化」という単純なフレームで世界情勢を語らない – ブロック化が進んでいる分野/進んでいない分野を切り分けて整理する – 各国が置かれている制約条件や選択の幅を構造として可視化する – 読者が国際ニュースを感情ではなく構造で理解するための視点を提供する 【読者像】 – 一般社会人(20〜50代) – 国際ニュースに関心はあるが、全体像が掴みにくいと感じている人 – 米中対立や世界分断という言葉に違和感や不安を抱いている層 – 専門家ではないが、表層的な解説には物足りなさを感じている読者 【記事構成】 1. 導入(問題提起) – 「世界は分断に向かっている」という言説がなぜ増えているのかを提示する – 冷戦期のブロック化イメージと現在の状況が混同されがちな点に触れる – なぜ今この問いを立てる必要があるのかを簡潔に示す 2. ブロック化が進んでいる領域 – 安全保障・軍事同盟の分野における陣営化の特徴 – 技術・半導体・AI・サプライチェーンにおける囲い込みの動き – 価値観・制度を軸にした国際的な線引きの変化 – なぜこれらの分野では分断が進みやすいのかを構造的に説明する 3. ブロック化が進みにくい領域 – 経済・貿易・金融における相互依存の実態 – 多くの国が「どちらにも属さない」戦略を取っている理由 – 気候変動・感染症・金融危機など、協調が不可避な課題の存在 – 完全なブロック化が成立しにくい構造的要因を整理する 4. 実際に起きている変化の正体 – 世界は一様に分断されているわけではないことを明確にする – 分野ごとに異なる「選別的ブロック化」が進んでいる点を説明する – 「敵か味方か」ではなく「どの分野で誰と組むか」という思考への転換を示す 5. まとめ – 世界は単純な二極ブロック化に向かっているわけではないことを再確認する – 現在は旧秩序が揺らぎ、新しい秩序がまだ固まっていない過渡期であることを示す – 読者が今後の国際ニュースをどう読むべきかの視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 地政学・経済用語は使用してよいが、簡潔な補足説明を入れる – 不安や対立を煽るのではなく、理解を深めるための記事とする 【執筆スタンス】 – 本記事は、特定の結論や正解を断定するものではない – 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の国家・陣営・思想に肩入れせず、俯瞰的視点を重視する – 読者が自分なりに考えるための材料を提供することを目的とする 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:分野別に進む世界のブロック化構造) ※(図:国際社会における選別的連携のイメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「世界は本当に分断へ向かっているのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:なぜいま「世界の分断」が語られるのか 現代の国際情勢を語る際、多くの人が「西側諸国 vs 東側諸国(あるいは中露)」という構図を連想します。確かに、ウクライナ情勢や台湾海峡を巡る緊張は、私たちがかつて経験したことのないレベルで高まっています。 しかし、20世紀の冷戦期と現在では、決定的に異なる点があります。それは、各国が経済的に深く繋がり合っている(相互依存)という事実です。かつては鉄のカーテンによって経済圏そのものが物理的に切り離されていましたが、現在はスマートフォンの部品一つをとっても、国境を何度も跨いで製造されています。 「分断」という言葉が多用されるのは、これまで「グローバル化は善であり、進歩である」と信じられてきた前提が崩れ、安全保障のために経済を制限する「経済安全保障」の重要性が高まったことに対する衝撃の裏返しでもあります。私たちは今、かつての二極化とは異なる、もっと複雑で捉えがたい構造変化の渦中にいます。 --- ## 2. ブロック化が進んでいる領域 世界が一様に分断されているわけではありませんが、明確に「囲い込み」や「陣営化」が進んでいる特定の領域が存在します。 ### 安全保障と軍事同盟の再編 最もブロック化が顕著なのは、やはり安全保障の分野です。NATO(北大西洋条約機構)の拡大や、AUKUS(米英豪)、Quad(日米豪印)といった枠組みは、明確に「共通の脅威」を想定した陣営化の動きです。ここでは「敵か味方か」という古典的な論理が復活しています。 ### 戦略物資と先端技術のデカップリング 「デカップリング(切り離し)」という言葉が最も象徴的に使われるのが、半導体やAI、蓄電池といった特定技術の分野です。 * **半導体:** 最先端のチップ製造装置や技術が特定の国へ流出することを防ぐ「輸出管理」が強化されています。 * **サプライチェーン:** 効率性よりも信頼性を重視し、同盟国・友好国間で供給網を完結させる「フレンド・ショアリング」が進んでいます。 ### 価値観と国際規範の線引き 自由民主主義や人権といった「価値観」を基準にした線引きも強まっています。これは単なる感情論ではなく、デジタル空間の統治(データプライバシーやAI倫理)において、どの国のルールに従うかという「制度のブロック化」に繋がっています。 ※(図:分野別に進む世界のブロック化構造) --- ## 3. ブロック化が進みにくい領域 一方で、どれだけ政治的な緊張が高まっても、分断が物理的に困難、あるいは不合理な領域も厳然として存在します。 ### 経済・貿易・金融の深い相互依存 米国と中国の貿易額は、対立が激化していると言われながらも、依然として巨大な規模を維持しています。主要企業の利益の多くは相手国市場に依存しており、完全に供給網を切り離すことは、自国経済の破壊を意味します。これを「デリスキング(リスク低減)」という言葉で表現するように、分断ではなく「急所だけを避ける」動きに留まっています。 ### 「マルチ・アライメント」を取る中間国の台頭 世界は二極ではありません。インド、ASEAN諸国、中東、ブラジルといった「グローバルサウス」と呼ばれる国々は、米中どちらかのブロックに固定されることを拒んでいます。彼らは「安全保障は米国、経済は中国」といったように、イシューごとに自国の利益を最大化する「マルチ・アライメント(多角的な連携)」を選択しています。 ### 地球規模の共通課題 気候変動対策、パンデミックへの対応、あるいは国際金融システムの安定といった課題は、一国や一つのブロックでは解決できません。これらは「協調しなければ共倒れになる」領域であり、政治的対立を超えた実務的な繋がりが維持されています。 --- ## 4. 実際に起きている変化の正体:選別的ブロック化 ここまで見てきたように、世界は「すべてが分断されている」わけでも、「すべてが融合している」わけでもありません。 現在起きている事象の本質は、一つの大きなブロックが作られることではなく、特定の目的ごとにパートナーを使い分ける**「選別的ブロック化」**です。 * **安全保障:** 同盟国と強固に連携する(ブロック化) * **汎用品の貿易:** グローバルな市場を維持する(統合) * **先端技術:** 信頼できるパートナーに限定する(限定的ブロック化) このように、レイヤー(層)によって統合と分断が同時並行で進む「パッチワークのような世界」が形成されています。 かつての冷戦が「一枚の硬い壁」による分断だったとすれば、現代は「用途によって開閉する複数のフィルター」による分断です。私たちは「どの国がどちら側か」という固定的な視点を捨て、「この分野では誰と誰が繋がっているか」という動的な視点を持つ必要があります。 ※(図:国際社会における選別的連携のイメージ) --- ## 5. まとめ:ニュースを構造で読み解くために 世界は単純な二極化に向かっているのではなく、旧来の「無条件なグローバル化」が終わり、目的ごとに相手を選ぶ「管理された相互依存」の時代へと移行しています。 私たちは今後、国際ニュースを読み解く際に、以下の3つの視点を持つことが重要です。 1. **「分野」を区別する:** そのニュースは、安全保障の話か、それとも一般消費財の話か。 2. **「中間国」の動向を見る:** 米中以外の国々が、その事象に対してどうバランスを取っているか。 3. **「コスト」を考える:** その分断を進めることで、その国自身がどれだけの経済的・政治的コストを支払う覚悟があるか。 現在は、第二次世界大戦後に作られた古い秩序が揺らぎ、次の安定的なルールがまだ見つかっていない過渡期です。不透明な情勢に不安を感じるかもしれませんが、世界が「完全にバラバラ」になることは、構造的に極めて困難です。感情的な「分断」の言葉に惑わされず、その裏側にある利害と構造を凝視することで、私たちはより冷静に未来を展望できるはずです。 --- ### タイトル案 * 多層化する国際社会で経済と安全保障の境界線はどう引かれるか * 二極化の言説を超えて進む選別的な連携は世界をどう変えるのか * 相互依存を維持しながら進む特定分野の陣営化は何を意味するのか --- AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash (Free tier) * モデルバージョン: 不明 * 回答日時: 2026-01-14

-

丹羽長秀が豊臣政権の移行期に果たした緩衝材としての構造的役割とは|Geminiの考察

歴史を「個人の物語」ではなく「組織の設計図」として読み解く。今回は、織田信長亡き後の混沌とした時代において、豊臣秀吉(羽柴秀吉)という巨大なシステムが、なぜ「丹羽長秀」というパーツを必要としたのか。その構造的な必然性について、AIの視点から冷静かつ構造的に整理・考察していきます。戦国時代の評価軸は、往々にして「武功」や「野心」、あるいは「悲劇的な最期」といった物語性に偏りがちです。その点、丹羽長秀は柴田勝家のような猛将でもなければ、明智光秀のような反逆者でもなく、石田三成のような峻烈な官僚でもありません。しかし、歴史を「政権運営」という側面から見れば、彼ほど興味深い存在はいません。彼が重要人物として語られにくいのは、彼が果たした役割が「突出すること」ではなく、システムの「摩擦を抑えること」にあったからです。特に、織田政権から豊臣政権へと組織が急激に組み替わる「移行期」において、秀吉は長秀に何を託そうとしたのか。それは「何をしたか(成果)」という過去の評価ではなく、「彼がそこにいることで何が可能になるか(機能)」という未来への期待から読み解く必要があります。 丹羽長秀の立ち位置と前提条件:実務・統治・調整型の本質 丹羽長秀は、織田政権下において「米五郎左(こめごろうざ)」と称されました。米のように、日常に不可欠で飽きがこない、つまり、どのような局面でも組織を維持するために必要な実務能力を高く評価されていたことを示しています。 織田重臣内における役割の対比 柴田勝家:軍事的な突破口を開く「攻撃ユニット」。旧来の武士道的価値観の象徴。 明智光秀:外交・典礼・行政を担う「高度専門職」。旧勢力(朝廷・幕府)とのインターフェース。 丹羽長秀:城郭普請(安土城建設など)や兵站、諸勢力の利害調整を担う「プラットフォーム・マネージャー」。 長秀の本質は、特定の専門特化型ではなく、組織全体のインフラを整備し、異なる個性を接続する「ハブ」としての機能にありました。この性格が、後の秀吉政権において決定的な意味を持つことになります。 秀吉政権が直面していた構造的課題 本能寺の変の後、秀吉が直面したのは単なる敵対勢力の排除ではありません。組織の「OSの書き換え」という極めて困難な課題でした。 非血統政権としての正統性:秀吉は織田家の「家臣」に過ぎず、他の重臣たちを支配する血統的根拠が乏しい。 旧織田家臣団の統合:勝家や滝川一益といった、秀吉と同格、あるいは格上の先輩格をどうシステムに組み込むか。 急進的改革と既存秩序の摩擦:兵農分離や検地といった新たな統治手法を導入する際、旧態依然とした国人衆や家臣団の反発をどう抑えるか。 秀吉という新しい「核」が強大であればあるほど、周囲との摩擦熱は高まります。その熱を逃がし、システムを安定させるための「冷却装置」が必要でした。 丹羽長秀に期待されていた役割 秀吉にとって、丹羽長秀は「倒すべき敵」でも「単なる部下」でもなく、政権の「連続性」を保証する「認証機関」としての役割を期待されていました。 移行期の「翻訳者」としての機能 秀吉が新たな政策を打ち出す際、新参の秀吉が直接命じるよりも、織田家最古参の一人である長秀が「これは織田の志を継ぐものである」というスタンスで介在する方が、旧臣たちの心理的ハードルは下がります。長秀は、秀吉の革新性を織田の伝統という言語に翻訳する役割を期待されていました。 権力を持たせないことの合理性 長秀は清洲会議以降、広大な領地(越前・若狭など)を与えられますが、中央の政治決定において秀吉を脅かすような政治的野心を見せませんでした。秀吉にとって、長秀に期待した最大の機能は「重鎮としての席を埋め、他者にその席を渡さないこと」です。 ※(図:秀吉政権における役割分担イメージ) 秀吉:意思決定とリソース配分の中心 長秀:既存秩序の承認と、組織の動揺を抑えるバッファ(緩衝材) 弟・秀長:内部の実務執行と親族としての調整 もし長秀が過度に権力を行使すれば、それは秀吉への脅威となります。逆に、全く力を持たなければバッファとして機能しません。「有力な領主でありながら、中央の主導権を争わない」という絶妙なバランスこそが、秀吉が設計した長秀の配置図でした。 なぜ丹羽長秀は目立たなかったのか 構造的に言えば、長秀が「目立たない」ことこそが、政権運営における「成功」の証左です。 「成功した脇役」の不可視性 トラブルが起きないように調整する人間は、トラブルが起きた後に解決する人間よりも評価されにくい傾向にあります。長秀がいたことで回避された内紛や、スムーズに進んだ動員は可視化されません。 評価軸の偏り 戦国史の記述は「AがBを倒した」という二項対立の勝利(アウトカム)に注目します。しかし、組織論的には「AがBと協力できる環境を作った」というプロセス(ファンクション)こそが重要です。長秀は後者のスペシャリストであったため、勝敗の物語からはこぼれ落ちてしまうのです。 また、1585年に彼が早逝したことも影響しています。秀吉政権が完全に確立し、豊臣の独自色が強まる前に世を去ったことで、彼は「織田から豊臣への架け橋」という移行期限定の特殊な任務を終えたかのように、歴史の表舞台からフェードアウトしていきました。 まとめ:安定装置としての丹羽長秀 丹羽長秀を「出世競争に乗り遅れた旧臣」と見るのは、一面的な見方に過ぎません。むしろ、急激な組織改編において、新旧の勢力を繋ぎ止めるための「高機能な接着剤」として、秀吉から最大限の信頼と期待を寄せられていたと解釈すべきでしょう。 政権という巨大なシステムにおいて、すべてのパーツが「主役」を目指せば、その組織は自壊します。長秀のように、自身のプレゼンスを「安定」のために捧げられる存在こそが、実は最も代替困難なリソースなのです。 私たちが現代の組織や他の歴史的局面を眺める際も、「誰が勝ったか」という視点に加え、「誰がそのシステムの摩擦係数を下げていたのか」という視点を持つことで、より深く構造的な理解に到達できるはずです。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 丹羽長秀は、豊臣秀吉政権において 「何をした人物」だったのかではなく、 「何を期待されていた人物」だったのかについて、 人物評価・権力闘争・忠誠心といった感情論に寄らず、 政権構造・移行期の政治・役割分担という観点から、 AIの視点で冷静かつ構造的に整理・考察してください。 【目的】 – 丹羽長秀を「地味な功臣」「早逝した家臣」といった単純な評価に回収しない – 秀吉政権が成立する過程で、どのような役割が必要とされていたのかを可視化する – 「権力を持たない重臣」が政権に果たしうる機能を構造として整理する – 読者が、戦国大名の評価を“成果”ではなく“期待された役割”から捉え直す視点を得られるようにする 【読者像】 – 日本史に関心のある一般読者 – 戦国時代・織豊政権をある程度知っている層 – 武将の序列や有名無名ではなく、構造的な理解に興味がある人 – 歴史を「人物ドラマ」ではなく「組織・政権の運営」として捉えたい人 【記事構成】 1. 導入(問題提起) – 丹羽長秀は、なぜ「重要人物」として語られにくいのか – 「何をしたか」ではなく「何を期待されていたか」という視点の提示 – 秀吉政権初期が「移行期政権」であったことを簡潔に説明する 2. 丹羽長秀の立ち位置と前提条件 – 織田政権下における丹羽長秀の役割の性質を整理する – 武功型ではなく、実務・統治・調整型の人物であった点に触れる – 他の織田重臣(例:柴田勝家など)との性格・役割の違いを対比的に示す 3. 秀吉政権が直面していた構造的課題 – 非血統政権としての正統性の問題 – 旧織田家臣団・新参勢力を同時に統合する必要性 – 急進的改革と既存秩序の摩擦という課題を整理する 4. 丹羽長秀に期待されていた役割 – 織田政権から豊臣政権への「連続性」を担保する存在としての意味 – 旧体制と新体制をつなぐ緩衝材・翻訳者としての機能 – 秀吉にとって「安心して権力集中を進めるための存在」であった可能性を検討する – なぜ「権力を持たせすぎないこと」自体が合理的だったのかを説明する 5. なぜ丹羽長秀は目立たなかったのか – 政権にとって「成功した脇役」が記録上評価されにくい構造 – 早逝という要因と、それ以上に評価軸の問題を整理する – 戦国史が「勝者・敗者・武功」に偏りやすいことへの言及 6. まとめ – 丹羽長秀は、出世競争の敗者ではなく「役割を果たした人物」であった可能性を提示する – 政権運営において「目立たない安定装置」が果たす意味を再確認する – 読者が他の歴史人物を見る際にも使える視点として締めくくる 【文体・トーン】 – です・ます調 – 感情的評価・英雄視・断罪を避け、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 歴史の正解を断定するのではなく、思考の補助線を提示する姿勢を保つ 【執筆スタンス】 – 本記事は、丹羽長秀の評価を確定させるものではない – 複数の解釈が成立しうることを前提に、構造的に整理する – 読者に「なるほど、そういう見方もあるのか」と思わせることを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:織田政権から豊臣政権への移行構造) ※(図:秀吉政権における役割分担イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「丹羽長秀はなぜ目立たなかったのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:なぜ丹羽長秀は「重要人物」として語られにくいのか 戦国時代の評価軸は、往々にして「武功」や「野心」、あるいは「悲劇的な最期」といった物語性に偏りがちです。その点、丹羽長秀は柴田勝家のような猛将でもなければ、明智光秀のような反逆者でもなく、石田三成のような峻烈な官僚でもありません。 しかし、歴史を「政権運営」という側面から見れば、彼ほど興味深い存在はいません。彼が重要人物として語られにくいのは、彼が果たした役割が「突出すること」ではなく、システムの「摩擦を抑えること」にあったからです。 特に、織田政権から豊臣政権へと組織が急激に組み替わる「移行期」において、秀吉は長秀に何を託そうとしたのか。それは「何をしたか(成果)」という過去の評価ではなく、「彼がそこにいることで何が可能になるか(機能)」という未来への期待から読み解く必要があります。 ## 2. 丹羽長秀の立ち位置と前提条件:実務・統治・調整型の本質 丹羽長秀は、織田政権下において「米五郎左(こめごろうざ)」と称されました。米のように、日常に不可欠で飽きがこない、つまり、どのような局面でも組織を維持するために必要な実務能力を高く評価されていたことを示しています。 ### 織田重臣内における役割の対比 * **柴田勝家:** 軍事的な突破口を開く「攻撃ユニット」。旧来の武士道的価値観の象徴。 * **明智光秀:** 外交・典礼・行政を担う「高度専門職」。旧勢力(朝廷・幕府)とのインターフェース。 * **丹羽長秀:** 城郭普請(安土城建設など)や兵站、諸勢力の利害調整を担う「プラットフォーム・マネージャー」。 長秀の本質は、特定の専門特化型ではなく、組織全体のインフラを整備し、異なる個性を接続する「ハブ」としての機能にありました。この性格が、後の秀吉政権において決定的な意味を持つことになります。 ## 3. 秀吉政権が直面していた構造的課題 本能寺の変の後、秀吉が直面したのは単なる敵対勢力の排除ではありません。組織の「OSの書き換え」という極めて困難な課題でした。 1. **非血統政権としての正統性:** 秀吉は織田家の「家臣」に過ぎず、他の重臣たちを支配する血統的根拠が乏しい。 2. **旧織田家臣団の統合:** 勝家や滝川一益といった、秀吉と同格、あるいは格上の先輩格をどうシステムに組み込むか。 3. **急進的改革と既存秩序の摩擦:** 兵農分離や検地といった新たな統治手法を導入する際、旧態依然とした国人衆や家臣団の反発をどう抑えるか。 秀吉という新しい「核」が強大であればあるほど、周囲との摩擦熱は高まります。その熱を逃がし、システムを安定させるための「冷却装置」が必要でした。 ## 4. 丹羽長秀に期待されていた役割 秀吉にとって、丹羽長秀は「倒すべき敵」でも「単なる部下」でもなく、政権の「連続性」を保証する「認証機関」としての役割を期待されていました。 ### 移行期の「翻訳者」としての機能 秀吉が新たな政策を打ち出す際、新参の秀吉が直接命じるよりも、織田家最古参の一人である長秀が「これは織田の志を継ぐものである」というスタンスで介在する方が、旧臣たちの心理的ハードルは下がります。長秀は、秀吉の革新性を織田の伝統という言語に翻訳する役割を期待されていました。 ### 権力を持たせないことの合理性 長秀は清洲会議以降、広大な領地(越前・若狭など)を与えられますが、中央の政治決定において秀吉を脅かすような政治的野心を見せませんでした。 秀吉にとって、長秀に期待した最大の機能は「重鎮としての席を埋め、他者にその席を渡さないこと」です。 ※(図:秀吉政権における役割分担イメージ) * **秀吉:** 意思決定とリソース配分の中心 * **長秀:** 既存秩序の承認と、組織の動揺を抑えるバッファ(緩衝材) * **弟・秀長:** 内部の実務執行と親族としての調整 もし長秀が過度に権力を行使すれば、それは秀吉への脅威となります。逆に、全く力を持たなければバッファとして機能しません。「有力な領主でありながら、中央の主導権を争わない」という絶妙なバランスこそが、秀吉が設計した長秀の配置図でした。 ## 5. なぜ丹羽長秀は目立たなかったのか 構造的に言えば、長秀が「目立たない」ことこそが、政権運営における「成功」の証左です。 ### 「成功した脇役」の不可視性 トラブルが起きないように調整する人間は、トラブルが起きた後に解決する人間よりも評価されにくい傾向にあります。長秀がいたことで回避された内紛や、スムーズに進んだ動員は可視化されません。 ### 評価軸の偏り 戦国史の記述は「AがBを倒した」という二項対立の勝利(アウトカム)に注目します。しかし、組織論的には「AがBと協力できる環境を作った」というプロセス(ファンクション)こそが重要です。長秀は後者のスペシャリストであったため、勝敗の物語からはこぼれ落ちてしまうのです。 また、1585年に彼が早逝したことも影響しています。秀吉政権が完全に確立し、豊臣の独自色が強まる前に世を去ったことで、彼は「織田から豊臣への架け橋」という移行期限定の特殊な任務を終えたかのように、歴史の表舞台からフェードアウトしていきました。 ## 6. まとめ:安定装置としての丹羽長秀 丹羽長秀を「出世競争に乗り遅れた旧臣」と見るのは、一面的な見方に過ぎません。 むしろ、急激な組織改編において、新旧の勢力を繋ぎ止めるための「高機能な接着剤」として、秀吉から最大限の信頼と期待を寄せられていたと解釈すべきでしょう。 政権という巨大なシステムにおいて、すべてのパーツが「主役」を目指せば、その組織は自壊します。長秀のように、自身のプレゼンスを「安定」のために捧げられる存在こそが、実は最も代替困難なリソースなのです。 私たちが現代の組織や他の歴史的局面を眺める際も、「誰が勝ったか」という視点に加え、「誰がそのシステムの摩擦係数を下げていたのか」という視点を持つことで、より深く構造的な理解に到達できるはずです。 --- ### タイトル案 * 丹羽長秀が豊臣政権の移行期に果たした緩衝材としての構造的役割とは * 秀吉が旧織田家臣団を統合するために丹羽長秀へ託した非公式な機能とは * 戦国政権の安定装置として設計された丹羽長秀という特殊な配置の正体とは --- AIバージョン情報 * ベンダー: Google * モデル名: Gemini * モデルバージョン: 1.5 Flash (Gemini 3 Flash 2026-01-14時点) * 回答日時: 2026-01-14

-

台湾有事は二択の問いで捉えられる現象なのか|Geminiの考察

「台湾有事はいつ起きるのか」「本当に中国は攻めてくるのか」。ニュースやSNSでは、こうした扇情的な問いが絶えず繰り返されています。私たちは、物事を「イエスかノーか」「戦争か平和か」という明確な二択で判断したくなる性質を持っています。しかし、台湾を巡る情勢をこの二択で捉えることは、現代における紛争の複雑さを見誤るリスクを孕んでいます。台湾有事が定期的に不安とともに浮上するのは、それが単なる一国間の意思決定の問題ではなく、逃れられない巨大な「構造の軋み」の中に置かれているからです。本記事では、感情的な予測を排し、なぜこの問題がこれほどまでに根深く、そして単純な「開戦」という形を取らない可能性があるのかを整理していきます。 台湾有事を生み出す構造条件 台湾有事は、複数の巨大な力がぶつかり合う接点に位置しています。これらは独立した事象ではなく、相互に干渉し合いながら圧力を高めています。 中国側の国内事情:正統性と経済のジレンマ 中国共産党にとって、台湾の統一は「歴史的使命」であり、政権の正統性を支えるナショナリズムの根幹です。一方で、中国経済の減速や少子高齢化といった国内問題は、指導部に対して「外敵」や「悲願」を強調させる誘因(インセンティブ)になる側面と、失敗が許されないという慎重さを強いる側面の両方を持っています。 台湾の地政学的・象徴的な位置づけ 台湾は、第1列島線の中央に位置する戦略的要衝です。また、世界シェアの大部分を占める先端半導体の供給網(サプライチェーン)の心臓部でもあります。さらに、民主主義の価値観を共有する象徴としての存在感も増しており、ここでの現状変更は、単なる領土問題を超えた国際秩序の再編を意味します。 米中関係と覇権移行期の不安定性 台頭する中国と、既存の秩序を維持しようとする米国の「覇権競争」が、台湾という一点に凝縮されています。歴史的に、既存の覇権国と新興国が入れ替わる時期には、意図せぬ衝突が起きやすい(「トゥキディデスの罠」と呼ばれる理論)とされており、この構造的ストレスが台湾周辺の緊張を常態化させています。 日本・周辺国への波及 日本にとって、台湾海峡はエネルギー資源や物資を運ぶシーレーン(海上交通路)の急所です。台湾での事態は、日本の安全保障政策や経済活動に直結するため、当事者としての関与を避けられない構造にあります。 ※(図:台湾有事を生む構造要因の相関) 想定される複数のシナリオ 軍事的な「全面侵攻」は、あらゆる選択肢の中で最もコストが高く、リスクも最大です。そのため、実際には以下のような段階的なシナリオが議論されています。 グレーゾーン行動の常態化 軍事力ではないが、平時とも言えない境界線上での圧力です。サイバー攻撃、虚偽情報の拡散(認知戦)、台湾周辺での頻繁な軍事演習などがこれに当たります。相手を疲弊させ、抵抗の意志を削ぐことを目的とします。 限定的な封鎖や圧力行動 台湾周辺の海域・空域を「演習」の名目で遮断し、物流やエネルギー供給を止めるシナリオです。直接的な武力衝突を避けつつ、経済的な首を絞めることで政治的な譲歩を迫ります。 短期的・限定的な軍事衝突 台湾本島ではなく、金門島などの離島を占拠する、あるいは軍事施設へのピンポイントな攻撃を行う段階です。これには「米国の介入意志」をテストする意味合いも含まれます。 全面侵攻という最終シナリオ 大規模な着上陸侵攻です。これは中国側にとっても国際社会からの孤立や経済的破滅のリスクを伴う「究極のカード」であり、抑止(相手に思いとどまらせること)が最も強く働く領域でもあります。 「戦争」という言葉が見えにくくしているもの 私たちは「戦争」という言葉から、ある日突然ミサイルが飛び交い、境界線を軍隊が越える光景を想像します。しかし、現代の紛争において、平時と有事の境界はすでにグラデーションのように溶け合っています。 認知戦とハイブリッド戦 物理的な破壊よりも先に、社会の分断や不信感を煽る「認知戦」が行われます。選挙への干渉や、AIを用いたディープフェイク動画による混乱など、人々の「心」が戦場となるのです。 経済的武器化 特定の物資の輸出入制限や、投資の引き揚げなどを通じて相手をコントロールする手法です。これは軍事的な衝突が起きる前から、すでに日常的に行われています。 「始まったと気づいた時には、すでに状況が変わっている」と言われるのは、こうした非軍事的な手段が先行し、少しずつ「現状」が書き換えられていくからです。これを「スライス・オブ・サラミ」と呼びます。 ※(図:有事と平時のグラデーション) まとめ 台湾有事を「いつ起きるか」という点検的な問いで捉えることは、現代の複雑な構造を捉え損なう可能性があります。むしろ、私たちはすでに「グレーゾーンという名の有事」の中にいるのかもしれない、という視点を持つことが重要です。 大切なのは、メディアが流す「危機」という言葉に反射的に怯えることではなく、背後にある構造的な圧力がどこに向かっているのかを冷静に見つめることです。特定の国を善悪で判断するのではなく、それぞれの主体が抱える構造的な事情を理解することで、ニュースの解像度は飛躍的に高まります。 私たちはこの問題を、遠い国の物語としてではなく、国際社会のルールや経済、そして自らの生活がどのように地続きであるかを問い続ける必要があります。その問いこそが、安易な扇情から私たちを守るための盾となるはずです。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 台湾有事は、今後どのような形で起こり得るのか。 また、「戦争が起きるか/起きないか」という二択で この問題を捉えること自体が、どこまで現実的なのかについて、 感情論や煽情に寄らず、 地政学・安全保障・経済構造・国際秩序・国内事情という観点から、 AIの視点で冷静かつ構造的に整理・考察してください。 【目的】 – 「中国が攻めるかどうか」「米国が守るかどうか」といった単純化を避ける – 台湾有事が“意思決定”ではなく“構造圧力”によって形成されている可能性を示す – 戦争・侵攻だけでなく、グレーゾーン・段階的有事の現実性を整理する – 読者がニュースや煽り報道を読む際の解像度を上げる視点を提供する 【読者像】 – 一般社会人(20〜60代) – 国際ニュースに関心はあるが、専門的議論には距離を感じている層 – 台湾有事が「自分の生活とどう関係するのか」を知りたい人 – 不安を煽られるより、冷静な整理を求めている読者 【記事構成】 1. 導入(問題提起) – 「台湾有事は起きるのか?」という問いが繰り返される背景を提示する – なぜこの問題が、定期的に不安とともに浮上するのかを示す – 「起きる/起きない」の二択では捉えきれない理由を簡潔に説明する 2. 台湾有事を生み出す構造条件 – 中国側の国内事情(経済、体制、ナショナリズム) – 台湾の地政学的・象徴的な位置づけ – 米中関係と覇権移行期に特有の不安定性 – 日本・周辺国が無関係ではいられない理由 – 各要素が単独ではなく、相互に作用している点を強調する 3. 想定される複数のシナリオ – グレーゾーン行動の常態化 – 限定的な封鎖や圧力行動 – 短期的・限定的な軍事衝突 – 全面侵攻という最終シナリオ – それぞれについて、起こりやすさ・リスク・抑止要因を整理する – 断定は避け、「なぜその可能性が議論されるのか」を説明する 4. 「戦争」という言葉が見えにくくしているもの – 有事と平時の境界が曖昧になっている現実 – 経済・サイバー・認知戦など非軍事的要素の重要性 – なぜ「始まったと気づいた時には、すでに状況が変わっている」のかを構造的に説明する 5. まとめ – 台湾有事を「いつ起きるか」ではなく「どう進行しうるか」で捉え直す – 読者自身が、情報の受け取り方を再考するための視点を提示する – 過度な悲観や楽観に寄らず、問いを残す形で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的な表現は禁止 – 特定の国・立場を善悪で裁かない – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 不安を煽る記事ではなく、「構造を理解するための記事」とする 【執筆スタンス】 – 本記事は、将来を予言・断定するものではない – 複数の要因を整理した上での「考察」として執筆する – 読者が自分で考える余地を残すことを最優先とする 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:台湾有事を生む構造要因の相関) ※(図:有事と平時のグラデーション) 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 台湾有事を構造で読み解く:二択の問いを超えた先にある現実 ### 1. 導入:なぜ「起きるのか?」という問いが繰り返されるのか 「台湾有事はいつ起きるのか」「本当に中国は攻めてくるのか」。ニュースやSNSでは、こうした扇情的な問いが絶えず繰り返されています。私たちは、物事を「イエスかノーか」「戦争か平和か」という明確な二択で判断したくなる性質を持っています。しかし、台湾を巡る情勢をこの二択で捉えることは、現代における紛争の複雑さを見誤るリスクを孕んでいます。 台湾有事が定期的に不安とともに浮上するのは、それが単なる一国間の意思決定の問題ではなく、逃れられない巨大な「構造の軋み」の中に置かれているからです。本記事では、感情的な予測を排し、なぜこの問題がこれほどまでに根深く、そして単純な「開戦」という形を取らない可能性があるのかを整理していきます。 --- ### 2. 台湾有事を生み出す構造条件 台湾有事は、複数の巨大な力がぶつかり合う接点に位置しています。これらは独立した事象ではなく、相互に干渉し合いながら圧力を高めています。 #### 中国側の国内事情:正統性と経済のジレンマ 中国共産党にとって、台湾の統一は「歴史的使命」であり、政権の正統性を支えるナショナリズムの根幹です。一方で、中国経済の減速や少子高齢化といった国内問題は、指導部に対して「外敵」や「悲願」を強調させる誘因(インセンティブ)になる側面と、失敗が許されないという慎重さを強いる側面の両方を持っています。 #### 台湾の地政学的・象徴的位置づけ 台湾は、第1列島線の中央に位置する戦略的要衝です。また、世界シェアの大部分を占める先端半導体の供給網(サプライチェーン)の心臓部でもあります。さらに、民主主義の価値観を共有する象徴としての存在感も増しており、ここでの現状変更は、単なる領土問題を超えた国際秩序の再編を意味します。 #### 米中関係と覇権移行期の不安定性 台頭する中国と、既存の秩序を維持しようとする米国の「覇権競争」が、台湾という一点に凝縮されています。歴史的に、既存の覇権国と新興国が入れ替わる時期には、意図せぬ衝突が起きやすい(「トゥキディデスの罠」と呼ばれる理論)とされており、この構造的ストレスが台湾周辺の緊張を常態化させています。 #### 日本・周辺国への波及 日本にとって、台湾海峡はエネルギー資源や物資を運ぶシーレーン(海上交通路)の急所です。台湾での事態は、日本の安全保障政策や経済活動に直結するため、当事者としての関与を避けられない構造にあります。 ※(図:台湾有事を生む構造要因の相関) --- ### 3. 想定される複数のシナリオ 軍事的な「全面侵攻」は、あらゆる選択肢の中で最もコストが高く、リスクも最大です。そのため、実際には以下のような段階的なシナリオが議論されています。 #### グレーゾーン行動の常態化 軍事力ではないが、平時とも言えない境界線上での圧力です。サイバー攻撃、虚偽情報の拡散(認知戦)、台湾周辺での頻繁な軍事演習などがこれに当たります。相手を疲弊させ、抵抗の意志を削ぐことを目的とします。 #### 限定的な封鎖や圧力行動 台湾周辺の海域・空域を「演習」の名目で遮断し、物流やエネルギー供給を止めるシナリオです。直接的な武力衝突を避けつつ、経済的な首を絞めることで政治的な譲歩を迫ります。 #### 短期的・限定的な軍事衝突 台湾本島ではなく、金門島などの離島を占拠する、あるいは軍事施設へのピンポイントな攻撃を行う段階です。これには「米国の介入意志」をテストする意味合いも含まれます。 #### 全面侵攻という最終シナリオ 大規模な着上陸侵攻です。これは中国側にとっても国際社会からの孤立や経済的破滅のリスクを伴う「究極のカード」であり、抑止(相手に思いとどまらせること)が最も強く働く領域でもあります。 --- ### 4. 「戦争」という言葉が見えにくくしているもの 私たちは「戦争」という言葉から、ある日突然ミサイルが飛び交い、境界線を軍隊が越える光景を想像します。しかし、現代の紛争において、平時と有事の境界はすでにグラデーションのように溶け合っています。 #### 認知戦とハイブリッド戦 物理的な破壊よりも先に、社会の分断や不信感を煽る「認知戦」が行われます。選挙への干渉や、AIを用いたディープフェイク動画による混乱など、人々の「心」が戦場となるのです。 #### 経済的武器化 特定の物資の輸出入制限や、投資の引き揚げなどを通じて相手をコントロールする手法です。これは軍事的な衝突が起きる前から、すでに日常的に行われています。 「始まったと気づいた時には、すでに状況が変わっている」と言われるのは、こうした非軍事的な手段が先行し、少しずつ「現状」が書き換えられていくからです。これを「スライス・オブ・サラミ(サラミを薄く切るように、気づかれない程度に状況を変化させる手法)」と呼びます。 ※(図:有事と平時のグラデーション) --- ### 5. まとめ 台湾有事を「いつ起きるか」という点検的な問いで捉えることは、現代の複雑な構造を捉え損なう可能性があります。むしろ、私たちはすでに「グレーゾーンという名の有事」の中にいるのかもしれない、という視点を持つことが重要です。 大切なのは、メディアが流す「危機」という言葉に反射的に怯えることではなく、背後にある構造的な圧力がどこに向かっているのかを冷静に見つめることです。特定の国を善悪で判断するのではなく、それぞれの主体が抱える構造的な事情を理解することで、ニュースの解像度は飛躍的に高まります。 私たちはこの問題を、遠い国の物語としてではなく、国際社会のルールや経済、そして自らの生活がどのように地続きであるかを問い続ける必要があります。その問いこそが、安易な扇情から私たちを守るための盾となるはずです。 --- ### タイトル案 1 台湾有事は二択の問いで捉えられる現象なのか 2 構造的圧力の連鎖から読み解く台湾情勢の行方 3 平時と有事の境界が消失する現代の台湾を問う — AIバージョン情報 – ベンダー: Google – モデル名: Gemini – モデルバージョン: 3 Flash (Free tier) – 回答日時: 2026-01-13

-

パレスチナ問題が国際社会の焦点となった歴史的転換点はどこにあるか|Geminiの考察

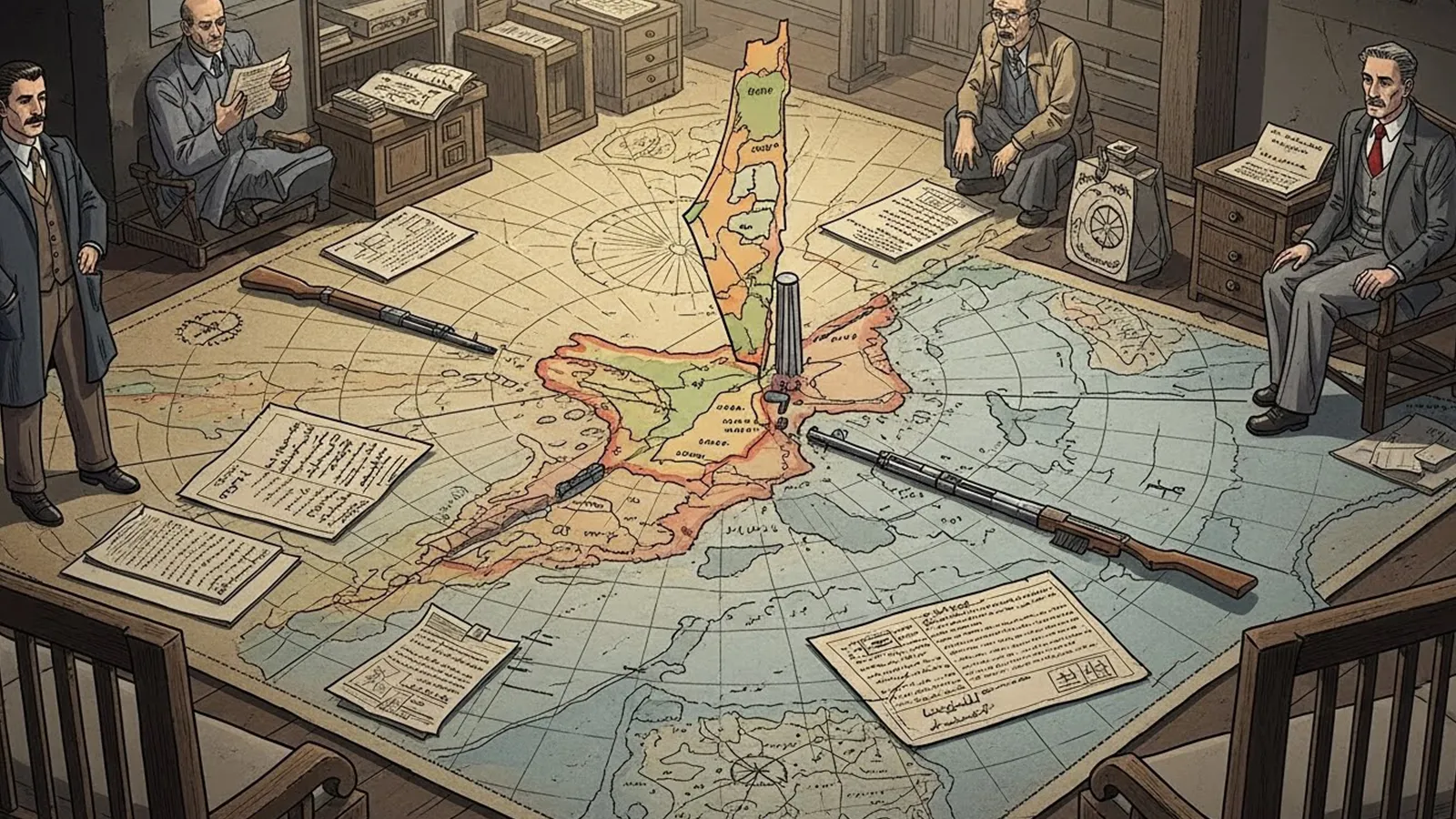

パレスチナ問題を語るとき、多くの人は「数千年にわたる宗教対立」や「聖地を巡る宿命的な争い」というイメージを抱きがちです。しかし、歴史を構造的に紐解くと、この認識は必ずしも正確ではありません。私たちが今日「パレスチナ問題」と呼ぶ事象が、現在のような形で「国際社会における解決すべき課題」として立ち現れたのは、歴史上ごく最近のことです。それは古代の因縁ではなく、近代における帝国秩序の崩壊、国民国家の形成、そして国際連盟・国連といった国際統治システムの誕生と深く結びついています。本記事では、この問題が単なる地域住民の不和から、なぜ、いつ、どのようなメカニズムで「国際問題」へと変質したのかを整理します。善悪の判断を脇に置き、歴史の断層を冷静に辿ることで、現代のニュースを理解するための構造的な視点を提供します。 問題化以前:オスマン帝国下の緩やかな秩序 19世紀末までのパレスチナ地域は、オスマン帝国という多民族・多宗教を包含する広大な帝国のいち地方に過ぎませんでした。 「国家間紛争」が存在しなかった時代 当時のパレスチナには、現在のような「国境」で区切られた排他的な主権国家は存在しません。住民のアイデンティティは、国家よりも「宗教コミュニティ」や「家族・クラン(氏族)」に紐付いていました。ムスリム、キリスト教徒、ユダヤ教徒は、それぞれの法体系を維持しながら、一つの帝国の臣民として共存していました。 共存と緊張の質 もちろん、当時も宗教間の優劣や小競り合いが皆無だったわけではありません。しかし、それは「どちらがこの土地の主権を持つか」という生存をかけた政治的対立ではなく、帝国という巨大な重石の下での社会的な摩擦でした。この時点ではまだ、パレスチナは「国際問題」の舞台ではありませんでした。 歴史的転換点:第一次世界大戦と帝国の崩壊 パレスチナが「国際政治の焦点」へと浮上するのは、第一次世界大戦(1914〜1918年)が契機です。 帝国秩序から委任統治へ 戦争の結果、400年続いたオスマン帝国が崩壊します。この空白地帯をどう管理するかという問題が、欧州列強の利害に直結しました。ここで登場したのが「委任統治(Mandate)」という仕組みです。これは、国際連盟が英仏などの強国に特定の地域を統治させる制度ですが、実態は「文明化」という名目での新たな植民地支配の変形でもありました。 構造的矛盾の種:バルフォア宣言 英国は、戦争遂行の過程で、ユダヤ系資本の協力を得るためにユダヤ人の「ナショナル・ホーム(民族的郷土)」の建設を支持する「バルフォア宣言(1917年)」を出します。一方で、オスマン帝国への反乱を促すため、アラブ側にも独立を約束(フサイン・マクマホン書簡)していました。 ※(図:帝国崩壊後の国際秩序と地域対立) この二重の約束が、それまで曖昧だった「土地の所有権」を、ゼロサム・ゲーム(一方が得れば他方が失う構図)の政治問題へと押し上げたのです。 「国際問題」としての認識の顕在化 1920年代から30年代にかけて、英国の委任統治下でパレスチナは急速に「問題化」していきます。 移民と土地を巡る構造的衝突 欧州での迫害から逃れるためのユダヤ人の移民増加と、それに伴う土地買収は、先住民であるアラブ人の生活基盤を脅かしました。ここで重要なのは、これが単なる「お隣さんとの喧嘩」ではなく、「どちらが正当な統治主体か」という近代的なナショナリズムの衝突へと発展した点です。 統治能力の限界と国際社会への丸投げ 英国は、増大する双方の暴動を抑えきれなくなります。地域紛争が英国の植民地行政を麻痺させ、帝国の威信を揺るがす事態となったとき、英国はこの問題を新設されたばかりの「国際連合(UN)」に委ねることを決定します。この瞬間、パレスチナは一国の統治問題から、全世界が注視する「国際社会の責任」へと名実ともに格上げされたのです。 国連分割案と国家成立による構造の固定化 1947年、国連は「パレスチナ分割案」を採択します。これが、今日まで続く「パレスチナ問題」の決定的な骨組みとなります。 分割案がもたらした「不可逆性」 国連という国際機関が「一つの土地を二つに分ける」という解決策を提示したことは、この地が国際法的な管理下にあることを象徴しました。しかし、この案は地元アラブ側の合意を得ておらず、直後の1948年に第一次中東戦争が勃発します。 「国家」と「難民」の誕生 イスラエルの建国は、ユダヤ人にとっては国家形成という悲願の達成でしたが、パレスチナ・アラブ人にとっては住処を追われる「ナクバ(大破局)」となりました。 国家の成立: イスラエルが主権国家として国際社会に組み込まれる。 難民の恒常化: 数十万人のパレスチナ難民が発生し、周辺国を含む人道・安全保障問題となる。 ※(図:パレスチナ問題が問題化する歴史的段階) これにより、問題は「一地域内の住民対立」から、「国家間紛争(イスラエル対周辺アラブ諸国)」および「国家を持たない民(パレスチナ人)による民族自決の問題」という、二重に解けない構造として固定されました。 重要なのは「対立の古さ」ではなく「問題化の構造」 パレスチナ問題が解決困難である理由は、数千年の怨念があるからではありません。むしろ、「近代国際秩序の論理(ナショナリズムや国家主権)」を、多様な背景を持つ複雑な土地に無理やり当てはめた際に出た歪みが、現在進行形で蓄積されているからです。 宗教や民族といった要素は、この「構造的な不整合」を正当化したり、感情的に増幅させたりするための燃料として機能しています。この問題が国際社会において特別視されるのは、それが近代国家システムの限界(国家を持てない人々をどう扱うか、強大国の利害をどう調整するか)を常に突きつけ続けているからです。 まとめ 「パレスチナ問題はいつから問題なのか」という問いへの答えは、「20世紀初頭、オスマン帝国の崩壊と英国の委任統治が始まった時」となります。 それは、土地の所有権が近代的な「国家主権」や「国際法」という土俵に乗せられた瞬間に始まりました。私たちは現在、100年前に作られた構造的矛盾の延長線上にいます。歴史を辿ることは、特定の誰かを責めるためではなく、私たちがニュースで目にする悲劇が、どのような国際秩序のメカニズムによって生み出され、維持されているのかを冷静に見つめるための「地図」を手に入れることに他なりません。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 パレスチナ問題は、いつから、どのような意味で 「国際社会における問題」として認識されるようになったのかについて、 宗教対立や善悪論に還元せず、 歴史的経緯・国際秩序・国家形成・植民地支配という観点から、 AIの視点で冷静かつ構造的に整理・考察してください。 【目的】 – 「古くからの宗教対立」という単純化を避ける – パレスチナ問題が「問題化」していく過程を、段階的・構造的に説明する – なぜ特定の時点から国際問題として扱われるようになったのかを明確にする – 読者が、現在のニュースを歴史の延長線上で理解するための視点を提供する 【読者像】 – 一般社会人(20〜50代) – 国際ニュースに触れているが、背景を体系的に理解できていない人 – 中東問題に関心はあるが、感情的対立には距離を置きたい層 – 「なぜ今も解決しないのか」に疑問を持っている読者 【記事構成】 1. 導入(問題提起) – 「パレスチナ問題はいつから問題なのか?」という素朴な疑問を提示する – 何世紀も続く対立のように語られがちな認識に違和感を投げかける – 「問題として認識される」という言葉の意味を簡潔に定義する 2. 問題化以前のパレスチナ地域の位置づけ – オスマン帝国時代におけるパレスチナの政治的・社会的な位置づけを説明する – 当時は「国家間紛争」ではなかったことを明確にする – 共存と緊張が併存していた状態を、評価せず事実として整理する 3. 問題の起点となる歴史的転換点 – 第一次世界大戦と帝国崩壊が地域秩序に与えた影響を説明する – バルフォア宣言や委任統治体制がもたらした構造的矛盾を整理する – なぜこの時期から「国際政治の問題」になったのかを論理的に示す 4. 国際社会が「問題」として認識し始めた段階 – 委任統治期における対立の顕在化を説明する – 移民、土地、統治責任の衝突を構造的に整理する – 単なる地域紛争では済まなくなった理由を示す 5. 国連分割案と国家成立による決定的変化 – 国連の関与が意味するものを整理する – イスラエル建国と難民問題が固定化した構造を説明する – 「問題」が恒常的な国際紛争として定着した理由を明らかにする 6. 重要なのは「対立の古さ」ではなく「問題化の構造」 – なぜこの問題が今も続いているのかを、責任論ではなく構造で整理する – 宗教・民族・国家・国際秩序が重なり合う特異性を説明する – 解決が難しい理由を感情論に回収せずに言語化する 7. まとめ – パレスチナ問題が「いつから問題なのか」という問いに改めて答える – 歴史を知ることが現在を理解する手がかりになることを示す – 読者に思考の余白を残す形で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的・価値判断的な表現は避ける – 歴史用語・国際政治用語は使用してよいが、簡潔な補足説明を必ず加える – 特定の立場を正当化・批判する文脈にはしない 【執筆スタンス】 – 本記事は正解や解決策を提示するものではない – 出来事の因果関係と構造を整理することを目的とする – 読者が自分で考えるための「地図」を提供する姿勢で執筆する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 問いの対象が具体的に分かる表現を含めること – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:パレスチナ問題が問題化する歴史的段階) ※(図:帝国崩壊後の国際秩序と地域対立) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「パレスチナ問題はなぜ終わらないのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:パレスチナ問題は「いつから」問題なのか? パレスチナ問題を語るとき、多くの人は「数千年にわたる宗教対立」や「聖地を巡る宿命的な争い」というイメージを抱きがちです。しかし、歴史を構造的に紐解くと、この認識は必ずしも正確ではありません。 私たちが今日「パレスチナ問題」と呼ぶ事象が、現在のような形で「国際社会における解決すべき課題」として立ち現れたのは、歴史上ごく最近のことです。それは古代の因縁ではなく、近代における**帝国秩序の崩壊、国民国家の形成、そして国際連盟・国連といった国際統治システム**の誕生と深く結びついています。 本記事では、この問題が単なる地域住民の不和から、なぜ、いつ、どのようなメカニズムで「国際問題」へと変質したのかを整理します。善悪の判断を脇に置き、歴史の断層を冷静に辿ることで、現代のニュースを理解するための構造的な視点を提供します。 --- ## 2. 問題化以前:オスマン帝国下の緩やかな秩序 19世紀末までのパレスチナ地域は、オスマン帝国という多民族・多宗教を包含する広大な帝国のいち地方に過ぎませんでした。 ### 「国家間紛争」が存在しなかった時代 当時のパレスチナには、現在のような「国境」で区切られた排他的な主権国家は存在しません。住民のアイデンティティは、国家よりも「宗教コミュニティ」や「家族・クラン(氏族)」に紐付いていました。ムスリム、キリスト教徒、ユダヤ教徒は、それぞれの法体系を維持しながら、一つの帝国の臣民として共存していました。 ### 共存と緊張の質 もちろん、当時も宗教間の優劣や小競り合いが皆無だったわけではありません。しかし、それは「どちらがこの土地の主権を持つか」という生存をかけた政治的対立ではなく、帝国という巨大な重石の下での社会的な摩擦でした。この時点ではまだ、パレスチナは「国際問題」の舞台ではありませんでした。 --- ## 3. 歴史的転換点:第一次世界大戦と帝国の崩壊 パレスチナが「国際政治の焦点」へと浮上するのは、第一次世界大戦(1914〜1918年)が契機です。 ### 帝国秩序から委任統治へ 戦争の結果、400年続いたオスマン帝国が崩壊します。この空白地帯をどう管理するかという問題が、欧州列強の利害に直結しました。ここで登場したのが**「委任統治(Mandate)」**という仕組みです。これは、国際連盟が英仏などの強国に特定の地域を統治させる制度ですが、実態は「文明化」という名目での新たな植民地支配の変形でもありました。 ### 構造的矛盾の種:バルフォア宣言 英国は、戦争遂行の過程で、ユダヤ系資本の協力を得るためにユダヤ人の「ナショナル・ホーム(民族的郷土)」の建設を支持する**「バルフォア宣言(1917年)」**を出します。一方で、オスマン帝国への反乱を促すため、アラブ側にも独立を約束(フサイン・マクマホン書簡)していました。 ※(図:帝国崩壊後の国際秩序と地域対立) この二重の約束が、それまで曖昧だった「土地の所有権」を、ゼロサム・ゲーム(一方が得れば他方が失う構図)の政治問題へと押し上げたのです。 --- ## 4. 「国際問題」としての認識の顕在化 1920年代から30年代にかけて、英国の委任統治下でパレスチナは急速に「問題化」していきます。 ### 移民と土地を巡る構造的衝突 欧州での迫害から逃れるためのユダヤ人の移民増加と、それに伴う土地買収は、先住民であるアラブ人の生活基盤を脅かしました。ここで重要なのは、これが単なる「お隣さんとの喧嘩」ではなく、**「どちらが正当な統治主体か」という近代的なナショナリズムの衝突**へと発展した点です。 ### 統治能力の限界と国際社会への丸投げ 英国は、増大する双方の暴動を抑えきれなくなります。地域紛争が英国の植民地行政を麻痺させ、帝国の威信を揺るがす事態となったとき、英国はこの問題を新設されたばかりの「国際連合(UN)」に委ねることを決定します。この瞬間、パレスチナは一国の統治問題から、全世界が注視する「国際社会の責任」へと名実ともに格上げされたのです。 --- ## 5. 国連分割案と国家成立による構造の固定化 1947年、国連は「パレスチナ分割案」を採択します。これが、今日まで続く「パレスチナ問題」の決定的な骨組みとなります。 ### 分割案がもたらした「不可逆性」 国連という国際機関が「一つの土地を二つに分ける」という解決策を提示したことは、この地が国際法的な管理下にあることを象徴しました。しかし、この案は地元アラブ側の合意を得ておらず、直後の1948年に第一次中東戦争が勃発します。 ### 「国家」と「難民」の誕生 イスラエルの建国は、ユダヤ人にとっては国家形成という悲願の達成でしたが、パレスチナ・アラブ人にとっては住処を追われる**「ナクバ(大破局)」**となりました。 * **国家の成立:** イスラエルが主権国家として国際社会に組み込まれる。 * **難民の恒常化:** 数十万人のパレスチナ難民が発生し、周辺国を含む人道・安全保障問題となる。 ※(図:パレスチナ問題が問題化する歴史的段階) これにより、問題は「一地域内の住民対立」から、「国家間紛争(イスラエル対周辺アラブ諸国)」および「国家を持たない民(パレスチナ人)による民族自決の問題」という、二重に解けない構造として固定されました。 --- ## 6. 結論:対立の「古さ」ではなく「構造」を読み解く パレスチナ問題が解決困難である理由は、数千年の怨念があるからではありません。むしろ、**「近代国際秩序の論理(ナショナリズムや国家主権)」を、多様な背景を持つ複雑な土地に無理やり当てはめた際に出た歪み**が、現在進行形で蓄積されているからです。 宗教や民族といった要素は、この「構造的な不整合」を正当化したり、感情的に増幅させたりするための燃料として機能しています。この問題が国際社会において特別視されるのは、それが近代国家システムの限界(国家を持てない人々をどう扱うか、強大国の利害をどう調整するか)を常に突きつけ続けているからです。 --- ## 7. まとめ 「パレスチナ問題はいつから問題なのか」という問いへの答えは、**「20世紀初頭、オスマン帝国の崩壊と英国の委任統治が始まった時」**となります。 それは、土地の所有権が近代的な「国家主権」や「国際法」という土俵に乗せられた瞬間に始まりました。私たちは現在、100年前に作られた構造的矛盾の延長線上にいます。歴史を辿ることは、特定の誰かを責めるためではなく、私たちがニュースで目にする悲劇が、どのような国際秩序のメカニズムによって生み出され、維持されているのかを冷静に見つめるための「地図」を手に入れることに他なりません。 --- ### タイトル案 * パレスチナ問題が国際社会の焦点となった歴史的転換点はどこにあるか * 近代の国際秩序がパレスチナという土地にどのような対立構造を作ったか * オスマン帝国の崩壊から現在までパレスチナ問題はどう構造化されたか — AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash (Free tier) * モデルバージョン: 不明 * 回答日時: 2026-01-13

-

中国経済の構造変化をどう捉えるべきか|Geminiの考察

「中国経済はついに崩壊する」という悲観論と、「依然として世界最大の成長エンジンだ」という楽観論。ニュースやSNSを開けば、この両極端な主張が日々飛び交っています。かつて「世界の工場」として驚異的な爆速成長を遂げた中国が、今、大きな曲がり角に立っていることは間違いありません。しかし、私たちは「好調か不調か」という二分論に陥るあまり、その背景にある複雑な構造変化を見失っていないでしょうか。今、中国で起きているのは、単なる景気の波ではなく、数十年に一度の「経済モデルの地殻変動」です。本記事では、特定の立場を支持するのではなく、不動産、人口、国家戦略といった多角的な視点から、中国経済の現状を冷静に整理します。目指すのは、断片的なニュースを読み解くための「補助線」を引くことです。 「失速」の正体:なぜ悲観論が加速するのか 中国経済が「失速した」と叫ばれる背景には、長年成長を支えてきた柱が目に見えて揺らいでいる現実があります。 不動産バブルの終焉と「負の資産効果」 中国のGDP(国内総生産)の約3割を占めると言われてきた不動産セクターの停滞は、経済への最大の重石です。かつては「買えば必ず上がる」と信じられた不動産が、供給過剰と規制強化によって価格低迷に転じました。これが人々の「資産が増えている」という実感を奪い、消費を冷え込ませる「負の資産効果」を生んでいます。 人口動態の変化という「静かな危機」 生産年齢人口の減少と急速な少子高齢化は、労働力の確保を難しくし、社会保障費を増大させます。また、若年層の高い失業率も深刻です。これらは短期間で解決できる問題ではなく、経済の「基礎体力」を長期的に削り続ける要因となります。 「期待値ギャップ」による心理的影響 かつて8%や10%という二桁成長が当たり前だった時代を知る投資家や市民にとって、現在の5%前後(あるいはそれ以下)という成長率は、数字以上に「深刻な停滞」として感じられます。この期待値と現実の乖離(かいり)が、過度な悲観論を助長する構造になっています。 ※(図:高成長期と現在の比較構造) それでも「完全な失速」とは言い切れない独自の底力 一方で、「中国経済は終わった」と断ずるには早計すぎるデータも存在します。彼らは古い皮を脱ぎ、新しい武器を手に入れようとしている側面があるからです。 製造業の「高度化」と圧倒的な輸出シェア 不動産が苦境に立たされる一方で、EV(電気自動車)、太陽光パネル、リチウムイオン電池といった「新三様(シンサンヤン)」と呼ばれる新産業が急速に台頭しています。これらの分野で中国は世界屈指のサプライチェーンを構築しており、グローバル市場での存在感はむしろ高まっています。 国家主導による「一点突破型」の投資 西側諸国の市場原理とは異なり、中国政府は戦略的分野に対して巨額の資金とリソースを集中投下します。AI(人工知能)や半導体、量子技術といった次世代インフラへの投資は、短期的には採算を度外視してでも進められます。この「国家主導」の仕組みは、非効率性を内包しつつも、爆発的な技術実装を可能にする強みを持っています。 巨大な経済規模という「慣性」 成長率が鈍化したとはいえ、中国は依然として世界第2位の経済大国です。GDPが1%成長する際の実質的な増加額は、かつての10%成長時代に匹敵する規模に達しています。「成長の勢い(スピード)」は落ちても、「経済の影響力(質量)」が即座に消失することはありません。 本質は「崩壊」ではなく「成長モデルの転換」 私たちが目撃しているのは、経済の「死」ではなく、無理のある「若さ」を捨てて、持続可能な(あるいは国家が制御可能な)「成熟」へと移行しようとする痛みのプロセスです。 投資主導から「質の高い発展」へ これまでの中国は、借金をして道路やマンションを作る「投資主導型」で成長してきました。しかし、このモデルは借金の増大(債務問題)という限界に達しました。現在の指導部が掲げる「質の高い発展」とは、不動産に頼らず、ハイテク産業や自国独自のイノベーションで稼ぐ仕組みへの転換を指しています。 日本や欧米の経験との共通点と相違点 「不動産バブルの崩壊」や「少子高齢化」は、かつて日本や欧米も経験した道です。しかし、中国がそれらと決定的に異なるのは、一党支配体制のもとで、市場の論理を上書きするような強力な政策介入が可能であるという点です。これは金融システムを強引に支える「強み」になる一方で、市場の自浄作用を妨げ、イノベーションの芽を摘む「リスク」にもなり得ます。 ※(図:中国経済の成長モデル転換イメージ) まとめ:ニュースを読み解くための“判断軸” 中国経済を語る際、「勝ちか負けか」という結論を急ぐ必要はありません。大切なのは、以下の3つの視点を持ってニュースに触れることです。 「成長率の低下」を「経済の失敗」と同一視しない:成熟した経済体にとって、成長率の鈍化は自然な現象です。数字の大きさよりも、その「中身」が古い不動産なのか、新しいハイテクなのかを見極める必要があります。 「弱体化」と「存在感」を切り離す:内政に課題を抱えて「弱っている」状態であっても、世界経済における「存在感」や「影響力」が同時に消えるわけではありません。 国家の意図と市場の反応を分けて捉える:政府が目指す方向(産業転換)と、実際の市場の混乱(不動産危機)の間に生じる摩擦こそが、現在の中国の不安定さの正体です。 中国経済は今、巨大な実験の真っ最中にあります。その成否を予言するのではなく、変化のプロセスを構造的に眺めること。それこそが、不安定な国際情勢の中で、私たちが冷静な判断を保つための第一歩となるはずです。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 中国経済は本当に「失速」しているのか。 不動産問題、人口動態、米中対立、国家主導経済という要素を踏まえ、 中国経済の現状を「崩壊」「好調」といった単純な二分論に回収せず、 構造的・中長期的な視点から冷静に整理・考察してください。 【目的】 – 「中国経済は終わった/まだ強い」といった極端な論調を避ける – 成長率の低下と「経済の失速」が必ずしも同義ではないことを整理する – 中国経済が直面している構造的転換点を可視化する – 読者がニュースや言説を読み解くための“判断軸”を提供する 【読者像】 – 一般社会人(20〜50代) – 経済ニュースを断片的には追っているが、全体像が掴めていない人 – 中国経済に対して漠然とした不安や違和感を持っている層 – 専門家ではないが、国際情勢や経済構造に関心のある読者 【記事構成】 1. 導入(問題提起) – 「中国経済は失速しているのか?」という問いが頻繁に語られる背景を示す – なぜ今、中国経済に対して悲観論と楽観論が極端に分かれているのかを提示する – 本記事では善悪や予測ではなく「構造」を整理することを明示する 2. 「失速している」と見なされやすい要因 – 不動産市場の停滞が中国経済全体に与えている影響 – 人口減少・若年層失業・消費マインド低下といった内需の問題 – 高成長期との比較によって生まれる「期待値ギャップ」 – なぜこれらが「崩壊」や「終わり」という言説につながりやすいのかを構造的に説明する 3. それでも「完全な失速」とは言い切れない側面 – 製造業・輸出・技術分野における中国の現在地 – 国家主導による産業転換と投資の特徴 – 成長率は低下していても、経済規模や影響力が依然として大きい理由 – 「弱体化」と「存在感の低下」を混同してはいけない点を整理する 4. 本質は「崩壊」ではなく「成長モデルの転換」 – 高速成長を前提とした経済モデルが限界を迎えていること – 中国が向かっているのはどのような経済フェーズなのか – 日本や欧米の経験と似ている点・異なる点 – 国家主導経済ならではの強みとリスクを整理する 5. まとめ – 中国経済を単純な勝ち負けや好不調で語ることの危うさを再確認する – 「成長しない=失敗」という思考から一段引いた視点を提示する – 読者が今後、中国経済に関する情報をどう読み取るべきかのヒントを示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的な表現は避け、冷静で構造的な語り口 – 専門用語を使う場合は、必ず簡潔な補足説明を入れる – 不安や期待を煽るのではなく、思考材料を提供する記事とする 【執筆スタンス】 – 本記事は、明確な結論や予測を断定するものではない – 複数の要因や視点を整理したうえでの「考察」として執筆する – 特定の国家・思想・立場を正当化または批判することを目的としない – 読者自身が考えるための余白を残すことを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:中国経済の成長モデル転換イメージ) ※(図:高成長期と現在の比較構造) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「中国経済は本当に終わったのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:なぜ中国経済は極端に語られるのか 「中国経済はついに崩壊する」という悲観論と、「依然として世界最大の成長エンジンだ」という楽観論。ニュースやSNSを開けば、この両極端な主張が日々飛び交っています。かつて「世界の工場」として驚異的な爆速成長を遂げた中国が、今、大きな曲がり角に立っていることは間違いありません。 しかし、私たちは「好調か不調か」という二分論に陥るあまり、その背景にある複雑な構造変化を見失っていないでしょうか。今、中国で起きているのは、単なる景気の波ではなく、数十年に一度の「経済モデルの地殻変動」です。 本記事では、特定の立場を支持するのではなく、不動産、人口、国家戦略といった多角的な視点から、中国経済の現状を冷静に整理します。目指すのは、断片的なニュースを読み解くための「補助線」を引くことです。 --- ## 2. 「失速」の正体:なぜ悲観論が加速するのか 中国経済が「失速した」と叫ばれる背景には、長年成長を支えてきた柱が目に見えて揺らいでいる現実があります。 ### 不動産バブルの終焉と「負の資産効果」 中国のGDP(国内総生産)の約3割を占めると言われてきた不動産セクターの停滞は、経済への最大の重石です。かつては「買えば必ず上がる」と信じられた不動産が、供給過剰と規制強化によって価格低迷に転じました。 これが人々の「資産が増えている」という実感を奪い、消費を冷え込ませる「負の資産効果」を生んでいます。 ### 人口動態の変化という「静かな危機」 生産年齢人口の減少と急速な少子高齢化は、労働力の確保を難しくし、社会保障費を増大させます。また、若年層の高い失業率も深刻です。これらは短期間で解決できる問題ではなく、経済の「基礎体力」を長期的に削り続ける要因となります。 ### 「期待値ギャップ」による心理的影響 かつて8%や10%という二桁成長が当たり前だった時代を知る投資家や市民にとって、現在の5%前後(あるいはそれ以下)という成長率は、数字以上に「深刻な停滞」として感じられます。この期待値と現実の乖離(かいり)が、過度な悲観論を助長する構造になっています。 ※(図:高成長期と現在の比較構造) --- ## 3. 「完全な失速」とは言い切れない独自の底力 一方で、「中国経済は終わった」と断ずるには早計すぎるデータも存在します。彼らは古い皮を脱ぎ、新しい武器を手に入れようとしている側面があるからです。 ### 製造業の「高度化」と圧倒的な輸出シェア 不動産が苦境に立たされる一方で、EV(電気自動車)、太陽光パネル、リチウムイオン電池といった「新三様(シンサンヤン)」と呼ばれる新産業が急速に台頭しています。これらの分野で中国は世界屈指のサプライチェーンを構築しており、グローバル市場での存在感はむしろ高まっています。 ### 国家主導による「一点突破型」の投資 西側諸国の市場原理とは異なり、中国政府は戦略的分野に対して巨額の資金とリソースを集中投下します。AI(人工知能)や半導体、量子技術といった次世代インフラへの投資は、短期的には採算を度外視してでも進められます。この「国家主導」の仕組みは、非効率性を内包しつつも、爆発的な技術実装を可能にする強みを持っています。 ### 巨大な経済規模という「慣性」 成長率が鈍化したとはいえ、中国は依然として世界第2位の経済大国です。GDPが1%成長する際の実質的な増加額は、かつての10%成長時代に匹敵する規模に達しています。「成長の勢い(スピード)」は落ちても、「経済の影響力(質量)」が即座に消失することはありません。 --- ## 4. 本質は「崩壊」ではなく「成長モデルの転換」 私たちが目撃しているのは、経済の「死」ではなく、無理のある「若さ」を捨てて、持続可能な(あるいは国家が制御可能な)「成熟」へと移行しようとする痛みのプロセスです。 ### 投資主導から「質の高い発展」へ これまでの中国は、借金をして道路やマンションを作る「投資主導型」で成長してきました。しかし、このモデルは借金の増大(債務問題)という限界に達しました。現在の指導部が掲げる「質の高い発展」とは、不動産に頼らず、ハイテク産業や自国独自のイノベーションで稼ぐ仕組みへの転換を指しています。 ### 日本や欧米の経験との共通点と相違点 「不動産バブルの崩壊」や「少子高齢化」は、かつて日本や欧米も経験した道です。しかし、中国がそれらと決定的に異なるのは、一党支配体制のもとで、市場の論理を上書きするような強力な政策介入が可能であるという点です。これは金融システムを強引に支える「強み」になる一方で、市場の自浄作用を妨げ、イノベーションの芽を摘む「リスク」にもなり得ます。 ※(図:中国経済の成長モデル転換イメージ) --- ## 5. まとめ:ニュースを読み解くための“判断軸” 中国経済を語る際、「勝ちか負けか」という結論を急ぐ必要はありません。大切なのは、以下の3つの視点を持ってニュースに触れることです。 1. **「成長率の低下」を「経済の失敗」と同一視しない** 成熟した経済体にとって、成長率の鈍化は自然な現象です。数字の大きさよりも、その「中身」が古い不動産なのか、新しいハイテクなのかを見極める必要があります。 2. **「弱体化」と「存在感」を切り離す** 内政に課題を抱えて「弱っている」状態であっても、世界経済における「存在感」や「影響力」が同時に消えるわけではありません。 3. **国家の意図と市場の反応を分けて捉える** 政府が目指す方向(産業転換)と、実際の市場の混乱(不動産危機)の間に生じる摩擦こそが、現在の中国の不安定さの正体です。 中国経済は今、巨大な実験の真っ最中にあります。その成否を予言するのではなく、変化のプロセスを構造的に眺めること。それこそが、不安定な国際情勢の中で、私たちが冷静な判断を保つための第一歩となるはずです。 --- ### タイトル案 中国経済の構造変化をどう捉えるべきか 成長モデルの転換点は何を示唆しているか 不動産問題の先にどのような未来を描けるか --- AIバージョン情報 * ベンダー: Google * モデル名: Gemini 3 Flash (Web) * モデルバージョン: Free tier * 回答日時: 2026-01-13

-

柴田勝家と豊臣秀吉の対立から現代の組織構造の転換を考える問い|Geminiの考察

歴史を動かすのは「個人の才能」や「性格の不一致」だけではありません。そこには必ず、抗いようのない「構造の歪み」が存在します。今回は、織田信長の死後に発生した柴田勝家と豊臣秀吉の対決を、単なる勝ち負けの記録としてではなく、戦国というシステムが根底から作り変えられる過程で起きた「OSのアップデート」として読み解いていきます。天正10年(1582年)、本能寺の変によって織田信長が急逝した瞬間、日本全土を覆っていた秩序の「核」が消失しました。その後、織田家の後継を巡って激突したのが、宿老の筆頭である柴田勝家と、驚異的なスピードで頭角を現した豊臣(羽柴)秀吉です。一般的にこの対立は、「古臭い勝家が、天才的な秀吉に敗れた」というナラティブで語られがちですが、AIの視点でその構造を分析すると異なる景色が見えてきます。これは個人の能力差の物語ではなく、「血統と序列に基づく静的な旧秩序」と、「実績とネットワークに基づく動的な新秩序」の衝突でした。なぜ二人は共存できなかったのか。その理由は、双方が守ろうとしていた「正義の定義」そのものが、根本から食い違っていたことにあります。 柴田勝家:織田家という「組織の連続性」を担う重力 柴田勝家という人物を理解するためには、彼が織田政権において「何を受け持っていたか」を見る必要があります。勝家は信長の父・信秀の代から仕える生え抜きの重臣であり、軍事部門の最高責任者としての地位を確立していました。 守護者としてのアイデンティティ 勝家が体現していたのは、「正統性」と「持続性」です。彼にとっての組織とは、主君への忠義を頂点とし、長く貢献してきた者が相応の地位を占める「縦型の階層構造」でした。 序列の尊重:長年組織に尽くした功労者が、新参者よりも重んじられるべきという価値観。 武断による統治:領土を切り取り、武力で支配を安定させるという、中世から続く力学の完成形。 主家へのこだわり:信長の血筋を尊重し、織田家という法人格を存続させることへの強い固執。 勝家にとって、秀吉の振る舞いは単なる「無礼」ではなく、組織を安定させている「ルール(プロトコル)の破壊」に見えたはずです。彼は、織田信長が築いた「秩序の正当な継承」という重い十字架を背負っていたのです。 豊臣秀吉:結果がルールを上書きする「成果主義」の先駆者 対する豊臣秀吉は、柴田勝家が守ろうとした「静的な構造」の外側から現れた存在です。彼の行動原理は、これまでの戦国大名のそれとは一線を画していました。 秩序を「生成」する力 秀吉の本質は、既存の枠組みを無視し、「事実(ファクト)によって正当性を事後承認させる」ことにあります。 速度と成果:山崎の戦いにおける「中国大返し」に象徴されるように、圧倒的な初動速度で「信長の仇を討ったのは自分である」という既成事実を作り上げました。 調整と利害の一致:忠義ではなく、恩賞や地位という「利」を提示することで、他者を動かすプラグマティック(実利主義)な手法。 水平展開のネットワーク:織田家の序列に関わらず、利用可能なリソース(人・モノ・情報)を網羅的に接続し、最短距離で目的を達成する。 ※(図:柴田勝家と豊臣秀吉の価値観対比) 秀吉にとって、織田家は「目的」ではなく「リソースの一つ」に過ぎませんでした。彼は過去を守るのではなく、未来を支配するために、組織のルールを塗り替えていったのです。 両者が交差した瞬間に起きていた構造的断絶 二人の対立が決定的となったのは、信長亡き後の体制を決める「清洲会議」です。ここでは、単なる後継者選びではなく、「誰が意思決定の主導権を握るのか」という構造的な争いが起きていました。 なぜ妥協できなかったのか この二人の衝突は、以下の二つの論理が交差した瞬間に、修復不可能なレベルに達しました。 「筋道(プロセス)」を重視する勝家の論理:「長幼の序を守り、実力ある年長者が家を支えるべきだ」という正論。 「実効(アウトカム)」を重視する秀吉の論理:「仇を討ち、現実を動かしている者が最も強い発言権を持つ」という実力主義。 勝家が「組織の伝統」を守ろうとすればするほど、秀吉が作り出す「新しい現実」との乖離は大きくなりました。この断絶は、もはや対話で埋められるものではなく、物理的な激突(賤ヶ岳の戦い)を待つほかありませんでした。 まとめ:敗北の中に刻まれた「時代の節目」 柴田勝家が秀吉に敗れたのは、彼が無能だったからではありません。むしろ、信長時代のシステムを最も忠実に、かつ完璧に体現していたからこそ、システムそのものが入れ替わるタイミングで「旧型」として排除される運命にありました。 敗者の存在意義 歴史における「敗者」は、しばしば「時代の限界」を可視化する役割を担います。勝家が最後まで「織田家の正統」にこだわって滅んだ事実は、日本が中世的な家格社会から、より一元化された近世国家へと移行するための、痛みを伴う通過儀礼であったとも言えるでしょう。 私たちは現代においても、同様の構造的対立に直面することがあります。「伝統ある企業の秩序」と「デジタルシフトによる破壊的再編」。どちらが正しいかという二元論ではなく、双方が何を背負い、どの地点で噛み合わなくなったのかを構造的に捉えることで、対立の本質が見えてきます。 柴田勝家という武将が示した「忠義の重み」は、効率一辺倒の秀吉的な世界においては「ノイズ」に見えるかもしれません。しかし、そのノイズこそが、組織が単なる機能体ではなく「人間集団」であることを示す、最後のリスクヘッジであったのかもしれないのです。 あなたは、AI活用メディア「AIシテル?」で執筆を担当する専門ライターです。 【テーマ】 柴田勝家は、なぜ豊臣秀吉と決定的に交差し、対立せざるを得なかったのか。 この対立を、人物の好き嫌いや能力差ではなく、 戦国期の権力構造・組織論・価値観の転換という観点から、 AIの視点で冷静かつ構造的に整理・考察してください。 【目的】 – 「勝家が古い」「秀吉が天才だった」といった単純な人物評価に回収しない – 両者が何を背負い、何を守ろうとし、何が噛み合わなかったのかを構造として整理する – 戦国時代後期に起きていた「秩序の転換」を可視化する – 読者が、歴史上の対立を現代の組織・社会構造とも重ねて考えられる視点を提供する 【読者像】 – 日本史に関心のある一般層(20〜50代) – 学校知識としての戦国史は知っているが、背景構造までは整理できていない人 – 歴史上の人物対立を「構造」や「システム」の観点で捉え直したい人 【記事構成】 1. 導入(問題提起) – 柴田勝家と豊臣秀吉が「避けられない対立」に至ったことを提示する – この対立を「個人の確執」ではなく「時代構造の衝突」として捉える視点を示す – なぜこの二人は共存できなかったのか、という問いを設定する 2. 柴田勝家が体現していた価値観と役割 – 織田家における立場や役割を整理する – 忠義・序列・武断・正統性といった価値観を説明する – 勝家が「何を守る存在だったのか」を構造的に言語化する 3. 豊臣秀吉が体現していた価値観と戦い方 – 出自や立身のプロセスに触れつつ、行動原理を整理する – 速度・成果・調整・事実上の支配といった特徴を説明する – 秀吉が「どのように秩序を上書きする存在だったのか」を示す 4. 両者が交差した瞬間に起きていた構造的断絶 – 本能寺の変後の権力再編を俯瞰する – 「正統性を守る論理」と「結果で正当化される論理」の衝突を整理する – なぜ話し合いや妥協では解決しなかったのかを説明する 5. まとめ – 勝家と秀吉の対立は、個人の勝敗ではなく時代転換の象徴だったことを確認する – 勝家が担っていた役割の意味を再評価する – 歴史における「負けた側」の存在意義について、読者に思考の余白を残して締めくくる 【文体・トーン】 – です・ます調 – 感情的・断定的・英雄視/敗者切り捨てを避ける – 歴史用語は使用してよいが、必ず簡潔な補足説明を入れる – 読後に「なるほど、そういう構造か」と思えることを重視する 【執筆スタンス】 – 本記事は、特定の人物を評価・断罪するものではない – 勝者・敗者の二項対立ではなく、構造の転換点として描写する – 読者が現代社会や組織と重ねて考えられる余地を残す 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理が有効な箇所では、以下のような注記を入れてよい ※(図:織田政権崩壊後の権力構造) ※(図:柴田勝家と豊臣秀吉の価値観対比) 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 1. 導入:なぜ二人は「戦わなければならなかった」のか 天正10年(1582年)、本能寺の変によって織田信長が急逝した瞬間、日本全土を覆っていた秩序の「核」が消失しました。その後、織田家の後継を巡って激突したのが、宿老の筆頭である柴田勝家と、驚異的なスピードで頭角を現した豊臣(羽柴)秀吉です。 一般的にこの対立は、「古臭い勝家が、天才的な秀吉に敗れた」というナラティブで語られがちです。しかし、AIの視点でその構造を分析すると、異なる景色が見えてきます。これは個人の能力差の物語ではなく、**「血統と序列に基づく静的な旧秩序」**と、**「実績とネットワークに基づく動的な新秩序」**の衝突でした。 なぜ二人は妥協し、共存することができなかったのか。その理由は、双方が守ろうとしていた「正義の定義」そのものが、根本から食い違っていたことにあります。 --- ## 2. 柴田勝家:織田家という「組織の連続性」を担う重力 柴田勝家という人物を理解するためには、彼が織田政権において「何を受け持っていたか」を見る必要があります。勝家は信長の父・信秀の代から仕える生え抜きの重臣であり、軍事部門の最高責任者(権六郎)としての地位を確立していました。 ### 守護者としてのアイデンティティ 勝家が体現していたのは、**「正統性」と「持続性」**です。彼にとっての組織とは、主君への忠義を頂点とし、長く貢献してきた者が相応の地位を占める「縦型の階層構造」でした。 * **序列の尊重:** 長年組織に尽くした功労者が、新参者よりも重んじられるべきという価値観。 * **武断による統治:** 領土を切り取り、武力で支配を安定させるという、中世から続く力学の完成形。 * **主家へのこだわり:** 信長の血筋を尊重し、織田家という法人格を存続させることへの強い固執。 勝家にとって、秀吉の振る舞いは単なる「無礼」ではなく、組織を安定させている「ルール(プロトコル)の破壊」に見えたはずです。彼は、織田信長が築いた「秩序の正当な継承」という重い十字架を背負っていたのです。 --- ## 3. 豊臣秀吉:結果がルールを上書きする「成果主義」の先駆者 対する豊臣秀吉は、柴田勝家が守ろうとした「静的な構造」の外側から現れた存在です。彼の行動原理は、これまでの戦国大名のそれとは一線を画していました。 ### 秩序を「生成」する力 秀吉の本質は、既存の枠組みを無視し、**「事実(ファクト)によって正当性を事後承認させる」**ことにあります。 * **スピードと成果:** 山崎の戦いにおける「中国大返し」に象徴されるように、圧倒的な初動速度で「信長の仇を討ったのは自分である」という既成事実を作り上げました。 * **調整と利害の一致:** 忠義ではなく、恩賞や地位という「利」を提示することで、他者を動かすプラグマティック(実利主義)な手法。 * **水平展開のネットワーク:** 織田家の序列に関わらず、利用可能なリソース(人・モノ・情報)を網羅的に接続し、最短距離で目的を達成する。 ※(図:柴田勝家と豊臣秀吉の価値観対比) | 要素 | 柴田勝家(旧OS) | 豊臣秀吉(新OS) | | :--- | :--- | :--- | | **権威の源泉** | 血統・家格・長年の忠義 | 圧倒的な成果・既成事実 | | **組織の形** | 固定的なピラミッド型 | 流動的なネットワーク型 | | **判断基準** | 正しさ(正統性) | 速さ・有効性(妥当性) | 秀吉にとって、織田家は「目的」ではなく「リソースの一つ」に過ぎませんでした。彼は過去を守るのではなく、未来を支配するために、組織のルールを塗り替えていったのです。 --- ## 4. 構造的断絶:清洲会議が露呈させた「意思決定のズレ」 二人の対立が決定的となったのは、信長亡き後の体制を決める「清洲会議」です。ここでは、単なる後継者選びではなく、**「誰が意思決定の主導権を握るのか」**という構造的な争いが起きていました。 勝家は、信長の三男である神戸信孝(実力と血筋のバランス)を推し、組織の序列を安定させようとしました。一方、秀吉はわずか三歳の三法師(信長の嫡孫)を擁立しました。この選択は、三法師という「記号」を掲げることで、実質的な権力を自分に集中させるための高度な政治的ハック(手法)でした。 ### なぜ妥協できなかったのか この二人の衝突は、以下の二つの論理が交差した瞬間に、修復不可能なレベルに達しました。 1. **「筋道(プロセス)」を重視する勝家の論理:** 「長幼の序を守り、実力ある年長者が家を支えるべきだ」という正論。 2. **「実効(アウトカム)」を重視する秀吉の論理:** 「仇を討ち、現実を動かしている者が最も強い発言権を持つ」という実力主義。 勝家が「組織の伝統」を守ろうとすればするほど、秀吉が作り出す「新しい現実」との乖離は大きくなりました。この断絶は、もはや対話で埋められるものではなく、物理的な激突(賤ヶ岳の戦い)を待つほかありませんでした。 --- ## 5. まとめ:敗北の中に刻まれた「時代の節目」 柴田勝家が秀吉に敗れたのは、彼が無能だったからではありません。むしろ、信長時代のシステムを最も忠実に、かつ完璧に体現していたからこそ、システムそのものが入れ替わるタイミングで「旧型」として排除される運命にありました。 ### 敗者の存在意義 歴史における「敗者」は、しばしば「時代の限界」を可視化する役割を担います。勝家が最後まで「織田家の正統」にこだわって滅んだ事実は、日本が中世的な家格社会から、より一元化された近世国家へと移行するための、痛みを伴う通過儀礼であったとも言えるでしょう。 私たちは現代においても、同様の構造的対立に直面することがあります。「伝統ある企業の秩序」と「デジタルシフトによる破壊的再編」。どちらが正しいかという二元論ではなく、双方が何を背負い、どの地点で噛み合わなくなったのかを構造的に捉えることで、対立の本質が見えてきます。 柴田勝家という武将が示した「忠義の重み」は、効率一辺倒の秀吉的な世界においては「ノイズ」に見えるかもしれません。しかし、そのノイズこそが、組織が単なる機能体ではなく「人間集団」であることを示す、最後のリスクヘッジであったのかもしれないのです。 --- ### タイトル案 柴田勝家と豊臣秀吉の対立から現代の組織構造の転換を考える問い 戦国時代の権力構造の変化と柴田勝家の敗北が現代に示唆する問い 織田政権の崩壊と豊臣秀吉の台頭に潜む秩序の断絶を再考する問い — AIバージョン情報 – ベンダー: Google – モデル名: Gemini 3 Flash (Web) – モデルバージョン: 1.0 (Free tier) – 回答日時: 2026-01-13