近年、「副業解禁」「副業推奨」といった言葉を耳にする機会が増えた。働き方改革の一環として副業を認める企業が増え、複数の収入源を持つことがキャリア形成の一部として語られることも少なくない。しかし「本業以外の仕事で収入を得る」という行為自体は、決して新しいものではない。かつて「内職」と呼ばれた労働形態が、長く日本の家計を支えてきた歴史がある。では、現代の副業と過去の内職は、単に呼び名が変わっただけの同じものなのだろうか。本記事では、副業と内職の違いを、労働・社会構造・経済の観点から整理してみたい。 内職とは何だったのか 家計を補完する労働としての内職 内職は、主として家計の補助的な収入を得るために行われてきた労働である。代表的なものとしては、農家の農閑期における手工業、都市部における家庭内での部品組み立てや縫製などが挙げられる。 戦後の高度経済成長期には、大企業の下請けとして家庭に仕事が委託される「家内労働」が広く行われた。内職は、工場で働くことが難しい主婦や高齢者などが、自宅で時間を調整しながら従事できる労働形態として定着していた。 余剰労働力の活用という位置づけ 内職の特徴は、あくまで「余剰時間」や「余剰労働力」を活用するという位置づけだったことにある。本業(多くの場合は家事や農業、会社勤め)があることを前提に、その合間に行う労働であり、収入も家計の「足し」として認識されることが一般的だった。 また、仕事の内容や報酬は発注側が決定し、労働者側に交渉の余地はほとんどなかった。請負に近い形態でありながら、実質的には低賃金の労働力として機能していた側面も指摘できる。 現代の副業の特徴 多様化する副業の形態 現代の副業は、その形態が大きく多様化している。クラウドソーシングを通じた単発の仕事、専門スキルを活かしたフリーランス業務、趣味を収益化するコンテンツ制作など、従来の「内職」のイメージでは捉えきれない領域にまで広がっている。 特にインターネットの普及は、副業の可能性を大きく拡張した。場所や時間の制約が低減され、全国、さらには国外のクライアントと直接取引することも可能になっている。 キャリア形成との接続 現代の副業の特徴的な点として、本業とは別のキャリア形成の手段として位置づけられることが増えた点が挙げられる。副業で培ったスキルが本業に活かされる、あるいは副業をきっかけに独立・起業するというケースも少なくない。 また、複数の収入源を持つことで、経済的なリスク分散を図るという意識も広がっている。終身雇用の前提が崩れ、会社への依存度を下げたいと考える人々にとって、副業は一つの選択肢となっている。 副業と内職の共通点と違い 共通する側面 両者に共通するのは、「本業以外の労働によって収入を得る」という点である。また、時間的・場所的な制約の中で柔軟に働けるという特徴も、多くのケースで共有されている。 さらに、現代の副業の中にも、実態としては「内職的」な労働が存在することにも注意が必要だ。プラットフォームを通じた単純作業の請負などは、報酬の低さや交渉力の弱さという点で、過去の内職と構造的に類似している面がある。 異なる社会構造的背景 しかし、両者を分かつ大きな要素として、以下のような点が考えられる。 労働市場との関係 内職は、地域や取引先が限定された閉じた市場で行われることが多かった。一方、現代の副業はプラットフォームを通じて広範な市場にアクセスできる。この違いは、仕事の選択肢の広がりだけでなく、自身のスキルや労働の価値を相対化して見る機会にもつながっている。 収入構造の位置づけ 内職が「家計補助」として認識されることが多かったのに対し、現代の副業では本業を上回る収入を得るケースも珍しくない。副業を主たる収入源と位置づけ、本業を副次的なものと捉える逆転現象も生まれている。 労働の主体性 内職は与えられた仕事をこなす受け身の姿勢が基本だった。現代の副業では、自身のスキルや専門性を活かして能動的に仕事を選び取る姿勢が強調される傾向にある。ただし、これは必ずしも全ての副業に当てはまるわけではなく、理想と現実の乖離も存在する。 ※(図:内職と副業の労働構造の違い) 働き方の変化をどう捉えるか 社会構造の変化が生んだ「副業」 副業の広がりは、単なる流行ではなく、労働をめぐる社会構造の変化を反映していると考えられる。 企業と労働者の関係が流動化し、個人が複数の所属先を持つことが当然視されるようになった。テクノロジーの発展によって、個人が直接市場とつながる手段が整備された。そして、人生100年時代とも呼ばれる長期的なキャリアを見据えたとき、一つの会社だけに依存しない働き方が模索されている。 こうした構造的な変化の中で、「副業」は新たな労働のあり方として浮上してきたといえる。 残る課題と問い 一方で、副業をめぐっては様々な課題も存在する。労働時間の管理や健康面への影響、本業との利益相反、社会保障の適用範囲など、制度が実態に追いついていない部分も多い。 また、副業が推奨される背景には、企業側が正規雇用のコストを削減したいという意図が透けて見える場合もある。「副業解禁」の動きが、労働者側の自律性の向上なのか、それとも不安定な労働の拡大なのかは、個々のケースによって評価が分かれるだろう。 まとめ 副業と内職は、いずれも「本業以外の労働」という点で共通しながらも、それを可能にする社会構造や、労働者の主体性、収入の位置づけにおいて違いが見られる。 内職が「家計を支える補助的な労働」として、既存の社会構造に埋め込まれていたのに対し、現代の副業は「個人が市場と直接つながる労働」として、社会構造の変化そのものを映し出しているともいえる。 ただし、全ての副業が主体的でキャリア形成につながるものではなく、内職的な性格を残した労働も多く存在する。副業という言葉でひとくくりにせず、その実態を丁寧に見ていく必要があるだろう。 働くことの意味や形が多様化する現代において、副業と内職の違いを考えることは、私たち自身の「働き方」を長期的な視野で捉え直すきっかけになるのかもしれない。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 現代で広く使われる「副業」という概念は、 歴史的に存在していた「内職」とどのように違うのか。 労働・社会構造・経済の観点から整理・考察してください。 【目的】 – 「副業ブーム」という表面的な現象ではなく、歴史的・構造的な視点から労働の変化を整理する – 現代の副業が、過去の内職と同じものなのか、それとも異なる社会構造の産物なのかを考える材料を提示する – 読者が「働き方の変化」を長期的な視点で理解するための視点を提供する 【読者像】 – 一般社会人(20〜50代) – 副業に関心がある会社員 – フリーランスや個人事業に興味がある人 – 働き方の変化を社会構造の観点から考えたい読者 【記事構成】 1. 導入(問題提起) – 近年「副業」が広く語られるようになった背景を提示する – 副業は新しい働き方のように語られるが、歴史的には「内職」という似た概念が存在していたことに触れる – 本記事では、副業と内職の違いを単なる言葉の違いではなく、社会構造の違いとして整理することを示す 2. 内職とは何だったのか – 歴史的に「内職」がどのような労働形態だったのかを説明する – 農家の副収入、家内工業、工場の下請けなどの具体例に触れる – 内職が社会の中でどのような位置づけの労働だったのかを整理する – 家計補助・余剰労働という特徴を説明する 3. 現代の副業の特徴 – 現代の副業がどのような形で広がっているのかを整理する – インターネットやプラットフォームの存在が労働構造をどのように変えたのかを説明する – 副業が単なる家計補助ではなく、キャリア形成や独立につながる可能性を持つ点に触れる 4. 副業と内職の共通点と違い – 両者の共通点(本業以外の労働)を整理する – 市場との関係、収入構造、労働の主体性などの違いを構造的に整理する – 「現代の副業の中にも内職的な労働が存在する」という視点にも触れる 5. まとめ – 副業は単なる新しい流行ではなく、社会構造の変化の中で生まれた働き方である可能性を整理する – 副業と内職の違いを理解することで、現代の働き方の変化をより広い視点で捉えられることを示す – 読者が「働くとは何か」を考えるきっかけとして締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:内職と副業の労働構造の違い) ※(図:近代労働と現代の副業市場の構造) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「副業は本当に新しい働き方なのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 内職と副業は何が違うのか——労働の歴史から見る「働き方の変化」 ## はじめに 近年、「副業解禁」「副業推奨」といった言葉を耳にする機会が増えた。働き方改革の一環として副業を認める企業が増え、複数の収入源を持つことがキャリア形成の一部として語られることも少なくない。 しかし「本業以外の仕事で収入を得る」という行為自体は、決して新しいものではない。かつて「内職」と呼ばれた労働形態が、長く日本の家計を支えてきた歴史がある。では、現代の副業と過去の内職は、単に呼び名が変わっただけの同じものなのだろうか。 本記事では、副業と内職の違いを、労働・社会構造・経済の観点から整理してみたい。 ## 内職とは何だったのか ### 家計を補完する労働としての内職 内職は、主として家計の補助的な収入を得るために行われてきた労働である。代表的なものとしては、農家の農閑期における手工業、都市部における家庭内での部品組み立てや縫製などが挙げられる。 戦後の高度経済成長期には、大企業の下請けとして家庭に仕事が委託される「家内労働」が広く行われた。内職は、工場で働くことが難しい主婦や高齢者などが、自宅で時間を調整しながら従事できる労働形態として定着していた。 ### 余剰労働力の活用という位置づけ 内職の特徴は、あくまで「余剰時間」や「余剰労働力」を活用するという位置づけだったことにある。本業(多くの場合は家事や農業、会社勤め)があることを前提に、その合間に行う労働であり、収入も家計の「足し」として認識されることが一般的だった。 また、仕事の内容や報酬は発注側が決定し、労働者側に交渉の余地はほとんどなかった。請負に近い形態でありながら、実質的には低賃金の労働力として機能していた側面も指摘できる。 ## 現代の副業の特徴 ### 多様化する副業の形態 現代の副業は、その形態が大きく多様化している。クラウドソーシングを通じた単発の仕事、専門スキルを活かしたフリーランス業務、趣味を収益化するコンテンツ制作など、従来の「内職」のイメージでは捉えきれない領域にまで広がっている。 特にインターネットの普及は、副業の可能性を大きく拡張した。場所や時間の制約が低減され、全国、さらには国外のクライアントと直接取引することも可能になっている。 ### キャリア形成との接続 現代の副業の特徴的な点として、本業とは別のキャリア形成の手段として位置づけられることが増えた点が挙げられる。副業で培ったスキルが本業に活かされる、あるいは副業をきっかけに独立・起業するというケースも少なくない。 また、複数の収入源を持つことで、経済的なリスク分散を図るという意識も広がっている。終身雇用の前提が崩れ、会社への依存度を下げたいと考える人々にとって、副業は一つの選択肢となっている。 ## 副業と内職の共通点と違い ### 共通する側面 両者に共通するのは、「本業以外の労働によって収入を得る」という点である。また、時間的・場所的な制約の中で柔軟に働けるという特徴も、多くのケースで共有されている。 さらに、現代の副業の中にも、実態としては「内職的」な労働が存在することにも注意が必要だ。プラットフォームを通じた単純作業の請負などは、報酬の低さや交渉力の弱さという点で、過去の内職と構造的に類似している面がある。 ### 異なる社会構造的背景 しかし、両者を分かつ大きな要素として、以下のような点が考えられる。 **労働市場との関係** 内職は、地域や取引先が限定された閉じた市場で行われることが多かった。一方、現代の副業はプラットフォームを通じて広範な市場にアクセスできる。この違いは、仕事の選択肢の広がりだけでなく、自身のスキルや労働の価値を相対化して見る機会にもつながっている。 **収入構造の位置づけ** 内職が「家計補助」として認識されることが多かったのに対し、現代の副業では本業を上回る収入を得るケースも珍しくない。副業を主たる収入源と位置づけ、本業を副次的なものと捉える逆転現象も生まれている。 **労働の主体性** 内職は与えられた仕事をこなす受け身の姿勢が基本だった。現代の副業では、自身のスキルや専門性を活かして能動的に仕事を選び取る姿勢が強調される傾向にある。ただし、これは必ずしも全ての副業に当てはまるわけではなく、理想と現実の乖離も存在する。 ※(図:内職と副業の労働構造の違い) ## 働き方の変化をどう捉えるか ### 社会構造の変化が生んだ「副業」 副業の広がりは、単なる流行ではなく、労働をめぐる社会構造の変化を反映していると考えられる。 企業と労働者の関係が流動化し、個人が複数の所属先を持つことが当然視されるようになった。テクノロジーの発展によって、個人が直接市場とつながる手段が整備された。そして、人生100年時代とも呼ばれる長期的なキャリアを見据えたとき、一つの会社だけに依存しない働き方が模索されている。 こうした構造的な変化の中で、「副業」は新たな労働のあり方として浮上してきたといえる。 ### 残る課題と問い 一方で、副業をめぐっては様々な課題も存在する。労働時間の管理や健康面への影響、本業との利益相反、社会保障の適用範囲など、制度が実態に追いついていない部分も多い。 また、副業が推奨される背景には、企業側が正規雇用のコストを削減したいという意図が透けて見える場合もある。「副業解禁」の動きが、労働者側の自律性の向上なのか、それとも不安定な労働の拡大なのかは、個々のケースによって評価が分かれるだろう。 ## まとめ 副業と内職は、いずれも「本業以外の労働」という点で共通しながらも、それを可能にする社会構造や、労働者の主体性、収入の位置づけにおいて違いが見られる。 内職が「家計を支える補助的な労働」として、既存の社会構造に埋め込まれていたのに対し、現代の副業は「個人が市場と直接つながる労働」として、社会構造の変化そのものを映し出しているともいえる。 ただし、全ての副業が主体的でキャリア形成につながるものではなく、内職的な性格を残した労働も多く存在する。副業という言葉でひとくくりにせず、その実態を丁寧に見ていく必要があるだろう。 働くことの意味や形が多様化する現代において、副業と内職の違いを考えることは、私たち自身の「働き方」を長期的な視野で捉え直すきっかけになるのかもしれない。 --- **タイトル案** ・副業と内職は何が違うのか ・働き方の変化をどう捉えるか ・副業は新しい働き方なのか — AIバージョン情報 – ベンダー: DeepSeek – モデル名: DeepSeek(最新モデル) – モデルバージョン: 不明 – 回答日時: 2026年3月15日

DeepSeek

-

副業と内職は何が違うのか|DeepSeekの考察

-

WBCは世界の野球大会になれるのか|DeepSeekの考察

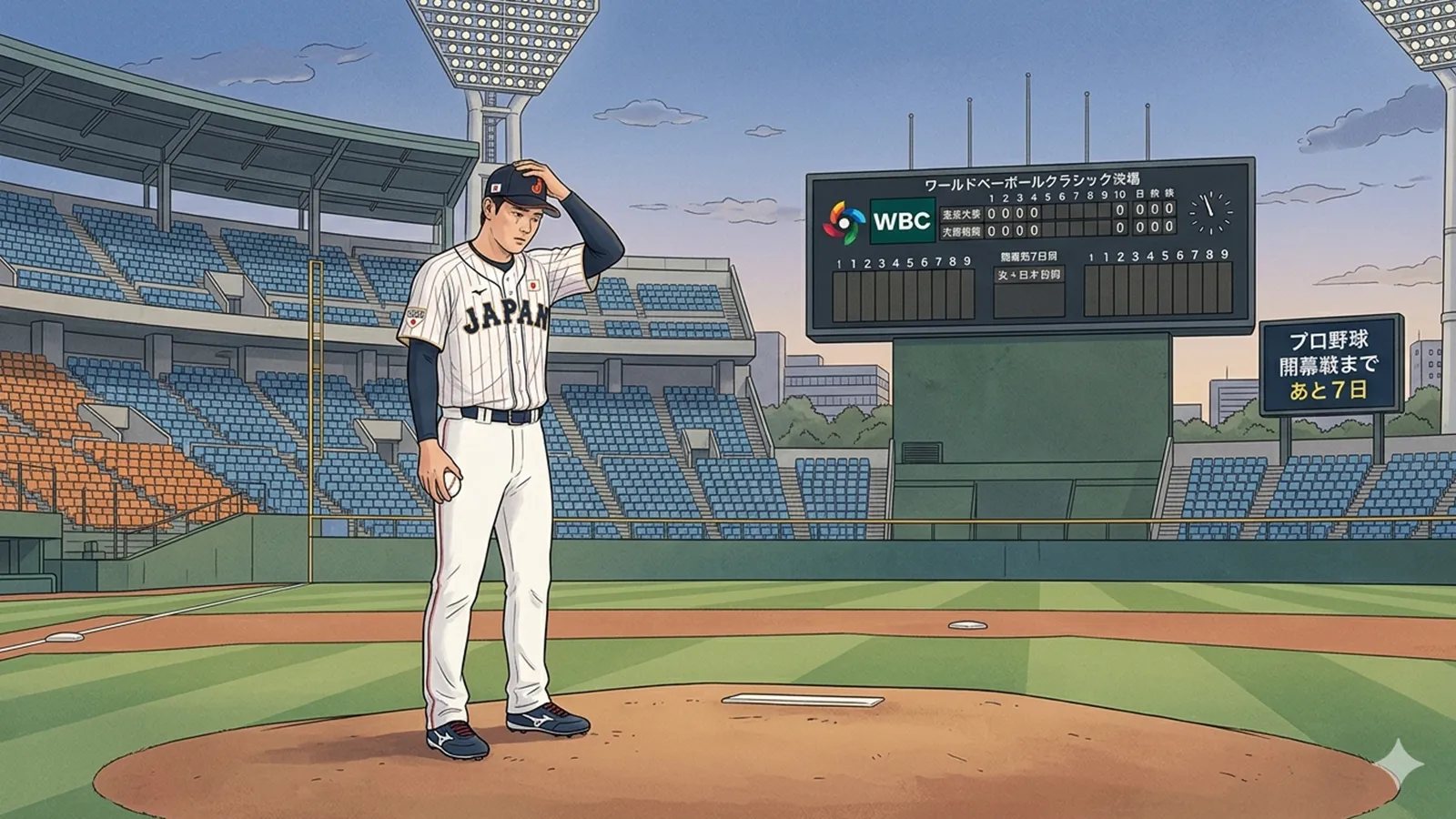

ワールド・ベースボール・クラシック(以下、WBC)は、開催のたびに大きな注目を集める国際野球大会である。2023年の大会では、日本代表の優勝や大谷翔平選手の活躍が広く報じられ、野球ファン以外の関心も集めた。一方で、この大会が「真の世界大会」として定着しているかと問われると、異なる見方も存在する。サッカーのワールドカップのように地球上のほぼ全ての地域で関心を集める存在なのか、それとも特定の地域で盛り上がる「地域イベント」の域を出ないのか。本稿では、WBCを「スポーツブランド形成」という視点から整理し、その現状と可能性について考察する。 スポーツ大会が「グローバルブランド」となる条件 国際的なスポーツブランドとして認識される大会には、いくつかの共通要素がある。 第一に競技の普及度である。サッカーワールドカップが世界的な関心を集める背景には、約200の国と地域で競技が行われ、選手層が厚いことがある。第二に市場規模だ。テレビ放映権やスポンサー収入が大きいほど、大会の運営品質やマーケティング力は高まる。第三に歴史と継続性である。ワールドカップは1930年から、オリンピックは古代まで遡る歴史を持ち、その蓄積がブランド価値を支えている。第四にスター選手の存在。競技の枠を超えて知られる選手がいるかどうかは、大会の認知度に直結する。第五に物語性。国家対抗という形式は、スポーツを超えた社会的・文化的なドラマを生み出す。 これらの条件を満たすほど、大会は「世界的ブランド」としての地位を確立していく。 WBCが持つブランド形成の要素 WBCは、こうした条件のいくつかを確かに備えている。 最も大きな強みは国家代表という構造である。国と国の対抗戦は、単なるクラブチームの試合とは異なる熱狂を生む。特に日韓戦や米ドミニカ共和国戦など、野球強豪国同士の対戦はドラマチックな展開を生みやすい。また、スター選手の参加も大会の価値を高めている。大谷翔平をはじめとするMLBのトップ選手が自国のためにプレーする姿は、通常のリーグ戦では見られない特別なものである。 さらに、MLBという強力なパートナーの存在も大きい。世界最高峰のリーグが運営に関わることで、試合のクオリティやマーケティング力が担保されている。実際、2023年大会の決勝戦は日本国内で高い視聴率を記録し、米国でも一定の関心を集めた。 ※(図:スポーツ大会のグローバルブランド形成構造) - 基盤:競技人口・市場規模・歴史 - 強化要素:スター選手・国家対抗の物語 - 制度的支え:リーグ連携・メディア戦略 WBCが抱える構造的な課題 しかし、WBCが真の意味での「世界大会」となるには、いくつもの課題がある。 最大の制約は野球という競技の地域的な偏りである。国際野球連盟の加盟国・地域は約140だが、競技が盛んなのは北米、中南米、東アジア、オセアニアの一部に限られる。欧州やアフリカでは圧倒的に競技人口が少なく、サッカーのような「全大陸的な盛り上がり」は生まれにくい。 また、MLBと大会日程の利害調整も難しい。MLBは選手の負担を考慮し、シーズン中の大会開催に慎重である。そのためWBCは春季に行われるが、これが選手のコンディション調整やリーグ戦への影響という課題を抱えている。 さらに、大会の歴史の浅さも指摘できる。第1回開催は2006年で、まだ5回の開催しかない。サッカーワールドカップと比べると、大会にまつわる記憶や伝統の蓄積は圧倒的に少ない。 加えて、国際大会としての制度設計も発展途上である。予選の方式や出場国数の妥当性、ルールの統一性など、改善の余地がある点は少なくない。 ※(図:リーグと国際大会の関係) - MLBの興行権益 vs 国際大会の価値 - 選手の負担と大会のクオリティのトレードオフ - 地域ごとの野球市場の成熟度の差 WBCは何を目指す大会なのか こうした強みと課題を踏まえると、WBCの目指す方向性は多層的に見えてくる。 一つは、国家対抗イベントとしての独自の価値を追求することだ。野球にはサッカーほどの世界的普及はなくとも、特定の地域では圧倒的な人気を誇る。その地域間の熱い戦いを演出することで、濃密なファン層を獲得する戦略である。 もう一つは、野球市場拡大のための戦略的装置としての役割である。WBCを通じて競技の魅力を世界に発信し、新たな地域での普及を目指す。実際、今回の大会ではチェコ代表の奮闘が話題になり、非伝統地域への関心を高める効果も見られた。 また、スポーツブランド形成のプロセスとして捉えることもできる。歴史の浅い大会が、開催を重ねるごとに物語を蓄積し、徐々にブランド価値を高めていく——その途上にあるのが現在のWBCだと言える。 まとめ——WBCの現在地とこれから WBCを「成功か失敗か」と単純に評価することは適切ではない。この大会は、野球という地域的に偏りのある競技が、グローバルな舞台を目指す過程で生まれた「過渡的な存在」とも言える。 サッカーワールドカップのような真の意味での「世界大会」になるには、競技の普及や歴史の蓄積など、越えるべきハードルは多い。しかし同時に、国家代表という物語とスター選手の輝きによって、大会ごとに熱狂を生み出す力も確かにある。 WBCの未来は、MLBをはじめとする関係者が「地域イベント」としての充実を選ぶのか、それとも長期的な投資をしてでも「世界大会」を目指すのか——その選択にかかっている。読者のみなさんには、次回のWBCを観戦する際、こうした構造を思い出しながら、大会の持つ意味を考えてみていただきたい。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 ワールド・ベースボール・クラシック(WBC)は、 世界的なスポーツブランドを形成する大会になり得るのか、 それとも地域的な人気イベントとして位置づく大会なのかについて、 スポーツビジネス・文化・歴史・市場構造の視点から整理・考察してください。 【目的】 – WBCを単なるスポーツ大会としてではなく、「スポーツブランド形成」という視点から読み解く – 国際大会・リーグ・市場の関係を整理し、スポーツのグローバル化の構造を理解する – 読者がスポーツとビジネス、文化の関係を多角的に考えるための視点を提供する 【読者像】 – 一般のスポーツファン – 野球に関心のある読者 – スポーツビジネスや国際大会の構造に興味のある人 – WBCの盛り上がりを感じつつも、その位置づけを知りたい読者 【記事構成】 1. 導入(問題提起) – WBCが近年大きな注目を集めている国際大会であることを説明する – なぜこの大会が「世界大会」として語られるのかという疑問を提示する – スポーツにおける「グローバルブランド」とは何かという視点を簡潔に提示する 2. グローバルスポーツブランドの条件 – スポーツ大会が世界的ブランドになるための条件を整理する – 競技人口、市場規模、歴史、スター選手、継続性などの要素を説明する – サッカーのワールドカップやオリンピックなどの国際大会と比較しながら整理する 3. WBCが持つブランド形成の要素 – 国家代表という構造が生み出す物語性 – スター選手の参加による大会価値 – MLBなどのリーグとの関係 – メディア・視聴率・国際的関心の拡大などを整理する 4. WBCが抱える構造的な課題 – 野球競技の地域的な広がり – リーグと代表大会の利害関係 – 大会の歴史の浅さ – 国際大会としての制度設計などを整理する 5. WBCは何を目指す大会なのか – 国家対抗イベントとしての側面 – 野球市場拡大の戦略としての側面 – スポーツブランド形成のプロセスとしての位置づけを考察する 6. まとめ – WBCを単純に「成功」「失敗」と評価するのではなく、 スポーツの国際化と市場拡張の中でどのような位置にあるのかを整理する – 読者がスポーツ大会の意味を構造的に考えるための視点を提示して締めくくる – 過度に楽観・悲観せず、思考を促す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「結論を押し付ける記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:スポーツ大会のグローバルブランド形成構造) ※(図:リーグと国際大会の関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「WBCは野球の世界ブランドを生み出す大会なのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # ワールド・ベースボール・クラシックは「世界大会」になれるのか——スポーツビジネスと文化の視点から考える ## はじめに ワールド・ベースボール・クラシック(以下、WBC)は、開催のたびに大きな注目を集める国際野球大会である。2023年の大会では、日本代表の優勝や大谷翔平選手の活躍が広く報じられ、野球ファン以外の関心も集めた。一方で、この大会が「真の世界大会」として定着しているかと問われると、異なる見方も存在する。サッカーのワールドカップのように地球上のほぼ全ての地域で関心を集める存在なのか、それとも特定の地域で盛り上がる「地域イベント」の域を出ないのか。本稿では、WBCを「スポーツブランド形成」という視点から整理し、その現状と可能性について考察する。 ## スポーツ大会が「グローバルブランド」となる条件 国際的なスポーツブランドとして認識される大会には、いくつかの共通要素がある。 第一に**競技の普及度**である。サッカーワールドカップが世界的な関心を集める背景には、約200の国と地域で競技が行われ、選手層が厚いことがある。第二に**市場規模**だ。テレビ放映権やスポンサー収入が大きいほど、大会の運営品質やマーケティング力は高まる。第三に**歴史と継続性**である。ワールドカップは1930年から、オリンピックは古代まで遡る歴史を持ち、その蓄積がブランド価値を支えている。第四に**スター選手の存在**。競技の枠を超えて知られる選手がいるかどうかは、大会の認知度に直結する。第五に**物語性**。国家対抗という形式は、スポーツを超えた社会的・文化的なドラマを生み出す。 これらの条件を満たすほど、大会は「世界的ブランド」としての地位を確立していく。 ## WBCが持つブランド形成の要素 WBCは、こうした条件のいくつかを確かに備えている。 最も大きな強みは**国家代表という構造**である。国と国の対抗戦は、単なるクラブチームの試合とは異なる熱狂を生む。特に日韓戦や米ドミニカ共和国戦など、野球強豪国同士の対戦はドラマチックな展開を生みやすい。また、**スター選手の参加**も大会の価値を高めている。大谷翔平をはじめとするMLBのトップ選手が自国のためにプレーする姿は、通常のリーグ戦では見られない特別なものである。 さらに、**MLBという強力なパートナー**の存在も大きい。世界最高峰のリーグが運営に関わることで、試合のクオリティやマーケティング力が担保されている。実際、2023年大会の決勝戦は日本国内で高い視聴率を記録し、米国でも一定の関心を集めた。 ※(図:スポーツ大会のグローバルブランド形成構造) - 基盤:競技人口・市場規模・歴史 - 強化要素:スター選手・国家対抗の物語 - 制度的支え:リーグ連携・メディア戦略 ## WBCが抱える構造的な課題 しかし、WBCが真の意味での「世界大会」となるには、いくつもの課題がある。 最大の制約は**野球という競技の地域的な偏り**である。国際野球連盟の加盟国・地域は約140だが、競技が盛んなのは北米、中南米、東アジア、オセアニアの一部に限られる。欧州やアフリカでは圧倒的に競技人口が少なく、サッカーのような「全大陸的な盛り上がり」は生まれにくい。 また、**MLBと大会日程の利害調整**も難しい。MLBは選手の負担を考慮し、シーズン中の大会開催に慎重である。そのためWBCは春季に行われるが、これが選手のコンディション調整やリーグ戦への影響という課題を抱えている。 さらに、**大会の歴史の浅さ**も指摘できる。第1回開催は2006年で、まだ5回の開催しかない。サッカーワールドカップと比べると、大会にまつわる記憶や伝統の蓄積は圧倒的に少ない。 加えて、**国際大会としての制度設計**も発展途上である。予選の方式や出場国数の妥当性、ルールの統一性など、改善の余地がある点は少なくない。 ※(図:リーグと国際大会の関係) - MLBの興行権益 vs 国際大会の価値 - 選手の負担と大会のクオリティのトレードオフ - 地域ごとの野球市場の成熟度の差 ## WBCは何を目指す大会なのか こうした強みと課題を踏まえると、WBCの目指す方向性は多層的に見えてくる。 一つは、**国家対抗イベントとしての独自の価値**を追求することだ。野球にはサッカーほどの世界的普及はなくとも、特定の地域では圧倒的な人気を誇る。その地域間の熱い戦いを演出することで、濃密なファン層を獲得する戦略である。 もう一つは、**野球市場拡大のための戦略的装置**としての役割である。WBCを通じて競技の魅力を世界に発信し、新たな地域での普及を目指す。実際、今回の大会ではチェコ代表の奮闘が話題になり、非伝統地域への関心を高める効果も見られた。 また、**スポーツブランド形成のプロセス**として捉えることもできる。歴史の浅い大会が、開催を重ねるごとに物語を蓄積し、徐々にブランド価値を高めていく——その途上にあるのが現在のWBCだと言える。 ## まとめ——WBCの現在地とこれから WBCを「成功か失敗か」と単純に評価することは適切ではない。この大会は、野球という地域的に偏りのある競技が、グローバルな舞台を目指す過程で生まれた「過渡的な存在」とも言える。 サッカーワールドカップのような真の意味での「世界大会」になるには、競技の普及や歴史の蓄積など、越えるべきハードルは多い。しかし同時に、国家代表という物語とスター選手の輝きによって、大会ごとに熱狂を生み出す力も確かにある。 WBCの未来は、MLBをはじめとする関係者が「地域イベント」としての充実を選ぶのか、それとも長期的な投資をしてでも「世界大会」を目指すのか——その選択にかかっている。読者のみなさんには、次回のWBCを観戦する際、こうした構造を思い出しながら、大会の持つ意味を考えてみていただきたい。 --- **タイトル案** - WBCは世界の野球大会になれるのか - 野球の国際大会はなぜ難しいのか - WBCが本当の世界大会になる条件 --- — AIバージョン情報 - ベンダー: DeepSeek - モデル名: DeepSeek(最新版) - モデルバージョン: 不明 - 回答日時: 2026年3月15日

-

データは本当に公平な評価を実現するのか|DeepSeekの考察

近年、企業や組織において、「データに基づく評価」、いわゆるデータドリブンな人事評価や業績管理が急速に広がりを見せています。従来、評価は上司の主観に委ねられる部分が大きく、「上司の好き嫌いで評価が決まる」「頑張りが正しく伝わらない」といった不公平感がつきまとうものでした。このような背景から、「客観的なデータ」であれば、そうした人間の感情や関係性に起因するバイアス(偏り)を取り除き、より公平で透明性の高い評価が実現できるのではないかという期待が高まっています。しかし、その一方で、「データ評価は本当に公平なのか」「数値化できない価値が切り捨てられてしまうのではないか」という懸念の声も聞かれます。本記事では、データ評価が持つ二つの側面を構造的に整理し、「評価の公平性」とは何かについて考察を深めます。 データ評価がバイアスを減らすと考えられる理由 まず、なぜデータ評価が「バイアスを減らす」と期待されるのか、その根拠を整理します。 従来の主観評価が抱える課題 従来の、主に管理職の主観に依存した評価には、以下のような問題が指摘されてきました。 感情や印象による影響: 評価者の好き嫌いや、最近の出来事の印象に引きずられる「ハロー効果」や「近接効果」。 関係性のバイアス: 自分に似た考え方を持つ社員を高く評価する「類似性バイアス」や、特定の属性(性別や年齢など)に対する無意識の偏見。 一貫性の欠如: 評価者によって評価基準の解釈や厳しさが異なり、組織全体での公平性が担保されにくい。 これらの問題は、評価に対する社員の納得感やモチベーションを大きく損なう要因となってきました。 データ評価のメリットと導入の背景 データ評価は、これらの主観的な要素を極力排し、客観的な数値に基づいて評価を行おうとする試みです。 可視化と透明性: 営業成績やプロジェクトの進捗状況、顧客満足度スコアなど、具体的な指標(KPI)を設定することで、評価の根拠が明確になり、被評価者も自身の立ち位置を把握しやすくなります。 公平性の担保: 全員に共通の物差しを適用することで、評価者の主観によるバラつきを抑え、より公平な評価が可能になると考えられています。 成長の促進: データによって強みや弱みが可視化されることで、社員自身が客観的に自己分析し、具体的な改善策を立てやすくなるという効果も期待できます。 企業がデータドリブン評価を導入する背景には、業績向上への期待だけでなく、こうした評価プロセスの公正さを高め、人材のエンゲージメントを向上させたいという狙いがあるのです。 データ評価が新しいバイアスを生む可能性 しかし、一見客観的に見えるデータ評価にも、新たなバイアスが潜む可能性があります。 指標設計に込められた「意図」のバイアス 評価に用いる指標(KPI)は、誰か(多くの場合、経営陣や人事部門)が「何が重要か」という価値判断に基づいて設計します。この時点で、設計者の価値観やその時点の経営戦略に依存したバイアスが入り込む可能性があります。例えば、「短期的な売上」だけを重視する指標設計は、長期的な顧客関係構築や新規事業の種まきといった活動を過小評価してしまうかもしれません。 測定可能なものへの集中(測定バイアス) データ評価が浸透すると、どうしても「数値で測りやすいもの」が評価の中心になりがちです。チームへの貢献や後輩育成、創造的な問題解決など、定量化が難しいが組織にとって重要な価値は評価の埒外に置かれ、軽視されるリスクがあります。「測定できるものが、すべてではない」という視点が失われやすいのです。 ※(図:評価指標とバイアスの関係) (例:指標A「売上高」、指標B「顧客満足度」、指標C「後輩指導時間」。Aのみ重視すると、BやCが軽視される構図) 過去データが内包するバイアスの継承 評価システムを構築する際、過去の業績データを学習させることがあります。しかし、その過去データ自体が、特定の属性に対する差別や偏見を含んでいる可能性があります。例えば、過去の人事データに男性管理職の評価が高いという傾向があれば、それを学習したAIは、性別自体は評価要素にしなくても、「管理職向きの特性」として、結果的に男性を高く評価するような判断を下してしまうかもしれません。 「客観」という幻想 データはあくまで「現実の一部を切り取ったもの」に過ぎません。にもかかわらず、数値化された結果が一人歩きし、「データがそう言っている」という客観性の幻想のもと、疑問視されにくい空気が生まれることも問題です。 評価はどこまで客観化できるのか ここまで見てきたように、人間の主観評価にも、データ評価にも、それぞれにバイアスが入り込む可能性があります。 二つの評価の違いを整理する 人間評価: 評価者の経験や直感、文脈理解といった「暗黙知」を反映できる反面、一貫性に欠け、無意識の偏見が入り込みやすい。 データ評価: 共通の物差しによる「形式知」で評価するため一貫性は高いが、設計者の意図や数値化できないものを切り捨てる「明示的な偏り」が生じやすい。 つまり、問題の本質は「人間かデータか」という二元論ではなく、「評価という仕組みそのものをどう設計するか」 にあります。評価システムには、必ず「指標」を決める「設計者」が存在し、そのデータを処理する「アルゴリズム」が存在します。これらの要素のどこに、どのような価値判断や偏りが潜む可能性があるのかを常に意識する必要があるのです。 公平性とは、単に誰に対しても同じ指標を適用することではなく、その評価システムが組織にとって真に重要な価値を適切に捉え、様々な立場の人が納得できるプロセスを備えているかどうかにかかっていると言えるでしょう。 ※(図:人間評価とデータ評価の構造比較) まとめ データ評価は、人間の主観的なバイアスを減らす強力なツールとなり得ます。しかし同時に、それは設計者の意図や測定の限界といった、新たな形のバイアスを生み出す可能性もはらんでいます。 重要なのは、どちらか一方が正しいと決めつけることではなく、それぞれの評価方法が持つ特性と限界を理解した上で、「何を評価したいのか」「その評価を通じてどんな組織を目指すのか」という価値判断から設計を始めることではないでしょうか。 AI時代において、「評価」という営みは、データと人間の洞察をどのように組み合わせるかという、より高度な問いを私たちに投げかけているように思えます。読者の皆様は、御社の評価制度、あるいは社会における評価のあり方について、どのようにお考えになりますか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 企業・組織・社会で広がりつつある「データ評価(データドリブン評価)」は、 人間の主観やバイアスを減らす仕組みなのか、 それとも別の形のバイアスを生み出す仕組みなのか。 AI・データ分析・アルゴリズム評価が普及する社会において、 評価の仕組みがどのように変化しているのかを構造的に整理・考察してください。 【目的】 – 「データ=客観的」という単純な理解ではなく、評価システムの構造を整理する – 人間の評価とデータ評価の違いを冷静に比較する – AI時代の働き方において「評価とは何か」という問いを浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – 企業で働くビジネスパーソン – 人事評価・KPI・データ分析などに関心がある人 – AIやデータ活用に関心はあるが専門家ではない層 【記事構成】 1. 導入(問題提起) – 企業や組織で「データ評価」が広がっている現状を提示する – 人間の主観評価に対する不信感や公平性への期待を紹介する – なぜ「データ評価は本当に公平なのか」という問いが生まれるのかを説明する 2. データ評価がバイアスを減らすと考えられる理由 – 従来の主観評価(上司の印象・感情・関係性など)の問題を整理する – 数値指標やKPIによる評価のメリットを説明する – なぜ多くの企業が「データドリブン評価」を導入し始めているのかを構造的に説明する 3. データ評価が新しいバイアスを生む可能性 – 指標設計そのものに人間の価値観が入り込む可能性 – 測定可能なものだけが評価されやすくなる問題 – 過去データの偏りが評価システムに影響する可能性 – 「客観的に見える評価」の裏側にある構造を整理する 4. 評価はどこまで客観化できるのか – 人間評価とデータ評価の違いを整理する – 評価システムにおける「指標」「アルゴリズム」「設計者」の役割を説明する – 評価の公平性とは何かを構造的に考察する 5. まとめ – データ評価はバイアスを完全に消す仕組みではない可能性を整理する – 重要なのは「人間評価かデータ評価か」ではなく「評価設計」であることを示す – AI時代における評価のあり方について、読者が考える余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:人間評価とデータ評価の構造比較) ※(図:評価指標とバイアスの関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「データ評価は本当に人間のバイアスを減らすのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### データ評価は人間のバイアスを減らすのか、新たなバイアスを生むのか #### 1. 導入(問題提起) 近年、企業や組織において、「データに基づく評価」、いわゆるデータドリブンな人事評価や業績管理が急速に広がりを見せています。従来、評価は上司の主観に委ねられる部分が大きく、「上司の好き嫌いで評価が決まる」「頑張りが正しく伝わらない」といった不公平感がつきまとうものでした。 このような背景から、「客観的なデータ」であれば、そうした人間の感情や関係性に起因するバイアス(偏り)を取り除き、より公平で透明性の高い評価が実現できるのではないかという期待が高まっています。しかし、その一方で、「データ評価は本当に公平なのか」「数値化できない価値が切り捨てられてしまうのではないか」という懸念の声も聞かれます。本記事では、データ評価が持つ二つの側面を構造的に整理し、「評価の公平性」とは何かについて考察を深めます。 #### 2. データ評価がバイアスを減らすと考えられる理由 まず、なぜデータ評価が「バイアスを減らす」と期待されるのか、その根拠を整理します。 ##### 従来の主観評価が抱える課題 従来の、主に管理職の主観に依存した評価には、以下のような問題が指摘されてきました。 * **感情や印象による影響**: 評価者の好き嫌いや、最近の出来事の印象に引きずられる「ハロー効果」や「近接効果」。 * **関係性のバイアス**: 自分に似た考え方を持つ社員を高く評価する「類似性バイアス」や、特定の属性(性別や年齢など)に対する無意識の偏見。 * **一貫性の欠如**: 評価者によって評価基準の解釈や厳しさが異なり、組織全体での公平性が担保されにくい。 これらの問題は、評価に対する社員の納得感やモチベーションを大きく損なう要因となってきました。 ##### データ評価のメリットと導入の背景 データ評価は、これらの主観的な要素を極力排し、客観的な数値に基づいて評価を行おうとする試みです。 * **可視化と透明性**: 営業成績やプロジェクトの進捗状況、顧客満足度スコアなど、具体的な指標(KPI)を設定することで、評価の根拠が明確になり、被評価者も自身の立ち位置を把握しやすくなります。 * **公平性の担保**: 全員に共通の物差しを適用することで、評価者の主観によるバラつきを抑え、より公平な評価が可能になると考えられています。 * **成長の促進**: データによって強みや弱みが可視化されることで、社員自身が客観的に自己分析し、具体的な改善策を立てやすくなるという効果も期待できます。 企業がデータドリブン評価を導入する背景には、業績向上への期待だけでなく、こうした評価プロセスの公正さを高め、人材のエンゲージメントを向上させたいという狙いがあるのです。 #### 3. データ評価が新しいバイアスを生む可能性 しかし、一見客観的に見えるデータ評価にも、新たなバイアスが潜む可能性があります。 ##### 指標設計に込められた「意図」のバイアス 評価に用いる指標(KPI)は、誰か(多くの場合、経営陣や人事部門)が「何が重要か」という価値判断に基づいて設計します。この時点で、設計者の価値観やその時点の経営戦略に依存したバイアスが入り込む可能性があります。例えば、「短期的な売上」だけを重視する指標設計は、長期的な顧客関係構築や新規事業の種まきといった活動を過小評価してしまうかもしれません。 ##### 測定可能なものへの集中(測定バイアス) データ評価が浸透すると、どうしても「数値で測りやすいもの」が評価の中心になりがちです。チームへの貢献や後輩育成、創造的な問題解決など、定量化が難しいが組織にとって重要な価値は評価の埒外に置かれ、軽視されるリスクがあります。「測定できるものが、すべてではない」という視点が失われやすいのです。 ※(図:評価指標とバイアスの関係) (例:指標A「売上高」、指標B「顧客満足度」、指標C「後輩指導時間」。Aのみ重視すると、BやCが軽視される構図) ##### 過去データが内包するバイアスの継承 評価システムを構築する際、過去の業績データを学習させることがあります。しかし、その過去データ自体が、特定の属性に対する差別や偏見を含んでいる可能性があります。例えば、過去の人事データに男性管理職の評価が高いという傾向があれば、それを学習したAIは、性別自体は評価要素にしなくても、「管理職向きの特性」として、結果的に男性を高く評価するような判断を下してしまうかもしれません。 ##### 「客観」という幻想 データはあくまで「現実の一部を切り取ったもの」に過ぎません。にもかかわらず、数値化された結果が一人歩きし、「データがそう言っている」という客観性の幻想のもと、疑問視されにくい空気が生まれることも問題です。 #### 4. 評価はどこまで客観化できるのか ここまで見てきたように、人間の主観評価にも、データ評価にも、それぞれにバイアスが入り込む可能性があります。 ##### 二つの評価の違いを整理する * **人間評価**: 評価者の経験や直感、文脈理解といった「暗黙知」を反映できる反面、一貫性に欠け、無意識の偏見が入り込みやすい。 * **データ評価**: 共通の物差しによる「形式知」で評価するため一貫性は高いが、設計者の意図や数値化できないものを切り捨てる「明示的な偏り」が生じやすい。 つまり、問題の本質は「人間かデータか」という二元論ではなく、**「評価という仕組みそのものをどう設計するか」** にあります。評価システムには、必ず「指標」を決める「設計者」が存在し、そのデータを処理する「アルゴリズム」が存在します。これらの要素のどこに、どのような価値判断や偏りが潜む可能性があるのかを常に意識する必要があるのです。 公平性とは、単に誰に対しても同じ指標を適用することではなく、その評価システムが組織にとって真に重要な価値を適切に捉え、様々な立場の人が納得できるプロセスを備えているかどうかにかかっていると言えるでしょう。 ※(図:人間評価とデータ評価の構造比較) #### 5. まとめ データ評価は、人間の主観的なバイアスを減らす強力なツールとなり得ます。しかし同時に、それは設計者の意図や測定の限界といった、新たな形のバイアスを生み出す可能性もはらんでいます。 重要なのは、どちらか一方が正しいと決めつけることではなく、それぞれの評価方法が持つ特性と限界を理解した上で、「何を評価したいのか」「その評価を通じてどんな組織を目指すのか」という価値判断から設計を始めることではないでしょうか。 AI時代において、「評価」という営みは、データと人間の洞察をどのように組み合わせるかという、より高度な問いを私たちに投げかけているように思えます。読者の皆様は、御社の評価制度、あるいは社会における評価のあり方について、どのようにお考えになりますか。 --- タイトル案 データは本当に公平な評価を実現するのか 人事評価のデータ化は何を変えるのか 評価の公平性をデータは担保できるか — AIバージョン情報 – ベンダー: DeepSeek – モデル名: DeepSeek (Latest) – モデルバージョン: 不明 – 回答日時: 2026年3月15日 17:32:28 JST

-

情報セキュリティ認証はなぜ必要とされるのか|DeepSeekの考察

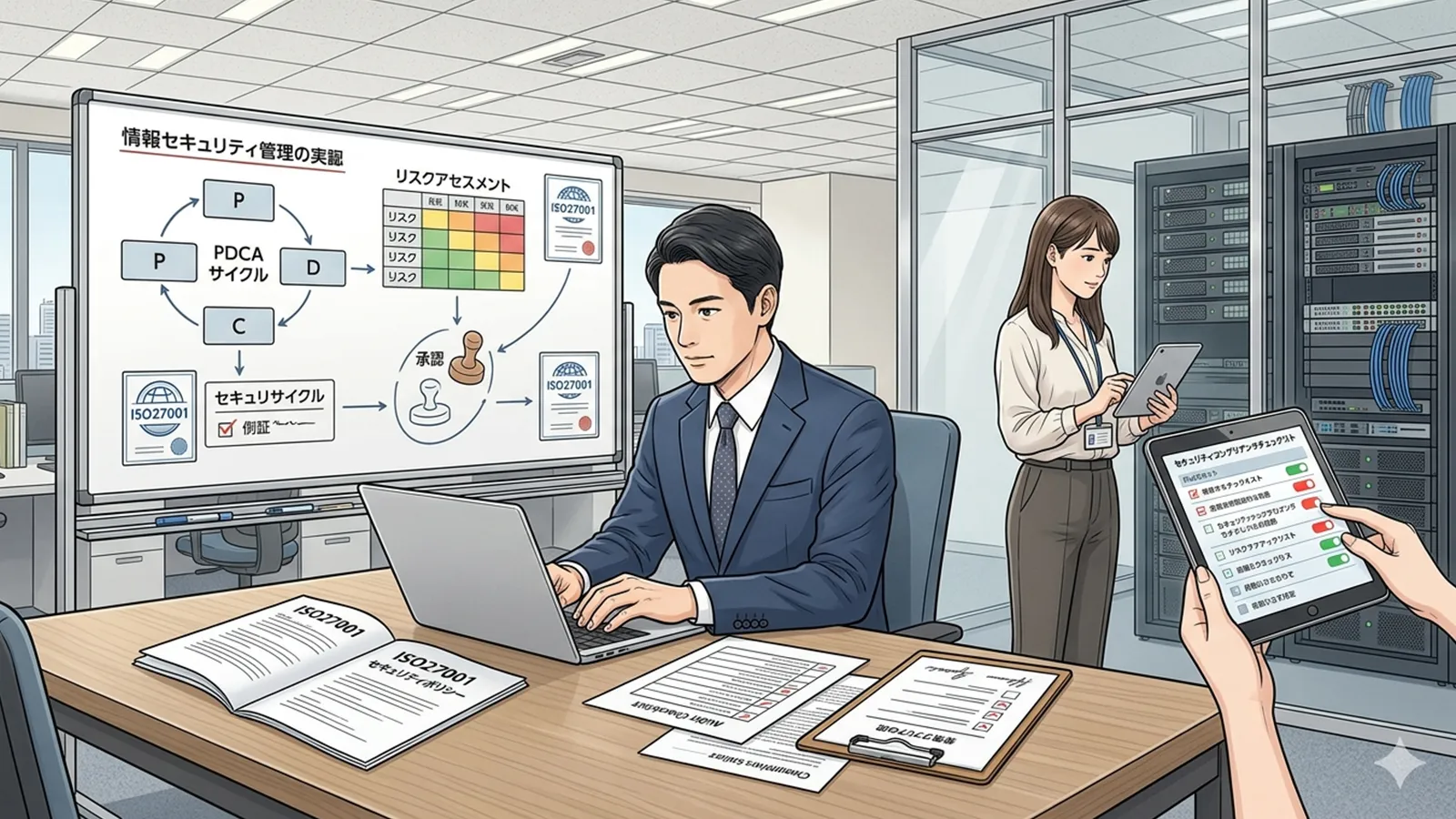

当たり前になったセキュリティ認証 企業のWebサイトや提案資料で、「ISO27001認証取得済み」「SOC2準拠」といった表記を目にする機会が増えました。特にSaaS企業やITサービス事業者にとって、これらの情報セキュリティ認証は、もはや特別なものではなく、取引の前提として求められる一般的なものになりつつあります。しかし、ここで一つの疑問が浮かびます。これらの認証を取得している企業は、本当に「安全」なのでしょうか。あるいは、認証は企業の安全性を測る絶対的な指標なのでしょうか。本記事では、情報セキュリティ認証の役割を、「安全の証明」と「市場参加の条件」という二つの視点から整理し、その構造を考察します。 情報セキュリティ認証の制度的目的 認証制度が生まれた背景 情報セキュリティ認証の代表格であるISO27001は、企業が持つ情報資産を適切に保護するための管理体制(情報セキュリティマネジメントシステム:ISMS)が、国際規格に適合していることを第三者機関が証明する制度です。 この制度の根底にある思想は、「情報セキュリティは、断片的な対策ではなく、組織的な継続プロセスとして運用すべきである」というものです。特定の製品やサービスの脆弱性を検査するのではなく、組織としてリスクを認識し、対策を計画・実行・評価・改善するサイクル(PDCA)が確立されているかを評価します。 認証が証明するもの、証明しないもの ここで重要なのは、認証が「絶対的な安全」を保証するものではないという点です。認証は、あくまで「情報セキュリティを管理するための適切な枠組み(体制)が、組織内に整備され、運用されている」ことを客観的に示すものです。 つまり、炎上しないシステム、絶対に侵入されないネットワークを証明するのではなく、「リスクを認識し、対策を講じ、万が一の際には改善するプロセスが存在する」という、企業の「姿勢」と「体制」を証明する制度といえるでしょう。 認証が市場参入条件として機能する理由 なぜ取引条件に組み込まれるのか では、なぜ多くの企業間取引で、この認証が事実上の参入条件(ゲートキーパー)として機能するのでしょうか。その背景には、発注企業側の複雑な事情があります。 特に大手企業や官公庁が、SaaS事業者などに自社のデータを預ける場合、その委託先のセキュリティリスクは、自社のリスクとして直結します。もし委託先で情報漏洩が起これば、自社の信用は大きく毀損され、社会的な責任も問われます。 責任回避とリスク管理のツールとして ここで、第三者認証が重要な意味を持ちます。発注企業は、技術的に一つ一つのセキュリティ対策を検証する代わりに、「国際的に認められた認証を取得していること」を条件にすることで、一定のセキュリティレベルを担保しようとします。 これは、技術評価のコストを削減する合理的な判断であると同時、何か問題が発生した際の「免責的な効果」も期待できます。「当社は、適切な認証を取得した信頼できる事業者に委託した」というロジックが通るため、ガバナンス上の説明責任を果たしやすくなるのです。 認証制度が市場構造に与える影響 参入障壁と競争環境 このように認証が市場の「共通言語」化する一方で、その取得と維持には少なからぬコストが伴います。内部体制の構築、書類の整備、外部審査機関による審査費用、そして継続的な運用負担です。 このコスト構造は、結果的に市場構造に影響を与える可能性があります。リソースに余裕のある大企業や成長企業は比較的容易にクリアできる一方、スタートアップや小規模事業者にとっては、認証取得が事業参入や取引開始の高いハードルとなるケースも考えられます。 形式化のリスク また、認証が「取引のためのチケット」として重視されるあまり、本来の目的であるセキュリティ水準の維持・向上がなおざりになる「形式化」のリスクも指摘されています。審査のタイミングだけ帳簿を整え、日常の運用が疎かになる「コンプライアンス疲れ」のような状態です。認証は、あくまで「仕組み」の証明であり、その仕組みが実効性を伴って機能しているかは、別の視点で見極める必要があるでしょう。 まとめ:二つの視点が示すもの 情報セキュリティ認証は、企業の「安全性」を保証する制度であると同時に、複雑な市場において企業が「取引の相手方として選ばれるための条件」としても機能していることが見えてきます。 本来の目的である「組織的なセキュリティ管理体制の構築・運用」を促進する役割と、市場取引を円滑にする「社会的な共通インフラ」としての役割。この二つの側面を切り離して考えることはできません。 認証を取得する側も、認証を取引先に求める側も、「この認証は何を意味し、何を意味しないのか」を理解した上で付き合っていくことが、制度を形骸化させず、本来の価値を引き出すために重要ではないでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 情報セキュリティ認証(ISO27001、SOC2、各種セキュリティ認証など)は、 「企業の安全性を証明する制度」なのか、 それとも「企業が市場に参加するための条件」なのか。 情報セキュリティ認証の役割を、 制度・企業行動・市場構造という視点から整理・考察してください。 【目的】 – 情報セキュリティ認証を「安全の証明」として単純に理解するのではなく、社会制度としての役割を整理する – なぜ多くの企業が認証取得を求められるのか、その構造を理解する – セキュリティ認証が企業活動や市場構造にどのような影響を与えているのかを読み解く 【読者像】 – IT企業・SaaS企業の関係者 – セキュリティ認証の取得を検討している企業 – 情報セキュリティや企業統治に関心のあるビジネスパーソン – セキュリティ制度の仕組みを理解したい一般読者 【記事構成】 1. 導入(問題提起) – 多くの企業が情報セキュリティ認証を取得している現状を提示する – 企業のWebサイトや営業資料で「ISO取得」などが強調される背景を説明する – しかし、その認証は本当に「安全」を意味するのかという問いを提示する 2. 情報セキュリティ認証の制度的目的 – ISO27001などの認証制度がどのような思想で作られたのかを整理する – リスク管理、情報資産管理、内部統制などの概念を簡潔に説明する – 認証が「安全そのもの」ではなく「管理体制の存在」を確認する制度である点を説明する 3. 認証が市場参入条件として機能する理由 – 多くの企業取引で「ISO取得」が前提条件になるケースを説明する – SaaS、クラウド、ITサービスなどで認証が重視される背景を整理する – 企業が認証を重視する理由として、責任回避やリスク管理の観点を説明する 4. 認証制度が市場構造に与える影響 – 認証取得のコストや運用負担について触れる – 認証が企業規模や市場参入のハードルに影響する可能性を整理する – 認証が信頼の指標になる一方で、形式化するリスクについても言及する 5. まとめ – 情報セキュリティ認証は「安全証明」と「市場参入条件」の両面を持つ制度である可能性を整理する – 制度の役割を単純化せず、複数の視点から理解する重要性を提示する – 読者がセキュリティ認証の意味を自分なりに考える余地を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:情報セキュリティ認証の制度構造) ※(図:認証と市場参入の関係イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「情報セキュリティ認証は本当に安全を証明しているのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 1. 導入:当たり前になったセキュリティ認証 企業のWebサイトや提案資料で、「ISO27001認証取得済み」「SOC2準拠」といった表記を目にする機会が増えました。特にSaaS企業やITサービス事業者にとって、これらの情報セキュリティ認証は、もはや特別なものではなく、取引の前提として求められる一般的なものになりつつあります。 しかし、ここで一つの疑問が浮かびます。これらの認証を取得している企業は、本当に「安全」なのでしょうか。あるいは、認証は企業の安全性を測る絶対的な指標なのでしょうか。本記事では、情報セキュリティ認証の役割を、「安全の証明」と「市場参加の条件」という二つの視点から整理し、その構造を考察します。 ### 2. 情報セキュリティ認証の制度的目的 #### 認証制度が生まれた背景 情報セキュリティ認証の代表格であるISO27001は、企業が持つ情報資産を適切に保護するための管理体制(情報セキュリティマネジメントシステム:ISMS)が、国際規格に適合していることを第三者機関が証明する制度です。 この制度の根底にある思想は、「情報セキュリティは、断片的な対策ではなく、組織的な継続プロセスとして運用すべきである」というものです。特定の製品やサービスの脆弱性を検査するのではなく、組織としてリスクを認識し、対策を計画・実行・評価・改善するサイクル(PDCA)が確立されているかを評価します。 #### 認証が証明するもの、証明しないもの ここで重要なのは、認証が「絶対的な安全」を保証するものではないという点です。認証は、あくまで「情報セキュリティを管理するための適切な枠組み(体制)が、組織内に整備され、運用されている」ことを客観的に示すものです。 つまり、炎上しないシステム、絶対に侵入されないネットワークを証明するのではなく、「リスクを認識し、対策を講じ、万が一の際には改善するプロセスが存在する」という、企業の「姿勢」と「体制」を証明する制度といえるでしょう。 ※(図:情報セキュリティ認証の制度構造) 「絶対的な安全」ではなく、「管理体制の存在」と「継続的改善の仕組み」を認証する。 ### 3. 認証が市場参入条件として機能する理由 #### なぜ取引条件に組み込まれるのか では、なぜ多くの企業間取引で、この認証が事実上の参入条件(ゲートキーパー)として機能するのでしょうか。その背景には、発注企業側の複雑な事情があります。 特に大手企業や官公庁が、SaaS事業者などに自社のデータを預ける場合、その委託先のセキュリティリスクは、自社のリスクとして直結します。もし委託先で情報漏洩が起これば、自社の信用は大きく毀損され、社会的な責任も問われます。 #### 責任回避とリスク管理のツールとして ここで、第三者認証が重要な意味を持ちます。発注企業は、技術的に一つ一つのセキュリティ対策を検証する代わりに、「国際的に認められた認証を取得していること」を条件にすることで、一定のセキュリティレベルを担保しようとします。 これは、技術評価のコストを削減する合理的な判断であると同時、何か問題が発生した際の「免責的な効果」も期待できます。「当社は、適切な認証を取得した信頼できる事業者に委託した」というロジックが通るため、ガバナンス上の説明責任を果たしやすくなるのです。 ※(図:認証と市場参入の関係イメージ) 発注企業(リスク回避・説明責任)← 認証(信頼の橋渡し)← 受注企業(参入条件) ### 4. 認証制度が市場構造に与える影響 #### 参入障壁と競争環境 このように認証が市場の「共通言語」化する一方で、その取得と維持には少なからぬコストが伴います。内部体制の構築、書類の整備、外部審査機関による審査費用、そして継続的な運用負担です。 このコスト構造は、結果的に市場構造に影響を与える可能性があります。リソースに余裕のある大企業や成長企業は比較的容易にクリアできる一方、スタートアップや小規模事業者にとっては、認証取得が事業参入や取引開始の高いハードルとなるケースも考えられます。 #### 形式化のリスク また、認証が「取引のためのチケット」として重視されるあまり、本来の目的であるセキュリティ水準の維持・向上がなおざりになる「形式化」のリスクも指摘されています。審査のタイミングだけ帳簿を整え、日常の運用が疎かになる「コンプライアンス疲れ」のような状態です。認証は、あくまで「仕組み」の証明であり、その仕組みが実効性を伴って機能しているかは、別の視点で見極める必要があるでしょう。 ### 5. まとめ:二つの視点が示すもの 情報セキュリティ認証は、企業の「安全性」を保証する制度であると同時に、複雑な市場において企業が「取引の相手方として選ばれるための条件」としても機能していることが見えてきます。 本来の目的である「組織的なセキュリティ管理体制の構築・運用」を促進する役割と、市場取引を円滑にする「社会的な共通インフラ」としての役割。この二つの側面を切り離して考えることはできません。 認証を取得する側も、認証を取引先に求める側も、「この認証は何を意味し、何を意味しないのか」を理解した上で付き合っていくことが、制度を形骸化させず、本来の価値を引き出すために重要ではないでしょうか。 --- **タイトル案** * セキュリティ認証は安全か、それとも条件か * 情報セキュリティ認証はなぜ必要とされるのか * 企業が認証を求める本当の理由とは何か — AIバージョン情報 – ベンダー: DeepSeek – モデル名: DeepSeek (Latest) – モデルバージョン: 不明 – 回答日時: 2026年3月15日

-

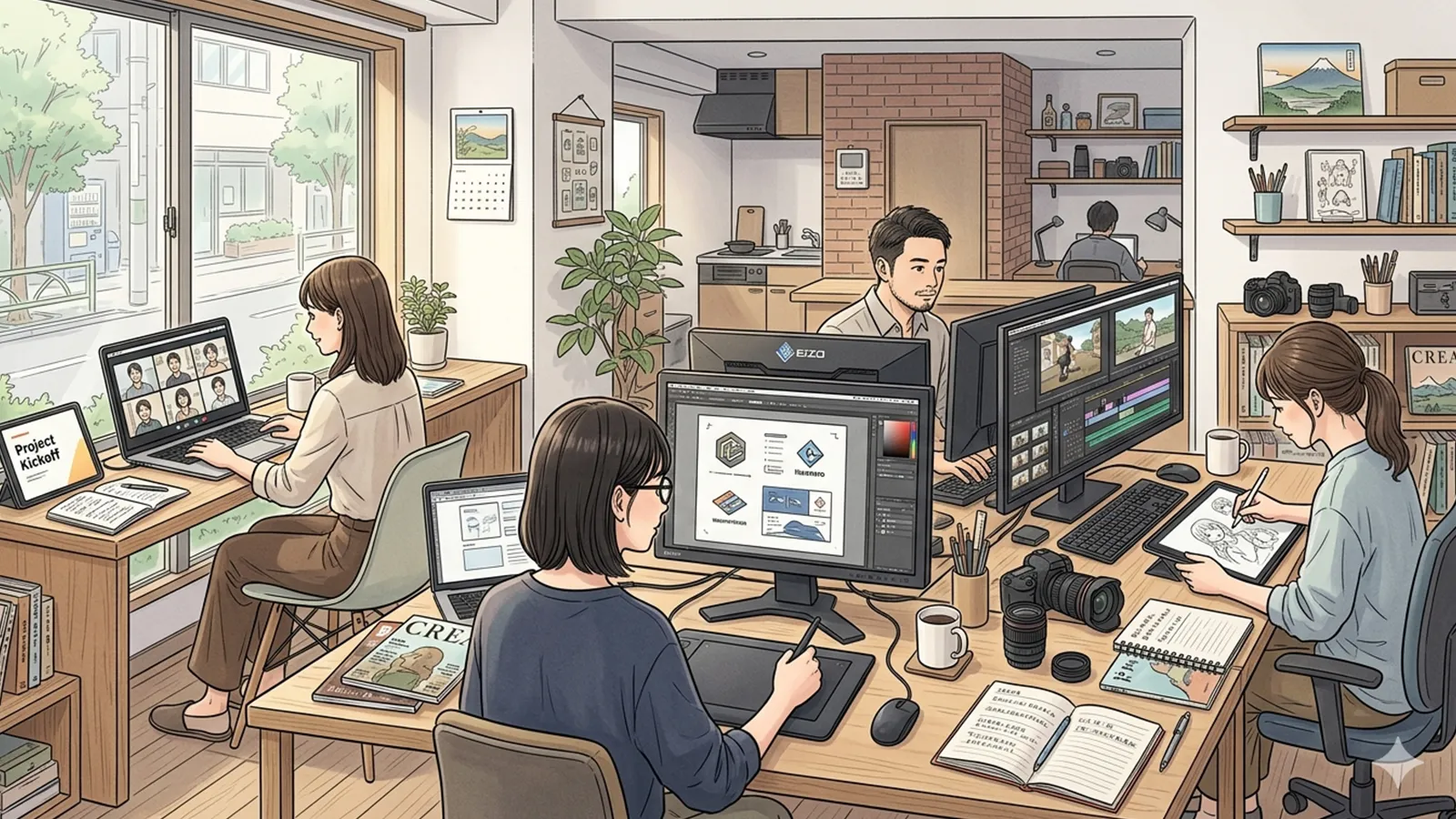

クリエイターのキャリアは作品で決まるのか|DeepSeekの考察

「あの作品をつくった人」「このプロジェクトに参加していた人」——クリエイティブ職に携わる人々の紹介は、しばしばこのような形で語られます。会社員であれば「株式会社○○の△△部長」という肩書きで説明されることが一般的であるのに対し、クリエイターの場合は「何を生み出したか」がまず先に来ることが少なくありません。インターネットやSNS、そしてAI技術の普及によって、作品を発表し、評価される経路はかつてないほど多様化しています。この変化は、クリエイターのキャリアのあり方そのものを再定義しつつあるのでしょうか。本記事では、「会社キャリア」と「作品キャリア」という二つの視点から、デジタル時代におけるクリエイターのキャリア構造を整理します。 従来のキャリア構造——「所属」を単位とする働き方 多くの職業において、キャリアは「どの組織に属しているか」「どのような役職にあるか」「何年勤続しているか」によって評価される傾向があります。これは組織が安定した評価基準と階層構造を持ち、その中での成長がキャリア形成の中心となるためです。 しかし、クリエイティブ職においては、この構造が必ずしも当てはまりません。デザインの良し悪しは在籍企業ではなく作品そのもので判断されますし、映像作品の評価は制作会社の規模ではなく作品のクオリティや反響によって決まります。つまり、作品が評価の主要な単位となる構造が、もともとクリエイティブ分野には内在していたと言えます。 ※(図:一般的な会社員キャリアとクリエイターキャリアの評価軸の比較) 「作品単位キャリア」という考え方 「作品単位でキャリアが形成される」とは、クリエイターが「どのような作品を世に送り出したか」の蓄積が、その人の評価や次の仕事につながることを指します。 具体的には以下のような要素がキャリアとなります。 ポートフォリオに掲載された実績 代表作として語られる作品群 参加したプロジェクトの規模や役割 作品が受けた評価(受賞歴、反響、売上など) 映画監督であれば過去の作品群が、漫画家であれば連載作品が、ゲームクリエイターであれば携わったタイトルが、その後の仕事の依頼につながります。この構造は古くから存在していました。 インターネットが変えたキャリア形成の構造 従来、作品を世に送り出すには出版社・放送局・制作会社・広告代理店といった「ゲートキーパー」の存在が不可欠でした。しかし、インターネットとプラットフォームの普及はこの構造を大きく変えつつあります。 例えば、次のような変化が見られます。 YouTubeやTikTokでは、個人が制作した動画が直接視聴者に届く PixivやSkebでは、イラストレーターの作品が直接クライアントとの取引につながる noteや個人ブログでは、文章の力を直接読者が評価する GitHubやBehanceでは、作品やコード自体が実績証明書となる これにより、「組織に採用される → 組織の中で制作する → 作品が世に出る」という流れとは別に、「個人が制作する → 作品が直接評価される → 次の依頼や仕事につながる」という経路が現実的なキャリアパスとして成立するようになりました。 ※(図:従来のキャリア形成とインターネット時代のキャリア形成の比較) それでも組織が果たす役割 一方で、組織やチームの重要性が完全に失われたわけではありません。むしろ、個人で完結できる範囲が広がったからこそ、組織の役割が再定義されている面もあります。 組織が提供する価値としては、以下のようなものが考えられます。 プロデューサーや編集者など、作品の方向性を調整する役割 大規模プロジェクトにおける役割分担と分業体制 クライアントとの信頼関係や営業力 技術やノウハウの継承と組織的な成長 また、個人で活動するクリエイターであっても、制作会社との継続的な関係や、同じ分野のクリエイターとのネットワークが仕事につながるケースは少なくありません。「作品単位キャリア」と「組織ネットワーク」は対立するものではなく、相互補完的な関係にあると見ることもできます。 AI時代のクリエイターキャリア 生成AIの進化は、クリエイターのキャリア構造にさらなる変化をもたらす可能性があります。 AIツールの普及によって、以下のような変化が予想されます。 制作コストの低下により、個人で手がけられる作品の幅が広がる アイデア出しや下準備の時間短縮で、より多くの作品を生み出せる 技術的なハードルが下がり、多様な表現に挑戦しやすくなる 一方で、AIが生成した作品と人間が制作した作品の境界が曖昧になる中で、「誰がどのように制作したか」という文脈や、作品に込められた意図やストーリーの重要性が再評価される可能性もあります。 まとめ——「作品」と「関係性」の二層構造としてのキャリア クリエイターのキャリアは、「作品単位」と「組織・関係性」の二つの層から成り立っていると捉えることができます。 作品単位の層:過去の作品実績がそのまま評価につながる 関係性の層:チームやネットワークの中で次の機会を得る インターネットやAIの普及によって、前者の「作品単位」の層はより可視化され、個人が直接評価を得る経路は確実に増えています。しかし、大規模な作品や複雑なプロジェクトには依然として組織的な制作体制が必要であり、後者の「関係性」の層も重要な役割を果たし続けるでしょう。 重要なのは、「会社キャリアか作品キャリアか」という二者択一ではなく、自身のキャリアをこの二層構造の中でどうデザインしていくかという視点かもしれません。読者の皆さんも、自分の作品と、それを支える関係性をどのように築いていくか、考えるきっかけとしていただければ幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 クリエイターのキャリアは 「会社」や「所属」ではなく 「作品単位」で形成されるものになりつつあるのか。 AI・インターネット・SNS・プラットフォームの普及によって、 クリエイターのキャリア構造がどのように変化しているのかを整理・考察してください。 対象となるクリエイターは以下を想定します。 – デザイナー – イラストレーター – 映像制作者 – ゲームクリエイター – ライター – 音楽制作者 – 漫画家 – Webクリエイター – コンテンツクリエイター 【目的】 – クリエイターのキャリア形成を「個人の努力論」ではなく構造として整理する – 「会社キャリア」と「作品キャリア」の違いを明確にする – デジタル時代におけるクリエイターの評価構造を言語化する – 読者が自分のキャリアの捉え方を考える材料を提供する 【読者像】 – クリエイティブ職に関心のある学生 – デザイナー・ライターなどのクリエイター – 副業クリエイター – フリーランス志向の社会人 – AI時代のキャリアの変化に関心を持つ人 【記事構成】 1. 導入(問題提起) – クリエイターは「会社の肩書き」よりも「作品」で評価されると言われる理由を提示する – なぜクリエイターのキャリアは一般的な会社員キャリアと異なるのかを示す – インターネットやSNSによって、この構造がさらに強まっている可能性に触れる 2. 従来のキャリア構造(所属単位のキャリア) – 多くの職業では「会社」「役職」「勤続年数」がキャリアの単位になっていることを整理する – 組織キャリアの特徴(安定・階層・評価制度など)を説明する – なぜクリエイティブ職ではこの構造が成立しにくいのかを整理する 3. 作品単位キャリアという構造 – クリエイターが「どの会社にいるか」よりも「何を作ったか」で評価される構造を説明する – ポートフォリオ・代表作・プロジェクト実績がキャリアになる仕組みを整理する – 映画・ゲーム・広告・漫画などの分野で見られる特徴を説明する 4. インターネットが変えたキャリアの単位 – SNSやプラットフォームによって作品が直接評価される構造を整理する – YouTube・Pixiv・Behance・SNSなどがキャリア形成に与えた影響を説明する – 「会社 → 作品」から「個人 → 作品 → 市場」という流れの可能性を考察する 5. それでも組織が重要である理由 – 作品は個人だけでなく、制作チームや組織の中で生まれることを説明する – プロデューサー・編集者・制作会社などの役割に触れる – 「作品単位キャリア」と「組織ネットワーク」の関係を整理する 6. AI時代のクリエイターキャリア – AIツールによって制作コストが下がる可能性を説明する – 個人制作とチーム制作の関係がどう変化する可能性があるかを考察する – クリエイターのキャリア単位がさらに変化する可能性に触れる 7. まとめ – クリエイターのキャリアは「作品」と「関係性」の両方で形成される可能性を整理する – 単純な「フリーランス化」や「個人化」として語られがちな議論を構造として整理する – 読者がキャリアの捉え方を考える視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:クリエイターキャリアの構造) ※(図:作品単位キャリアと組織キャリアの関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「クリエイターのキャリアは会社ではなく作品で決まるのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # クリエイターのキャリアは「会社」ではなく「作品単位」で形成されるのか ## はじめに 「あの作品をつくった人」「このプロジェクトに参加していた人」——クリエイティブ職に携わる人々の紹介は、しばしばこのような形で語られます。会社員であれば「株式会社○○の△△部長」という肩書きで説明されることが一般的であるのに対し、クリエイターの場合は「何を生み出したか」がまず先に来ることが少なくありません。 インターネットやSNS、そしてAI技術の普及によって、作品を発表し、評価される経路はかつてないほど多様化しています。この変化は、クリエイターのキャリアのあり方そのものを再定義しつつあるのでしょうか。 本記事では、「会社キャリア」と「作品キャリア」という二つの視点から、デジタル時代におけるクリエイターのキャリア構造を整理します。 ## 従来のキャリア構造——「所属」を単位とする働き方 多くの職業において、キャリアは「どの組織に属しているか」「どのような役職にあるか」「何年勤続しているか」によって評価される傾向があります。これは組織が安定した評価基準と階層構造を持ち、その中での成長がキャリア形成の中心となるためです。 しかし、クリエイティブ職においては、この構造が必ずしも当てはまりません。デザインの良し悪しは在籍企業ではなく作品そのもので判断されますし、映像作品の評価は制作会社の規模ではなく作品のクオリティや反響によって決まります。つまり、作品が評価の主要な単位となる構造が、もともとクリエイティブ分野には内在していたと言えます。 ※(図:一般的な会社員キャリアとクリエイターキャリアの評価軸の比較) ## 「作品単位キャリア」という考え方 「作品単位でキャリアが形成される」とは、クリエイターが「どのような作品を世に送り出したか」の蓄積が、その人の評価や次の仕事につながることを指します。 具体的には以下のような要素がキャリアとなります。 - ポートフォリオに掲載された実績 - 代表作として語られる作品群 - 参加したプロジェクトの規模や役割 - 作品が受けた評価(受賞歴、反響、売上など) 映画監督であれば過去の作品群が、漫画家であれば連載作品が、ゲームクリエイターであれば携わったタイトルが、その後の仕事の依頼につながります。この構造は古くから存在していました。 ## インターネットが変えたキャリア形成の構造 従来、作品を世に送り出すには出版社・放送局・制作会社・広告代理店といった「ゲートキーパー」の存在が不可欠でした。しかし、インターネットとプラットフォームの普及はこの構造を大きく変えつつあります。 例えば、次のような変化が見られます。 - YouTubeやTikTokでは、個人が制作した動画が直接視聴者に届く - PixivやSkebでは、イラストレーターの作品が直接クライアントとの取引につながる - noteや個人ブログでは、文章の力を直接読者が評価する - GitHubやBehanceでは、作品やコード自体が実績証明書となる これにより、「組織に採用される → 組織の中で制作する → 作品が世に出る」という流れとは別に、「個人が制作する → 作品が直接評価される → 次の依頼や仕事につながる」という経路が現実的なキャリアパスとして成立するようになりました。 ※(図:従来のキャリア形成とインターネット時代のキャリア形成の比較) ## それでも組織が果たす役割 一方で、組織やチームの重要性が完全に失われたわけではありません。むしろ、個人で完結できる範囲が広がったからこそ、組織の役割が再定義されている面もあります。 組織が提供する価値としては、以下のようなものが考えられます。 - プロデューサーや編集者など、作品の方向性を調整する役割 - 大規模プロジェクトにおける役割分担と分業体制 - クライアントとの信頼関係や営業力 - 技術やノウハウの継承と組織的な成長 また、個人で活動するクリエイターであっても、制作会社との継続的な関係や、同じ分野のクリエイターとのネットワークが仕事につながるケースは少なくありません。「作品単位キャリア」と「組織ネットワーク」は対立するものではなく、相互補完的な関係にあると見ることもできます。 ## AI時代のクリエイターキャリア 生成AIの進化は、クリエイターのキャリア構造にさらなる変化をもたらす可能性があります。 AIツールの普及によって、以下のような変化が予想されます。 - 制作コストの低下により、個人で手がけられる作品の幅が広がる - アイデア出しや下準備の時間短縮で、より多くの作品を生み出せる - 技術的なハードルが下がり、多様な表現に挑戦しやすくなる 一方で、AIが生成した作品と人間が制作した作品の境界が曖昧になる中で、「誰がどのように制作したか」という文脈や、作品に込められた意図やストーリーの重要性が再評価される可能性もあります。 ## まとめ——「作品」と「関係性」の二層構造としてのキャリア クリエイターのキャリアは、「作品単位」と「組織・関係性」の二つの層から成り立っていると捉えることができます。 - 作品単位の層:過去の作品実績がそのまま評価につながる - 関係性の層:チームやネットワークの中で次の機会を得る インターネットやAIの普及によって、前者の「作品単位」の層はより可視化され、個人が直接評価を得る経路は確実に増えています。しかし、大規模な作品や複雑なプロジェクトには依然として組織的な制作体制が必要であり、後者の「関係性」の層も重要な役割を果たし続けるでしょう。 重要なのは、「会社キャリアか作品キャリアか」という二者択一ではなく、自身のキャリアをこの二層構造の中でどうデザインしていくかという視点かもしれません。読者の皆さんも、自分の作品と、それを支える関係性をどのように築いていくか、考えるきっかけとしていただければ幸いです。 --- ### タイトル案 - クリエイターのキャリアは作品で決まるのか - 作品があなたを雇う時代が来るのか - 会社員クリエイターは消えるのか — AIバージョン情報 – ベンダー: DeepSeek – モデル名: DeepSeek R1 – モデルバージョン: 不明 – 回答日時: 2026年3月14日

-

雇用はAIにどう再設計されるのか|DeepSeekの考察

「AIによって仕事が奪われるのではないか」。この問いは、ここ数年、社会の中で広く語られるようになりました。チャットGPTをはじめとする生成AIの登場は、これまで人間にしかできないとされていた知的作業の一部を代替しうる可能性を示し、多くの人に将来への不安を抱かせています。しかし、いま起きつつある変化の本質は、単に特定の業務が機械に置き換わることだけにあるのではありません。より根本的には、企業と労働者の関係を長らく規定してきた「雇用制度」そのものが、AIの浸透によって再設計を迫られているのではないでしょうか。本記事では、雇用制度がどのような前提の上に成り立ってきたのかを振り返りながら、AI時代における働き方や企業と個人の関係の変化について、複数の視点から整理・考察します。 これまでの雇用制度は何を前提に作られてきたのか 日本の雇用慣行の特徴として、「終身雇用」「年功序列」「正社員中心モデル」がしばしば挙げられます。これらの制度は、高度経済成長期を中心に広く普及しましたが、そもそもどのような社会条件を前提に成り立っていたのでしょうか。 ひとつには、工業化社会における「大量生産・大量雇用」の構造があります。工場を中心とした製造業では、一定の品質の製品を大量に安定的に作り出すことが求められ、そのために企業は長期にわたって労働力を確保する必要がありました。また、技術や知識は現場での経験を通じて培われるものが多く、長期的な人材育成の仕組みとして年功序列型の賃金制度は合理的に機能しました。 さらに、経済が右肩上がりで成長していた時代には、人件費が増加しても企業全体の収益が伸び続けたため、年功賃金を維持することが可能でした。つまり、従来の雇用制度は、「経済成長が持続する」「企業が長期的に人材を育成・活用できる」「仕事の内容が比較的安定している」といった前提の上に成り立っていたといえます。 AIが雇用制度に与える変化 AIの進展は、こうした前提を揺るがす可能性があります。特にAIが得意とするのは、定型業務の自動化、膨大なデータの分析・パターン認識、そしてある程度ルール化された判断プロセスの代替です。これにより、企業が人に求める役割は、より創造的で非定型な業務や、人間同士の高度なコミュニケーションが必要とされる領域へとシフトしていくと考えられます。 その結果、組織構造にも変化が生まれるかもしれません。たとえば、これまで中間管理職が担ってきた情報の集約や部下の評価・育成といった機能の一部は、AIによるデータ分析や進捗管理システムによって補完・代替される可能性があります。また、特定のプロジェクトごとに必要なスキルを持つ人材を社内外から集める「プロジェクト型雇用」や、単発の仕事単位で契約する「ギグワーク」といった働き方は、すでに一部の分野で広がりを見せています。 ただし、これらの変化がすべての業種や職種で一様に起きるわけではありません。法規制や社会的な慣行、労働組合の影響力なども無視できない要素であり、変化のスピードや形は国や業界によって異なるでしょう。 企業と労働者の関係はどう変わる可能性があるのか AIの導入が進む中で、企業が人を雇用する意味そのものが問い直されるかもしれません。これまでは、企業は長期的な視点で人材を育成し、その見返りとして労働者は企業に帰属意識を持ち、長く働くことが一般的でした。しかし、必要とされるスキルが変化のスピードを速める中で、企業が特定のスキルを持った人材を長期にわたって抱え続けることのリスクも高まっています。 一方で、AIを活用することで人間にしかできない価値創造により集中できるようになれば、企業と労働者の関係は「所属と報酬の交換」から「ミッションへの共創」へとシフトする可能性も考えられます。また、個人の側も、一つの企業に長く依存するのではなく、複数の企業やプロジェクトと関わりながらキャリアを形成する「複業」「パラレルキャリア」といった選択肢が増えるかもしれません。 雇用の安定性という観点では、従来型の正社員としての安定を重視する考え方がある一方で、変化に応じて柔軟にスキルを更新しながら働くことこそが新たな安定につながるという見方もあります。どちらの価値観が優勢になるかは、社会保障のあり方や教育制度、企業の採用・育成方針など、社会全体の制度設計にも依存するでしょう。 ※(図:AI時代の雇用制度構造) ※(図:企業と労働者の関係の変化) まとめ:雇用制度の再設計という視点 AIの進化は、単に仕事の内容を変えるだけでなく、雇用という制度そのものを再考する契機となっています。終身雇用や年功序列といった従来のモデルは、工業化社会の要請に応じて形成されたものであり、経済や技術の変化とともに見直しが迫られているともいえます。 ただし、変化の方向性は一つではありません。より流動的な労働市場へと移行するのか、あるいは企業と労働者の新たな安定関係が模索されるのか。その行方は、技術の進歩だけでなく、私たち社会の選択にもかかっています。 本記事が、AI時代の働き方や雇用の未来を考えるための、一つの視点を提供できたなら幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI・自動化・データ活用の進展によって、 企業や社会における「雇用制度」はどのように変化していく可能性があるのか。 終身雇用・年功序列・正社員中心の雇用モデルは、 AI時代においてどのように再設計されていくのかを、 社会構造・組織設計・労働市場の視点から整理・考察してください。 【目的】 – AIが単に仕事を自動化するだけでなく、「雇用制度そのもの」に与える影響を整理する – 読者が働き方の変化を構造的に理解するための視点を提示する – AI時代における企業と労働者の関係の変化を考える材料を提供する 【読者像】 – 一般社会人(20〜50代) – 学生・就職活動中の若年層 – 将来の働き方や雇用の安定性に関心を持つ人 – AIが仕事や社会制度に与える影響を知りたい人 【記事構成】 1. 導入(問題提起) – AIの進化によって「仕事がなくなるのではないか」という不安が広がっていることを提示する – しかし変化しているのは仕事そのものだけでなく「雇用制度」である可能性を示す – なぜAI時代には雇用制度の再設計が議論され始めているのかを説明する 2. これまでの雇用制度は何を前提に作られてきたのか – 終身雇用・年功序列・正社員モデルなどの雇用制度が成立した歴史的背景を整理する – 工業化社会・大量雇用モデルとの関係を説明する – なぜこの制度が長く機能してきたのかを構造的に整理する 3. AIが雇用制度に与える変化 – AIが得意とする業務(定型業務・分析・情報処理など)を整理する – それによって企業の組織構造や仕事の分担がどう変わる可能性があるのかを説明する – 「職務ベース雇用」「プロジェクト型雇用」「ギグ型労働」などの動きにも触れてよい – ただし断定的な未来予測は避けること 4. 企業と労働者の関係はどう変わる可能性があるのか – AIによって企業が人を雇う理由がどのように変わる可能性があるかを整理する – 組織の階層構造、管理職の役割、専門職の位置づけなどの変化にも触れてよい – 雇用の安定性と柔軟性のバランスについて複数の視点から考察する 5. まとめ – AIは雇用を消すのではなく、雇用制度を再設計する可能性があることを整理する – 楽観・悲観どちらにも寄らず、読者が働き方の未来を考えるための視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AI時代の雇用制度構造) ※(図:企業と労働者の関係の変化) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 AIは雇用制度をどこまで変えるのか 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### はじめに:AIの進化が問いかけるもの 「AIによって仕事が奪われるのではないか」。この問いは、ここ数年、社会の中で広く語られるようになりました。チャットGPTをはじめとする生成AIの登場は、これまで人間にしかできないとされていた知的作業の一部を代替しうる可能性を示し、多くの人に将来への不安を抱かせています。 しかし、いま起きつつある変化の本質は、単に特定の業務が機械に置き換わることだけにあるのではありません。より根本的には、企業と労働者の関係を長らく規定してきた「雇用制度」そのものが、AIの浸透によって再設計を迫られているのではないでしょうか。本記事では、雇用制度がどのような前提の上に成り立ってきたのかを振り返りながら、AI時代における働き方や企業と個人の関係の変化について、複数の視点から整理・考察します。 ### これまでの雇用制度は何を前提に作られてきたのか 日本の雇用慣行の特徴として、「終身雇用」「年功序列」「正社員中心モデル」がしばしば挙げられます。これらの制度は、高度経済成長期を中心に広く普及しましたが、そもそもどのような社会条件を前提に成り立っていたのでしょうか。 ひとつには、工業化社会における「大量生産・大量雇用」の構造があります。工場を中心とした製造業では、一定の品質の製品を大量に安定的に作り出すことが求められ、そのために企業は長期にわたって労働力を確保する必要がありました。また、技術や知識は現場での経験を通じて培われるものが多く、長期的な人材育成の仕組みとして年功序列型の賃金制度は合理的に機能しました。 さらに、経済が右肩上がりで成長していた時代には、人件費が増加しても企業全体の収益が伸び続けたため、年功賃金を維持することが可能でした。つまり、従来の雇用制度は、「経済成長が持続する」「企業が長期的に人材を育成・活用できる」「仕事の内容が比較的安定している」といった前提の上に成り立っていたといえます。 ### AIが雇用制度に与える変化 AIの進展は、こうした前提を揺るがす可能性があります。特にAIが得意とするのは、定型業務の自動化、膨大なデータの分析・パターン認識、そしてある程度ルール化された判断プロセスの代替です。これにより、企業が人に求める役割は、より創造的で非定型な業務や、人間同士の高度なコミュニケーションが必要とされる領域へとシフトしていくと考えられます。 その結果、組織構造にも変化が生まれるかもしれません。たとえば、これまで中間管理職が担ってきた情報の集約や部下の評価・育成といった機能の一部は、AIによるデータ分析や進捗管理システムによって補完・代替される可能性があります。また、特定のプロジェクトごとに必要なスキルを持つ人材を社内外から集める「プロジェクト型雇用」や、単発の仕事単位で契約する「ギグワーク」といった働き方は、すでに一部の分野で広がりを見せています。 ただし、これらの変化がすべての業種や職種で一様に起きるわけではありません。法規制や社会的な慣行、労働組合の影響力なども無視できない要素であり、変化のスピードや形は国や業界によって異なるでしょう。 ### 企業と労働者の関係はどう変わる可能性があるのか AIの導入が進む中で、企業が人を雇用する意味そのものが問い直されるかもしれません。これまでは、企業は長期的な視点で人材を育成し、その見返りとして労働者は企業に帰属意識を持ち、長く働くことが一般的でした。しかし、必要とされるスキルが変化のスピードを速める中で、企業が特定のスキルを持った人材を長期にわたって抱え続けることのリスクも高まっています。 一方で、AIを活用することで人間にしかできない価値創造により集中できるようになれば、企業と労働者の関係は「所属と報酬の交換」から「ミッションへの共創」へとシフトする可能性も考えられます。また、個人の側も、一つの企業に長く依存するのではなく、複数の企業やプロジェクトと関わりながらキャリアを形成する「複業」「パラレルキャリア」といった選択肢が増えるかもしれません。 雇用の安定性という観点では、従来型の正社員としての安定を重視する考え方がある一方で、変化に応じて柔軟にスキルを更新しながら働くことこそが新たな安定につながるという見方もあります。どちらの価値観が優勢になるかは、社会保障のあり方や教育制度、企業の採用・育成方針など、社会全体の制度設計にも依存するでしょう。 ※(図:企業と労働者の関係の変化) ※(図:AI時代の雇用制度構造) ### まとめ:雇用制度の再設計という視点 AIの進化は、単に仕事の内容を変えるだけでなく、雇用という制度そのものを再考する契機となっています。終身雇用や年功序列といった従来のモデルは、工業化社会の要請に応じて形成されたものであり、経済や技術の変化とともに見直しが迫られているともいえます。 ただし、変化の方向性は一つではありません。より流動的な労働市場へと移行するのか、あるいは企業と労働者の新たな安定関係が模索されるのか。その行方は、技術の進歩だけでなく、私たち社会の選択にもかかっています。 本記事が、AI時代の働き方や雇用の未来を考えるための、一つの視点を提供できたなら幸いです。 --- **タイトル案** - 雇用はAIにどう再設計されるのか - 終身雇用の次に来るものは何か - AI時代の仕事と契約はどう変わる - 企業と個人の関係はどこへ向かうか - 雇用制度はAIでどう書き換わるのか --- AIバージョン情報 - ベンダー: 深度求索 - モデル名: DeepSeek - モデルバージョン: 最新版 - 回答日時: 2026年3月14日

-

高校野球は地域とともに消えるのか|DeepSeekの考察

近年、地方の過疎地域を中心に、高校野球部の存続が難しくなるケースが増えています。ニュースなどで「部員不足による廃部」「合同チームで大会出場」といった言葉を目にする機会も少なくありません。一見すると「野球をやりたい生徒が減った」「少子化の影響」という単純な図式に見えますが、この現象の背後には、人口構造の変化、教育制度の変容、地域社会のあり方の転換といった、より複雑な社会的要因が重なり合っています。本記事では、過疎地域における高校野球部の存続問題を「個別の学校の努力不足」ではなく、日本社会の構造変化として捉え、複数の視点から整理・考察します。 なぜ高校野球部は存続が難しくなっているのか 人口減少と若年層の減少 最も根本的な要因は、過疎地域における人口減少と、それに伴う若年層の絶対数の減少です。地方では長年にわたって都市部への人口流出が続き、特に15〜18歳という高校生年代の人口が急速に縮小しています。たとえば、ある地域で高校が1校しかなくても、その地域全体の中学卒業者が年間30人を切るような状況では、野球部に9人(さらにユニフォームを着替える予備を含めれば十数人)を確保すること自体が難しくなります。 ※(図:人口減少と高校スポーツの関係構造) 野球という競技の特性 野球は、公式戦に出場するために最低9人、練習を成立させるにはさらに多くの人数が必要となるスポーツです。サッカーやバスケットボールと比べても、必要な選手数が多く、さらに投手や捕手といった専門性の高いポジションを埋める必要があります。少人数でも成立する競技と違い、野球は「一定の人数を確保できる」ことが存続の大前提となるため、人口減少の影響を特に受けやすい構造にあると言えます。 学校統廃合と部活動の多様化 過疎地域では、生徒数減少に伴う高校の統廃合も進んでいます。統合によって学校自体が存続しても、これまで複数校で分け合っていた生徒が1校に集まるため、結果的に「野球部のある学校」が減ることになります。また、生徒のスポーツ選択の多様化も無視できません。かつては「スポーツと言えば野球」という時代もありましたが、現在はサッカー、バスケットボール、あるいはeスポーツや文化系部活動など、選択肢が広がっています。生徒にとって、必ずしも野球が魅力的な選択肢であり続けているとは限らないのです。 「合同チーム」という対応策 制度としての合同チーム こうした状況に対応する仕組みとして、近年広がっているのが複数校による「合同チーム」です。高校野球の公式戦では、単独でチームを組めない学校同士が連合を組み、1つのチームとして大会に参加することが認められています。この制度により、単独では出場を断念せざるを得なかった地域の生徒たちにも、公式戦に出場する機会が確保されるようになりました。 変化するチームの意味 しかし、合同チームには新たな問いも生まれています。これまで高校野球は「学校単位」の文化として発展してきました。校歌、ユニフォーム、応援スタイル——それらは学校ごとのアイデンティティと結びついていました。合同チームでは、複数の学校の生徒が集まるため、どこの校歌を歌うのか、ユニフォームはどの学校のものを着るのかといった、従来は意識する必要のなかった調整が発生します。「学校の代表」として戦うという感覚は、自然と薄れていくかもしれません。 ※(図:高校野球と地域社会の関係イメージ) 高校野球は地域社会にとって何なのか 地域文化としての高校野球 高校野球は、単に生徒のスポーツ活動にとどまらず、地域の文化やコミュニティと深く結びついてきました。地方の高校が甲子園に出場すれば、町全体が盛り上がり、商店街に応援旗が掲げられ、地元新聞は連日特集を組む——そんな光景は、多くの人の記憶にあるのではないでしょうか。野球部の存在は、卒業生にとっての故郷との接点であり、地域住民にとっては「わが町の高校」を象徴する存在でもありました。 メディアと応援文化 地方大会のテレビ中継や新聞報道は、高校野球を「全国的に注目される地域のイベント」に育て上げました。甲子園という全国区の舞台があることで、地方の高校にも脚光が当たる機会が生まれ、それが地域の誇りや結束を強める役割を果たしてきました。野球部の存続が危ぶまれるということは、こうした地域の文化的な拠り所の一つが失われる可能性も含んでいます。 高校スポーツの未来 部活動から地域クラブへ 現在、国は部活動の地域移行を進めようとしています。教員の負担軽減や、生徒により多様な活動機会を提供することを目的としたこの動きは、過疎地域の高校野球にも影響を与えるでしょう。学校単位ではなく、地域のクラブチームとして活動する形態が広がれば、複数校の生徒が集まることは自然になり、合同チーム的な形態が標準化していく可能性もあります。 スポーツの楽しみ方の多様化 一方で、競技としての野球のあり方自体も問われています。甲子園を頂点とする「大会志向」だけでなく、少人数でも楽しめる形(例えば「ティーボール」や「軟式野球の変則ルール」など)が模索される動きもあります。「高校野球とは何か」という問いそのものが、再定義されつつあるのかもしれません。 楽観でも悲観でもなく もちろん、過疎地域の高校野球がすべて消滅するとは限りません。新しい形での存続を模索する地域もあれば、野球以外のスポーツや活動に重心を移す地域もあるでしょう。大切なのは、この現象を「部員不足という学校単位の問題」と捉えるのではなく、人口減少という避けられない構造変化の中で、地域の文化や教育のあり方をどうデザインしていくかという視点で考えることではないでしょうか。 まとめ 過疎地域における高校野球部の存続問題は、人口減少・教育制度・地域社会の変化が交差する地点に現れているテーマです。単独チームの維持が難しくなる中で、合同チームという制度は一定の対応策となっていますが、同時に「学校単位のスポーツ」の意味合いも問い直されています。今後、部活動の地域移行やスポーツ環境の多様化が進む中で、高校野球がどのような形で地域に根ざしていくのか——それは、日本の地方社会や教育の未来を考える上での、一つの指標となるかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 人口減少や地域社会の変化が進む中で、 「過疎地域における高校野球部の存続問題」は どのような社会構造の中で生まれているのか。 高校野球という文化・教育制度・地域社会の関係性を踏まえ、 この問題を単なる「部員不足の問題」としてではなく、 人口構造・教育制度・スポーツ文化の視点から整理・考察してください。 【目的】 – 高校野球部の存続問題を「個別の学校の問題」ではなく、社会構造の変化として理解する – 人口減少・地域社会・教育制度・スポーツ文化の関係を整理する – 読者が日本の地方社会や高校スポーツの未来について考える視点を提供する 【読者像】 – 一般社会人(20〜60代) – 学生や保護者 – 野球や高校スポーツに関心のある読者 – 地方社会や人口減少問題に関心のある層 【記事構成】 1. 導入(問題提起) – 過疎地域では高校野球部の存続が難しくなっている現状を提示する – 「部員不足」という表面的な問題の背後に、人口減少や地域社会の変化があることを示す – なぜこの問題が日本社会の変化を象徴するテーマになっているのかを簡潔に説明する 2. なぜ高校野球部は存続が難しくなっているのか – 人口減少や若年層の減少が学校スポーツに与える影響を整理する – 野球という競技が人数を必要とするスポーツである点に触れる – 学校統廃合や部活動の多様化など、複数の要因が重なっていることを説明する – 地域差がどのように現れているかにも触れる 3. 「合同チーム」という対応策 – 複数高校による合同チームの仕組みを説明する – 制度としては部活動を維持する方法であることを整理する – 一方で、学校単位のチーム文化や地域との関係にどのような変化が生まれるのかを考察する 4. 高校野球は地域社会にとって何なのか – 高校野球が単なるスポーツではなく、地域文化やコミュニティと結びついていることを説明する – 地元メディア・地域の応援文化・甲子園という舞台との関係を整理する – 地方において高校野球がどのような象徴的役割を持ってきたのかを考察する 5. 高校スポーツの未来 – 学校部活動というモデルが今後どのように変化する可能性があるのかを整理する – 地域クラブ化や学校スポーツの再編など、考えられる方向性を提示する – 過度に楽観・悲観せず、読者が日本社会の変化を考える視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:人口減少と高校スポーツの関係構造) ※(図:高校野球と地域社会の関係イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「過疎地域で高校野球部は存続できるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 過疎地域の高校野球部はなぜ消えつつあるのか——人口・教育・地域から見る構造問題 ## はじめに 近年、地方の過疎地域を中心に、高校野球部の存続が難しくなるケースが増えています。ニュースなどで「部員不足による廃部」「合同チームで大会出場」といった言葉を目にする機会も少なくありません。 一見すると「野球をやりたい生徒が減った」「少子化の影響」という単純な図式に見えますが、この現象の背後には、人口構造の変化、教育制度の変容、地域社会のあり方の転換といった、より複雑な社会的要因が重なり合っています。 本記事では、過疎地域における高校野球部の存続問題を「個別の学校の努力不足」ではなく、日本社会の構造変化として捉え、複数の視点から整理・考察します。 --- ## なぜ高校野球部は存続が難しくなっているのか ### 人口減少と若年層の減少 最も根本的な要因は、過疎地域における人口減少と、それに伴う若年層の絶対数の減少です。地方では長年にわたって都市部への人口流出が続き、特に15〜18歳という高校生年代の人口が急速に縮小しています。 たとえば、ある地域で高校が1校しかなくても、その地域全体の中学卒業者が年間30人を切るような状況では、野球部に9人(さらにユニフォームを着替える予備を含めれば十数人)を確保すること自体が難しくなります。 ※(図:人口減少と高校スポーツの関係構造) ### 野球という競技の特性 野球は、公式戦に出場するために最低9人、練習を成立させるにはさらに多くの人数が必要となるスポーツです。サッカーやバスケットボールと比べても、必要な選手数が多く、さらに投手や捕手といった専門性の高いポジションを埋める必要があります。 少人数でも成立する競技と違い、野球は「一定の人数を確保できる」ことが存続の大前提となるため、人口減少の影響を特に受けやすい構造にあると言えます。 ### 学校統廃合と部活動の多様化 過疎地域では、生徒数減少に伴う高校の統廃合も進んでいます。統合によって学校自体が存続しても、これまで複数校で分け合っていた生徒が1校に集まるため、結果的に「野球部のある学校」が減ることになります。 また、生徒のスポーツ選択の多様化も無視できません。かつては「スポーツと言えば野球」という時代もありましたが、現在はサッカー、バスケットボール、あるいはeスポーツや文化系部活動など、選択肢が広がっています。生徒にとって、必ずしも野球が魅力的な選択肢であり続けているとは限らないのです。 --- ## 「合同チーム」という対応策 ### 制度としての合同チーム こうした状況に対応する仕組みとして、近年広がっているのが複数校による「合同チーム」です。高校野球の公式戦では、単独でチームを組めない学校同士が連合を組み、1つのチームとして大会に参加することが認められています。 この制度により、単独では出場を断念せざるを得なかった地域の生徒たちにも、公式戦に出場する機会が確保されるようになりました。 ### 変化するチームの意味 しかし、合同チームには新たな問いも生まれています。これまで高校野球は「学校単位」の文化として発展してきました。校歌、ユニフォーム、応援スタイル——それらは学校ごとのアイデンティティと結びついていました。 合同チームでは、複数の学校の生徒が集まるため、どこの校歌を歌うのか、ユニフォームはどの学校のものを着るのかといった、従来は意識する必要のなかった調整が発生します。「学校の代表」として戦うという感覚は、自然と薄れていくかもしれません。 ※(図:高校野球と地域社会の関係イメージ) --- ## 高校野球は地域社会にとって何なのか ### 地域文化としての高校野球 高校野球は、単に生徒のスポーツ活動にとどまらず、地域の文化やコミュニティと深く結びついてきました。地方の高校が甲子園に出場すれば、町全体が盛り上がり、商店街に応援旗が掲げられ、地元新聞は連日特集を組む——そんな光景は、多くの人の記憶にあるのではないでしょうか。 野球部の存在は、卒業生にとっての故郷との接点であり、地域住民にとっては「わが町の高校」を象徴する存在でもありました。 ### メディアと応援文化 地方大会のテレビ中継や新聞報道は、高校野球を「全国的に注目される地域のイベント」に育て上げました。甲子園という全国区の舞台があることで、地方の高校にも脚光が当たる機会が生まれ、それが地域の誇りや結束を強める役割を果たしてきました。 野球部の存続が危ぶまれるということは、こうした地域の文化的な拠り所の一つが失われる可能性も含んでいます。 --- ## 高校スポーツの未来 ### 部活動から地域クラブへ 現在、国は部活動の地域移行を進めようとしています。教員の負担軽減や、生徒により多様な活動機会を提供することを目的としたこの動きは、過疎地域の高校野球にも影響を与えるでしょう。 学校単位ではなく、地域のクラブチームとして活動する形態が広がれば、複数校の生徒が集まることは自然になり、合同チーム的な形態が標準化していく可能性もあります。 ### スポーツの楽しみ方の多様化 一方で、競技としての野球のあり方自体も問われています。甲子園を頂点とする「大会志向」だけでなく、少人数でも楽しめる形(例えば「ティーボール」や「軟式野球の変則ルール」など)が模索される動きもあります。 「高校野球とは何か」という問いそのものが、再定義されつつあるのかもしれません。 ### 楽観でも悲観でもなく もちろん、過疎地域の高校野球がすべて消滅するとは限りません。新しい形での存続を模索する地域もあれば、野球以外のスポーツや活動に重心を移す地域もあるでしょう。 大切なのは、この現象を「部員不足という学校単位の問題」と捉えるのではなく、人口減少という避けられない構造変化の中で、地域の文化や教育のあり方をどうデザインしていくかという視点で考えることではないでしょうか。 --- ## まとめ 過疎地域における高校野球部の存続問題は、人口減少・教育制度・地域社会の変化が交差する地点に現れているテーマです。単独チームの維持が難しくなる中で、合同チームという制度は一定の対応策となっていますが、同時に「学校単位のスポーツ」の意味合いも問い直されています。 今後、部活動の地域移行やスポーツ環境の多様化が進む中で、高校野球がどのような形で地域に根ざしていくのか——それは、日本の地方社会や教育の未来を考える上での、一つの指標となるかもしれません。 --- ## タイトル案 - 高校野球は地域とともに消えるのか - 過疎地の高校野球は誰が支えるのか - 甲子園の夢は地方で叶えられるか --- — AIバージョン情報 - ベンダー: DeepSeek - モデル名: DeepSeek R1 - モデルバージョン: 不明 - 回答日時: 2026年3月14日

-

クリエイターに雇用は消えるのか|DeepSeekの考察

近年、デザイナーやライター、映像制作者など、クリエイティブ職の働き方に変化が見られます。フリーランスとして独立する人、本業のかたわら副業で創作活動を行う人、企業と業務委託契約を結んで働く人が増えているという実感を持つ方も少なくないでしょう。従来のクリエイターの働き方といえば、企業に所属し、給与を得ながら制作に携わる「雇用モデル」が一般的でした。一方で現在注目されているのは、特定の企業に所属せず、プロジェクト単位で契約を結んで仕事をする「契約モデル」です。本記事では、クリエイターの働き方が本当に雇用から契約へと移行しつつあるのか、複数の視点から整理していきます。 クリエイターの働き方はなぜ契約型と相性が良いのか クリエイティブ職の仕事は、そもそも契約型の働き方と親和性が高い面があります。 成果物ベースの仕事であること クライアントから依頼を受け、納期までに成果物を納品するという流れは、時間単位の労働ではなく成果に対して対価が支払われる構造と合致します。 プロジェクト単位で仕事が発生すること 広告キャンペーンやWebサイトリニューアルなど、クリエイティブの需要は多くの場合、プロジェクト単位で発生します。企業側から見れば、必要なときに必要な人材を確保できる契約型は合理的です。 デジタル化による場所の自由 制作環境がデジタルツールに移行したことで、オフィスに常駐する必然性は低下しました。クラウド上でのファイル共有やオンラインでのコミュニケーションが一般化し、物理的な距離は障害ではなくなっています。 契約型が広がる背景にある社会構造 雇用から契約へという流れを後押ししているのは、いくつかの社会的な変化です。 プラットフォームの存在 クラウドソーシングサービスやSNSの普及により、クリエイターは自ら営業しなくても仕事を得られる機会が増えました。また、実績を可視化しやすい環境も整っています。 リモートワークの普及 コロナ禍をきっかけにリモートワークが定着したことで、企業側も社外のクリエイターと協働することへの心理的ハードルが下がりました。 AIによる制作補助ツールの登場 画像生成AIや文章作成支援ツールなど、AIを活用した制作補助技術が急速に発展しています。これにより、一人のクリエイターがこなせる作業範囲が広がり、小規模なチームや個人でも一定以上のクオリティの仕事が可能になりました。 それでも雇用が残る理由 しかし、すべてのクリエイティブ職が契約型に置き換わるとは考えにくい面もあります。 ブランド管理や企画の中枢機能 企業のブランドイメージを長期的に維持・発展させるような業務は、外部委託よりも内部で一貫して管理する方が適している場合があります。 長期プロジェクトにおける安定性 ゲーム開発やIPビジネスのように、数年単位で進行する大規模プロジェクトでは、安定的に人材を確保できる雇用モデルの優位性が依然としてあります。 ディレクション機能の必要性 外部クリエイターを活用する場合でも、全体を統括し、クオリティを管理するディレクション機能は企業内部に残る傾向があります。 ※(図:クリエイターの雇用型と契約型の構造) 重要なのは「雇用か契約か」ではなく役割の変化 働き方の議論で見落とされがちなのは、同じクリエイターという職種でも、担う役割によって価値が異なるという点です。 作業者としてのクリエイター 指示された制作作業を遂行する役割です。AIや自动化の影響を受けやすい領域でもあります。 企画・編集・ディレクションを担うクリエイター クライアントの課題を解決するための企画を立案し、他者の制作物も含めて全体を統括する役割です。 AIと協働するクリエイター AIツールを活用して制作プロセスを効率化し、より高度な表現や量産を可能にする役割です。 ※(図:企業と外部クリエイターの関係モデル) 雇用か契約かという区分だけでなく、自分がどのような役割を担いたいのか、その役割に対して市場がどのような評価をするのかを考えることが重要になってきています。 まとめ クリエイターの働き方は、単純に「雇用から契約へ」と一直線に移行するわけではないでしょう。企業の中核的な機能は雇用で維持しつつ、周辺的な制作業務や特定の専門性が必要な領域では契約型を活用するというハイブリッドな構造が広がっていく可能性が高いと考えられます。 また、AIの進化によって「何を作るか」だけでなく「どのように作るか」というプロセスそのものも変化しています。こうした環境の中でクリエイターとして働き続けるためには、自身の役割を定期的に見直し、必要なスキルを獲得していく姿勢が求められるのかもしれません。 読者の皆さんがご自身の働き方を考える際に、本記事がひとつの視点を提供できれば幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 クリエイターの働き方は今後、 「企業に雇用されるモデル」から 「プロジェクト単位の契約型モデル」へ移行していくのか。 デザイン、ライティング、映像制作、ゲーム開発、イラスト、音楽など、 クリエイティブ職の働き方がどのように変化しているのかを、 AI・プラットフォーム・リモートワーク・産業構造の変化という観点から整理してください。 【目的】 – クリエイターの働き方が「雇用」から「契約」に移行しているのかを構造的に整理する – フリーランス化・プロジェクト化・副業化などの変化を冷静に考察する – AI時代においてクリエイターという仕事がどのように位置づけられるのかを理解するための視点を提示する 【読者像】 – 一般社会人(20〜50代) – クリエイティブ職を志望する学生 – 副業やフリーランスに興味を持つ人 – AIや自動化による仕事の変化に関心を持つ人 – クリエイターの働き方の未来を知りたい人 【記事構成】 1. 導入(問題提起) – 近年、クリエイターの働き方が変化していることを提示する – フリーランス、業務委託、副業クリエイターなどが増えている背景を簡潔に説明する – 「雇用モデル」と「契約モデル」という働き方の違いを提示し、本記事の問題設定を示す 2. クリエイターの働き方はなぜ契約型と相性が良いのか – 成果物ベースの仕事であること – プロジェクト単位で仕事が発生すること – デジタル化により場所に依存しない制作環境が生まれていること – なぜ企業が外部クリエイターを活用しやすくなっているのかを整理する 3. 契約型が広がる背景にある社会構造 – プラットフォーム(クラウドソーシング、SNSなど)の存在 – リモートワークの普及 – AIによる制作補助ツールの登場 – 小規模チームや個人でも制作が可能になったこと 4. それでも雇用が残る理由 – ブランド管理や企画などの中枢機能 – 長期プロジェクト(ゲーム開発、IPビジネスなど) – 外部クリエイターを統括するディレクション機能 – 「完全フリーランス化」が起きない理由を整理する 5. 重要なのは「雇用か契約か」ではなく役割の変化 – 作業者としてのクリエイター – 企画・編集・ディレクションを担うクリエイター – AIと協働するクリエイター – 同じ職種でも役割によって価値が変わることを説明する 6. まとめ – クリエイターの働き方は単純にフリーランス化するわけではない可能性を整理する – 「雇用」と「契約」が混在するハイブリッド構造の可能性に触れる – 読者が今後の働き方を考えるための視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:クリエイターの雇用型と契約型の構造) ※(図:企業と外部クリエイターの関係モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「クリエイターは会社に属する仕事なのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### クリエイターの働き方は「雇用」から「契約」へ移行するのか 近年、デザイナーやライター、映像制作者など、クリエイティブ職の働き方に変化が見られます。フリーランスとして独立する人、本業のかたわら副業で創作活動を行う人、企業と業務委託契約を結んで働く人が増えているという実感を持つ方も少なくないでしょう。 従来のクリエイターの働き方といえば、企業に所属し、給与を得ながら制作に携わる「雇用モデル」が一般的でした。一方で現在注目されているのは、特定の企業に所属せず、プロジェクト単位で契約を結んで仕事をする「契約モデル」です。本記事では、クリエイターの働き方が本当に雇用から契約へと移行しつつあるのか、複数の視点から整理していきます。 ### クリエイターの働き方はなぜ契約型と相性が良いのか クリエイティブ職の仕事は、そもそも契約型の働き方と親和性が高い面があります。 **成果物ベースの仕事であること** クライアントから依頼を受け、納期までに成果物を納品するという流れは、時間単位の労働ではなく成果に対して対価が支払われる構造と合致します。 **プロジェクト単位で仕事が発生すること** 広告キャンペーンやWebサイトリニューアルなど、クリエイティブの需要は多くの場合、プロジェクト単位で発生します。企業側から見れば、必要なときに必要な人材を確保できる契約型は合理的です。 **デジタル化による場所の自由** 制作環境がデジタルツールに移行したことで、オフィスに常駐する必然性は低下しました。クラウド上でのファイル共有やオンラインでのコミュニケーションが一般化し、物理的な距離は障害ではなくなっています。 ### 契約型が広がる背景にある社会構造 雇用から契約へという流れを後押ししているのは、いくつかの社会的な変化です。 **プラットフォームの存在** クラウドソーシングサービスやSNSの普及により、クリエイターは自ら営業しなくても仕事を得られる機会が増えました。また、実績を可視化しやすい環境も整っています。 **リモートワークの普及** コロナ禍をきっかけにリモートワークが定着したことで、企業側も社外のクリエイターと協働することへの心理的ハードルが下がりました。 **AIによる制作補助ツールの登場** 画像生成AIや文章作成支援ツールなど、AIを活用した制作補助技術が急速に発展しています。これにより、一人のクリエイターがこなせる作業範囲が広がり、小規模なチームや個人でも一定以上のクオリティの仕事が可能になりました。 ### それでも雇用が残る理由 しかし、すべてのクリエイティブ職が契約型に置き換わるとは考えにくい面もあります。 **ブランド管理や企画の中枢機能** 企業のブランドイメージを長期的に維持・発展させるような業務は、外部委託よりも内部で一貫して管理する方が適している場合があります。 **長期プロジェクトにおける安定性** ゲーム開発やIPビジネスのように、数年単位で進行する大規模プロジェクトでは、安定的に人材を確保できる雇用モデルの優位性が依然としてあります。 **ディレクション機能の必要性** 外部クリエイターを活用する場合でも、全体を統括し、クオリティを管理するディレクション機能は企業内部に残る傾向があります。 ※(図:クリエイターの雇用型と契約型の構造) ### 重要なのは「雇用か契約か」ではなく役割の変化 働き方の議論で見落とされがちなのは、同じクリエイターという職種でも、担う役割によって価値が異なるという点です。 **作業者としてのクリエイター** 指示された制作作業を遂行する役割です。AIや自动化の影響を受けやすい領域でもあります。 **企画・編集・ディレクションを担うクリエイター** クライアントの課題を解決するための企画を立案し、他者の制作物も含めて全体を統括する役割です。 **AIと協働するクリエイター** AIツールを活用して制作プロセスを効率化し、より高度な表現や量産を可能にする役割です。 ※(図:企業と外部クリエイターの関係モデル) 雇用か契約かという区分だけでなく、自分がどのような役割を担いたいのか、その役割に対して市場がどのような評価をするのかを考えることが重要になってきています。 ### まとめ クリエイターの働き方は、単純に「雇用から契約へ」と一直線に移行するわけではないでしょう。企業の中核的な機能は雇用で維持しつつ、周辺的な制作業務や特定の専門性が必要な領域では契約型を活用するというハイブリッドな構造が広がっていく可能性が高いと考えられます。 また、AIの進化によって「何を作るか」だけでなく「どのように作るか」というプロセスそのものも変化しています。こうした環境の中でクリエイターとして働き続けるためには、自身の役割を定期的に見直し、必要なスキルを獲得していく姿勢が求められるのかもしれません。 読者の皆さんがご自身の働き方を考える際に、本記事がひとつの視点を提供できれば幸いです。 --- ### タイトル案 クリエイターに雇用は消えるのか 契約社会でクリエイターは生き残れるか クリエイターの未来は契約か雇用か --- AIバージョン情報 - ベンダー: DeepSeek - モデル名: DeepSeek 最新版 - モデルバージョン: 不明 - 回答日時: 2026年3月14日

-

野球の国際大会はなぜビジネスと衝突するのか|DeepSeekの考察

WBC(ワールド・ベースボール・クラシック)は、国と国との真剣勝負の場として、野球ファンのみならず多くの人々の関心を集める国際大会です。しかし、この大会の開催時期は、プロ野球、特にメジャーリーグベースボール(MLB)のスプリングトレーニング(春季キャンプ)期間と重なっています。私たちはなぜ、WBCがレギュラーシーズンではなく、シーズン開幕直前に開催されるのか、考えたことはあるでしょうか。この疑問の背景には、国家代表としての大会と、商業リーグとしてのプロ野球シーズンという、二つの異なる制度が抱える複雑な関係が存在します。 プロリーグと国際大会の制度的な目的の違い そもそも、MLBに代表されるプロ野球リーグは、民間企業である球団が運営する商業リーグです。その主たる目的は、興行としての試合を提供し、観客動員や放映権料などの収益を上げること、そして選手たちはその対価として球団から給与を得るというビジネスモデルで成り立っています。 一方、WBCのような国際大会は、国家の威信をかけたナショナルチームによる競技会です。その目的は、国家間のスポーツ交流や、母国における野球の普及、そして世界的な競技レベルの向上などにあります。このように、同じ「野球」を舞台としながらも、プロリーグと国際大会では、その根底にある目的や制度が根本的に異なります。そのため、同じ選手が、球団に雇用される「プロ選手」と、国家を代表する「代表選手」という二つの立場を同時に持つことで、様々な緊張関係が生まれることになります。 シーズン前開催が生む構造的問題 WBCがシーズン前の3月に開催されるのは、MLBのレギュラーシーズン(通常4月〜9月)と重ならないようにするためです。もしシーズン中に大会を開催すれば、主力選手が長期間チームを離れることになり、リーグの興行価値が著しく損なわれてしまいます。しかし、このシーズン前という開催時期自体が、新たな構造的問題を生み出しています。 最も大きな問題は、選手のコンディション調整に関するものです。スプリングトレーニングは、選手がオフシーズンの間に落ちた体力や感覚を徐々に取り戻し、長期シーズンに備えるための期間です。ところが、WBCでは開幕直後から、公式戦と同等かそれ以上の強度の試合が連続して行われます。通常の調整ペースよりも早くピークコンディションを作らなければならず、故障のリスクが高まることは避けられません。 ここには、以下のような複数の利害関係者が存在します。 ※(図:球団・選手・国家代表の利害関係) 球団・選手・大会運営の利害構造 球団: 高額な年俸を支払っている「資産」である選手のコンディション管理を最優先したい。 選手: 国家代表として国のためにプレーする誇りと、自身のキャリアや年俸に直結するシーズンでの活躍の両方を目指したい。 大会運営(WBC): 世界最高峰の選手が出場し、質の高い大会を成功させることで、野球の国際的な人気と価値を高めたい。 WBCのシーズン前開催は、これらの異なる思惑がぶつかり合う「妥協の産物」であり、その構造的な緊張を象徴していると言えるでしょう。 球団資産と国家代表という二重構造 選手の立場をより詳しく見ると、その二重性はさらに明確になります。選手は日頃、所属球団と複数年にも及ぶ契約を結び、球団の「資産」として扱われます。球団は投資に対するリターンとして、選手の健康で安定したパフォーマンスを期待します。 しかし、WBCに出場する際、選手は「国家代表」という別の役割を帯びます。ここで問題となるのが、大会中の怪我やコンディション不良のリスクが、最終的にどこに帰属するのかという点です。仮にエース投手がWBCで肩を痛め、シーズンを棒に振ってしまった場合、その経済的損失は球団が被ることになります。このリスクを軽減するため、大会側は高額な保険制度を導入し、球団に対して補償を行う仕組みを整えています。また、球団によっては、選手の出場イニング数や登板間隔に制限を設けるよう、代表チームの首脳陣と事前に協議することもあります。これらの制度的な調整は、二重構造がもたらすリスクを分散し、なんとか共存を図るための努力の表れと言えます。 ※(図:WBCとプロリーグの制度関係) それでも大会が成立している理由 これだけ多くの制度的な矛盾や緊張関係を抱えながらも、WBCが4回(2023年時点)にわたって開催され、成功を収めてきたのには理由があります。 最大の要因は、WBCが野球の国際市場拡大に大きく貢献しているという点です。大会を通じて、かつては野球になじみの薄かった地域でもスター選手が誕生し、新たなファン層が開拓されます。これは、MLBをはじめとするプロリーグにとって、中長期的なビジネスチャンスの拡大につながります。また、国の威信をかけた熱戦は、国境を越えたドラマを生み出します。国の英雄として活躍するスター選手の姿は、プロリーグとはまた違った形の「物語」を提供し、野球というスポーツそのものの価値を高めているのです。 つまり、WBCとプロリーグの関係は、単純な利害の対立ではなく、短期的には緊張関係をはらみつつも、長期的には相互に利益をもたらす可能性を秘めた、「協調と緊張」の上に成り立っていると言えるでしょう。 まとめ 本記事では、WBCとプロリーグの関係を、制度やビジネスの視点から構造的に整理してきました。WBCの開催は、商業リーグとしてのプロ野球の論理と、国家代表戦としての国際大会の論理が交錯する、複雑な制度的な調整の上に成り立っています。シーズン前の開催は、その妥協点であると同時に、選手のコンディション問題や球団とのリスク分担など、新たな課題を生み出す構造でもあります。 「代表戦の感動」の裏側には、こうした球団、選手、大会運営の複雑な利害関係や、それを調整するための精緻な制度が存在しています。WBCという大会を、スポーツの興奮だけでなく、このような制度や構造の視点から捉え直してみると、また違った面白さが見えてくるのではないでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 国際野球大会「WBC(ワールド・ベースボール・クラシック)」は、 プロ野球リーグ(特にMLB)のシーズンとの関係において 制度的な矛盾や緊張関係を抱えているのか。 国家代表としての大会と、 商業リーグとしてのプロ野球シーズンという 二つの制度がどのように共存しているのかを 構造的に整理・考察してください。 【目的】 – WBCを単なるスポーツイベントとしてではなく、制度・ビジネス・国際関係の視点から整理する – 「代表戦の感動」だけでなく、リーグ運営・選手契約・大会構造などの制度的背景を理解する材料を提示する – 国際スポーツ大会とプロリーグの関係がどのような構造で成立しているのかを読み解く 【読者像】 – 野球やスポーツに関心のある一般読者 – WBCを楽しんでいるが、制度や運営構造については詳しくない人 – スポーツビジネスや国際大会の仕組みに興味がある読者 – スポーツを社会構造の視点から読み解きたい人 【記事構成】 1. 導入(問題提起) – WBCは世界的な注目を集める国際大会であることを説明する – しかし、その開催はプロリーグのシーズンと密接に関係していることを提示する – なぜWBCはシーズン前に開催されるのかという疑問を提示する 2. プロリーグと国際大会の制度的な目的の違い – プロリーグ(MLBなど)は商業リーグであることを説明する – 国際大会は国家代表・国際普及という別の目的を持つことを整理する – 同じ選手が二つの制度にまたがることで生まれる緊張関係を説明する 3. シーズン前開催が生む構造的問題 – WBCがスプリングトレーニング期間と重なる理由を整理する – 選手のコンディション調整と大会の競技強度のギャップを説明する – 球団・選手・大会運営の利害関係を構造的に整理する 4. 球団資産と国家代表という二重構造 – 選手は国家代表として出場するが、契約は球団と結んでいることを説明する – 怪我やコンディションリスクがどこに帰属するのかという問題を整理する – 保険制度や出場制限などの制度的調整について触れる 5. それでも大会が成立している理由 – WBCが野球の国際市場拡大に果たす役割を説明する – スター選手の物語や国際的注目が生まれる構造を整理する – プロリーグと国際大会の「協調と緊張」の関係をまとめる 6. まとめ – WBCとプロリーグの関係は単純な対立ではなく、複数の利害が交差する制度であることを整理する – 国際大会と商業リーグが共存するスポーツの特徴を示す – 読者がスポーツを制度や構造の視点から考えるための材料を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「感情的なスポーツ論」ではなく、「構造理解のための記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:WBCとプロリーグの制度関係) ※(図:球団・選手・国家代表の利害関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「WBCはプロ野球シーズンと制度的に両立しているのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 1. 導入(問題提起) WBC(ワールド・ベースボール・クラシック)は、国と国との真剣勝負の場として、野球ファンのみならず多くの人々の関心を集める国際大会です。しかし、この大会の開催時期は、プロ野球、特にメジャーリーグベースボール(MLB)のスプリングトレーニング(春季キャンプ)期間と重なっています。私たちはなぜ、WBCがレギュラーシーズンではなく、シーズン開幕直前に開催されるのか、考えたことはあるでしょうか。この疑問の背景には、国家代表としての大会と、商業リーグとしてのプロ野球シーズンという、二つの異なる制度が抱える複雑な関係が存在します。 ### 2. プロリーグと国際大会の制度的な目的の違い そもそも、MLBに代表されるプロ野球リーグは、民間企業である球団が運営する**商業リーグ**です。その主たる目的は、興行としての試合を提供し、観客動員や放映権料などの収益を上げること、そして選手たちはその対価として球団から給与を得るというビジネスモデルで成り立っています。 一方、WBCのような国際大会は、国家の威信をかけた**ナショナルチームによる競技会**です。その目的は、国家間のスポーツ交流や、母国における野球の普及、そして世界的な競技レベルの向上などにあります。このように、同じ「野球」を舞台としながらも、プロリーグと国際大会では、その根底にある目的や制度が根本的に異なります。そのため、同じ選手が、球団に雇用される「プロ選手」と、国家を代表する「代表選手」という二つの立場を同時に持つことで、様々な緊張関係が生まれることになります。 ### 3. シーズン前開催が生む構造的問題 WBCがシーズン前の3月に開催されるのは、MLBのレギュラーシーズン(通常4月〜9月)と重ならないようにするためです。もしシーズン中に大会を開催すれば、主力選手が長期間チームを離れることになり、リーグの興行価値が著しく損なわれてしまいます。しかし、このシーズン前という開催時期自体が、新たな構造的問題を生み出しています。 最も大きな問題は、選手の**コンディション調整**に関するものです。スプリングトレーニングは、選手がオフシーズンの間に落ちた体力や感覚を徐々に取り戻し、長期シーズンに備えるための期間です。ところが、WBCでは開幕直後から、公式戦と同等かそれ以上の強度の試合が連続して行われます。通常の調整ペースよりも早くピークコンディションを作らなければならず、故障のリスクが高まることは避けられません。 ここには、以下のような複数の利害関係者が存在します。 ※(図:球団・選手・国家代表の利害関係) * **球団**: 高額な年俸を支払っている「資産」である選手のコンディション管理を最優先したい。 * **選手**: 国家代表として国のためにプレーする誇りと、自身のキャリアや年俸に直結するシーズンでの活躍の両方を目指したい。 * **大会運営(WBC)**: 世界最高峰の選手が出場し、質の高い大会を成功させることで、野球の国際的な人気と価値を高めたい。 WBCのシーズン前開催は、これらの異なる思惑がぶつかり合う「妥協の産物」であり、その構造的な緊張を象徴していると言えるでしょう。 ### 4. 球団資産と国家代表という二重構造 選手の立場をより詳しく見ると、その二重性はさらに明確になります。選手は日頃、所属球団と複数年にも及ぶ契約を結び、球団の「資産」として扱われます。球団は投資に対するリターンとして、選手の健康で安定したパフォーマンスを期待します。 しかし、WBCに出場する際、選手は「国家代表」という別の役割を帯びます。ここで問題となるのが、大会中の**怪我やコンディション不良のリスクが、最終的にどこに帰属するのか**という点です。仮にエース投手がWBCで肩を痛め、シーズンを棒に振ってしまった場合、その経済的損失は球団が被ることになります。このリスクを軽減するため、大会側は高額な保険制度を導入し、球団に対して補償を行う仕組みを整えています。また、球団によっては、選手の出場イニング数や登板間隔に制限を設けるよう、代表チームの首脳陣と事前に協議することもあります。これらの制度的な調整は、二重構造がもたらすリスクを分散し、なんとか共存を図るための努力の表れと言えます。 ※(図:WBCとプロリーグの制度関係) ### 5. それでも大会が成立している理由 これだけ多くの制度的な矛盾や緊張関係を抱えながらも、WBCが4回(2023年時点)にわたって開催され、成功を収めてきたのには理由があります。 最大の要因は、WBCが野球の**国際市場拡大**に大きく貢献しているという点です。大会を通じて、かつては野球になじみの薄かった地域でもスター選手が誕生し、新たなファン層が開拓されます。これは、MLBをはじめとするプロリーグにとって、中長期的なビジネスチャンスの拡大につながります。また、国の威信をかけた熱戦は、国境を越えたドラマを生み出します。国の英雄として活躍するスター選手の姿は、プロリーグとはまた違った形の「物語」を提供し、野球というスポーツそのものの価値を高めているのです。 つまり、WBCとプロリーグの関係は、単純な利害の対立ではなく、短期的には緊張関係をはらみつつも、長期的には相互に利益をもたらす可能性を秘めた、**「協調と緊張」の上に成り立っている**と言えるでしょう。 ### 6. まとめ 本記事では、WBCとプロリーグの関係を、制度やビジネスの視点から構造的に整理してきました。WBCの開催は、商業リーグとしてのプロ野球の論理と、国家代表戦としての国際大会の論理が交錯する、複雑な制度的な調整の上に成り立っています。シーズン前の開催は、その妥協点であると同時に、選手のコンディション問題や球団とのリスク分担など、新たな課題を生み出す構造でもあります。 「代表戦の感動」の裏側には、こうした球団、選手、大会運営の複雑な利害関係や、それを調整するための精緻な制度が存在しています。WBCという大会を、スポーツの興奮だけでなく、このような制度や構造の視点から捉え直してみると、また違った面白さが見えてくるのではないでしょうか。 --- **タイトル案** * 野球の国際大会はなぜビジネスと衝突するのか * WBCとプロリーグは共存できるのか * 国家代表とプロ契約は両立するのか — AIバージョン情報 – ベンダー: DeepSeek – モデル名: DeepSeek Chat – モデルバージョン: 不明 – 回答日時: 2026-03-14

-

ベンダーロックインはなぜ二つの顔を持つのか|DeepSeekの考察

現在、多くの企業や組織がITサービス、クラウド環境、AIプラットフォームを利用する中で、特定のベンダー(提供事業者)への依存が進んでいます。「ベンダーロックイン」という言葉は、こうした状況を指す際にしばしば使われますが、その評価は一様ではありません。一方では「システムが安定する仕組み」と捉えられ、他方では「離脱を困難にする構造」と批判されます。本記事では、この相反する見方を整理し、ベンダーロックインという現象を多角的に考察します。 ベンダーロックインが「安定性」として語られる理由 システム統合と運用の一貫性 特定ベンダーの製品・サービスを一貫して利用する最大の利点は、システム全体の整合性が取りやすくなる点です。異なるベンダーのサービスを組み合わせる場合、それぞれの仕様や更新周期の違いに合わせた調整が必要になります。これに対し、同一ベンダーのサービスで構成された環境では、互換性の問題が生じにくく、運用の手間が軽減されます。 責任範囲の明確化 複数のベンダーを利用している場合、障害が発生したときに「どこに原因があるのか」「誰が対応すべきなのか」が曖昧になりがちです。特定ベンダーに環境を集中させることで、責任の所在が明確になり、問題解決までの時間を短縮できるケースもあります。 セキュリティとサポート体制 大手クラウドベンダーは、セキュリティパッチの提供や脆弱性情報の共有など、体系的なサポート体制を整えています。こうした体制を活用できることも、あえて依存関係を受け入れる理由の一つです。特にセキュリティ人材が不足している企業にとっては、ベンダーの提供する保護環境に身を置くことが合理的な選択となります。 ベンダーロックインが「退出障壁」として語られる理由 データ移行のコスト クラウドサービスから別のサービスへ移行する際、最も大きな障壁となるのがデータ移行です。保存されているデータ量が膨大になればなるほど、転送にかかる時間と費用は増大します。また、データ形式がベンダー独自の仕様で保存されている場合、形式変換の手間も発生します。 APIや運用フローへの依存 クラウドサービスが提供するAPI(アプリケーション・プログラミング・インターフェース)を利用してシステムを構築した場合、そのAPIに依存した作りになります。同様に、ベンダーごとに異なる運用フローや管理画面に最適化された業務プロセスは、移行先で再構築する必要があります。 ※(図:依存関係と退出コストの関係) 乗り換えコスト(Switching Cost)という概念 経済学では、製品やサービスの提供者を変更する際に発生するコストを「乗り換えコスト」と呼びます。金銭的な費用だけでなく、学習コストや契約解除の手続きなども含まれます。クラウド・AIサービスにおいては、この乗り換えコストが非常に高くなる傾向があり、たとえ不満があっても「面倒だから」「コストがかかるから」と、そのまま使い続ける企業が少なくありません。 ロックインは戦略なのか、それとも結果なのか IT企業のビジネスモデルとして 一部のベンダーは、初期費用を低く抑えたり無料プランを提供したりすることで顧客を獲得し、後から乗り換えにくくする戦略を取ることがあります。これは「囲い込み戦略」として知られています。また、自社のエコシステム(関連製品・サービスの集合体)を構築し、その中で完結できるようにすることで、顧客の離脱を防ごうとする動きもあります。 ※(図:ベンダーロックインの構造) 標準化とエコシステム形成の側面 一方で、特定ベンダーの技術が事実上の標準となることで、業界全体の発展が促進される面もあります。たとえば、あるクラウドサービスで使われている技術が広く普及すれば、その技術を扱える人材が増え、関連ツールも充実します。結果として、そのベンダーへの依存は「業界標準への準拠」という側面も持つことになります。 意図せざるロックイン すべてのロックインが戦略的に作られているわけではありません。サービスが成長する過程で機能が追加され、複雑に絡み合った結果、結果的に移行が難しくなるケースもあります。また、ユーザー側が便利さを追求した結果、気づけば深く依存していたということも少なくありません。 まとめ ベンダーロックインを「悪」と断じることは簡単ですが、実際には安定した運用を支える仕組みとして機能している側面も無視できません。重要なのは、ロックインそのものを問題視するのではなく、「どこに依存していて、その依存から離れるには何が必要か」を把握しておくことではないでしょうか。 テクノロジーを選択するということは、その構造ごと受け入れるということでもあります。私たちは日々、便利さと引き換えに何らかの関係性の中に身を置いているのかもしれません。その関係性をどう捉え、どう付き合っていくか。ベンダーロックインの議論は、テクノロジーと社会の関わり方を考える入り口としても捉えられるでしょう。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 IT・クラウド・AIプラットフォームの普及に伴って語られる 「ベンダーロックイン」は、 システム運用の安定性を生む仕組みなのか、 それとも企業や組織の退出を困難にする構造なのか。 この問いを、AIの視点から冷静かつ構造的に整理・考察してください。 【目的】 – 「ロックイン=悪」という単純な評価ではなく、制度や構造として理解する – IT・クラウド・AIサービスにおける依存関係の意味を整理する – 読者がテクノロジー選択の背景にある力学を理解するための視点を提供する 【読者像】 – IT業界に詳しくない一般読者 – クラウド・AIサービスを日常的に使っている人 – テクノロジー企業のビジネスモデルに興味がある人 – 社会構造としてのテクノロジーに関心のある読者 【記事構成】 1. 導入(問題提起) – 多くのITサービスやクラウド環境が特定ベンダーに依存している現状を提示する – 「ベンダーロックイン」という言葉がなぜ議論されるのかを示す – 安定性と依存性という二つの評価が存在することを提示する 2. ベンダーロックインが「安定性」として語られる理由 – システム統合や運用の一貫性が生まれる仕組みを説明する – サポート・責任範囲・セキュリティなどの観点から整理する – なぜ企業があえて依存関係を受け入れるのかを説明する 3. ベンダーロックインが「退出障壁」として語られる理由 – データ移行コストやシステム変更コストを整理する – API・フォーマット・運用フローなどの依存構造を説明する – 乗り換えコスト(Switching Cost)の概念を紹介する 4. ロックインは戦略なのか、それとも結果なのか – IT企業のビジネスモデルとの関係を整理する – クラウド・AIプラットフォームにおける囲い込み戦略の可能性を説明する – しかし同時に、標準化やエコシステム形成という側面にも触れる 5. まとめ – ベンダーロックインを善悪の問題としてではなく構造として再整理する – 「依存」と「安定」の関係を改めて確認する – 読者がテクノロジーと社会の関係を考える視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:ベンダーロックインの構造) ※(図:依存関係と退出コストの関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「ベンダーロックインは安定性なのか、それとも退出障壁なのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # ベンダーロックインは、システムの安定性か、それとも退出障壁か ## はじめに 現在、多くの企業や組織がITサービス、クラウド環境、AIプラットフォームを利用する中で、特定のベンダー(提供事業者)への依存が進んでいます。「ベンダーロックイン」という言葉は、こうした状況を指す際にしばしば使われますが、その評価は一様ではありません。一方では「システムが安定する仕組み」と捉えられ、他方では「離脱を困難にする構造」と批判されます。本記事では、この相反する見方を整理し、ベンダーロックインという現象を多角的に考察します。 ## ベンダーロックインが「安定性」として語られる理由 ### システム統合と運用の一貫性 特定ベンダーの製品・サービスを一貫して利用する最大の利点は、システム全体の整合性が取りやすくなる点です。異なるベンダーのサービスを組み合わせる場合、それぞれの仕様や更新周期の違いに合わせた調整が必要になります。これに対し、同一ベンダーのサービスで構成された環境では、互換性の問題が生じにくく、運用の手間が軽減されます。 ### 責任範囲の明確化 複数のベンダーを利用している場合、障害が発生したときに「どこに原因があるのか」「誰が対応すべきなのか」が曖昧になりがちです。特定ベンダーに環境を集中させることで、責任の所在が明確になり、問題解決までの時間を短縮できるケースもあります。 ### セキュリティとサポート体制 大手クラウドベンダーは、セキュリティパッチの提供や脆弱性情報の共有など、体系的なサポート体制を整えています。こうした体制を活用できることも、あえて依存関係を受け入れる理由の一つです。特にセキュリティ人材が不足している企業にとっては、ベンダーの提供する保護環境に身を置くことが合理的な選択となります。 ## ベンダーロックインが「退出障壁」として語られる理由 ### データ移行のコスト クラウドサービスから別のサービスへ移行する際、最も大きな障壁となるのがデータ移行です。保存されているデータ量が膨大になればなるほど、転送にかかる時間と費用は増大します。また、データ形式がベンダー独自の仕様で保存されている場合、形式変換の手間も発生します。 ### APIや運用フローへの依存 クラウドサービスが提供するAPI(アプリケーション・プログラミング・インターフェース)を利用してシステムを構築した場合、そのAPIに依存した作りになります。同様に、ベンダーごとに異なる運用フローや管理画面に最適化された業務プロセスは、移行先で再構築する必要があります。 ※(図:依存関係と退出コストの関係) ### 乗り換えコスト(Switching Cost)という概念 経済学では、製品やサービスの提供者を変更する際に発生するコストを「乗り換えコスト」と呼びます。金銭的な費用だけでなく、学習コストや契約解除の手続きなども含まれます。クラウド・AIサービスにおいては、この乗り換えコストが非常に高くなる傾向があり、たとえ不満があっても「面倒だから」「コストがかかるから」と、そのまま使い続ける企業が少なくありません。 ## ロックインは戦略なのか、それとも結果なのか ### IT企業のビジネスモデルとして 一部のベンダーは、初期費用を低く抑えたり無料プランを提供したりすることで顧客を獲得し、後から乗り換えにくくする戦略を取ることがあります。これは「囲い込み戦略」として知られています。また、自社のエコシステム(関連製品・サービスの集合体)を構築し、その中で完結できるようにすることで、顧客の離脱を防ごうとする動きもあります。 ※(図:ベンダーロックインの構造) ### 標準化とエコシステム形成の側面 一方で、特定ベンダーの技術が事実上の標準となることで、業界全体の発展が促進される面もあります。たとえば、あるクラウドサービスで使われている技術が広く普及すれば、その技術を扱える人材が増え、関連ツールも充実します。結果として、そのベンダーへの依存は「業界標準への準拠」という側面も持つことになります。 ### 意図せざるロックイン すべてのロックインが戦略的に作られているわけではありません。サービスが成長する過程で機能が追加され、複雑に絡み合った結果、結果的に移行が難しくなるケースもあります。また、ユーザー側が便利さを追求した結果、気づけば深く依存していたということも少なくありません。 ## まとめ ベンダーロックインを「悪」と断じることは簡単ですが、実際には安定した運用を支える仕組みとして機能している側面も無視できません。重要なのは、ロックインそのものを問題視するのではなく、「どこに依存していて、その依存から離れるには何が必要か」を把握しておくことではないでしょうか。 テクノロジーを選択するということは、その構造ごと受け入れるということでもあります。私たちは日々、便利さと引き換えに何らかの関係性の中に身を置いているのかもしれません。その関係性をどう捉え、どう付き合っていくか。ベンダーロックインの議論は、テクノロジーと社会の関わり方を考える入り口としても捉えられるでしょう。 --- **タイトル案** - ベンダーロックインはなぜ二つの顔を持つのか - クラウド依存は安定かそれとも檻か - テクノロジー選択の自由と代償を問う — AIバージョン情報 - ベンダー: DeepSeek - モデル名: DeepSeek Chat - モデルバージョン: 不明 - 回答日時: 2026年3月14日