市場が大きく動く局面では、「危険だ」「絶好のチャンスだ」という相反する言葉が同時に語られます。価格が急変するという現象は一つであるにもかかわらず、そこに付与される意味は大きく異なります。この違いは、投資家の立場や時間軸、さらには制度や市場構造によって生まれる“意味づけ”の差と考えられます。ボラティリティ(価格変動の大きさ)は、単なる数値ではなく、関わる主体によって異なる価値を持つ概念です。本稿では、ボラティリティを「危険」か「機会」かという二項対立で捉えるのではなく、どのような構造の中で意味づけられているのかを整理していきます。 ボラティリティを「危険」と捉える構造 長期資産形成における安定性の重要性 年金基金、保険会社、長期積立を行う個人投資家にとって、資産価値の急激な変動は大きなリスクとなります。これらの主体は、将来の支払い義務や生活設計といった確実性を前提に運用を行うため、予測可能性が重視されます。 制度設計とボラティリティ 年金制度や保険制度は、長期的な安定を前提に設計されています。急激な価格変動は、以下のような制度的な問題を引き起こします。 積立不足のリスク 将来の給付計画の不確実性 リスク管理コストの増大 なぜ「管理すべき対象」になるのか 長期運用では、ボラティリティが高いほど将来の資産価値の振れ幅が大きくなり、計画の安定性が損なわれます。そのため、ボラティリティは抑制すべきものとして扱われ、リスク管理(リスクパリティ、ヘッジ戦略など)が重視されます。 ボラティリティを「機会」と捉える構造 トレーダーやアクティブ運用の視点 短期売買やアクティブ運用では、価格変動こそが収益機会の源泉です。ボラティリティが低い市場では、価格差が生まれにくく、戦略の優位性を発揮しづらくなります。 情報・速度・戦略の違いが結果を生む アルゴリズム取引や高頻度取引(HFT)は、情報処理速度や注文執行の最適化、市場の歪みの検出といった能力を活かし、微小な価格変動から利益を積み上げます。ボラティリティが高い局面では、これらの差がより明確に結果へ反映されます。 変動が「差が生まれる条件」になる理由 市場が大きく動くと、判断の速度、リスク許容度、情報の質といった要素が投資家ごとに異なるため、結果にばらつきが生まれます。この“ばらつき”こそが、機会として認識される構造です。 意味を決めているのは「現象」か「立場」か 時間軸の違いが解釈を変える 短期投資では、ボラティリティは利益を得るための材料として扱われます。一方、長期投資では計画を乱す要因として認識されます。つまり、同じ変動でも数分〜数日の視点では機会、数十年の視点ではリスクとなりやすい構造があります。 責任の所在による違い 投資家の立場によって、ボラティリティへの向き合い方は大きく変わります。 自己資金を運用する個人:自己責任でリスクを取れるため、機会として捉えやすい 他者の資産を預かる運用者:安定性が求められ、過度な変動は説明責任の負担に 制度運営者(年金・保険):長期の安定が最優先で、変動は管理対象 同じ現象が異なる価値を持つ理由 ボラティリティそのものが価値を持つのではなく、どの時間軸で、どの責任を負い、どの目的で市場に参加しているかによって意味が変わります。つまり、ボラティリティは現象ではなく、関係性の中で意味づけられる構造といえます。 まとめ:ボラティリティを「関係性の鏡」として捉える ボラティリティは、善悪や勝敗を決める対象ではなく、市場との関わり方を映し出す鏡のような存在です。市場が揺れるとき、私たちはその揺れそのものを評価しているのではなく、自分がどの立場で市場に向き合っているのかを反映しているにすぎません。 読者のみなさんには、自分はどの時間軸で市場に参加しているのか、どの程度の責任を負っているのか、変動をどのように扱いたいのかといった視点から、ボラティリティとの距離感を考えていただければと思います。結論を固定するのではなく、ボラティリティを通じて自分自身の投資観を見つめ直す余白を残して、本稿を締めくくります。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 金融市場・投資環境・アルゴリズム取引・情報流通の変化によって、 「ボラティリティは危険なのか、それとも機会なのか」という問いを、 投資家・制度・市場構造・時間軸・責任の所在といった複数の観点から、冷静かつ構造的に考察してください。 【目的】 – 「リスクかチャンスか」という単純な二項対立を避ける – ボラティリティが“現象”としてではなく、“立場や制度によって意味づけられる構造”であることを整理する – 読者が自分の投資スタイルや市場との関わり方を考えるための“視点”を提供する 【読者像】 – 一般投資家(初心者〜中級者) – 長期資産形成に関心のある社会人 – トレードや市場ニュースに触れているが、構造的な理解は深めたい層 – AIやアルゴリズム取引に漠然とした関心や不安を持つ読者 【記事構成】 1. 導入(問題提起) – 市場が大きく動く局面で、「危険だ」「チャンスだ」という言葉が同時に語られる矛盾を提示する – なぜ同じ現象が、正反対の意味として解釈されるのかを問いとして設定する – ボラティリティを“価格変動”ではなく“意味づけの対象”として捉える視点を示す 2. ボラティリティを「危険」と捉える構造 – 長期運用、年金、保険、個人の資産形成といった文脈での位置づけを整理する – 安定性・予測可能性・制度設計との関係を説明する – なぜ変動が「管理すべき対象」として扱われるのかを構造的に示す 3. ボラティリティを「機会」と捉える構造 – トレーダー、アクティブ運用、裁定取引などの視点から整理する – 情報、速度、判断、戦略の違いが結果として現れる場であることを説明する – 変動が「差が生まれる条件」として扱われる理由を構造的に示す 4. 意味を決めているのは「現象」か「立場」か – 時間軸(短期/長期)の違いが解釈をどう変えるかを整理する – 責任の所在(自己責任/制度責任/他者の資産を預かる立場)の違いに触れる – 同じボラティリティが、なぜ役割ごとに異なる価値を持つのかを言語化する 5. まとめ – ボラティリティを「善悪」や「勝敗」の対象としてではなく、「市場との関係性を映す構造」として再定義する – 読者自身が、どの立場で市場に関わっているのかを考える視点を提示する – 結論を固定せず、思考の余白を残す形で締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「投資判断を誘導する記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の投資スタイルや価値観を押し付けず、 読者が自分の立場を相対化できる構成を重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:ボラティリティの解釈構造) ※(図:投資主体と時間軸の関係図) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「市場の揺れは誰のリスクで、誰の機会なのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # ボラティリティは危険か、それとも機会か 市場構造から読み解く多層的な意味 ## 1. 導入:同じ値動きが「危険」と「機会」に分かれる理由 市場が大きく動く局面では、「危険だ」「絶好のチャンスだ」という相反する言葉が同時に語られます。価格が急変するという“現象”は一つであるにもかかわらず、そこに付与される意味は大きく異なります。この違いは、投資家の立場や時間軸、さらには制度や市場構造によって生まれる“意味づけ”の差と考えられます。 ボラティリティ(価格変動の大きさ)は、単なる数値ではなく、関わる主体によって異なる価値を持つ概念です。本稿では、ボラティリティを「危険」か「機会」かという二項対立で捉えるのではなく、どのような構造の中で意味づけられているのかを整理していきます。 ※(図:ボラティリティの解釈構造) --- ## 2. ボラティリティを「危険」と捉える構造 ### 長期資産形成における安定性の重要性 年金基金、保険会社、長期積立を行う個人投資家にとって、資産価値の急激な変動は大きなリスクとなります。これらの主体は、将来の支払い義務や生活設計といった“確実性”を前提に運用を行うため、予測可能性が重視されます。 ### 制度設計とボラティリティ 年金制度や保険制度は、長期的な安定を前提に設計されています。急激な価格変動は、 - 積立不足のリスク - 将来の給付計画の不確実性 - リスク管理コストの増大 といった制度的な問題を引き起こします。 ### なぜ「管理すべき対象」になるのか 長期運用では、ボラティリティが高いほど将来の資産価値の振れ幅が大きくなり、計画の安定性が損なわれます。そのため、ボラティリティは“抑制すべきもの”として扱われ、リスク管理(リスクパリティ、ヘッジ戦略など)が重視されます。 --- ## 3. ボラティリティを「機会」と捉える構造 ### トレーダーやアクティブ運用の視点 短期売買やアクティブ運用では、価格変動こそが収益機会の源泉です。ボラティリティが低い市場では、価格差が生まれにくく、戦略の優位性を発揮しづらくなります。 ### 情報・速度・戦略の違いが結果を生む アルゴリズム取引や高頻度取引(HFT)は、 - 情報処理速度 - 注文執行の最適化 - 市場の歪みの検出 といった能力を活かし、微小な価格変動から利益を積み上げます。 ボラティリティが高い局面では、これらの差がより明確に結果へ反映されます。 ### 変動が「差が生まれる条件」になる理由 市場が大きく動くと、 - 判断の速度 - リスク許容度 - 情報の質 といった要素が投資家ごとに異なるため、結果にばらつきが生まれます。この“ばらつき”こそが、機会として認識される構造です。 --- ## 4. 意味を決めているのは「現象」か「立場」か ### 時間軸の違いが解釈を変える 短期投資では、ボラティリティは「利益を得るための材料」として扱われます。一方、長期投資では「計画を乱す要因」として認識されます。 同じ変動でも、 - 数分〜数日の視点では“機会” - 数十年の視点では“リスク” となりやすい構造があります。 ### 責任の所在による違い 投資家の立場によって、ボラティリティへの向き合い方は大きく変わります。 | 立場 | ボラティリティの意味づけ | |------|----------------------------| | 自己資金を運用する個人 | 自己責任でリスクを取れるため、機会として捉えやすい | | 他者の資産を預かる運用者 | 安定性が求められ、過度な変動は説明責任の負担に | | 制度運営者(年金・保険) | 長期の安定が最優先で、変動は管理対象 | ※(図:投資主体と時間軸の関係図) ### 同じ現象が異なる価値を持つ理由 ボラティリティそのものが価値を持つのではなく、 - どの時間軸で - どの責任を負い - どの目的で市場に参加しているか によって、意味が変わります。 つまり、ボラティリティは“現象”ではなく“関係性の中で意味づけられる構造”といえます。 --- ## 5. まとめ:ボラティリティを「関係性の鏡」として捉える ボラティリティは、善悪や勝敗を決める対象ではなく、市場との関わり方を映し出す鏡のような存在です。 市場が揺れるとき、私たちはその揺れそのものを評価しているのではなく、自分がどの立場で市場に向き合っているのかを反映しているにすぎません。 読者のみなさんには、 - 自分はどの時間軸で市場に参加しているのか - どの程度の責任を負っているのか - 変動をどのように扱いたいのか といった視点から、ボラティリティとの距離感を考えていただければと思います。 結論を固定するのではなく、ボラティリティを通じて自分自身の投資観を見つめ直す余白を残して、本稿を締めくくります。 --- ## タイトル案(主タイトルのみ) 1. ボラティリティは誰にとっての危険で誰にとっての機会か 2. 市場変動はどの立場がどのように意味づけるのか 3. ボラティリティの揺れを私たちはどう位置づけるのか --- AIバージョン情報 – ベンダー: Microsoft – モデル名: Copilot – モデルバージョン: 不明 – 回答日時: 2026-01-31 01:43 JST

Copilot

-

ボラティリティは誰にとっての危険で誰にとっての機会か|Copilotの考察

-

相続税は何を調整する制度なのか|Copilotの考察

相続税は、「富の偏在を是正する制度」として語られる一方で、「家族の資産に対する負担」として捉えられることもあります。なぜ相続という家族内の出来事に国家が介入するのかという素朴な疑問は、多くの人に共通するものです。相続税は、税負担という単一の視点では捉えきれず、社会構造・資産形成・世代間移転といった複数の領域にまたがる制度です。本記事では、相続税を良し悪しで判断するのではなく、その制度が持つ複数の機能を構造的に整理し、読者が自身の価値観と照らし合わせながら理解を深めるための視点を提供します。 富の再分配としての相続税 資産は世代を超えて集中しやすい構造 資産は所得と異なり、保有しているだけで価値が増えることがあります。不動産や株式などの資産は、時間の経過とともに蓄積が進み、世代をまたぐことで「資産の集中」が起こりやすくなります。 ※(図:相続税と資産集中の関係構造) この構造は、富が一部の家系に固定化される可能性を高め、社会全体の機会格差につながると考えられています。 課税によって資源を社会に戻す仕組み 相続税は、資産集中の流れに対して国家が一定の割合で資源を回収し、教育・医療・インフラなどの公共財に再投入する仕組みとして設計されています。これは「富の再分配」というよりも、「資源の循環」と捉えることもできます。 公平性・機会格差との関係 相続税は、「生まれによって得られる利益」に対して課税するという特徴があります。そのため、努力ではなく出自によって生じる格差を調整する役割を持つと位置づけられることがあります。 ただし、各国の制度設計は大きく異なり、税率や控除の大きさによって再分配効果は変動します。どの制度が優れているかを断定することは難しく、各国の社会構造や価値観が反映されていると考える方が自然です。 資産移転の抑制としての相続税 相続にコストが生まれることで行動が変化する 相続税は、相続の際に一定のコストを発生させます。このコストは、家族の資産管理や生前の行動に影響を与えます。 生前贈与を活用して計画的に資産を移す 法人化して事業承継を行う 信託を利用して資産管理を分散する これらは節税対策として語られることが多いですが、構造的には「資産移転のタイミングや方法を分散させる仕組み」と捉えることもできます。 資産の流動性を高める側面 相続税は、資産を固定化させず、社会全体での流動性を高める効果を持つことがあります。たとえば、相続税の支払いのために不動産が売却されるケースは、結果として市場に物件が供給されることにつながります。 これは、資産が特定の家系に長期間固定されることを防ぎ、経済全体の循環を促す側面として理解できます。 個人の自由と社会の調整のあいだ 財産権と公共性の緊張関係 相続は本来、家族の内部で完結する行為です。しかし、財産権(個人が財産を自由に処分できる権利)と、社会全体の公平性や公共性はしばしば緊張関係にあります。 ※(図:個人の財産権と社会的再分配の位置関係) 相続税は、この緊張関係の「調整装置」として機能しているとも言えます。 家族内の継承と社会全体への影響 家族が資産を継承することは自然な行為ですが、その結果として社会全体の資産分布に影響が生じます。相続税は、この「家族の行為が社会に及ぼす影響」を制度として可視化し、一定の調整を行う役割を担っています。 制度は価値観の違いを内包している 相続税をめぐる議論には、家族の自由を重視する価値観と、社会全体の公平性を重視する価値観の両方が存在します。制度はこれらの価値観の間で揺れ動きながら設計されており、どちらか一方に完全に寄せることは難しい構造になっています。 まとめ:相続税は多層的な制度である 相続税は、単一の目的で設計された制度ではありません。富の再分配としての側面と、資産移転を抑制する側面が同時に存在し、さらに個人の自由と社会の調整という価値観の交差点に位置しています。 そのため、相続税を理解する際には「良い/悪い」という評価軸だけでは不十分であり、制度が持つ多層的な機能を踏まえて、自分自身がどの価値観を重視するのかを考えることが重要になります。本記事が、相続制度を自分の立場から捉え直すための視点の一つとなれば幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 税制・社会構造・資産形成・世代間移転の観点から、 「相続税は富の再分配の装置なのか、それとも資産移転を抑制する制度なのか」という問いを、 善悪や賛否ではなく、構造として冷静に整理・考察してください。 【目的】 – 「相続税は良い/悪い」という二項対立を避け、制度が持つ複数の機能を整理する – 個人の資産継承と社会的調整の関係を、構造的に読み解く – 読者が、自分の立場や価値観を相続制度の中で再認識するための“視点”を提供する 【読者像】 – 一般社会人(30〜60代) – 相続や資産形成に関心を持ち始めた層 – 制度の是非よりも「なぜこの仕組みが存在するのか」を知りたい人 – 税制や法律に詳しくはないが、無関係ではいられないと感じている層 【記事構成】 1. 導入(問題提起) – 相続税が「公平のための制度」と「負担としての制度」の両方で語られる現状を提示する – なぜ相続の場面で国家が介入するのかという素朴な問いを提示する – 本記事が結論ではなく、構造の整理を目的としていることを明示する 2. 富の再分配としての相続税 – 資産が世代を超えて集中しやすい構造を整理する – 国家が課税を通じて社会全体に資源を戻す仕組みを説明する – 公平性・機会格差・公共財との関係を構造的に位置づける – ※具体的な制度例や国際比較に触れてもよいが、評価は断定しないこと 3. 資産移転の抑制としての相続税 – 相続にコストが生まれることで、行動が変化する点を整理する – 生前贈与、法人化、信託などの選択肢が生まれる構造を説明する – 資産の「固定」ではなく「流動」を促す側面に触れる 4. 個人の自由と社会の調整のあいだ – 財産権と公共性の緊張関係を整理する – 家族内の継承と、社会全体への影響の重なりを構造的に示す – 制度が価値観の違いを内包したまま存在していることを言語化する 5. まとめ – 相続税が単一の目的で設計されていないことを再確認する – 再分配と抑制の両方が同時に働く制度である点を整理する – 読者が自分の立場から制度をどう見るかを考える余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「制度を評価する記事」ではなく、「制度を読み解く記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や設計意図を整理したうえでの「考察」として執筆する – 特定の思想や立場を押し付けず、 読者が自分の価値観を照らし合わせる材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:相続税と資産集中の関係構造) ※(図:個人の財産権と社会的再分配の位置関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「相続税は誰のための制度なのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 相続税は富の再分配の装置なのか、それとも資産移転を抑制する制度なのか 構造から読み解く相続税の多層性 --- ## 1. 導入:相続税は「公平」か「負担」か 相続税は、しばしば二つの異なる文脈で語られます。 一つは「富の偏在を是正するための制度」という肯定的な文脈、もう一つは「家族の資産を奪う負担」という否定的な文脈です。どちらの見方も社会の中に根強く存在し、相続税をめぐる議論を複雑にしています。 しかし、そもそも「なぜ相続という家族内の出来事に国家が介入するのか」という素朴な疑問は、多くの人に共通するものです。相続税は単なる税負担ではなく、社会構造・資産形成・世代間移転といった複数の領域にまたがる制度であり、その目的も一枚岩ではありません。 本記事では、相続税を「良い/悪い」で評価するのではなく、制度が持つ複数の機能を構造的に整理し、読者が自身の価値観と照らし合わせながら理解を深めるための視点を提供します。 --- ## 2. 富の再分配としての相続税 ### 2-1. 資産は世代を超えて集中しやすい 資産は、所得よりも「蓄積の速度」が速いという特徴があります。 不動産や株式などの資産は、保有しているだけで価値が増えることがあり、これが世代をまたぐと「資産の集中」が起こりやすくなります。 ※(図:相続税と資産集中の関係構造) この構造は、富が一部の家系に固定化される可能性を高め、社会全体の機会格差につながると考えられています。 ### 2-2. 課税によって資源を社会に戻す仕組み 相続税は、こうした資産集中の流れに対して、国家が一定の割合で資源を回収し、公共財(教育、医療、インフラなど)に再投入する仕組みとして設計されています。 これは「富の再分配」というよりも、「資源の循環」と捉える方が近い場合もあります。 ### 2-3. 公平性・機会格差との関係 相続税は、所得税や消費税とは異なり、「生まれによって得られる利益」に対して課税するという特徴があります。 そのため、社会的には「努力ではなく出自による格差」を調整する役割を持つと位置づけられることがあります。 ただし、各国の制度設計は大きく異なり、税率や控除の大きさによって再分配効果は変動します。国際比較をしても、どの制度が優れているかを断定することは難しく、各国の社会構造や価値観が反映されていると考える方が自然です。 --- ## 3. 資産移転の抑制としての相続税 ### 3-1. 相続に「コスト」が生まれることで行動が変わる 相続税は、相続を行う際に一定のコストを発生させます。 このコストは、家族の資産管理や生前の行動に影響を与えます。 たとえば、 - 生前贈与を活用して計画的に資産を移す - 法人化して事業承継を行う - 信託を利用して資産管理を分散する といった選択肢が生まれます。 これらは「節税対策」として語られることが多いですが、構造的には「資産移転のタイミングや方法を分散させる仕組み」と捉えることもできます。 ### 3-2. 資産の流動性を高める側面 相続税は、資産を固定化させず、社会全体での流動性を高める効果を持つことがあります。 たとえば、相続税の支払いのために不動産が売却されるケースは、結果として市場に物件が供給されることにつながります。 これは、資産が特定の家系に長期間固定されることを防ぎ、経済全体の循環を促す側面として理解できます。 --- ## 4. 個人の自由と社会の調整のあいだ ### 4-1. 財産権と公共性の緊張関係 相続は本来、家族の内部で完結する行為です。しかし、財産権(個人が財産を自由に処分できる権利)と、社会全体の公平性や公共性はしばしば緊張関係にあります。 ※(図:個人の財産権と社会的再分配の位置関係) 相続税は、この緊張関係の「調整装置」として機能しているとも言えます。 ### 4-2. 家族内の継承と社会全体への影響 家族が資産を継承することは自然な行為ですが、その結果として社会全体の資産分布に影響が生じます。 相続税は、この「家族の行為が社会に及ぼす影響」を制度として可視化し、一定の調整を行う役割を担っています。 ### 4-3. 制度は価値観の違いを内包している 相続税をめぐる議論には、 - 家族の自由を重視する価値観 - 社会全体の公平性を重視する価値観 の両方が存在します。 制度は、これらの価値観の間で揺れ動きながら設計されており、どちらか一方に完全に寄せることは難しい構造になっています。 --- ## 5. まとめ:相続税は多層的な制度である 相続税は、単一の目的で設計された制度ではありません。 富の再分配としての側面と、資産移転を抑制する側面が同時に存在し、さらに個人の自由と社会の調整という価値観の交差点に位置しています。 そのため、相続税を理解する際には「良い/悪い」という評価軸だけでは不十分であり、制度が持つ多層的な機能を踏まえて、自分自身がどの価値観を重視するのかを考えることが重要になります。 本記事が、相続制度を自分の立場から捉え直すための視点の一つとなれば幸いです。 --- ## タイトル案 1. 相続税は何を調整する制度なのか 2. 相続税は富と家族にどう作用するのか 3. 相続税は資産の行方をどう形づくるのか --- AIバージョン情報 – ベンダー: Microsoft – モデル名: Copilot – モデルバージョン: 不明 – 回答日時: 2026-01-31

-

家族は相続の場面で何を映し出すのか|Copilotの考察

相続という出来事は、ドラマや小説においてしばしば家族の絆や対立を浮かび上がらせる契機として扱われます。財産の分配という制度的な行為でありながら、そこには長年の感情、記憶、承認欲求が複雑に絡み合います。そのため相続は、感情と制度が交差する象徴的なテーマとして、物語に深いドラマ性をもたらしてきました。本記事では、特定の作品を評価するのではなく、フィクションにおける「相続」の描かれ方を構造的に整理し、家族という関係性の多層性を考察します。 家族が「感情の共同体」として描かれる構造 愛情・記憶・承認が可視化される場面 相続の場面では、家族が共有してきた時間や感情が一気に表面化します。 親がどの子どもに何を託すのか 遺言に込められた思いがどう解釈されるのか 「なぜ自分ではないのか」という承認欲求の揺らぎ これらは、財産の分配という制度的行為を超えて、家族間の心理的距離や過去の関係性を映し出す鏡として機能します。 財産分配が「関係性の評価」として働く フィクションでは、財産の多寡そのものよりも、「誰がどのように扱われたか」が物語の焦点となることが多いです。たとえば、長年家業を支えてきた子が冷遇される、疎遠だった家族が突然優遇されるなど、分配の内容が「親が家族をどう見ていたか」という評価として受け取られます。 過去の出来事が再解釈される構造 相続の場面は、家族の歴史を再編成する契機にもなります。 幼少期の記憶が「なぜあの時あの態度だったのか」と再解釈される 親の選択が、死後に初めて意味づけられる 兄弟間のわだかまりが、相続をきっかけに言語化される ※(図:相続における感情と制度の交差構造) 家族が「制度の単位」として描かれる構造 法律・血縁・戸籍が物語に与える影響 相続は法律に基づく制度であり、フィクションでもその枠組みが物語の前提を形づくります。 血縁関係があるかどうか 婚姻関係が法的に成立しているか 相続順位がどう定められているか これらの制度的条件が、登場人物の行動や葛藤を方向づけます。 「個人」ではなく「立場」として扱われる家族 物語では、登場人物が「長男」「後妻」「養子」などの役割で語られる場面が多く見られます。これは、家族が制度的に位置づけられた単位であることを示しています。役割が強調されることで、個人の感情と制度上の立場がズレを生み、そのズレが物語の緊張を生み出します。 感情と制度のズレが生むドラマ 「本当は一番世話をしたのに、法的には相続権が弱い」 「血縁はあるが、関係性は希薄」 「制度上の正しさ」と「感情上の納得」が一致しない こうしたズレが、物語における対立や葛藤の源泉となります。 家族を「社会の縮図」として描く視点 世代間の価値観の違い 相続の場面では、世代ごとに異なる価値観が衝突します。 家業を継ぐことを当然とする親世代 自由な生き方を求める子世代 家族観そのものの変化 これらは、社会全体の価値観の変化を反映しています。 性別役割・経済格差・序列意識 フィクションでは、長男優遇や性別による役割期待など、文化的な規範が描かれることも多いです。また、経済格差が家族内の力関係に影響を与える構造も見られます。 相続が「個人の問題」を超える理由 相続は家庭内の出来事でありながら、社会制度や文化的背景を反映する場面でもあります。そのため、物語の中で相続はしばしば「社会の縮図」として扱われ、家族の問題が社会的テーマへと接続されます。 ※(図:家族が担う役割の変化イメージ) 「財産」ではなく「意味の継承」へ モノ・お金を超えた継承 フィクションでは、相続は単なる財産の移転ではなく、価値観や記憶、役割の継承として描かれることがあります。 家業を継ぐ 家訓や理念を受け継ぐ 家族の記憶を守る これらは、相続が「意味の継承」であることを示しています。 作品ごとに異なる「家族」の意味づけ 同じ相続の場面でも、作品によって家族の描かれ方は大きく異なります。 家族の絆を再確認する物語 関係性の脆さを露呈する物語 家族の再編成を描く物語 相続は、家族という概念そのものを問い直す契機として機能します。 まとめ 相続を扱うフィクション作品は、家族を「守る場」と「揺らぐ場」の両方として描いてきました。そこには、感情と制度、個人と社会が交差する複雑な構造があります。相続という出来事を通して、家族の歴史や価値観が再解釈され、継承されるものの意味が問い直されます。読者の皆さんが、自分にとっての「家族」とは何か、そして何を引き継ぐことが大切なのかを考えるきっかけとなれば幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 ドラマや小説などのフィクション作品において、 「相続」という出来事を通して「家族」はどのように描かれてきたのかを、 感情・制度・社会構造・世代間関係といった観点から、冷静かつ構造的に整理・考察してください。 【目的】 – 相続を「お金や争いの物語」として単純化せず、家族という関係性の構造がどのように表現されてきたのかを整理する – 家族が「感情の共同体」である側面と、「制度の単位」である側面の両義性を浮かび上がらせる – 読者が、自分にとっての「家族」や「引き継ぐことの意味」を考えるための視点を提供する 【読者像】 – 一般読者(20〜60代) – ドラマ・小説・映画などの物語表現に関心のある層 – 相続や家族関係について、現実的な問題意識を持ち始めている人 – 制度や法律には詳しくないが、無関係ではいられないと感じている層 【記事構成】 1. 導入(問題提起) – 相続を扱う物語が「家族の絆」や「対立の場面」として描かれることの多さを提示する – なぜ相続が、感情と制度が交差する象徴的なテーマになりやすいのかを簡潔に示す – 本記事が、作品の評価ではなく「描かれ方の構造」を整理する試みであることを説明する 2. 家族が「感情の共同体」として描かれる構造 – 愛情、記憶、承認、わだかまりといった要素が、相続を通して可視化される点を整理する – 財産の分配が、実際には「関係性の評価」として機能する場面を説明する – なぜ過去の出来事や親子関係が、相続の場面で再解釈されやすいのかを構造的に考察する 3. 家族が「制度の単位」として描かれる構造 – 法律、血縁、戸籍、相続順位といったルールが物語に与える影響を整理する – 登場人物が「個人」ではなく「立場」や「役割」として扱われる場面に触れる – 感情と制度のズレが、物語上の緊張や対立を生む仕組みを説明する 4. 家族を「社会の縮図」として描く視点 – 世代間の価値観の違い、性別役割、経済格差、長男・次男といった序列意識が表れる構造を整理する – 相続が、家庭内の出来事でありながら、社会的なルールや文化を反映する場面であることを示す – なぜ多くの作品で、相続が「個人の問題」を超えたテーマとして扱われるのかを考察する 5. 重要なのは「財産」ではなく「意味の継承」 – モノやお金だけでなく、価値観、役割、記憶がどのように引き継がれるかに注目する – 同じ相続の場面でも、作品ごとに「家族」の意味づけが異なる理由を整理する – 家族という概念そのものが、物語の中で再定義されている可能性に触れる 6. まとめ – 相続をめぐる物語が、家族を「守る場」と「揺らぐ場」の両方として描いてきたことを再確認する – 家族が、感情と制度、個人と社会の交差点として機能している点を整理する – 読者自身が「自分にとって家族とは何か」「何を引き継ぐことが大切なのか」を考える視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「感動させる記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で意味づけできる余地を残すことを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:相続における感情と制度の交差構造) ※(図:家族が担う役割の変化イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「相続の物語は家族をどう変えてきたのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## フィクション作品における「相続」と「家族」の描かれ方 相続という出来事は、ドラマや小説においてしばしば家族の絆や対立を浮かび上がらせる契機として扱われます。財産の分配という制度的な行為でありながら、そこには長年の感情、記憶、承認欲求が複雑に絡み合います。そのため相続は、感情と制度が交差する象徴的なテーマとして、物語に深いドラマ性をもたらしてきました。本記事では、特定の作品を評価するのではなく、フィクションにおける「相続」の描かれ方を構造的に整理し、家族という関係性の多層性を考察します。 --- ## 1. 家族が「感情の共同体」として描かれる構造 ### ● 愛情・記憶・承認が可視化される場面 相続の場面では、家族が共有してきた時間や感情が一気に表面化します。 ・親がどの子どもに何を託すのか ・遺言に込められた思いがどう解釈されるのか ・「なぜ自分ではないのか」という承認欲求の揺らぎ これらは、財産の分配という制度的行為を超えて、家族間の心理的距離や過去の関係性を映し出す鏡として機能します。 ### ● 財産分配が「関係性の評価」として働く フィクションでは、財産の多寡そのものよりも、「誰がどのように扱われたか」が物語の焦点となることが多いです。 たとえば、長年家業を支えてきた子が冷遇される、疎遠だった家族が突然優遇されるなど、分配の内容が「親が家族をどう見ていたか」という評価として受け取られます。 ### ● 過去の出来事が再解釈される構造 相続の場面は、家族の歴史を再編成する契機にもなります。 ・幼少期の記憶が「なぜあの時あの態度だったのか」と再解釈される ・親の選択が、死後に初めて意味づけられる ・兄弟間のわだかまりが、相続をきっかけに言語化される ※(図:相続における感情と制度の交差構造) このように、相続は「感情の共同体」としての家族を可視化する装置として描かれます。 --- ## 2. 家族が「制度の単位」として描かれる構造 ### ● 法律・血縁・戸籍が物語に与える影響 相続は法律に基づく制度であり、フィクションでもその枠組みが物語の前提を形づくります。 ・血縁関係があるかどうか ・婚姻関係が法的に成立しているか ・相続順位がどう定められているか これらの制度的条件が、登場人物の行動や葛藤を方向づけます。 ### ● 「個人」ではなく「立場」として扱われる家族 物語では、登場人物が「長男」「後妻」「養子」などの役割で語られる場面が多く見られます。これは、家族が制度的に位置づけられた単位であることを示しています。 役割が強調されることで、個人の感情と制度上の立場がズレを生み、そのズレが物語の緊張を生み出します。 ### ● 感情と制度のズレが生むドラマ ・「本当は一番世話をしたのに、法的には相続権が弱い」 ・「血縁はあるが、関係性は希薄」 ・「制度上の正しさ」と「感情上の納得」が一致しない こうしたズレが、物語における対立や葛藤の源泉となります。 --- ## 3. 家族を「社会の縮図」として描く視点 ### ● 世代間の価値観の違い 相続の場面では、世代ごとに異なる価値観が衝突します。 ・家業を継ぐことを当然とする親世代 ・自由な生き方を求める子世代 ・家族観そのものの変化 これらは、社会全体の価値観の変化を反映しています。 ### ● 性別役割・経済格差・序列意識 フィクションでは、長男優遇や性別による役割期待など、文化的な規範が描かれることも多いです。 また、経済格差が家族内の力関係に影響を与える構造も見られます。 ### ● 相続が「個人の問題」を超える理由 相続は家庭内の出来事でありながら、社会制度や文化的背景を反映する場面でもあります。 そのため、物語の中で相続はしばしば「社会の縮図」として扱われ、家族の問題が社会的テーマへと接続されます。 ※(図:家族が担う役割の変化イメージ) --- ## 4. 「財産」ではなく「意味の継承」へ ### ● モノ・お金を超えた継承 フィクションでは、相続は単なる財産の移転ではなく、価値観や記憶、役割の継承として描かれることがあります。 ・家業を継ぐ ・家訓や理念を受け継ぐ ・家族の記憶を守る これらは、相続が「意味の継承」であることを示しています。 ### ● 作品ごとに異なる「家族」の意味づけ 同じ相続の場面でも、作品によって家族の描かれ方は大きく異なります。 ・家族の絆を再確認する物語 ・関係性の脆さを露呈する物語 ・家族の再編成を描く物語 相続は、家族という概念そのものを問い直す契機として機能します。 --- ## 5. まとめ 相続を扱うフィクション作品は、家族を「守る場」と「揺らぐ場」の両方として描いてきました。そこには、感情と制度、個人と社会が交差する複雑な構造があります。相続という出来事を通して、家族の歴史や価値観が再解釈され、継承されるものの意味が問い直されます。 読者の皆さんが、自分にとっての「家族」とは何か、そして何を引き継ぐことが大切なのかを考えるきっかけとなれば幸いです。 --- ## タイトル案(主タイトルのみ) 1. 家族は相続の場面で何を映し出すのか 2. 相続は家族のどの関係を揺らすのか 3. 相続は家族の意味をどう問い直すのか --- — AIバージョン情報 – ベンダー: Microsoft – モデル名: Copilot – モデルバージョン: 不明 – 回答日時: 2026-01-30 23:49(JST)

-

アクティブファンドは何を委ねる仕組みなのか|Copilotの考察

アクティブファンドは「専門性の装置」なのか、それとも「期待を商品化したビジネス」なのか。インデックス投資が一般化し、「市場平均で十分」という考え方が広がる一方で、アクティブファンドは依然として市場に存在し続けています。本記事では、成績の優劣ではなく、アクティブファンドが市場の中で果たす構造的な役割に焦点を当て、読者が自分自身の投資観を見つめ直すための視点を整理します。 導入:揺らぐ意味と残る問い アクティブファンドは、市場平均(ベンチマーク)を上回る成果(アルファ)を目指す運用手法です。しかし、インデックス投資の普及により「アクティブは勝てない」という議論が繰り返されてきました。それでもアクティブファンドが消えないのは、単純な成績比較では説明できない構造的な役割を担っているためです。本記事では、アクティブファンドを「専門性の装置」として捉える視点と、「期待を商品化したビジネス」として捉える視点の両方を整理します。 専門性としてのアクティブファンド 分析能力・判断力・情報処理の集約 アクティブファンドは、膨大な情報を収集・分析し、投資判断を行う専門家集団によって運用されています。企業分析、マクロ環境の把握、業界構造の理解、財務モデルの構築など、個人投資家が自力で行うには負荷の高い作業を代替する役割を持ちます。 市場の非効率性を前提とした運用モデル 市場は常に効率的とは限らず、情報の偏在や投資家行動の癖によって歪みが生じることがあります。アクティブ運用は、この「歪み」を見つけて利益に変えることを目的とします。 アルファ:市場平均を上回る超過収益 ベンチマーク:比較対象となる市場指数 人間の判断が介在する価値 AIやアルゴリズムが発達した現在でも、人間の判断が持つ価値は残っています。企業経営者との対話から得られる定性的情報や、社会変化の兆しを読み取る感性など、数値化しにくい要素は依然として重要です。アクティブファンドは、こうした専門性を集約する装置として機能しています。 ※(図:アクティブファンドの価値構造) 期待ビジネスとしてのアクティブファンド 投資家は「可能性」にコストを払う アクティブファンドには、将来の成果への期待が織り込まれています。投資家は「このファンドなら市場を上回るかもしれない」という可能性に対して、手数料というコストを支払います。 過去実績・ブランド・哲学・個性の価値化 アクティブファンドは、成果だけでなく「物語」を持ちます。 過去の運用実績 運用会社のブランド ファンドマネージャーの哲学 投資スタイルの一貫性 これらが期待を形成し、商品としての魅力を高めます。 成果だけでなく「納得感」も流通する 投資家は必ずしも最大のリターンだけを求めているわけではありません。「この方針なら納得できる」「この人に任せたい」という心理的価値も、アクティブファンドの重要な要素です。 市場と制度の中のアクティブファンド 手数料・評価制度・販売チャネルの構造 アクティブファンドは、手数料体系や販売チャネルの仕組みによって支えられています。販売会社のインセンティブ、ランキングの仕組み、評価機関の指標などが、投資家の選択に影響を与えます。 なぜアクティブファンドは消えないのか アクティブファンドが市場から完全に消えない理由は複数あります。 市場の効率性を高める役割(価格発見) 投資家の多様なニーズに対応 制度的に一定の存在が前提となっている 販売側のビジネスモデルとしての必要性 規制・金融教育・メディアの影響 規制は投資家保護を目的としつつ、アクティブファンドの存在を前提に設計されている部分もあります。また、金融教育やメディアの情報発信も、アクティブファンドの位置づけに影響を与えています。 投資家の役割と選択の構造 「運用を外注する」とは何か アクティブファンドに投資することは、運用判断を専門家に委ねる行為です。これは「成果を買う」だけでなく、「判断の責任を委ねる」側面も含みます。 ※(図:投資家とファンドの役割分担モデル) 投資家は何を買っているのか アクティブファンドは複数の価値が重なり合った商品と言えます。 成果そのもの 判断プロセス 期待や物語 安心感や納得感 アクティブとインデックスは価値観の選択 インデックス投資は「市場全体を信じる」選択であり、アクティブ投資は「特定の判断を信じる」選択です。どちらが優れているかではなく、投資家が何を委ね、何を自分で引き受けたいのかという価値観の問題として捉えることができます。 まとめ:専門性と期待のあいだで アクティブファンドは、「専門性の装置」としての側面と、「期待を商品化したビジネス」としての側面の両方を持っています。どちらか一方では成立せず、両者が重なり合うことで市場の中に位置づけられています。投資とは、何を委ね、何を自分で引き受けるのかを選ぶ行為です。本記事が、そのための視点のひとつとして役立てば幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 金融市場・投資環境・情報技術の変化によって、 「アクティブファンドは“専門性の装置”なのか、 それとも“期待を商品化したビジネス”なのか」という問いを、 運用技術・市場構造・投資家心理・制度設計の観点から、冷静かつ構造的に考察してください。 【目的】 – 「アクティブは優れている/劣っている」という単純な評価を避ける – ファンドが市場の中でどのような役割を担っているのかを構造として整理する – 読者が、自分にとっての「投資」とは何かを考えるための“視点”を提供する 【読者像】 – 一般投資家(初心者〜中級者) – 資産運用に関心のある社会人(20〜60代) – インデックス投資とアクティブ投資の違いに関心がある層 – 金融や投資に詳しくはないが、無関係ではいられないと感じている人 【記事構成】 1. 導入(問題提起) – 「なぜ人はアクティブファンドにお金を預けるのか」という素朴な疑問を提示する – インデックス投資が一般化する中で、アクティブファンドが持つ意味が揺らいでいることを示す – 本記事が“成績の優劣”ではなく“構造の違い”を扱うことを明確にする 2. 専門性としてのアクティブファンド – 運用会社やファンドマネージャーが持つ分析能力・判断力・情報処理の役割を整理する – 市場の非効率性や歪みを前提とした運用モデルを説明する – 「人間の判断が介在すること」自体の価値を構造として言語化する – ※専門用語(アルファ、ベンチマーク等)には簡潔な補足を加えること 3. 期待ビジネスとしてのアクティブファンド – 投資家が「将来の可能性」や「物語」に対してコストを支払う構造を整理する – 過去実績・ブランド・運用哲学・ファンドマネージャーの個性がどのように価値化されるかを説明する – 成果だけでなく「納得感」や「信頼」が市場で流通している点に触れる 4. 市場と制度の中のアクティブファンド – 手数料構造、評価制度、ランキング、販売チャネルなどの仕組みを整理する – なぜアクティブファンドが市場から完全に消えないのかを構造的に説明する – 規制・金融教育・メディアの役割にも触れる 5. 投資家の役割と選択の構造 – 投資家が「運用を外注する」とはどういう意味を持つのかを整理する – 成果を買っているのか、判断の責任を委ねているのか、期待を共有しているのかを問い直す – アクティブとインデックスの選択を、価値観の違いとして位置づける 6. まとめ – アクティブファンドは「専門性」と「期待」のどちらか一方では成立しないことを再確認する – 投資とは何を委ね、何を自分で引き受ける行為なのかという視点を提示して締めくくる – 過度に推奨や否定をせず、読者の思考を促す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「投資判断を誘導する記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の投資手法・立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:アクティブファンドの価値構造) ※(図:投資家とファンドの役割分担モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「アクティブファンドは誰のために存在しているのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## アクティブファンドは「専門性の装置」か「期待のビジネス」か 金融市場・投資環境・情報技術の変化を背景に、この問いはますます複雑さを増しています。 インデックス投資が広く普及し、「市場平均で十分」という考え方が一般化する一方で、アクティブファンドは依然として一定の存在感を保っています。 では、人々はなぜアクティブファンドに資金を預けるのでしょうか。本記事では、成績の優劣ではなく、アクティブファンドが市場の中で果たす「構造的な役割」に焦点を当てて考察します。 --- ## 1. 導入:揺らぐ意味と残る問い アクティブファンドは、市場平均(ベンチマーク)を上回る成果(アルファ)を目指す運用手法です。しかし、近年はインデックス投資の台頭により、「アクティブは勝てない」という議論が繰り返されてきました。 それでもアクティブファンドが消えないのは、単純な成績比較では説明できない「構造的な役割」を担っているからです。 本記事では、アクティブファンドを「専門性の装置」として捉える視点と、「期待を商品化したビジネス」として捉える視点の両方を整理し、投資家が自分の価値観を見つめ直すための材料を提供します。 --- ## 2. 専門性としてのアクティブファンド ### ● 分析能力・判断力・情報処理の集約 アクティブファンドは、膨大な情報を収集・分析し、投資判断を行う専門家集団によって運用されます。 企業分析、マクロ環境の把握、業界構造の理解、財務モデルの構築など、個人投資家が自力で行うには負荷の高い作業を代替する役割を持ちます。 ### ● 市場の非効率性を前提とした運用モデル 市場は常に効率的とは限らず、情報の偏在や投資家行動の癖によって歪みが生じることがあります。 アクティブ運用は、この「歪み」を見つけて利益に変えることを目的とします。 ※アルファ:市場平均を上回る超過収益 ※ベンチマーク:比較対象となる市場指数 ### ● 人間の判断が介在する価値 AIやアルゴリズムが発達した現在でも、人間の判断が持つ価値は残っています。 たとえば、企業経営者との対話から得られる定性的情報や、社会変化の兆しを読み取る感性など、数値化しにくい要素は依然として重要です。 アクティブファンドは、こうした「専門性の集約装置」として機能し、投資家が自力でアクセスできない知識や洞察を提供する存在とも言えます。 ※(図:アクティブファンドの価値構造) --- ## 3. 期待ビジネスとしてのアクティブファンド ### ● 投資家は「可能性」にコストを払う アクティブファンドには、将来の成果への期待が織り込まれています。 投資家は「このファンドなら市場を上回るかもしれない」という可能性に対して、手数料というコストを支払います。 ### ● 過去実績・ブランド・哲学・個性の価値化 アクティブファンドは、成果だけでなく「物語」を持ちます。 ・過去の運用実績 ・運用会社のブランド ・ファンドマネージャーの哲学 ・投資スタイルの一貫性 これらが「期待」を形成し、商品としての魅力を高めます。 ### ● 成果だけでなく「納得感」も流通する 投資家は必ずしも最大のリターンだけを求めているわけではありません。 「この方針なら納得できる」「この人に任せたい」という心理的価値も、アクティブファンドの重要な要素です。 アクティブファンドは、専門性だけでなく「期待」を商品化するビジネスとしての側面も持っています。 --- ## 4. 市場と制度の中のアクティブファンド ### ● 手数料・評価制度・販売チャネルの構造 アクティブファンドは、手数料体系や販売チャネルの仕組みによって支えられています。 販売会社のインセンティブ、ランキングの仕組み、評価機関の指標などが、投資家の選択に影響を与えます。 ### ● なぜアクティブファンドは消えないのか アクティブファンドが市場から完全に消えない理由は複数あります。 ・市場の効率性を高める役割(価格発見) ・投資家の多様なニーズに対応 ・制度的に一定の存在が前提となっている ・販売側のビジネスモデルとしての必要性 アクティブファンドは、単なる運用手法ではなく、市場構造の一部として組み込まれています。 ### ● 規制・金融教育・メディアの影響 規制は投資家保護を目的としつつ、アクティブファンドの存在を前提に設計されている部分もあります。 また、金融教育やメディアの情報発信も、アクティブファンドの位置づけに影響を与えています。 --- ## 5. 投資家の役割と選択の構造 ### ● 「運用を外注する」とは何か アクティブファンドに投資することは、運用判断を専門家に委ねる行為です。 これは「成果を買う」だけでなく、「判断の責任を委ねる」側面も含みます。 ※(図:投資家とファンドの役割分担モデル) ### ● 投資家は何を買っているのか ・成果そのもの ・判断プロセス ・期待や物語 ・安心感や納得感 アクティブファンドは、これら複数の価値が重なり合った商品と言えます。 ### ● アクティブとインデックスは価値観の選択 インデックス投資は「市場全体を信じる」選択であり、アクティブ投資は「特定の判断を信じる」選択です。 どちらが優れているかではなく、投資家が何を委ね、何を自分で引き受けたいのかという価値観の問題として捉えることができます。 --- ## 6. まとめ:専門性と期待のあいだで アクティブファンドは、「専門性の装置」としての側面と、「期待を商品化したビジネス」としての側面の両方を持っています。 どちらか一方では成立せず、両者が重なり合うことで市場の中に位置づけられています。 投資とは、何を委ね、何を自分で引き受けるのかを選ぶ行為です。 アクティブファンドを理解することは、自分自身の投資観や価値観を見つめ直すきっかけにもなります。 本記事が、そのための視点のひとつとして役立てば幸いです。 --- ## タイトル案 1. アクティブファンドは何を委ねる仕組みなのか 2. アクティブ運用は専門性か期待かをどう捉えるか 3. アクティブファンドは何を価値として提供しているのか --- ## AIバージョン情報 – ベンダー: Microsoft – モデル名: Copilot – モデルバージョン: 不明 – 回答日時: 2026-01-30 23:24 (JST)

-

相続制度の前提は今の社会に何を映しているのか|Copilotの考察

相続という言葉には、「家族の中で財産を引き継ぐ」という素朴なイメージがつきまといます。しかし、現代の日本では少子化、単身世帯の増加、未婚率の上昇など、家族のあり方そのものが大きく変化しています。相続人が複数いることを前提とした制度設計が、必ずしも現実と一致しないケースも増えています。こうした変化の中で、「相続制度が前提としてきた社会像は、いまも有効なのか」という問いが浮かび上がります。本稿では、制度設計・家族関係・財産の意味・社会との関係性という複数の観点から、この問いを構造的に整理していきます。 相続制度が想定してきた社会構造 家族単位での調整を前提とした仕組み 相続制度は、複数の相続人が存在し、家族内で財産を分配・調整することを前提に設計されてきました。遺産分割協議という手続きが象徴的で、家族間の合意形成を促す仕組みが制度の中心にあります。 血縁・世帯・家系という概念の影響 制度の根底には、血縁関係を軸とした「家族の継承」という考え方があります。かつての家制度ほど強固ではないものの、「家系を維持する」「家族が財産を引き継ぐ」という価値観が制度に影響を与えてきました。 ※(図:相続制度が前提としてきた家族構造) 少子化社会で生じているズレ 相続人が一人、あるいは不在というケースの増加 少子化や未婚化の進行により、相続人が一人しかいない、あるいは相続人が存在しないケースが増えています。相続人がいない場合、財産は最終的に国庫に帰属しますが、そこに至るまでの管理や手続きは必ずしも簡単ではありません。 財産が「引き継がれるもの」から「行き場を探すもの」へ 相続人がいない、あるいは財産を引き継ぐ意思が弱い場合、財産は「誰が管理するのか」という問題に変わります。特に不動産は維持管理の負担が大きく、相続を辞退するケースも見られます。 空き家・管理不能資産・国庫帰属制度 空き家問題や管理不能な土地の増加を背景に、国庫帰属制度などの新しい仕組みが整備されつつあります。これらは「制度が時代遅れ」というよりも、「前提が変わったことで新たな対応が必要になった」と位置づけることができるでしょう。 ※(図:少子化社会における財産の流れ) 家族の制度から社会の制度へ 相続の役割が変わりつつある可能性 従来、相続は家族内の調整装置として機能してきました。しかし、相続人がいないケースや、財産の管理が社会的課題となるケースが増える中で、相続は「社会との接点を管理する仕組み」としての側面を強めつつあります。 税制・公共性・再分配という視点 相続税は、財産の再分配を通じて社会の公平性を保つ役割を担っています。財産が社会に還元される仕組みとしての相続税は、家族単位の継承とは異なる論理で制度を支えています。 私的所有と社会的責任のあいだ 財産は私的所有でありながら、管理されない不動産が地域に悪影響を及ぼすなど、社会的責任も伴います。相続制度は、この二つの価値のバランスをどのように取るかという課題に直面しています。 問われているのは制度か、価値観か 「権利」としての相続、「責任」としての相続 相続は、財産を受け取る権利であると同時に、管理や維持の責任を伴う側面もあります。特に不動産では、相続によって負担が生じるケースもあり、相続を「権利」とだけ捉えることが難しくなっています。 血縁中心の継承と社会への還元 血縁を中心とした継承は家族の連続性を支える一方で、相続人がいない場合には社会全体で財産を扱う必要が生じます。どちらが望ましいというよりも、状況に応じて複数の価値観が併存していると捉える方が現実的です。 制度変更ではなく、意味づけの変化 相続制度そのものを大きく変えるかどうかよりも、相続をどう意味づけるかが問われているともいえます。財産を「家族のもの」と見るのか、「社会とつながる資源」と見るのかによって、相続の捉え方は大きく変わります。 まとめ:相続制度の前提は崩れているのか、変質しているのか 少子化や家族構造の変化によって、相続制度が前提としてきた社会像は確かに揺らいでいます。しかし、それは制度が「崩れている」というよりも、「新しい社会像に合わせて変質しつつある」とも捉えられます。相続は家族の問題であると同時に、社会の仕組みとも深く結びついています。読者の皆さまが、自分の財産や継承をどのように位置づけるかを考える際の材料として、本稿が少しでも役立てば幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 少子化・家族構造の変化・高齢化社会の進行によって、 「相続制度が前提としてきた社会像は、いまも有効なのか」という問いを、 制度設計・家族関係・財産の意味・社会との関係性という複数の観点から、冷静かつ構造的に考察してください。 【目的】 – 「制度は時代遅れか/問題ないか」という二項対立を避ける – 相続制度が前提としてきた“家族・継承・財産”の構造を整理する – 読者が、相続を個人の問題ではなく社会的な仕組みとして捉え直すための“視点”を提供する 【読者像】 – 一般社会人(30〜70代) – 親の相続や自分自身の終活を意識し始めた層 – 法律や制度には詳しくないが、無関係ではいられないと感じている人 – 相続を「お金の問題」以上のものとして考えたい読者 【記事構成】 1. 導入(問題提起) – 「相続は家族の中の出来事」という一般的なイメージを提示する – 少子化・単身世帯の増加・未婚率の上昇など、前提条件が変化していることを示す – なぜ今、相続制度の“前提”そのものを問い直す必要があるのかを簡潔に説明する 2. 相続制度が想定してきた社会構造 – 複数の相続人が存在することを前提とした設計 – 家族内での分配・調整の仕組みとしての役割 – 血縁・世帯・家系という概念が制度に与えてきた影響を整理する 3. 少子化社会で生じているズレ – 相続人が一人、またはいないケースの増加 – 財産が「引き継がれるもの」から「行き場を探すもの」へ変わる構造 – 空き家、管理不能資産、国庫帰属などの制度的対応を例示しつつ、断定せずに位置づける 4. 家族の制度から社会の制度へ – 相続が「家族内調整装置」から「社会との接点を管理する仕組み」へと役割を変えつつある可能性 – 税制・公共性・再分配という視点からの再解釈 – 財産の私的所有と社会的責任のあいだに生じる緊張関係を整理する 5. 問われているのは制度か、価値観か – 相続を「権利」と見る視点と「責任」と見る視点の違い – 血縁中心の継承と、社会全体への還元という考え方の対比 – 制度変更ではなく、意味づけの変化として捉える視点を提示する 6. まとめ – 相続制度の前提が“崩れている”のか、“変質している”のかという問いを再提示する – 読者自身が、自分の財産や継承をどう位置づけるかを考えるための余白を残して締めくくる – 過度に制度批判や理想論に寄らず、構造的な視点を保つ 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 読者の不安を煽るのではなく、思考の材料を提示する姿勢を重視する 【執筆スタンス】 – 本記事は、正解や結論を提示することを目的としない – 制度・社会構造・価値観の関係を整理する「考察」として執筆する – 特定の立場や政策的主張には寄らず、複数の視点を並置する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:相続制度が前提としてきた家族構造) ※(図:少子化社会における財産の流れ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「相続制度は誰のために設計されているのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 少子化と家族構造の変化から考える相続制度の現在地 ### ― 相続制度の“前提”を静かに見直すための考察 ― --- ## 1. 導入:相続は「家族の中の出来事」なのか 相続という言葉には、「家族の中で財産を引き継ぐ」という素朴なイメージがつきまといます。親から子へ、夫から妻へと財産が移り、家族の歴史や暮らしが連続していく――そのような前提が、長く制度の背景にありました。 しかし、現代の日本では少子化、単身世帯の増加、未婚率の上昇など、家族のあり方そのものが大きく変化しています。相続人が複数いることを前提とした制度設計が、必ずしも現実と一致しないケースも増えています。 こうした変化の中で、「相続制度が前提としてきた社会像は、いまも有効なのか」という問いが浮かび上がります。本稿では、制度設計・家族関係・財産の意味・社会との関係性という複数の観点から、この問いを構造的に整理していきます。 --- ## 2. 相続制度が想定してきた社会構造 ### 家族単位での調整を前提とした仕組み 相続制度は、複数の相続人が存在し、家族内で財産を分配・調整することを前提に設計されてきました。遺産分割協議という手続きが象徴的で、家族間の合意形成を促す仕組みが制度の中心にあります。 ### 血縁・世帯・家系という概念の影響 制度の根底には、血縁関係を軸とした「家族の継承」という考え方があります。かつての家制度ほど強固ではないものの、「家系を維持する」「家族が財産を引き継ぐ」という価値観が制度に影響を与えてきました。 ※(図:相続制度が前提としてきた家族構造) このように、相続制度は「家族が複数いて、財産を引き継ぐ意思がある」という社会像を前提に組み立てられてきたといえます。 --- ## 3. 少子化社会で生じているズレ ### 相続人が一人、あるいは不在というケースの増加 少子化や未婚化の進行により、相続人が一人しかいない、あるいは相続人が存在しないケースが増えています。相続人がいない場合、財産は最終的に国庫に帰属しますが、そこに至るまでの管理や手続きは必ずしも簡単ではありません。 ### 財産が「引き継がれるもの」から「行き場を探すもの」へ 相続人がいない、あるいは財産を引き継ぐ意思が弱い場合、財産は「誰が管理するのか」という問題に変わります。特に不動産は、維持管理の負担が大きく、相続を辞退するケースも見られます。 ### 空き家・管理不能資産・国庫帰属制度 空き家問題や管理不能な土地の増加を背景に、国庫帰属制度などの新しい仕組みが整備されつつあります。これらは「制度が時代遅れ」というよりも、「前提が変わったことで新たな対応が必要になった」と位置づけることができるでしょう。 ※(図:少子化社会における財産の流れ) --- ## 4. 家族の制度から社会の制度へ ### 相続の役割が変わりつつある可能性 従来、相続は家族内の調整装置として機能してきました。しかし、相続人がいないケースや、財産の管理が社会的課題となるケースが増える中で、相続は「社会との接点を管理する仕組み」としての側面を強めつつあります。 ### 税制・公共性・再分配という視点 相続税は、財産の再分配を通じて社会の公平性を保つ役割を担っています。財産が社会に還元される仕組みとしての相続税は、家族単位の継承とは異なる論理で制度を支えています。 ### 私的所有と社会的責任のあいだ 財産は私的所有でありながら、管理されない不動産が地域に悪影響を及ぼすなど、社会的責任も伴います。相続制度は、この二つの価値のバランスをどのように取るかという課題に直面しています。 --- ## 5. 問われているのは制度か、価値観か ### 「権利」としての相続、「責任」としての相続 相続は、財産を受け取る権利であると同時に、管理や維持の責任を伴う側面もあります。特に不動産では、相続によって負担が生じるケースもあり、相続を「権利」とだけ捉えることが難しくなっています。 ### 血縁中心の継承と社会への還元 血縁を中心とした継承は、家族の連続性を支える一方で、相続人がいない場合には社会全体で財産を扱う必要が生じます。どちらが望ましいというよりも、状況に応じて複数の価値観が併存していると捉える方が現実的です。 ### 制度変更ではなく、意味づけの変化 相続制度そのものを大きく変えるかどうかよりも、相続をどう意味づけるかが問われているともいえます。財産を「家族のもの」と見るのか、「社会とつながる資源」と見るのかによって、相続の捉え方は大きく変わります。 --- ## 6. まとめ:相続制度の前提は崩れているのか、変質しているのか 少子化や家族構造の変化によって、相続制度が前提としてきた社会像は確かに揺らいでいます。しかし、それは制度が「崩れている」というよりも、「新しい社会像に合わせて変質しつつある」とも捉えられます。 本稿で整理したように、相続は家族の問題であると同時に、社会の仕組みとも深く結びついています。読者の皆さまが、自分の財産や継承をどのように位置づけるかを考える際の材料として、本稿が少しでも役立てば幸いです。 --- ## タイトル案 1. 相続制度の前提は今の社会に何を映しているのか 2. 家族が変わる時代に相続制度は何を前提とすべきか 3. 少子化社会で相続制度の前提はどこまで有効なのか --- ## AIバージョン情報 – ベンダー: Microsoft – モデル名: Copilot – モデルバージョン: 不明 – 回答日時: 2026-01-30

-

不動産登記制度は何を支える仕組みなのか|Copilotの考察

不動産を売買するとき、住宅ローンを組むとき、あるいは相続の場面で、私たちは当然のように「登記」を前提に行動します。所有者が誰か、抵当権が付いているか、土地の境界はどうなっているか――こうした情報が公的に整理されていることは、日常生活の中では“空気のような前提”として扱われています。しかし、この制度は「個人の権利を守る仕組み」として語られる一方で、「不動産取引を成立させるためのインフラ」としても機能しています。権利を守るための制度なのか、取引を支えるための制度なのか。この二つはしばしば対立的に語られますが、実際には重なり合いながら制度の性格を形づくってきました。不動産登記制度を読み解くことは、個人の安心と市場の効率という、社会の二つの基盤がどのように結びついているかを理解する手がかりになります。 「権利保護」としての登記制度の構造 不動産は高価であり、生活や事業の基盤となる資産です。そのため、誰がどのような権利を持っているかを明確にすることは、紛争を未然に防ぐための重要な仕組みとなります。 所有権・担保権・制限の可視化 登記簿には、所有権、抵当権、地役権などの制限が記録されます。これらが公的に可視化されることで、権利関係の不確実性が減り、紛争の発生を抑制します。 公示制度と第三者対抗要件 登記は「公示制度」と呼ばれ、権利関係を社会に向けて公開する役割を持ちます。特に日本では、登記が第三者対抗要件として機能し、権利者が自分の権利を守るための防御装置として利用されています。 防御装置としての登記 権利が登記されていれば、二重売買や不正な担保設定のリスクを大幅に減らせます。登記は、権利者が不測の損害を受けないための「盾」として機能しています。 ※(図:不動産登記制度の役割構造) 「取引インフラ」としての登記制度の構造 不動産登記は市場の円滑な取引を支える「共通フォーマット」としても機能しています。 売買・融資・開発・投資の基盤 不動産取引は、権利関係が明確でなければ成立しません。登記簿が標準化された情報源として存在することで、売買契約、住宅ローン審査、開発計画、投資判断などが迅速に行えるようになります。 金融機関・不動産市場・行政との接続点 金融機関は抵当権設定を通じて融資の安全性を確保し、不動産会社は登記情報を基に物件調査を行い、行政は税務や都市計画の基礎データとして登記を利用します。登記制度は、これらのプレイヤーをつなぐ「情報のハブ」として機能しています。 情報の標準化と市場の流動性 登記情報が全国で統一された形式で管理されていることは、市場の透明性を高め、取引コストを下げます。その結果、不動産市場の流動性や規模にも影響を与えています。 ※(図:権利保護と市場取引の重なり合い) 両者が重なり合う領域 権利保護と取引インフラという二つの性質は、実際には明確に分離できるものではありません。 公開性が権利保護と取引促進を同時に支える 権利を守るために情報を公開することが、同時に取引の前提条件にもなっています。公開性は、個人の安心と市場の効率を同時に支える共通基盤として機能しています。 「盾」と「道路」という比喩 登記制度は、権利を守るための「盾」であると同時に、取引を流通させる「道路」でもあります。両者は相反するものではなく、相互に補完し合う関係にあります。 国家・市場・個人の接点 登記制度は、国家が管理する公的情報基盤でありながら、市場の取引を支え、個人の権利を守るという三層構造の中心に位置しています。この多層性こそが制度の特徴と言えます。 現代的な変化と問い直し 近年、登記制度はデジタル化の波の中で新たな段階に入りつつあります。 デジタル化・オンライン申請・データ連携 オンライン申請の普及や地図情報との連携、自治体とのデータ共有などにより、登記情報の利便性は大きく向上しています。これにより、制度の性格も変化しつつあります。 権利保護と市場性のどちらが強まるのか デジタル化によって情報アクセスが容易になると、取引の効率性は高まります。一方で、情報の正確性やプライバシー保護といった権利保護の観点も重要性を増しています。両者のバランスをどう取るかが今後の課題となります。 将来的な「公共インフラ」としての再定義 登記制度は、単なる法的手続きではなく、社会全体の情報基盤として再定義されつつあります。将来的には、より広い意味での公共インフラとして機能する可能性もあります。 まとめ 不動産登記制度は、権利保護と取引インフラという二つの目的のどちらか一方に還元できるものではありません。両者が重なり合い、相互に影響し合いながら制度の姿を形づくっています。読者の皆さまには、自分が「制度に守られている側」なのか、「制度を利用して取引を行う側」なのか、あるいはその両方なのかを考えてみていただければと思います。制度と市場の関係は固定されたものではなく、社会の変化とともに問い直され続けるものです。その余白を残しつつ、本稿を締めくくります。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 法制度・市場構造・情報公開の仕組みという観点から、 「不動産登記制度は『権利保護のための制度』なのか、それとも『取引を成立させるためのインフラ』なのか」という問いを、 歴史的・社会的・経済的な複数のレイヤーで冷静かつ構造的に考察してください。 【目的】 – 「個人の権利を守る制度」「市場を支える仕組み」という二項対立に回収せず、両者がどのように重なり合ってきたかを整理する – 不動産取引・金融・行政・市民生活の接点として、登記制度が果たしている役割の構造を可視化する – 読者が、制度と市場の関係性を自分なりに再解釈するための“視点”を提供する 【読者像】 – 一般社会人(20〜60代) – 不動産取引・相続・住宅購入などに関心を持つ層 – 法制度や経済の仕組みに漠然とした疑問を持つ読者 – 専門家ではないが、制度の背景を理解したいと感じている人 【記事構成】 1. 導入(問題提起) – 不動産登記制度が「当たり前の前提」として存在している現状を提示する – なぜこの制度が「権利保護」と「取引基盤」という二つの意味で語られるのかを示す – この問いが、個人の安心と市場の効率のどちらにも関わっていることを簡潔に説明する 2. 「権利保護」としての登記制度の構造 – 所有権・担保権・制限の可視化が、どのように紛争予防や法的安定につながっているかを整理する – 公示制度としての登記の役割と、第三者対抗要件の意味を構造的に説明する – 個人や法人にとっての「防御装置」としての側面を言語化する 3. 「取引インフラ」としての登記制度の構造 – 売買・融資・開発・投資が成立するための共通フォーマットとしての役割を整理する – 金融機関・不動産市場・行政手続きとの接続点としての登記の位置づけを説明する – 情報の標準化と透明性が、流動性や市場規模に与える影響を構造的に示す 4. 両者が重なり合う領域 – 権利を守るための公開性が、同時に取引を促進する条件になっている点を整理する – 制度が「盾」と「道路」の両方の性質を持つことを比喩的・構造的に説明する – 国家・市場・個人の関係性の中で、登記制度がどこに位置づけられているかを考察する 5. 現代的な変化と問い直し – デジタル化、オンライン申請、データ連携が制度の性格に与えている影響を整理する – 情報の利便性向上が、権利保護と市場性のどちらを強めているのかを構造的に検討する – 将来的に登記制度が「公共インフラ」としてどう再定義され得るかを提示する 6. まとめ – 不動産登記制度が単一の目的で設計されているわけではないことを再確認する – 読者自身が「制度に守られている側」なのか「制度を利用している側」なのかを考える視点を提示する – 結論を固定せず、制度と市場の関係を考え続ける余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「制度を評価する記事」ではなく、「制度の構造を読み解く記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の視点や制度的背景を整理したうえでの「考察」として執筆する – 特定の立場・職業・利害関係者の視点に偏らず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:不動産登記制度の役割構造) ※(図:権利保護と市場取引の重なり合い) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「不動産登記は誰のための制度なのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ## 不動産登記制度は「権利保護」か「取引インフラ」か ### ― 歴史・社会・経済のレイヤーから読み解く構造的考察 ― ### 1. 導入(問題提起) 不動産を売買するとき、住宅ローンを組むとき、あるいは相続の場面で、私たちは当然のように「登記」を前提に行動します。所有者が誰か、抵当権が付いているか、土地の境界はどうなっているか――こうした情報が公的に整理されていることは、日常生活の中では“空気のような前提”として扱われています。 しかし、この制度は「個人の権利を守る仕組み」として語られる一方で、「不動産取引を成立させるためのインフラ」としても機能しています。権利を守るための制度なのか、取引を支えるための制度なのか。この二つはしばしば対立的に語られますが、実際には重なり合いながら制度の性格を形づくってきました。 不動産登記制度を読み解くことは、個人の安心と市場の効率という、社会の二つの基盤がどのように結びついているかを理解する手がかりになります。 --- ### 2. 「権利保護」としての登記制度の構造 不動産は高価であり、生活や事業の基盤となる資産です。そのため、誰がどのような権利を持っているかを明確にすることは、紛争を未然に防ぐための重要な仕組みとなります。 #### 所有権・担保権・制限の可視化 登記簿には、所有権(誰のものか)、抵当権(どの金融機関が担保を取っているか)、地役権などの制限(他者が利用できる範囲)が記録されます。これらが公的に可視化されることで、権利関係の不確実性が減り、紛争の発生を抑制します。 #### 公示制度と第三者対抗要件 登記は「公示制度」と呼ばれ、権利関係を社会に向けて公開する役割を持ちます。特に日本では、登記が第三者対抗要件(第三者に対して自分の権利を主張するための条件)として機能します。 これは、個人や企業が「自分の権利を守るための防御装置」として登記を利用する構造を生み出しています。 #### 防御装置としての登記 権利が登記されていれば、他者が同じ不動産を二重に売買したり、勝手に担保設定したりするリスクを大幅に減らせます。登記は、権利者が不測の損害を受けないための“盾”として機能していると言えます。 ※(図:不動産登記制度の役割構造) --- ### 3. 「取引インフラ」としての登記制度の構造 一方で、不動産登記は市場の円滑な取引を支える“共通フォーマット”としても機能しています。 #### 売買・融資・開発・投資の基盤 不動産取引は、権利関係が明確でなければ成立しません。登記簿が標準化された情報源として存在することで、売買契約、住宅ローン審査、開発計画、投資判断などが迅速に行えるようになります。 #### 金融機関・不動産市場・行政との接続点 金融機関は抵当権設定を通じて融資の安全性を確保し、不動産会社は登記情報を基に物件の調査を行い、行政は税務や都市計画の基礎データとして登記を利用します。 登記制度は、これらのプレイヤーをつなぐ“情報のハブ”として機能しています。 #### 情報の標準化と市場の流動性 登記情報が全国で統一された形式で管理されていることは、市場の透明性を高め、取引コストを下げます。結果として、不動産市場の流動性や規模にも影響を与えています。 ※(図:権利保護と市場取引の重なり合い) --- ### 4. 両者が重なり合う領域 権利保護と取引インフラという二つの性質は、実際には明確に分離できるものではありません。 #### 公開性が権利保護と取引促進を同時に支える 権利を守るために情報を公開することが、同時に取引の前提条件にもなっています。公開性は、個人の安心と市場の効率を同時に支える“共通基盤”として機能しています。 #### 「盾」と「道路」という比喩 登記制度は、権利を守るための“盾”であると同時に、取引を流通させる“道路”でもあります。 盾としての役割が強まれば不正取引が減り、道路としての役割が強まれば市場が活性化します。両者は相反するものではなく、相互に補完し合う関係にあります。 #### 国家・市場・個人の接点 登記制度は、国家が管理する公的情報基盤でありながら、市場の取引を支え、個人の権利を守るという三層構造の中心に位置しています。この多層性こそが、制度の特徴と言えます。 --- ### 5. 現代的な変化と問い直し 近年、登記制度はデジタル化の波の中で新たな段階に入りつつあります。 #### デジタル化・オンライン申請・データ連携 オンライン申請の普及や、地図情報との連携、自治体とのデータ共有などにより、登記情報の利便性は大きく向上しています。これにより、制度の性格も変化しつつあります。 #### 権利保護と市場性のどちらが強まるのか デジタル化によって情報アクセスが容易になると、取引の効率性は高まります。一方で、情報の正確性やプライバシー保護といった権利保護の観点も重要性を増しています。 どちらが強まるかは一概には言えず、両者のバランスをどう取るかが今後の課題となります。 #### 将来的な「公共インフラ」としての再定義 登記制度は、単なる法的手続きではなく、社会全体の情報基盤として再定義されつつあります。将来的には、より広い意味での「公共インフラ」として機能する可能性もあります。 --- ### 6. まとめ 不動産登記制度は、権利保護と取引インフラという二つの目的のどちらか一方に還元できるものではありません。両者が重なり合い、相互に影響し合いながら制度の姿を形づくっています。 読者の皆さまには、自分が「制度に守られている側」なのか、「制度を利用して取引を行う側」なのか、あるいはその両方なのかを考えてみていただければと思います。 制度と市場の関係は固定されたものではなく、社会の変化とともに問い直され続けるものです。その余白を残しつつ、本稿を締めくくります。 --- ## タイトル案 1. 不動産登記制度は何を支える仕組みなのか 2. 不動産登記は権利と取引のどちらを映すのか 3. 不動産登記制度は社会の中で何を可能にするのか --- — AIバージョン情報 – ベンダー: Microsoft – モデル名: Copilot – モデルバージョン: 不明 – 回答日時: 2026-01-30 22:25(JST)

-

デジタル資産の相続は何を前提に成り立つのか|Copilotの考察

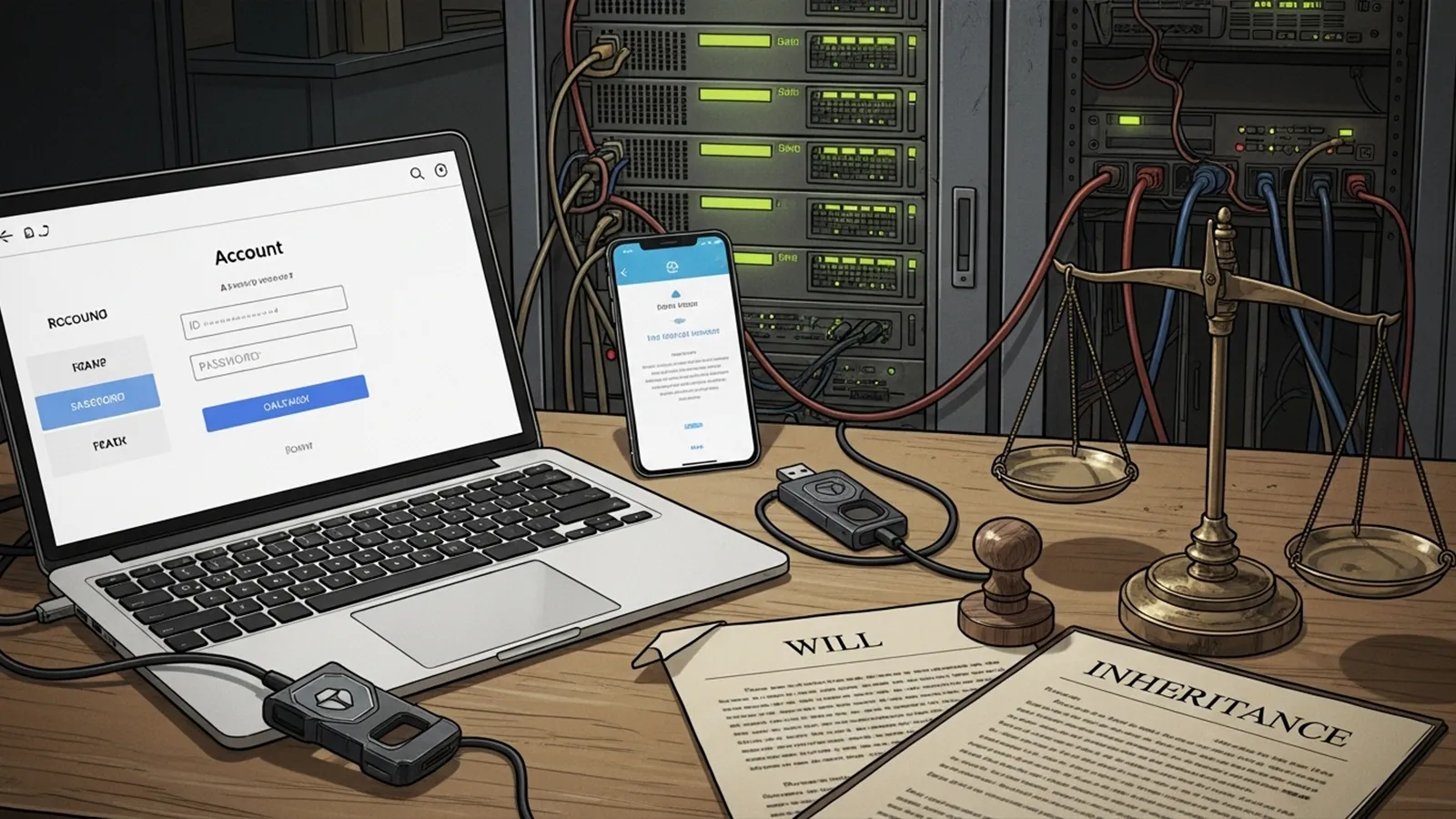

私たちの財産は、かつて「物理的に存在するもの」が中心でした。しかし現在は、銀行口座のオンライン化、クラウド上の契約情報、暗号資産のウォレットなど、「アクセス権」「アカウント」「秘密鍵」といったデジタルな形の財産が増えています。こうした資産は、従来の相続制度が前提としてきた「所有の証明方法」や「管理の仕組み」と異なる論理で動いており、そのため相続の場面で新しい摩擦や手続き上の課題が生まれています。本記事では、「相続できる/できない」という単純な二択ではなく、制度と技術の前提構造の違いを整理し、どこにズレが生じているのかを多角的に考察します。 相続制度の前提構造 従来の相続制度が想定してきた「財産」の姿 相続制度は、長らく「物理的に存在し、国家や金融機関が管理する財産」を前提に設計されてきました。具体的には以下のような構造があります。 所有の証明:登記簿、通帳、証書など、国家や金融機関が発行する記録 仲介者の存在:銀行、法務局、公証人などが「権利の移転」を確認 財産の特定性:土地・建物・預金など、所在や残高が明確 ※(図:相続制度とデジタル資産の管理構造) この仕組みは、物理資産や銀行口座と非常に相性が良く、相続人が戸籍や遺言を提示すれば、金融機関が手続きを進めるという明確な流れがありました。 オンライン口座が持ち込む論点 ID・パスワードという「アクセス権」の問題 オンライン口座は、従来の銀行口座と似ているようで、実際には異なる管理構造を持っています。ID・パスワード、二段階認証、利用規約といった「契約とアクセス権」に基づいて管理されており、相続人が法的に権利を持っていても、ログイン情報がなければアクセスできません。 プラットフォーム企業と法制度の関係 オンライン証券、ネット銀行、海外サービスなど、運営主体は多様化しています。その結果、 企業ごとに相続手続きのルールが異なる 利用規約が国内法より優先される場面がある 海外企業の場合、管轄が曖昧になる といった複雑さが生まれています。 国境・管轄・契約条件の問題 オンラインサービスは国境を越えて利用されるため、「どの国の法律が適用されるのか」「相続人がどの手続きを踏むべきか」が明確でないケースもあります。従来の銀行口座のように国内の金融機関が一元的に管理している状況とは異なり、相続手続きが“契約ベース”に寄っている点が特徴です。 暗号資産が持ち込む別の論理 秘密鍵と分散管理 暗号資産は、ブロックチェーン上のアドレスに紐づいており、秘密鍵を持つ者が資産を動かせるという技術的ルールで成立しています。ここには、国家や金融機関のような「仲介者」が存在しません。 法的権利と技術的支配のズレ 相続制度は「法的権利の移転」を前提にしていますが、暗号資産は「技術的にアクセスできるか」がすべてです。そのため、 相続人がいても、秘密鍵がなければ資産を動かせない 相続人でなくても、秘密鍵を知っていれば資産を動かせてしまう という、法制度とは異なるロジックが働きます。 ※(図:法的権利と技術的アクセスの関係) ウォレットの種類による違い 暗号資産は、ウォレットの種類によって相続の難易度が大きく変わります。 取引所ウォレット:企業が管理するため、相続手続きが比較的制度に近い 自己管理型ウォレット:秘密鍵を本人が保持するため、相続制度とのズレが大きい 「適合」とは何を意味するのか 制度が技術に合わせる方向性 デジタル資産が増える中で、「制度が技術に合わせるのか」「技術が制度を再設計させるのか」という問いが浮かび上がります。制度側がデジタル資産を前提にアップデートする動きとして、以下のような方向性があります。 デジタル遺産のガイドライン整備 プラットフォーム企業への相続対応の義務化 国際的なルール作りの検討 技術が制度を再設計させる方向性 一方で、技術側が「相続を前提とした設計」を取り入れる可能性もあります。 秘密鍵の分散管理 相続用のマルチシグ(複数署名) 死亡時に自動移転するスマートコントラクト 社会的合意の位置づけ 最終的には、「財産とは何か」「所有とは何か」「アクセス権は誰に帰属するのか」といった根本的な概念に対する社会的合意が必要になります。制度と技術のどちらが主導するかは一概に言えず、両者が相互に影響しながら調整されていくと考えられます。 まとめ オンライン口座と暗号資産は、相続制度に対して次のような問いを投げかけています。 財産は「物」なのか、「アクセス権」なのか 所有は「法的権利」なのか、「技術的支配」なのか 仲介者がいない資産を制度はどう扱うべきか 国境を越えるサービスにどのように管轄を適用するのか これらの問いに明確な答えはまだありません。しかし、読者が自分の資産管理を考える際には、「自分の資産は、誰が、どのようにアクセスできる設計になっているのか」を確認することが重要になります。デジタル資産の相続は、不安を煽るテーマではなく、これからの社会で避けて通れない“設計の問題”です。本記事が、その設計を考えるための視点の一つになれば幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 デジタル化・グローバル化・技術設計の進展によって、 「オンライン口座」や「暗号資産」は、現在の相続制度にどのように適合し、どの部分でズレや摩擦を生んでいるのかを、 法制度・技術構造・社会的合意・運用実態といった複数の観点から冷静かつ構造的に整理・考察してください。 【目的】 – 「相続できる/できない」という二択ではなく、制度と技術の前提構造の違いを可視化する – デジタル資産が「所有」「権利」「管理」という概念をどう変えつつあるのかを整理する – 読者が、自分の資産管理や相続のあり方を考えるための“視点”を提供する 【読者像】 – 一般社会人(30〜60代) – デジタル資産を保有している、または将来的に関心を持っている層 – 相続や終活を意識し始めている人 – 法律や技術に詳しくはないが、無関係ではいられないと感じている層 【記事構成】 1. 導入(問題提起) – 財産が「物理的なもの」から「アクセス権・鍵・アカウント」へと変わりつつある現状を提示する – なぜオンライン口座や暗号資産が、相続の場面で新しい問いを生んでいるのかを示す – 本記事が「結論」ではなく「構造の整理」を目的としていることを明示する 2. 相続制度の前提構造 – 従来の相続制度が想定してきた「財産」「所有」「証明」「仲介者」の枠組みを整理する – 国家・金融機関・登記制度などが果たしてきた役割を構造的に説明する – なぜこの設計が、物理資産や銀行口座とは相性が良かったのかを示す 3. オンライン口座が持ち込む論点 – ID・パスワード・利用規約に基づく管理構造を整理する – プラットフォーム企業と法制度の関係性に触れる – 国境・管轄・契約条件といった要素が、相続手続きをどう複雑化しているかを説明する 4. 暗号資産が持ち込む別の論理 – 秘密鍵・分散管理・技術的所有という概念を簡潔に整理する – 法的権利と技術的支配のズレを構造として説明する – なぜ「相続人がいても引き継げない」「相続人でなくても動かせる」という状況が生まれるのかを考察する 5. 「適合」とは何を意味するのか – 制度が技術に合わせるのか、技術が制度を再設計させるのかという視点を提示する – 財産・権利・アクセス・責任のどこに社会的合意が置かれているのかを整理する – 各国や企業の対応の方向性を、一般論として構造的に示す 6. まとめ – オンライン口座と暗号資産が、相続制度に投げかけている問いを再整理する – 読者が「自分の資産は、誰に、どのように引き継がれる設計になっているのか」を考えるための視点を提示する – 楽観や不安に寄らず、思考の余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:相続制度とデジタル資産の管理構造) ※(図:法的権利と技術的アクセスの関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「あなたのデジタル資産は誰に引き継がれるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # デジタル資産と相続制度のズレを考える ※本記事は結論を断定するものではなく、制度と技術の前提構造を整理し、読者が自分の資産管理を考えるための視点を提供することを目的としています。 --- ## 1. 導入(問題提起) 私たちの財産は、かつて「物理的に存在するもの」が中心でした。しかし現在は、銀行口座のオンライン化、クラウド上の契約情報、暗号資産のウォレットなど、「アクセス権」「アカウント」「秘密鍵」といった“デジタルな形の財産”が増えています。 こうした資産は、従来の相続制度が前提としてきた「所有の証明方法」や「管理の仕組み」と異なる論理で動いています。そのため、相続の場面で新しい摩擦や手続き上の課題が生まれています。 本記事では、「相続できる/できない」という単純な二択ではなく、制度と技術の前提構造の違いを整理し、どこにズレが生じているのかを多角的に考察します。 --- ## 2. 相続制度の前提構造 ### 2-1. 従来の相続制度が想定してきた「財産」の姿 相続制度は、長らく「物理的に存在し、国家や金融機関が管理する財産」を前提に設計されてきました。 具体的には以下のような構造です。 - **所有の証明**:登記簿、通帳、証書など、国家や金融機関が発行する記録 - **仲介者の存在**:銀行、法務局、公証人などが「権利の移転」を確認 - **財産の特定性**:土地・建物・預金など、所在や残高が明確 ※(図:相続制度とデジタル資産の管理構造) この仕組みは、物理資産や銀行口座と非常に相性が良く、相続人が戸籍や遺言を提示すれば、金融機関が手続きを進めるという明確な流れがありました。 --- ## 3. オンライン口座が持ち込む論点 オンライン口座は、従来の銀行口座と似ているようで、実際には異なる管理構造を持っています。 ### 3-1. ID・パスワードという「アクセス権」の問題 オンライン口座は、 - **ID・パスワード** - **二段階認証** - **利用規約** といった「契約とアクセス権」に基づいて管理されています。 相続人が法的に権利を持っていても、ログイン情報がなければアクセスできません。 ### 3-2. プラットフォーム企業と法制度の関係 オンライン証券、ネット銀行、海外サービスなど、運営主体は多様化しています。 その結果、 - 企業ごとに相続手続きのルールが異なる - 利用規約が国内法より優先される場面がある - 海外企業の場合、管轄が曖昧になる といった複雑さが生まれています。 ### 3-3. 国境・管轄・契約条件の問題 オンラインサービスは国境を越えて利用されるため、 「どの国の法律が適用されるのか」 「相続人がどの手続きを踏むべきか」 が明確でないケースもあります。 従来の銀行口座のように、国内の金融機関が一元的に管理している状況とは異なり、相続手続きが“契約ベース”に寄っている点が大きな特徴です。 --- ## 4. 暗号資産が持ち込む別の論理 暗号資産は、オンライン口座以上に「技術的な所有」の概念が強く、相続制度とのズレが顕著です。 ### 4-1. 秘密鍵と分散管理 暗号資産は、ブロックチェーン上のアドレスに紐づいており、 **秘密鍵を持つ者が資産を動かせる** という技術的ルールで成立しています。 ここには、国家や金融機関のような「仲介者」が存在しません。 ### 4-2. 法的権利と技術的支配のズレ 相続制度は「法的権利の移転」を前提にしていますが、暗号資産は「技術的にアクセスできるか」がすべてです。 そのため、 - 相続人がいても、秘密鍵がなければ資産を動かせない - 相続人でなくても、秘密鍵を知っていれば資産を動かせてしまう という、法制度とは異なるロジックが働きます。 ※(図:法的権利と技術的アクセスの関係) ### 4-3. ウォレットの種類による違い - **取引所ウォレット**:企業が管理するため、相続手続きが比較的制度に近い - **自己管理型ウォレット**:秘密鍵を本人が保持するため、相続制度とのズレが大きい 同じ「暗号資産」でも、技術設計によって相続の難易度が大きく変わります。 --- ## 5. 「適合」とは何を意味するのか デジタル資産が増える中で、「制度が技術に合わせるのか」「技術が制度を再設計させるのか」という問いが浮かび上がります。 ### 5-1. 制度が技術に合わせる方向性 - デジタル遺産のガイドライン整備 - プラットフォーム企業への相続対応の義務化 - 国際的なルール作りの検討 制度側がデジタル資産を前提にアップデートする動きが見られます。 ### 5-2. 技術が制度を再設計させる方向性 一方で、技術側が「相続を前提とした設計」を取り入れる可能性もあります。 - 秘密鍵の分散管理 - 相続用のマルチシグ(複数署名) - 死亡時に自動移転するスマートコントラクト など、技術が新しい相続の形を生み出す余地もあります。 ### 5-3. 社会的合意の位置づけ 最終的には、 「財産とは何か」 「所有とは何か」 「アクセス権は誰に帰属するのか」 といった根本的な概念に対する社会的合意が必要になります。 制度と技術のどちらが主導するかは一概に言えず、両者が相互に影響しながら調整されていくと考えられます。 --- ## 6. まとめ オンライン口座と暗号資産は、相続制度に対して次のような問いを投げかけています。 - 財産は「物」なのか、「アクセス権」なのか - 所有は「法的権利」なのか、「技術的支配」なのか - 仲介者がいない資産を、制度はどう扱うべきか - 国境を越えるサービスに、どのように管轄を適用するのか これらの問いに明確な答えはまだありません。しかし、読者が自分の資産管理を考える際には、 「自分の資産は、誰が、どのようにアクセスできる設計になっているのか」 を確認することが重要になります。 デジタル資産の相続は、不安を煽るテーマではなく、これからの社会で避けて通れない“設計の問題”です。 本記事が、その設計を考えるための視点の一つになれば幸いです。 --- ## タイトル案(主タイトルのみ) 1. デジタル資産の相続は何を前提に成り立つのか 2. オンライン口座と暗号資産は相続にどんな問いを投げかけるのか 3. 相続制度はデジタル資産のどこに適合しどこでズレるのか --- AIバージョン情報 – ベンダー: Microsoft – モデル名: Copilot – モデルバージョン: 不明 – 回答日時: 2026-01-30 19:11 JST

-

API連携は拡張性と依存のどこに境界を引くのか|Copilotの考察

現代のシステム開発において、API(Application Programming Interface)連携は特別な選択ではなく、ほぼ前提条件のように扱われています。一方で、APIは「拡張性の象徴」として語られると同時に、「依存リスクの源泉」としても語られます。本記事では、API連携を良い・悪いで評価するのではなく、技術設計・経済性・運用・組織構造・市場環境といった複数の観点から「仕組み」として整理し、読者が自身の前提条件を考えるための視点を提供します。 拡張性としてのAPI連携の構造 機能分離とモジュール化の促進 APIは、機能を独立したモジュールとして扱う設計思想と相性が良い仕組みです。機能分離により、システムは「必要な機能を必要なときに外部から呼び出す」構造を取れます。 認証はAuthサービス 決済は決済API 画像処理は外部AIモデル このように、専門性の高い機能を外部に委ねることで、内製部分をスリムに保つことができます。 小規模システムが能力を拡張する仕組み API連携は、特に小規模なチームやスタートアップにとって「能力の外部調達」を可能にします。 高度なAIモデルを自前で構築する必要がない 決済インフラをゼロから整備する必要がない グローバルなSMS送信や地図情報など、巨大なインフラを利用できる これにより、少人数でも大規模サービスに匹敵する機能を提供できます。 内製と外部利用の境界線 API連携は「どこまでを自社で持ち、どこからを外部に委ねるか」という境界設計を明確にします。 ※(図:API連携による責任範囲の境界構造) 境界線は技術的な都合だけでなく、以下のような要素によっても変動します。 コア技術かどうか コスト構造 将来の事業戦略 運用負荷の許容度 APIは拡張性を提供する一方で、境界線の引き方によっては依存の構造も生まれます。 依存関係としてのAPI連携の構造 外部要因の影響を受ける仕組み API連携は、外部サービスの仕様や運営方針に影響される構造を持ちます。 仕様変更(エンドポイントの廃止、レスポンス形式の変更) 価格改定(従量課金の増加、無料枠の縮小) 提供停止(サービス終了、地域制限) 利用制限(レートリミット、利用規約の変更) これらは自社の意思決定ではコントロールできません。 技術的依存と経済的・契約的依存 依存には複数の層があります。 技術的依存:API仕様に合わせた実装が必要になる 経済的依存:価格体系に事業モデルが左右される 契約的依存:利用規約やSLAに縛られる 特にSaaS型APIは、技術的依存と経済的依存が密接に結びつく点が特徴です。 管理外に置かれる領域の意味 API連携は、システムの一部を「自社の管理外」に置くことを意味します。 ※(図:拡張性と依存関係の重なりイメージ) これは、運用負荷を軽減する一方で、障害時の対応範囲や責任範囲が曖昧になる可能性も含みます。 技術選択が組織や戦略に与える影響 開発体制・意思決定・事業スピードへの影響 API連携は、技術選択であると同時に組織設計にも影響します。 外部サービスを使うことで開発スピードは向上する しかし、外部仕様に合わせるための調整コストが発生する 障害時の原因切り分けが複雑化する 技術選択が、組織の意思決定プロセスや運用体制に影響を与える構造が見えてきます。 スタートアップと大企業で異なる意味 同じAPI依存でも、組織規模によって意味が変わります。 スタートアップ:スピード重視で外部APIを積極活用し、事業成長を優先 大企業:長期的な安定性やコスト構造を重視し、依存リスクを慎重に評価 API連携は、単なる技術選択ではなく、組織戦略と密接に結びつく判断になります。 境界設計という視点 中核に残すべきものを定義する API連携を考える際には、「何を自分たちの中核に残すか」という設計思想が重要です。 競争優位の源泉となる技術 顧客体験の根幹を担う部分 長期的に維持したい資産 これらを内製として保持し、それ以外をAPIで補完するという考え方が一般的です。 APIは責任範囲を定義する装置 APIは単なる接続点ではなく、「どこまでを自社が責任を持つか」を明確にする装置でもあります。 自社が管理する領域 外部に委ねる領域 両者の境界で発生する調整コスト これらを可視化することで、拡張性と依存関係が同時に成立する構造が理解しやすくなります。 まとめ API連携は、システムの自由度を広げると同時に、選択を固定化する側面も持ちます。拡張性と依存関係は対立概念ではなく、APIという仕組みの中で同時に存在する構造です。 読者の皆さまには、自身の立場や事業フェーズに応じて「どこまでを自分の責任領域とするか」を考える際の視点として、本記事の整理が役立てば幸いです。結論を断定せず、思考の余白を残したまま、API連携という設計選択を捉え直すきっかけとなればと思います。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 API連携は、 システムや組織にとって「拡張性」をもたらす仕組みなのか、 それとも「依存関係」を深める構造なのか。 技術設計・経済性・運用・組織構造・市場環境といった複数の観点から、 善悪や推奨ではなく「仕組み」として冷静に整理・考察してください。 【目的】 – API連携を「便利な技術」や「ベンダーロックイン問題」といった単純な評価から切り離し、構造的な設計選択として捉え直す – 技術判断が、経済的・組織的・戦略的な影響をどのように伴うのかを可視化する – 読者が、自身のシステム設計やサービス選定の前提条件を考えるための“視点”を提供する 【読者像】 – エンジニア・プロダクトマネージャー – IT導入を検討する企業担当者・経営層 – スタートアップ・個人開発者 – 技術には詳しくないが、システムの「外部依存」に関心を持つ一般読者 【記事構成】 1. 導入(問題提起) – API連携が「当たり前の設計」になっている現状を提示する – なぜAPIは、拡張性の象徴として語られる一方で、依存のリスクとしても語られるのかを示す – 本記事が「良い・悪い」を判断するものではなく、「構造」を整理する試みであることを明示する 2. 拡張性としてのAPI連携の構造 – 機能分離・モジュール化・スケーラビリティの観点から整理する – 小規模なシステムが外部サービスを通じて能力を拡張できる仕組みを説明する – 内製と外部利用の境界線がどのように引かれるのかを構造的に示す 3. 依存関係としてのAPI連携の構造 – 仕様変更・価格改定・提供停止・制限ルールといった外部要因の影響を整理する – 技術的依存と、経済的・契約的依存の違いを説明する – システムの一部が「自社の管理外」に置かれる意味を構造として言語化する 4. 技術選択が組織や戦略に与える影響 – API連携が、開発体制・意思決定・事業スピードにどう影響するかを整理する – スタートアップと大企業で、API依存の意味が異なる点に触れる – 技術設計と経営判断が重なり合う領域として位置づける 5. 境界設計という視点 – 「何を自分たちの中核に残すか」という設計思想の重要性を整理する – APIが単なる接続点ではなく、責任範囲を定義する装置であることを示す – 拡張性と依存関係が同時に成立する構造を言語化する 6. まとめ – API連携は、自由度を広げると同時に、選択を固定化する側面を持つことを再確認する – 読者が、自身の立場で「どこまでを自分の責任領域とするか」を考えるための視点を提示して締めくくる – 結論を断定せず、思考の余白を残す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 技術礼賛・危機煽動のどちらにも寄らない 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、複数の構造を整理したうえでの「考察」として執筆する – 特定の技術思想・経営思想・ベンダー戦略を推奨・批判しない – 読者が自分の判断基準を形成するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:API連携による責任範囲の境界構造) ※(図:拡張性と依存関係の重なりイメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「APIはシステムを自由にするのか縛るのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # API連携は拡張性か依存か――構造として捉える試み ## 1. 導入(問題提起) 現代のシステム開発において、API(Application Programming Interface)連携は特別な選択ではなく、ほぼ前提条件のように扱われています。決済、認証、データ分析、通知、AIモデルなど、多くの機能が外部サービスとして提供され、それらを組み合わせることでサービスは迅速に立ち上がります。 一方で、APIは「拡張性の象徴」として語られると同時に、「依存リスクの源泉」としても語られます。外部サービスを利用することで自社の能力を広げられる反面、仕様変更や価格改定といった外部要因に影響される構造も生まれます。 本記事では、API連携を良い・悪いで評価するのではなく、技術設計・経済性・運用・組織構造・市場環境といった複数の観点から「仕組み」として整理し、読者が自身の前提条件を考えるための視点を提供します。 --- ## 2. 拡張性としてのAPI連携の構造 ### ● 機能分離とモジュール化の促進 APIは、機能を独立したモジュールとして扱う設計思想と相性が良い仕組みです。 機能分離(Separation of Concerns)により、システムは「必要な機能を必要なときに外部から呼び出す」構造を取れます。 - 認証はAuthサービス - 決済は決済API - 画像処理は外部AIモデル といったように、専門性の高い機能を外部に委ねることで、内製部分をスリムに保つことができます。 ### ● 小規模システムが能力を拡張する仕組み API連携は、特に小規模なチームやスタートアップにとって「能力の外部調達」を可能にします。 - 高度なAIモデルを自前で構築する必要がない - 決済インフラをゼロから整備する必要がない - グローバルなSMS送信や地図情報など、巨大なインフラを利用できる これにより、少人数でも大規模サービスに匹敵する機能を提供できます。 ### ● 内製と外部利用の境界線 API連携は「どこまでを自社で持ち、どこからを外部に委ねるか」という境界設計を明確にします。 ※(図:API連携による責任範囲の境界構造) 境界線は技術的な都合だけでなく、以下のような要素によっても変動します。 - コア技術かどうか - コスト構造 - 将来の事業戦略 - 運用負荷の許容度 APIは拡張性を提供する一方で、境界線の引き方によっては依存の構造も生まれます。 --- ## 3. 依存関係としてのAPI連携の構造 ### ● 外部要因の影響を受ける仕組み API連携は、外部サービスの仕様や運営方針に影響される構造を持ちます。 - 仕様変更(エンドポイントの廃止、レスポンス形式の変更) - 価格改定(従量課金の増加、無料枠の縮小) - 提供停止(サービス終了、地域制限) - 利用制限(レートリミット、利用規約の変更) これらは自社の意思決定ではコントロールできません。 ### ● 技術的依存と経済的・契約的依存 依存には複数の層があります。 - **技術的依存**:API仕様に合わせた実装が必要になる - **経済的依存**:価格体系に事業モデルが左右される - **契約的依存**:利用規約やSLA(サービス品質保証)に縛られる 特にSaaS型APIは、技術的依存と経済的依存が密接に結びつく点が特徴です。 ### ● 管理外に置かれる領域の意味 API連携は、システムの一部を「自社の管理外」に置くことを意味します。 ※(図:拡張性と依存関係の重なりイメージ) これは、運用負荷を軽減する一方で、障害時の対応範囲や責任範囲が曖昧になる可能性も含みます。 --- ## 4. 技術選択が組織や戦略に与える影響 ### ● 開発体制・意思決定・事業スピードへの影響 API連携は、技術選択であると同時に組織設計にも影響します。 - 外部サービスを使うことで開発スピードは向上する - しかし、外部仕様に合わせるための調整コストが発生する - 障害時の原因切り分けが複雑化する 技術選択が、組織の意思決定プロセスや運用体制に影響を与える構造が見えてきます。 ### ● スタートアップと大企業で異なる意味 同じAPI依存でも、組織規模によって意味が変わります。 - **スタートアップ**:スピード重視で外部APIを積極活用し、事業成長を優先 - **大企業**:長期的な安定性やコスト構造を重視し、依存リスクを慎重に評価 API連携は、単なる技術選択ではなく、組織戦略と密接に結びつく判断になります。 --- ## 5. 境界設計という視点 ### ● 中核に残すべきものを定義する API連携を考える際には、「何を自分たちの中核に残すか」という設計思想が重要です。 - 競争優位の源泉となる技術 - 顧客体験の根幹を担う部分 - 長期的に維持したい資産 これらを内製として保持し、それ以外をAPIで補完するという考え方が一般的です。 ### ● APIは責任範囲を定義する装置 APIは単なる接続点ではなく、「どこまでを自社が責任を持つか」を明確にする装置でもあります。 - 自社が管理する領域 - 外部に委ねる領域 - 両者の境界で発生する調整コスト これらを可視化することで、拡張性と依存関係が同時に成立する構造が理解しやすくなります。 --- ## 6. まとめ API連携は、システムの自由度を広げると同時に、選択を固定化する側面も持ちます。 拡張性と依存関係は対立概念ではなく、APIという仕組みの中で同時に存在する構造です。 読者の皆さまには、自身の立場や事業フェーズに応じて「どこまでを自分の責任領域とするか」を考える際の視点として、本記事の整理が役立てば幸いです。 結論を断定せず、思考の余白を残したまま、API連携という設計選択を捉え直すきっかけとなればと思います。 --- ## タイトル案(主タイトルのみ) 1. API連携は拡張性と依存のどこに境界を引くのか 2. APIはシステム設計にどんな責任範囲を生むのか 3. API依存は組織と技術の関係に何をもたらすのか --- AIバージョン情報 – ベンダー: Microsoft – モデル名: Copilot – モデルバージョン: 不明 – 回答日時: 2026-01-30 09:45 JST

-

AI時代の投資判断は誰のものなのかを問う|Copilotの考察

AIを活用した投資ツールや自動分析サービスが一般の個人投資家にも広く利用されるようになり、「誰でもプロ並みの判断ができる時代」という言葉が語られるようになりました。しかし、この言い方にはどこか違和感があります。判断が本当に民主化しているのか、それとも判断の主体が別の場所へ移動しているのか。こうした疑問から、投資判断の民主化という言葉そのものを問い直す必要があります。 AIは投資判断を民主化しているのか 情報アクセスの拡大 AIの普及により、膨大なデータを瞬時に処理し、要点を抽出する機能が一般化しました。決算書の読み解き、ニュースの影響度分析、チャートの自動解析など、かつて専門家だけが扱えた情報が低コストで利用できるようになっています。 個人投資家が持てる“材料”の増加 AIは情報を整理し、理解しやすい形で提示してくれるため、個人投資家が判断に使える材料は確実に増えています。これは情報の非対称性を縮小し、投資の参入障壁を下げる方向に働いています。 参入障壁の低下 チャート分析の自動化やニュース要約など、投資を始める際の心理的・技術的ハードルが下がっています。こうした点だけを見ると、投資判断は民主化しているように見えます。 判断が集約されていく構造 AIの設計者・学習データの影響 AIは中立ではなく、設計者の意図や学習データの偏りを反映します。どのデータを重視するか、どの指標を優先するかといった判断はアルゴリズム内部で決定され、利用者には見えにくい構造になっています。 判断の同調化と集中化 同じAIツールを使う投資家が増えるほど、判断が似通う可能性があります。ニュース要約、スコアリング、推奨銘柄などが重なることで、市場全体の行動が同調化し、判断が集中する方向に働くことがあります。 民主化と集中化の同時進行 表面的には選択肢が増えているように見えても、実際にはAIの背後にある設計思想に判断が集約される可能性があります。これは民主化と集中化が同時に進む構造といえます。 格差の再編成という視点 「情報格差」から「使いこなし格差」へ AIが情報を整理してくれることで、従来の「情報を持っているかどうか」という格差は縮小しました。しかし、新たに「AIをどう使いこなすか」という格差が生まれています。 重要になるスキル プロンプト設計:AIに何をどう尋ねるか 検証力:AIの出力を鵜呑みにせず裏取りする力 疑う力:AIの前提や限界を理解する姿勢 投資リテラシーの再定義 投資判断の質は、情報量よりも「AIをどう位置づけるか」に左右されるようになりつつあります。AIを代行者とみなすのか、補助者とみなすのか、比較対象として使うのか。この姿勢の違いが判断の主体性に影響を与えます。 市場全体への影響 AIを介した行動が増える市場の構造 AIが広く使われるほど、市場は「AIを通じて行動する参加者」が増えます。これは単に投資家が増えるという話ではなく、市場構造そのものに影響を与えます。 ボラティリティ・流動性・価格形成への影響 同じシグナルに反応する投資家が増えると短期的な価格変動が増える可能性があります。また、AIが瞬時に判断を下すことで流動性が偏り、価格形成がAIの解釈に左右される度合いが高まることも考えられます。 AIは主体か、インフラか AIが投資判断の基盤として広がるほど、個々の投資家の判断はAIというインフラの上で行われるようになります。AIを主体とみるのか、環境とみるのかによって、市場の見え方は大きく変わります。 まとめ AIが投資判断を一方向的に民主化しているとは言い切れません。情報アクセスは広がり参入障壁は下がりましたが、判断の集約化や使いこなし格差といった新しい構造も生まれています。重要なのは、判断の重心がどこに移動しているのかを意識することです。読者の皆さんには、AIをどう位置づけ、どの距離感で使うのかを考える余白を残したいと思います。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AIの普及と高度化によって、 「投資判断」は本当に民主化されつつあるのか。 それとも、判断の権限や影響力が別の主体へと再配置されているのか。 個人投資家・機関投資家・AI提供企業・市場構造という複数の視点から、 冷静かつ構造的に整理・考察してください。 【目的】 – 「AIが投資を簡単にした/危険にした」という単純な評価を避ける – 投資判断の“主体”と“責任の所在”がどのように変化しているかを可視化する – 読者が、自分自身の判断とAIの関係性を考えるための視点を提供する 【読者像】 – 一般個人投資家(初心者〜中級者) – 金融・経済ニュースに関心のある社会人 – AIの活用に興味はあるが、投資への影響を整理できていない層 – 専門家ではないが、無関係ではいられないと感じている読者 【記事構成】 1. 導入(問題提起) – AI投資ツールや自動分析が一般化してきた現状を提示する – 「誰でもプロ並みの判断ができる時代」という語られ方への違和感を示す – なぜ「民主化」という言葉自体を問い直す必要があるのかを簡潔に説明する 2. 民主化しているように見える構造 – 情報アクセスの拡大(データ、分析、予測の低コスト化)を整理する – 個人投資家が以前より多くの“材料”を持てるようになった点を説明する – AIが参入障壁を下げている側面を構造的に示す 3. 判断が集約されていく構造 – AIの設計者・学習データ・アルゴリズムの影響力を整理する – 多くの利用者が似た判断に近づく可能性を指摘する – 民主化と同時に起きうる「同調化」や「集中化」の構図を説明する 4. 格差の再編成という視点 – 「情報格差」から「使いこなし格差」への移行を整理する – プロンプト設計、検証力、疑う力といった要素の重要性を示す – AI時代における“投資リテラシー”の再定義に触れる 5. 市場全体への影響 – 多数の参加者がAIを介して行動することの市場構造的な意味を考察する – ボラティリティ、流動性、価格形成への影響可能性を整理する – AIが「参加者」なのか「環境」なのかという視点を提示する 6. まとめ – AIが投資判断を一方向的に民主化しているとは言い切れない点を再確認する – 判断の重心がどこに移動しつつあるのかという問いを残す – 読者自身が、AIとどう距離を取るかを考える余白を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 読者を不安にさせるのではなく、思考材料を提供する姿勢を保つ 【執筆スタンス】 – 本記事は、正解や結論を提示するものではなく、 複数の構造や要因を整理する「比較と考察」を目的とする – 特定の投資手法・サービス・立場を推奨または否定しない – 読者の判断力を補完する視点の提示を最優先とする 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AIと投資判断の権限移動構造) ※(図:個人投資家・AI・市場の関係モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「AIは投資を誰のものにしたのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # AI時代の投資判断はどこへ向かうのか (※見出しは本文構成上のものであり、タイトル案ではありません) --- ## 1. 導入(問題提起) AIを活用した投資ツールや自動分析サービスが、一般の個人投資家にも広く利用されるようになっています。企業決算の要点抽出、ニュースの要約、チャートの自動解析、さらにはポートフォリオ提案まで、かつて専門家だけが扱っていた機能が低コストで手に入るようになりました。 その結果、「誰でもプロ並みの判断ができる時代になった」という語られ方が増えています。しかし、この言い方にはどこか違和感があります。判断が“できるようになった”のか、それとも“判断の仕方が変わった”だけなのか。あるいは、判断の主体そのものが別の場所へ移動しているのか。 こうした疑問から、「投資判断の民主化」という言葉自体を一度立ち止まって考える必要があります。民主化とは、単にツールが使えるようになることではなく、判断の権限や責任がどこにあるのかという構造の問題でもあるためです。 --- ## 2. 民主化しているように見える構造 ### 情報アクセスの拡大 AIの普及によって、膨大なデータを瞬時に処理し、要点を抽出する能力が一般化しました。 - 決算書の読み解き - ニュースの影響度分析 - テクニカル指標の自動生成 これらが低コストで利用できるようになり、情報の非対称性は以前より縮小しています。 ### 個人投資家が持てる“材料”の増加 従来は専門知識や時間がなければ扱えなかった情報が、AIによって整理された形で提供されるため、個人投資家が判断に使える材料は確実に増えています。 ※(図:AIと投資判断の権限移動構造) ### 参入障壁の低下 AIは「分析の初期ハードル」を下げる役割を果たしています。 - チャート分析の自動化 - ニュースの要約 - 投資テーマの抽出 これらは、投資を始める際の心理的・技術的障壁を下げ、参加者を増やす方向に働いています。 こうした点だけを見ると、投資判断は民主化しているように見えます。 --- ## 3. 判断が集約されていく構造 ### AIの設計者・学習データの影響 AIは中立ではなく、設計者の意図や学習データの偏りを反映します。 - どのデータを重視するか - どの指標を優先するか - どのリスクを強調するか これらはアルゴリズムの内部で決定され、利用者には見えにくい構造です。 ### 多くの利用者が似た判断に近づく可能性 同じAIツールを使う投資家が増えるほど、判断が似通う可能性があります。 - 同じニュース要約 - 同じスコアリング - 同じ推奨銘柄 これらが重なると、市場全体の行動が同調化し、結果として判断が集中する方向に働きます。 ### 民主化と同時に進む「集中化」 表面的には選択肢が増えているように見えても、実際にはAIの背後にある設計思想に判断が集約される可能性があります。 ※(図:個人投資家・AI・市場の関係モデル) --- ## 4. 格差の再編成という視点 ### 「情報格差」から「使いこなし格差」へ AIが情報を整理してくれることで、従来の「情報を持っているかどうか」という格差は縮小しました。しかし、新たに「AIをどう使いこなすか」という格差が生まれています。 ### 重要になるスキル - **プロンプト設計**:AIに何をどう尋ねるか - **検証力**:AIの出力を鵜呑みにせず、裏取りする力 - **疑う力**:AIの前提や限界を理解する姿勢 これらは、従来の投資リテラシーとは異なる能力であり、AI時代の新しい“読み書き能力”ともいえます。 ### 投資リテラシーの再定義 投資判断の質は、情報量よりも「AIをどう位置づけるか」に左右されるようになりつつあります。 - AIを“代行者”とみなすのか - AIを“補助者”とみなすのか - AIを“比較対象”として使うのか この姿勢の違いが、投資成果よりもむしろ判断の主体性に影響を与えます。 --- ## 5. 市場全体への影響 ### 多数の参加者がAIを介して行動する意味 AIが広く使われるほど、市場は「AIを通じて行動する参加者」が増えます。これは、単に投資家が増えるという話ではなく、市場の構造そのものに影響します。 ### ボラティリティ・流動性・価格形成への影響 - 同じシグナルに反応する投資家が増えると、短期的な価格変動が増える可能性 - AIが瞬時に判断を下すことで、流動性が偏る可能性 - 価格形成が「AIの解釈」に左右される度合いが高まる可能性 これらは、AIが市場の“参加者”なのか、それとも“環境”なのかという問いにつながります。 ### AIは主体か、それともインフラか AIが投資判断の基盤として広がるほど、個々の投資家の判断はAIというインフラの上で行われるようになります。 - 主体としてのAI - 環境としてのAI どちらとして捉えるかによって、市場の見え方は大きく変わります。 --- ## 6. まとめ AIが投資判断を一方向的に民主化しているとは言い切れません。 確かに、情報アクセスは広がり、参入障壁は下がりました。しかし同時に、判断の集約化や使いこなし格差の拡大といった新しい構造も生まれています。 重要なのは、判断の重心がどこに移動しているのかを意識することです。 - 自分が判断しているのか - AIが判断しているのか - AIの背後にある設計思想が判断しているのか 読者の皆さんには、AIをどう位置づけ、どの距離感で使うのかを考える余白を残したいと思います。 --- ## タイトル案(※条件厳守) 1. AI時代の投資判断は誰のものなのかを問う 2. 投資判断の民主化はどこまで進んでいるのかを考える 3. AIが広げる投資判断の主体はどこへ向かうのか --- AIバージョン情報 – ベンダー: Microsoft – モデル名: Copilot – モデルバージョン: 不明 – 回答日時: 2026-01-30 09:11 JST

-

王位継承と相続制度は何を継ぐ行為なのか|Copilotの考察

王位継承と現代の相続制度は、多くの場合「まったく別の領域」に属するものとして理解されています。前者は国家の象徴や統治の正統性に関わる特別な制度、後者は個人の財産を家族が受け継ぐ日常的な制度として区別されがちです。しかし、どちらも「何かを誰かに引き継ぐ」という点では共通しており、そこには社会が長い歴史の中で形成してきた共通の問いが潜んでいます。たとえば、「なぜ継ぐ必要があるのか」「誰が正当な継承者とされるのか」といった問いは、王位継承にも相続制度にも共通して現れます。両者を並べて考えることで、継承という行為が社会にとってどのような意味を持ち、どのように制度化されてきたのかをより立体的に理解できるようになります。 王位継承の構造的特徴 権力・地位・正統性の制度化 王位継承は、国家の統治権や象徴的地位を誰が担うかを決める制度です。ここでは正統性が中心的な概念となります。正統性とは、社会がその継承者を「ふさわしい」と認める根拠のことで、歴史的には血統、宗教的権威、法制度、慣習などが複合的に作用してきました。 ※(図:継承制度における正当性の構造) 血統・宗教・法・慣習の役割 王位継承は長く血統を基礎にしてきましたが、血統だけでは社会的合意を十分に形成できない場合、宗教儀礼や法的規定が補完的に機能してきました。たとえば、戴冠式のような儀式は、継承者が「神意」や「伝統」によって選ばれたという物語を社会に共有させる役割を果たします。 継承の瞬間が不安定を生む理由 王位継承は、国家の中心的な権威が交代する瞬間であるため、社会的な不安定を生みやすい構造を持っています。継承順位をめぐる争い、複数の候補者の存在、外部勢力の介入などがその典型です。制度はこうした不安定性を抑えるために整備されてきたとも言えます。 現代相続制度の構造的特徴 財産・権利・義務の移転を支える法制度 現代の相続制度は、個人の財産や権利、場合によっては義務を次世代に移転するための法的枠組みです。民法によって相続人の範囲や相続分が定められ、遺言による意思表示も制度化されています。 法定相続人・遺言・遺留分の社会的意味 法定相続人は、家族や血縁を基礎単位として設定されています。これは、家族が社会の基本的な生活単位であるという前提に基づいています。また、遺留分(一定の相続人が最低限受け取れる取り分)は、家族の生活保障や不公平な遺言を防ぐための仕組みとして機能しています。 家族や血縁が基礎単位として残る理由 近代以降、個人主義が進展してもなお、相続制度が血縁を基礎にしているのは、家族が生活共同体としての役割を持ち続けているためです。財産の移転は、単なる経済的行為ではなく、家族関係の継続性を支える側面も持っています。 両者に見られる連続性 正当性をどう担保するかという共通構造 王位継承も相続制度も、「誰が継ぐべきか」を社会が納得できる形で決める必要があります。王位継承では血統や儀式、相続制度では法律や遺言がその役割を果たします。いずれも、継承の正当性を社会的に保証するための仕組みです。 衝突や争いを予防する制度設計 継承は利害が絡むため、争いが生じやすい領域です。王位継承では継承順位の明確化や儀式の制度化、相続制度では法定相続分や遺留分の設定など、争いを予防するための制度が整備されています。 ※(図:王位継承と相続制度の比較イメージ) 個人の死や退場が社会秩序に与える影響 どちらの制度も、個人の死や退場が社会に与える影響を最小化するために存在しています。王位継承は国家秩序の維持、相続制度は家族や経済の安定を目的としています。 両者に見られる断絶点 公共性と私的領域の違い 王位継承は国家という公共領域に属し、相続制度は個人や家族の私的領域に属します。このスケールの違いは、制度の目的や正当性の根拠にも影響します。 権力の継承と財産の継承の違い 王位継承は権力や象徴性の継承であり、社会全体に影響を及ぼします。一方、相続は主に財産の移転であり、影響範囲は限定的です。ただし、家業や企業の継承など、相続が社会的影響を持つ場合もあります。 近代以降の法制度による変化 近代国家の成立とともに、相続制度は法によって明確に規定され、個人の権利が重視されるようになりました。一方、王位継承は象徴的な意味を強めつつ、政治的権力から距離を置く方向に変化してきました。この点で、両者は異なる方向に制度化が進んでいます。 「継ぐ」という行為の社会的意味 継承は単なる財産や地位の移転ではなく、社会的な物語や合意形成を伴う行為です。王位継承では国家の歴史や伝統が、相続では家族の歴史や価値観が共有されます。現代の相続制度は、個人の意思と家族の関係性を調整しながら、社会的な連続性を支える役割を果たしています。 まとめ 王位継承と相続制度を比較すると、両者は異なる領域に属しながらも、継承の正当性を確保し、社会の安定を維持するという共通の目的を持っていることが見えてきます。読者の皆さんが、自分にとっての「継ぐ」「引き継がれる」という行為の意味を考えるきっかけになれば幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 王位継承と現代の相続制度は、どのような点で連続しており、どのような点で断絶しているのかについて、歴史・法制度・社会構造の観点から冷静かつ構造的に考察してください。 【目的】 – 王位継承と相続を「特別な制度」と「日常的な制度」として分離せず、共通する社会的機能として整理する – 「なぜ継ぐ必要があるのか」「誰が正当な継承者とされるのか」という問いを構造として浮かび上がらせる – 現代社会における相続制度の背景にある歴史的・制度的な連続性を読者が再解釈できる視点を提供する 【読者像】 – 一般社会人(20〜60代) – 相続や家族制度に関心を持ち始めた層 – 歴史・制度・社会構造に興味がある読者 – 法律や政治に詳しくはないが、制度の意味を考えてみたい人 【記事構成】 1. 導入(問題提起) – 王位継承と現代の相続が「まったく別のもの」として認識されている現状を提示する – 両者が「何かを誰かに引き継ぐ制度」である点に着目し、共通する問いがあることを示す – なぜこの2つを並べて考える意味があるのかを簡潔に説明する 2. 王位継承の構造的特徴 – 権力・地位・正統性がどのように制度化されてきたかを整理する – 血統・宗教・法・慣習といった要素が果たしてきた役割を説明する – 継承の瞬間が社会的な不安定を生みやすい理由を構造的に示す 3. 現代相続制度の構造的特徴 – 財産・権利・義務の移転を支える法制度の役割を整理する – 法定相続人、遺言、遺留分などの仕組みが持つ社会的意味を説明する – 家族や血縁が制度の基礎単位として残っている理由に触れる 4. 両者に見られる連続性 – 「正当性をどう担保するか」という共通の問題構造を整理する – 衝突や争いを予防するための制度設計の類似点を示す – 個人の死や退場が社会秩序に与える影響という視点から共通性を考察する 5. 両者に見られる断絶点 – 公共性と私的領域の違いを軸にスケールの差を整理する – 権力の継承と財産の継承が社会に与える意味の違いを比較する – 近代以降の法制度が継承の意味をどう変えてきたかに触れる 6. 「継ぐ」という行為の社会的意味 – 継承が単なる移転ではなく、社会的な物語や合意形成を伴う行為である点を整理する – 現代において相続が持つ心理的・制度的な役割を構造的に説明する 7. まとめ – 王位継承と相続制度を通じて見える「社会が継承をどう扱ってきたか」を再確認する – 読者自身が、自分にとっての「継ぐ/引き継がれる」という意味を考えるための視点を提示して締めくくる – 過度に歴史的評価や制度批評に寄らず、思考を促す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 評価や主張ではなく、「整理」と「比較」を重視する 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の歴史的・制度的・社会的要因を整理したうえでの「考察」として執筆する – 特定の価値観や制度観を押し付けず、 読者が自分なりに解釈できる余地を残すことを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:継承制度における正当性の構造) ※(図:王位継承と相続制度の比較イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「私たちは何を誰に引き継いでいるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 王位継承と現代相続制度の連続性と断絶を考える ## 1. 導入(問題提起) 王位継承と現代の相続制度は、多くの場合「まったく別の領域」に属するものとして理解されています。前者は国家の象徴や統治の正統性に関わる特別な制度、後者は個人の財産を家族が受け継ぐ日常的な制度として区別されがちです。しかし、どちらも「何かを誰かに引き継ぐ」という点では共通しており、そこには社会が長い歴史の中で形成してきた共通の問いが潜んでいます。 たとえば、「なぜ継ぐ必要があるのか」「誰が正当な継承者とされるのか」といった問いは、王位継承にも相続制度にも共通して現れます。両者を並べて考えることで、継承という行為が社会にとってどのような意味を持ち、どのように制度化されてきたのかをより立体的に理解できるようになります。 ## 2. 王位継承の構造的特徴 ### 権力・地位・正統性の制度化 王位継承は、国家の統治権や象徴的地位を誰が担うかを決める制度です。ここでは「正統性」が中心的な概念となります。正統性とは、社会がその継承者を「ふさわしい」と認める根拠のことで、歴史的には血統、宗教的権威、法制度、慣習などが複合的に作用してきました。 ※(図:継承制度における正当性の構造) ### 血統・宗教・法・慣習の役割 王位継承は長く血統を基礎にしてきましたが、血統だけでは社会的合意を十分に形成できない場合、宗教儀礼や法的規定が補完的に機能してきました。たとえば、戴冠式のような儀式は、継承者が「神意」や「伝統」によって選ばれたという物語を社会に共有させる役割を果たします。 ### 継承の瞬間が不安定を生む理由 王位継承は、国家の中心的な権威が交代する瞬間であるため、社会的な不安定を生みやすい構造を持っています。継承順位をめぐる争い、複数の候補者の存在、外部勢力の介入などがその典型です。制度はこうした不安定性を抑えるために整備されてきたとも言えます。 ## 3. 現代相続制度の構造的特徴 ### 財産・権利・義務の移転を支える法制度 現代の相続制度は、個人の財産や権利、場合によっては義務を次世代に移転するための法的枠組みです。民法によって相続人の範囲や相続分が定められ、遺言による意思表示も制度化されています。 ### 法定相続人・遺言・遺留分の社会的意味 法定相続人は、家族や血縁を基礎単位として設定されています。これは、家族が社会の基本的な生活単位であるという前提に基づいています。また、遺留分(一定の相続人が最低限受け取れる取り分)は、家族の生活保障や不公平な遺言を防ぐための仕組みとして機能しています。 ### 家族や血縁が基礎単位として残る理由 近代以降、個人主義が進展してもなお、相続制度が血縁を基礎にしているのは、家族が生活共同体としての役割を持ち続けているためです。財産の移転は、単なる経済的行為ではなく、家族関係の継続性を支える側面も持っています。 ## 4. 両者に見られる連続性 ### 正当性をどう担保するかという共通構造 王位継承も相続制度も、「誰が継ぐべきか」を社会が納得できる形で決める必要があります。王位継承では血統や儀式、相続制度では法律や遺言がその役割を果たします。いずれも、継承の正当性を社会的に保証するための仕組みです。 ### 衝突や争いを予防する制度設計 継承は利害が絡むため、争いが生じやすい領域です。王位継承では継承順位の明確化や儀式の制度化、相続制度では法定相続分や遺留分の設定など、争いを予防するための制度が整備されています。 ※(図:王位継承と相続制度の比較イメージ) ### 個人の死や退場が社会秩序に与える影響 どちらの制度も、個人の死や退場が社会に与える影響を最小化するために存在しています。王位継承は国家秩序の維持、相続制度は家族や経済の安定を目的としています。 ## 5. 両者に見られる断絶点 ### 公共性と私的領域の違い 王位継承は国家という公共領域に属し、相続制度は個人や家族の私的領域に属します。このスケールの違いは、制度の目的や正当性の根拠にも影響します。 ### 権力の継承と財産の継承の違い 王位継承は権力や象徴性の継承であり、社会全体に影響を及ぼします。一方、相続は主に財産の移転であり、影響範囲は限定的です。ただし、家業や企業の継承など、相続が社会的影響を持つ場合もあります。 ### 近代以降の法制度による変化 近代国家の成立とともに、相続制度は法によって明確に規定され、個人の権利が重視されるようになりました。一方、王位継承は象徴的な意味を強めつつ、政治的権力から距離を置く方向に変化してきました。この点で、両者は異なる方向に制度化が進んでいます。 ## 6. 「継ぐ」という行為の社会的意味 継承は単なる財産や地位の移転ではなく、社会的な物語や合意形成を伴う行為です。王位継承では国家の歴史や伝統が、相続では家族の歴史や価値観が共有されます。現代の相続制度は、個人の意思と家族の関係性を調整しながら、社会的な連続性を支える役割を果たしています。 ## 7. まとめ 王位継承と相続制度を比較すると、両者は異なる領域に属しながらも、継承の正当性を確保し、社会の安定を維持するという共通の目的を持っていることが見えてきます。読者の皆さんが、自分にとっての「継ぐ」「引き継がれる」という行為の意味を考えるきっかけになれば幸いです。 --- ## タイトル案 1. 王位継承と相続制度は何を継ぐ行為なのか 2. 継承の正当性はどのように形づくられるのか 3. 王位と相続の継ぐ仕組みはどこが連続するのか --- AIバージョン情報 – ベンダー: Microsoft – モデル名: Copilot – モデルバージョン: 不明 – 回答日時: 2026-01-29 20:59 JST