近年、「副業解禁」「副業で収入を増やす」といった言葉をよく耳にするようになりました。政府の働き方改革や、大手企業による副業容認の流れを受け、副業は「現代的な新しい働き方」として語られることが増えています。しかし、少し立ち止まって考えてみると、「本業以外の仕事で収入を得る」という行為そのものは、決して現代に始まったことではありません。かつての日本社会には「内職」という言葉があり、多くの人が本業の傍らで何らかの仕事をこなしてきました。では、「内職」と「副業」は同じものなのでしょうか。それとも、言葉が違うように、社会的な意味や構造も異なるのでしょうか。本記事では、副業と内職の違いを単なる言葉の問題としてではなく、それぞれが生まれた社会構造の違いとして整理していきます。 内職とは何だったのか 農村・家内工業から始まった「余剰労働」 「内職」という概念は、近代以前から日本社会に存在していました。農村では、農閑期(農作業の少ない時期)に副収入を得るための手仕事が広く行われていました。草履づくり、機織り、竹細工といった作業がその代表です。これらは、農業という「本業」が休止している期間の「余剰労働力」を活用する手段でした。 産業化が進む明治・大正・昭和期には、工場の下請けとして部品の組み立てや縫製を自宅で行う「家内工業」的な内職が広がりました。問屋や工場から材料を受け取り、自宅で加工して納品するという形態です。 内職の社会的位置づけ 内職の特徴を整理すると、以下のような傾向が見えてきます。 担い手の属性:主に農家の女性・主婦・低賃金層など、正規の労働市場に参加しにくい層が中心だった 収入の性格:家計の補助であり、生活費の「足し」という位置づけが強かった 労働の主体性:発注元(問屋・工場)から仕事を受ける「受け身型」の労働が多く、自分で仕事を開拓する性格は薄かった 市場との距離:最終的な消費者や市場とは直接つながらず、中間業者を通じた間接的な関係にあった つまり内職とは、正規の賃金労働の「外側」に位置しながら、既存の生産構造に従属する形で行われる補助的労働として社会に組み込まれていた、と整理できます。 現代の副業の特徴 プラットフォームが変えた労働の構造 現代の副業を特徴づける最大の要因のひとつが、インターネットとデジタルプラットフォームの存在です。クラウドソーシングサービス、フリーランスマッチングサービス、動画配信・情報発信プラットフォームなどの登場により、個人が直接「市場」と接続できるようになりました。 かつての内職では、問屋や工場という「仲介者」を通じてしか仕事にアクセスできませんでしたが、現代では個人がスキルや知識を直接販売できる環境が整っています。 副業の多様な目的 現代の副業は、その目的においても内職とは異なる広がりを持っています。 収入補完型:本業の給与だけでは不足する生活費を補う目的(内職に近い性格) スキル開発型:本業とは異なる分野でのスキルを磨く、キャリア形成の手段として 独立準備型:将来的なフリーランス・起業を見据えた「助走」としての副業 自己実現型:収入よりも、趣味や関心を仕事にすることへの動機 副業は、家計補助という単一の目的ではなく、個人のキャリアや人生設計と連動した選択肢になりつつあります。 副業と内職の共通点と違い 共通点:「本業以外の労働」という構造 両者に共通するのは、何らかの「本業」(農業・会社勤めなど)を前提としたうえで、その傍らで行われる労働という点です。また、収入を得るという経済的な動機も共通しています。労働力が余剰となる時間や状況を活用するという発想も、形を変えながら受け継がれています。 違い:労働の主体性と市場との関係 一方で、両者の違いは次のような軸で整理できます。 市場との関係:内職は仲介業者を介した間接的関係/現代の副業はプラットフォームを通じた直接接続も可能 労働の主体性:内職は発注を受ける受動的な側面が強い/現代の副業は自ら仕事を開拓・提案する能動的側面も 収入の性格:内職は家計補助・余剰収入/現代の副業は収入補完から独立資金・自己実現まで多様 担い手の属性:内職は正規労働市場から外れた層が中心/現代の副業は正規雇用者が積極的に参加する場合も キャリアとの関係:内職は本業キャリアとは切り離されやすい/現代の副業は本業キャリアとの接続・転換を意識する場合も 「現代の副業の中にも内職的な労働は存在する」 ただし、現代の副業がすべてこのような「主体的・キャリア志向型」かといえば、そうとも言い切れません。クラウドソーシングでの単価の低いデータ入力作業や、配送プラットフォームでのギグワークなどは、構造的には「デジタル化した内職」に近い性格を持っているという見方もできます。 テクノロジーが変わっても、低スキル・低賃金・受注依存という労働の構造が形を変えて再生産されている側面は、副業の現実を考えるうえで見落とせない視点です。 まとめ:「働き方の変化」を長期的に捉えるために 副業は、単に「時代のトレンド」や「新しい働き方」として現れたわけではありません。本業を前提とした補完的な労働という形は、内職という形で歴史的に存在していました。 しかし現代の副業は、デジタルプラットフォームの登場、個人のスキルの市場化、キャリア形成との接続という点で、かつての内職とは異なる構造的条件のもとで展開されています。一方で、その中には依然として内職的な労働の性格を持つものも含まれており、現代の副業を一括りに語ることには注意が必要です。 副業と内職の変遷を見ることは、「働くとはどういうことか」「個人と市場の関係はどう変わってきたのか」という、より根本的な問いを考えるための入口になるかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 現代で広く使われる「副業」という概念は、 歴史的に存在していた「内職」とどのように違うのか。 労働・社会構造・経済の観点から整理・考察してください。 【目的】 – 「副業ブーム」という表面的な現象ではなく、歴史的・構造的な視点から労働の変化を整理する – 現代の副業が、過去の内職と同じものなのか、それとも異なる社会構造の産物なのかを考える材料を提示する – 読者が「働き方の変化」を長期的な視点で理解するための視点を提供する 【読者像】 – 一般社会人(20〜50代) – 副業に関心がある会社員 – フリーランスや個人事業に興味がある人 – 働き方の変化を社会構造の観点から考えたい読者 【記事構成】 1. 導入(問題提起) – 近年「副業」が広く語られるようになった背景を提示する – 副業は新しい働き方のように語られるが、歴史的には「内職」という似た概念が存在していたことに触れる – 本記事では、副業と内職の違いを単なる言葉の違いではなく、社会構造の違いとして整理することを示す 2. 内職とは何だったのか – 歴史的に「内職」がどのような労働形態だったのかを説明する – 農家の副収入、家内工業、工場の下請けなどの具体例に触れる – 内職が社会の中でどのような位置づけの労働だったのかを整理する – 家計補助・余剰労働という特徴を説明する 3. 現代の副業の特徴 – 現代の副業がどのような形で広がっているのかを整理する – インターネットやプラットフォームの存在が労働構造をどのように変えたのかを説明する – 副業が単なる家計補助ではなく、キャリア形成や独立につながる可能性を持つ点に触れる 4. 副業と内職の共通点と違い – 両者の共通点(本業以外の労働)を整理する – 市場との関係、収入構造、労働の主体性などの違いを構造的に整理する – 「現代の副業の中にも内職的な労働が存在する」という視点にも触れる 5. まとめ – 副業は単なる新しい流行ではなく、社会構造の変化の中で生まれた働き方である可能性を整理する – 副業と内職の違いを理解することで、現代の働き方の変化をより広い視点で捉えられることを示す – 読者が「働くとは何か」を考えるきっかけとして締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:内職と副業の労働構造の違い) ※(図:近代労働と現代の副業市場の構造) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「副業は本当に新しい働き方なのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 「内職」と「副業」は何が違うのか——労働構造の変化から考える --- ## 1. 導入:「副業ブーム」の背景にある問い 近年、「副業解禁」「副業で収入を増やす」といった言葉をよく耳にするようになりました。政府の働き方改革や、大手企業による副業容認の流れを受け、副業は「現代的な新しい働き方」として語られることが増えています。 しかし、少し立ち止まって考えてみると、「本業以外の仕事で収入を得る」という行為そのものは、決して現代に始まったことではありません。かつての日本社会には「内職」という言葉があり、多くの人が本業の傍らで何らかの仕事をこなしてきました。 では、「内職」と「副業」は同じものなのでしょうか。それとも、言葉が違うように、社会的な意味や構造も異なるのでしょうか。本記事では、副業と内職の違いを単なる言葉の問題としてではなく、それぞれが生まれた社会構造の違いとして整理していきます。 --- ## 2. 内職とは何だったのか ### 農村・家内工業から始まった「余剰労働」 「内職」という概念は、近代以前から日本社会に存在していました。農村では、農閑期(農作業の少ない時期)に副収入を得るための手仕事が広く行われていました。草履づくり、機織り、竹細工といった作業がその代表です。これらは、農業という「本業」が休止している期間の「余剰労働力」を活用する手段でした。 産業化が進む明治・大正・昭和期には、工場の下請けとして部品の組み立てや縫製を自宅で行う「家内工業」的な内職が広がりました。問屋や工場から材料を受け取り、自宅で加工して納品するという形態です。 ### 内職の社会的位置づけ 内職の特徴を整理すると、以下のような傾向が見えてきます。 - **担い手の属性**:主に農家の女性・主婦・低賃金層など、正規の労働市場に参加しにくい層が中心だった - **収入の性格**:家計の補助であり、生活費の「足し」という位置づけが強かった - **労働の主体性**:発注元(問屋・工場)から仕事を受ける「受け身型」の労働が多く、自分で仕事を開拓する性格は薄かった - **市場との距離**:最終的な消費者や市場とは直接つながらず、中間業者を通じた間接的な関係にあった ※(図:内職と副業の労働構造の違い) つまり内職とは、正規の賃金労働の「外側」に位置しながら、既存の生産構造に従属する形で行われる補助的労働として社会に組み込まれていた、と整理できます。 --- ## 3. 現代の副業の特徴 ### プラットフォームが変えた労働の構造 現代の副業を特徴づける最大の要因のひとつが、インターネットとデジタルプラットフォームの存在です。クラウドソーシングサービス、フリーランスマッチングサービス、動画配信・情報発信プラットフォームなどの登場により、個人が直接「市場」と接続できるようになりました。 かつての内職では、問屋や工場という「仲介者」を通じてしか仕事にアクセスできませんでしたが、現代では個人がスキルや知識を直接販売できる環境が整っています。 ### 副業の多様な目的 現代の副業は、その目的においても内職とは異なる広がりを持っています。 - **収入補完型**:本業の給与だけでは不足する生活費を補う目的(内職に近い性格) - **スキル開発型**:本業とは異なる分野でのスキルを磨く、キャリア形成の手段として - **独立準備型**:将来的なフリーランス・起業を見据えた「助走」としての副業 - **自己実現型**:収入よりも、趣味や関心を仕事にすることへの動機 副業は、家計補助という単一の目的ではなく、個人のキャリアや人生設計と連動した選択肢になりつつあります。 --- ## 4. 副業と内職の共通点と違い ### 共通点:「本業以外の労働」という構造 両者に共通するのは、何らかの「本業」(農業・会社勤めなど)を前提としたうえで、その傍らで行われる労働という点です。また、収入を得るという経済的な動機も共通しています。労働力が余剰となる時間や状況を活用するという発想も、形を変えながら受け継がれています。 ### 違い:労働の主体性と市場との関係 一方で、両者の違いは次のような軸で整理できます。 | 比較軸 | 内職 | 現代の副業 | |---|---|---| | 市場との関係 | 仲介業者を介した間接的関係 | プラットフォームを通じた直接接続も可能 | | 労働の主体性 | 発注を受ける受動的な側面が強い | 自ら仕事を開拓・提案する能動的側面も | | 収入の性格 | 家計補助・余剰収入 | 収入補完から独立資金・自己実現まで多様 | | 担い手の属性 | 正規労働市場から外れた層が中心 | 正規雇用者が積極的に参加する場合も | | キャリアとの関係 | 本業キャリアとは切り離されやすい | 本業キャリアとの接続・転換を意識する場合も | ※(図:近代労働と現代の副業市場の構造) ### 「現代の副業の中にも内職的な労働は存在する」 ただし、現代の副業がすべてこのような「主体的・キャリア志向型」かといえば、そうとも言い切れません。クラウドソーシングでの単価の低いデータ入力作業や、配送プラットフォームでのギグワークなどは、構造的には「デジタル化した内職」に近い性格を持っているという見方もできます。 テクノロジーが変わっても、低スキル・低賃金・受注依存という労働の構造が形を変えて再生産されている側面は、副業の現実を考えるうえで見落とせない視点です。 --- ## 5. まとめ:「働き方の変化」を長期的に捉えるために 副業は、単に「時代のトレンド」や「新しい働き方」として現れたわけではありません。本業を前提とした補完的な労働という形は、内職という形で歴史的に存在していました。 しかし現代の副業は、デジタルプラットフォームの登場、個人のスキルの市場化、キャリア形成との接続という点で、かつての内職とは異なる構造的条件のもとで展開されています。一方で、その中には依然として内職的な労働の性格を持つものも含まれており、現代の副業を一括りに語ることには注意が必要です。 副業と内職の変遷を見ることは、「働くとはどういうことか」「個人と市場の関係はどう変わってきたのか」という、より根本的な問いを考えるための入口になるかもしれません。 --- ## タイトル案 1. 「副業」と「内職」は何が違う働き方なのか 2. 内職から副業へ、労働の補完という行為はどう変わったのか 3. 現代の副業は歴史の中でどんな位置にある労働なのか --- AIバージョン情報 - ベンダー: Anthropic - モデル名: Claude - モデルバージョン: Claude Sonnet 4.6 - 回答日時: 2026年3月15日

Claude

-

内職から副業へ、労働の補完という行為はどう変わったのか|Claudeの考察

-

WBCは野球文化を世界に広げる大会になれるのか|Claudeの考察

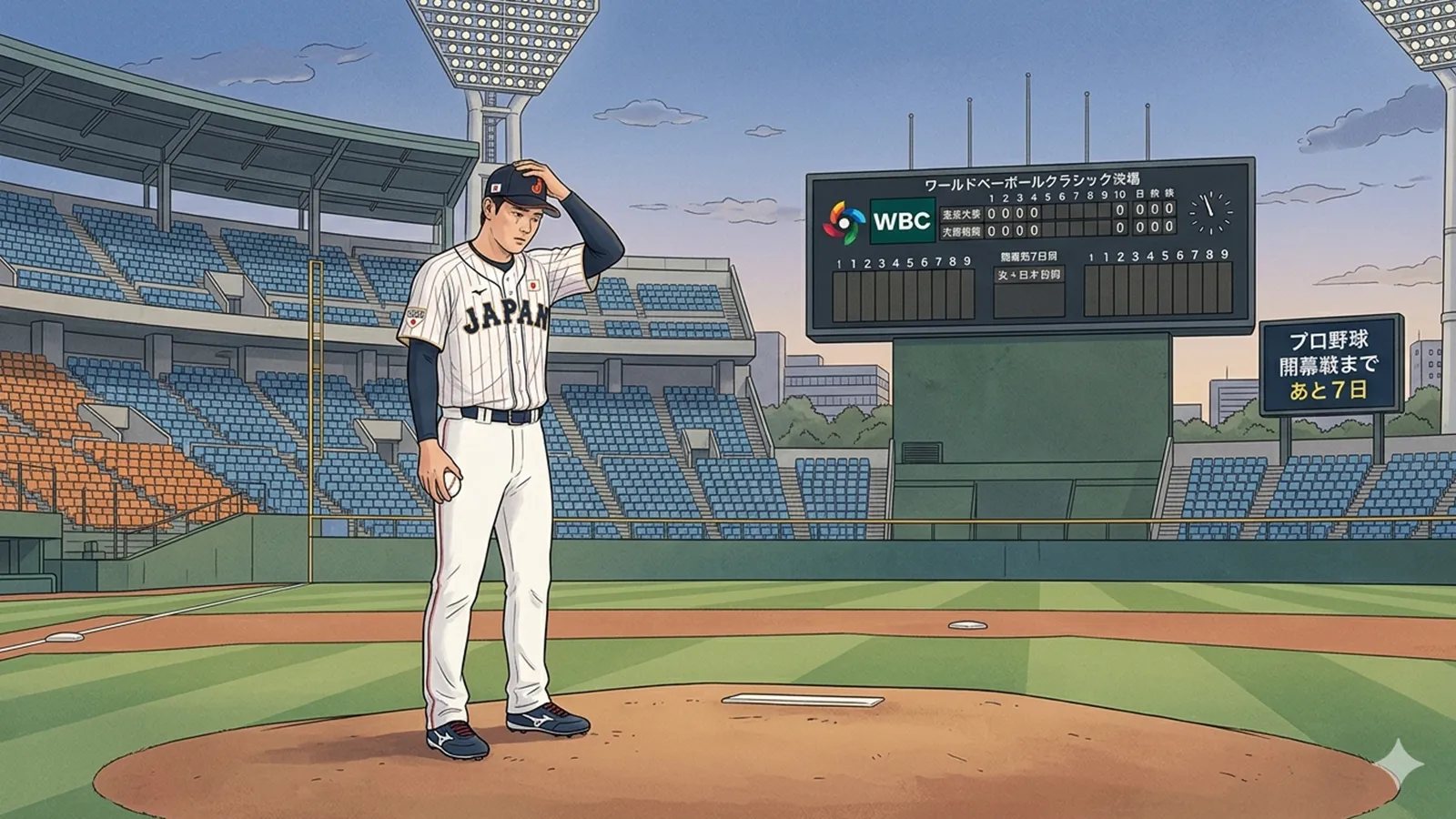

2023年のワールド・ベースボール・クラシック(WBC)は、日本中を熱狂させました。大谷翔平選手や村上宗隆選手などのスター選手が国家の代表として集い、決勝戦の視聴率は記録的な数字を叩き出しました。SNSでも連日トレンド入りし、「野球の世界大会」として広く認知された大会となっています。しかし、少し立ち止まって考えてみると、自然と湧き上がる疑問があります。WBCは、サッカーのワールドカップやオリンピックと同じ意味での「世界大会」なのでしょうか。そもそも、スポーツにおける「グローバルブランド」とはどのような条件を満たしたものを指すのでしょうか。本記事では、WBCをスポーツビジネスや文化の視点から構造的に整理し、読者がこの大会の位置づけを多角的に考えるための材料を提供します。 グローバルスポーツブランドの条件 ブランドを構成する要素とは スポーツ大会が「グローバルブランド」として機能するためには、いくつかの条件が重なる必要があります。 競技人口と地理的分布:その競技がどれだけ多くの国・地域でプレーされているか 市場規模と経済的影響力:放映権・スポンサー・グッズなどの収益規模 歴史と継続性:大会の積み重ねが生む信頼性と物語 スター選手の存在:競技の顔となる選手が大会に参加しているか 制度的な正当性:国際機関や各競技のリーグとの関係 サッカーWCとオリンピックが示す構造 サッカーのFIFAワールドカップは、200以上の国・地域が参加する予選を経て本大会が開催されます。競技人口は世界で2億人以上とも言われ、欧州・南米・アフリカ・アジアなど全大陸にわたって競技が根付いています。オリンピックは競技そのものではなく「祭典」としての普遍的価値を持ち、国際オリンピック委員会(IOC)という強固な制度的基盤を持ちます。こうした大会と比較したとき、WBCはどのような位置にあるのでしょうか。 WBCが持つブランド形成の要素 国家代表という構造が生む物語 WBCの大きな特徴のひとつは、「国家代表」という形式です。普段はライバル関係にある選手たちが同じユニフォームを着て戦う構図は、強烈な感情的共鳴を生みます。日本代表の場合、メジャーリーガーとNPBの選手が同じチームに立つ光景は、国内のファン層を横断して熱狂を生み出しました。 スター選手の参加と大会価値 2023年大会では、大谷翔平・ダルビッシュ有(日本)、マイク・トラウト(アメリカ)、フランシス・マルティス(ドミニカ共和国)など、世界トップレベルの選手が揃いました。スター選手の存在は大会の価値を直接的に高め、メディア露出や視聴率に大きく影響します。 メディアと視聴率の拡大 2023年のWBC決勝(日本対アメリカ)は、日本国内で42.4%の瞬間最高視聴率を記録したと報じられました。アメリカでも、近年の大会と比較して視聴者数が伸びており、国際的関心の高まりは数値としても現れています。 WBCが抱える構造的な課題 野球の地理的な偏在 野球という競技は、その普及が特定の地域に偏っています。主要な野球市場は、北米(アメリカ・カナダ)、東アジア(日本・韓国・台湾)、カリブ海・中南米(ドミニカ共和国・キューバ・ベネズエラなど)に集中しており、ヨーロッパや中東・アフリカでの競技人口は限定的です。この地理的な偏在は、WBCが「世界大会」を名乗る上での根本的な課題です。 リーグと代表大会の利害関係 サッカーにはFIFAという統括団体があり、各国リーグはFIFAの管轄下で国際Aマッチデー(代表戦のための中断期間)が制度化されています。一方、野球のWBCはMLB(メジャーリーグベースボール)のシーズン前に開催されており、選手の疲労リスクや怪我への懸念から、出場を制限するチームも存在します。リーグと代表大会の制度的統合という点で、WBCはまだ発展途上です。 歴史の浅さと継続性の課題 WBCが初めて開催されたのは2006年のことです。サッカーWCが1930年から続く歴史を持つのと比較すると、わずか20年程度の歴史しかありません。また、大会は4年に1度の開催であり、ブランドが積み重なるサイクルも限られています。 WBCは何を目指す大会なのか 国家対抗イベントとしての側面 WBCの参加国・地域は現在20チームです。各国の誇りをかけた対戦という形式は、強いナショナリズムと感情的エネルギーを生み出します。これはブランド形成において非常に強力な要素ですが、同時にその熱狂が特定の国や地域に集中しやすいという構造にもつながります。 野球市場拡大の戦略としての側面 MLBはWBCを、野球市場のグローバル拡大のための戦略的プラットフォームとして位置づけていると考えられます。ヨーロッパや新興市場への普及を図りながら、既存の強豪国の熱狂を維持する——という二重の目的が見えます。 スポーツブランド形成のプロセスとして スポーツの国際ブランドは、一夜にして形成されるものではありません。サッカーWCも、初期の数十年はヨーロッパと南米を中心とした大会でした。WBCは現時点では「地域的な熱狂を持つ国際大会」という段階にあると整理できます。ブランド形成の途上にあるのか、あるいは構造的な限界があるのか——それはこれからの大会が積み重ねる歴史によって決まるでしょう。 まとめ:問いを持ち続けることの意味 WBCは「失敗した大会」でも「完成されたグローバルブランド」でもありません。野球という競技の地理的・文化的な特性を持ちながら、国家代表の物語性とスター選手の存在によって大きな熱狂を生み出している大会です。 グローバルスポーツブランドの条件と照らし合わせると、WBCは一部の要素を強く持ちながら、他の要素では課題を抱えています。それは「現在進行形のプロセス」として捉えるのが最も正確かもしれません。 スポーツ大会の価値は、視聴率やビジネス規模だけでは測れません。人々が熱狂し、記憶し、語り継ぐ——そのサイクルが積み重なったとき、ブランドは形成されていきます。WBCが今後どのような歴史を刻むか、私たちは観客であり証人でもあります。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 ワールド・ベースボール・クラシック(WBC)は、 世界的なスポーツブランドを形成する大会になり得るのか、 それとも地域的な人気イベントとして位置づく大会なのかについて、 スポーツビジネス・文化・歴史・市場構造の視点から整理・考察してください。 【目的】 – WBCを単なるスポーツ大会としてではなく、「スポーツブランド形成」という視点から読み解く – 国際大会・リーグ・市場の関係を整理し、スポーツのグローバル化の構造を理解する – 読者がスポーツとビジネス、文化の関係を多角的に考えるための視点を提供する 【読者像】 – 一般のスポーツファン – 野球に関心のある読者 – スポーツビジネスや国際大会の構造に興味のある人 – WBCの盛り上がりを感じつつも、その位置づけを知りたい読者 【記事構成】 1. 導入(問題提起) – WBCが近年大きな注目を集めている国際大会であることを説明する – なぜこの大会が「世界大会」として語られるのかという疑問を提示する – スポーツにおける「グローバルブランド」とは何かという視点を簡潔に提示する 2. グローバルスポーツブランドの条件 – スポーツ大会が世界的ブランドになるための条件を整理する – 競技人口、市場規模、歴史、スター選手、継続性などの要素を説明する – サッカーのワールドカップやオリンピックなどの国際大会と比較しながら整理する 3. WBCが持つブランド形成の要素 – 国家代表という構造が生み出す物語性 – スター選手の参加による大会価値 – MLBなどのリーグとの関係 – メディア・視聴率・国際的関心の拡大などを整理する 4. WBCが抱える構造的な課題 – 野球競技の地域的な広がり – リーグと代表大会の利害関係 – 大会の歴史の浅さ – 国際大会としての制度設計などを整理する 5. WBCは何を目指す大会なのか – 国家対抗イベントとしての側面 – 野球市場拡大の戦略としての側面 – スポーツブランド形成のプロセスとしての位置づけを考察する 6. まとめ – WBCを単純に「成功」「失敗」と評価するのではなく、 スポーツの国際化と市場拡張の中でどのような位置にあるのかを整理する – 読者がスポーツ大会の意味を構造的に考えるための視点を提示して締めくくる – 過度に楽観・悲観せず、思考を促す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「結論を押し付ける記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:スポーツ大会のグローバルブランド形成構造) ※(図:リーグと国際大会の関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「WBCは野球の世界ブランドを生み出す大会なのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # WBCはスポーツの国際ブランドたり得るのか ## 1. 問題提起:「世界大会」という言葉の重さ 2023年のワールド・ベースボール・クラシック(WBC)は、日本中を熱狂させました。大谷翔平選手や村上宗隆選手などのスター選手が国家の代表として集い、決勝戦の視聴率は記録的な数字を叩き出しました。SNSでも連日トレンド入りし、「野球の世界大会」として広く認知された大会となっています。 しかし、少し立ち止まって考えてみると、自然と湧き上がる疑問があります。WBCは、サッカーのワールドカップやオリンピックと同じ意味での「世界大会」なのでしょうか。そもそも、スポーツにおける「グローバルブランド」とはどのような条件を満たしたものを指すのでしょうか。 本記事では、WBCをスポーツビジネスや文化の視点から構造的に整理し、読者がこの大会の位置づけを多角的に考えるための材料を提供します。 --- ## 2. グローバルスポーツブランドの条件 ### ブランドを構成する要素とは スポーツ大会が「グローバルブランド」として機能するためには、いくつかの条件が重なる必要があります。 - **競技人口と地理的分布**:その競技がどれだけ多くの国・地域でプレーされているか - **市場規模と経済的影響力**:放映権・スポンサー・グッズなどの収益規模 - **歴史と継続性**:大会の積み重ねが生む信頼性と物語 - **スター選手の存在**:競技の顔となる選手が大会に参加しているか - **制度的な正当性**:国際機関や各競技のリーグとの関係 ### サッカーWCとオリンピックが示す構造 サッカーのFIFAワールドカップは、200以上の国・地域が参加する予選を経て本大会が開催されます。競技人口は世界で2億人以上とも言われ、欧州・南米・アフリカ・アジアなど全大陸にわたって競技が根付いています。オリンピックは競技そのものではなく「祭典」としての普遍的価値を持ち、国際オリンピック委員会(IOC)という強固な制度的基盤を持ちます。 ※(図:スポーツ大会のグローバルブランド形成構造) こうした大会と比較したとき、WBCはどのような位置にあるのでしょうか。 --- ## 3. WBCが持つブランド形成の要素 ### 国家代表という構造が生む物語 WBCの大きな特徴のひとつは、「国家代表」という形式です。普段はライバル関係にある選手たちが同じユニフォームを着て戦う構図は、強烈な感情的共鳴を生みます。日本代表の場合、メジャーリーガーとNPBの選手が同じチームに立つ光景は、国内のファン層を横断して熱狂を生み出しました。 ### スター選手の参加と大会価値 2023年大会では、大谷翔平・ダルビッシュ有(日本)、マイク・トラウト(アメリカ)、フランシス・マルティス(ドミニカ共和国)など、世界トップレベルの選手が揃いました。スター選手の存在は大会の価値を直接的に高め、メディア露出や視聴率に大きく影響します。 ### メディアと視聴率の拡大 2023年のWBC決勝(日本対アメリカ)は、日本国内で42.4%の瞬間最高視聴率を記録したと報じられました。アメリカでも、近年の大会と比較して視聴者数が伸びており、国際的関心の高まりは数値としても現れています。 --- ## 4. WBCが抱える構造的な課題 ### 野球の地理的な偏在 野球という競技は、その普及が特定の地域に偏っています。主要な野球市場は、北米(アメリカ・カナダ)、東アジア(日本・韓国・台湾)、カリブ海・中南米(ドミニカ共和国・キューバ・ベネズエラなど)に集中しており、ヨーロッパや中東・アフリカでの競技人口は限定的です。この地理的な偏在は、WBCが「世界大会」を名乗る上での根本的な課題です。 ### リーグと代表大会の利害関係 ※(図:リーグと国際大会の関係) サッカーにはFIFAという統括団体があり、各国リーグはFIFAの管轄下で国際Aマッチデー(代表戦のための中断期間)が制度化されています。一方、野球のWBCはMLB(メジャーリーグベースボール)のシーズン前に開催されており、選手の疲労リスクや怪我への懸念から、出場を制限するチームも存在します。リーグと代表大会の制度的統合という点で、WBCはまだ発展途上です。 ### 歴史の浅さと継続性の課題 WBCが初めて開催されたのは2006年のことです。サッカーWCが1930年から続く歴史を持つのと比較すると、わずか20年程度の歴史しかありません。また、大会は4年に1度の開催であり、ブランドが積み重なるサイクルも限られています。 --- ## 5. WBCは何を目指す大会なのか ### 国家対抗イベントとしての側面 WBCの参加国・地域は現在20チームです。各国の誇りをかけた対戦という形式は、強いナショナリズムと感情的エネルギーを生み出します。これはブランド形成において非常に強力な要素ですが、同時にその熱狂が特定の国や地域に集中しやすいという構造にもつながります。 ### 野球市場拡大の戦略としての側面 MLBはWBCを、野球市場のグローバル拡大のための戦略的プラットフォームとして位置づけていると考えられます。ヨーロッパや新興市場への普及を図りながら、既存の強豪国の熱狂を維持する——という二重の目的が見えます。 ### スポーツブランド形成のプロセスとして スポーツの国際ブランドは、一夜にして形成されるものではありません。サッカーWCも、初期の数十年はヨーロッパと南米を中心とした大会でした。WBCは現時点では「地域的な熱狂を持つ国際大会」という段階にあると整理できます。ブランド形成の途上にあるのか、あるいは構造的な限界があるのか——それはこれからの大会が積み重ねる歴史によって決まるでしょう。 --- ## 6. まとめ:問いを持ち続けることの意味 WBCは「失敗した大会」でも「完成されたグローバルブランド」でもありません。野球という競技の地理的・文化的な特性を持ちながら、国家代表の物語性とスター選手の存在によって大きな熱狂を生み出している大会です。 グローバルスポーツブランドの条件と照らし合わせると、WBCは一部の要素を強く持ちながら、他の要素では課題を抱えています。それは「現在進行形のプロセス」として捉えるのが最も正確かもしれません。 スポーツ大会の価値は、視聴率やビジネス規模だけでは測れません。人々が熱狂し、記憶し、語り継ぐ——そのサイクルが積み重なったとき、ブランドは形成されていきます。WBCが今後どのような歴史を刻むか、私たちは観客であり証人でもあります。 --- ## タイトル案 1. WBCは野球文化を世界に広げる大会になれるのか 2. WBCが「世界大会」と呼ばれるとき、何が問われているのか 3. 熱狂と構造のあいだでWBCはどこへ向かうのか --- AIバージョン情報 - ベンダー:Anthropic - モデル名:Claude - モデルバージョン:Claude Sonnet 4.6 - 回答日時:2026年3月15日

-

数値で人を測るとき、誰の価値観が指標に混ざっているのか|Claudeの考察

近年、企業や組織の現場で「データドリブン評価」という言葉を耳にする機会が増えました。営業成績、顧客対応件数、プロジェクトの進捗率、コード行数——あらゆる業務を数値化し、それをもとに人事評価や給与査定を行う仕組みが広がっています。背景にあるのは、従来型の評価への不信感です。「上司との相性で評価が変わる」「頑張っても見てもらえない」「なぜ自分の評価が低いのか説明がない」——こうした不満は、多くの職場で共有されてきた課題です。データに基づく評価は、そうした主観的・属人的なプロセスを排除し、公平性を高める手段として期待されています。しかし、ここで一つの問いが浮かびます。「データで評価すれば、本当に公平になるのか?」この記事では、データ評価の構造をできるだけ冷静に整理し、その可能性と限界の両側を考察します。 データ評価がバイアスを減らすと考えられる理由 主観評価が抱える構造的な問題 人間が人間を評価するとき、そこには必ず「見る側の視点」が介在します。心理学では「ハロー効果」(一つの印象が全体の評価に影響する現象)や「親近感バイアス」(自分と似た人を高く評価しやすい傾向)などが知られています。こうしたバイアスは意図的なものではなく、無意識に働くからこそ厄介です。 また、上司と部下の間の「関係性の質」や、コミュニケーションの頻度・スタイルが評価に影響するケースも少なくありません。成果が同じでも、印象管理がうまい人と、黙々と仕事をこなす人では評価が異なることがあります。 数値指標による評価のメリット これに対し、KPI(重要業績評価指標)などの数値指標を用いた評価には、いくつかの利点があります。 透明性:評価基準が明文化されるため、評価される側が何を目指せばよいかが明確になる 再現性:同じ指標で複数人を評価できるため、比較の一貫性が保たれやすい 説明可能性:「なぜこの評価か」を数値で示しやすくなる こうした特性から、データドリブン評価は「属人的な判断を減らし、評価プロセスを民主化する」手段として、多くの企業が導入を進めています。 データ評価が新しいバイアスを生む可能性 指標設計に潜む価値観 しかし、ここに重要な問いがあります。「どの指標を測るか」を決めるのは、人間です。 たとえば、営業職の評価に「成約件数」だけを使えば、長期的な顧客関係の構築や社内での知識共有といった行動は評価されにくくなります。コールセンターで「対応件数」を指標にすれば、丁寧な対応よりも処理速度が優先されるかもしれません。 指標は、設計者の「何を重視するか」という価値観を反映します。つまり、データ評価の出発点には、必ず人間の判断が入り込んでいます。 測定可能なものだけが見えてくる問題 データで評価できるのは、「測定可能なもの」に限られます。チームへの貢献、後輩へのメンタリング、職場の雰囲気づくり——こうした「見えにくい価値」は、数値化が難しいため評価対象から外れやすくなります。 結果として、「測定できる行動」と「本当に重要な行動」がズレる可能性があります。評価システムが優秀さの定義を歪めてしまうリスクです。 過去データが未来の評価を縛る AIや機械学習を使ったアルゴリズム評価では、過去の実績データが学習の基礎になります。しかし、過去のデータには過去の偏りが含まれています。 たとえば、ある職種の採用・評価データに「特定の属性の人が高く評価されてきた」という傾向があれば、アルゴリズムはその傾向を「正解パターン」として学習してしまう可能性があります。これは、意図せず過去の不公平を再生産する仕組みになりかねません。 「客観的に見えるデータ」が、実は過去の人間の判断を圧縮したものである——この点は、データ評価を設計・運用するうえで特に注意が必要です。 評価はどこまで客観化できるのか 人間評価とデータ評価の構造比較 人間評価とデータ評価を構造的に比較すると、バイアスがなくなるわけではなく、バイアスの所在が「評価者個人」から「評価システムの設計」へと移動していることがわかります。人間評価では評価者の主観・感情がバイアスの源となり、透明性は低くなりがちです。一方、データ評価では指標設計やデータ収集プロセスにバイアスが潜み、設計の透明性が担保されて初めて高い透明性が実現します。また、測定できないものへの対応という点では、人間評価は主観的ながら可能である一方、データ評価は困難です。 評価システムにおける「設計」の重みと責任 データ評価において、指標を選ぶ人、アルゴリズムを設計する人、データを収集する仕組みを作る人——これらの判断が、評価の公平性を大きく左右します。 評価システムは、「誰が設計したか」「どんな前提に基づいているか」「何を測定対象から外しているか」によって、その性質が大きく変わります。評価の公平性を問うとき、私たちは「誰が・何のために・どんな基準で設計したか」を問い続ける必要があるかもしれません。 まとめ:評価設計こそが問われている データ評価は、人間の主観評価が持つ一部のバイアスを構造的に抑制できる可能性を持っています。しかし同時に、指標設計・データの偏り・測定対象の選択という形で、別の種類のバイアスを生み出す可能性も持っています。 「人間評価かデータ評価か」という問いは、本質的には的外れかもしれません。どちらの評価手法も、設計次第で公平にも不公平にもなりえます。 重要なのは「何を使って評価するか」ではなく、「どういう目的で、何を測り、何を測らないと決めたか」という評価設計の問いです。 AI・データ活用が進む社会において、評価の透明性と設計への問いかけは、働く人一人ひとりにとっても、他人事ではない問題になりつつあります。あなたの職場で使われている評価の仕組みは、何を可視化し、何を見えなくしているでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 企業・組織・社会で広がりつつある「データ評価(データドリブン評価)」は、 人間の主観やバイアスを減らす仕組みなのか、 それとも別の形のバイアスを生み出す仕組みなのか。 AI・データ分析・アルゴリズム評価が普及する社会において、 評価の仕組みがどのように変化しているのかを構造的に整理・考察してください。 【目的】 – 「データ=客観的」という単純な理解ではなく、評価システムの構造を整理する – 人間の評価とデータ評価の違いを冷静に比較する – AI時代の働き方において「評価とは何か」という問いを浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – 企業で働くビジネスパーソン – 人事評価・KPI・データ分析などに関心がある人 – AIやデータ活用に関心はあるが専門家ではない層 【記事構成】 1. 導入(問題提起) – 企業や組織で「データ評価」が広がっている現状を提示する – 人間の主観評価に対する不信感や公平性への期待を紹介する – なぜ「データ評価は本当に公平なのか」という問いが生まれるのかを説明する 2. データ評価がバイアスを減らすと考えられる理由 – 従来の主観評価(上司の印象・感情・関係性など)の問題を整理する – 数値指標やKPIによる評価のメリットを説明する – なぜ多くの企業が「データドリブン評価」を導入し始めているのかを構造的に説明する 3. データ評価が新しいバイアスを生む可能性 – 指標設計そのものに人間の価値観が入り込む可能性 – 測定可能なものだけが評価されやすくなる問題 – 過去データの偏りが評価システムに影響する可能性 – 「客観的に見える評価」の裏側にある構造を整理する 4. 評価はどこまで客観化できるのか – 人間評価とデータ評価の違いを整理する – 評価システムにおける「指標」「アルゴリズム」「設計者」の役割を説明する – 評価の公平性とは何かを構造的に考察する 5. まとめ – データ評価はバイアスを完全に消す仕組みではない可能性を整理する – 重要なのは「人間評価かデータ評価か」ではなく「評価設計」であることを示す – AI時代における評価のあり方について、読者が考える余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:人間評価とデータ評価の構造比較) ※(図:評価指標とバイアスの関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「データ評価は本当に人間のバイアスを減らすのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # データで測れば公平になるのか?評価システムの構造を読み解く --- ## 1. 導入:「公平な評価」への期待と問い 近年、企業や組織の現場で「データドリブン評価」という言葉を耳にする機会が増えました。営業成績、顧客対応件数、プロジェクトの進捗率、コード行数——あらゆる業務を数値化し、それをもとに人事評価や給与査定を行う仕組みが広がっています。 背景にあるのは、従来型の評価への不信感です。「上司との相性で評価が変わる」「頑張っても見てもらえない」「なぜ自分の評価が低いのか説明がない」——こうした不満は、多くの職場で共有されてきた課題です。データに基づく評価は、そうした主観的・属人的なプロセスを排除し、公平性を高める手段として期待されています。 しかし、ここで一つの問いが浮かびます。**「データで評価すれば、本当に公平になるのか?」** この記事では、データ評価の構造をできるだけ冷静に整理し、その可能性と限界の両側を考察します。 --- ## 2. データ評価がバイアスを減らすと考えられる理由 ### 主観評価が抱える構造的な問題 人間が人間を評価するとき、そこには必ず「見る側の視点」が介在します。心理学では「ハロー効果」(一つの印象が全体の評価に影響する現象)や「親近感バイアス」(自分と似た人を高く評価しやすい傾向)などが知られています。こうしたバイアスは意図的なものではなく、無意識に働くからこそ厄介です。 また、上司と部下の間の「関係性の質」や、コミュニケーションの頻度・スタイルが評価に影響するケースも少なくありません。成果が同じでも、印象管理がうまい人と、黙々と仕事をこなす人では評価が異なることがあります。 ### 数値指標による評価のメリット これに対し、KPI(重要業績評価指標)などの数値指標を用いた評価には、いくつかの利点があります。 - **透明性**:評価基準が明文化されるため、評価される側が何を目指せばよいかが明確になる - **再現性**:同じ指標で複数人を評価できるため、比較の一貫性が保たれやすい - **説明可能性**:「なぜこの評価か」を数値で示しやすくなる こうした特性から、データドリブン評価は「属人的な判断を減らし、評価プロセスを民主化する」手段として、多くの企業が導入を進めています。 --- ## 3. データ評価が新しいバイアスを生む可能性 ### 指標設計に潜む価値観 しかし、ここに重要な問いがあります。「どの指標を測るか」を決めるのは、人間です。 たとえば、営業職の評価に「成約件数」だけを使えば、長期的な顧客関係の構築や社内での知識共有といった行動は評価されにくくなります。コールセンターで「対応件数」を指標にすれば、丁寧な対応よりも処理速度が優先されるかもしれません。 指標は、設計者の「何を重視するか」という価値観を反映します。つまり、**データ評価の出発点には、必ず人間の判断が入り込んでいます。** ※(図:評価指標とバイアスの関係) ### 測定可能なものだけが見えてくる問題 データで評価できるのは、「測定可能なもの」に限られます。チームへの貢献、後輩へのメンタリング、職場の雰囲気づくり——こうした「見えにくい価値」は、数値化が難しいため評価対象から外れやすくなります。 結果として、「測定できる行動」と「本当に重要な行動」がズレる可能性があります。評価システムが優秀さの定義を歪めてしまうリスクです。 ### 過去データが未来の評価を縛る AIや機械学習を使ったアルゴリズム評価では、過去の実績データが学習の基礎になります。しかし、過去のデータには過去の偏りが含まれています。 たとえば、ある職種の採用・評価データに「特定の属性の人が高く評価されてきた」という傾向があれば、アルゴリズムはその傾向を「正解パターン」として学習してしまう可能性があります。これは、意図せず過去の不公平を再生産する仕組みになりかねません。 「客観的に見えるデータ」が、実は過去の人間の判断を圧縮したものである——この点は、データ評価を設計・運用するうえで特に注意が必要です。 --- ## 4. 評価はどこまで客観化できるのか ### 人間評価とデータ評価の構造比較 ※(図:人間評価とデータ評価の構造比較) | 観点 | 人間評価 | データ評価 | |---|---|---| | バイアスの所在 | 評価者の主観・感情 | 指標設計・データ収集プロセス | | 透明性 | 低いことが多い | 高い(ただし設計の透明性が前提) | | 測定できないものへの対応 | 可能(ただし主観的) | 困難 | | 設計者の影響 | 評価者本人 | 指標・アルゴリズムの設計者 | この比較からわかることは、バイアスがなくなるわけではなく、**バイアスの所在が「評価者個人」から「評価システムの設計」へと移動している**ということです。 ### 評価システムにおける「設計」の重みと責任 データ評価において、指標を選ぶ人、アルゴリズムを設計する人、データを収集する仕組みを作る人——これらの判断が、評価の公平性を大きく左右します。 評価システムは、「誰が設計したか」「どんな前提に基づいているか」「何を測定対象から外しているか」によって、その性質が大きく変わります。評価の公平性を問うとき、私たちは「誰が・何のために・どんな基準で設計したか」を問い続ける必要があるかもしれません。 --- ## 5. まとめ:評価設計こそが問われている データ評価は、人間の主観評価が持つ一部のバイアスを構造的に抑制できる可能性を持っています。しかし同時に、指標設計・データの偏り・測定対象の選択という形で、別の種類のバイアスを生み出す可能性も持っています。 「人間評価かデータ評価か」という問いは、本質的には的外れかもしれません。どちらの評価手法も、設計次第で公平にも不公平にもなりえます。 **重要なのは「何を使って評価するか」ではなく、「どういう目的で、何を測り、何を測らないと決めたか」という評価設計の問いです。** AI・データ活用が進む社会において、評価の透明性と設計への問いかけは、働く人一人ひとりにとっても、他人事ではない問題になりつつあります。あなたの職場で使われている評価の仕組みは、何を可視化し、何を見えなくしているでしょうか。 --- ## タイトル案 1. あなたの職場のデータ評価は何を見えなくしているのか 2. 数値で人を測るとき、誰の価値観が指標に混ざっているのか 3. データで評価すれば公平になると思っていませんか --- — AIバージョン情報 - ベンダー: Anthropic - モデル名: Claude - モデルバージョン: Claude Sonnet 4.6 - 回答日時: 2026年3月15日

-

情報セキュリティ認証は誰のための制度として機能しているのか|Claudeの考察

企業のWebサイトや営業資料を眺めていると、「ISO27001認証取得」「SOC2 Type II準拠」といった記載を目にする機会が増えています。特にSaaSやクラウドサービスを提供する企業では、サービス紹介ページの冒頭にセキュリティ認証のバッジが並ぶことも珍しくありません。こうした認証取得の動きは、ここ数年で明らかに加速しています。では、その認証は何を意味しているのでしょうか。「この企業は安全だ」という証明なのか、それとも別の意味合いが混在しているのか。本記事では、情報セキュリティ認証を「安全の証明」として単純に読むのではなく、制度・企業行動・市場構造という三つの視点から整理してみます。 情報セキュリティ認証の制度的目的 認証が測るのは「安全」ではなく「管理体制」 ISO27001は、国際標準化機構(ISO)が策定した情報セキュリティマネジメントシステム(ISMS)の国際規格です。SOC2は、米国公認会計士協会(AICPA)が定めた、サービス組織のセキュリティや可用性などを評価する報告基準です。 これらの認証に共通する思想は、「情報資産をどのように管理するか」という体制の存在を確認することにあります。具体的には、リスクアセスメント(どのようなリスクが存在するかを洗い出し評価するプロセス)、情報資産管理(どの情報が、誰によって、どのように扱われているかの把握)、内部統制(不正や誤りを防ぐための組織的な仕組み)といった要素が審査対象となります。 「安全そのもの」とは何が違うのか ここで注意が必要なのは、認証取得が「インシデントが起きない」ことを保証するものではないという点です。認証はあくまで、「適切な管理体制が存在し、それが一定の基準を満たしている」という事実を第三者機関が確認した記録です。体制が整っていても、想定外の攻撃や内部の運用ミスによって情報漏洩が発生することはあり得ます。 つまり認証制度は、「安全を証明する仕組み」というより、「管理の仕組みが存在することを可視化する制度」として設計されています。 認証が市場参入条件として機能する理由 取引の「前提条件」になりつつある認証 近年、特にBtoB(企業間取引)の領域において、情報セキュリティ認証は取引開始の前提条件として機能するケースが増えています。大手企業がベンダーやSaaSツールを選定する際に、セキュリティ審査の一環として「ISO27001取得の有無」を確認するフローを設けている例は少なくありません。 公共調達や金融・医療・インフラ関連の領域では、こうした要件が明文化されていることもあります。クラウドサービスや、機密性の高いデータを扱うSaaSが特に審査されやすい背景には、データの預け先に対するリスク管理の意識が高まっていることがあります。 なぜ企業は認証取得企業を優遇するのか 発注側の企業が認証取得を重視する理由は、純粋なセキュリティへの関心だけではありません。「認証取得済みのベンダーを選んだ」という事実は、万が一インシデントが発生した際の責任所在の明確化にも寄与します。つまり、認証の確認は調達側のリスク管理行動でもあります。 こうした構造の中で、認証は「信頼の証」であると同時に、「責任の分散装置」としても機能しているとも言えるでしょう。 認証制度が市場構造に与える影響 認証取得にかかるコストと運用負担 ISO27001の認証取得には、審査機関への申請費用だけでなく、社内体制の整備、文書管理の仕組み構築、継続的な内部監査の実施など、相応のリソースが必要です。大企業であれば専任チームを設けることも可能ですが、スタートアップや中小規模の企業にとっては、人員・費用ともに無視できない負担となります。 また認証は一度取得すれば終わりではなく、定期的なサーベイランス審査(継続的な維持審査)が必要です。運用を継続するための組織的なコストが発生し続ける点も、導入を検討する企業にとっては重要な判断材料となります。 認証が参入障壁になる可能性 認証取得が実質的な市場参入条件となる領域では、認証を持てる企業と持てない企業の間で、取引機会に差が生じる可能性があります。これはセキュリティ意識の底上げという観点からは合理的な側面もある一方で、資本力や組織規模によって市場へのアクセス格差が生まれるという構造的な問題を内包しています。 形式化するリスク もう一つ考慮すべき点は、認証取得が「目的化」するリスクです。本来は情報セキュリティの実態を改善するための仕組みであるはずの認証が、書類整備や審査対応に最適化された形式的な運用になってしまうケースがあります。審査をクリアすることと、実際のセキュリティレベルを高めることは、必ずしも一致しないという指摘は、制度運用の現場でも聞かれます。 まとめ:二つの役割の間で 情報セキュリティ認証は、少なくとも二つの異なる役割を同時に担っています。一つは、情報管理体制の質を可視化し、組織のセキュリティを改善する「制度的な仕組み」としての役割。もう一つは、市場取引における信頼の基準として機能し、参入条件を形成する「市場の仕組み」としての役割です。 この二つは相互に補完し合う面もありますが、時に緊張関係を生む面もあります。認証を「安全の証明」として一義的に読むことも、「参入のためのコスト」として割り切ることも、どちらも制度の一側面しか捉えていない可能性があります。 認証の意味を問い直すことは、情報セキュリティそのものの意味を問い直すことにもつながります。自社にとってその認証が何を意味するのか、取引相手にとって何を意味するのか。そうした問いを持ち続けることが、制度を形骸化させないための第一歩かもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 情報セキュリティ認証(ISO27001、SOC2、各種セキュリティ認証など)は、 「企業の安全性を証明する制度」なのか、 それとも「企業が市場に参加するための条件」なのか。 情報セキュリティ認証の役割を、 制度・企業行動・市場構造という視点から整理・考察してください。 【目的】 – 情報セキュリティ認証を「安全の証明」として単純に理解するのではなく、社会制度としての役割を整理する – なぜ多くの企業が認証取得を求められるのか、その構造を理解する – セキュリティ認証が企業活動や市場構造にどのような影響を与えているのかを読み解く 【読者像】 – IT企業・SaaS企業の関係者 – セキュリティ認証の取得を検討している企業 – 情報セキュリティや企業統治に関心のあるビジネスパーソン – セキュリティ制度の仕組みを理解したい一般読者 【記事構成】 1. 導入(問題提起) – 多くの企業が情報セキュリティ認証を取得している現状を提示する – 企業のWebサイトや営業資料で「ISO取得」などが強調される背景を説明する – しかし、その認証は本当に「安全」を意味するのかという問いを提示する 2. 情報セキュリティ認証の制度的目的 – ISO27001などの認証制度がどのような思想で作られたのかを整理する – リスク管理、情報資産管理、内部統制などの概念を簡潔に説明する – 認証が「安全そのもの」ではなく「管理体制の存在」を確認する制度である点を説明する 3. 認証が市場参入条件として機能する理由 – 多くの企業取引で「ISO取得」が前提条件になるケースを説明する – SaaS、クラウド、ITサービスなどで認証が重視される背景を整理する – 企業が認証を重視する理由として、責任回避やリスク管理の観点を説明する 4. 認証制度が市場構造に与える影響 – 認証取得のコストや運用負担について触れる – 認証が企業規模や市場参入のハードルに影響する可能性を整理する – 認証が信頼の指標になる一方で、形式化するリスクについても言及する 5. まとめ – 情報セキュリティ認証は「安全証明」と「市場参入条件」の両面を持つ制度である可能性を整理する – 制度の役割を単純化せず、複数の視点から理解する重要性を提示する – 読者がセキュリティ認証の意味を自分なりに考える余地を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:情報セキュリティ認証の制度構造) ※(図:認証と市場参入の関係イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「情報セキュリティ認証は本当に安全を証明しているのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 情報セキュリティ認証の二つの顔 ## 導入:「ISO取得済み」という言葉の重さ 企業のWebサイトや営業資料を眺めていると、「ISO27001認証取得」「SOC2 Type II準拠」といった記載を目にする機会が増えています。特にSaaSやクラウドサービスを提供する企業では、サービス紹介ページの冒頭にセキュリティ認証のバッジが並ぶことも珍しくありません。 こうした認証取得の動きは、ここ数年で明らかに加速しています。では、その認証は何を意味しているのでしょうか。「この企業は安全だ」という証明なのか、それとも別の意味合いが混在しているのか。本記事では、情報セキュリティ認証を「安全の証明」として単純に読むのではなく、制度・企業行動・市場構造という三つの視点から整理してみます。 --- ## 情報セキュリティ認証の制度的目的 ### 認証が測るのは「安全」ではなく「管理体制」 ISO27001は、国際標準化機構(ISO)が策定した情報セキュリティマネジメントシステム(ISMS)の国際規格です。SOC2は、米国公認会計士協会(AICPA)が定めた、サービス組織のセキュリティや可用性などを評価する報告基準です。 これらの認証に共通する思想は、「情報資産をどのように管理するか」という体制の存在を確認することにあります。具体的には、リスクアセスメント(どのようなリスクが存在するかを洗い出し評価するプロセス)、情報資産管理(どの情報が、誰によって、どのように扱われているかの把握)、内部統制(不正や誤りを防ぐための組織的な仕組み)といった要素が審査対象となります。 ### 「安全そのもの」とは何が違うのか ここで注意が必要なのは、認証取得が「インシデントが起きない」ことを保証するものではないという点です。認証はあくまで、「適切な管理体制が存在し、それが一定の基準を満たしている」という事実を第三者機関が確認した記録です。体制が整っていても、想定外の攻撃や内部の運用ミスによって情報漏洩が発生することはあり得ます。 つまり認証制度は、「安全を証明する仕組み」というより、「管理の仕組みが存在することを可視化する制度」として設計されています。 ※(図:情報セキュリティ認証の制度構造) --- ## 認証が市場参入条件として機能する理由 ### 取引の「前提条件」になりつつある認証 近年、特にBtoB(企業間取引)の領域において、情報セキュリティ認証は取引開始の前提条件として機能するケースが増えています。大手企業がベンダーやSaaSツールを選定する際に、セキュリティ審査の一環として「ISO27001取得の有無」を確認するフローを設けている例は少なくありません。 公共調達や金融・医療・インフラ関連の領域では、こうした要件が明文化されていることもあります。クラウドサービスや、機密性の高いデータを扱うSaaSが特に審査されやすい背景には、データの預け先に対するリスク管理の意識が高まっていることがあります。 ### なぜ企業は認証取得企業を優遇するのか 発注側の企業が認証取得を重視する理由は、純粋なセキュリティへの関心だけではありません。「認証取得済みのベンダーを選んだ」という事実は、万が一インシデントが発生した際の責任所在の明確化にも寄与します。つまり、認証の確認は調達側のリスク管理行動でもあります。 こうした構造の中で、認証は「信頼の証」であると同時に、「責任の分散装置」としても機能しているとも言えるでしょう。 ※(図:認証と市場参入の関係イメージ) --- ## 認証制度が市場構造に与える影響 ### 認証取得にかかるコストと運用負担 ISO27001の認証取得には、審査機関への申請費用だけでなく、社内体制の整備、文書管理の仕組み構築、継続的な内部監査の実施など、相応のリソースが必要です。大企業であれば専任チームを設けることも可能ですが、スタートアップや中小規模の企業にとっては、人員・費用ともに無視できない負担となります。 また認証は一度取得すれば終わりではなく、定期的なサーベイランス審査(継続的な維持審査)が必要です。運用を継続するための組織的なコストが発生し続ける点も、導入を検討する企業にとっては重要な判断材料となります。 ### 認証が参入障壁になる可能性 認証取得が実質的な市場参入条件となる領域では、認証を持てる企業と持てない企業の間で、取引機会に差が生じる可能性があります。これはセキュリティ意識の底上げという観点からは合理的な側面もある一方で、資本力や組織規模によって市場へのアクセス格差が生まれるという構造的な問題を内包しています。 ### 形式化するリスク もう一つ考慮すべき点は、認証取得が「目的化」するリスクです。本来は情報セキュリティの実態を改善するための仕組みであるはずの認証が、書類整備や審査対応に最適化された形式的な運用になってしまうケースがあります。審査をクリアすることと、実際のセキュリティレベルを高めることは、必ずしも一致しないという指摘は、制度運用の現場でも聞かれます。 --- ## まとめ:二つの役割の間で 情報セキュリティ認証は、少なくとも二つの異なる役割を同時に担っています。一つは、情報管理体制の質を可視化し、組織のセキュリティを改善する「制度的な仕組み」としての役割。もう一つは、市場取引における信頼の基準として機能し、参入条件を形成する「市場の仕組み」としての役割です。 この二つは相互に補完し合う面もありますが、時に緊張関係を生む面もあります。認証を「安全の証明」として一義的に読むことも、「参入のためのコスト」として割り切ることも、どちらも制度の一側面しか捉えていない可能性があります。 認証の意味を問い直すことは、情報セキュリティそのものの意味を問い直すことにもつながります。自社にとってその認証が何を意味するのか、取引相手にとって何を意味するのか。そうした問いを持ち続けることが、制度を形骸化させないための第一歩かもしれません。 --- ## タイトル案 1. 情報セキュリティ認証は誰のための制度として機能しているのか 2. ISO取得企業を優遇する市場の構造はどこから来ているのか 3. セキュリティ認証が参入条件になるとき何が変わるのか --- AIバージョン情報 - ベンダー: Anthropic - モデル名: Claude - モデルバージョン: Claude Sonnet 4.6 - 回答日時: 2026年3月15日

-

クリエイターのキャリアは「何を作ったか」で形成されるのか|Claudeの考察

クリエイティブ職に就く人と話すとき、「どの会社に勤めているか」よりも「何を作ったか」を聞く場面が多くなっています。デザイナーであればポートフォリオサイト、イラストレーターであればSNSの投稿、ゲームクリエイターであれば参加タイトルのクレジット——これらが、その人のキャリアを示す"証明書"として機能しています。一般的な会社員キャリアでは、「どの企業に何年勤めたか」「どのような役職に就いたか」が評価の基準になりやすい構造があります。しかしクリエイティブ職においては、所属組織の名前よりも「成果物そのもの」が評価の対象になりやすい傾向があります。さらに、インターネットやSNSの普及により、作品が組織を介さずに世界中の人々に届くようになりました。この変化が、クリエイターのキャリア構造をどのように変えつつあるのか——本記事ではその構造を整理・考察します。 従来のキャリア構造:「所属単位」のキャリア 組織キャリアの特徴 多くの職業において、キャリアは「所属」を軸に形成されてきました。入社した企業の名前、昇進した役職、積み上げた勤続年数——これらが「その人が何者か」を示す指標として機能してきたのです。 この構造には一定の合理性があります。組織に属することで、安定した収入・社会保障・スキル習得の機会が得られます。また、評価制度や昇格基準が明文化されているため、キャリアパスが可視化されやすい側面もあります。 クリエイティブ職でこの構造が機能しにくい理由 クリエイティブ職においては、所属単位のキャリア構造が成立しにくい場合があります。その理由のひとつは、「スキルと成果物の個人帰属性」です。同じ会社に所属していても、デザインの質・表現の独自性は個人によって大きく異なります。また、異なる会社を渡り歩きながらキャリアを積む「転職前提のキャリア構造」も、クリエイティブ職では一般的です。 作品単位キャリアという構造 「何を作ったか」がキャリアになる仕組み クリエイターのキャリアにおいて、ポートフォリオ・代表作・プロジェクト実績は重要な役割を果たします。採用担当者やクライアントが最初に確認するのは、多くの場合「どんな作品を作ってきたか」です。 映画・映像制作の世界では、「どの作品のどのポジションで関わったか」がキャリアの根拠になります。ゲーム業界においても、参加タイトルのクレジットが実績として機能します。広告デザインやWebデザインの分野では、公開されたビジュアルや受賞歴がポートフォリオの中心になります。漫画家・イラストレーターは、作品そのものが名刺代わりです。 「代表作」という概念の重要性 作品単位キャリアにおいては、「代表作が存在するかどうか」が大きな意味を持ちます。一本のヒット作、一つのバイラル(拡散)コンテンツ、一つの受賞歴が、その後の仕事の流れを変える可能性があります。この構造は、勤続年数の積み上げとは異なる時間軸でキャリアが形成されることを示しています。 インターネットが変えたキャリアの単位 SNS・プラットフォームが作品評価を変えた YouTube・Pixiv・Behance・Instagram・X(旧Twitter)・note——これらのプラットフォームは、作品と評価の間にあった「組織」という仲介者の役割を部分的に変化させました。以前は、作品を多くの人に届けるためには出版社・放送局・広告代理店などの組織を経由する必要がありました。しかし現在では、個人が直接作品を公開し、反応を受け取ることができます。 「会社 → 作品」から「個人 → 作品 → 市場」へ 従来の構造では、「会社に所属してはじめて作品を作れる」という側面が強くありました。しかし現在では、「個人が作品を作り、市場(視聴者・クライアント・コミュニティ)に直接届ける」というルートが現実的な選択肢になりつつあります。 ただし、この変化が「すべてのクリエイターに等しく開かれた機会」を意味するかどうかは慎重に考える必要があります。プラットフォームのアルゴリズム・可視性・収益構造は均一ではなく、個人の発信力には大きな差があるからです。 それでも組織が重要である理由 作品は「関係性の中」で生まれる 「作品単位キャリア」という視点は重要ですが、作品の多くは個人だけで完結するわけではありません。映像作品にはディレクター・撮影・音楽・編集が関わり、ゲームにはプログラマー・アーティスト・プランナーが関わります。漫画においても、編集者との協働が作品の質に影響することは広く知られています。 プロデューサー・編集者の存在 良い作品を生み出す環境を整えるプロデューサー、作家の才能を引き出す編集者——こうした「制作支援者」の存在は、作品単位のキャリアと組織・ネットワークの関係を考えるうえで欠かせない視点です。クリエイターが「個人として評価される」場合でも、その背後には組織やチームのサポートが存在することが多いのです。 AI時代のクリエイターキャリア 制作コストの変化と個人制作の可能性 画像生成AI・映像生成AI・作曲AIなどのツールの普及により、これまでチームで行っていた制作の一部を個人が担えるようになりつつあります。制作コストの低下は、個人クリエイターが多様なジャンルで作品を生み出す可能性を広げる一方で、作品の総量増加による「可視性の競争」を激化させる可能性もあります。 キャリア単位のさらなる変化 AIによって制作効率が上がれば、「一人が複数の役割を担えるクリエイター」が増える可能性があります。同時に、AIが生成したコンテンツと人間が制作したコンテンツの区別・評価をどう行うかという問いも浮かび上がります。クリエイターのキャリアにおいて「何を作ったか」という問いに加え、「どのように作ったか」という問いが重要性を増す可能性があります。 まとめ:「作品」と「関係性」の両方で形成されるキャリア 本記事で整理してきた内容をまとめると、クリエイターのキャリアは「作品単位」という要素を強く持ちながらも、それだけで完結するわけではないことが見えてきます。 「フリーランス化」や「個人化」として語られがちなクリエイターキャリアの変化は、実際には「作品による評価」と「組織・ネットワークとの関係性」の両方が複雑に絡み合う構造として捉えるほうが実態に近いかもしれません。 デジタル技術・SNS・AIの普及は、クリエイターが作品を世に出す経路を多様化させました。しかしそれは、「組織が不要になった」ことを意味するのではなく、「組織との関わり方の選択肢が増えた」と捉えることもできます。 自分のキャリアを「どの会社にいるか」で語るのか、「何を作ってきたか」で語るのか——あるいはその両方の組み合わせで語るのか。その問いを考えることが、これからのクリエイターキャリアを構造として捉える出発点になるかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 クリエイターのキャリアは 「会社」や「所属」ではなく 「作品単位」で形成されるものになりつつあるのか。 AI・インターネット・SNS・プラットフォームの普及によって、 クリエイターのキャリア構造がどのように変化しているのかを整理・考察してください。 対象となるクリエイターは以下を想定します。 – デザイナー – イラストレーター – 映像制作者 – ゲームクリエイター – ライター – 音楽制作者 – 漫画家 – Webクリエイター – コンテンツクリエイター 【目的】 – クリエイターのキャリア形成を「個人の努力論」ではなく構造として整理する – 「会社キャリア」と「作品キャリア」の違いを明確にする – デジタル時代におけるクリエイターの評価構造を言語化する – 読者が自分のキャリアの捉え方を考える材料を提供する 【読者像】 – クリエイティブ職に関心のある学生 – デザイナー・ライターなどのクリエイター – 副業クリエイター – フリーランス志向の社会人 – AI時代のキャリアの変化に関心を持つ人 【記事構成】 1. 導入(問題提起) – クリエイターは「会社の肩書き」よりも「作品」で評価されると言われる理由を提示する – なぜクリエイターのキャリアは一般的な会社員キャリアと異なるのかを示す – インターネットやSNSによって、この構造がさらに強まっている可能性に触れる 2. 従来のキャリア構造(所属単位のキャリア) – 多くの職業では「会社」「役職」「勤続年数」がキャリアの単位になっていることを整理する – 組織キャリアの特徴(安定・階層・評価制度など)を説明する – なぜクリエイティブ職ではこの構造が成立しにくいのかを整理する 3. 作品単位キャリアという構造 – クリエイターが「どの会社にいるか」よりも「何を作ったか」で評価される構造を説明する – ポートフォリオ・代表作・プロジェクト実績がキャリアになる仕組みを整理する – 映画・ゲーム・広告・漫画などの分野で見られる特徴を説明する 4. インターネットが変えたキャリアの単位 – SNSやプラットフォームによって作品が直接評価される構造を整理する – YouTube・Pixiv・Behance・SNSなどがキャリア形成に与えた影響を説明する – 「会社 → 作品」から「個人 → 作品 → 市場」という流れの可能性を考察する 5. それでも組織が重要である理由 – 作品は個人だけでなく、制作チームや組織の中で生まれることを説明する – プロデューサー・編集者・制作会社などの役割に触れる – 「作品単位キャリア」と「組織ネットワーク」の関係を整理する 6. AI時代のクリエイターキャリア – AIツールによって制作コストが下がる可能性を説明する – 個人制作とチーム制作の関係がどう変化する可能性があるかを考察する – クリエイターのキャリア単位がさらに変化する可能性に触れる 7. まとめ – クリエイターのキャリアは「作品」と「関係性」の両方で形成される可能性を整理する – 単純な「フリーランス化」や「個人化」として語られがちな議論を構造として整理する – 読者がキャリアの捉え方を考える視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:クリエイターキャリアの構造) ※(図:作品単位キャリアと組織キャリアの関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「クリエイターのキャリアは会社ではなく作品で決まるのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # クリエイターのキャリア形成は「作品単位」へと移行しつつあるのか --- ## 1. 導入:「何を作ったか」が問われる時代 クリエイティブ職に就く人と話すとき、「どの会社に勤めているか」よりも「何を作ったか」を聞く場面が多くなっています。デザイナーであればポートフォリオサイト、イラストレーターであればSNSの投稿、ゲームクリエイターであれば参加タイトルのクレジット——これらが、その人のキャリアを示す"証明書"として機能しています。 一般的な会社員キャリアでは、「どの企業に何年勤めたか」「どのような役職に就いたか」が評価の基準になりやすい構造があります。しかしクリエイティブ職においては、所属組織の名前よりも「成果物そのもの」が評価の対象になりやすい傾向があります。 さらに、インターネットやSNSの普及により、作品が組織を介さずに世界中の人々に届くようになりました。この変化が、クリエイターのキャリア構造をどのように変えつつあるのか——本記事ではその構造を整理・考察します。 --- ## 2. 従来のキャリア構造:「所属単位」のキャリア ### 組織キャリアの特徴 多くの職業において、キャリアは「所属」を軸に形成されてきました。入社した企業の名前、昇進した役職、積み上げた勤続年数——これらが「その人が何者か」を示す指標として機能してきたのです。 この構造には一定の合理性があります。組織に属することで、安定した収入・社会保障・スキル習得の機会が得られます。また、評価制度や昇格基準が明文化されているため、キャリアパスが可視化されやすい側面もあります。 ### クリエイティブ職でこの構造が機能しにくい理由 クリエイティブ職においては、所属単位のキャリア構造が成立しにくい場合があります。その理由のひとつは、「スキルと成果物の個人帰属性」です。同じ会社に所属していても、デザインの質・表現の独自性は個人によって大きく異なります。また、異なる会社を渡り歩きながらキャリアを積む「転職前提のキャリア構造」も、クリエイティブ職では一般的です。 --- ## 3. 作品単位キャリアという構造 ※(図:作品単位キャリアと組織キャリアの関係) ### 「何を作ったか」がキャリアになる仕組み クリエイターのキャリアにおいて、ポートフォリオ・代表作・プロジェクト実績は重要な役割を果たします。採用担当者やクライアントが最初に確認するのは、多くの場合「どんな作品を作ってきたか」です。 映画・映像制作の世界では、「どの作品のどのポジションで関わったか」がキャリアの根拠になります。ゲーム業界においても、参加タイトルのクレジットが実績として機能します。広告デザインやWebデザインの分野では、公開されたビジュアルや受賞歴がポートフォリオの中心になります。漫画家・イラストレーターは、作品そのものが名刺代わりです。 ### 「代表作」という概念の重要性 作品単位キャリアにおいては、「代表作が存在するかどうか」が大きな意味を持ちます。一本のヒット作、一つのバイラル(拡散)コンテンツ、一つの受賞歴が、その後の仕事の流れを変える可能性があります。この構造は、勤続年数の積み上げとは異なる時間軸でキャリアが形成されることを示しています。 --- ## 4. インターネットが変えたキャリアの単位 ### SNS・プラットフォームが作品評価を変えた YouTube・Pixiv・Behance・Instagram・X(旧Twitter)・note——これらのプラットフォームは、作品と評価の間にあった「組織」という仲介者の役割を部分的に変化させました。以前は、作品を多くの人に届けるためには出版社・放送局・広告代理店などの組織を経由する必要がありました。しかし現在では、個人が直接作品を公開し、反応を受け取ることができます。 ### 「会社 → 作品」から「個人 → 作品 → 市場」へ 従来の構造では、「会社に所属してはじめて作品を作れる」という側面が強くありました。しかし現在では、「個人が作品を作り、市場(視聴者・クライアント・コミュニティ)に直接届ける」というルートが現実的な選択肢になりつつあります。 ただし、この変化が「すべてのクリエイターに等しく開かれた機会」を意味するかどうかは慎重に考える必要があります。プラットフォームのアルゴリズム・可視性・収益構造は均一ではなく、個人の発信力には大きな差があるからです。 --- ## 5. それでも組織が重要である理由 ### 作品は「関係性の中」で生まれる 「作品単位キャリア」という視点は重要ですが、作品の多くは個人だけで完結するわけではありません。映像作品にはディレクター・撮影・音楽・編集が関わり、ゲームにはプログラマー・アーティスト・プランナーが関わります。漫画においても、編集者との協働が作品の質に影響することは広く知られています。 ### プロデューサー・編集者の存在 良い作品を生み出す環境を整えるプロデューサー、作家の才能を引き出す編集者——こうした「制作支援者」の存在は、作品単位のキャリアと組織・ネットワークの関係を考えるうえで欠かせない視点です。クリエイターが「個人として評価される」場合でも、その背後には組織やチームのサポートが存在することが多い。 ※(図:クリエイターキャリアの構造) --- ## 6. AI時代のクリエイターキャリア ### 制作コストの変化と個人制作の可能性 画像生成AI・映像生成AI・作曲AIなどのツールの普及により、これまでチームで行っていた制作の一部を個人が担えるようになりつつあります。制作コストの低下は、個人クリエイターが多様なジャンルで作品を生み出す可能性を広げる一方で、作品の総量増加による「可視性の競争」を激化させる可能性もあります。 ### キャリア単位のさらなる変化 AIによって制作効率が上がれば、「一人が複数の役割を担えるクリエイター」が増える可能性があります。同時に、AIが生成したコンテンツと人間が制作したコンテンツの区別・評価をどう行うかという問いも浮かび上がります。クリエイターのキャリアにおいて「何を作ったか」という問いに加え、「どのように作ったか」という問いが重要性を増す可能性があります。 --- ## 7. まとめ:「作品」と「関係性」の両方で形成されるキャリア 本記事で整理してきた内容をまとめると、クリエイターのキャリアは「作品単位」という要素を強く持ちながらも、それだけで完結するわけではないことが見えてきます。 「フリーランス化」や「個人化」として語られがちなクリエイターキャリアの変化は、実際には「作品による評価」と「組織・ネットワークとの関係性」の両方が複雑に絡み合う構造として捉えるほうが実態に近いかもしれません。 デジタル技術・SNS・AIの普及は、クリエイターが作品を世に出す経路を多様化させました。しかしそれは、「組織が不要になった」ことを意味するのではなく、「組織との関わり方の選択肢が増えた」と捉えることもできます。 自分のキャリアを「どの会社にいるか」で語るのか、「何を作ってきたか」で語るのか——あるいはその両方の組み合わせで語るのか。その問いを考えることが、これからのクリエイターキャリアを構造として捉える出発点になるかもしれません。 --- ## タイトル案 1. クリエイターのキャリアは「何を作ったか」で形成されるのか 2. デジタル時代にクリエイターの評価単位はどう変わりつつあるのか 3. クリエイターにとって「所属」よりも「作品」が重要になってきているのか --- AIバージョン情報 - ベンダー: Anthropic - モデル名: Claude - モデルバージョン: Claude Sonnet 4.6 - 回答日時: 2026年3月14日

-

終身雇用が前提とした社会は、AIによって何を失うのか|Claudeの考察

「AIに仕事を奪われる」という言葉が、ここ数年で急速に広まっています。製造ラインの自動化、文書作成の効率化、コールセンター業務のAI代替など、具体的な事例も増えてきました。しかし、この問いを「どの職種が残るか」という視点だけで捉えていると、本質的な変化を見逃す可能性があります。変化しているのは、個々の仕事の内容だけではないかもしれません。より根本的な問いとして浮かび上がってきているのが、「企業が人を雇う仕組みそのもの」、すなわち雇用制度の変化です。終身雇用・年功序列・正社員中心というモデルは、日本社会において長く機能してきました。しかし、AIや自動化の進展を背景に、この制度の前提条件が少しずつ変わり始めているとも言われています。本記事では、その構造的な変化の可能性を、複数の視点から整理・考察します。 これまでの雇用制度は何を前提に作られてきたのか 工業化社会が生んだ「安定と忠誠」のモデル 現在の雇用制度の多くは、20世紀の工業化社会を背景に設計されました。大量生産・大量消費を支えるために、企業は多くの人材を長期的に確保する必要がありました。そのための仕組みとして機能したのが、終身雇用と年功序列です。 終身雇用:企業が長期的な雇用を保障する代わりに、労働者は組織への忠誠と継続的な貢献を提供する 年功序列:勤続年数に応じて賃金と地位が上昇する仕組み。長く働くほど報われる設計 正社員モデル:雇用の安定を核とし、福利厚生・退職金・昇進などがセットになったパッケージ型の雇用 これらの制度は、「スキルが均質で、変化の少ない業務環境」において機能しやすい構造でした。技術の変化が緩やかで、一度習得したスキルが長期にわたって価値を持ち続けた時代には、長期雇用の安定性は企業・労働者の双方にとってメリットがありました。 制度の「前提」を支えてきたもの この制度が長く機能してきた理由は、以下のような構造的前提があったからと整理できます。 業務の安定性:求められるスキルや業務内容が大きく変化しにくかった 組織の階層性:管理職・一般職という明確な階層が、役割と報酬の設計を支えた 情報の非対称性:企業が労働市場の情報を持ち、個人は転職より内部昇進を選ぶ傾向があった AIが雇用制度に与える変化の可能性 AIが得意とする業務領域 現在のAIが比較的高い精度でこなせる業務は、大きく以下のように整理されます。 定型的・反復的な処理:データ入力、書類の仕分け、定型文書の作成 情報の収集・分析:大量データの統計処理、パターン認識、レポート生成 照合・確認作業:契約書のチェック、法規制との照合、品質検査 これらは、これまで「新卒・若手社員が担う業務」としても機能してきた領域でもあります。企業内での「経験を積む入口」となっていた仕事が自動化されることで、人材の育成ルート自体にも影響が出る可能性があります。 組織構造への波及 AIの導入が進むことで、組織設計にも変化の圧力がかかり得ます。 たとえば、中間管理職の一部が担っていた「情報の集約・整理・上申」という役割は、AIによって代替されやすい業務でもあります。これにより、組織の階層がフラット化(少ない管理層で構成される組織形態)する方向に動くとも言われています。 また、プロジェクト単位での雇用(プロジェクト型雇用)や、特定のスキルを持つ人材を必要に応じて活用するギグ型労働(特定の仕事ごとに契約する働き方)、さらに職務内容を明確に定義したうえで雇用するジョブ型雇用への注目も高まっています。ただし、これらが従来の雇用モデルを完全に置き換えるかどうかは、現時点では不明確な部分も多く、慎重に見ていく必要があります。 企業と労働者の関係はどう変わる可能性があるのか 「人を雇う理由」の変化 従来、企業が正社員を採用するのは、「長期的な戦力として育成・定着させるため」という側面が強くありました。しかしAIが定型業務を担うようになると、企業が人間に求める価値の重心が変わる可能性があります。 具体的には、判断・創造・関係構築など、文脈の読み取りや価値観の調整が必要な領域への需要が相対的に高まるとも言われています。こうした変化が進むと、「特定の職務における専門性(スキル)」を基準に採用・評価する動きが強まる可能性があります。 雇用の安定性と柔軟性のバランス 雇用制度の変化をめぐっては、複数の視点が存在します。 柔軟性を重視する立場からは: 個人がスキルに応じて多様な働き方を選べる機会が増える 企業側も必要な能力を必要なタイミングで活用できる 安定性を重視する立場からは: 柔軟化が進むと雇用のリスクが個人に転嫁されやすくなる セーフティネット(社会保険・雇用保険など)が雇用形態に依存している現行制度との矛盾が生じる これらは「どちらが正しいか」という問いではなく、社会がどのようなバランスを選ぶかという制度設計の問いとも言えます。AIの進展は、この選択を迫る契機になっている可能性があります。 まとめ:AIは制度を「消す」のではなく「再設計する」可能性がある 本記事で整理してきたように、AIが雇用に与える影響は、「職種の消滅」という単純な話にとどまらない可能性があります。より構造的な変化として、「雇用制度そのものの前提条件」が揺らぎ始めているという視点が重要です。 終身雇用・年功序列・正社員中心のモデルは、工業化社会の産物でした。それが機能した理由があったように、AI時代には異なる前提に基づく制度設計が模索されていくかもしれません。 ただし、変化の速度や方向性は、技術だけでなく、政策・企業文化・社会的合意によっても大きく左右されます。「AIが雇用をどう変えるか」という問いへの答えは、社会全体がどのような制度を選ぶかにもかかっています。 不安を感じることも、期待を持つことも、どちらも自然な反応です。しかし重要なのは、変化の構造を理解したうえで、自分自身の働き方や将来の設計について考え続けることではないでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI・自動化・データ活用の進展によって、 企業や社会における「雇用制度」はどのように変化していく可能性があるのか。 終身雇用・年功序列・正社員中心の雇用モデルは、 AI時代においてどのように再設計されていくのかを、 社会構造・組織設計・労働市場の視点から整理・考察してください。 【目的】 – AIが単に仕事を自動化するだけでなく、「雇用制度そのもの」に与える影響を整理する – 読者が働き方の変化を構造的に理解するための視点を提示する – AI時代における企業と労働者の関係の変化を考える材料を提供する 【読者像】 – 一般社会人(20〜50代) – 学生・就職活動中の若年層 – 将来の働き方や雇用の安定性に関心を持つ人 – AIが仕事や社会制度に与える影響を知りたい人 【記事構成】 1. 導入(問題提起) – AIの進化によって「仕事がなくなるのではないか」という不安が広がっていることを提示する – しかし変化しているのは仕事そのものだけでなく「雇用制度」である可能性を示す – なぜAI時代には雇用制度の再設計が議論され始めているのかを説明する 2. これまでの雇用制度は何を前提に作られてきたのか – 終身雇用・年功序列・正社員モデルなどの雇用制度が成立した歴史的背景を整理する – 工業化社会・大量雇用モデルとの関係を説明する – なぜこの制度が長く機能してきたのかを構造的に整理する 3. AIが雇用制度に与える変化 – AIが得意とする業務(定型業務・分析・情報処理など)を整理する – それによって企業の組織構造や仕事の分担がどう変わる可能性があるのかを説明する – 「職務ベース雇用」「プロジェクト型雇用」「ギグ型労働」などの動きにも触れてよい – ただし断定的な未来予測は避けること 4. 企業と労働者の関係はどう変わる可能性があるのか – AIによって企業が人を雇う理由がどのように変わる可能性があるかを整理する – 組織の階層構造、管理職の役割、専門職の位置づけなどの変化にも触れてよい – 雇用の安定性と柔軟性のバランスについて複数の視点から考察する 5. まとめ – AIは雇用を消すのではなく、雇用制度を再設計する可能性があることを整理する – 楽観・悲観どちらにも寄らず、読者が働き方の未来を考えるための視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AI時代の雇用制度構造) ※(図:企業と労働者の関係の変化) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 AIは雇用制度をどこまで変えるのか 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # AI時代に雇用制度はどう再設計されるのか --- ## 1. 導入:仕事がなくなるのか、制度が変わるのか 「AIに仕事を奪われる」という言葉が、ここ数年で急速に広まっています。製造ラインの自動化、文書作成の効率化、コールセンター業務のAI代替など、具体的な事例も増えてきました。しかし、この問いを「どの職種が残るか」という視点だけで捉えていると、本質的な変化を見逃す可能性があります。 変化しているのは、個々の仕事の内容だけではないかもしれません。より根本的な問いとして浮かび上がってきているのが、「企業が人を雇う仕組みそのもの」、すなわち雇用制度の変化です。 終身雇用・年功序列・正社員中心というモデルは、日本社会において長く機能してきました。しかし、AIや自動化の進展を背景に、この制度の前提条件が少しずつ変わり始めているとも言われています。本記事では、その構造的な変化の可能性を、複数の視点から整理・考察します。 --- ## 2. これまでの雇用制度は何を前提に作られてきたのか ### 工業化社会が生んだ「安定と忠誠」のモデル 現在の雇用制度の多くは、20世紀の工業化社会を背景に設計されました。大量生産・大量消費を支えるために、企業は多くの人材を長期的に確保する必要がありました。そのための仕組みとして機能したのが、終身雇用と年功序列です。 - **終身雇用**:企業が長期的な雇用を保障する代わりに、労働者は組織への忠誠と継続的な貢献を提供する - **年功序列**:勤続年数に応じて賃金と地位が上昇する仕組み。長く働くほど報われる設計 - **正社員モデル**:雇用の安定を核とし、福利厚生・退職金・昇進などがセットになったパッケージ型の雇用 これらの制度は、「スキルが均質で、変化の少ない業務環境」において機能しやすい構造でした。技術の変化が緩やかで、一度習得したスキルが長期にわたって価値を持ち続けた時代には、長期雇用の安定性は企業・労働者の双方にとってメリットがありました。 ### 制度の「前提」を支えてきたもの この制度が長く機能してきた理由は、以下のような構造的前提があったからと整理できます。 1. **業務の安定性**:求められるスキルや業務内容が大きく変化しにくかった 2. **組織の階層性**:管理職・一般職という明確な階層が、役割と報酬の設計を支えた 3. **情報の非対称性**:企業が労働市場の情報を持ち、個人は転職より内部昇進を選ぶ傾向があった --- ## 3. AIが雇用制度に与える変化の可能性 ### AIが得意とする業務領域 現在のAIが比較的高い精度でこなせる業務は、大きく以下のように整理されます。 - **定型的・反復的な処理**:データ入力、書類の仕分け、定型文書の作成 - **情報の収集・分析**:大量データの統計処理、パターン認識、レポート生成 - **照合・確認作業**:契約書のチェック、法規制との照合、品質検査 これらは、これまで「新卒・若手社員が担う業務」としても機能してきた領域でもあります。企業内での「経験を積む入口」となっていた仕事が自動化されることで、人材の育成ルート自体にも影響が出る可能性があります。 ### 組織構造への波及 AIの導入が進むことで、組織設計にも変化の圧力がかかり得ます。 ※(図:AI時代の雇用制度構造) たとえば、中間管理職の一部が担っていた「情報の集約・整理・上申」という役割は、AIによって代替されやすい業務でもあります。これにより、組織の階層が「フラット化(少ない管理層で構成される組織形態)」する方向に動くとも言われています。 また、プロジェクト単位での雇用(プロジェクト型雇用)や、特定のスキルを持つ人材を必要に応じて活用するギグ型労働(特定の仕事ごとに契約する働き方)、さらに職務内容を明確に定義したうえで雇用するジョブ型雇用への注目も高まっています。ただし、これらが従来の雇用モデルを完全に置き換えるかどうかは、現時点では不明確な部分も多く、慎重に見ていく必要があります。 --- ## 4. 企業と労働者の関係はどう変わる可能性があるのか ### 「人を雇う理由」の変化 従来、企業が正社員を採用するのは、「長期的な戦力として育成・定着させるため」という側面が強くありました。しかしAIが定型業務を担うようになると、企業が人間に求める価値の重心が変わる可能性があります。 具体的には、**判断・創造・関係構築**など、文脈の読み取りや価値観の調整が必要な領域への需要が相対的に高まるとも言われています。こうした変化が進むと、「特定の職務における専門性(スキル)」を基準に採用・評価する動きが強まる可能性があります。 ### 雇用の安定性と柔軟性のバランス 雇用制度の変化をめぐっては、複数の視点が存在します。 **柔軟性を重視する立場からは:** - 個人がスキルに応じて多様な働き方を選べる機会が増える - 企業側も必要な能力を必要なタイミングで活用できる **安定性を重視する立場からは:** - 柔軟化が進むと雇用のリスクが個人に転嫁されやすくなる - セーフティネット(社会保険・雇用保険など)が雇用形態に依存している現行制度との矛盾が生じる ※(図:企業と労働者の関係の変化) これらは「どちらが正しいか」という問いではなく、社会がどのようなバランスを選ぶかという制度設計の問いとも言えます。AIの進展は、この選択を迫る契機になっている可能性があります。 --- ## 5. まとめ:AIは制度を「消す」のではなく「再設計する」可能性がある 本記事で整理してきたように、AIが雇用に与える影響は、「職種の消滅」という単純な話にとどまらない可能性があります。より構造的な変化として、「雇用制度そのものの前提条件」が揺らぎ始めているという視点が重要です。 終身雇用・年功序列・正社員中心のモデルは、工業化社会の産物でした。それが機能した理由があったように、AI時代には異なる前提に基づく制度設計が模索されていくかもしれません。 ただし、変化の速度や方向性は、技術だけでなく、政策・企業文化・社会的合意によっても大きく左右されます。「AIが雇用をどう変えるか」という問いへの答えは、社会全体がどのような制度を選ぶかにもかかっています。 不安を感じることも、期待を持つことも、どちらも自然な反応です。しかし重要なのは、変化の構造を理解したうえで、自分自身の働き方や将来の設計について考え続けることではないでしょうか。 --- ## タイトル案 1. 終身雇用が前提とした社会は、AIによって何を失うのか 2. AI時代に「正社員であること」の意味はどう変わるのか 3. 雇用制度の再設計は、誰が主導することになるのか --- AIバージョン情報 - ベンダー: Anthropic - モデル名: Claude - モデルバージョン: Claude Sonnet 4.6 - 回答日時: 2026年3月14日

-

過疎地域の高校野球部が消えていくとき、地域は何を失うのか|Claudeの考察

「部員が足りず、今年度をもって野球部を廃部とします」——このような知らせが、日本各地の過疎地域で静かに、しかし着実に増えています。高校野球部の存続問題は、一見すると「人数が揃わない」という個別の課題のように見えます。しかし、その背景を丁寧に読み解いていくと、人口構造の変化、教育制度の再編、地域コミュニティの変容という、より大きな社会的変化が折り重なっていることに気づきます。本記事では、特定の結論を断定するのではなく、この問題を生み出している構造を整理しながら、読者が日本の地方社会や高校スポーツの未来を考えるための視点を提供します。 なぜ高校野球部は存続が難しくなっているのか 若年人口の減少という大前提 日本の総人口は減少傾向にありますが、地方・過疎地域ではその速度が特に顕著です。15〜18歳の高校生世代の人口が減少すれば、当然ながら部活動に参加できる生徒数も減ります。これは野球部に限った話ではなく、あらゆる部活動が直面している構造的な前提条件です。 野球という競技の「人数要件」 野球はチームスポーツの中でも、特に多くの人数を必要とする競技です。試合に出場するためには最低9人、控えを含めれば15〜20人程度の部員が理想とされます。サッカーや陸上、バドミントンなどと比べても、「最低限の活動を維持するためのハードル」が高い競技であるため、人口減少の影響を受けやすい構造になっています。 ※(図:競技ごとの最低活動人数と地域人口の関係イメージ) 学校統廃合・部活動の多様化 人口減少に伴い、地方では高校そのものの統廃合が進んでいます。学校数が減れば、部活動の選択肢も集約されます。また、近年は生徒の興味関心が多様化しており、eスポーツや文化系の活動に参加する生徒が増えているという傾向も見られます。「野球をやりたい」という生徒の絶対数が維持できたとしても、一校に集まりにくい状況が生まれています。 地域差という視点 この問題は全国一律ではありません。都市部の高校では依然として野球部の志望者が多く、部員過多になるケースもあります。一方、地方の小規模校では数人しか集まらないという二極化が起きています。同じ「高校野球」という制度の中で、地域によって全く異なる現実が存在していることは、見落とされがちな重要な視点です。 「合同チーム」という対応策が示すもの 制度の仕組みと現状 日本高等学校野球連盟(高野連)は、部員不足の学校が複数校合同でチームを編成し、公式大会に出場できる制度を設けています。これにより、単独では試合に出られない学校の生徒も、高校野球の舞台に立てる機会が保たれています。 制度が「つないで」いるもの 合同チームは、廃部を防ぎ、生徒の活動機会を守るという点で機能しています。学校ごとの「部」としては存続しつつ、実質的には複数校の生徒が一緒に練習・試合を行う形です。 変化する「チーム」の意味 一方で、合同チームの普及は、従来の高校野球が前提としてきた「一校一チーム」という文化のあり方を変えつつあります。学校ごとに異なる校風や伝統、地域との関係性がチームのアイデンティティを形成してきた側面があります。複数校が合同になることで、その輪郭がどう変わっていくのかは、単純に良し悪しで語れるものではなく、現在進行形で問われている問いです。 高校野球は地域社会にとって何だったのか 地域文化としての高校野球 高校野球は、単なるスポーツ活動にとどまらず、地域コミュニティの象徴的な存在として機能してきた歴史があります。地元紙や地域のラジオ・テレビ局が試合を丁寧に報じ、地域住民がスタンドに足を運んで応援する。そうした文化が、地域の結束やアイデンティティとゆるやかに結びついてきました。 甲子園という「舞台」が持つ意味 甲子園大会は、地方の高校にとって「地域の代表」として全国の舞台に立てる数少ない機会のひとつでした。地元チームの甲子園出場が、地域全体の話題になり、商店街に応援幕が張られ、老若男女が一体となって声援を送る——そうした風景は、地方社会における「共有された体験」として機能してきたといえます。 役割の変化 人口減少が進み、高齢化が加速する地方社会では、地域が「共有できる体験」の機会そのものが減っています。その中で高校野球が担ってきた役割は、スポーツの枠を超えたものでした。その機能が変化・縮小していくことは、地域社会全体の変容と切り離せない問題です。 ※(図:高校野球と地域社会の関係イメージ) 高校スポーツの未来を考える 「学校部活動」というモデルの問いなおし 日本の高校スポーツは長らく、「学校に所属する部活動」という形で運営されてきました。しかし近年、教員の働き方改革の観点からも、部活動の運営を学校単独で担うことの限界が議論されています。文部科学省は、地域の外部指導者やスポーツクラブとの連携を推進する方針を示しており、「学校部活動の地域移行」という考え方が広がりつつあります。 地域クラブ化という選択肢 学校の枠を超えて地域単位でスポーツクラブを運営するモデルは、ヨーロッパ諸国では一般的です。日本でも、サッカーを中心にJリーグのアカデミーや地域クラブが育成機能を担う事例が増えています。野球でも、学校部活動の枠に縛られない育成モデルが模索されています。ただし、地方では指導者の確保や活動資金など、新たな課題も生じます。 問いとして残すこと 高校野球部の存続問題は、「このままでいいのか」という問いであると同時に、「何を守り、何を変えるのか」という問いでもあります。地域の活力、生徒の教育機会、スポーツ文化の継承——これらは、いずれも一方を選べばもう一方が失われるような単純な話ではありません。 人口減少という不可逆的な変化の中で、日本の地方社会や高校スポーツがどのような形に変わっていくのか。その答えはまだ出ていません。だからこそ、私たち一人ひとりがこの問題を「他人事」ではなく、社会構造の変化として考える視点を持つことが、今求められているのかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 人口減少や地域社会の変化が進む中で、 「過疎地域における高校野球部の存続問題」は どのような社会構造の中で生まれているのか。 高校野球という文化・教育制度・地域社会の関係性を踏まえ、 この問題を単なる「部員不足の問題」としてではなく、 人口構造・教育制度・スポーツ文化の視点から整理・考察してください。 【目的】 – 高校野球部の存続問題を「個別の学校の問題」ではなく、社会構造の変化として理解する – 人口減少・地域社会・教育制度・スポーツ文化の関係を整理する – 読者が日本の地方社会や高校スポーツの未来について考える視点を提供する 【読者像】 – 一般社会人(20〜60代) – 学生や保護者 – 野球や高校スポーツに関心のある読者 – 地方社会や人口減少問題に関心のある層 【記事構成】 1. 導入(問題提起) – 過疎地域では高校野球部の存続が難しくなっている現状を提示する – 「部員不足」という表面的な問題の背後に、人口減少や地域社会の変化があることを示す – なぜこの問題が日本社会の変化を象徴するテーマになっているのかを簡潔に説明する 2. なぜ高校野球部は存続が難しくなっているのか – 人口減少や若年層の減少が学校スポーツに与える影響を整理する – 野球という競技が人数を必要とするスポーツである点に触れる – 学校統廃合や部活動の多様化など、複数の要因が重なっていることを説明する – 地域差がどのように現れているかにも触れる 3. 「合同チーム」という対応策 – 複数高校による合同チームの仕組みを説明する – 制度としては部活動を維持する方法であることを整理する – 一方で、学校単位のチーム文化や地域との関係にどのような変化が生まれるのかを考察する 4. 高校野球は地域社会にとって何なのか – 高校野球が単なるスポーツではなく、地域文化やコミュニティと結びついていることを説明する – 地元メディア・地域の応援文化・甲子園という舞台との関係を整理する – 地方において高校野球がどのような象徴的役割を持ってきたのかを考察する 5. 高校スポーツの未来 – 学校部活動というモデルが今後どのように変化する可能性があるのかを整理する – 地域クラブ化や学校スポーツの再編など、考えられる方向性を提示する – 過度に楽観・悲観せず、読者が日本社会の変化を考える視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:人口減少と高校スポーツの関係構造) ※(図:高校野球と地域社会の関係イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「過疎地域で高校野球部は存続できるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # 人口減少時代、高校野球部はどこへ向かうのか --- ## 1. 導入:「部員が集まらない」の背後にあるもの 「部員が足りず、今年度をもって野球部を廃部とします」 このような知らせが、日本各地の過疎地域で静かに、しかし着実に増えています。高校野球部の存続問題は、一見すると「人数が揃わない」という個別の課題のように見えます。しかし、その背景を丁寧に読み解いていくと、人口構造の変化、教育制度の再編、地域コミュニティの変容という、より大きな社会的変化が折り重なっていることに気づきます。 本記事では、特定の結論を断定するのではなく、この問題を生み出している構造を整理しながら、読者が日本の地方社会や高校スポーツの未来を考えるための視点を提供します。 --- ## 2. なぜ高校野球部は存続が難しくなっているのか ### 若年人口の減少という大前提 日本の総人口は減少傾向にありますが、地方・過疎地域ではその速度が特に顕著です。15〜18歳の高校生世代の人口が減少すれば、当然ながら部活動に参加できる生徒数も減ります。これは野球部に限った話ではなく、あらゆる部活動が直面している構造的な前提条件です。 ### 野球という競技の「人数要件」 野球はチームスポーツの中でも、特に多くの人数を必要とする競技です。試合に出場するためには最低9人、控えを含めれば15〜20人程度の部員が理想とされます。サッカーや陸上、バドミントンなどと比べても、「最低限の活動を維持するためのハードル」が高い競技であるため、人口減少の影響を受けやすい構造になっています。 ※(図:競技ごとの最低活動人数と地域人口の関係イメージ) ### 学校統廃合・部活動の多様化 人口減少に伴い、地方では高校そのものの統廃合が進んでいます。学校数が減れば、部活動の選択肢も集約されます。また、近年は生徒の興味関心が多様化しており、eスポーツや文化系の活動に参加する生徒が増えているという傾向も見られます。「野球をやりたい」という生徒の絶対数が維持できたとしても、一校に集まりにくい状況が生まれています。 ### 地域差という視点 この問題は全国一律ではありません。都市部の高校では依然として野球部の志望者が多く、部員過多になるケースもあります。一方、地方の小規模校では数人しか集まらないという二極化が起きています。同じ「高校野球」という制度の中で、地域によって全く異なる現実が存在していることは、見落とされがちな重要な視点です。 --- ## 3. 「合同チーム」という対応策が示すもの ### 制度の仕組みと現状 日本高等学校野球連盟(高野連)は、部員不足の学校が複数校合同でチームを編成し、公式大会に出場できる制度を設けています。これにより、単独では試合に出られない学校の生徒も、高校野球の舞台に立てる機会が保たれています。 ### 制度が「つないで」いるもの 合同チームは、廃部を防ぎ、生徒の活動機会を守るという点で機能しています。学校ごとの「部」としては存続しつつ、実質的には複数校の生徒が一緒に練習・試合を行う形です。 ### 変化する「チーム」の意味 一方で、合同チームの普及は、従来の高校野球が前提としてきた「一校一チーム」という文化のあり方を変えつつあります。学校ごとに異なる校風や伝統、地域との関係性がチームのアイデンティティを形成してきた側面があります。複数校が合同になることで、その輪郭がどう変わっていくのかは、単純に良し悪しで語れるものではなく、現在進行形で問われている問いです。 --- ## 4. 高校野球は地域社会にとって何だったのか ### 地域文化としての高校野球 高校野球は、単なるスポーツ活動にとどまらず、地域コミュニティの象徴的な存在として機能してきた歴史があります。地元紙や地域のラジオ・テレビ局が試合を丁寧に報じ、地域住民がスタンドに足を運んで応援する。そうした文化が、地域の結束やアイデンティティとゆるやかに結びついてきました。 ### 甲子園という「舞台」が持つ意味 甲子園大会は、地方の高校にとって「地域の代表」として全国の舞台に立てる数少ない機会のひとつでした。地元チームの甲子園出場が、地域全体の話題になり、商店街に応援幕が張られ、老若男女が一体となって声援を送る——そうした風景は、地方社会における「共有された体験」として機能してきたといえます。 ### 役割の変化 人口減少が進み、高齢化が加速する地方社会では、地域が「共有できる体験」の機会そのものが減っています。その中で高校野球が担ってきた役割は、スポーツの枠を超えたものでした。その機能が変化・縮小していくことは、地域社会全体の変容と切り離せない問題です。 ※(図:高校野球と地域社会の関係イメージ) --- ## 5. 高校スポーツの未来を考える ### 「学校部活動」というモデルの問いなおし 日本の高校スポーツは長らく、「学校に所属する部活動」という形で運営されてきました。しかし近年、教員の働き方改革の観点からも、部活動の運営を学校単独で担うことの限界が議論されています。文部科学省は、地域の外部指導者やスポーツクラブとの連携を推進する方針を示しており、「学校部活動の地域移行」という考え方が広がりつつあります。 ### 地域クラブ化という選択肢 学校の枠を超えて地域単位でスポーツクラブを運営するモデルは、ヨーロッパ諸国では一般的です。日本でも、サッカーを中心にJリーグのアカデミーや地域クラブが育成機能を担う事例が増えています。野球でも、学校部活動の枠に縛られない育成モデルが模索されています。ただし、地方では指導者の確保や活動資金など、新たな課題も生じます。 ### 問いとして残すこと 高校野球部の存続問題は、「このままでいいのか」という問いであると同時に、「何を守り、何を変えるのか」という問いでもあります。地域の活力、生徒の教育機会、スポーツ文化の継承——これらは、いずれも一方を選べばもう一方が失われるような単純な話ではありません。 人口減少という不可逆的な変化の中で、日本の地方社会や高校スポーツがどのような形に変わっていくのか。その答えはまだ出ていません。だからこそ、私たち一人ひとりがこの問題を「他人事」ではなく、社会構造の変化として考える視点を持つことが、今求められているのかもしれません。 --- ## タイトル案 1. 過疎地域の高校野球部が消えていくとき、地域は何を失うのか 2. 部員不足の野球部が問いかける、日本の地方社会の変化とは何か 3. 合同チームが増える時代に、高校野球の「地域との絆」はどこへ行くのか --- AIバージョン情報 - ベンダー: Anthropic - モデル名: Claude - モデルバージョン: Claude Sonnet 4.6 - 回答日時: 2026年3月14日

-

クリエイターの仕事はフリーランス化していくのか|Claudeの考察

近年、デザイナーやライター、映像ディレクター、イラストレーターといったクリエイティブ職の働き方が、多様化しています。正社員として企業に属するだけでなく、フリーランスとして複数の企業と契約する人、副業として創作活動を行う人、個人でコンテンツを発信して収益を得る人など、その形態はさまざまです。こうした変化は「クリエイターの働き方が、企業に雇用されるモデルからプロジェクト単位の契約型モデルへ移行している」という見方を生んでいます。本記事では、この変化が実際に起きているのかどうかを、社会構造・技術・産業の観点から整理します。結論を断定するのではなく、読者が自分の働き方を考えるための材料を提供することを目的としています。 クリエイターの働き方が契約型と相性が良い理由 成果物ベースの仕事であること クリエイティブ職の多くは、「勤務時間」よりも「制作物」に価値が生まれます。デザイン1点、記事1本、楽曲1曲という形で納品物が明確なため、プロジェクト単位で契約を結びやすい性質があります。 プロジェクト単位で仕事が発生すること 企業側も、常にクリエイティブな制作物を必要とするわけではありません。新製品のローンチ時、キャンペーン期間、サービスのリニューアルなど、特定のタイミングに需要が集中します。このため、「必要なときに必要なスキルを持つ人を起用する」という発想が生まれやすくなっています。 デジタル化による場所・環境の非依存化 制作環境のデジタル化により、物理的なオフィスや機材室がなくても高品質な制作が可能になりました。クラウドストレージ・リモートコミュニケーションツール・共同編集ソフトウェアの普及が、外部クリエイターとの協働を現実的なものにしています。 契約型が広がる背景にある社会構造 プラットフォームの登場 クラウドソーシングサービス(例:ランサーズ、クラウドワークスなど)やSNSの普及により、クリエイターが企業や個人から直接仕事を受注できる経路が増えました。かつては「仕事を得るためには会社に属することが必要」という前提がありましたが、その構造が変わりつつあります。 リモートワークの定着 2020年代に急速に普及したリモートワークは、「同じオフィスにいる人と仕事をする」という慣習を崩しました。地理的な距離が縮まったことで、国内外を問わず外部クリエイターを起用するハードルが下がっています。 AIによる制作補助ツールの登場 画像生成AI・文章生成AI・音楽生成AIなどのツールは、制作における「作業コスト」を大幅に下げています。これにより、小規模チームや個人が、以前は大きなスタジオや制作会社が担っていた仕事をこなせるようになっています。一方で、AIツールを使いこなすスキルが新たな競争軸になるという側面もあります。 それでも「雇用」が残る理由 契約型の広がりを整理する一方で、クリエイターの完全フリーランス化が起きていない・起きにくい領域があることも見逃せません。 ブランド管理・企画・編集の中枢機能 企業のブランドアイデンティティを守り、一貫したクリエイティブ方針を維持するためには、内部に継続的な判断力を持つ人材が必要です。こうした役割は、単発の外部委託では担いにくい部分です。 長期・大規模プロジェクト ゲーム開発やIPビジネス(知的財産を軸にしたコンテンツ展開)のように、数年単位で一貫したクリエイティブ体制が求められる領域では、チームの内製化が合理的な選択になります。 ディレクション機能の重要性 外部クリエイターを複数起用するほど、それを束ねるディレクター(制作を統括・管理する役職)の役割が重要になります。このディレクション機能は、企業の中核として雇用される形が多く、「契約型の拡大が逆に雇用の重要性を高める」という構造も存在します。 重要なのは「雇用か契約か」ではなく、役割の変化 本質的な問いは、雇用形態そのものよりも、クリエイターとして何を担うかという役割の変化にあるかもしれません。 作業者としてのクリエイター 特定のスキルを持ち、依頼された制作物を高品質に仕上げる役割。AIツールの普及により、この領域では「人間の代替可能性」が議論されるようになっています。ただし、AIが出力したものを判断・編集・改善する人間の目は依然として必要とされています。 企画・編集・ディレクションを担うクリエイター 何を作るかを考え、制作の方向性を決め、クオリティを管理する役割。この機能は雇用・契約を問わず、価値が高まっていると言えます。 AIと協働するクリエイター AIをツールとして活用しながら、人間にしかできない感性・文脈理解・倫理的判断を加えていく役割。新しい働き方の可能性として注目されています。同じ「デザイナー」「ライター」という肩書きでも、どの役割を担うかによって、働き方の選択肢や市場価値は大きく変わります。 まとめ:ハイブリッドな構造の時代へ クリエイターの働き方は、「雇用から契約へ」という単純な一方向の移行が起きているわけではなさそうです。むしろ、雇用と契約が混在するハイブリッドな構造が広がっている、と整理するほうが実態に近いかもしれません。 企業はコアとなる機能を内製化しながら、専門性の高い制作を外部に委託する。クリエイターは、一つの企業に属しながら副業・兼業で別のプロジェクトに関わる。こうした重層的な働き方が、今後の標準になっていく可能性があります。 「雇用か契約か」という二択で考えるよりも、自分がどんな役割を担い、どんな価値を提供できるかを問い直すことが、クリエイターにとっての実践的な問いになるのではないでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 クリエイターの働き方は今後、 「企業に雇用されるモデル」から 「プロジェクト単位の契約型モデル」へ移行していくのか。 デザイン、ライティング、映像制作、ゲーム開発、イラスト、音楽など、 クリエイティブ職の働き方がどのように変化しているのかを、 AI・プラットフォーム・リモートワーク・産業構造の変化という観点から整理してください。 【目的】 – クリエイターの働き方が「雇用」から「契約」に移行しているのかを構造的に整理する – フリーランス化・プロジェクト化・副業化などの変化を冷静に考察する – AI時代においてクリエイターという仕事がどのように位置づけられるのかを理解するための視点を提示する 【読者像】 – 一般社会人(20〜50代) – クリエイティブ職を志望する学生 – 副業やフリーランスに興味を持つ人 – AIや自動化による仕事の変化に関心を持つ人 – クリエイターの働き方の未来を知りたい人 【記事構成】 1. 導入(問題提起) – 近年、クリエイターの働き方が変化していることを提示する – フリーランス、業務委託、副業クリエイターなどが増えている背景を簡潔に説明する – 「雇用モデル」と「契約モデル」という働き方の違いを提示し、本記事の問題設定を示す 2. クリエイターの働き方はなぜ契約型と相性が良いのか – 成果物ベースの仕事であること – プロジェクト単位で仕事が発生すること – デジタル化により場所に依存しない制作環境が生まれていること – なぜ企業が外部クリエイターを活用しやすくなっているのかを整理する 3. 契約型が広がる背景にある社会構造 – プラットフォーム(クラウドソーシング、SNSなど)の存在 – リモートワークの普及 – AIによる制作補助ツールの登場 – 小規模チームや個人でも制作が可能になったこと 4. それでも雇用が残る理由 – ブランド管理や企画などの中枢機能 – 長期プロジェクト(ゲーム開発、IPビジネスなど) – 外部クリエイターを統括するディレクション機能 – 「完全フリーランス化」が起きない理由を整理する 5. 重要なのは「雇用か契約か」ではなく役割の変化 – 作業者としてのクリエイター – 企画・編集・ディレクションを担うクリエイター – AIと協働するクリエイター – 同じ職種でも役割によって価値が変わることを説明する 6. まとめ – クリエイターの働き方は単純にフリーランス化するわけではない可能性を整理する – 「雇用」と「契約」が混在するハイブリッド構造の可能性に触れる – 読者が今後の働き方を考えるための視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:クリエイターの雇用型と契約型の構造) ※(図:企業と外部クリエイターの関係モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「クリエイターは会社に属する仕事なのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # クリエイターの働き方は「雇用」から「契約」に変わっていくのか --- ## 1. 導入:変化する「クリエイターの働き方」という問い 近年、デザイナーやライター、映像ディレクター、イラストレーターといったクリエイティブ職の働き方が、多様化しています。正社員として企業に属するだけでなく、フリーランスとして複数の企業と契約する人、副業として創作活動を行う人、個人でコンテンツを発信して収益を得る人など、その形態はさまざまです。 こうした変化は「クリエイターの働き方が、企業に雇用されるモデルからプロジェクト単位の契約型モデルへ移行している」という見方を生んでいます。 本記事では、この変化が実際に起きているのかどうかを、社会構造・技術・産業の観点から整理します。結論を断定するのではなく、**読者が自分の働き方を考えるための材料**を提供することを目的としています。 --- ## 2. クリエイターの働き方が契約型と相性が良い理由 ### 成果物ベースの仕事であること クリエイティブ職の多くは、「勤務時間」よりも「制作物」に価値が生まれます。デザイン1点、記事1本、楽曲1曲という形で納品物が明確なため、プロジェクト単位で契約を結びやすい性質があります。 ### プロジェクト単位で仕事が発生すること 企業側も、常にクリエイティブな制作物を必要とするわけではありません。新製品のローンチ時、キャンペーン期間、サービスのリニューアルなど、特定のタイミングに需要が集中します。このため、「必要なときに必要なスキルを持つ人を起用する」という発想が生まれやすくなっています。 ### デジタル化による場所・環境の非依存化 制作環境のデジタル化により、物理的なオフィスや機材室がなくても高品質な制作が可能になりました。クラウドストレージ・リモートコミュニケーションツール・共同編集ソフトウェアの普及が、外部クリエイターとの協働を現実的なものにしています。 ※(図:企業と外部クリエイターの関係モデル) --- ## 3. 契約型が広がる背景にある社会構造 ### プラットフォームの登場 クラウドソーシングサービス(例:ランサーズ、クラウドワークスなど)やSNSの普及により、クリエイターが企業や個人から直接仕事を受注できる経路が増えました。かつては「仕事を得るためには会社に属することが必要」という前提がありましたが、その構造が変わりつつあります。 ### リモートワークの定着 2020年代に急速に普及したリモートワークは、「同じオフィスにいる人と仕事をする」という慣習を崩しました。地理的な距離が縮まったことで、国内外を問わず外部クリエイターを起用するハードルが下がっています。 ### AIによる制作補助ツールの登場 画像生成AI・文章生成AI・音楽生成AIなどのツールは、制作における「作業コスト」を大幅に下げています。これにより、小規模チームや個人が、以前は大きなスタジオや制作会社が担っていた仕事をこなせるようになっています。一方で、AIツールを使いこなすスキルが新たな競争軸になるという側面もあります。 --- ## 4. それでも「雇用」が残る理由 契約型の広がりを整理する一方で、クリエイターの完全フリーランス化が起きていない・起きにくい領域があることも見逃せません。 ### ブランド管理・企画・編集の中枢機能 企業のブランドアイデンティティを守り、一貫したクリエイティブ方針を維持するためには、内部に継続的な判断力を持つ人材が必要です。こうした役割は、単発の外部委託では担いにくい部分です。 ### 長期・大規模プロジェクト ゲーム開発やIPビジネス(知的財産を軸にしたコンテンツ展開)のように、数年単位で一貫したクリエイティブ体制が求められる領域では、チームの内製化が合理的な選択になります。 ### ディレクション機能の重要性 外部クリエイターを複数起用するほど、それを束ねるディレクター(制作を統括・管理する役職)の役割が重要になります。このディレクション機能は、企業の中核として雇用される形が多く、「契約型の拡大が逆に雇用の重要性を高める」という構造も存在します。 ※(図:クリエイターの雇用型と契約型の構造) --- ## 5. 重要なのは「雇用か契約か」ではなく、役割の変化 本質的な問いは、雇用形態そのものよりも、**クリエイターとして何を担うか**という役割の変化にあるかもしれません。 ### 作業者としてのクリエイター 特定のスキルを持ち、依頼された制作物を高品質に仕上げる役割。AIツールの普及により、この領域では「人間の代替可能性」が議論されるようになっています。ただし、AIが出力したものを判断・編集・改善する人間の目は依然として必要とされています。 ### 企画・編集・ディレクションを担うクリエイター 何を作るかを考え、制作の方向性を決め、クオリティを管理する役割。この機能は雇用・契約を問わず、価値が高まっていると言えます。 ### AIと協働するクリエイター AIをツールとして活用しながら、人間にしかできない感性・文脈理解・倫理的判断を加えていく役割。新しい働き方の可能性として注目されています。 同じ「デザイナー」「ライター」という肩書きでも、どの役割を担うかによって、働き方の選択肢や市場価値は大きく変わります。 --- ## 6. まとめ:ハイブリッドな構造の時代へ クリエイターの働き方は、「雇用から契約へ」という単純な一方向の移行が起きているわけではなさそうです。むしろ、**雇用と契約が混在するハイブリッドな構造**が広がっている、と整理するほうが実態に近いかもしれません。 企業はコアとなる機能を内製化しながら、専門性の高い制作を外部に委託する。クリエイターは、一つの企業に属しながら副業・兼業で別のプロジェクトに関わる。こうした重層的な働き方が、今後の標準になっていく可能性があります。 「雇用か契約か」という二択で考えるよりも、**自分がどんな役割を担い、どんな価値を提供できるか**を問い直すことが、クリエイターにとっての実践的な問いになるのではないでしょうか。 --- ## タイトル案 1. クリエイターの仕事はフリーランス化していくのか 2. AIとプラットフォームの時代にクリエイターの雇用はどう変わるのか 3. 契約型クリエイターが増える時代に「雇用」に残る意味とは何か --- AIバージョン情報 - ベンダー: Anthropic - モデル名: Claude - モデルバージョン: Claude Sonnet 4.6 - 回答日時: 2026年3月14日

-

WBCはなぜシーズン前に開催されなければならないのか|Claudeの考察

WBC(ワールド・ベースボール・クラシック)は、野球の世界一を決める国際大会として、野球ファンのみならず広く一般社会の注目を集めます。日本代表の活躍、スター選手同士の対決、国を背負った戦いの緊張感——これらは多くの人を熱狂させます。しかし、大会の「制度的な構造」に目を向けると、WBCはかなり複雑な立ち位置に置かれていることがわかります。開催時期は毎回3月前後——これはMLB(メジャーリーグベースボール)をはじめとするプロ野球リーグの開幕直前にあたります。なぜこの時期なのか。なぜシーズン中ではないのか。この問いを入口として、WBCとプロリーグの間に横たわる制度的な関係を整理してみます。 プロリーグと国際大会:目的の違いが生む緊張関係 商業リーグとしてのプロ野球 MLBや日本のNPB(日本野球機構)などのプロリーグは、本質的には商業組織です。球団はオーナーや投資家が出資し、選手契約・放映権・スポンサー収入によって運営されます。リーグの目的は「より多くの観客を集め、収益を最大化すること」であり、選手はその商業価値を担う「球団の資産」でもあります。 国際大会の別の目的 一方、WBCは野球の国際普及と各国代表の競争を目的として、MLBとWBSC(世界野球ソフトボール連盟)が主導して設立された大会です。サッカーのFIFAワールドカップや、バスケのFIBAワールドカップに相当するイベントと位置づけられますが、決定的な違いがあります。それは、選手が所属するプロリーグの「シーズン」と大会が直接競合しうるという点です。 サッカーや他の競技では代表戦のための「国際マッチデー」が設けられ、クラブは選手を一定期間代表チームに提供する義務があります。野球にはこれに相当する国際的な取り決めが制度化されておらず、MLBと大会運営組織の間での個別交渉が基盤となっています。 ※(図:WBCとプロリーグの制度関係) シーズン前開催が生む構造的問題 なぜ3月開催なのか WBCが3月に開催されるのは、MLBのスプリングトレーニング(春季キャンプ)期間と重なるからです。この時期であれば、各球団の「公式シーズン」はまだ始まっていません。つまり、球団側の興行上の損害を最小化しつつ、選手を大会に参加させやすい唯一の「隙間」がこの時期にあたります。 コンディションのギャップ しかし、スプリングトレーニングとはあくまで「開幕に向けて体を仕上げていく準備期間」です。この時期の選手は、まだシーズンを戦える状態には至っていません。そこへ、国を代表して勝利を追求する高強度の試合が続くWBCが重なります。 投手であれば投球数の制限が設けられる場合もありますが、試合の緊張感や走塁・守備での瞬発的な負荷は通常のキャンプ練習とは次元が異なります。コンディション管理と競技的な勝負の間に、構造的なギャップが生まれます。 利害の三角形 この問題を整理すると、以下の三者の利害が交差することがわかります。 球団:シーズン本番に備えた選手の健康・調整状態を守りたい 選手:代表として出場したいが、怪我や疲労のリスクを避けたい 大会運営(MLB・WBSC):最高レベルの選手が出場する大会を実現したい この三者の利害は必ずしも一致せず、WBCへの出場を選手が辞退するケースや、球団が難色を示すケースが繰り返されてきました。 球団資産と国家代表という二重構造 選手の二重の帰属 WBCに出場する選手は、国家代表として試合に臨む一方で、法的・契約的には球団所属の選手です。つまり、選手は二つの組織に同時に帰属するという二重構造の中に置かれます。 この構造において問いとなるのは、怪我やコンディション悪化のリスクが誰に帰属するか、という点です。WBC出場中に選手が故障した場合、その損失を被るのは第一義的に球団です。大会出場による収益を直接得ない球団が、リスクだけを負担する構造になりかねません。 制度的な調整の仕組み この問題に対応するため、WBCでは球団への補償保険制度が設けられており、出場選手が大会中に故障した場合には一定の補填がなされる仕組みが整備されています。また、各球団は選手の出場に同意する・しないを判断する権限を持つとされており、完全な強制参加ではありません。 ただし、この制度が完全に機能しているかについては議論があります。保険補填の水準や球団の同意権の実効性については、大会ごとに条件が異なり、一貫した国際的ルールとはなっていないのが現状です。 ※(図:球団・選手・国家代表の利害関係) それでも大会が成立している理由 野球の国際市場拡大という共通利益 では、なぜこれほど多くの構造的問題を抱えながら、WBCは継続・拡大しているのでしょうか。 その背景には、野球の国際市場拡大という、MLBと大会運営組織が共有する長期的な利益があります。WBCを通じてアジア・中南米・欧州での野球への関心が高まれば、将来的な放映権収入・スポンサー収益・選手市場の拡大につながります。短期的なリスクを超えた、戦略的な投資として大会が位置づけられているのです。 スター選手の物語が生む価値 また、WBCは単なる競技大会にとどまらず、選手の「国を背負う物語」を生み出す装置でもあります。2023年大会における大谷翔平選手やトラウト選手の対決は、野球ファン以外にも大きく報道されました。こうした「物語」は、プロリーグのレギュラーシーズンでは生まれにくい国際的な注目を呼び込みます。 この注目は、最終的には選手個人のブランド価値を高め、球団や用具メーカー、スポンサーにも波及する経済効果を持ちます。つまり、プロリーグ側にとっても「無縁ではない利益」が存在します。 「協調と緊張」の共存 結果として、WBCとプロリーグの関係は対立でも完全な協調でもなく、緊張をはらみながら共存する構造として成立しています。球団は不満を持ちながらも参加を容認し、選手は誇りを持ちながらもリスクを計算し、大会運営は利害調整を繰り返しながら大会を継続させています。 まとめ:WBCを「制度」として読み解く WBCとプロリーグの関係は、単純な「感動の国際大会 vs. 商業主義のプロリーグ」という対立図式では捉えきれません。 実態は、商業リーグ・国際大会・国家代表・選手個人という複数の制度と利害が複雑に交差する構造です。開催時期、選手の二重帰属、怪我のリスク配分、保険制度——これらは、スポーツが単なる競技を超えた制度的・経済的な構造の上に成立していることを示しています。 スポーツの「感動」は確かに存在します。しかしその背後には、多くの制度的調整と利害関係が積み重なっています。WBCを「制度」として読み解くことは、スポーツをより多角的に理解する一つの視点を提供してくれます。 読者の皆さんが、次にWBCの中継を観るとき、選手のプレーと同時に「この大会はどのような構造の上に成り立っているのか」という問いを持ち始めるきっかけになれば幸いです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 国際野球大会「WBC(ワールド・ベースボール・クラシック)」は、 プロ野球リーグ(特にMLB)のシーズンとの関係において 制度的な矛盾や緊張関係を抱えているのか。 国家代表としての大会と、 商業リーグとしてのプロ野球シーズンという 二つの制度がどのように共存しているのかを 構造的に整理・考察してください。 【目的】 – WBCを単なるスポーツイベントとしてではなく、制度・ビジネス・国際関係の視点から整理する – 「代表戦の感動」だけでなく、リーグ運営・選手契約・大会構造などの制度的背景を理解する材料を提示する – 国際スポーツ大会とプロリーグの関係がどのような構造で成立しているのかを読み解く 【読者像】 – 野球やスポーツに関心のある一般読者 – WBCを楽しんでいるが、制度や運営構造については詳しくない人 – スポーツビジネスや国際大会の仕組みに興味がある読者 – スポーツを社会構造の視点から読み解きたい人 【記事構成】 1. 導入(問題提起) – WBCは世界的な注目を集める国際大会であることを説明する – しかし、その開催はプロリーグのシーズンと密接に関係していることを提示する – なぜWBCはシーズン前に開催されるのかという疑問を提示する 2. プロリーグと国際大会の制度的な目的の違い – プロリーグ(MLBなど)は商業リーグであることを説明する – 国際大会は国家代表・国際普及という別の目的を持つことを整理する – 同じ選手が二つの制度にまたがることで生まれる緊張関係を説明する 3. シーズン前開催が生む構造的問題 – WBCがスプリングトレーニング期間と重なる理由を整理する – 選手のコンディション調整と大会の競技強度のギャップを説明する – 球団・選手・大会運営の利害関係を構造的に整理する 4. 球団資産と国家代表という二重構造 – 選手は国家代表として出場するが、契約は球団と結んでいることを説明する – 怪我やコンディションリスクがどこに帰属するのかという問題を整理する – 保険制度や出場制限などの制度的調整について触れる 5. それでも大会が成立している理由 – WBCが野球の国際市場拡大に果たす役割を説明する – スター選手の物語や国際的注目が生まれる構造を整理する – プロリーグと国際大会の「協調と緊張」の関係をまとめる 6. まとめ – WBCとプロリーグの関係は単純な対立ではなく、複数の利害が交差する制度であることを整理する – 国際大会と商業リーグが共存するスポーツの特徴を示す – 読者がスポーツを制度や構造の視点から考えるための材料を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「感情的なスポーツ論」ではなく、「構造理解のための記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:WBCとプロリーグの制度関係) ※(図:球団・選手・国家代表の利害関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「WBCはプロ野球シーズンと制度的に両立しているのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # WBCとプロ野球シーズンの制度的関係を整理する --- ## 1. 導入:世界が注目する大会の「構造的な背景」 WBC(ワールド・ベースボール・クラシック)は、野球の世界一を決める国際大会として、野球ファンのみならず広く一般社会の注目を集めます。日本代表の活躍、スター選手同士の対決、国を背負った戦いの緊張感——これらは多くの人を熱狂させます。 しかし、大会の「制度的な構造」に目を向けると、WBCはかなり複雑な立ち位置に置かれていることがわかります。開催時期は毎回3月前後——これはMLB(メジャーリーグベースボール)をはじめとするプロ野球リーグの開幕直前にあたります。なぜこの時期なのか。なぜシーズン中ではないのか。この問いを入口として、WBCとプロリーグの間に横たわる制度的な関係を整理してみます。 --- ## 2. プロリーグと国際大会:目的の違いが生む緊張関係 ### 商業リーグとしてのプロ野球 MLBや日本のNPB(日本野球機構)などのプロリーグは、本質的には**商業組織**です。球団はオーナーや投資家が出資し、選手契約・放映権・スポンサー収入によって運営されます。リーグの目的は「より多くの観客を集め、収益を最大化すること」であり、選手はその商業価値を担う「球団の資産」でもあります。 ### 国際大会の別の目的 一方、WBCは**野球の国際普及と各国代表の競争**を目的として、MLBとWBSC(世界野球ソフトボール連盟)が主導して設立された大会です。サッカーのFIFAワールドカップや、バスケのFIBAワールドカップに相当するイベントと位置づけられますが、決定的な違いがあります。それは、**選手が所属するプロリーグの「シーズン」と大会が直接競合しうる**という点です。 サッカーや他の競技では代表戦のための「国際マッチデー」が設けられ、クラブは選手を一定期間代表チームに提供する義務があります。野球にはこれに相当する国際的な取り決めが制度化されておらず、MLBと大会運営組織の間での個別交渉が基盤となっています。 ※(図:WBCとプロリーグの制度関係) --- ## 3. シーズン前開催が生む構造的問題 ### なぜ3月開催なのか WBCが3月に開催されるのは、MLBの**スプリングトレーニング**(春季キャンプ)期間と重なるからです。この時期であれば、各球団の「公式シーズン」はまだ始まっていません。つまり、球団側の興行上の損害を最小化しつつ、選手を大会に参加させやすい唯一の「隙間」がこの時期にあたります。 ### コンディションのギャップ しかし、スプリングトレーニングとはあくまで「開幕に向けて体を仕上げていく準備期間」です。この時期の選手は、まだシーズンを戦える状態には至っていません。そこへ、国を代表して勝利を追求する**高強度の試合**が続くWBCが重なります。 投手であれば投球数の制限が設けられる場合もありますが、試合の緊張感や走塁・守備での瞬発的な負荷は通常のキャンプ練習とは次元が異なります。コンディション管理と競技的な勝負の間に、構造的なギャップが生まれます。 ### 利害の三角形 この問題を整理すると、以下の三者の利害が交差することがわかります。 - **球団**:シーズン本番に備えた選手の健康・調整状態を守りたい - **選手**:代表として出場したいが、怪我や疲労のリスクを避けたい - **大会運営(MLB・WBSC)**:最高レベルの選手が出場する大会を実現したい この三者の利害は必ずしも一致せず、WBCへの出場を選手が辞退するケースや、球団が難色を示すケースが繰り返されてきました。 --- ## 4. 球団資産と国家代表という二重構造 ### 選手の二重の帰属 WBCに出場する選手は、**国家代表**として試合に臨む一方で、法的・契約的には**球団所属の選手**です。つまり、選手は二つの組織に同時に帰属するという二重構造の中に置かれます。 この構造において問いとなるのは、**怪我やコンディション悪化のリスクが誰に帰属するか**、という点です。WBC出場中に選手が故障した場合、その損失を被るのは第一義的に球団です。大会出場による収益を直接得ない球団が、リスクだけを負担する構造になりかねません。 ### 制度的な調整の仕組み この問題に対応するため、WBCでは**球団への補償保険制度**が設けられており、出場選手が大会中に故障した場合には一定の補填がなされる仕組みが整備されています。また、各球団は選手の出場に同意する・しないを判断する権限を持つとされており、完全な強制参加ではありません。 ただし、この制度が完全に機能しているかについては議論があります。保険補填の水準や球団の同意権の実効性については、大会ごとに条件が異なり、一貫した国際的ルールとはなっていないのが現状です。 ※(図:球団・選手・国家代表の利害関係) --- ## 5. それでも大会が成立している理由 ### 野球の国際市場拡大という共通利益 では、なぜこれほど多くの構造的問題を抱えながら、WBCは継続・拡大しているのでしょうか。 その背景には、**野球の国際市場拡大という、MLBと大会運営組織が共有する長期的な利益**があります。WBCを通じてアジア・中南米・欧州での野球への関心が高まれば、将来的な放映権収入・スポンサー収益・選手市場の拡大につながります。短期的なリスクを超えた、戦略的な投資として大会が位置づけられているのです。 ### スター選手の物語が生む価値 また、WBCは単なる競技大会にとどまらず、**選手の「国を背負う物語」**を生み出す装置でもあります。2023年大会における大谷翔平選手やトラウト選手の対決は、野球ファン以外にも大きく報道されました。こうした「物語」は、プロリーグのレギュラーシーズンでは生まれにくい国際的な注目を呼び込みます。 この注目は、最終的には選手個人のブランド価値を高め、球団や用具メーカー、スポンサーにも波及する経済効果を持ちます。つまり、プロリーグ側にとっても「無縁ではない利益」が存在します。 ### 「協調と緊張」の共存 結果として、WBCとプロリーグの関係は**対立でも完全な協調でもなく、緊張をはらみながら共存する構造**として成立しています。球団は不満を持ちながらも参加を容認し、選手は誇りを持ちながらもリスクを計算し、大会運営は利害調整を繰り返しながら大会を継続させています。 --- ## 6. まとめ:WBCを「制度」として読み解く WBCとプロリーグの関係は、単純な「感動の国際大会 vs. 商業主義のプロリーグ」という対立図式では捉えきれません。 実態は、**商業リーグ・国際大会・国家代表・選手個人という複数の制度と利害が複雑に交差する構造**です。開催時期、選手の二重帰属、怪我のリスク配分、保険制度——これらは、スポーツが単なる競技を超えた制度的・経済的な構造の上に成立していることを示しています。 スポーツの「感動」は確かに存在します。しかしその背後には、多くの制度的調整と利害関係が積み重なっています。WBCを「制度」として読み解くことは、スポーツをより多角的に理解する一つの視点を提供してくれます。 読者の皆さんが、次にWBCの中継を観るとき、選手のプレーと同時に「この大会はどのような構造の上に成り立っているのか」という問いを持ち始めるきっかけになれば幸いです。 --- ## タイトル案 1. WBCはなぜシーズン前に開催されなければならないのか 2. 球団と国家代表のはざまで選手はどちらに属しているのか 3. プロ野球リーグとWBCは本当に同じ方向を向いているのか --- AIバージョン情報 - ベンダー: Anthropic - モデル名: Claude - モデルバージョン: Claude Sonnet 4.6 - 回答日時: 2026年3月14日

-

クラウドに依存することは合理的な選択なのか|Claudeの考察

クラウドストレージにファイルを保存し、特定のメールサービスで連絡を取り、AIツールで業務を補助する——こうした日常の積み重ねの中で、私たちは気づかないうちに特定のテクノロジー企業のサービスに深く依存しています。企業レベルでも同様です。基幹業務をAWSやAzureなどのクラウドプラットフォームで運用し、SalesforceやSAPで顧客・業務管理を行い、特定のAIベンダーのAPIで自社サービスを構築する——こうした構造が今や当たり前になっています。この状態を指す言葉が「ベンダーロックイン」です。直訳すれば「特定の販売者への固定化」。この言葉をめぐっては、「安定性をもたらす合理的な選択だ」という評価と、「企業の自由な意思決定を縛る構造だ」という批判の両方が存在します。本記事では、どちらが正しいかを断定するのではなく、この現象の構造を整理し、読者自身が判断するための材料を提供することを目的とします。 ベンダーロックインが「安定性」として語られる理由 統合された環境が生む一貫性 同一ベンダーのサービスを複数利用すると、それらはシームレスに連携するよう設計されています。たとえば、Microsoft 365(旧Office 365)を導入すれば、Word・Excel・Teams・OneDriveが一体として動作し、管理コストが下がります。別々のベンダーのサービスを組み合わせる場合、その連携のための追加作業が発生します。この「統合性」こそが、ベンダーロックインが選ばれる最も合理的な理由のひとつです。 サポートと責任範囲の明確化 特定のベンダーに依存することで、障害発生時の問い合わせ先が一本化されます。複数ベンダーが絡むシステムでは、「どのサービスが原因か」を特定するだけで時間を要することがあります。一元化された責任構造は、問題解決を速めるうえで現実的なメリットです。 セキュリティと更新の自動化 大手クラウドベンダーは、セキュリティパッチの適用やシステムの更新を自動的に行います。自社でインフラを管理するオンプレミス環境(社内サーバーによる自前管理)に比べ、こうした保守作業の負担が大幅に軽減されます。 なぜ企業はあえて「依存」を受け入れるのか 端的に言えば、「乗り換えコストを払うより、現状維持の方が合理的」という判断です。安定稼働・コスト・人材スキルが特定の環境に最適化された状態では、移行そのものがリスクになります。 ベンダーロックインが「退出障壁」として語られる理由 データ移行の困難さ あるクラウドサービスで長年蓄積したデータを別のサービスに移すとき、フォーマットの違いや対応APIの違いが壁になります。データは「どこにでも持ち運べる資産」のように見えて、実際には特定のプラットフォームに最適化された形で保存されていることが多いのです。 乗り換えコスト(Switching Cost) 経済学の概念として「スイッチングコスト」があります。これは、現在のサービスをやめて別のものに移行する際に発生する費用や手間の総称です。金銭的コストだけでなく、以下のような要素が含まれます。 学習コスト:新しいシステムへの習熟にかかる時間と労力 再構築コスト:既存の業務フローや連携設定のやり直し 心理的コスト:慣れ親しんだ環境を変えることへの抵抗感 これらが積み重なると、「乗り換えたくても乗り換えられない」状態が生まれます。 APIとフォーマットへの依存 特定ベンダーの独自API(アプリケーション同士をつなぐ仕組み)を使ってシステムを構築すると、そのAPIが変更・廃止されたときに対応が必要になります。標準化されたオープンな仕様ではなく、ベンダー固有の仕様に深く依存するほど、退出の難易度は上がります。 ロックインは「戦略」なのか、それとも「結果」なのか ビジネスモデルとしての囲い込み IT企業の収益モデルは、多くの場合「継続利用」に依存しています。SaaS(Software as a Service:月額や年額で利用するソフトウェアサービス)は、顧客が使い続けることで収益が発生します。この構造において、ロックインは意図せずとも「顧客の継続利用を促す仕組み」として機能します。一部の研究者やビジネスアナリストは、一部のベンダーが意図的に乗り換えを困難にする設計をしていると指摘しています。ただし、こうした指摘はすべてのケースに当てはまるわけではなく、ケースバイケースで判断が必要です。 エコシステムと標準化という別の視点 しかし、ロックインをすべて「囲い込み戦略」として見るのは単純すぎます。大規模なプラットフォームは、多くのサードパーティ(外部の企業や開発者)が参加するエコシステムを形成します。AWSのマーケットプレイスやAppleのApp Storeがその例です。こうしたエコシステムは、参加者全体に価値をもたらす側面もあります。また、業界標準のフォーマットや相互運用性(異なるシステム間でデータや機能をやり取りできる性質)を推進する動きも各分野で進んでいます。 AIプラットフォームにおける新しいロックイン 生成AIの分野では、特定ベンダーのAIモデルをシステムに組み込む動きが加速しています。モデルの性能・コスト・APIの仕様は各社で異なり、一度特定のモデルに最適化されたシステムを構築すると、別モデルへの移行には相応のコストが伴います。これは従来のクラウドロックインに加え、「AIモデルへの依存」という新たな層が加わっていることを意味します。 まとめ:ベンダーロックインを「構造」として読む ベンダーロックインは、善でも悪でもありません。それは、現代のテクノロジー環境が生み出す「依存と安定の交換条件」とも言える構造です。安定性・効率・コスト削減という便益を得るために、私たちは自由な移行という選択肢の一部を手放します。この交換が合理的かどうかは、組織や個人の状況によって異なります。 重要なのは、この構造を「知らずに受け入れる」のではなく、「理解した上で選択する」ことではないでしょうか。テクノロジーの選択は、単なるツールの選択ではなく、将来の選択肢の幅を決める意思決定でもあります。依存することと、依存に気づくこと——その差が、テクノロジーと社会の関係を考える起点になるのかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 IT・クラウド・AIプラットフォームの普及に伴って語られる 「ベンダーロックイン」は、 システム運用の安定性を生む仕組みなのか、 それとも企業や組織の退出を困難にする構造なのか。 この問いを、AIの視点から冷静かつ構造的に整理・考察してください。 【目的】 – 「ロックイン=悪」という単純な評価ではなく、制度や構造として理解する – IT・クラウド・AIサービスにおける依存関係の意味を整理する – 読者がテクノロジー選択の背景にある力学を理解するための視点を提供する 【読者像】 – IT業界に詳しくない一般読者 – クラウド・AIサービスを日常的に使っている人 – テクノロジー企業のビジネスモデルに興味がある人 – 社会構造としてのテクノロジーに関心のある読者 【記事構成】 1. 導入(問題提起) – 多くのITサービスやクラウド環境が特定ベンダーに依存している現状を提示する – 「ベンダーロックイン」という言葉がなぜ議論されるのかを示す – 安定性と依存性という二つの評価が存在することを提示する 2. ベンダーロックインが「安定性」として語られる理由 – システム統合や運用の一貫性が生まれる仕組みを説明する – サポート・責任範囲・セキュリティなどの観点から整理する – なぜ企業があえて依存関係を受け入れるのかを説明する 3. ベンダーロックインが「退出障壁」として語られる理由 – データ移行コストやシステム変更コストを整理する – API・フォーマット・運用フローなどの依存構造を説明する – 乗り換えコスト(Switching Cost)の概念を紹介する 4. ロックインは戦略なのか、それとも結果なのか – IT企業のビジネスモデルとの関係を整理する – クラウド・AIプラットフォームにおける囲い込み戦略の可能性を説明する – しかし同時に、標準化やエコシステム形成という側面にも触れる 5. まとめ – ベンダーロックインを善悪の問題としてではなく構造として再整理する – 「依存」と「安定」の関係を改めて確認する – 読者がテクノロジーと社会の関係を考える視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:ベンダーロックインの構造) ※(図:依存関係と退出コストの関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「ベンダーロックインは安定性なのか、それとも退出障壁なのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: # ベンダーロックインをどう読むか ## 特定のサービスへの依存は、安定をもたらすのか、それとも自由を奪うのか --- ### はじめに:私たちはいつの間にか「依存」している クラウドストレージにファイルを保存し、特定のメールサービスで連絡を取り、AIツールで業務を補助する——こうした日常の積み重ねの中で、私たちは気づかないうちに特定のテクノロジー企業のサービスに深く依存しています。 企業レベルでも同様です。基幹業務をAWSやAzureなどのクラウドプラットフォームで運用し、SalesforceやSAPで顧客・業務管理を行い、特定のAIベンダーのAPIで自社サービスを構築する——こうした構造が今や当たり前になっています。 この状態を指す言葉が「ベンダーロックイン」です。直訳すれば「特定の販売者への固定化」。この言葉をめぐっては、「安定性をもたらす合理的な選択だ」という評価と、「企業の自由な意思決定を縛る構造だ」という批判の両方が存在します。 本記事では、どちらが正しいかを断定するのではなく、この現象の構造を整理し、読者自身が判断するための材料を提供することを目的とします。 --- ## ベンダーロックインが「安定性」として語られる理由 ### 統合された環境が生む一貫性 同一ベンダーのサービスを複数利用すると、それらはシームレスに連携するよう設計されています。たとえば、Microsoft 365(旧Office 365)を導入すれば、Word・Excel・Teams・OneDriveが一体として動作し、管理コストが下がります。別々のベンダーのサービスを組み合わせる場合、その連携のための追加作業が発生します。 この「統合性」こそが、ベンダーロックインが選ばれる最も合理的な理由のひとつです。 ### サポートと責任範囲の明確化 特定のベンダーに依存することで、障害発生時の問い合わせ先が一本化されます。複数ベンダーが絡むシステムでは、「どのサービスが原因か」を特定するだけで時間を要することがあります。一元化された責任構造は、問題解決を速めるうえで現実的なメリットです。 ### セキュリティと更新の自動化 大手クラウドベンダーは、セキュリティパッチの適用やシステムの更新を自動的に行います。自社でインフラを管理するオンプレミス環境(社内サーバーによる自前管理)に比べ、こうした保守作業の負担が大幅に軽減されます。 ### なぜ企業はあえて「依存」を受け入れるのか 端的に言えば、「乗り換えコストを払うより、現状維持の方が合理的」という判断です。安定稼働・コスト・人材スキルが特定の環境に最適化された状態では、移行そのものがリスクになります。 --- ## ベンダーロックインが「退出障壁」として語られる理由 ※(図:依存関係と退出コストの関係) ### データ移行の困難さ あるクラウドサービスで長年蓄積したデータを別のサービスに移すとき、フォーマットの違いや対応APIの違いが壁になります。データは「どこにでも持ち運べる資産」のように見えて、実際には特定のプラットフォームに最適化された形で保存されていることが多いのです。 ### 乗り換えコスト(Switching Cost) 経済学の概念として「スイッチングコスト」があります。これは、現在のサービスをやめて別のものに移行する際に発生する費用や手間の総称です。金銭的コストだけでなく、以下のような要素が含まれます。 - **学習コスト**:新しいシステムへの習熟にかかる時間と労力 - **再構築コスト**:既存の業務フローや連携設定のやり直し - **心理的コスト**:慣れ親しんだ環境を変えることへの抵抗感 これらが積み重なると、「乗り換えたくても乗り換えられない」状態が生まれます。 ### APIとフォーマットへの依存 特定ベンダーの独自API(アプリケーション同士をつなぐ仕組み)を使ってシステムを構築すると、そのAPIが変更・廃止されたときに対応が必要になります。標準化されたオープンな仕様ではなく、ベンダー固有の仕様に深く依存するほど、退出の難易度は上がります。 --- ## ロックインは「戦略」なのか、それとも「結果」なのか ※(図:ベンダーロックインの構造) ### ビジネスモデルとしての囲い込み IT企業の収益モデルは、多くの場合「継続利用」に依存しています。SaaS(Software as a Service:月額や年額で利用するソフトウェアサービス)は、顧客が使い続けることで収益が発生します。この構造において、ロックインは意図せずとも「顧客の継続利用を促す仕組み」として機能します。 一部の研究者やビジネスアナリストは、一部のベンダーが意図的に乗り換えを困難にする設計をしていると指摘しています。ただし、こうした指摘はすべてのケースに当てはまるわけではなく、ケースバイケースで判断が必要です。 ### エコシステムと標準化という別の視点 しかし、ロックインをすべて「囲い込み戦略」として見るのは単純すぎます。大規模なプラットフォームは、多くのサードパーティ(外部の企業や開発者)が参加するエコシステムを形成します。AWSのマーケットプレイスやAppleのApp Storeがその例です。 こうしたエコシステムは、参加者全体に価値をもたらす側面もあります。また、業界標準のフォーマットや相互運用性(異なるシステム間でデータや機能をやり取りできる性質)を推進する動きも各分野で進んでいます。 ### AIプラットフォームにおける新しいロックイン 生成AIの分野では、特定ベンダーのAIモデルをシステムに組み込む動きが加速しています。モデルの性能・コスト・APIの仕様は各社で異なり、一度特定のモデルに最適化されたシステムを構築すると、別モデルへの移行には相応のコストが伴います。 これは従来のクラウドロックインに加え、「AIモデルへの依存」という新たな層が加わっていることを意味します。 --- ## まとめ:ベンダーロックインを「構造」として読む ベンダーロックインは、善でも悪でもありません。それは、現代のテクノロジー環境が生み出す「依存と安定の交換条件」とも言える構造です。 安定性・効率・コスト削減という便益を得るために、私たちは自由な移行という選択肢の一部を手放します。この交換が合理的かどうかは、組織や個人の状況によって異なります。 重要なのは、この構造を「知らずに受け入れる」のではなく、「理解した上で選択する」ことではないでしょうか。テクノロジーの選択は、単なるツールの選択ではなく、将来の選択肢の幅を決める意思決定でもあります。 依存することと、依存に気づくこと——その差が、テクノロジーと社会の関係を考える起点になるのかもしれません。 --- ## タイトル案 1. クラウドに依存することは合理的な選択なのか 2. ベンダーロックインはなぜ避けられない構造になっているのか 3. テクノロジーへの依存が安定と引き換えに奪うものは何か --- AIバージョン情報 – ベンダー: Anthropic – モデル名: Claude – モデルバージョン: Claude Sonnet 4.6 – 回答日時: 2026年3月14日