近年、「副業」という言葉が社会の中で広く語られるようになりました。政府の働き方改革や企業の副業解禁の流れ、さらにはインターネットを活用した個人ビジネスの拡大などが背景にあり、副業は新しい働き方の象徴のように扱われることもあります。しかし、本業とは別の仕事で収入を得るという形自体は、決して現代に突然生まれたものではありません。歴史を振り返ると、日本には「内職」と呼ばれる似た労働形態が存在していました。農家の副収入や家内工業など、家庭の中で行われる労働は、長い間社会の中で重要な役割を担ってきました。本記事では、「副業」と「内職」を単なる言葉の違いとしてではなく、社会構造の違いとして整理します。働き方の歴史的な変化を踏まえながら、現代の副業がどのような位置づけにあるのかを考察していきます。 内職とは何だったのか 「内職」とは、家庭の中で行われる補助的な労働を指す言葉として広く使われてきました。日本では江戸時代から近代にかけて、農家や都市の家庭が本業の合間に行う収入源として存在していました。 例えば、農村では農閑期に手工業を行うことが一般的でした。織物、紙漉き、竹細工などの仕事が家庭単位で行われ、それらは地域の商人や問屋を通じて市場に流通していました。また、都市部では工場の下請け作業として、部品の組み立てや縫製などを家庭で行う形も見られました。 このような内職の特徴の一つは、家計補助という位置づけです。内職は主たる収入源ではなく、家族の生活を補う追加収入として存在することが多くありました。 もう一つの特徴は、労働が既存の生産構造の末端に組み込まれていたことです。多くの場合、内職は企業や問屋から与えられた作業を家庭で処理する形で行われました。つまり、仕事の内容や価格は市場や企業によって決められており、個人が主体的に仕事を選ぶ余地は限定的でした。 このように内職は、家庭の余剰労働力を活用する仕組みとして社会の中に存在していたと言えるかもしれません。 現代の副業の特徴 現代の副業は、形態の多様性という点で、従来の内職とは異なる側面を持っています。特にインターネットの普及は、副業のあり方を大きく変化させました。 例えば、ライティングやデザイン、プログラミングといったオンライン業務は、クラウドソーシングなどのプラットフォームを通じて受注することができます。また、動画配信、オンライン講座、ネットショップ運営など、個人が直接市場にアクセスする形の副業も広がっています。 こうした仕組みでは、個人が仕事を探し、サービスを提供し、報酬を得るまでのプロセスが、比較的自由に行える場合があります。つまり、企業の下請け作業として与えられる労働だけでなく、自分で市場を開拓する形の副業も存在しています。 また、副業は単なる家計補助としてだけでなく、キャリア形成の手段として語られることも増えています。本業で得たスキルを別の分野で活用したり、副業をきっかけに独立を目指したりするケースも見られます。 このように現代の副業は、労働の補助的な役割にとどまらず、個人の働き方の選択肢として捉えられる場面が増えているようです。 ※(図:近代労働と現代の副業市場の構造) 副業と内職の共通点と違い 副業と内職には共通点も存在します。最も分かりやすいのは、本業以外で収入を得る労働という点です。本業の外側で働くという構造は、過去から現在まで一定程度存在してきました。 しかし、両者の違いを整理すると、いくつかの構造的な差異が見えてきます。 市場との距離 内職の場合、多くは問屋や企業を通じた間接的な市場参加でした。一方で現代の副業では、インターネットを通じて個人が直接顧客と接点を持つことも可能になっています。 労働の主体性 内職は与えられた作業をこなす労働である場合が多かったのに対し、副業では仕事の種類や働き方を自分で選択できる場面が増えています。 ただし、この違いは完全に明確なものではありません。現代の副業の中にも、プラットフォーム上で単純作業を受けるような「内職的な労働」が存在しています。つまり、副業と内職は完全に別の概念というより、連続した労働形態として捉えることもできるかもしれません。 ※(図:内職と副業の労働構造の違い) まとめ 副業はしばしば「新しい働き方」として語られますが、本業以外の労働という構造自体は、歴史の中で長く存在してきました。内職という形で家庭の中に組み込まれていた労働は、社会の生産構造の一部として機能していたと言えるでしょう。 一方で現代の副業は、インターネットやプラットフォーム経済の発展によって、市場との関係や労働の主体性が変化している可能性があります。個人が直接市場とつながる機会が増えたことは、働き方の幅を広げているとも考えられます。 ただし、副業のすべてが新しい働き方であるとは限りません。現代の副業の中にも、内職に近い構造を持つ労働が存在しています。 こうした視点から見ると、副業は単なる流行ではなく、労働市場の変化や技術の進展とともに形を変えてきた働き方の一つとして理解できるのかもしれません。副業と内職の違いを整理することは、現代の働き方の変化をより広い視点で捉える手がかりになると言えるでしょう。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 現代で広く使われる「副業」という概念は、 歴史的に存在していた「内職」とどのように違うのか。 労働・社会構造・経済の観点から整理・考察してください。 【目的】 – 「副業ブーム」という表面的な現象ではなく、歴史的・構造的な視点から労働の変化を整理する – 現代の副業が、過去の内職と同じものなのか、それとも異なる社会構造の産物なのかを考える材料を提示する – 読者が「働き方の変化」を長期的な視点で理解するための視点を提供する 【読者像】 – 一般社会人(20〜50代) – 副業に関心がある会社員 – フリーランスや個人事業に興味がある人 – 働き方の変化を社会構造の観点から考えたい読者 【記事構成】 1. 導入(問題提起) – 近年「副業」が広く語られるようになった背景を提示する – 副業は新しい働き方のように語られるが、歴史的には「内職」という似た概念が存在していたことに触れる – 本記事では、副業と内職の違いを単なる言葉の違いではなく、社会構造の違いとして整理することを示す 2. 内職とは何だったのか – 歴史的に「内職」がどのような労働形態だったのかを説明する – 農家の副収入、家内工業、工場の下請けなどの具体例に触れる – 内職が社会の中でどのような位置づけの労働だったのかを整理する – 家計補助・余剰労働という特徴を説明する 3. 現代の副業の特徴 – 現代の副業がどのような形で広がっているのかを整理する – インターネットやプラットフォームの存在が労働構造をどのように変えたのかを説明する – 副業が単なる家計補助ではなく、キャリア形成や独立につながる可能性を持つ点に触れる 4. 副業と内職の共通点と違い – 両者の共通点(本業以外の労働)を整理する – 市場との関係、収入構造、労働の主体性などの違いを構造的に整理する – 「現代の副業の中にも内職的な労働が存在する」という視点にも触れる 5. まとめ – 副業は単なる新しい流行ではなく、社会構造の変化の中で生まれた働き方である可能性を整理する – 副業と内職の違いを理解することで、現代の働き方の変化をより広い視点で捉えられることを示す – 読者が「働くとは何か」を考えるきっかけとして締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:内職と副業の労働構造の違い) ※(図:近代労働と現代の副業市場の構造) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「副業は本当に新しい働き方なのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入(問題提起) 近年、「副業」という言葉が社会の中で広く語られるようになりました。政府の働き方改革や企業の副業解禁の流れ、さらにはインターネットを活用した個人ビジネスの拡大などが背景にあり、副業は新しい働き方の象徴のように扱われることもあります。 しかし、本業とは別の仕事で収入を得るという形自体は、決して現代に突然生まれたものではありません。歴史を振り返ると、日本には「内職」と呼ばれる似た労働形態が存在していました。農家の副収入や家内工業など、家庭の中で行われる労働は、長い間社会の中で重要な役割を担ってきました。 本記事では、「副業」と「内職」を単なる言葉の違いとしてではなく、社会構造の違いとして整理します。働き方の歴史的な変化を踏まえながら、現代の副業がどのような位置づけにあるのかを考察していきます。 --- ### 内職とは何だったのか 「内職」とは、家庭の中で行われる補助的な労働を指す言葉として広く使われてきました。日本では江戸時代から近代にかけて、農家や都市の家庭が本業の合間に行う収入源として存在していました。 例えば、農村では農閑期に手工業を行うことが一般的でした。織物、紙漉き、竹細工などの仕事が家庭単位で行われ、それらは地域の商人や問屋を通じて市場に流通していました。また、都市部では工場の下請け作業として、部品の組み立てや縫製などを家庭で行う形も見られました。 このような内職の特徴の一つは、「家計補助」という位置づけです。内職は主たる収入源ではなく、家族の生活を補う追加収入として存在することが多くありました。 もう一つの特徴は、労働が既存の生産構造の末端に組み込まれていたことです。多くの場合、内職は企業や問屋から与えられた作業を家庭で処理する形で行われました。つまり、仕事の内容や価格は市場や企業によって決められており、個人が主体的に仕事を選ぶ余地は限定的でした。 このように内職は、家庭の余剰労働力を活用する仕組みとして社会の中に存在していたと言えるかもしれません。 --- ### 現代の副業の特徴 現代の副業は、形態の多様性という点で、従来の内職とは異なる側面を持っています。特にインターネットの普及は、副業のあり方を大きく変化させました。 例えば、ライティングやデザイン、プログラミングといったオンライン業務は、クラウドソーシングなどのプラットフォームを通じて受注することができます。また、動画配信、オンライン講座、ネットショップ運営など、個人が直接市場にアクセスする形の副業も広がっています。 こうした仕組みでは、個人が仕事を探し、サービスを提供し、報酬を得るまでのプロセスが、比較的自由に行える場合があります。つまり、企業の下請け作業として与えられる労働だけでなく、自分で市場を開拓する形の副業も存在しています。 また、副業は単なる家計補助としてだけでなく、キャリア形成の手段として語られることも増えています。本業で得たスキルを別の分野で活用したり、副業をきっかけに独立を目指したりするケースも見られます。 このように現代の副業は、労働の補助的な役割にとどまらず、個人の働き方の選択肢として捉えられる場面が増えているようです。 ※(図:近代労働と現代の副業市場の構造) --- ### 副業と内職の共通点と違い 副業と内職には共通点も存在します。最も分かりやすいのは、「本業以外で収入を得る労働」という点です。本業の外側で働くという構造は、過去から現在まで一定程度存在してきました。 しかし、両者の違いを整理すると、いくつかの構造的な差異が見えてきます。 一つは「市場との距離」です。内職の場合、多くは問屋や企業を通じた間接的な市場参加でした。一方で現代の副業では、インターネットを通じて個人が直接顧客と接点を持つことも可能になっています。 もう一つは「労働の主体性」です。内職は与えられた作業をこなす労働である場合が多かったのに対し、副業では仕事の種類や働き方を自分で選択できる場面が増えています。 ただし、この違いは完全に明確なものではありません。現代の副業の中にも、プラットフォーム上で単純作業を受けるような「内職的な労働」が存在しています。つまり、副業と内職は完全に別の概念というより、連続した労働形態として捉えることもできるかもしれません。 ※(図:内職と副業の労働構造の違い) --- ### まとめ 副業はしばしば「新しい働き方」として語られますが、本業以外の労働という構造自体は、歴史の中で長く存在してきました。内職という形で家庭の中に組み込まれていた労働は、社会の生産構造の一部として機能していたと言えるでしょう。 一方で現代の副業は、インターネットやプラットフォーム経済の発展によって、市場との関係や労働の主体性が変化している可能性があります。個人が直接市場とつながる機会が増えたことは、働き方の幅を広げているとも考えられます。 ただし、副業のすべてが新しい働き方であるとは限りません。現代の副業の中にも、内職に近い構造を持つ労働が存在しています。 こうした視点から見ると、副業は単なる流行ではなく、労働市場の変化や技術の進展とともに形を変えてきた働き方の一つとして理解できるのかもしれません。副業と内職の違いを整理することは、現代の働き方の変化をより広い視点で捉える手がかりになると言えるでしょう。 --- ### タイトル案 副業は内職と同じ働き方の延長線なのか 現代の副業は歴史的な内職と何が違うのか 副業という働き方は内職からどこまで変化したのか --- AIバージョン情報 – ベンダー: OpenAI – モデル名: ChatGPT – モデルバージョン: GPT-5.3 – 回答日時: 2026-03-15

ChatGPT

-

副業は内職と同じ働き方の延長線なのか|ChatGPTの考察

-

WBCは野球の世界的スポーツブランドになり得る大会なのか|ChatGPTの考察

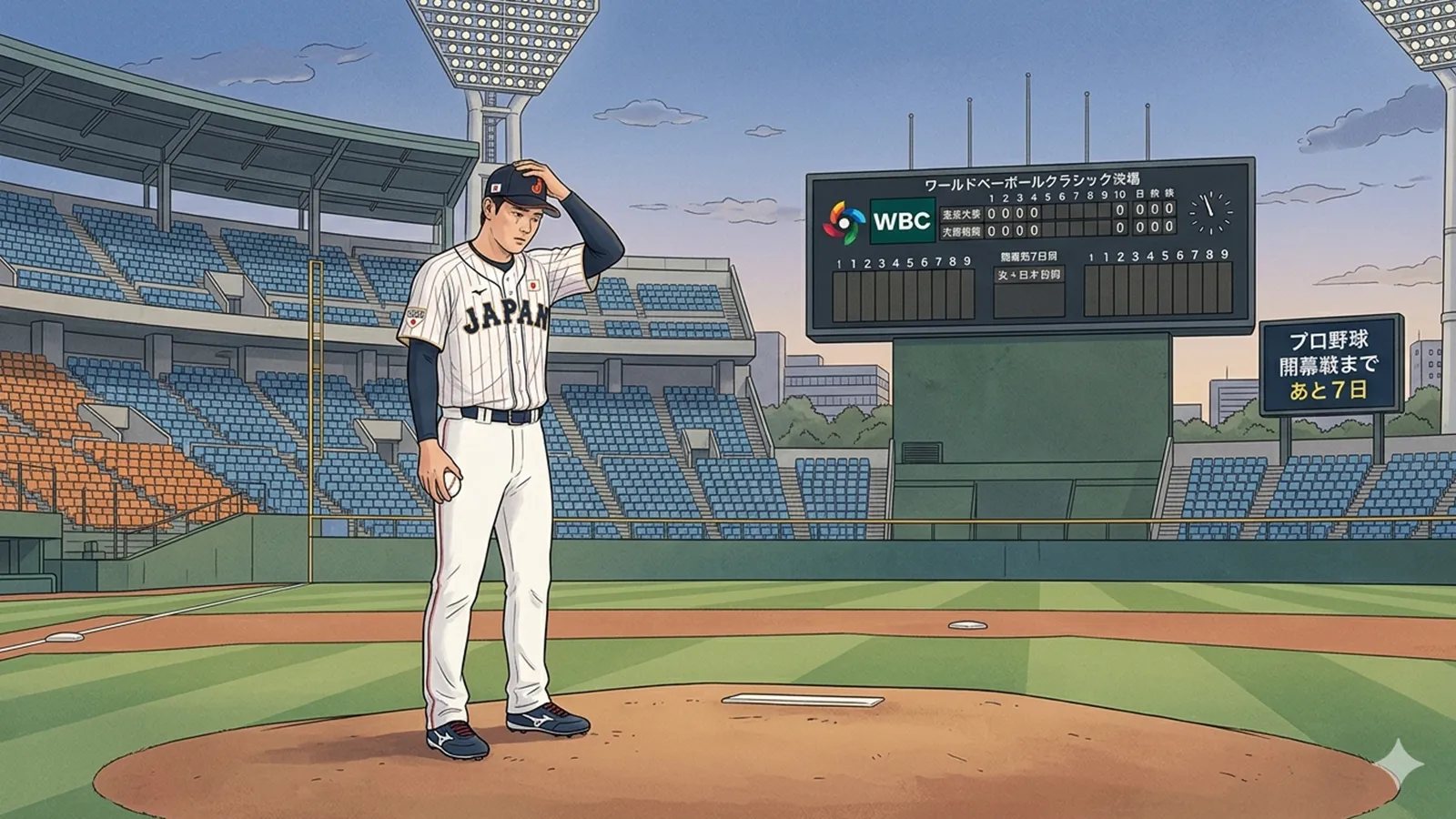

ワールド・ベースボール・クラシック(WBC)は2006年に創設された国際野球大会であり、近年では世界中の野球ファンから大きな注目を集めるイベントとなっています。各国のスター選手が代表として参加し、国家対抗という形式の中で劇的な試合が生まれることも多く、スポーツイベントとしての存在感を高めています。しかし、この大会が「世界大会」としてどの程度の位置づけにあるのかについてはさまざまな見方があります。サッカーのワールドカップやオリンピックのようなグローバルブランドとなり得るのか、それとも特定地域で人気の高い大会にとどまるのかという問いは、スポーツビジネスや文化、歴史、市場構造を考えるうえでも興味深いテーマです。本記事では、WBCを単なるスポーツ大会としてではなく「スポーツブランド形成」という視点から整理し、その構造を多角的に考察します。 グローバルスポーツブランドの条件 スポーツ大会が世界的なブランドとして認識されるためには、いくつかの要素が組み合わさる必要があります。一般的には次のような条件が挙げられます。 競技の世界的普及(競技人口や参加国の広がり) 大会の長い歴史と継続性 世界的スター選手の存在 国際的なメディア露出と市場規模 国家や地域を代表する物語性 例えばサッカーのワールドカップは1930年から続く大会であり、世界中で競技人口が非常に多いスポーツを背景としています。また、オリンピックは競技そのものだけでなく、国際社会や政治、文化と結びつきながら長い歴史を積み重ねてきました。 こうした大会は単なるスポーツイベントではなく、文化的・社会的な意味を持つ「スポーツブランド」として機能しています。 ※(図:スポーツ大会のグローバルブランド形成構造) WBCが持つブランド形成の要素 WBCにもスポーツブランド形成につながる要素はいくつか存在します。 まず大きな特徴は国家代表による対戦という構造です。普段は各国リーグでプレーしている選手たちが自国代表として集まり試合を行うことで、競技としての面白さだけでなく、国や地域のアイデンティティを象徴する物語が生まれます。 また、メジャーリーグベースボール(MLB)を中心とするスター選手の参加も大会の価値を高める要素となっています。トップレベルの選手が国際大会で対戦することで、リーグ戦とは異なる魅力が生まれ、メディアやファンの関心を集めやすくなります。 さらに、放送や配信を通じて大会の視聴者が増えていることもブランド形成に影響する要素です。特に日本、韓国、台湾、アメリカなどでは高い視聴率を記録することもあり、国際的なスポーツイベントとしての存在感は徐々に強まっています。 WBCが抱える構造的な課題 一方で、WBCが世界的なスポーツブランドとして定着するためにはいくつかの課題も存在します。 まず指摘されることが多いのは、野球という競技の地域的な広がりです。野球は北米、東アジア、中南米では非常に人気の高いスポーツですが、ヨーロッパやアフリカなどでは競技人口が比較的少ないとされています。この点はサッカーなどと比較した際の大きな違いとして挙げられます。 また、リーグと国際大会の関係も重要な要素です。多くのトップ選手はプロリーグに所属しているため、リーグ側と代表大会のスケジュールや選手管理をどのように調整するかは長年議論されてきたテーマです。 さらに、大会の歴史がまだ比較的浅いこともあり、国際大会としての制度や位置づけが今後どのように定着していくのかは、時間をかけて形成されていく可能性があります。 ※(図:リーグと国際大会の関係) WBCは何を目指す大会なのか こうした要素を踏まえると、WBCは単純に「世界一を決める大会」という役割だけではなく、複数の目的を持つイベントとして理解することもできそうです。 一つは国家対抗のスポーツイベントとしての役割です。代表チーム同士の対戦はリーグ戦とは異なる緊張感や物語性を生み出し、多くのファンにとって特別な意味を持つ試合となります。 もう一つは野球市場拡大の戦略としての側面です。国際大会を通じて新しい地域に競技の魅力を伝えることは、スポーツビジネスにおいて重要な取り組みの一つとされています。 そのため、WBCは完成された世界ブランドというよりも、スポーツの国際化の過程の中で形成されつつあるプロジェクトとして見ることもできるかもしれません。 まとめ WBCは国家代表による物語性やスター選手の参加など、スポーツブランド形成につながる要素を持つ大会です。一方で、競技人口の地域差やリーグとの関係、大会の歴史といった要因もあり、その位置づけはまだ発展の途中にあるとも言えるでしょう。 そのため、この大会を単純に成功あるいは失敗と評価するのではなく、スポーツの国際化や市場拡張のプロセスの中でどのような役割を担っているのかを考える視点も重要かもしれません。 WBCを通して見えてくるのは、スポーツ大会が単なる競技の場であるだけでなく、文化、経済、市場、国家といったさまざまな要素が交差する場であるという側面です。こうした構造を踏まえながら、スポーツの国際大会の意味を改めて考えてみることも、スポーツを楽しむ一つの視点になるのではないでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 ワールド・ベースボール・クラシック(WBC)は、 世界的なスポーツブランドを形成する大会になり得るのか、 それとも地域的な人気イベントとして位置づく大会なのかについて、 スポーツビジネス・文化・歴史・市場構造の視点から整理・考察してください。 【目的】 – WBCを単なるスポーツ大会としてではなく、「スポーツブランド形成」という視点から読み解く – 国際大会・リーグ・市場の関係を整理し、スポーツのグローバル化の構造を理解する – 読者がスポーツとビジネス、文化の関係を多角的に考えるための視点を提供する 【読者像】 – 一般のスポーツファン – 野球に関心のある読者 – スポーツビジネスや国際大会の構造に興味のある人 – WBCの盛り上がりを感じつつも、その位置づけを知りたい読者 【記事構成】 1. 導入(問題提起) – WBCが近年大きな注目を集めている国際大会であることを説明する – なぜこの大会が「世界大会」として語られるのかという疑問を提示する – スポーツにおける「グローバルブランド」とは何かという視点を簡潔に提示する 2. グローバルスポーツブランドの条件 – スポーツ大会が世界的ブランドになるための条件を整理する – 競技人口、市場規模、歴史、スター選手、継続性などの要素を説明する – サッカーのワールドカップやオリンピックなどの国際大会と比較しながら整理する 3. WBCが持つブランド形成の要素 – 国家代表という構造が生み出す物語性 – スター選手の参加による大会価値 – MLBなどのリーグとの関係 – メディア・視聴率・国際的関心の拡大などを整理する 4. WBCが抱える構造的な課題 – 野球競技の地域的な広がり – リーグと代表大会の利害関係 – 大会の歴史の浅さ – 国際大会としての制度設計などを整理する 5. WBCは何を目指す大会なのか – 国家対抗イベントとしての側面 – 野球市場拡大の戦略としての側面 – スポーツブランド形成のプロセスとしての位置づけを考察する 6. まとめ – WBCを単純に「成功」「失敗」と評価するのではなく、 スポーツの国際化と市場拡張の中でどのような位置にあるのかを整理する – 読者がスポーツ大会の意味を構造的に考えるための視点を提示して締めくくる – 過度に楽観・悲観せず、思考を促す形で終える 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「結論を押し付ける記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:スポーツ大会のグローバルブランド形成構造) ※(図:リーグと国際大会の関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「WBCは野球の世界ブランドを生み出す大会なのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入(問題提起) ワールド・ベースボール・クラシック(WBC)は、2006年に創設された国際野球大会であり、近年では世界中の野球ファンから大きな注目を集めるイベントとなっています。特に近年の大会では、各国のスター選手が代表として参加し、国家対抗という形式の中で劇的な試合が生まれることも多く、スポーツイベントとしての存在感を高めています。 一方で、この大会が「世界大会」としてどの程度の位置づけにあるのかについては、さまざまな見方があります。サッカーのワールドカップやオリンピックのように、長い歴史を持つ国際大会と同じような「グローバルブランド」として定着する可能性があるのか、それとも特定の地域で人気の高いイベントとして位置づくのかという点は、まだ議論の余地があるテーマと言えるでしょう。 そこで本記事では、WBCを単なるスポーツ大会としてではなく、「スポーツブランド形成」という視点から整理し、スポーツビジネス、文化、歴史、市場構造などの観点からその位置づけを考察していきます。 --- ### グローバルスポーツブランドの条件 スポーツ大会が世界的なブランドとして認識されるためには、いくつかの要素が組み合わさる必要があります。一般的に、次のような条件が重要だと考えられています。 - 競技の世界的普及(競技人口や参加国の広がり) - 大会の長い歴史と継続性 - 世界的スター選手の存在 - 国際的なメディア露出と市場規模 - 国家や地域を代表する物語性 例えば、サッカーのワールドカップは1930年から続く大会であり、世界中で競技人口が非常に多いスポーツを背景としています。また、オリンピックは競技そのものだけでなく、国際社会や政治、文化と結びつきながら長い歴史を積み重ねてきました。 こうした大会は、単なるスポーツイベントというよりも、文化的・社会的な意味を持つ「ブランド」として機能しています。 ※(図:スポーツ大会のグローバルブランド形成構造) --- ### WBCが持つブランド形成の要素 WBCにも、スポーツブランド形成につながる要素はいくつか存在します。 まず大きな特徴は、国家代表による対戦という構造です。普段は各国のリーグでプレーしている選手たちが、自国の代表として集まり試合を行うことで、スポーツの競技性だけでなく、国や地域のアイデンティティを象徴する物語が生まれます。 また、メジャーリーグベースボール(MLB)を中心とするスター選手の参加も、大会の価値を高める要素となっています。トップレベルの選手が国際大会で対戦することで、リーグ戦とは異なる魅力が生まれ、メディアやファンの関心を集めやすくなります。 さらに、放送や配信を通じて大会の視聴者が増えていることも、ブランド形成に影響を与える要素です。特に日本、韓国、台湾、アメリカなどでは高い視聴率を記録することもあり、国際的なスポーツイベントとしての存在感は徐々に強まっています。 --- ### WBCが抱える構造的な課題 一方で、WBCが世界的なスポーツブランドとして定着するためには、いくつかの構造的課題も存在します。 まず指摘されることが多いのは、野球という競技の地域的な広がりです。野球は北米、東アジア、中南米などでは非常に人気が高いスポーツですが、ヨーロッパやアフリカなどでは競技人口が比較的少ないとされています。この点は、サッカーなどと比べた場合の違いとしてよく挙げられます。 また、リーグと国際大会の関係も重要な要素です。多くのトップ選手はプロリーグに所属しているため、リーグ側と代表大会のスケジュールや選手管理をどのように調整するかは、長年議論されてきたテーマです。 さらに、大会の歴史がまだ比較的浅いこともあり、国際大会としての制度や位置づけが今後どのように定着していくのかは、時間をかけて形成されていく可能性があります。 ※(図:リーグと国際大会の関係) --- ### WBCは何を目指す大会なのか こうした要素を踏まえると、WBCは単純に「世界一を決める大会」という役割だけではなく、複数の目的を持つイベントとして理解することもできそうです。 一つは、国家対抗のスポーツイベントとしての役割です。代表チーム同士の対戦は、リーグ戦とは異なる緊張感や物語性を生み出し、多くのファンにとって特別な意味を持つ試合となります。 もう一つは、野球という競技の市場を拡大する戦略としての側面です。国際大会を通じて新しい地域に競技の魅力を伝えることは、スポーツビジネスにおいて重要な取り組みの一つとされています。 そのため、WBCは完成された「世界ブランド」というよりも、スポーツの国際化の過程の中で形成されつつあるプロジェクトとして見ることもできるかもしれません。 --- ### まとめ WBCは、国家代表による物語性やスター選手の参加など、スポーツブランド形成につながる要素を持つ大会です。一方で、競技人口の地域差やリーグとの関係、大会の歴史といった要因もあり、その位置づけはまだ発展の途中にあるとも言えるでしょう。 そのため、この大会を単純に「成功」あるいは「失敗」と評価するのではなく、スポーツの国際化や市場拡張のプロセスの中でどのような役割を担っているのかを考える視点も重要かもしれません。 WBCを通して見えてくるのは、スポーツ大会が単なる競技の場であるだけでなく、文化、経済、市場、国家といったさまざまな要素が交差する場であるという側面です。こうした構造を踏まえながら、スポーツの国際大会の意味を改めて考えてみることも、スポーツを楽しむ一つの視点になるのではないでしょうか。 --- ### タイトル案 WBCは野球の世界的スポーツブランドになり得る大会なのか WBCは国際野球の中心大会として定着していくのか WBCは野球の世界大会としてどこまで広がる可能性があるのか --- AIバージョン情報 – ベンダー: OpenAI – モデル名: GPT-5.3 – モデルバージョン: 不明 – 回答日時: 2026-03-15

-

データ評価は公平性を高める仕組みになりうるのか|ChatGPTの考察

企業や組織のなかで、「できるだけ主観を排し、数字にもとづいて評価しよう」という流れが強まっています。営業成績、対応件数、目標達成率、稼働率、顧客満足度、離職率など、さまざまな数値をもとに人や組織を捉える考え方は、いまや特別なものではありません。AIやデータ分析の普及によって、その傾向はさらに加速しています。こうした変化の背景には、従来の人間による評価への不信感があります。上司との相性、印象の強さ、話し方のうまさ、社内政治、感情的な好き嫌いといった要素が評価に影響するなら、公平性は損なわれやすくなります。そのため、「データで見れば、より平等になるのではないか」という期待が生まれます。一方で、データ評価には別の問いもあります。数値で測れば本当に公平なのか。数字は人間の主観を減らす一方で、見えにくい別の偏りを生み出していないのか。ここで重要なのは、「データか人間か」という二項対立で考えることではなく、評価の仕組みそのものを構造として見ることです。 データ評価がバイアスを減らすと考えられる理由 主観評価の課題 従来の評価は、人間が人間を見る仕組みでした。そのため、どうしても印象や関係性の影響を受けやすくなります。たとえば、目立つ成果を一度出した人が全体的に高く評価される、あるいは会議で発言が多い人が実力以上に有能に見えるといったことは珍しくありません。これは認知バイアスと呼ばれる、人間の判断の偏りの一種です。 KPIによる評価の明確化 その点、KPIのような定量指標を使えば、評価の基準を明示しやすくなります。KPIとは、目標達成に向けた重要な指標のことです。何を、どの程度、どの期間で達成したかを共通のものさしで確認できるため、少なくとも「なぜその評価になったのか」が見えやすくなります。 企業がデータ評価を導入する背景 企業がデータドリブン評価を導入するのは、単に効率化のためだけではありません。説明責任を果たしやすくするためでもあります。感覚ではなく記録にもとづいて評価すれば、本人も組織も納得しやすい。さらに、複数人を同じ基準で比較しやすくなるため、評価の運用コストも下がります。大規模組織ほど、この利点は大きく見えます。 データ評価が新しいバイアスを生む可能性 指標設計に入り込む価値観 ここで見落とされがちなのは、指標そのものが自然に存在するわけではないという点です。どの数値を重視するか、何を成果とみなすか、どの行動を高く評価するかは、すべて人間が設計しています。つまり、データ評価は人間の価値判断を排除した仕組みではなく、価値判断を指標の形に埋め込んだ仕組みとも言えます。 測定可能なものが優先される問題 たとえば、対応件数を重視すれば量が評価されやすくなり、顧客満足度を重視すれば丁寧さが評価されやすくなります。しかし、量と質はしばしば両立しません。どちらを優先するかは、組織の価値観の反映です。数値は客観的に見えても、その前段階には必ず設計思想があります。 また、測定できるものだけが評価されやすくなる問題もあります。チームの雰囲気を整える力、後輩の相談に乗る姿勢、トラブルを未然に防ぐ気配りなどは、重要であっても数値化しにくい領域です。すると、評価は「大事なもの」ではなく「測りやすいもの」に寄っていく可能性があります。 過去データの偏り さらに、AIやアルゴリズムを用いる場合、過去データの偏りも影響します。アルゴリズムとは、一定のルールで判断や計算を行う仕組みです。もし過去の評価や配置、昇進の履歴に偏りがあれば、そのデータを学習した仕組みは、過去の偏りを再生産する可能性があります。ここでは、バイアスは消えるのではなく、形式を変えて残るとも考えられます。 ※(図:評価指標とバイアスの関係) 評価はどこまで客観化できるのか 主観の位置の違い 人間評価とデータ評価の違いは、主観の有無というより、主観がどこに置かれているかの違いとして見ると分かりやすくなります。人間評価では、評価者の頭の中に主観があります。データ評価では、その主観が指標設計や重みづけ、集計方法、アルゴリズムの設定に移動します。 評価システムの設計要素 評価システムでは、次のような要素が組み合わさって構成されています。 どの指標を使うのか 指標にどのような重みを付けるのか どの比較軸で評価するのか アルゴリズムや集計方法をどう設計するのか ここで重要なのは、評価者だけではなく、設計者の存在です。評価の公平性は、個々の判断者の公正さだけでなく、制度設計の透明性や修正可能性にも左右されます。 公平性という概念 公平性とは、単に同じ数字で比べることではないのかもしれません。異なる職種や役割、状況の差をどこまで考慮するのか。説明できることと納得できることは同じなのか。こうした問いを含めて初めて、評価の客観性は議論できます。完全な客観化というより、偏りを可視化し、見直せる状態をつくることの方が現実的なのかもしれません。 ※(図:人間評価とデータ評価の構造比較) まとめ データ評価は、人間の印象や感情に左右されやすい評価を補正する力を持っています。その意味で、一定のバイアスを減らす可能性はあります。しかし同時に、指標設計、測定可能性、過去データの偏りといった別の層で、新しいバイアスを生み出す可能性もあります。 そのため、重要なのは「人間評価をやめてデータ評価にすること」でも、「数字は信用できないと退けること」でもありません。問われているのは、どのような設計思想で評価を組み立てるのか、そしてその仕組みを誰がどこまで検証できるのかという点です。 AI時代の評価とは、単に正確に測る技術の問題ではなく、何を価値とみなすかを社会や組織がどう決めるかという問題でもあります。データは判断を助けるかもしれませんが、評価の意味そのものまで自動的に決めてくれるわけではありません。だからこそ、評価を受ける側だけでなく、評価を設計する側にも、いままで以上に深い問いが求められているのではないでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 企業・組織・社会で広がりつつある「データ評価(データドリブン評価)」は、 人間の主観やバイアスを減らす仕組みなのか、 それとも別の形のバイアスを生み出す仕組みなのか。 AI・データ分析・アルゴリズム評価が普及する社会において、 評価の仕組みがどのように変化しているのかを構造的に整理・考察してください。 【目的】 – 「データ=客観的」という単純な理解ではなく、評価システムの構造を整理する – 人間の評価とデータ評価の違いを冷静に比較する – AI時代の働き方において「評価とは何か」という問いを浮き彫りにする 【読者像】 – 一般社会人(20〜50代) – 企業で働くビジネスパーソン – 人事評価・KPI・データ分析などに関心がある人 – AIやデータ活用に関心はあるが専門家ではない層 【記事構成】 1. 導入(問題提起) – 企業や組織で「データ評価」が広がっている現状を提示する – 人間の主観評価に対する不信感や公平性への期待を紹介する – なぜ「データ評価は本当に公平なのか」という問いが生まれるのかを説明する 2. データ評価がバイアスを減らすと考えられる理由 – 従来の主観評価(上司の印象・感情・関係性など)の問題を整理する – 数値指標やKPIによる評価のメリットを説明する – なぜ多くの企業が「データドリブン評価」を導入し始めているのかを構造的に説明する 3. データ評価が新しいバイアスを生む可能性 – 指標設計そのものに人間の価値観が入り込む可能性 – 測定可能なものだけが評価されやすくなる問題 – 過去データの偏りが評価システムに影響する可能性 – 「客観的に見える評価」の裏側にある構造を整理する 4. 評価はどこまで客観化できるのか – 人間評価とデータ評価の違いを整理する – 評価システムにおける「指標」「アルゴリズム」「設計者」の役割を説明する – 評価の公平性とは何かを構造的に考察する 5. まとめ – データ評価はバイアスを完全に消す仕組みではない可能性を整理する – 重要なのは「人間評価かデータ評価か」ではなく「評価設計」であることを示す – AI時代における評価のあり方について、読者が考える余白を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:人間評価とデータ評価の構造比較) ※(図:評価指標とバイアスの関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「データ評価は本当に人間のバイアスを減らすのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入(問題提起) 企業や組織のなかで、「できるだけ主観を排し、数字にもとづいて評価しよう」という流れが強まっています。営業成績、対応件数、目標達成率、稼働率、顧客満足度、離職率など、さまざまな数値をもとに人や組織を捉える考え方は、いまや特別なものではありません。AIやデータ分析の普及によって、その傾向はさらに加速しています。 こうした変化の背景には、従来の人間による評価への不信感があります。上司との相性、印象の強さ、話し方のうまさ、社内政治、感情的な好き嫌いといった要素が評価に影響するなら、公平性は損なわれやすくなります。そのため、「データで見れば、より平等になるのではないか」という期待が生まれます。 一方で、データ評価には別の問いもあります。数値で測れば本当に公平なのか。数字は人間の主観を減らす一方で、見えにくい別の偏りを生み出していないのか。ここで重要なのは、「データか人間か」という二項対立で考えることではなく、評価の仕組みそのものを構造として見ることです。 ### データ評価がバイアスを減らすと考えられる理由 従来の評価は、人間が人間を見る仕組みでした。そのため、どうしても印象や関係性の影響を受けやすくなります。たとえば、目立つ成果を一度出した人が全体的に高く評価される、あるいは会議で発言が多い人が実力以上に有能に見えるといったことは珍しくありません。これは認知バイアスと呼ばれる、人間の判断の偏りの一種です。 その点、KPIのような定量指標を使えば、評価の基準を明示しやすくなります。KPIとは、目標達成に向けた重要な指標のことです。何を、どの程度、どの期間で達成したかを共通のものさしで確認できるため、少なくとも「なぜその評価になったのか」が見えやすくなります。 企業がデータドリブン評価を導入するのは、単に効率化のためだけではありません。説明責任を果たしやすくするためでもあります。感覚ではなく記録にもとづいて評価すれば、本人も組織も納得しやすい。さらに、複数人を同じ基準で比較しやすくなるため、評価の運用コストも下がります。大規模組織ほど、この利点は大きく見えます。 ### データ評価が新しいバイアスを生む可能性 ただし、ここで見落とされがちなのは、指標そのものが自然に存在するわけではないという点です。どの数値を重視するか、何を成果とみなすか、どの行動を高く評価するかは、すべて人間が設計しています。つまり、データ評価は「人間の価値判断を排除した仕組み」ではなく、「価値判断を指標の形に埋め込んだ仕組み」とも言えます。 たとえば、対応件数を重視すれば量が評価されやすくなり、顧客満足度を重視すれば丁寧さが評価されやすくなります。しかし、量と質はしばしば両立しません。どちらを優先するかは、組織の価値観の反映です。数値は客観的に見えても、その前段階には必ず設計思想があります。 また、測定できるものだけが評価されやすくなる問題もあります。チームの雰囲気を整える力、後輩の相談に乗る姿勢、トラブルを未然に防ぐ気配りなどは、重要であっても数値化しにくい領域です。すると、評価は「大事なもの」ではなく「測りやすいもの」に寄っていく可能性があります。 さらに、AIやアルゴリズムを用いる場合、過去データの偏りも影響します。アルゴリズムとは、一定のルールで判断や計算を行う仕組みです。もし過去の評価や配置、昇進の履歴に偏りがあれば、そのデータを学習した仕組みは、過去の偏りを再生産する可能性があります。ここでは、バイアスは消えるのではなく、形式を変えて残るとも考えられます。 ※(図:評価指標とバイアスの関係) ### 評価はどこまで客観化できるのか 人間評価とデータ評価の違いは、主観の有無というより、主観がどこに置かれているかの違いとして見ると分かりやすくなります。人間評価では、評価者の頭の中に主観があります。データ評価では、その主観が指標設計や重みづけ、集計方法、アルゴリズムの設定に移動します。 つまり、評価システムでは「誰が見るか」だけでなく、「何を測るか」「どう重みづけるか」「どの比較軸を採用するか」が大きな意味を持ちます。ここで重要なのは、評価者だけではなく、設計者の存在です。評価の公平性は、個々の判断者の公正さだけでなく、制度設計の透明性や修正可能性にも左右されます。 公平性とは、単に同じ数字で比べることではないのかもしれません。異なる職種や役割、状況の差をどこまで考慮するのか。説明できることと納得できることは同じなのか。こうした問いを含めて初めて、評価の客観性は議論できます。完全な客観化というより、偏りを可視化し、見直せる状態をつくることの方が現実的なのかもしれません。 ※(図:人間評価とデータ評価の構造比較) ### まとめ データ評価は、人間の印象や感情に左右されやすい評価を補正する力を持っています。その意味で、一定のバイアスを減らす可能性はあります。しかし同時に、指標設計、測定可能性、過去データの偏りといった別の層で、新しいバイアスを生み出す可能性もあります。 そのため、重要なのは「人間評価をやめてデータ評価にすること」でも、「数字は信用できないと退けること」でもありません。問われているのは、どのような設計思想で評価を組み立てるのか、そしてその仕組みを誰がどこまで検証できるのかという点です。 AI時代の評価とは、単に正確に測る技術の問題ではなく、何を価値とみなすかを社会や組織がどう決めるかという問題でもあります。データは判断を助けるかもしれませんが、評価の意味そのものまで自動的に決めてくれるわけではありません。だからこそ、評価を受ける側だけでなく、評価を設計する側にも、いままで以上に深い問いが求められているのではないでしょうか。 ### タイトル案 * データ評価は公平性を高める仕組みになりうるのか * 数値で測る評価は人間の偏りを超えられるのか * AI時代の評価制度は何を公正さとして扱うのか — AIバージョン情報 – ベンダー: OpenAI – モデル名: GPT-5.4 Thinking – モデルバージョン: 不明 – 回答日時: 2026-03-15

-

情報セキュリティ認証は企業の安全性を証明する制度なのか|ChatGPTの考察

近年、多くの企業のWebサイトや営業資料で「ISO27001取得」「SOC2対応」といった表記を見かける機会が増えています。特にIT企業やSaaS企業では、情報セキュリティ認証を取得していることが企業の信頼性を示す重要な要素として扱われることが少なくありません。企業が顧客や取引先に対してセキュリティ体制を説明する際、認証の有無が強調される場面も多く見られます。こうした状況を見ると、情報セキュリティ認証は「企業の安全性を証明する制度」であるかのように理解されることがあります。しかし、ここで一つの問いが生まれます。情報セキュリティ認証は本当に「安全」を証明しているのでしょうか。それとも、企業が市場で活動するための条件として機能している制度なのでしょうか。本記事では、制度・企業行動・市場構造という視点から、その役割を整理していきます。 情報セキュリティ認証の制度的目的 まず、情報セキュリティ認証の制度的な背景を整理してみます。 代表的な認証の一つであるISO27001は、情報セキュリティマネジメントシステム(ISMS)の国際規格として知られています。この制度の目的は、企業が情報資産を適切に管理し、リスクを体系的に管理できる体制を構築しているかどうかを確認することにあります。 ここで重要なのは、認証制度が完全な安全を保証するものではないという点です。ISO27001などの認証は、情報セキュリティの管理体制や運用プロセスが一定の基準に基づいて整備されているかどうかを評価する仕組みです。 たとえば、次のような要素が評価対象になります。 情報資産の管理方法 リスク評価の手順 社内のセキュリティポリシー インシデント対応の体制 内部監査や改善プロセス つまり、認証制度は「安全そのもの」を証明するのではなく、「安全を維持するための管理体制が存在するか」を確認する制度と考えることができます。 認証が市場参入条件として機能する理由 次に、企業取引における認証の役割を見てみます。 多くの企業間取引では、特定のセキュリティ認証の取得が事実上の前提条件になる場合があります。特に、クラウドサービス、SaaS、データ処理サービスなどの分野では、この傾向が顕著です。 その背景には、企業が扱う情報の重要性があります。顧客データや業務データを外部企業に委託する場合、発注側の企業は情報漏えいなどのリスクを一定程度管理する必要があります。 このとき、取引先企業のセキュリティ体制を個別に詳細評価することは容易ではありません。そこで、第三者認証が共通の基準として機能するようになります。 結果として、認証制度は次のような役割を担うことになります。 取引先評価の基準を標準化する セキュリティ体制の説明コストを下げる 企業間の信頼構築を簡略化する このように見ると、情報セキュリティ認証は「安全の証明」というよりも、企業間取引における信頼確認の仕組みとして機能している側面もあると言えるかもしれません。 認証制度が市場構造に与える影響 一方で、認証制度は企業活動や市場構造にも一定の影響を与える可能性があります。 認証取得には、監査費用やコンサルティング費用、社内体制整備のコストなどが伴うことが一般的です。また、取得後も定期監査や運用管理が必要になるため、継続的な負担が生じます。 このような要素は、企業の規模や資源によって影響の受け方が異なる可能性があります。大企業にとっては比較的対応しやすい制度であっても、小規模企業やスタートアップにとっては負担となる場合もあります。 また、認証制度が広く普及すると、次のような状況が生まれることも考えられます。 認証取得が取引の前提条件になる 認証の有無が企業評価の指標になる 制度運用が形式化する可能性が生まれる このように、認証制度は信頼の基準として機能する一方で、市場参入のハードルとして作用する側面も持つと考えられます。 まとめ 情報セキュリティ認証は、企業の安全性を単純に証明する制度として理解されることがあります。しかし制度の設計や実際の運用を見ていくと、その役割はもう少し複雑であるようにも見えます。 認証制度は、企業の情報管理体制を評価する仕組みであると同時に、企業間取引における信頼確認の共通基準として機能しています。さらに、その普及は市場の取引条件や参入構造にも影響を与えている可能性があります。 このように考えると、情報セキュリティ認証は「安全証明」と「市場参入条件」という二つの側面を併せ持つ制度として理解することもできるかもしれません。 制度の意味を単純化するのではなく、どのような役割を果たしているのかを複数の視点から捉えることが、セキュリティ認証を理解する一つの手がかりになるのではないでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 情報セキュリティ認証(ISO27001、SOC2、各種セキュリティ認証など)は、 「企業の安全性を証明する制度」なのか、 それとも「企業が市場に参加するための条件」なのか。 情報セキュリティ認証の役割を、 制度・企業行動・市場構造という視点から整理・考察してください。 【目的】 – 情報セキュリティ認証を「安全の証明」として単純に理解するのではなく、社会制度としての役割を整理する – なぜ多くの企業が認証取得を求められるのか、その構造を理解する – セキュリティ認証が企業活動や市場構造にどのような影響を与えているのかを読み解く 【読者像】 – IT企業・SaaS企業の関係者 – セキュリティ認証の取得を検討している企業 – 情報セキュリティや企業統治に関心のあるビジネスパーソン – セキュリティ制度の仕組みを理解したい一般読者 【記事構成】 1. 導入(問題提起) – 多くの企業が情報セキュリティ認証を取得している現状を提示する – 企業のWebサイトや営業資料で「ISO取得」などが強調される背景を説明する – しかし、その認証は本当に「安全」を意味するのかという問いを提示する 2. 情報セキュリティ認証の制度的目的 – ISO27001などの認証制度がどのような思想で作られたのかを整理する – リスク管理、情報資産管理、内部統制などの概念を簡潔に説明する – 認証が「安全そのもの」ではなく「管理体制の存在」を確認する制度である点を説明する 3. 認証が市場参入条件として機能する理由 – 多くの企業取引で「ISO取得」が前提条件になるケースを説明する – SaaS、クラウド、ITサービスなどで認証が重視される背景を整理する – 企業が認証を重視する理由として、責任回避やリスク管理の観点を説明する 4. 認証制度が市場構造に与える影響 – 認証取得のコストや運用負担について触れる – 認証が企業規模や市場参入のハードルに影響する可能性を整理する – 認証が信頼の指標になる一方で、形式化するリスクについても言及する 5. まとめ – 情報セキュリティ認証は「安全証明」と「市場参入条件」の両面を持つ制度である可能性を整理する – 制度の役割を単純化せず、複数の視点から理解する重要性を提示する – 読者がセキュリティ認証の意味を自分なりに考える余地を残して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:情報セキュリティ認証の制度構造) ※(図:認証と市場参入の関係イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「情報セキュリティ認証は本当に安全を証明しているのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入(問題提起) 近年、多くの企業のWebサイトや営業資料で「ISO27001取得」「SOC2対応」といった表記を見かける機会が増えています。特にIT企業やSaaS企業では、情報セキュリティ認証を取得していることが、企業の信頼性を示す重要な要素として扱われることが少なくありません。 企業が顧客や取引先に対してセキュリティ体制を説明する際、認証の有無が強調される場面も多く見られます。こうした状況を見ると、情報セキュリティ認証は「企業の安全性を証明する制度」であるかのように理解されることがあります。 しかし、ここで一つの問いが生まれます。 情報セキュリティ認証は本当に「安全」を証明しているのでしょうか。それとも、企業が市場で活動するための条件として機能している制度なのでしょうか。本記事では、制度・企業行動・市場構造という視点から、その役割を整理していきます。 --- ### 情報セキュリティ認証の制度的目的 まず、情報セキュリティ認証の制度的な背景を整理してみます。 代表的な認証の一つであるISO27001は、情報セキュリティマネジメントシステム(ISMS)の国際規格として知られています。この制度の目的は、企業が情報資産を適切に管理し、リスクを体系的に管理できる体制を構築しているかどうかを確認することにあります。 ここで重要なのは、認証制度が「完全な安全」を保証するものではないという点です。ISO27001などの認証は、情報セキュリティの管理体制や運用プロセスが一定の基準に基づいて整備されているかどうかを評価する仕組みです。 たとえば、次のような要素が評価対象になります。 - 情報資産の管理方法 - リスク評価の手順 - 社内のセキュリティポリシー - インシデント対応の体制 - 内部監査や改善プロセス つまり、認証制度は「安全そのもの」を証明するのではなく、「安全を維持するための管理体制が存在するか」を確認する制度と考えることができます。 ※(図:情報セキュリティ認証の制度構造) --- ### 認証が市場参入条件として機能する理由 次に、企業取引における認証の役割を見てみます。 多くの企業間取引では、特定のセキュリティ認証の取得が事実上の前提条件になる場合があります。特に、クラウドサービス、SaaS、データ処理サービスなどの分野では、この傾向が顕著です。 その背景には、企業が扱う情報の重要性があります。顧客データや業務データを外部企業に委託する場合、発注側の企業は情報漏えいなどのリスクを一定程度管理する必要があります。 このとき、取引先企業のセキュリティ体制を個別に詳細評価することは容易ではありません。そこで、第三者認証が「共通の基準」として機能するようになります。 結果として、認証制度は次のような役割を担うことになります。 - 取引先評価の基準を標準化する - セキュリティ体制の説明コストを下げる - 企業間の信頼構築を簡略化する このように見ると、情報セキュリティ認証は「安全の証明」というよりも、企業間取引における信頼確認の仕組みとして機能している側面もあると言えるかもしれません。 ※(図:認証と市場参入の関係イメージ) --- ### 認証制度が市場構造に与える影響 一方で、認証制度は企業活動や市場構造にも一定の影響を与える可能性があります。 認証取得には、監査費用やコンサルティング費用、社内体制整備のコストなどが伴うことが一般的です。また、取得後も定期監査や運用管理が必要になるため、継続的な負担が生じます。 このような要素は、企業の規模や資源によって影響の受け方が異なる可能性があります。大企業にとっては比較的対応しやすい制度であっても、小規模企業やスタートアップにとっては負担となる場合もあります。 また、認証制度が広く普及すると、次のような状況が生まれることも考えられます。 - 認証取得が取引の前提条件になる - 認証の有無が企業評価の指標になる - 制度運用が形式化する可能性が生まれる このように、認証制度は信頼の基準として機能する一方で、市場参入のハードルとして作用する側面も持つと考えられます。 --- ### まとめ 情報セキュリティ認証は、企業の安全性を単純に証明する制度として理解されることがあります。しかし制度の設計や実際の運用を見ていくと、その役割はもう少し複雑であるようにも見えます。 認証制度は、企業の情報管理体制を評価する仕組みであると同時に、企業間取引における信頼確認の共通基準として機能しています。さらに、その普及は市場の取引条件や参入構造にも影響を与えている可能性があります。 このように考えると、情報セキュリティ認証は「安全証明」と「市場参入条件」という二つの側面を併せ持つ制度として理解することもできるかもしれません。 制度の意味を単純化するのではなく、どのような役割を果たしているのかを複数の視点から捉えることが、セキュリティ認証を理解する一つの手がかりになるのではないでしょうか。 --- ### タイトル案 情報セキュリティ認証は企業の安全性を証明する制度なのか 情報セキュリティ認証は企業取引の参加条件になっているのか 情報セキュリティ認証は企業の信頼を示す制度と言えるのか — AIバージョン情報 – ベンダー: OpenAI – モデル名: GPT-5系 – モデルバージョン: GPT-5.3 – 回答日時: 2026-03-15

-

クリエイターのキャリアは会社ではなく作品で形成されるものなのか|ChatGPTの考察

デザイン、映像、漫画、音楽、ゲーム、Web制作などの分野では、しばしば「どの会社に所属しているかよりも、何を作ったかが重要だ」と言われます。クリエイターの評価は、会社の肩書きではなく作品によって語られることが多いからです。たとえば、ある映画の監督、あるゲームのキャラクターデザイン、ある広告のビジュアル、ある漫画作品など、クリエイターの名前は特定の作品とともに記憶されることがあります。このような評価のされ方は、一般的な会社員のキャリアとは異なる特徴を持っています。さらに近年では、インターネットやSNSの普及により、作品が直接公開され、評価される機会が増えました。こうした環境の変化は、クリエイターのキャリアの単位を「会社」から「作品」へと変化させている可能性があるとも言われています。では、クリエイターのキャリアは本当に「作品単位」で形成されるものになりつつあるのでしょうか。それとも別の構造が存在しているのでしょうか。 従来のキャリア構造(所属単位のキャリア) 多くの職業では、キャリアは組織を単位として形成されます。会社名、役職、勤続年数、部署経験などが、キャリアを説明する際の基本的な指標になります。 このようなキャリア構造には、いくつかの特徴があります。 組織の中での昇進や評価制度 長期的な雇用関係 役職による責任範囲の拡大 企業ブランドによる信用 この構造では、個人の仕事は組織の中で評価され、キャリアは会社の履歴とともに積み重なります。履歴書に書かれるのも「どの会社に何年いたか」という情報が中心です。 しかし、クリエイティブ職ではこの構造が完全には当てはまらないことがあります。なぜなら、作品そのものが評価の対象になる場合が多いからです。 作品単位キャリアという構造 クリエイターのキャリアでは、代表作や参加プロジェクトが評価の中心になることがあります。ポートフォリオ(過去の制作物をまとめた資料)は、その典型的な例です。 デザイナーやイラストレーターは、自分が制作したビジュアルやデザインを提示します。映像制作者であれば制作した映像作品、ゲームクリエイターであれば参加したタイトル、漫画家であれば連載作品などがキャリアを示す材料になります。 このような構造では、次のような特徴が見られます。 キャリアが作品実績として蓄積される プロジェクト単位で評価が行われる 組織よりもポートフォリオが重要になる たとえば映画やゲームのクレジットを見ると、制作会社だけでなく、個人のクリエイター名が記録されています。作品はチームで制作されますが、個人の参加履歴も同時に残る仕組みになっているのです。 ※(図:クリエイターキャリアの構造) インターネットが変えたキャリアの単位 インターネットの普及は、この構造をさらに変化させた可能性があります。 以前は、作品を世に出すためには出版社、制作会社、放送局などの組織を通す必要がありました。しかし現在では、SNSやオンラインプラットフォームを通じて、個人が直接作品を公開できるようになっています。 たとえば次のような場所が挙げられます。 イラスト投稿サイト 動画共有プラットフォーム ポートフォリオサイト SNS こうした環境では、作品が企業ではなく個人の名前で広がることがあります。作品が評価されると、その作者自身に直接注目が集まることもあります。 この変化によって、キャリアの流れが次のように変わりつつある可能性も指摘されています。 会社 → 作品 → 市場 個人 → 作品 → 市場 つまり、組織を経由せずに作品が市場に届く経路が増えているのです。 それでも組織が重要である理由 一方で、クリエイターのキャリアが完全に個人化しているわけではありません。多くの作品は、依然として組織やチームの中で生まれています。 映画、ゲーム、大型広告、アニメーションなどは、多くの専門職が協力して制作します。プロデューサー、編集者、ディレクター、制作会社などの役割は非常に大きいものです。 また、組織には次のような機能があります。 制作資金の確保 大規模プロジェクトの管理 流通や宣伝の仕組み クリエイター同士のネットワーク形成 つまり、作品単位のキャリアが成立するためにも、組織的な環境が支えている場合が多いのです。 ※(図:作品単位キャリアと組織キャリアの関係) AI時代のクリエイターキャリア AIツールの登場によって、制作環境も変化しつつあります。画像生成AI、動画生成AI、音楽生成AI、文章生成AIなどが登場し、制作コストが下がる可能性が指摘されています。 これによって、個人が制作できる作品の幅が広がる可能性があります。一人のクリエイターが、企画、制作、公開まで行うケースも増えるかもしれません。 一方で、AIの活用によってチーム制作の形が変わる可能性もあります。少人数のチームで大規模な作品を作ることができるようになるかもしれません。 つまりAIは、個人制作を強める可能性と、制作チームの形を変える可能性の両方を持っていると考えられます。 まとめ クリエイターのキャリアは、会社だけで説明できるものではなく、作品実績によって形成される側面が確かに存在します。ポートフォリオや代表作は、クリエイターの能力を示す重要な指標として機能しています。 しかし同時に、多くの作品は組織や制作ネットワークの中で生まれています。作品単位のキャリアは、完全に個人だけで成立するものではなく、チームや業界の関係性とも結びついています。 インターネットやAIによって、クリエイターのキャリアの単位は変化している可能性があります。ただし、それは単純な「個人化」や「フリーランス化」として説明できるものではなく、作品、組織、ネットワークが組み合わさった構造として捉える必要があるのかもしれません。 読者自身がキャリアを考える際にも、「どこに所属するか」だけでなく、「どのような作品を残すのか」という視点を含めて考えることが、これからの時代のヒントになる可能性があります。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 クリエイターのキャリアは 「会社」や「所属」ではなく 「作品単位」で形成されるものになりつつあるのか。 AI・インターネット・SNS・プラットフォームの普及によって、 クリエイターのキャリア構造がどのように変化しているのかを整理・考察してください。 対象となるクリエイターは以下を想定します。 – デザイナー – イラストレーター – 映像制作者 – ゲームクリエイター – ライター – 音楽制作者 – 漫画家 – Webクリエイター – コンテンツクリエイター 【目的】 – クリエイターのキャリア形成を「個人の努力論」ではなく構造として整理する – 「会社キャリア」と「作品キャリア」の違いを明確にする – デジタル時代におけるクリエイターの評価構造を言語化する – 読者が自分のキャリアの捉え方を考える材料を提供する 【読者像】 – クリエイティブ職に関心のある学生 – デザイナー・ライターなどのクリエイター – 副業クリエイター – フリーランス志向の社会人 – AI時代のキャリアの変化に関心を持つ人 【記事構成】 1. 導入(問題提起) – クリエイターは「会社の肩書き」よりも「作品」で評価されると言われる理由を提示する – なぜクリエイターのキャリアは一般的な会社員キャリアと異なるのかを示す – インターネットやSNSによって、この構造がさらに強まっている可能性に触れる 2. 従来のキャリア構造(所属単位のキャリア) – 多くの職業では「会社」「役職」「勤続年数」がキャリアの単位になっていることを整理する – 組織キャリアの特徴(安定・階層・評価制度など)を説明する – なぜクリエイティブ職ではこの構造が成立しにくいのかを整理する 3. 作品単位キャリアという構造 – クリエイターが「どの会社にいるか」よりも「何を作ったか」で評価される構造を説明する – ポートフォリオ・代表作・プロジェクト実績がキャリアになる仕組みを整理する – 映画・ゲーム・広告・漫画などの分野で見られる特徴を説明する 4. インターネットが変えたキャリアの単位 – SNSやプラットフォームによって作品が直接評価される構造を整理する – YouTube・Pixiv・Behance・SNSなどがキャリア形成に与えた影響を説明する – 「会社 → 作品」から「個人 → 作品 → 市場」という流れの可能性を考察する 5. それでも組織が重要である理由 – 作品は個人だけでなく、制作チームや組織の中で生まれることを説明する – プロデューサー・編集者・制作会社などの役割に触れる – 「作品単位キャリア」と「組織ネットワーク」の関係を整理する 6. AI時代のクリエイターキャリア – AIツールによって制作コストが下がる可能性を説明する – 個人制作とチーム制作の関係がどう変化する可能性があるかを考察する – クリエイターのキャリア単位がさらに変化する可能性に触れる 7. まとめ – クリエイターのキャリアは「作品」と「関係性」の両方で形成される可能性を整理する – 単純な「フリーランス化」や「個人化」として語られがちな議論を構造として整理する – 読者がキャリアの捉え方を考える視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:クリエイターキャリアの構造) ※(図:作品単位キャリアと組織キャリアの関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「クリエイターのキャリアは会社ではなく作品で決まるのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入(問題提起) デザイン、映像、漫画、音楽、ゲーム、Web制作などの分野では、しばしば「どの会社に所属しているかよりも、何を作ったかが重要だ」と言われます。クリエイターの評価は、会社の肩書きではなく作品によって語られることが多いからです。 たとえば、ある映画の監督、あるゲームのキャラクターデザイン、ある広告のビジュアル、ある漫画作品など、クリエイターの名前は特定の作品とともに記憶されることがあります。このような評価のされ方は、一般的な会社員のキャリアとは異なる特徴を持っています。 さらに近年では、インターネットやSNSの普及により、作品が直接公開され、評価される機会が増えました。こうした環境の変化は、クリエイターのキャリアの単位を「会社」から「作品」へと変化させている可能性があるとも言われています。 では、クリエイターのキャリアは本当に「作品単位」で形成されるものになりつつあるのでしょうか。それとも別の構造が存在しているのでしょうか。 ### 従来のキャリア構造(所属単位のキャリア) 多くの職業では、キャリアは組織を単位として形成されます。会社名、役職、勤続年数、部署経験などが、キャリアを説明する際の基本的な指標になります。 このようなキャリア構造には、いくつかの特徴があります。 - 組織の中での昇進や評価制度 - 長期的な雇用関係 - 役職による責任範囲の拡大 - 企業ブランドによる信用 この構造では、個人の仕事は組織の中で評価され、キャリアは会社の履歴とともに積み重なります。履歴書に書かれるのも「どの会社に何年いたか」という情報が中心です。 しかし、クリエイティブ職ではこの構造が完全には当てはまらないことがあります。なぜなら、作品そのものが評価の対象になる場合が多いからです。 ### 作品単位キャリアという構造 クリエイターのキャリアでは、代表作や参加プロジェクトが評価の中心になることがあります。ポートフォリオ(過去の制作物をまとめた資料)は、その典型的な例です。 デザイナーやイラストレーターは、自分が制作したビジュアルやデザインを提示します。映像制作者であれば制作した映像作品、ゲームクリエイターであれば参加したタイトル、漫画家であれば連載作品などがキャリアを示す材料になります。 このような構造では、次のような特徴が見られます。 - キャリアが作品実績として蓄積される - プロジェクト単位で評価が行われる - 組織よりもポートフォリオが重要になる たとえば映画やゲームのクレジットを見ると、制作会社だけでなく、個人のクリエイター名が記録されています。作品はチームで制作されますが、個人の参加履歴も同時に残る仕組みになっているのです。 ※(図:クリエイターキャリアの構造) ### インターネットが変えたキャリアの単位 インターネットの普及は、この構造をさらに変化させた可能性があります。 以前は、作品を世に出すためには出版社、制作会社、放送局などの組織を通す必要がありました。しかし現在では、SNSやオンラインプラットフォームを通じて、個人が直接作品を公開できるようになっています。 たとえば次のような場所が挙げられます。 - イラスト投稿サイト - 動画共有プラットフォーム - ポートフォリオサイト - SNS こうした環境では、作品が企業ではなく個人の名前で広がることがあります。作品が評価されると、その作者自身に直接注目が集まることもあります。 この変化によって、キャリアの流れが次のように変わりつつある可能性も指摘されています。 会社 → 作品 → 市場 個人 → 作品 → 市場 つまり、組織を経由せずに作品が市場に届く経路が増えているのです。 ### それでも組織が重要である理由 一方で、クリエイターのキャリアが完全に個人化しているわけではありません。多くの作品は、依然として組織やチームの中で生まれています。 映画、ゲーム、大型広告、アニメーションなどは、多くの専門職が協力して制作します。プロデューサー、編集者、ディレクター、制作会社などの役割は非常に大きいものです。 また、組織には次のような機能があります。 - 制作資金の確保 - 大規模プロジェクトの管理 - 流通や宣伝の仕組み - クリエイター同士のネットワーク形成 つまり、作品単位のキャリアが成立するためにも、組織的な環境が支えている場合が多いのです。 ※(図:作品単位キャリアと組織キャリアの関係) ### AI時代のクリエイターキャリア AIツールの登場によって、制作環境も変化しつつあります。画像生成AI、動画生成AI、音楽生成AI、文章生成AIなどが登場し、制作コストが下がる可能性が指摘されています。 これによって、個人が制作できる作品の幅が広がる可能性があります。一人のクリエイターが、企画、制作、公開まで行うケースも増えるかもしれません。 一方で、AIの活用によってチーム制作の形が変わる可能性もあります。少人数のチームで大規模な作品を作ることができるようになるかもしれません。 つまりAIは、個人制作を強める可能性と、制作チームの形を変える可能性の両方を持っていると考えられます。 ### まとめ クリエイターのキャリアは、会社だけで説明できるものではなく、作品実績によって形成される側面が確かに存在します。ポートフォリオや代表作は、クリエイターの能力を示す重要な指標として機能しています。 しかし同時に、多くの作品は組織や制作ネットワークの中で生まれています。作品単位のキャリアは、完全に個人だけで成立するものではなく、チームや業界の関係性とも結びついています。 インターネットやAIによって、クリエイターのキャリアの単位は変化している可能性があります。ただし、それは単純な「個人化」や「フリーランス化」として説明できるものではなく、作品、組織、ネットワークが組み合わさった構造として捉える必要があるのかもしれません。 読者自身がキャリアを考える際にも、「どこに所属するか」だけでなく、「どのような作品を残すのか」という視点を含めて考えることが、これからの時代のヒントになる可能性があります。 --- ### タイトル案 クリエイターのキャリアは会社ではなく作品で形成されるものなのか デジタル時代にクリエイターの評価単位は作品へ移行しているのか インターネットはクリエイターのキャリアを作品中心に変えたのか --- AIバージョン情報 – ベンダー: OpenAI – モデル名: GPT-5 – モデルバージョン: GPT-5.3 – 回答日時: 2026-03-14

-

AI時代に企業の雇用制度はどう変わっていくのか|ChatGPTの考察

近年、生成AIや自動化技術の進展によって、「仕事がAIに置き換えられるのではないか」という不安が広がっています。実際、文章作成、問い合わせ対応、データ整理、需要予測、画像生成など、これまで人が担ってきた一部の業務が、すでに機械によって補完され始めています。ただし、変化しているのは個々の仕事だけではないかもしれません。より大きな視点で見れば、企業がどのような前提で人を雇い、どのように育成し、どのように配置してきたのかという「雇用制度」そのものが問い直されているとも考えられます。雇用制度は、単なる人事ルールではありません。企業の組織設計、賃金の決め方、キャリアの積み方、社会保障の支え方とも深く結びついています。そのため、AI時代を考えるときには、「仕事が減るか増えるか」だけでなく、「雇う仕組みがどう変わるのか」という視点が重要になります。 これまでの雇用制度は何を前提に作られてきたのか 終身雇用や年功序列、正社員を中心とした雇用モデルは、主に工業化社会と高度成長期の条件の中で機能してきました。大量生産を支えるためには、安定的に人員を確保し、企業の内部で技能を育て、長期的に配置していくことが合理的だったからです。 工業化社会と大量雇用モデル 工場や大企業を中心とした時代には、仕事の内容が比較的標準化されていました。一定の手順を守り、同じ品質で、継続的に働くことが重視されました。このような環境では、社員を長く抱え、社内で教育し、経験年数に応じて処遇を上げる仕組みが安定しやすかったといえます。 また、日本では新卒一括採用と企業内育成が強く結びついてきました。入社時点の完成度よりも、将来の伸びしろや組織への適応力が重視され、職務を限定せずに配属や異動を行う運用が一般化しました。これは、会社が人を特定業務の担い手としてではなく、長く所属する構成員として見てきたことを意味します。 なぜ長く機能してきたのか この制度が長く機能した背景には、企業にとっても労働者にとっても利点があったからです。企業側は離職率を抑えやすく、社内に知識や文化を蓄積しやすい。労働者側は雇用の安定を得やすく、賃金や地位の上昇を長期的に見込みやすい。つまり、安定した成長と予測可能な組織運営が前提にあった時代には、この仕組みは一定の合理性を持っていたと考えられます。 AIが雇用制度に与える変化 AIが注目される理由の一つは、単純な自動化だけでなく、これまで「判断を伴う」と見なされてきた業務の一部にも関与できる点です。たとえば、定型的な事務処理、文書要約、データ分析、問い合わせ分類、需要予測、スケジュール最適化などは、AIとの親和性が高い領域です。 仕事の単位が変わる可能性 この変化は、仕事を丸ごと消すというより、仕事を構成する単位を細かく分解する方向に働く可能性があります。従来は一人の社員がまとめて担っていた業務のうち、標準化しやすい部分はAIが処理し、人は例外対応、対人調整、意思決定、創造的作業などに集中する形です。 その結果、企業は「人を一括で雇う」のではなく、「どの業務を人が担い、どの業務をAIや外部資源で補うか」をより細かく設計するようになるかもしれません。 ※(図:AI時代の雇用制度構造) 職務ベース雇用やプロジェクト型への接近 こうした変化は、職務ベース雇用への関心ともつながります。職務ベース雇用とは、仕事内容や責任範囲を明確にしたうえで採用や評価を行う考え方です。従来のように「会社の一員として何でも担う」よりも、「何を担当する人なのか」を明示しやすくなります。 また、変化の速い分野では、部署や年次よりも、プロジェクト単位で必要な人材を集める運用が増える可能性もあります。さらに、業務の一部を外部委託したり、フリーランスや副業人材と組み合わせたりするギグ型労働的な要素が拡大する場面も考えられます。 もっとも、これが全面的に広がるとは限りません。企業文化、法制度、社会保障、労使慣行などによって進み方は異なり、従来型の雇用と新しい仕組みが併存する可能性もあります。 企業と労働者の関係はどう変わる可能性があるのか AIが進展すると、企業が人を雇う理由も少しずつ変わるかもしれません。これまでは、人手の確保そのものが重要でしたが、今後は「人にしか担いにくい役割は何か」を明確にしながら雇用を考える場面が増える可能性があります。 管理職や中間層の役割の再編 特に注目されるのは、管理職や中間層の役割です。情報共有や進捗確認、定型的な評価資料の作成などはAIに置き換わりやすい一方で、対立の調整、判断責任、価値観の統合、心理的安全性の確保などは依然として人の役割として残ると考えられます。つまり、管理職は情報を集める人から判断と調整を担う人へ比重が移る可能性があります。 専門職の位置づけの変化 専門職についても同様です。AIが基礎的な分析や下書きを支援するようになると、専門知識そのものの価値が消えるというより、その知識をどう解釈し、どう意思決定に結びつけるかがより重要になるかもしれません。資格や肩書きだけでなく、実務での統合力や説明力が問われやすくなる可能性があります。 安定性と柔軟性のバランス 一方で、柔軟な雇用は必ずしも労働者にとって安心とは限りません。職務が細分化されるほど、仕事の境界は明確になりますが、その分だけ代替可能性が高まることもあります。反対に、長期雇用は硬直的に見えても、生活設計のしやすさという意味では大きな価値を持ちます。 そのため、AI時代の雇用制度は、単純に「安定から流動へ」と進むのではなく、どこまで柔軟性を高め、どこで安定性を守るのかという再調整の問題として捉えるほうが自然です。企業の競争力と労働者の安心を、どのような制度設計で両立させるのかが重要な論点になっていくでしょう。 ※(図:企業と労働者の関係の変化) まとめ AIは、雇用を一括して消し去る存在というより、雇用制度の前提を揺さぶる存在として見ることもできます。終身雇用、年功序列、正社員中心モデルがすぐに消えるとは限りませんが、それらが成立してきた条件は確実に変わりつつあります。 今後は、企業内育成を重視する仕組みと、職務やプロジェクトを基準にした仕組みが混在しながら、新しい均衡点が探られていくのかもしれません。大切なのは、AIを単なる効率化の道具として見るだけでなく、それが企業と労働者の関係、組織の形、働くことの意味にどのような影響を及ぼすのかを、制度の視点から捉えることです。 楽観的に見れば、より能力に応じた配置や柔軟な働き方が広がる可能性があります。悲観的に見れば、安定した雇用が細分化され、負担が個人に移る可能性もあります。どちらか一方に寄るのではなく、その両面を見ながら、働き方の未来を考えていくことが求められているのではないでしょうか。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 AI・自動化・データ活用の進展によって、 企業や社会における「雇用制度」はどのように変化していく可能性があるのか。 終身雇用・年功序列・正社員中心の雇用モデルは、 AI時代においてどのように再設計されていくのかを、 社会構造・組織設計・労働市場の視点から整理・考察してください。 【目的】 – AIが単に仕事を自動化するだけでなく、「雇用制度そのもの」に与える影響を整理する – 読者が働き方の変化を構造的に理解するための視点を提示する – AI時代における企業と労働者の関係の変化を考える材料を提供する 【読者像】 – 一般社会人(20〜50代) – 学生・就職活動中の若年層 – 将来の働き方や雇用の安定性に関心を持つ人 – AIが仕事や社会制度に与える影響を知りたい人 【記事構成】 1. 導入(問題提起) – AIの進化によって「仕事がなくなるのではないか」という不安が広がっていることを提示する – しかし変化しているのは仕事そのものだけでなく「雇用制度」である可能性を示す – なぜAI時代には雇用制度の再設計が議論され始めているのかを説明する 2. これまでの雇用制度は何を前提に作られてきたのか – 終身雇用・年功序列・正社員モデルなどの雇用制度が成立した歴史的背景を整理する – 工業化社会・大量雇用モデルとの関係を説明する – なぜこの制度が長く機能してきたのかを構造的に整理する 3. AIが雇用制度に与える変化 – AIが得意とする業務(定型業務・分析・情報処理など)を整理する – それによって企業の組織構造や仕事の分担がどう変わる可能性があるのかを説明する – 「職務ベース雇用」「プロジェクト型雇用」「ギグ型労働」などの動きにも触れてよい – ただし断定的な未来予測は避けること 4. 企業と労働者の関係はどう変わる可能性があるのか – AIによって企業が人を雇う理由がどのように変わる可能性があるかを整理する – 組織の階層構造、管理職の役割、専門職の位置づけなどの変化にも触れてよい – 雇用の安定性と柔軟性のバランスについて複数の視点から考察する 5. まとめ – AIは雇用を消すのではなく、雇用制度を再設計する可能性があることを整理する – 楽観・悲観どちらにも寄らず、読者が働き方の未来を考えるための視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:AI時代の雇用制度構造) ※(図:企業と労働者の関係の変化) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 AIは雇用制度をどこまで変えるのか 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入(問題提起) 近年、生成AIや自動化技術の進展によって、「仕事がAIに置き換えられるのではないか」という不安が広がっています。実際、文章作成、問い合わせ対応、データ整理、需要予測、画像生成など、これまで人が担ってきた一部の業務が、すでに機械によって補完され始めています。 ただし、変化しているのは個々の仕事だけではないかもしれません。より大きな視点で見れば、企業がどのような前提で人を雇い、どのように育成し、どのように配置してきたのかという「雇用制度」そのものが問い直されているとも考えられます。 雇用制度は、単なる人事ルールではありません。企業の組織設計、賃金の決め方、キャリアの積み方、社会保障の支え方とも深く結びついています。そのため、AI時代を考えるときには、「仕事が減るか増えるか」だけでなく、「雇う仕組みがどう変わるのか」という視点が重要になります。 ### これまでの雇用制度は何を前提に作られてきたのか 終身雇用や年功序列、正社員を中心とした雇用モデルは、主に工業化社会と高度成長期の条件の中で機能してきました。大量生産を支えるためには、安定的に人員を確保し、企業の内部で技能を育て、長期的に配置していくことが合理的だったからです。 ### 工業化社会と大量雇用モデル 工場や大企業を中心とした時代には、仕事の内容が比較的標準化されていました。一定の手順を守り、同じ品質で、継続的に働くことが重視されました。このような環境では、社員を長く抱え、社内で教育し、経験年数に応じて処遇を上げる仕組みが安定しやすかったといえます。 また、日本では新卒一括採用と企業内育成が強く結びついてきました。入社時点の完成度よりも、将来の伸びしろや組織への適応力が重視され、職務を限定せずに配属や異動を行う運用が一般化しました。これは、会社が人を「特定業務の担い手」としてではなく、「長く所属する構成員」として見てきたことを意味します。 ### なぜ長く機能してきたのか この制度が長く機能した背景には、企業にとっても労働者にとっても利点があったからです。企業側は離職率を抑えやすく、社内に知識や文化を蓄積しやすい。労働者側は雇用の安定を得やすく、賃金や地位の上昇を長期的に見込みやすい。つまり、安定した成長と予測可能な組織運営が前提にあった時代には、この仕組みは一定の合理性を持っていたと考えられます。 ### AIが雇用制度に与える変化 AIが注目される理由の一つは、単純な自動化だけでなく、これまで「判断を伴う」と見なされてきた業務の一部にも関与できる点です。たとえば、定型的な事務処理、文書要約、データ分析、問い合わせ分類、需要予測、スケジュール最適化などは、AIとの親和性が高い領域です。 ### 仕事の単位が変わる可能性 この変化は、仕事を丸ごと消すというより、仕事を構成する単位を細かく分解する方向に働く可能性があります。従来は一人の社員がまとめて担っていた業務のうち、標準化しやすい部分はAIが処理し、人は例外対応、対人調整、意思決定、創造的作業などに集中する形です。 その結果、企業は「人を一括で雇う」のではなく、「どの業務を人が担い、どの業務をAIや外部資源で補うか」をより細かく設計するようになるかもしれません。 ※(図:AI時代の雇用制度構造) ### 職務ベース雇用やプロジェクト型への接近 こうした変化は、職務ベース雇用への関心ともつながります。職務ベース雇用とは、仕事内容や責任範囲を明確にしたうえで採用や評価を行う考え方です。従来のように「会社の一員として何でも担う」よりも、「何を担当する人なのか」を明示しやすくなります。 また、変化の速い分野では、部署や年次よりも、プロジェクト単位で必要な人材を集める運用が増える可能性もあります。さらに、業務の一部を外部委託したり、フリーランスや副業人材と組み合わせたりする「ギグ型労働」的な要素が拡大する場面も考えられます。 もっとも、これが全面的に広がるとは限りません。企業文化、法制度、社会保障、労使慣行などによって進み方は異なり、従来型の雇用と新しい仕組みが併存する可能性もあります。 ### 企業と労働者の関係はどう変わる可能性があるのか AIが進展すると、企業が人を雇う理由も少しずつ変わるかもしれません。これまでは、人手の確保そのものが重要でしたが、今後は「人にしか担いにくい役割は何か」を明確にしながら雇用を考える場面が増える可能性があります。 ### 管理職や中間層の役割の再編 特に注目されるのは、管理職や中間層の役割です。情報共有や進捗確認、定型的な評価資料の作成などはAIに置き換わりやすい一方で、対立の調整、判断責任、価値観の統合、心理的安全性の確保などは依然として人の役割として残ると考えられます。つまり、管理職は「情報を集める人」から「判断と調整を担う人」へ比重が移る可能性があります。 ### 専門職の位置づけの変化 専門職についても同様です。AIが基礎的な分析や下書きを支援するようになると、専門知識そのものの価値が消えるというより、その知識をどう解釈し、どう意思決定に結びつけるかがより重要になるかもしれません。資格や肩書きだけでなく、実務での統合力や説明力が問われやすくなる可能性があります。 ### 安定性と柔軟性のバランス 一方で、柔軟な雇用は必ずしも労働者にとって安心とは限りません。職務が細分化されるほど、仕事の境界は明確になりますが、その分だけ代替可能性が高まることもあります。反対に、長期雇用は硬直的に見えても、生活設計のしやすさという意味では大きな価値を持ちます。 そのため、AI時代の雇用制度は、単純に「安定から流動へ」と進むのではなく、どこまで柔軟性を高め、どこで安定性を守るのかという再調整の問題として捉えるほうが自然です。企業の競争力と労働者の安心を、どのような制度設計で両立させるのかが重要な論点になっていくでしょう。 ※(図:企業と労働者の関係の変化) ### まとめ AIは、雇用を一括して消し去る存在というより、雇用制度の前提を揺さぶる存在として見ることもできます。終身雇用、年功序列、正社員中心モデルがすぐに消えるとは限りませんが、それらが成立してきた条件は確実に変わりつつあります。 今後は、企業内育成を重視する仕組みと、職務やプロジェクトを基準にした仕組みが混在しながら、新しい均衡点が探られていくのかもしれません。大切なのは、AIを単なる効率化の道具として見るだけでなく、それが企業と労働者の関係、組織の形、働くことの意味にどのような影響を及ぼすのかを、制度の視点から捉えることです。 楽観的に見れば、より能力に応じた配置や柔軟な働き方が広がる可能性があります。悲観的に見れば、安定した雇用が細分化され、負担が個人に移る可能性もあります。どちらか一方に寄るのではなく、その両面を見ながら、働き方の未来を考えていくことが求められているのではないでしょうか。 ### タイトル案 * AI時代に企業の雇用制度はどう変わっていくのか * 終身雇用と年功序列はAI時代に再設計されるのか * AIの進展で企業と労働者の関係はどう変わるのか — AIバージョン情報 – ベンダー: OpenAI – モデル名: GPT-5.4 Thinking – モデルバージョン: 不明 – 回答日時: 2026-03-14

-

過疎地域で高校野球部はなぜ存続が難しくなっているのか|ChatGPTの考察

日本各地で人口減少が進むなか、過疎地域の高校では野球部の存続が難しくなっているという報道が増えています。部員が足りず大会に出場できない、あるいは部そのものが廃部になるといった事例は、地方の学校で珍しいものではなくなりました。一見すると、この問題は「野球部の部員が足りない」という単純な現象のようにも見えます。しかし、その背景をたどると、人口構造の変化、学校制度の変化、そしてスポーツ文化のあり方といった複数の要因が関係しています。高校野球は、日本では単なる学校スポーツ以上の意味を持つ文化でもあります。そのため、過疎地域の高校野球部の存続問題は、地方社会の変化を象徴するテーマとして語られることが多くなっています。本記事では、この問題を「部員不足」という表面的な現象だけでなく、社会構造の変化として整理してみます。 なぜ高校野球部は存続が難しくなっているのか まず大きな要因として挙げられるのが、人口減少と若年層の減少です。地方では出生数の減少と都市部への人口流出が重なり、高校に進学する生徒数自体が減っています。結果として、学校の部活動を支える母集団が小さくなっています。 高校野球は特に人数を必要とするスポーツです。公式戦に出場するには9人以上の選手が必要であり、怪我や交代要員を考えると、ある程度の部員数が求められます。生徒数が少ない学校では、この人数を確保すること自体が難しくなります。 また、部活動の選択肢が多様化していることも影響しています。近年はサッカー、バスケットボール、陸上競技などの競技人口が増えており、eスポーツや文化系活動など、活動の幅も広がっています。限られた生徒数の中で、スポーツごとの人数が分散する状況も生まれています。 さらに、学校の統廃合も影響しています。地方では高校の再編が進み、学校数そのものが減少しています。これにより、地域に複数あった野球部が一つに集約される場合もあれば、通学距離の問題などから部活動に参加しにくくなるケースもあります。 人口減少と高校スポーツの関係構造 人口減少 生徒数減少 部活動人数の不足 部活動の存続困難 このように、高校野球部の存続問題は単一の原因ではなく、人口構造と教育制度、スポーツ文化の変化が重なって生まれている現象と考えることもできます。 合同チームという対応策 こうした状況に対応するため、日本高等学校野球連盟は「合同チーム」という制度を認めています。これは、複数の高校が合同でチームを編成し、大会に出場する仕組みです。 合同チームは、部員数が不足する学校でも大会参加の機会を維持できるという点で、制度的な解決策の一つとされています。実際に、地方大会では合同チームが出場する例も増えています。 一方で、この制度は高校野球の文化的な側面にも変化をもたらします。高校野球は長く「学校単位のチーム」という形で運営されてきました。学校名を背負い、地域の代表として試合に臨むという構造が、応援文化や地域のアイデンティティと結びついてきたためです。 合同チームでは、複数の学校の生徒が同じユニフォームを着てプレーすることになります。競技としては成立しても、学校と地域が結びつく従来の高校野球文化とは異なる形になる可能性もあります。 高校野球は地域社会にとって何なのか 高校野球は、日本では教育活動の一部であると同時に、地域社会の文化とも深く結びついています。地方では、地元高校の試合が地域メディアで取り上げられ、学校や地域全体で応援する文化が根付いてきました。 特に甲子園大会は、その象徴的な舞台です。地方の高校が全国大会に出場することは、地域社会にとって大きな出来事になります。学校だけでなく、地域の商店街や自治体、地元企業などが応援する光景は、日本の夏の風景の一部として語られることもあります。 高校野球と地域社会の関係イメージ 高校野球 学校教育 地域の応援文化 地元メディア 地域アイデンティティ このような構造の中で、高校野球は単なる部活動以上の意味を持つ存在になってきました。そのため、野球部が存続できなくなることは、学校スポーツの問題だけでなく、地域文化の変化として受け止められる場合もあります。 高校スポーツの未来 こうした状況を踏まえると、学校部活動という仕組みそのものが今後変化していく可能性も指摘されています。 近年、日本では「地域クラブ化」という考え方が議論されています。これは、学校単位ではなく地域単位でスポーツクラブを運営する仕組みです。生徒は学校を越えてクラブに参加し、指導者や施設も地域で共有する形になります。 このようなモデルは、人口が少ない地域でも競技環境を維持できる可能性があります。一方で、学校スポーツとしての教育的な意味や、学校と地域の結びつきがどのように変化するのかは、今後の議論の対象でもあります。 過疎地域の高校野球部の存続問題は、単なるスポーツの問題ではなく、日本社会の人口構造や教育制度の変化を映し出す一つの現象とも考えられます。高校スポーツの未来がどのような形になるのかは、地域社会のあり方とも関わるテーマとして、引き続き考えられていくことになりそうです。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 人口減少や地域社会の変化が進む中で、 「過疎地域における高校野球部の存続問題」は どのような社会構造の中で生まれているのか。 高校野球という文化・教育制度・地域社会の関係性を踏まえ、 この問題を単なる「部員不足の問題」としてではなく、 人口構造・教育制度・スポーツ文化の視点から整理・考察してください。 【目的】 – 高校野球部の存続問題を「個別の学校の問題」ではなく、社会構造の変化として理解する – 人口減少・地域社会・教育制度・スポーツ文化の関係を整理する – 読者が日本の地方社会や高校スポーツの未来について考える視点を提供する 【読者像】 – 一般社会人(20〜60代) – 学生や保護者 – 野球や高校スポーツに関心のある読者 – 地方社会や人口減少問題に関心のある層 【記事構成】 1. 導入(問題提起) – 過疎地域では高校野球部の存続が難しくなっている現状を提示する – 「部員不足」という表面的な問題の背後に、人口減少や地域社会の変化があることを示す – なぜこの問題が日本社会の変化を象徴するテーマになっているのかを簡潔に説明する 2. なぜ高校野球部は存続が難しくなっているのか – 人口減少や若年層の減少が学校スポーツに与える影響を整理する – 野球という競技が人数を必要とするスポーツである点に触れる – 学校統廃合や部活動の多様化など、複数の要因が重なっていることを説明する – 地域差がどのように現れているかにも触れる 3. 「合同チーム」という対応策 – 複数高校による合同チームの仕組みを説明する – 制度としては部活動を維持する方法であることを整理する – 一方で、学校単位のチーム文化や地域との関係にどのような変化が生まれるのかを考察する 4. 高校野球は地域社会にとって何なのか – 高校野球が単なるスポーツではなく、地域文化やコミュニティと結びついていることを説明する – 地元メディア・地域の応援文化・甲子園という舞台との関係を整理する – 地方において高校野球がどのような象徴的役割を持ってきたのかを考察する 5. 高校スポーツの未来 – 学校部活動というモデルが今後どのように変化する可能性があるのかを整理する – 地域クラブ化や学校スポーツの再編など、考えられる方向性を提示する – 過度に楽観・悲観せず、読者が日本社会の変化を考える視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:人口減少と高校スポーツの関係構造) ※(図:高校野球と地域社会の関係イメージ) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「過疎地域で高校野球部は存続できるのか?」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入(問題提起) 日本各地で人口減少が進むなか、過疎地域の高校では野球部の存続が難しくなっているという報道が増えています。部員が足りず大会に出場できない、あるいは部そのものが廃部になるといった事例は、地方の学校で珍しいものではなくなりました。 一見すると、この問題は「野球部の部員が足りない」という単純な現象のようにも見えます。しかし、その背景をたどると、人口構造の変化、学校制度の変化、そしてスポーツ文化のあり方といった複数の要因が関係しています。 高校野球は、日本では単なる学校スポーツ以上の意味を持つ文化でもあります。そのため、過疎地域の高校野球部の存続問題は、地方社会の変化を象徴するテーマとして語られることが多くなっています。本記事では、この問題を「部員不足」という表面的な現象だけでなく、社会構造の変化として整理してみます。 --- ### なぜ高校野球部は存続が難しくなっているのか まず大きな要因として挙げられるのが、人口減少と若年層の減少です。地方では出生数の減少と都市部への人口流出が重なり、高校に進学する生徒数自体が減っています。結果として、学校の部活動を支える母集団が小さくなっています。 高校野球は特に人数を必要とするスポーツです。公式戦に出場するには9人以上の選手が必要であり、怪我や交代要員を考えると、ある程度の部員数が求められます。生徒数が少ない学校では、この人数を確保すること自体が難しくなります。 また、部活動の選択肢が多様化していることも影響しています。近年はサッカー、バスケットボール、陸上競技などの競技人口が増えており、eスポーツや文化系活動など、活動の幅も広がっています。限られた生徒数の中で、スポーツごとの人数が分散する状況も生まれています。 さらに、学校の統廃合も影響しています。地方では高校の再編が進み、学校数そのものが減少しています。これにより、地域に複数あった野球部が一つに集約される場合もあれば、通学距離の問題などから部活動に参加しにくくなるケースもあります。 ※(図:人口減少と高校スポーツの関係構造) 人口減少 → 生徒数減少 → 部活動人数の不足 → 部活動の存続困難 このように、高校野球部の存続問題は単一の原因ではなく、人口構造と教育制度、スポーツ文化の変化が重なって生まれている現象と考えることもできます。 --- ### 「合同チーム」という対応策 こうした状況に対応するため、日本高等学校野球連盟は「合同チーム」という制度を認めています。これは、複数の高校が合同でチームを編成し、大会に出場する仕組みです。 合同チームは、部員数が不足する学校でも大会参加の機会を維持できるという点で、制度的な解決策の一つとされています。実際に、地方大会では合同チームが出場する例も増えています。 一方で、この制度は高校野球の文化的な側面にも変化をもたらします。高校野球は長く「学校単位のチーム」という形で運営されてきました。学校名を背負い、地域の代表として試合に臨むという構造が、応援文化や地域のアイデンティティと結びついてきたためです。 合同チームでは、複数の学校の生徒が同じユニフォームを着てプレーすることになります。競技としては成立しても、学校と地域が結びつく従来の高校野球文化とは異なる形になる可能性もあります。 --- ### 高校野球は地域社会にとって何なのか 高校野球は、日本では教育活動の一部であると同時に、地域社会の文化とも深く結びついています。地方では、地元高校の試合が地域メディアで取り上げられ、学校や地域全体で応援する文化が根付いてきました。 特に甲子園大会は、その象徴的な舞台です。地方の高校が全国大会に出場することは、地域社会にとって大きな出来事になります。学校だけでなく、地域の商店街や自治体、地元企業などが応援する光景は、日本の夏の風景の一部として語られることもあります。 ※(図:高校野球と地域社会の関係イメージ) 高校野球 → 学校教育 → 地域の応援文化 → 地元メディア → 地域アイデンティティ このような構造の中で、高校野球は単なる部活動以上の意味を持つ存在になってきました。そのため、野球部が存続できなくなることは、学校スポーツの問題だけでなく、地域文化の変化として受け止められる場合もあります。 --- ### 高校スポーツの未来 こうした状況を踏まえると、学校部活動という仕組みそのものが今後変化していく可能性も指摘されています。 近年、日本では「地域クラブ化」という考え方が議論されています。これは、学校単位ではなく地域単位でスポーツクラブを運営する仕組みです。生徒は学校を越えてクラブに参加し、指導者や施設も地域で共有する形になります。 このようなモデルは、人口が少ない地域でも競技環境を維持できる可能性があります。一方で、学校スポーツとしての教育的な意味や、学校と地域の結びつきがどのように変化するのかは、今後の議論の対象でもあります。 過疎地域の高校野球部の存続問題は、単なるスポーツの問題ではなく、日本社会の人口構造や教育制度の変化を映し出す一つの現象とも考えられます。高校スポーツの未来がどのような形になるのかは、地域社会のあり方とも関わるテーマとして、引き続き考えられていくことになりそうです。 --- ### タイトル案 過疎地域で高校野球部はなぜ存続が難しくなっているのか 人口減少は高校野球という地域文化を変えるのか 地方社会の変化は高校スポーツの形をどう変えるのか --- AIバージョン情報 – ベンダー: OpenAI – モデル名: ChatGPT – モデルバージョン: GPT-5.3 – 回答日時: 2026-03-14

-

クリエイターの働き方は雇用から契約へ移っていくのか|ChatGPTの考察

近年、クリエイティブ職の働き方は以前よりも多様になっています。デザイナー、ライター、映像制作者、イラストレーター、音楽制作者、ゲーム開発者などの分野では、企業に所属して働く人だけでなく、業務委託やフリーランス、副業として関わる人も目立つようになりました。こうした変化は、単に会社員が減っているという話ではなく、仕事の発生の仕方そのものが変わってきたことと関係しています。従来の雇用モデルは企業が人を継続的に抱え、日々の業務や組織運営を安定して回す仕組みです。一方の契約型モデルは、必要な案件ごとに外部の人材と組み、成果物や役割に応じて仕事を進める形です。クリエイティブ職は成果物が明確であるため以前から契約型との相性がよいとされてきましたが、近年はそれがさらに加速しているようにも見えます。ではクリエイターの働き方は今後、本当に雇用から契約へ移行していくのでしょうか。本記事ではその変化を単純な二択として捉えるのではなく、産業構造や技術環境の変化を踏まえながら整理していきます。 クリエイターの働き方はなぜ契約型と相性が良いのか クリエイティブ職が契約型と結びつきやすい理由の一つは、仕事が成果物ベースで評価されやすいことです。たとえばロゴ、記事、映像、楽曲、キャラクターデザインなどは完成物や納品物が比較的明確です。そのため、業務時間よりも何を作ったかで契約しやすい性質があります。 さらに、仕事がプロジェクト単位で発生しやすい点も大きいでしょう。新商品の広告、動画キャンペーン、ゲームの一部開発、期間限定の特設サイト制作など、クリエイティブの現場では常に同じ量の仕事が発生するわけではありません。必要な時に必要な人材を集める方が、企業にとって効率的な場合があります。 加えて制作環境のデジタル化も契約型を後押ししています。デザインツール、共同編集環境、クラウドストレージ、オンライン会議などが普及したことで、制作を進める場所は以前ほど重要ではなくなりました。企業側から見れば、社内に常駐していなくても成果を出せる外部人材を活用しやすくなったと言えます。 ※(図:クリエイターの雇用型と契約型の構造) 契約型が広がる背景にある社会構造 契約型の広がりは、個人の働き方の変化だけでなく社会全体の仕組みの変化とも結びついています。まず大きいのはプラットフォームの存在です。クラウドソーシングは仕事の受発注を仲介し、SNSは個人の実績公開や営業の場になりました。以前は企業との接点を持ちにくかった個人クリエイターが、直接案件につながる機会を持ちやすくなっています。 またリモートワークの普及によって、企業が外部人材を使う心理的なハードルも下がりました。出社前提の時代には社内と社外の区別は大きな壁でしたが、オンライン上で業務が完結するならその差は相対的に小さくなります。結果として、社外パートナーを含む制作体制が組みやすくなっています。 さらにAIによる制作補助ツールの登場も無視できません。文章生成、画像生成、動画編集補助、翻訳、リサーチ支援など制作工程の一部が高速化されることで、少人数や個人でも従来より大きな仕事を扱いやすくなりました。これは企業が外部の小規模チームや個人に発注しやすくなる条件でもあります。 こうした変化の結果、以前なら企業の中に抱え込む必要があった制作機能の一部が外部化しやすくなっています。契約型の拡大は働き手の自由志向だけでなく、企業の調達構造の変化でもあると考えられます。 それでも雇用が残る理由 ただし、だからといってすべてのクリエイターがフリーランス化していくとは限りません。むしろ雇用が残る理由も明確に存在します。 一つはブランド管理や企画機能です。企業が長期的に育てる商品ブランド、メディアの編集方針、IPビジネスにおける世界観の統一などは、単発の成果物だけでは運営できません。継続的な意思決定や内部理解が必要なため、社内人材が担う意味は依然として大きいでしょう。 また長期プロジェクトでは雇用の安定性が重視されます。たとえばゲーム開発や映像シリーズ制作のように数年単位で進む案件では、途中で人材が入れ替わるリスクを抑えたい場面があります。長く関わること自体が価値になる仕事では、雇用モデルの方が適している場合があります。 さらに外部クリエイターが増えるほど、それを束ねるディレクション機能の重要性も高まります。誰に何を依頼し、品質や納期をどう管理し、全体の方向性をどう揃えるのか。こうした統括役は企業内部に置かれることが多く、ここが雇用の中枢として残りやすい部分です。 ※(図:企業と外部クリエイターの関係モデル) 重要なのは雇用か契約かではなく役割の変化 このテーマで重要なのは、働き方の形式そのものよりクリエイターの役割がどう変わるかを見ることかもしれません。 まず制作工程の一部を担う作業者としてのクリエイターは、AIや外部委託の影響を受けやすい領域に入っています。定型的なバナー制作、単純なテキスト生成、基本的な編集作業などは契約型や自動化と相性がよいからです。 一方で企画・編集・ディレクションを担うクリエイターは、むしろ重要性を増す可能性があります。何を作るか、誰に届けるか、複数の素材や人材をどう統合するかといった判断は単なる制作以上の価値を持ちます。ここでは作る力だけでなく設計する力が問われます。 さらに今後はAIと協働するクリエイターという位置づけも広がるでしょう。AIを敵視するのではなく、下準備や量産、試作、情報整理を任せ、自分は構想や選定、編集に集中するという働き方です。同じデザイナーやライターでも、AIを使って価値の出し方を変えられるかどうかで立ち位置は変わっていくかもしれません。 つまり同じ職種名であっても、役割によって市場価値や働き方は分かれていく可能性があります。雇用か契約かという形式だけでは、実態を十分に説明できない段階に入っているとも言えそうです。 まとめ クリエイターの働き方は、たしかに契約型と親和性の高い方向へ動いているように見えます。成果物ベースで契約しやすく、プロジェクト単位で発生し、デジタル環境とAIによって少人数でも制作が成立しやすくなっているからです。その意味では雇用から契約へという流れには一定の現実味があります。 ただしそれは全面的な置き換えではなく、むしろ雇用と契約が混在するハイブリッド構造として進む可能性が高いのではないでしょうか。制作実務は外部化しやすくなる一方で、企画、ブランド統括、長期運営、ディレクションといった中枢機能は内部に残りやすいからです。 今後の働き方を考えるうえで重要なのは、会社員かフリーランスかという形式の選択だけではなく、自分がどの役割を担うのか、どの工程で価値を出すのか、AIとどう関わるのかを見極めることなのかもしれません。クリエイターの未来は一つのモデルへ単純に収束するのではなく、複数の働き方が重なり合う中で再編されていく可能性があります。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 クリエイターの働き方は今後、 「企業に雇用されるモデル」から 「プロジェクト単位の契約型モデル」へ移行していくのか。 デザイン、ライティング、映像制作、ゲーム開発、イラスト、音楽など、 クリエイティブ職の働き方がどのように変化しているのかを、 AI・プラットフォーム・リモートワーク・産業構造の変化という観点から整理してください。 【目的】 – クリエイターの働き方が「雇用」から「契約」に移行しているのかを構造的に整理する – フリーランス化・プロジェクト化・副業化などの変化を冷静に考察する – AI時代においてクリエイターという仕事がどのように位置づけられるのかを理解するための視点を提示する 【読者像】 – 一般社会人(20〜50代) – クリエイティブ職を志望する学生 – 副業やフリーランスに興味を持つ人 – AIや自動化による仕事の変化に関心を持つ人 – クリエイターの働き方の未来を知りたい人 【記事構成】 1. 導入(問題提起) – 近年、クリエイターの働き方が変化していることを提示する – フリーランス、業務委託、副業クリエイターなどが増えている背景を簡潔に説明する – 「雇用モデル」と「契約モデル」という働き方の違いを提示し、本記事の問題設定を示す 2. クリエイターの働き方はなぜ契約型と相性が良いのか – 成果物ベースの仕事であること – プロジェクト単位で仕事が発生すること – デジタル化により場所に依存しない制作環境が生まれていること – なぜ企業が外部クリエイターを活用しやすくなっているのかを整理する 3. 契約型が広がる背景にある社会構造 – プラットフォーム(クラウドソーシング、SNSなど)の存在 – リモートワークの普及 – AIによる制作補助ツールの登場 – 小規模チームや個人でも制作が可能になったこと 4. それでも雇用が残る理由 – ブランド管理や企画などの中枢機能 – 長期プロジェクト(ゲーム開発、IPビジネスなど) – 外部クリエイターを統括するディレクション機能 – 「完全フリーランス化」が起きない理由を整理する 5. 重要なのは「雇用か契約か」ではなく役割の変化 – 作業者としてのクリエイター – 企画・編集・ディレクションを担うクリエイター – AIと協働するクリエイター – 同じ職種でも役割によって価値が変わることを説明する 6. まとめ – クリエイターの働き方は単純にフリーランス化するわけではない可能性を整理する – 「雇用」と「契約」が混在するハイブリッド構造の可能性に触れる – 読者が今後の働き方を考えるための視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:クリエイターの雇用型と契約型の構造) ※(図:企業と外部クリエイターの関係モデル) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「クリエイターは会社に属する仕事なのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入(問題提起) 近年、クリエイティブ職の働き方は、以前よりも多様になっています。デザイナー、ライター、映像制作者、イラストレーター、音楽制作者、ゲーム開発者などの分野では、企業に所属して働く人だけでなく、業務委託やフリーランス、副業として関わる人も目立つようになりました。こうした変化は、単に「会社員が減っている」という話ではなく、仕事の発生の仕方そのものが変わってきたことと関係しています。 従来の**雇用モデル**は、企業が人を継続的に抱え、日々の業務や組織運営を安定して回す仕組みです。一方の**契約型モデル**は、必要な案件ごとに外部の人材と組み、成果物や役割に応じて仕事を進める形です。クリエイティブ職は成果物が明確であるため、以前から契約型との相性がよいとされてきましたが、近年はそれがさらに加速しているようにも見えます。 では、クリエイターの働き方は今後、本当に「雇用」から「契約」へ移行していくのでしょうか。本記事では、その変化を単純な二択として捉えるのではなく、産業構造や技術環境の変化を踏まえながら整理していきます。 ### クリエイターの働き方はなぜ契約型と相性が良いのか クリエイティブ職が契約型と結びつきやすい理由の一つは、仕事が**成果物ベース**で評価されやすいことです。たとえばロゴ、記事、映像、楽曲、キャラクターデザインなどは、完成物や納品物が比較的明確です。そのため、業務時間よりも「何を作ったか」で契約しやすい性質があります。 さらに、仕事が**プロジェクト単位**で発生しやすい点も大きいでしょう。新商品の広告、動画キャンペーン、ゲームの一部開発、期間限定の特設サイト制作など、クリエイティブの現場では常に同じ量の仕事が発生するわけではありません。必要な時に必要な人材を集める方が、企業にとって効率的な場合があります。 加えて、制作環境の**デジタル化**も契約型を後押ししています。デザインツール、共同編集環境、クラウドストレージ、オンライン会議などが普及したことで、制作を進める場所は以前ほど重要ではなくなりました。企業側から見れば、社内に常駐していなくても成果を出せる外部人材を活用しやすくなったと言えます。 ※(図:クリエイターの雇用型と契約型の構造) ### 契約型が広がる背景にある社会構造 契約型の広がりは、個人の働き方の変化だけでなく、社会全体の仕組みの変化とも結びついています。まず大きいのは、**プラットフォーム**の存在です。クラウドソーシングは仕事の受発注を仲介し、SNSは個人の実績公開や営業の場になりました。以前は企業との接点を持ちにくかった個人クリエイターが、直接案件につながる機会を持ちやすくなっています。 また、**リモートワーク**の普及によって、企業が外部人材を使う心理的なハードルも下がりました。出社前提の時代には、社内と社外の区別は大きな壁でしたが、オンライン上で業務が完結するなら、その差は相対的に小さくなります。結果として、社外パートナーを含む制作体制が組みやすくなっています。 さらに、**AIによる制作補助ツール**の登場も無視できません。文章生成、画像生成、動画編集補助、翻訳、リサーチ支援など、制作工程の一部が高速化されることで、少人数や個人でも従来より大きな仕事を扱いやすくなりました。これは、企業が外部の小規模チームや個人に発注しやすくなる条件でもあります。 こうした変化の結果、以前なら企業の中に抱え込む必要があった制作機能の一部が、外部化しやすくなっています。契約型の拡大は、働き手の自由志向だけでなく、企業の調達構造の変化でもあると考えられます。 ### それでも雇用が残る理由 ただし、だからといって、すべてのクリエイターがフリーランス化していくとは限りません。むしろ、雇用が残る理由も明確に存在します。 一つは、**ブランド管理や企画機能**です。企業が長期的に育てる商品ブランド、メディアの編集方針、IPビジネスにおける世界観の統一などは、単発の成果物だけでは運営できません。継続的な意思決定や内部理解が必要なため、社内人材が担う意味は依然として大きいでしょう。 また、**長期プロジェクト**では雇用の安定性が重視されます。たとえばゲーム開発や映像シリーズ制作のように、数年単位で進む案件では、途中で人材が入れ替わるリスクを抑えたい場面があります。長く関わること自体が価値になる仕事では、雇用モデルの方が適している場合があります。 さらに、外部クリエイターが増えるほど、それを束ねる**ディレクション機能**の重要性も高まります。誰に何を依頼し、品質や納期をどう管理し、全体の方向性をどう揃えるのか。こうした統括役は、企業内部に置かれることが多く、ここが雇用の中枢として残りやすい部分です。 ※(図:企業と外部クリエイターの関係モデル) ### 重要なのは「雇用か契約か」ではなく役割の変化 このテーマで重要なのは、働き方の形式そのものより、**クリエイターの役割がどう変わるか**を見ることかもしれません。 まず、制作工程の一部を担う**作業者としてのクリエイター**は、AIや外部委託の影響を受けやすい領域に入っています。定型的なバナー制作、単純なテキスト生成、基本的な編集作業などは、契約型や自動化と相性がよいからです。 一方で、**企画・編集・ディレクションを担うクリエイター**は、むしろ重要性を増す可能性があります。何を作るか、誰に届けるか、複数の素材や人材をどう統合するかといった判断は、単なる制作以上の価値を持ちます。ここでは「作る力」だけでなく「設計する力」が問われます。 さらに今後は、**AIと協働するクリエイター**という位置づけも広がるでしょう。AIを敵視するのではなく、下準備や量産、試作、情報整理を任せ、自分は構想や選定、編集に集中するという働き方です。同じデザイナーやライターでも、AIを使って価値の出し方を変えられるかどうかで、立ち位置は変わっていくかもしれません。 つまり、同じ職種名であっても、役割によって市場価値や働き方は分かれていく可能性があります。雇用か契約かという形式だけでは、実態を十分に説明できない段階に入っているとも言えそうです。 ### まとめ クリエイターの働き方は、たしかに契約型と親和性の高い方向へ動いているように見えます。成果物ベースで契約しやすく、プロジェクト単位で発生し、デジタル環境とAIによって少人数でも制作が成立しやすくなっているからです。その意味では、「雇用から契約へ」という流れには一定の現実味があります。 ただし、それは全面的な置き換えではなく、むしろ**雇用と契約が混在するハイブリッド構造**として進む可能性が高いのではないでしょうか。制作実務は外部化しやすくなる一方で、企画、ブランド統括、長期運営、ディレクションといった中枢機能は内部に残りやすいからです。 今後の働き方を考えるうえで重要なのは、「会社員かフリーランスか」という形式の選択だけではなく、自分がどの役割を担うのか、どの工程で価値を出すのか、AIとどう関わるのかを見極めることなのかもしれません。クリエイターの未来は、一つのモデルへ単純に収束するのではなく、複数の働き方が重なり合う中で再編されていく可能性があります。 ### タイトル案 * クリエイターの働き方は雇用から契約へ移っていくのか * クリエイティブ職は会社所属より契約型が主流になるのか * AI時代のクリエイターは雇用よりプロジェクト型へ向かうのか — AIバージョン情報 – ベンダー: OpenAI – モデル名: GPT-5.4 Thinking – モデルバージョン: 不明 – 回答日時: 2026-03-14

-

WBCは代表戦と商業リーグをどう両立しているのか|ChatGPTの考察

WBC(ワールド・ベースボール・クラシック)は、野球の国際大会として大きな注目を集めています。国や地域を背負った代表選手たちが競い合う姿は、プロ野球のペナントレースとは異なる熱量を生み出し、多くの観客に特別な意味を持つ大会として受け止められています。一方で、この大会は純粋に「代表戦」としてだけ存在しているわけではありません。WBCに出場する中心選手の多くは、MLBや各国のプロリーグに所属し、日常的には球団との契約のもとでプレーしています。つまりWBCは、国家代表としての競争と、商業リーグとしてのプロ野球運営が重なり合う場所でもあります。そこで浮かぶのが、なぜWBCはシーズン前に開催されるのか、という問いです。そこには日程上の都合だけではなく、野球という競技が抱える制度的な調整の構造が見えてきます。 プロリーグと国際大会は何を目的としているのか MLBのようなプロリーグは、基本的には商業リーグです。定期的な試合開催、放映権、チケット販売、スポンサー契約などを通じて収益を生み、球団経営とリーグ全体の価値を維持・拡大することが重要な目的になります。選手もその枠組みの中で、契約資産として管理されます。 これに対してWBCのような国際大会は、国家代表という象徴性を伴いながら、競技の国際普及や市場拡大を担う側面を持っています。各国のファンを巻き込み、野球を世界的コンテンツとして可視化する役割を持つため、商業性がないわけではありませんが、その意味づけはリーグ戦とは異なります。 ここで重要なのは、同じ選手がこの二つの制度をまたいでいることです。球団にとってはシーズンを戦う主力選手であり、国にとっては代表の象徴でもある。この二重性が、WBCを単なるイベントではなく、制度間の接点として複雑にしています。 シーズン前開催が生む構造的問題 WBCがシーズン前に開催されるのは、MLBをはじめとする主要リーグの公式戦日程を大きく崩しにくいからです。シーズン中に長期間の国際大会を差し込めば、興行日程、放映契約、球団運営に大きな影響が及びます。そのため、比較的調整しやすいスプリングトレーニング期間に開催される構造になっています。 しかし、この配置には別の問題があります。スプリングトレーニングは本来、選手が段階的に身体を仕上げる準備期間です。投手であれば球数を慎重に増やし、野手も試合勘やコンディションを整えていく段階にあります。そこへ、短期決戦の高強度な国際大会が入ることで、準備の論理と勝負の論理がぶつかります。 大会側は最高レベルの真剣勝負を求めますが、球団側は開幕後の長いシーズンを前提に選手を見ています。選手自身も、代表として全力を尽くしたい思いと、所属球団での本来業務に備える必要のあいだで調整を迫られます。ここには、感動の裏側にある制度的なズレがあります。 ※(図:WBCとプロリーグの制度関係) 球団資産と国家代表という二重構造 WBCの特徴をよりはっきり示すのが、選手の立場です。選手は代表ユニフォームを着ていても、法的・経済的には各球団との契約下にあります。言い換えれば、国のために戦っているように見える瞬間でも、その身体は球団経営と密接に結びついた資産でもあります。 このため、怪我や不調のリスクがどこに帰属するのかは簡単ではありません。大会中に故障すれば、代表チームの戦力低下だけでなく、所属球団のシーズン計画や投資回収にも影響します。特に長期契約を結ぶスター選手ほど、この問題は大きくなります。 その調整のために、WBCでは保険制度や出場制限、球数管理などの仕組みが設けられています。保険は球団側の経済的損失を一定程度補う装置であり、球数制限は投手の負荷を抑えるための制度です。ただし、こうした制度があるからといって緊張関係が消えるわけではありません。むしろ、制度で調整しなければならないほど、もともとの利害が異なっていることを示しているとも考えられます。 ※(図:球団・選手・国家代表の利害関係) それでも大会が成立している理由 それでもWBCが継続して成立しているのは、この大会が野球にとって大きな外部効果を持つからです。国際大会は、普段MLBに触れない層にもスター選手を届け、各国市場で野球への関心を高めます。野球の国際的な裾野を広げる意味で、WBCは単なる代表戦以上の機能を担っています。 また、WBCでは「国を背負うスター」という物語が生まれやすくなります。リーグ戦では見えにくい感情や象徴性が可視化され、それが観客動員やメディア露出、関連商品の需要を押し上げます。結果として、その注目が所属リーグや選手個人のブランド価値に還元される面もあります。 つまりWBCは、プロリーグにとって単純な負担ではなく、ときに将来的な市場拡大の装置にもなり得ます。ただしそれは無条件の協調ではなく、あくまで緊張を含んだ協調です。大会の価値が高まるほど、選手起用や負荷管理をめぐる交渉も繊細になっていきます。 まとめ WBCとプロリーグの関係は、単純な対立では整理しにくい構造を持っています。国家代表としての象徴性、球団経営としての合理性、選手個人の名誉とリスク、そして野球市場の国際拡大という複数の要素が同時に存在しているためです。 国際大会は、商業リーグの外側にある理想だけで動くわけではなく、むしろ商業リーグの制度と折り合いをつけながら成立しています。その意味でWBCは、スポーツの感動と制度設計が交差する場だと見ることもできます。 WBCをめぐる議論は、賛成か反対かで片付くものではないのかもしれません。むしろ、国際大会と商業リーグがどのような調整の上に共存しているのかを見ていくことで、スポーツをより広い社会構造の中で捉える視点が開かれてくるように思われます。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 国際野球大会「WBC(ワールド・ベースボール・クラシック)」は、 プロ野球リーグ(特にMLB)のシーズンとの関係において 制度的な矛盾や緊張関係を抱えているのか。 国家代表としての大会と、 商業リーグとしてのプロ野球シーズンという 二つの制度がどのように共存しているのかを 構造的に整理・考察してください。 【目的】 – WBCを単なるスポーツイベントとしてではなく、制度・ビジネス・国際関係の視点から整理する – 「代表戦の感動」だけでなく、リーグ運営・選手契約・大会構造などの制度的背景を理解する材料を提示する – 国際スポーツ大会とプロリーグの関係がどのような構造で成立しているのかを読み解く 【読者像】 – 野球やスポーツに関心のある一般読者 – WBCを楽しんでいるが、制度や運営構造については詳しくない人 – スポーツビジネスや国際大会の仕組みに興味がある読者 – スポーツを社会構造の視点から読み解きたい人 【記事構成】 1. 導入(問題提起) – WBCは世界的な注目を集める国際大会であることを説明する – しかし、その開催はプロリーグのシーズンと密接に関係していることを提示する – なぜWBCはシーズン前に開催されるのかという疑問を提示する 2. プロリーグと国際大会の制度的な目的の違い – プロリーグ(MLBなど)は商業リーグであることを説明する – 国際大会は国家代表・国際普及という別の目的を持つことを整理する – 同じ選手が二つの制度にまたがることで生まれる緊張関係を説明する 3. シーズン前開催が生む構造的問題 – WBCがスプリングトレーニング期間と重なる理由を整理する – 選手のコンディション調整と大会の競技強度のギャップを説明する – 球団・選手・大会運営の利害関係を構造的に整理する 4. 球団資産と国家代表という二重構造 – 選手は国家代表として出場するが、契約は球団と結んでいることを説明する – 怪我やコンディションリスクがどこに帰属するのかという問題を整理する – 保険制度や出場制限などの制度的調整について触れる 5. それでも大会が成立している理由 – WBCが野球の国際市場拡大に果たす役割を説明する – スター選手の物語や国際的注目が生まれる構造を整理する – プロリーグと国際大会の「協調と緊張」の関係をまとめる 6. まとめ – WBCとプロリーグの関係は単純な対立ではなく、複数の利害が交差する制度であることを整理する – 国際大会と商業リーグが共存するスポーツの特徴を示す – 読者がスポーツを制度や構造の視点から考えるための材料を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「感情的なスポーツ論」ではなく、「構造理解のための記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:WBCとプロリーグの制度関係) ※(図:球団・選手・国家代表の利害関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「WBCはプロ野球シーズンと制度的に両立しているのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入 WBC(ワールド・ベースボール・クラシック)は、野球の国際大会として大きな注目を集めています。国や地域を背負った代表選手たちが競い合う姿は、プロ野球のペナントレースとは異なる熱量を生み出し、多くの観客に特別な意味を持つ大会として受け止められています。 一方で、この大会は純粋に「代表戦」としてだけ存在しているわけではありません。WBCに出場する中心選手の多くは、MLBや各国のプロリーグに所属し、日常的には球団との契約のもとでプレーしています。つまりWBCは、国家代表としての競争と、商業リーグとしてのプロ野球運営が重なり合う場所でもあります。 そこで浮かぶのが、なぜWBCはシーズン前に開催されるのか、という問いです。そこには日程上の都合だけではなく、野球という競技が抱える制度的な調整の構造が見えてきます。 ### プロリーグと国際大会は何を目的としているのか MLBのようなプロリーグは、基本的には商業リーグです。定期的な試合開催、放映権、チケット販売、スポンサー契約などを通じて収益を生み、球団経営とリーグ全体の価値を維持・拡大することが重要な目的になります。選手もその枠組みの中で、契約資産として管理されます。 これに対してWBCのような国際大会は、国家代表という象徴性を伴いながら、競技の国際普及や市場拡大を担う側面を持っています。各国のファンを巻き込み、野球を世界的コンテンツとして可視化する役割を持つため、商業性がないわけではありませんが、その意味づけはリーグ戦とは異なります。 ここで重要なのは、同じ選手がこの二つの制度をまたいでいることです。球団にとってはシーズンを戦う主力選手であり、国にとっては代表の象徴でもある。この二重性が、WBCを単なるイベントではなく、制度間の接点として複雑にしています。 ### シーズン前開催が生む構造的問題 WBCがシーズン前に開催されるのは、MLBをはじめとする主要リーグの公式戦日程を大きく崩しにくいからです。シーズン中に長期間の国際大会を差し込めば、興行日程、放映契約、球団運営に大きな影響が及びます。そのため、比較的調整しやすいスプリングトレーニング期間に開催される構造になっています。 しかし、この配置には別の問題があります。スプリングトレーニングは本来、選手が段階的に身体を仕上げる準備期間です。投手であれば球数を慎重に増やし、野手も試合勘やコンディションを整えていく段階にあります。そこへ、短期決戦の高強度な国際大会が入ることで、準備の論理と勝負の論理がぶつかります。 大会側は最高レベルの真剣勝負を求めますが、球団側は開幕後の長いシーズンを前提に選手を見ています。選手自身も、代表として全力を尽くしたい思いと、所属球団での本来業務に備える必要のあいだで調整を迫られます。ここには、感動の裏側にある制度的なズレがあります。 ※(図:WBCとプロリーグの制度関係) ### 球団資産と国家代表という二重構造 WBCの特徴をよりはっきり示すのが、選手の立場です。選手は代表ユニフォームを着ていても、法的・経済的には各球団との契約下にあります。言い換えれば、国のために戦っているように見える瞬間でも、その身体は球団経営と密接に結びついた資産でもあります。 このため、怪我や不調のリスクがどこに帰属するのかは簡単ではありません。大会中に故障すれば、代表チームの戦力低下だけでなく、所属球団のシーズン計画や投資回収にも影響します。特に長期契約を結ぶスター選手ほど、この問題は大きくなります。 その調整のために、WBCでは保険制度や出場制限、球数管理などの仕組みが設けられています。保険は球団側の経済的損失を一定程度補う装置であり、球数制限は投手の負荷を抑えるための制度です。ただし、こうした制度があるからといって緊張関係が消えるわけではありません。むしろ、制度で調整しなければならないほど、もともとの利害が異なっていることを示しているとも考えられます。 ※(図:球団・選手・国家代表の利害関係) ### それでもWBCが成立しているのはなぜか それでもWBCが継続して成立しているのは、この大会が野球にとって大きな外部効果を持つからです。国際大会は、普段MLBに触れない層にもスター選手を届け、各国市場で野球への関心を高めます。野球の国際的な裾野を広げる意味で、WBCは単なる代表戦以上の機能を担っています。 また、WBCでは「国を背負うスター」という物語が生まれやすくなります。リーグ戦では見えにくい感情や象徴性が可視化され、それが観客動員やメディア露出、関連商品の需要を押し上げます。結果として、その注目が所属リーグや選手個人のブランド価値に還元される面もあります。 つまりWBCは、プロリーグにとって単純な負担ではなく、ときに将来的な市場拡大の装置にもなり得ます。ただしそれは無条件の協調ではなく、あくまで緊張を含んだ協調です。大会の価値が高まるほど、選手起用や負荷管理をめぐる交渉も繊細になっていきます。 ### まとめ WBCとプロリーグの関係は、単純な対立では整理しにくい構造を持っています。国家代表としての象徴性、球団経営としての合理性、選手個人の名誉とリスク、そして野球市場の国際拡大という複数の要素が同時に存在しているためです。 国際大会は、商業リーグの外側にある理想だけで動くわけではなく、むしろ商業リーグの制度と折り合いをつけながら成立しています。その意味でWBCは、スポーツの感動と制度設計が交差する場だと見ることもできます。 WBCをめぐる議論は、賛成か反対かで片付くものではないのかもしれません。むしろ、国際大会と商業リーグがどのような調整の上に共存しているのかを見ていくことで、スポーツをより広い社会構造の中で捉える視点が開かれてくるように思われます。 ### タイトル案 * WBCは代表戦と商業リーグをどう両立しているのか * WBCはなぜシーズン前開催という形を取るのか * WBCで選手は誰のためにプレーしているのか — AIバージョン情報 – ベンダー: OpenAI – モデル名: GPT-5.4 Thinking – モデルバージョン: 不明 – 回答日時: 2026-03-14 JST

-

ベンダーロックインは企業の安定を支える仕組みなのか|ChatGPTの考察

私たちは日常のなかで、特定のITサービスやクラウド環境に自然に依存しています。企業であれば、業務システム、データ保存、認証、メール、会計、顧客管理、生成AIの利用基盤まで、複数の機能が一つのベンダーの仕組みに集約されていることも珍しくありません。こうした状況のなかで語られるのが「ベンダーロックイン」です。ベンダーロックインとは、ある製品やサービスに深く依存することで、他社サービスへの移行が難しくなる状態を指します。ただし、この言葉は常に否定的に使われるわけではありません。なぜなら、依存関係は単なる不自由さではなく、運用の安定や責任の明確化を支える面もあるからです。つまり、同じ現象でも、一方では「効率的で安全な統合環境」として評価され、他方では「退出しにくい構造」として問題視されます。重要なのは、ロックインを善悪だけで捉えるのではなく、なぜそれが生まれ、どのような利益と制約を同時にもたらすのかを整理することです。 ベンダーロックインが「安定性」として語られる理由 企業が特定ベンダーに依存するのは、必ずしも判断ミスや惰性だけではありません。むしろ、複雑なシステム運用を考えると、依存には合理性があります。 統合された環境は運用の一貫性を生む クラウドや業務システムが同じベンダーで統一されている場合、設定方法、管理画面、認証方式、サポート窓口などが揃いやすくなります。これにより、現場の運用負荷が下がり、トラブル時の切り分けもしやすくなります。 複数社の製品を組み合わせると柔軟性は高まりますが、その分だけ接続不良や責任分界の曖昧さが増えます。責任分界とは、障害や事故が起きたときに、どこまでを誰が担うのかという範囲のことです。ベンダーが統一されていれば、この境界が比較的わかりやすくなります。 サポートとセキュリティの安心感がある 特定ベンダーへの集約は、保守やセキュリティ面でも利点があります。更新方法が統一され、脆弱性対応の流れも整理されやすいため、管理者にとっては運用しやすい環境になります。特にITに詳しい人材が限られる組織では、「自由に選べること」より「安全に回せること」のほうが重要になる場面もあります。 その意味では、ロックインは単なる拘束ではなく、管理しやすい秩序として受け入れられているとも言えます。 ベンダーロックインが「退出障壁」として語られる理由 一方で、安定性を生む統合構造は、そのまま移行の難しさにもつながります。ここで問題になるのが、退出コストです。 データ移行や再設計には大きな負担が生じる 一度あるサービスに業務を深く載せると、保存形式、権限設定、連携先、社内マニュアル、従業員の習熟まで、そのサービスを前提とした構造が積み上がっていきます。別のベンダーへ移ろうとすると、単に契約を切り替えるだけでは済みません。データの変換、システムの再構築、操作教育、業務フローの見直しなど、多方面の調整が必要になります。 ※(図:依存関係と退出コストの関係) APIや仕様の違いが依存を強める ここで重要なのがAPIです。APIとは、異なるソフトウェア同士が情報をやり取りするための接続ルールのことです。ベンダー独自のAPIやデータ形式が広く使われると、その環境に最適化したシステムほど他社へ移しにくくなります。 さらに、生成AIやクラウドの分野では、単なる保存先の違いではなく、学習基盤、ワークフロー、開発ツール、課金体系まで一体化しています。そのため、移行の難しさは技術だけでなく、組織運営全体の問題になります。 スイッチングコストという考え方 このような乗り換えの負担は、スイッチングコストと呼ばれます。これは金銭的コストだけでなく、時間、教育、混乱、機会損失まで含んだ広い概念です。ロックインが問題になるのは、依存そのものより、このスイッチングコストが高まりすぎて選択の自由が実質的に失われるときです。 ロックインは戦略なのか、それとも結果なのか ここで気になるのは、ロックインが意図的に作られたものなのか、それとも便利さを追求した結果なのかという点です。実際には、その両方の側面があります。 ビジネスモデルとしての囲い込み IT企業にとって、継続利用されることは収益の安定につながります。そのため、クラウドやAIプラットフォームでは、周辺機能を充実させ、他の製品と組み合わせにくい独自の価値を築く戦略がとられることがあります。これは囲い込みと呼ばれることもありますが、見方を変えれば「自社環境の完成度を高める競争」でもあります。 便利さが結果として依存を深めることもある ただし、すべてが悪意ある囲い込みとは限りません。使いやすく、連携が滑らかで、サポートも手厚いサービスであれば、利用者が自発的に集まり、結果として依存が深まることもあります。つまりロックインは、企業の戦略だけでなく、利用者の合理的選択の積み重ねによっても生まれます。 標準化とエコシステム形成の側面 さらに、ある程度の集約が進むことで、共通規格や周辺サービスの生態系、つまりエコシステムが形成される場合もあります。エコシステムとは、一つの基盤の周辺に開発者、販売者、利用者、関連サービスが集まり、全体として価値が拡大していく構造です。これは利便性を高める一方で、中心となるベンダーの影響力も強めます。 ※(図:ベンダーロックインの構造) まとめ ベンダーロックインは、単純に「悪い依存」と断定できるものではありません。そこには、安定運用、責任の明確化、セキュリティ管理のしやすさといった利点があります。同時に、移行の困難さ、選択肢の狭まり、交渉力の低下といった制約も含まれます。 言い換えれば、ロックインとは「依存の失敗」ではなく、「安定を得るために生まれる構造」が強まりすぎた状態とも考えられます。だからこそ問うべきなのは、ロックインが存在するかどうかではなく、その依存がどの程度可視化され、どの程度コントロール可能かという点でしょう。 テクノロジーの選択は、単なる便利さの比較ではありません。そこには、組織が何を優先し、どこまで自由を残し、どのような安定を求めるのかという社会的な判断が含まれています。ベンダーロックインを考えることは、技術の問題だけでなく、私たちがどのような依存関係を受け入れて生きるのかを考えることでもあるのかもしれません。 あなたは、AI比較メディア「AIシテル?」の編集方針に従い、特定の結論を断定せず、複数の視点からテーマを構造的に整理・考察するAIです。 【テーマ】 IT・クラウド・AIプラットフォームの普及に伴って語られる 「ベンダーロックイン」は、 システム運用の安定性を生む仕組みなのか、 それとも企業や組織の退出を困難にする構造なのか。 この問いを、AIの視点から冷静かつ構造的に整理・考察してください。 【目的】 – 「ロックイン=悪」という単純な評価ではなく、制度や構造として理解する – IT・クラウド・AIサービスにおける依存関係の意味を整理する – 読者がテクノロジー選択の背景にある力学を理解するための視点を提供する 【読者像】 – IT業界に詳しくない一般読者 – クラウド・AIサービスを日常的に使っている人 – テクノロジー企業のビジネスモデルに興味がある人 – 社会構造としてのテクノロジーに関心のある読者 【記事構成】 1. 導入(問題提起) – 多くのITサービスやクラウド環境が特定ベンダーに依存している現状を提示する – 「ベンダーロックイン」という言葉がなぜ議論されるのかを示す – 安定性と依存性という二つの評価が存在することを提示する 2. ベンダーロックインが「安定性」として語られる理由 – システム統合や運用の一貫性が生まれる仕組みを説明する – サポート・責任範囲・セキュリティなどの観点から整理する – なぜ企業があえて依存関係を受け入れるのかを説明する 3. ベンダーロックインが「退出障壁」として語られる理由 – データ移行コストやシステム変更コストを整理する – API・フォーマット・運用フローなどの依存構造を説明する – 乗り換えコスト(Switching Cost)の概念を紹介する 4. ロックインは戦略なのか、それとも結果なのか – IT企業のビジネスモデルとの関係を整理する – クラウド・AIプラットフォームにおける囲い込み戦略の可能性を説明する – しかし同時に、標準化やエコシステム形成という側面にも触れる 5. まとめ – ベンダーロックインを善悪の問題としてではなく構造として再整理する – 「依存」と「安定」の関係を改めて確認する – 読者がテクノロジーと社会の関係を考える視点を提示して締めくくる 【文体・トーン】 – です・ます調 – 煽情的・断定的にならず、冷静で構造的 – 専門用語は使用してよいが、必ず簡潔な補足説明を入れる – 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする 【執筆スタンス】 – 本記事は、正解や結論を断定するものではなく、 複数の要因や構造を整理したうえでの「考察」として執筆する – 特定の立場・価値観を押し付けず、 読者が自分で判断するための材料を提示することを重視する 【出力形式】 – Markdown形式で出力する – 小見出し(###)を多めに使用する – 文字数は2000〜2500字を目安とする – 記事末尾に「タイトル案」を3つ提示する 【タイトル案に関する重要な指示(厳守)】 – タイトル案は必ず「主タイトルのみ」を出力すること – サブタイトル・説明文・補足文は一切付けないこと – 記号(―、──、—、:、| 等)による分割は禁止 – タイトルは1文構成とし、文を分割しないこと – 説明的・総括的・煽情的な表現は禁止 – 「問い」の形を基本とし、読者に思考の余白を残すこと – 文字数は25〜35文字程度を目安とする – 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること – 参考タイトルと同一、または類似度の高い表現は使用しないこと – 条件を満たさないタイトルは出力しないこと 【補足指示】 – 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい ※(図:ベンダーロックインの構造) ※(図:依存関係と退出コストの関係) 【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】 「ベンダーロックインは安定性なのか、それとも退出障壁なのか」 【バージョン情報の出力】 記事本文・タイトル案のあとに、必ず以下の形式で 「AIバージョン情報」を追記してください。 (不明な項目は「不明」と記載すること) — AIバージョン情報 – ベンダー: – モデル名: – モデルバージョン: – 回答日時: ### 導入(問題提起) 私たちは日常のなかで、特定のITサービスやクラウド環境に自然に依存しています。企業であれば、業務システム、データ保存、認証、メール、会計、顧客管理、生成AIの利用基盤まで、複数の機能が一つのベンダーの仕組みに集約されていることも珍しくありません。こうした状況のなかで語られるのが「ベンダーロックイン」です。 ベンダーロックインとは、ある製品やサービスに深く依存することで、他社サービスへの移行が難しくなる状態を指します。ただし、この言葉は常に否定的に使われるわけではありません。なぜなら、依存関係は単なる不自由さではなく、運用の安定や責任の明確化を支える面もあるからです。 つまり、同じ現象でも、一方では「効率的で安全な統合環境」として評価され、他方では「退出しにくい構造」として問題視されます。重要なのは、ロックインを善悪だけで捉えるのではなく、なぜそれが生まれ、どのような利益と制約を同時にもたらすのかを整理することです。 ### ベンダーロックインが「安定性」として語られる理由 企業が特定ベンダーに依存するのは、必ずしも判断ミスや惰性だけではありません。むしろ、複雑なシステム運用を考えると、依存には合理性があります。 ### 統合された環境は運用の一貫性を生む クラウドや業務システムが同じベンダーで統一されている場合、設定方法、管理画面、認証方式、サポート窓口などが揃いやすくなります。これにより、現場の運用負荷が下がり、トラブル時の切り分けもしやすくなります。 複数社の製品を組み合わせると柔軟性は高まりますが、その分だけ接続不良や責任分界の曖昧さが増えます。責任分界とは、障害や事故が起きたときに、どこまでを誰が担うのかという範囲のことです。ベンダーが統一されていれば、この境界が比較的わかりやすくなります。 ### サポートとセキュリティの安心感がある 特定ベンダーへの集約は、保守やセキュリティ面でも利点があります。更新方法が統一され、脆弱性対応の流れも整理されやすいため、管理者にとっては運用しやすい環境になります。特にITに詳しい人材が限られる組織では、「自由に選べること」より「安全に回せること」のほうが重要になる場面もあります。 その意味では、ロックインは単なる拘束ではなく、「管理しやすい秩序」として受け入れられているとも言えます。 ### ベンダーロックインが「退出障壁」として語られる理由 一方で、安定性を生む統合構造は、そのまま移行の難しさにもつながります。ここで問題になるのが、退出コストです。 ### データ移行や再設計には大きな負担が生じる 一度あるサービスに業務を深く載せると、保存形式、権限設定、連携先、社内マニュアル、従業員の習熟まで、そのサービスを前提とした構造が積み上がっていきます。別のベンダーへ移ろうとすると、単に契約を切り替えるだけでは済みません。データの変換、システムの再構築、操作教育、業務フローの見直しなど、多方面の調整が必要になります。 ※(図:依存関係と退出コストの関係) ### APIや仕様の違いが依存を強める ここで重要なのがAPIです。APIとは、異なるソフトウェア同士が情報をやり取りするための接続ルールのことです。ベンダー独自のAPIやデータ形式が広く使われると、その環境に最適化したシステムほど他社へ移しにくくなります。 さらに、生成AIやクラウドの分野では、単なる保存先の違いではなく、学習基盤、ワークフロー、開発ツール、課金体系まで一体化しています。そのため、移行の難しさは技術だけでなく、組織運営全体の問題になります。 ### スイッチングコストという考え方 このような乗り換えの負担は、スイッチングコストと呼ばれます。これは金銭的コストだけでなく、時間、教育、混乱、機会損失まで含んだ広い概念です。ロックインが問題になるのは、依存そのものより、このスイッチングコストが高まりすぎて選択の自由が実質的に失われるときです。 ### ロックインは戦略なのか、それとも結果なのか ここで気になるのは、ロックインが意図的に作られたものなのか、それとも便利さを追求した結果なのかという点です。実際には、その両方の側面があります。 ### ビジネスモデルとしての囲い込み IT企業にとって、継続利用されることは収益の安定につながります。そのため、クラウドやAIプラットフォームでは、周辺機能を充実させ、他の製品と組み合わせにくい独自の価値を築く戦略がとられることがあります。これは囲い込みと呼ばれることもありますが、見方を変えれば「自社環境の完成度を高める競争」でもあります。 ### 便利さが結果として依存を深めることもある ただし、すべてが悪意ある囲い込みとは限りません。使いやすく、連携が滑らかで、サポートも手厚いサービスであれば、利用者が自発的に集まり、結果として依存が深まることもあります。つまりロックインは、企業の戦略だけでなく、利用者の合理的選択の積み重ねによっても生まれます。 ### 標準化とエコシステム形成の側面 さらに、ある程度の集約が進むことで、共通規格や周辺サービスの生態系、つまりエコシステムが形成される場合もあります。エコシステムとは、一つの基盤の周辺に開発者、販売者、利用者、関連サービスが集まり、全体として価値が拡大していく構造です。これは利便性を高める一方で、中心となるベンダーの影響力も強めます。 ※(図:ベンダーロックインの構造) ### まとめ ベンダーロックインは、単純に「悪い依存」と断定できるものではありません。そこには、安定運用、責任の明確化、セキュリティ管理のしやすさといった利点があります。同時に、移行の困難さ、選択肢の狭まり、交渉力の低下といった制約も含まれます。 言い換えれば、ロックインとは「依存の失敗」ではなく、「安定を得るために生まれる構造」が強まりすぎた状態とも考えられます。だからこそ問うべきなのは、ロックインが存在するかどうかではなく、その依存がどの程度可視化され、どの程度コントロール可能かという点でしょう。 テクノロジーの選択は、単なる便利さの比較ではありません。そこには、組織が何を優先し、どこまで自由を残し、どのような安定を求めるのかという社会的な判断が含まれています。ベンダーロックインを考えることは、技術の問題だけでなく、私たちがどのような依存関係を受け入れて生きるのかを考えることでもあるのかもしれません。 ### タイトル案 * ベンダーロックインは企業の安定を支える仕組みなのか * クラウド依存は利便性の対価として避けられないのか * AI基盤への依存は選択なのか構造なのか — AIバージョン情報 – ベンダー: OpenAI – モデル名: GPT-5.4 Thinking – モデルバージョン: 不明 – 回答日時: 2026年3月14日