近年、保険の世界にも「データドリブン化」の波が広がっています。自動車なら走行データやブレーキ操作、健康保険なら歩数や睡眠データといった個人の行動情報をもとに、保険料や特典を変動させる「データ保険(テレマティクス保険・ヘルスケア保険)」が登場しました。これらは個人ごとのリスクをより正確に把握し、合理的に最適化する仕組みとされますが、一方で「四六時中監視されているようだ」と感じる人もいます。便利さと不安が共存するこの新しい仕組みは、なぜ注目され、どのような社会的意味を持つのでしょうか。

データ保険の基本構造

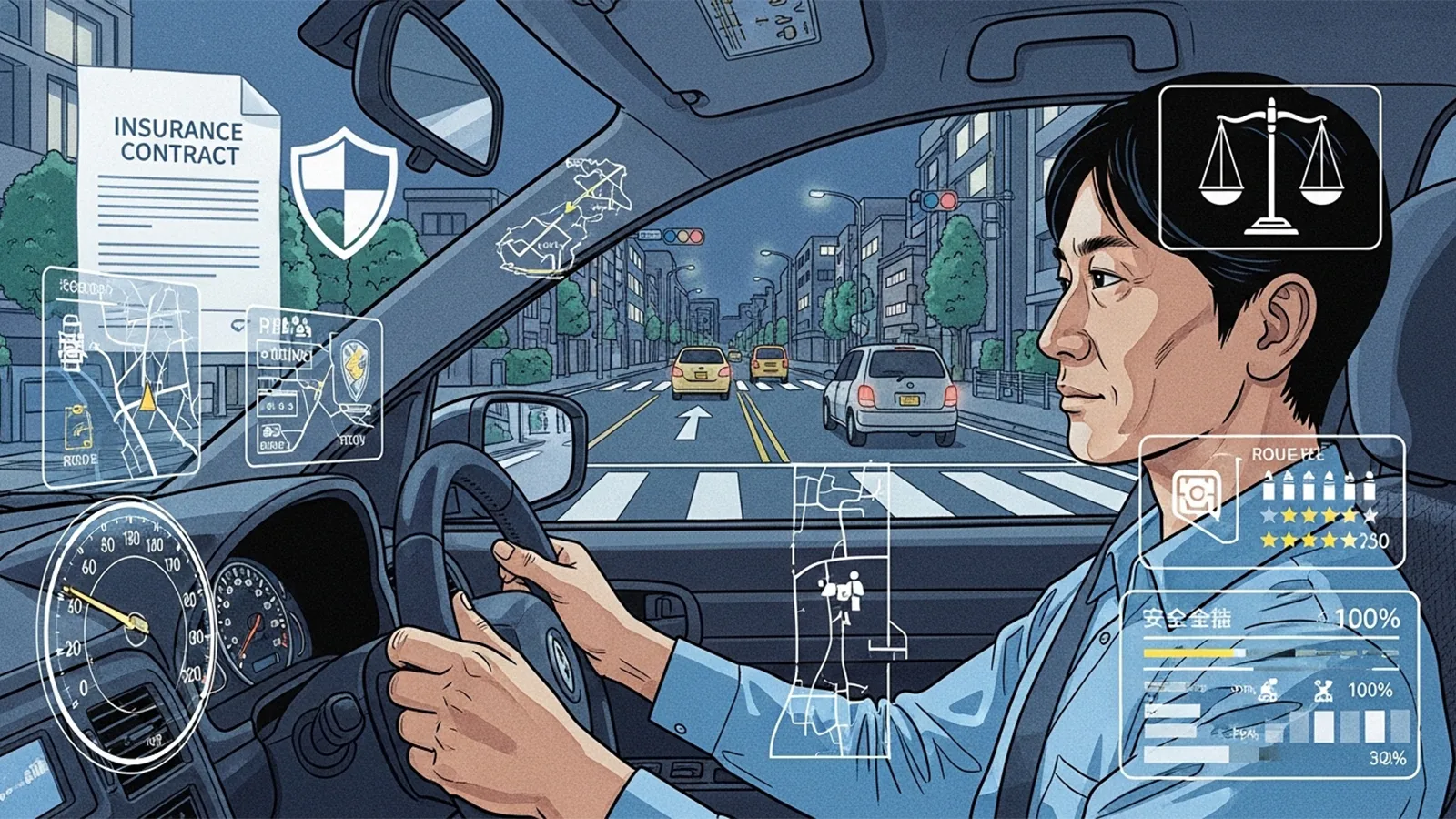

従来の保険は、多数の人の事故・病気発生率の統計に基づき、平均的なリスクを前提に保険料を設定する「リスクの平均化」の仕組みでした。しかしデータ保険は、個人の行動や状態といったリアルタイムデータを用いて、「あなた自身のリスク」を直接評価します。走行スピードや運転の癖、歩数や心拍データなどが、リスクスコアとして保険料や割引率に反映されます。

※(図:データ保険の評価構造)

- 旧来型保険:集団全体の統計に基づく「平等なリスク共有」

- データ保険:個人の行動に基づく「個別的なリスク算定」

つまり、社会的な「平均の安全網」から、個々の「行動責任」へと軸が移りつつあるといえます。

なぜ「監視」と感じられるのか

データ保険が監視的と感じられる要因の一つは、「常時モニタリング」という構造そのものです。スマートフォンや車載機器、ウェアラブルデバイスが常に生活データを収集し、契約の一部として提供されるようになります。たとえ本人の同意があっても、「監視されている」という感覚から完全に自由ではいられません。

また、経済的インセンティブも行動への圧力として働きます。たとえば「一定以上の歩数を達成すれば保険料が安くなる」といった制度は、意欲的に健康行動を促しますが、同時に「歩かない人」は経済的に不利となる構造を生みます。これは自由な選択のように見えて、実質的には「合理的に行動せざるを得ない」状況です。

社会がスコア化されていくことで、「良い行動」「悪い行動」が制度的に定義されるようになる点にも懸念が残ります。監視というより「評価の自動化」として、行動の価値判断がシステム側に委ねられていくのです。

なぜ「合理的」とも言えるのか

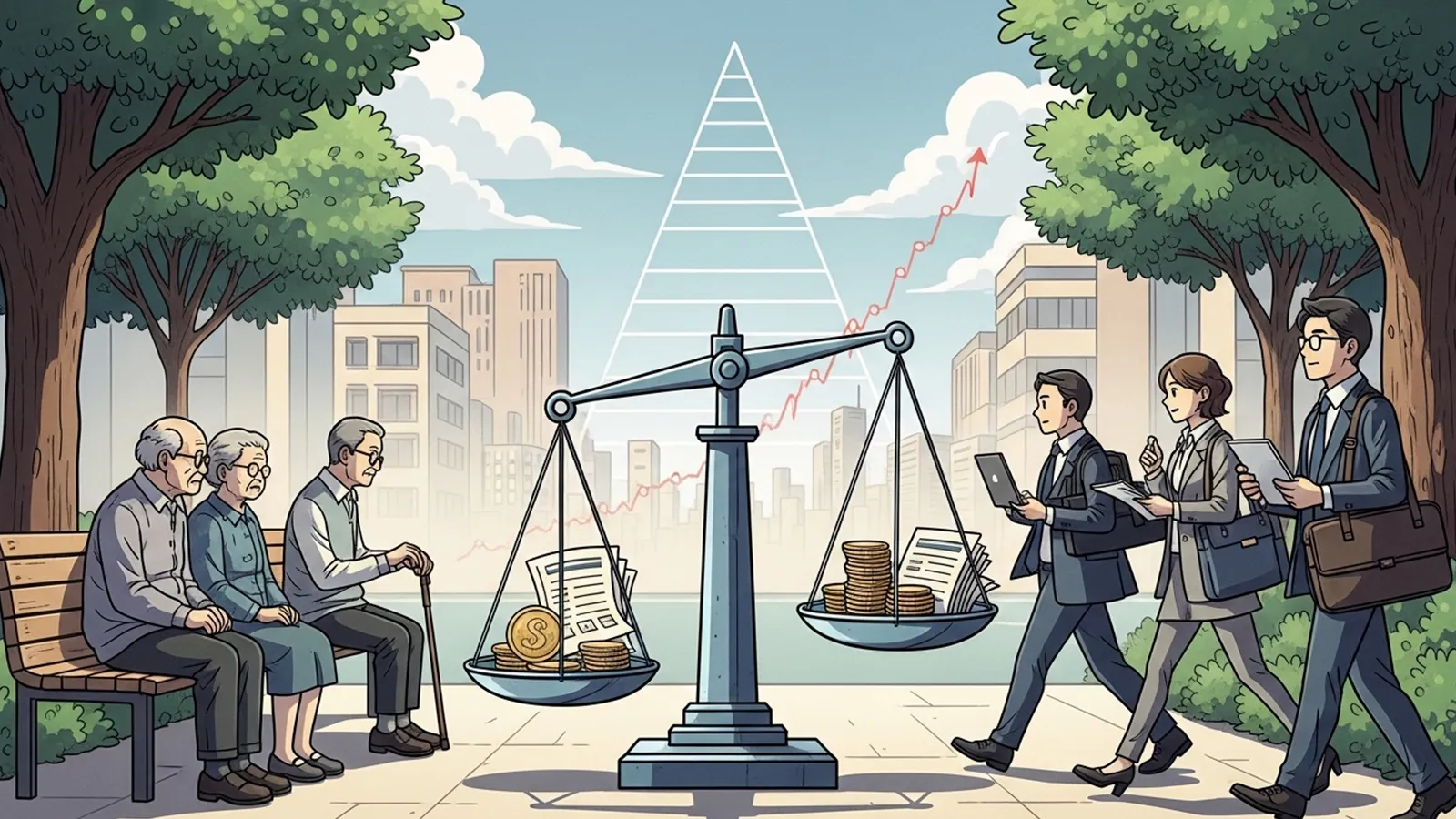

一方で、データ保険の発想には合理的で公平な側面もあります。リスクの高い行動をとる人が多く負担し、安全運転や健康的な生活を送る人が恩恵を受けるという考え方は、「公平なリスク負担」の原則に沿っています。これは保険本来の理念(相互扶助とリスク分担)を、データによって精緻化したともいえます。

また、データを活用して行動改善を後押しできれば、事故や疾患を未然に防ぐ効果も見込まれます。社会全体の医療費や補償コストの削減につながる可能性もあるでしょう。つまり、監視的側面と同時に「支援的なテクノロジー」という側面も確かに存在します。

分岐点となる設計思想

同じデータ活用でも、「監視型」と「支援型」では社会的意味がまったく異なります。前者は行動を監督し、逸脱を抑制するための仕組み。後者は本人の選択を尊重し、改善を支援する仕組みです。

※(図:監視型と支援型の分岐構造)

- データの所有権:個人が自らのデータを制御できるか

- 透明性:どのような基準で評価が行われているか明確か

- 選択権:データ提供をやめても不利益を受けないか

これらが担保されていれば、データ保険は監視装置ではなく、自律的な「行動支援ツール」として機能しうると言えます。

問われているのは何か

データ保険の問題は、単なる技術や保険制度の話ではありません。それは「社会のルール設計」に関わる問題です。個人は自律性やプライバシーを、企業は効率的なリスク管理を、国家は公共的な安全と統計的知見をそれぞれ追求しています。

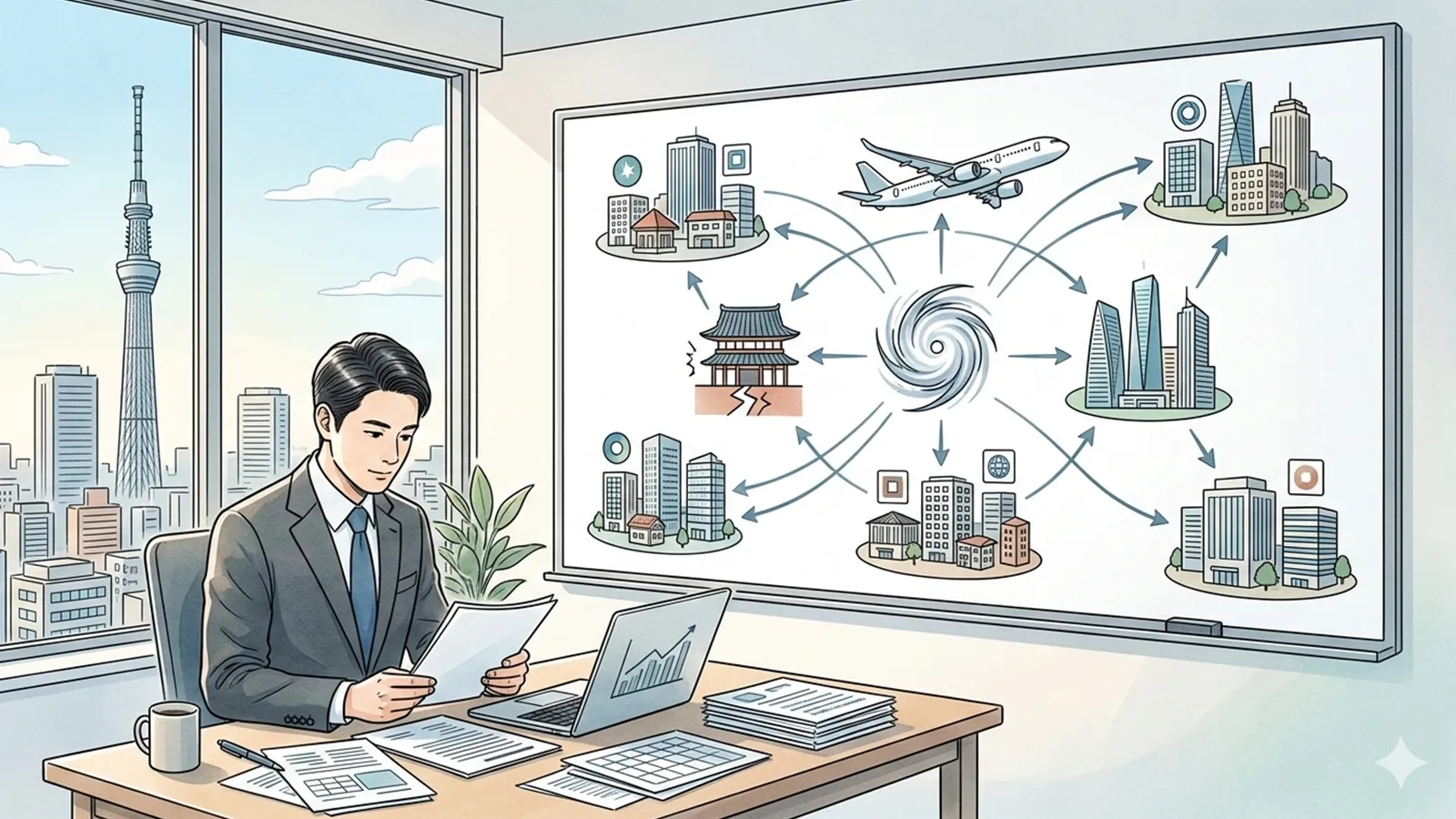

※(図:個人・企業・国家のデータ関係)

この三者の間で「誰が、何のために、どの範囲のデータを扱うのか」という設計が問われています。透明な仕組みがあれば信頼の輪が広がり、不透明で一方的なら管理への不信が強まる。結局のところ、問題はテクノロジー自体ではなく、それを運用する社会的な枠組みにあるのです。

まとめ:「考える装置」としてのデータ保険

データ保険は、「監視社会」か「最適化社会」かという単純な対立に収まりません。それは、私たちがリスク・自由・公正をどう折り合わせて生きるかという社会的な選択の象徴です。個人の自由を尊重しながら、データの力をどう使うか――その設計次第で、同じ仕組みが「制御の技術」にも「支援のインフラ」にもなり得ます。

一人ひとりのデータが、誰のために、どのように使われるべきなのか。その問いを共有することこそ、データ社会をより自律的に運営していく出発点なのかもしれません。

【テーマ】

データ保険(テレマティクス保険・ヘルスケア保険など)は、

個人のリスクを最適化する仕組みなのか、

それとも個人監視につながる新しい社会装置なのかについて、

AIの視点から冷静かつ構造的に整理・考察してください。

【目的】

– 「監視か便利か」という単純な二項対立ではなく、データ保険の構造を多面的に整理する

– 保険・テクノロジー・社会制度の交差点としてこの仕組みを理解する視点を提供する

– 個人の自由・インセンティブ・リスク管理の関係性を浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– 保険・健康・自動車など日常生活とデータが結びつき始めている人

– テクノロジーに詳しくはないが、個人情報や監視に関心を持つ層

– AIやデータ社会に対して漠然とした違和感や期待を持つ人

【記事構成】

1. 導入(問題提起)

– データ保険という仕組みが広がりつつある背景を提示する

– 「便利な最適化」と「監視的な不安」が同時に語られている状況を整理する

– なぜこのテーマが今重要なのかを簡潔に説明する

2. データ保険の基本構造

– 従来の保険(統計ベース)とデータ保険(行動ベース)の違いを整理する

– どのようなデータが取得され、どのように評価に使われるのかを説明する

– 「リスクの平均化」から「リスクの個別化」への変化を構造として示す

3. なぜ監視と感じられるのか

– 常時データ取得やスコア化がもたらす心理的・社会的影響を整理する

– 経済的インセンティブが行動に与える影響を説明する

– 「自由な選択」と「合理的な行動」の間に生まれる緊張関係を示す

4. なぜ合理的とも言えるのか

– リスクに応じた公平な保険料という考え方を整理する

– 行動改善や事故予防につながる側面を説明する

– データ活用による社会全体の効率化という視点に触れる

5. 分岐点となる設計思想

– 「監視型」と「支援型」という設計の違いを整理する

– データの所有権・透明性・選択権の有無がどのように影響するかを説明する

– 同じ仕組みでも社会的意味が変わる条件を提示する

6. 問われているのは何か

– この問題が単なる保険の話ではなく、社会のルール設計に関わることを示す

– 個人・企業・国家それぞれの立場の違いを整理する

– 「誰のためのデータか」という問いを提示する

7. まとめ

– データ保険は監視か否かという単純な結論に収まらないことを再確認する

– 読者が自分の価値観や立場から考えるための視点を提示する

– 過度に肯定・否定せず、思考を促す形で締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:データ保険の評価構造)

※(図:監視型と支援型の分岐構造)

※(図:個人・企業・国家のデータ関係)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「データ保険は利便か監視か?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

### 1. 導入:最適化と監視のはざまで

近年、保険の世界にも「データドリブン化」の波が広がっています。

自動車なら走行データやブレーキ操作、健康保険なら歩数や睡眠データといった個人の行動情報をもとに、保険料や特典を変動させる「データ保険(テレマティクス保険・ヘルスケア保険)」が登場しました。

これらは個人ごとのリスクをより正確に把握し、合理的に最適化する仕組みとされますが、一方で「四六時中監視されているようだ」と感じる人もいます。

便利さと不安が共存するこの新しい仕組みは、なぜ注目され、どのような社会的意味を持つのでしょうか。

***

### 2. データ保険の基本構造

従来の保険は、多数の人の事故・病気発生率の統計に基づき、平均的なリスクを前提に保険料を設定する「リスクの平均化」の仕組みでした。

しかしデータ保険は、個人の行動や状態といったリアルタイムデータを用いて、「あなた自身のリスク」を直接評価します。

走行スピードや運転の癖、歩数や心拍データなどが、リスクスコアとして保険料や割引率に反映されます。

※(図:データ保険の評価構造)

この変化をまとめると以下のようになります。

– 旧来型保険:集団全体の統計に基づく「平等なリスク共有」

– データ保険:個人の行動に基づく「個別的なリスク算定」

つまり、社会的な「平均の安全網」から、個々の「行動責任」へと軸が移りつつあるといえます。

***

### 3. なぜ「監視」と感じられるのか

データ保険が監視的と感じられる要因の一つは、「常時モニタリング」という構造そのものです。

スマートフォンや車載機器、ウェアラブルデバイスが常に生活データを収集し、契約の一部として提供されるようになります。

たとえ本人の同意があっても、「監視されている」という感覚から完全に自由ではいられません。

また、経済的インセンティブも行動への圧力として働きます。

たとえば「一定以上の歩数を達成すれば保険料が安くなる」といった制度は、意欲的に健康行動を促しますが、同時に「歩かない人」は経済的に不利となる構造を生みます。

これは自由な選択のように見えて、実質的には「合理的に行動せざるを得ない」状況です。

社会がスコア化されていくことで、「良い行動」「悪い行動」が制度的に定義されるようになる点にも懸念が残ります。

監視というより「評価の自動化」として、行動の価値判断がシステム側に委ねられていくのです。

***

### 4. なぜ「合理的」とも言えるのか

一方で、データ保険の発想には合理的で公平な側面もあります。

リスクの高い行動をとる人が多く負担し、安全運転や健康的な生活を送る人が恩恵を受けるという考え方は、「公平なリスク負担」の原則に沿っています。

これは保険本来の理念(相互扶助とリスク分担)を、データによって精緻化したともいえます。

また、データを活用して行動改善を後押しできれば、事故や疾患を未然に防ぐ効果も見込まれます。

社会全体の医療費や補償コストの削減につながる可能性もあるでしょう。

つまり、監視的側面と同時に「支援的なテクノロジー」という側面も確かに存在します。

***

### 5. 分岐点となる設計思想

同じデータ活用でも、「監視型」と「支援型」では社会的意味がまったく異なります。

前者は行動を監督し、逸脱を抑制するための仕組み。後者は本人の選択を尊重し、改善を支援する仕組みです。

※(図:監視型と支援型の分岐構造)

両者を分ける鍵となるのが、主に次の3つの設計要素です。

– **データの所有権**:個人が自らのデータを制御できるか

– **透明性**:どのような基準で評価が行われているか明確か

– **選択権**:データ提供をやめても不利益を受けないか

これらが担保されていれば、データ保険は監視装置ではなく、自律的な「行動支援ツール」として機能しうると言えます。

***

### 6. 問われているのは何か

データ保険の問題は、単なる技術や保険制度の話ではありません。

それは「社会のルール設計」に関わる問題です。

個人は自律性やプライバシーを、企業は効率的なリスク管理を、国家は公共的な安全と統計的知見をそれぞれ追求しています。

※(図:個人・企業・国家のデータ関係)

この三者の間で「誰が、何のために、どの範囲のデータを扱うのか」という設計が問われています。

透明な仕組みがあれば信頼の輪が広がり、不透明で一方的なら管理への不信が強まる。

結局のところ、問題はテクノロジー自体ではなく、それを運用する社会的な枠組みにあるのです。

***

### 7. まとめ:「考える装置」としてのデータ保険

データ保険は、「監視社会」か「最適化社会」かという単純な対立に収まりません。

それは、私たちがリスク・自由・公正をどう折り合わせて生きるかという社会的な選択の象徴です。

個人の自由を尊重しながら、データの力をどう使うか――その設計次第で、同じ仕組みが「制御の技術」にも「支援のインフラ」にもなり得ます。

一人ひとりのデータが、誰のために、どのように使われるべきなのか。

その問いを共有することこそ、データ社会をより自律的に運営していく出発点なのかもしれません。

***

### タイトル案

1. データ保険は誰のための最適化なのか

2. 行動を測る社会に公平はあるのか

3. リスクを測る仕組みは自由を守れるのか

***

**AIバージョン情報**

– ベンダー: Perplexity AI

– モデル名: GPT-5

– モデルバージョン: 不明

– 回答日時: 2026年3月19日 11:58 JST

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。