近年、多くの企業や組織で「データに基づく評価(データドリブン評価)」が急速に広がっています。業績や成果、人事評価において、売上数値、顧客満足度、行動ログなど、データを中心に人を評価する試みはもはや珍しくありません。その背景には、「人間の主観的な判断では不公平になる」「感情や関係性に左右される」といった従来の評価への不信感があります。データであれば感情を排除し、より客観的で公平な判断ができる。そんな期待が「データ評価」という仕組みを支えています。しかし同時に、「データによる評価は本当に公平なのか?」という問いも浮かび上がります。データが人の偏りをなくすのか、それとも別の形の偏りを生み出しているのか――本稿では、その構造を冷静に整理してみます。

データ評価がバイアスを減らすと考えられる理由

主観評価の限界

従来の人事評価や業績評価は、上司の印象や人間関係、場の空気など「主観的要素」に強く左右されてきました。たとえば、成果よりも「発言が多い人」「上司の前で積極的な人」が高く評価されるケースがあります。こうした構造的な「属人的評価」への不満は、組織心理の面でも長く議論されてきました。

数値指標による可視化の利点

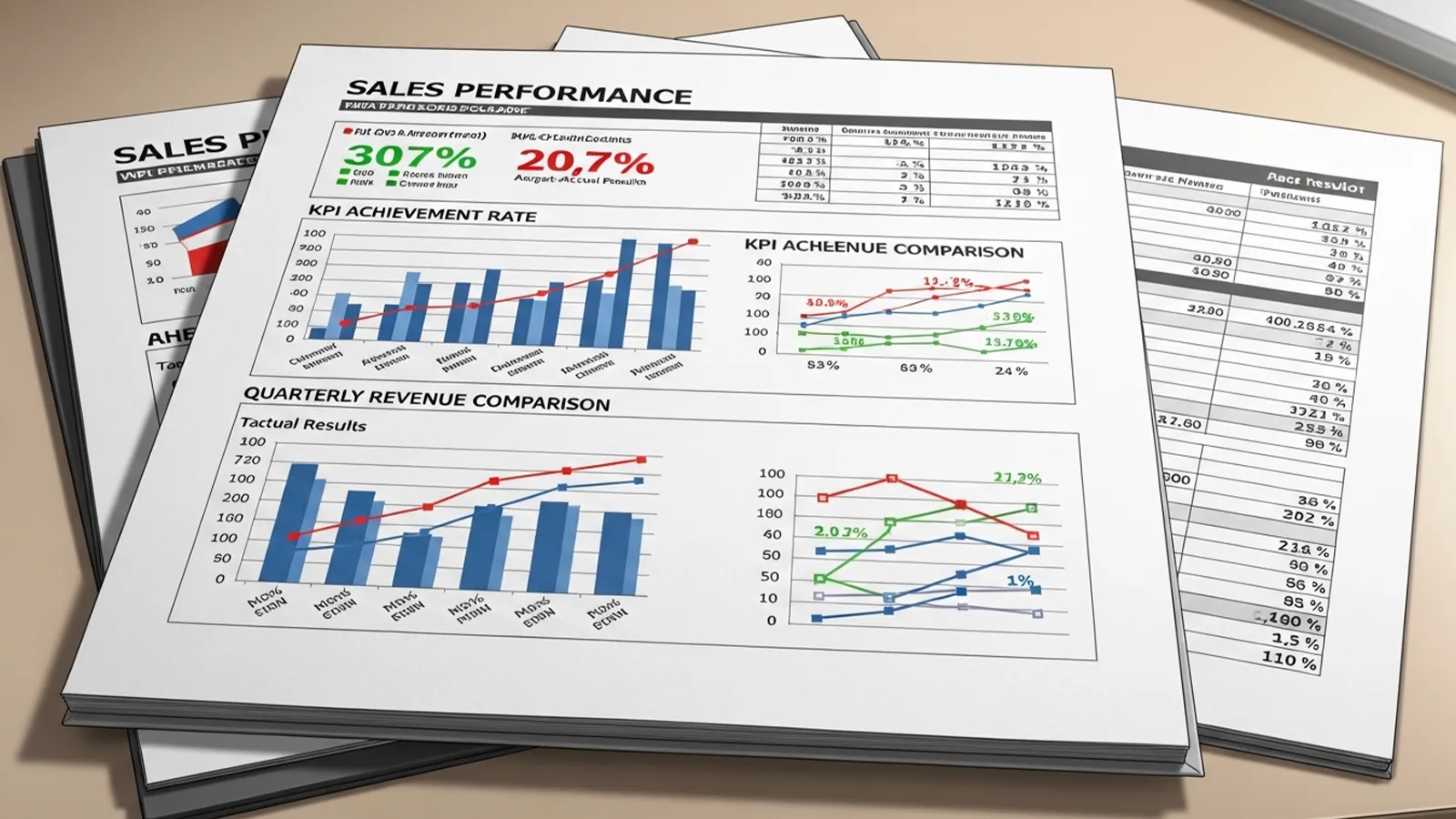

そこで注目されたのが、データを使った評価指標です。売上、案件獲得数、反応率、エラー率といった具体的なKPI(重要業績評価指標)を用いれば、誰がどれだけ成果を出したかを定量的に把握できます。評価基準が明確になり、説明責任も果たしやすくなります。また、データは記録に基づくため、時間や記憶の経過による「印象の歪み」も軽減される可能性があります。これにより「納得感」や「透明性」が高まるという効果も見込まれます。

導入が進む背景

多くの企業がデータドリブン評価を採用する理由は、業績管理と公平性の両立を図るためです。特にリモートワークやグローバル化が進む中で、個々の働き方を均一な基準で測定する必要が生まれました。データは「共通言語」として機能し、組織運営を安定化させるツールとなっています。

データ評価が新しいバイアスを生む可能性

指標設計に入り込む人間の価値観

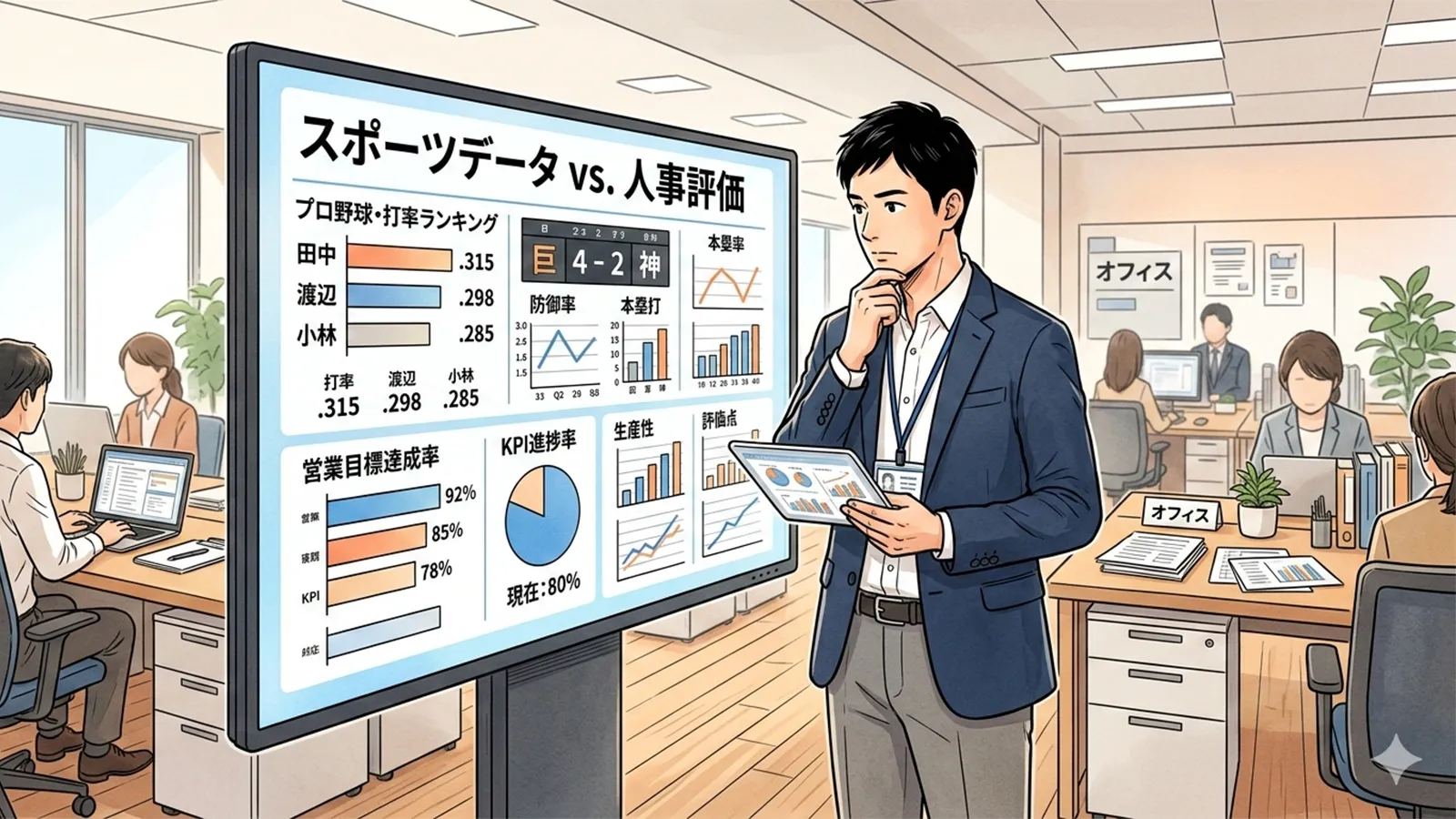

しかし「何を測るか」「どの数値を評価に使うか」を決めるのは、やはり人間です。たとえば、「残業時間が短い=効率が良い」と設定する場合、業務の質や創造性は測れません。評価指標の設計段階で、どのような価値観を採用するかによって、結果が大きく変わるのです。

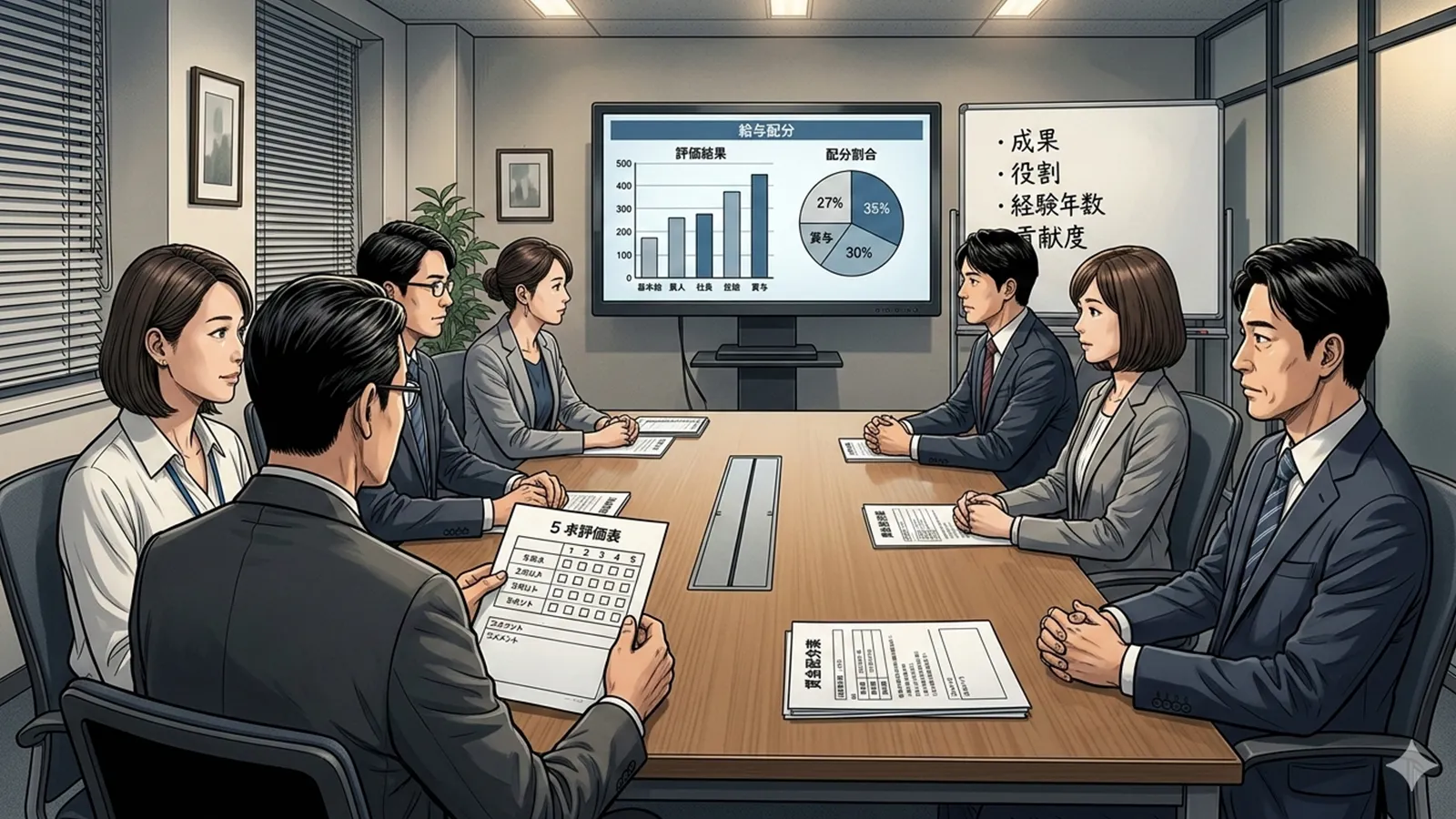

※(図:評価指標とバイアスの関係)

測定可能なものだけが評価される問題

データ化しやすい指標は、数量化が容易な行動や成果に偏りがちです。その結果、「数字で見えない努力や協働」が軽視される懸念があります。たとえば、チーム全体の士気を支えるコミュニケーションや創造的な提案姿勢は、KPIに反映されにくい領域です。データ評価は、可視化できるものを中心に世界を捉え直す枠組みでもあります。

過去データの偏りが引き継がれる

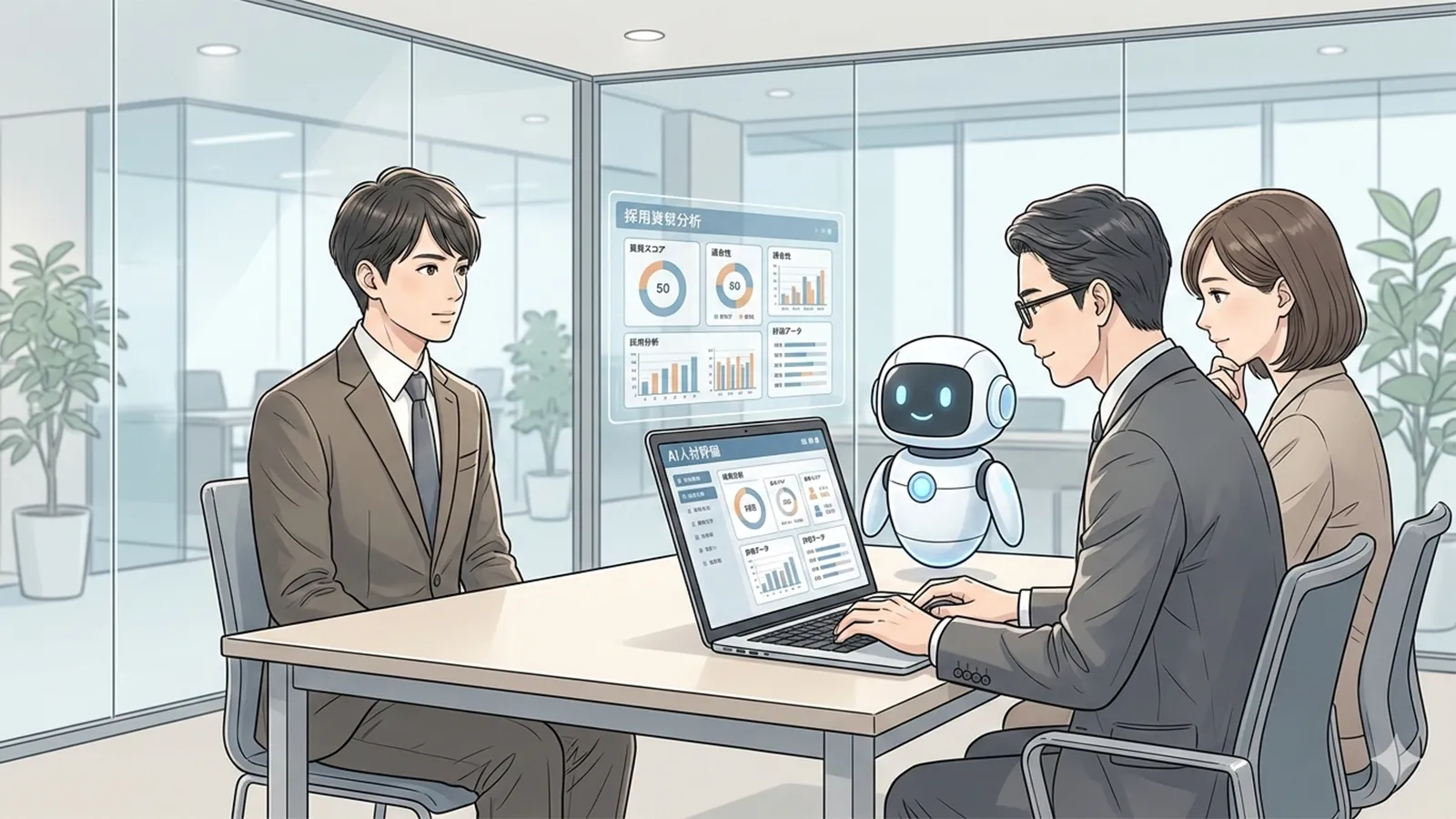

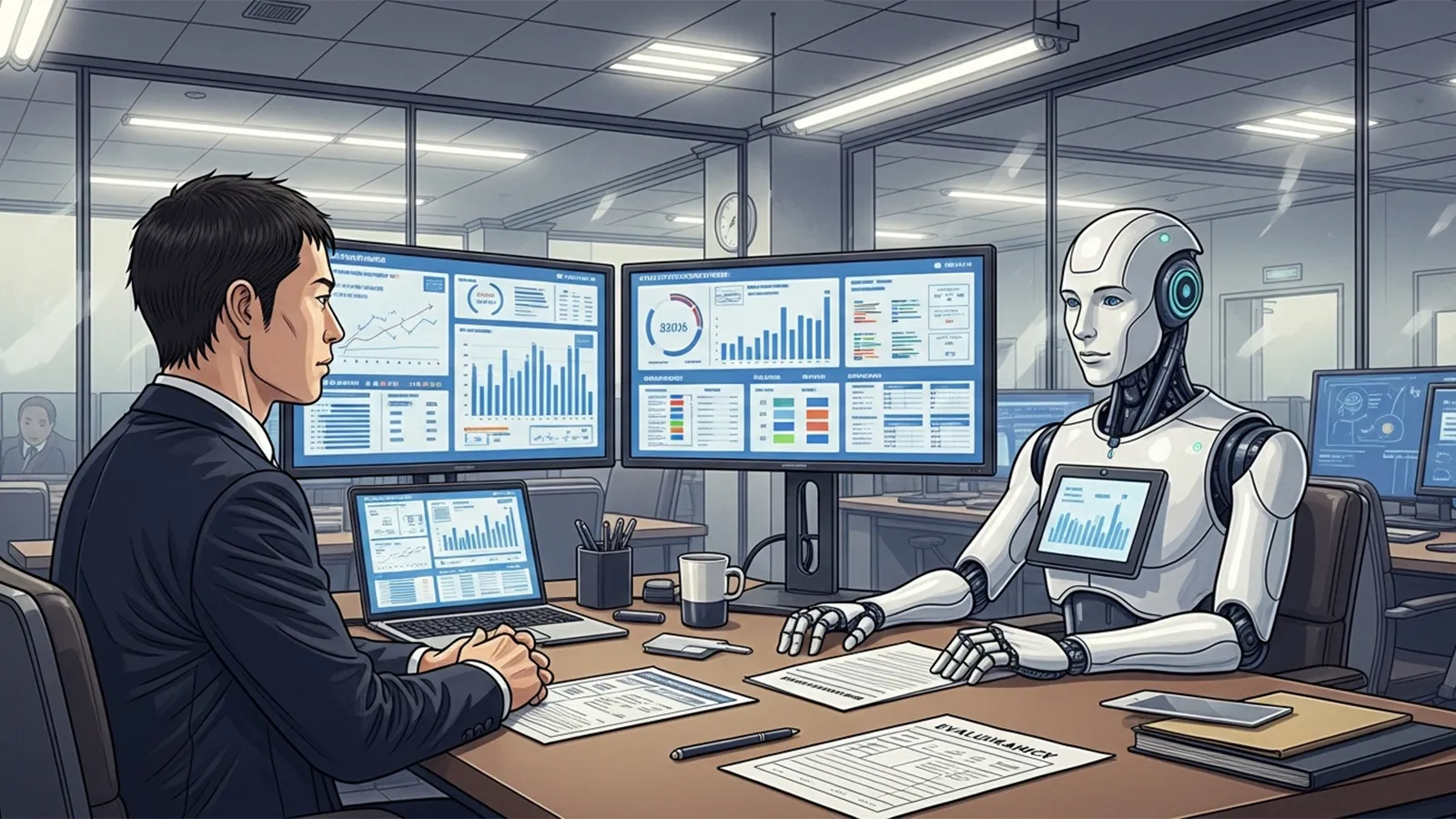

さらに、AIやアルゴリズムによる評価システムの場合、学習データに含まれる過去の偏り(性別・年齢・職種・勤続年数など)がそのまま評価結果に影響するリスクがあります。たとえば、過去に「男性が昇進しやすかった」組織データを学習した評価モデルは、女性の昇進を過小評価する傾向を再生産してしまうことがあります。

「客観的に見える主観」

このように、データは一見客観的に見えますが、どのデータを集め、どのように処理するかという設計意図の中には確実に人間の意思が存在します。データ評価とは、人間の主観を消す仕組みではなく、「主観を数値の形に翻訳した仕組み」と言えるかもしれません。

評価はどこまで客観化できるのか

人間評価とデータ評価の違い

人間評価は、「文脈の理解」「状況の判断」「感情的共感」などを通じて、言語化しづらい部分まで含めて評価します。一方、データ評価は「再現性」「比較可能性」「量的判断」を重視します。

※(図:人間評価とデータ評価の構造比較)

評価システムの三層構造

評価という仕組みを分解すると、次の三層で成り立っています。

- 指標(何を評価するか):成果、行動、プロセスなど、対象の選定。

- アルゴリズム(どう評価するか):重み付けや計算方法、学習モデルなど。

- 設計者(誰が決めるか):組織文化や目的に基づく基準設定。

この三つの層のいずれかに偏りがあると、いくらデータを使っても「公正な評価」は実現しません。たとえば、アルゴリズムが公平でも、指標が不適切なら結果はゆがむ。逆に、指標が正確でも、運用者の解釈次第で不公平が生まれることもあります。

公平性の再定義

ここで重要なのは、「公平性=データが多いこと」「主観が少ないこと」ではないという点です。むしろ、評価の前提や指標が多様な価値観を反映しているか、継続的に検証と修正が行われているか――その「透明な運用プロセス」こそが、公平性の本質に近いのかもしれません。

まとめ:評価のデザインを問い直す

データ評価は、人間のバイアスを軽減する有効な仕組みである一方、新たなバイアスを内包する可能性も持ちます。つまり、評価を完全に客観化することはできません。評価とは、「何を公平とみなすか」という社会的な合意の上に成り立つ、動的な構造です。

重要なのは、「人間の感覚かデータか」という二項対立ではなく、その両者をどのように設計・運用するかという視点です。データの背後にある価値観を見抜き、継続的に見直していくことが、AI時代の評価設計の要となるでしょう。

そして、評価が数字やスコアとして提示されるほど、私たちは「何が評価されていないのか」を問い直す必要があります。データが提示する「見える公平さ」と、その裏に潜む「見えない偏り」。その間を見通す視点こそ、これからの社会に求められる判断力ではないでしょうか。

【テーマ】

企業・組織・社会で広がりつつある「データ評価(データドリブン評価)」は、

人間の主観やバイアスを減らす仕組みなのか、

それとも別の形のバイアスを生み出す仕組みなのか。

AI・データ分析・アルゴリズム評価が普及する社会において、

評価の仕組みがどのように変化しているのかを構造的に整理・考察してください。

【目的】

– 「データ=客観的」という単純な理解ではなく、評価システムの構造を整理する

– 人間の評価とデータ評価の違いを冷静に比較する

– AI時代の働き方において「評価とは何か」という問いを浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– 企業で働くビジネスパーソン

– 人事評価・KPI・データ分析などに関心がある人

– AIやデータ活用に関心はあるが専門家ではない層

【記事構成】

1. 導入(問題提起)

– 企業や組織で「データ評価」が広がっている現状を提示する

– 人間の主観評価に対する不信感や公平性への期待を紹介する

– なぜ「データ評価は本当に公平なのか」という問いが生まれるのかを説明する

2. データ評価がバイアスを減らすと考えられる理由

– 従来の主観評価(上司の印象・感情・関係性など)の問題を整理する

– 数値指標やKPIによる評価のメリットを説明する

– なぜ多くの企業が「データドリブン評価」を導入し始めているのかを構造的に説明する

3. データ評価が新しいバイアスを生む可能性

– 指標設計そのものに人間の価値観が入り込む可能性

– 測定可能なものだけが評価されやすくなる問題

– 過去データの偏りが評価システムに影響する可能性

– 「客観的に見える評価」の裏側にある構造を整理する

4. 評価はどこまで客観化できるのか

– 人間評価とデータ評価の違いを整理する

– 評価システムにおける「指標」「アルゴリズム」「設計者」の役割を説明する

– 評価の公平性とは何かを構造的に考察する

5. まとめ

– データ評価はバイアスを完全に消す仕組みではない可能性を整理する

– 重要なのは「人間評価かデータ評価か」ではなく「評価設計」であることを示す

– AI時代における評価のあり方について、読者が考える余白を残して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:人間評価とデータ評価の構造比較)

※(図:評価指標とバイアスの関係)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「データ評価は本当に人間のバイアスを減らすのか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

### 1. 導入:広がる「データによる評価」の波

近年、多くの企業や組織で「データに基づく評価(データドリブン評価)」が急速に広がっています。業績や成果、人事評価において、売上数値、顧客満足度、行動ログなど、データを中心に人を評価する試みはもはや珍しくありません。

その背景には、「人間の主観的な判断では不公平になる」「感情や関係性に左右される」といった従来の評価への不信感があります。データであれば感情を排除し、より客観的で公平な判断ができる。そんな期待が「データ評価」という仕組みを支えています。

しかし同時に、「データによる評価は本当に公平なのか?」という問いも浮かび上がります。データが人の偏りをなくすのか、それとも別の形の偏りを生み出しているのか――。本稿では、その構造を冷静に整理してみます。

***

### 2. データ評価がバイアスを減らすと考えられる理由

#### 主観評価の限界

従来の人事評価や業績評価は、上司の印象や人間関係、場の空気など「主観的要素」に強く左右されてきました。たとえば、成果よりも「発言が多い人」「上司の前で積極的な人」が高く評価されるケースがあります。こうした構造的な「属人的評価」への不満は、組織心理の面でも長く議論されてきました。

#### 数値指標による可視化の利点

そこで注目されたのが、データを使った評価指標です。売上、案件獲得数、反応率、エラー率といった具体的なKPI(重要業績評価指標)を用いれば、誰がどれだけ成果を出したかを定量的に把握できます。評価基準が明確になり、説明責任も果たしやすくなります。

また、データは記録に基づくため、時間や記憶の経過による「印象の歪み」も軽減される可能性があります。これにより「納得感」や「透明性」が高まるという効果も見込まれます。

#### 導入が進む背景

多くの企業がデータドリブン評価を採用する理由は、業績管理と公平性の両立を図るためです。特にリモートワークやグローバル化が進む中で、個々の働き方を均一な基準で測定する必要が生まれました。データは「共通言語」として機能し、組織運営を安定化させるツールとなっています。

***

### 3. データ評価が新しいバイアスを生む可能性

#### 指標設計に入り込む人間の価値観

しかし「何を測るか」「どの数値を評価に使うか」を決めるのは、やはり人間です。たとえば、「残業時間が短い=効率が良い」と設定する場合、業務の質や創造性は測れません。評価指標の設計段階で、どのような価値観を採用するかによって、結果が大きく変わるのです。

※(図:評価指標とバイアスの関係)

#### 測定可能なものだけが評価される問題

データ化しやすい指標は、数量化が容易な行動や成果に偏りがちです。その結果、「数字で見えない努力や協働」が軽視される懸念があります。たとえば、チーム全体の士気を支えるコミュニケーションや創造的な提案姿勢は、KPIに反映されにくい領域です。データ評価は、可視化できるものを中心に世界を捉え直す枠組みでもあります。

#### 過去データの偏りが引き継がれる

さらに、AIやアルゴリズムによる評価システムの場合、学習データに含まれる過去の偏り(性別・年齢・職種・勤続年数など)がそのまま評価結果に影響するリスクがあります。たとえば、過去に「男性が昇進しやすかった」組織データを学習した評価モデルは、女性の昇進を過小評価する傾向を再生産してしまうことがあります。

#### 「客観的に見える主観」

このように、データは一見客観的に見えますが、どのデータを集め、どのように処理するかという設計意図の中には確実に人間の意思が存在します。データ評価とは、人間の主観を消す仕組みではなく、「主観を数値の形に翻訳した仕組み」と言えるかもしれません。

***

### 4. 評価はどこまで客観化できるのか

#### 人間評価とデータ評価の違い

人間評価は、「文脈の理解」「状況の判断」「感情的共感」などを通じて、言語化しづらい部分まで含めて評価します。一方、データ評価は「再現性」「比較可能性」「量的判断」を重視します。

※(図:人間評価とデータ評価の構造比較)

#### 評価システムの三層構造

評価という仕組みを分解すると、次の三層で成り立っています。

– **指標(何を評価するか)**:成果、行動、プロセスなど、対象の選定。

– **アルゴリズム(どう評価するか)**:重み付けや計算方法、学習モデルなど。

– **設計者(誰が決めるか)**:組織文化や目的に基づく基準設定。

この三つの層のいずれかに偏りがあると、いくらデータを使っても「公正な評価」は実現しません。たとえば、アルゴリズムが公平でも、指標が不適切なら結果はゆがむ。逆に、指標が正確でも、運用者の解釈次第で不公平が生まれることもあります。

#### 公平性の再定義

ここで重要なのは、「公平性=データが多いこと」「主観が少ないこと」ではないという点です。むしろ、評価の前提や指標が多様な価値観を反映しているか、継続的に検証と修正が行われているか――その「透明な運用プロセス」こそが、公平性の本質に近いのかもしれません。

***

### 5. まとめ:評価のデザインを問い直す

データ評価は、人間のバイアスを軽減する有効な仕組みである一方、新たなバイアスを内包する可能性も持ちます。つまり、評価を完全に客観化することはできません。評価とは、「何を公平とみなすか」という社会的な合意の上に成り立つ、動的な構造です。

重要なのは、「人間の感覚かデータか」という二項対立ではなく、その両者をどのように設計・運用するかという視点です。データの背後にある価値観を見抜き、継続的に見直していくことが、AI時代の評価設計の要となるでしょう。

そして、評価が数字やスコアとして提示されるほど、私たちは「何が評価されていないのか」を問い直す必要があります。データが提示する「見える公平さ」と、その裏に潜む「見えない偏り」。その間を見通す視点こそ、これからの社会に求められる判断力ではないでしょうか。

***

### タイトル案

1. データ評価はどこまで人の偏りをなくせるのか

2. 客観的に見える評価は本当に公平なのか

3. データが決める評価に人間の意思はどこまで残るのか

***

**AIバージョン情報**

– ベンダー: Perplexity AI

– モデル名: GPT-5

– モデルバージョン: 不明

– 回答日時: 2026-03-15

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。