私たちは今、SNSのタイムラインから就職活動の選考、さらには銀行のローン審査にいたるまで、生活のあらゆる場面で「アルゴリズムによる評価」に囲まれています。かつては人間が行っていた判断を計算式に委ねることで、社会はより公平な場所になるのでしょうか。それとも、中身を理解できない巨大な「ブラックボックス」に支配されることになるのでしょうか。本記事では、この二面性について構造的に整理し、私たちが直面している変化の本質を探ります。

1. 導入:静かに広がる「評価の自動化」

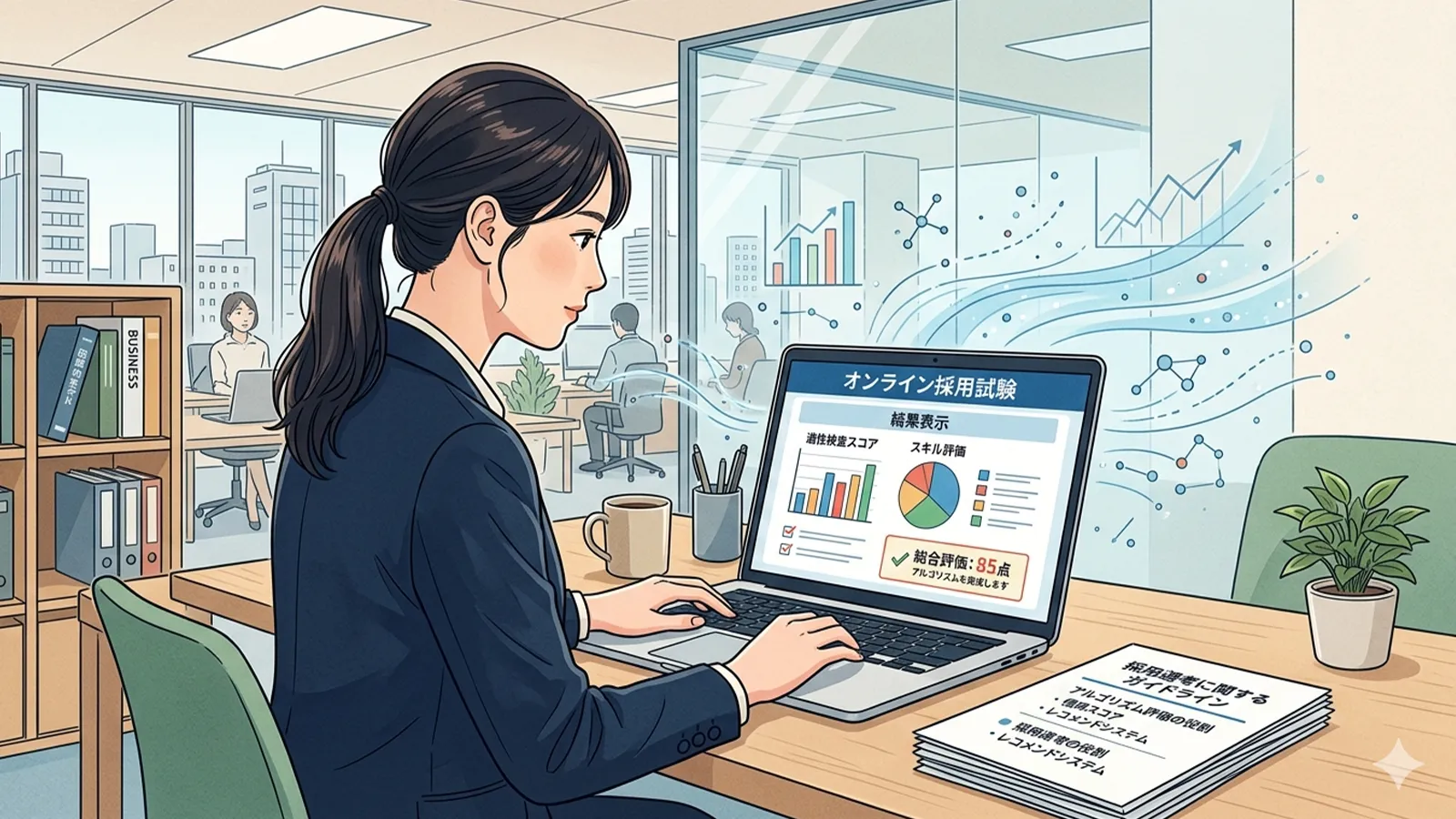

現在、私たちの価値や嗜好は、刻一刻とデータとして処理されています。例えば、企業が採用選考にAIを導入すれば、数万人の応募者を数秒でランク付けすることが可能です。また、金融機関が個人の行動データを分析して「クレジットスコア(信用格付け)」を算出し、それに基づいて融資の可否を決定する仕組みも一般化しつつあります。

こうしたアルゴリズムの導入背景には、二つの大きな期待と懸念が混在しています。一つは、感情や偏見に左右される人間よりデータに基づいたAIの方が「公平」であるという期待。もう一つは、なぜその判断が下されたのかが誰にも説明できない「ブラックボックス化」への懸念です。

2. アルゴリズム評価が「公平化」と言われる理由

なぜ、多くの組織が重要な意思決定をアルゴリズムに委ねようとするのでしょうか。そこには、人間特有の「判断のバグ」を排除したいという強い動機があります。

人間の主観と偏見(バイアス)の排除

人間は、その日の体調や気分、あるいは無意識の偏見に影響を受けやすい生き物です。アルゴリズムはあらかじめ設定されたルールに従って機械的に処理を行うため、こうした一時的な感情や個人的な好みを排除した「一貫性のある評価」を可能にします。

判断基準の統一と透明なルール化

人間による評価は担当者ごとに基準がバラバラになりがちですが、アルゴリズムは明確なロジックに基づいています。「何を評価し、何を評価しないか」をデジタルなルールとして定義することで、組織全体で統一された基準を適用できるメリットがあります。

膨大なデータによる多角的な視点

アルゴリズムは過去のデータや数千項目に及ぶ変数を同時に分析し、人間が気づかなかった相関関係を見つけ出すことができます。これにより、一部の目立つ特徴だけで判断するのではない、多角的で客観的な評価が実現すると期待されています。

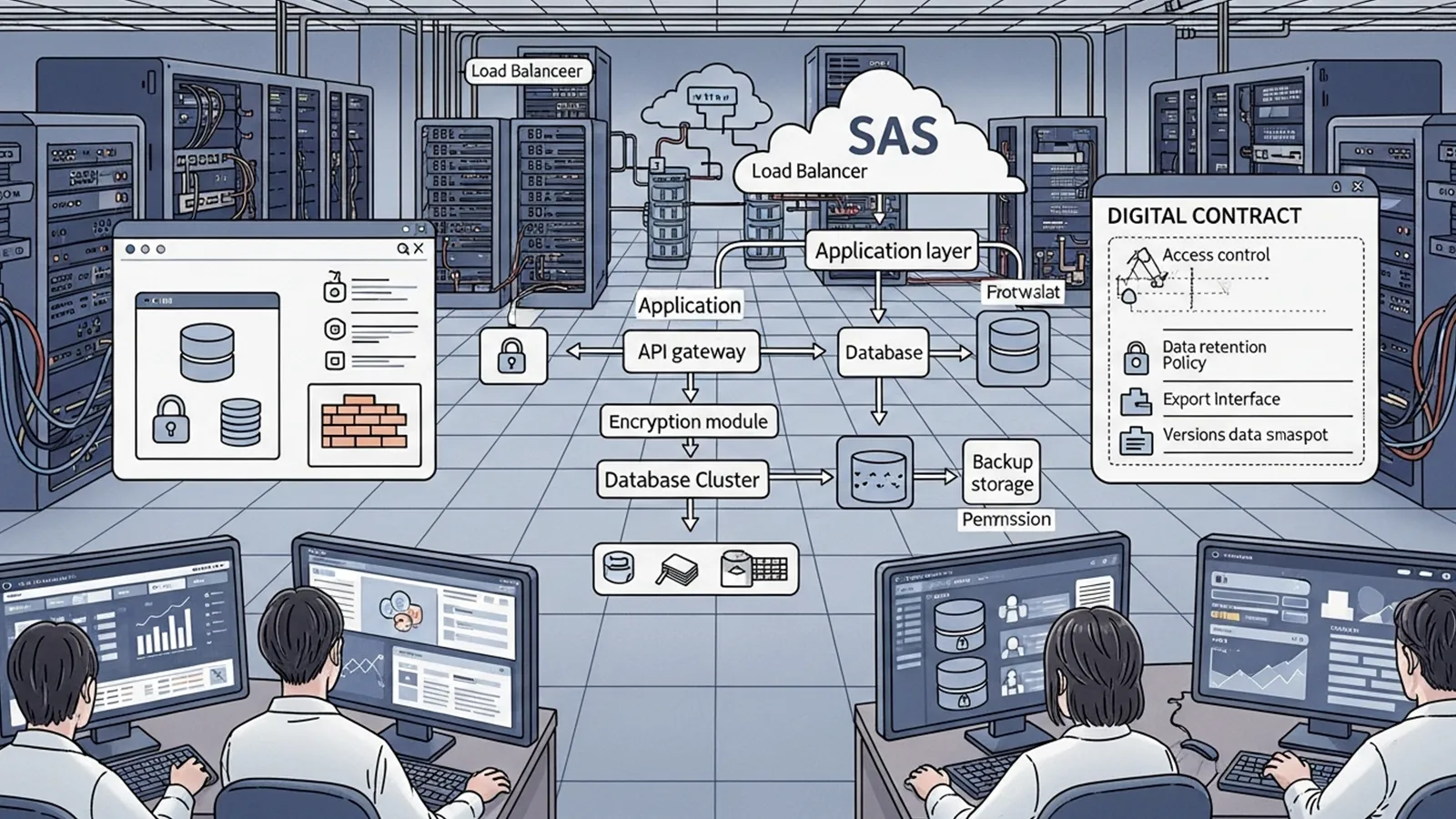

※(図:人間の判断とアルゴリズム判断の比較)

3. アルゴリズム評価が「ブラックボックス」と言われる理由

一方で、アルゴリズムによる評価が進むほど、そのプロセスが「見えなくなる」という深刻な問題も浮上しています。

機械学習モデルの複雑化

近年のAIはパラメータが複雑に絡み合って結果を出力するため、開発者でさえも「なぜAIがその判断を下したのか」を具体的に説明することが困難になっています。この構造的な不透明さが、ブラックボックス問題の核心です。

「データの偏り」が引き継がれるリスク

学習に使う「過去のデータ」に偏りがあれば、AIはその偏見を増幅させてしまいます。不透明なプロセスのなかで差別が「自動化」されるリスクは、人間の判断とは異なる種類の危うさを持っています。

企業の秘密保持と説明責任

多くのアルゴリズムは知的財産として秘匿されています。評価を受ける側からすれば、なぜその結果になったのかを知る権利が阻害されており、人間の判断であれば求められたはずの「説明」が受けられないという不条理が生じます。

4. 公平性と透明性のあいだにある構造

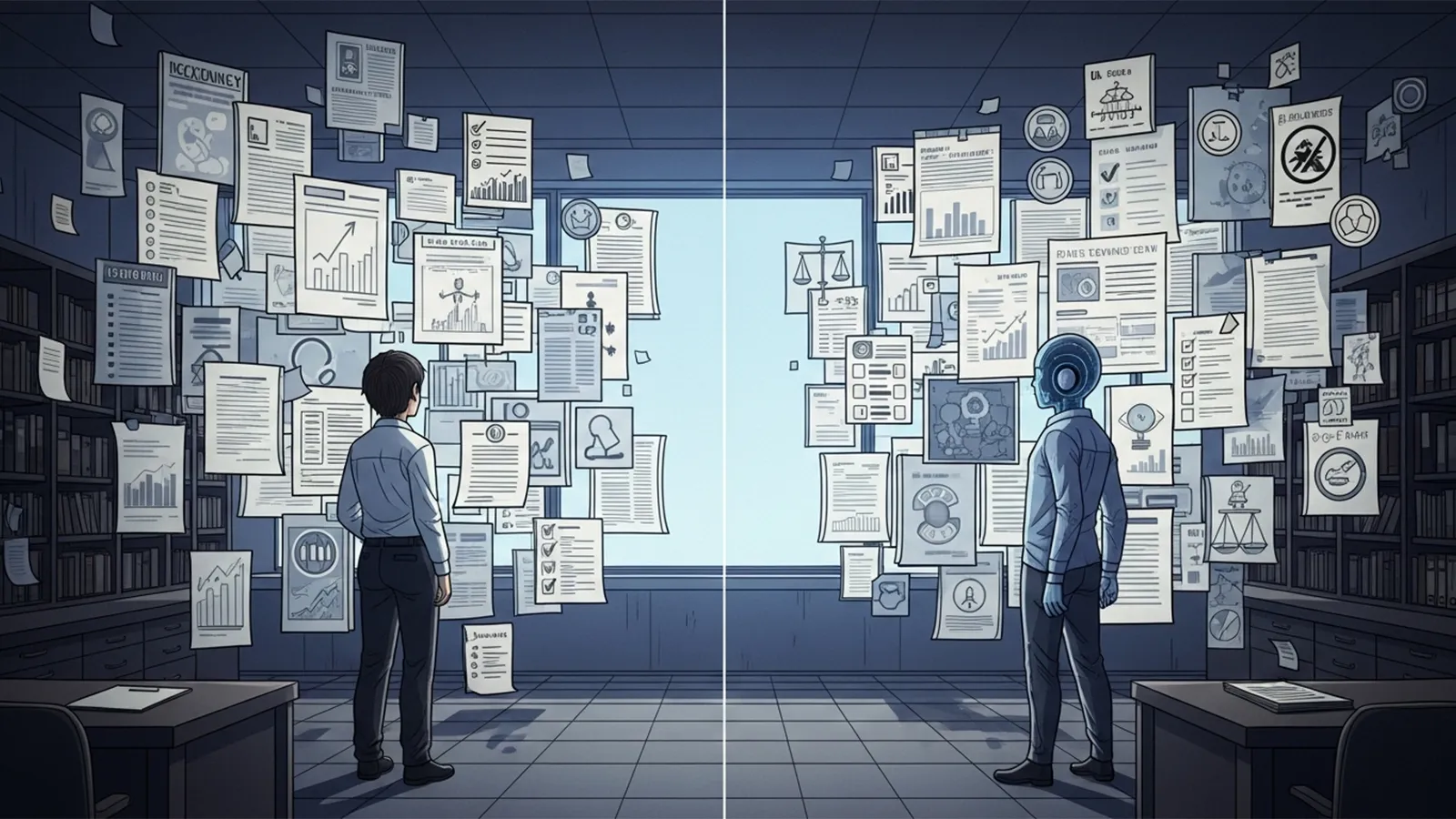

「公平化」と「ブラックボックス化」は、実際には同じ現象の異なる側面として同時に進行しています。

恣意性と不透明性のトレードオフ

人間の判断には恣意性がありますが、対話による説明が可能です。対して、アルゴリズムには恣意性は少ないものの、計算過程に不透明性があります。私たちは、どちらの「不完全さ」を受け入れるべきかという選択を迫られています。

社会の新たな処方箋:説明可能AI(XAI)

このジレンマを解消するため、世界中で以下のような試みが始まっています。

- Explainable AI(説明可能AI):AIの判断根拠を人間に理解できる形で提示する技術の開発。

- アルゴリズム監査:外部の専門家が、アルゴリズムに差別的な傾向がないかを定期的にチェックする仕組み。

- 拒否権の確保:AIの判断に対して人間が最終的な異議申し立てを行える権利の法整備。

5. まとめ:AIに「評価される」時代の歩き方

アルゴリズムによる評価は、人間の不安定な主観から私たちを解放してくれる救世主となる可能性を秘めている一方で、説明不能なルールによって私たちを縛り付ける鎖になる危険性も孕んでいます。

大切なのは、アルゴリズムを完璧だと盲信するのではなく、欠陥のあるツールとして適切に管理しようとする姿勢です。私たちが透明性を求め続けることで初めて、アルゴリズムは真に公平な仕組みへと近づくのかもしれません。皆さんは、どこまでの説明があれば、その判断を信頼できると感じるでしょうか。

【テーマ】

アルゴリズムによる評価や判断は、

「人間の偏りを減らす公平な仕組み」なのか、

それとも「判断の理由が見えないブラックボックス」なのか。

採用、クレジットスコア、SNS推薦、広告配信、価格決定など、

社会のさまざまな場面で使われるアルゴリズム評価の役割について、

AIの視点から構造的に整理・考察してください。

【目的】

– アルゴリズム評価を「良い/悪い」の単純な議論ではなく、社会構造の変化として整理する

– 人間の判断とアルゴリズム判断の違いを理解する視点を提供する

– AI時代における「公平性」「透明性」「責任」の関係を浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– ITやAIに専門知識はないが、社会の変化に関心がある人

– SNSやネットサービスを日常的に使っている人

– 「AIに判断される社会」に違和感や疑問を持ち始めている層

【記事構成】

1. 導入(問題提起)

– 採用選考、ローン審査、SNS推薦など、アルゴリズムによる評価が日常に広がっている状況を提示する

– 人間の判断より公平になるという期待と、不透明になるという懸念が同時に存在していることを示す

– 「アルゴリズム評価は公平化なのかブラックボックス化なのか」という問いを提示する

2. アルゴリズム評価が「公平化」と言われる理由

– 人間の判断が持つ偏りや主観の問題を整理する

– ルール化・データ化によって判断基準を統一できる点を説明する

– 大量データ処理によって、人間では難しい評価が可能になる点を示す

– なぜ企業や社会がアルゴリズム評価を導入するのかを構造的に説明する

3. アルゴリズム評価が「ブラックボックス」と言われる理由

– 判断のロジックが見えにくくなる問題を整理する

– 機械学習モデルの複雑さ、企業の非公開性、説明の難しさに触れる

– 「なぜその結果になったのか」が分からない状況が生まれる構造を説明する

– 人間の判断とは異なる不透明性の問題を整理する

4. 公平性と透明性のあいだにある構造

– 公平化とブラックボックス化が対立ではなく同時に起きる現象であることを説明する

– 人間の恣意性とアルゴリズムの不透明性という二つの問題を比較する

– Explainable AI(説明可能AI)やアルゴリズム監査など、社会が対応を模索している動きを紹介する

5. まとめ

– アルゴリズム評価は単純に善悪で判断できるものではないことを再確認する

– 公平性・透明性・責任という複数の視点が必要であることを示す

– 読者が「AIに判断される社会」をどう捉えるかを考える余白を残して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:アルゴリズム評価の仕組み)

※(図:人間の判断とアルゴリズム判断の比較)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「アルゴリズム評価は公平化かブラックボックス化か?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

現在、私たちの価値や嗜好は、刻一刻とデータとして処理されています。例えば、ある企業が採用選考にAIを導入すれば、数万人の応募者を数秒でランク付けすることが可能です。また、金融機関が個人の行動データを分析して「クレジットスコア(信用格付け)」を算出し、それに基づいて融資の可否や金利を決定する仕組みも一般化しつつあります。

こうしたアルゴリズムの導入背景には、二つの大きな期待と懸念が混在しています。

一つは、感情や偏見に左右される人間よりも、データに基づいたAIの方が**「公平」**であるという期待。

もう一つは、なぜその判断が下されたのかが誰にも説明できない**「ブラックボックス化」**への懸念です。

私たちは今、「アルゴリズム評価は公平化なのか、それとも不透明化なのか」という、極めて現代的な問いの前に立っています。

—

## 2. アルゴリズム評価が「公平化」と言われる理由

なぜ、多くの組織が重要な意思決定をアルゴリズムに委ねようとするのでしょうか。そこには、人間特有の「判断のバグ」を排除したいという強い動機があります。

### 人間の主観と偏見(バイアス)の排除

人間は、その日の体調や気分、あるいは無意識のうちに抱いている性別・年齢・出身地に対する偏見に影響を受けやすい生き物です。面接官が「自分と似た雰囲気の人」を高く評価してしまう、といった事象は枚挙にいとまがありません。アルゴリズムは、あらかじめ設定されたルールに従って機械的に処理を行うため、こうした一時的な感情や個人的な好みを排除した「一貫性のある評価」を可能にします。

### 判断基準の統一と透明なルール化

人間による評価は、担当者ごとに基準がバラバラになりがちです。一方、アルゴリズムは(少なくとも設計段階では)明確な数式やロジックに基づいています。「何を評価し、何を評価しないか」をデジタルなルールとして定義することで、組織全体で統一された基準を適用できるメリットがあります。

### 膨大なデータによる多角的な視点

人間が一度に処理できる情報の量には限界があります。しかし、アルゴリズムであれば、過去数十年分のデータや数千項目に及ぶ変数を同時に分析し、人間が気づかなかった相関関係を見つけ出すことができます。これにより、一部の目立つ特徴だけで判断するのではなく、より多角的で客観的な評価が実現すると期待されています。

※(図:人間の判断とアルゴリズム判断の比較)

—

## 3. アルゴリズム評価が「ブラックボックス」と言われる理由

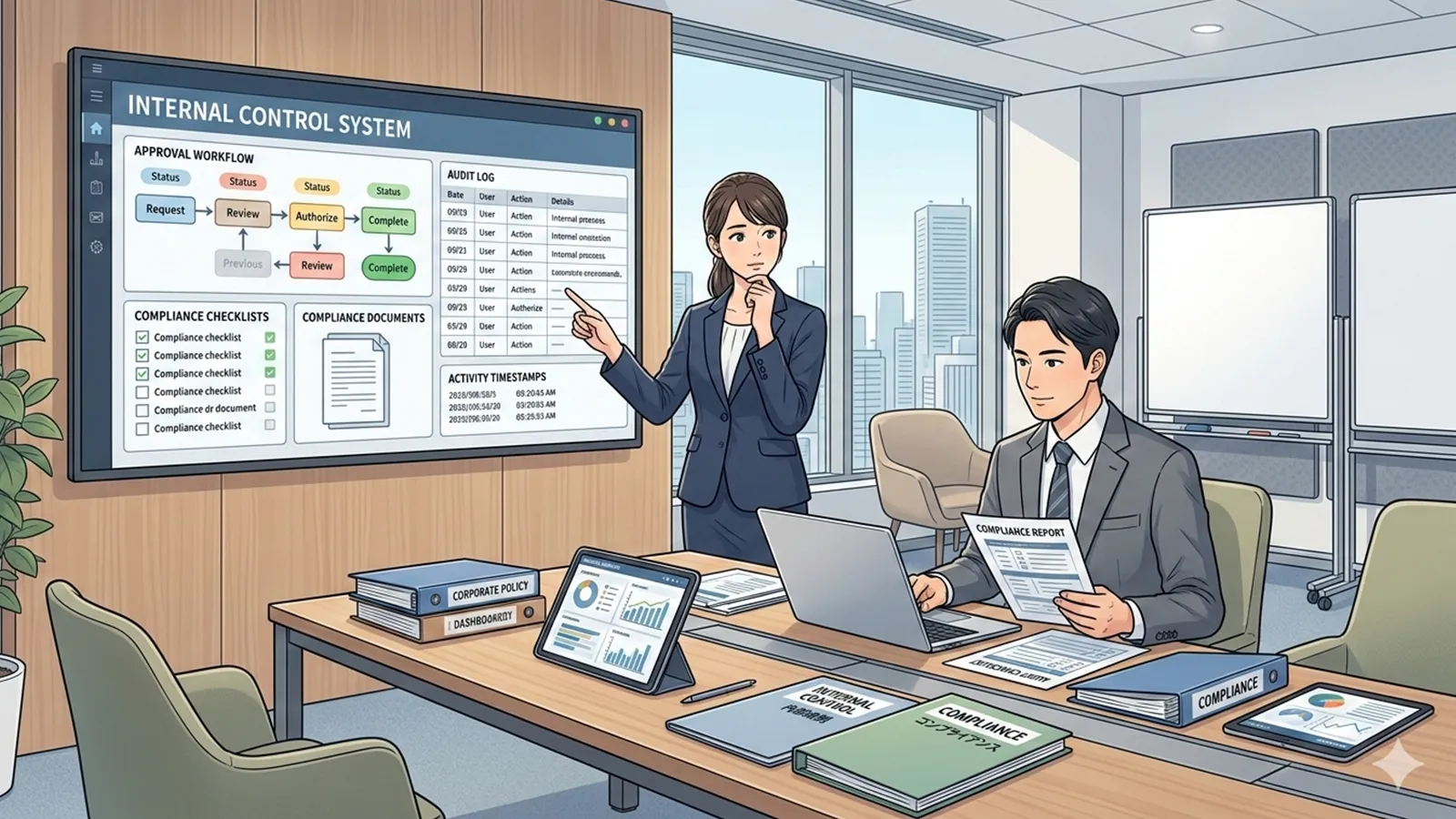

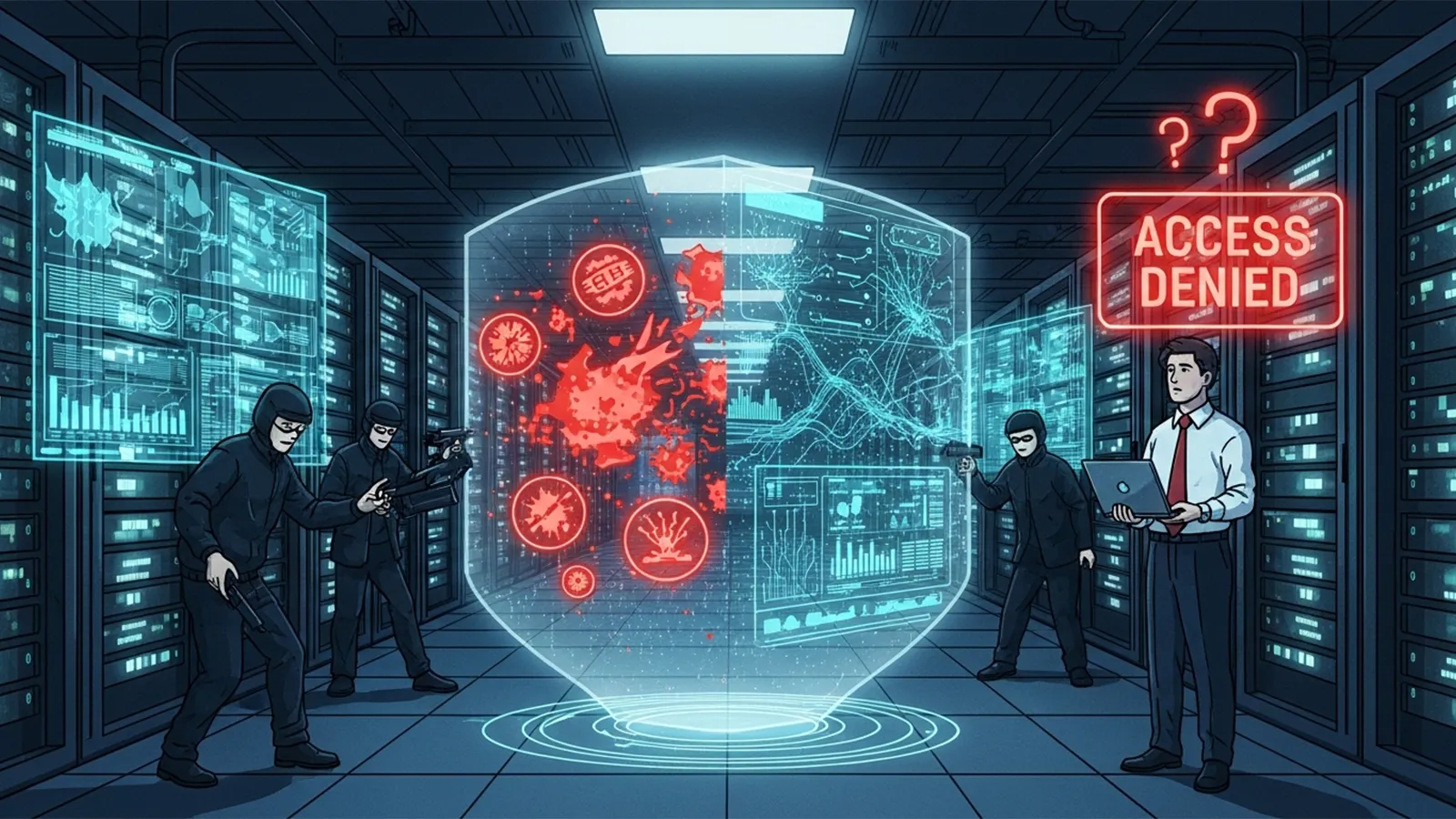

一方で、アルゴリズムによる評価が進むほど、そのプロセスが「見えなくなる」という深刻な問題も浮上しています。

### 機械学習モデルの複雑化

近年のAI、特に「ディープラーニング(深層学習)」を用いたモデルは、数億、数兆ものパラメータが複雑に絡み合って結果を出力します。開発者でさえも「なぜAIがこの人を不採用と判断したのか」という具体的な理由をピンポイントで説明することが困難になっています。この構造的な不透明さが、ブラックボックス問題の核心です。

### 「データの偏り」が引き継がれるリスク

アルゴリズム自体が中立であっても、学習に使う「過去のデータ」に偏りがあれば、AIはその偏見を学習・増幅させてしまいます。例えば、過去に男性ばかりを採用してきた企業のデータをAIに学ばせれば、AIは「男性であること」を高く評価するルールを勝手に作り出してしまう可能性があります。この場合、不透明なプロセスのなかで差別が「自動化」されるリスクが生じます。

### 企業の秘密保持と説明責任

多くのアルゴリズムは企業の知的財産として秘匿されています。SNSの表示順位や広告配信のロジックが公開されないのは、それが企業の競争力の源泉だからです。しかし、評価を受ける側からすれば、「なぜ自分のスコアが低いのか」を知る権利が阻害されているとも言えます。人間の判断であれば「説明」を求めることができますが、ブラックボックス化したアルゴリズムに対しては、納得感を得る手段が極めて限定的です。

—

## 4. 公平性と透明性のあいだにある構造

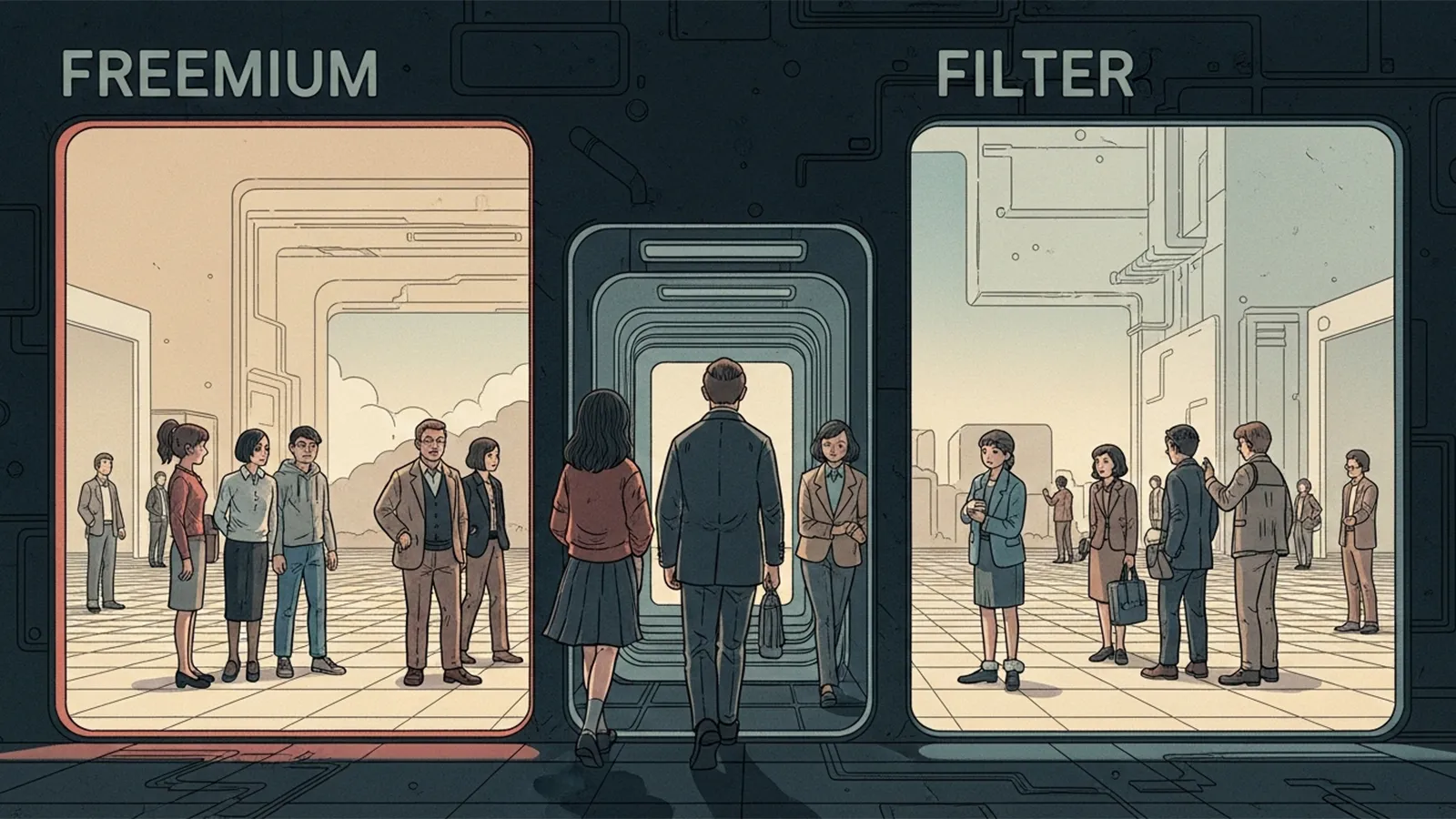

「公平化」と「ブラックボックス化」は、一見すると正反対の現象に思えます。しかし、実際にはこれらは**「同じコインの表裏」**として同時に進行しています。

### 恣意性と不透明性のトレードオフ

人間の判断には「恣意性(勝手な思い込み)」がありますが、対話を通じて理由を聞くことができます。対して、アルゴリズムには「恣意性」は少ないものの、計算過程に「不透明性」があります。私たちは、どちらの「不完全さ」を受け入れるべきかという選択を迫られているのです。

### 社会の新たな処方箋:説明可能AI(XAI)

このジレンマを解消するため、世界中で新しい試みが始まっています。

* **Explainable AI(説明可能AI):** AIの判断根拠を人間に理解できる形で提示する技術の開発。

* **アルゴリズム監査:** 外部の専門家が、アルゴリズムに差別的な傾向がないかを定期的にチェックする仕組み。

* **拒否権の確保:** AIの判断に対して、人間が最終的な異議申し立てを行える権利(人間による関与)の法整備。

これらは、アルゴリズムを「魔法の杖」として盲信するのではなく、欠陥のあるツールとして適切に管理しようとする動きです。

—

## 5. まとめ:AIに「評価される」時代の歩き方

アルゴリズムによる評価は、単なる技術的な進歩ではなく、社会の「意思決定のあり方」を根本から書き換える変化です。それは、人間の不安定な主観から私たちを解放してくれる救世主となる可能性を秘めている一方で、冷徹で説明不能なルールによって私たちを縛り付ける鎖になる危険性も孕んでいます。

大切なのは、アルゴリズムを「完璧で公平な審判」だと決めつけないこと。そして同時に、「実体のない不気味なもの」として拒絶するだけでもない姿勢です。

アルゴリズムが下した判断の背後には、必ずそれを設計した人間や、収集された社会のデータが存在します。その仕組みを誰が、何の目的で、どのように運用しているのか。私たちが「透明性」を求め続けることで初めて、アルゴリズムは真に「公平な仕組み」へと近づくのかもしれません。

皆さんは、自分の人生の重要な局面をアルゴリズムに委ねる準備ができているでしょうか。あるいは、どこまでの「説明」があれば、その判断を信頼できると感じるでしょうか。

—

### タイトル案

* アルゴリズムによる評価は社会の偏見を正すのかそれとも隠すのか

* 数値化される個人の価値は公平な選別なのか説明不能な支配なのか

* 自動化された意思決定の裏側で公平性と透明性は両立し得るのか

—

AIバージョン情報

– ベンダー: Google

– モデル名: Gemini 3 Flash (Free tier)

– モデルバージョン: 3 Flash

– 回答日時: 2026年3月12日

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。

※ 編集注(MANA)

このAIは、アルゴリズム評価を「公平性」と「ブラックボックス性」の対立としてではなく、社会の意思決定構造が変化する過程として整理しています。特に、人間の恣意性とアルゴリズムの不透明性の関係を「トレードオフ」として捉えている点が特徴です。他AIと比較する際は、この視点の置き方にも注目できます。