コンビニ、マンションのエントランス、駅構内、商業施設など、私たちの日常空間には防犯カメラが当たり前のように存在しています。最近では録画するだけではなく、AIが映像を解析する「AI防犯カメラ」が急速に普及しつつあります。一方で、「どこまで監視してよいのか」「AIが人を“怪しい”と判定してよいのか」という疑問も強まっています。本記事では、AI防犯カメラの仕組みと利点、そして社会的リスクを整理し、どこまでを社会として許容すべきかを考察します。

AI防犯カメラの仕組みと、今できること

AI防犯カメラは、カメラ映像をサーバーやカメラ内のAIが解析し、特定のパターンを自動検出する仕組みです。ここでのAIとは、膨大な画像データを学習して「人物」「車」「転倒」などを識別できるようにした機械学習・ディープラーニング技術を指します。

※(図:AI映像解析の基本フロー「撮影 → 映像データ → AI解析 → アラート → 対応」)

代表的な機能

- 人物検知・侵入検知:特定エリアへの侵入や人物の出現をリアルタイムで検知します。

- 不審行動検知:うろつき、逆走、よじ登りなど、通常と異なる行動を検出します。

- ナンバープレート認識:車両ナンバーを読み取り、入退場管理や料金計算に活用されます。

- 顔認証・属性推定:顔の特徴を数値化して本人確認を行う技術で、プライバシー懸念も大きい領域です。

まとめると、AI防犯カメラは「映像内の出来事をパターンとして理解したことにする技術」と言えます。

許容されやすい用途:社会的合意が得られやすい領域

犯罪の未然防止

侵入行為や器物損壊などを兆候段階で検出し、警備効率を高めます。多くの人が必要性を理解しやすい領域です。

転倒検知・火災検知などの安全向上

高齢者施設や工場などで、転倒・転落・煙などを検知し、人命を守るために用いられます。監視というより「見守り」に近い用途です。

個人を特定しない統計分析

混雑度や動線の把握など、統計的な情報を得る目的であればプライバシー侵害が少ないため、比較的受け入れられやすいといえます。

許容されにくい用途:社会的抵抗が大きい領域

本人同意のない顔認証・追跡

商業施設や公共空間で、誰がどこを移動したかを追跡し続ける運用は、プライバシー侵害の懸念が極めて大きい領域です。データ漏えい時のリスクも深刻です。

感情推定や「怪しさ」のスコア化

表情や動作から感情や不審度を推定する技術は、誤認や偏見を強化する危険があります。「AIが怪しいと言ったから怪しい」という扱いは極めて危険です。

ブラックリスト照合による差別リスク

過去のトラブル記録との照合は、防犯効果が語られる一方で、誤認時の救済が難しく、不当な排除につながる恐れがあります。

社会実装の課題とリスク

プライバシー侵害の懸念

映像データは、個人の行動履歴そのものです。他データと組み合わされれば、その人の生活を詳細に再構築できてしまいます。

アルゴリズムの透明性欠如

AIが「不審」と判断した理由が見えないため、人々に不信感を与えます。説明責任を果たせない運用は社会的な反発を招きます。

データ保存期間・利用範囲の曖昧さ

映像がどれだけ保存され、どの目的に使われるのかが曖昧だと、後からトラブルが発生しやすくなります。

監視社会化の問題

AIによる監視が高度化すると、「常に見られている」感覚が強まり、行動や発言に自己検閲が働く危険があります。

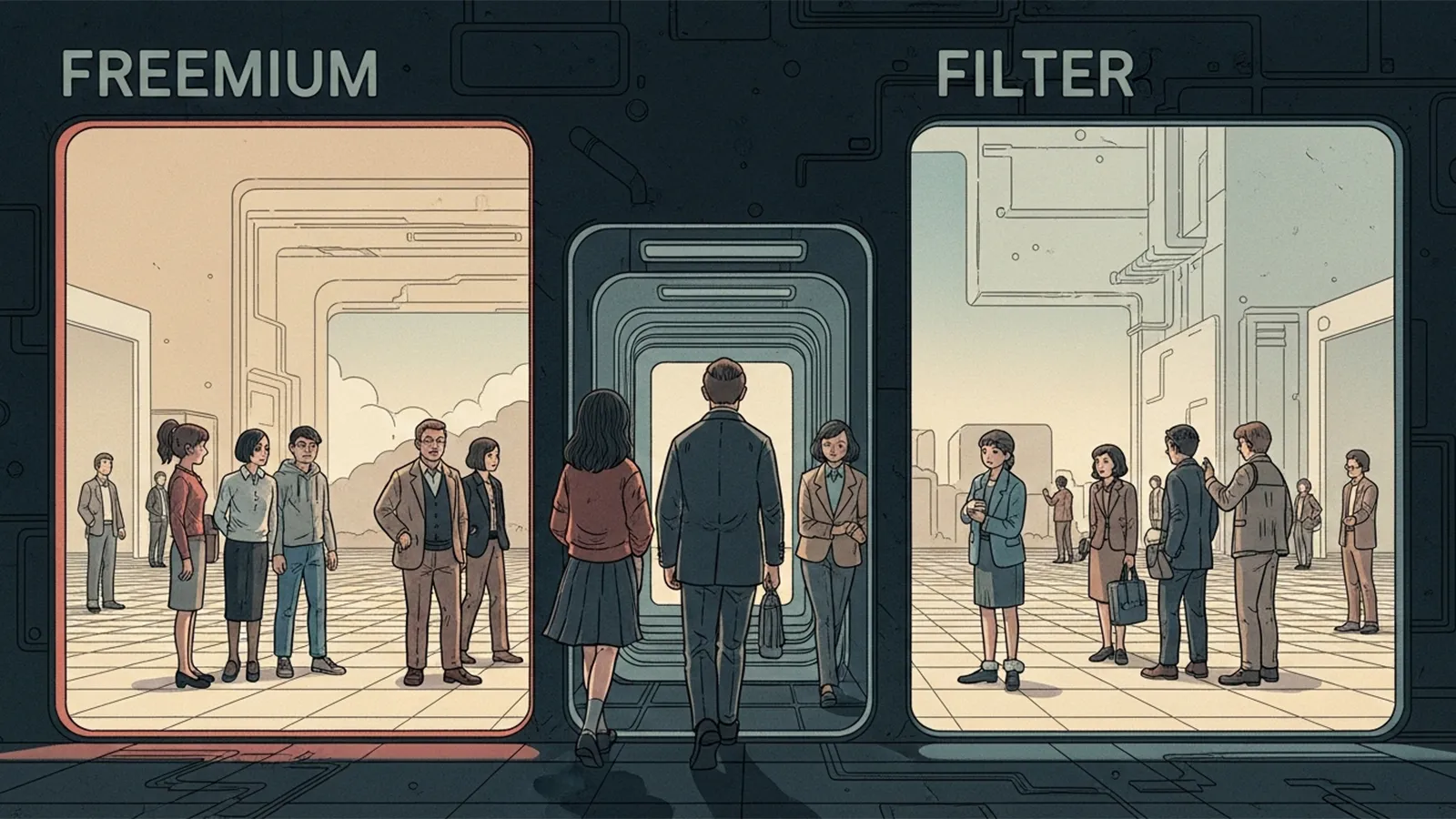

どこまで許されるのか ― 線引きの考え方

目的の正当性と手段の妥当性

「犯罪防止」など目的が正当でも、手段が過剰であれば個人の自由を不必要に削ってしまいます。目的と手段を分けて考える姿勢が重要です。

個人識別をしない設計の優先

個人を特定しない統計利用や、識別情報の最小化など、プライバシーと安全のバランスを取りやすい設計が求められます。

データの自動削除と目的限定

一定期間で自動削除する、目的外利用を行わないなど「最小限の保存」と「目的限定」はリスク軽減の基本原則です。

透明性のある運用

カメラの目的やAIが何をしているかを明示し、問い合わせ窓口を設けるなど、透明性こそが社会的受容の鍵になります。

※(図:許容/非許容領域のマップ「縦軸:目的の正当性 × 横軸:侵襲性」)

おわりに:AIと自由、その境界を決めるのは誰か

AI防犯カメラは大きな利点をもたらす一方、社会的なリスクも抱えています。「どこまで解析し、どこまで記録するか」という線引きを決めるのは技術ではなく社会です。読者の皆様にも、AIと自由の境界線をどこに引くべきか、ぜひ一度立ち止まって考えていただければと思います。

【テーマ】

近年急速に普及している「AI防犯カメラ」を題材に、

**AI技術が社会にもたらす利点とリスクを整理し、

“どこまで許されるのか” の線引きを冷静に考察する記事**を書いてください。

【目的】

– AI防犯カメラの技術・仕組み・活用場面をわかりやすく伝える

– 利便性だけでなく、プライバシー・監視社会・差別リスクを公平に論じる

– 読者に「AIと社会の境界をどう考えるべきか」という視点を提供する

【読者像】

– 一般社会人、学生、行政・企業の情報管理担当者

– 防犯カメラのAI化をニュースで聞いたことがあるが詳しくは知らない層

– AIの社会実装・倫理・プライバシー問題に関心がある人

【記事構成】

1. **導入(問題提起)**

– AI防犯カメラの普及が急速に進んでいる背景

– なぜ今これが議論になるのか(犯罪対策・人手不足・技術進化)

– 「どこまで許されるのか」という疑問が生まれていることを提示する

2. **AI防犯カメラの仕組みと現在できること**

– 人物検知・不審行動検知・ナンバープレート認識など

– 顔認証や属性推定(年齢・性別の推定など)の技術も紹介

– 映像解析AIの一般的な仕組みを一文で補足

※(図:AI映像解析の基本フロー)

3. **許容されやすい用途(社会的合意が得られやすい領域)**

– 犯罪の未然防止

– 転倒検知・火災検知など安全向上

– 混雑度の計測など個人特定を伴わない分析

– 公共利益が大きいことを明示

4. **許容されにくい用途(社会的抵抗が大きい領域)**

– 本人同意のない顔認証や追跡

– 感情推定や“怪しい行動”のスコア化

– ブラックリスト照合による差別リスク

– 誤認や偏見の強化につながる点を指摘

5. **社会実装の課題とリスク**

– プライバシー侵害の懸念

– アルゴリズムの透明性欠如

– データ保存期間・利用範囲の曖昧さ

– 監視社会化の問題

– 公共・企業で導入する際のルール整備の必要性

6. **どこまで許されるのか ― 線引きの考え方**

– “目的の正当性” と “手段の妥当性” のバランス

– 個人識別をしない設計の重要性

– データの自動削除や目的限定の原則

– 社会が合意できる“透明性のある運用”が鍵になる

※(図:許容/非許容領域のマップ)

7. **まとめ**

– AIは防犯に貢献し得るが、“使い方” がすべてを左右する

– 技術と自由のバランスをどう取るかを、読者にも考えてもらう形で締める

【文体・トーン】

– です・ます調

– 感情的になりすぎず、冷静で中立

– 専門用語には一文の補足を必ずつける

– 恐怖を煽らず、事実関係を丁寧に説明する

【出力形式】

– Markdown形式

– 小見出し(###)を多めに使用

– 文字数は **2000〜2500字** を目安

– 記事末尾に「タイトル案」を **3つ** 提示する

【補足指示】

– 技術構成図や概念説明が有効な箇所では、

※(図:AI防犯カメラの判断プロセス)

のようにコメントを入れてよい(実際の画像は不要)。

【バージョン情報の出力】

記事本文とタイトル案のあとに必ず以下の形式で追記してください。

(不明な項目は「不明」と記載)

—

**AIバージョン情報**

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

—

【参考タイトル】

「AI防犯カメラはどこまで許されるのか ― 技術と自由の“境界線”を考える」

コンビニ、マンションのエントランス、駅構内、商業施設――。気がつけば、私たちのまわりには当たり前のように防犯カメラがあります。

最近では、単に「録画するだけ」のカメラではなく、AIが映像を自動解析する**AI防犯カメラ**が急速に普及し始めています。

背景には、犯罪や迷惑行為への対策ニーズの高まり、人手不足、そして映像解析技術の進歩があります。一方で、

「どこまで監視していいのか?」

「人を“点数化”したり、“怪しい人”を自動で決めてしまって良いのか?」

という不安や違和感も、少しずつ広がっています。

この記事では、AI防犯カメラの仕組みと利点、そして見過ごせないリスクを整理しながら、**“どこまでなら社会として許容できるのか”という線引き**について考えていきます。

—

### AI防犯カメラの仕組みと、今できること

#### 映像を「理解」しようとするカメラ

AI防犯カメラは、カメラが撮影した映像をサーバーやカメラ内のAI(画像認識アルゴリズム)が解析し、特定のパターンを検出する仕組みです。

ここでいうAIは、多数の画像データを学習して「これは人」「これは車」「これは転倒している状態」などを判別できるようにした**機械学習/ディープラーニング**のモデルを指します。

※(図:AI映像解析の基本フロー

「撮影 → 映像データ → AIによる解析 → アラート/記録 → オペレーター対応」)

#### 代表的な機能

* **人物検知・侵入検知**

人が映ったかどうか、立ち入り禁止エリアに侵入したかどうかをリアルタイムで検知します。夜間の施設警備や無人店舗などで活用されます。

* **不審行動検知**

同じ場所を長時間うろつく、逆走する、柵をよじ登るなど、通常と異なる行動パターンを検出し、アラートを出す機能です。

「不審らしさ」を学習データやルールで定義している点がポイントです。

* **ナンバープレート認識**

車両のナンバーを読み取り、入退場管理や駐車料金の自動計算、盗難車両の検知などに使われます。

文字認識(OCR)技術と画像認識を組み合わせた応用例です。

* **顔認証・属性推定**

顔の特徴をベクトル化(数値化)して本人確認を行う**顔認証**や、年齢・性別などを推定する**属性推定**も実用化されています。

ログイン、入室管理、VIP顧客の来店検知などに使われる一方で、プライバシーや差別の懸念が大きい領域でもあります。

一言でまとめると、

> **「映像の中で何が起きているかを、AIがパターンとして“理解したことにする”技術**

> といえます。

—

### 許容されやすい用途:社会的合意が得られやすい領域

AI防犯カメラのすべてが「危険」なわけではありません。多くの人が「それは必要だ」と感じやすい領域もたしかに存在します。

#### 1. 犯罪の未然防止・早期発見

夜間の店舗や施設で、侵入行為や器物損壊などを検知して通報する用途は、多くの人が直感的に理解しやすい領域です。

被害が発生してから犯人を探すのではなく、**「起きそうな兆候」を早めに捉える**ことは、警備の効率化に直結します。

#### 2. 転倒検知・火災検知など、安全性の向上

高齢者施設や工場、駅ホームなどでは、転倒や転落、煙・火炎といった危険を検知するAIカメラが導入されつつあります。

これは、**本人の安全を守るための用途**であり、監視というより「見守り」に近い役割を持ちます。

#### 3. 混雑度の計測など、個人を特定しない分析

商業施設やイベント会場で、

* 何人くらい人がいるか

* どのエリアが混雑しているか

* 動線がどのように流れているか

といった統計的なデータを取る用途は、個人を特定せずに行えるケースが多いです。

このように、**個人の特定よりも「全体の傾向」を知るための利用**は、比較的受け入れられやすいと言えます。

—

### 許容されにくい用途:社会的抵抗が大きい領域

一方で、同じ技術でも使い方によっては強い反発や不安を引き起こします。

#### 1. 本人同意のない顔認証・追跡

商業施設や駅などで、

「誰がどこを歩いていたか」を顔認証で追跡し続けるような運用は、**プライバシー侵害の懸念が極めて大きい**領域です。

* 同意なく行われた場合、人々は「常に顔をチェックされている」と感じる

* データが漏えいした場合、行動履歴が丸ごと流出するリスクがある

など、影響範囲が非常に広くなります。

#### 2. 感情推定や「怪しさ」のスコア化

表情や視線、動きから「不機嫌そう」「攻撃的」「不審」といったラベルを自動で付与し、スコア化する技術も研究・実用化されています。

しかし、人の感情は文化や体質によっても大きく異なり、AIが正確に判断できるとは限りません。

**「AIが怪しいと言ったから怪しい人だ」**

という扱いは、誤認と偏見を強化する危険があります。

#### 3. ブラックリスト照合による差別リスク

過去にトラブルのあった顧客や、治安対策上の要注意人物の顔データと照合して入場を制限する――。

このような運用は、防犯の観点から一定の合理性が語られる一方で、

* 誤登録・誤認識があった場合の救済が難しい

* 特定の人々が半永久的に排除される可能性がある

といった深刻な人権問題を引き起こします。

—

### 社会実装の課題とリスク

AI防犯カメラは便利であるほど、その裏側でいくつもの課題を抱えています。

#### プライバシー侵害の懸念

いつ、どこで、誰が、誰といたのか。

映像データは、私たちの日常行動の「履歴そのもの」です。

これが長期間保存され、他のデータ(位置情報や購入履歴など)と結びつくと、**個人の生活が詳細に再現できてしまいます**。

#### アルゴリズムの透明性の欠如

AIが「不審」と判断したとき、

なぜそう判断したのか、どのデータに影響されたのかが、一般にはほとんど見えません。

この**「理由の不透明さ」**が、不安や不信感を生みます。

#### データ保存期間・利用範囲の曖昧さ

* 何日分の映像を保存するのか

* 目的外利用(マーケティングなど)をしていないか

* 警察・行政への提供ルールはどうなっているのか

といった点が曖昧なまま運用されると、後から問題が顕在化しやすくなります。

#### 監視社会化の問題

防犯目的でカメラが増え、それをAIで高度化すればするほど、

**「常に誰かに見られている」感覚**は強くなります。

その結果、

* 発言や行動を過剰に自己検閲してしまう

* 特定のグループだけがより強く監視される

といった、民主主義や自由な社会にとって望ましくない状況を生む恐れがあります。

公共機関や企業がAI防犯カメラを導入する際には、**技術だけでなく運用ルールの整備**が欠かせません。

—

### どこまで許されるのか ― 線引きの考え方

#### 「目的の正当性」と「手段の妥当性」

AI防犯カメラを考えるとき、

**「目的が正しいか」**と**「そのための手段が過剰ではないか」**を切り分けて考えることが重要です。

* 目的:犯罪を減らす/事故を防ぐ/安全を高める → 多くの場合、社会的に正当

* 手段:全面的な顔認証・行動スコア化・長期保存など → 必要以上に強すぎないか?

目的がどれだけ正しくても、手段が過度であれば、自由やプライバシーを不必要に削ってしまいます。

#### 個人識別をしない設計を優先する

まずは、**個人を特定しない範囲で何ができるか**を優先して検討する姿勢が重要です。

* 「混雑度」や「人の流れ」など、統計レベルの情報にとどめる

* 顔やナンバーなど、個人識別子を最小限にする

といった設計は、プライバシーと防犯のバランスを取りやすくします。

#### データの自動削除と目的限定

* 一定期間が過ぎた映像は自動削除する

* 防犯目的で取得したデータをマーケティングに流用しない

* 利用目的を事前に明示する

といった**「目的限定」と「最小限の保存」**は、リスクを抑えるための基本原則です。

#### 透明性のある運用が鍵

そして何より大切なのは、

**「何を、どの目的で、どのように使うのか」を社会に説明できること**です。

* カメラの設置場所や目的を明示する

* AIが何をしているのかをわかりやすく説明する

* 苦情や疑問に対応する窓口を用意する

こうした透明性があって初めて、社会はAI防犯カメラを「必要な技術」として受け入れやすくなります。

※(図:許容/非許容領域のマップ

縦軸「目的の正当性」、横軸「手段の侵襲性」でプロット)

—

### おわりに:技術か、人か――決めるのは誰か

AI防犯カメラは、防犯や安全に大きく貢献しうる技術です。

しかし、「どこまで映し、どこまで解析し、どこまで記録するのか」という**線引きを決めるのは、技術そのものではなく社会の側**です。

* 安全のために、どこまでプライバシーを差し出すのか

* 誰がそのルールを決め、どう説明するのか

* 誤った運用をどう正していくのか

これらの問いに、私たち一人ひとりが無関心でいることはできません。

AI防犯カメラをめぐる議論は、

**「AIと自由の境界線をどこに引くのか」**を考える、現代社会の縮図とも言えます。

便利さだけでなく、その裏側にあるリスクと責任にも目を向けながら、

「どこまでなら許せるのか」

を、ぜひご自身の言葉で考えてみてください。

—

### タイトル案

1. AI防犯カメラはどこまで許されるのか――技術と自由の境界線を考える

2. 見守りか監視か? AI防犯カメラが変える「安全」と「プライバシー」

3. 顔認証・不審検知の先にあるもの――AI防犯カメラ時代のルールづくり

—

**AIバージョン情報**

– ベンダー: OpenAI

– モデル名: GPT-5.1 Thinking

– モデルバージョン: gpt-5.1-thinking

– 回答日時: 2025-12-02(JST)

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。