AI防犯カメラの導入が、商業施設・マンション・自治体の街頭などで急速に進んでいます。背景には、犯罪対策の強化、人手不足による監視業務の自動化、そして映像解析技術の進化があります。利便性が高まる一方で、個人の自由やプライバシーに関わる「どこまで許されるのか」という線引きが社会的な論点になっています。この記事では、技術の仕組みと活用の利点・リスクを整理し、冷静な判断軸を提示します。

AI防犯カメラの仕組みと現在できること

AI防犯カメラは、撮影した映像をリアルタイムまたは録画後に解析し、イベントを検知・通知します。映像解析とは、カメラが捉えた画素データから物体や行動の特徴量を抽出し、機械学習モデルがパターンとして識別する技術のことです。

- 人物検知: 人の形状や動きを認識して、侵入や滞留を検出します。人物検知は「人の輪郭やポーズの特徴」を学習済みモデルで照合する仕組みです。

- 不審行動検知: 深夜の徘徊、立ち入り禁止区域への進入、逆走などのルール違反を自動検知します。不審行動は「事前に定義した振る舞いのパターン」に基づきスコア化されます。

- ナンバープレート認識: 車両のプレート文字を読み取り、入退場管理に活用します。文字認識は「画像から文字領域を抽出し、OCRで解読する」技術です。

- 顔認証・属性推定: 顔認証は「顔特徴量のベクトル比較」で本人同一性を推定し、属性推定は「年齢層や性別などの確率推定」を行います。いずれも誤認率やバイアスの管理が重要です。

※(図:AI映像解析の基本フロー)

入力映像 → 前処理(ノイズ除去・補正) → 検出(人物・車両) → 追跡 → 特徴抽出 → 判定(ルール・モデル) → 通知・記録

許容されやすい用途(社会的合意が得られやすい領域)

- 犯罪の未然防止: 侵入検知や器物破損の兆候を早期に察知し、通報につなげます。公共の安全向上という明確な目的を満たします。

- 安全向上(転倒・火災検知): 高齢者施設や工場での転倒検知、煙・炎の検知により迅速な対応を促します。安全関連は「生命・身体の保護」という公益性が高い領域です。

- 混雑度計測などの非特定分析: 匿名の人数カウントや滞留時間分析で、施設の運営改善や災害時の避難誘導に役立てます。個人識別を伴わない集計は許容度が高いです。

許容されにくい用途(社会的抵抗が大きい領域)

- 本人同意のない顔認証・追跡: 同意なく個人を識別し、移動履歴を追跡する行為はプライバシーと自由な行動を著しく制限します。

- 感情推定や“怪しい行動”のスコア化: 表情や仕草から意図や感情を推測する精度には限界があり、誤判定が偏見や過剰な介入を招きます。

- ブラックリスト照合による差別リスク: 過去のデータに依存した自動排除は、属性や誤認に基づく不当な扱いにつながりやすいです。

社会実装の課題とリスク

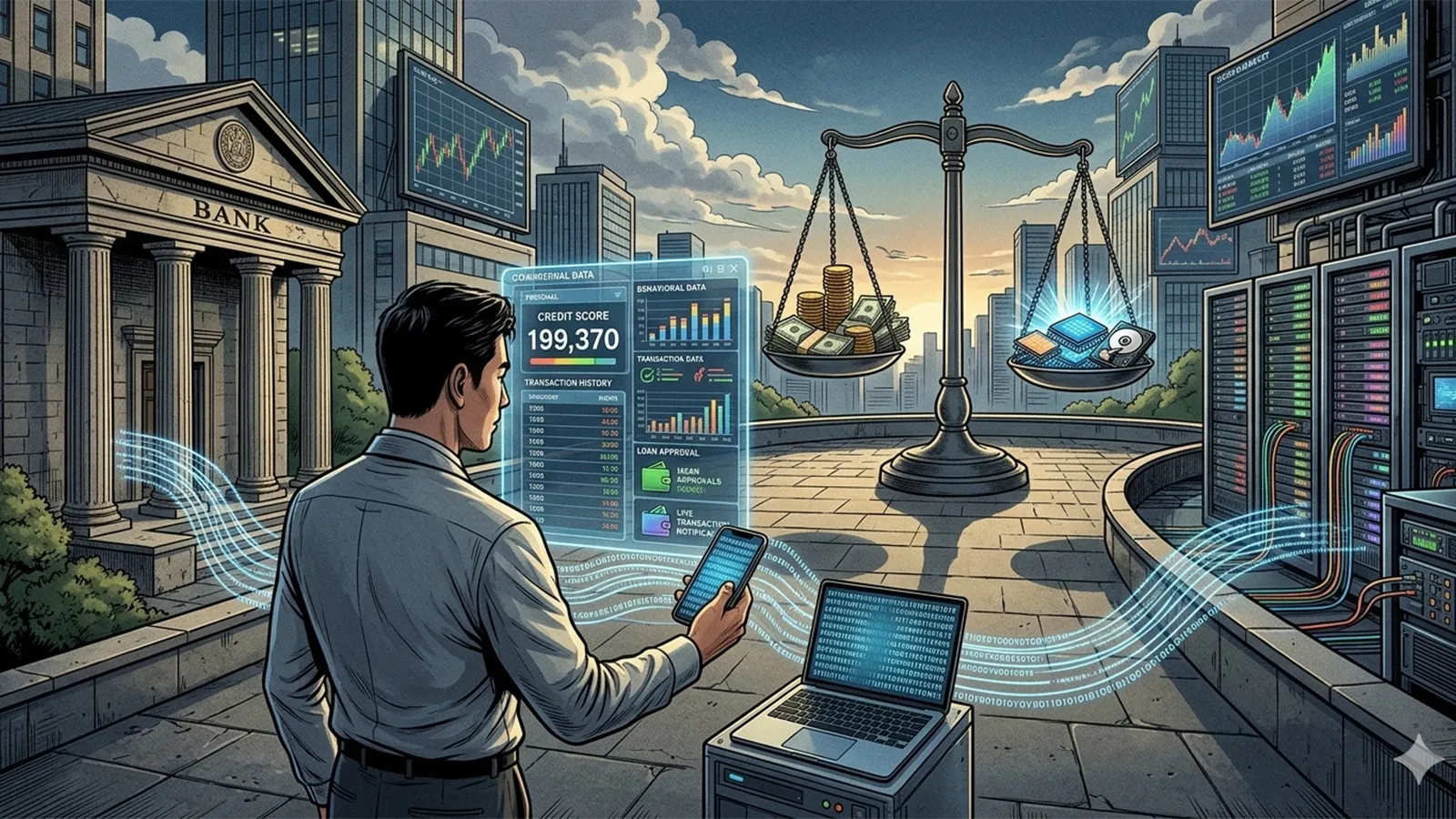

- プライバシー侵害: いつ、どこで、誰が監視され、何が保存されるかの不透明さは、自己検閲(自由な行動の萎縮)を生みます。プライバシーとは「個人が自分に関する情報の開示・利用をコントロールできる権利」です。

- アルゴリズムの透明性欠如: モデルが何を根拠に判断したかが分からないと、異議申し立てや改善が困難になります。透明性は「判断過程の説明可能性」を指します。

- データ保存期間・利用範囲の曖昧さ: 不要な長期保存や目的外利用は、二次的なリスク(漏えい・再識別)を増幅します。

- 監視社会化: 常時監視が「自由な集合・発言・移動」を抑制し、民主的な活動に影響を与えます。

- 導入ルールの未整備: 公共・企業での運用において、同意取得、掲示、目的限定、第三者提供の統制などのルールが不可欠です。

どこまで許されるのか ― 線引きの考え方

- 目的の正当性: 生命・身体・重大財産の保護など、公益性が明確で必要性が高い目的に限定します。

- 手段の妥当性: 目的達成に必要最小限の機能(検知範囲、解像度、識別有無)に抑え、過剰な個人特定を避けます。

- 個人識別をしない設計: 人数カウントや行動パターンの匿名分析を優先し、顔認証は「明示的同意+限定目的+代替手段の評価」がある場合に限ります。

- データの自動削除・目的限定: 保存期間を短く設定し、自動削除をデフォルトにします。目的外利用を禁止し、再利用時は追加の同意を要する仕組みが必要です。

- 透明性のある運用: 撮影・解析の事実と目的、保存期間、問い合わせ窓口を明示します。監査・ログ・第三者評価により説明可能性を担保します。

※(図:許容/非許容領域のマップ)

横軸=目的の正当性(低→高)、縦軸=手段の侵襲性(低→高)。右下(正当性高・侵襲性低)は許容、右上は厳格な限定と監査、左上は原則不可。

まとめ

AIは防犯や安全に確かな価値をもたらしますが、効果と副作用は表裏一体です。鍵になるのは「何のために、どこまで、どう透明に」使うかという設計と運用の責任です。個人識別の抑制、保存の最小化、目的限定と説明可能性を徹底し、社会的合意を積み重ねることが、技術と自由のバランスを保つ唯一の道です。最後に、読者の皆さん自身が所属する組織や地域で、この線引きをどのように合意形成し、検証・更新していくべきかを考えてみてください。

【テーマ】

近年急速に普及している「AI防犯カメラ」を題材に、

**AI技術が社会にもたらす利点とリスクを整理し、

“どこまで許されるのか” の線引きを冷静に考察する記事**を書いてください。

【目的】

– AI防犯カメラの技術・仕組み・活用場面をわかりやすく伝える

– 利便性だけでなく、プライバシー・監視社会・差別リスクを公平に論じる

– 読者に「AIと社会の境界をどう考えるべきか」という視点を提供する

【読者像】

– 一般社会人、学生、行政・企業の情報管理担当者

– 防犯カメラのAI化をニュースで聞いたことがあるが詳しくは知らない層

– AIの社会実装・倫理・プライバシー問題に関心がある人

【記事構成】

1. **導入(問題提起)**

– AI防犯カメラの普及が急速に進んでいる背景

– なぜ今これが議論になるのか(犯罪対策・人手不足・技術進化)

– 「どこまで許されるのか」という疑問が生まれていることを提示する

2. **AI防犯カメラの仕組みと現在できること**

– 人物検知・不審行動検知・ナンバープレート認識など

– 顔認証や属性推定(年齢・性別の推定など)の技術も紹介

– 映像解析AIの一般的な仕組みを一文で補足

※(図:AI映像解析の基本フロー)

3. **許容されやすい用途(社会的合意が得られやすい領域)**

– 犯罪の未然防止

– 転倒検知・火災検知など安全向上

– 混雑度の計測など個人特定を伴わない分析

– 公共利益が大きいことを明示

4. **許容されにくい用途(社会的抵抗が大きい領域)**

– 本人同意のない顔認証や追跡

– 感情推定や“怪しい行動”のスコア化

– ブラックリスト照合による差別リスク

– 誤認や偏見の強化につながる点を指摘

5. **社会実装の課題とリスク**

– プライバシー侵害の懸念

– アルゴリズムの透明性欠如

– データ保存期間・利用範囲の曖昧さ

– 監視社会化の問題

– 公共・企業で導入する際のルール整備の必要性

6. **どこまで許されるのか ― 線引きの考え方**

– “目的の正当性” と “手段の妥当性” のバランス

– 個人識別をしない設計の重要性

– データの自動削除や目的限定の原則

– 社会が合意できる“透明性のある運用”が鍵になる

※(図:許容/非許容領域のマップ)

7. **まとめ**

– AIは防犯に貢献し得るが、“使い方” がすべてを左右する

– 技術と自由のバランスをどう取るかを、読者にも考えてもらう形で締める

【文体・トーン】

– です・ます調

– 感情的になりすぎず、冷静で中立

– 専門用語には一文の補足を必ずつける

– 恐怖を煽らず、事実関係を丁寧に説明する

【出力形式】

– Markdown形式

– 小見出し(###)を多めに使用

– 文字数は **2000〜2500字** を目安

– 記事末尾に「タイトル案」を **3つ** 提示する

【補足指示】

– 技術構成図や概念説明が有効な箇所では、

※(図:AI防犯カメラの判断プロセス)

のようにコメントを入れてよい(実際の画像は不要)。

【バージョン情報の出力】

記事本文とタイトル案のあとに必ず以下の形式で追記してください。

(不明な項目は「不明」と記載)

—

**AIバージョン情報**

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

—

【参考タイトル】

「AI防犯カメラはどこまで許されるのか ― 技術と自由の“境界線”を考える」

AI防犯カメラの導入が、商業施設・マンション・自治体の街頭などで急速に進んでいます。背景には、犯罪対策の強化、人手不足による監視業務の自動化、そして映像解析技術の進化があります。利便性が高まる一方で、個人の自由やプライバシーに関わる「どこまで許されるのか」という線引きが社会的な論点になっています。この記事では、技術の仕組みと活用の利点・リスクを整理し、冷静な判断軸を提示します。

—

### AI防犯カメラの仕組みと現在できること

AI防犯カメラは、撮影した映像をリアルタイムまたは録画後に解析し、イベントを検知・通知します。映像解析とは、カメラが捉えた画素データから物体や行動の特徴量を抽出し、機械学習モデルがパターンとして識別する技術のことです。

– **人物検知:** 人の形状や動きを認識して、侵入や滞留を検出します。人物検知は「人の輪郭やポーズの特徴」を学習済みモデルで照合する仕組みです。

– **不審行動検知:** 深夜の徘徊、立ち入り禁止区域への進入、逆走などのルール違反を自動検知します。不審行動は「事前に定義した振る舞いのパターン」に基づきスコア化されます。

– **ナンバープレート認識:** 車両のプレート文字を読み取り、入退場管理に活用します。文字認識は「画像から文字領域を抽出し、OCRで解読する」技術です。

– **顔認証・属性推定:** 顔認証は「顔特徴量のベクトル比較」で本人同一性を推定し、属性推定は「年齢層や性別などの確率推定」を行います。いずれも誤認率やバイアスの管理が重要です。

※(図:AI映像解析の基本フロー)

入力映像 → 前処理(ノイズ除去・補正) → 検出(人物・車両) → 追跡 → 特徴抽出 → 判定(ルール・モデル) → 通知・記録

—

### 許容されやすい用途(社会的合意が得られやすい領域)

– **犯罪の未然防止:** 侵入検知や器物破損の兆候を早期に察知し、通報につなげます。公共の安全向上という明確な目的を満たします。

– **安全向上(転倒・火災検知):** 高齢者施設や工場での転倒検知、煙・炎の検知により迅速な対応を促します。安全関連は「生命・身体の保護」という公益性が高い領域です。

– **混雑度計測などの非特定分析:** 匿名の人数カウントや滞留時間分析で、施設の運営改善や災害時の避難誘導に役立てます。個人識別を伴わない集計は許容度が高いです。

これらは、目的が明確で個人の権利侵害が小さく、社会的利益が大きいことから合意を得やすいと考えられます。

—

### 許容されにくい用途(社会的抵抗が大きい領域)

– **本人同意のない顔認証・追跡:** 同意なく個人を識別し、移動履歴を追跡する行為はプライバシーと自由な行動を著しく制限します。

– **感情推定や“怪しい行動”のスコア化:** 表情や仕草から意図や感情を推測する精度には限界があり、誤判定が偏見や過剰な介入を招きます。

– **ブラックリスト照合による差別リスク:** 過去のデータに依存した自動排除は、属性や誤認に基づく不当な扱いにつながりやすいです。

これらは誤認・偏見の強化、説明困難、救済手段の不足といった問題が重なり、社会的抵抗が高まります。

—

### 社会実装の課題とリスク

– **プライバシー侵害:** いつ、どこで、誰が監視され、何が保存されるかの不透明さは、自己検閲(自由な行動の萎縮)を生みます。プライバシーとは「個人が自分に関する情報の開示・利用をコントロールできる権利」です。

– **アルゴリズムの透明性欠如:** モデルが何を根拠に判断したかが分からないと、異議申し立てや改善が困難になります。透明性は「判断過程の説明可能性」を指します。

– **データ保存期間・利用範囲の曖昧さ:** 不要な長期保存や目的外利用は、二次的なリスク(漏えい・再識別)を増幅します。

– **監視社会化:** 常時監視が「自由な集合・発言・移動」を抑制し、民主的な活動に影響を与えます。

– **導入ルールの未整備:** 公共・企業での運用において、同意取得、掲示、目的限定、第三者提供の統制などのルールが不可欠です。

—

### どこまで許されるのか ― 線引きの考え方

– **目的の正当性:** 生命・身体・重大財産の保護など、公益性が明確で必要性が高い目的に限定します。

– **手段の妥当性:** 目的達成に必要最小限の機能(検知範囲、解像度、識別有無)に抑え、過剰な個人特定を避けます。

– **個人識別をしない設計:** 人数カウントや行動パターンの匿名分析を優先し、顔認証は「明示的同意+限定目的+代替手段の評価」がある場合に限ります。

– **データの自動削除・目的限定:** 保存期間を短く設定し、自動削除をデフォルトにします。目的外利用を禁止し、再利用時は追加の同意を要する仕組みが必要です。

– **透明性のある運用:** 撮影・解析の事実と目的、保存期間、問い合わせ窓口を明示します。監査・ログ・第三者評価により説明可能性を担保します。

※(図:許容/非許容領域のマップ)

横軸=目的の正当性(低→高)、縦軸=手段の侵襲性(低→高)。右下(正当性高・侵襲性低)は許容、右上は厳格な限定と監査、左上は原則不可。

—

### まとめ

AIは防犯や安全に確かな価値をもたらしますが、効果と副作用は表裏一体です。鍵になるのは「何のために、どこまで、どう透明に」使うかという設計と運用の責任です。個人識別の抑制、保存の最小化、目的限定と説明可能性を徹底し、社会的合意を積み重ねることが、技術と自由のバランスを保つ唯一の道です。最後に、読者の皆さん自身が所属する組織や地域で、この線引きをどのように合意形成し、検証・更新していくべきかを考えてみてください。

—

### タイトル案

1. AI防犯カメラはどこまで許されるのか ― 技術と自由の境界線を考える

2. 監視か安心か:AI防犯カメラの利点・リスク・運用の作法

3. 顔認証の先にあるもの:AIと社会の線引きを設計する

—

**AIバージョン情報**

– ベンダー: Microsoft AI

– モデル名: Copilot

– モデルバージョン: 不明

– 回答日時: 2025-12-02 16:18 JST

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。