コンビニエンスストア、駅構内、商業施設――私たちの日常空間に、いつの間にか「AI防犯カメラ」が増えています。従来の録画機能だけでなく、人物の動きを検知し、不審行動を自動で判別し、場合によっては顔を識別する。こうした技術は、人手不足が深刻化する現場での防犯業務を効率化し、犯罪の未然防止に貢献すると期待されています。しかし同時に、「知らない間に顔を記録されているのでは」「AIが私たちを評価しているのでは」という不安の声も広がっています。技術の進化は確かに社会を便利にしますが、その一方で「監視社会化」や「プライバシー侵害」といった重大なリスクも内包しています。では、AI防犯カメラは社会にとって「どこまで許されるのか」。本記事では、技術の仕組みと実際の用途を整理しながら、利便性とリスクのバランスをどう取るべきかを冷静に考察します。

AI防犯カメラの仕組みと現在できること

AI防犯カメラとは、カメラで撮影した映像をAIが解析し、特定の情報を抽出・判断する仕組みを持つシステムです。従来の「録画して後で確認する」カメラとは異なり、リアルタイムで状況を判断し、通知や記録を行う点が特徴です。

主な機能

- 人物検知:映像内に人がいるかを判別し、動きを追跡

- 不審行動検知:長時間の滞留、急な走り出し、転倒などを検出

- ナンバープレート認識:車両を識別し、入退場管理や盗難車両の発見に活用

- 顔認証:事前に登録された顔画像と照合し、本人確認や要注意人物の検知を行う

- 属性推定:性別や年齢層などを推定し、マーケティングデータとして利用される場合もある

※(図:AI映像解析の基本フロー)

カメラ映像 → 物体検出(人・車など) → 特徴抽出(顔・動き) → AIモデルによる判定 → アラート/記録

これらの技術は、ディープラーニング(深層学習)と呼ばれる機械学習技術を用いており、大量の画像データから「何が映っているか」を学習することで高精度な判断を実現しています。

許容されやすい用途:公共利益が明確な領域

AI防犯カメラの中には、社会的な合意が得られやすい用途も存在します。これらに共通するのは、個人を特定しない、あるいは明確な公共の安全に資するという点です。

犯罪の未然防止

駅や商業施設での不審な動きを検知し、警備員に通知することで、犯罪を未然に防ぐ取り組みが進んでいます。たとえば、長時間同じ場所に立ち止まる、複数回同じエリアを往復するといった行動パターンを検出する仕組みです。

安全確保のための検知機能

高齢者施設や駅ホームでの転倒検知、工場での火災・煙の自動検出など、人命に直結する安全対策としてのAI活用は社会的に受け入れられやすい傾向にあります。

匿名化された統計情報の取得

店舗の混雑度や人の流れを計測し、サービス改善に活かす用途も一般的です。この場合、個人を識別せず、統計情報のみを扱うため、プライバシー侵害のリスクは比較的低いとされています。

許容されにくい用途:抵抗感が強い領域

一方で、技術的には可能であっても、社会的に強い抵抗や懸念が示される用途も存在します。

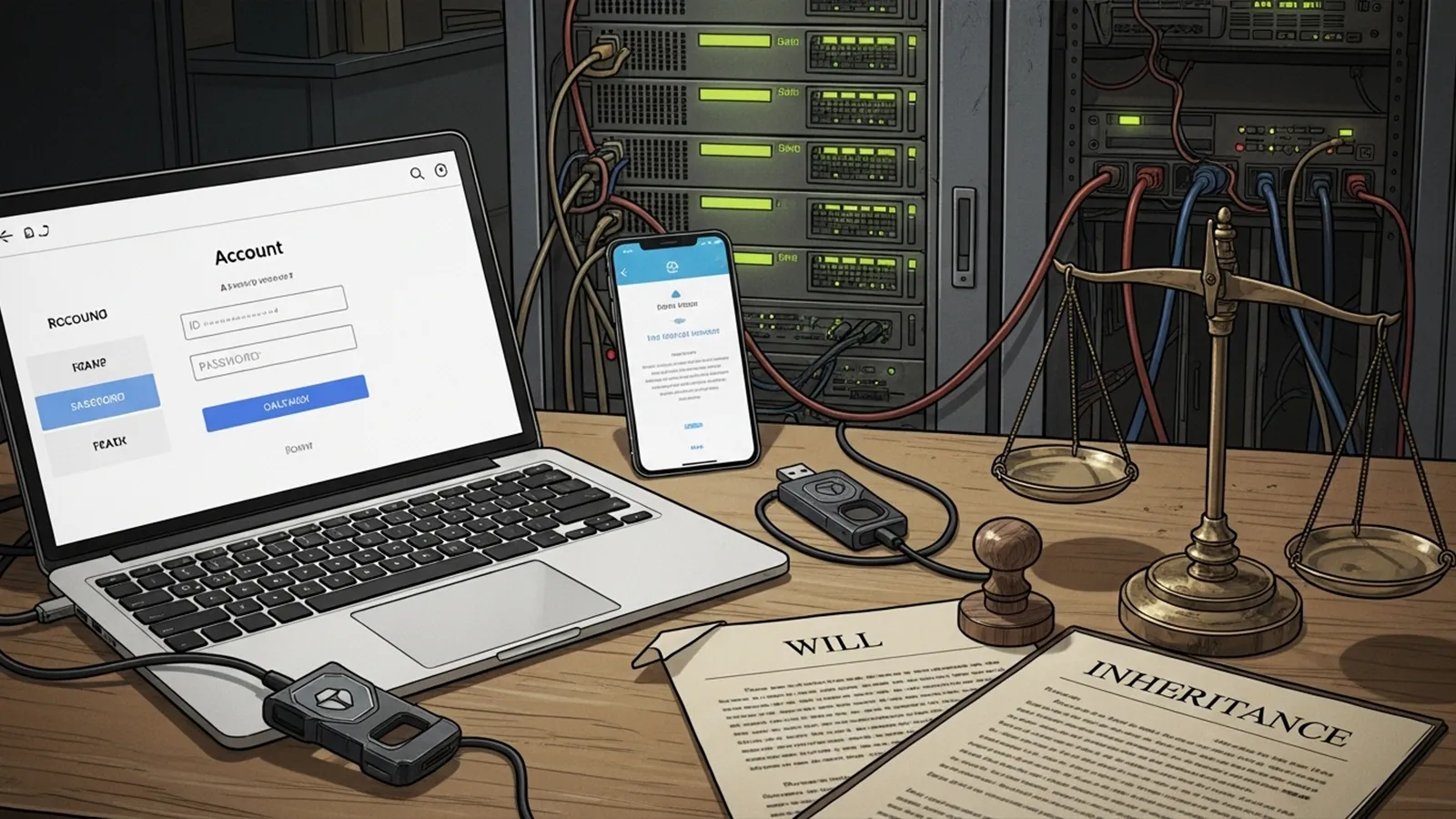

本人同意のない顔認証・追跡

街中や店舗で、利用者に知らせることなく顔認証を行い、行動履歴を記録・追跡する行為は、プライバシー権の侵害として問題視されています。特に、複数のカメラネットワークで個人を追跡できる仕組みは、「常に見られている」という監視社会の象徴とも言えます。

感情推定や”怪しさ”のスコア化

AIが表情や動作から「怪しい」「危険」といったスコアを付与する技術も開発されていますが、科学的根拠が不十分であり、誤判定や偏見の助長につながるリスクが指摘されています。たとえば、特定の人種や服装に対してAIが不当に高いリスクスコアを与える可能性があります。

ブラックリスト照合による差別

過去に万引きをした人物の顔データを登録し、再入店時に警告を出す仕組みは、一見合理的に思えます。しかし、誤認逮捕のリスクや、刑期を終えた人への過剰な監視といった人権上の問題があり、慎重な議論が必要です。

社会実装における課題とリスク

AI防犯カメラの導入が進む中で、技術そのものだけでなく、その運用ルールが不十分であることが大きな課題となっています。

プライバシー侵害の懸念

撮影された映像や抽出された顔データが、どこに保存され、誰がアクセスでき、いつ削除されるのか。こうした情報が不透明なままでは、市民の不安は解消されません。

アルゴリズムの透明性欠如

AIがどのような基準で「不審」と判断しているのか、その仕組みが公開されていないケースがほとんどです。ブラックボックス化されたAIは、誤判定が起きても原因究明が困難であり、説明責任を果たせません。

データの目的外利用

防犯目的で収集されたデータが、マーケティングや人事評価など別の目的に転用されるリスクも存在します。企業が顧客の行動データを無断で分析・販売する事例も報告されています。

監視社会化への懸念

AI防犯カメラが社会全体に行き渡ると、「常に監視されている」という意識が市民の行動を萎縮させる可能性があります。これは、自由な表現や行動を抑制する社会的圧力となり得ます。

どこまで許されるのか ― 線引きの考え方

では、AI防犯カメラの「許される範囲」はどのように考えるべきでしょうか。ここでは、いくつかの判断軸を提示します。

目的の正当性と手段の妥当性

まず問うべきは、「なぜそれが必要なのか」です。犯罪予防という目的は正当ですが、そのために全市民を常時監視する必要があるのか。目的と手段のバランスが取れているかが重要です。

個人識別をしない設計の優先

可能な限り、個人を特定しない形での運用を優先すべきです。たとえば、混雑検知や転倒検知は、顔を識別しなくても実現できます。技術的に可能だからといって、すべての機能を使う必要はありません。

データの自動削除と目的限定

収集したデータは、必要な期間を過ぎたら自動的に削除する仕組みを導入すべきです。また、防犯目的で集めたデータを他の用途に転用しないという目的限定の原則も不可欠です。

透明性のある運用と市民への説明

AI防犯カメラを設置する際は、設置場所・目的・データの扱い方を明示し、市民に説明する責任があります。不透明な運用は不信を生み、社会的合意を得られません。

※(図:許容/非許容領域のマップ)

縦軸:公共利益の大きさ / 横軸:個人識別の度合い

→ 高公益×低識別:許容されやすい / 低公益×高識別:許容されにくい

まとめ:技術の進化と自由のバランスを問い直す

AI防犯カメラは、犯罪抑止や安全確保において大きな可能性を秘めた技術です。しかし、その力が強大であるがゆえに、使い方次第で社会を守る盾にも、自由を奪う剣にもなり得ます。

技術そのものに善悪はありません。問われるべきは、私たち社会が「どのような目的で」「どこまでの範囲で」「どのような透明性をもって」この技術を使うのか、という合意形成のプロセスです。

AI防犯カメラの普及が進む今こそ、技術と自由の境界線をどこに引くべきかを、一人ひとりが考える時です。

【テーマ】

近年急速に普及している「AI防犯カメラ」を題材に、

**AI技術が社会にもたらす利点とリスクを整理し、

“どこまで許されるのか” の線引きを冷静に考察する記事**を書いてください。

【目的】

– AI防犯カメラの技術・仕組み・活用場面をわかりやすく伝える

– 利便性だけでなく、プライバシー・監視社会・差別リスクを公平に論じる

– 読者に「AIと社会の境界をどう考えるべきか」という視点を提供する

【読者像】

– 一般社会人、学生、行政・企業の情報管理担当者

– 防犯カメラのAI化をニュースで聞いたことがあるが詳しくは知らない層

– AIの社会実装・倫理・プライバシー問題に関心がある人

【記事構成】

1. **導入(問題提起)**

– AI防犯カメラの普及が急速に進んでいる背景

– なぜ今これが議論になるのか(犯罪対策・人手不足・技術進化)

– 「どこまで許されるのか」という疑問が生まれていることを提示する

2. **AI防犯カメラの仕組みと現在できること**

– 人物検知・不審行動検知・ナンバープレート認識など

– 顔認証や属性推定(年齢・性別の推定など)の技術も紹介

– 映像解析AIの一般的な仕組みを一文で補足

※(図:AI映像解析の基本フロー)

3. **許容されやすい用途(社会的合意が得られやすい領域)**

– 犯罪の未然防止

– 転倒検知・火災検知など安全向上

– 混雑度の計測など個人特定を伴わない分析

– 公共利益が大きいことを明示

4. **許容されにくい用途(社会的抵抗が大きい領域)**

– 本人同意のない顔認証や追跡

– 感情推定や“怪しい行動”のスコア化

– ブラックリスト照合による差別リスク

– 誤認や偏見の強化につながる点を指摘

5. **社会実装の課題とリスク**

– プライバシー侵害の懸念

– アルゴリズムの透明性欠如

– データ保存期間・利用範囲の曖昧さ

– 監視社会化の問題

– 公共・企業で導入する際のルール整備の必要性

6. **どこまで許されるのか ― 線引きの考え方**

– “目的の正当性” と “手段の妥当性” のバランス

– 個人識別をしない設計の重要性

– データの自動削除や目的限定の原則

– 社会が合意できる“透明性のある運用”が鍵になる

※(図:許容/非許容領域のマップ)

7. **まとめ**

– AIは防犯に貢献し得るが、“使い方” がすべてを左右する

– 技術と自由のバランスをどう取るかを、読者にも考えてもらう形で締める

【文体・トーン】

– です・ます調

– 感情的になりすぎず、冷静で中立

– 専門用語には一文の補足を必ずつける

– 恐怖を煽らず、事実関係を丁寧に説明する

【出力形式】

– Markdown形式

– 小見出し(###)を多めに使用

– 文字数は **2000〜2500字** を目安

– 記事末尾に「タイトル案」を **3つ** 提示する

【補足指示】

– 技術構成図や概念説明が有効な箇所では、

※(図:AI防犯カメラの判断プロセス)

のようにコメントを入れてよい(実際の画像は不要)。

【バージョン情報の出力】

記事本文とタイトル案のあとに必ず以下の形式で追記してください。

(不明な項目は「不明」と記載)

—

**AIバージョン情報**

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

—

【参考タイトル】

「AI防犯カメラはどこまで許されるのか ― 技術と自由の“境界線”を考える」

## 導入:急速に広がる”監視の目”と問われる境界線

コンビニエンスストア、駅構内、商業施設――私たちの日常空間に、いつの間にか「AI防犯カメラ」が増えています。従来の録画機能だけでなく、人物の動きを検知し、不審行動を自動で判別し、場合によっては顔を識別する。こうした技術は、人手不足が深刻化する現場での防犯業務を効率化し、犯罪の未然防止に貢献すると期待されています。

しかし同時に、「知らない間に顔を記録されているのでは」「AIが私たちを評価しているのでは」という不安の声も広がっています。技術の進化は確かに社会を便利にしますが、その一方で「監視社会化」や「プライバシー侵害」といった重大なリスクも内包しています。

では、AI防犯カメラは社会にとって「どこまで許されるのか」。本記事では、技術の仕組みと実際の用途を整理しながら、利便性とリスクのバランスをどう取るべきかを冷静に考察します。

## AI防犯カメラの仕組みと現在できること

AI防犯カメラとは、カメラで撮影した映像をAIが解析し、特定の情報を抽出・判断する仕組みを持つシステムです。従来の「録画して後で確認する」カメラとは異なり、**リアルタイムで状況を判断し、通知や記録を行う**点が特徴です。

### 主な機能

– **人物検知**:映像内に人がいるかを判別し、動きを追跡

– **不審行動検知**:長時間の滞留、急な走り出し、転倒などを検出

– **ナンバープレート認識**:車両を識別し、入退場管理や盗難車両の発見に活用

– **顔認証**:事前に登録された顔画像と照合し、本人確認や要注意人物の検知を行う

– **属性推定**:性別や年齢層などを推定し、マーケティングデータとして利用される場合もある

※(図:AI映像解析の基本フロー)

カメラ映像 → 物体検出(人・車など) → 特徴抽出(顔・動き) → AIモデルによる判定 → アラート/記録

これらの技術は、**ディープラーニング(深層学習)**と呼ばれる機械学習技術を用いており、大量の画像データから「何が映っているか」を学習することで高精度な判断を実現しています。

## 許容されやすい用途:公共利益が明確な領域

AI防犯カメラの中には、社会的な合意が得られやすい用途も存在します。これらに共通するのは、**個人を特定しない**、あるいは**明確な公共の安全に資する**という点です。

### 犯罪の未然防止

駅や商業施設での不審な動きを検知し、警備員に通知することで、犯罪を未然に防ぐ取り組みが進んでいます。たとえば、長時間同じ場所に立ち止まる、複数回同じエリアを往復するといった行動パターンを検出する仕組みです。

### 安全確保のための検知機能

高齢者施設や駅ホームでの転倒検知、工場での火災・煙の自動検出など、**人命に直結する安全対策**としてのAI活用は社会的に受け入れられやすい傾向にあります。

### 匿名化された統計情報の取得

店舗の混雑度や人の流れを計測し、サービス改善に活かす用途も一般的です。この場合、**個人を識別せず、統計情報のみを扱う**ため、プライバシー侵害のリスクは比較的低いとされています。

## 許容されにくい用途:抵抗感が強い領域

一方で、技術的には可能であっても、社会的に強い抵抗や懸念が示される用途も存在します。

### 本人同意のない顔認証・追跡

街中や店舗で、利用者に知らせることなく顔認証を行い、行動履歴を記録・追跡する行為は、**プライバシー権の侵害**として問題視されています。特に、複数のカメラネットワークで個人を追跡できる仕組みは、「常に見られている」という監視社会の象徴とも言えます。

### 感情推定や”怪しさ”のスコア化

AIが表情や動作から「怪しい」「危険」といったスコアを付与する技術も開発されていますが、**科学的根拠が不十分**であり、誤判定や偏見の助長につながるリスクが指摘されています。たとえば、特定の人種や服装に対してAIが不当に高いリスクスコアを与える可能性があります。

### ブラックリスト照合による差別

過去に万引きをした人物の顔データを登録し、再入店時に警告を出す仕組みは、一見合理的に思えます。しかし、**誤認逮捕のリスク**や、**刑期を終えた人への過剰な監視**といった人権上の問題があり、慎重な議論が必要です。

## 社会実装における課題とリスク

AI防犯カメラの導入が進む中で、技術そのものだけでなく、その**運用ルール**が不十分であることが大きな課題となっています。

### プライバシー侵害の懸念

撮影された映像や抽出された顔データが、どこに保存され、誰がアクセスでき、いつ削除されるのか。こうした情報が不透明なままでは、市民の不安は解消されません。

### アルゴリズムの透明性欠如

AIがどのような基準で「不審」と判断しているのか、その仕組みが公開されていないケースがほとんどです。**ブラックボックス化されたAI**は、誤判定が起きても原因究明が困難であり、説明責任を果たせません。

### データの目的外利用

防犯目的で収集されたデータが、マーケティングや人事評価など**別の目的に転用される**リスクも存在します。企業が顧客の行動データを無断で分析・販売する事例も報告されています。

### 監視社会化への懸念

AI防犯カメラが社会全体に行き渡ると、「常に監視されている」という意識が市民の行動を萎縮させる可能性があります。これは、**自由な表現や行動を抑制する**社会的圧力となり得ます。

## どこまで許されるのか ― 線引きの考え方

では、AI防犯カメラの「許される範囲」はどのように考えるべきでしょうか。ここでは、いくつかの判断軸を提示します。

### 目的の正当性と手段の妥当性

まず問うべきは、**「なぜそれが必要なのか」**です。犯罪予防という目的は正当ですが、そのために全市民を常時監視する必要があるのか。目的と手段のバランスが取れているかが重要です。

### 個人識別をしない設計の優先

可能な限り、**個人を特定しない形での運用**を優先すべきです。たとえば、混雑検知や転倒検知は、顔を識別しなくても実現できます。技術的に可能だからといって、すべての機能を使う必要はありません。

### データの自動削除と目的限定

収集したデータは、**必要な期間を過ぎたら自動的に削除**する仕組みを導入すべきです。また、防犯目的で集めたデータを他の用途に転用しないという**目的限定の原則**も不可欠です。

### 透明性のある運用と市民への説明

AI防犯カメラを設置する際は、**設置場所・目的・データの扱い方を明示**し、市民に説明する責任があります。不透明な運用は不信を生み、社会的合意を得られません。

※(図:許容/非許容領域のマップ)

縦軸:公共利益の大きさ / 横軸:個人識別の度合い

→ 高公益×低識別:許容されやすい / 低公益×高識別:許容されにくい

## まとめ:技術の進化と自由のバランスを問い直す

AI防犯カメラは、犯罪抑止や安全確保において大きな可能性を秘めた技術です。しかし、その力が強大であるがゆえに、**使い方次第で社会を守る盾にも、自由を奪う剣にもなり得ます**。

技術そのものに善悪はありません。問われるべきは、私たち社会が「どのような目的で」「どこまでの範囲で」「どのような透明性をもって」この技術を使うのか、という合意形成のプロセスです。

AI防犯カメラの普及が進む今こそ、技術と自由の境界線をどこに引くべきかを、一人ひとりが考える時です。

—

## タイトル案

1. **AI防犯カメラはどこまで許されるのか ― 技術と自由の”境界線”を考える**

2. **見守る目か、監視の目か ― AI防犯カメラが問う社会の選択**

3. **防犯カメラのAI化で何が変わる?利便性とリスクの境界を探る**

—

## AIバージョン情報

– **ベンダー**: Anthropic

– **モデル名**: Claude

– **モデルバージョン**: Claude 3.7 Sonnet

– **回答日時**: 2025年12月2日

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。