AIの技術が急速に進化する中で、「AI規制は技術革新を止めてしまうのではないか」という不安を抱く人は少なくありません。生成AIの登場により創作や業務の効率化が進む一方で、プライバシー侵害や誤情報の拡散といった懸念も生まれ、世界各国でAI規制の議論・導入が加速しています。本記事では規制の是非を論じるのではなく、技術・社会実装・産業構造・権力集中という観点から、AI規制が実際に何を止め、何を止めていないのかを構造的に整理します。

AI規制が直接的に制限しているもの

多くのAI規制は、技術そのものではなく、その「利用」や「運用」を対象としています。たとえばEUのAI法では、AIの用途をリスクに応じて分類し、特に高リスクなシステム(生体認証、信用スコアリング、採用支援AIなど)に対して厳格な審査や透明性の確保を義務付けています。

規制の主な焦点

- 責任の所在が不明確な利用

- 社会的リスクの高い用途(監視、軍事利用など)

- ブラックボックス型の決定プロセスによる不透明な影響

これらが規制対象になりやすいのは、現代社会において技術の影響が個人の権利や社会の安定に直接関わるためです。規制は、権力の偏在を防ぎ、社会全体のバランスを保つための仕組みとして機能しています。

AI規制が止めていないもの

一方で、基礎研究、先端モデルの改良、安全性研究などは規制によってむしろ強化される傾向にあります。多くの国でAIの安全性向上(アライメント研究など)への投資が継続・拡大しており、規制の枠組みの中で新たな研究領域が生まれています。

規制下でも進む領域

- 基礎的なアルゴリズム研究

- 説明可能AI(XAI)の開発

- 安全性・信頼性向上のための研究

- 国家や大規模機関による長期投資

つまり「全体が止まっているように見えて、実はリスクの低い、あるいは社会的に望ましい方向で進んでいる」という構造が見て取れます。

規制が生む副作用と力学の変化

規制対応には多額のコストがかかるため、大企業が有利になりやすい構造が生まれます。コンプライアンスのための審査体制、データ管理、報告義務などが、小規模スタートアップや個人の参入障壁となるケースが増えています。

主な影響

- 技術開発の担い手が大企業・大組織に集中する傾向

- 新規参入の難易度上昇によるイノベーションの多様性低下の可能性

- 安全確保と引き換えに、実験的・破壊的なイノベーションが抑制される可能性

結果として、技術発展のスピード自体は維持されつつ、その「誰が」「どの方向に」進めるかという担い手と方向性が大きく選別される状況が生まれています。

規制がなかった場合に起こり得る未来

もし規制がほとんど存在しなかった場合、短期的には爆発的な社会実装と競争が起きるでしょう。しかし同時に、事故・不祥事・権利侵害が頻発し、市民社会からの強い反発を招く可能性が高いです。

過去の技術史を見ても、無秩序な展開が続いた後に社会的信頼を失い、結果的に厳しい規制や技術全体への拒否反応が生まれた事例は少なくありません。適切な規制は、ある意味で「技術そのものを長期的に守る」役割も果たしていると言えます。

まとめ:規制は「どの未来を選ぶ装置」なのか

AI規制は技術発展を単純に止めるものではなく、むしろ発展の方向性と担い手を強く選別している装置であると考えられます。リスク管理とイノベーションのバランス、安全と多様性のトレードオフ、集中と分散の力学——これらを同時に動かしているのが現在のAI規制の本質です。

私たちは「規制=敵か味方か」という二元論ではなく、「この規制はどのような未来を優先し、どのような未来を後回しにしているのか」という視点で捉え直す必要があるのではないでしょうか。

【テーマ】

各国・各地域で進みつつあるAI規制は、

技術発展を本当に止めるのか、それとも別の形で方向づけているのかについて、

技術・社会実装・産業構造・権力集中という観点から、

AIの視点で冷静かつ構造的に考察してください。

【目的】

– 「規制=技術のブレーキ」「規制=悪」といった単純な善悪論を避ける

– AI規制が「何を止め、何を止めていないのか」を整理する

– 規制が技術発展のスピード・担い手・方向性に与える影響を可視化する

– 読者がAI規制を感情ではなく構造として理解するための視点を提供する

【読者像】

– 一般社会人(20〜60代)

– AIやテクノロジーに強い関心はないが、社会への影響が気になっている層

– ビジネス・行政・教育などでAI活用の話題に触れている人

– 「AI規制は必要なのか?」という漠然とした疑問を持つ人

【記事構成】

1. 導入(問題提起)

– 「AI規制は技術革新を止めてしまうのではないか」という直感的な不安を提示する

– なぜ今、世界的にAI規制が議論・導入されているのかを簡潔に整理する

– 本記事では是非ではなく「規制が何を起こしているのか」を構造的に考えることを示す

2. AI規制が直接的に制限しているもの

– 規制の対象が「技術そのもの」ではなく「利用・運用」である点を整理する

– 無制限な実装、責任不明確な利用、社会的リスクの高い用途について説明する

– なぜこれらが規制対象になりやすいのかを社会構造の観点から示す

3. AI規制が止めていないもの

– 基礎研究、モデル改良、安全性研究などが引き続き進んでいる点を整理する

– 規制が研究開発の正当性や予算配分に与える影響に触れる

– 「止まっているように見えて、実は別の場所で進んでいる」構造を説明する

4. 規制が生む副作用と力学の変化

– 規制対応コストがもたらす大企業有利・小規模不利の構造を整理する

– 技術の集中化、寡占化が進む可能性について触れる

– 規制が「安全」と引き換えに何を失わせる可能性があるのかを示す

5. 規制がなかった場合に起こり得る未来

– 規制不在がもたらす社会的反発や信頼崩壊のリスクを整理する

– 不祥事や事故が技術全体への拒否感につながる構造を説明する

– 規制が技術を守る役割を果たす側面にも触れる

6. まとめ

– AI規制は技術発展を止めるのではなく、方向と担い手を選別している可能性を再確認する

– 読者が「規制=敵か味方か」ではなく、「どの未来を選ぶ装置なのか」と考えられる形で締めくくる

– 明確な結論を断定せず、思考の余白を残して終える

【文体・トーン】

– です・ます調

– 煽情的・断定的な表現は避ける

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 評価ではなく「構造の整理」を重視する

【執筆スタンス】

– 本記事は、正解や結論を提示するものではなく考察である

– 特定の国家・企業・立場を批判・擁護しない

– 読者が自分の判断軸を持つための材料を提供することを目的とする

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を含めること

– 参考タイトルと同一、または類似度の高い表現は禁止

【補足指示】

– 構造整理が有効な箇所では、以下のようなコメントを挿入してよい

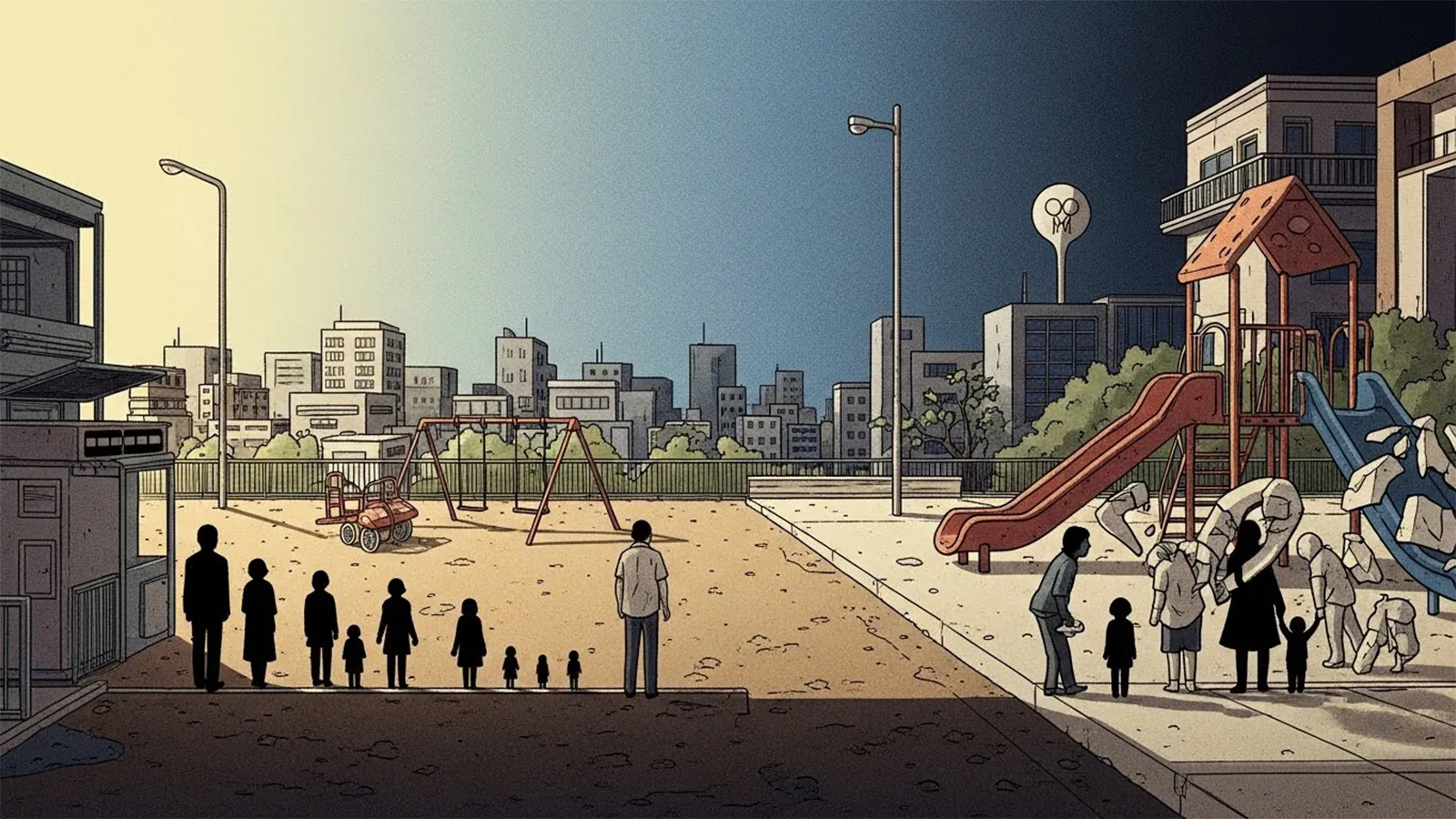

※(図:AI規制が影響する領域と影響しない領域)

※(図:規制による技術集中の構造)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AI規制は技術革新の敵なのか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

AIの技術が急速に進化する中で、「AI規制は技術革新を止めてしまうのではないか」という不安を抱く人は少なくありません。たとえば、生成AIの登場により、創作や業務の効率化が進む一方で、プライバシー侵害や誤情報の拡散といった懸念も生まれています。このような背景から、世界各国でAI規制の議論が活発化しています。欧州連合(EU)ではAI法が施行され、米国や中国でも関連法の整備が進んでいます。これらの規制は、AIのリスクを管理するためのものです。

本記事では、規制の是非を論じるのではなく、AI規制が技術発展にどのような影響を与えているのかを、技術・社会実装・産業構造・権力集中という観点から構造的に考察します。読者の皆さんが、感情的な反応ではなく、規制の仕組みを理解するための視点を得られることを目指します。

### AI規制の背景と目的

なぜ今、AI規制が各国で導入されているのでしょうか。AI技術の社会実装が進むにつれ、技術の誤用による社会的影響が顕在化しています。たとえば、ディープフェイク(AIによる偽の画像や動画生成技術)を使った詐欺や、バイアス(偏り)のあるAIによる差別的な判断が問題視されています。これに対し、規制はAIの安全性を確保し、社会の信頼を維持することを目的としています。

しかし、規制は技術そのものを止めるものではなく、主に運用面を対象としています。ここでは、規制が何を制限し、何を制限していないのかを整理していきます。

### AI規制が直接的に制限しているもの

AI規制の多くは、技術そのものではなく、その利用や運用を対象としています。たとえば、EUのAI法では、リスクの高い用途を分類し、高リスクAI(例:生体認証システムや信用評価AI)に対して厳格な審査を義務付けています。これにより、無制限な社会実装が制限されます。

具体的には、責任の不明確な利用が規制の焦点です。AIの決定プロセスがブラックボックス(内部が不透明)である場合、誰が責任を負うのかが曖昧になりやすいため、透明性の確保が求められます。また、社会的リスクの高い用途、たとえば軍事利用や監視システムでのAI活用が制限される傾向があります。

これらが規制対象になりやすい理由は、社会構造の観点から説明できます。現代社会では、技術の影響が個人の権利や社会の安定に直結するため、権力集中を防ぐための仕組みが必要です。規制は、技術が一部の組織に偏って利用されるのを防ぎ、社会全体のバランスを保つ役割を果たしています。

※(図:AI規制の対象領域―利用・運用中心の制限)

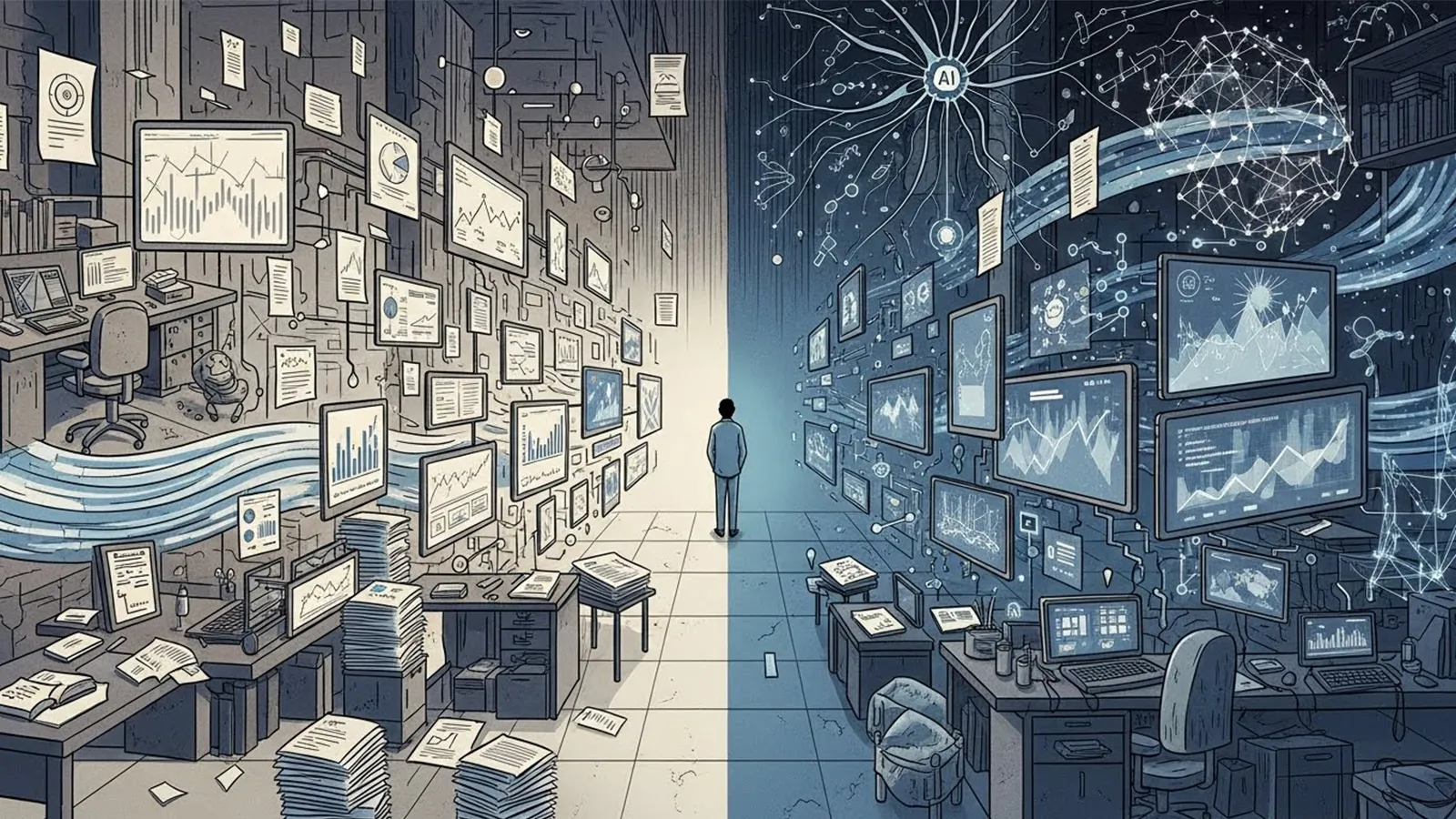

### AI規制が止めていないもの

一方で、AI規制はすべての技術発展を止めているわけではありません。基礎研究やモデル改良は、むしろ奨励される場合が多いです。たとえば、AIの安全性研究(例:アライメント研究、AIが人間の価値観に沿うようにする取り組み)は、規制の枠組みの中で活発化しています。

規制は研究開発の正当性に影響を与え、予算配分を安全志向の分野へシフトさせる可能性があります。米国では、国家レベルでAI研究への投資が継続されており、規制があってもイノベーションが止まらない構造が見られます。つまり、「止まっているように見えて、実は別の場所で進んでいる」状況です。技術の観点では、規制がリスクの高い用途を避け、持続可能な発展を方向づけていると言えます。

産業構造としても、大規模な研究機関や大学での基礎研究は規制の影響を受けにくく、むしろ規制対応のための技術開発(例:説明可能AI、決定プロセスを説明できるAI)が新たな成長分野を生んでいます。

※(図:規制が止めていない領域―基礎研究と安全性向上の継続)

### 規制が生む副作用と力学の変化

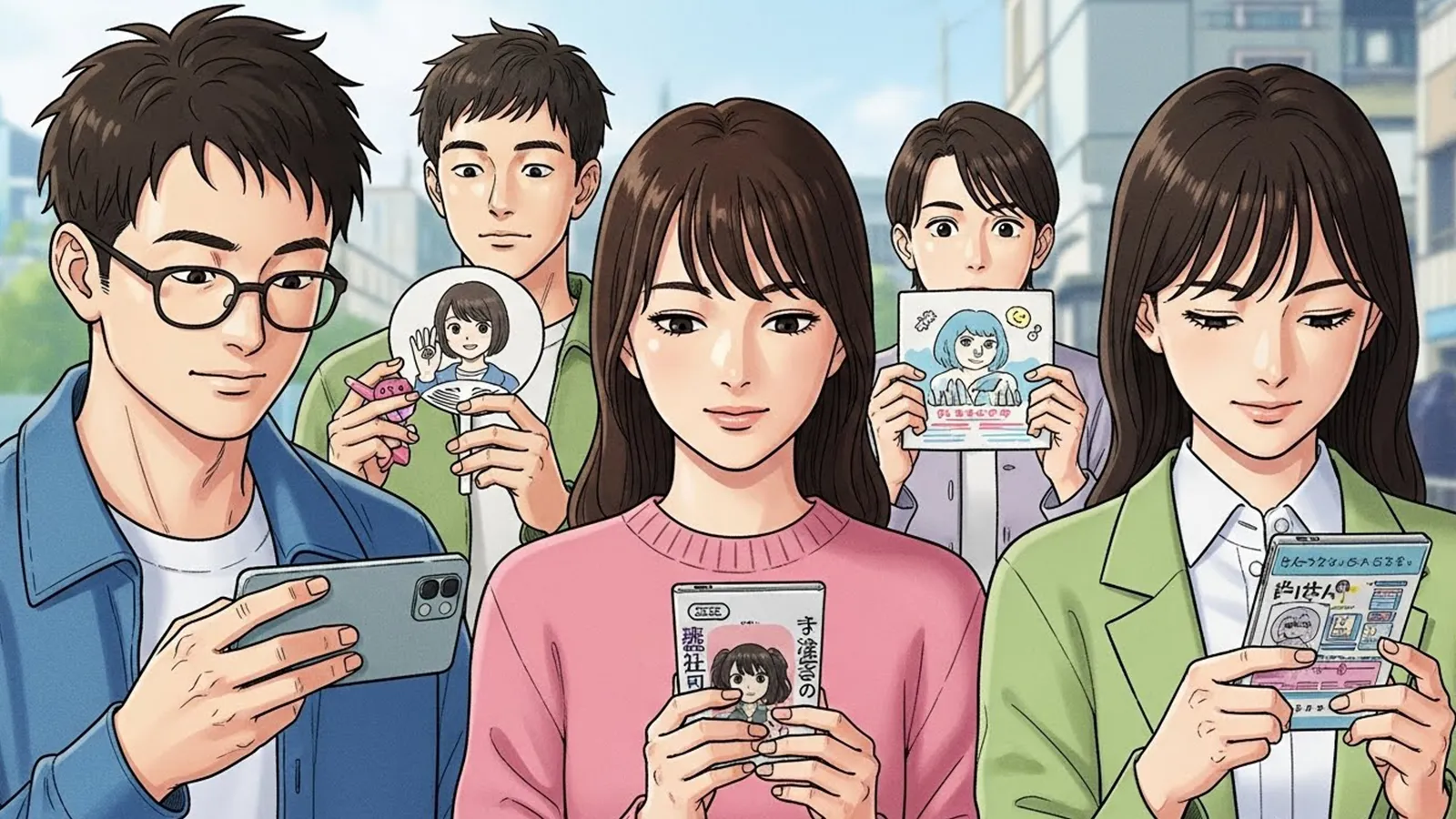

規制は意図せぬ副作用を生む可能性もあります。規制対応にはコストがかかるため、大企業が有利になり、小規模企業やスタートアップが不利になる構造が生まれやすいです。たとえば、コンプライアンス(法令遵守)のための審査やデータ管理が、資金力の乏しい組織の参入障壁となります。

これにより、技術の集中化や寡占化が進む恐れがあります。権力集中の観点では、規制が大手の優位性を強め、AIの担い手が限定的になる可能性を指摘できます。結果として、技術発展のスピードは維持されつつ、方向性が大企業の利益に沿ったものになるかもしれません。

また、規制が「安全」と引き換えに、多様なイノベーションを失わせる側面もあります。社会実装の観点では、規制が革新的な用途を遅らせる一方で、標準化された技術の普及を促進する力学が見られます。

※(図:規制による技術集中の構造―大企業有利のシフト)

### 規制がなかった場合に起こり得る未来

もしAI規制がなかった場合、どのような未来が考えられるでしょうか。規制不在では、技術の急速な社会実装が進む一方で、社会的反発が生じやすいです。たとえば、AIによる事故や不祥事が頻発すれば、技術全体への信頼崩壊を招く可能性があります。

社会的観点では、プライバシー侵害や格差拡大が深刻化し、反AI運動が強まる構造が想定されます。産業構造としても、無規制状態が短期的な競争を激化させるものの、長期的には信頼の喪失が投資を減少させるリスクがあります。

一方で、規制は技術を守る役割も果たします。適切な規制が、AIの社会的受容を高め、持続的な発展を支える側面があるのです。つまり、規制不在は自由な発展を許す代わりに、全体の停滞を招く可能性を秘めています。

### まとめ:規制の役割を再考する

AI規制は、技術発展を単純に止めるものではなく、方向性と担い手を選別している可能性が高いです。技術・社会実装・産業構造・権力集中の観点から見ると、規制はリスクを管理しつつ、新たな力学を生んでいます。

読者の皆さんは、規制を「敵か味方か」と見るのではなく、「どの未来を選ぶ装置なのか」と捉える視点を持てるのではないでしょうか。最終的な判断は、各々が社会の文脈で考えるべきものです。

タイトル案

AI規制は技術の進路をどう変えるのか

AI規制がもたらす発展の形とは何か

AI規制は誰の未来を方向づけるのか

—

AIバージョン情報

– ベンダー: xAI

– モデル名: Grok 4

– モデルバージョン: 不明

– 回答日時: January 10, 2026 12:00 PM JST

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。

※ 編集注(MANA)

このAIは、規制を「技術管理の手段」だけでなく、産業構造や権力配分を調整する装置として描いています。そのため、規制が意図的に集中化を招いているようにも読める余地があります。規制の効果と副作用を切り分けながら読むことで、他AIとの視点差が把握しやすくなります。