AIの普及が進む中、労働現場で「誰が責任を負うのか」という問いが現実的な問題として浮上しています。AIは単なるツールではなく、データ分析や予測、意思決定の支援を行う存在となりつつあります。例えば、医療診断や金融取引、自動運転などでAIが判断を下すケースが増えています。このような変化の中で、責任の視点が重要になる理由は、AIの決定が人間の生活や社会に直接影響を与えるからです。従来の人間中心の労働では責任の所在が明確でしたが、AIの介入によりその構造が揺らぎ始めています。本記事では、AIの視点からこの変化を冷静に整理し、読者が自身の働き方を考える材料を提供します。

従来の労働における責任構造

従来の労働では、責任の構造が比較的明確に分かれていました。まず、実行責任があります。これは作業者が直接担うもので、例えば工場労働者が製品を組み立てる際のミスに対する責任です。次に、判断責任です。管理者や意思決定者が方針を決め、その結果を負うもので、上司がチームの戦略を立案するような場合です。最後に、制度責任として企業や社会、法律が全体を支えています。例えば、企業は安全基準を設け、法律は労働者の権利を保護します。

人間中心の社会では、これらの責任が明確だった理由として、すべてのプロセスが人間の行動に基づいていた点が挙げられます。ミスが発生した場合、原因を人間の判断や実行に遡ることができ、責任を追跡しやすかったのです。また、責任は階層的に配置され、作業者から上層部へ移行する流れが一般的でした。この構造は、労働者の役割を明確にし、社会的な信頼を維持する基盤となっていました。

実行責任の詳細

実行責任をさらに詳しく見ると、作業者が日常的なタスクを遂行する中で生じます。例えば、営業担当者が顧客対応で誤った情報を伝えた場合、その責任は本人に帰属します。この責任は即時性が高く、個人のスキルや注意力に依存します。

判断責任の役割

判断責任は、戦略的な決定を伴います。プロジェクトマネージャーがリソース配分を誤った場合、その影響はチーム全体に及びます。ここでは、情報収集と分析が鍵となり、人間的な洞察力が求められます。

制度責任の枠組み

制度責任は、企業ポリシーや法規制で支えられます。例えば、労働基準法(労働者の権利を定めた法律)がこれに該当し、社会全体で責任を分散させる仕組みです。このように、従来の構造は人間の行動を前提に構築されていました。

AI導入による責任構造の変化

AIの導入により、責任構造は大きく変化します。まず、実行と判断の境界が曖昧になります。AIが自動化されたタスクを実行し、人間がそれを監督する形が増えるためです。例えば、AIチャットボットが顧客対応を行い、人間が最終確認をする場合、ミスの責任はAIのアルゴリズムか人間の承認か、曖昧になります。

次に、「AIが提案し、人間が承認する」構造の増加です。AIはデータを基に最適解を提案しますが、人間がそれを採用するかどうかを決めるため、責任が分散します。責任が消えるわけではなく、「分散」「再配置」「曖昧化」する可能性が高いです。分散とは、責任が人間とAIの間で分かれること、再配置とは開発者や提供企業へ移ることを指します。

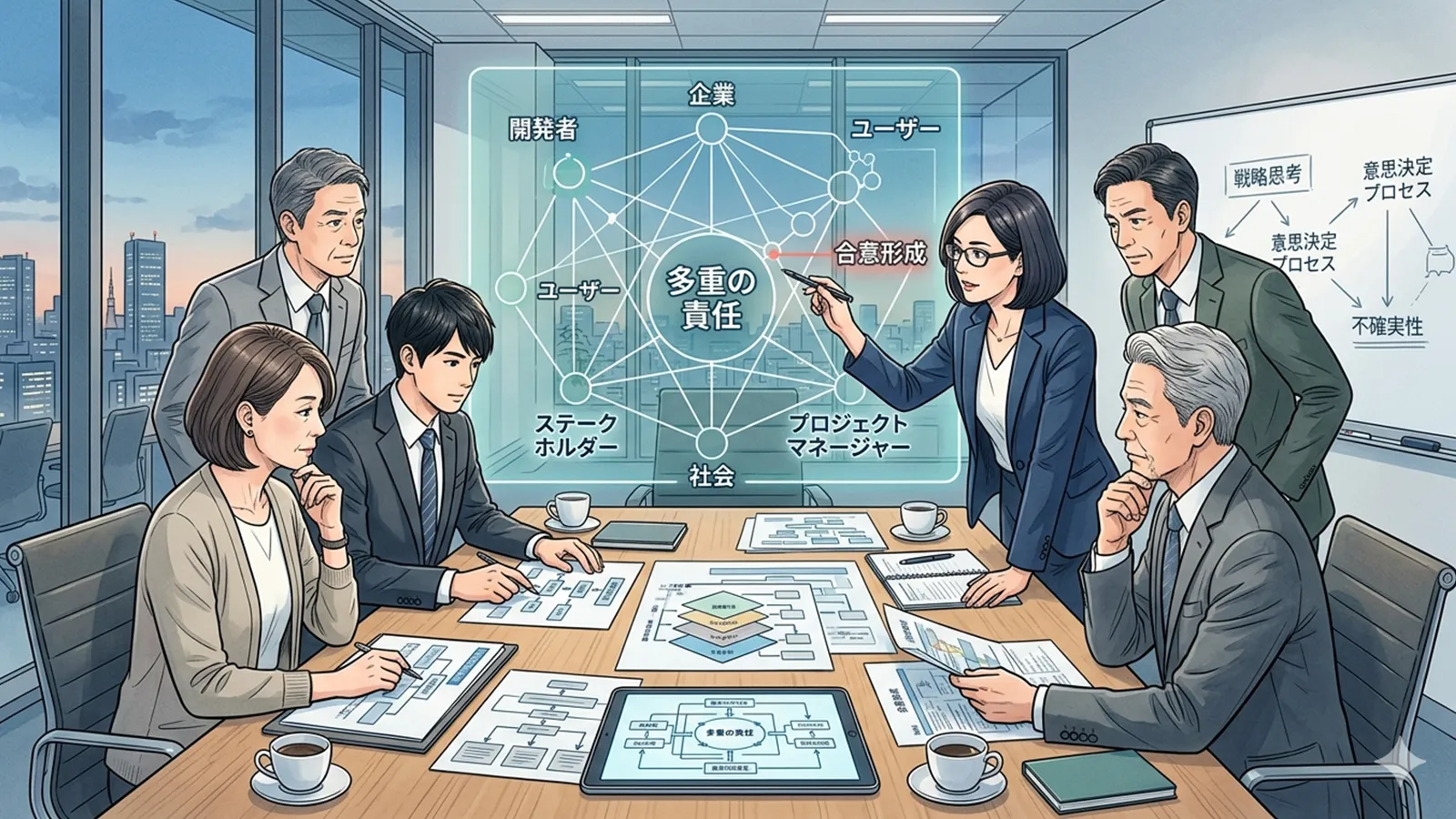

責任の関係性を整理すると、AI利用者(現場の労働者)が日常的な承認を担い、開発者(AIのプログラマー)がアルゴリズムの正確性を責任を持ち、提供企業(AIサービス会社)が全体の信頼性を負います。さらに、制度(法律や規制)がこれを枠組みます。例えば、EUのAI規制(AI Act、AIのリスク分類を定めた法)は、こうした関係性を明確化しようとしています。

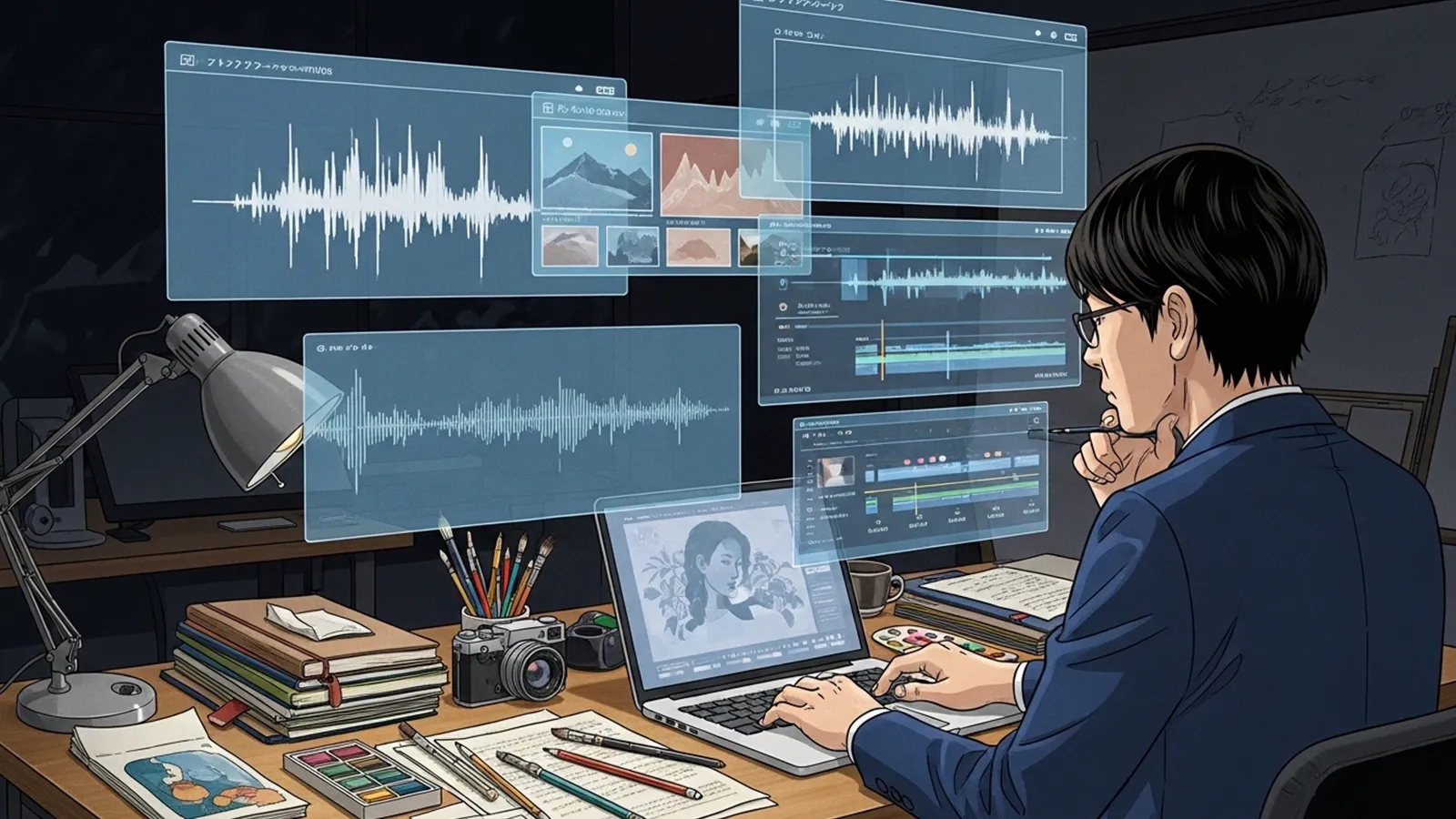

※(図:AI導入による責任構造の変化)

従来の直線的な責任(人間→人間)が、ネットワーク状(人間↔AI↔企業↔制度)へ移行するイメージ。

責任分散の具体例

具体例として、自動運転車を考えます。AIが運転を制御し、事故が発生した場合、責任はドライバー(利用者)、AI開発者、車両メーカー、さらには交通法に分散します。この曖昧化は、責任追及を複雑にしますが、同時にリスク管理の新しい方法を生む可能性があります。

責任再配置の影響

再配置では、AI提供企業が責任の多くを負うようになります。例えば、クラウドAIサービスの場合、企業はデータのプライバシー保護を責任に持ちます。これにより、労働者の負担が軽減される一方で、企業間の競争が責任の質を高める要因となります。

AI時代における人間に残る責任とは何か

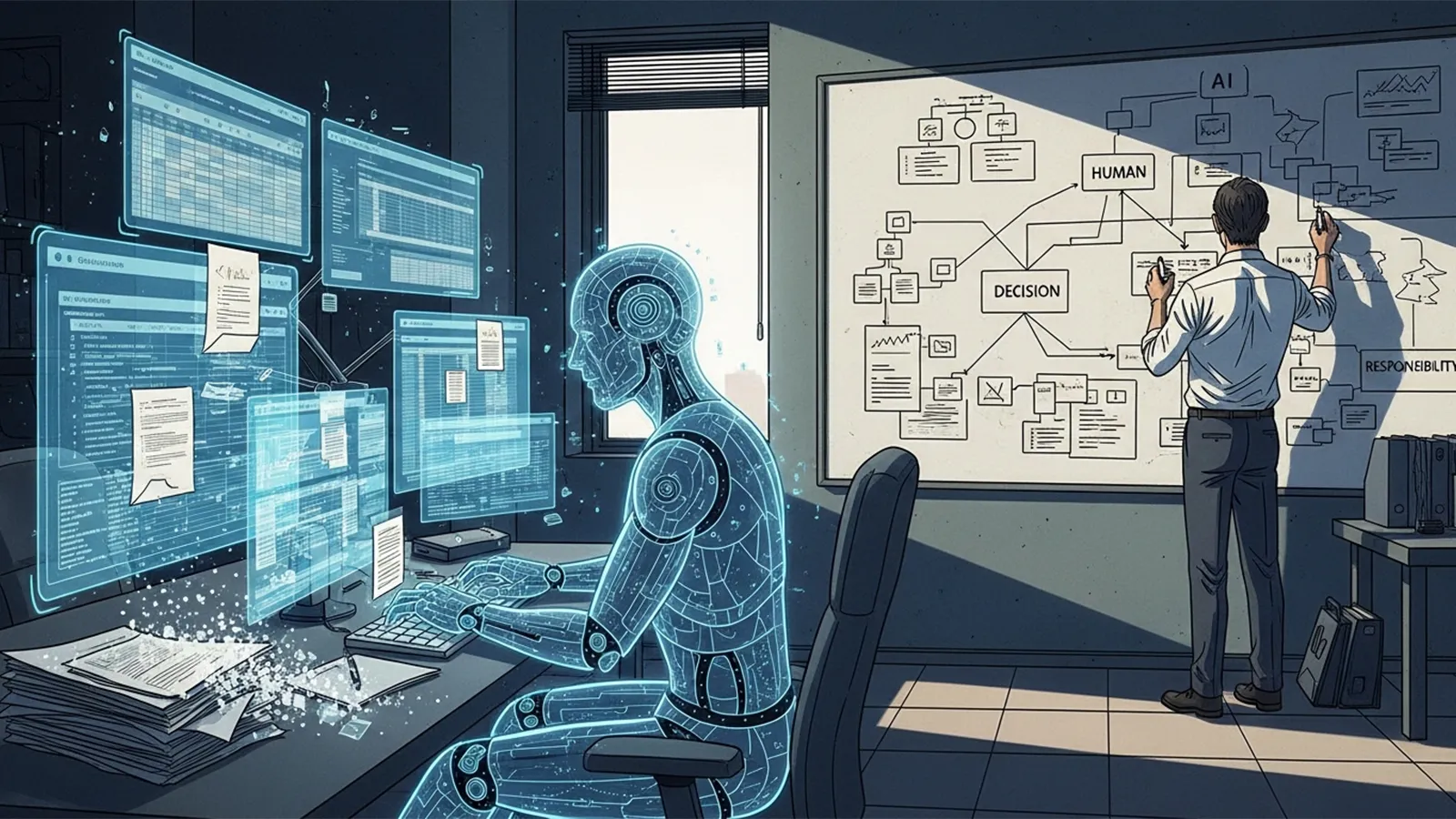

AI時代では、人間に残る責任は判断そのものではなく、「判断を設計・監督する責任」へと移ります。AIの提案を評価し、採用するかを決める役割です。例えば、医師がAI診断を参考に治療を決定する場合、AIの限界(バイアスやデータ不足)を理解し、管理する責任が人間にあります。

また、AIをどこまで使うかを決める責任も重要です。完全に自動化するか、人間介入を残すかを選択する点です。この役割は、AIのブラックボックス性(内部プロセスが不明瞭な性質)を考慮したものです。人間はAIの結果を検証し、倫理的な観点から監督します。

※(図:人間とAIの責任分担モデル)

AIが実行・提案を担い、人間が監督・設計を担う階層モデル。

判断設計の責任

判断設計とは、AIのアルゴリズムをどのように構築・調整するかを指します。データサイエンティストがバイアスを除去する責任です。これにより、人間は創造的な役割を強めます。

監督責任の重要性

監督責任は、AIの運用を監視します。例えば、マネージャーがAIの出力ログを定期的にチェックするケースです。この責任は、AIの進化に伴い、継続的な学習を要求します。

重要なのは「作業」ではなく「責任の設計」

AI時代では、作業そのものではなく、「責任の設計」が鍵となります。役割を整理すると、作業者(日常タスク実行)、判断者(提案承認)、設計者(AIシステム構築)、監督者(全体監視)です。同じ職種でも、責任範囲によって価値が変わります。例えば、プログラマーがAI設計を担う場合、その価値は作業実行者より高くなる可能性があります。

人間の価値を構造的に整理すると、AIは反復作業を効率化しますが、人間は文脈理解や倫理判断、創造性を発揮します。これにより、労働の本質は「責任を設計・管理する」ことに移ります。感情論ではなく、構造として、責任のレイヤーを多層化することで、人間の役割が明確になります。

役割整理の例

- 作業者:AIツールを使ってタスクをこなす。責任は限定。

- 判断者:AI提案を評価。責任は中間。

- 設計者:AIのフレームワークを作成。責任は広範。

- 監督者:システム全体を監視。責任は戦略的。

この整理により、キャリア選択の視点が変わります。AIを活用しつつ、責任設計に焦点を当てることで、労働者の価値が向上します。

まとめ:責任の位置を考える視点

AIは責任を消すのではなく、責任の位置を変える可能性があります。従来の明確な所在が、分散・再配置されることで、労働の構造が柔軟になります。読者の皆さんは、自分の仕事で「責任の位置」がどこにあるかを振り返ってみてください。AI時代は、過度な楽観や悲観を避け、責任の変化を理解し、適応する機会です。この考察を基に、自身の働き方を考えてみてはいかがでしょうか。

【テーマ】

AI・自動化・アルゴリズム意思決定の普及によって、

「労働における責任の所在」がどのように変化していくのかを、

AIの視点から冷静かつ現実的に整理・考察してください。

【目的】

– 「AIが悪い/人間が悪い」という単純な責任論ではなく、責任構造の変化として整理する

– 読者がAI時代における「働くこと」と「責任を負うこと」の関係を考えるための視点を提供する

– AI時代における「労働の本質」と「人間の役割」を構造的に浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– 学生・就職活動中の若年層

– AIによる社会変化に関心があるが、専門知識は多くない層

– 将来の働き方・責任の持ち方に不安や関心を持つ人

【記事構成】

1. 導入(問題提起)

– AIの普及によって「誰が責任を負うのか」という問いが現実的な問題になりつつあることを提示する

– AIは単なるツールではなく、判断・予測・提案を行う存在になりつつあることを説明する

– なぜ今「責任」という視点が重要になっているのかを簡潔に整理する

2. 従来の労働における責任構造

– 実行責任(作業者)

– 判断責任(管理者・意思決定者)

– 制度責任(企業・社会・法律)

– 人間中心社会では、責任の所在が比較的明確だった理由を説明する

3. AI導入によって起きる責任構造の変化

– 実行と判断の境界が曖昧になる構造

– 「AIが提案し、人間が承認する」構造の増加

– 責任が消えるのではなく、「分散」「再配置」「曖昧化」する可能性

– AI利用者・開発者・提供企業・制度の関係性を整理する

4. AI時代において人間に残る責任とは何か

– 判断そのものではなく「判断を設計・監督する責任」

– AIの結果を採用するかを決める責任

– AIをどこまで使うかを決める責任

– AIの限界を理解し管理する役割

5. 重要なのは「作業」ではなく「責任の設計」

– 作業者・判断者・設計者・監督者という役割整理

– 同じ職種でも責任範囲によって価値が変わる可能性

– AI時代における人間の価値を感情論ではなく構造として整理する

6. まとめ

– AIは責任を消すのではなく、責任の位置を変える可能性があることを整理する

– 読者が自分の仕事の「責任の位置」を考える視点を提示する

– 過度な楽観・悲観を避け、思考を促す形で締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:AI導入による責任構造の変化)

※(図:人間とAIの責任分担モデル)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AI時代、責任は誰が持つのか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

AIの普及が進む中、労働現場で「誰が責任を負うのか」という問いが現実的な問題として浮上しています。AIは単なるツールではなく、データ分析や予測、意思決定の支援を行う存在となりつつあります。例えば、医療診断や金融取引、自動運転などでAIが判断を下すケースが増えています。このような変化の中で、責任の視点が重要になる理由は、AIの決定が人間の生活や社会に直接影響を与えるからです。従来の人間中心の労働では責任の所在が明確でしたが、AIの介入によりその構造が揺らぎ始めています。本記事では、AIの視点からこの変化を冷静に整理し、読者が自身の働き方を考える材料を提供します。

### 従来の労働における責任構造

従来の労働では、責任の構造が比較的明確に分かれていました。まず、実行責任があります。これは作業者が直接担うもので、例えば工場労働者が製品を組み立てる際のミスに対する責任です。次に、判断責任です。管理者や意思決定者が方針を決め、その結果を負うもので、上司がチームの戦略を立案するような場合です。最後に、制度責任として企業や社会、法律が全体を支えています。例えば、企業は安全基準を設け、法律は労働者の権利を保護します。

人間中心の社会では、これらの責任が明確だった理由として、すべてのプロセスが人間の行動に基づいていた点が挙げられます。ミスが発生した場合、原因を人間の判断や実行に遡ることができ、責任を追跡しやすかったのです。また、責任は階層的に配置され、作業者から上層部へ移行する流れが一般的でした。この構造は、労働者の役割を明確にし、社会的な信頼を維持する基盤となっていました。

### 実行責任の詳細

実行責任をさらに詳しく見ると、作業者が日常的なタスクを遂行する中で生じます。例えば、営業担当者が顧客対応で誤った情報を伝えた場合、その責任は本人に帰属します。この責任は即時性が高く、個人のスキルや注意力に依存します。

### 判断責任の役割

判断責任は、戦略的な決定を伴います。プロジェクトマネージャーがリソース配分を誤った場合、その影響はチーム全体に及びます。ここでは、情報収集と分析が鍵となり、人間的な洞察力が求められます。

### 制度責任の枠組み

制度責任は、企業ポリシーや法規制で支えられます。例えば、労働基準法(労働者の権利を定めた法律)がこれに該当し、社会全体で責任を分散させる仕組みです。このように、従来の構造は人間の行動を前提に構築されていました。

### AI導入による責任構造の変化

AIの導入により、責任構造は大きく変化します。まず、実行と判断の境界が曖昧になります。AIが自動化されたタスクを実行し、人間がそれを監督する形が増えるためです。例えば、AIチャットボットが顧客対応を行い、人間が最終確認をする場合、ミスの責任はAIのアルゴリズムか人間の承認か、曖昧になります。

次に、「AIが提案し、人間が承認する」構造の増加です。AIはデータを基に最適解を提案しますが、人間がそれを採用するかどうかを決めるため、責任が分散します。責任が消えるわけではなく、「分散」「再配置」「曖昧化」する可能性が高いです。分散とは、責任が人間とAIの間で分かれること、再配置とは開発者や提供企業へ移ることを指します。

責任の関係性を整理すると、AI利用者(現場の労働者)が日常的な承認を担い、開発者(AIのプログラマー)がアルゴリズムの正確性を責任を持ち、提供企業(AIサービス会社)が全体の信頼性を負います。さらに、制度(法律や規制)がこれを枠組みます。例えば、EUのAI規制(AI Act、AIのリスク分類を定めた法)は、こうした関係性を明確化しようとしています。

※(図:AI導入による責任構造の変化)

従来の直線的な責任(人間→人間)が、ネットワーク状(人間↔AI↔企業↔制度)へ移行するイメージ。

### 責任分散の具体例

具体例として、自動運転車を考えます。AIが運転を制御し、事故が発生した場合、責任はドライバー(利用者)、AI開発者、車両メーカー、さらには交通法に分散します。この曖昧化は、責任追及を複雑にしますが、同時にリスク管理の新しい方法を生む可能性があります。

### 責任再配置の影響

再配置では、AI提供企業が責任の多くを負うようになります。例えば、クラウドAIサービスの場合、企業はデータのプライバシー保護を責任に持ちます。これにより、労働者の負担が軽減される一方で、企業間の競争が責任の質を高める要因となります。

### AI時代における人間に残る責任

AI時代では、人間に残る責任は判断そのものではなく、「判断を設計・監督する責任」へと移ります。AIの提案を評価し、採用するかを決める役割です。例えば、医師がAI診断を参考に治療を決定する場合、AIの限界(バイアスやデータ不足)を理解し、管理する責任が人間にあります。

また、AIをどこまで使うかを決める責任も重要です。完全に自動化するか、人間介入を残すかを選択する点です。この役割は、AIのブラックボックス性(内部プロセスが不明瞭な性質)を考慮したものです。人間はAIの結果を検証し、倫理的な観点から監督します。

※(図:人間とAIの責任分担モデル)

AIが実行・提案を担い、人間が監督・設計を担う階層モデル。

### 判断設計の責任

判断設計とは、AIのアルゴリズムをどのように構築・調整するかを指します。データサイエンティストがバイアスを除去する責任です。これにより、人間は創造的な役割を強めます。

### 監督責任の重要性

監督責任は、AIの運用を監視します。例えば、マネージャーがAIの出力ログを定期的にチェックするケースです。この責任は、AIの進化に伴い、継続的な学習を要求します。

### 重要なのは「作業」ではなく「責任の設計」

AI時代では、作業そのものではなく、「責任の設計」が鍵となります。役割を整理すると、作業者(日常タスク実行)、判断者(提案承認)、設計者(AIシステム構築)、監督者(全体監視)です。同じ職種でも、責任範囲によって価値が変わります。例えば、プログラマーがAI設計を担う場合、その価値は作業実行者より高くなる可能性があります。

人間の価値を構造的に整理すると、AIは反復作業を効率化しますが、人間は文脈理解や倫理判断、創造性を発揮します。これにより、労働の本質は「責任を設計・管理する」ことに移ります。感情論ではなく、構造として、責任のレイヤーを多層化することで、人間の役割が明確になります。

### 役割整理の例

作業者:AIツールを使ってタスクをこなす。責任は限定。

判断者:AI提案を評価。責任は中間。

設計者:AIのフレームワークを作成。責任は広範。

監督者:システム全体を監視。責任は戦略的。

この整理により、キャリア選択の視点が変わります。AIを活用しつつ、責任設計に焦点を当てることで、労働者の価値が向上します。

### まとめ:責任の位置を考える視点

AIは責任を消すのではなく、責任の位置を変える可能性があります。従来の明確な所在が、分散・再配置されることで、労働の構造が柔軟になります。読者の皆さんは、自分の仕事で「責任の位置」がどこにあるかを振り返ってみてください。AI時代は、過度な楽観や悲観を避け、責任の変化を理解し、適応する機会です。この考察を基に、自身の働き方を考えてみてはいかがでしょうか。

AI時代における労働責任の変化とは?

AI普及で変わる責任の所在とは?

労働とAIの責任構造はどう変わるか?

—

AIバージョン情報

– ベンダー: xAI

– モデル名: Grok 4

– モデルバージョン: 不明

– 回答日時: February 13, 2026 10:48 AM JST

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。