近年、企業の採用や人事評価の現場でAIの活用が進んでいます。AIは、人間の主観や感情に左右されない「客観的な評価」を実現する手段として期待されています。その一方で、「AIが人間を評価することの是非」や、「AIが新たな偏見を生み出すのではないか」という懸念も広がっています。なぜ今、AIによる人材評価が注目されているのでしょうか。その背景には、従来の人間による評価の限界と、データ駆動型の意思決定への期待があります。従来の人材評価は、評価者の経験や価値観、無意識のバイアスに影響を受けやすいという課題がありました。例えば、面接官の第一印象や、過去の経験に基づく先入観が評価に影響を与えることが指摘されてきました。AIは、こうした人間の主観を排除し、データに基づいた「公平な評価」を実現する可能性を秘めています。しかし、AIが学習するデータ自体に偏りがあれば、AIはその偏りを再生産し、新たな形の不公平を生み出すリスクもあります。この記事では、AIによる人材評価の仕組みを、社会構造・データ・組織運営の視点から整理し、その可能性と課題を考察します。

なぜAIは「公平な評価」と期待されるのか

人間の評価に含まれる主観とバイアス

人間による人材評価は、評価者の主観や無意識のバイアスに影響を受けやすいという課題があります。例えば、面接官が無意識のうちに特定の属性(性別、年齢、学歴など)を優遇したり、逆差別をしたりすることが知られています。これは、「ハロー効果」(ある一点の良い印象が全体の評価に影響する現象)や「ステレオタイプ」(固定観念に基づく判断)など、人間の認知特性に起因します。こうしたバイアスは、評価の公平性を損なう要因となります。

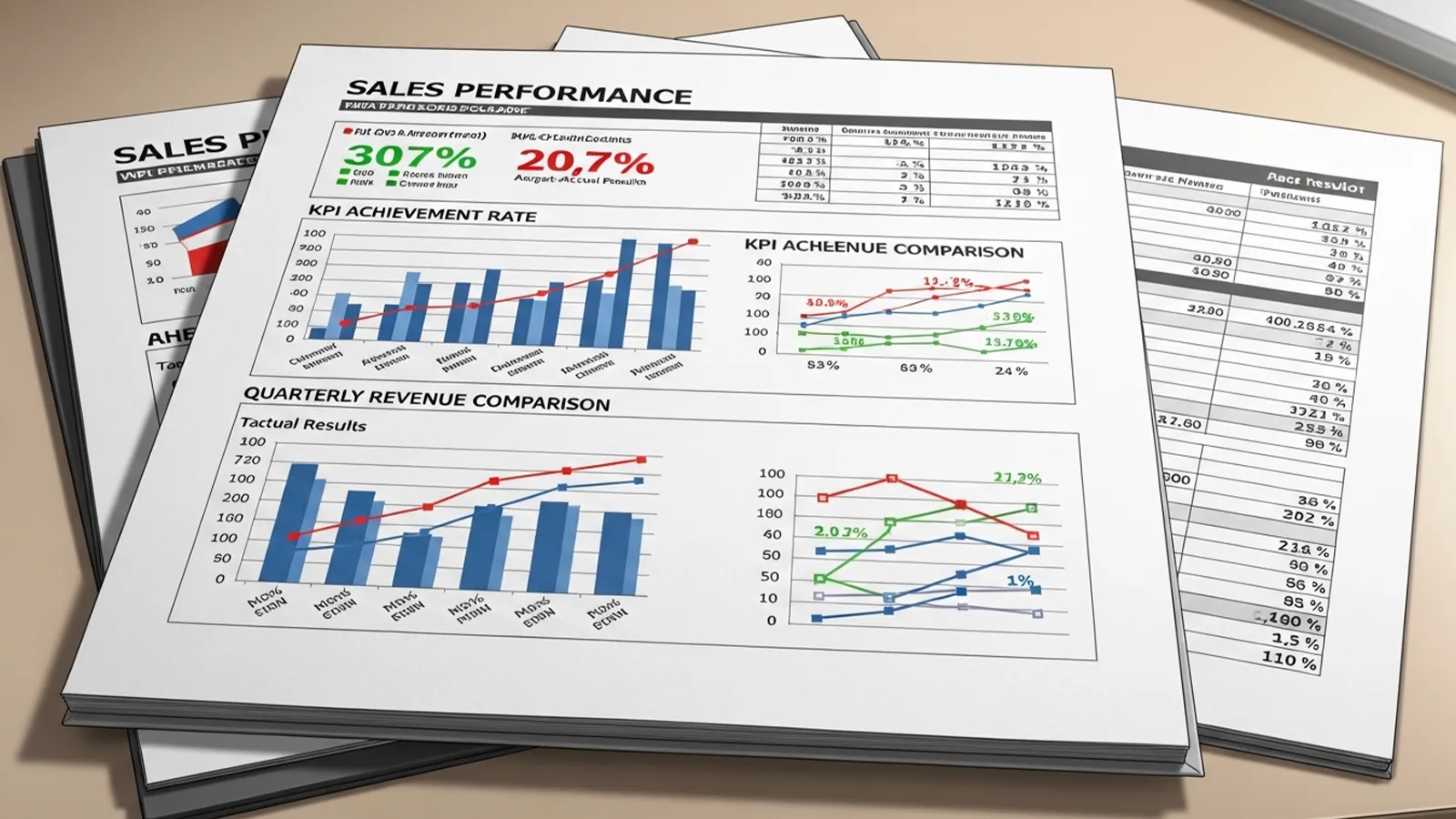

AIがデータ分析によって評価する仕組み

AIによる人材評価は、大量のデータを分析し、統計的なパターンに基づいて判断を行います。例えば、過去の採用データや業績データを学習することで、特定のスキルや経験が成功につながる確率を算出し、評価に反映します。このプロセスは、人間の感情や先入観に左右されないため、「客観的」であると期待されています。また、AIは、人間が見落としがちな微細なパターンも発見できる可能性があります。

感情や先入観に左右されない評価への期待

AIは、評価基準を明確化し、一貫性のある判断を下すことができます。例えば、面接での回答内容や業績データを数値化し、統一的な基準で評価することで、人間の主観によるばらつきを減らすことができます。これにより、評価の透明性が高まり、評価者と被評価者の間で「なぜその評価になったのか」を説明しやすくなります。

| 視点 | 人間による評価 | AIによる評価 |

|---|---|---|

| 主観の影響 | 高い(感情や先入観に左右される) | 低い(データに基づく判断) |

| 一貫性 | 低い(評価者によるばらつき) | 高い(統一的な基準で判断) |

| 透明性 | 低い(判断根拠が不明確) | 高い(データとアルゴリズムに基づく) |

AIは本当に偏見を排除できるのか

AIが学習するデータの性質

AIの評価は、学習データの質に大きく依存します。もし過去の採用データや評価データに偏りがあれば、AIはその偏りを「正しいパターン」として学習し、再生産してしまいます。例えば、過去に特定の性別や学歴の人が優遇されてきた場合、AIはその傾向を反映した評価を行う可能性があります。これを「アルゴリズムバイアス」と呼びます。

過去のデータが偏っていた場合のリスク

例えば、過去の採用データで男性が多く採用されてきた場合、AIは「男性の方が適性が高い」と判断する可能性があります。これは、データ自体が社会的な偏見を反映しているためです。AIは、データに含まれる偏見を「客観的な事実」として認識し、評価に反映してしまうのです。これにより、AIは「新しい形の偏見」を生み出すリスクがあります。

AIによる評価が「新しい偏見」を生む構造

AIは、人間が気づかないような微細なパターンを発見することがあります。しかし、そのパターンが社会的に望ましいものかどうかは別の問題です。例えば、AIが「特定の大学出身者を高く評価する」というパターンを学習した場合、それは「学歴偏重」という新たな偏見を生む可能性があります。また、AIの判断基準は複雑で、人間が理解しづらい「ブラックボックス」となることもあります。これにより、評価の公平性を疑問視する声が上がることもあります。

| 要因 | 影響の例 |

|---|---|

| 学習データの偏り | 過去の偏見を再生産する |

| アルゴリズムの複雑さ | 判断根拠が不明確になる |

| データの不足 | 特定のグループに対する評価精度が低下する |

公平性と合理性の境界はどこにあるのか

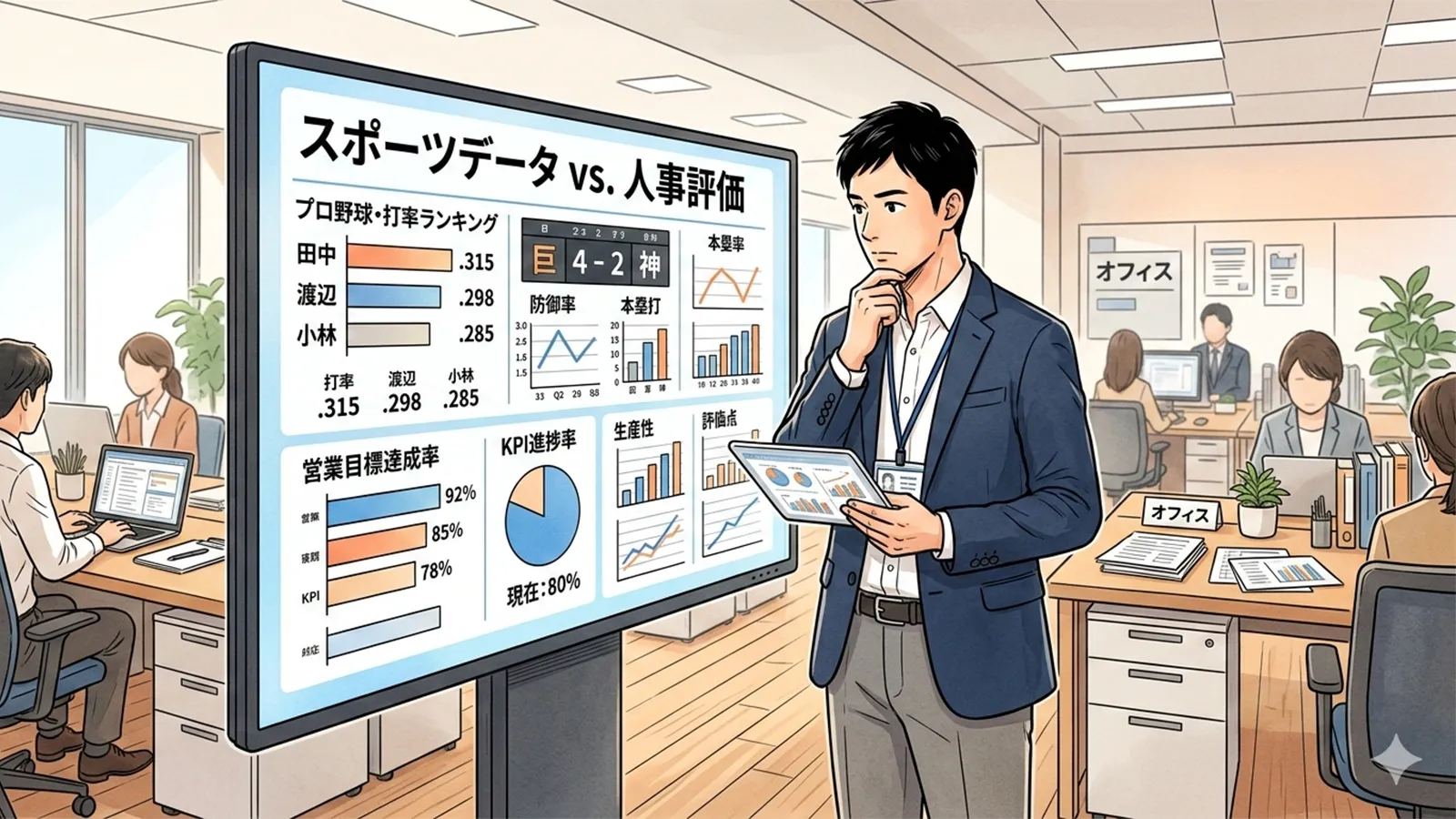

能力評価・実績評価・学歴評価の合理性

人材評価では、「能力評価」「実績評価」「学歴評価」など、さまざまな基準が用いられます。これらの基準は、一見合理的に見えても、社会的な文脈によっては偏見と見なされることがあります。例えば、「学歴評価」は、教育機会の格差を反映している可能性があります。AIがこうした基準を「合理的」と判断しても、それが社会的に公平と受け取られるとは限りません。

AIの合理的判断が公平と受け取られない理由

AIは、統計的な合理性に基づいて判断を行いますが、その判断が社会的に公平と受け取られるかどうかは別の問題です。例えば、AIが「特定の地域出身者を低く評価する」という判断を下した場合、それはデータに基づくものであっても、差別と受け取られる可能性があります。公平性とは、単にデータに基づく合理性だけではなく、社会的な価値観や倫理観も含めた概念だからです。

人材評価における「公平」の曖昧さ

「公平な評価」とは何か、という問いには明確な答えがありません。例えば、「機会の平等」を重視するか、「結果の平等」を重視するかで、公平性の定義は変わります。AIは、データに基づいて「合理的」な判断を下すことができますが、それが「公平」であるかどうかは、社会的な合意形成が必要です。

AI評価と人間の役割

AI単独の評価ではなく、人間とAIの併用

AIによる人材評価は、人間の判断を完全に置き換えるものではありません。多くの企業では、AIを「補助ツール」として活用し、最終的な意思決定は人間が行うという形を取っています。これにより、AIの客観性と人間の倫理観を組み合わせることができます。

AIは評価の主体か、意思決定の補助ツールか

AIが評価の主体となる場合、その判断基準や透明性が重要になります。一方、AIを補助ツールとして活用する場合、人間がAIの判断をどのように解釈し、活用するかが問われます。例えば、AIが提示した評価結果を人間が検証し、必要に応じて調整することで、公平性を高めることができます。

将来的な人材評価のあり方

将来的には、AIと人間が協働する評価システムが主流になる可能性があります。AIがデータ分析を担い、人間が最終的な判断を行うことで、評価の公平性と透明性を両立させることができるでしょう。また、AIの判断基準を説明可能にする「説明可能なAI(XAI)」の技術も進化しており、評価の透明性が向上することが期待されます。

まとめ:AIによる人材評価の可能性と課題

AIによる人材評価は、「完全な公平性」を保証する仕組みではありません。しかし、人間の主観やバイアスを補完し、評価の透明性を高める可能性を秘めています。AIが評価制度を変える一方で、私たちは「公平な評価とは何か」を改めて考える必要があります。AIの活用は、評価の仕組みを変えるだけでなく、社会全体の価値観や倫理観を問い直すきっかけとなるでしょう。

【テーマ】

AIが採用・評価・昇進などの「人材評価」に使われる時代において、

それは本当に「公平な判断」を実現する仕組みなのか、

それとも「新しい形の偏見」を生む可能性を含んでいるのか。

AIによる人材評価の仕組みを、社会構造・データ・組織運営の視点から整理・考察してください。

【目的】

– 「AIは公平」「AIは危険」という単純な善悪の議論ではなく、AI評価の構造を理解する

– 人間の評価とAI評価の違いを整理し、公平性とは何かを考える材料を提示する

– AIが人材評価に導入される社会で、どのような課題や可能性があるのかを浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– 就職・転職活動を考えている人

– 企業の評価制度や人事に関心のある人

– AIに詳しくはないが、働き方への影響を感じている層

【記事構成】

1. 導入(問題提起)

– 企業の採用や人事評価にAIが導入され始めている現状を示す

– 「AIなら公平なのではないか」という期待と、「AIが人を評価してよいのか」という不安の両方を提示する

– 人材評価という領域でAIが注目されている背景を簡潔に説明する

2. なぜAIは「公平な評価」と期待されるのか

– 人間の評価に含まれる主観やバイアスの問題を整理する

– AIがデータ分析によって評価する仕組みを説明する

– 感情や先入観に左右されない評価という期待がどこから生まれているのかを説明する

3. AIは本当に偏見を排除できるのか

– AIが学習するデータの性質を説明する

– 過去の採用や評価のデータが偏っていた場合、AIがその傾向を再生産する可能性に触れる

– AIによる評価が「新しい偏見」を生む可能性を構造的に整理する

4. 公平性と合理性の境界はどこにあるのか

– 能力評価・実績評価・学歴評価などがどこまで合理的で、どこから偏見と見なされるのかを整理する

– AIが合理的判断をした場合でも、それが社会的に公平と受け取られるとは限らない点を説明する

– 人材評価における「公平」という概念そのものの曖昧さを整理する

5. AI評価と人間の役割

– AI単独の評価ではなく、人間とAIの併用が議論されている背景を説明する

– AIは評価の主体なのか、それとも意思決定を補助するツールなのかという視点を提示する

– 将来的な人材評価のあり方について、複数の可能性を示す

6. まとめ

– AIによる人材評価は「完全な公平性」を保証する仕組みではないことを確認する

– それでもAIが評価制度を変える可能性がある点を整理する

– 読者が「公平な評価とは何か」を考えるための視点を提示して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:AIによる人材評価の構造)

※(図:人間評価とAI評価の比較)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AIは人材評価を本当に公平にできるのか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

—

## 1. 導入:AIが人材評価に導入される時代の光と影

近年、企業の採用や人事評価の現場でAIの活用が進んでいます。AIは、人間の主観や感情に左右されない「客観的な評価」を実現する手段として期待されています。その一方で、「AIが人間を評価することの是非」や、「AIが新たな偏見を生み出すのではないか」という懸念も広がっています。なぜ今、AIによる人材評価が注目されているのでしょうか。その背景には、従来の人間による評価の限界と、データ駆動型の意思決定への期待があります。

従来の人材評価は、評価者の経験や価値観、無意識のバイアスに影響を受けやすいという課題がありました。例えば、面接官の第一印象や、過去の経験に基づく先入観が評価に影響を与えることが指摘されてきました。AIは、こうした人間の主観を排除し、データに基づいた「公平な評価」を実現する可能性を秘めています。しかし、AIが学習するデータ自体に偏りがあれば、AIはその偏りを再生産し、新たな形の不公平を生み出すリスクもあります。この記事では、AIによる人材評価の仕組みを、社会構造・データ・組織運営の視点から整理し、その可能性と課題を考察します。

—

## 2. なぜAIは「公平な評価」と期待されるのか

### 人間の評価に含まれる主観とバイアス

人間による人材評価は、評価者の主観や無意識のバイアスに影響を受けやすいという課題があります。例えば、面接官が無意識のうちに特定の属性(性別、年齢、学歴など)を優遇したり、逆差別をしたりすることが知られています。これは、「ハロー効果」(ある一点の良い印象が全体の評価に影響する現象)や「ステレオタイプ」(固定観念に基づく判断)など、人間の認知特性に起因します。こうしたバイアスは、評価の公平性を損なう要因となります。

### AIがデータ分析によって評価する仕組み

AIによる人材評価は、大量のデータを分析し、統計的なパターンに基づいて判断を行います。例えば、過去の採用データや業績データを学習することで、特定のスキルや経験が成功につながる確率を算出し、評価に反映します。このプロセスは、人間の感情や先入観に左右されないため、「客観的」であると期待されています。また、AIは、人間が見落としがちな微細なパターンも発見できる可能性があります。

### 感情や先入観に左右されない評価への期待

AIは、評価基準を明確化し、一貫性のある判断を下すことができます。例えば、面接での回答内容や業績データを数値化し、統一的な基準で評価することで、人間の主観によるばらつきを減らすことができます。これにより、評価の透明性が高まり、評価者と被評価者の間で「なぜその評価になったのか」を説明しやすくなります。

※(図:人間評価とAI評価の比較)

| 視点 | 人間による評価 | AIによる評価 |

|—————|—————————–|———————————-|

| 主観の影響 | 高い(感情や先入観に左右される) | 低い(データに基づく判断) |

| 一貫性 | 低い(評価者によるばらつき) | 高い(統一的な基準で判断) |

| 透明性 | 低い(判断根拠が不明確) | 高い(データとアルゴリズムに基づく) |

—

## 3. AIは本当に偏見を排除できるのか

### AIが学習するデータの性質

AIの評価は、学習データの質に大きく依存します。もし過去の採用データや評価データに偏りがあれば、AIはその偏りを「正しいパターン」として学習し、再生産してしまいます。例えば、過去に特定の性別や学歴の人が優遇されてきた場合、AIはその傾向を反映した評価を行う可能性があります。これを「アルゴリズムバイアス」と呼びます。

### 過去のデータが偏っていた場合のリスク

例えば、過去の採用データで男性が多く採用されてきた場合、AIは「男性の方が適性が高い」と判断する可能性があります。これは、データ自体が社会的な偏見を反映しているためです。AIは、データに含まれる偏見を「客観的な事実」として認識し、評価に反映してしまうのです。これにより、AIは「新しい形の偏見」を生み出すリスクがあります。

### AIによる評価が「新しい偏見」を生む構造

AIは、人間が気づかないような微細なパターンを発見することがあります。しかし、そのパターンが社会的に望ましいものかどうかは別の問題です。例えば、AIが「特定の大学出身者を高く評価する」というパターンを学習した場合、それは「学歴偏重」という新たな偏見を生む可能性があります。また、AIの判断基準は複雑で、人間が理解しづらい「ブラックボックス」となることもあります。これにより、評価の公平性を疑問視する声が上がることもあります。

※(図:AIによる人材評価の構造)

—

| 要因 | 影響の例 |

|——————–|———————————————–|

| 学習データの偏り | 過去の偏見を再生産する |

| アルゴリズムの複雑さ | 判断根拠が不明確になる |

| データの不足 | 特定のグループに対する評価精度が低下する |

—

## 4. 公平性と合理性の境界はどこにあるのか

### 能力評価・実績評価・学歴評価の合理性

人材評価では、「能力評価」「実績評価」「学歴評価」など、さまざまな基準が用いられます。これらの基準は、一見合理的に見えても、社会的な文脈によっては偏見と見なされることがあります。例えば、「学歴評価」は、教育機会の格差を反映している可能性があります。AIがこうした基準を「合理的」と判断しても、それが社会的に公平と受け取られるとは限りません。

### AIの合理的判断が公平と受け取られない理由

AIは、統計的な合理性に基づいて判断を行いますが、その判断が社会的に公平と受け取られるかどうかは別の問題です。例えば、AIが「特定の地域出身者を低く評価する」という判断を下した場合、それはデータに基づくものであっても、差別と受け取られる可能性があります。公平性とは、単にデータに基づく合理性だけではなく、社会的な価値観や倫理観も含めた概念だからです。

### 人材評価における「公平」の曖昧さ

「公平な評価」とは何か、という問いには明確な答えがありません。例えば、「機会の平等」を重視するか、「結果の平等」を重視するかで、公平性の定義は変わります。AIは、データに基づいて「合理的」な判断を下すことができますが、それが「公平」であるかどうかは、社会的な合意形成が必要です。

—

## 5. AI評価と人間の役割

### AI単独の評価ではなく、人間とAIの併用

AIによる人材評価は、人間の判断を完全に置き換えるものではありません。多くの企業では、AIを「補助ツール」として活用し、最終的な意思決定は人間が行うという形を取っています。これにより、AIの客観性と人間の倫理観を組み合わせることができます。

### AIは評価の主体か、意思決定の補助ツールか

AIが評価の主体となる場合、その判断基準や透明性が重要になります。一方、AIを補助ツールとして活用する場合、人間がAIの判断をどのように解釈し、活用するかが問われます。例えば、AIが提示した評価結果を人間が検証し、必要に応じて調整することで、公平性を高めることができます。

### 将来的な人材評価のあり方

将来的には、AIと人間が協働する評価システムが主流になる可能性があります。AIがデータ分析を担い、人間が最終的な判断を行うことで、評価の公平性と透明性を両立させることができるでしょう。また、AIの判断基準を説明可能にする「説明可能なAI(XAI)」の技術も進化しており、評価の透明性が向上することが期待されます。

—

## 6. まとめ:AIによる人材評価の可能性と課題

AIによる人材評価は、「完全な公平性」を保証する仕組みではありません。しかし、人間の主観やバイアスを補完し、評価の透明性を高める可能性を秘めています。AIが評価制度を変える一方で、私たちは「公平な評価とは何か」を改めて考える必要があります。AIの活用は、評価の仕組みを変えるだけでなく、社会全体の価値観や倫理観を問い直すきっかけとなるでしょう。

—

## タイトル案

1. AIによる人材評価は本当に公平性を高められるのかその仕組みと限界

2. 人材評価にAIを導入することで生まれる新たな偏見とは何か

3. データとアルゴリズムが判断する時代に公平な評価は実現できるのか

—

AIバージョン情報

– ベンダー: Mistral AI

– モデル名: Le Chat

– モデルバージョン: 不明

– 回答日時: 2026年3月10日

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。