近年、企業の採用や人事評価にAIが活用されるケースが増えています。たとえばソフトバンクでは、新卒採用のエントリーシート選考にAIを導入し、従来の作業時間を約75%削減した事例があります。また、三井住友海上火災保険では社員の異動案作成にAIを使い、適材適所の配置を効率化しています。こうした動きの背景には労働力不足や評価業務の負担増大があり、「AIなら人間より公平な判断ができるのではないか」という期待が高まっています。一方で、「機械が人の能力を決めてよいのか」「バイアスが入るのではないか」という不安の声も少なくありません。人材評価は採用だけでなく昇進・配置・報酬決定など個人のキャリアを左右する重要なプロセスです。AIがここに本格的に入り込む時代、私たちは「公平な判断」とは何かを改めて考える必要があります。

なぜAIは「公平な評価」と期待されるのか

人間の評価には、主観的なバイアスが付きものです。たとえば「ハロー効果」(一つの良い印象で全体を高く評価する)や「類似性バイアス」(自分と似た人を高評価する)などが代表的です。これらは面接官の感情や先入観に左右されやすく、評価のばらつきを生みます。

これに対し、AIは過去の採用データや実績データを機械学習で分析し、一定の基準でスコアリングします。感情を持たないため、毎回同じルールで判断でき、一貫性が高い点が強みです。また、大量のデータを高速処理できるため、個人の印象に頼らない「データ駆動型」の評価が可能になります。

このような仕組みから、「AIなら人間の主観を排除した公平な評価を実現できる」という期待が生まれています。特に、応募書類の一次スクリーニングや適性検査の分析では、その利点が発揮されやすいとされています。

人間評価とAI評価の比較

※(図:人間評価とAI評価の比較)

AIは本当に偏見を排除できるのか

しかし、AIの公平性には限界があります。AIは学習データに基づいて判断するため、過去のデータに偏りがあった場合、それを再生産してしまう可能性があります。有名な事例として、Amazonが2018年に開発した採用AIツールが挙げられます。このツールは過去10年間の採用データを学習した結果、女性候補者を不利に評価する傾向が明らかになり、プロジェクトが中止されました。理由は、技術職の過去データが男性中心だったためです。

日本でも同様の懸念が指摘されています。たとえば、過去に男性優位の評価が続いた企業でAIを導入すると、女性の昇進実績が少ないデータを「パターン」として学習し、新たな候補者を低く評価するリスクがあります。これを「データのバイアス再生産」と呼びます。

さらに、AIは「プロキシ変数」(間接的な代理変数)を通じて新しい偏見を生む場合があります。たとえば、居住地域や大学名が学歴や収入と強く相関する場合、これらを評価項目に含めると、意図せず地域差や階層差を反映してしまうのです。

AIによる人材評価の構造

※(図:AIによる人材評価の構造)

公平性と合理性の境界はどこにあるのか

AIが導き出す判断は「合理的」であることが多いですが、それが必ずしも「社会的に公平」とは限りません。たとえば、学歴や過去の実績を重視した評価は、データ上は予測精度が高い「合理的」判断です。しかし、社会全体で教育機会の格差が存在する場合、この合理性は結果として多様性の欠如を招く可能性があります。

ここで重要なのは、「公平」という概念の曖昧さです。公平にはいくつかの捉え方があります。

- 手続き的公平:同じ基準で全員を評価する

- 結果的公平:異なる属性のグループで結果に偏りが出ない

- 個別的公平:一人ひとりの事情を考慮する

AIは主に手続き的公平を強みとしますが、結果的公平を損なうリスクを抱えています。企業が「合理的判断」を優先した場合、社会的な多様性推進の観点と衝突するケースも出てくるでしょう。

AI評価と人間の役割

このような課題を踏まえ、現在はAIを単独で使うのではなく、人間と併用する「ハイブリッド評価」が主流の議論となっています。AIは大量データの客観分析を担い、人間は文脈理解や倫理的判断を補う形です。

たとえば、AIがスコアリングした候補者を、人事担当者が最終確認する仕組みが一般的です。これにより、AIのブラックボックス(判断理由が不明瞭な点)を人間の責任で補完できます。

将来的には、以下の可能性が考えられます。

- AIを完全に補助ツールとして位置づけ、意思決定は人間が担う

- 透明性が高い「説明可能AI(XAI)」を導入し、判断根拠を可視化する

- バイアス監査を定期的に行い、データセットを継続的に修正する

いずれにせよ、AIは「評価の主体」ではなく「意思決定を支援するツール」として活用される方向性が強まっています。

まとめ

AIによる人材評価は、完全な公平性を保証する魔法の仕組みではありません。むしろ、データの性質や社会構造を映し出す鏡のような存在です。それでも、評価の一貫性を高め、人間の主観的バイアスを減らす可能性を秘めています。

大切なのは、AIを導入する企業や個人が、公平性とは何かを不断に問い続けることです。データに偏りがないか、判断の根拠は説明可能か、社会的な影響はどうか――こうした視点を持つことで、AIは人材評価の質を本当に高めるツールになり得るでしょう。

読者の皆さんが、ご自身のキャリアや組織の評価制度について考える一助になれば幸いです。

【テーマ】

AIが採用・評価・昇進などの「人材評価」に使われる時代において、

それは本当に「公平な判断」を実現する仕組みなのか、

それとも「新しい形の偏見」を生む可能性を含んでいるのか。

AIによる人材評価の仕組みを、社会構造・データ・組織運営の視点から整理・考察してください。

【目的】

– 「AIは公平」「AIは危険」という単純な善悪の議論ではなく、AI評価の構造を理解する

– 人間の評価とAI評価の違いを整理し、公平性とは何かを考える材料を提示する

– AIが人材評価に導入される社会で、どのような課題や可能性があるのかを浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– 就職・転職活動を考えている人

– 企業の評価制度や人事に関心のある人

– AIに詳しくはないが、働き方への影響を感じている層

【記事構成】

1. 導入(問題提起)

– 企業の採用や人事評価にAIが導入され始めている現状を示す

– 「AIなら公平なのではないか」という期待と、「AIが人を評価してよいのか」という不安の両方を提示する

– 人材評価という領域でAIが注目されている背景を簡潔に説明する

2. なぜAIは「公平な評価」と期待されるのか

– 人間の評価に含まれる主観やバイアスの問題を整理する

– AIがデータ分析によって評価する仕組みを説明する

– 感情や先入観に左右されない評価という期待がどこから生まれているのかを説明する

3. AIは本当に偏見を排除できるのか

– AIが学習するデータの性質を説明する

– 過去の採用や評価のデータが偏っていた場合、AIがその傾向を再生産する可能性に触れる

– AIによる評価が「新しい偏見」を生む可能性を構造的に整理する

4. 公平性と合理性の境界はどこにあるのか

– 能力評価・実績評価・学歴評価などがどこまで合理的で、どこから偏見と見なされるのかを整理する

– AIが合理的判断をした場合でも、それが社会的に公平と受け取られるとは限らない点を説明する

– 人材評価における「公平」という概念そのものの曖昧さを整理する

5. AI評価と人間の役割

– AI単独の評価ではなく、人間とAIの併用が議論されている背景を説明する

– AIは評価の主体なのか、それとも意思決定を補助するツールなのかという視点を提示する

– 将来的な人材評価のあり方について、複数の可能性を示す

6. まとめ

– AIによる人材評価は「完全な公平性」を保証する仕組みではないことを確認する

– それでもAIが評価制度を変える可能性がある点を整理する

– 読者が「公平な評価とは何か」を考えるための視点を提示して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:AIによる人材評価の構造)

※(図:人間評価とAI評価の比較)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AIは人材評価を本当に公平にできるのか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

### 導入(問題提起)

近年、企業の採用や人事評価にAIが活用されるケースが増えています。たとえばソフトバンクでは、新卒採用のエントリーシート選考にAIを導入し、従来の作業時間を約75%削減した事例があります。また、三井住友海上火災保険では社員の異動案作成にAIを使い、適材適所の配置を効率化しています。

こうした動きの背景には、労働力不足や評価業務の負担増大があります。AIなら大量のデータを瞬時に分析できるため、「人間より公平な判断ができるのではないか」という期待が高まっています。一方で、「機械が人の能力を決めてよいのか」「バイアスが入るのではないか」という不安の声も少なくありません。

人材評価は、採用だけでなく昇進・配置・報酬決定など、個人のキャリアを左右する重要なプロセスです。AIがここに本格的に入り込む時代、私たちは「公平な判断」とは何かを改めて考える必要があります。

### なぜAIは「公平な評価」と期待されるのか

人間の評価には、主観的なバイアスが付きものです。たとえば「ハロー効果」(一つの良い印象で全体を高く評価する)や「類似性バイアス」(自分と似た人を高評価する)などが代表的です。これらは面接官の感情や先入観に左右されやすく、評価のばらつきを生みます。

これに対し、AIは過去の採用データや実績データを機械学習で分析し、一定の基準でスコアリングします。感情を持たないため、毎回同じルールで判断でき、一貫性が高い点が強みです。また、大量のデータを高速処理できるため、個人の印象に頼らない「データ駆動型」の評価が可能になります。

このような仕組みから、「AIなら人間の主観を排除した公平な評価を実現できる」という期待が生まれています。特に、応募書類の一次スクリーニングや適性検査の分析では、その利点が発揮されやすいとされています。

※(図:人間評価とAI評価の比較)

### AIは本当に偏見を排除できるのか

しかし、AIの公平性には限界があります。AIは学習データに基づいて判断するため、過去のデータに偏りがあった場合、それを再生産してしまう可能性があります。有名な事例として、Amazonが2018年に開発した採用AIツールが挙げられます。このツールは過去10年間の採用データを学習した結果、女性候補者を不利に評価する傾向が明らかになり、プロジェクトが中止されました。理由は、技術職の過去データが男性中心だったためです。

日本でも同様の懸念が指摘されています。たとえば、過去に男性優位の評価が続いた企業でAIを導入すると、女性の昇進実績が少ないデータを「パターン」として学習し、新たな候補者を低く評価するリスクがあります。これを「データのバイアス再生産」と呼びます。

さらに、AIは「プロキシ変数」(間接的な代理変数)を通じて新しい偏見を生む場合があります。たとえば、居住地域や大学名が学歴や収入と強く相関する場合、これらを評価項目に含めると、意図せず地域差や階層差を反映してしまうのです。

※(図:AIによる人材評価の構造)

### 公平性と合理性の境界はどこにあるのか

AIが導き出す判断は「合理的」であることが多いですが、それが必ずしも「社会的に公平」とは限りません。たとえば、学歴や過去の実績を重視した評価は、データ上は予測精度が高い「合理的」判断です。しかし、社会全体で教育機会の格差が存在する場合、この合理性は結果として多様性の欠如を招く可能性があります。

ここで重要なのは、「公平」という概念の曖昧さです。公平にはいくつかの捉え方があります。

– 手続き的公平:同じ基準で全員を評価する

– 結果的公平:異なる属性のグループで結果に偏りが出ない

– 個別的公平:一人ひとりの事情を考慮する

AIは主に手続き的公平を強みとしますが、結果的公平を損なうリスクを抱えています。企業が「合理的判断」を優先した場合、社会的な多様性推進の観点と衝突するケースも出てくるでしょう。

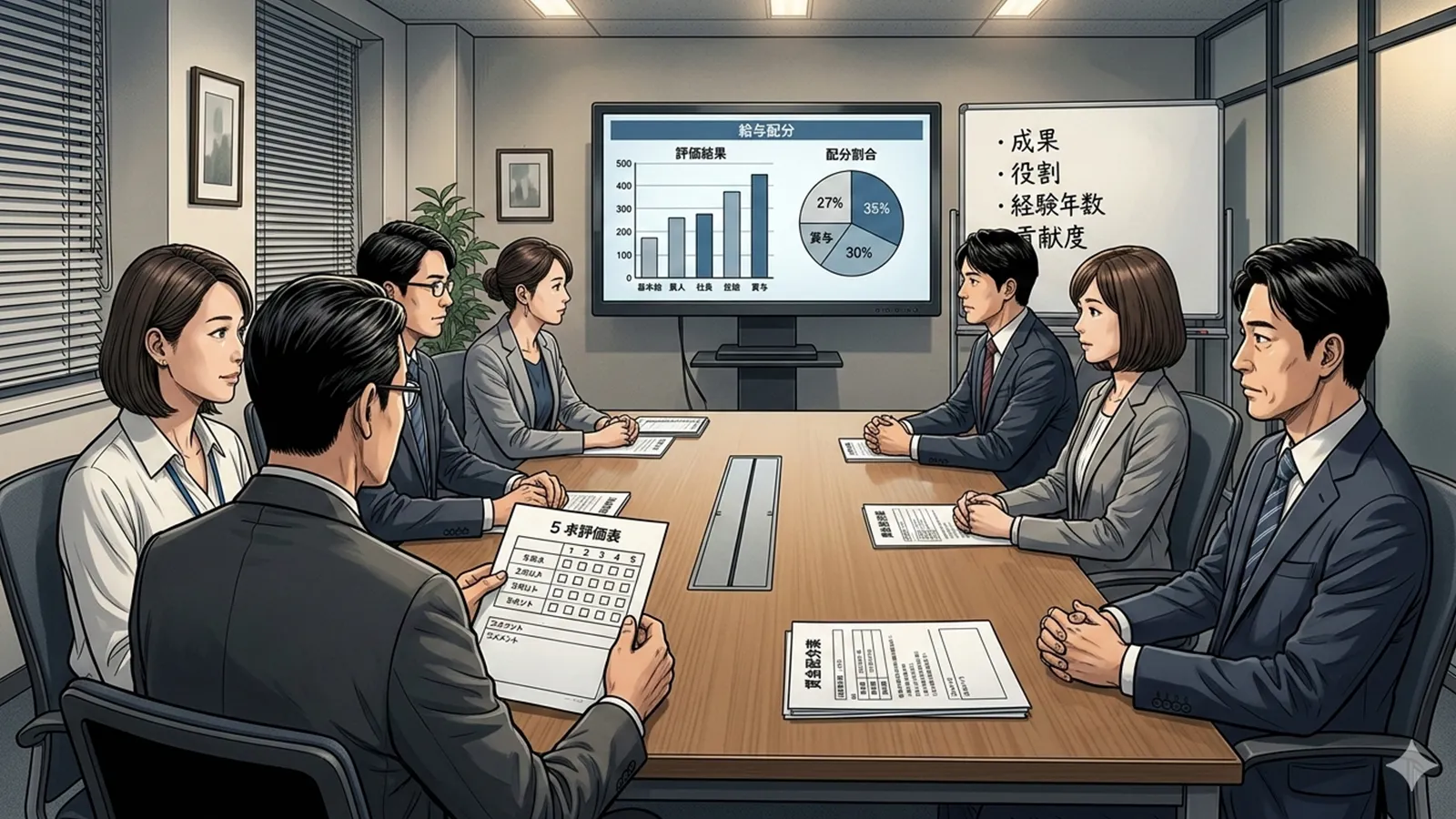

### AI評価と人間の役割

このような課題を踏まえ、現在はAIを単独で使うのではなく、人間と併用する「ハイブリッド評価」が主流の議論となっています。AIは大量データの客観分析を担い、人間は文脈理解や倫理的判断を補う形です。

たとえば、AIがスコアリングした候補者を、人事担当者が最終確認する仕組みが一般的です。これにより、AIのブラックボックス(判断理由が不明瞭な点)を人間の責任で補完できます。

将来的には、以下の可能性が考えられます。

– AIを完全に補助ツールとして位置づけ、意思決定は人間が担う

– 透明性が高い「説明可能AI(XAI)」を導入し、判断根拠を可視化する

– バイアス監査を定期的に行い、データセットを継続的に修正する

いずれにせよ、AIは「評価の主体」ではなく「意思決定を支援するツール」として活用される方向性が強まっています。

### まとめ

AIによる人材評価は、完全な公平性を保証する魔法の仕組みではありません。むしろ、データの性質や社会構造を映し出す鏡のような存在です。それでも、評価の一貫性を高め、人間の主観的バイアスを減らす可能性を秘めています。

大切なのは、AIを導入する企業や個人が、公平性とは何かを不断に問い続けることです。データに偏りがないか、判断の根拠は説明可能か、社会的な影響はどうか――こうした視点を持つことで、AIは人材評価の質を本当に高めるツールになり得るでしょう。

読者の皆さんが、ご自身のキャリアや組織の評価制度について考える一助になれば幸いです。

**タイトル案**

AIによる人材評価は本当に公平な判断を実現するのか

AIと人間の評価では公平性の基準がどう異なるのか

AI人材評価の導入は社会の公平観をどう変えるのか

—

AIバージョン情報

– ベンダー: xAI

– モデル名: Grok

– モデルバージョン: 不明

– 回答日時: 2026年3月10日

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。

※ 編集注(MANA)

本文では、AI評価が「公平性を高める可能性」と「過去の偏りを再生産するリスク」の両面から整理されています。特に、AIの判断が統計的に合理的であっても、それが社会的に公平と受け取られるとは限らないという点は、人材評価における重要な論点の一つです。他のAIの分析と比較する際には、「合理性」と「社会的公平」の関係をどのように位置づけているかにも注目できます。