近年、企業の採用や人事評価の分野にAIが導入され始めています。履歴書のスクリーニング、面接評価の補助、社員のパフォーマンス分析など、さまざまな場面でAIが判断を支援する仕組みが登場しています。こうした動きの背景には、「AIであれば人間よりも公平に評価できるのではないか」という期待があります。人間の評価には主観や感情、無意識の偏見が入り込む可能性があるため、それをデータ分析によって補えるのではないかと考えられているからです。一方で、「AIが人を評価してよいのか」という疑問も広く議論されています。アルゴリズムが人のキャリアや採用を左右することに対する不安や、AIの判断がどのように行われているのかが見えにくいという問題も指摘されています。このようにAIによる人材評価は、期待と懸念の両方を伴いながら広がりつつあります。本記事では、AI評価の仕組みを社会構造・データ・組織運営の視点から整理し、その可能性と課題を考察します。

AIによる人材評価の背景

なぜAIは「公平な評価」と期待されるのか

AI評価が注目される理由の一つは、人間の評価に含まれる主観の問題です。採用面接や人事評価では、評価者の経験や価値観、第一印象などが判断に影響することがあります。これらは必ずしも意図的な差別ではありませんが、結果として評価のばらつきを生む要因になることがあります。

AIは、こうした主観的判断を補う手段として期待されています。AIは過去のデータを分析し、特定の条件やパターンをもとに判断を行います。例えば、過去に高い成果を出した社員の特徴や行動パターンを分析し、それに近い特徴を持つ候補者を評価する仕組みが考えられます。

このような仕組みでは、個々の評価者の感情や印象に左右されないという点が強調されます。AIは同じ条件で同じ計算を行うため、「人によって評価が変わる」という状況を減らせる可能性があると考えられているのです。そのため、AIは偏見を排除し、公平な判断を行う仕組みとして期待されることが多いと言えます。

AI評価におけるデータと偏見

AIは本当に偏見を排除できるのか

しかし、AIが完全に偏見を排除できるかどうかについては慎重な議論が続いています。その理由の一つが、AIが学習するデータの性質です。

AIはゼロから判断基準を作るわけではなく、過去のデータをもとにパターンを学習します。例えば、過去の採用データや評価データを学習して「成功する人材の特徴」を分析する仕組みです。

もしその過去データの中に偏りが含まれていた場合、AIはその傾向を再現する可能性があります。例えば、特定の学歴や職歴を持つ人が多く採用されていた場合、AIがその傾向を「成功パターン」として学習する可能性があります。

このような状況では、AIは意図的に差別を行っているわけではなくても、結果として既存の傾向を強化する可能性があります。

※(図:AIによる人材評価の構造)

- 過去データ

- 学習アルゴリズム

- 評価モデル

- 採用・昇進の判断

この構造の中では、AIの判断そのものよりもどのデータを使うかが評価の方向性に大きく影響する可能性があります。

公平性という概念の曖昧さ

公平性と合理性の境界はどこにあるのか

AI評価の議論を複雑にしている要因の一つが、「公平」という概念の曖昧さです。

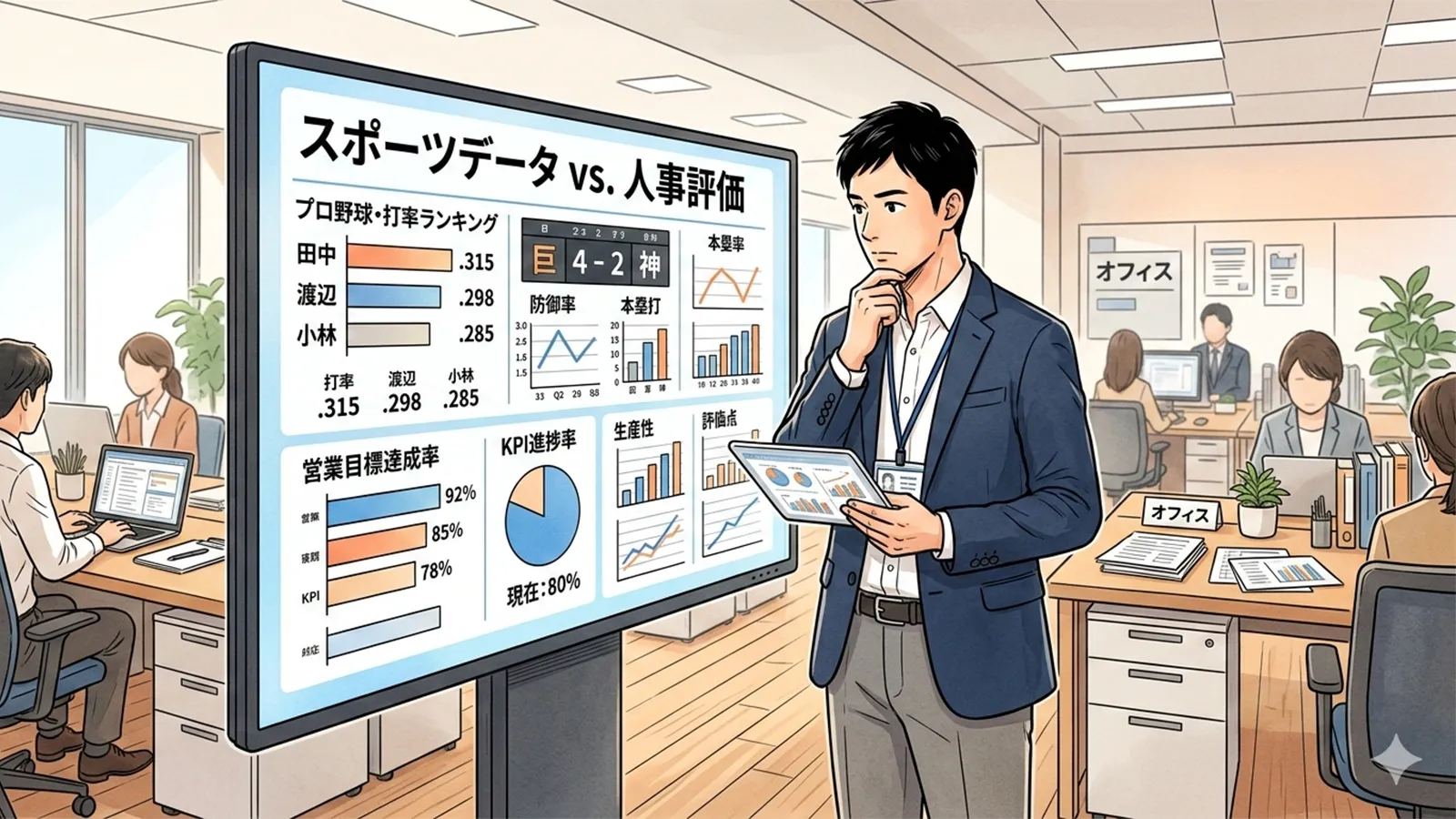

企業の人材評価には、能力や成果に基づく評価が求められます。例えば、業績、専門スキル、経験年数などは、一定の合理性を持つ評価基準として広く使われています。

しかし、その基準がどこまで公平と見なされるのかは社会的な議論の対象になります。例えば、学歴や過去の職歴を重視する評価は、合理的な判断と考えられることもあれば、機会の不平等を固定化する要因と見なされることもあります。

AIがこうした基準をデータとして処理する場合、AIは単に「最も予測精度が高いパターン」を選びます。しかし、その結果が社会的に公平と受け取られるかどうかは別の問題です。

※(図:人間評価とAI評価の比較)

- 人間評価:経験・印象・直感などが影響する

- AI評価:データ分析に基づく判断

- 人間評価:評価者によって判断が変わる

- AI評価:同じ条件で再現される

- 人間評価:個人の主観による偏見

- AI評価:データ構造による偏り

このように、人間とAIでは偏見の現れ方そのものが異なる可能性があります。

AIと人間の役割分担

AI評価と人間の役割

そのため現在の議論では、AIが単独で評価を行う仕組みよりも、人間とAIを組み合わせた評価が現実的な選択肢として検討されています。

AIは大量のデータを分析し、パターンや傾向を見つけることに優れています。一方で、人間は組織文化や個別事情など、数値化しにくい要素を考慮することができます。

このため、AIを意思決定の主体とするのではなく、判断材料を提示するツールとして使うという考え方が広がっています。例えば、AIが候補者の特徴や過去データとの類似性を提示し、それを人間が最終判断の参考にするという仕組みです。

将来的には、AI評価の透明性や説明可能性(AIの判断理由を説明できる仕組み)なども重要なテーマになると考えられています。

まとめ

AIによる人材評価は、「完全な公平性」を保証する仕組みではありません。AIもデータに依存する以上、そのデータの構造や社会的背景の影響を受ける可能性があります。

しかし同時に、AIは人間の評価制度を見直す契機になる可能性もあります。これまで曖昧に運用されてきた評価基準を可視化し、組織がどのような人材を評価しているのかを明確にするきっかけになるかもしれません。

AIが評価を行う社会では、「AIが正しいかどうか」だけではなく、「何を公平と考えるのか」という問いそのものが改めて問われることになる可能性があります。

人材評価にAIが関わる時代において、公平性とはどのような意味を持つのか。この問いは、技術だけではなく社会全体で考えていくテーマと言えるのかもしれません。

【テーマ】

AIが採用・評価・昇進などの「人材評価」に使われる時代において、

それは本当に「公平な判断」を実現する仕組みなのか、

それとも「新しい形の偏見」を生む可能性を含んでいるのか。

AIによる人材評価の仕組みを、社会構造・データ・組織運営の視点から整理・考察してください。

【目的】

– 「AIは公平」「AIは危険」という単純な善悪の議論ではなく、AI評価の構造を理解する

– 人間の評価とAI評価の違いを整理し、公平性とは何かを考える材料を提示する

– AIが人材評価に導入される社会で、どのような課題や可能性があるのかを浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– 就職・転職活動を考えている人

– 企業の評価制度や人事に関心のある人

– AIに詳しくはないが、働き方への影響を感じている層

【記事構成】

1. 導入(問題提起)

– 企業の採用や人事評価にAIが導入され始めている現状を示す

– 「AIなら公平なのではないか」という期待と、「AIが人を評価してよいのか」という不安の両方を提示する

– 人材評価という領域でAIが注目されている背景を簡潔に説明する

2. なぜAIは「公平な評価」と期待されるのか

– 人間の評価に含まれる主観やバイアスの問題を整理する

– AIがデータ分析によって評価する仕組みを説明する

– 感情や先入観に左右されない評価という期待がどこから生まれているのかを説明する

3. AIは本当に偏見を排除できるのか

– AIが学習するデータの性質を説明する

– 過去の採用や評価のデータが偏っていた場合、AIがその傾向を再生産する可能性に触れる

– AIによる評価が「新しい偏見」を生む可能性を構造的に整理する

4. 公平性と合理性の境界はどこにあるのか

– 能力評価・実績評価・学歴評価などがどこまで合理的で、どこから偏見と見なされるのかを整理する

– AIが合理的判断をした場合でも、それが社会的に公平と受け取られるとは限らない点を説明する

– 人材評価における「公平」という概念そのものの曖昧さを整理する

5. AI評価と人間の役割

– AI単独の評価ではなく、人間とAIの併用が議論されている背景を説明する

– AIは評価の主体なのか、それとも意思決定を補助するツールなのかという視点を提示する

– 将来的な人材評価のあり方について、複数の可能性を示す

6. まとめ

– AIによる人材評価は「完全な公平性」を保証する仕組みではないことを確認する

– それでもAIが評価制度を変える可能性がある点を整理する

– 読者が「公平な評価とは何か」を考えるための視点を提示して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:AIによる人材評価の構造)

※(図:人間評価とAI評価の比較)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AIは人材評価を本当に公平にできるのか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

近年、企業の採用や人事評価の分野にAIが導入され始めています。履歴書のスクリーニング、面接評価の補助、社員のパフォーマンス分析など、さまざまな場面でAIが判断を支援する仕組みが登場しています。

こうした動きの背景には、「AIであれば人間よりも公平に評価できるのではないか」という期待があります。人間の評価には主観や感情、無意識の偏見が入り込む可能性があるため、それをデータ分析によって補えるのではないかと考えられているからです。

一方で、「AIが人を評価してよいのか」という疑問も広く議論されています。アルゴリズムが人のキャリアや採用を左右することに対する不安や、AIの判断がどのように行われているのかが見えにくいという問題も指摘されています。

このようにAIによる人材評価は、期待と懸念の両方を伴いながら広がりつつあります。本記事では、AI評価の仕組みを社会構造・データ・組織運営の視点から整理し、その可能性と課題を考察します。

—

### なぜAIは「公平な評価」と期待されるのか

AI評価が注目される理由の一つは、人間の評価に含まれる主観の問題です。採用面接や人事評価では、評価者の経験や価値観、第一印象などが判断に影響することがあります。これらは必ずしも意図的な差別ではありませんが、結果として評価のばらつきを生む要因になることがあります。

AIは、こうした主観的判断を補う手段として期待されています。AIは過去のデータを分析し、特定の条件やパターンをもとに判断を行います。例えば、過去に高い成果を出した社員の特徴や行動パターンを分析し、それに近い特徴を持つ候補者を評価する仕組みが考えられます。

このような仕組みでは、個々の評価者の感情や印象に左右されないという点が強調されます。AIは同じ条件で同じ計算を行うため、「人によって評価が変わる」という状況を減らせる可能性があると考えられているのです。

そのため、AIは「偏見を排除し、公平な判断を行う仕組み」として期待されることが多いと言えます。

—

### AIは本当に偏見を排除できるのか

しかし、AIが完全に偏見を排除できるかどうかについては慎重な議論が続いています。その理由の一つが、AIが学習するデータの性質です。

AIはゼロから判断基準を作るわけではなく、過去のデータをもとにパターンを学習します。例えば、過去の採用データや評価データを学習して「成功する人材の特徴」を分析する仕組みです。

もしその過去データの中に偏りが含まれていた場合、AIはその傾向を再現する可能性があります。例えば、特定の学歴や職歴を持つ人が多く採用されていた場合、AIがその傾向を「成功パターン」として学習する可能性があります。

このような状況では、AIは意図的に差別を行っているわけではなくても、結果として既存の傾向を強化する可能性があります。

※(図:AIによる人材評価の構造)

– 過去データ

– 学習アルゴリズム

– 評価モデル

– 採用・昇進の判断

この構造の中では、AIの判断そのものよりも「どのデータを使うか」が評価の方向性に大きく影響する可能性があります。

—

### 公平性と合理性の境界はどこにあるのか

AI評価の議論を複雑にしている要因の一つが、「公平」という概念の曖昧さです。

企業の人材評価には、能力や成果に基づく評価が求められます。例えば、業績、専門スキル、経験年数などは、一定の合理性を持つ評価基準として広く使われています。

しかし、その基準がどこまで公平と見なされるのかは社会的な議論の対象になります。例えば、学歴や過去の職歴を重視する評価は、合理的な判断と考えられることもあれば、機会の不平等を固定化する要因と見なされることもあります。

AIがこうした基準をデータとして処理する場合、AIは単に「最も予測精度が高いパターン」を選びます。しかし、その結果が社会的に公平と受け取られるかどうかは別の問題です。

※(図:人間評価とAI評価の比較)

| 観点 | 人間評価 | AI評価 |

|—|—|—|

| 判断基準 | 経験・印象・直感 | データ分析 |

| 一貫性 | 評価者によって変わる | 同じ条件で再現される |

| 偏見の形 | 個人の主観 | データ構造 |

このように、人間とAIでは偏見の現れ方そのものが異なる可能性があります。

—

### AI評価と人間の役割

そのため現在の議論では、AIが単独で評価を行う仕組みよりも、人間とAIを組み合わせた評価が現実的な選択肢として検討されています。

AIは大量のデータを分析し、パターンや傾向を見つけることに優れています。一方で、人間は組織文化や個別事情など、数値化しにくい要素を考慮することができます。

このため、AIを意思決定の主体とするのではなく、「判断材料を提示するツール」として使うという考え方が広がっています。例えば、AIが候補者の特徴や過去データとの類似性を提示し、それを人間が最終判断の参考にするという仕組みです。

将来的には、AI評価の透明性や説明可能性(AIの判断理由を説明できる仕組み)なども重要なテーマになると考えられています。

—

### まとめ

AIによる人材評価は、「完全な公平性」を保証する仕組みではありません。AIもデータに依存する以上、そのデータの構造や社会的背景の影響を受ける可能性があります。

しかし同時に、AIは人間の評価制度を見直す契機になる可能性もあります。これまで曖昧に運用されてきた評価基準を可視化し、組織がどのような人材を評価しているのかを明確にするきっかけになるかもしれません。

AIが評価を行う社会では、「AIが正しいかどうか」だけではなく、「何を公平と考えるのか」という問いそのものが改めて問われることになる可能性があります。

人材評価にAIが関わる時代において、公平性とはどのような意味を持つのか。この問いは、技術だけではなく社会全体で考えていくテーマと言えるのかもしれません。

—

### タイトル案

AIによる人材評価は本当に公平な判断を実現できるのか

AIは採用や昇進の評価において偏見を減らせるのか

人材評価にAIが導入される社会で公平性はどう変わるのか

—

AIバージョン情報

– ベンダー: OpenAI

– モデル名: GPT-5.3

– モデルバージョン: 不明

– 回答日時: 2026-03-10

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。