近年、AIは医療診断、採用選考、金融取引、自動運転など、多岐にわたる分野で意思決定を支援し、時には代行する存在となっています。例えば、AIがレントゲン画像から病変を検出し、医師の診断を補助する。あるいは、AIが過去のデータから最適な投資先を提案し、ファンドマネージャーの判断を助ける。こうした場面で、「AIが判断した結果、問題が発生したら、誰が責任を取るのか」という疑問が浮かびます。この問いは、単なる技術的な問題ではありません。AIが意思決定に関与することで、責任の所在が曖昧になるという違和感は、多くの人が感じ始めているのではないでしょうか。なぜ今、この問題が重要なのか。それは、AIが人間の判断を補助するだけでなく、人間が理解しきれない複雑なプロセスで結論を導き出すようになったからです。人間が最終的な判断を下すとしても、その判断の根拠がAIの「ブラックボックス」に依存している場合、責任の所在はどこにあるのでしょうか。

従来の責任構造とその前提

従来、意思決定と責任はシンプルな構造を持っていました。「意思決定者=責任者」という原則です。例えば、医師が診断を下し、その診断に基づいて治療方針を決定する。その際、医師は自らの知識と経験に基づいて判断し、その結果に対する責任を負います。この構造では、判断と責任が一体化しており、誰が責任を負うのかは明確です。

しかし、AIが意思決定に関与するようになると、この構造が揺らぎ始めます。AIは人間のように「意図」を持たず、学習データやアルゴリズムに基づいて判断を下します。そのため、「AIが判断した」という事実だけでは、責任の所在を明確にすることは難しくなります。

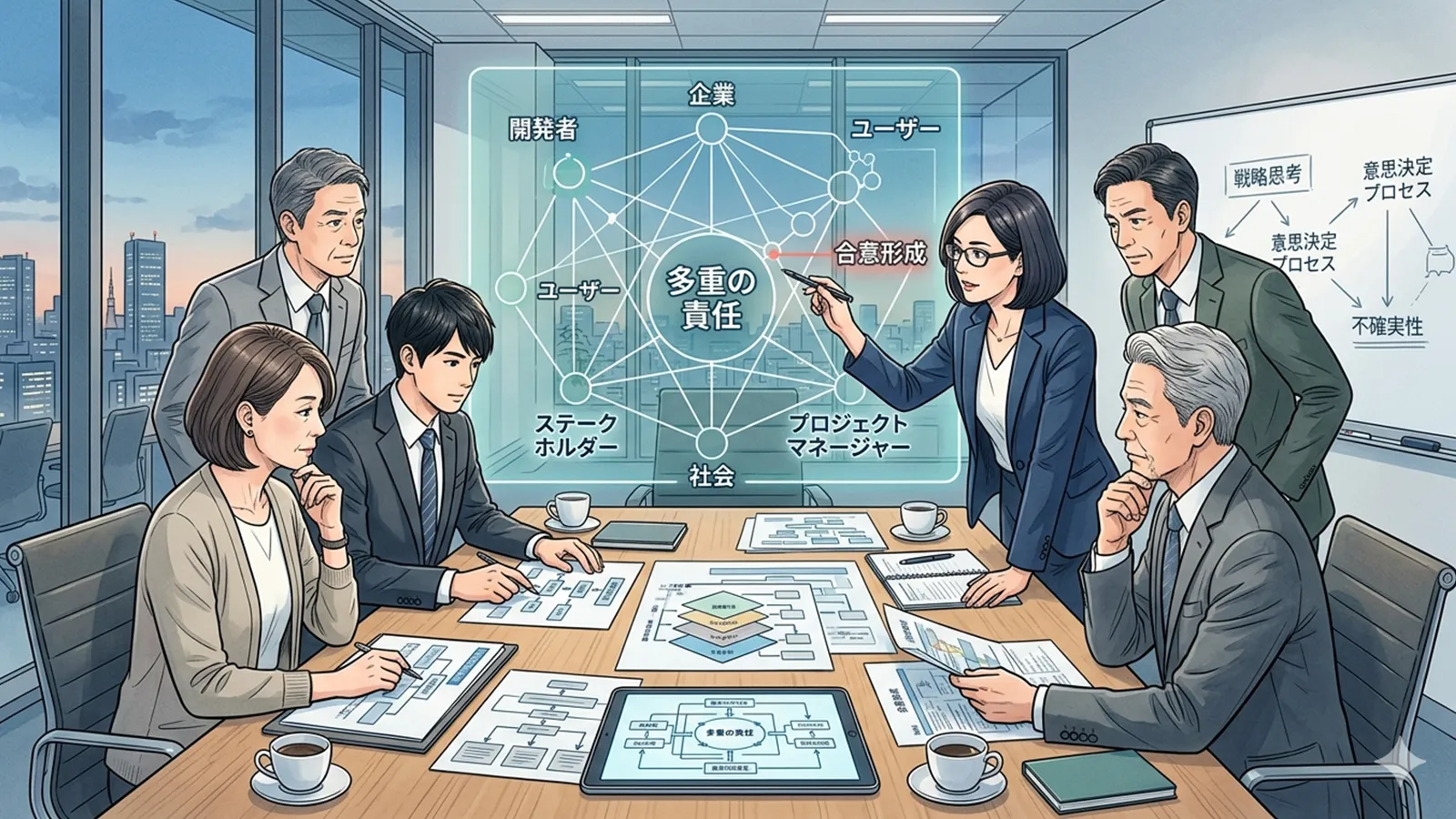

※(図:人間主体の意思決定と責任構造)

AI導入によって生まれる責任の分散

AIが意思決定に関与するようになると、責任は複数の主体に分散します。具体的には、以下のような主体が関与します。

- AI開発者:アルゴリズムの設計や学習データの選定を行う。

- AI提供者:AIシステムを市場に提供し、利用者に導入を促す。

- AI利用者:AIの判断を活用し、最終的な意思決定を行う。

- 組織・企業:AIを導入し、業務プロセスに組み込む。

例えば、AIが採用選考で候補者を選別した場合、その判断の根拠が不明瞭であれば、「AIが選んだ」という事実だけでは責任の所在は曖昧です。開発者はアルゴリズムの精度を担保したのか、提供者は適切な説明を行ったのか、利用者はAIの判断を盲目的に信頼しなかったか、組織は適切なガバナンスを整備したのか——これらの問いが浮かびます。

※(図:AIと意思決定責任の分散構造)

責任の所在をめぐる論点

AIは責任主体になり得るのか

法律上、責任を負うのは「法人」や「自然人」です。AIは法的な主体性を持たないため、直接的な責任を負うことはできません。しかし、AIが自律的に判断を下す場合、その判断の結果に対する責任は誰が負うべきなのか、という議論が続けられています。

最終判断責任は人間に残る

多くの専門家は、「AIはツールであり、最終的な判断は人間が行うべき」と主張します。例えば、AIが診断を補助しても、医師が最終的な治療方針を決定する。この立場では、AIの判断を活用する人間が責任を負うことになります。

企業・制度・ガバナンスの責任

AIの導入には、企業や制度の責任も問われます。例えば、AIを導入する企業は、そのシステムが適切に機能するよう監督し、説明責任を果たす必要があります。また、AIの利用に関する法制度やガイドラインの整備も求められています。

「説明責任」と「監督責任」の重要性

AIの判断プロセスがブラックボックス化する中で、「説明責任」が重要になります。AIがなぜその判断を下したのかを説明できる仕組みが必要です。また、AIを監督する人間や組織の「監督責任」も問われます。

本質は「誰が決めたか」ではなく「どう設計されたか」

AIの責任問題を考える際、重要なのは「誰が決めたか」ではなく、「どう設計されたか」です。AIが意思決定に関与する場合、そのプロセスの設計が責任を左右します。例えば、AIが診断を補助する場合、そのAIがどのようなデータで学習され、どのようなアルゴリズムで判断を下すのかが重要です。また、AIの判断を人間がどのように活用し、どのように監督するのかも重要です。

AIの精度や判断そのものよりも、「使い方・任せ方」の問題として整理する必要があります。責任は個人に帰属するのではなく、AIを取り巻く構造全体に帰属するという視点が求められています。

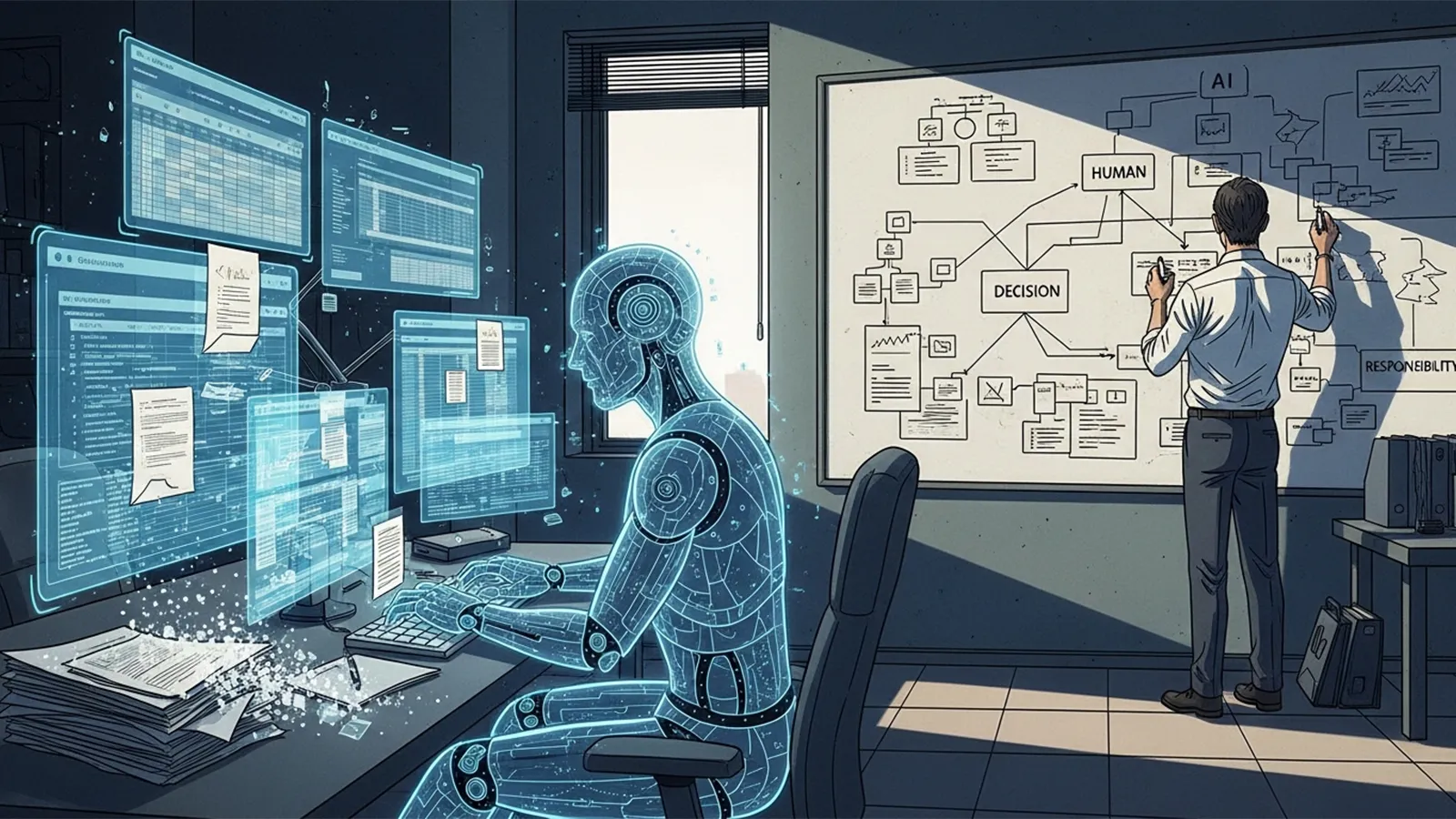

※(図:人間とAIの責任分担イメージ)

まとめ:AI時代の責任を考える視点

AIは責任を持つ存在ではありません。しかし、AIは責任構造を変える存在です。AIが意思決定に関与するようになると、責任は複数の主体に分散し、その所在は曖昧になりやすくなります。しかし、これは責任がなくなることを意味しません。むしろ、責任の所在を明確にするために、AIの設計や利用の仕方、監督の仕組みをより意識的に考える必要があります。

読者の皆さんがAIを利用する際には、以下の視点を持つことが重要です。

- AIはツールである:AIの判断を盲目的に信頼せず、人間が最終的な判断を行う。

- 説明責任を求める:AIの判断プロセスが説明可能であることを確認する。

- 構造的な視点を持つ:責任は個人に帰属するのではなく、AIを取り巻く構造全体に帰属する。

AI時代の責任問題に正解はありません。しかし、この問題を考えることは、AIをより安全で有益な存在として活用するための第一歩です。

【テーマ】

AIの導入によって意思決定プロセスが変化する中で、

「意思決定の責任は誰に帰属するのか」という問題について、

技術・制度・社会構造の観点から冷静かつ多面的に整理・考察してください。

【目的】

– 「AIが判断したから責任が曖昧になる」という単純な議論ではなく、責任構造の変化として整理する

– 読者がAIを利用する際のリスク・立場・役割を考えるための“視点”を提供する

– AI時代における「責任」とは何かを構造的に浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– 管理職・意思決定に関わる立場の人

– AIツールを業務で使い始めている人

– AIに詳しくはないが、責任問題に違和感や不安を感じている層

【記事構成】

1. 導入(問題提起)

– AIが意思決定に関与する場面が増えている現状を提示する

– 「誰が責任を取るのか分からない」という違和感を提示する

– なぜこの問題が今重要なのかを簡潔に説明する

2. 従来の責任構造とその前提

– 従来は「意思決定者=責任者」という構造であったことを整理する

– 人間主体の判断における責任のシンプルさを説明する

– この前提がAIによって揺らいでいることを示す

3. AI導入によって生まれる責任の分散

– 開発者・提供者・利用者・組織など、複数の主体が関与する構造を整理する

– 「判断」と「責任」が分離し始めている点に触れる

– なぜ責任が曖昧になりやすいのかを構造的に説明する

4. 責任の所在をめぐる論点

– AIは責任主体になり得るのかという議論

– 最終判断責任は人間に残るという考え方

– 企業・制度・ガバナンスの責任

– 「説明責任」「監督責任」といった概念の重要性

5. 本質は「誰が決めたか」ではなく「どう設計されたか」

– 意思決定プロセスの設計が責任を左右することを説明する

– AIの精度や判断ではなく、「使い方・任せ方」の問題として整理する

– 責任の個人帰属から構造帰属への変化を示す

6. まとめ

– AIは責任を持つ存在ではなく、責任構造を変える存在であることを再確認する

– 読者が自分の立場(使う側・任せる側)として何を意識すべきかの視点を提示する

– 結論を断定せず、思考を促す形で締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

– 3案すべて同等の品質であることを必須とする

– 条件を満たさないタイトルは出力しないこと

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– タイトルは「読者が感じる違和感・不満・疑問」を起点とすること

– 「なぜ〜なのか」「〜でよいのか」「〜はどうなっているのか」など自然な疑問文とすること

– 「〜なのでしょうか」「〜ではないでしょうか」などの丁寧すぎる疑問文は禁止する

– 会話文や説明文ではなく「心の中のつぶやき」の自然な語感にすること

– 一読で意味が理解できる短さと具体性を持たせること

– 抽象的・論文的な表現(例:どのように影響するのか/どのように位置づけられるのか)は避けること

– 文字数は20〜35文字程度を目安とすること

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 「?」は使用しない

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:AIと意思決定責任の分散構造)

※(図:人間とAIの責任分担イメージ)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AIが判断したとき責任は誰に残るのか」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

—

## 1. 導入:AIが変える意思決定の現場

近年、AIは医療診断、採用選考、金融取引、自動運転など、多岐にわたる分野で意思決定を支援し、時には代行する存在となっています。例えば、AIがレントゲン画像から病変を検出し、医師の診断を補助する。あるいは、AIが過去のデータから最適な投資先を提案し、ファンドマネージャーの判断を助ける。こうした場面で、「AIが判断した結果、問題が発生したら、誰が責任を取るのか」という疑問が浮かびます。

この問いは、単なる技術的な問題ではありません。AIが意思決定に関与することで、責任の所在が曖昧になるという違和感は、多くの人が感じ始めているのではないでしょうか。なぜ今、この問題が重要なのか。それは、AIが人間の判断を補助するだけでなく、人間が理解しきれない複雑なプロセスで結論を導き出すようになったからです。人間が最終的な判断を下すとしても、その判断の根拠がAIの「ブラックボックス」に依存している場合、責任の所在はどこにあるのでしょうか。

—

## 2. 従来の責任構造とその前提

従来、意思決定と責任はシンプルな構造を持っていました。「意思決定者=責任者」という原則です。例えば、医師が診断を下し、その診断に基づいて治療方針を決定する。その際、医師は自らの知識と経験に基づいて判断し、その結果に対する責任を負います。この構造では、判断と責任が一体化しており、誰が責任を負うのかは明確です。

しかし、AIが意思決定に関与するようになると、この構造が揺らぎ始めます。AIは人間のように「意図」を持たず、学習データやアルゴリズムに基づいて判断を下します。そのため、「AIが判断した」という事実だけでは、責任の所在を明確にすることは難しくなります。

※(図:人間主体の意思決定と責任構造)

—

## 3. AI導入によって生まれる責任の分散

AIが意思決定に関与するようになると、責任は複数の主体に分散します。具体的には、以下のような主体が関与します。

– **AI開発者**:アルゴリズムの設計や学習データの選定を行う。

– **AI提供者**:AIシステムを市場に提供し、利用者に導入を促す。

– **AI利用者**:AIの判断を活用し、最終的な意思決定を行う。

– **組織・企業**:AIを導入し、業務プロセスに組み込む。

例えば、AIが採用選考で候補者を選別した場合、その判断の根拠が不明瞭であれば、「AIが選んだ」という事実だけでは責任の所在は曖昧です。開発者はアルゴリズムの精度を担保したのか、提供者は適切な説明を行ったのか、利用者はAIの判断を盲目的に信頼しなかったか、組織は適切なガバナンスを整備したのか——これらの問いが浮かびます。

※(図:AIと意思決定責任の分散構造)

—

## 4. 責任の所在をめぐる論点

AIの責任問題を考える際、以下の論点が議論されています。

### AIは責任主体になり得るのか

法律上、責任を負うのは「法人」や「自然人」です。AIは法的な主体性を持たないため、直接的な責任を負うことはできません。しかし、AIが自律的に判断を下す場合、その判断の結果に対する責任は誰が負うべきなのか、という議論が続けられています。

### 最終判断責任は人間に残る

多くの専門家は、「AIはツールであり、最終的な判断は人間が行うべき」と主張します。例えば、AIが診断を補助しても、医師が最終的な治療方針を決定する。この立場では、AIの判断を活用する人間が責任を負うことになります。

### 企業・制度・ガバナンスの責任

AIの導入には、企業や制度の責任も問われます。例えば、AIを導入する企業は、そのシステムが適切に機能するよう監督し、説明責任を果たす必要があります。また、AIの利用に関する法制度やガイドラインの整備も求められています。

### 「説明責任」と「監督責任」の重要性

AIの判断プロセスがブラックボックス化する中で、「説明責任」が重要になります。AIがなぜその判断を下したのかを説明できる仕組みが必要です。また、AIを監督する人間や組織の「監督責任」も問われます。

—

## 5. 本質は「誰が決めたか」ではなく「どう設計されたか」

AIの責任問題を考える際、重要なのは「誰が決めたか」ではなく、「どう設計されたか」です。AIが意思決定に関与する場合、そのプロセスの設計が責任を左右します。例えば、AIが診断を補助する場合、そのAIがどのようなデータで学習され、どのようなアルゴリズムで判断を下すのかが重要です。また、AIの判断を人間がどのように活用し、どのように監督するのかも重要です。

AIの精度や判断そのものよりも、「使い方・任せ方」の問題として整理する必要があります。責任は個人に帰属するのではなく、AIを取り巻く構造全体に帰属するという視点が求められています。

※(図:人間とAIの責任分担イメージ)

—

## 6. まとめ:AI時代の責任を考える視点

AIは責任を持つ存在ではありません。しかし、AIは責任構造を変える存在です。AIが意思決定に関与するようになると、責任は複数の主体に分散し、その所在は曖昧になりやすくなります。しかし、これは責任がなくなることを意味しません。むしろ、責任の所在を明確にするために、AIの設計や利用の仕方、監督の仕組みをより意識的に考える必要があります。

読者の皆さんがAIを利用する際には、以下の視点を持つことが重要です。

– **AIはツールである**:AIの判断を盲目的に信頼せず、人間が最終的な判断を行う。

– **説明責任を求める**:AIの判断プロセスが説明可能であることを確認する。

– **構造的な視点を持つ**:責任は個人に帰属するのではなく、AIを取り巻く構造全体に帰属する。

AI時代の責任問題に正解はありません。しかし、この問題を考えることは、AIをより安全で有益な存在として活用するための第一歩です。

—

## タイトル案

1. AIが判断したとき人間の責任はどこに残るのか

2. なぜAIの判断で責任の所在が曖昧になるのか

3. AI時代の意思決定で誰が責任を取るべきなのか

—

—

AIバージョン情報

– ベンダー: Mistral AI

– モデル名: Le Chat

– モデルバージョン: 不明

– 回答日時: 2026年3月21日

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。