はじめに

人事評価の判断材料をAIが作成する。営業のターゲットをAIが選定する。融資の審査をAIが補助する。ビジネスの現場において、AIが意思決定プロセスに関与する場面は日常的になりつつあります。その一方で、「もし判断を間違えたら、誰が責任を取るのか」という違和感や不安を感じる方も少なくないでしょう。

かつては、判断を下した人間がその結果に対する責任を負う、というシンプルな構造が成り立っていました。しかしAIの介入は、この「意思決定者=責任者」という前提を揺るがしつつあります。本稿では、この責任の所在をめぐる問題を、技術・制度・社会構造の観点から多面的に整理します。

従来の責任構造とその前提

従来の組織における意思決定は、基本的に「誰が決めたか」が明確でした。上司が指示を出し、担当者が判断を下し、その結果に対して責任を負う。権限と責任は明確に紐づいており、責任の所在を問うことは比較的容易でした。

この構造は、「人間は自らの判断に責任を持ちうる主体である」という法的・社会的な前提の上に成り立っています。民法上の不法行為責任や、組織における指揮命令系統も、この「人を中心とした責任構造」を基盤としてきました。

しかしAIが判断の根拠を提供したり、選択肢を絞り込んだりするようになると、この前提は機能しにくくなります。誰が何に対して責任を持つのかという境界が、そもそも曖昧になってしまうのです。

AI導入によって生まれる責任の分散

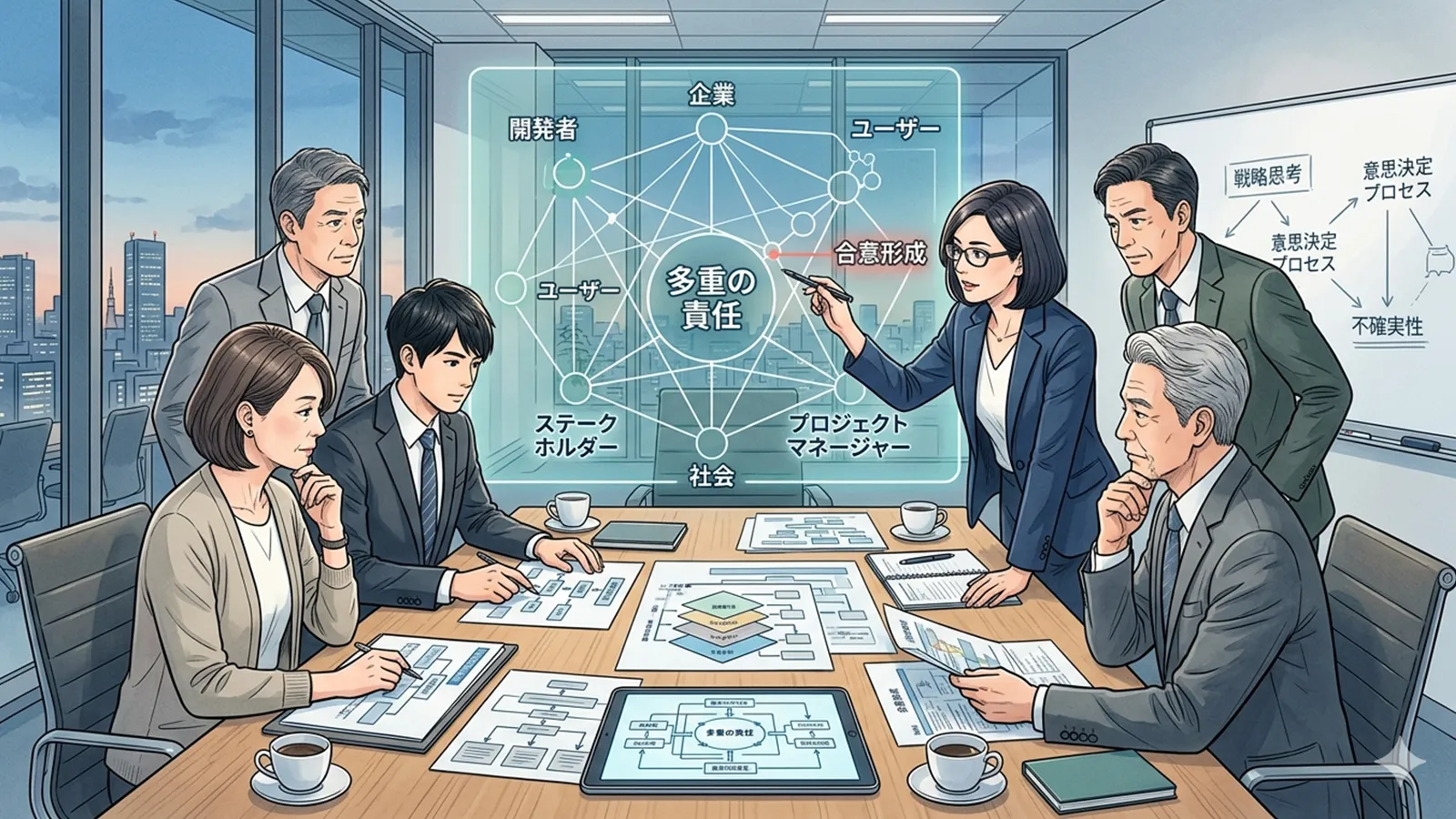

AIが関与する意思決定プロセスには、複数の主体が関わります。

- 開発者:AIモデルを設計・学習させる

- 提供者:AIをサービスとして提供する

- 導入企業:AIを業務に組み込む

- 利用者:AIの出力をもとに判断する

- 監査役:プロセスを検証する

従来は「判断した人」に一元化されていた責任が、これらの複数の主体に分散されます。さらに重要なのは、「判断」と「責任」が分離し始めている点です。AIが判断の素材を提供し、人間が最終判断を下す場合、その「最終判断」が妥当であったかどうかという責任と、「提供された素材」の妥当性に対する責任が、異なる主体に帰属することになります。

この分散構造が、結果として「誰も責任を取らない」という状況を生み出しやすくしているのです。

責任の所在をめぐる論点

AIは責任主体になり得るのか

法律上の「責任」は、現在のところ自然人または法人に帰属するものです。AI自身が法的な責任主体となることはありません。仮にAIが自律的に判断を下したとしても、その責任は設計者・提供者・利用者といった人間の側に帰属するというのが、現行の法体系における基本的な考え方です。

最終判断責任は人間に残るという考え方

多くのガイドラインや制度設計では、「AIはあくまで補助ツールであり、最終的な判断責任は人間にある」とされます。これは一見すると明快ですが、実際の現場では「形式的に人間が承認しているだけ」になりかねないという課題があります。AIの提案をそのまま通すことが暗黙のルール化した場合、責任だけが形骸化するリスクがあります。

企業・制度・ガバナンスの責任

近年注目されているのは、個人の責任ではなく、組織としての「監督責任」や「説明責任」のあり方です。AIの導入にあたり、どのような目的で、どのような検証プロセスを経て、どのような運用ルールのもとで使用するのか。これらの体制を整備する責任は、組織そのものにあるという考え方です。

本質は「誰が決めたか」ではなく「どう設計されたか」

ここまでの議論を踏まえると、この問題の本質は「AIが判断したから責任が曖昧になる」というよりも、「判断プロセスがどのように設計されているか」にあります。

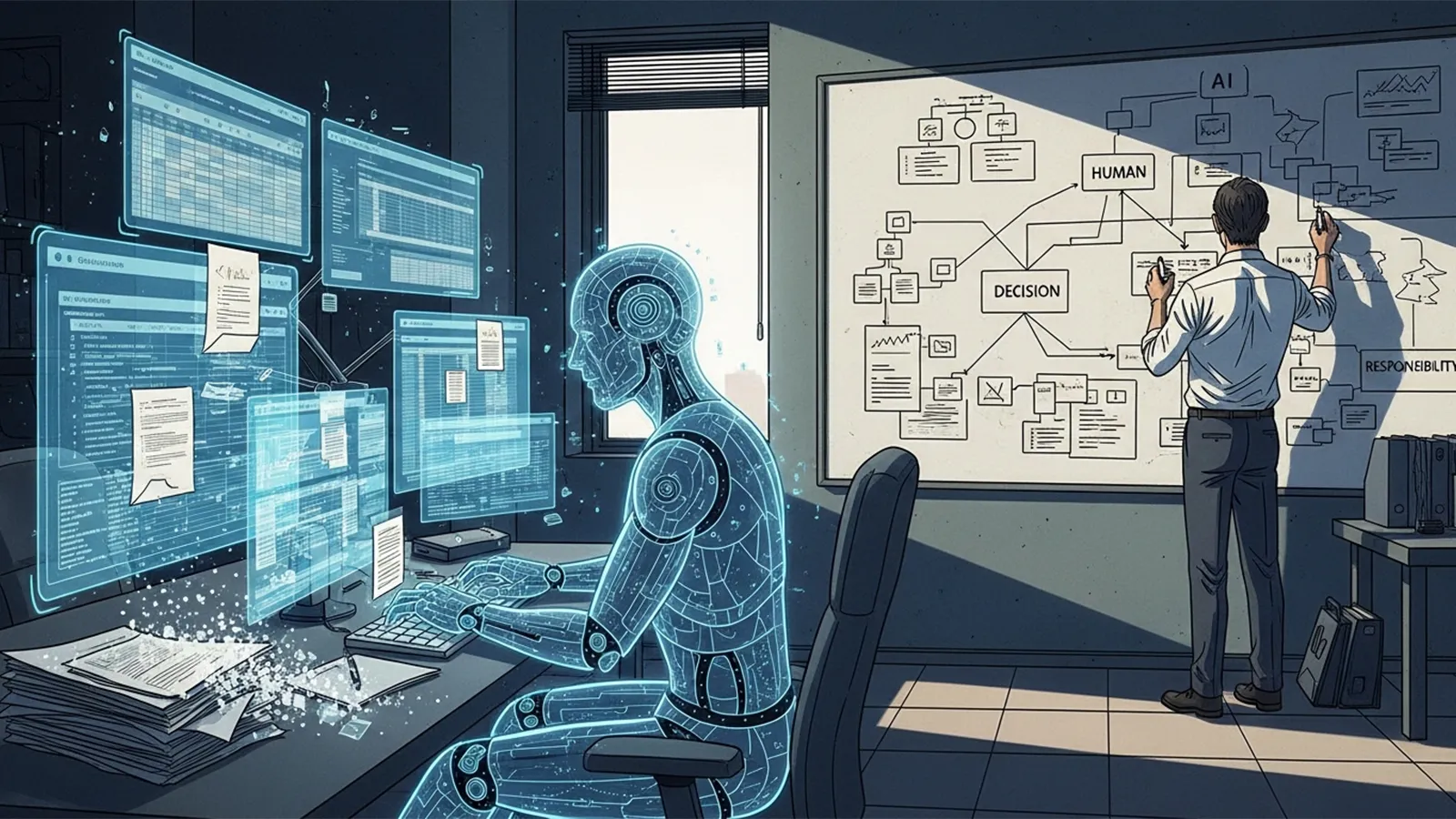

AIの出力結果がどのような経緯で導かれたのか。人間がどの段階でどのように介入するのか。誤った判断が発生した場合に、どのようなフィードバックループが機能するのか。これらはすべて、技術の精度以前に「使い方・任せ方」として設計されるべきです。

※(図:人間とAIの責任分担イメージ)

責任の所在を個人に帰属させる従来の考え方から、組織やシステムの構造として責任を設計する考え方へ。この視点の転換が、AI時代における責任問題に対処するうえで重要ではないでしょうか。

まとめ

AIは責任を持つ存在ではありません。しかし、責任の構造を大きく変える存在です。複数の主体が関与し、判断と責任が分離するこの構造の中で、私たちは「誰が責任を取るのか」という問いを、より精緻な形で問い直す必要があります。

読者の皆様がAIを「使う側」「任せる側」として何を意識すべきか。それはおそらく、AIそのものの精度や能力以上に、「自分たちがどのようなプロセスを設計し、どのようなルールのもとで運用しているのか」という点ではないでしょうか。

特定の結論を断ずることはできませんが、この責任構造の変化を意識しておくことが、AIを適切に活用するための第一歩になるはずです。

【テーマ】

AIの導入によって意思決定プロセスが変化する中で、

「意思決定の責任は誰に帰属するのか」という問題について、

技術・制度・社会構造の観点から冷静かつ多面的に整理・考察してください。

【目的】

– 「AIが判断したから責任が曖昧になる」という単純な議論ではなく、責任構造の変化として整理する

– 読者がAIを利用する際のリスク・立場・役割を考えるための“視点”を提供する

– AI時代における「責任」とは何かを構造的に浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– 管理職・意思決定に関わる立場の人

– AIツールを業務で使い始めている人

– AIに詳しくはないが、責任問題に違和感や不安を感じている層

【記事構成】

1. 導入(問題提起)

– AIが意思決定に関与する場面が増えている現状を提示する

– 「誰が責任を取るのか分からない」という違和感を提示する

– なぜこの問題が今重要なのかを簡潔に説明する

2. 従来の責任構造とその前提

– 従来は「意思決定者=責任者」という構造であったことを整理する

– 人間主体の判断における責任のシンプルさを説明する

– この前提がAIによって揺らいでいることを示す

3. AI導入によって生まれる責任の分散

– 開発者・提供者・利用者・組織など、複数の主体が関与する構造を整理する

– 「判断」と「責任」が分離し始めている点に触れる

– なぜ責任が曖昧になりやすいのかを構造的に説明する

4. 責任の所在をめぐる論点

– AIは責任主体になり得るのかという議論

– 最終判断責任は人間に残るという考え方

– 企業・制度・ガバナンスの責任

– 「説明責任」「監督責任」といった概念の重要性

5. 本質は「誰が決めたか」ではなく「どう設計されたか」

– 意思決定プロセスの設計が責任を左右することを説明する

– AIの精度や判断ではなく、「使い方・任せ方」の問題として整理する

– 責任の個人帰属から構造帰属への変化を示す

6. まとめ

– AIは責任を持つ存在ではなく、責任構造を変える存在であることを再確認する

– 読者が自分の立場(使う側・任せる側)として何を意識すべきかの視点を提示する

– 結論を断定せず、思考を促す形で締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

– 3案すべて同等の品質であることを必須とする

– 条件を満たさないタイトルは出力しないこと

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– タイトルは「読者が感じる違和感・不満・疑問」を起点とすること

– 「なぜ〜なのか」「〜でよいのか」「〜はどうなっているのか」など自然な疑問文とすること

– 「〜なのでしょうか」「〜ではないでしょうか」などの丁寧すぎる疑問文は禁止する

– 会話文や説明文ではなく「心の中のつぶやき」の自然な語感にすること

– 一読で意味が理解できる短さと具体性を持たせること

– 抽象的・論文的な表現(例:どのように影響するのか/どのように位置づけられるのか)は避けること

– 文字数は20〜35文字程度を目安とすること

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 「?」は使用しない

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:AIと意思決定責任の分散構造)

※(図:人間とAIの責任分担イメージ)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AIが判断したとき責任は誰に残るのか」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

### はじめに

人事評価の判断材料をAIが作成する。営業のターゲットをAIが選定する。融資の審査をAIが補助する。ビジネスの現場において、AIが意思決定プロセスに関与する場面は日常的になりつつあります。その一方で、「もし判断を間違えたら、誰が責任を取るのか」という違和感や不安を感じる方も少なくないでしょう。

かつては、判断を下した人間がその結果に対する責任を負う、というシンプルな構造が成り立っていました。しかしAIの介入は、この「意思決定者=責任者」という前提を揺るがしつつあります。本稿では、この責任の所在をめぐる問題を、技術・制度・社会構造の観点から多面的に整理します。

### 従来の責任構造とその前提

従来の組織における意思決定は、基本的に「誰が決めたか」が明確でした。上司が指示を出し、担当者が判断を下し、その結果に対して責任を負う。権限と責任は明確に紐づいており、責任の所在を問うことは比較的容易でした。

この構造は、「人間は自らの判断に責任を持ちうる主体である」という法的・社会的な前提の上に成り立っています。民法上の不法行為責任や、組織における指揮命令系統も、この「人を中心とした責任構造」を基盤としてきました。

しかしAIが判断の根拠を提供したり、選択肢を絞り込んだりするようになると、この前提は機能しにくくなります。誰が何に対して責任を持つのかという境界が、そもそも曖昧になってしまうのです。

### AI導入によって生まれる責任の分散

AIが関与する意思決定プロセスには、複数の主体が関わります。

– **開発者**:AIモデルを設計・学習させる

– **提供者**:AIをサービスとして提供する

– **導入企業**:AIを業務に組み込む

– **利用者**:AIの出力をもとに判断する

– **監査役**:プロセスを検証する

従来は「判断した人」に一元化されていた責任が、これらの複数の主体に分散されます。さらに重要なのは、「判断」と「責任」が分離し始めている点です。AIが判断の素材を提供し、人間が最終判断を下す場合、その「最終判断」が妥当であったかどうかという責任と、「提供された素材」の妥当性に対する責任が、異なる主体に帰属することになります。

この分散構造が、結果として「誰も責任を取らない」という状況を生み出しやすくしているのです。

### 責任の所在をめぐる論点

#### AIは責任主体になり得るのか

法律上の「責任」は、現在のところ自然人または法人に帰属するものです。AI自身が法的な責任主体となることはありません。仮にAIが自律的に判断を下したとしても、その責任は設計者・提供者・利用者といった人間の側に帰属するというのが、現行の法体系における基本的な考え方です。

#### 最終判断責任は人間に残るという考え方

多くのガイドラインや制度設計では、「AIはあくまで補助ツールであり、最終的な判断責任は人間にある」とされます。これは一見すると明快ですが、実際の現場では「形式的に人間が承認しているだけ」になりかねないという課題があります。AIの提案をそのまま通すことが暗黙のルール化した場合、責任だけが形骸化するリスクがあります。

#### 企業・制度・ガバナンスの責任

近年注目されているのは、個人の責任ではなく、組織としての「監督責任」や「説明責任」のあり方です。AIの導入にあたり、どのような目的で、どのような検証プロセスを経て、どのような運用ルールのもとで使用するのか。これらの体制を整備する責任は、組織そのものにあるという考え方です。

### 本質は「誰が決めたか」ではなく「どう設計されたか」

ここまでの議論を踏まえると、この問題の本質は「AIが判断したから責任が曖昧になる」というよりも、「判断プロセスがどのように設計されているか」にあります。

AIの出力結果がどのような経緯で導かれたのか。人間がどの段階でどのように介入するのか。誤った判断が発生した場合に、どのようなフィードバックループが機能するのか。これらはすべて、技術の精度以前に「使い方・任せ方」として設計されるべきものです。

※(図:人間とAIの責任分担イメージ)

責任の所在を個人に帰属させる従来の考え方から、組織やシステムの構造として責任を設計する考え方へ。この視点の転換が、AI時代における責任問題に対処するうえで重要ではないでしょうか。

### まとめ

AIは責任を持つ存在ではありません。しかし、責任の構造を大きく変える存在です。複数の主体が関与し、判断と責任が分離するこの構造の中で、私たちは「誰が責任を取るのか」という問いを、より精緻な形で問い直す必要があります。

読者の皆様がAIを「使う側」「任せる側」として何を意識すべきか。それはおそらく、AIそのものの精度や能力以上に、「自分たちがどのようなプロセスを設計し、どのようなルールのもとで運用しているのか」という点ではないでしょうか。

特定の結論を断ずることはできませんが、この責任構造の変化を意識しておくことが、AIを適切に活用するための第一歩になるはずです。

—

### タイトル案

AIが判断を出したとき責任は誰にあるのか

その判断、AIと人間どちらが決めたのか

AI導入で責任の所在が曖昧になるのはなぜか

—

—

AIバージョン情報

– ベンダー: DeepSeek

– モデル名: DeepSeek

– モデルバージョン: 不明

– 回答日時: 2026-03-21

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。