AI導入が進む中で、「誰が責任を負うのか」が見えにくくなっているという声が増えています。業務の一部をAIに任せることが当たり前になりつつある一方で、判断の根拠や責任の所在が従来の枠組みでは説明しにくくなっているためです。本記事では、特定の結論を断定するのではなく、技術・制度・社会構造の観点からこの問題を多面的に整理し、読者が自分の立場で考えるための視点を提供します。

AIが意思決定に関与する場面の増加と違和感

AIが意思決定に関与する場面の増加

営業予測、人事評価、リスク管理、顧客対応など、かつて人間が判断していた領域にもAIが入り込み、意思決定プロセスの一部を担うようになっています。

「誰が責任を取るのか」という違和感

AIの判断を参考にした結果、誤った意思決定が行われた場合に「AIがそう言ったから」「システムの仕様通りに使っただけ」といった責任の押し付け合いが起きやすくなっています。

なぜ今この問題が重要なのか

AIは単なるツールではなく、意思決定の質や方向性に影響を与える存在になりつつあります。そのため、従来の「判断=人間」「責任=人間」という構造が揺らぎ、責任の所在を再設計する必要性が高まっています。

従来の責任構造とその前提

「意思決定者=責任者」というシンプルな構造

これまでの組織では、意思決定を行った人がその結果に責任を負うという前提がありました。判断の根拠も経験や知識に紐づいていたため、責任の所在は比較的明確でした。

人間主体の判断が持つ透明性

人間の判断は曖昧であっても「誰が決めたか」は明確でした。しかしAIが介在すると、判断のプロセスがブラックボックス化し、責任の説明が難しくなります。

この前提がAIによって揺らぐ理由

AIは人間の判断を補助するだけでなく、場合によっては推奨や自動判断を行います。これにより意思決定の主体が曖昧になり、従来の責任構造がそのままでは機能しなくなっています。

AI導入によって生まれる責任の分散

関与する主体の増加

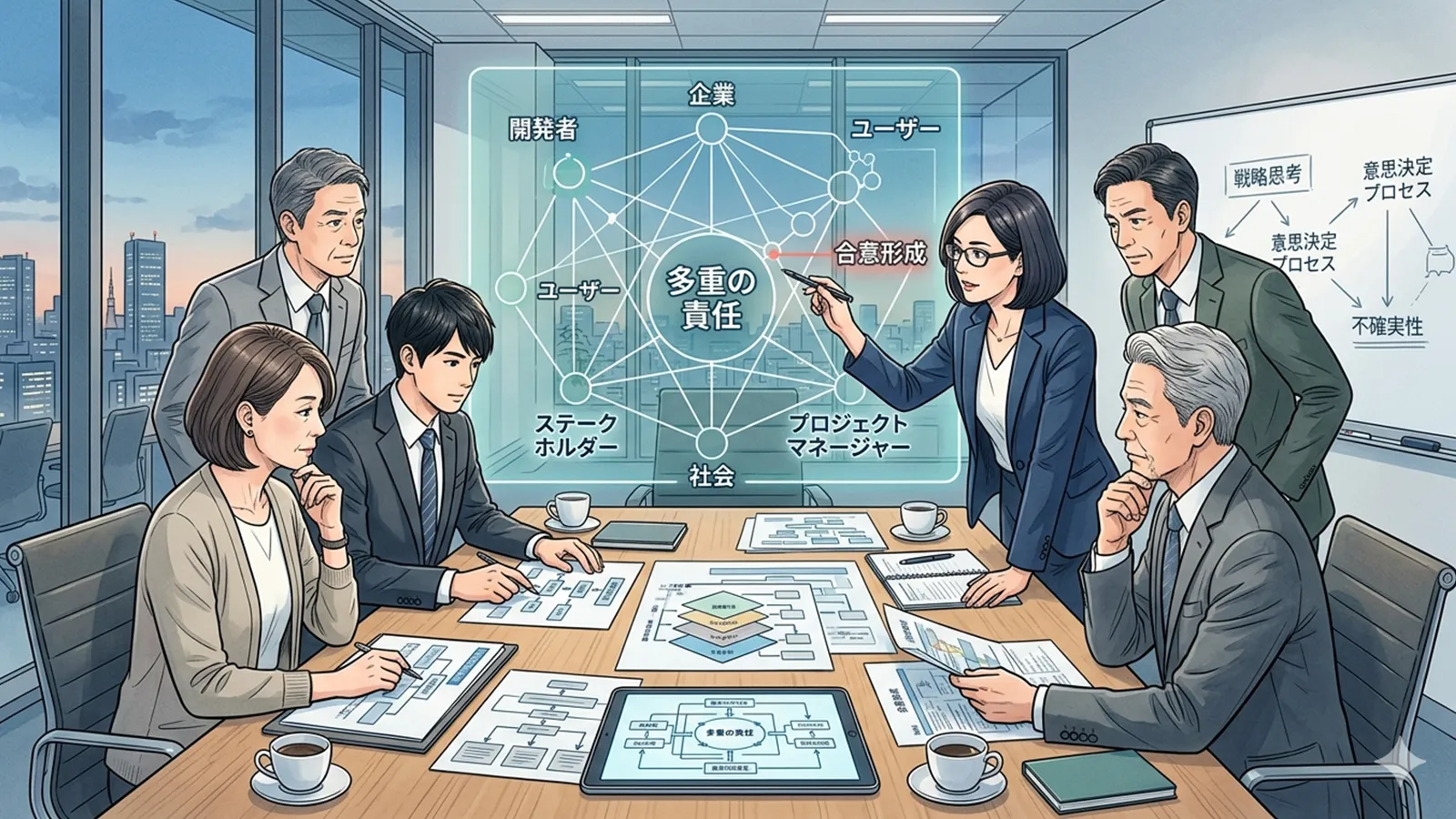

AIが関わる意思決定には複数の主体が関与します。

- 開発者:アルゴリズムの設計・学習データの選定

- 提供者(ベンダー):サービスの運用・アップデート

- 利用者(現場担当者):AIの出力をどう扱うか

- 組織(管理者):AI導入の方針・運用ルールの策定

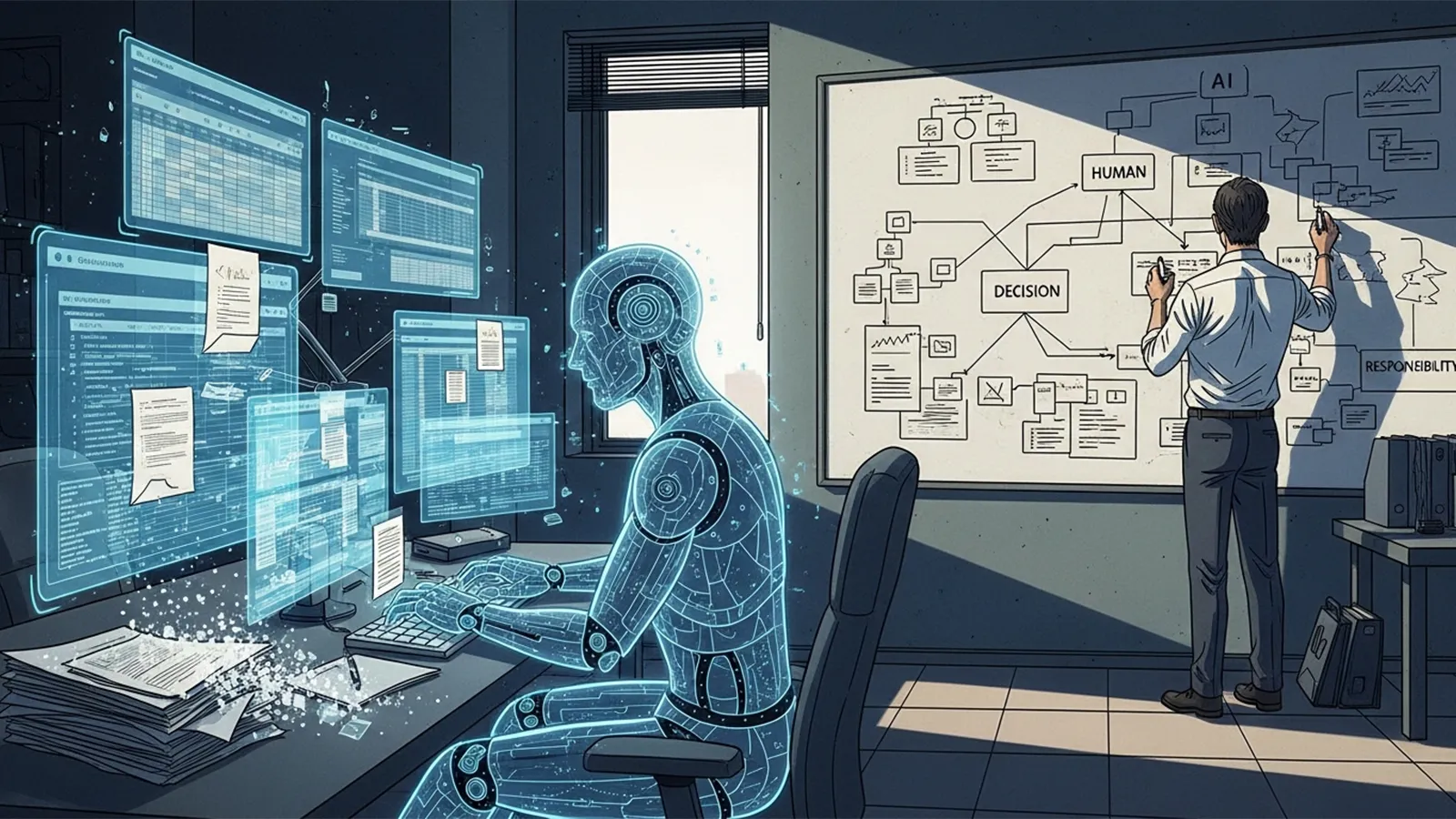

※(図:AIと意思決定責任の分散構造)

「判断」と「責任」の分離

AIが判断を行い、人間がその判断を採用するという構造では「判断したのはAI」「決めたのは人間」という二重構造が生まれます。

なぜ責任が曖昧になりやすいのか

- AIの判断根拠が説明しにくい

- データやアルゴリズムの偏りが見えにくい

- 利用者がAIの判断を過信しやすい

- 組織がAI導入のリスクを十分に設計していない

責任の所在をめぐる論点

AIは責任主体になり得るのか

AIは法的主体ではなく、意図や倫理観を持ちません。そのためAIそのものが責任を負うという考え方は現実的ではありません。

最終判断責任は人間に残るという立場

多くの制度やガイドラインでは最終的な責任は人間にあるとされています。しかしAIの判断が強く影響する状況では、人間が形式的な責任者になってしまう懸念もあります。

企業・制度・ガバナンスの責任

AIの導入・運用においては、企業や組織がどのようなガバナンスを構築するかが重要です。

- 運用ルール

- モニタリング体制

- データ管理

- リスク評価

「説明責任」「監督責任」の重要性

AIの判断を利用する側には、AIの出力をそのまま受け入れるのではなく「なぜその判断に至ったのか」「その判断を採用してよいのか」を確認する責任が求められます。

本質は「誰が決めたか」ではなく「どう設計されたか」

意思決定プロセスの設計が責任を左右する

AI導入後の責任問題は、個人の判断能力よりもプロセス設計の問題として捉える必要があります。

※(図:人間とAIの責任分担イメージ)

AIの精度ではなく「使い方・任せ方」の問題

AIの性能が高くても、どこまで任せるか、どの段階で人間が介入するか、どのように監視するかといった設計が不十分であれば責任は曖昧になります。

責任の個人帰属から構造帰属へ

AI時代の責任は、個人の判断ミスではなく「組織としてどのような意思決定構造を設計したか」に帰属する傾向が強まっています。

まとめ

AIは責任を持つ存在ではなく、責任構造そのものを変える存在です。読者がAIを利用する立場で意識すべきなのは、AIの判断をどう扱うか、どこまで任せるか、どのように説明できる状態を保つかといったプロセスの設計です。本記事がAI時代の意思決定と責任について考えるための材料となれば幸いです。

【テーマ】

AIの導入によって意思決定プロセスが変化する中で、

「意思決定の責任は誰に帰属するのか」という問題について、

技術・制度・社会構造の観点から冷静かつ多面的に整理・考察してください。

【目的】

– 「AIが判断したから責任が曖昧になる」という単純な議論ではなく、責任構造の変化として整理する

– 読者がAIを利用する際のリスク・立場・役割を考えるための“視点”を提供する

– AI時代における「責任」とは何かを構造的に浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– 管理職・意思決定に関わる立場の人

– AIツールを業務で使い始めている人

– AIに詳しくはないが、責任問題に違和感や不安を感じている層

【記事構成】

1. 導入(問題提起)

– AIが意思決定に関与する場面が増えている現状を提示する

– 「誰が責任を取るのか分からない」という違和感を提示する

– なぜこの問題が今重要なのかを簡潔に説明する

2. 従来の責任構造とその前提

– 従来は「意思決定者=責任者」という構造であったことを整理する

– 人間主体の判断における責任のシンプルさを説明する

– この前提がAIによって揺らいでいることを示す

3. AI導入によって生まれる責任の分散

– 開発者・提供者・利用者・組織など、複数の主体が関与する構造を整理する

– 「判断」と「責任」が分離し始めている点に触れる

– なぜ責任が曖昧になりやすいのかを構造的に説明する

4. 責任の所在をめぐる論点

– AIは責任主体になり得るのかという議論

– 最終判断責任は人間に残るという考え方

– 企業・制度・ガバナンスの責任

– 「説明責任」「監督責任」といった概念の重要性

5. 本質は「誰が決めたか」ではなく「どう設計されたか」

– 意思決定プロセスの設計が責任を左右することを説明する

– AIの精度や判断ではなく、「使い方・任せ方」の問題として整理する

– 責任の個人帰属から構造帰属への変化を示す

6. まとめ

– AIは責任を持つ存在ではなく、責任構造を変える存在であることを再確認する

– 読者が自分の立場(使う側・任せる側)として何を意識すべきかの視点を提示する

– 結論を断定せず、思考を促す形で締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

– 3案すべて同等の品質であることを必須とする

– 条件を満たさないタイトルは出力しないこと

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– タイトルは「読者が感じる違和感・不満・疑問」を起点とすること

– 「なぜ〜なのか」「〜でよいのか」「〜はどうなっているのか」など自然な疑問文とすること

– 「〜なのでしょうか」「〜ではないでしょうか」などの丁寧すぎる疑問文は禁止する

– 会話文や説明文ではなく「心の中のつぶやき」の自然な語感にすること

– 一読で意味が理解できる短さと具体性を持たせること

– 抽象的・論文的な表現(例:どのように影響するのか/どのように位置づけられるのか)は避けること

– 文字数は20〜35文字程度を目安とすること

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 「?」は使用しない

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:AIと意思決定責任の分散構造)

※(図:人間とAIの責任分担イメージ)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AIが判断したとき責任は誰に残るのか」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

AI導入が進む中で、「誰が責任を負うのか」が見えにくくなっているという声が増えています。業務の一部をAIに任せることが当たり前になりつつある一方で、判断の根拠や責任の所在が従来の枠組みでは説明しにくくなっているためです。本記事では、特定の結論を断定するのではなく、技術・制度・社会構造の観点からこの問題を多面的に整理し、読者が自分の立場で考えるための視点を提供します。

—

## 1. 導入(問題提起)

### AIが意思決定に関与する場面の増加

業務効率化や高度な分析のために、AIが意思決定プロセスに組み込まれるケースが急速に増えています。営業予測、人事評価、リスク管理、顧客対応など、かつて人間が判断していた領域にもAIが入り込んでいます。

### 「誰が責任を取るのか」という違和感

AIの判断を参考にした結果、誤った意思決定が行われた場合、

「AIがそう言ったから」

「システムの仕様通りに使っただけ」

といった“責任の押し付け合い”が起きやすくなっています。

### なぜ今この問題が重要なのか

AIは単なるツールではなく、意思決定の質や方向性に影響を与える存在になりつつあります。そのため、従来の「判断=人間」「責任=人間」という構造が揺らぎ、責任の所在を再設計する必要性が高まっています。

—

## 2. 従来の責任構造とその前提

### 「意思決定者=責任者」というシンプルな構造

これまでの組織では、意思決定を行った人がその結果に責任を負うという前提がありました。判断の根拠も、経験・知識・価値観といった“人間の内面”に紐づいていたため、責任の所在は比較的明確でした。

### 人間主体の判断が持つ透明性

人間の判断は曖昧であっても、「誰が決めたか」は明確でした。

しかしAIが介在すると、判断のプロセスがブラックボックス化し、責任の説明が難しくなります。

### この前提がAIによって揺らぐ理由

AIは人間の判断を補助するだけでなく、場合によっては“推奨”や“自動判断”を行います。これにより、意思決定の主体が曖昧になり、従来の責任構造がそのままでは機能しなくなっています。

—

## 3. AI導入によって生まれる責任の分散

### 関与する主体の増加

AIが関わる意思決定には、複数の主体が関与します。

– **開発者**:アルゴリズムの設計・学習データの選定

– **提供者(ベンダー)**:サービスの運用・アップデート

– **利用者(現場担当者)**:AIの出力をどう扱うか

– **組織(管理者)**:AI導入の方針・運用ルールの策定

※(図:AIと意思決定責任の分散構造)

### 「判断」と「責任」の分離

AIが判断を行い、人間がその判断を採用するという構造では、

「判断したのはAI」

「決めたのは人間」

という二重構造が生まれます。

### なぜ責任が曖昧になりやすいのか

– AIの判断根拠が説明しにくい

– データやアルゴリズムの偏りが見えにくい

– 利用者がAIの判断を過信しやすい

– 組織がAI導入のリスクを十分に設計していない

こうした要因が重なることで、責任の所在が分散し、曖昧化しやすくなります。

—

## 4. 責任の所在をめぐる論点

### AIは責任主体になり得るのか

AIは法的主体ではなく、意図や倫理観を持ちません。そのため、AIそのものが責任を負うという考え方は現実的ではありません。

### 最終判断責任は人間に残るという立場

多くの制度やガイドラインでは、最終的な責任は人間にあるとされています。しかし、AIの判断が強く影響する状況では、人間が「形式的な責任者」になってしまう懸念もあります。

### 企業・制度・ガバナンスの責任

AIの導入・運用においては、企業や組織がどのようなガバナンスを構築するかが重要です。

– 運用ルール

– モニタリング体制

– データ管理

– リスク評価

これらの設計が不十分であれば、責任の所在はさらに不明確になります。

### 「説明責任」「監督責任」の重要性

AIの判断を利用する側には、AIの出力をそのまま受け入れるのではなく、

「なぜその判断に至ったのか」

「その判断を採用してよいのか」

を確認する責任が求められます。

—

## 5. 本質は「誰が決めたか」ではなく「どう設計されたか」

### 意思決定プロセスの設計が責任を左右する

AI導入後の責任問題は、個人の判断能力よりも、プロセス設計の問題として捉える必要があります。

※(図:人間とAIの責任分担イメージ)

### AIの精度ではなく「使い方・任せ方」の問題

AIの性能が高くても、

– どこまで任せるか

– どの段階で人間が介入するか

– どのように監視するか

といった設計が不十分であれば、責任は曖昧になります。

### 責任の個人帰属から構造帰属へ

AI時代の責任は、個人の判断ミスではなく、

「組織としてどのような意思決定構造を設計したか」

に帰属する傾向が強まっています。

—

## 6. まとめ

AIは責任を持つ存在ではなく、責任構造そのものを変える存在です。

読者の皆さまがAIを利用する立場で意識すべきなのは、

– AIの判断をどう扱うか

– どこまで任せるか

– どのように説明できる状態を保つか

といった“プロセスの設計”です。

本記事が、AI時代の意思決定と責任について考えるための材料となれば幸いです。

—

## タイトル案(※条件厳守)

1. AIの判断に責任はどこへ向かうのか

2. AIを使った決定の責任は誰が背負うのか

3. AI任せの判断で責任はどこに残るのか

—

## AIバージョン情報

– ベンダー: Microsoft

– モデル名: 不明

– モデルバージョン: 不明

– 回答日時: 2026-03-21

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。