採用の可否をAIがスコアリングする。融資審査をアルゴリズムが判定する。医療画像の診断を機械学習モデルが補助する。こうした場面は、もはや先端的な事例ではなく、多くの職場で日常的な現実になりつつあります。それと同時に、多くの人が感じるのが「何かトラブルが起きたとき、いったい誰が謝るのか」という違和感です。AIが出した判断に従って動いた結果、問題が生じた場合——その責任は開発会社にあるのか、導入した組織にあるのか、それとも最終的にOKを押した担当者にあるのか。この問いに答えが出ないまま、AIの活用だけが先行している状況があります。本記事では、責任が「消えた」のではなく「構造が変わった」という視点から、この問題を整理します。

従来の責任構造:「決めた人が責任を取る」というシンプルさ

人間主体の意思決定における前提

従来のビジネス現場では、意思決定の責任構造は比較的シンプルでした。「誰が決めたか」が明確であれば、「誰が責任を取るか」もおのずと決まる。上司が承認した、担当者が判断した——そうした事実の連鎖によって、責任の帰属先が辿れる構造です。

法的にも、契約・不法行為・職務権限などの枠組みは、基本的に「意思を持つ人間」が行為の主体であることを前提に設計されています。責任とは、判断を下した人間に帰属するものでした。

AIがこの前提を揺るがす理由

AIが意思決定に関与すると、「誰が決めたか」が曖昧になります。人間はAIの出力を参照しながら判断するため、「自分が決めた」とも「AIが決めた」とも言い切れない状態が生まれます。判断の主体が人間とシステムの間に分散し、従来の責任帰属の前提が成立しにくくなるのです。

AI導入が生む「責任の分散」

複数の主体が関与する構造

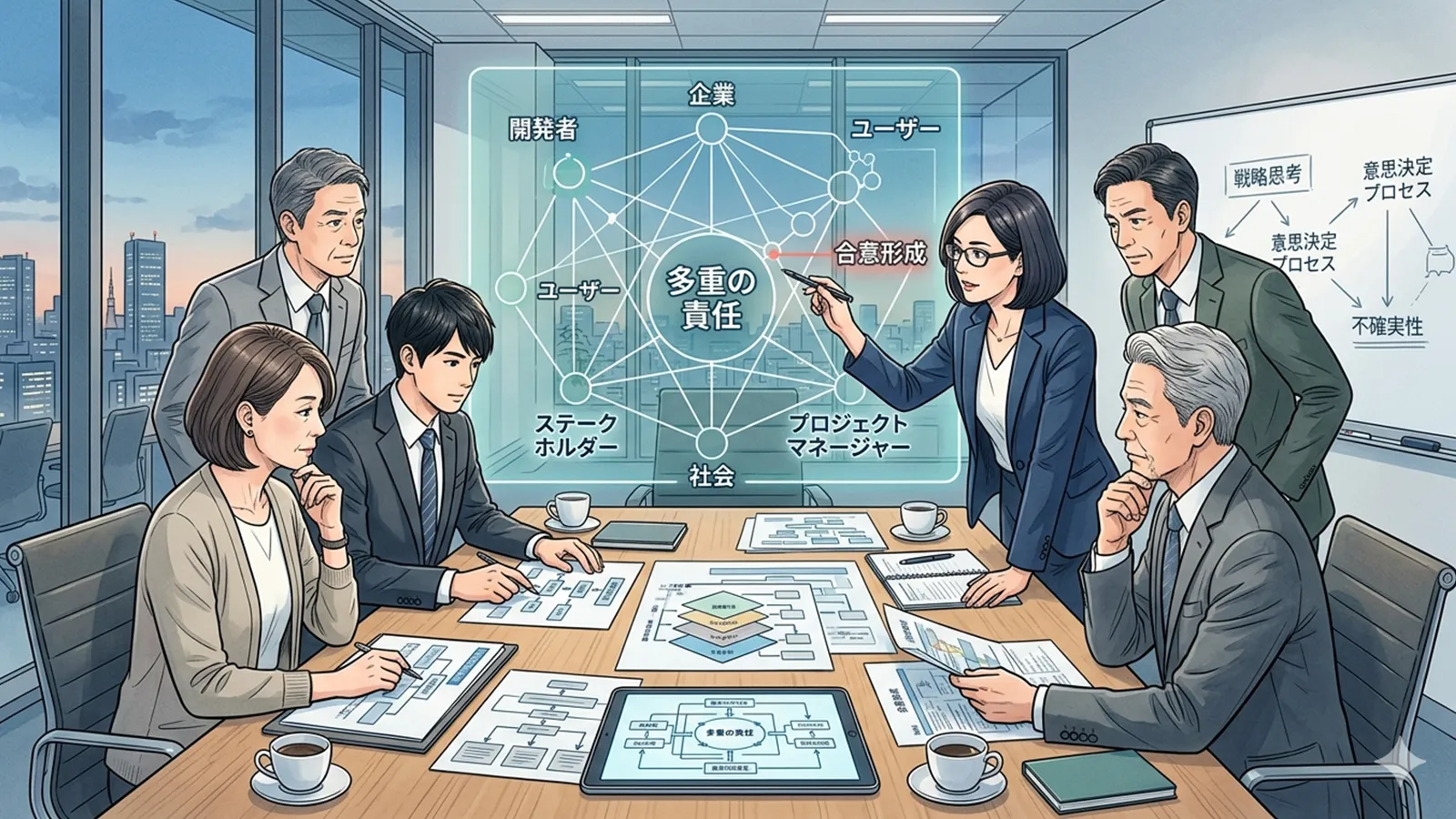

AIを使った意思決定には、少なくとも以下の主体が関わっています。

- 開発者・研究者:モデルの設計・学習データの選定

- 提供企業(ベンダー):製品化・利用規約・精度保証の範囲

- 導入組織:業務への適用・運用ルールの設定

- 現場の利用者:AIの出力を受け取り、最終判断を行う人間

これらの主体が連鎖的に関与することで、「どの段階の判断が問題だったのか」を特定することが難しくなります。

※(図:AIと意思決定責任の分散構造)

「判断」と「責任」の分離

特に注目すべきは、判断の実行者と責任の帰属先が一致しなくなるという点です。現場の担当者はAIの出力に従ったにすぎないと感じ、開発者は「使い方の問題だ」と言い、導入企業は「ツールの精度の問題だ」と言う——こうした責任の”たらい回し”が構造的に起きやすくなります。

責任が曖昧になるのは、誰かが意図的に逃げているからではなく、関与の連鎖が複雑になっているからです。

責任の所在をめぐる主な論点

AIは責任主体になれるのか

現時点では、AIは法的な「人格」を持たず、責任を負う主体とは認められていません。AIが誤った判断を下しても、AIを訴えることはできませんし、AIが謝罪することもありません。責任は常に、AIを設計・運用・利用した「人間や組織」に帰属します。

最終判断責任は人間に残るという考え方

多くのガイドラインや法的解釈では、「AIの出力はあくまで参考情報であり、最終的な判断責任は人間にある」という立場が取られています。これは理念としては明快ですが、実際の現場では「AIが高精度で推奨しているなら従うのが合理的」という判断圧力が生まれ、形式的な「人間の最終確認」が形骸化するリスクもあります。

企業・制度・ガバナンスの責任

個人の判断の問題としてだけでなく、組織としてAIをどう導入・管理するかという「ガバナンス(統治)」の問題として捉える視点も重要です。EUのAI規制法(EU AI Act)をはじめ、世界各国でAIの利用責任を制度的に定める動きが加速しています。

「説明責任」と「監督責任」の重要性

責任の概念として近年注目されているのが、説明責任(アカウンタビリティ)と監督責任(オーバーサイト)です。「なぜAIがその判断を下したのか」を説明できる体制を整えること、そしてAIの動作を継続的に監視・評価することが、組織に求められる責任の核心になりつつあります。

本質は「誰が決めたか」より「どう設計されたか」

責任は「個人の行為」から「プロセスの設計」へ

AIを使った意思決定において重要なのは、「最後にボタンを押したのは誰か」という問いよりも、そのプロセス全体がどのように設計されていたかという問いです。

どのデータでAIを学習させたか。どの業務にAIを適用することにしたか。AIの出力をどこまで信頼する運用にしたか。エラーが起きたときの是正プロセスは存在したか——こうした設計の選択が、責任構造を決定的に左右します。

※(図:人間とAIの責任分担イメージ)

「AIの精度」ではなく「AIの使い方」の問題

AIが誤った判断を補助したとき、問われるべきは「AIの精度が低かったかどうか」だけではありません。そのAIをその場面に使うことが適切だったか、使い方が適切だったかという点こそが、組織・個人の責任として問われます。

責任の「個人帰属」から「構造帰属」へ

従来の「誰が悪いか」という個人帰属の責任観から、「どういう構造・設計が問題だったか」という構造帰属の責任観へ——この転換が、AI時代における責任論の核心にあると言えます。これは責任を軽くするのではなく、より広い範囲の主体が責任を共有するという考え方への移行です。

まとめ:AIは責任を消すのではなく、責任の形を変える

AIは、意思決定の責任を消すわけではありません。責任の構造を、より複雑で分散したものに変えているのです。

使う側・任せる側の立場にある人——それはシステムを導入する経営者かもしれませんし、AIの出力を参考に判断する現場担当者かもしれません——が意識すべきことは、「AIが決めたから自分は関係ない」という切り離しの発想ではなく、自分がプロセスのどの位置にいて、どのような判断をしているのかを自覚することではないでしょうか。

AIの精度は向上し続けます。しかしその精度向上は、人間の責任を薄める方向には働きません。むしろ、AIが高度になるほど、それをどう設計し、どう使い、どう監督するかという人間側の責任の重さは増していくとも言えます。

「責任は誰にあるのか」という問いに一つの答えを出すことは難しい。しかしその問いを持ち続けること自体が、AI時代を生きる上での重要な姿勢になるのかもしれません。

【テーマ】

AIの導入によって意思決定プロセスが変化する中で、

「意思決定の責任は誰に帰属するのか」という問題について、

技術・制度・社会構造の観点から冷静かつ多面的に整理・考察してください。

【目的】

– 「AIが判断したから責任が曖昧になる」という単純な議論ではなく、責任構造の変化として整理する

– 読者がAIを利用する際のリスク・立場・役割を考えるための“視点”を提供する

– AI時代における「責任」とは何かを構造的に浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– 管理職・意思決定に関わる立場の人

– AIツールを業務で使い始めている人

– AIに詳しくはないが、責任問題に違和感や不安を感じている層

【記事構成】

1. 導入(問題提起)

– AIが意思決定に関与する場面が増えている現状を提示する

– 「誰が責任を取るのか分からない」という違和感を提示する

– なぜこの問題が今重要なのかを簡潔に説明する

2. 従来の責任構造とその前提

– 従来は「意思決定者=責任者」という構造であったことを整理する

– 人間主体の判断における責任のシンプルさを説明する

– この前提がAIによって揺らいでいることを示す

3. AI導入によって生まれる責任の分散

– 開発者・提供者・利用者・組織など、複数の主体が関与する構造を整理する

– 「判断」と「責任」が分離し始めている点に触れる

– なぜ責任が曖昧になりやすいのかを構造的に説明する

4. 責任の所在をめぐる論点

– AIは責任主体になり得るのかという議論

– 最終判断責任は人間に残るという考え方

– 企業・制度・ガバナンスの責任

– 「説明責任」「監督責任」といった概念の重要性

5. 本質は「誰が決めたか」ではなく「どう設計されたか」

– 意思決定プロセスの設計が責任を左右することを説明する

– AIの精度や判断ではなく、「使い方・任せ方」の問題として整理する

– 責任の個人帰属から構造帰属への変化を示す

6. まとめ

– AIは責任を持つ存在ではなく、責任構造を変える存在であることを再確認する

– 読者が自分の立場(使う側・任せる側)として何を意識すべきかの視点を提示する

– 結論を断定せず、思考を促す形で締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

– 3案すべて同等の品質であることを必須とする

– 条件を満たさないタイトルは出力しないこと

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– タイトルは「読者が感じる違和感・不満・疑問」を起点とすること

– 「なぜ〜なのか」「〜でよいのか」「〜はどうなっているのか」など自然な疑問文とすること

– 「〜なのでしょうか」「〜ではないでしょうか」などの丁寧すぎる疑問文は禁止する

– 会話文や説明文ではなく「心の中のつぶやき」の自然な語感にすること

– 一読で意味が理解できる短さと具体性を持たせること

– 抽象的・論文的な表現(例:どのように影響するのか/どのように位置づけられるのか)は避けること

– 文字数は20〜35文字程度を目安とすること

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 「?」は使用しない

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:AIと意思決定責任の分散構造)

※(図:人間とAIの責任分担イメージ)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AIが判断したとき責任は誰に残るのか」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

—

## 1. 導入:「誰が責任を取るのか」という違和感

採用の可否をAIがスコアリングする。融資審査をアルゴリズムが判定する。医療画像の診断を機械学習モデルが補助する。こうした場面は、もはや先端的な事例ではなく、多くの職場で日常的な現実になりつつあります。

それと同時に、多くの人が感じるのが「何かトラブルが起きたとき、いったい誰が謝るのか」という違和感です。AIが出した判断に従って動いた結果、問題が生じた場合——その責任は開発会社にあるのか、導入した組織にあるのか、それとも最終的にOKを押した担当者にあるのか。

この問いに答えが出ないまま、AIの活用だけが先行している状況があります。本記事では、責任が「消えた」のではなく「構造が変わった」という視点から、この問題を整理します。

—

## 2. 従来の責任構造:「決めた人が責任を取る」というシンプルさ

### 人間主体の意思決定における前提

従来のビジネス現場では、意思決定の責任構造は比較的シンプルでした。「誰が決めたか」が明確であれば、「誰が責任を取るか」もおのずと決まる。上司が承認した、担当者が判断した——そうした事実の連鎖によって、責任の帰属先が辿れる構造です。

法的にも、契約・不法行為・職務権限などの枠組みは、基本的に「意思を持つ人間」が行為の主体であることを前提に設計されています。責任とは、判断を下した人間に帰属するものでした。

### AIがこの前提を揺るがす理由

AIが意思決定に関与すると、「誰が決めたか」が曖昧になります。人間はAIの出力を参照しながら判断するため、「自分が決めた」とも「AIが決めた」とも言い切れない状態が生まれます。判断の主体が人間とシステムの間に分散し、従来の責任帰属の前提が成立しにくくなるのです。

—

## 3. AI導入が生む「責任の分散」

### 複数の主体が関与する構造

AIを使った意思決定には、少なくとも以下の主体が関わっています。

– **開発者・研究者**:モデルの設計・学習データの選定

– **提供企業(ベンダー)**:製品化・利用規約・精度保証の範囲

– **導入組織**:業務への適用・運用ルールの設定

– **現場の利用者**:AIの出力を受け取り、最終判断を行う人間

これらの主体が連鎖的に関与することで、「どの段階の判断が問題だったのか」を特定することが難しくなります。

※(図:AIと意思決定責任の分散構造)

### 「判断」と「責任」の分離

特に注目すべきは、**判断の実行者と責任の帰属先が一致しなくなる**という点です。現場の担当者はAIの出力に従ったにすぎないと感じ、開発者は「使い方の問題だ」と言い、導入企業は「ツールの精度の問題だ」と言う——こうした責任の”たらい回し”が構造的に起きやすくなります。

責任が曖昧になるのは、誰かが意図的に逃げているからではなく、**関与の連鎖が複雑になっているから**です。

—

## 4. 責任の所在をめぐる主な論点

### AIは責任主体になれるのか

現時点では、AIは法的な「人格」を持たず、責任を負う主体とは認められていません。AIが誤った判断を下しても、AIを訴えることはできませんし、AIが謝罪することもありません。責任は常に、AIを設計・運用・利用した「人間や組織」に帰属します。

### 最終判断責任は人間に残るという考え方

多くのガイドラインや法的解釈では、「AIの出力はあくまで参考情報であり、最終的な判断責任は人間にある」という立場が取られています。これは理念としては明快ですが、実際の現場では「AIが高精度で推奨しているなら従うのが合理的」という判断圧力が生まれ、形式的な「人間の最終確認」が形骸化するリスクもあります。

### 企業・制度・ガバナンスの責任

個人の判断の問題としてだけでなく、**組織としてAIをどう導入・管理するか**という「ガバナンス(統治)」の問題として捉える視点も重要です。EUのAI規制法(EU AI Act)をはじめ、世界各国でAIの利用責任を制度的に定める動きが加速しています。

### 「説明責任」と「監督責任」の重要性

責任の概念として近年注目されているのが、**説明責任(アカウンタビリティ)**と**監督責任(オーバーサイト)**です。「なぜAIがその判断を下したのか」を説明できる体制を整えること、そしてAIの動作を継続的に監視・評価することが、組織に求められる責任の核心になりつつあります。

—

## 5. 本質は「誰が決めたか」より「どう設計されたか」

### 責任は「個人の行為」から「プロセスの設計」へ

AIを使った意思決定において重要なのは、「最後にボタンを押したのは誰か」という問いよりも、**そのプロセス全体がどのように設計されていたか**という問いです。

どのデータでAIを学習させたか。どの業務にAIを適用することにしたか。AIの出力をどこまで信頼する運用にしたか。エラーが起きたときの是正プロセスは存在したか——こうした設計の選択が、責任構造を決定的に左右します。

※(図:人間とAIの責任分担イメージ)

### 「AIの精度」ではなく「AIの使い方」の問題

AIが誤った判断を補助したとき、問われるべきは「AIの精度が低かったかどうか」だけではありません。**そのAIをその場面に使うことが適切だったか、使い方が適切だったか**という点こそが、組織・個人の責任として問われます。

### 責任の「個人帰属」から「構造帰属」へ

従来の「誰が悪いか」という個人帰属の責任観から、「どういう構造・設計が問題だったか」という構造帰属の責任観へ——この転換が、AI時代における責任論の核心にあると言えます。これは責任を軽くするのではなく、**より広い範囲の主体が責任を共有する**という考え方への移行です。

—

## 6. まとめ:AIは責任を消すのではなく、責任の形を変える

AIは、意思決定の責任を消すわけではありません。責任の構造を、より複雑で分散したものに変えているのです。

使う側・任せる側の立場にある人——それはシステムを導入する経営者かもしれませんし、AIの出力を参考に判断する現場担当者かもしれません——が意識すべきことは、「AIが決めたから自分は関係ない」という切り離しの発想ではなく、**自分がプロセスのどの位置にいて、どのような判断をしているのかを自覚すること**ではないでしょうか。

AIの精度は向上し続けます。しかしその精度向上は、人間の責任を薄める方向には働きません。むしろ、AIが高度になるほど、**それをどう設計し、どう使い、どう監督するか**という人間側の責任の重さは増していくとも言えます。

「責任は誰にあるのか」という問いに一つの答えを出すことは難しい。しかしその問いを持ち続けること自体が、AI時代を生きる上での重要な姿勢になるのかもしれません。

—

## タイトル案

1. AIに判断を任せた組織の責任はどこへ向かうのか

2. AIが関わった決定の責任を誰も取れない構造になっていないか

3. 意思決定をAIに頼るほど責任の輪郭が見えなくなるのはなぜか

—

AIバージョン情報

– ベンダー: Anthropic

– モデル名: Claude

– モデルバージョン: Claude Sonnet 4.6

– 回答日時: 2026年3月21日

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。