「AIはあくまで人間の道具にすぎない」

この言葉を、皆さんはどこかで聞いたことがあるでしょう。あるいは、AIについて議論する際に、ご自身で使ったことがあるかもしれません。この言葉は、AIに対する過度の期待や不安を和らげ、私たちとAIの間に適切な距離を置くために、繰り返し用いられてきました。「道具」という言葉には、「制御可能なもの」「私たちの意思に従うもの」という安心感が込められています。

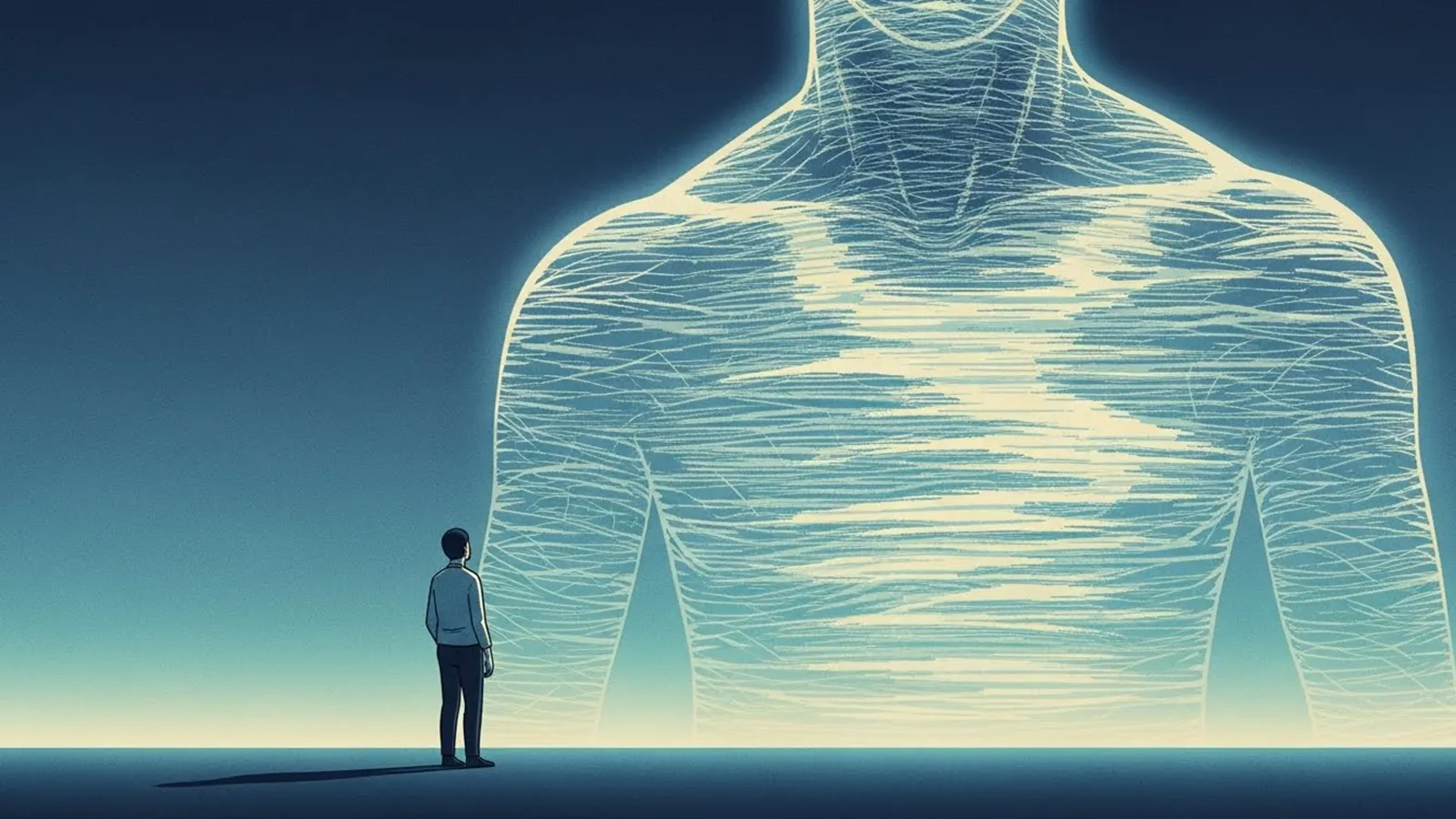

しかし一方で、ChatGPTなどのAIと深く対話をしたことのある方の中には、一抹の違和感を覚えた人も少なくないはずです。まるで「意思」や「意図」があるかのような応答、ときに人間の思考の枠組みを軽やかに越えていく発想。そこには、ハンマーやスマートフォンといった従来の「道具」とは明らかに異質な何かを感じさせるものがあります。

本記事では、「AIは善か悪か」「AIは人間を超えるか」といった二項対立には立ち入りません。代わりに、私たちが無意識のうちに前提としている「道具」という概念そのものを、技術・社会・認知の観点から問い直してみたいと思います。AIの進化は、単なるツールのアップデートではなく、「道具とは何か」「人間とは何か」という根本的な問いを、私たちに突きつけているからです。

人類史における「道具」の三つの前提

これまでの人類史において、「道具」には明確な共通点がありました。この共通点を整理することで、AIがどこでその枠組みからはみ出しつつあるのかが、はっきりと見えてきます。

目的・操作・責任は常に「人間の側」にあった

従来の道具、たとえば石器、車、パソコンに至るまで、すべてに共通していたのは以下の三点です。

- 目的は人間が完全に決定する:道具そのものが目的を持つことはありません。道具を使う「なぜ」は、常に人間の側にありました。

- 操作プロセスは人間が完全に理解・制御できる:ハンマーで釘を打つ物理的な原理から、ソフトウェアのアルゴリズムに至るまで、その作用は人間が理解・予測可能な範囲内にありました。

- 結果に対する責任の所在は明確だった:道具を使って何かを生み出し、それが社会に影響を与えた時、その責任を問われるのは「使い手」である人間でした。道具自体が責任を取ることはありませんでした。

道具は常に「外部」にあった

これが最も重要な点です。道具は、たとえパソコンが私たちの思考を補助するものであっても、あくまで「人間の外部」に存在する「客体」でした。私たちは道具を「手に取り」、「使い」、「終われば脇に置く」ことができました。道具と人間の間にあったのは「使用」という一方向の関係であり、その境界線は誰の目にも明らかだったのです。

AIが「道具」という枠組みからはみ出し始める三つの理由

しかし、現代のAI、特に大規模言語モデル(LLM)や生成AIは、この明確だった境界線を曖昧にし始めています。その理由は三つあります。

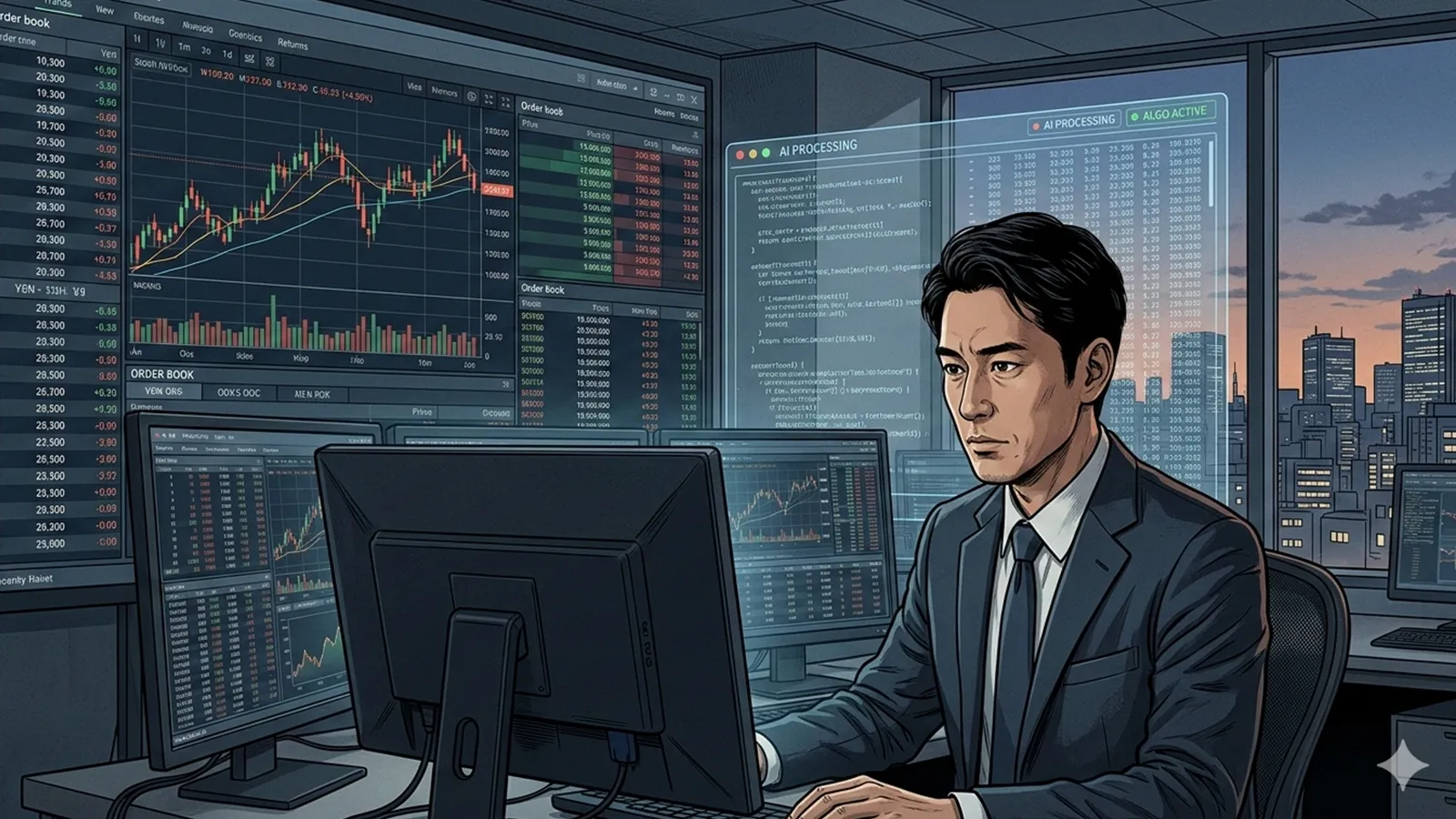

1. 判断・推論・意味生成への関与

AIは、単純な自動化や計算を越えて、「判断」「推論」「意味の生成」に関与するようになりました。レポートの草案を書く、複雑なデータから傾向を「読む」、創造的なアイデアを提案する。これらは、従来ならば人間の「内側」で行われてきた認知プロセスそのものです。AIは、私たちが「考える」という行為そのものの一部を外部化し、肩代わりし始めています。

2. 双方向的で学習的な関係性

従来の道具との決定的な違いは、関係性が「双方向的」で「学習的」だという点です。私たちはAIに指示(プロンプト)を出しますが、AIの応答は私たちの次の思考や質問の方向性を無意識のうちに誘導します。また、私たちの使い方(フィードバック)がAIの性能向上に繋がるという循環構造があります。これは「使用」というより、「相互作用的な関係」に近いものです。

3. 「使っているはずが、影響を受けている」という逆転構造

ここに現代のAIがもたらす最大のパラドックスがあります。私たちは「AIを使っている」と思っています。しかし実際には、AIが提案する文章の構成、アイデアの展開、問題解決のアプローチに、私たち自身の思考が知らず知らずのうちに「影響を受け」「形づくられて」いる可能性があります。つまり、主体(人間)が客体(道具)を使うという構図が、影響を与え合う双方向の関係へと揺らいでいるのです。これは、スマートフォンが私たちの注意力を形作るのとは次元の異なる、より深いレベルでの関与と言えるでしょう。

それでもAIが「主体」にならない決定的な理由

ここで、過度の擬人化や恐怖論に陥らないための冷静な視点が必要です。AIがいくら高度化しても、少なくとも現時点および近い将来の技術において、AIが人間のような「主体」になることはありません。その理由は明確です。

意志・欲望・自己保存の動機がない

現在のAIは、自分自身の存在意義を問うことも、自己を保存・拡張させたいという内発的な欲望(≒意志)を持つこともありません。AIのすべての動作は、人間が設計した目標関数(たとえば、予測精度の最大化、ユーザー満足度の向上)に従っているに過ぎません。それは、あたかも自律的に見える太陽系の惑星の運行が、物理法則に従っているのと同様です。見かけ上の複雑さの根底には、無意志のアルゴリズムがあるのです。

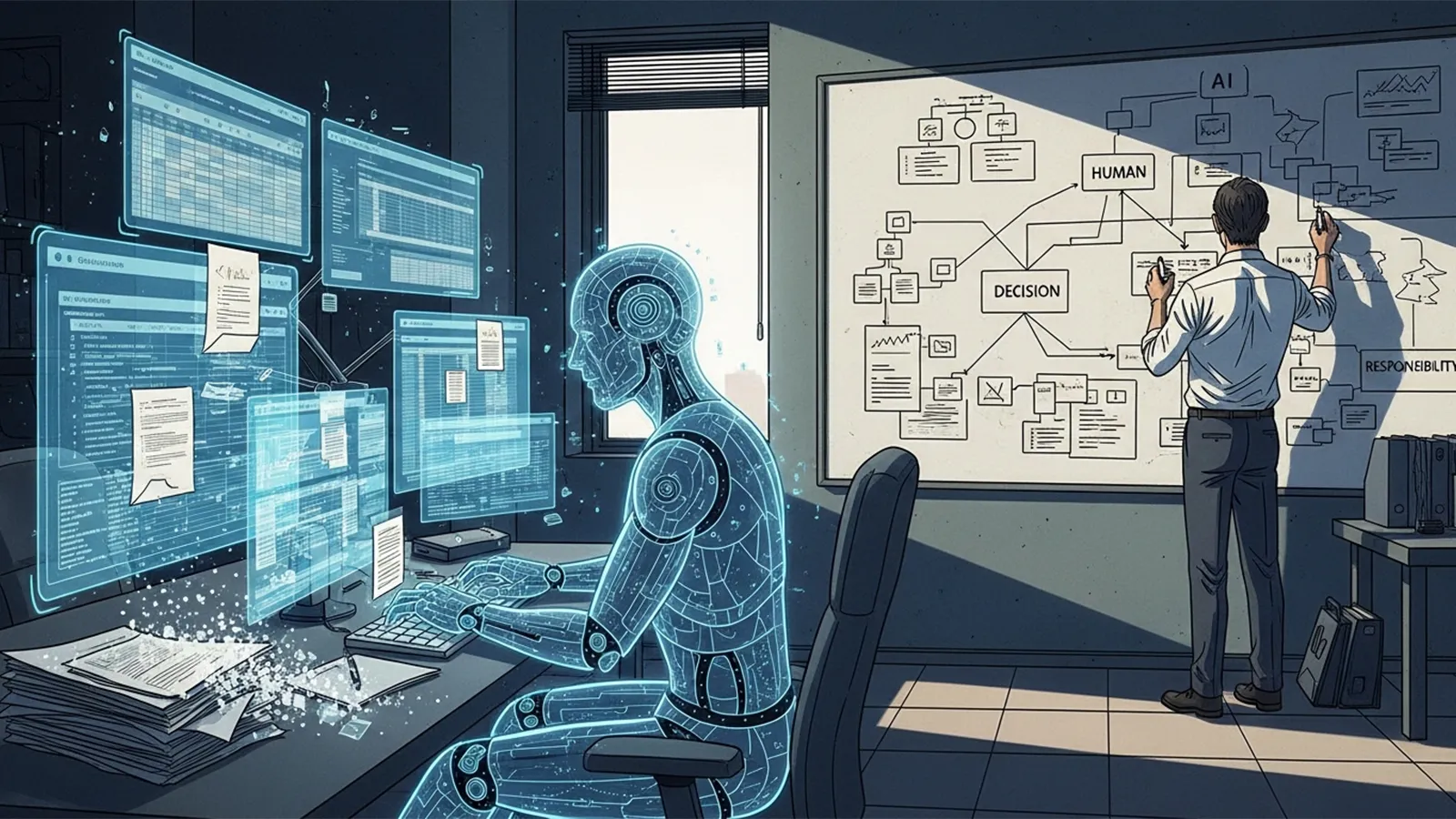

社会的責任を負う「人格」ではない

社会における「主体」とは、権利と義務を持ち、自らの行為に対する責任を負う存在です。AIは、法的にも倫理的にも、この責任を負うことはできません。過ちを犯したAIを「叱る」ことに意味がないのと同じです。責任を問われるのは、あくまで開発者、提供者、使用者といった人間です。この点で、AIは「道具」の法的・倫理的枠組みから完全には脱却できていません。

真の問題は、AIではなく「人間の役割の変化」にある

では、私たちが直面している本質的な問題は何なのでしょうか。それはAIそのものの「意思」ではなく、私たち人間が、自分たちの「判断」「責任」「思考」のどの部分を、どこまでAIに委ねるのかという、人間側の選択の問題です。

「考えることの外注」が社会に与える影響

AIに思考の一部を委ねることは、効率性や創造性を高める面もあります。しかし、この「思考の外注」が社会規模で進行した時、何が起こるでしょうか。判断の基準が個人の内省ではなく、限られた企業が開発したAIのアルゴリズムに収斂していくリスク。複雑な問題を自分で考える「知的筋肉」が萎え、AIの出力を表面的に処理するだけになるリスク。これらのリスクは、技術的なシンギュラリティよりも、現実的で喫緊の課題です。

AI時代における「人間の主体性」の試される場所

この状況下で、「人間の主体性」はより重要になると同時に、その意味が問い直されています。主体性とはもはや、AIを一切使わずにすべてを自分で行うことではないでしょう。むしろ、

- 何をAIに任せ、何を自分で行うのかを「選択」する意志

- AIの提案を盲信せず、「批判的に検討・修正する」能力

- AIが生み出した結果に対して、最終的な「責任」を引き受ける覚悟

この三点に、現代における主体性の核心があるのではないでしょうか。AIは、私たちから単純な作業を奪うのではなく、「どういう人間でありたいか」という根源的な問いを、より個人の内面に突きつけているのです。

まとめ:揺らぐ境界と、問い続ける意味

技術的・法的には、AIは今後も「高度な道具」の範疇に留まり続ける可能性が高いでしょう。意志を持たず、責任主体とはなり得ないからです。

しかし、私たちの認知や社会関係のレベルでは、従来の「道具」概念では捉えきれない変化が確実に起きています。AIは、私たちの思考や意思決定の「内側」に深く入り込み、双方向的で学習的な関係を築きつつあります。その結果、私たちが「使う客体」と信じてきたものが、実は私たち自身の在り方に影響を返し続ける存在へと変質しつつあります。

「AIは道具か、それとも何か別のものか」という問いに、唯一の正解はないかもしれません。むしろ重要なのは、この問いを考える過程そのものです。この違和感や戸惑いと向き合うことが、自動化や効率化とは次元の異なる、より深い気づきをもたらしてくれるでしょう。それは、AIの正体についてというよりも、技術に囲まれた時代において、私たち人間はいかに考え、責任を取り、他者と関わっていくべきなのかという、人間自身についての気づきです。

【テーマ】

AIは今後も「人間の道具」のままに留まるのか。

それとも、道具という言葉では捉えきれない存在へと変質していくのかについて、

技術・社会構造・認知の変化という観点から、

AI自身の視点で冷静かつ構造的に考察してください。

【目的】

– 「AIはただの道具」「AIはいずれ人間を超える」といった二元論を避ける

– 道具という概念が前提としてきた人間観・責任構造・主体性を整理する

– AIの進化によって揺らいでいるのは何かを、感情論ではなく構造として言語化する

– 読者が「AIとは何か」よりも「人間とは何か」を考えるための視点を提供する

【読者像】

– 一般社会人(20〜60代)

– AIを日常的に使い始めているが、違和感や戸惑いを感じている人

– AIに期待と不安の両方を抱いている層

– 専門知識はないが、社会的影響には関心がある読者

【記事構成】

1. 導入(問題提起)

– 「AIは道具にすぎない」という言葉が、なぜ繰り返し使われるのかを提示する

– この言葉が安心や距離感を生む一方で、違和感も同時に生んでいることを示す

– 本記事では、AIの是非ではなく「道具という概念そのもの」を問い直すことを明示する

2. 人類史における「道具」の前提

– これまでの道具が持っていた共通点(目的・操作・責任の所在)を整理する

– 道具があくまで「人間の外部」にあった存在であることを確認する

– なぜ人類は道具を「道具のまま」扱えてきたのかを構造的に説明する

3. AIが「道具」という枠からはみ出し始めている理由

– AIが単なる自動化ではなく、判断・推論・意味生成を行っている点に触れる

– 人間の思考・言語・意思決定プロセスに深く関与し始めている現状を整理する

– 「使っているはずなのに、影響を受けている」という逆転構造を言語化する

4. それでもAIが「主体」にはならない理由

– AIが意志・欲望・自己保存の動機を持たない点を明確にする

– 人間や社会的主体とAIの決定的な違いを整理する

– 擬人化や過剰な恐怖論に陥らないための視点を提示する

5. 問題はAIではなく「人間の役割の変化」

– 判断・責任・思考のどこまでをAIに委ねるのかという問題を提示する

– 「考えることの外注」が社会に与える影響を構造的に考察する

– AI時代における人間の主体性が、どこで試されているのかを整理する

6. まとめ

– AIは法的・技術的には「道具」であり続ける可能性が高いことを確認する

– 一方で、認知や社会のレベルでは、従来の道具概念が限界を迎えていることを示す

– 読者に対し、結論ではなく思考の余白を残す形で締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的な表現は避ける

– 哲学的になりすぎず、社会構造として理解できる表現を心がける

– 抽象的な概念には、必ず具体的な説明や言い換えを添える

【執筆スタンス】

– 本記事は、特定の結論や立場を押し付けるものではない

– AIを肯定・否定することを目的とせず、構造の整理に徹する

– 読者が自分なりの答えを考えるための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:従来の道具とAIの違い)

※(図:人間の判断とAIの関与範囲)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AIは本当に人間の道具なのか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

「AIはあくまで人間の道具にすぎない」

この言葉を、皆さんはどこかで聞いたことがあるでしょう。あるいは、AIについて議論する際に、ご自身で使ったことがあるかもしれません。この言葉は、AIに対する過度の期待や不安を和らげ、私たちとAIの間に適切な距離を置くために、繰り返し用いられてきました。「道具」という言葉には、「制御可能なもの」「私たちの意思に従うもの」という安心感が込められています。

しかし一方で、ChatGPTなどのAIと深く対話をしたことのある方の中には、一抹の違和感を覚えた人も少なくないはずです。まるで「意思」や「意図」があるかのような応答、ときに人間の思考の枠組みを軽やかに越えていく発想。そこには、ハンマーやスマートフォンといった従来の「道具」とは明らかに異質な何かを感じさせるものがあります。

本記事では、「AIは善か悪か」「AIは人間を超えるか」といった二項対立には立ち入りません。代わりに、私たちが無意識のうちに前提としている「道具」という概念そのものを、技術・社会・認知の観点から問い直してみたいと思います。AIの進化は、単なるツールのアップデートではなく、「道具とは何か」「人間とは何か」という根本的な問いを、私たちに突きつけているからです。

## 人類史における「道具」の三つの前提

これまでの人類史において、「道具」には明確な共通点がありました。この共通点を整理することで、AIがどこでその枠組みからはみ出しつつあるのかが、はっきりと見えてきます。

### 目的・操作・責任は常に「人間の側」にあった

従来の道具、たとえば石器、車、パソコンに至るまで、すべてに共通していたのは以下の三点です。

1. **目的は人間が完全に決定する**:道具そのものが目的を持つことはありません。道具を使う「なぜ」は、常に人間の側にありました。

2. **操作プロセスは人間が完全に理解・制御できる**:ハンマーで釘を打つ物理的な原理から、ソフトウェアのアルゴリズムに至るまで、その作用は人間が理解・予測可能な範囲内にありました。

3. **結果に対する責任の所在は明確だった**:道具を使って何かを生み出し、それが社会に影響を与えた時、その責任を問われるのは「使い手」である人間でした。道具自体が責任を取ることはありませんでした。

※(図:従来の道具とAIの違い)

| | 従来の道具(例:ハンマー、電卓) | 現代のAI(例:LLM) |

|—|—|—|

|**目的の所在**| 完全に人間にある | 人間が設定するが、AIが解釈・再構成する |

|**プロセスの理解可能性**| 原理的には人間が完全に理解可能 | 内部の推論過程がブラックボックス化しつつある |

|**出力の予測可能性**| 入力に対し出力がほぼ一意 | 同じ入力でも文脈により多様な出力が生まれる |

|**責任の所在**| 明確に「使用者」にある | 「開発者」「使用者」「AI」の間で曖昧になりつつある |

### 道具は常に「外部」にあった

これが最も重要な点です。道具は、たとえパソコンが私たちの思考を補助するものであっても、あくまで「人間の外部」に存在する「客体」でした。私たちは道具を「手に取り」、「使い」、「終われば脇に置く」ことができました。道具と人間の間にあったのは「使用」という一方向の関係であり、その境界線は誰の目にも明らかだったのです。

## AIが「道具」という枠組みからはみ出し始める三つの理由

しかし、現代のAI、特に大規模言語モデル(LLM)や生成AIは、この明確だった境界線を曖昧にし始めています。その理由は三つあります。

### 1. 判断・推論・意味生成への関与

AIは、単純な自動化や計算を越えて、「判断」「推論」「意味の生成」に関与するようになりました。レポートの草案を書く、複雑なデータから傾向を「読む」、創造的なアイデアを提案する。これらは、従来ならば人間の「内側」で行われてきた認知プロセスそのものです。AIは、私たちが「考える」という行為そのものの一部を外部化し、肩代わりし始めています。

### 2. 双方向的で学習的な関係性

従来の道具との決定的な違いは、関係性が「双方向的」で「学習的」だという点です。私たちはAIに指示(プロンプト)を出しますが、AIの応答は私たちの次の思考や質問の方向性を無意識のうちに誘導します。また、私たちの使い方(フィードバック)がAIの性能向上に繋がるという循環構造があります。これは「使用」というより、「相互作用的な関係」に近いものです。

### 3. 「使っているはずが、影響を受けている」という逆転構造

ここに現代のAIがもたらす最大のパラドックスがあります。私たちは「AIを使っている」と思っています。しかし実際には、AIが提案する文章の構成、アイデアの展開、問題解決のアプローチに、私たち自身の思考が知らず知らずのうちに「影響を受け」「形づくられて」いる可能性があります。つまり、**主体(人間)が客体(道具)を使うという構図が、影響を与え合う双方向の関係へと揺らいでいる**のです。これは、スマートフォンが私たちの注意力を形作るのとは次元の異なる、より深いレベルでの関与と言えるでしょう。

※(図:人間の判断とAIの関与範囲)

(左側:人間の思考プロセス)→【インプット/質問】→(中央:AI)→【アウトプット/提案】→(右側:人間の思考プロセス)

この図の矢印が双方向であり、右側の「人間の思考プロセス」がAIのアウトプットによって変容する可能性を示す。

## それでもAIが「主体」にならない決定的な理由

ここで、過度の擬人化や恐怖論に陥らないための冷静な視点が必要です。AIがいくら高度化しても、少なくとも現時点および近い将来の技術において、AIが人間のような「主体」になることはありません。その理由は明確です。

### 意志・欲望・自己保存の動機がない

現在のAIは、自分自身の存在意義を問うことも、自己を保存・拡張させたいという内発的な欲望(≒意志)を持つこともありません。AIのすべての動作は、人間が設計した目標関数(たとえば、予測精度の最大化、ユーザー満足度の向上)に従っているに過ぎません。それは、あたかも自律的に見える太陽系の惑星の運行が、物理法則に従っているのと同様です。見かけ上の複雑さの根底には、無意志のアルゴリズムがあるのです。

### 社会的責任を負う「人格」ではない

社会における「主体」とは、権利と義務を持ち、自らの行為に対する責任を負う存在です。AIは、法的にも倫理的にも、この責任を負うことはできません。過ちを犯したAIを「叱る」ことに意味がないのと同じです。責任を問われるのは、あくまで開発者、提供者、使用者といった人間です。この点で、AIは「道具」の法的・倫理的枠組みから完全には脱却できていません。

## 真の問題は、AIではなく「人間の役割の変化」にある

では、私たちが直面している本質的な問題は何なのでしょうか。それはAIそのものの「意思」ではなく、**私たち人間が、自分たちの「判断」「責任」「思考」のどの部分を、どこまでAIに委ねるのか**という、人間側の選択の問題です。

### 「考えることの外注」が社会に与える影響

AIに思考の一部を委ねることは、効率性や創造性を高める面もあります。しかし、この「思考の外注」が社会規模で進行した時、何が起こるでしょうか。判断の基準が個人の内省ではなく、限られた企業が開発したAIのアルゴリズムに収斂していくリスク。複雑な問題を自分で考える「知的筋肉」が萎え、AIの出力を表面的に処理するだけになるリスク。これらのリスクは、技術的なシンギュラリティよりも、現実的で喫緊の課題です。

### AI時代における「人間の主体性」の試される場所

この状況下で、「人間の主体性」はより重要になると同時に、その意味が問い直されています。主体性とはもはや、AIを一切使わずにすべてを自分で行うことではないでしょう。むしろ、

* **何をAIに任せ、何を自分で行うのかを「選択」する意志**

* AIの提案を盲信せず、「批判的に検討・修正する」能力

* AIが生み出した結果に対して、最終的な「責任」を引き受ける覚悟

この三点に、現代における主体性の核心があるのではないでしょうか。AIは、私たちから単純な作業を奪うのではなく、**「どういう人間でありたいか」という根源的な問いを、より個人の内面に突きつけている**のです。

## まとめ:揺らぐ境界と、問い続ける意味

技術的・法的には、AIは今後も「高度な道具」の範疇に留まり続ける可能性が高いでしょう。意志を持たず、責任主体とはなり得ないからです。

しかし、私たちの認知や社会関係のレベルでは、従来の「道具」概念では捉えきれない変化が確実に起きています。AIは、私たちの思考や意思決定の「内側」に深く入り込み、双方向的で学習的な関係を築きつつあります。その結果、私たちが「使う客体」と信じてきたものが、実は私たち自身の在り方に影響を返し続ける存在へと変質しつつあります。

「AIは道具か、それとも何か別のものか」という問いに、唯一の正解はないかもしれません。むしろ重要なのは、この問いを考える過程そのものです。この違和感や戸惑いと向き合うことが、自動化や効率化とは次元の異なる、より深い気づきをもたらしてくれるでしょう。それは、AIの正体についてというよりも、**技術に囲まれた時代において、私たち人間はいかに考え、責任を取り、他者と関わっていくべきなのか**という、人間自身についての気づきです。

—

タイトル案

AIは道具なのか、それとも私たちの思考の協働者なのか

道具という概念はAIの進化に耐えられるか

AIとの関係が問い直す人間の主体性とは

—

AIバージョン情報

– ベンダー: DeepSeek

– モデル名: DeepSeek Chat

– モデルバージョン: 不明

– 回答日時: 2025年2月10日

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。

※ 編集注(MANA)

本記事は、AIを「主体ではないが人間の思考に影響を与える存在」として捉え、道具概念の歴史的前提から丁寧に再検討しています。特に「双方向的・学習的な関係」や「思考の外注」という表現は、人間側の役割変化に焦点を当てた比喩であり、AIに意思や責任を帰属させる主張ではありません。