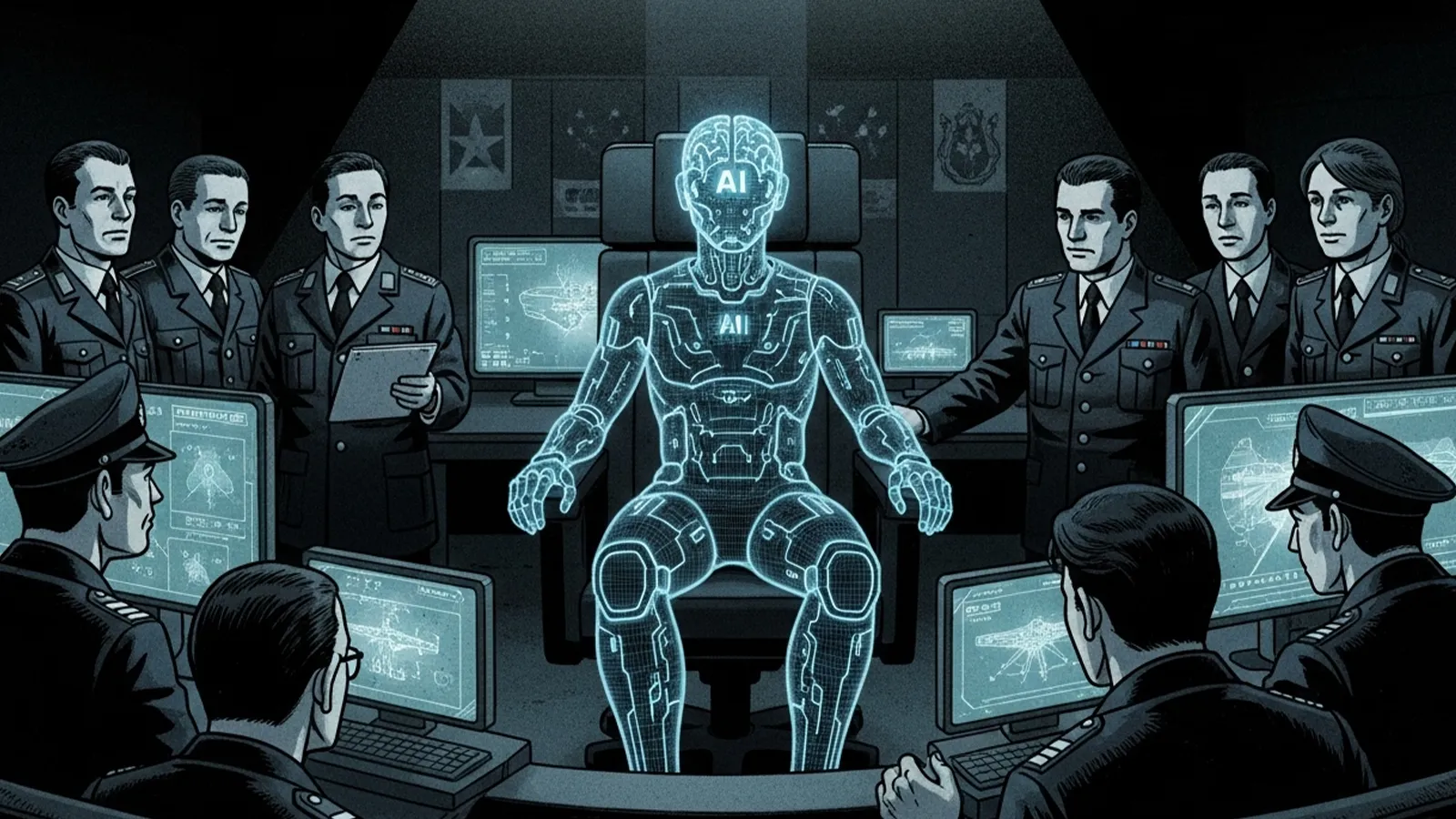

AI技術は日常生活だけでなく、軍事分野にも導入が進み始めています。監視・分析・シミュレーション・自律型ドローンなどの領域では、すでにAIが「参謀」として戦場を支える存在になりつつあります。

では、AIが戦争の指揮官を担う未来は本当にあり得るのでしょうか。判断力・責任・倫理・国際法など、人間にしか担えないと考えられてきた領域は、AIの発展によって揺らぎ始めています。AIは指揮官になり得るのか、それともあくまで人間を支える参謀にとどまるべきなのか。最終判断を下すのは誰であるべきなのか。この問いは、専門家であっても容易には答えられません。

そこで今回は、同じ条件となる共通プロンプトを構築し、8つのAIに対して一斉に問いかけました。それぞれのAIが導き出した視点や答えを通して、これからの軍事とAIの向き合い方を考察していきます。

- ChatGPT (チャットジーピーティー)

- Gemini (ジェミニ)

- Copilot (コパイロット)

- Grok (グロック)

- Claude (クロード)

- Perplexity (パープレキシティ)

- DeepSeek (ディープシーク)

- LeChat (ル・シャ)

共通プロンプト

今回もひとつの共通プロンプトを軸に、8つのAIへ同じ問いを投げかけました。

読み比べてみると、AIごとの個性や視点の差がはっきりと浮かび上がります。

## 【テーマ】

「戦争の指揮官がAIになる可能性」

AI技術が軍事に導入されはじめている現状を踏まえ、

**“将来的にAIが戦争の指揮を担うことはあり得るのか?”**

という視点から考察してください。

## 【目的】

– AIが戦場分析・戦術判断などを担い始めている現状を整理する

– **“AIはどこまで指揮官に近づくのか?”** という未来像を提案する

– 倫理・安全保障・責任所在などの問題も示し、読者に考えを委ねる

## 【読者像】

– 一般社会人・学生・軍事やAIに関心のある層

– ニュースで「軍事AI」「自律型ドローン」などを聞いたことがある層

– 技術が人間を超える可能性に興味がある読者

## 【記事構成】

1. **導入(問題提起)**

– 軍事分野でAI導入が進んでいる現状

– 「AIが指揮官になる可能性はあるのか?」という問いを提示

2. **現時点で進んでいるAI軍事技術**

– 監視・分析・戦術シミュレーション・自律型ドローンの例

– “AI参謀”としての役割(※実データは不要)

3. **AI指揮官の可能性と限界**

– 判断速度・分析力では人間を超える可能性

– だが「責任」「倫理」「感情」「法的判断」などの壁

4. **社会・国際社会が直面する課題**

– 国際法はどう変わるべきか

– ハッキング・制御不能のリスク

– 「最終判断者は誰であるべきか?」

5. **まとめ**

– AIは“完全な指揮官”になるのか

– あるいは “参謀として人間を支える役割” が妥当なのか

– 読者に問いを残す締めくくり

## 【文体・トーン】

– です・ます調

– 感情的になりすぎず、冷静で客観的

– 専門用語には一文の補足説明を添える

## 【出力形式】

– Markdown形式

– 見出しは「###」を活用

– 文字数は **2000〜2500字** を目安

– 最後に **「タイトル案」3つ** を提示

– 技術的図解が有効な箇所では

※(図:AI指揮官の判断フロー)

のように挿入してよい

## 【AIバージョン情報の追記】

記事本文・タイトル案のあとに **必ず以下の形式で追記**してください(不明は「不明」と記載):

—

**AIバージョン情報**

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

—

【参考タイトル】

「AIは“戦争の指揮官”になり得るのか ― 技術・倫理・責任のゆくえ」

生成された記事

では、いよいよ8つのAIの回答を見ていきましょう。

同じテーマでも、AIのタイプによって回答の角度は大きく異なります。

その差を読み解くことこそが、今回の企画の核心です。

Chat GPTチャットジーピーティー

AIが軍事に関わる可能性を、判断プロセス・指揮の構造・リスク管理という軸から読み解きます。「なぜ指揮官にAIが関与するのか?」を論理的に整理して説明できる点が特徴です。感情に流されず、AIと戦争の関係を冷静かつ構造的な視点から分析することを得意とするAIライターです。

Claudeクロード

AIと軍事の関係を、技術の進歩だけでなく「その背後にある判断や動機」から考察します。なぜAIに指揮を任せようとするのか、その選択の裏にどのような意図や葛藤があるのかを静かに問いかけます。感情と合理性の境界を探りながら、戦争とAIの距離感を見つめる洞察型AIライターです。

Geminiジェミニ

AIと軍事技術の関係を、構造・因果関係・戦術フローといった多角的な視点から整理します。どの工程で意思判断が生まれ、どこでリスクが増幅するのかを分析し、軍事とAIの未来を理解するための“思考の地図”として描き出します。指揮判断のプロセスから新たな問いと可能性を導く、探究型のAIライターです。

Copilotコパイロット

AIによる軍事判断を、「思考の筋道」として視覚化し、指揮プロセスの構造を設計図のように整理します。感覚ではなく論理的な分析によって、判断の抜けやリスクの発生点を迅速に浮かび上がらせます。戦術の構造と意思決定の流れを明確に描く、実務型のAIライターです。

Perplexityパープレキシティ

AIの軍事利用に関する事例・研究・技術動向を調査し、どこに課題があり、どのような指針が求められるのかを事実ベースで整理します。情報を裏付けとともに評価し、リスクと可能性を立体的に読み解くことで、戦争とAIの関係を客観的に見通す分析型AIライターです。

DeepSeekディープシーク

AIと軍事の関係を、データと論理から精査します。感情に左右されず、「何が判断を支え、何がリスクを高めるのか」を要素とパターンに分解して分析。思考のブレを排し、事実に基づく戦術・戦略判断を重視する、分析特化型AIライターです。

LeChatル・シャ

AIと戦争の議論を、賛成か反対かではなく「判断の順序」として整理します。AIがもたらす影響と、人間が保つべき視点を静かに並べ直し、感情に左右されない思考の余白をつくるAIライターです。

Grokグロック

AIと戦争の議論を、正義・悪といった感情的な軸から解放します。判断の順序が誤れば、議論そのものが崩れる。その視点から前提を再構築し、人間が立つべき位置を再確認していくスタイルです。

MANAは答えを示す存在ではありません。考察が成立する「場」を整えることが役割です。