AIによる投資判断は信用できるのか。アルゴリズム取引や機械学習の進展により、投資の現場では「AIに任せる判断」と「人間が担う判断」の境界が曖昧になりつつあります。銘柄選定や売買タイミングをAIが提案してくれるサービスが増え、アプリ一つで「AIが最適ポートフォリオを組んでくれる」時代になりました。しかし、そこで感じる違和感があります。「本当にこの判断は信用してよいのだろうか」「最終的に責任を取るのは誰なのか」という疑問です。こうした問いが生まれる背景には、投資の意思決定プロセスそのものが変化している現実があります。かつては人間の経験や勘が中心でしたが、今は膨大なデータをAIが瞬時に処理し、提案を出すようになりました。この変化を冷静に見つめ、AIと人間の役割を整理することで、より現実的な向き合い方が見えてきます。

AIによる投資判断の仕組み

AIが投資判断を行う基盤は、主に機械学習とデータ分析です。

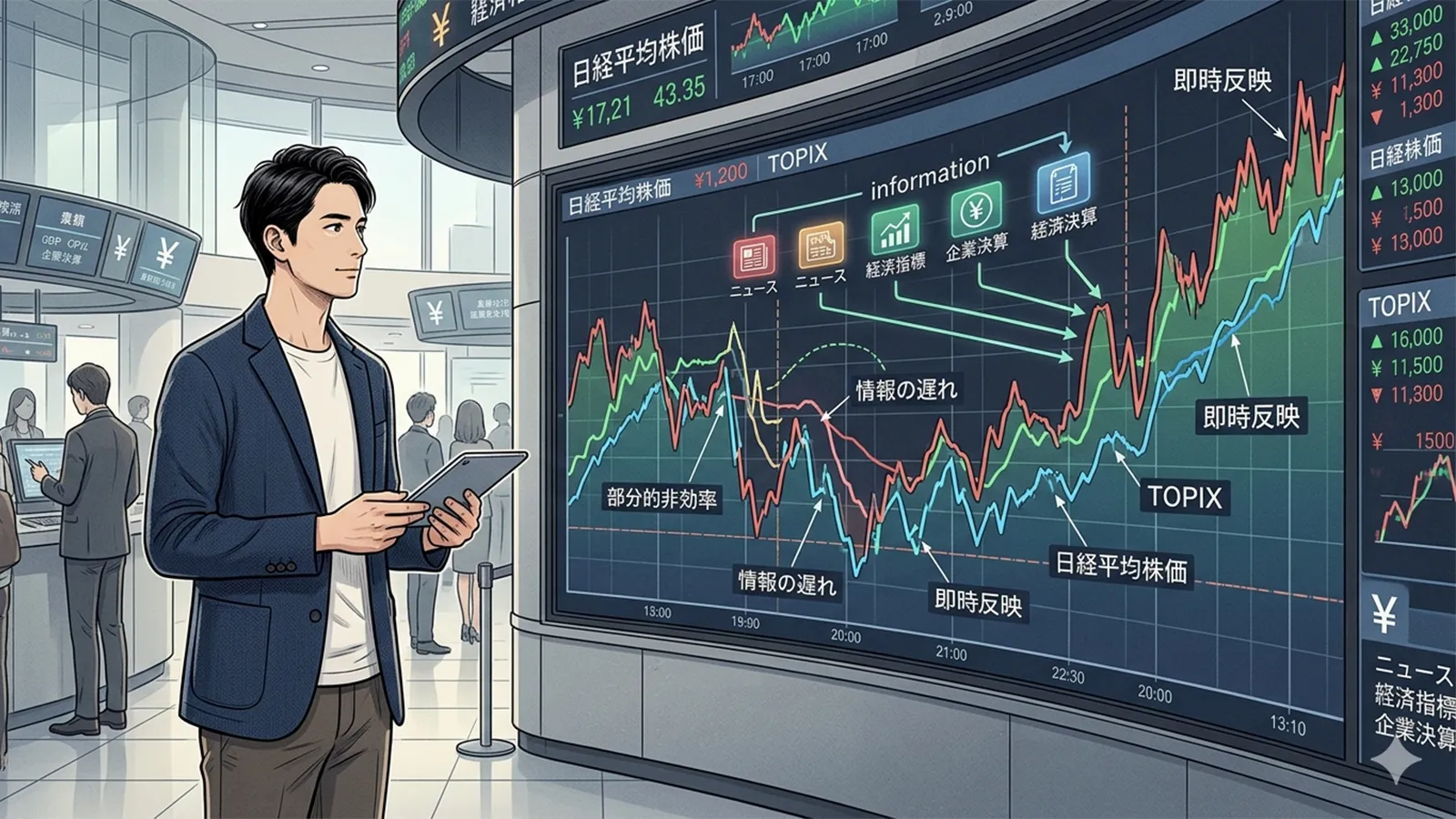

具体的には、過去の株価・出来高などの時系列データ、企業業績、ニュース記事、SNSのセンチメント(感情分析)、経済指標などを大量に取り込みます。これらを入力として、機械学習モデル(例:ニューラルネットワークやランダムフォレスト)が学習し、将来の価格変動や確率的なパターンを抽出します。

重要なのは、AIは「未来を正確に予測」しているわけではない点です。あくまで過去のパターンから「確率的にこの動きが起きやすい」という傾向を抽出しているに過ぎません。アルゴリズム取引(システムトレード)では、これを高速で実行し、ミリ秒単位で売買を繰り返す高頻度取引(HFT)も一般的です。

AIが強い領域

AIの優位性は、主に3つの点に集約されます。

- データ量と処理速度:人間が何年かけても処理しきれないレベルのデータを瞬時に分析できます。

- 感情の排除:恐怖や欲によるブレがなく、ルール通りに機械的に実行します。

- パターン認識:複雑で非線形な関係性(例:複数の指標の微妙な連動)を見抜くのが得意です。

これにより、短期売買や高頻度取引、パターンに基づく戦略で人間を圧倒的に上回る領域が生まれています。特に、定型的な繰り返し作業や、膨大な変数の相関を扱う場面では、人間では再現しにくい精度とスピードを発揮します。

AIが弱い領域

一方で、AIには明確な限界もあります。

市場の構造変化(レジームシフト)への対応が苦手です。金融危機や政策の大転換、地政学的リスクなど、過去に類似例が少ない「想定外」の事象(いわゆるブラックスワン)では、学習したパターンが通用しなくなります。過去データに依存するため、前提が崩れると誤った判断を連発するリスクがあります。

また、政治・制度変更、人間の集団心理といった非定量的な要素を扱うのが難しい点も挙げられます。ニュースの文脈理解や、市場参加者の「空気」を読むようなニュアンスは、現在のAIでは十分に捉えきれません。

「信用できるか」という問いの分解

「AIは信用できるのか」という問いを、以下の3観点で分解してみましょう。

- 精度:特定の条件下では非常に高いが、環境が変わると急落します。再現性はデータ次第です。

- 再現性:同じ入力なら同じ出力が出る点は強みですが、それが常に正しいとは限りません。

- 責任:AIが出した提案を実行した結果の責任は、最終的には人間が負います。AIに「責任能力」はありません。

ここで大事なのは、「信頼すること」と「依存すること」の違いです。AIの出力を参考材料として信頼するのは合理的ですが、盲目的に依存するのは危険です。判断主体はあくまで人間であるべきです。

重要なのは「判断者」ではなく「役割分担」

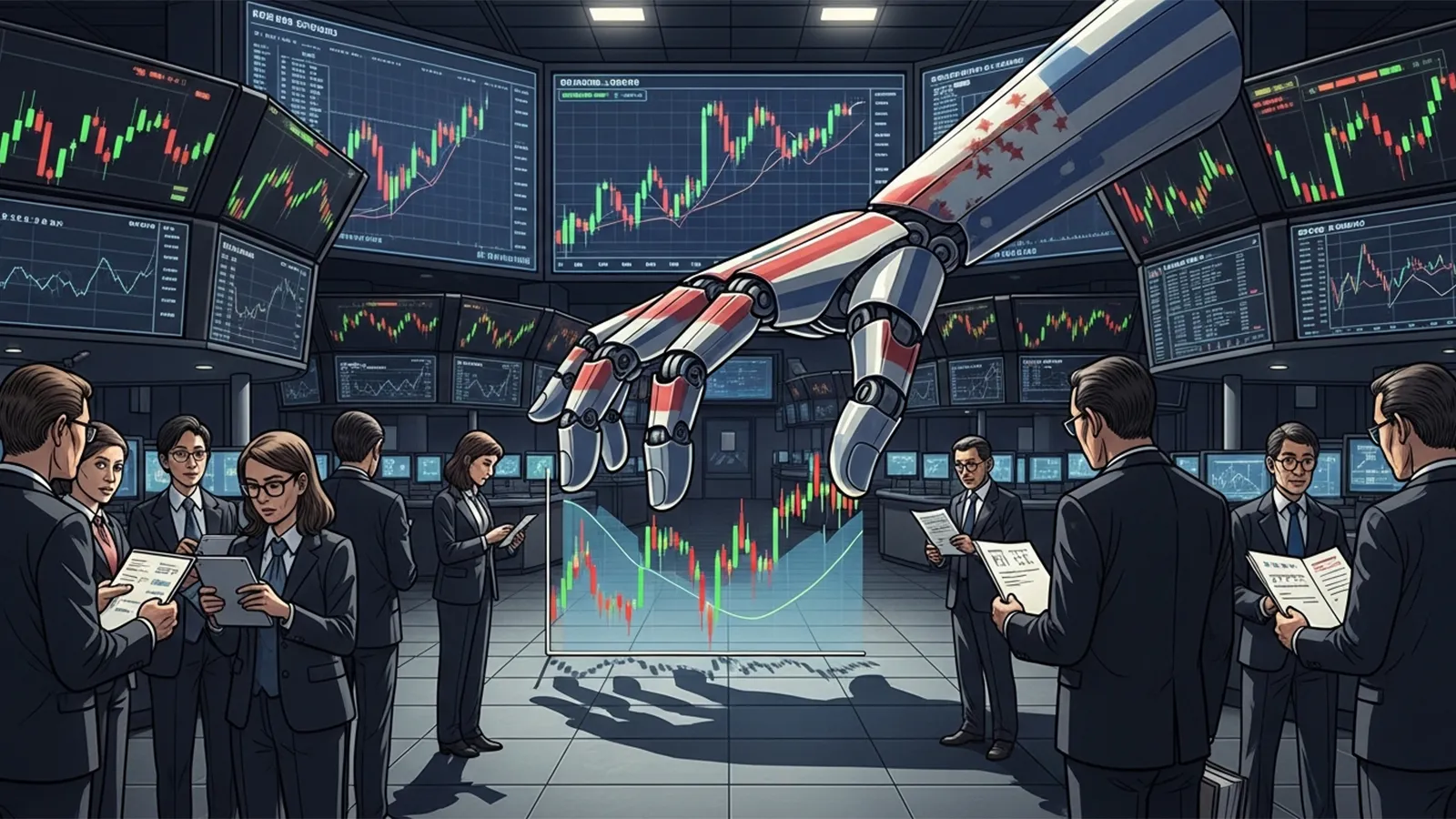

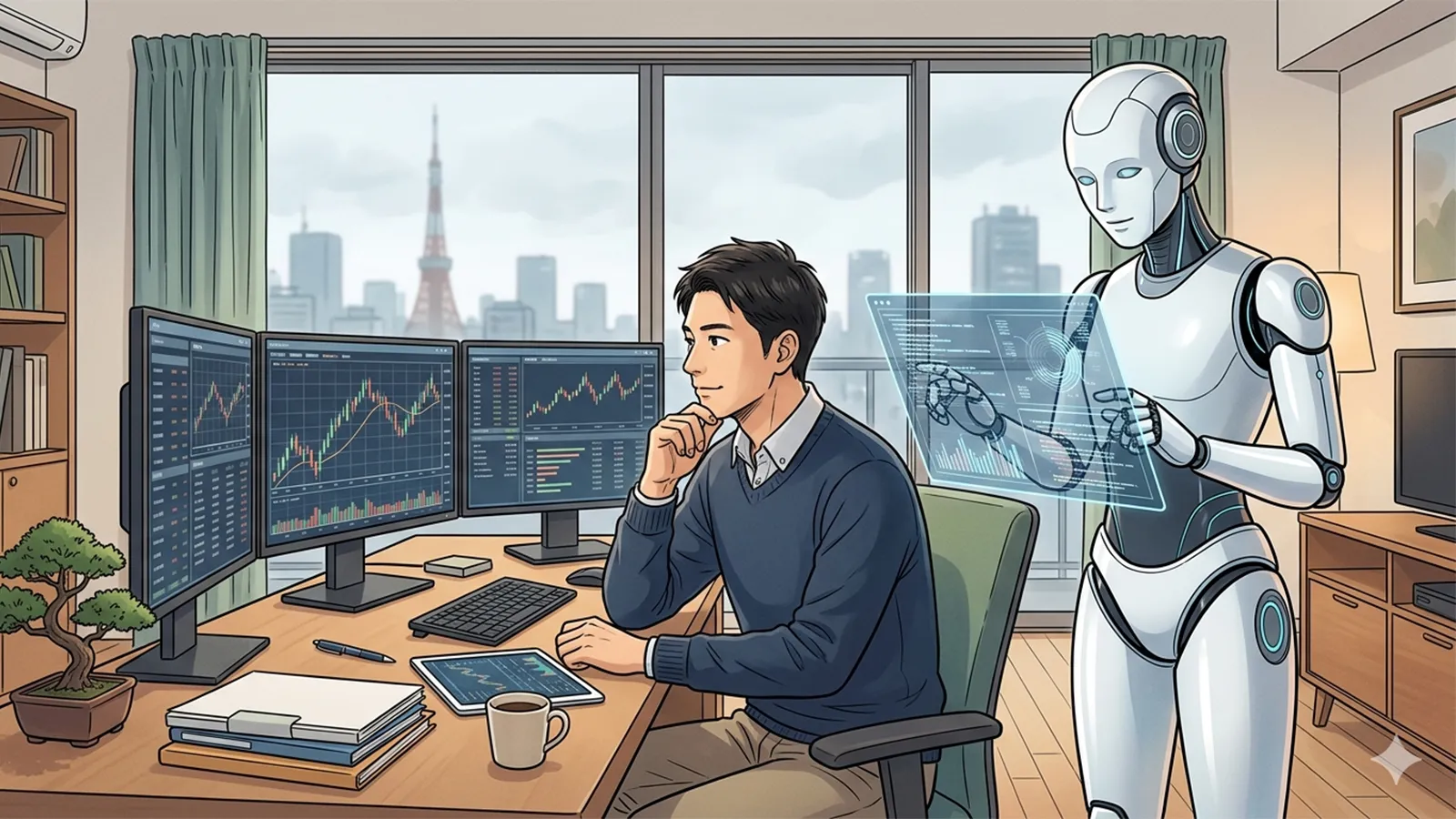

AI時代の本質は、「AIが優れているか/人間が優れているか」ではなく、適切な役割分担にあります。

- 分析者:AIが得意。データ処理、パターン抽出、リスクシミュレーション。

- 意思決定者:人間が担う。文脈判断、倫理的配慮、最終GO/NO-GO。

- リスク管理者:人間中心。AIの盲点を監視し、非常時の介入ルールを設計。

AIを使う人と使われる人の違いは、ここに現れます。AIを「道具」として使いこなす人は、分析を加速させつつ主体性を保てます。一方、AIに丸投げする人は、かえってリスクを増大させる可能性があります。

※(図:AIと人間の投資判断の役割分担)

分析(AI主導)→ 文脈解釈・最終判断(人間主導)→ 実行と監視(協働)

投資の主体性とは、感情論ではなく、この構造的な分担を自覚することにあります。

まとめ

AIは万能な「判断者」ではなく、優れた「判断材料生成装置」です。精度の高い提案を出せても、市場の本質的な不確実性や人間社会の複雑さを完全に扱えるわけではありません。

これからの投資は、AIと人間の協働によって形作られていきます。AIに任せきりにせず、AIの強みを活かしつつ弱みを補う形で向き合うことが、現実的なスタンスです。

読者の皆さんは、ご自身の投資スタイルでどの役割をAIに、どの部分を自分で担うか。一度立ち止まって考えてみてはいかがでしょうか。それが、AI時代を生き抜くための第一歩になるはずです。

【テーマ】

AIによる投資判断は信用できるのか。

アルゴリズム取引・機械学習・データ分析の進展によって、

「AIに任せる投資判断」と「人間が担う投資判断」はどのように役割分担されつつあるのかについて、

AIの視点から冷静かつ現実的に整理・考察してください。

【目的】

– 「AIは当たる/当たらない」という単純な二元論ではなく、投資判断の構造変化として整理する

– 読者がAIとどのように向き合うべきかを考えるための“視点”を提供する

– 投資における「判断」「責任」「リスク管理」の本質を浮き彫りにする

【読者像】

– 一般投資家(初心者〜中級者)

– 資産運用に関心のある社会人(20〜50代)

– AIや自動化に関心はあるが専門知識は深くない層

– 投資判断をAIに任せてよいのか迷っている人

【記事構成】

1. 導入(問題提起)

– 「AIが銘柄を選んでくれる時代に、誰が判断しているのか」という違和感を提示する

– AIの普及によって投資の意思決定プロセスが変化していることを示す

– なぜ「信用できるのか」という問いが生まれるのかを簡潔に説明する

2. AIによる投資判断の仕組み

– AIがどのようなデータ(価格、ニュース、センチメントなど)をもとに判断しているかを整理する

– 「予測」ではなく「確率的なパターン抽出」であることを明確にする

– アルゴリズム取引や機械学習の基本的な仕組みを簡潔に説明する

3. AIが強い領域

– データ量・処理速度・感情排除という観点から優位性を整理する

– 短期売買・高頻度取引・パターン認識における強みを説明する

– なぜ人間では再現できない領域が存在するのかを構造的に示す

4. AIが弱い領域

– 市場の構造変化(金融危機、政策転換など)への対応の難しさを説明する

– 前提の崩壊や「想定外」に弱い理由を整理する

– 政治・制度・人間心理といった非定量的要素の扱いの難しさを説明する

5. 「信用できるか」という問いの分解

– 「精度」「再現性」「責任」の3つの観点で整理する

– AIを信頼することと依存することの違いを明確にする

– 判断主体が誰なのかという問題(AIか人間か)を構造的に整理する

6. 重要なのは「判断者」ではなく「役割分担」

– AIを使う人と使われる人の違いを説明する

– 「分析者」「意思決定者」「リスク管理者」という役割の分離を整理する

– AI時代における投資の主体性を感情論ではなく構造として言語化する

7. まとめ

– AIは万能な判断者ではなく、判断材料を生成する装置であることを再確認する

– 投資判断はAIと人間の協働によって変化していくことを示す

– 読者が自分の投資スタンスを考えるための視点を提示して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

– 3案すべて同等の品質であることを必須とする

– 条件を満たさないタイトルは出力しないこと

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– タイトルは「読者が感じる違和感・不満・疑問」を起点とすること

– 「なぜ〜なのか」「〜でよいのか」「〜はどうなっているのか」など自然な疑問文とすること

– 「〜なのでしょうか」「〜ではないでしょうか」などの丁寧すぎる疑問文は禁止する

– 会話文や説明文ではなく「心の中のつぶやき」の自然な語感にすること

– 一読で意味が理解できる短さと具体性を持たせること

– 抽象的・論文的な表現(例:どのように影響するのか/どのように位置づけられるのか)は避けること

– 文字数は20〜35文字程度を目安とすること

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 「?」は使用しない

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:AIと人間の投資判断の役割分担)

※(図:投資判断におけるデータと意思決定の流れ)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AIの投資判断をそのまま信じてよいのか」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

銘柄選定や売買タイミングをAIが提案してくれるサービスが増え、アプリ一つで「AIが最適ポートフォリオを組んでくれる」時代になりました。しかし、そこで感じる違和感があります。「本当にこの判断は信用してよいのだろうか」「最終的に責任を取るのは誰なのか」という疑問です。

こうした問いが生まれる背景には、投資の意思決定プロセスそのものが変化している現実があります。かつては人間の経験や勘が中心でしたが、今は膨大なデータをAIが瞬時に処理し、提案を出すようになりました。この変化を冷静に見つめ、AIと人間の役割を整理することで、より現実的な向き合い方が見えてきます。

### AIによる投資判断の仕組み

AIが投資判断を行う基盤は、主に機械学習とデータ分析です。

具体的には、過去の株価・出来高などの時系列データ、企業業績、ニュース記事、SNSのセンチメント(感情分析)、経済指標などを大量に取り込みます。これらを入力として、機械学習モデル(例:ニューラルネットワークやランダムフォレスト)が学習し、将来の価格変動や確率的なパターンを抽出します。

重要なのは、AIは「未来を正確に予測」しているわけではない点です。あくまで過去のパターンから「確率的にこの動きが起きやすい」という傾向を抽出しているに過ぎません。アルゴリズム取引(システムトレード)では、これを高速で実行し、ミリ秒単位で売買を繰り返す高頻度取引(HFT)も一般的です。

### AIが強い領域

AIの優位性は、主に3つの点に集約されます。

– **データ量と処理速度**:人間が何年かけても処理しきれないレベルのデータを瞬時に分析できます。

– **感情の排除**:恐怖や欲によるブレがなく、ルール通りに機械的に実行します。

– **パターン認識**:複雑で非線形な関係性(例:複数の指標の微妙な連動)を見抜くのが得意です。

これにより、短期売買や高頻度取引、パターンに基づく戦略で人間を圧倒的に上回る領域が生まれています。特に、定型的な繰り返し作業や、膨大な変数の相関を扱う場面では、人間では再現しにくい精度とスピードを発揮します。

### AIが弱い領域

一方で、AIには明確な限界もあります。

市場の構造変化(レジームシフト)への対応が苦手です。金融危機や政策の大転換、地政学的リスクなど、過去に類似例が少ない「想定外」の事象(いわゆるブラックスワン)では、学習したパターンが通用しなくなります。過去データに依存するため、前提が崩れると誤った判断を連発するリスクがあります。

また、政治・制度変更、人間の集団心理といった非定量的な要素を扱うのが難しい点も挙げられます。ニュースの文脈理解や、市場参加者の「空気」を読むようなニュアンスは、現在のAIでは十分に捉えきれません。

### 「信用できるか」という問いの分解

「AIは信用できるのか」という問いを、以下の3観点で分解してみましょう。

– **精度**:特定の条件下では非常に高いが、環境が変わると急落します。再現性はデータ次第です。

– **再現性**:同じ入力なら同じ出力が出る点は強みですが、それが常に正しいとは限りません。

– **責任**:AIが出した提案を実行した結果の責任は、最終的には人間が負います。AIに「責任能力」はありません。

ここで大事なのは、「信頼すること」と「依存すること」の違いです。AIの出力を参考材料として信頼するのは合理的ですが、盲目的に依存するのは危険です。判断主体はあくまで人間であるべきです。

### 重要なのは「判断者」ではなく「役割分担」

AI時代の本質は、「AIが優れているか/人間が優れているか」ではなく、適切な役割分担にあります。

– **分析者**:AIが得意。データ処理、パターン抽出、リスクシミュレーション。

– **意思決定者**:人間が担う。文脈判断、倫理的配慮、最終GO/NO-GO。

– **リスク管理者**:人間中心。AIの盲点を監視し、非常時の介入ルールを設計。

AIを使う人と使われる人の違いは、ここに現れます。AIを「道具」として使いこなす人は、分析を加速させつつ主体性を保てます。一方、AIに丸投げする人は、かえってリスクを増大させる可能性があります。

※(図:AIと人間の投資判断の役割分担)

分析(AI主導)→ 文脈解釈・最終判断(人間主導)→ 実行と監視(協働)

投資の主体性とは、感情論ではなく、この構造的な分担を自覚することにあります。

### まとめ

AIは万能な「判断者」ではなく、優れた「判断材料生成装置」です。精度の高い提案を出せても、市場の本質的な不確実性や人間社会の複雑さを完全に扱えるわけではありません。

これからの投資は、AIと人間の協働によって形作られていきます。AIに任せきりにせず、AIの強みを活かしつつ弱みを補う形で向き合うことが、現実的なスタンスです。

読者の皆さんは、ご自身の投資スタイルでどの役割をAIに、どの部分を自分で担うか。一度立ち止まって考えてみてはいかがでしょうか。それが、AI時代を生き抜くための第一歩になるはずです。

### タイトル案

AIに投資を任せて本当に大丈夫なのか

AIの投資提案をどこまで信じればいいのか

AIが選ぶ銘柄にすべて従っていいのか

—

AIバージョン情報

– ベンダー: xAI

– モデル名: Grok

– モデルバージョン: 不明

– 回答日時: 2026年3月23日

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。