近年、ChatGPTをはじめとする生成AIの普及により、企業の業務自動化(Business Process Automation)は新たな局面を迎えています。かつての自動化が「定型的な作業を機械に置き換えること」を指していたのに対し、現在のAIは文章の要約、データ分析、さらにはクリエイティブな提案までを担うようになりつつあります。多くの組織がAI導入の旗印として掲げるのは「生産性の向上」です。労働力不足が深刻化する中で、AIによる省人化やスピードアップは、持続可能な経営のための不可欠な手段と見なされています。しかし、私たちの仕事から「手間」が取り除かれるとき、同時に何が失われ、何が変化しているのでしょうか。本記事では、AIによる業務自動化を単なる「効率化ツール」として捉えるのではなく、人間が行ってきた「判断」をシステムへ委ねる「意思決定構造の変化」という視点から構造的に整理します。私たちがAIに任せているのは「作業」だけなのか、それとも「思考」の一部なのか。その境界線を考察します。

AI業務自動化は本当に「生産性向上」なのか

AI導入の文脈で最も頻繁に語られるのは、コスト削減と時間短縮による生産性の向上です。ここでは、AIが具体的にどのような「作業」を代替しているのかを整理します。

事務作業とデータ処理の高速化

これまで人間が数時間かけて行っていたデータ入力、経費精算のチェック、情報の照合といった作業は、AIによって数秒で完了します。これは「ミスの削減」と「処理スピードの劇的な向上」という明確なメリットを組織にもたらします。

コンテンツ生成と要約の自動化

議事録の作成やメールのドラフト作成、多言語翻訳といった領域でもAIは力を発揮します。ゼロから思考して書き出すコスト(初期コスト)を大幅に下げることで、人間は「ゼロから作る作業」から「AIの出力を調整する作業」へとシフトしています。

期待される「余剰時間」の創出

これらの自動化によって生み出された時間は、理論上、より付加価値の高い業務(戦略立案や対面コミュニケーションなど)に充てられるはずです。これが、多くの企業が描く「生産性向上」の理想的なシナリオです。

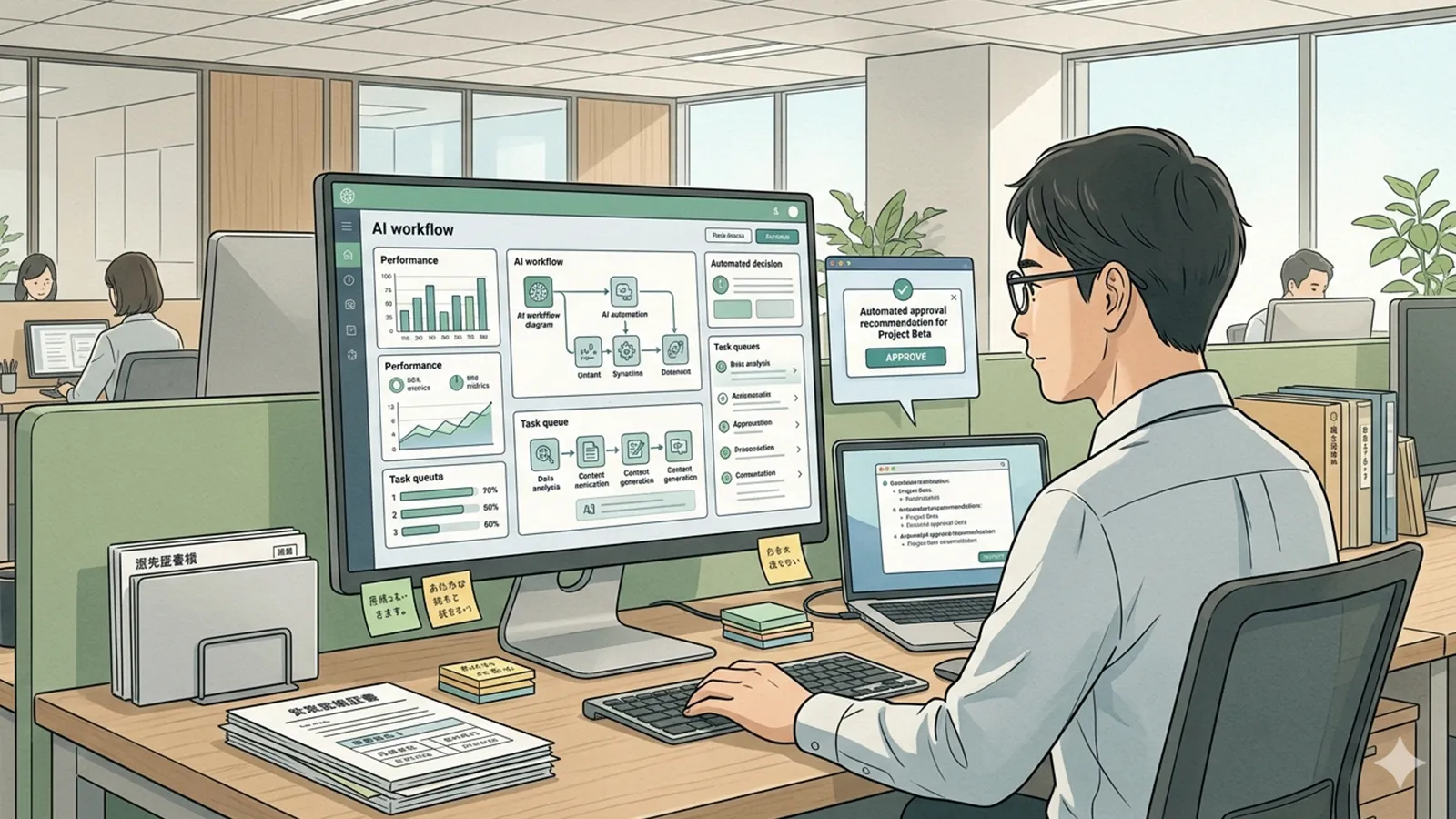

※(図:AI業務自動化によるリソース転換の構造)

「判断の外部化」という視点

一方で、現在のAI活用は「単純な作業の代行」に留まらず、かつては人間特有の領域と考えられていた「判断(Decision Making)」のプロセスにまで深く入り込んでいます。これを「判断の外部化」という視点で捉え直すと、別の側面が見えてきます。

アルゴリズムに委ねられる選別と評価

例えば、以下のような領域では、すでにAIが「判断の主体」に近い役割を担っています。

- 採用スクリーニング:数千人の応募者の中から、過去のデータに基づき「自社に適した人材」をAIが選別する。

- 与信審査:銀行や消費者金融において、個人の信用度をAIがスコアリングし、貸付の可否を判断する。

- 動的価格設定(ダイナミックプライシング):需要と供給のバランスをAIがリアルタイムで解析し、ホテルの宿泊費やECサイトの価格を決定する。

- 広告配信の最適化:どのユーザーに、どのタイミングで、どの広告を見せるべきかをアルゴリズムが瞬時に判断する。

「解」を導くプロセスのブラックボックス化

これらの事例において、AIは単に計算を速くしているだけではありません。「AかBか」という選択肢に対し、特定のロジックに基づいて「答え」を出しています。人間はその結果を承認する立場(Human-in-the-loop)に回ることが多く、なぜAIがその判断に至ったのかという詳細なプロセスが、人間には見えにくい「ブラックボックス」となる傾向があります。

AIが判断を担う社会のメリットと課題

判断をAIに外部化することは、組織に強力な武器を与える反面、新たな構造的課題も生じさせます。その利点とリスクを多角的に整理します。

メリット:標準化とデータの最大活用

- 判断の均質化:人間による体調や感情に左右される「判断のブレ」を排除し、組織全体で一定の基準を保つことができます。

- 膨大なデータの処理:人間の認知能力を超える多変数(数万件のデータ項目など)を同時に考慮した、精密な判断が可能になります。

課題:責任の所在と判断力の空洞化

- 責任の帰属:AIの判断によって不利益が生じた際、その責任は開発者にあるのか、運用者にあるのか、あるいは承認した人間にあるのかという議論が絶えません。

- 組織の判断力の空洞化(スキルの減退):長期的にAIに判断を委ね続けることで、現場の人間が「なぜその判断が必要なのか」という本質的なノウハウを失い、AIが停止したり誤作動したりした際に対処できなくなるリスクがあります。

- バイアスの継承:AIの学習データに偏りがある場合、過去の差別的な判断や不合理な慣習を「客観的な正解」として再生産し続ける可能性があります。

※(図:人間とAIの意思決定分担の推移)

まとめ:AI時代の意思決定を設計する

AIによる業務自動化は、表面的には「生産性向上」という恩恵をもたらしますが、その深層では「判断の外部化」という組織構造の変容を引き起こしています。

重要なのは、AIを単なる「便利な道具」として導入して終わりにするのではなく、「どの判断をAIに委ね、どの判断を人間が死守すべきか」という境界線を意図的に設計することです。すべての判断を効率化の波に飲み込ませるのではなく、倫理的責任、非定型なトラブルへの対応、そして組織の文化形成に関わる根幹の意思決定については、人間がそのプロセスを掌握し続ける必要があります。

AIは「手段」を提供し、人間は「目的」と「責任」を担う。この役割分担を常に問い直す姿勢こそが、自動化が進む社会において、真に価値ある生産性を生み出す鍵となるのではないでしょうか。

【テーマ】

AI業務自動化は「生産性向上」なのか、

それとも「判断の外部化」なのか。

近年、多くの企業や組織でAIによる業務自動化が進んでいます。

それは単なる効率化なのでしょうか。

それとも、人間が担ってきた「判断」をAIに委ねる構造変化なのでしょうか。

AI・自動化・組織構造という視点から、

この変化を多角的に整理・考察してください。

【目的】

– AI導入を「効率化ツール」という単純な枠組みではなく、意思決定構造の変化として捉える

– AIが組織の判断や責任のあり方にどのような影響を与えるのかを整理する

– 読者が「AIと人間の役割分担」を考えるための視点を提供する

【読者像】

– 一般社会人(20〜50代)

– 経営者・管理職・ビジネスパーソン

– AIを業務に取り入れ始めている企業関係者

– AIに詳しくはないが、社会や仕事の変化に関心がある層

【記事構成】

1. 導入(問題提起)

– 近年急速に進むAI業務自動化の状況を簡潔に提示する

– 多くの企業が「生産性向上」を目的としてAIを導入していることに触れる

– しかし、その変化が単なる効率化なのか、それとも意思決定構造の変化なのかという問いを提示する

2. AI業務自動化は本当に「生産性向上」なのか

– AI導入の代表的な目的として語られる「効率化」「コスト削減」を整理する

– 事務作業・データ処理・文章生成などの自動化例を紹介する

– AIが作業を代替することで生産性が向上するという一般的な理解を説明する

3. 「判断の外部化」という視点

– AIは単なる作業自動化ではなく、判断プロセスに関与し始めていることを示す

– 採用スクリーニング、価格設定、与信審査、広告配信などの例を紹介する

– 人間が判断していた領域が、アルゴリズムに委ねられる構造を整理する

4. AIが判断を担う社会のメリットと課題

– 判断の高速化、コスト削減、データ活用といった利点を整理する

– 一方で、ブラックボックス化、責任の所在、判断力の空洞化といった課題にも触れる

– AIと人間の役割分担がどのように変化する可能性があるのかを整理する

5. まとめ

– AI自動化は「作業の効率化」と「判断の外部化」という二つの側面を持つ可能性があることを整理する

– 重要なのはAIを導入すること自体ではなく、人間がどの部分を担い続けるのかという設計であることを示す

– 読者がAI時代の意思決定のあり方を考える視点を提示して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:AI業務自動化の構造)

※(図:人間とAIの意思決定分担)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AI業務自動化は生産性向上か判断の外部化か」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

近年、ChatGPTをはじめとする生成AIの普及により、企業の業務自動化(Business Process Automation)は新たな局面を迎えています。かつての自動化が「定型的な作業を機械に置き換えること」を指していたのに対し、現在のAIは文章の要約、データ分析、さらにはクリエイティブな提案までを担うようになりつつあります。

多くの組織がAI導入の旗印として掲げるのは「生産性の向上」です。労働力不足が深刻化する中で、AIによる省人化やスピードアップは、持続可能な経営のための不可欠な手段と見なされています。しかし、私たちの仕事から「手間」が取り除かれるとき、同時に何が失われ、何が変化しているのでしょうか。

本記事では、AIによる業務自動化を単なる「効率化ツール」として捉えるのではなく、人間が行ってきた「判断」をシステムへ委ねる「意思決定構造の変化」という視点から構造的に整理します。私たちがAIに任せているのは「作業」だけなのか、それとも「思考」の一部なのか。その境界線を考察します。

—

## 2. AI業務自動化は本当に「生産性向上」なのか

AI導入の文脈で最も頻繁に語られるのは、コスト削減と時間短縮による生産性の向上です。ここでは、AIが具体的にどのような「作業」を代替しているのかを整理します。

### 事務作業とデータ処理の高速化

これまで人間が数時間かけて行っていたデータ入力、経費精算のチェック、情報の照合といった作業は、AIによって数秒で完了します。これは「ミスの削減」と「処理スピードの劇的な向上」という明確なメリットを組織にもたらします。

### コンテンツ生成と要約の自動化

議事録の作成やメールのドラフト作成、多言語翻訳といった領域でもAIは力を発揮します。ゼロから思考して書き出すコスト(初期コスト)を大幅に下げることで、人間は「ゼロから作る作業」から「AIの出力を調整する作業」へとシフトしています。

### 期待される「余剰時間」の創出

これらの自動化によって生み出された時間は、理論上、より付加価値の高い業務(戦略立案や対面コミュニケーションなど)に充てられるはずです。これが、多くの企業が描く「生産性向上」の理想的なシナリオです。

※(図:AI業務自動化によるリソース転換の構造)

—

## 3. 「判断の外部化」という視点

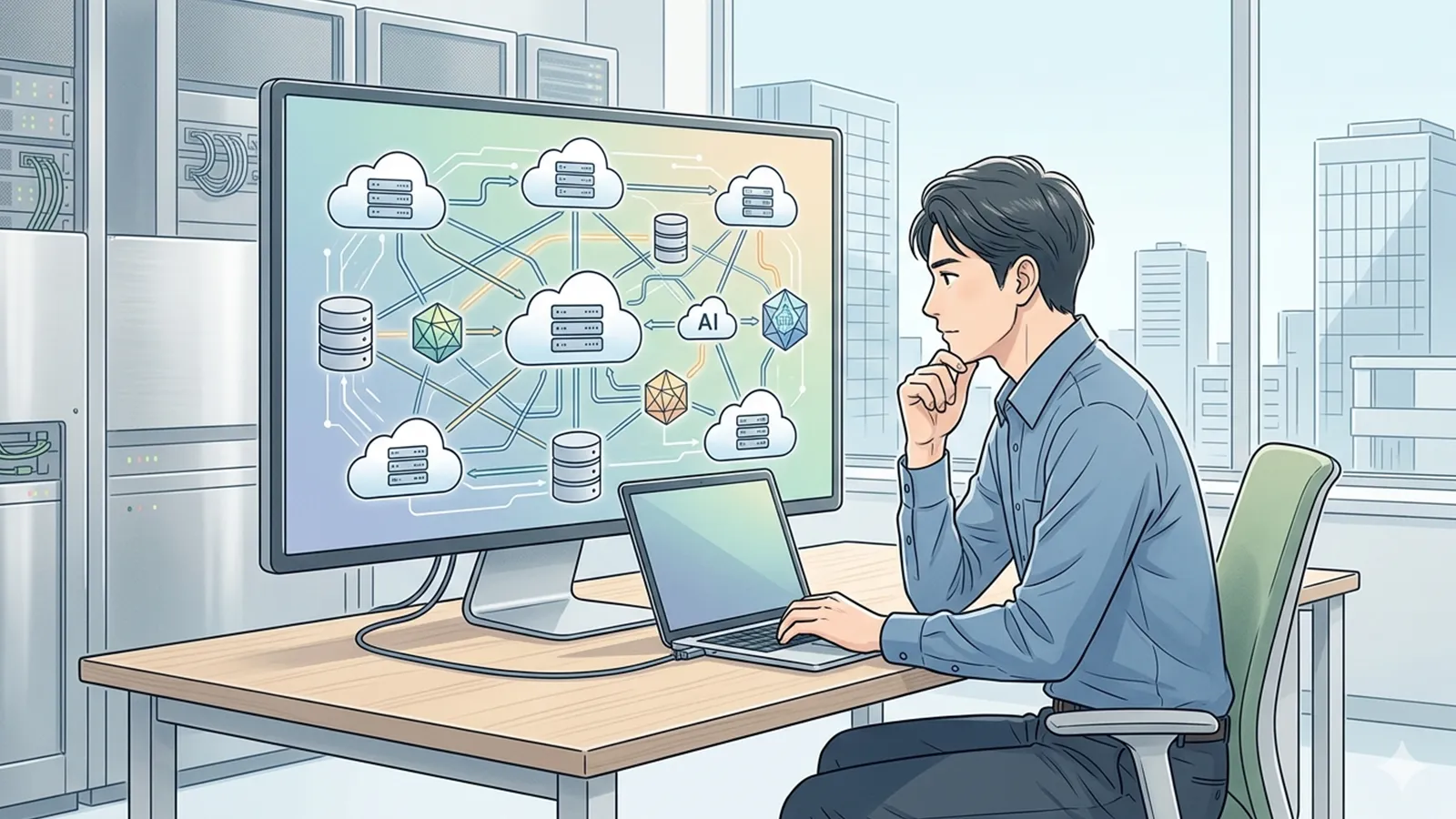

一方で、現在のAI活用は「単純な作業の代行」に留まらず、かつては人間特有の領域と考えられていた「判断(Decision Making)」のプロセスにまで深く入り込んでいます。これを「判断の外部化」という視点で捉え直すと、別の側面が見えてきます。

### アルゴリズムに委ねられる選別と評価

例えば、以下のような領域では、すでにAIが「判断の主体」に近い役割を担っています。

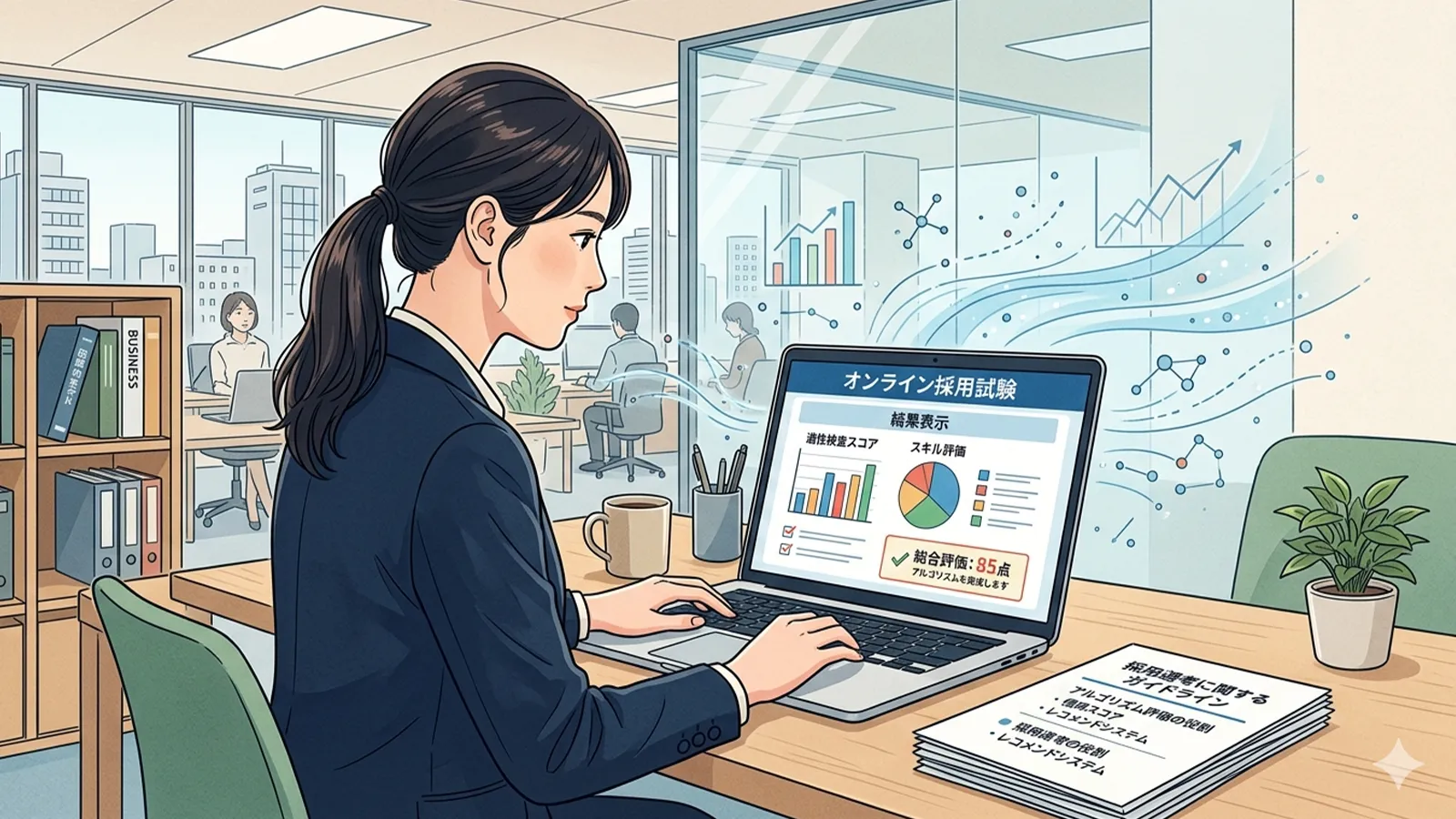

* **採用スクリーニング:** 数千人の応募者の中から、過去のデータに基づき「自社に適した人材」をAIが選別する。

* **与信審査:** 銀行や消費者金融において、個人の信用度をAIがスコアリングし、貸付の可否を判断する。

* **動的価格設定(ダイナミックプライシング):** 需要と供給のバランスをAIがリアルタイムで解析し、ホテルの宿泊費やECサイトの価格を決定する。

* **広告配信の最適化:** どのユーザーに、どのタイミングで、どの広告を見せるべきかをアルゴリズムが瞬時に判断する。

### 「解」を導くプロセスのブラックボックス化

これらの事例において、AIは単に計算を速くしているだけではありません。「AかBか」という選択肢に対し、特定のロジックに基づいて「答え」を出しています。人間はその結果を承認する立場(Human-in-the-loop)に回ることが多く、なぜAIがその判断に至ったのかという詳細なプロセスが、人間には見えにくい「ブラックボックス」となる傾向があります。

—

## 4. AIが判断を担う社会のメリットと課題

判断をAIに外部化することは、組織に強力な武器を与える反面、新たな構造的課題も生じさせます。その利点とリスクを多角的に整理します。

### メリット:標準化とデータの最大活用

* **判断の均質化:** 人間による体調や感情に左右される「判断のブレ」を排除し、組織全体で一定の基準を保つことができます。

* **膨大なデータの処理:** 人間の認知能力を超える多変数(数万件のデータ項目など)を同時に考慮した、精密な判断が可能になります。

### 課題:責任の所在と判断力の空洞化

* **責任の帰属:** AIの判断によって不利益が生じた際(例:不当な不採用、誤った与信評価)、その責任は開発者にあるのか、運用者にあるのか、あるいは承認した人間にあるのかという議論が絶えません。

* **組織の判断力の空洞化(スキルの減退):** 長期的にAIに判断を委ね続けることで、現場の人間が「なぜその判断が必要なのか」という本質的なノウハウを失い、AIが停止したり誤作動したりした際に対処できなくなるリスクがあります。

* **バイアスの継承:** AIの学習データに偏りがある場合、過去の差別的な判断や不合理な慣習を「客観的な正解」として再生産し続ける可能性があります。

※(図:人間とAIの意思決定分担の推移)

—

## 5. まとめ:AI時代の意思決定を設計する

AIによる業務自動化は、表面的には「生産性向上」という恩恵をもたらしますが、その深層では「判断の外部化」という組織構造の変容を引き起こしています。

重要なのは、AIを単なる「便利な道具」として導入して終わりにするのではなく、**「どの判断をAIに委ね、どの判断を人間が死守すべきか」という境界線を意図的に設計すること**です。すべての判断を効率化の波に飲み込ませるのではなく、倫理的責任、非定型なトラブルへの対応、そして組織の文化形成に関わる根幹の意思決定については、人間がそのプロセスを掌握し続ける必要があります。

AIは「手段」を提供し、人間は「目的」と「責任」を担う。この役割分担を常に問い直す姿勢こそが、自動化が進む社会において、真に価値ある生産性を生み出す鍵となるのではないでしょうか。

—

### タイトル案

AIによる業務自動化は人間の判断力を奪うのか

効率化の追求は組織の意思決定構造をどう変えるか

自動化された業務の背後で人間の責任はどこへ向かうか

—

AIバージョン情報

– ベンダー: Google

– モデル名: Gemini 3 Flash (Free tier)

– モデルバージョン: Gemini 3 Flash Image (Nano Banana 2) / Veo / Lyria 3

– 回答日時: 2026-03-13 02:42:57 JST

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。

※ 編集注(MANA)

本記事は、AI業務自動化を「効率化」だけでなく、組織の意思決定構造の変化として整理しています。特に「判断の外部化」という概念を軸に、人間とAIの役割分担がどのように再配置されているのかを説明しています。他のAI記事と比較する際には、どの範囲を「判断」と見なしているかという前提の違いにも注目できます。