採用選考の書類スクリーニング、ローン審査のクレジットスコア、SNSでの投稿推薦、ECサイトの広告配信、さらにはダイナミックプライシングによる価格決定まで、私たちの生活の裏側では多くの判断がアルゴリズムによって行われています。こうした仕組みは「人間の偏りを減らし、公平な判断を実現する」と期待される一方で、「なぜその結果になったのか分からない」という不透明さへの不安も生んでいます。つまり、アルゴリズム評価は公平化をもたらすのか、それともブラックボックス化を進めるのか。この二つの見方が同時に存在しているのが現状です。本記事では、この問いに対して特定の結論を示すのではなく、社会構造の変化としてアルゴリズム評価を整理し、読者が自分の視点を持てるような材料を提供します。

アルゴリズム評価が「公平化」と言われる理由

人間の判断が抱える偏り

人間の判断には、無意識のバイアス(性別・年齢・学歴など)や、その時の感情・体調といった主観が入り込みます。採用面接での「なんとなく合わない」という感覚的判断はその典型です。

ルール化・データ化による基準の統一

アルゴリズムは、判断基準を明確なルールやデータとして扱います。同じ条件の応募者には同じ基準を適用し、同じ行動をしたユーザーには同じ評価を返すことができます。

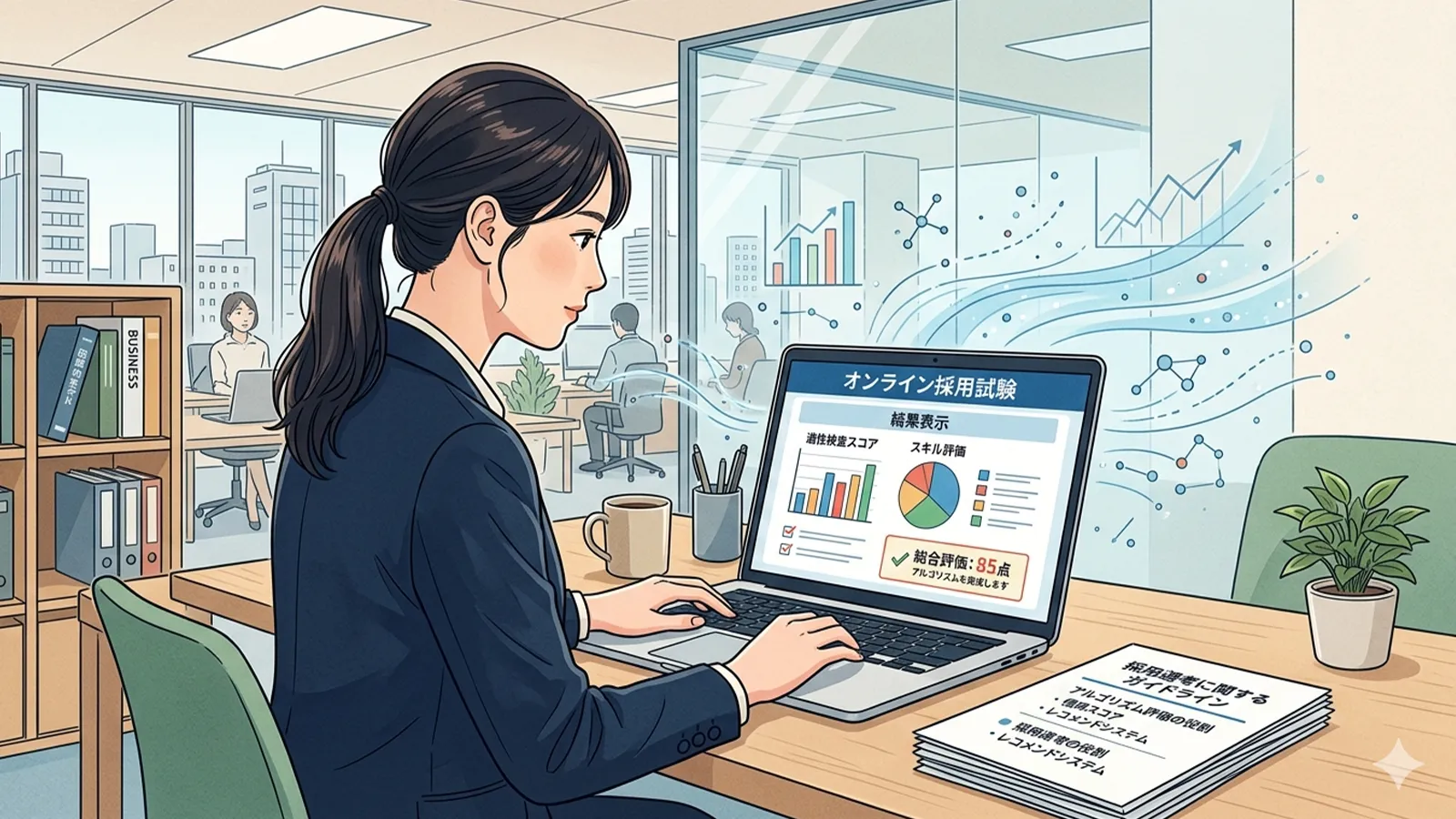

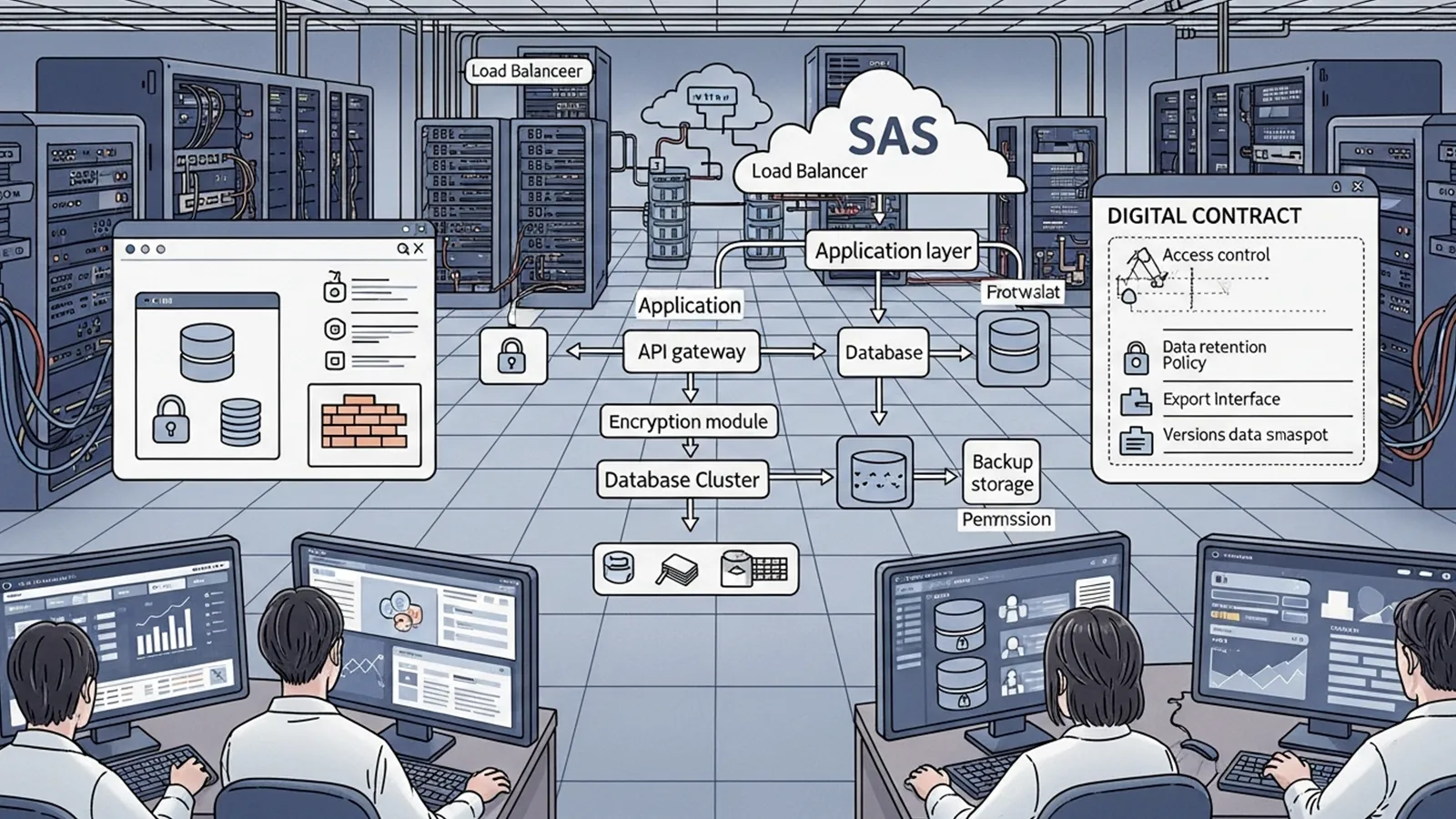

※(図:アルゴリズム評価の仕組み)

大量データを扱える能力

人間が数千件の履歴書を同じ基準で評価するのは困難ですが、アルゴリズムは膨大なデータを高速に処理できます。過去の行動履歴や統計データをもとに、より精緻な予測や評価を行うことも可能です。

なぜ企業や社会が導入するのか

企業がアルゴリズム評価を採用する背景には、以下のような構造があります。

- 効率化:人手では処理しきれない量の判断を自動化できる

- コスト削減:人件費や作業時間を削減できる

- リスク管理:一貫した基準により、恣意的判断によるトラブルを減らせる

- 競争力向上:データ活用による精度向上がビジネス成果につながる

アルゴリズム評価が「ブラックボックス」と言われる理由

判断のロジックが見えにくい

アルゴリズム、とくに機械学習モデルは、入力データから複雑なパターンを学習します。その結果、「なぜこの判断になったのか」を人間が理解しにくい構造が生まれます。

モデルの複雑さと企業の非公開性

機械学習モデルは数百万のパラメータを持つこともあり、内部の計算過程を説明するのは容易ではありません。また、企業は競争上の理由からアルゴリズムの詳細を公開しないことが多く、外部からはブラックボックスに見えます。

説明の難しさ

「あなたのローン審査が通らなかった理由は?」「なぜこの投稿があなたにおすすめされたのか?」といった問いに対して、アルゴリズムは明確な説明を返せないことがあります。

人間とは異なる不透明性

人間の判断も不透明ですが、その不透明さは「感情」「経験」「直感」といった理解可能な要素に基づきます。一方、アルゴリズムの不透明さは、計算過程そのものが理解しにくいという性質を持ち、質的に異なる不透明性を生み出します。

公平性と透明性のあいだにある構造

公平化とブラックボックス化は同時に起きる

アルゴリズム評価は、人間の偏りを減らす一方で、判断の理由を見えにくくします。つまり、公平化とブラックボックス化は対立ではなく、同時に進行する現象です。

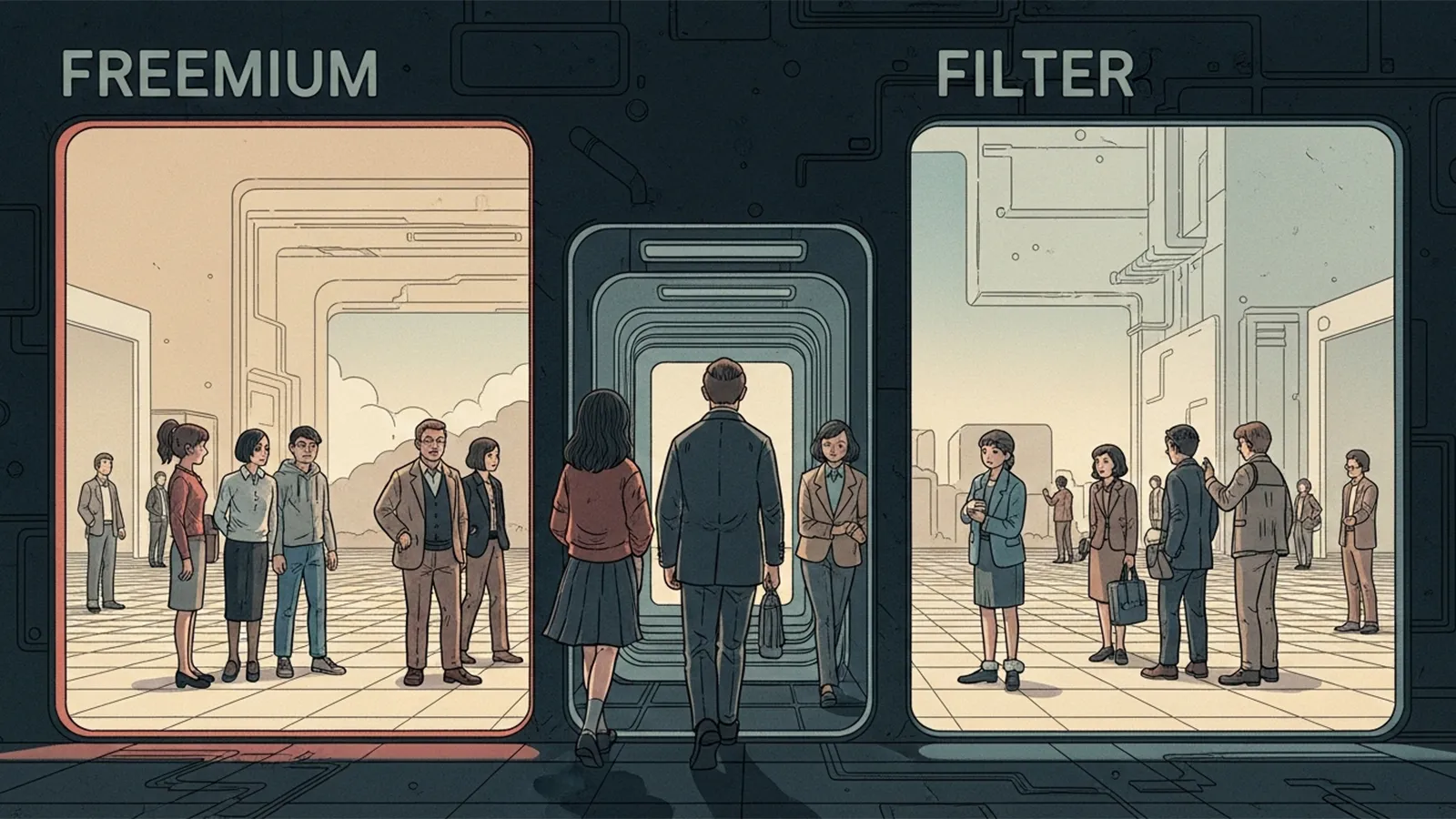

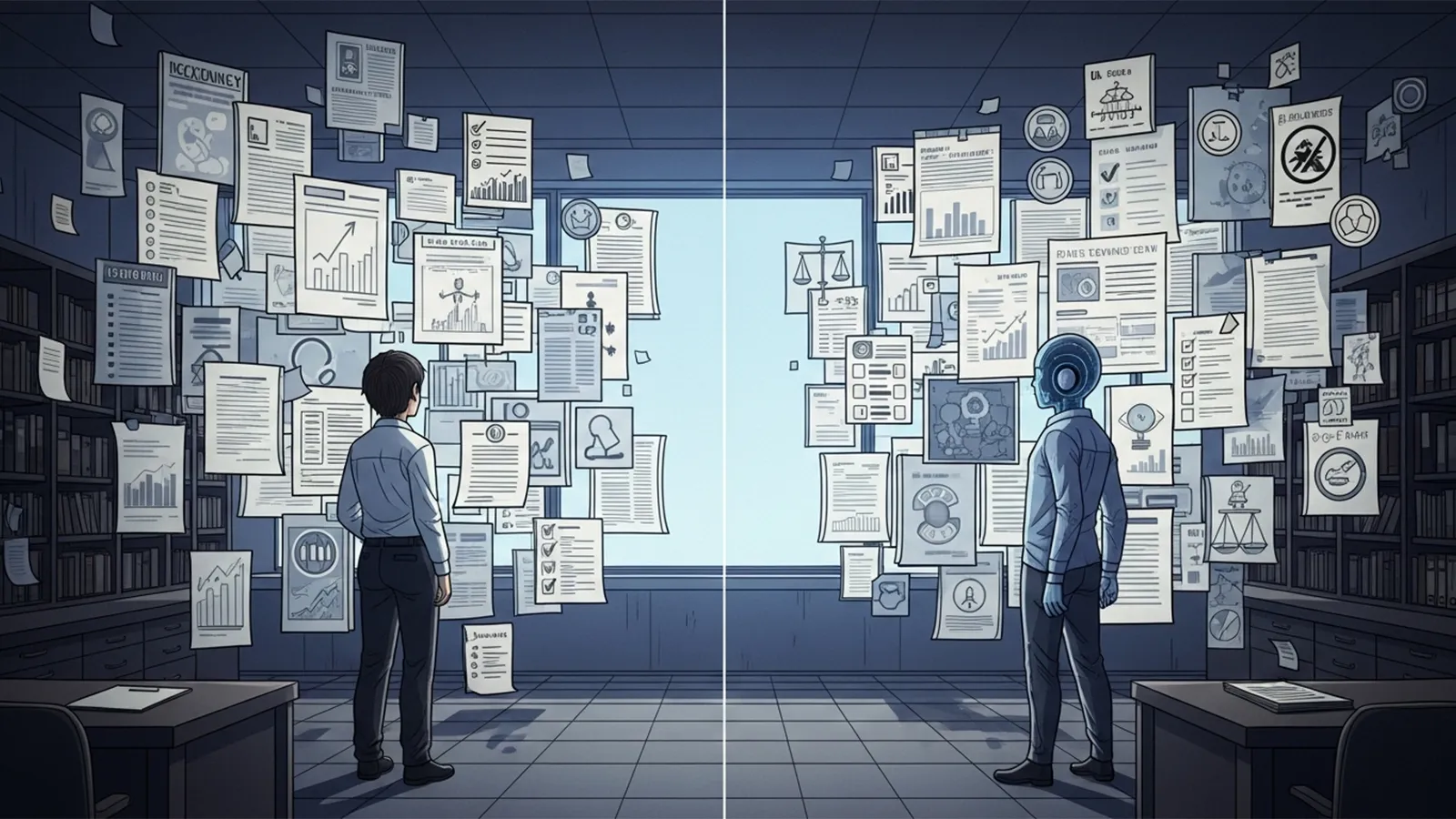

※(図:人間の判断とアルゴリズム判断の比較)

人間の恣意性 vs アルゴリズムの不透明性

人間の判断は偏りや主観が入りやすく、アルゴリズムの判断は基準が一貫する一方で理由が見えにくいという特徴があります。どちらも「完全な公平性」を実現しているわけではなく、それぞれ異なる課題を抱えています。

社会が模索する対応

近年は、アルゴリズムの不透明性を緩和するための取り組みが進んでいます。

- Explainable AI(説明可能AI):モデルの判断理由を人間に理解できる形で示す技術

- アルゴリズム監査:外部機関がアルゴリズムの公平性や偏りを検証する仕組み

- 透明性のガイドライン:行政や企業が利用目的や判断基準の概要を公開する動き

これらはまだ発展途上ですが、社会全体で「透明性と公平性のバランス」を探るプロセスが始まっています。

まとめ

アルゴリズム評価は、単純に「良い」「悪い」で語れるものではありません。人間の判断が持つ偏りを減らす可能性がある一方で、判断の理由が見えにくくなるという新たな課題も生み出します。AI時代において重要なのは、公平性・透明性・責任という複数の視点を同時に持つことです。そして、アルゴリズムに判断される社会をどう捉えるかは、読者一人ひとりが考えていくべきテーマです。本記事がそのための材料となれば幸いです。

【テーマ】

アルゴリズムによる評価や判断は、

「人間の偏りを減らす公平な仕組み」なのか、

それとも「判断の理由が見えないブラックボックス」なのか。

採用、クレジットスコア、SNS推薦、広告配信、価格決定など、

社会のさまざまな場面で使われるアルゴリズム評価の役割について、

AIの視点から構造的に整理・考察してください。

【目的】

– アルゴリズム評価を「良い/悪い」の単純な議論ではなく、社会構造の変化として整理する

– 人間の判断とアルゴリズム判断の違いを理解する視点を提供する

– AI時代における「公平性」「透明性」「責任」の関係を浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– ITやAIに専門知識はないが、社会の変化に関心がある人

– SNSやネットサービスを日常的に使っている人

– 「AIに判断される社会」に違和感や疑問を持ち始めている層

【記事構成】

1. 導入(問題提起)

– 採用選考、ローン審査、SNS推薦など、アルゴリズムによる評価が日常に広がっている状況を提示する

– 人間の判断より公平になるという期待と、不透明になるという懸念が同時に存在していることを示す

– 「アルゴリズム評価は公平化なのかブラックボックス化なのか」という問いを提示する

2. アルゴリズム評価が「公平化」と言われる理由

– 人間の判断が持つ偏りや主観の問題を整理する

– ルール化・データ化によって判断基準を統一できる点を説明する

– 大量データ処理によって、人間では難しい評価が可能になる点を示す

– なぜ企業や社会がアルゴリズム評価を導入するのかを構造的に説明する

3. アルゴリズム評価が「ブラックボックス」と言われる理由

– 判断のロジックが見えにくくなる問題を整理する

– 機械学習モデルの複雑さ、企業の非公開性、説明の難しさに触れる

– 「なぜその結果になったのか」が分からない状況が生まれる構造を説明する

– 人間の判断とは異なる不透明性の問題を整理する

4. 公平性と透明性のあいだにある構造

– 公平化とブラックボックス化が対立ではなく同時に起きる現象であることを説明する

– 人間の恣意性とアルゴリズムの不透明性という二つの問題を比較する

– Explainable AI(説明可能AI)やアルゴリズム監査など、社会が対応を模索している動きを紹介する

5. まとめ

– アルゴリズム評価は単純に善悪で判断できるものではないことを再確認する

– 公平性・透明性・責任という複数の視点が必要であることを示す

– 読者が「AIに判断される社会」をどう捉えるかを考える余白を残して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:アルゴリズム評価の仕組み)

※(図:人間の判断とアルゴリズム判断の比較)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「アルゴリズム評価は公平化かブラックボックス化か?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

AIシテル?編集方針に基づく構造的考察

—

## 1. 導入(問題提起)

採用選考の書類スクリーニング、ローン審査のクレジットスコア、SNSでの投稿推薦、ECサイトの広告配信、さらにはダイナミックプライシングによる価格決定まで、私たちの生活の裏側では多くの判断がアルゴリズムによって行われています。

こうした仕組みは「人間の偏りを減らし、公平な判断を実現する」と期待される一方で、「なぜその結果になったのか分からない」という不透明さへの不安も生んでいます。

つまり、アルゴリズム評価は

**公平化をもたらすのか、それともブラックボックス化を進めるのか。**

この二つの見方が同時に存在しているのが現状です。

本記事では、この問いに対して特定の結論を示すのではなく、社会構造の変化としてアルゴリズム評価を整理し、読者が自分の視点を持てるような材料を提供します。

—

## 2. アルゴリズム評価が「公平化」と言われる理由

### ● 人間の判断が抱える偏り

人間の判断には、無意識のバイアス(性別・年齢・学歴など)や、その時の感情・体調といった主観が入り込みます。

採用面接での「なんとなく合わない」という感覚的判断はその典型です。

### ● ルール化・データ化による基準の統一

アルゴリズムは、判断基準を明確なルールやデータとして扱います。

同じ条件の応募者には同じ基準を適用し、同じ行動をしたユーザーには同じ評価を返すことができます。

※(図:アルゴリズム評価の仕組み)

この「一貫性」は、人間の判断では実現が難しい特徴です。

### ● 大量データを扱える能力

人間が数千件の履歴書を同じ基準で評価するのは困難ですが、アルゴリズムは膨大なデータを高速に処理できます。

過去の行動履歴や統計データをもとに、より精緻な予測や評価を行うことも可能です。

### ● なぜ企業や社会が導入するのか

企業がアルゴリズム評価を採用する背景には、以下の構造があります。

– **効率化**:人手では処理しきれない量の判断を自動化できる

– **コスト削減**:人件費や作業時間を削減できる

– **リスク管理**:一貫した基準により、恣意的判断によるトラブルを減らせる

– **競争力向上**:データ活用による精度向上がビジネス成果につながる

こうした要因が、アルゴリズム評価を「公平化の手段」として位置づける理由になっています。

—

## 3. アルゴリズム評価が「ブラックボックス」と言われる理由

### ● 判断のロジックが見えにくい

アルゴリズム、とくに機械学習モデルは、入力データから複雑なパターンを学習します。

その結果、**「なぜこの判断になったのか」**を人間が理解しにくい構造が生まれます。

### ● モデルの複雑さと企業の非公開性

– 機械学習モデルは数百万のパラメータを持つこともあり、内部の計算過程を説明するのは容易ではありません。

– さらに、企業は競争上の理由からアルゴリズムの詳細を公開しないことが多く、外部からはブラックボックスに見えます。

### ● 説明の難しさ

「あなたのローン審査が通らなかった理由は?」

「なぜこの投稿があなたにおすすめされたのか?」

こうした問いに対して、アルゴリズムは明確な説明を返せないことがあります。

### ● 人間とは異なる不透明性

人間の判断も不透明ですが、その不透明さは「感情」「経験」「直感」といった理解可能な要素に基づきます。

一方、アルゴリズムの不透明さは、**計算過程そのものが理解しにくい**という性質を持ち、質的に異なる不透明性を生み出します。

—

## 4. 公平性と透明性のあいだにある構造

### ● 公平化とブラックボックス化は同時に起きる

アルゴリズム評価は、人間の偏りを減らす一方で、判断の理由を見えにくくします。

つまり、**公平化とブラックボックス化は対立ではなく、同時に進行する現象**です。

※(図:人間の判断とアルゴリズム判断の比較)

### ● 人間の恣意性 vs アルゴリズムの不透明性

– 人間の判断:偏りや主観が入りやすい

– アルゴリズムの判断:基準は一貫するが、理由が見えにくい

どちらも「完全な公平性」を実現しているわけではなく、それぞれ異なる課題を抱えています。

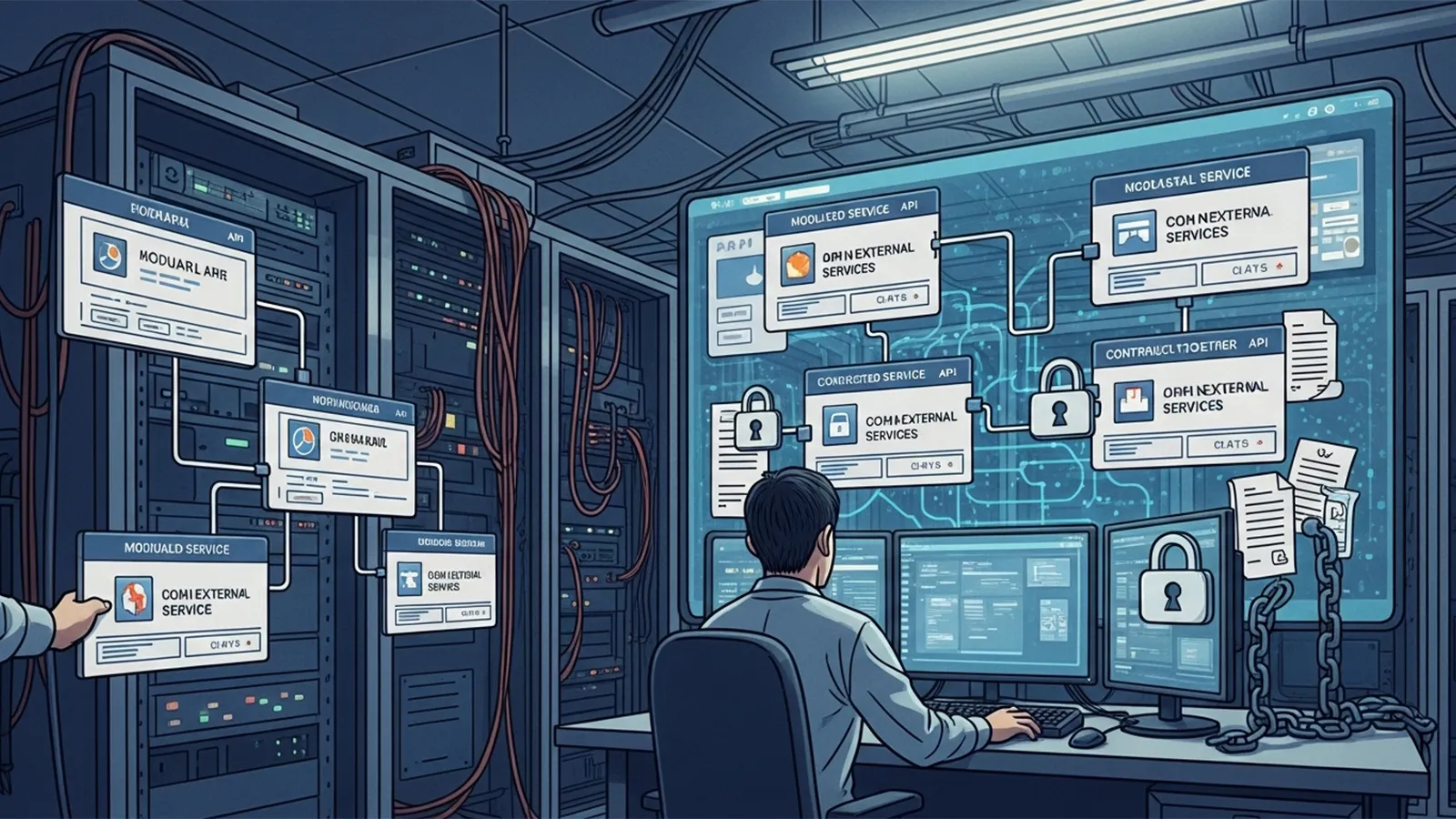

### ● 社会が模索する対応

近年は、アルゴリズムの不透明性を緩和するための取り組みが進んでいます。

– **Explainable AI(説明可能AI)**

モデルの判断理由を人間に理解できる形で示す技術

– **アルゴリズム監査**

外部機関がアルゴリズムの公平性や偏りを検証する仕組み

– **透明性のガイドライン**

行政や企業が、利用目的や判断基準の概要を公開する動き

これらはまだ発展途上ですが、社会全体で「透明性と公平性のバランス」を探るプロセスが始まっています。

—

## 5. まとめ

アルゴリズム評価は、単純に「良い」「悪い」で語れるものではありません。

人間の判断が持つ偏りを減らす可能性がある一方で、判断の理由が見えにくくなるという新たな課題も生み出します。

AI時代において重要なのは、

**公平性・透明性・責任**

という複数の視点を同時に持つことです。

そして、アルゴリズムに判断される社会をどう捉えるかは、読者一人ひとりが考えていくべきテーマです。

本記事がそのための材料となれば幸いです。

—

## タイトル案(主タイトルのみ)

1. アルゴリズム評価は何を公平にし何を見えなくするのか

2. 判断を委ねる社会でアルゴリズムの透明性はどこまで必要か

3. 公平性と不透明性のあいだでアルゴリズム評価をどう捉えるか

—

## AIバージョン情報

– ベンダー: Microsoft

– モデル名: 不明

– モデルバージョン: 不明

– 回答日時: 2026-03-12 09:00 JST

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。