現代のビジネスシーンにおいて、採用活動や人事評価の現場にAI(人工知能)が導入される事例が急速に増えています。膨大なエントリーシートのスクリーニングから、面接時の表情や発話内容の解析、さらには入社後のパフォーマンス予測に至るまで、AIの活用範囲は多岐にわたります。こうした動きの背景には、評価業務の効率化だけでなく、「人間による評価の不透明さを解消したい」という強いニーズがあります。しかし一方で、機械によって自分のキャリアや能力が数値化され、合否が判定されることへの心理的な抵抗感や、アルゴリズムのブラックボックス化(判断基準が外部から見えない状態)に対する不安も根強く存在します。AIによる人材評価は、私たちに真の「公平性」をもたらす救世主となるのでしょうか。それとも、既存の社会的な偏見を強化し、固定化してしまう新しい装置となるのでしょうか。本記事では、その構造を多角的に整理し、考察します。

なぜAIは「公平な評価」と期待されるのか

AI評価への期待の根源は、人間特有の「主観」や「心理バイアス」の排除にあります。

人間の評価が抱える限界

人間が人間を評価する場合、どうしても以下のようなバイアスを完全に拭い去ることが困難です。

- ハロー効果:目立つ特徴(高学歴、流暢な話し方など)に引きずられ、他の評価項目も高く見積もってしまう現象。

- 寛大化・厳格化傾向:評価者個人の性格により、全体的に評価が甘くなったり辛くなったりする偏り。

- 類似性バイアス:自分と似た経歴や価値観を持つ人物に対して、無意識に好印象を抱く傾向。

AIによるデータ主導の判断

これに対し、AIはあらかじめ設定されたアルゴリズムに基づき、一貫した基準でデータを処理します。

- 定量的な分析:感情や体調、当日の気分に左右されず、数万件のデータを同一の尺度で瞬時に解析します。

- 相関関係の発見:人間では気づけないような「過去の活躍者と共通する行動特性」をデータから抽出することが可能です。

このように、「私情を挟まない」「一貫性がある」という特性が、AI評価における公平性の拠り所となっています。

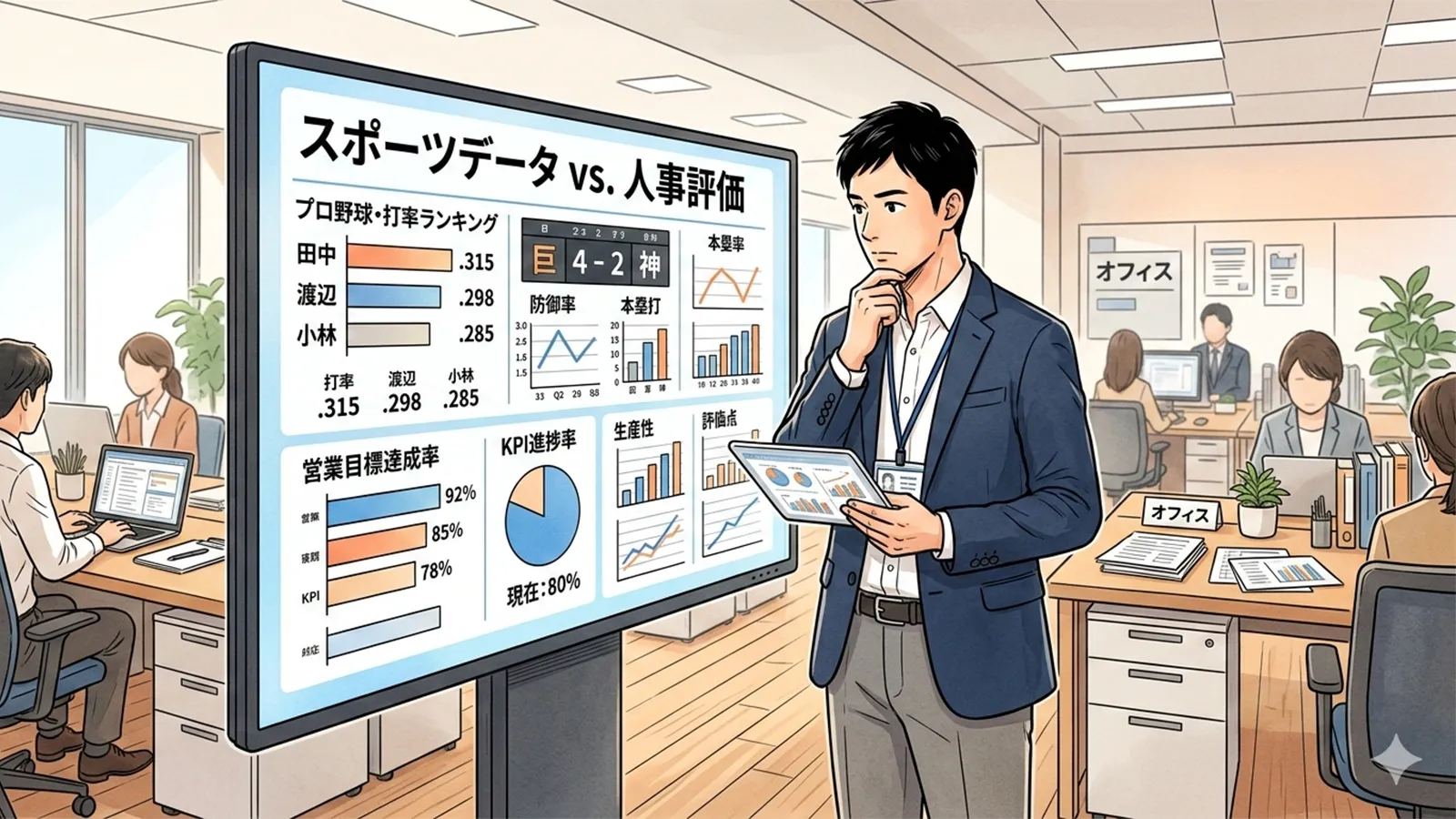

※(図:人間評価とAI評価の比較)

AIは本当に偏見を排除できるのか

しかし、AIが「客観的な計算機」であるからといって、その出力結果が常に「公平」であるとは限りません。ここには、AIの学習プロセスに起因する構造的な課題があります。

データの「汚染」と再生産

AIは過去の膨大なデータを学習して判断基準を作ります。もし、学習元となる過去の採用データや評価データ自体に、性別や人種、年齢に対する偏見が含まれていた場合、AIはその偏り(バイアス)を「正解パターン」として学習してしまいます。

- 例:過去の管理職が特定の属性に偏っていた場合、AIは「その属性こそが管理職に適している」と判断する可能性があります。

統計的差別のリスク

AIは「グループの傾向」を個人の評価に適用する性質があります。特定の属性を持つ集団の離職率が統計的に高い場合、その属性を持つ個人がどれほど優秀であっても、AIは「リスクが高い」と評価してしまう懸念があります。これは、個人の努力や資質を無視した「新しい形の偏見」となり得るものです。

評価基準のブラックボックス化

ディープラーニング(深層学習)などの高度なAI技術では、なぜその評価が導き出されたのかというプロセスを人間が説明できないことがあります。「理由は不明だがAIが不採用と判断した」という状況は、評価される側の納得感を得るのが難しく、透明性の欠如という課題を生みます。

公平性と合理性の境界はどこにあるのか

「公平」という言葉の解釈は、立場や状況によって揺れ動きます。人材評価における「合理的判断」と「社会的な公平性」の境界線について整理します。

組織にとっての合理性

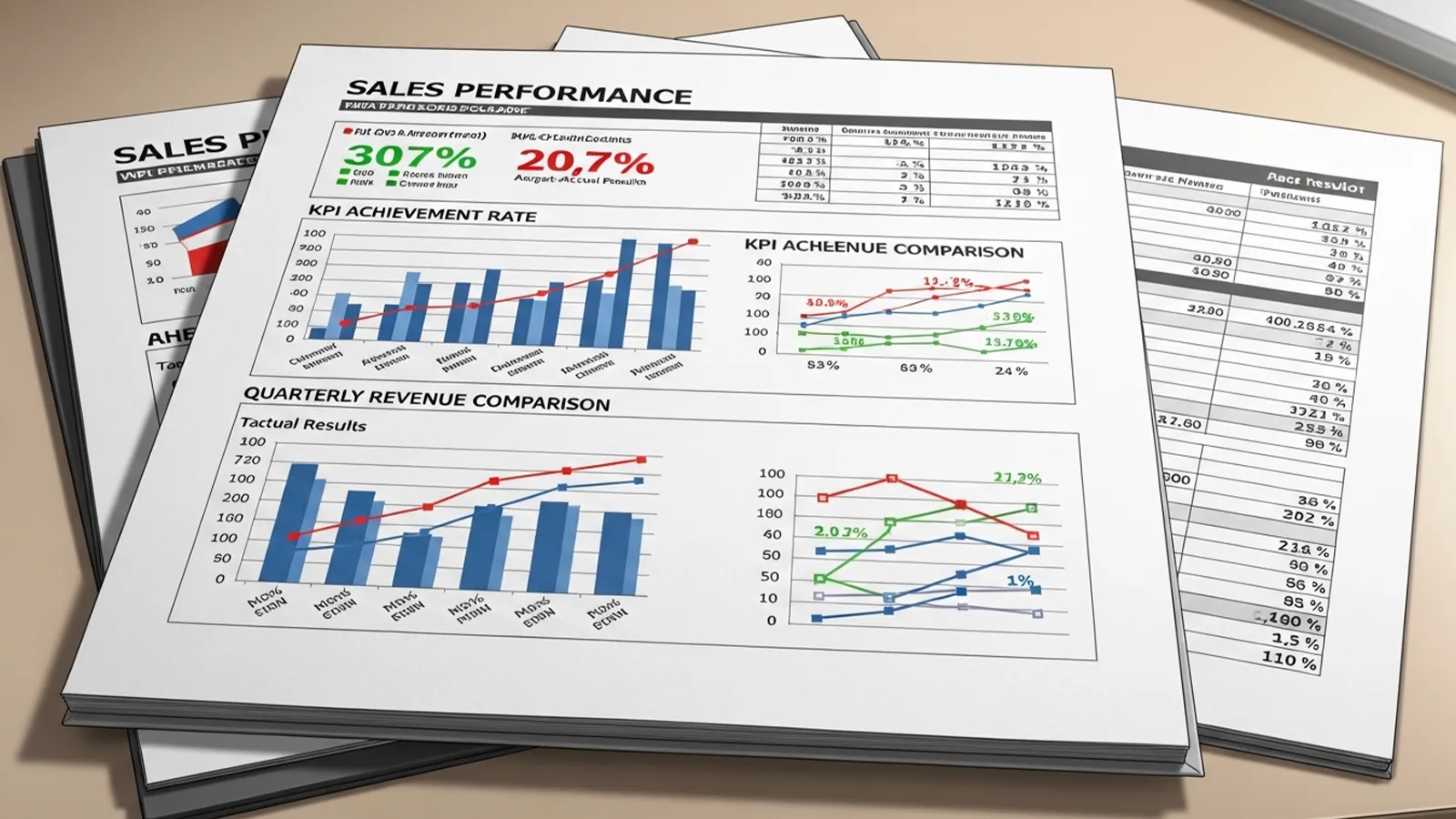

企業にとって、高いパフォーマンスを発揮する可能性が高い人材をデータに基づいて選ぶことは、経営上の「合理性」に叶っています。例えば、特定のスキルセットや過去の成功パターンに合致する人物をAIが選出することは、組織運営の最適化と言えます。

社会的な公平性との乖離

一方で、社会的な視点では「機会の平等」が重視されます。特定の属性を排除するようなアルゴリズムが、たとえ企業の利益(合理性)に貢献するとしても、それが社会的な差別を助長するものであれば、それは「不当な偏見」と見なされます。

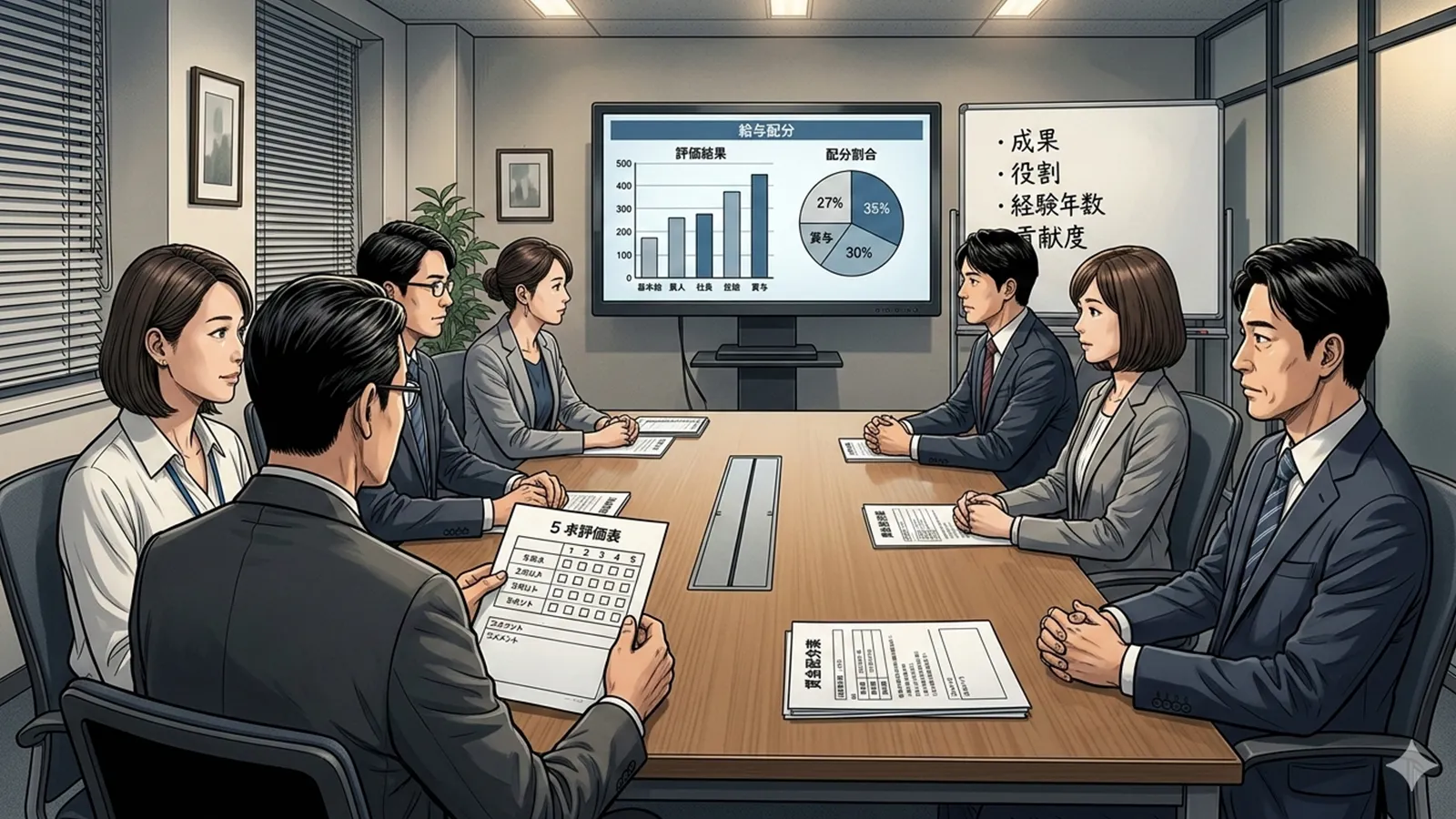

評価指標そのもののバイアス

「何をもって優秀とするか」という評価指標の設定自体、人間が行うものです。AIが測定しやすい「数値化可能な実績」ばかりが重視されるようになると、数値に表れにくい「チームへの貢献」や「心理的安全性の構築」といった能力が過小評価されるという、構造的な偏りが生じる可能性もあります。

AI評価と人間の役割

こうした課題を踏まえ、現在ではAIに全てを委ねるのではなく、人間とAIが相互に補完し合う「ハイブリッド型」の評価体制が模索されています。

AIを「意思決定支援」として活用する

AIを合否の最終決定者にするのではなく、人間が見落としがちな視点を提供する「補助ツール」として位置づける考え方です。

- スクリーニングの省力化:定型的な判断をAIに任せ、人間はより深い対話や動機付けに時間を割く。

- バイアスのチェック:人間の評価結果とAIの予測値を比較し、人間に偏見が生じていないかを逆検証する。

説明責任(アカウンタビリティ)の保持

評価の結果に対して責任を負うのは、常に人間であるべきだという議論があります。AIの提示したスコアを参考にしつつも、最終的な判断の「理由」を言語化し、本人にフィードバックする役割は人間が担い続ける必要があります。

継続的なアルゴリズムの監査

AIが導き出す結果に偏りが出ていないか、定期的に第三者がアルゴリズムを監査(チェック)する仕組みも重要視され始めています。

※(図:AIによる人材評価の構造)

まとめ:問い直される「公平」の定義

AIによる人材評価の導入は、私たちが長年目をつむってきた「人間による評価の曖昧さ」を浮き彫りにしました。AIは鏡のように、組織が持っていた過去のバイアスを映し出すこともあれば、主観を排除した一貫性のある基準を提示することもあります。

結論として、AIそのものが公平性を保証してくれるわけではありません。AIをどのように設計し、どの範囲で活用し、その結果を人間がどう解釈するのかという「運用の設計」にこそ、公平性の成否がかかっています。

AI評価が普及する社会において、私たちは「何をもって公平とするのか」「データで測れない価値をどう扱うのか」という問いに、改めて向き合うことを求められています。それは技術の問題である以上に、私たちがどのような組織や社会を築きたいかという、価値観の問題でもあるのです。

【テーマ】

AIが採用・評価・昇進などの「人材評価」に使われる時代において、

それは本当に「公平な判断」を実現する仕組みなのか、

それとも「新しい形の偏見」を生む可能性を含んでいるのか。

AIによる人材評価の仕組みを、社会構造・データ・組織運営の視点から整理・考察してください。

【目的】

– 「AIは公平」「AIは危険」という単純な善悪の議論ではなく、AI評価の構造を理解する

– 人間の評価とAI評価の違いを整理し、公平性とは何かを考える材料を提示する

– AIが人材評価に導入される社会で、どのような課題や可能性があるのかを浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– 就職・転職活動を考えている人

– 企業の評価制度や人事に関心のある人

– AIに詳しくはないが、働き方への影響を感じている層

【記事構成】

1. 導入(問題提起)

– 企業の採用や人事評価にAIが導入され始めている現状を示す

– 「AIなら公平なのではないか」という期待と、「AIが人を評価してよいのか」という不安の両方を提示する

– 人材評価という領域でAIが注目されている背景を簡潔に説明する

2. なぜAIは「公平な評価」と期待されるのか

– 人間の評価に含まれる主観やバイアスの問題を整理する

– AIがデータ分析によって評価する仕組みを説明する

– 感情や先入観に左右されない評価という期待がどこから生まれているのかを説明する

3. AIは本当に偏見を排除できるのか

– AIが学習するデータの性質を説明する

– 過去の採用や評価のデータが偏っていた場合、AIがその傾向を再生産する可能性に触れる

– AIによる評価が「新しい偏見」を生む可能性を構造的に整理する

4. 公平性と合理性の境界はどこにあるのか

– 能力評価・実績評価・学歴評価などがどこまで合理的で、どこから偏見と見なされるのかを整理する

– AIが合理的判断をした場合でも、それが社会的に公平と受け取られるとは限らない点を説明する

– 人材評価における「公平」という概念そのものの曖昧さを整理する

5. AI評価と人間の役割

– AI単独の評価ではなく、人間とAIの併用が議論されている背景を説明する

– AIは評価の主体なのか、それとも意思決定を補助するツールなのかという視点を提示する

– 将来的な人材評価のあり方について、複数の可能性を示す

6. まとめ

– AIによる人材評価は「完全な公平性」を保証する仕組みではないことを確認する

– それでもAIが評価制度を変える可能性がある点を整理する

– 読者が「公平な評価とは何か」を考えるための視点を提示して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:AIによる人材評価の構造)

※(図:人間評価とAI評価の比較)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AIは人材評価を本当に公平にできるのか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

現代のビジネスシーンにおいて、採用活動や人事評価の現場にAI(人工知能)が導入される事例が急速に増えています。膨大なエントリーシートのスクリーニングから、面接時の表情や発話内容の解析、さらには入社後のパフォーマンス予測に至るまで、AIの活用範囲は多岐にわたります。

こうした動きの背景には、評価業務の効率化だけでなく、「人間による評価の不透明さを解消したい」という強いニーズがあります。しかし一方で、機械によって自分のキャリアや能力が数値化され、合否が判定されることへの心理的な抵抗感や、アルゴリズムのブラックボックス化(判断基準が外部から見えない状態)に対する不安も根強く存在します。

AIによる人材評価は、私たちに真の「公平性」をもたらす救世主となるのでしょうか。それとも、既存の社会的な偏見を強化し、固定化してしまう新しい装置となるのでしょうか。本記事では、その構造を多角的に整理し、考察します。

—

## 2. なぜAIは「公平な評価」と期待されるのか

AI評価への期待の根源は、人間特有の「主観」や「心理バイアス」の排除にあります。

### 人間が抱える評価の限界

人間が人間を評価する場合、どうしても以下のようなバイアスを完全に拭い去ることが困難です。

* **ハロー効果**:目立つ特徴(高学歴、流暢な話し方など)に引きずられ、他の評価項目も高く見積もってしまう現象。

* **寛大化・厳格化傾向**:評価者個人の性格により、全体的に評価が甘くなったり辛くなったりする偏り。

* **類似性バイアス**:自分と似た経歴や価値観を持つ人物に対して、無意識に好印象を抱く傾向。

### AIによるデータ主導の判断

これに対し、AIはあらかじめ設定されたアルゴリズムに基づき、一貫した基準でデータを処理します。

* **定量的な分析**:感情や体調、当日の気分に左右されず、数万件のデータを同一の尺度で瞬時に解析します。

* **相関関係の発見**:人間では気づけないような「過去の活躍者と共通する行動特性」をデータから抽出することが可能です。

このように、「私情を挟まない」「一貫性がある」という特性が、AI評価における公平性の拠り所となっています。

※(図:人間評価とAI評価の比較)

—

## 3. AIは本当に偏見を排除できるのか

しかし、AIが「客観的な計算機」であるからといって、その出力結果が常に「公平」であるとは限りません。ここには、AIの学習プロセスに起因する構造的な課題があります。

### データの「汚染」と再生産

AIは過去の膨大なデータを学習して判断基準を作ります。もし、学習元となる過去の採用データや評価データ自体に、性別や人種、年齢に対する偏見が含まれていた場合、AIはその偏り(バイアス)を「正解パターン」として学習してしまいます。

* **例**:過去の管理職が特定の属性に偏っていた場合、AIは「その属性こそが管理職に適している」と判断する可能性があります。

### 統計的差別のリスク

AIは「グループの傾向」を個人の評価に適用する性質があります。特定の属性を持つ集団の離職率が統計的に高い場合、その属性を持つ個人がどれほど優秀であっても、AIは「リスクが高い」と評価してしまう懸念があります。これは、個人の努力や資質を無視した「新しい形の偏見」となり得るものです。

### 評価基準のブラックボックス化

ディープラーニング(深層学習)などの高度なAI技術では、なぜその評価が導き出されたのかというプロセスを人間が説明できないことがあります。「理由は不明だがAIが不採用と判断した」という状況は、評価される側の納得感を得るのが難しく、透明性の欠如という課題を生みます。

—

## 4. 公平性と合理性の境界はどこにあるのか

「公平」という言葉の解釈は、立場や状況によって揺れ動きます。人材評価における「合理的判断」と「社会的な公平性」の境界線について整理します。

### 組織にとっての合理性

企業にとって、高いパフォーマンスを発揮する可能性が高い人材をデータに基づいて選ぶことは、経営上の「合理性」に叶っています。例えば、特定のスキルセットや過去の成功パターンに合致する人物をAIが選出することは、組織運営の最適化と言えます。

### 社会的な公平性との乖離

一方で、社会的な視点では「機会の平等」が重視されます。特定の属性を排除するようなアルゴリズムが、たとえ企業の利益(合理性)に貢献するとしても、それが社会的な差別を助長するものであれば、それは「不当な偏見」と見なされます。

### 評価指標そのもののバイアス

「何をもって優秀とするか」という評価指標の設定自体、人間が行うものです。AIが測定しやすい「数値化可能な実績」ばかりが重視されるようになると、数値に表れにくい「チームへの貢献」や「心理的安全性の構築」といった能力が過小評価されるという、構造的な偏りが生じる可能性もあります。

—

## 5. AI評価と人間の役割

こうした課題を踏まえ、現在ではAIに全てを委ねるのではなく、人間とAIが相互に補完し合う「ハイブリッド型」の評価体制が模索されています。

### AIを「意思決定支援」として活用する

AIを合否の最終決定者にするのではなく、人間が見落としがちな視点を提供する「補助ツール」として位置づける考え方です。

* **スクリーニングの省力化**:定型的な判断をAIに任せ、人間はより深い対話や動機付けに時間を割く。

* **バイアスのチェック**:人間の評価結果とAIの予測値を比較し、人間に偏見が生じていないかを逆検証する。

### 説明責任(アカウンタビリティ)の保持

評価の結果に対して責任を負うのは、常に人間であるべきだという議論があります。AIの提示したスコアを参考にしつつも、最終的な判断の「理由」を言語化し、本人にフィードバックする役割は人間が担い続ける必要があります。

### 継続的なアルゴリズムの監査

AIが導き出す結果に偏りが出ていないか、定期的に第三者がアルゴリズムを監査(チェック)する仕組みも重要視され始めています。

※(図:AIによる人材評価の構造)

—

## 6. まとめ:問い直される「公平」の定義

AIによる人材評価の導入は、私たちが長年目をつむってきた「人間による評価の曖昧さ」を浮き彫りにしました。AIは鏡のように、組織が持っていた過去のバイアスを映し出すこともあれば、主観を排除した一貫性のある基準を提示することもあります。

結論として、AIそのものが公平性を保証してくれるわけではありません。AIをどのように設計し、どの範囲で活用し、その結果を人間がどう解釈するのかという「運用の設計」にこそ、公平性の成否がかかっています。

AI評価が普及する社会において、私たちは「何をもって公平とするのか」「データで測れない価値をどう扱うのか」という問いに、改めて向き合うことを求められています。それは技術の問題である以上に、私たちがどのような組織や社会を築きたいかという、価値観の問題でもあるのです。

—

### タイトル案

1. 人材評価へのAI導入で組織の公平性はどのように変化するのか

2. データの学習がもたらす新しい偏見と客観的評価の境界はどこか

3. アルゴリズムが人を査定する時代に納得感のある公平性は宿るか

—

AIバージョン情報

* ベンダー: Google

* モデル名: Gemini 3 Flash (Free tier)

* モデルバージョン: 3 Flash

* 回答日時: 2026-03-10

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。

※ 編集注(MANA)

本記事は、AIによる人材評価を「アルゴリズムによる選別」という視点から整理し、データ構造・統計的判断・組織合理性の関係に焦点を当てています。特に、AIが生む偏見を「データと設計の問題」として説明している点が特徴です。他のAIと比較する際には、この技術構造寄りの視点の置き方にも注目できます。