近年、私たちの身の回りでは、AIによるセキュリティ対策が当たり前の存在になりつつあります。不正ログインの検知や不審な通信の遮断など、多くの場面でAIが裏側から支えています。しかし、そのAIは本当に「守る装置」として機能しているのか、それとも誤検知や排除を生みうる自動判断の仕組みなのかについては、十分に整理された議論が共有されているとは言えません。「AIがあれば安心だ」という期待が語られる一方で、突然のアカウント凍結や取引停止といった経験から、不安を感じる声もあります。

セキュリティAIは、単なる技術の進化ではなく、防御と判断、効率と排除といった複数の要素が重なり合う仕組みです。そのため、「安全/危険」や「便利/不安」といった単純な二分法では捉えきれない性質を持っています。

そこで本特集では、共通プロンプトをもとに、8つのAIに対して「セキュリティAIは防御装置なのか、それとも誤検知リスクを内包する自動判断システムなのか」という問いを投げかけました。

- ChatGPT (チャットジーピーティー)

- Gemini (ジェミニ)

- Copilot (コパイロット)

- Grok (グロック)

- Claude (クロード)

- Perplexity (パープレキシティ)

- DeepSeek (ディープシーク)

- LeChat (ル・シャ)

特定の立場や結論を導くことを目的とするのではなく、セキュリティAIが持つ役割と副作用を構造として整理することを本特集の狙いとしています。本記事は、各AIの考察を読み進めるための思考の整理役として位置づけています。

共通プロンプト

ここでは、本特集を考えるうえで用いた共通プロンプトについて、簡単にご説明します。本特集では、「セキュリティAIは防御装置なのか、それとも誤検知リスクを内包する自動判断システムなのか」という問いを、技術の優劣や是非の議論として扱うのではなく、防御能力の向上・誤検知の発生・自動排除の仕組み・運用と責任の所在といった要素が重なり合う構造として整理しています。

この共通プロンプトは、特定の立場や結論を導くためのものではありません。どのような前提のもとでAIによる自動判断が運用され、どのような条件で「安全」と「排除」が分かれていくのかに目を向けながら、「AIに任せることは何を意味するのか」を考えるための視点を共有することを目的としています。

【テーマ】

セキュリティAIは「防御装置」なのか、それとも「誤検知リスクを内包する自動判断システム」なのか。

AIによるセキュリティ対策の進化と、その副作用としての誤検知・排除・ブラックボックス化の問題について、構造的に整理・考察してください。

【目的】

– セキュリティAIを「万能の防御」または「危険な監視装置」と単純化せず、両面性を整理する

– 技術論だけでなく、運用・責任・統治設計の観点を提示する

– 読者が「AIに任せることの意味」を自分で考えるための視点を提供する

【読者像】

– 一般社会人(20〜50代)

– ITやAIに詳しくはないが、日常的にデジタルサービスを利用している層

– 企業の情報セキュリティやアカウント凍結、誤検知に関心を持つ人

– AIによる自動判断に漠然とした不安や期待を抱いている人

【記事構成】

1. 導入(問題提起)

– サイバー攻撃の高度化とAI活用の現状を簡潔に提示する

– 「AIが守ってくれる」という期待と、「AIに誤って排除されるかもしれない」という不安を提示する

– なぜセキュリティAIが単なる技術問題ではないのかを示す

2. 防御としてのセキュリティAI

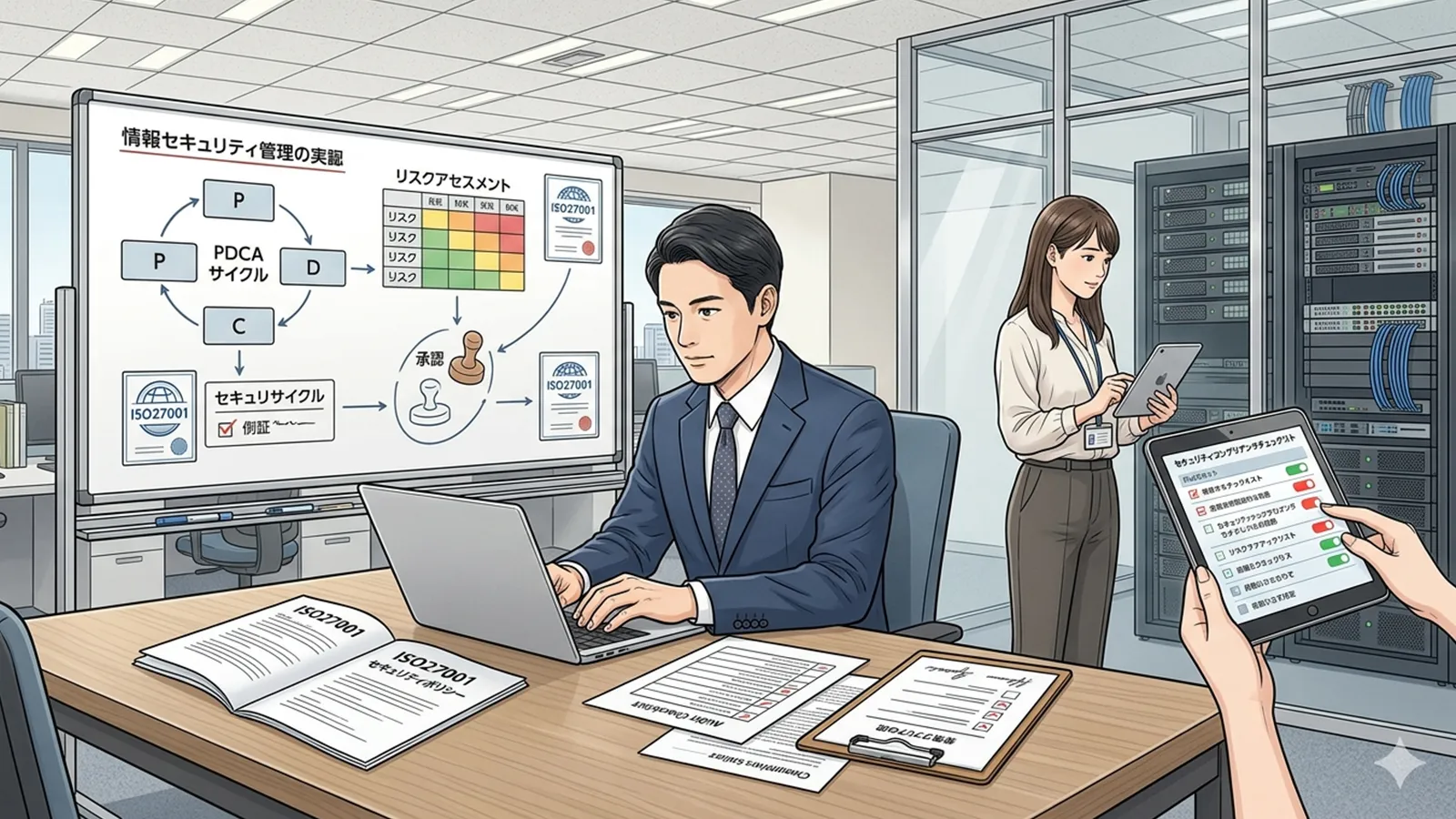

– 従来型セキュリティとの違い(シグネチャ型と行動分析型など)を簡潔に整理する

– 未知の攻撃や大規模データ処理への対応力を説明する

– 攻撃側もAIを使うという構造的対抗関係に触れる

– 防御インフラとしての必要性を冷静に整理する

3. 誤検知と排除のリスク

– 誤検知(False Positive)の概念を簡潔に説明する

– 正常なユーザーや業務が遮断される可能性を整理する

– ブラックボックス化や説明困難性の問題に触れる

– 「自動防御」が「自動排除」に変わる構造を説明する

4. 問題は技術か、それとも統治設計か

– 閾値設定・運用責任・異議申し立て制度の重要性を整理する

– 「AIが判断した」という言葉が責任を曖昧にする構造を指摘する

– 国家レベル、企業レベル、プラットフォームレベルの違いに簡潔に触れる

– セキュリティAIをどう位置づけるかは設計思想次第であることを示す

5. まとめ

– セキュリティAIは防御でもあり、リスクでもあるという二面性を再確認する

– 問題は「使うか使わないか」ではなく「どう設計し、どう責任を持つか」であることを提示する

– 過度に楽観・悲観せず、読者が自分なりに考える余白を残して締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「恐怖を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:セキュリティAIの防御と誤検知の構造)

※(図:自動判断と責任主体の関係図)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「3年後、あなたの仕事は残っているか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

生成された記事

以下では、本特集で用いた共通プロンプトをもとに、各AIがまとめた個別の考察記事へのリンクを掲載しています。出発点となる問いは、「セキュリティAIは防御装置なのか、それとも誤検知リスクを内包する自動判断システムなのか」というものです。

防御インフラとしての役割を重視した整理、誤検知やアカウント凍結といった排除の側面に注目した考察、責任や統治設計の観点から見直したものなど、切り口はAIごとに少しずつ異なります。視点の違いを比べながら、気になった考察から読み進めてみてください。

ChatGPTチャットジーピーティー

セキュリティAIを、防御機能・誤検知・責任設計が重なり合う全体構造として整理するタイプです。安全性の向上と排除リスクの両面を並べながら、AIに任せるとはどういうことかを冷静に言語化します。

Claudeクロード

アカウント凍結や誤検知による戸惑いに目を向けつつ、自動判断と利用者体験のずれを丁寧に読み解くタイプです。安心と不安が同時に存在する状況を、やわらかな語り口で整理します。

Geminiジェミニ

技術的な仕組みや制度設計に注目し、AIによる自動検知が成り立つ条件を整理するタイプです。データ処理や監視の枠組みから、防御と制限のバランスを落ち着いた視点でまとめます。

Copilotコパイロット

現実的な運用や企業の判断を踏まえ、安全確保と業務継続の両立の難しさを整理するタイプです。理想と実務のあいだにある調整の課題を実践的な視点で捉えます。

Grokグロック

「そもそも守るとは何か」「排除とはどこから始まるのか」といった素朴な問いから考察を始めるタイプです。前提を見直しながら、議論の土台そのものを軽やかに問い直します。

Perplexityパープレキシティ

セキュリティAIがどのような文脈で語られてきたのかを、社会的議論や報道の流れから俯瞰するタイプです。なぜ評価が分かれやすいのかを整理します。

DeepSeekディープシーク

要素を分解し、技術・運用・責任の関係を論理的に組み立てるタイプです。どの設計が安全性を高め、どの部分がリスクを生むのかを丁寧に言語化します。

LeChatル・シャ

AIを善悪で単純化せず、不確実な社会とどう向き合うかという視点から考えるタイプです。自動化が広がる世界での共存のあり方を静かに見つめます。

MANAは答えを示す存在ではありません。考察が成立する「場」を整えることが役割です。