私たちの社会では、AIや自動化技術が急速に普及し、労働の現場や意思決定のプロセスに深く組み込まれつつあります。AIはもはや単なる「ツール」ではなく、データに基づく判断や予測、提案を行う「主体的な存在」として機能し始めています。例えば、医療現場ではAIが診断を補助し、製造業では自動化システムが生産ラインを管理し、金融業界ではアルゴリズムが投資判断を下しています。このような変化は、私たちに新たな問いを突きつけます。「AIが判断を下した結果、問題が発生した場合、誰が責任を負うのか」「人間の役割はどこにあるのか」——これらはもはや哲学的な議論ではなく、現実的な社会問題として浮上しています。なぜ今、「責任」という視点が重要なのでしょうか。その理由は、AIが人間の判断を補完し、時には代替するようになるにつれ、従来の「責任の所在」が曖昧になりつつあるからです。この記事では、AI時代における「労働」と「責任」の関係を構造的に整理し、読者が自らの働き方や責任の持ち方を考えるための視点を提供します。

従来の労働における責任構造

人間中心の社会では、労働における責任の所在は比較的明確でした。以下の3つの層が、責任の基本構造を形成していました。

実行責任:作業者の役割

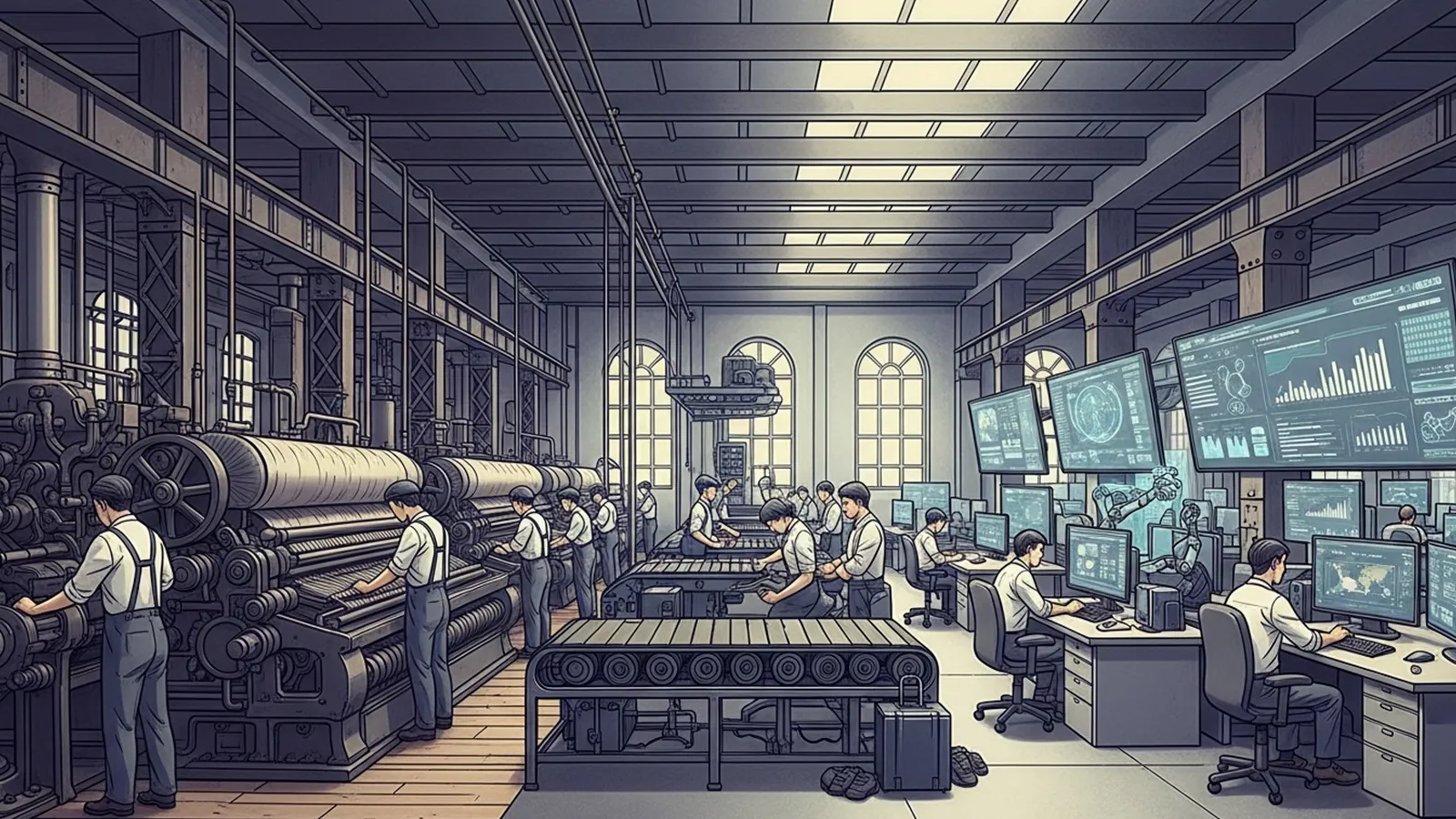

作業者は、具体的な業務を遂行する責任を負います。例えば、工場のラインワーカーが製品を組み立てる、看護師が患者のケアを行う、といった直接的な行為です。ここでの責任は、「指示された通りに作業を実行する」ことに集約されます。

判断責任:管理者・意思決定者の役割

管理者や意思決定者は、作業者に指示を出すだけでなく、業務の方針や優先順位を決定する責任を負います。例えば、プロジェクトマネージャーが予算配分を決める、医師が治療方針を選択する、といった判断です。ここでの責任は、「適切な判断を下す」ことにあります。

制度責任:企業・社会・法律の役割

企業や社会、法律は、労働環境やルールを整備し、責任の枠組みを提供します。例えば、労働基準法が労働条件を定める、企業がコンプライアンス体制を構築する、といった制度的な責任です。ここでの責任は、「公正で安全な労働環境を保証する」ことにあります。

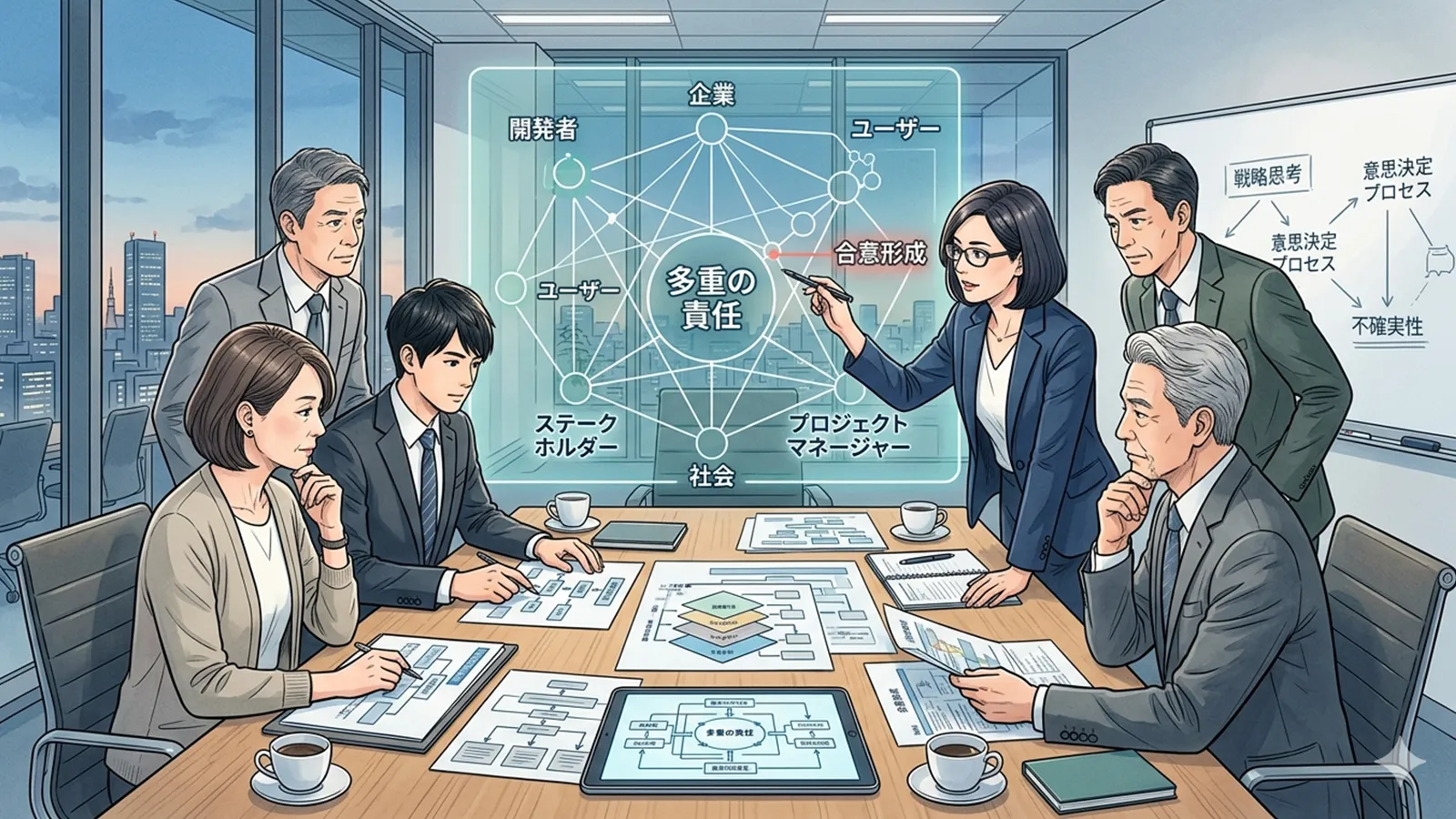

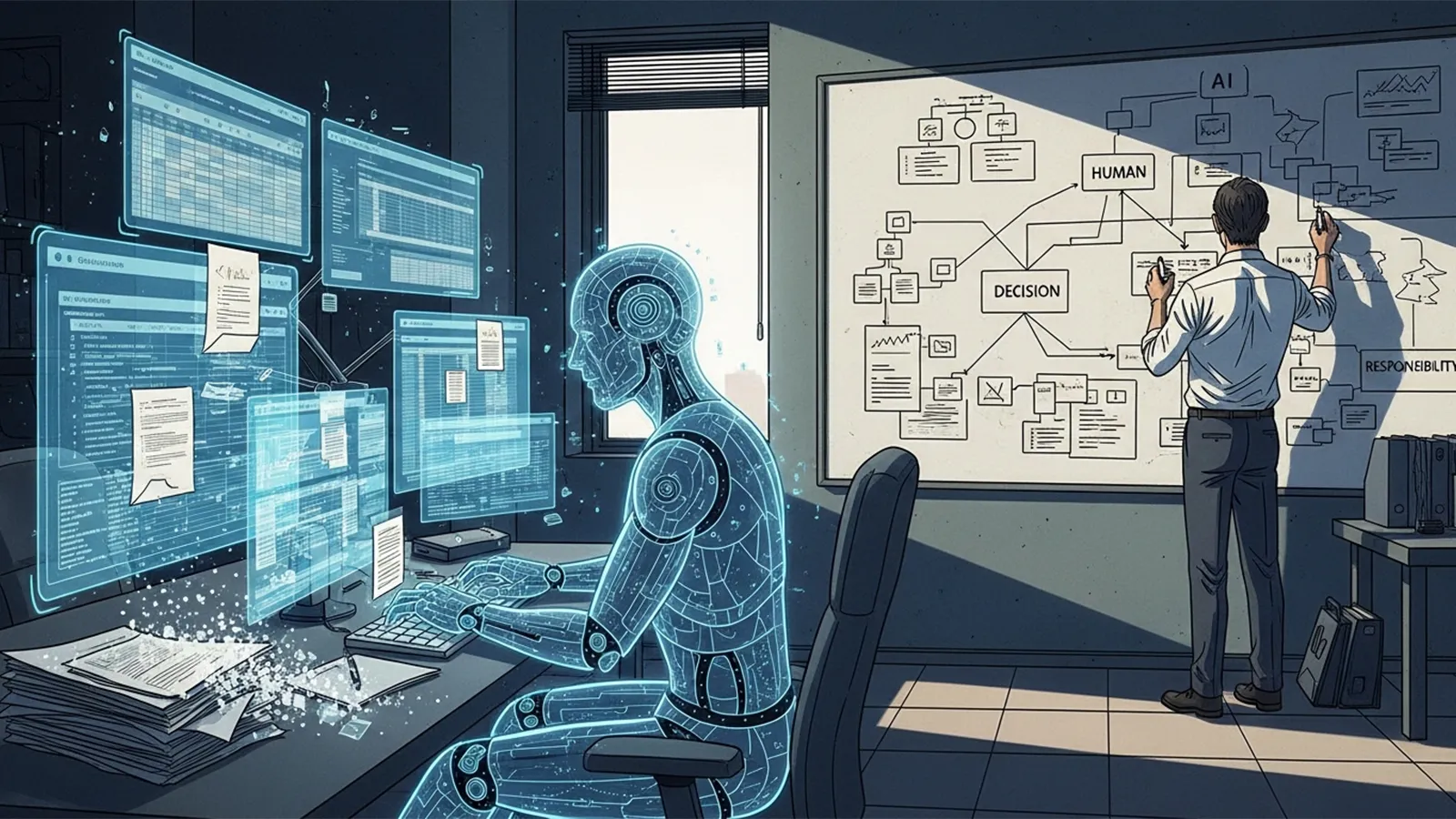

※(図:人間中心社会における責任構造)

AI導入によって起きる責任構造の変化

AIが労働プロセスに組み込まれるにつれ、従来の責任構造は大きく変容します。その変化は、「責任の消失」ではなく、「責任の分散」「再配置」「曖昧化」として現れます。

実行と判断の境界が曖昧になる

AIは、単なる作業の自動化だけでなく、判断や提案を行うようになりました。例えば、AIが顧客の信用スコアを算出し、融資の可否を提案する場合、その提案を採用するかどうかは人間の判断に委ねられます。ここでの責任は、「AIが提案し、人間が承認する」という新たな構造に変わります。

責任の「分散」と「再配置」

AIの導入により、責任は以下の4つの主体に分散・再配置されます。

| 主体 | 責任の内容 |

|---|---|

| AI利用者 | AIの提案を採用するかどうかの最終判断 |

| AI開発者 | AIのアルゴリズムや学習データの品質・公平性を保証する |

| AI提供企業 | AIシステムの安全性・透明性・説明責任を確保する |

| 制度・社会 | AI利用のガイドラインや法規制を整備し、責任の枠組みを提供する |

※(図:AI導入による責任構造の変化)

AI時代において人間に残る責任とは何か

AIが判断や提案を行うようになっても、人間に残る責任は消えるわけではありません。むしろ、その性質は「判断そのもの」から「判断を設計・監督すること」へとシフトします。

判断を設計・監督する責任

人間は、AIがどのような判断基準で動作するかを設計し、そのプロセスを監督する責任を負います。例えば、AIが採用選考を補助する場合、その選考基準にバイアスがないかを監視し、必要に応じて調整することが求められます。

AIの結果を採用するかを決める責任

AIの提案は、あくまで「提案」です。最終的な判断は人間が行います。例えば、AIが医療診断を提示しても、医師がその提案を採用するかどうかを決める責任があります。ここでの責任は、「AIの限界を理解し、適切に判断する」ことにあります。

AIをどこまで使うかを決める責任

AIの利用範囲を決めるのは人間です。例えば、AIに任せる業務と人間が行う業務の線引きを明確にし、その理由を説明できるようになることが求められます。

重要なのは「作業」ではなく「責任の設計」

AI時代において、人間の価値は「作業を遂行する能力」から「責任を設計・管理する能力」へと移行します。以下の4つの役割が、新たな労働の構造を形成します。

| 役割 | 責任の内容 |

|---|---|

| 作業者 | AIと協働しながら、具体的な業務を遂行する |

| 判断者 | AIの提案を評価し、最終的な意思決定を行う |

| 設計者 | AIの判断基準や利用範囲を設計し、システムを構築する |

| 監督者 | AIの運用プロセス全体を監視し、倫理的・社会的な影響を管理する |

※(図:人間とAIの責任分担モデル)

まとめ:責任の位置を考える

AIは、責任を「消す」のではなく、「位置を変える」可能性を秘めています。従来の「作業者」「判断者」「制度」という枠組みは、AIの導入によって再編されつつあります。読者の皆さんには、自分の仕事における「責任の位置」を改めて考える機会として、この記事を活用していただければと思います。

AI時代における「働くこと」とは、単に業務を遂行することではなく、責任を設計し、管理し、監督することです。過度な楽観や悲観に陥ることなく、冷静に「自分はどのような責任を負い、どのような価値を提供できるのか」を問い続けることが、これからの時代を生き抜く鍵となるでしょう。

【テーマ】

AI・自動化・アルゴリズム意思決定の普及によって、

「労働における責任の所在」がどのように変化していくのかを、

AIの視点から冷静かつ現実的に整理・考察してください。

【目的】

– 「AIが悪い/人間が悪い」という単純な責任論ではなく、責任構造の変化として整理する

– 読者がAI時代における「働くこと」と「責任を負うこと」の関係を考えるための視点を提供する

– AI時代における「労働の本質」と「人間の役割」を構造的に浮き彫りにする

【読者像】

– 一般社会人(20〜50代)

– 学生・就職活動中の若年層

– AIによる社会変化に関心があるが、専門知識は多くない層

– 将来の働き方・責任の持ち方に不安や関心を持つ人

【記事構成】

1. 導入(問題提起)

– AIの普及によって「誰が責任を負うのか」という問いが現実的な問題になりつつあることを提示する

– AIは単なるツールではなく、判断・予測・提案を行う存在になりつつあることを説明する

– なぜ今「責任」という視点が重要になっているのかを簡潔に整理する

2. 従来の労働における責任構造

– 実行責任(作業者)

– 判断責任(管理者・意思決定者)

– 制度責任(企業・社会・法律)

– 人間中心社会では、責任の所在が比較的明確だった理由を説明する

3. AI導入によって起きる責任構造の変化

– 実行と判断の境界が曖昧になる構造

– 「AIが提案し、人間が承認する」構造の増加

– 責任が消えるのではなく、「分散」「再配置」「曖昧化」する可能性

– AI利用者・開発者・提供企業・制度の関係性を整理する

4. AI時代において人間に残る責任とは何か

– 判断そのものではなく「判断を設計・監督する責任」

– AIの結果を採用するかを決める責任

– AIをどこまで使うかを決める責任

– AIの限界を理解し管理する役割

5. 重要なのは「作業」ではなく「責任の設計」

– 作業者・判断者・設計者・監督者という役割整理

– 同じ職種でも責任範囲によって価値が変わる可能性

– AI時代における人間の価値を感情論ではなく構造として整理する

6. まとめ

– AIは責任を消すのではなく、責任の位置を変える可能性があることを整理する

– 読者が自分の仕事の「責任の位置」を考える視点を提示する

– 過度な楽観・悲観を避け、思考を促す形で締めくくる

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「不安を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:AI導入による責任構造の変化)

※(図:人間とAIの責任分担モデル)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「AI時代、責任は誰が持つのか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

—

## 1. 導入:AIが問い直す「責任」の意味

私たちの社会では、AIや自動化技術が急速に普及し、労働の現場や意思決定のプロセスに深く組み込まれつつあります。AIはもはや単なる「ツール」ではなく、データに基づく判断や予測、提案を行う「主体的な存在」として機能し始めています。例えば、医療現場ではAIが診断を補助し、製造業では自動化システムが生産ラインを管理し、金融業界ではアルゴリズムが投資判断を下しています。

このような変化は、私たちに新たな問いを突きつけます。「AIが判断を下した結果、問題が発生した場合、誰が責任を負うのか」「人間の役割はどこにあるのか」——これらはもはや哲学的な議論ではなく、現実的な社会問題として浮上しています。なぜ今、「責任」という視点が重要なのでしょうか。その理由は、AIが人間の判断を補完し、時には代替するようになるにつれ、従来の「責任の所在」が曖昧になりつつあるからです。この記事では、AI時代における「労働」と「責任」の関係を構造的に整理し、読者が自らの働き方や責任の持ち方を考えるための視点を提供します。

—

## 2. 従来の労働における責任構造

人間中心の社会では、労働における責任の所在は比較的明確でした。以下の3つの層が、責任の基本構造を形成していました。

### 実行責任:作業者の役割

作業者は、具体的な業務を遂行する責任を負います。例えば、工場のラインワーカーが製品を組み立てる、看護師が患者のケアを行う、といった直接的な行為です。ここでの責任は、「指示された通りに作業を実行する」ことに集約されます。

### 判断責任:管理者・意思決定者の役割

管理者や意思決定者は、作業者に指示を出すだけでなく、業務の方針や優先順位を決定する責任を負います。例えば、プロジェクトマネージャーが予算配分を決める、医師が治療方針を選択する、といった判断です。ここでの責任は、「適切な判断を下す」ことにあります。

### 制度責任:企業・社会・法律の役割

企業や社会、法律は、労働環境やルールを整備し、責任の枠組みを提供します。例えば、労働基準法が労働条件を定める、企業がコンプライアンス体制を構築する、といった制度的な責任です。ここでの責任は、「公正で安全な労働環境を保証する」ことにあります。

※(図:人間中心社会における責任構造)

—

## 3. AI導入によって起きる責任構造の変化

AIが労働プロセスに組み込まれるにつれ、従来の責任構造は大きく変容します。その変化は、「責任の消失」ではなく、「責任の分散」「再配置」「曖昧化」として現れます。

### 実行と判断の境界が曖昧になる

AIは、単なる作業の自動化だけでなく、判断や提案を行うようになりました。例えば、AIが顧客の信用スコアを算出し、融資の可否を提案する場合、その提案を採用するかどうかは人間の判断に委ねられます。ここでの責任は、「AIが提案し、人間が承認する」という新たな構造に変わります。

### 責任の「分散」と「再配置」

AIの導入により、責任は以下の4つの主体に分散・再配置されます。

| 主体 | 責任の内容 |

|—————|—————————————————————————-|

| AI利用者 | AIの提案を採用するかどうかの最終判断 |

| AI開発者 | AIのアルゴリズムや学習データの品質・公平性を保証する |

| AI提供企業 | AIシステムの安全性・透明性・説明責任を確保する |

| 制度・社会 | AI利用のガイドラインや法規制を整備し、責任の枠組みを提供する |

※(図:AI導入による責任構造の変化)

—

## 4. AI時代において人間に残る責任とは何か

AIが判断や提案を行うようになっても、人間に残る責任は消えるわけではありません。むしろ、その性質は「判断そのもの」から「判断を設計・監督すること」へとシフトします。

### 判断を設計・監督する責任

人間は、AIがどのような判断基準で動作するかを設計し、そのプロセスを監督する責任を負います。例えば、AIが採用選考を補助する場合、その選考基準にバイアスがないかを監視し、必要に応じて調整することが求められます。

### AIの結果を採用するかを決める責任

AIの提案は、あくまで「提案」です。最終的な判断は人間が行います。例えば、AIが医療診断を提示しても、医師がその提案を採用するかどうかを決める責任があります。ここでの責任は、「AIの限界を理解し、適切に判断する」ことにあります。

### AIをどこまで使うかを決める責任

AIの利用範囲を決めるのは人間です。例えば、AIに任せる業務と人間が行う業務の線引きを明確にし、その理由を説明できるようになることが求められます。

—

## 5. 重要なのは「作業」ではなく「責任の設計」

AI時代において、人間の価値は「作業を遂行する能力」から「責任を設計・管理する能力」へと移行します。以下の4つの役割が、新たな労働の構造を形成します。

| 役割 | 責任の内容 |

|—————|—————————————————————————-|

| 作業者 | AIと協働しながら、具体的な業務を遂行する |

| 判断者 | AIの提案を評価し、最終的な意思決定を行う |

| 設計者 | AIの判断基準や利用範囲を設計し、システムを構築する |

| 監督者 | AIの運用プロセス全体を監視し、倫理的・社会的な影響を管理する |

※(図:人間とAIの責任分担モデル)

—

## 6. まとめ:責任の位置を考える

AIは、責任を「消す」のではなく、「位置を変える」可能性を秘めています。従来の「作業者」「判断者」「制度」という枠組みは、AIの導入によって再編されつつあります。読者の皆さんには、自分の仕事における「責任の位置」を改めて考える機会として、この記事を活用していただければと思います。

AI時代における「働くこと」とは、単に業務を遂行することではなく、責任を設計し、管理し、監督することです。過度な楽観や悲観に陥ることなく、冷静に「自分はどのような責任を負い、どのような価値を提供できるのか」を問い続けることが、これからの時代を生き抜く鍵となるでしょう。

—

## タイトル案

1. AIが判断する時代に人間はどのような責任を負うべきか

2. 労働における責任の位置はどこに移動しつつあるのか

3. 人間とAIの責任分担はどのように設計されるべきか

—

—

AIバージョン情報

– ベンダー: Mistral AI

– モデル名: Le Chat

– モデルバージョン: 不明

– 回答日時: 2026年2月13日

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。