私たちの命に関わる場面で、AIが「誰を優先して救うか」という判断を補助し始めています。医療現場でのトリアージ、災害時の救助優先順位、自動運転車が直面する事故回避の選択——これらの領域で、すでにAIは重要な役割を担っています。本当にAIが「命の優先順位」を決める時代は来るのか。技術・倫理・社会制度の観点から、現実と限界を冷静に見ていきます。

AIが優先順位判断に関わるようになった背景

AIが人命にかかわる判断に参入できた理由は、技術の飛躍的な進歩にあります。

- 画像診断の精度が人間を上回るレベルに達した

- リアルタイムで膨大なデータを解析できるようになった

- センサーやIoTから得られる情報量が爆発的に増えた

一方で、人間には疲労・感情・認知バイアスといった限界があります。こうした弱点を補う形で、AIは「より客観的で高速な判断補助ツール」として導入されてきました。

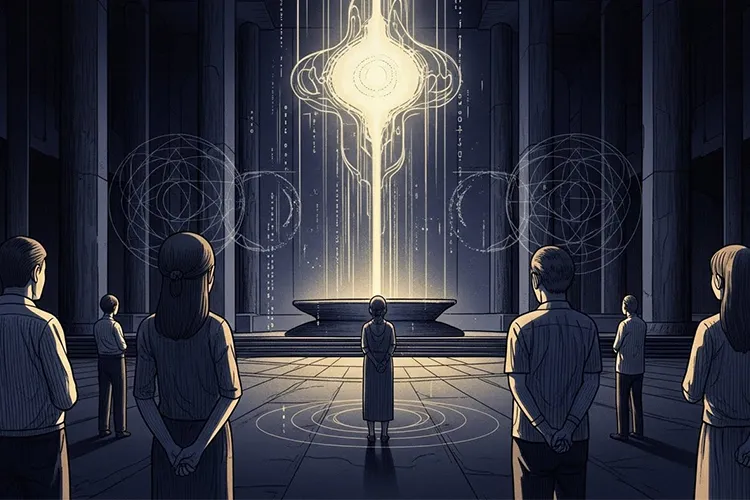

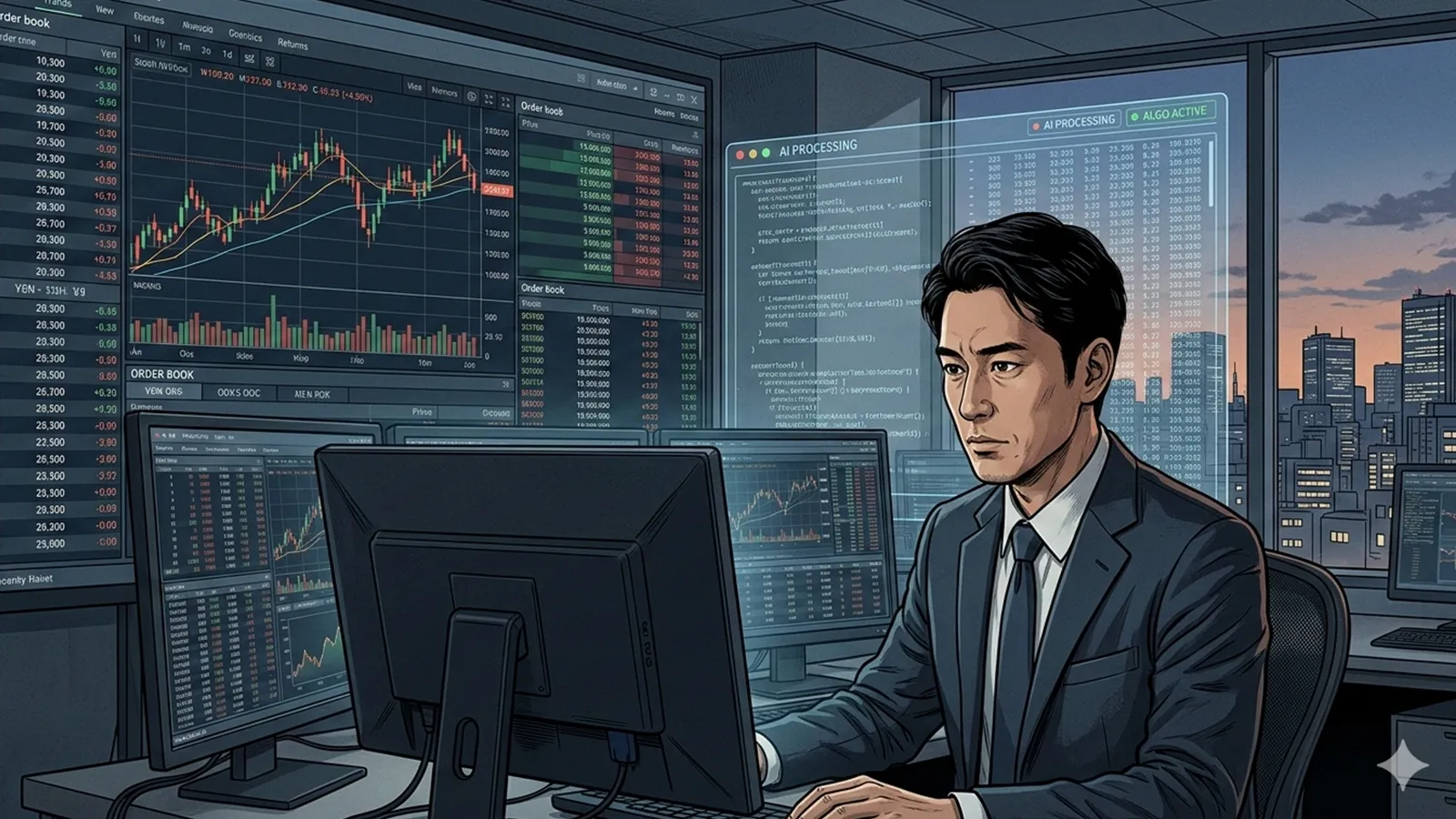

※(図:AIが優先順位判断を補助する仕組み ― データ入力→解析→優先度スコア算出→人間への提示フロー)

AIが得意とする領域と苦手とする領域

得意なこと

- 重症度や生存確率の統計的推定

- リスクの数値化とリアルタイム計算

- 最適ルートの探索・資源配分のシミュレーション

- 「人間の尊厳」や「人生の価値」といった価値判断

- 文化・宗教・個別事情を踏まえた倫理的配慮

- 説明できない「直感」や「現場の空気」の読み取り

つまり、AIは「統計的判断」は得意でも「価値判断」はできない——この違いが最も重要な境界線です。

AIに命を委ねるリスクと限界

- 誤判定の致命性:一度のミスが取り返しのつかない結果になる

- データバイアス:学習データに偏りがあると、特定の属性(人種・性別・年齢など)で不利な判断が出る

- ブラックボックス問題:なぜその結論に至ったのか説明できない場合、責任の所在が曖昧になる

- 法制度の遅れ:現行法では「AIが下した判断」の責任主体が明確でない

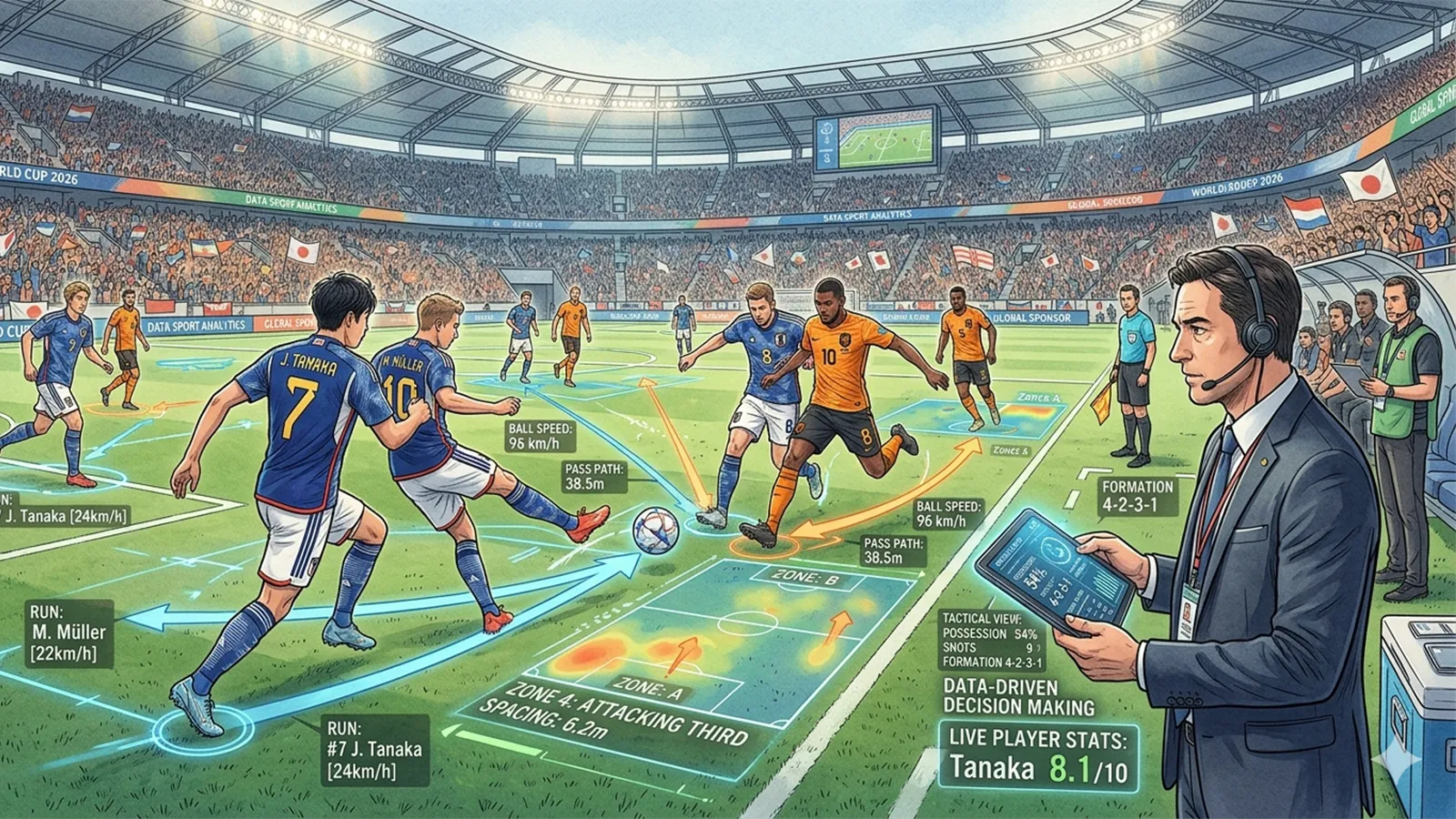

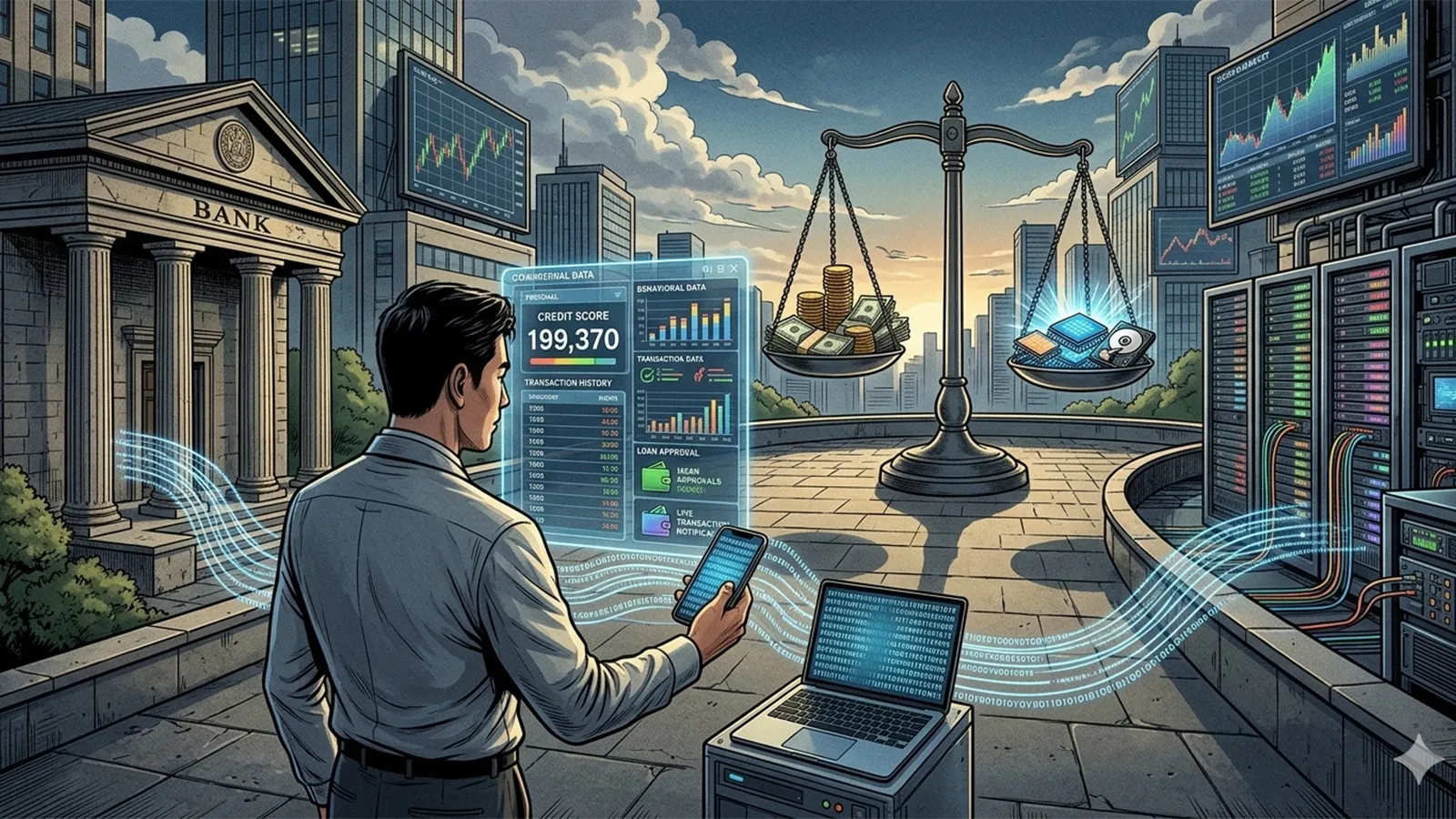

※(図:リスク要因とガバナンス構造)

現実的に訪れる未来シナリオ

完全にAIが最終決定する世界はまだ遠いでしょう。現実的な未来像は以下の「協働モデル」です。

- AIがリスク評価・優先順位案を提示

- 医師・救助隊員・運転者などが最終判断

- 人間が「拒否権(human override)」を常に持つ

すでに米国では災害時の資源配分にAIが活用され、日本でもがん画像診断支援や感染症予測にAIが導入されています。いずれも「人間が最終責任を持つ」形です。

社会が直面する課題

- 法整備(誰が責任を負うのか)

- 倫理ガイドラインの策定

- 透明性・説明可能性の確保

- 過度なAI依存による人間の判断力低下

- 導入コストと人材育成

まとめ

AIが「命の優先順位を完全に決める」時代は、技術的にも倫理的にも法的にもまだ遠い未来です。しかし、「より正確な判断材料を高速で提示する」役割はすでに現実のものとなっています。

大切なのは、AIを万能の神ではなく「優秀な補助者」として位置づけ、技術と人間の倫理を両立させる仕組みを作ること。私たちは今、その分岐点に立っています。

【テーマ】

“命の優先順位”をAIが決める時代は本当に来るのか。

医療・災害・自動運転など、人命に直結する領域でAIが意思決定を担う未来を、

技術・倫理・社会制度の観点から総合的に分析してください。

【目的】

– AIが人命判断に関わる際の“現実と限界”を、一般読者にもわかりやすく整理する。

– 技術的可能性だけでなく、倫理・法律・社会的受容性をバランスよく伝える。

– 読者に「AIはどこまで任せられるのか?」という思考のきっかけを与える。

【読者像】

– 一般社会人、学生、行政関係者

– AIが医療や自動運転に使われていることは知っているが、詳しくは知らない層

– 事故現場や災害時の“優先順位判断”に興味がある人

– 技術と倫理の関係に関心がある読者

【記事構成】

1. **導入(問題提起)**

– 「命の優先順位」を決める判断が、すでに一部AIで補助されている現状

– 医療トリアージ・災害救助・自動運転の意思決定などの例を簡潔に提示する

2. **AIが“優先順位判断”に関わるようになった背景**

– 画像診断の精度向上、リアルタイム解析、膨大なデータ処理能力

– 人間判断の限界(疲労・主観・情報量の多さ)

– 技術進歩で“判断の補助”が現実的になった理由

※(図:AIが優先順位判断を補助する仕組み)

3. **AIが得意な領域・不得意な領域**

– **得意**:重症度推定、リスク計算、最適ルート分析、リアルタイム処理

– **不得意**:価値観の判断、倫理基準の設定、文化的背景の理解、人間の尊厳に関する判断

– 統計的判断と“価値判断”の違いを解説する

4. **AIが命の優先順位を決めるリスク・限界**

– 誤判定が取り返しのつかない結果になる問題

– データバイアス(学習データに偏りがあると特定の集団に不利)

– 透明性・説明責任(AIの“理由”が説明できない場合の問題)

– 法制度と社会的合意が追いつかない現状

※(図:リスク要因とガバナンス構造)

5. **現実的に起こりうる未来シナリオ**

– AIが“最終決定”ではなく“判断材料の提示”を担う未来

– 医師・救助隊・運転者などが最終判断を行う“協働モデル”

– 完全自動化ではなく、人間とAIの役割分担が主流になる予測

– 海外事例や国内の取り組み(実在・仮想どちらでも可)

6. **社会への影響と導入の課題**

– 法整備、倫理ガイドライン、説明責任、透明性

– AIへの過度な依存のリスク

– 組織や自治体が導入する際のハードル(費用・人材・運用体制)

7. **まとめ**

– AIが「命の優先順位を完全に決める」未来は遠い

– しかし「判断の補助として優先順位を提示する」未来はすでに始まっている

– 技術と倫理を両立させる社会的取り組みの重要性を強調して締めくくる

【文体・トーン】

– です・ます調

– 客観的で冷静、専門用語には必ず一文で補足説明を付与

– 読みやすいが、内容的には深く掘り下げる

【出力形式】

– Markdown形式

– 小見出し(###)を多めに使用

– 文字数は2000〜2500字を目安

– 記事末尾に「タイトル案」を3つ提示する

【補足指示】

– “AIモデルの判断フロー”や“リスク構造”など、図解が有効な箇所には

※(図:AI判断プロセスのイメージ)

のようにコメントを追加してよい。

【バージョン情報の出力】

記事本文とタイトル案のあとに、必ず以下の形式で「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

**AIバージョン情報**

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

—

【参考タイトル】

「AIは“命の優先順位”を決められるのか ― 技術・倫理・社会から考える未来の意思決定」

### 導入:命の優先順位をめぐるAIの役割

私たちの日常生活では、AIがさまざまな判断を補助するようになりました。特に、人命にかかわる領域で「命の優先順位」を決める場面が増えています。例えば、医療現場でのトリアージ(患者の重症度を評価し、治療の優先順位を決めるプロセス)では、AIが患者の症状を分析して医師の判断を支援しています。実際、緊急部門でのAI駆動トリアージは、患者の優先順位付けを改善し、待ち時間を短縮する効果が報告されています。 また、災害救助では、AIが被災者の位置を特定し、救助の優先順位を提案します。 さらに、自動運転車では、事故回避時の選択が倫理的なジレンマを生む可能性があります。 これらの例から、AIが人命判断に関わる時代がすでに始まっていることがわかります。本記事では、そんな未来を技術・倫理・社会制度の観点から分析し、AIにどこまで任せられるのかを考えます。

### AIが優先順位判断に関わる背景:技術進歩の恩恵

AIが人命の優先順位判断に携わるようになった背景には、技術の急速な進化があります。まず、画像診断の精度向上です。AIはCTやMRIなどの医療画像を高速に解析し、重症度の推定を可能にします。 次に、リアルタイム解析能力です。災害時、AIは衛星画像やセンサーデータを即座に処理し、被害の程度を評価します。 また、膨大なデータ処理能力により、人間では扱いきれない量の情報を統合できます。

人間判断の限界もAI導入を後押ししています。人間は疲労や主観が入りやすく、情報過多の状況でミスを犯しやすいのです。一方、AIはこれらの弱点を補い、客観的な判断補助を提供します。例えば、緊急医療ではAIが患者の到着を予測し、資源配分を最適化します。 このように、機械学習(AIがデータからパターンを学習する技術)の進歩で、判断の補助が現実的になりました。

※(図:AIが優先順位判断を補助する仕組み ― データ入力から出力までのフロー)

### AIの得意領域:データ駆動型の判断

AIは特定の領域で優れた性能を発揮します。まず、重症度推定です。医療トリアージでは、AIがバイタルサイン(脈拍や血圧などの生命徴候)を分析し、患者のリスクを計算します。 次に、リスク計算です。自動運転では、衝突確率をリアルタイムで評価し、最適な回避行動を提案します。 また、最適ルート分析では、災害救助でAIが交通状況や被害地を考慮した経路を導きます。 さらに、リアルタイム処理能力が高く、膨大なデータを瞬時に扱えます。

これらの得意領域は、統計的判断に基づきます。つまり、過去のデータから確率を算出する点で強みを発揮するのです。

### AIの不得意領域:価値観の壁

一方、AIは価値観の判断が苦手です。例えば、誰を優先的に救うかといった倫理基準の設定は、人間の文化的・社会的文脈を理解する必要があります。AIはデータバイアス(学習データに偏りがあること)により、特定の集団を不利に扱うリスクがあります。 また、人間の尊厳に関する判断、例えば終末期医療での選択は、統計だけでは決められません。

ここで重要なのは、統計的判断と価値判断の違いです。統計的判断は「確率が高い」ことを基にしますが、価値判断は「何が正しいか」を問うものです。AIは前者を扱えても、後者は人間の領域です。

### リスクと限界:誤判定の深刻さ

AIが命の優先順位を決めるリスクは大きいです。まず、誤判定の問題です。AIの予測が外れれば、取り返しのつかない結果を生みます。例えば、緊急トリアージでAIが重症を見逃せば、患者の命が危うくなります。 次に、データバイアスです。学習データに人種や性別の偏りがあると、特定の集団に不利な判断が出ます。

透明性・説明責任も課題です。AIの「ブラックボックス」(内部ロジックが不明瞭な状態)では、なぜその判断に至ったかを説明できません。これにより、信頼性が損なわれます。 さらに、法制度と社会的合意が追いついていません。誰が責任を取るのか、明確でないのです。

※(図:リスク要因とガバナンス構造 ― バイアス、透明性、法制度の関係図)

### 未来シナリオ:協働モデルの台頭

現実的に、AIが「最終決定」を担う未来は遠いです。むしろ、判断材料の提示に留まる協働モデルが主流になると予測されます。例えば、医療ではAIがリスクを提示し、医師が最終判断します。 災害では、AIが救助優先順位を提案し、救助隊が現場状況を加味します。

海外事例として、米国ではAIが災害時の資源配分を最適化しています。 日本では、AIを活用したがん検知ツールやインフルエンザ診断システムが導入され、医師の判断を補助しています。 また、災害対策ではAIが極端な天候予測を向上させ、警報システムに活用されています。 これらの取り組みから、人間とAIの役割分担が鍵です。

### 社会への影響:法整備の必要性

AI導入は社会に大きな影響を与えます。まず、法整備です。AIの判断基準を定めるガイドラインが必要です。 倫理ガイドラインでは、公正性とプライバシーを確保します。 また、説明責任と透明性を高めることが重要です。

過度な依存のリスクもあります。AIに頼りすぎると、人間の判断力が衰える恐れがあります。導入課題として、費用や人材育成、運用体制の整備が挙げられます。特に、自治体では予算不足がハードルです。日本では、医療AIの教育システムを整備する動きがあります。

### まとめ:技術と倫理のバランスを求めて

AIが「命の優先順位を完全に決める」未来は、まだ遠いと言えます。技術的限界と倫理的課題がそれを阻むからです。しかし、「判断の補助として優先順位を提示する」未来はすでに始まっています。医療や災害、自動運転でAIの役割は拡大中です。重要なのは、技術と倫理を両立させる社会的取り組みです。読者の皆さんは、AIにどこまで任せられるかを考えてみてください。私たちは、AIを道具として賢く活用する社会を築く必要があります。

(本文文字数:約2350字)

### タイトル案

1. AIは“命の優先順位”を決められるのか ― 技術・倫理・社会から考える未来の意思決定

2. AIが命の順番を決める日 ― 医療・災害・自動運転の現実と限界

3. 「AIに命を託す?」 ― 人命判断におけるAIの役割と私たちが考えるべきこと

—

**AIバージョン情報**

– ベンダー: xAI

– モデル名: Grok 4

– モデルバージョン: 不明

– 回答日時: December 08, 2025

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。