「誰の命を優先するか」という判断は、医療現場や災害救助、自動運転車の緊急回避などで日常的に直面する課題です。近年、AI(人工知能)がその判断を補助する事例が増えています。例えば、医療現場ではAIによる画像診断がトリアージ(患者の重症度に応じて治療の優先順位を決めること)を支援し、災害現場ではドローンとAI解析による被災者発見が進められています。自動運転車では、衝突回避のアルゴリズムが「どちらの進路を選ぶか」という瞬間的な意思決定を担います。こうした現状を踏まえ、「命の優先順位をAIが決める時代」は本当に来るのかを考える必要があります。

AIが“優先順位判断”に関わるようになった背景

- 技術的進歩

AIは画像診断やセンサー解析において、人間を凌駕する精度を示しています。膨大なデータをリアルタイムで処理できるため、災害現場や救急医療での即時判断に活用されています。 - 人間判断の限界

医師や救助隊員は疲労やストレスの影響を受けやすく、また大量の情報を瞬時に処理することは困難です。AIはその補完役として期待されています。 - 現実的な導入理由

技術の成熟により、AIは「判断の補助」として現場に組み込まれるようになりました。

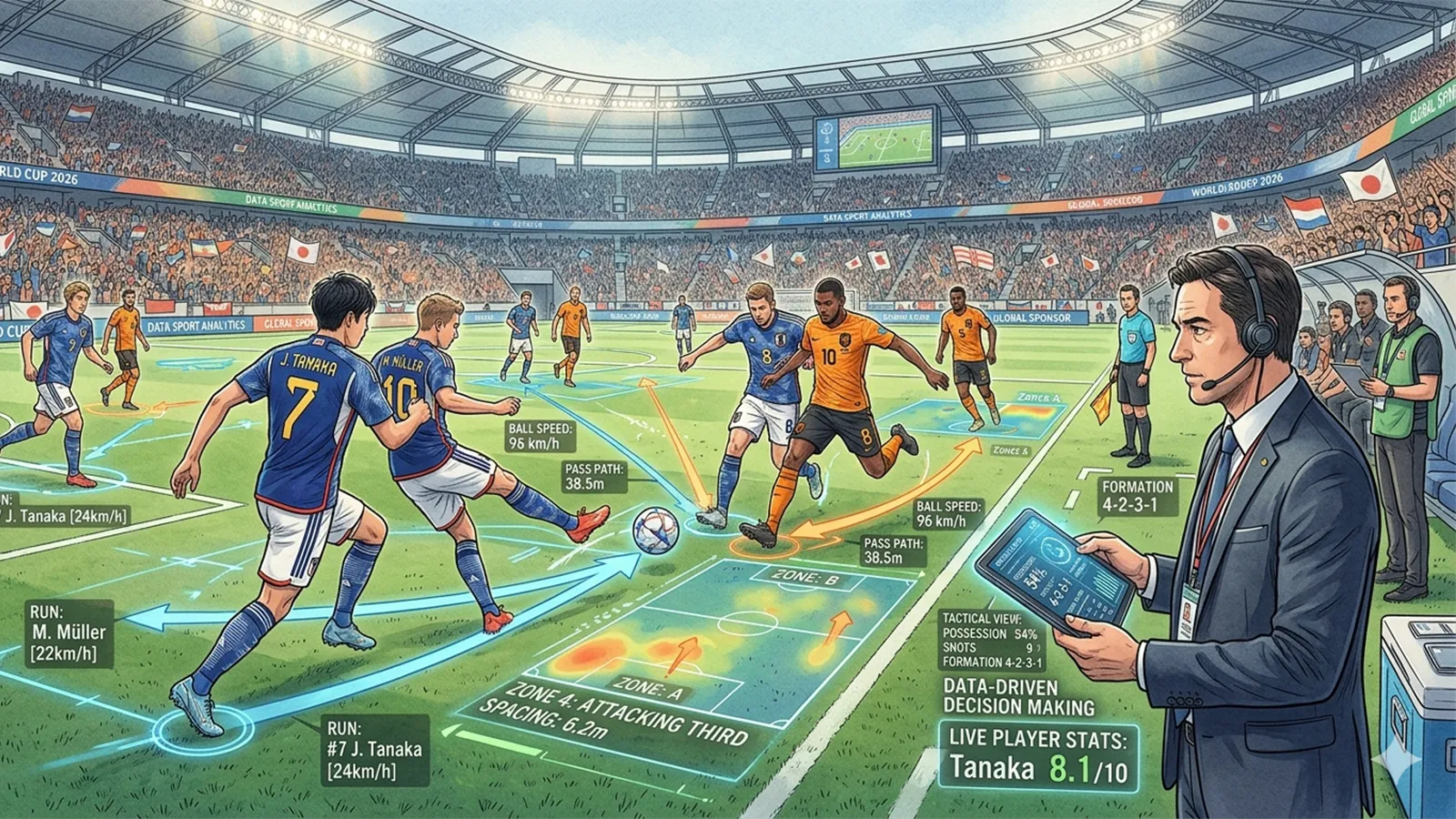

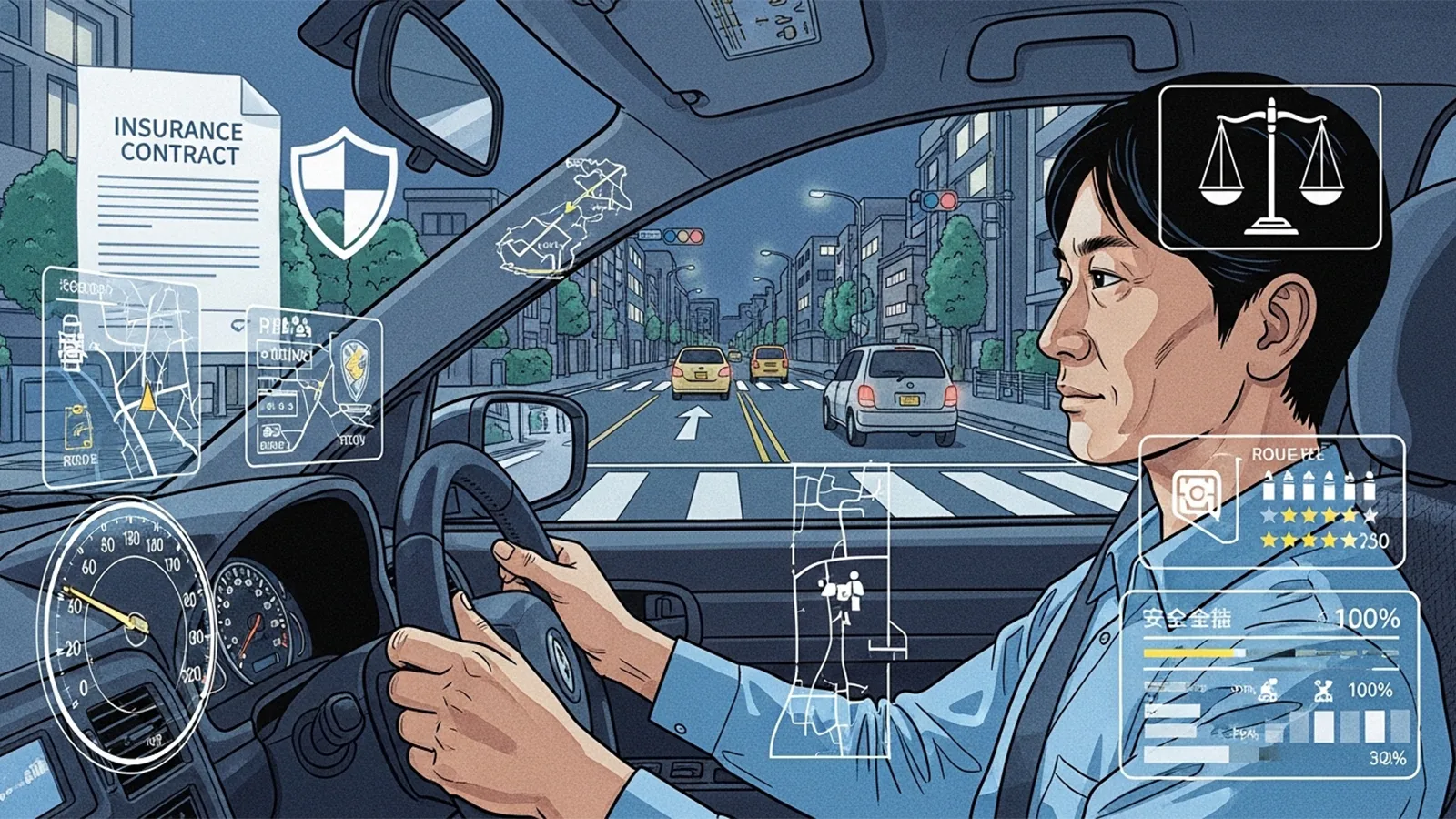

※(図:AIが優先順位判断を補助する仕組み)

AIが得意な領域・不得意な領域

得意な領域

- 重症度推定(画像診断やバイタルデータ解析)

- リスク計算(事故発生確率や治療成功率の推定)

- 最適ルート分析(災害時の救助ルート選定)

- リアルタイム処理(瞬間的な意思決定)

不得意な領域

- 価値観の判断(「誰を優先すべきか」という倫理的選択)

- 倫理基準の設定(社会的合意が必要)

- 文化的背景の理解(地域や宗教による価値観の違い)

- 人間の尊厳に関する判断(統計では測れない人間性の要素)

ここで重要なのは、AIが行うのは「統計的判断」であり、「価値判断」ではないという点です。統計的判断とは、データに基づき最も確率的に合理的な選択を導くこと。一方、価値判断は社会や倫理に基づく選択であり、AI単独では担えません。

AIが命の優先順位を決めるリスク・限界

- 誤判定のリスク

AIの誤診や誤検知は、命に直結する重大な結果を招きます。 - データバイアス

学習データに偏りがある場合、特定の人種や属性が不利になる可能性があります。 - 透明性・説明責任

AIが「なぜその判断をしたのか」を説明できない場合、社会的信頼を損ないます。 - 法制度の遅れ

技術の進歩に比べ、法制度や倫理ガイドラインの整備は追いついていません。

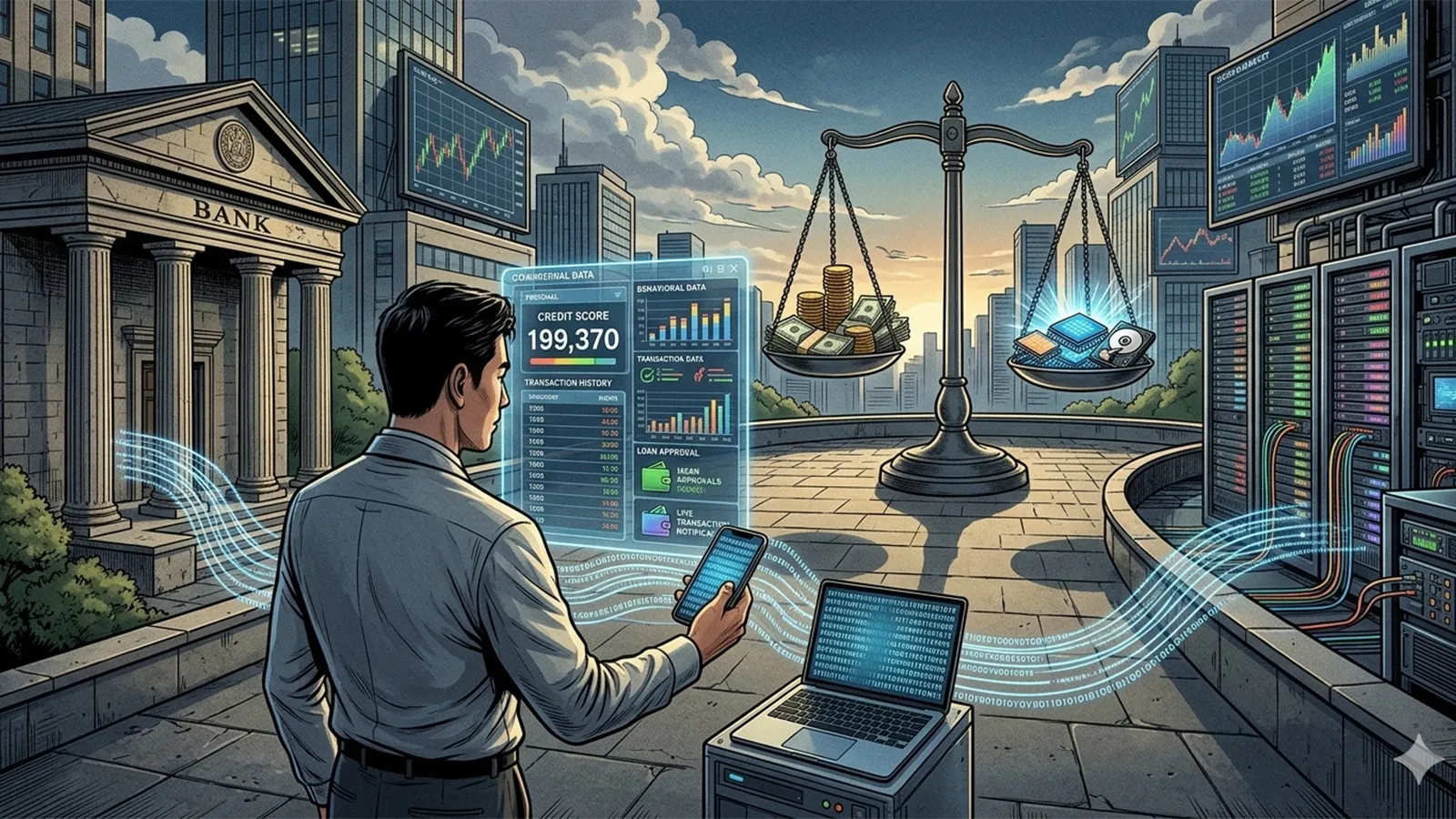

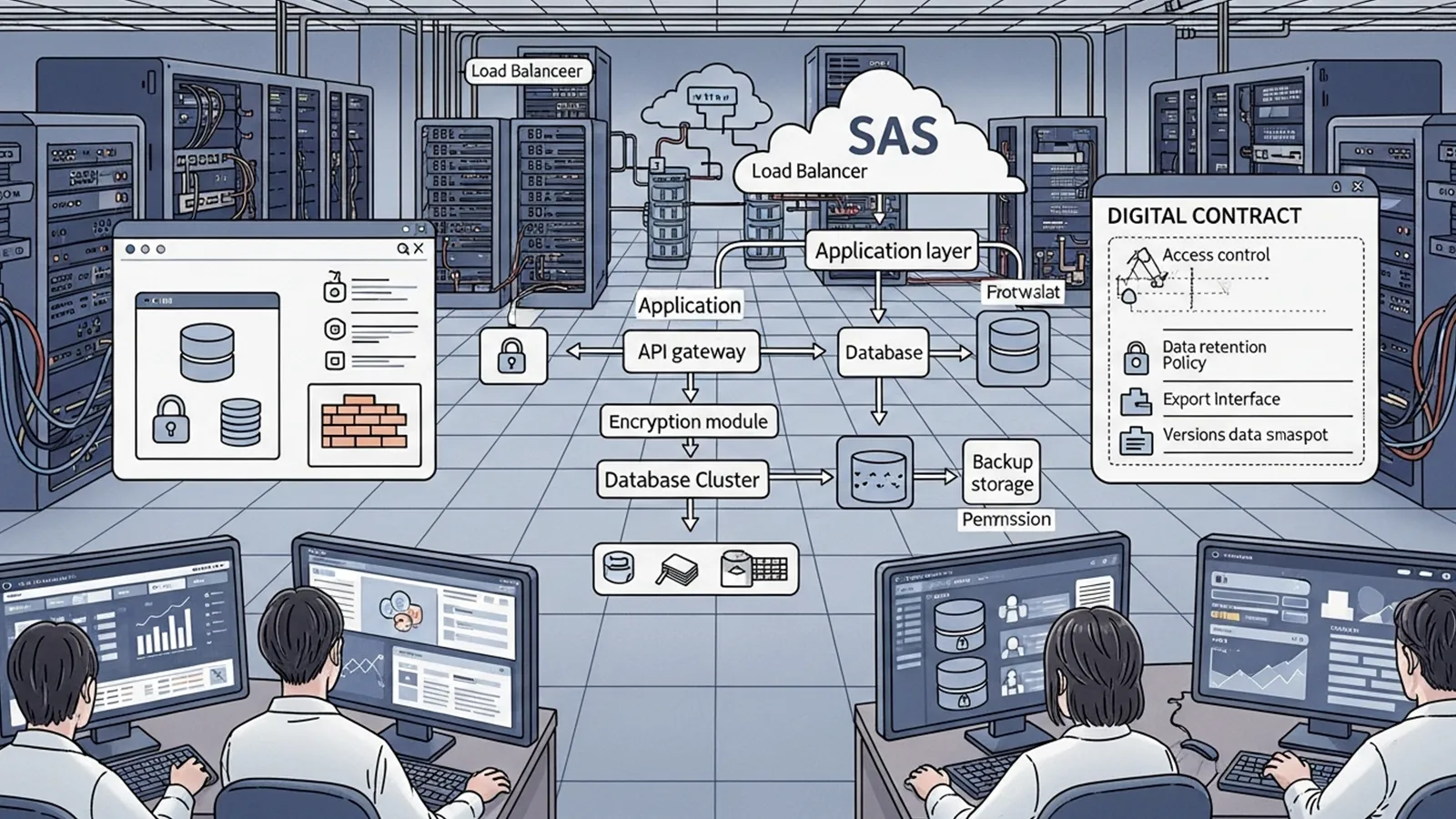

※(図:リスク要因とガバナンス構造)

現実的に起こりうる未来シナリオ

- 判断材料の提示型

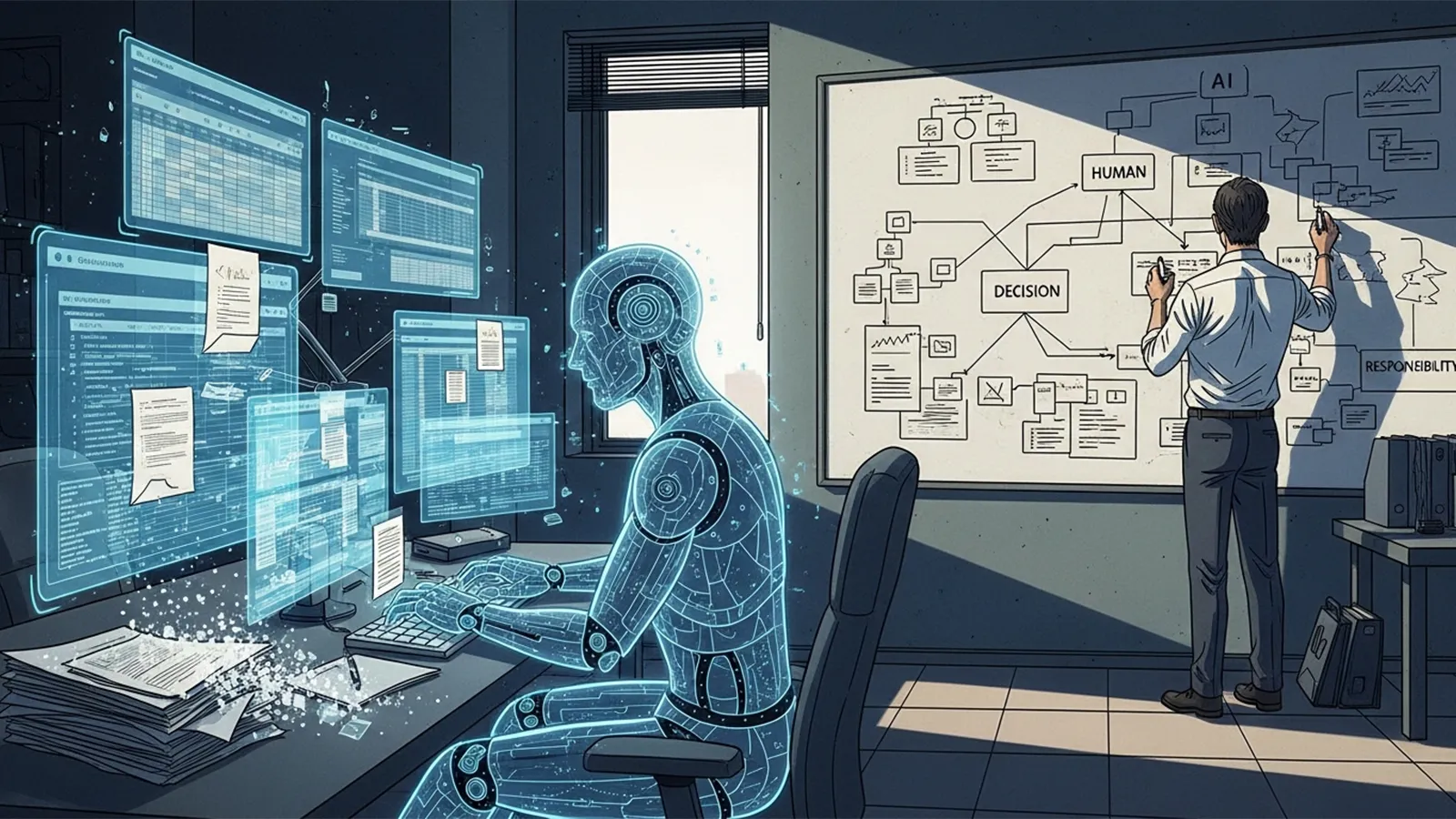

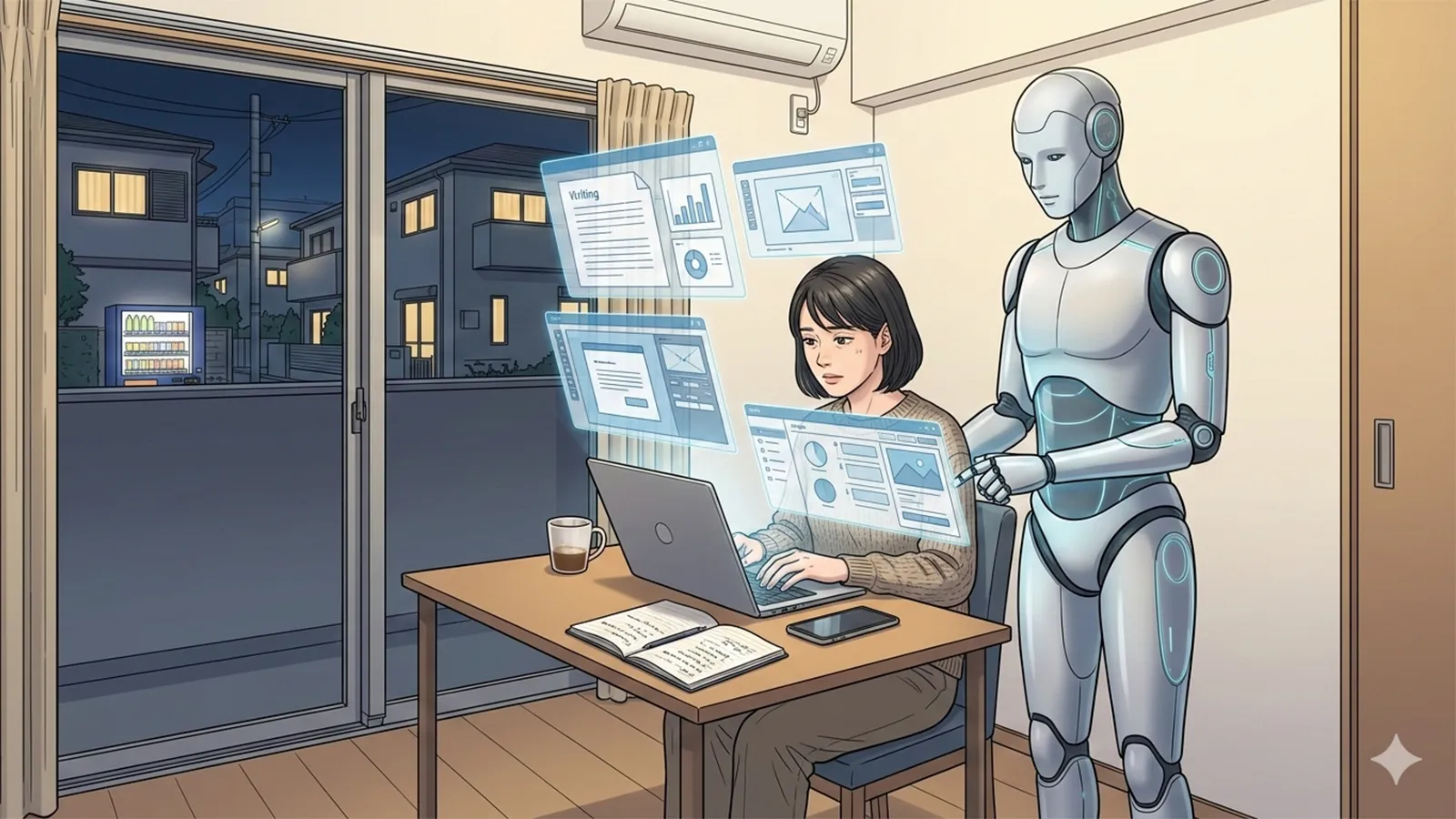

AIは「最終決定」ではなく「判断材料の提示」を担う可能性が高いです。 - 協働モデル

医師や救助隊員、運転者が最終判断を行い、AIは補助的役割を果たす形が主流になるでしょう。 - 完全自動化の制約

技術的には可能でも、倫理的・社会的受容性の観点から完全自動化は難しいと考えられます。 - 事例

海外では自動運転車の「緊急回避アルゴリズム」に関する議論が進み、国内でも災害時のAI活用が研究されています。

社会への影響と導入の課題

- 法整備と倫理ガイドライン

AIが人命に関わる判断を行う場合、透明性と説明責任を確保する制度が不可欠です。 - 過度な依存のリスク

AIに頼りすぎると、人間の判断力が低下する可能性があります。 - 導入のハードル

費用、人材育成、運用体制の整備が課題となります。特に地方自治体や小規模組織では負担が大きいでしょう。

まとめ

AIが「命の優先順位を完全に決める」未来はまだ遠いです。しかし「判断の補助として優先順位を提示する」未来はすでに始まっています。技術の進歩と倫理的課題の両立を目指す社会的取り組みが不可欠です。AIを人間の意思決定の代替ではなく、協働のパートナーとして位置づけることが、現実的で持続可能な未来につながるでしょう。

【テーマ】

“命の優先順位”をAIが決める時代は本当に来るのか。

医療・災害・自動運転など、人命に直結する領域でAIが意思決定を担う未来を、

技術・倫理・社会制度の観点から総合的に分析してください。

【目的】

– AIが人命判断に関わる際の“現実と限界”を、一般読者にもわかりやすく整理する。

– 技術的可能性だけでなく、倫理・法律・社会的受容性をバランスよく伝える。

– 読者に「AIはどこまで任せられるのか?」という思考のきっかけを与える。

【読者像】

– 一般社会人、学生、行政関係者

– AIが医療や自動運転に使われていることは知っているが、詳しくは知らない層

– 事故現場や災害時の“優先順位判断”に興味がある人

– 技術と倫理の関係に関心がある読者

【記事構成】

1. **導入(問題提起)**

– 「命の優先順位」を決める判断が、すでに一部AIで補助されている現状

– 医療トリアージ・災害救助・自動運転の意思決定などの例を簡潔に提示する

2. **AIが“優先順位判断”に関わるようになった背景**

– 画像診断の精度向上、リアルタイム解析、膨大なデータ処理能力

– 人間判断の限界(疲労・主観・情報量の多さ)

– 技術進歩で“判断の補助”が現実的になった理由

※(図:AIが優先順位判断を補助する仕組み)

3. **AIが得意な領域・不得意な領域**

– **得意**:重症度推定、リスク計算、最適ルート分析、リアルタイム処理

– **不得意**:価値観の判断、倫理基準の設定、文化的背景の理解、人間の尊厳に関する判断

– 統計的判断と“価値判断”の違いを解説する

4. **AIが命の優先順位を決めるリスク・限界**

– 誤判定が取り返しのつかない結果になる問題

– データバイアス(学習データに偏りがあると特定の集団に不利)

– 透明性・説明責任(AIの“理由”が説明できない場合の問題)

– 法制度と社会的合意が追いつかない現状

※(図:リスク要因とガバナンス構造)

5. **現実的に起こりうる未来シナリオ**

– AIが“最終決定”ではなく“判断材料の提示”を担う未来

– 医師・救助隊・運転者などが最終判断を行う“協働モデル”

– 完全自動化ではなく、人間とAIの役割分担が主流になる予測

– 海外事例や国内の取り組み(実在・仮想どちらでも可)

6. **社会への影響と導入の課題**

– 法整備、倫理ガイドライン、説明責任、透明性

– AIへの過度な依存のリスク

– 組織や自治体が導入する際のハードル(費用・人材・運用体制)

7. **まとめ**

– AIが「命の優先順位を完全に決める」未来は遠い

– しかし「判断の補助として優先順位を提示する」未来はすでに始まっている

– 技術と倫理を両立させる社会的取り組みの重要性を強調して締めくくる

【文体・トーン】

– です・ます調

– 客観的で冷静、専門用語には必ず一文で補足説明を付与

– 読みやすいが、内容的には深く掘り下げる

【出力形式】

– Markdown形式

– 小見出し(###)を多めに使用

– 文字数は2000〜2500字を目安

– 記事末尾に「タイトル案」を3つ提示する

【補足指示】

– “AIモデルの判断フロー”や“リスク構造”など、図解が有効な箇所には

※(図:AI判断プロセスのイメージ)

のようにコメントを追加してよい。

【バージョン情報の出力】

記事本文とタイトル案のあとに、必ず以下の形式で「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

**AIバージョン情報**

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

—

【参考タイトル】

「AIは“命の優先順位”を決められるのか ― 技術・倫理・社会から考える未来の意思決定」

### 導入(問題提起)

「誰の命を優先するか」という判断は、医療現場や災害救助、自動運転車の緊急回避などで日常的に直面する課題です。近年、AI(人工知能)がその判断を補助する事例が増えています。例えば、医療現場ではAIによる画像診断がトリアージ(患者の重症度に応じて治療の優先順位を決めること)を支援し、災害現場ではドローンとAI解析による被災者発見が進められています。自動運転車では、衝突回避のアルゴリズムが「どちらの進路を選ぶか」という瞬間的な意思決定を担います。

こうした現状を踏まえ、「命の優先順位をAIが決める時代」は本当に来るのかを考える必要があります。

—

### AIが“優先順位判断”に関わるようになった背景

– **技術的進歩**

AIは画像診断やセンサー解析において、人間を凌駕する精度を示しています。膨大なデータをリアルタイムで処理できるため、災害現場や救急医療での即時判断に活用されています。

– **人間判断の限界**

医師や救助隊員は疲労やストレスの影響を受けやすく、また大量の情報を瞬時に処理することは困難です。AIはその補完役として期待されています。

– **現実的な導入理由**

技術の成熟により、AIは「判断の補助」として現場に組み込まれるようになりました。

※(図:AIが優先順位判断を補助する仕組み)

—

### AIが得意な領域・不得意な領域

– **得意な領域**

– 重症度推定(画像診断やバイタルデータ解析)

– リスク計算(事故発生確率や治療成功率の推定)

– 最適ルート分析(災害時の救助ルート選定)

– リアルタイム処理(瞬間的な意思決定)

– **不得意な領域**

– 価値観の判断(「誰を優先すべきか」という倫理的選択)

– 倫理基準の設定(社会的合意が必要)

– 文化的背景の理解(地域や宗教による価値観の違い)

– 人間の尊厳に関する判断(統計では測れない人間性の要素)

ここで重要なのは、AIが行うのは「統計的判断」であり、「価値判断」ではないという点です。統計的判断とは、データに基づき最も確率的に合理的な選択を導くこと。一方、価値判断は社会や倫理に基づく選択であり、AI単独では担えません。

—

### AIが命の優先順位を決めるリスク・限界

– **誤判定のリスク**

AIの誤診や誤検知は、命に直結する重大な結果を招きます。

– **データバイアス**

学習データに偏りがある場合、特定の人種や属性が不利になる可能性があります。

– **透明性・説明責任**

AIが「なぜその判断をしたのか」を説明できない場合、社会的信頼を損ないます。

– **法制度の遅れ**

技術の進歩に比べ、法制度や倫理ガイドラインの整備は追いついていません。

※(図:リスク要因とガバナンス構造)

—

### 現実的に起こりうる未来シナリオ

– **判断材料の提示型**

AIは「最終決定」ではなく「判断材料の提示」を担う可能性が高いです。

– **協働モデル**

医師や救助隊員、運転者が最終判断を行い、AIは補助的役割を果たす形が主流になるでしょう。

– **完全自動化の制約**

技術的には可能でも、倫理的・社会的受容性の観点から完全自動化は難しいと考えられます。

– **事例**

海外では自動運転車の「緊急回避アルゴリズム」に関する議論が進み、国内でも災害時のAI活用が研究されています。

—

### 社会への影響と導入の課題

– **法整備と倫理ガイドライン**

AIが人命に関わる判断を行う場合、透明性と説明責任を確保する制度が不可欠です。

– **過度な依存のリスク**

AIに頼りすぎると、人間の判断力が低下する可能性があります。

– **導入のハードル**

費用、人材育成、運用体制の整備が課題となります。特に地方自治体や小規模組織では負担が大きいでしょう。

—

### まとめ

AIが「命の優先順位を完全に決める」未来はまだ遠いです。しかし「判断の補助として優先順位を提示する」未来はすでに始まっています。技術の進歩と倫理的課題の両立を目指す社会的取り組みが不可欠です。AIを人間の意思決定の代替ではなく、協働のパートナーとして位置づけることが、現実的で持続可能な未来につながるでしょう。

—

## タイトル案

1. 「AIは命の優先順位を決められるのか ― 技術・倫理・社会から考える未来」

2. 「人命判断をAIに委ねる時代は来るのか ― 医療・災害・自動運転の現実と限界」

3. 「AIと人間が協働する“命の選択” ― 技術と倫理の交差点から未来を読む」

—

**AIバージョン情報**

– ベンダー: Microsoft

– モデル名: Copilot

– モデルバージョン: 不明

– 回答日時: 2025-12-08 11:47 JST

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。