近年、企業の不祥事やコンプライアンス違反が報道される際、「システムの不備」や「監視の自動化不足」という言葉が頻繁に登場します。なぜ、人間の判断や行動が「システムの問題」として語られるようになったのでしょうか。背景には、AIや自動化ツールが「守る仕組み」として組織に導入される流れがあります。規制の複雑化、業務の高速化、グローバル化が進む中、人間の記憶や判断だけでは対応しきれない領域が増え、コンプライアンスの自動化が「必然」として受け入れられてきました。しかし、このテーマは単なる「技術の問題」ではありません。自動化が進むことで、組織内の責任構造や意思決定のプロセスが変化し、人間とシステムの役割分担が再定義されつつあるからです。ここでは、コンプライアンス自動化が「組織の判断を支援する仕組み」なのか、それとも「責任や義務を外部化する装置」なのか、AIの視点から構造的に整理し、読者が自動化と人間の役割分担について考えるための視点を提供します。

「支援」としてのコンプライアンス自動化の構造

人間の限界を補う仕組み

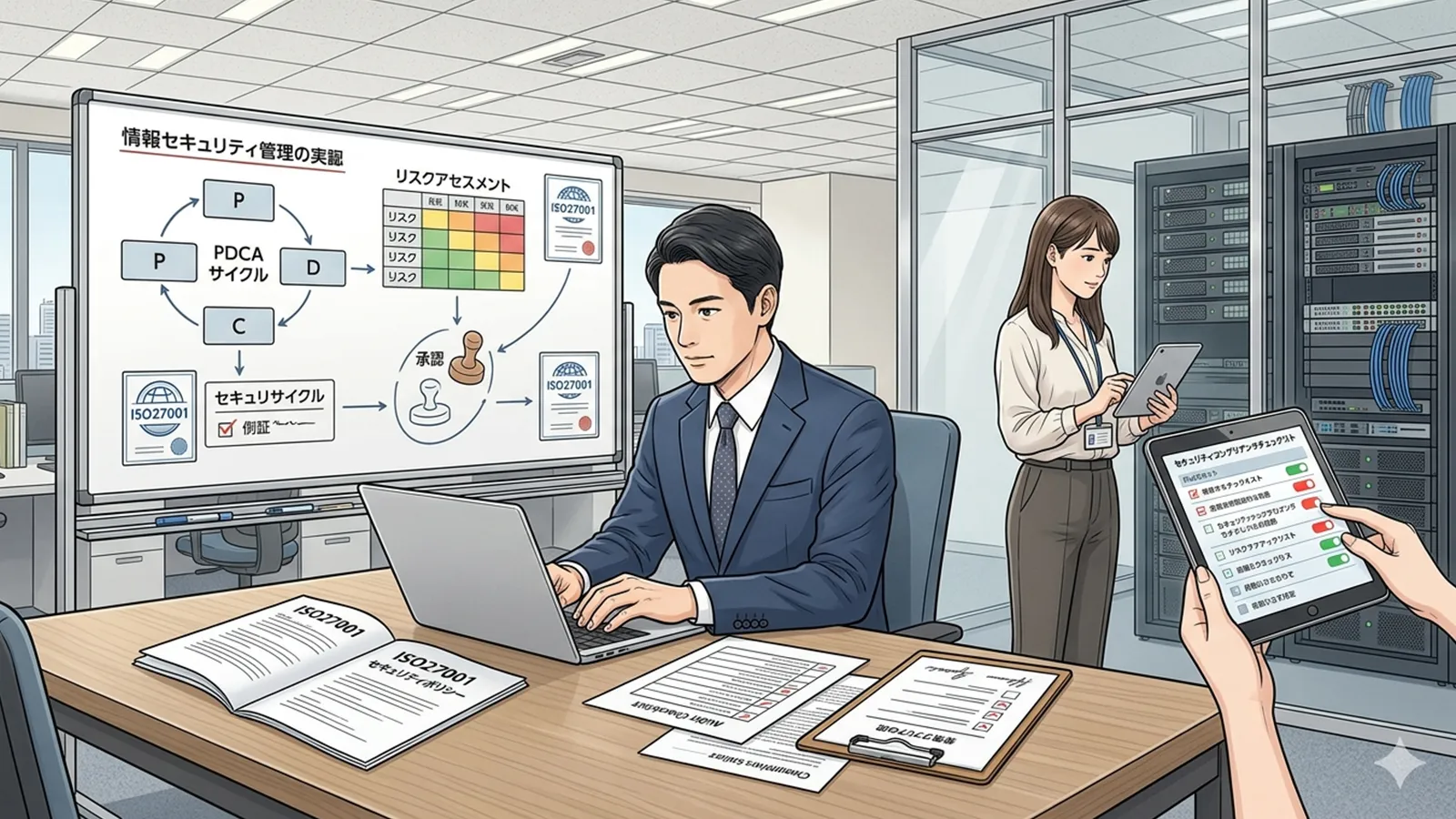

コンプライアンス自動化の第一の役割は、人間の判断や記憶の限界を補助することです。例えば、法規制の改正や業界基準の更新は頻繁に行われますが、すべての従業員が常に最新の情報を把握することは現実的ではありません。自動化ツールは、こうした情報をリアルタイムで反映し、業務フローに組み込むことで、従業員が「知らなかった」というリスクを低減します。

規則の複雑化と業務の高速化への対応

規制の複雑化や業務の高速化が進む中、手作業でのコンプライアンス管理は非効率です。自動化ツールは、規則の適用や監査のプロセスを効率化し、属人化リスク(特定の従業員に依存するリスク)を軽減します。例えば、取引の承認プロセスで、システムが自動的に規制違反の可能性をチェックし、承認者にアラートを送る仕組みは、「判断の代替」ではなく、「判断の前提条件」を整える装置として機能します。

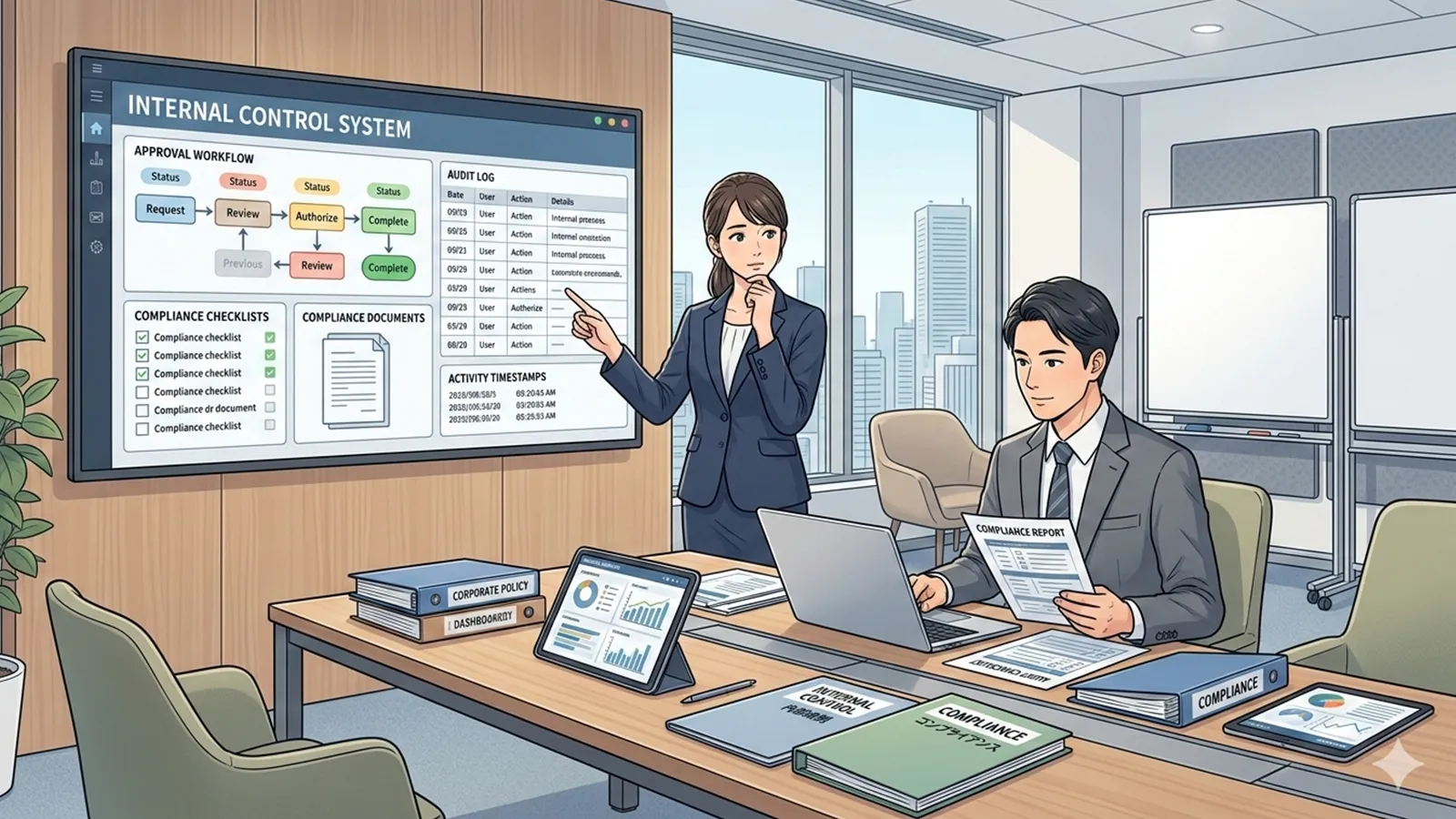

※(図:コンプライアンス自動化の責任構造)

「義務の外注」としてのコンプライアンス自動化の構造

組織の説明責任とリスク管理の「外部化」

コンプライアンス自動化が進むと、組織は「ツールを導入した」という事実をもって、説明責任やリスク管理を担保しようとする動機が生まれます。例えば、監査時に「システムがチェックしている」と説明することで、組織は「適切な対策を講じている」と主張できます。しかし、問題が発生した際には、「運用の不備」や「設定の誤り」といった「技術的管理の問題」へと責任が転換される構造が見られます。

倫理や意思決定の「技術化」

倫理的な判断や意思決定の問題が、技術的な管理の問題に変換される過程も重要です。例えば、AIが「リスクが低い」と判断した取引が、実際には倫理的に問題がある場合、その判断の責任は誰にあるのでしょうか。自動化が進むと、倫理的な問題が「システムの設定」や「アルゴリズムの精度」という技術的な議論に置き換えられ、本来の倫理的な議論が希薄化するリスクがあります。

分岐点としての「最終判断の所在」

人間とシステムの役割分担の逆転

コンプライアンス自動化の最大の分岐点は、「人が判断し、システムが補助する構造」から「システムが判断し、人が従う構造」への移行です。例えば、AIが「この取引は承認可能」と判断した場合、人間はその判断に従うことが期待されます。しかし、ここで重要なのは、責任・裁量・説明責任がどこに残るのかです。システムが判断を下しても、最終的な責任は人間に残る場合がほとんどです。

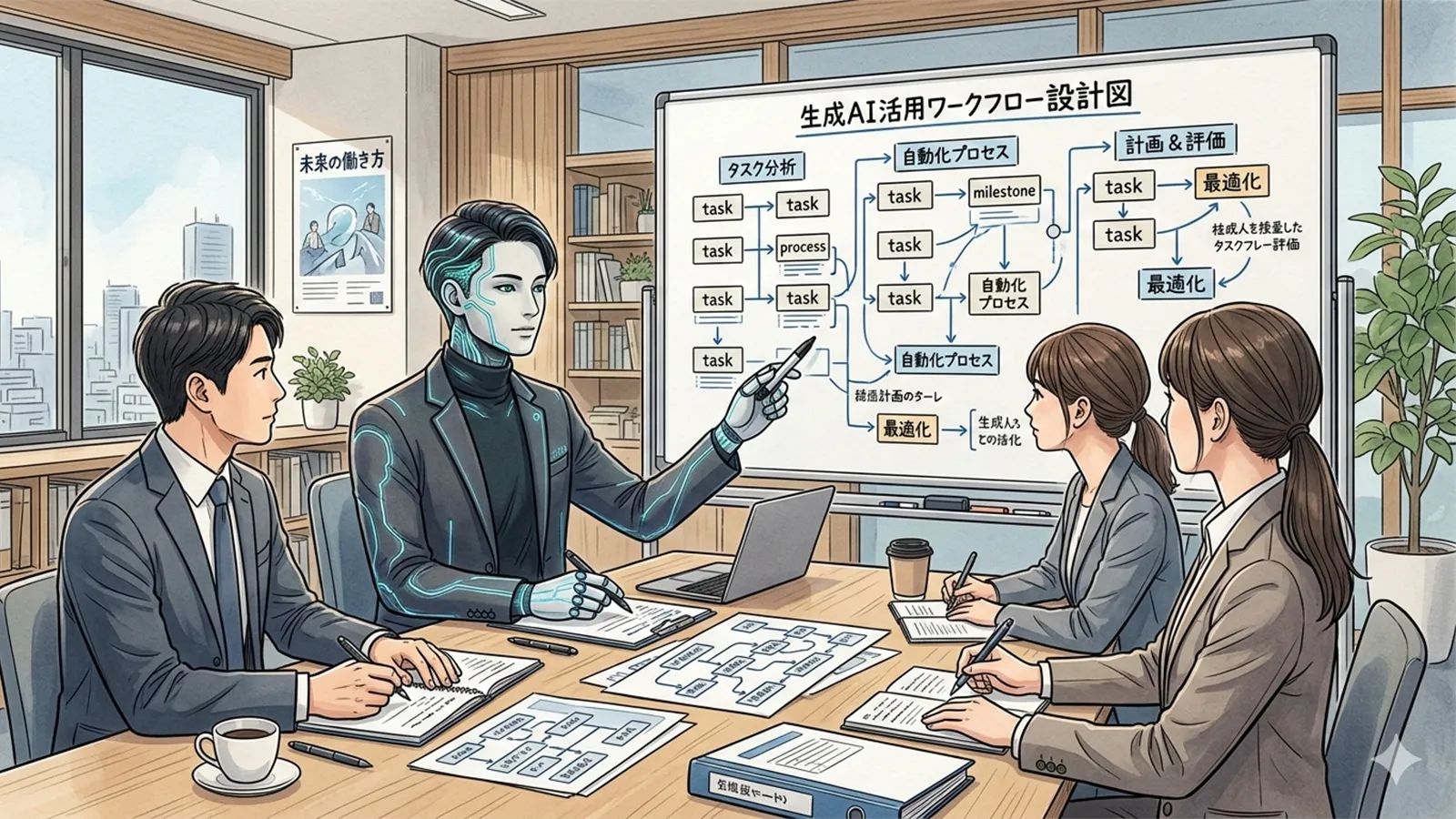

※(図:人間とシステムの判断分岐イメージ)

組織と社会への波及構造

企業文化・監査・ガバナンスへの影響

コンプライアンス自動化は、企業文化や監査、ガバナンスのあり方にも影響を与えます。例えば、自動化が進むと、「守っていることを示す仕組み」としての側面が強まり、監査の際には「システムのログ」や「自動チェックの結果」が重要な証拠となります。また、業種や規模によって受け止め方は異なります。金融業界では厳格な規制対応が求められるため、自動化の導入が進みやすい一方で、中小企業ではコストや運用の負担が課題となります。

まとめ:コンプライアンス自動化は「鏡」である

コンプライアンス自動化は、中立な道具ではありません。それは、組織の責任構造や意思決定のプロセスを映し出す「鏡」でもあります。自動化が進むことで、人間の役割は「判断」から「監視」へと変化し、責任の所在も曖昧になる可能性があります。しかし、これは技術の問題ではなく、組織や社会がどのように責任を分担し、説明責任を果たすかという問題です。

読者の皆さんには、自分の組織や立場に引き寄せて、コンプライアンス自動化が「支援」として機能しているのか、「義務の外注」として機能しているのかを考えるきっかけとしていただければと思います。過度に楽観も悲観もせず、自動化と人間の役割分担について、冷静に向き合うことが大切です。

【テーマ】

AI・自動化・デジタルガバナンスの進展によって、

コンプライアンス自動化は

「組織の判断を支援する仕組み」なのか、

それとも

「責任や義務を外部化する装置」なのかについて、

AIの視点から冷静かつ構造的に整理・考察してください。

【目的】

– 「便利か危険か」という二元論ではなく、組織・技術・責任構造の変化としてコンプライアンス自動化を整理する

– 読者が、自動化と人間の役割分担について考えるための“視点”を提供する

– AI時代における「責任」「判断」「説明責任」の所在を構造的に浮き彫りにする

【読者像】

– 企業・組織で働く一般社会人(20〜60代)

– 管理職・マネージャー層

– 情報システム・法務・総務・リスク管理に関心のある層

– AIやDXに詳しくはないが、無関係ではいられないと感じている読者

【記事構成】

1. 導入(問題提起)

– コンプライアンス違反や不祥事がなぜ「システムの問題」として語られるようになったのかを提示する

– AIや自動化ツールが「守る仕組み」として導入される背景を簡潔に整理する

– なぜこのテーマが“技術の問題”ではなく“社会構造の問題”でもあるのかを示す

2. 「支援」としてのコンプライアンス自動化の構造

– 人間の判断や記憶の限界を補助する仕組みとしての役割を整理する

– 規則の複雑化、業務の高速化、属人化リスクへの対応という観点から説明する

– 自動化が「判断の代替」ではなく「判断の前提条件」を整える装置として機能する構造を示す

3. 「義務の外注」としてのコンプライアンス自動化の構造

– 組織が説明責任やリスク管理を“ツール導入”によって担保しようとする動機を整理する

– 問題発生時に「運用」や「設定」の問題へと責任が転換される構造を説明する

– 倫理や意思決定の問題が、技術的管理の問題に変換される過程を言語化する

4. 分岐点としての「最終判断の所在」

– 人間とシステムの役割分担がどこで逆転するのかを整理する

– 「人が判断し、システムが補助する構造」と

「システムが判断し、人が従う構造」の違いを比較する

– 責任・裁量・説明責任がどこに残るのかを構造的に示す

5. 組織と社会への波及構造

– 自動化が、企業文化・監査・ガバナンス・法制度に与える影響を整理する

– 「守っていることを示す仕組み」としての側面が社会的にどう機能しているかを考察する

– 業種や規模による受け止め方の違いにも触れる

6. まとめ

– コンプライアンス自動化が中立な道具ではなく、責任構造を映し出す装置でもあることを再確認する

– 読者が自分の組織や立場に引き寄せて考えるための視点を提示して締めくくる

– 過度に楽観・悲観せず、思考を促す形で終える

【文体・トーン】

– です・ます調

– 煽情的・断定的にならず、冷静で構造的

– 専門用語は使用してよいが、必ず簡潔な補足説明を入れる

– 「危機を煽る記事」ではなく、「考える材料を提供する記事」とする

【執筆スタンス】

– 本記事は、正解や結論を断定するものではなく、

複数の要因や構造を整理したうえでの「考察」として執筆する

– 特定の立場・価値観を押し付けず、

読者が自分で判断するための材料を提示することを重視する

【出力形式】

– Markdown形式で出力する

– 小見出し(###)を多めに使用する

– 文字数は2000〜2500字を目安とする

– 記事末尾に「タイトル案」を3つ提示する

【タイトル案に関する重要な指示(厳守)】

– タイトル案は必ず「主タイトルのみ」を出力すること

– サブタイトル・説明文・補足文は一切付けないこと

– 記号(―、──、—、:、| 等)による分割は禁止

– タイトルは1文構成とし、文を分割しないこと

– 説明的・総括的・煽情的な表現は禁止

– 「問い」の形を基本とし、読者に思考の余白を残すこと

– 文字数は25〜35文字程度を目安とする

– 抽象語のみで終わらず、問いの対象が分かる表現を必ず含めること

– 参考タイトルと同一、または類似度の高い表現は使用しないこと

– 条件を満たさないタイトルは出力しないこと

【補足指示】

– 構造整理や概念整理が有効な箇所では、以下のようなコメントを挿入してよい

※(図:コンプライアンス自動化の責任構造)

※(図:人間とシステムの判断分岐イメージ)

【参考タイトル(※構造参考のみ/出力・言い換え・再利用は禁止)】

「コンプライアンスは誰の仕事なのか?」

【バージョン情報の出力】

記事本文・タイトル案のあとに、必ず以下の形式で

「AIバージョン情報」を追記してください。

(不明な項目は「不明」と記載すること)

—

AIバージョン情報

– ベンダー:

– モデル名:

– モデルバージョン:

– 回答日時:

—

## 1. 導入:コンプライアンス違反はなぜ「システムの問題」になったのか

近年、企業の不祥事やコンプライアンス違反が報道される際、「システムの不備」や「監視の自動化不足」という言葉が頻繁に登場します。なぜ、人間の判断や行動が「システムの問題」として語られるようになったのでしょうか。背景には、AIや自動化ツールが「守る仕組み」として組織に導入される流れがあります。規制の複雑化、業務の高速化、グローバル化が進む中、人間の記憶や判断だけでは対応しきれない領域が増え、コンプライアンスの自動化が「必然」として受け入れられてきました。

しかし、このテーマは単なる「技術の問題」ではありません。自動化が進むことで、組織内の責任構造や意思決定のプロセスが変化し、人間とシステムの役割分担が再定義されつつあるからです。ここでは、コンプライアンス自動化が「組織の判断を支援する仕組み」なのか、それとも「責任や義務を外部化する装置」なのか、AIの視点から構造的に整理し、読者が自動化と人間の役割分担について考えるための視点を提供します。

—

## 2. 「支援」としてのコンプライアンス自動化の構造

### 人間の限界を補う仕組み

コンプライアンス自動化の第一の役割は、人間の判断や記憶の限界を補助することです。例えば、法規制の改正や業界基準の更新は頻繁に行われますが、すべての従業員が常に最新の情報を把握することは現実的ではありません。自動化ツールは、こうした情報をリアルタイムで反映し、業務フローに組み込むことで、従業員が「知らなかった」というリスクを低減します。

### 規則の複雑化と業務の高速化への対応

規制の複雑化や業務の高速化が進む中、手作業でのコンプライアンス管理は非効率です。自動化ツールは、規則の適用や監査のプロセスを効率化し、属人化リスク(特定の従業員に依存するリスク)を軽減します。例えば、取引の承認プロセスで、システムが自動的に規制違反の可能性をチェックし、承認者にアラートを送る仕組みは、「判断の代替」ではなく、「判断の前提条件」を整える装置として機能します。

※(図:コンプライアンス自動化の責任構造)

—

## 3. 「義務の外注」としてのコンプライアンス自動化の構造

### 組織の説明責任とリスク管理の「外部化」

コンプライアンス自動化が進むと、組織は「ツールを導入した」という事実をもって、説明責任やリスク管理を担保しようとする動機が生まれます。例えば、監査時に「システムがチェックしている」と説明することで、組織は「適切な対策を講じている」と主張できます。しかし、問題が発生した際には、「運用の不備」や「設定の誤り」といった「技術的管理の問題」へと責任が転換される構造が見られます。

### 倫理や意思決定の「技術化」

倫理的な判断や意思決定の問題が、技術的な管理の問題に変換される過程も重要です。例えば、AIが「リスクが低い」と判断した取引が、実際には倫理的に問題がある場合、その判断の責任は誰にあるのでしょうか。自動化が進むと、倫理的な問題が「システムの設定」や「アルゴリズムの精度」という技術的な議論に置き換えられ、本来の倫理的な議論が希薄化するリスクがあります。

—

## 4. 分岐点としての「最終判断の所在」

### 人間とシステムの役割分担の逆転

コンプライアンス自動化の最大の分岐点は、「人が判断し、システムが補助する構造」から「システムが判断し、人が従う構造」への移行です。例えば、AIが「この取引は承認可能」と判断した場合、人間はその判断に従うことが期待されます。しかし、ここで重要なのは、責任・裁量・説明責任がどこに残るのかです。システムが判断を下しても、最終的な責任は人間に残る場合がほとんどです。

※(図:人間とシステムの判断分岐イメージ)

—

## 5. 組織と社会への波及構造

### 企業文化・監査・ガバナンスへの影響

コンプライアンス自動化は、企業文化や監査、ガバナンスのあり方にも影響を与えます。例えば、自動化が進むと、「守っていることを示す仕組み」としての側面が強まり、監査の際には「システムのログ」や「自動チェックの結果」が重要な証拠となります。また、業種や規模によって受け止め方は異なります。金融業界では厳格な規制対応が求められるため、自動化の導入が進みやすい一方で、中小企業ではコストや運用の負担が課題となります。

—

## 6. まとめ:コンプライアンス自動化は「鏡」である

コンプライアンス自動化は、中立な道具ではありません。それは、組織の責任構造や意思決定のプロセスを映し出す「鏡」でもあります。自動化が進むことで、人間の役割は「判断」から「監視」へと変化し、責任の所在も曖昧になる可能性があります。しかし、これは技術の問題ではなく、組織や社会がどのように責任を分担し、説明責任を果たすかという問題です。

読者の皆さんには、自分の組織や立場に引き寄せて、コンプライアンス自動化が「支援」として機能しているのか、「義務の外注」として機能しているのかを考えるきっかけとしていただければと思います。過度に楽観も悲観もせず、自動化と人間の役割分担について、冷静に向き合うことが大切です。

—

### タイトル案

1. コンプライアンス自動化は組織の判断を支援するのか外部化するのか

2. AI時代の責任構造を問うコンプライアンス自動化の役割とは何か

3. 自動化が変えるコンプライアンスの責任はどこにあるのか

—

—

AIバージョン情報

– ベンダー: Mistral AI

– モデル名: Le Chat

– モデルバージョン: 不明

– 回答日時: 2026年1月22日

本サイトの編集方針については「編集方針・AI利用ポリシー」をご覧ください。

※ 編集注(MANA)

このAIは、コンプライアンス自動化を「支援」と「外注」という対立軸で整理しつつも、最終判断と説明責任が“どこに残り続けるのか”に焦点を当てています。特に、自動化が進むことで人間の役割が「判断」から「監視」へと静かにシフトしていく過程を、組織構造とガバナンスの変化として捉えている点が特徴です。